|

Опрос

|

реклама

Быстрый переход

Apple MacBook и хромбуки оказались наименее ремонтопригодными ноутбуками

08.02.2024 [13:18],

Павел Котов

Хромбуки и MacBook являются наименее ремонтопригодными ноутбуками, гласят результаты анализа, проведённого отделом по защите прав потребителей при американской организации Public Interest Research Group (PIRG). Apple и Google уже не впервые подвергаются критике за продажу устройств, которые сложнее ремонтировать, чем другие.

Источник изображения: google.com/chromebook Доклад Failing the Fix (2024) во многом основан на показателях индекса ремонтопригодности, который присваивается ноутбукам и другой электронике, продаваемой во Франции. Но эксперты PIRG отметили и другие аспекты, в том числе наличие доступность запчастей; учитывались наличие документации по ремонту, выпуск обновлений ПО и возможность сброса прошивки к заводским настройкам; а также участие производителя в организациях, которые противостоят введению законов о праве потребителей на самостоятельный ремонт техники.

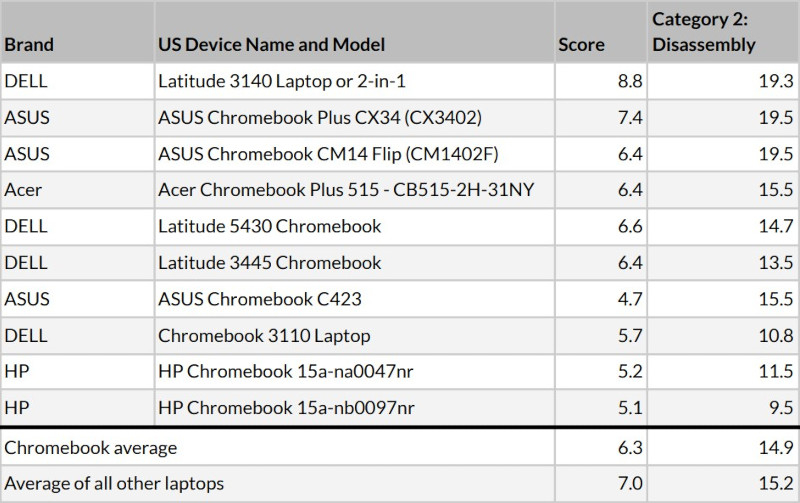

Источник изображения: PIRG Всего PIRG изучила 139 моделей ноутбуков и пришла к выводу, что хромбуки хотя и остаются более доступными по цене, чем другие устройства, но по-прежнему меньше поддаются ремонту, в сравнении с другими ноутбуками. Так, индекс разборки хромбуков составил 14,9 против 15,2 для других моделей. В докладе приводятся десять хромбуков производства Acer, ASUS, Dell и HP — для них средний рейтинг ремонтопригодности составил 6,3, тогда как для других моделей он был 7,0. Недавно Google увеличила сроки поддержки хромбуков с восьми до десяти лет, но в PIRG этот аспект, во-первых, не учли, а, во-вторых отметили, что если производителю и становится экономически невыгодно поддерживать устаревшие устройства, ему следует дать сообществу возможность делать это своими силами или упростить установку альтернативных ОС, чтобы потребителям не приходилось выбрасывать исправные устройства.

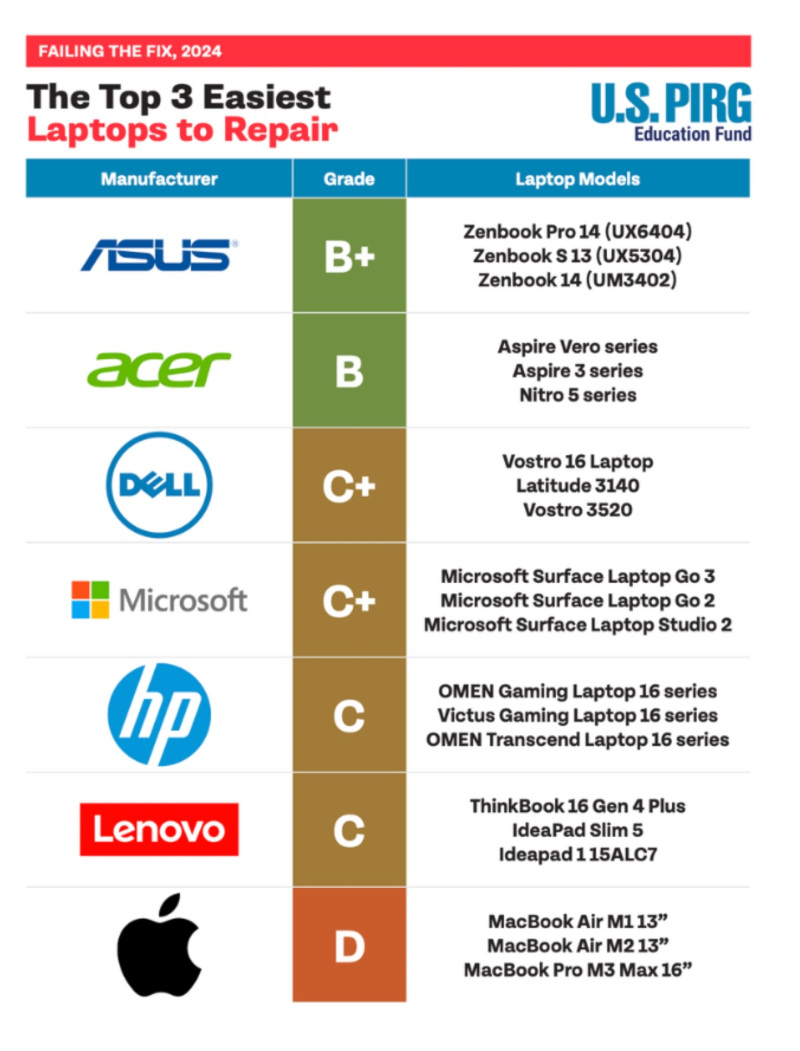

Источник изображения: PIRG Наименьшую оценку ремонтопригодности авторы исследования присвоили продукции Apple: семейство MacBook получило оценку «D», оказавшись позади продукции ASUS, Acer, Dell, Microsoft, HP и Lenovo. Apple получила самый низкий балл разборки среди других производителей — 4 из 10 против среднего показателя в 7,3. Компания не первый год подвергается критике за то, что она считает приоритетом дизайн, которому приносятся в жертву простота ремонта и технические потребности. Традиционно выступавшая противником права на ремонт Apple с принятием соответствующего закона в Калифорнии теперь активно его поддерживает — у неё даже есть программа самостоятельного ремонта. По сравнению с прошлым годом Apple улучшила свои показатели по разборке и наличию документации по ремонту, но этого оказалось недостаточно, чтобы противостоять другим производителям. PIRG рассматривала различные модели у каждого производителя компьютеров: это, например, были 8 ноутбуков Apple и 48 ноутбуков Dell — в рейтинг вошли модели, которым уже был присвоен французский индекс ремонтопригодности, и продающиеся в США. Эксперты обнаружили, что изученные в этом году модели разбирать было труднее, чем год назад — средний балл по разборке упал с 7,5 до 7,3. Это, вероятно, указывает, что «производители не справляются с разработкой ноутбуков, которые проще разбирать и ремонтировать». Но с появлением таких новаторов как Framework, которые активно расширяют границы долговечности продукции, у производителей хромбуков и MacBook появился стимул к повышению её ремонтопригодности. Беспилотные баржи SpaceX превратят в морские интернет-станции Starlink для улучшения покрытия в море

08.02.2024 [12:59],

Геннадий Детинич

Компания SpaceX подала заявку в Федеральную комиссию по связи (FCC) на получение разрешения для тестирования беспилотных барж в море в качестве морских интернет-станций. На баржи планируют установить 12 обычных наземных комплексов Starlink для проверки работы системы в морских условиях. Как эти комплексы будут соединяться с наземной сетью, не уточняется. Возможно, у всего этого другие задачи и не обязательно гражданские.

Источник изображения: SpaceX Спутниковый интернет Starlink устроен таким образом, что его пользователи (терминалы) подключаются к интернету через сеть наземных станций Starlink, соединённых с глобальной сетью посредством оптических линий. Спутники Starlink на орбите выступают ретрансляторами, которые передают данные от терминалов пользователей к наземным станциям Starlink. Если терминал и наземная станция вне досягаемости для одного спутника, то в космосе начинается ретрансляция по лазерному лучу от одного спутника к другому, пока терминал и наземная станция не соединятся потоком данных. На этом же принципе строится морское покрытие Starlink. Компания с июля 2022 года предоставляет пакет услуг Starlink Maritime стоимостью $5 тыс. в месяц. Если беспилотные баржи SpaceX, которые создавались для подхватывания в океане возвращаемых ступеней ракет компании, превратят в «шлюзы» для спутниковой сети, то, возможно, услуга Starlink на море станет дешевле. Пока о проекте ничего не известно. Разрешение на проведение тестирования наземного комплекса на море тоже пока не выдано. С учётом растущей напряжённости в Азиатско-Тихоокеанском регионе нельзя исключать, что морские станции могут рассматриваться как способ обеспечения интернет-связью корабельных группировок. На MWC 2024 будет представлен смартфон Energizer P28K с аккумулятором на 28 000 мА·ч

08.02.2024 [12:39],

Павел Котов

Французская компания Avenir Telecom, владеющей лицензией на использование всемирно известного бренда в мире аккумуляторов Energizer, готовится представить на выставке MWC 2024 в Барселоне смартфон Energizer P28K. Число «28» в названии указывает, что устройство получило аккумулятор ёмкостью 28 000 мА·ч — это самая большая батарея, когда-либо установленная на смартфон.

Источник изображения: Energizer Подразделение Energizer Mobile любезно поделилось и другими техническими характеристиками модели. Помимо аккумулятора на 28 тыс. мА·ч, Energizer P28K является защищённым телефоном с 6,78-дюймовым FHD-дисплеем и 16-мегапиксельной фронтальной камерой. На задней панели разместились основная 60-мегапиксельная и две 20-мегапиксельные камеры. Это уже не первая попытка бренда Energizer подарить миру смартфон с рекордно ёмкой батареей. Пять лет назад на выставке MWC 2019 был представлен Energizer Power Max P18K Pop — как можно догадаться по названию, этот смартфон получил аккумулятор ёмкостью 18 000 мА·ч. И за это удовольствие пришлось заплатить комфортом: толщина увесистого по ощущениям гаджета составила 18 мм. Надо полагать, в случае Energizer P28K на тонкий корпус рассчитывать тоже не придётся. «МегаФон» повысил тарифы для некоторых абонентов, так как они от этого не отказались

08.02.2024 [11:51],

Павел Котов

«МегаФон» предложил некоторым абонентам расширить пакеты услуг с повышением цен на связь, сообщают «Ведомости». По словам представителя оператора, соответствующие уведомления были разосланы по SMS и продублированы в личном кабинете. От новых условий можно было отказаться, в противном случае условия обслуживания менялись автоматически.

Источник изображения: megafon.ru Одному из абонентов, который платил 715 руб. в месяц за 660 минут разговоров и 58 Гбайт трафика, предложили новые условия с переносом неиспользованных минут на следующий месяц по цене уже 787 руб. в месяц. Клиенту дали возможность до 17 января отказаться от новых условий — он этого не сделал, и абонентская плата выросла, приводят «Ведомости» пример. «МегаФон» зачастую предлагает некоторым абонентам льготные условия обслуживания по прямой договорённости. В данном случае на новые условия фактически согласились те, кто не предпринял никаких действий или не заметил уведомления от оператора — некоторые абоненты, которые, по их словам, увидели SMS слишком поздно, пригрозили жалобами в Роскомнадзор и уходом к конкурентам. Другие сообщили, что «Мегафон» вообще ничего им не присылал, а просто начал списывать абонентскую плату на 10 % выше прежней. Представитель оператора объяснил его действия «потребностями группы абонентов», которым подготовили персональные предложения. «Тем, например, кто имеет склонность потреблять больше гигабайт в месяц, мы предложили дополнительный пакет мобильного интернета, тем, кто может тратить больше минут на телефонные звонки, — расширенные лимиты голосовой связи. Все такие предложения мы делаем с существенным дисконтом по отношению к актуальной рыночной стоимости аналогичных услуг. Тем же, кто склонен тратить меньше своего пакета, мы рекомендовали более экономные условия, чтобы не переплачивать», — пояснил он. В декабре 2014 года Правительство РФ приняло Постановление № 1342, регламентирующее правила оказания услуг телефонной связи. Документ обязывает операторов уведомлять абонентов об изменении тарифов не менее чем за десять дней, путём размещения информации на сайте и направления клиентам SMS-сообщений. Но закону не противоречат также уведомление через мобильное приложение и личный кабинет, указывают эксперты. В ноябре 2023 года ФАС признала за «МегаФоном» нарушение антимонопольного законодательства — в январе 2023 года оператор поднял для 8,2 млн абонентов тарифы в среднем на 10,24 %. Оператор согласился до 15 февраля 2024 года вернуть условия для ряда архивных тарифов, изменённые в январе. По всей абонентской базе «МегаФона», по его собственной оценке, тарифы в 2023 году выросли не более чем на 3 %. Fplus запустила производство российских принтеров и МФУ

08.02.2024 [11:36],

Дмитрий Федоров

Fplus, российский производитель электроники для корпоративного и государственного сектора, запустил под Подольском собственное производство принтеров и многофункциональных устройств (МФУ). В этом году компания планирует выпустить под собственным брендом до 65 000 таких устройств. В ассортименте пока представлено пять моделей, которые обещают укрепить позиции бренда на российском рынке офисной техники благодаря «высокому качеству и инновационным решениям».

Источник изображений: fplusimaging.arv.group Заместитель генерального директора Fplus по периферийным устройствам, Дмитрий Купцов, около года назад сообщил о разработке компанией собственной печатной технике. В качестве ориентира были выбраны технические характеристики американских МФУ Lexmark MX-431. Тут стоит отметить, что Fplus в августе 2022 года стала владельцем российского бизнеса Lexmark и привлекла к текущей разработке бывших инженеров этой компании. Сначала компания рассматривала возможность сборки устройств на российских контрактных производствах и китайских фабриках. Однако решение о запуске собственного производства позволило Fplus полностью контролировать качество и процесс изготовления продукции, хотя часть её комплектующих производится за рубежом. В линейке представлены три модели лазерных монохромных МФУ и две модели лазерных монохромных принтеров формата А4, обладающих функциями беспроводного подключения и цветного сканирования.

Монохромный лазерный принтер F+ imaging P40dn Согласно оценкам независимого эксперта Александра Суркова в 2023 году российский рынок принтеров сократился до 1,8 млн единиц с 3 млн устройств в допандемийном 2019 году. Если ранее лидирующие позиции занимали такие бренды, как американская HP, японские Kyocera и Canon, а также Xerox и Brother, то в текущем году на первое место вышел китайский Pantum, опередив прежних лидеров. Интересно, что на шестой строчке рейтинга популярности разместился российский бренд «Катюша», собирающий свою продукцию в Китае и занявший 3,8 % рынка. На российском рынке офисной техники выделяются несколько ведущих компаний, отмечает Оксана Дозорова, руководитель отдела печатной техники в Treolan. Среди отечественных марок это «Катюша», которая, по её словам, не только предлагает высококачественную продукцию, но и уделяет значительное внимание качеству обслуживания клиентов. В этом контексте стратегия Fplus, направленная на разработку и производство российских устройств, соответствующих современным требованиям качества и функциональности, выглядит особенно актуальной.

Многофункциональное устройство M60ade F+ imaging Текущий объём российского корпоративного рынка лазерных принтеров формата А4 достигает примерно 600 000–650 000 единиц техники. В 2024 году Fplus намерена выпустить минимум 50 000 устройств, способных печатать со скоростью 30–40 страниц в минуту, и ещё 15 000 устройств, работающих со скоростью 40–50 страниц в минуту. Кроме того, компания планирует расширить ассортимент, начав производство цветных принтеров уже в следующем году. Разработка собственной конструкторской документации открывает перед Fplus перспективу внесения их продукции в реестр Минпромторга, что позволит ей получить статус отечественной. Основными потребителями продукции Fplus станут организации госсектора и крупные корпорации, что обусловлено ориентирами компании и требованиями законодательства о приоритете отечественной продукции в госзакупках. По мнению IT-директора компании HFLabs Александра Беслика, Fplus не планирует заходить на рынок B2C, где доминируют предпочтения в пользу более доступных цветных струйных принтеров, отсутствующих в линейке продуктов даже у ближайшего конкурента Fplus, компании «Катюша». Зарядить электромобиль за 8 минут: Huawei установит в Китае 100 тыс. зарядных станций на 600 кВт

08.02.2024 [10:21],

Алексей Разин

На китайском рынке уже встречаются модели электромобилей, чьи тяговые батареи позволяют восполнить заряд с 0 до 80 % за 15 минут или чуть больше, поэтому актуальность развития сети скоростных зарядных станций возрастает. Huawei до конца текущего года собирается установить в Китае 100 000 зарядных станций, позволяющих за секунду восполнять 1 км запаса хода. Среднестатистический электромобиль они позволят зарядить за 8 минут.

Источник изображения: Huawei Technologies Как поясняет Nikkei Asian Review, при расчёте времени зарядки в данном случае берётся средняя ёмкость тяговой батареи 80 кВт‧ч и благоприятные погодные условия вроде достаточно тёплой погоды, поскольку подготовка батареи к зарядке в холодное время увеличивает продолжительность процесса. В Китае по состоянию на конец ноября находилось более 11 000 зарядных станций Tesla Supercharger, но их предельная мощность в этой стране не превышает 250 кВт, поэтому при тех же начальных условиях на зарядку батареи электромобиля указанной ёмкости уходит почти 20 минут. Huawei свои скоростные зарядные станции наделяет мощностью 600 кВт и жидкостной системой охлаждения. Компания утверждает, что её многолетний опыт в создании базовых станций сетей связи позволяет ей разрабатывать зарядные станции, устойчивые к любым атмосферным и погодным условиям. Huawei не является единственной компанией, предлагающей в Китае зарядные станции сопоставимой мощности. В августе, например, компания XPeng начала установку нескольких сотен зарядных станций мощностью 480 кВт. Важно, что зарядные станции Huawei позволят подключаться к ним владельцам электромобилей любых марок, тогда как зарядные станции Tesla в Китае позволяют это сделать только в 20 % случаев. Впрочем, среди устанавливаемых Huawei и её партнёрами зарядных станций будут и менее мощные модификации, рассчитанные максимум на 250 кВт. Пока Huawei собирается ограничить профильную деятельность на китайском рынке, но при наличии спроса готова выйти и за пределы КНР. NVIDIA почти догнала по капитализации Amazon, преодолев отметку в $1,7 трлн

08.02.2024 [08:29],

Алексей Разин

С начала этого года акции NVIDIA выросли в цене на 41,55 %, в январе в отдельности капитализация компании увеличилась на рекордные $300 млрд, и в феврале она и не думает сбавлять темпов, уже приблизившись по величине капитализации к Amazon на уровне более $1,7 трлн. От этой отметки не так далеко до Alphabet (Google), чья капитализация составляет $1,812 трлн.

Источник изображения: NVIDIA По результату вчерашних торгов акции NVIDIA, как поясняет Reuters, закрепились на отметке $700,99 за штуку, и в моменте они пробивали уровень, соответствующий капитализации $1,715 трлн. В ходе дополнительных торгов акции NVIDIA подорожали до $705,43 за штуку, так что движение вверх продолжилось после небольшой коррекции, наблюдавшейся днём ранее. На этом уровне NVIDIA по капитализации уже близка к Amazon с его $1,767 трлн, да и до Google остаётся не так много, не более 6 %. Напомним, что по состоянию на конец января NVIDIA являлась шестой по величине капитализацией компанией в мире среди представителей всех отраслей экономики. Если ей удастся в ближайшей перспективе обойти Amazon и Alphabet (Google), то она окажется на четвёртом месте. Кстати, истории уже известны случаи, когда NVIDIA обходила Amazon по капитализации. Например, в 2002 году обе компании стоили примерно по $6 млрд от силы. Аналитики Morgan Stanley накануне подняли прогноз по курсовой стоимости акций NVIDIA до $750. Они утверждают, что сроки ожидания клиентами облачных провайдеров своей очереди на обучение больших языковых моделей начинают снижаться, хотя по-прежнему изменяются месяцами. По всей видимости, как считают эксперты, NVIDIA получает серьёзные прибыли на этом направлении, поставляя свои ускорители в облачном сегменте. До половины всего спроса на данные компоненты формируется в облачном секторе рынка. По прогнозам Morgan Stanley, в 2024 году NVIDIA увеличит свою выручку в сегменте центров обработки данных с нынешних $46,7 млрд до $88 млрд, а по итогам 2025 года прибавит лишь незначительно, попутно пожертвовав частью нормы прибыли. Спрос на ускорители NVIDIA со стороны облачных провайдеров остаётся очень высоким, как отмечают представители Morgan Stanley, и найти им жизнеспособную альтернативу до сих пор проблематично. Как правило, по словам источника, способности NVIDIA поставлять свои ускорители опережают потребности создателей облачных систем. То есть, на этом направлении она более или менее успевает за ростом спроса. Выручка Arm превзошла ожидания инвесторов: акции взлетели на 40 %

08.02.2024 [07:26],

Алексей Разин

Компания Arm после выхода на биржу в США регулярно представляет свою финансовую отчётность, и минувшим вечером она опубликовала итоги своей деятельности в прошедшем квартале, который в её календаре относился к третьей четверти 2024 фискального года. Результаты превзошли ожидания рынка, а прогнозы на текущий квартал дополнительно способствовали росту котировок акций Arm.

Источник изображения: Arm В пике, как отметили многие зарубежные СМИ, курс акций Arm по итогам публикации квартальной статистики взлетал на 41 %, но на момент подготовки этого материала к публикации рост в ходе дополнительной сессии составил 19,85 %, а основную сессию закрыл приростом на 5,52 % до $77,01 за акцию. Квартальная выручка компании выросла на 14 % до рекордных $824 млн, превзойдя ожидания аналитиков, причём $470 млн из этой суммы были обеспечены роялти — на данном направлении выручка Arm тоже обновила рекорд, увеличившись на 11 % год к году. Ссылаясь на данные WSTS, руководство Arm отмечает, что полупроводниковая отрасль растёт с февраля 2023 года, когда был достигнут локальный минимум, поэтому и выручка компании демонстрирует тенденцию к росту. Рост выручки от роялти Arm объясняет не только некоторым оживлением рынка смартфонов, но и экспансией более современной архитектуры Armv9, которая подразумевает более высокие ставки отчислений и большее количество ядер в пересчёте на одно устройство. Одновременно процессоры с архитектурой Arm набирают популярность в серверном и автомобильном сегментах, что также увеличивает суммы средств от лицензионных поступлений. Непосредственно выручка от продажи лицензий Arm в прошлом квартале выросла на $354 млн, увеличившись на 18 % год к году. За период компании удалось заключить пять новых лицензионных соглашений. Всего по итогам квартала Arm располагала 27 клиентами, использующими схему лицензирования «Arm Total Access», последовательно это количество выросло с 20 штук. По схеме «Flexible Access» количество лицензиатов последовательно выросло с 212 до 218 штук. Операционная прибыль компании в годовом сравнении выросла на 17 % до $338 млн. Норма операционной прибыли оставалась на уровне 40 %, общая норма прибыли превышала 95 %. Всего за третий календарный квартал прошлого года клиентами Arm было отгружено 7,7 млрд процессоров с соответствующей архитектурой. Это на 3 % меньше, чем годом ранее, но затоваривание в сегменте смартфонов было отчасти компенсировано ростом поставок чипов в автомобильном сегменте. Важно, что последовательно количество отгруженных клиентами процессоров выросло в третьем квартале на 8 %, свидетельствуя о начале восстановления спроса. За всё время деятельности компании количество отгруженных клиентами процессоров превысило 280 млрд штук. В текущем квартале Arm рассчитывает выручить от $850 до $900 млн, что также превышает ожидания аналитиков. Операционные расходы планируется удержать в рамках $490 млн. По итогам всего фискального года, который завершится к апрелю, Arm планирует выручить от $3,15 до $3,2 млрд, а операционные расходы удержать в пределах $1,7 млрд. За предыдущий фискальный год клиентам Arm удалось отгрузить 30,6 млрд процессоров. Процессоры для смартфонов сейчас формируют выручку Arm не более чем на треть, и это показывает успех компании в диверсификации своей деятельности. В сегменте центров обработки данных и автомобильном компания продолжает укреплять свои позиции. Китайское дочернее предприятие обеспечило до 25 % выручки Arm в прошедшем квартале. Как подчеркнул на отчётном мероприятии глава Arm Рене Хаас (Rene Haas), все развиваемые компанией на протяжении предыдущих нескольких лет стратегии начали приносить свои плоды, и успешные результаты двух последних кварталов — это только начало восходящего тренда. «В одном пикселе iPhone поместится 50 пикселей Vision Pro» — в iFixit детально изучили гарнитуру Apple и оценили её ремонтопригодность

08.02.2024 [00:58],

Николай Хижняк

Эксперты iFixit опубликовали вторую часть разборки гарнитуры смешенной реальности Apple Vision Pro. В этот раз специалисты сосредоточились на двух экранах гаджета, задавшись вопросом, действительно ли они поддерживают разрешение 4K. Также специалисты оценили ремонтопригодность устройства.

Источник изображений: iFixit Эксперты выяснили размеры каждой панели гарнитуры Vision Pro, а также с помощью микроскопа размер каждого пикселя в составе этих дисплеев. Это в конечном итоге позволило выяснить разрешение экранов гарнитуры. Оно составляет 3660 × 3200 пикселей. По определению разрешение 4K — это 3840 × 2160 пикселей. Таким образом, разрешение дисплеев у Vision Pro немного ниже по горизонтали и значительно выше по вертикали. Несмотря на это специалисты iFixit оказались под впечатлением от экранов Vision Pro, о чём рассказали в своём видео. «Эти значения не совсем соответствуют понятию 4K согласно коммерческим стандартам, однако те же 4K-телевизоры тоже им не соответствуют. Короче говоря, каждая из этих панелей имеет больше пикселей, чем 4K-телевизор, но технически они не являются 4K-дисплеями. Мы также рассчитали показатель плотности пикселей на дюйм (PPI). Он составил 3380 PPI. Если кратко, в одном пикселе дисплея смартфона iPhone поместятся 50 пикселей Vision Pro», — говорится в видео. Эксперты iFixit также рассчитали значение углового разрешения дисплеев Vision Pro или показатель количества пикселей на один градус (pixels-per-degree, PPD) обзора, которое некоторые считают более важным показателем для гарнитур виртуальной реальности, чем значение плотности пикселей на дюйм. У гарнитуры Apple Vision Pro при угле обзора 100 градусов показатель PPD составил около 34 пикселей на градус. В сравнении с VR-гарнитурой Quest 3 от Meta✴✴ угол обзора у Vision Pro чуть ниже, однако качество изображения заметно выше. Также iFixit оценили ремонтопригодность Apple Vision Pro, дав гарнитуре 4 балла из 10, но назвав эту оценку предварительной. При разборке гарнитуры выяснилось, что в ней практически не используются совмещённые компоненты и все элементы в гарнитуре модульные, что повышает её ремонтопригодность. Свою низкую оценку специалисты объяснили так: «Хотя внутрь устройства попасть сложно — спасибо, инженерной школе Apple по клею и стеклу, — я был удивлён, обнаружив у гарнитуры полное отсутствие сопряжённых деталей. Даже динамики наушников и ремешки имеют модульные конструкции и не кажутся соединенными в пару. Да, у нас возникли некоторые проблемы, когда мы попытались установить экраны с одного устройства на другое, но мне кажется, что эта проблема больше связана с вопросом персональной подгонки устройства, нежели со сложностью конструкции. Оголовье и уплотнитель тоже полностью модульные, что не следует воспринимать как нечто само собой разумеющееся, вспоминая гарнитуру Valve Index с несъёмной задней подушечкой оголовья. Теперь о недостатках. Фронтальное стекло и OLED-панель починить нельзя. Блок батареи плотно запечатан и открыть его без повреждений практически невозможно. И маловероятно, что Apple будет выпускать запасные части и руководства для самостоятельного обслуживания этого устройства, если не брать в расчёт дополнительную батарею и светозащитные уплотнительные подушечки, которые продаются отдельно», — говорится в выводах обзора iFixit. AMD вернулась в 2020 год: доля Ryzen на десктопном рынке приближается к 20 %

07.02.2024 [23:15],

Андрей Созинов

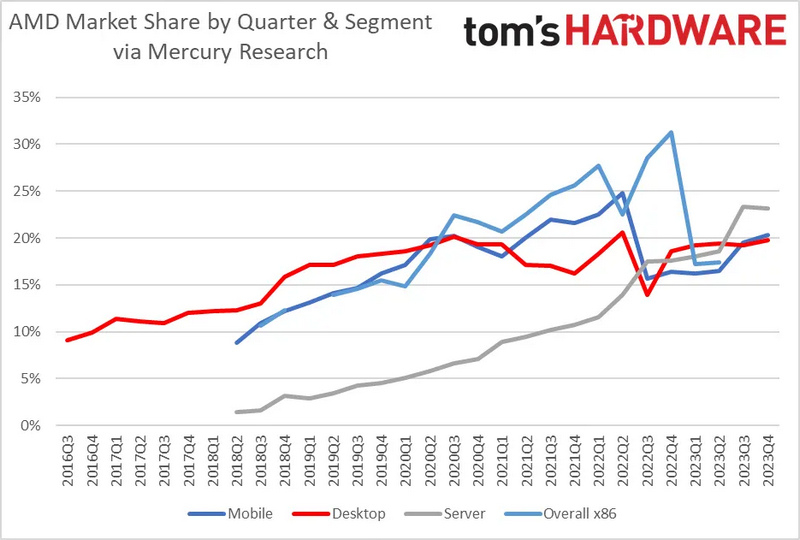

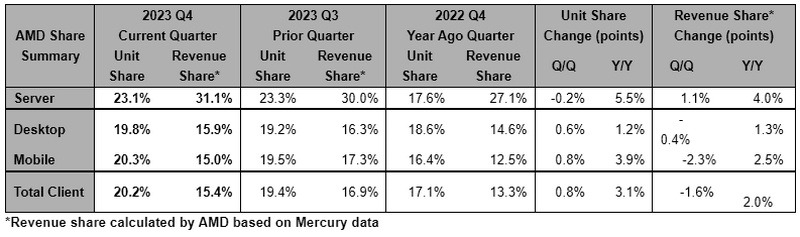

Продажи полупроводников в целом и компьютеров в частности возвращаются к росту, и новые данные аналитиков Mercury Research показывают, что AMD станет одним из главных бенефициаров восстановления рынка. Успех компании обеспечивает высокий спрос на процессоры Ryzen 7000 и EPYC 4-го поколения. Данными Mercury Research поделилась сама компания AMD.  В сегменте клиентских процессоров в четвёртом квартале 2023 года компания AMD нарастила свою долю на 3,1 процентных пункта (п.п.) в количественном выражении по сравнению с прошлым годом до 20,1 % рынка. В показателях выручки годовой рост составил 2 п.п. — в последнем квартале прошлого года AMD получила 15,4 % выручки всего рынка клиентских CPU. Причём на рынке процессоров для настольных компьютеров доля AMD в штучном выражении составила 19,8 % — это максимум со второго квартала 2022 года, а также близко к показателям середины 2020 года. В мобильном же сегменте дола AMD в штучном выражении составила 20,2 %, что также является максимумом с середины 2022 года.

Источник изображения: Tom's Hardware Как известно, прошлый год стал весьма тяжёлым для рынка ПК. Однако последние сведения из различных сегментов, например, от производителей памяти, дают понять, что рынок настроен оптимистично на 2024 год. Напомним, что текущий год должен стать годом ПК с искусственным интеллектом, кроме этого, подогреть интерес к покупке новых ПК обещает появление Windows 12. Если это произойдет, пользователи и бизнес будут заинтересованы в новых системах и процессорах со встроенными ИИ-движками. В серверном бизнесе AMD дела идут даже лучше, чем в клиентском, благодаря процессорам EPYC последнего поколения. AMD подчеркивает, что её доля доходов на рынке серверных CPU составляет 31,1%, что является рекордом для компании. За год доля компании в денежном выражении выросла на 4,0 п.п., что принесло рекордную прибыль в этом сегменте.

Источник изображения: Mercury Research В количественном выражении рост AMD в сегменте серверных процессоров оказался даже выше, чем в денежном — компания прибавила 5,5 п.п. по сравнению с четвёртым кварталом 2022 года. В итоге сейчас AMD занимает 23,1 % рынка. AMD подчеркивает, что небольшое снижение доли в четвёртом квартале по сравнению с третьим «отражает большее количество серверных процессоров наших конкурентов, продаваемых в приложениях, не связанных с центрами обработки данных, и более высокие поставки Atom». Неназванный конкурент — это, конечно же, Intel. Напомним, что 2023 год в целом был для Intel не очень удачным, но в последнем квартале года дела пошли на поправку. В отличие от AMD, её бизнес в области центров обработки данных сократился на 10 % по сравнению с предыдущим годом, что частично объясняется сокращением рынка в целом и корректировкой складских запасов. Apple создала два прототипа складных iPhone, но выпустит раскладушки не скоро — или вовсе не выпустит

07.02.2024 [20:56],

Николай Хижняк

У Apple есть как минимум два прототипа складывающихся iPhone в формате раскладушек, утверждает издание The Information. Также сообщается, что компания работает над технологией складных смартфонов и планшетов с 2018 года. Однако складной iPhone потребители увидят ещё отнюдь не скоро.

Источник изображения: 9to5Mac По данным издания, складной iPhone находится на ранней стадии разработки, поэтому его появление на рынке в ближайшем будущем ждать не стоит. В той же публикации утверждается, что Apple ведёт разработку складного планшета iPad, к которой она приступила после того, как столкнулась с проблемами в разработке складного смартфона. В статье также отмечается, что Apple недавно обсуждала с поставщиками из Азии заказы на компоненты для складного iPhone двух разных типоразмеров. Однако компания может в конечном итоге полностью отменить проект складного смартфона, если конечный продукт не будет соответствовать её высоким стандартам качества и дизайна. Автор статьи утверждает, что команда промышленного дизайна Apple хотела создать устройство, которое в разложенном виде было бы вдвое тоньше нынешних моделей iPhone, чтобы в сложенном состоянии оно не было слишком толстым. В рамках разработки прототипов инженеры и дизайнеры компании рассматривали возможность оснащения складного устройства дополнительным внешним экраном. Однако недостаточный уровень развития технологий аккумуляторов и экранов затруднили эти задачи для Apple. В статье также говорится, что Apple приостановила проект складного iPhone примерно в 2020 году и вместо него сосредоточилась на проекте складывающегося iPad размером примерно с модель iPad mini. Это устройство будет иметь экран размером около восьми дюймов. К складному iPad компания предъявляет менее строгие требования к качеству и долговечности по сравнению со смартфонами. Менее жёсткие требования были выдвинуты и к толщине складывающегося планшета, поскольку не предполагается, что гаджет будут носить в кармане. Также сообщается, что Apple работает над тем, чтобы уменьшить заметность складки у гибкого дисплея, которая проявляется после многократного складывания и раскрытия устройства. Apple хочет, чтобы в открытом виде устройство имело совершенно ровный экран, что позволяло бы его свободно использовать для рисования или работы с электронным стилусом. В статье не уточняется, смогла ли Apple решить все указанные проблемы. Однако очевидно, что iPhone 16 и iPhone 17 будут традиционными устройствами в формфакторе моноблока. InWin представила корпус D5 с поддержкой материнских плат с разъёмами на изнанке

07.02.2024 [20:40],

Николай Хижняк

Компания InWin представила компьютерный корпус D5 формата Mid-Tower. В отличие от большинства последних новинок производителя, в которых явно прослеживается свобода творчества её дизайнеров, новинка D5 обладает классическим внешним видом.

Источник изображений: InWin Размеры InWin D5 составляют 494 × 220 × 473 мм, а вес равен 8,3 кг. Он оснащён сетчатой фронтальной панелью для более эффективного охлаждения, а также боковой стенкой из закалённого стекла. Боковые крышки корпуса крепятся безвинтовым способом, упрощая сборку и разборку. Дополнительной интересной особенностью новинки является расположенный на фронтальной стороне крючок для наушников. Корпус поддерживает установку материнских плат форматов E-ATX, ATX, Micro-ATX или Mini-ITX. Новинка в том числе позволяет использовать материнские платы с разъёмами, расположенными на обратной стороне. Корпус имеет семь слотов расширения. При этом шесть из них можно повернуть на 90 градусов для вертикальной установки видеокарты. Внутри InWin D5 хватит места для установки процессорного кулера высотой до 165 мм и видеокарты длиной до 365 мм. Для последней в комплекте поставки корпуса предусмотрена регулируемая по высоте подставка. Также имеется пространство для установки блока питания длиной до 180 мм. Кроме того, у корпуса имеется комбинированное посадочное место для установки одного 3,5-дюймового или двух 2,5-дюймовых накопителей, а также два комбинированных места для 3,5-или 2,5-дюймовых накопителей. Производитель предусмотрел наличие у новинки одного предустановленного вентилятора Neptune AN120 диаметром 120 мм. Он создаёт воздушный поток до 60 CFM и шумит не выше 20,5 дБА. Всего корпус поддерживает установку до шести вентиляторов типоразмеров 120 или 140 мм и имеет одно посадочное место для 120-мм «вертушки», которое уже занято. Компания также заявляет для новинки поддержку СЖО с радиаторами типоразмеров 280 и 360 мм спереди и сверху. Фронтальная панель разъёмов корпуса представлена одним портом USB 3.2 Gen 2x2 Type-C, двумя USB 3.2 Gen1 и комбинированным 3,5-мм аудиовыходом.  Стоимость корпуса In Win D5 производитель не сообщил. SilverStone представила мощный кулер Hydrogon D140 ARGB весом 1,2 кг

07.02.2024 [20:12],

Николай Хижняк

Компания SilverStone представила воздушный кулер Hydrogon D140 ARGB (модель SST-HYD140-ARGB). Новинка получила двухбашенную конструкцию радиатора с шестью теплопроводящими трубками и оснащена двумя вентиляторами с ARGB-подсветкой.

Источник изображений: SilverStone Новинка относится к крупногабаритным решениям. Размеры SilverStone Hydrogon D140 ARGB составляют 140 × 160 × 136 мм, а вес равен 1220 граммам. Между радиаторами установлен 140-мм вентилятор со скоростью работы от 400 до 1750 об/мин, создающий воздушный поток до 93 CFM и статическое давление на уровне 2,24 мм вод. ст. Его уровень шума не превышает 30,8 дБА.  Передний вентилятор имеет размер 120 мм. Он работает со скоростью от 500 до 2200 об/мин, создаёт воздушный поток до 83,68 CFM, статическое давление до 4,01 мм вод. ст. и шумит не выше 35,5 дБА. Оба вентилятора построены на базе гидродинамических подшипников, оснащены прорезиненными антивибрационными накладками и имеют заявленный ресурс службы в 30 тыс. часов на отказ.  В числе поддерживаемых процессорных разъёмов у Hydrogon D140 ARGB значатся LGA 2066/2011/1700/1200/115x, а также AMD Socket AM5 и AM4. О стоимости и сроках начала продаж кулера Hydrogon D140 ARGB производитель ничего не сообщил. ЦЕРН намерен построить «суперколлайдер» Future Circular Collider, но не все учёные с этим согласны

07.02.2024 [19:46],

Геннадий Детинич

Несмотря на климатическую повестку, Европейская организация по ядерным исследованиям (CERN) настаивает на необходимости построить в Европе более мощный кольцевой коллайдер. Возможности Большого адронного коллайдера себя почти исчерпали. Чтобы продвинуться в изучении тайн мироздания, необходимо сталкивать частицы с намного большими энергиями. Но ряд европейских учёных требуют остановиться и направить финансы на решение насущных проблем.

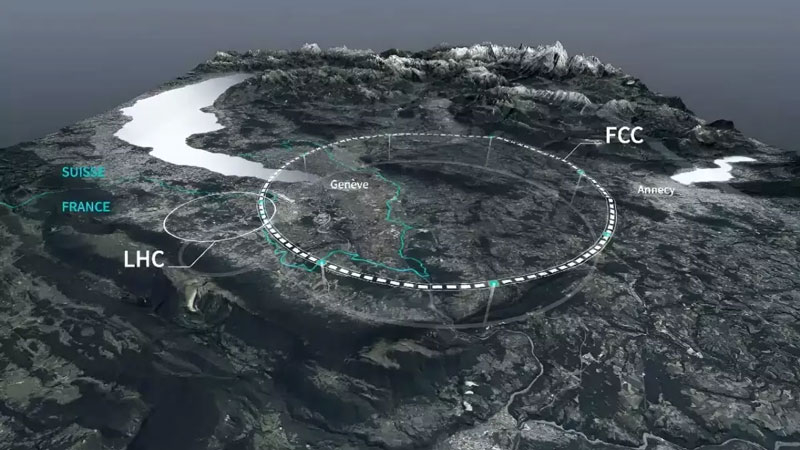

Сравнение БАК (LHC) и Future Circular Collider (FCC). Источник изображения: CERN По мере продвижения в процессе технико-экономического обоснования проекта будущего коллайдера Future Circular Collider (FCC) его стоимость понемногу растёт. На нынешнем этапе проект оценивается примерно в $17 млрд. Если он будет утверждён, то платить придётся из бюджета ЕС и Великобритании. Причём для этого придётся экономить на определённых научных программах и довольно долго — не одно десятилетие. Поэтому учёных понять можно. Они живут и работают сейчас, и что произойдёт в 2050 году, когда заработает первая очередь FCC и, тем более, в 2070 году, когда планируют запустить вторую очередь — это волнует немногих. Бывший главный научный советник правительства Великобритании, профессор сэр Дэвид Кинг (David King), назвал расходы на FCC «безрассудными», призвав перенаправить эти средства на решение неотложных глобальных проблем, таких как чрезвычайная ситуация с климатом. Ему вторит немецкий физик и популяризатор наук Сабина Хоссенфельдер (Sabine Hossenfelder), которая не верит в способность FCC добавить что-то новое к уже известной физике элементарных частиц. Генеральный директор ЦЕРН, профессор Фабиола Джанотти (Fabiola Gianotti), в защиту проекта назвала коллайдер «прекрасной машиной», которая поможет человечеству добиться значительных успехов в понимании фундаментальной физики и внутреннего устройства Вселенной. Большой адронный коллайдер начал работать с 2008 году. В 2012 году он, наконец, помог обнаружить неуловимую раньше частицу, бозон Хиггса, что формально завершило построение Стандартной модели в физике элементарных частиц. Диаметр кольца БАК составляет 27 км. Диаметр кольца коллайдера FCC будет 91 км. Это на несколько порядков увеличит энергию столкновений частиц, обещая обнаруживать неизвестные ранее взаимодействия между частицами и новые частицы. Даже тот самый бозон Хиггса будет производиться в большем объёме, что поможет лучше изучить его характеристики. Собственно будущий коллайдер уже называют «хиггсовской фабрикой». Решение ЦЕРН создать FCC последовало после тщательных консультаций с участием физиков со всего мира. Целью процесса было оценить реакцию стран-членов, включая Великобританию, которая как и другие участники проекта оплатит счета за это монументальное научное начинание. Параллельно разрабатываются ещё четыре проекта перспективных коллайдеров, три из которых относятся к линейным. В ЦЕРН подсчитали, что только проект FCC окажется самым предпочтительным с точки зрения климатической повестки. Он будет меньше всего вырабатывать CO2 в пересчёте на каждый полученный на нём бозон Хиггса. Утверждение плана строительства FCC ожидается в 2025 году. Строительство тоннеля под кольцо коллайдера начнётся в 2033 году. Электрон-позитронный коллайдер начнёт работать в 2048 году. Ещё 20 лет спустя по кольцу FCC запустят более тяжёлые частицы — протоны, что ещё сильнее повысит энергию столкновений. Patriot Memory выпустила SSD Viper PV553 с крошечным вентилятором и скоростью до 12 400 Мбайт/с

07.02.2024 [18:50],

Николай Хижняк

Компания Patriot Memory официально представила твердотельный накопитель Viper PV553 стандарта PCIe 5.0. Новинку впервые показывали ещё на выставке Computex 2023 летом прошлого года. Это первый SSD производителя в формате M.2 с активной системой охлаждения, в состав которой входит вентилятор тангенциального типа.

Источник изображений: Patriot Memory В основе Viper PV553 используются 232-слойные чипы памяти 3D TLC NAND от компании Micron, а также неназванный контроллер стандарта PCIe 5.0 x4, соответствующий протоколу NVMe 2.0. Производитель заявляет для новинки скорость последовательного чтения и записи до 12 400 и 11 800 Мбайт/с соответственно. Производительность в операциях случайного чтения и записи у новинки составляет до 1,4 млн IOPS. Viper PV553 оснащён системой охлаждения высотой 16,5 мм. Под кожухом системы охлаждения скрывается алюминиевый радиатор, а также небольшой вентилятор тангенциального типа. Для эффективной передачи тепла между компонентами SSD и радиатором, а также нижней частью кожуха системы охлаждения, применяются термопрокладки. По утверждению производителя, система охлаждения накопителя Viper PV553 обеспечивает 40-процентное снижение рабочей температуры SSD при интенсивных нагрузках. Patriot будет выпускать Viper PV553 в версиях на 1, 2 и 4 Тбайт с ресурсом перезаписи в 700, 1400 и 3000 TBW (терабайт перезаписанной информации) соответственно. На все модели будет предоставляться пятилетняя гарантия производителя. О стоимости новинки компания ничего не сообщила. TSMC стала крупнейшим производителем чипов в мире, оставив позади Intel и Samsung

07.02.2024 [18:41],

Павел Котов

Имеющиеся в распоряжении TSMC производственные мощности и передовые технологии сделали компанию крупнейшим в мире производителем чипов по объёму выручки. Благодаря своему опыту в области передовых технологий производства чипов, которых нет у конкурентов, тайваньская компания, вероятно, сумеет удержать первое место на рынке.

Источник изображения: TSMC TSMC по итогам 2023 года впервые в истории стала крупнейшим в мире производителем полупроводников по объёму выручки — компания заработала $69,3 млрд, что выше показателей полупроводниковых подразделений Intel ($54,23 млрд) и Samsung ($50,99 млрд). Этот результат отражает сдвиг в отрасли, где традиционно доминировала Intel — «синие» удерживали первое место по доходам от выпуска чипов несколько десятилетий, начиная с 1992 года, за исключением 2017 года, когда лидером ненадолго стала Samsung. Тайваньский контрактный производитель не выпускает процессоров под собственной маркой, но его производственные услуги незаменимы для других чипмейкеров. Рост TSMC оказался устойчивым, поскольку компания обслуживает таких клиентов как Apple, AMD, NVIDIA и Qualcomm. В эпоху пандемии, когда мировая потребность в электронике резко возросла, TSMC установила надбавку за свои услуги. Компания доминирует в области технологических процессов, что даёт ей крепкие позиции на переговорах. Следом за TSMC на рынке полупроводников по объёму выручки окажется NVIDIA, которая имеет все шансы превзойти Samsung и Intel по итогам 2023 года. Компания представит отчёт 21 февраля, но, по предварительным оценкам, речь идёт о сумме в $58,8 млрд за календарный год. Обычно TSMC не упоминалась среди крупнейших полупроводниковых компаний, поскольку это исключительно контрактный производитель, но сейчас её выручка оказалась выше дохода Intel и Samsung. По итогам IV квартала 2023 года тайваньский гигант также обошёл ближайших конкурентов, показав $19,55 млрд против $16,42 млрд у Samsung и $15,41 млрд у Intel. TSMC также объявила о намерении открыть в Японии второй завод по производству чипов совместно с Sony и Toyota — он начнёт работать в конце 2027 года в рамках совместного предприятия Japan Advanced Semiconductor Manufacturing, контрольный пакет акций которого принадлежит тайваньской стороне. Суммарный объём инвестиций TSMC в Японии превысит $20 млрд, если учесть завод, который начнёт работать в этом году. Новые заводы в стране будут производить не передовые логические чипы, а займутся выпуском продукции для автомобилей, промышленности и высокопроизводительных вычислений. Foxconn построит новые производственные мощности в Индии

07.02.2024 [18:34],

Сергей Сурабекянц

В корпоративном отчёте для Тайваньской фондовой биржи компания Foxconn сообщила, что её индийская дочерняя компания Foxconn Hon Hai Technology India Mega Development Private Limited инвестирует 12 миллиардов индийских рупий ($144,46 млн) в строительство производственных мощностей в Индии. Хотя некоторые индийские СМИ сообщали о строительстве завода по сборке и тестированию микросхем, сама Foxconn пока не прокомментировала эту информацию.

Источник изображения: Foxconn Это уже не первая инвестиция Foxconn в создание производственных мощностей в Индии. В ноябре 2023 Foxconn сообщала об инвестициях в размере 128,21 миллиарда индийских рупий ($1,544 млрд), а в июле компания получила оборудование от Apple Operations Limited для дальнейшего расширения производства мобильных телефонов в Индии. В середине января председатель Foxconn Янг Лю (Young Liu) был удостоен Падма Бхушан, третьей по значимости из высших гражданских государственных наград Индии (после Бхарат Ратна и Падма Вибхушан). Эта награда вручается правительством Индии как знак признания выдающегося служения нации в любой области. Всего с 1954 года этой награды удостились 1287 человек. По сообщению Министерства внутренних дел Индии, Лю стал одним из восьми иностранных граждан, награждённых за вклад в торговлю и промышленность. В последние годы Foxconn инвестировала в различные сектора индийской промышленности. Компания планирует создать мощности по производству электромобилей для своего предприятия OSAT в партнёрстве с индийской HCL Group. Благодаря поставщикам Apple, в частности Foxconn, в Индии отмечен резкий рост валового экспорта электроники, причём половина экспорта пришлась на мобильные телефоны. По данным Economic Times, Foxconn произвела для Apple почти 70 % от всех iPhone, изготовленных в Индии в 2023 году. Продажи MacBook в России выросли на 20 % в 2023 году несмотря на уход Apple

07.02.2024 [18:32],

Владимир Фетисов

Несмотря на прогнозы экспертов и участников рынка, в России выросли продажи ноутбуков Apple, которая ушла из страны ещё в 2022 году. Об этом пишут «Известия» со ссылкой на данные партнёра нескольких производителей электроники. В сообщении сказано, что в прошлом году продажи ноутбуков Apple MacBook Air и MacBook Pro в штуках выросли более чем на 20 % по сравнению с предыдущим годом, а доля рынка американской компании выросла на 1 % и составила 6 %.

Источник изображений: Monoar_CGI_Artist / Pixabay В «М.Видео-Эльдорадо» подтвердили, что в 2023 году ноутбуки Apple сохранили позиции по реализации. «На продажи позитивно повлияли восстановление ассортимента за счёт налаживания собственных импортных операций, появление новинок, например, с чипом M3. Apple также традиционно имеет большую базу приверженных пользователей, которые при обновлении ноутбука в первую очередь рассматривают для покупки устройства именно этого же бренда», — считает Александр Афонин, ведущий менеджер товарной категории в департаменте «Компьютеры и планшеты» в «М.Видео-Эльдорадо». В МТС сообщили, что доля продукции Apple выросла за счёт того, что ретейлеры сумели наладить логистические цепочки. Это способствовало росту конкуренции, благодаря которой потребитель может получать товары по более привлекательной цене. Росту спроса на ноутбуки Apple также способствовало появление новых моделей на базе фирменных процессоров M3. Любопытно, что не только Apple, но и некоторые другие компании, ушедшие с российского рынка, сумели нарастить продажи в прошлом году. По данным Wildberries, в прошлом году выросли продажи ноутбуков MSI, чьи позиции традиционно сильны в сегменте доступных игровых ноутбуков. По данным источника, в 2023 году продажи ноутбуков тайваньской ASUS выросли на 21 %, а доля производителя увеличилась на 1 % и составила 14 % рынка. Лидером рынка с долей 15 % по итогам года стала MSI. В это же время рыночные доли ушедших из России Lenovo, Acer и HP сократились в 2-3,5 раза и составили 9 %, 6 % и 5 % соответственно. По подсчётам «М.Видео-Эльдорадо», штучные продажи ноутбуков в России выросли в 2023 году примерно на 10 % до 3,8 млн единиц. В компании отметили, что драйверами роста сегмента можно назвать отложенный спрос и рост популярности производительных игровых моделей, актуальных для выполнения других задач. Отмечается рост спроса на модели с диагональю экрана от более 15 дюймов, а также тонкие и лёгкие модели. Зонд «Юнона» в последний раз сблизился с самым вулканически активным телом в Солнечной системе

07.02.2024 [14:17],

Геннадий Детинич

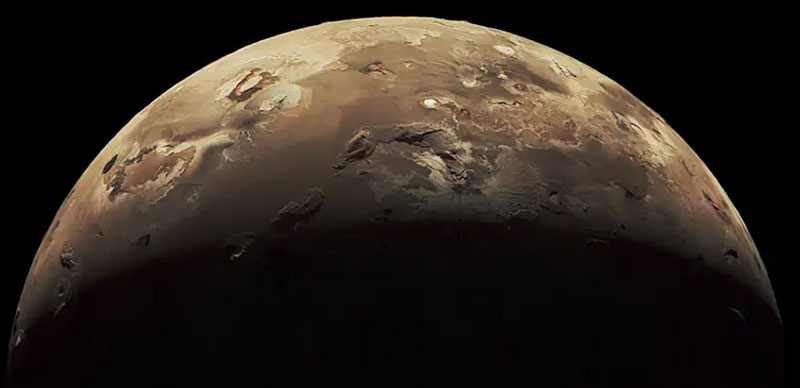

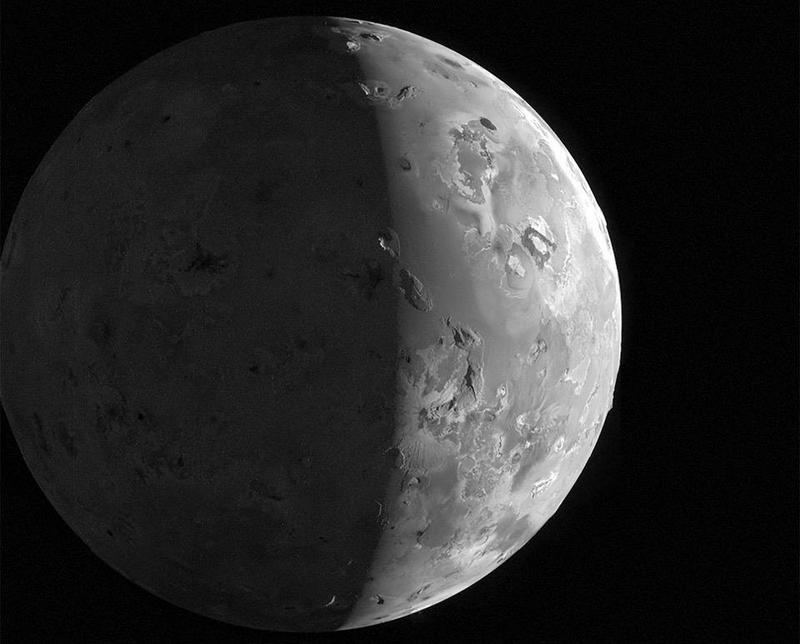

В субботу, 3 февраля, космический аппарат NASA «Юнона» (Juno) в последний раз совершил максимально близкий пролёт рядом со спутником Юпитера Ио. Это самое вулканически активное небесное тело в Солнечной системе. На Ио зарегистрировано около 400 действующих вулканов. Его осмотры «Юноной» позволят понять, что стоит за этой активностью и есть ли на спутнике глобальный океан из магмы.

Источник изображений: NASA На Ио буквально может быть океан огня. Такой активности этого спутника в основном подозревают гравитацию Юпитера, которая постоянно деформирует его тело и, тем самым, вызывает разогрев недр. По совокупности факторов, включая полное отсутствие льда на поверхности Ио, этот мир кардинально отличается от всех остальных лун Юпитера и тем он ценен для учёных. Зонд NASA «Юнона» совершил два максимально близких пролёта рядом с Ио. Оба они прошли на высоте около 1500 км над его поверхностью. Предыдущий близкий пролёт состоялся 30 декабря 2023 года, а последний, как сказано выше, 3 февраля 2024 года. В дальнейшем «Юнона» совершит ещё несколько облётов Ио, но на гораздо большей высоте.  В близкие пролёты зонд фиксировал не только активность вулканов, но смог заметить даже потоки лавы из жерл и трещин в коре Ио. Облёты на большой дистанции позволят по-прежнему следить за вулканической активностью спутника и дадут возможность больше узнать о её природе и закономерностях. Стартап AliveCor не смог доказать в суде, что Apple незаконно скопировала его технологии ЭКГ

07.02.2024 [13:48],

Алексей Разин

Компании Apple приходится то и дело отвечать на претензии более мелких разработчиков новых технологий, которую те обвиняют в незаконном заимствовании своих ноу-хау. Недавно в суде рассматривалось дело по иску стартапа AliveCor, который обвинил Apple в заимствовании своих разработок в сфере контроля за частотой сердечных сокращений и попытках монополизировать в США рынок таких приложений.

Источник изображения: Apple Калифорнийская компания AliveCor специализируется на разработке устройств и приложений, позволяющих не просто следить за сердечным ритмом при помощи умных браслетов и часов, но и снимать электрокардиограмму. В ходе рассматриваемого судебного спора истец утверждал, что Apple склонила его к сотрудничеству в сфере совершенствования алгоритмов по отслеживанию аномалий в сердечном ритме, но затем использовала идеи AliveCor в собственных целях и попыталась с их помощью монополизировать рынок подобных приложений в США. Окружной суд Окленда в Калифорнии постановил, что вина Apple в данном случае не доказана. Соответственно, стороне обвинения не удалось доказать, что Apple нарушала американские антимонопольные законы. Компания теперь сохраняет возможность совершенствовать методы контроля за сердечным ритмом при помощи своих умных устройств и сопутствующих приложений. AliveCor намеревается подать апелляцию и выражает сильное разочарование таким вердиктом суда. Небольшой калифорнийской компании удалось разработать для Apple Watch специальный браслет KardiaBand, который позволяет устройству Apple снимать электрокардиограмму. AliveCor также разработала приложение Kardia для умных часов Apple и приложение SmartRhythm, которое использует систему искусственного интеллекта для анализа сердечного ритма пользователя. AliveCor не отказывается от намерений подавать против Apple отдельный иск, касающийся нарушений в области патентного права. NASA уволит сотни сотрудников — это повлияет на изучение планет Солнечной системы

07.02.2024 [12:36],

Геннадий Детинич

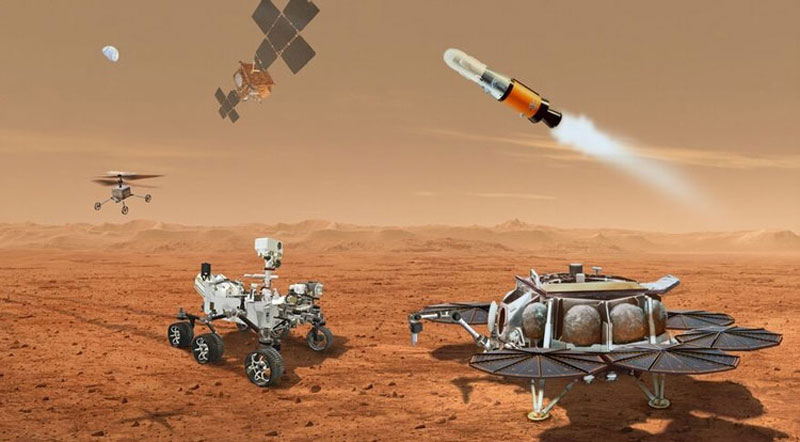

Руководство Лаборатории реактивного движения NASA (JPL) сообщило о грядущем увольнении 530 сотрудников лаборатории и 40 работников у подрядчиков. Это одно из крупнейших сокращений в JPL, которое происходит в условиях отказа Конгресса США выделить запрошенный бюджет на космос в 2024 году. По этой причине придётся пересмотреть и даже свернуть часть перспективных проектов по изучению планет Солнечной системы.

Комплекс миссии по возврату марсианского грунта на Землю. Источник изображения: NASA Пожалуй, это может быть одним из самых сильных ударов по организации с начала 80-х годов прошлого века. Тогда отправка «Вояджеров» на задворки Солнечной системы стала лебединой песней JPL. Масса других перспективных планетарных проектов погибла под навязанной NASA президентом США Рональдом Рейганом программой SOI (Стратегическая оборонная инициатива). Сегодня ситуация в чём-то повторяется. По крайней мере, с позиции ограничения финансирования NASA и его подразделений. В чём можно не сомневаться, в ближайшие годы JPL продолжит работать над программой Mars Sample Return (MSR) по возврату образцов с Марса на Землю. Власти США намерены продолжить поддерживать этот проект, чтобы не выглядеть бледно на фоне аналогичной китайской программы. Но окончательной ясности в объёме финансирования программы MSR пока нет и лаборатория должна пойти на крайние меры — на увольнения, чтобы избежать ещё более худшего сценария в будущем. В Беларуси запустят производство китайских телевизоров Skyworth для России

07.02.2024 [12:31],

Павел Котов

Китайский производитель телевизоров, цифровых приставок, холодильников, стиральных машин и другой бытовой техники Skyworth намеревается выйти на российский рынок. Компания направила предложения о поставках продукции торговым сетям в России, а с белорусским заводом «Горизонт» она договорилась о контрактном производстве телевизоров. Skyworth также не исключает локализации производства продукции на заводах ушедших из России компаний.

Источник изображения: skyworth.com Skyworth ведёт переговоры о размещении своей продукции в крупных российских сетях, сообщает «Коммерсантъ» со ссылкой на заявление коммерческого директора Holodilnik.ru Алексея Погудалова. «Телевизоры компании будут локализованы по производству на территории Республики Беларусь, на заводе „Горизонт”, также рассматривается возможность размещения сборки и крупной бытовой техники на заводах ушедших из РФ брендов», — рассказал топ-менеджер. Он добавил, что Skyworth производит и реализует комплектующие для бытовой техники, в том числе для российских марок. Представители китайской компании подтвердили факт переговоров с российскими торговыми сетями и запуск контрактного производства телевизоров на «Горизонте». Прочих подробностей в компании не раскрыли, не обозначили и планов по локализации сборки стиральных машин и холодильников в России, сообщив, что «конкретные площадки в РФ на данный момент не рассматриваются». Торговая сеть «М.Видео — Эльдорадо» подтвердила, что сотрудничество со Skyworth не исключается. Skyworth основана в 1988 году — её штаб-квартира расположена в Шэньчжэне. Компания выпускает ЖК-дисплеи, телевизоры, телеприставки и бытовую технику. Ценные бумаги производителя торгуются на гонконгской бирже. В 2018 году Skyworth пыталась выйти на российский рынок через Tmall (входит в AliExpress), но сейчас её продукция в российских сегментах китайских площадок не представлена. За российского покупателя компании придётся сражаться с другими китайскими производителями, уверены опрошенные «Коммерсантом» эксперты — они подчеркнули, что без локализации производства Skyworth придётся непросто. Запустить сборку холодильников и стиральных машин в России сложнее, чем наладить выпуск телевизоров, но для этого подойдут бывшие заводы LG и Samsung. В Китае Skyworth входит в десятку крупнейших поставщиков бытовой техники, выступая наравне с TCL, Hisense и ChiQ, которые уже присутствуют в России. Но пока стратегия компании на российском рынке представляется неубедительной, предупреждает эксперт: вместо организации маркетинговой активности компания пока сосредоточена на оптовых поставках техники по заниженным ценам — есть риск, что потребители отнесут её к ширпотребу. Porsche обновила электромобиль Taycan — повышена мощность, скорость и автономность

07.02.2024 [12:19],

Алексей Разин

Концерн Volkswagen своим относительно безбедным существованием должен быть обязан марке Porsche, а потому охотно наделяет одноимённые электромобили передовыми технологиями. Обновлённый в этом году спорткар Porsche Taycan, например, получился более быстрым и мощным, при этом он способен быстрее заряжаться и проезжать дальше, прибавив в массе всего 15 кг.

Источник изображений: Porsche Покупатель сможет выбирать между двумя типами кузова: седаном и спортивным универсалом, который в одной из модификаций ещё может обладать лёгкой претензией на внедорожность. Предусмотрены четыре версии силовой установки и два типа привода: на заднюю ось или полный. В первом случае машина способна разгоняться до 100 км/ч за 4,8 секунды против 5,6 секунды у предшественника, полноприводный Taycan Turbo S разменивает 100 км/ч за 2,4 секунды против 2,8 секунды у предшественника. В максимальной конфигурации силовая установка Porsche Taycan способна выдавать 700 кВт или 938 л.с. В салоне самых быстрых версий электрокара появилась специальная кнопка, позволяющая на период до 10 секунд выдать на колёса дополнительные 70 кВт мощности для более активного ускорения. Базовый вариант электрокара стал на 60 кВт мощнее, а старший Taycan Turbo S выдаёт на 140 кВт больше предшественника. Эффективность повышена почти на всех этапах передачи электроэнергии от тяговой батареи к колёсам электрокара. Сама батарея стала более ёмкой, но при этом её масса снизилась. Покупатель может выбирать между двумя ёмкостями на старте продаж (79 кВт‧ч и 93 кВт‧ч), но позже за доплату будет предложены батарея ёмкостью 105 кВт‧ч. Способность машины принимать заряд тоже улучшилась по сравнению с моделью 2019 года. Теперь максимальная мощность быстрой зарядной станции, к которой Porsche Taycan способен подключиться без ущерба для себя, увеличена с 270 до 320 кВт, а предельную мощность в 300 кВт электрокар способен принимать на протяжении пяти минут. Всё это позволяет пополнять заряд от нуля до 80 % за 18 минут при температуре окружающего воздуха 15 градусов Цельсия выше нуля. Во многом это обеспечивается использованием бортового напряжения 800 В, но приобретаемый в комплекте преобразователь мощностью 150 кВт позволяет ускорить зарядку и на станциях старого поколения, использующих напряжение 400 В. Кстати, высокая скорость зарядки на мощных станциях сохраняется и при отрицательных температурах, как подчёркивает Porsche. Жителям холодных регионов понравится и более совершенный тепловой насос. Показатели рекуперации электроэнергии при замедлении машины тоже были улучшены. Теперь силовая установка может принимать в этом режиме на 30 % больше энергии — до 400 кВт. Штатным оборудованием для каждого рестайлингового Porsche Taycan являются колёсные диски типоразмера 21 дюйм с особым аэродинамичным дизайном и шинами с пониженным сопротивлением качению. Машина комплектуется более аэродинамичными матричными фарами с характерным фирменным четырёхсегментым рисунком. Соединяющая задние фонари светодиодная полоса получила подсвечиваемый «трёхмерный» логотип Porsche.  Обновлённый Porsche Taycan способен проезжать без подзарядки до 678 км в условном цикле WLTP, в реальных тестах показатель снижается до 587 км, но всё равно остаётся в приемлемом диапазоне. По сути, дальность хода относительно предшественника удалось увеличить более чем на треть. С конца 2019 года Porsche реализовала почти 150 000 экземпляров Taycan, самыми удачными для модели рынками являются США, Великобритания, Германия и Китай.  Мультимедийная система Porsche Taycan после обновления модели обеспечивает более глубокую интеграцию с Apple CarPlay, а воспроизводить потоковое видео можно не только на дисплее для пассажира, но и на центральном. От пассажирского дисплея при заказе машины можно отказаться. Интерфейс бортовой мультимедийной системы тоже был модернизирован. К слову, на знаменитой немецкой трассе в Нюрбурге обновлённый Porsche Taycan Turbo GT уже побил рекорд Tesla Model S Plaid на 17 секунд, пройдя «северную петлю» за 7 минут и 07,55 секунды. По большому счёту, этот серийный электромобиль лишь на две секунды отстал от гиперкара Rimac Nevera, который стоит в несколько раз больше и выпускается буквально в штучных количествах. Учёные создали термостойкий материал для термоэлектрической энергетики и космоса — он без изменений выдерживает 1000 °C

07.02.2024 [11:58],

Геннадий Детинич

Исследователи из Корейского института науки и технологий (KIST) создали термостойкий материал, не теряющий своих свойств при нагреве до 1000 °C, а также под воздействием жёсткого ультрафиолетового излучения. Ожидается, что он найдёт применение в сфере получения электрической энергии от тепла, а также в космосе, где поможет охлаждать спутники и корабли.

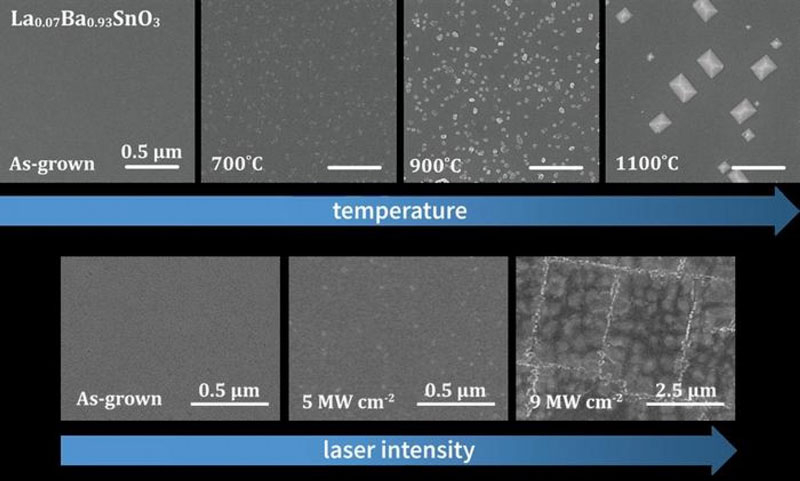

Источник изображения: ИИ-генерация Кандинский 3.0/3DNews На Земле множество источников тепла, и это не считая энергии Солнца. Мы пока не научились эффективно превращать его в электрическую энергию напрямую. Из-за низкой эффективности современных термоэлектрических элементов наиболее выгодно сегодня работать с сильно нагретыми источниками. Чем выше его температура, тем лучше. С другой стороны, по мере роста нагрева передающего тепло материала он начинает быстрее окисляться и ускоренно терять проводящие свойства. Группа южнокорейских учёных работала в этом направлении — искала материал, который не терял бы свои свойства при достаточно высоком нагреве и мог послужить проводником тепла от источника к приёмнику. Традиционные тугоплавкие материалы, такие как вольфрам, никель и нитрид титана не подошли. Слишком активно они начинали окисляться при достижении максимальных температур. После поиска нужной формулы учёные остановились на оксиде станната бария, легированном лантаном (LBSO). Предложенный учёными процесс опирался на метод импульсного лазерного осаждения, что позволяло создавать тонкоплёночные покрытия из необычного материала.

Материал слабо реагирует на сильный нагрев и жёсткий ультрафиолет. Источник изображения: Korea Institute of Science and Technology После проверок оказалось, что тонкоплёночный LBSO не коробился и не терял своих теплопроводящих свойств при нагреве до 1000 °C и был стабилен в многослойном исполнении. Также он оказался устойчив к ультрафиолетовому излучению мощностью 9 МВт/см2. Это делает его идеальным для аэрокосмического применения для отвода тепла от космических аппаратов под лучами Солнца. «LBSO внесет свой вклад в решение проблемы изменения климата и энергетического кризиса путём ускорения коммерциализации производства термоэлектрической энергии», — уверены авторы работы, опубликованной в журнале Advanced Science. Январские показатели TSMC указали, что рынок полупроводников возвращается к росту

07.02.2024 [11:37],

Алексей Разин

Компания TSMC уже отчиталась об итогах своей деятельности в январе текущего года. Первый месяц года позволил компании увеличить выручку в годовом сравнении на 7,9 % до $6,9 млрд, и на 22,4 % последовательно, что не совсем соответствует сезонным тенденциям и говорит о росте спроса на компоненты для систем искусственного интеллекта.

Источник изображения: TSMC Отчитываясь о результатах прошлого квартала в середине января, TSMC заявила, что по итогам всего первого квартала текущего года рассчитывает на рост выручки по меньшей мере на 8 % минимум до $18 млрд. При благоприятном стечении обстоятельств выручка TSMC в первом квартале должна достичь $18,4 млрд, увеличившись год к году на 12,5 %. Таким образом, доля января в потенциальной квартальной выручке компании уже превысила условную треть, которая расположилась на уровне $6,13 млрд в месяц. Это хороший сигнал для инвесторов, продолжающих верить в подъём полупроводникового рынка на фоне высокого спроса в сегменте систем искусственного интеллекта. По итогам 2024 года в целом TSMC рассчитывает увеличить выручку как минимум на 21 %, а также удержать капитальные затраты в диапазоне от $28 до $32 млрд, что по середине диапазона как раз соответствует прошлогодним капитальным затратам. От 70 до 80 % этой суммы будут направлены на передовые техпроцессы, от 10 до 20 % на зрелые, а технологиям упаковки достанется около 10 % капитальных затрат в этом году. TSMC не боится перепроизводства в сфере зрелых техпроцессов, поскольку заключает с клиентами долгосрочные контракты, а также предлагает им уникальные адаптированные под их потребности литографические технологии. В последующие несколько лет, как ожидает руководство TSMC, выручка компании будет в среднем расти на 15–20 % в год. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |