|

Опрос

|

реклама

Быстрый переход

Tower Semiconductor готова потратить $8 млрд на строительство предприятия по выпуску чипов в Индии

12.02.2024 [07:12],

Алексей Разин

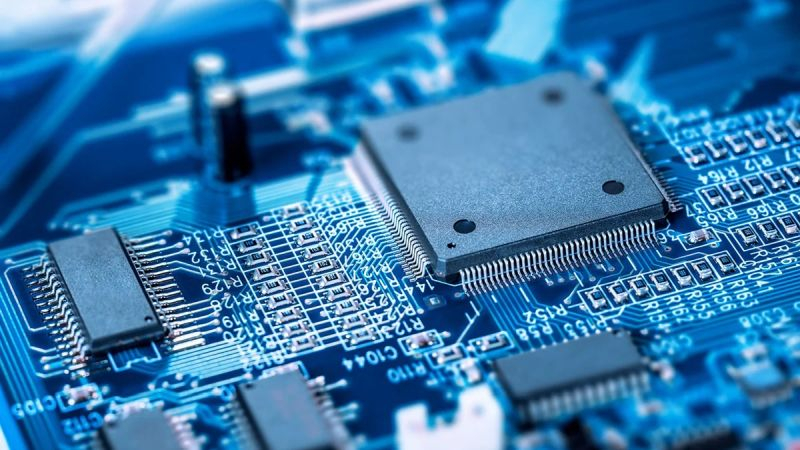

Инициатива индийских властей по привлечению в страну производителей чипов преимущественно порождала новости о намерениях Foxconn попробовать свои силы в этой сфере, но проект по сотрудничеству с местной компанией Vedanta развалился. Как выясняется, израильская Tower Semiconductor тоже пытается согласовать с властями Индии подобную инициативу, затраты на реализацию которой оцениваются в $8 млрд.

Источник изображения: Tower Semiconductor Издание The Indian Express сообщает, что Tower Semiconductor уже подала официальную заявку на проект по строительству предприятия в Индии, которое сможет заняться контрактным производством 65-нм и 40-нм чипов для сегментов носимой электроники и автомобильной промышленности. Ещё в октябре, по данным источников, индийский министр электронной промышленности и информационных технологий Раджив Чандрасекар (Rajeev Chandrasekhar) встретился с генеральным директором Tower Semiconductor Расселом Эллвангером (Russel Ellwanger) для обсуждения данного вопроса. Напомним, индийские власти в общей сложности готовы выделить на субсидирование национальной полупроводниковой промышленности $10 млрд, но до сих пор крупных претендентов на эти средства не находилось. Первоначально Tower рассчитывала построить в индийском штате Карнатака предприятие по выпуску чипов за $3 млрд в альянсе с ISMC, но на тот момент компания Intel рассчитывала поглотить Tower Semiconductor, и согласование проекта затянулось. К августу прошлого года стало понятно, что Intel не сможет поглотить Tower Semiconductor, но индийский проект компании в первоначальном варианте согласовать тоже не удалось. Если власти Индии покроют до половины затрат Tower, то им придётся выделить $4 млрд субсидий. Власти штата, в котором появится предприятие Tower на территории Индии, могут предложить и дополнительную финансовую поддержку. Правда, где именно появится такое предприятие, пока не уточняется. Сам по себе факт подачи заявки ещё не гарантирует успешной реализации проекта. У смарт-часов Apple Watch 9 и Watch Ultra 2 отмечена проблема «призрачных» касаний

12.02.2024 [00:08],

Владимир Мироненко

Некоторые пользователи смарт-часов Apple Watch 9 и Apple Watch Ultra 2 столкнулись с проблемой «призрачных» касаний, когда экран самопроизвольно активируется без касания к нему, а изображение начинает «прыгать», что затрудняет ввод пароля и может привести к случайному телефонному звонку. Apple направила авторизованным сервисам служебную записку, в которой сообщила, что «знает» и «расследует» данную проблему.

Источник изображения: Apple «Некоторые клиенты могут сообщать, что их Apple Watch Series 9 или Apple Watch Ultra 2 испытывают ложные прикосновения к дисплею», — говорится в записке Apple, с которой ознакомился ресурс MacRumors. В связи с этим Apple указала техническим специалистам из авторизованных сервисных центров не заменять «проблемные» модели Apple Watch, пока проводится расследование, а также рекомендовала предложить клиентам, которые столкнулись с этой проблемой, принудительно перезагрузить свои Apple Watch, одновременно удерживая колёсико Digital Crown и боковую кнопку в течение как минимум 10 секунд, пока не появится логотип Apple. Apple также попросила технических специалистов проинформировать клиентов о том, что компания вскоре выпустит обновление программного обеспечения, которое решит данную проблему. Смарт-часы Apple Watch Series 9 и Apple Watch Ultra 2 появились в продаже в сентябре 2023 года. Apple не стала раскрывать масштаб проблемы и не указала возможные сроки её решения. Также неясно, связана ли проблема с аппаратной частью смарт-часов. NVIDIA перегнала по стоимости все китайские компании вместе взятые

11.02.2024 [13:19],

Владимир Фетисов

Последнее время NVIDIA росла ошеломляющими темпами и в конечном счёте стоимость американской компании достигла уровня всего фондового рынка Китая. Об этом пишет Business Insider со ссылкой на исследование Майкла Харнетта (Michael Harnett), главного инвестиционного стратега Bank of America.

Источник изображений: PIX1861 / Pixabay В сообщении сказано, что за последние два месяца стоимость NVIDIA выросла на $600 млрд. За счёт этого капитализация компании достигла $1,7 трлн, что соответствует суммарной стоимости всех компаний, зарегистрированных на Гонконгской фондовой бирже. Рыночная капитализация производителя микросхем выросла почти в четыре раза с начала прошлого года. При этом стоимость акций NVIDIA подскочила на 239 % в 2023 году, а в нынешнем году увеличилась ещё на 41 %. За счёт этого NVIDIA переместилась на пятое место в рейтинге самых дорогих публичных компаний США. Тем временем экономический кризис в Китае привёл к падению акций крупных технологических компаний. Слабый экономический рост и продолжительный кризис на рынке недвижимости также оказали давление на рынок. На этом фоне технологический биржевой индекс Hang Seng упал в цене на 26 % в прошлом году и на 8 % в годы нынешнем. Американский регулятор разрешил Samsung включить функцию выявления апноэ во сне в Galaxy Watch

11.02.2024 [11:39],

Владимир Мироненко

Samsung получила разрешение Управления по санитарному надзору за качеством пищевых продуктов и медикаментов (FDA) США на использование функции обнаружения апноэ во сне в смарт-часах Samsung Galaxy Watch. Как сообщает The Verge, данная функция появится в носимом устройстве для жителей США после обновления приложения Samsung Health Monitor в III квартале.

Источник изображения: Samsung Ещё осенью прошлого года Министерство безопасности пищевых продуктов и лекарств Южной Кореи одобрило использование носимых устройств для обнаружения перебоев дыхания, поэтому обновление Samsung Health Monitor выйдет в этой стране в первую очередь. Врачи не считают умные часы надёжным инструментом для обнаружения апноэ во сне и других нарушений здоровья, но это не стало помехой для таких компаний, как Apple, Fitbit, Withings и другие, в попытках внедрить эти возможности в выпускаемых ими носимых устройствах. В декабре ресурсу Bloomberg стало известно, что Apple работает над расширенным мониторингом показателей здоровья (включая апноэ во сне и гипертонию) для следующего поколения смарт-часов Apple Watch. FDA пока не одобрило использование Apple этой функции, а компании пришлось удалить в устройстве функцию пульсоксиметра из-за патентного разбирательства с Masimo. Поскольку функция обнаружения апноэ полагается на показания встроенного пульсоксиметра, её появление в смарт-часах Apple Watch теперь под большим вопросом. Чтобы использовать функцию обнаружения апноэ во сне, пользователям будет необходимо отставлять смарт-часы Samsung Galaxy Watch на ночь включёнными и дважды отслеживать свой сон, каждый раз не менее четырёх часов, в течение 10-дневного периода. Galaxy Watch отслеживают уровень кислорода в крови пользователя в течение ночи, снижение которого является распространённым признаком апноэ сна и других нарушений сна. По данным клиники Мэйо, перебои дыхания во время сна являются одним из ключевых симптомов как центрального апноэ сна (когда мозг не посылает сигналы дыхательным мышцам), так и синдрома обструктивного апноэ сна, связанного с частичным или полным перекрытием верхних дыхательных путей во время сна. Гибридный ускоритель NVIDIA GH200 можно купить в составе рабочей станции за $41 500

11.02.2024 [07:53],

Алексей Разин

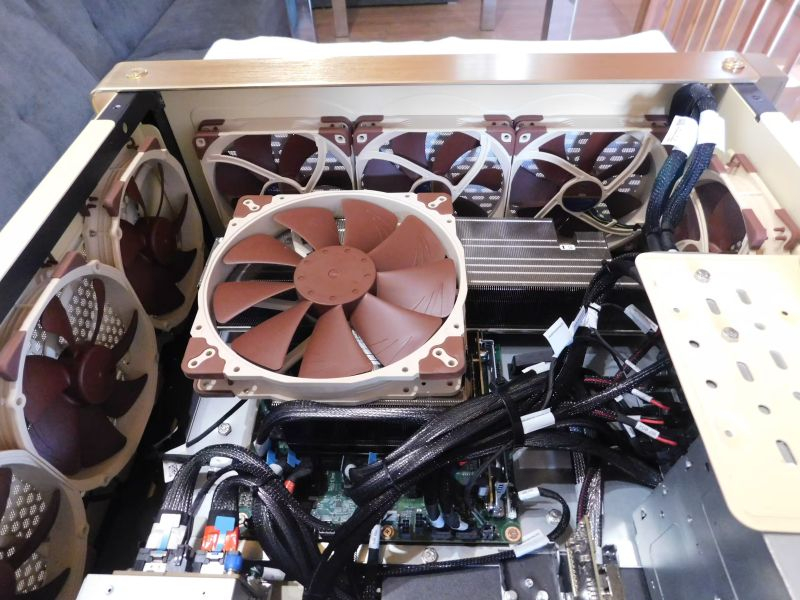

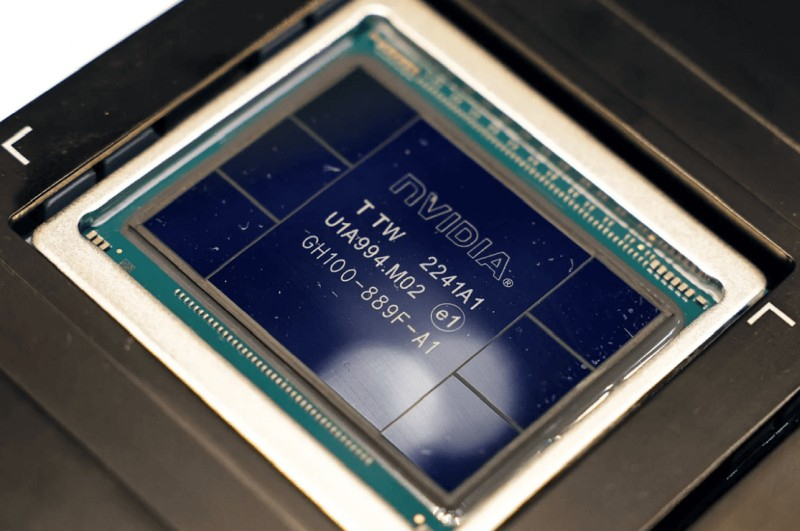

Формально объединяющий на одной плате ускоритель NVIDIA GH200 предназначается для серверного применения, но в интернет-магазине GPTshop можно приобрести рабочую станцию на его основе, которая использует операционную систему Ubuntu. Экзотическая рабочая станция оценивается минимум в $41 500, поскольку подобные ускорители сами по себе являются дорогостоящими компонентами.

Источник изображений: GPTshop Напомним, что ускоритель GH200 сочетает центральный процессор Grace с архитектурой Arm с 72 ядрами, он поддерживает до 480 Гбайт памяти типа LPDDR5X. По соседству на плате расположился графический процессор H200, который имеет площадь кристалла 814 мм2 и содержит 16 896 ядер CUDA, используемых для ускорения вычислений. Указанный интернет-магазин позволяет выбирать между модификацией ускорителя как с памятью HBM3, так и более новой версией с памятью типа HBM3E, которая ещё и предлагается в большем объёме.  Судя по фотографиям рабочей станции, сделанным в интерьере частного дома, система охлаждения этого необычного вычислительного решения строится на вентиляторах Noctua, которые напиханы буквально во все доступные посадочные места. В качестве опций рабочую станцию можно оснастить сетевыми платами Bluefield-3 и ConnectX-7, твердотельными накопителями объёмом до 8 Тбайт, а также жёсткими дисками объёмом до 30 Тбайт. Внутри системного блока может прописаться даже видеокарта GeForce RTX 4060, если пользователю потребуется работать с графикой на более серьёзном уровне. Впрочем, поскольку в качестве операционной системы может использоваться только Ubuntu, рассчитывать на игровое применение такой рабочей станции просто бессмысленно, учитывая концентрацию вычислительных ресурсов именно на стороне NVIDIA GH200.  В принципе, для определённых условий покупка такой рабочей станции примерно за $50 000 может считаться выгодной сделкой, если учесть, что ускоритель NVIDIA H100 предыдущего поколения сам по себе стоит $40 000. Клиенты GPTshop за чуть большие деньги просто получают готовую систему с более высокой производительностью. Благосостояние Лизы Су выросло до $1,1 млрд за счёт успеха AMD на рынке

11.02.2024 [06:16],

Алексей Разин

Акции AMD, которая долгие годы могла претендовать примерно на десятую долю процессорного рынка, уже давно обходят по курсовой стоимости акции конкурирующей Intel, а потому получающая вознаграждение ими глава компании Лиза Су (Lisa Su) постепенно увеличивает своё личное благосостояние. По оценкам Forbes, оно сейчас превышает $1,1 млрд.

Источник изображения: AMD Для Лизы Су подобная история успеха важна в том смысле, что она в статусе генерального директора компании принимала бизнес AMD почти десять лет назад в куда более плачевном состоянии: до 2016 года курс акций компании колебался между $2 и $4. Уходящую неделю он завершил на отметке $172,48 за штуку, укрепившись за предыдущие 12 месяцев более чем в два раза. По оценкам Forbes, Лиза Су владеет примерно $700 млн в форме акций компании, и с 2016 года продала их на общую сумму $400 млн. Впрочем, сумма в $1,1 млрд является лишь грубой оценкой её благосостояния, ведь получаемые в AMD за работу средства она могла инвестировать с определённой доходностью, да и должность члена совета директоров Cisco могла приносить ей определённый доход. Конкурирующая NVIDIA демонстрирует куда более впечатляющую динамику курса акций, да и стоявший у истоков компании генеральный директор Дженсен Хуанг (Jensen Huang) сосредоточил в своих руках куда более дорогие активы. В ноябре прошлого года его благосостояние оценивалось в $40 млрд, но теперь оно перешагнуло далеко за рубеж $60 млрд. История успеха Лизы Су ценна тем, что она смогла вывести из кризиса компанию, которую возглавила около десяти лет назад, и в этом смысле её попадание на 26-е место в списке американских женщин-миллиардеров, которые «начинали с нуля», является важным личным достижением. Учёные создали ультратонкие кремниевые солнечные панели для авиации, космоса и носимой электроники

10.02.2024 [21:14],

Геннадий Детинич

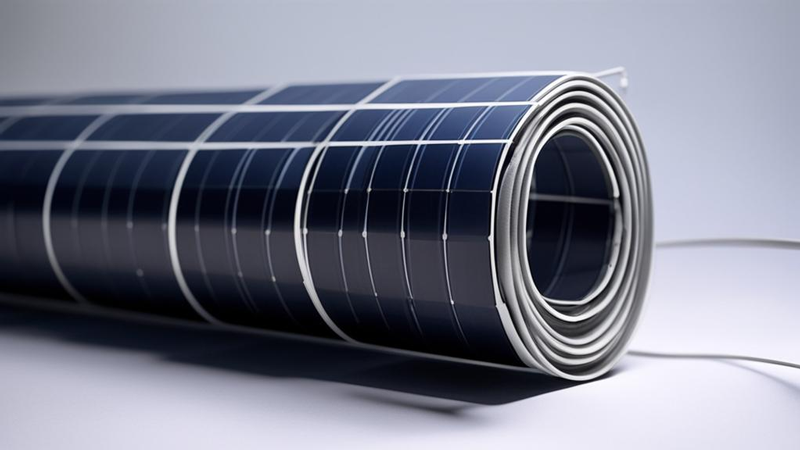

Современным кремниевым солнечным панелям не хватает гибкости в буквальном смысле этого слова. Они сравнительно толстые и поэтому тяжёлые, что мешает им попасть в авиацию и шире использоваться в носимой электронике. Для космоса это тоже важно, поскольку вывод на орбиту каждого килограмма стоит приличных денег. Возможно, с этим помогут учёные из Китая и Австралии, которые создали ультратонкие и гибкие панели из привычного кремния.

Источник изображения: ИИ-генерация Кандинский 3.0/3DNews На днях государственное китайское издание Science and Technology Daily процитировало профессора Цзянсуского университета науки и технологий (JUST) Ли Янга (Li Yang), который сказал, что солнечные элементы из кристаллического кремния, которые изготавливаются из кремниевых пластин, были и остаются наиболее зрелым и широко используемым решением для выработки электрической энергии, «но они сталкиваются с двумя основными технологическими узкими местами». Одним из недостатков современных кремниевых фотопанелей является то, что эффективность преобразования энергии кремниевыми элементами большой площади остаётся ограниченной на уровне 26 %; другим препятствием является толщина элемента — обычно от 150 до 180 мкм, что затрудняет их использование в случаях, требующих более гибкого и лёгкого материала для установки на изогнутые крыши, спутники и космические станции. Возглавляемая профессором Ли группа учёных из JUST, австралийского университета Кёртин и компании LONGi Green Energy Technology опубликовала в журнале Nature статью, в которой сообщила о создании из кристаллического кремния фотопанели толщиной около 50 мкм. Это тоньше, чем лист обычной писчей бумаги формата A4. Эту фотопанель нельзя согнуть пополам как лист бумаги, но можно изогнуть с достаточной степенью кривизны без разрушения. Что важно, КПД ультратонкой фотопанели превысил 26 %. Учёные создали ещё несколько фотоэлементов толщиной от 55 до 130 мкм, и у всех у них эффективность превысила 26 %. Профессор Ли сказал, что его группа работает над созданием более гибких и эффективных кристаллических кремниевых солнечных элементов, которые в один прекрасный день смогут стать такими удобными в использовании, как рулон пленки. Анонсирован мини-ПК MSI Cubi N ADL с энергоэффективным чипом Intel N100

10.02.2024 [18:29],

Владимир Мироненко

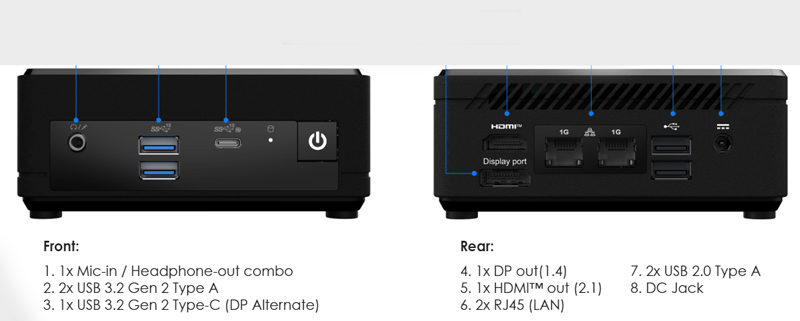

Компания MSI представила мини-ПК Cubi N ADL с пассивным охлаждением, отличающийся низким потреблением электроэнергии и предназначенный для корпоративного сегмента. Новинка выполнена в корпусе объёмом 0,66 л, отличаясь компактными габаритами и небольшим весом, составляющим всего 540 г.

Источник изображений: MSI Мини-ПК MSI Cubi N ADL построен на процессоре Intel N100 серии Alder Lake-N, содержащем четыре энергоэффективных Е-ядра с тактовой частотой до 3,4 ГГц и максимальным значением рассеиваемой тепловой энергии (TDP) всего 6 Вт, а также обладающем поддержкой четырёх потоков. Объём оперативной памяти DDR4 (3200 МГц) составляет до 16 Гбайт, для хранения данных имеются слоты для M.2 SSD и 2.5” SSD/HDD.  Для подключения внешних мониторов с разрешением 4K и частотой обновления 60 Гц у мини-ПК есть разъёмы HDMI, DP и Type-C. Коммуникационные возможности мини-ПК также включают два порта USB 3.2 Gen2 Type-A, два порта USB 2.0 Type-A, и адаптер беспроводной связи Wi-Fi. Для обеспечения безопасности данных в устройстве имеется криптографический модуль dTPM 2.0.  Компания гарантирует надёжность Мини-ПК MSI Cubi N ADL и поддержку 24/7 в течение трёх лет. Устройство работает под управлением Windows 11 Pro. Слухи: Huawei работает над VR-гарнитурой вдвое легче и дешевле Apple Vision Pro

10.02.2024 [18:18],

Павел Котов

Huawei может выпустить собственную гарнитуру виртуальной реальности Vision, которая составит конкуренцию Apple в этом сегменте. Об этом на китайской платформе микроблогов Weibo рассказал бывший директор по маркетингу Meizu Ли Нань (Li Nan) — по его сведениям, устройство может выйти уже в этом году.

Источник изображения: Huawei Гарнитура может получить название Huawei Vision или Vision Pro — китайский электронный гигант зарегистрировал эту торговую марку в Китае ещё в 2019 году. Она охватывает несколько продуктов, включая умные телевизоры и очки. Из-за этого Apple, возможно, будет вынуждена при выводе своей Vision Pro на китайский рынок переименовать её. Есть и некоторая информация о технических характеристиках Huawei Vision Pro — она получит дисплеи Sony MicroOLED с разрешением 4K и жестовую систему управления без задержек; устройство будет работать на собственном процессоре Huawei. Внешнего дисплея по образцу EyeSight не будет, за счёт чего масса китайской гарнитуры окажется 350 г — без малого вдвое меньше Apple Vision Pro; цена же составит 15 тыс. юаней ($2070), то есть почти вдвое дешевле американского пространственного компьютера, который из-за EyeSight весит 600 г. Господин Ли не сказал, когда выйдет Huawei Vision Pro. Но отметил, что Sony потребуется около полугода, чтобы подготовить дисплей и направить его производителю, то есть официального анонса можно ждать к концу года. Сейчас Huawei предлагает виртуальный монитор Vision Glass. Он оборудуется парой дисплеев MicroOLED с диагональю по 0,49 дюйма и разрешением 1920 × 1080 пикселей каждый. Индекс S&P 500 впервые в истории закрылся выше 5000 пунктов — всё благодаря техногигантам

10.02.2024 [16:55],

Павел Котов

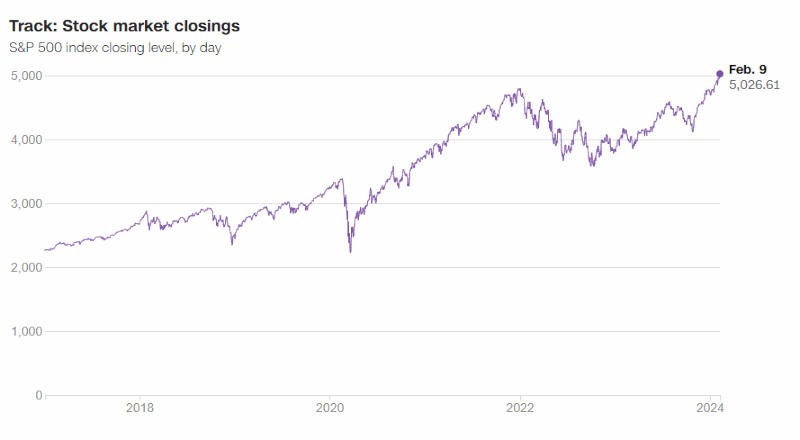

Индекс S&P 500 в минувшую пятницу впервые в истории закрылся выше уровня 5000 — инвесторов вдохновили сильный экономический рост, положительные финансовые отчёты компаний, продолжение бума искусственного интеллекта, а также ожидаемое снижение ключевой ставки ФРС. Впервые индекс взял эту отметку в четверг, передаёт CNN.

Источник изображения: Sergei Tokmakov / pixabay.com S&P 500 потребовался почти 41 год, чтобы достичь первой важной отметки в 1000 пунктов — это произошло 2 февраля 1998 года, напомнил старший аналитик S&P Dow Jones Indices Говард Сильверблатт (Howard Silverblatt). Предыдущий важный рубеж в 4000 пунктов индекс преодолел 1 апреля 2021 года, когда ФРС снизила ставку почти до нуля, правительство США начало вкачивать стимулирующие средства в экономику, а вакцина от коронавируса усилила оптимизм в отношении постпандемийного экономического роста. 19 января базовый индекс впервые за два года обновил собственный рекорд, превысив на закрытии предыдущий максимум в 4796,56 пункта, достигнутый 3 января 2022 года.

Источник изображения: cnn.com Установка S&P 500 нового максимума в январе в 75 % случаев означает, что следующий рекорд будет поставлен в феврале. Когда новые рекорды приходятся на оба месяца, индекс генерирует среднюю доходность около 16 % и заканчивает год с ростом в 88 % случаев, указал аналитик Сэм Стовалл (Sam Stovall) из CFRA Research. В 2023 году индекс вырос на 24 % — среди инвесторов установились оптимистические настроения по поводу снижения инфляции без экономического спада. За этот год его рост уже составил 5,4 %. Большая часть роста S&P 500 пришлась на «Великолепную семёрку»: NVIDIA, Microsoft, Meta✴✴ Platforms, Amazon, Apple, Alphabet и Tesla. В январе NVIDIA, Microsoft, Meta✴✴ Platforms и Alphabet несколько раз закрывались на рекордных уровнях. Доходность акций «Великолепной семёрки» в минувшем году составила 62 % от общей доходности эталонного индекса, которая достигла 26 %, добавил Сильверблатт. Sony PlayStation 5 вдвое превзошла Xbox Series X и S по продажам

10.02.2024 [16:01],

Павел Котов

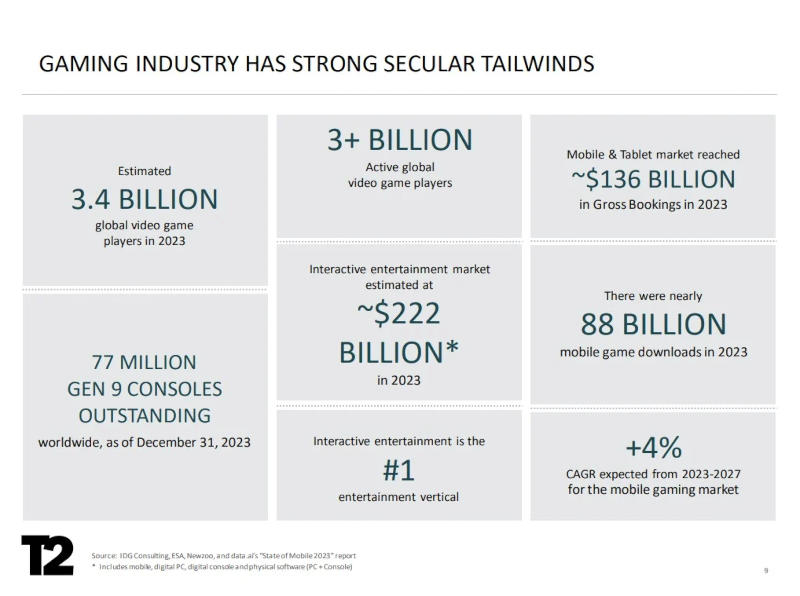

На конец 2023 года продажи Sony PlayStation 5 оказались примерно вдвое выше, чем у Xbox Series X и S. Такими данными в минувший четверг поделился с инвесторами в ходе квартального финансового отчёта издатель серии Grand Theft Auto — компания Take-Two.

Источник изображения: Kerde Severin / unsplash.com В адресованной инвесторам презентации компания сообщила, что по состоянию на 31 декабря было продано 77 млн консолей текущего поколения. Данные, представляющие совокупные продажи PS5 и Xbox Series X/S, были получены от IDG Consulting, Newzoo и Ассоциации развлекательного ПО (Entertainment Software Association). Актуальные игровые приставки Sony и Microsoft вышли в ноябре 2020 года. Microsoft точных данных по продажам Xbox Series X/S не привела, а Sony сообщила, что 9 декабря 2023 года продажи PS5 преодолели 50 млн.

Источник изображения: Take-Two Если предположить, что до конца месяца Sony удалось продать ещё 1,34 млн консолей, и данные Take-Two точны, то PS5 к концу 2023 года вдвое обошла по продажам Xbox Series X/S. В конце декабря исследовательская компания Ampere Analysis доложила о троекратном превосходстве PS5 над Xbox Series X/S по объёмам продаж. Ранее Microsoft открыто признала, что «проиграла консольные войны», стабильно сохраняя за собой третье место после PlayStation и Nintendo с момента выхода оригинальной Xbox в 2001 году. Недостаточно высокие продажи приставок Microsoft породили слухи, что компания планирует расширить каталог своих игр на конкурирующих платформах: Hi-Fi Rush и Sea of Thieves могут выйти на PlayStation и Nintendo Switch, а Starfield и Indiana Jones and the Great Circle — на PlayStation. Астрономы обнаружили экзопланету в «суперкомфортной» зоне для появления жизни

10.02.2024 [14:00],

Геннадий Детинич

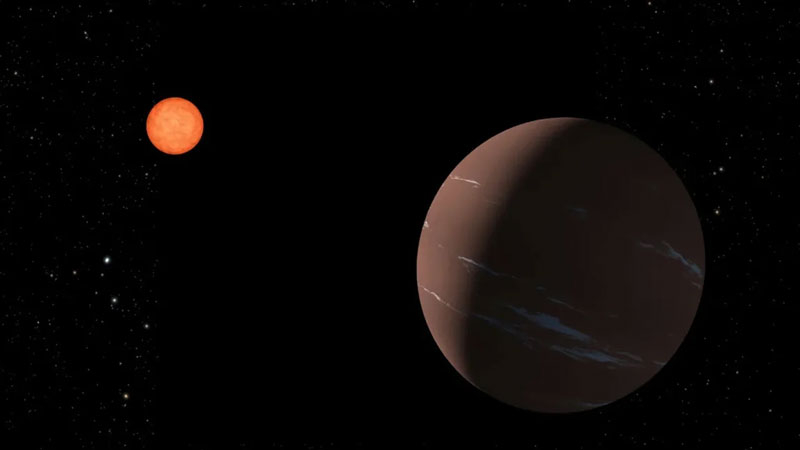

Группа астрономов в данных телескопа NASA TESS обнаружила потенциально пригодный для обитания мир в 137 световых годах от Земли. Экзопланета TOI-715b размерами в полтора раза больше нашей планеты входит в редкую «консервативную зону обитания», в которой условия среды максимально благоприятствуют возникновению биологической жизни. Будущие наблюдения с помощью телескопа «Уэбб» обещают лучше понять ситуацию с этим любопытным объектом.

Художественное представление экзопланеты TOI-715b у красного карлика. Источник изображения: NASA/JPL-Caltech Телескоп TESS запущен в космос в 2018 году. Он охотится за экзопланетами методом определения провалов в яркости звёзд. Частота и сила провалов позволяют вычислить орбиту небесного тела, проходящего по лику звезды-хозяйки системы, и его массу, а также плотность. По этой информации учёные воссоздают образы тех миров, которые кружат вокруг далёких звёзд. Чем ближе эти миры, тем больше у нас возможностей лучше их изучить. Например, исследование спектра света звёзд, проходящего сквозь атмосферу экзопланет, даёт данные об их атмосферах. А это уже способность точнее определить пригодность экзопланеты для жизни, чем просто факт её нахождения в зоне обитаемости звезды. Инструменты для такого анализа есть в составе космической обсерватории им. Джеймса Уэбба и рано или поздно он, таким образом, изучит также мир TOI-715b. «Это открытие является захватывающим, поскольку это первая суперземля в данных TESS, обнаруженная в пределах консервативной обитаемой зоны, — сказала доктор Джорджина Дрансфилд (Georgina Dransfield), научный сотрудник факультета физики и астрономии Бирмингемского университета в Соединенном Королевстве. — Кроме того, поскольку она находится относительно близко, система подходит для дальнейших исследований атмосферы». Астрономы полагают, что TOI-715b у красного карлика существует в узкой и наиболее оптимальной области вокруг звезды, известной как консервативная обитаемая зона, на которую с меньшей вероятностью влияют пределы погрешности измерений. Орбита экзопланеты составляет 19 дней, поэтому она находится в опасной близости к своей звезде с точки зрения угрозы от вспышек и радиации. Но пока звезда-хозяйка ведёт себя спокойно — за год наблюдений было всего две вспышки небольшой интенсивности и есть вероятность, что такое не повредит гипотетической жизни на планете. В 2026 году планируется запуск нового европейского охотника за экзопланетами — обсерватории PLATO. Он будет определять экзопланеты вокруг красных и оранжевых карликов, подобных нашему Солнцу. Астрономы получат в свои руки более мощный и более точный инструмент, благодаря которому мы сможем находить не только суперземли, но также планеты, больше соответствующие облику и размерам нашей родной Земли. TSMC и SK hynix объединились для совместного производства памяти HBM4

10.02.2024 [12:58],

Павел Котов

Стандарт HBM4, как ожидается, благодаря 2048-битному интерфейсу значительно увеличит пропускную способность памяти, что благотворно скажется на работе ИИ-ускорителей и компонентов высокопроизводительных вычислений (HPC). Но эта технология потребует многочисленных изменений в механизмах интеграции памяти, а значит, и более тесного сотрудничества между производителями памяти и производителями логики. Поэтому TSMC и SK hynix сформировали альянс для совместного производства HBM4.

Источник изображения: skhynix.com Новая организация получила название AI Semiconductor Alliance — инициатива поможет TSMC и SK hynix объединить свои сильные стороны и согласовать действия по принципу «стратегии единой команды», пишет Maeil Business News Korea. TSMC возьмёт на себя проработку «некоторых процессов HBM4» — вероятно, имеется в виду выпуск кристаллов с использованием одной из своих передовых технологий, которых нет в арсенале SK hynix. По неподтвержденной информации, речь идёт о нормах 12 нм; ранее также стало известно, что SK hynix и NVIDIA работают над технологией, которая позволит размещать память HBM прямо на графических процессорах без подложки. TSMC одновременно является членом сообщества 3DFabric Memory Alliance вместе со всеми тремя производителями HBM: Micron, Samsung и SK hynix. С последней тайваньский подрядчик также сотрудничает в области разработки упаковки CoWoS для HBM3 и HBM4, совместной оптимизации технологий проектирования (DTCO) HBM и даже чиплетного интерфейса UCIe для HBM. Тесное сотрудничество TSMC и SK hynix позволит гарантировать, что память HBM3E и HBM4 от SK hynix будет работать с чипами производства TSMC. Это важно, поскольку SK hynix лидирует на рынке HBM, а TSMC — крупнейший в мире полупроводниковый подрядчик. Корейское издание обмолвилось, что альянс также направлен на создание «единого фронта против Samsung Electronics» — это конкурент одновременно и для TSMC, и для SK hynix, но, возможно, не стоит излишне доверять таким заявлениям. И правда, трудно представить, чтобы TSMC намеренно ограничила совместимость своей упаковки только продукцией SK hynix — вероятно, в действительности тайваньский подрядчик будет просто плотнее сотрудничать с SK hynix, чем с Samsung. В Канаде создали альтернативную архитектуру кубита со встроенной защитой от ошибок вычислений

10.02.2024 [12:55],

Геннадий Детинич

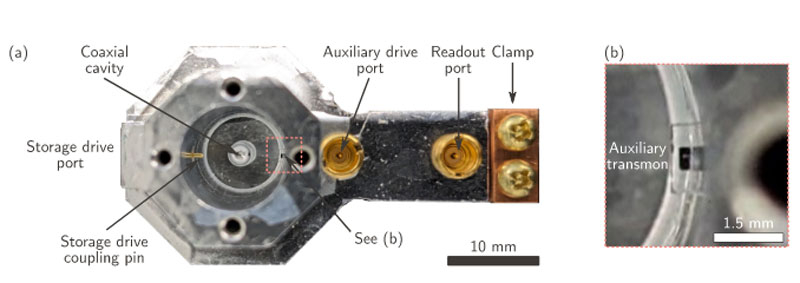

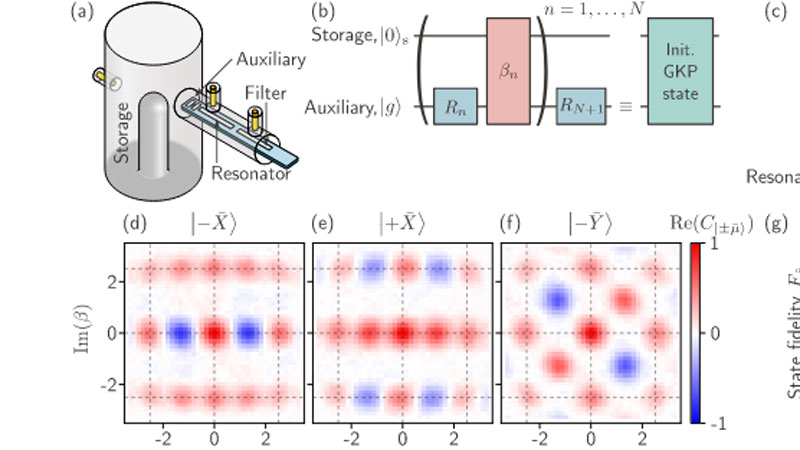

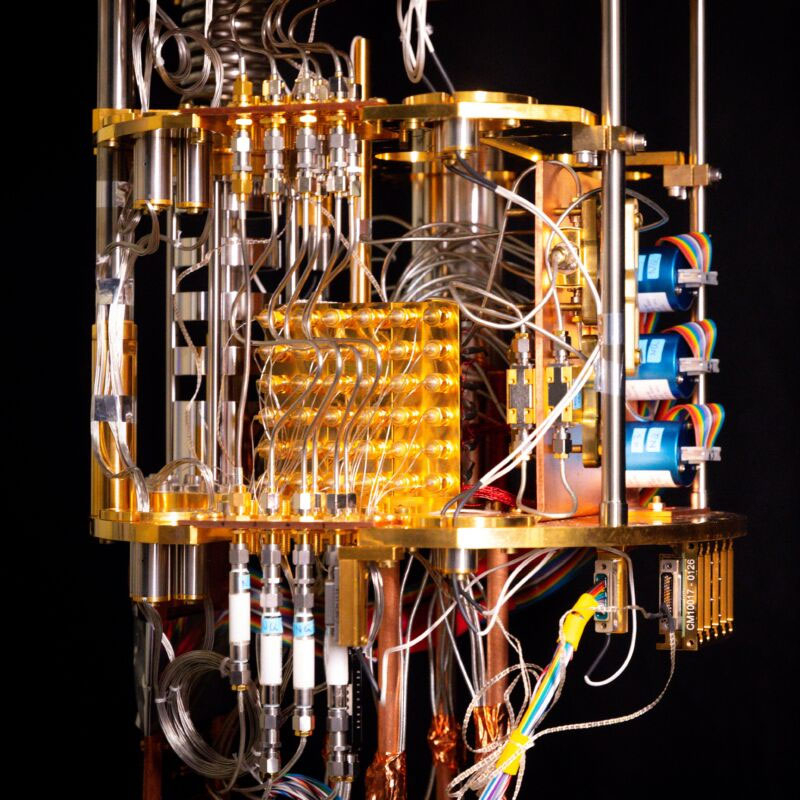

Канадская компания Nord Quantique на сайте arXiv выложила статью, в которой сообщила о создании альтернативной архитектуры кубита. Ценность разработки в том, что каждый участвующий в вычислениях логический кубит может быть представлен всего одним физическим кубитом. Все возникающие в процессе ошибки исправляются им самим без привлечения других физических кубитов, что открывает путь к массовым квантовым компьютерам.

Источник изображения: ИИ-генерация Кандинский 3.0/3DNews Компания Nord Quantique является дочерним предприятием факультета квантовой физики Шербрукского университета — одного из ведущих центров квантовых исследований в Канаде. Это предполагает крепкое теоретическое обоснование разработок компании в дополнение к возможности производить оборудование на заводе в Шербруке. Свой «альтернативный» кубит Nord Quantique создала в одном экземпляре. Статья и работа базируются на проверке его работы вне рамок вычислений, которые начнут проводиться ближе к концу текущего года.

Физическое представление кубита. Источник изображения: Nord Quantique Интересно, что канадцы фактически перевернули с ног на голову архитектуру, давно используемую в квантовых компьютерах IBM и Google в виде так называемых трансмониевых сверхпроводящих кубитов. Кубиты в компьютерах IBM и Google хранят информацию в сверхпроводящей петле, а управляются микроволновым резонатором, в котором микроволновые фотоны задерживаются на какое-то время. Кубит Nord Quantique, напротив, хранит информацию — квантовые состояния — в микроволновых фотонах, удерживаемых в резонаторах, а сверхпроводящая петля управляет его состоянием. Хитрость в том, что в резонатор можно запустить избыточное количество фотонов. Чем их больше, тем меньше вероятность появления ошибки. Избыточность — это хорошо проверенный и доказанный способ снизить количество ошибок, что широко применяется в обычных вычислениях.  В работе Nord Quantique показано, что предложенная архитектура кубита снизила вероятность появления ошибки на 14 %. К сожалению, общая точность пока низкая и начинается примерно с 85 %, что значительно ниже, чем в других системах, прошедших многолетнюю разработку. И всё же, в некоторых случаях бозонный кубит, как назвали его в Nord Quantique, показал точность работы на уровне 99 %. Иными словами, перспективы у него есть, если компания начнёт быстро догонять конкурентов.

Квантовый компьютер на сверхпроводящих кубитах Было бы заманчиво увидеть масштабное применение кубита Nord Quantique. Для кубитов IBM и Google безошибочная работа кубитов означает, что каждый логический кубит должен состоять из 1000 физических кубитов. Для логического кубита Nord Quantique нужен всего один физический кубит или, по крайней мере, десятки, а не тысячи всех этих петелек, резонаторов, коаксиальных разъёмов и прочей мелочи, которая в масштабе представляет то, что мы видим на современных фотографиях квантовых систем: огромные хромированные люстры. США выделят $5 млрд на создание национального исследовательского центра в области полупроводников

10.02.2024 [12:49],

Павел Котов

Администрация президента США планирует потратить $5 млрд на создание исследовательского центра, направленного на поддержку разработки чипов и инноваций в области электроники, а также противодействие попыткам Китая захватить передовые позиции в отрасли. Источник изображения: Maxence Pira / unsplash.com Накануне американские власти подтвердили намерение создать Национальный центр полупроводниковых технологий (NSTC), который станет второй крупной инвестицией государства в область полупроводниковых исследований и разработки после принятия в 2022 году «Закона о чипах» с бюджетом в десятки миллиардов долларов. Консорциум NSTC будет распределять средства на такие направления как подготовка специалистов и гранты на исследования в области полупроводников. В начале марта откроются заявки на финансирование проектов в области упаковки чипов. Сейчас чиновники работают над тем, чтобы не позволить Китаю воспользоваться достижениями финансируемых NSTC исследователей. Проект также направлен на заполнение пробелов американской науки и промышленности в таких областях как электронные компоненты и упаковка чипов — сегодня это ключевое направление в противостоянии США и Китая. Не факт, что проект будет предусматривать полный запрет на сотрудничество с китайскими учёными и университетами, но безопасности исследований уделяется особое внимание. «Закон о чипах» предусматривает выделение $39 млрд на стимулирование производства и $11 млрд на исследования и разработку — американская полупроводниковая отрасль десятки лет занималась переносом производства в Азию, и теперь местное производство предстоит восстанавливать, прикладывая немалые усилия. Примечательно, что за полтора года с момента подписания документа производители полупроводников не получили ничего из предусмотренных бюджетом средств. Место для штаб-квартиры NSTC пока не выбрано. Канада запретит продажи Flipper Zero из-за автоугонов, реальность которых сомнительна

10.02.2024 [11:37],

Павел Котов

Канадские власти сообщили о намерении запретить хакерский мультитул Flipper Zero, который якобы используется для угона автомобилей. Об этом заявил в минувший четверг министр по инновациям, науке и промышленности Канады Франсуа-Филипп Шампань (François-Philippe Champagne) — он пояснил, что «преступники пользуются сложными инструментами для угона машин. И канадцы справедливо встревожены».

Источник изображений: flipperzero.one «Сегодня я объявил, что мы запретим ввоз, продажу и использование потребительских хакерских устройств, таких как „флипперы”, которые применяются для совершения этих преступлений», — написал чиновник в соцсети X. Страна «задействует все возможности, чтобы запретить устройства, используемые для угона транспортных средств путём копирования беспроводных сигналов для удалённого доступа без ключа, таких как Flipper Zero», добавили в правительстве Канады. В настоящее время в Канаде угоняют около 90 тыс. машин в год. И Flipper Zero при ценнике в $169 действительно может использоваться для организации сбоев в работе устройств, в том числе посредством эмуляции радиочастотной идентификации. Лишь в декабре Apple удалось исправить ошибку, из-за которой Flipper Zero с модифицированной прошивкой атаковал iPhone чрезмерным количеством всплывающих сообщений. Но производитель мультитула уверен, что для защиты автомобилей от угона предложенные канадскими властями меры ошибочны. «Flipper Zero нельзя использовать для угона любого автомобиля, особенно выпущенного после девяностых годов, поскольку в их системах безопасности используются скользящие коды. Кроме того, чтобы перехватить исходный сигнал, потребуется заблокировать сигнал от владельца, на что оборудование в Flipper Zero неспособно», — пояснил ресурсу PCMag операционный директор Flipper Devices Алекс Кулагин (Alex Kulagin).  Канадские власти, возможно, отреагировали на ролики из интернета, где якобы демонстрируются способы вскрытия машин при помощи Flipper Zero — иногда даже подробно рассказывают, как настроить устройство для имитации сигнала от брелока замка, если находиться рядом и улавливать этот сигнал. Но повторить это на практике непросто: современные автомобильные системы работают не на постоянных, а на плавающих кодах, то есть перехваченный код для открытия машины можно использовать только один раз. Если Flipper Zero его и перехватит, то использовать его уже не сможет — применяться он больше не будет. Он останется действительным, если заглушить сигнал от брелока. «Flipper Zero предназначен для тестирования и разработки в области безопасности, и мы приняли необходимые меры предосторожности, чтобы гарантировать, что устройство не сможет использоваться в незаконных целях», — добавили в Flipper Devices. Компания также представила заявление одного из региональных ведомств США, которое установило, что пользователи соцсетей преувеличивают возможности гаджета как хакерского инструмента. «Большинство опубликованных в TikTok роликов могли быть постановочными и содержать не соответствующую действительности информацию, поскольку большинство современных беспроводных устройств не является уязвимым для простых атак с повторным воспроизведением [сигналов]», — гласят выводы Службы интеграции кибербезопасности и коммуникаций Нью-Джерси (NJCCIC). В прошлом году ёмкость рынка полупроводниковой продукции сократилась на 8,2 % до $526,8 млрд

10.02.2024 [07:41],

Алексей Разин

В денежном выражении рынок полупроводниковых компонентов в прошлом году много потерял из-за неблагоприятной динамики цен на память, но отраслевая ассоциация SIA утверждает, что в целом сокращение оборота ограничилось 8,2 % до $526,8 млрд по сравнению с 2022 годом. Зато уже в этом году ёмкость рынка вырастет на 13,1 %.

Источник изображения: ASML Как поясняют представители SIA, позапрошлый год сформировал не очень выгодную для сравнения высокую базу, поскольку по его итогам на мировом рынке было продано рекордное количество полупроводниковой продукции на общую сумму $574,1 млрд. Сложному во многих отношениях 2023 году перекрыть этот результат не удалось. Во второй половине прошлого года объёмы продаж чипов пошли вверх, как поясняется в пресс-релизе ассоциации SIA. В частности, по итогам четвёртого квартала наблюдался рост выручки на 11,6 % до $146 млрд по сравнению с аналогичным периодом 2022 года. В последовательном сравнении выручка четвёртого квартала 2023 года выросла на 8,4 %. Декабрьские продажи последовательно увеличились на 1,5 % до $48,6 млрд. Всё это позволяет рассчитывать на формирование устойчивой тенденции к восстановлению спроса на полупроводниковые изделия. Статистика SIA способна претендовать на представительность, поскольку в эту ассоциацию входят 99 % поставщиков чипов на территории США и примерно две трети мировых. Руководство ассоциации убеждено, что по итогам текущего года выручка в полупроводниковом секторе вырастет как минимум на 13,1 %. Чтобы обеспечить непрерывный рост рынка, властям различных стран необходимо сосредоточиться на поддержке локальных производителей и устранению торговых барьеров, как считают в SIA. Среди основных макрорегионов только Европа по итогам прошлого года продемонстрировала рост выручки в полупроводниковом сегменте, увеличив её на 4 %. Япония сократила свою выручку на 3,1 %, обе Америки просели сразу на 5,2 %, Китай потерял все 14 %, а все прочие страны, включая Азиатско-Тихоокеанский регион, убавили в выручке 10,1 %. В декабре прошлого года последовательный рост выручки наблюдался в Китае (4,7 %), Америках (1,8 %), а также в странах АТР и всех прочих (0,3 %), за исключением Японии (-2,4 %) и Китая. Европа потеряла в профильной выручке 3,9 %. Распределение выручки в 2023 году между сегментами рынка полупроводниковой продукции позволило направлению логических компонентов выйти в лидеры с $178,5 млрд, на втором месте оказался многострадальный рынок памяти с $92,3 млрд. Микроконтроллеры прибавили в выручке 11,4 % до $27,9 млрд, а автомобильные компоненты выросли сразу на 23,7 % до $42,2 млрд. Смарт-очки Frame с мультимодальным ИИ Noa оценены в $349

10.02.2024 [01:30],

Владимир Мироненко

Стартап Brilliant Labs представил умные очки Frame на открытой платформе с мультимодальным ИИ, с помощью которых можно осуществлять поиск в Сети, выполнять перевод текста или разговора, генерировать картинки и т. д.

Источник изображений: Brilliant Labs Frame весом всего 40 г используют чип nRF52840 Cortex-M4F и оснащены цветным микро-OLED-дисплеем с разрешением 640 x 400 пикселей, который проецируют изображение через призму прямо перед пользователем. Картинка отображается в поле зрения всего-то 20°. Для сравнения, поле зрения у Air 2 Ultra от Xreal составляет 52°. То есть пользователь Frame будет видеть изображение или текст в небольшом окошке. Смарт-очки работают под управлением специальной операционной системы с «полностью открытым исходным кодом», а также поддерживают приложение Noa. Приложение включает ИИ-ассистента, который использует OpenAI для визуального анализа, Whisper для перевода и Perplexity для веб-поиска. В интервью Venture Beat компания заявила, что ИИ Noa «обучается и адаптируется как к пользователю, так и к задачам, которые он получает». Пользоваться Noa можно бесплатно, есть ежедневные лимиты. Устройством также можно управлять с помощью голоса.  В комплект поставки Frame входит камера с разрешением 1280 × 720 пикселей, микрофон, аккумулятор ёмкостью 222 мА·ч и зарядное устройство Mister Power, которое при подключении добавляет очкам «нос». Frame поставляются в трех цветах: чёрном, сером и прозрачном. Цена новинки — $349. Можно также добавить линзы по рецепту, что увеличит цену до $448. Смарт-очки Frame уже доступны для предзаказа, поставки начнутся 15 апреля. Acer выпустит вседорожный электросамокат Predator Extreme стоимостью 1300 евро

09.02.2024 [23:46],

Николай Хижняк

Бренд Predator компании Acer в первую очередь известен благодаря мощным игровым ноутбукам, а также мониторам. Однако в скором времени под этой маркой будут выпускаться электрические самокаты. Компания официально представила вседорожный электросамокат Predator Extreme (модель PES017). Производитель впервые сообщил о готовящейся новинке ещё в марте 2023 года. С тех пор компания доработала Predator Extreme, повысив его мощность и запас хода.

Источник изображений: Acer В Predator Extreme используется электрический мотор мощностью 350 Вт с пиковой отдачей 960 Вт и крутящим моментом 40 Н·м. Это позволяет ему взбираться по дорогам с углом наклона до 18°. Электросамокат поддерживает несколько скоростных режимов: до 20 км/ч, до 25 км/ч или до 32 км/ч. Переключаться между ними можно с помощью специального контроллера, встроенного в ручку. Скутер оснащён 48-В батарей ёмкостью 10,5 А·ч, одной зарядки которой хватит до 35 км пути.  В электросамокате Acer используется система двойной подвески, которая включает в себя телескопическую вилку спереди, а также задний амортизатор, что делает поездку на неровных поверхностях более комфортной. Другие особенности Predator Extreme включают низкий центр тяжести, 10″ внедорожные шины для улучшенного сцепления, гидравлические дисковые тормоза и индикаторные лампы. Компания планирует выпустить Predator Extreme в странах в Европы, Ближнего Востока и Африки во II квартале 2024 года. Новинку оценили в 1299 евро (около $1400). ViewSonic представила игровой 27-дюймовый OLED-монитор с поддержкой разрешения 1440p и частоты обновления 240 Гц

09.02.2024 [23:38],

Николай Хижняк

Компания ViewSonic представила игровой OLED-монитор XG272-2K-OLED. Новинка поддерживает разрешение QHD (2560 × 1440 пикселей) и частоту обновления 240 Гц, а также имеет встроенную RGB-подсветку.

Источник изображений: ViewSonic Монитор оснащён 26,5-дюймовой OLED-матрицей с поддержкой 10-битной глубины цвета. Пиковая яркость дисплея составляет 450 кд/м2 в режиме HDR. Экран имеет сертификацию HDR10, поддерживает 100-процентный охват цветового пространства sRGB и 98,5-процентный охват DCI-P3. Скорость отклика дисплея составляет 0,02 мс. Заявлена поддержка технологии синхронизации изображения AMD FreeSync Premium и совместимость с NVIDIA G-Sync. В оснащение монитора ViewSonic XG272-2K-OLED входят два разъёма HDMI 2.1, два DisplayPort 1.4, один USB Type-C с возможностью передачи 15 Вт мощности на внешнее устройство, три USB 3.1 Type-A, один USB 3.1 Type-B port, а также комбинированный 3,5-мм аудиовыход и пара динамиков мощностью по 3 Вт каждый. В комплект поставки монитора также входит эргономичная подставка с регулировкой углов поворота и наклона, а также высоты экрана над столом. Кнопки настройки монитора и RGB-подсветки встроены в его подставку. Китайские производители солнечных панелей уничтожают европейских конкурентов, но Брюссель не знает, что с этим делать

09.02.2024 [23:34],

Геннадий Детинич

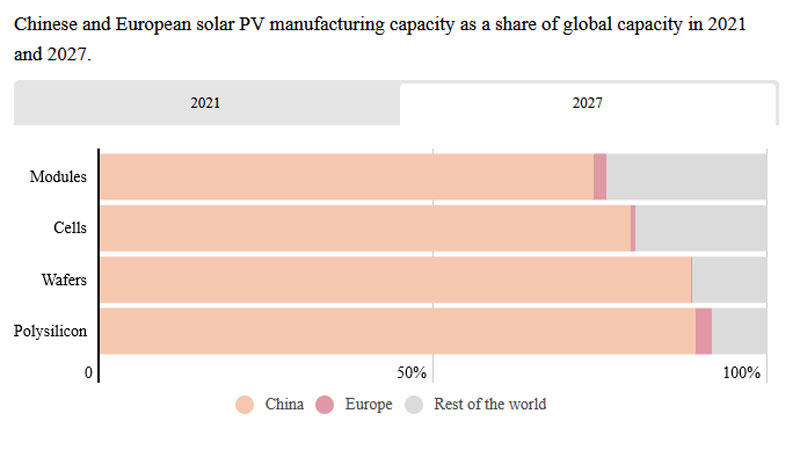

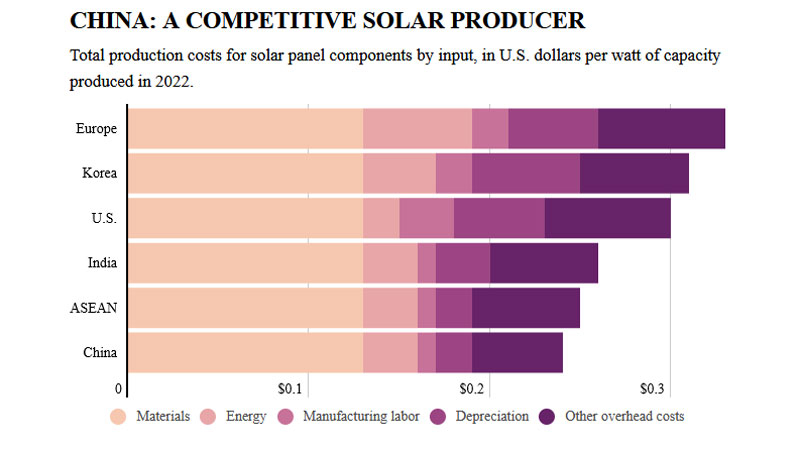

Как сообщает издание Politico, Европейский союз стоит перед серьёзнейшим выбором: хочет ли он быть «зелёным» или стратегически успешным в перспективе? Ибо одновременно и то и другое у ЕС не выйдет. Европейские производители солнечных панелей открыто говорят, что если власти не предпримут защитных мер, то китайская продукция уничтожит их бизнес за считанные месяцы или даже недели.

Источник изображения: ИИ-генерация Кандинский 3.0/3DNews «Несмотря на то, что Европейскому союзу необходимо избавиться от выбросов углекислого газа, он всё больше зависит от импорта из Китая, который он называет экономическим конкурентом и, что ещё хуже, системным соперником», — пишет издание. С одной стороны, ЕС выделяет миллиарды евро на ускоренное развёртывание солнечных электростанций по всей Европе. Панели для этих задач и объёмов можно купить только в Китае, включая поставки из Синьцзян-Уйгурского автономного района, о котором вне политического контекста даже говорить нельзя, не то что заводить тесные экономические отношения. Подобная бизнес-модель грозит уничтожить несколько последних европейских предприятий по выпуску солнечных панелей и идёт вразрез с предложениями группы стран во главе с Францией, которые ратуют за реиндустриализацию Европейского союза. Такое противостояние обязательно выльется в длительные торги в правительстве ЕС с непонятным пока результатом. Но то, что это только затянет принятие стратегического решения, каким бы оно ни было, очень и очень вероятно.

Прогнозируемые мощности по выпуску солнечных панелей в 2027 году. Источник изображений: IEA «Ситуация действительно тревожная, — сказал Йохан Линдаль (Johan Lindahl), генеральный секретарь Европейского совета по производству солнечной энергии (ESMC), представляющий местных производителей. — Мы можем потерять большую часть европейской промышленности в ближайшие пару месяцев, если не будет сильного политического сигнала». Европейская комиссия начала предварительные обсуждения вариантов оказания помощи производителям, но при этом не взяла на себя никаких конкретных обязательств во время прошедших в минувший понедельник дебатов в Европейском парламенте, которые, как надеялись многие в отрасли, покажут, что блок серьёзно относится к этому вопросу. Глава финансовых служб Европейской комиссии Мэйрид Макгиннесс (Mairead McGuinness ) во время сессии в Страсбурге заявила европейским законодателям, чтобы они «работали в тесном контакте» и что низкие цены на продукцию «явно являются проблемой для производителей солнечных панелей в ЕС». В то же время она подтвердила, что власти ЕС будут «тесно сотрудничать с промышленностью ЕС, чтобы приложить все усилия на техническом и политическом уровне».

Затраты на производство солнечных панелей по странам с разбивкой на категории На сегодняшний день китайские компании контролируют свыше 80 % глобальной цепочки поставок кремниевых солнечных панелей. Для сравнения, ЕС произвёл только 3 % солнечных панелей, установленных в прошлом году. Можно ли в таких условиях что-то предпринять? Это представляется маловероятным. Что-то изменить может только полная смена курса на развитие соответствующей отрасли в Европе. Необходимо принять, что Китай является экзистенциальной угрозой и шанс есть только в развитии настолько передовых технологий, где Европа ещё имеет преимущества. В конце концов, необходимо осознать существенную угрозу национальной безопасности и действовать соответствующим образом. И всё бы хорошо, но только летом этого года в ЕС выборы, так что чиновники будут заняты совсем другими проблемами. Для ИИ и не только: NVIDIA вплотную займётся разработкой кастомных чипов для крупных заказчиков

09.02.2024 [21:09],

Сергей Сурабекянц

NVIDIA сформировала новое подразделение, которое займётся разработкой индивидуальных чипов для облачных операторов и других крупных клиентов. Главная задача — захват как можно большей части развивающегося рынка специализированных чипов ИИ и защита бизнеса от растущего числа компаний, предлагающих альтернативные решения. NVIDIA в настоящее время контролирует около 80 % рынка высокопроизводительных ИИ-чипов, благодаря чему её рыночная стоимость в этом году выросла на 40 % до $1,73 трлн.

Источник изображений: NVIDIA Клиенты NVIDIA, в том числе OpenAI, Microsoft, Alphabet и Meta✴✴, активно скупают чипы NVIDIA H100 и A100, чтобы не отстать в гонке генеративного ИИ. «Если вы действительно пытаетесь оптимизировать энергопотребление или затраты, вы не можете позволить себе отказаться от H100 или A100», — уверен Грег Райчоу (Greg Reichow), генеральный партнёр Eclipse Ventures. Стоимость одного ускорителя H100 зависит от объёма закупок и колеблется в диапазоне от $16 000 до $100 000. При этом одна только Meta✴✴ планирует в этом году довести общий объём закупленных H100 до 350 000 штук. Одновременно с этим многие технологические компании начали разрабатывать свои собственные процессоры под конкретные задачи. По слухам, представители NVIDIA встречались с менеджерами Amazon, Meta✴✴, Microsoft, Google и OpenAI, чтобы обсудить создание для них собственных чипов. Помимо чипов для центров обработки данных, компания привлекает клиентов в сфере телекоммуникаций, автомобилестроения и видеоигр. По мнению Алана Векеля (Alan Weckel) из исследовательской компании 650 Group, рынок специализированных микросхем для центров обработки данных вырастет до $10 млрд в этом году и удвоится в 2025 году. Аналитик Needham Чарльз Ши (Charles Shi) оценивает годовой оборот рынка «нестандартных» чипов примерно в $30 млрд, что составляет около 5 % от общих мировых продаж чипов. NVIDIA не может позволить себе упустить столь заметный «кусок полупроводникового пирога».  Компания прикладывает значительные усилия для проникновения на рынок специализированных ИИ-чипов и заказных микросхем для дата-центров, где «правят бал» Broadcom и Marvell. Осведомлённые лица утверждают, что Дина МакКинни (Dina McKinney), бывший топ-менеджер AMD и Marvell, возглавит специальное подразделение NVIDIA, цель которого — расширить проникновение компании в сферы облачных вычислений, беспроводной связи 5G, видеоигр и автомобилестроения. Эта информация была удалена из публичных источников после запросов СМИ, которые NVIDIA комментировать отказалась. Выход NVIDIA на этот рынок может существенно повлиять на продажи Broadcom и Marvell. «Учитывая, что у Broadcom бизнес по производству кастомных чипов достигает $10 млрд, а у Marvell — около $2 млрд, это реальная угроза, — уверен основатель исследовательской группы SemiAnalysis Дилан Патель. Nintendo Switch уже использует чип NVIDIA Tegra X1. Ожидается, что новая версия консоли, выход которой запланирован на этот год, снова получит кастомный процессор NVIDIA. Осведомлённые источники утверждают, что сейчас NVIDIA ведёт переговоры с производителем телекоммуникационной инфраструктуры Ericsson о разработке чипа. Согласно многочисленным источникам и публикациям в социальных сетях, NVIDIA также планирует нацелиться на рынки автомобилей и видеоигр.  Аналитики оценивают рынок телекоммуникационных чипов в диапазоне $4–5 млрд в год. По мнению экспертов, рынок специализированных чипов для автомобилей будет последовательно расти с нынешних $6-8 млрд на 20 % в год, а рынок заказных чипов для видеоигр может ощутимо вырасти с нынешних $7-8 млрд после выхода на рынок консолей следующего поколения от Xbox и Sony. Стоит отметить, что в типичном соглашении партнёр по проектированию, такой как NVIDIA, предоставляет свою интеллектуальную собственность и технологии, а непосредственно за производство чипов, их упаковку и другие дополнительные этапы несут ответственность контрактные производители, например, TSMC. NASA впервые опробует радиочастотный датчик измерения уровня топлива в баках

09.02.2024 [20:23],

Геннадий Детинич

14 февраля в космос должен быть отправлен лунный посадочный модуль Nova-C компании Intuitive Machines из Хьюстона. На баках модуля с криогенным горючим инженеры NASA установили экспериментальные датчики уровня топлива. Эта технология ещё не испытывалась во время длительных перелётов с ускорениями и в невесомости. Новинка должна обеспечить более точный учёт оставшегося в баках горючего, что улучшит планирование полётных заданий.

Источник изображения: Intuitive Machines На Земле в условиях нормальной гравитации горючее скапливается в нижней части баков и определить его уровень не составляет труда множеством простых способов от механических (поплавки и другое) до электронных. В условиях невесомости и при движении с ускорением топливо может растекаться по стенкам или скапливаться в одном месте. Обычные способы измерения его уровня ничего кроме путаницы не дадут. Поэтому в NASA создали радиочастотный датчик измерения массы топлива — RFMG (radio frequency mass gauge). Датчик «просвечивает» радиоволнами объём бака с горючим и определяет резонансные отклики, которые зависят от толщины слоя топлива. Затем полученный результат сравнивается с базой данных, после чего программа вычисляет примерный объём оставшегося горючего. Разработчики утверждают, что погрешность измерений не превышает нескольких процентов. NASA уже испытывало новую систему на самолётах в свободном падении и на МКС. В составе миссии Nova-C испытание пройдёт во всей полноте, от старта на Земле до посадки на Луну. Без использования подобных датчиков оставшийся объём горючего вычисляется по предполагаемому расходу горючего во время работы двигателей. Но криогенное топливо в баках имеет свойство выкипать в процессе простого хранения, что вносит в традиционный метод подсчёта остатков большую погрешность. Для полётов к Луне это, по большому счёту, не имеет особого значения, хотя японскому модулю ispace HAKUTO-R, похоже, как раз не хватило горючего для посадки на спутник. Но если говорить о полётах вглубь Солнечной системы, то знание точных запасов топлива поможет намного лучше помочь спланировать миссию. Жажда наживы американских инвесторов помогла полупроводниковой и ИИ-отрасли Китая, считает Конгресс США

09.02.2024 [17:08],

Павел Котов

Вашингтон приложил значительные усилия, чтобы сдержать развитие полупроводниковой промышленности Китая и лишить страну инструментов для разработки передовых моделей искусственного интеллекта. Вину за недостаточную эффективность этих мер Конгресс США возложил на американских инвесторов.

Источник изображения: F8_f16 / pixabay.com Специальный комитет Палаты представителей, занимающийся расследованием деятельности Коммунистической партии Китая, накануне сообщил, что венчурные фонды GGV Capital, GSR Ventures, Qualcomm Ventures, Sequoia Capital и Walden International инвестировали миллиарды долларов в китайские предприятия, работающие в области полупроводников и ИИ. В частности, $1,9 млрд были выделены специализирующимся на ИИ компаниям Megvii, Intellifusion, SenseTime, DeepGlint и Yitu, внесённым в американские чёрные списки. Ещё не менее $1,2 млрд было вложено в 150 китайских полупроводниковых предприятий — Walden, в частности, на ранних этапах оказывала поддержку Semiconductor Manufacturing International Co. (SMIC), крупнейшему в стране производителю чипов. Walden связали с инвестиционными вливаниями в размере $125 млн в саму SMIC, а также её дочерние компании — SJSemi и Galaxy Core. Американские инвесторы оказывают и нематериальную поддержку китайским компаниям, предлагая им консультационные услуги, помощь в привлечении кадров и деятельности на рынке. Председатель совета директоров Walden Лип-Бу Тань (Lip-Bu Tan) ранее занимал должность генерального директора Cadence Design Systems — эта американская компания разрабатывает ПО для автоматизации проектирования электроники, и китайские компании, включая Huawei, пытаются его воспроизвести. Тань и его партнёры в Walden занимали места в советах директоров SMIC и Advanced Micro-Fabrication Equipment Co. (AMEC), координируя их возможности и поддерживая их своими экспертными знаниями, утверждают в Конгрессе США. Введённые Вашингтоном санкции ограничивают экспорт американских полупроводниковых технологий и ИИ-ускорителей в Китай и запрещают американским компаниям инвестировать в китайские технологии, которые могут иметь применение в военной сфере. Из-за этого многие венчурные фонды вывели свои китайские подразделения вовне — данный шаг парламентарии оценили положительно, но отметили, что для остановки притока американских денег в Китай этого может быть недостаточно. Хотя комитету Конгресса удалось связать американское финансирование с китайскими концернами в отраслях ИИ и полупроводников, крупные инвестиции были сделаны ещё до введения санкций, то есть на тот момент они были законными. Кроме того, средства обычно инвестируются ещё на стадии стартапа, когда трудно предсказать особенности дальнейшего развития компании. Авторы доклада предлагают ужесточить контроль и наложить запреты на американские вложения в критически важные технологии в Китае, расширив ограничительные меры на компании, входящие в те или иные чёрные списки Вашингтона. В США возник дефицит видеокарт GeForce RTX 4080 Super

09.02.2024 [16:29],

Николай Хижняк

В магазинах США наблюдается нехватка видеокарт GeForce RTX 4080 Super, пишет портал VideoCardz. Ускоритель с рекомендованной стоимостью $999, что ниже стартовой цены обычной модели RTX 4080, оказался востребованным среди геймеров. Как пишет источник, в большинстве магазинов карту невозможно заказать онлайн.

Источник изображения: VideoCardz У ряда ретейлеров, включая BestBuy и MicroCenter, ещё остался некоторый запас видеокарт GeForce RTX 4080 Super по рекомендованной цене. В частности, BestBuy реализует эталонную версию RTX 4080 Super Founders Edition от NVIDIA. Однако купить эти карты онлайн невозможно, за ними нужно идти в ближайший физический магазин. Самая же доступная версия RTX 4080 Super, которую всё ещё можно приобрети онлайн, предлагается за $1123. По данным VideoCardz, у ретейлера B&H Photo Video, а также в фирменных магазинах ASUS, MSI и Zotac карты отсутствуют. У Newegg самая доступная RTX 4080 Super предлагается за $1149. Других версий нет в наличии. Ограниченная доступность RTX 4080 Super на момент запуска может быть связана с малыми запасами обычной RTX 4080 в течение последних недель. Напомним, что RTX 4080 Super полностью заменит обычную модель в продаже. Сейчас RTX 4080 Super по рекомендованной цене $999 нет ни у одного крупного американского ретейлера и партнёра NVIDIA. Ситуация на европейских рынках, с другой стороны, выглядит более оптимистичной. Несколько магазинов предлагают RTX 4080 Super по цене €1109. Как пишет VideoCardz, проблем с запасами видеокарт RTX 4070 Super и RTX 4070 Ti Super у продавцов не наблюдается. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |