|

Опрос

|

реклама

Быстрый переход

Североамериканские компании сократили на 30 % закупки роботов в прошлом году

13.02.2024 [15:51],

Алексей Разин

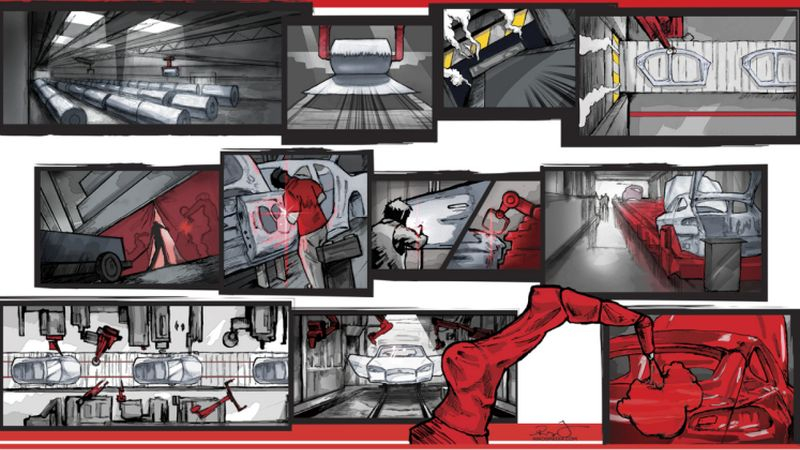

По данным одной из отраслевых ассоциаций, компании Северной Америки в прошлом году на треть сократили покупку промышленных роботов, поскольку замедление темпов развития экономики и рост ключевой ставки рефинансирования теперь позволяют с трудом оправдывать подобные инвестиции в средства производства. До этого закупки робототехники в промышленном секторе Северной Америки росли стабильно на протяжении пяти лет подряд.

Источник изображения: Tesla В прошлом году североамериканские компании закупили 31 159 роботов, что на 30 % меньше итогов 2022 года. В процентном выражении это снижение оказалось максимальным с 2006 года, а в абсолютном оказалось максимальным за всё время наблюдений. Половина закупок промышленных роботов в регионе в прошлом году пришлась на автомобильную отрасль. В четвёртом квартале в отдельности поставки сократились на 8 % до 7683 штук в годовом сравнении. Отчасти замедление объёмов продаж объясняется стремлением некоторых производителей внедрить более совершенные модели роботов. При этом желающие продать бывшее в употребление оборудование компании столкнулись со снижением спроса на него. Датская компания Universal Robots по итогам прошлого года сократила выручку на 7 % до $304 млн. При этом объёмы продажи промышленных роботов в период пандемии достигали рекордных величин. По крайней мере, рекордным с точки зрения объёмов заказов стал 2022 год. Это уже само по себе сформировало неблагоприятную для сравнения в 2023 году базу, помимо прочего. Некоторые поставщики роботов заявили о том, что клиенты задержали реализацию крупных проектов до текущего года. Наиболее оптимистичные участники рынка ожидают, что спрос на роботов вернётся к росту во второй половине этого года. Эффект пандемии, по сути, уже исчерпал потенциал своего влияния на рынок, но некоторые компании до сих пор «переваривают» излишки робототехнического оборудования. При этом в США сохраняется дефицит рабочих рук на производстве, и их замена роботами является разумным решением, поэтому страдать от затоваривания местный рынок промышленных роботов долго не будет. Смартфон Nothing Phone (2a) будет представлен 5 марта — в США его запустят нестандартно

13.02.2024 [15:42],

Владимир Фетисов

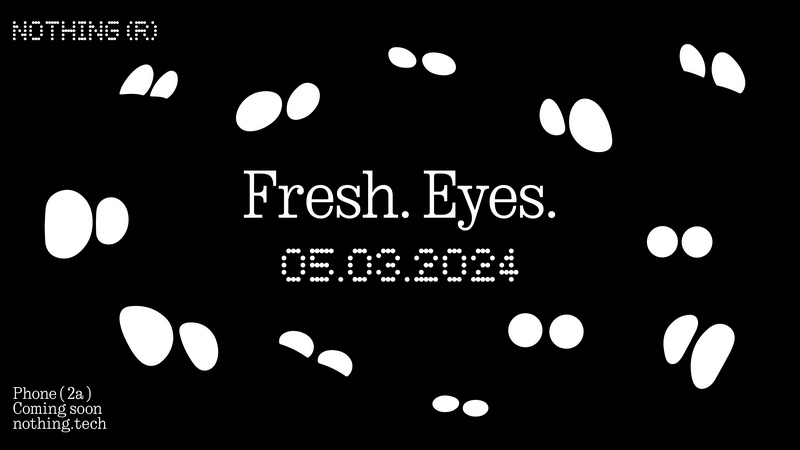

Компания Nothing объявила дату выпуска своего нового смартфона. В опубликованном тизере сказано, что аппарат Nothing Phone (2a) будет представлен 5 марта. Также было отмечено, что в США он дебютирует в рамках «Программы для разработчиков», а не масштабного официального релиза. При этом разработчики не показали ни одного снимка устройства, а также не рассказали о его параметрах и стоимости.

Смартфон Nothing Phone (2) «Программа для разработчиков» похожа на то, как Nothing подошла к запуску своего первого смартфона в США. Заинтересованные лица могли заплатить $299 за участие в «тестировании» аппарата Nothing Phone. При этом Phone (2) был запущен более полноценно: хотя и не прошёл сертификацию для работы в сетях Verizon, но он был полностью совместим с оборудованием T-Mobile и AT&T.  Nothing не подтвердила официально, что Phone (2a) станет более доступной альтернативой Phone (2), но, вероятно, это именно так. В отсутствие данных о характеристиках устройства появились слухи, указывающие на то, что Phone (2a) будет оснащён микропроцессором MediaTek Dimensity 7200, а его стоимость составит около $430. В плане дизайна ожидается, что смартфон получит упрощённую версию фирменной подсветки Glyph из трёх световых областей, а не 11, как у Phone (2). Также не исключается, что двойная основная камера будет размещена в горизонтальном блоке, что сделает её похожей на пару глаз. Хотя запуск Nothing Phone (2a) состоится не ранее следующего месяца, больше информации о новинке может появиться раньше. Дело в том, что разработчики планируют присутствовать на ежегодной выставке MWC 2024, которая пройдёт в конце февраля в Барселоне. Можно предположить, что в рамках этого мероприятия о Phone (2a) станет известно больше. Zalman представила компактный корпус P10 с панорамным видом на комплектующие внутри

13.02.2024 [15:37],

Николай Хижняк

Компания Zalman представила компактный компьютерный корпус P10, который обеспечит панорамный вид на находящиеся внутри комплектующие. Его фронтальная и левая боковая панели выполнены из закалённого стекла, и при этом между ними отсутствует опорная стойка для полностью беспрепятственного обзора комплектующих.

Источник изображений: Zalman Размеры корпуса Zalman P10 составляют 216 × 418 × 422 мм, а вес равен 6,1 кг. Основная часть его правой боковой панели перфорирована для более эффективного забора свежего воздуха внутрь. Она же открывает доступ в нижнюю часть корпуса, предназначенную для установки блока питания. Zalman P10 подходит для материнских плат формата Micro-ATX и имеет пять слотов расширения. В него можно устанавливать видеокарты длиной до 382 мм и процессорные кулеры высотой до 173 мм. Для увесистых видеокарт в корпусе предусмотрена подставка, которая предотвратит их провисание в разъёме PCIe. Внутри Zalman P10 хватит места для установки одного 3,5-дюймового и одного 2,5-дюймового накопителей. Для дополнительного охлаждения имеются посадочные места для трёх 120-мм или двух 140-мм вентиляторов сверху, двух 120-мм вентиляторов снизу и одного 120-мм сзади. Zalman P10 также поддерживает установку радиаторов СЖО типоразмеров 360 или 280 мм сверху и 240 мм снизу. О стоимости корпуса P10 компания Zalman не сообщила. Новинка будет предлагаться в белом и чёрном вариантах исполнения. SpaceX готова к следующему пуску Starship — корабль и ракету собрали вместе на стартовой площадке

13.02.2024 [15:08],

Геннадий Детинич

Компания SpaceX в социальной сети X (бывшая Twitter) сообщила о подготовке третьей ракеты для орбитальных испытаний корабля Starship. Компания готова совершить запуск до конца февраля, если Федеральное управление гражданской авиации США выдаст лицензию на полёт.

Источник изображений: SpaceX Ускоритель Super Heavy в версии Booster 10 и очередной прототип корабля Starship были вывезены на площадку космодрома в Техасе в субботу 10 февраля. Затем 50-метровый корабль Starship поместили на 70-метровый ускоритель. Каждый этап работ был тщательно задокументирован для отчёта. В 2023 году компания SpaceX совершила две попытки вывести прототип Starship на орбитальную высоту: одну в апреле, а вторую в ноябре. Обе они закончились подрывами ускорителей и кораблей. В первом случае не произошло разделения первой ступени и корабля, а во втором случае каждый из них взорвался по отдельности.

Федеральное управление гражданской авиации (FAA) пока не сделало выводов по результатам второго неудачного старта ракеты. В принципе, он был менее неудачным, чем первый, если так можно сказать о случае с аварийным исходом. Ракета и корабль продержались в воздухе около 8 минут или почти вдове дольше, чем во время первого полёта. Также успешно произошло разделение первой ступени и корабля, а ведь это был первый раз, когда ступень и корабль разделялись в горячем режиме — двигатели корабля зажглись ещё до разделения.  Компания SpaceX сборкой ракеты для новых испытаний показывает, что она готова к новому рывку Starship на орбиту. Илон Маск наверняка знает больше, чем готов обнародовать. Очень похоже на то, что третий запуск комплекса состоится в ближайшие несколько недель. Tesla заработала $9 млрд на продаже экологических кредитов другим автопроизводителям

13.02.2024 [14:27],

Алексей Разин

Попытки совладать с изменениями климата в глобальных масштабах привели к тому, что автопроизводители вынуждены укладываться в определённые квоты, и если одна компания выпустила слишком много машин с ДВС, она может условно компенсировать это покупкой «кредитов» у другого участника рынка. Tesla на подобной активности с 2009 года уже заработала почти $9 млрд.

Источник изображения: Tesla По сути, от Tesla реализация подобных регуляторных кредитов не требует никаких усилий. Они просто засчитываются в силу того, что эта компания производит только электромобили, которые существующими правилами считаются положительно влияющими на окружающую среду транспортными средствами. Если какая-то другая компания «перебрала» с производством машин на основе ДВС, она может «купить индульгенцию» в виде регуляторных кредитов у той же Tesla или любого другого автопроизводителя, располагающего в этом смысле положительным «сальдо». В прошлом году Tesla выручила за счёт такой деятельности $1,79 млрд, годом ранее примерно столько же, а всего с 2009 года доходы компании от реализации регуляторных экологических кредитов достигли в общей сложности $9 млрд. Представители Tesla ещё в 2020 году заявляли, что не особо рассчитывают на эту статью расходов, но замедление темпов экспансии электромобилей на мировом рынке в сочетании со стремлением законодателей ужесточать экологические правила наверняка обеспечат этой компании ещё несколько лет стабильного получения денег по этому основанию. Stellantis тоже переведёт электромобили на зарядный порт NACS, но не для совместимости со станциями Tesla

13.02.2024 [14:08],

Алексей Разин

Транснациональный автоконцерн Stellantis до недавних пор оставался единственным представленным на рынке Северной Америки крупным автопроизводителем, игнорирующим решение многих конкурентов обеспечить своим электромобилям совместимость с зарядными станциями Tesla, использующими стандарт подключения NACS. Поддержать его Stellantis действительно готов, но весьма своеобразно.

Источник изображения: Stellantis Во-первых, как поясняет Electrek, этот автоконцерн упоминает указанный стандарт не в принятом Tesla обозначении NACS, а в стандартизированном SAE J3400, как бы абстрагируясь от сотрудничества с Tesla, которая разработала этот стандарт зарядного порта и сделала его общедоступным с точки зрения использования интеллектуальной собственности с 2022 года. Stellantis начнёт оснащать новые модели электромобилей для североамериканского рынка данным типом разъёма с 2025 календарного и 2026 модельного года. Этому концерну принадлежат популярные в Северной Америке марки Jeep, Chrysler, RAM и Dodge. Причины такого дистанцирования от Tesla становятся понятны после изучения сопутствующих заявлений Stellantis. Как выясняется, компания будет развивать сеть зарядных станций IONNA на территории Северной Америки при участии BMW, GM, Honda, Hyundai/KIA и Mercedes-Benz. Все эти компании готовы обеспечивать с 2025 года совместимость своих новых электромобилей с зарядными станциями Tesla в Северной Америке, а по факту это произойдёт даже раньше с учётом возможности использования переходников. При этом Stellantis на совместимость с зарядной сетью Tesla пока не претендует, а делает ставку на развитие сети зарядных станций IONNA в сотрудничестве с партнёрами. На этих станциях будут одновременно присутствовать кабели с разъёмами CCS и NACS. Первая китайская многоразовая ракета полетит на орбиту в ноябре, но её возвращение пока под вопросом

13.02.2024 [13:08],

Геннадий Детинич

Компания Galactic Energy пообещала осуществить в ноябре 2024 года первый в Китае запуск многоразовой ракеты на орбиту. В стране за право стать первыми в производстве многоразовых ракет-носителей борются несколько частных предприятий. Большинство из них намерены дебютировать в 2025 году, а потому Galactic Energy может стать первой, кто совершит исторический старт.

Источник изображений: Weibo / Galactic Energy О готовности запустить частично многоразовую ракету Pallas-1 («Паллада-1») в грядущем ноябре сообщил глава компании Galactic Energy после визита на производство в конце января 2024 года. «”Паллада-1” будет готова к полёту в ноябре этого года, — сказал г-н Лю Байци (Liu Baiqi ). — Люди смогут наблюдать за запуском с побережья Южно-Китайского моря и наслаждаться красотой мудрости и технологий». В то же время Лю Байци отказался отвечать на вопрос, будет ли возвращена первая ступень ракеты. Он подчеркнул, что это закрытая информация и пока не подлежит обсуждению. Стартап Galactic Energy был создан в 2018 году и уже зарекомендовал себя в качестве одного из лидеров частного освоения космоса в Китае. Первая ракета компании — малая четырёхступенчатая 20-м Ceres-1 («Церера-1») на твердотопливных двигателях — совершила 9 успешных запусков. На десятый запуск произошла авария, но это не отменяет достижений Galactic Energy. Ракета «Паллада-1» разрабатывается как частично многоразовая. Это 49-метровая ракета-носитель среднего класса, которая сможет выводить на низкую орбиту до 5 т груза и 3 т на солнечно-синхронную. На первой ступени устанавливаются 7 двигателей с регулируемой тягой в 50 т на каждый, а работают они на смеси керосина и кислорода. Двигатели Cangqiong (Welkin) компания разработала самостоятельно.  Источники South China Morning Post утверждают, что в ноябре компания вряд ли вернёт первую ступень на стартовую площадку, хотя до орбиты ракета «Паллада-1» вполне способна долететь. По мнению осведомлённых лиц, «Паллада-1» не проходила масштабных испытаний. Испытания проходил только небольшой прототип, который проверяли с точки зрения работы бортового программного обеспечения, но никак не с позиции мягкого приземления крупномасштабного изделия. Кроме Galactic Energy многоразовые ракеты разрабатывают китайские компании LandSpace Technology, iSpace, ExPace и дочка китайской космической госкорпорации CAS Space. Все они, так или иначе, пока могут похвастаться только прыжками прототипов на небольшую высоту. В мировой сфере многоразовых ракет лидирует американская компания SpaceX Илона Маска. Многоразовые ракеты-носители нужны Китаю по той же причине, по которой их много лет создавал Маск — развёртывание на орбите многотысячных группировок спутников связи. Похожие на людей роботы 1X Eve показали полную автономность в бытовых задачах

13.02.2024 [12:49],

Павел Котов

Норвежский производитель роботов 1X продемонстрировал возможности модели Eve, способной выполнять множество операций в полностью автономном режиме. Компания подчеркнула, что роботы на демонстрационном видео не управлялись человеком в удалённом режиме, при подготовке материала не использовались монтажные склейки, ускорение видео, не было запрограммированных последовательностей — машины контролировались нейросетями без участия человека.

Источник изображения: 1x.tech В рамках первого раунда финансирования с бюджетом $25 млн компанию 1X поддержала OpenAI; за ним последовал второй раунд финансирования с бюджетом уже $100 млн. Человекоподобные роботы 1X выглядят достаточно скромно в сравнении с аналогами от Tesla, Figure, Sanctuary и Agility: у модели Eve нет ни ног, ни ловких ладоней. Этот робот передвигается на трехколёсной платформе, а на концах рук относительно простые манипуляторы. Чтобы внешний вид роботов был эстетичным, их нарядили в человеческую одежду, а на голове установили светодиодный экран с анимированным улыбающимся лицом. В разработке 1X значится также более похожий на человека робот Neo, который передвигается на двух ногах и может похвастаться красивыми руками, но для демонстрации базовых возможностей хватило и Eve. Все эти задачи сводятся преимущественно к навигации по помещению и перекладыванию предметов с места на место. Но в действительности 1X Eve оказались удивительно способными по сравнению с другими роботами. Они раскладывают вещи по коробкам и лоткам, собирают игрушки с пола, становятся на зарядку, руками подключая к себе кабель питания и отключая его, когда он больше не нужен, и открывают перед собой двери, если необходимо войти в соседнее помещение. Инженеры 1X обучили 30 единиц Eve различным базовым задачам при помощи демонстрации видео и удалённого управления — эти операции транслировались базовой модели искусственного интеллекта и дорабатывались с учётом конкретной среды. Система свела задачи к конкретным действиям, которые выполнялись роботами. Как утверждает разработчик, последний этап для коммерческих версий робота сможет осуществляться на месте у клиентов — потребуются «лишь несколько минут для сбора данных и обучения на графическом процессоре ПК». Возможно, оператору потребуется сначала самому продемонстрировать системе необходимую последовательность действий — система глубокого обучения многократно прогонит задачу через систему моделирования с учётом различных случайных факторов и подготовит машины к непосредственной работе. Космический грузовик «Прогресс МС-24» сгорел в атмосфере, а останки затонули в Тихом океане

13.02.2024 [12:15],

Владимир Мироненко

Грузовой корабль «Прогресс МС-24», отстыковавшийся сегодня утром от модуля «Звезда» российского сегмента Международной космической станции (МКС), сошёл с орбиты и разрушился в плотных слоях атмосферы. Большая часть космического корабля сгорела в атмосфере, а несгоревшие элементы упали в несудоходном районе южной части Тихого океана, сообщил «Роскосмос». Его место на МКС займёт «Прогресс МС-26», запуск которого с Байконура намечен на 15 февраля.

Источник изображения: «Роскосмос» Грузовой корабль «Прогресс МС-24» находился в составе МКС с 25 августа 2023 года. Его доставила на орбиту ракета-носитель «Союз-2.1а», запущенная с Байконура 23 августа. «Прогресс МС-24» доставил на станцию около 2,5 тонны грузов. За время нахождения «Прогресса» в составе МКС с помощью его двигателей было выполнено восемь коррекций орбиты станции, включая одну внеплановую в целях уклонения от возможного столкновения с космическим мусором. В настоящее время в составе станции находится грузовой корабль «Прогресс МС-25», прибывший 3 декабря 2023 года. В рамках подготовки к предстоящему запуску космический грузовик «Прогресс МС-26» прошёл в декабре 2023 года пневмовакуумные испытания с использованием гелиево-воздушной среды с целью проверки герметичности отсеков и пневмогидромагистралей в наземных условиях. До этого была проверена готовность бортовых систем «Прогресса МС-26» к выведению на орбиту и стыковке с МКС. Китай продолжит активно скупать японское оборудование для выпуска чипов, уверены в Tokyo Electron

13.02.2024 [12:08],

Алексей Разин

Японские поставщики оборудования для производства чипов тоже вынуждены работать в условиях экспортных ограничений на китайском направлении, но за рамками санкций им удаётся неплохо зарабатывать на рынке КНР. В частности, у компании Tokyo Electron китайские продажи в прошлом квартале формировали 46,9 % всей выручки, а прогноз на текущий квартал превзошёл ожидания аналитиков и вызвал рост котировок акций на 12 %.

Источник изображения: Tokyo Electron В календаре японских компаний фискальный год традиционно завершается одновременно с мартом, поэтому Tokyo Electron актуализировала свой прогноз по динамике операционной прибыли за весь 12-месячный период накануне, подняв его на 11 % относительно прошлого значения до $3 млрд. Это вызвало рост курса акций Tokyo Electron на 12 %, что стало максимальным приростом в пределах дня за предыдущие почти четыре года. Попутно представители Tokyo Electron выразили надежду, что затраты производителей памяти типа DRAM на закупку технологического оборудования вернутся к росту в текущем году. Представители компании также заявили, что рассчитывают на сохранение высокого спроса на свою продукцию в Китае до конца 2025 года как минимум, поскольку местные производители чипов стремятся добиться самодостаточности, наращивая мощности и активно закупая оборудование. Аналитики считают, что в высокой степени зависимости выручки Tokyo Electron от китайского рынка таятся определённые геополитические риски, но в компании их пока предпочитают игнорировать. В России пятикратно вырос спрос на ремонт импортных серверов и систем хранения данных

13.02.2024 [12:02],

Павел Котов

В России в пять раз вырос спрос на ремонт серверов и систем хранения данных иностранного производства, сообщает «Коммерсант» со ссылкой на участников рынка — речь идёт о технике NVIDIA, HPE, Supermicro и других брендов, которые ушли с российского рынка и перестали официально поставлять комплектующие. Есть мнение, что такое положение вещей не продлится долго — у клиентов растёт доверие к отечественному производителю.

Источник изображения: supermicro.com По итогам 2023 года отмечен пятикратный рост спроса на ремонт жёстких дисков, ленточных накопителей, контроллеров, материнских плат и других компонентов систем зарубежного производства, сообщил «Коммерсанту» управляющий партнёр сервисной компании «Мобиус Технологии» Михаил Сизов; причём 80 % заявок пришлись на второе полугодие. Резкий рост спроса, по его мнению, связан с санкциями и проблемами с поставками оборудования. Компания намеревается расширять это направление, в том числе дополняя список компонентов на восстановление — новые либо отсутствуют, либо продаются чрезмерно дорого и слишком долго доставляются. К концу 2024 года, уверен Сизов, рынок услуг по ремонту техники для корпоративных клиентов будет исчисляться миллиардами рублей. Рост спроса на ремонт компонентов для корпоративных систем подтвердили и в компании «Промобит» — она производит серверы и СХД Bitblaze. Чаще всего обращаются за ремонтом материнских плат, контроллеров, блоков питания и других компонентов производства Mellanox, Supermicro, HPE и прочих брендов. Поставщики оказываются перед выбором: доплачивать НДС и брать на себя расходы за перевозку техники в другие страны с официальной поддержкой от производителя или ремонтировать её самостоятельно в условиях дефицита запчастей. С уходом зарубежных производителей российские корпоративные клиенты стали к серверным платформам и СХД сразу дополнительно заказывать запчасти для них и формировать собственные запасы. Впрочем, также существуют российские производители серверов и систем хранения данных, обслуживание продукции которых не сопряжено с таким количеством сложностей, и «уровень доверия к отечественным решениям постепенно возрастает», отмечают эксперты. Новый скафандр для американских астронавтов испытали в условиях микрогравитации

13.02.2024 [11:16],

Владимир Фетисов

Компания Collins Aerospace, занимающаяся разработкой скафандров, пригодных для использования в открытом космосе, за пределами Международной космической станции, испытала свой новый продукт в условиях микрогравитации. Этот шаг является важным этапом на пути создания скафандра и подготовки его к использованию в реальных условиях.

Источник изображения: Collins Aerospace Национальное управление по аэронавтике и исследованию космического пространства (NASA) США передало разработку скафандров в руки частных компаний в 2022 году. Одной из таких компаний стала Collins Aerospace, представители которой заявили, что им удалось создать более лёгкий и гибкий скафандр по сравнению с теми, что в настоящее время используют астронавты на МКС. Отмечается, что новый скафандр можно легко модифицировать в зависимости от назначения миссии и он более универсален, чем действующие аналоги, в основе которых лежат созданные несколько десятилетий назад конструкции. Испытания скафандра проходили в специальном самолёте, который выполнял серию манёвров, поднимаясь вверх и резко снижаясь. За счёт этого на борту имитировались условия невесомости, и разработчики смогли оценить, насколько подвижным остаётся человек в новом скафандре. В рамках следующего испытания скафандр Collins Aerospace поместят в вакуумную камеру для моделирования условий, близких к космическим. В Дании запустили приливную электростанцию в виде гигантского воздушного змея

13.02.2024 [11:14],

Геннадий Детинич

В минувшую пятницу в Дании к одной из местных электросетей подключили необычную приливную электростанцию. Она выглядит как воздушный змей, только «парит» она в подводных течениях. Восходящие потоки воздуха и воды ускоряют движение «змея», и он всегда летает быстрее встречных потоков, что позволит вырабатывать достаточную мощность даже в условиях слабых приливов.

Источник изображений: Minesto Манёвренную приливную электростанцию Dragon 12 спроектировала и построила компания Minesto. «Дракон 12» способен вырабатывать 1,2 МВт электричества. Его вес достигает 28 т, а размах «крыльев» — 12 м. Внешне он похож на военный беспилотник из будущего, что, впрочем, обусловлено банальными законами гидродинамики. Электростанция крепится ко дну на длинном тросе и это даёт ей возможность перемещаться в воде с относительной свободой. Установленная на борту электроника следит за безопасностью движения, предотвращая рискованные манёвры. Согласно расчётам Minesto, для первой сотни установок нормированная стоимость вырабатываемой ими электроэнергии составит $108 за 1 МВт·ч. После этого нормированная стоимость снизится до $54 за 1 МВт·ч. Пару лет назад Министерство энергетики США сделало заключение, что морские электростанции с якорным (мёртвым) креплением ко дну, включая приливные, в среднем будут вырабатывать электроэнергию стоимостью $89 за МВт·ч. Нетрудно увидеть, что в таком случае у проекта «морских змеев» Minesto хорошие перспективы.  Первая из электростанций Dragon 12 установлена в проливе в районе Фарерских островов, где течения всегда сильные. Её подключили к электросети одного из островов, где проживает 55 тыс. человек. За три торговые сессии капитализация Arm почти удвоилась

13.02.2024 [08:28],

Алексей Разин

На прошлой неделе британская компания Arm отчиталась о результатах деятельности за предыдущий фискальный квартал, инвесторы воодушевились перспективами развития бизнеса на фоне бума искусственного интеллекта так сильно, что за прошедшие с того времени три торговые сессии удвоили капитализацию Arm, а всего с момента IPO акции компании подорожали примерно в три раза.

Источник изображения: Arm Только по итогам торгов в понедельник котировки акций Arm выросли на 29,3 % до $148,97 за штуку, а до публикации квартального отчёта на прошлой неделе они стоили около $77. В сентябре прошлого года Arm вышла на американский фондовый рынок, разместив акции по цене $60,75 за штуку, но вскоре их курс упал до $51,32, поэтому текущие котировки превышают этот уровень примерно втрое. Фактически, вчера котировки акций Arm в пике достигали $164, поэтому прирост относительно периода IPO оказался ещё выше. На текущих уровнях капитализация Arm колеблется возле отметки $150 млрд, потенциально согревая душу японской корпорации SoftBank, которая не смогла пару лет назад продать активы Arm компании NVIDIA за $40 млрд, и после этого задумалась о выходе на IPO в США. Интерес к акциям Arm вчера подтверждался и объёмом торгов ими, который превысил среднее дневное значение за предыдущие три месяца более чем в десять раз. По мнению аналитиков, сейчас росту котировок акций Arm способствует живой интерес инвесторов к теме искусственного интеллекта, который до этого концентрировался на ценных бумагах ограниченного количества эмитентов, и NVIDIA была в их числе. При нынешнем значении капитализации Arm оказывается дороже Boeing и AT&T. Спрос на акции Arm также подогревается их ограниченным предложением, поскольку SoftBank остаётся держателем 90,6 % их общего количества, а в целом 95 % акций Arm распределены между десятью её крупнейшими акционерами. В случае с NVIDIA, например, десять крупнейших акционеров контролируют не более трети капитала. Непосредственно SoftBank сможет приступить к продаже своих акций Arm после 12 марта, когда с момента IPO пройдёт полгода. NVIDIA ненадолго обогнала Amazon по рыночной капитализации — всё благодаря ИИ

13.02.2024 [00:25],

Николай Хижняк

NVIDIA на некоторое время обогнала компанию Amazon по рыночной капитализации в понедельник, пишет Reuters. Продолжающаяся эйфория вокруг технологий искусственного интеллекта позволила разработчику графических процессоров занять четвёртое место среди самых дорогих компаний США.

Источник изображения: Gordon Mah Ung / PCWorld По данным Лондонской фондовой биржи, при рекордно высокой стоимости акции в $734,96, наблюдавшейся в понедельник, рыночная стоимость NVIDIA составила $1,82 трлн долларов. Это позволило ей обогнать розничного гиганта Amazon с капитализацией $1,81 трлн и оказаться всего в нескольких миллиардах долларов позади холдинга Alphabet, владельца Google, стоимость которого составляет $1,87 трлн. Правда, к моменту публикации рыночные стоимости NVIDIA и Amazon несколько сократились, соответственно, до $1,78 трлн и $1,79 трлн, так что в итоге NVIDIA пока что уступает Amazon. В последний раз NVIDIA оценивалась дороже Amazon в 2002 году, когда стоимость каждой из компаний составляла менее 6 млрд долларов. После более удачного, чем ожидалось, финансового отчёта компании Amazon за последний квартал минувшего года, инвесторы с предвкушением ожидают финансовых результатов NVIDIA, которая отчитается о результатах работы одной из последних среди гигантов, 21 февраля. Заметим, что с начала текущего года NVIDIA подорожала на 47 %, что сделало её самой быстрорастущей компанией из индекса S&P 500. Выдающиеся прошлые квартальные результаты и сильные прогнозы NVIDIA в прошлом году показали, что разработчик чипов является лидером в сегменте поставок аппаратного обеспечения для компаний, занимающих разработкой и использованием технологий генеративного искусственного интеллекта. Последние применяются в специальных чат-ботах и программах для генерации изображений. Ставка на высокий спрос на ИИ-технологии привела к росту NVIDIA на 223 % за последние 12 месяцев, сделав её самой прибыльной среди так называемой «Великолепной семёрки», пишет издание Reuters. На втором месте самой быстрорастущей компанией в этом списке с показателем 163 % находится Meta✴✴ Platforms. NVIDIA представила компактную профессиональную видеокарту RTX 2000 ADA с 16 Гбайт памяти

12.02.2024 [22:07],

Николай Хижняк

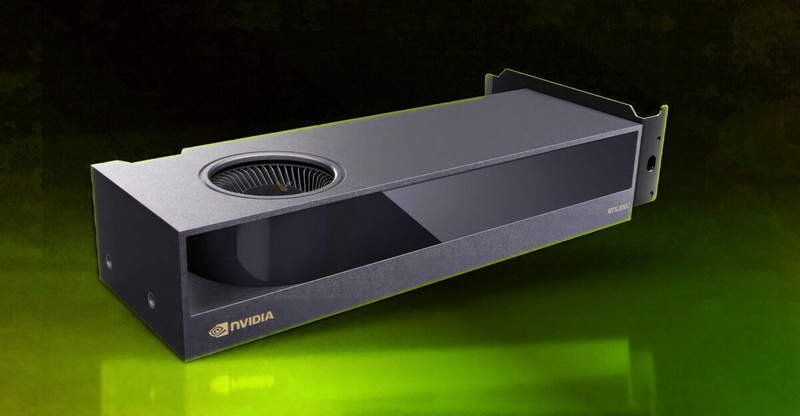

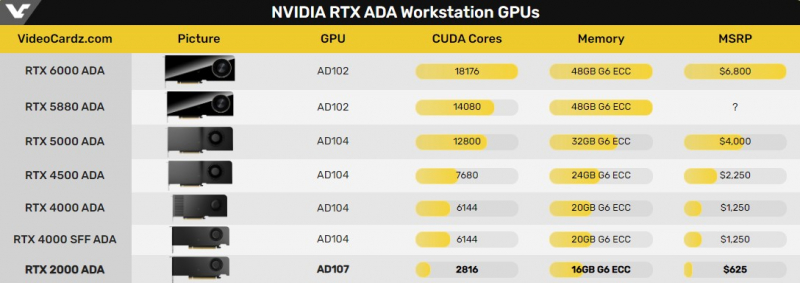

Компания NVIDIA дополнила ассортимент своих профессиональных видеокарт новой компактной моделью RTX 2000 ADA. Она является седьмой и самой младшей картой в серии специализированных графических ускорителей на архитектуре Ada Lovelaсe. Аналогично модели RTX 4000 SFF на той же архитектуре, новинка получила низкопрофильное исполнение и предназначена для использования в компактных ПК (SFF).

Источник изображений: NVIDIA С предыдущей RTX 4000 SFF модель RTX 2000 ADA также роднит низкий показатель энергопотребления, который составляет всего 70 Вт. Видеокарта не имеет дополнительного разъёма для питания. В отличие от RTX 4000 SFF, в основе которой лежит графический чип AD104 с 6144 ядрами CUDA, модель RTX 2000 ADA получила GPU AD107 с 2816 ядрами CUDA. В составе чипа также имеются 88 тензорных ядер четвёртого поколения и 22 RT-ядра третьего поколения. С точки зрения характеристик новинка получается чуть слабее игровой GeForce RTX 4060. NVIDIA RTX 2000 ADA является прямым наследником модели RTX 2000 Ampere, которая оснащалась 12 Гбайт памяти. В свою очередь, новая видеокарта получила 16 Гбайт памяти, и это, к слову, вдвое больше того, что приписывали ей слухи. В то же время RTX 2000 ADA поддерживает 128-битную шину памяти и обладает пропускной способностью до 224 Гбайт/с. Карта использует интерфейс PCIe 4.0, однако производитель выделил для всего 8 линий этого интерфейса. В набор внешних разъёмов RTX 2000 ADA вошли четыре Mini-DisplayPort 1.4a, поэтому тем, кому нужны более современные DisplayPort 2.0 или 2.1 в составе специализированного GPU того же уровня, придётся смотреть в сторону решений компаний AMD и Intel.

Источник изображения: VideoCardz NVIDIA оценила RTX 2000 ADA в $625. Она станет доступна у партнёров компании, включая Arrow Electronics, Ingram Micro, Leadtek, PNY, Ryoyo Electro, TD SYNNEX, Dell, HP и Lenovo с апреля этого года. Роботы «Пиксель» теперь будут убирать Москву на постоянной основе

12.02.2024 [21:59],

Владимир Мироненко

В Москве продолжат работу, но уже на постоянной основе, автономные беспилотные роботы-уборщиков «Пиксель». Они с успехом прошли в минувшем году испытания на территории «Цифрового делового пространства» на улице Покровка, индустриального парка «Руднево» и парка «Кузьминки».

Источник изображения: sobyanin.ru Власти Москвы также решили расширить эксперимент, увеличив количество используемых роботов до 12, а количество площадок для уборки — до пяти. С января 2024 года десять роботов-уборщиков «Пиксель» используются для регулярной уборки прогулочных дорожек в парках «Кузьминки», «Сокольники» и 50-летия Октября. Робот-уборщик «Пиксель» был разработан ООО «Автономика», резидентом кластера «Ломоносов» и участником Московского инновационного кластера. Благодаря различному сменному навесному оборудованию робот-уборщик может использоваться круглый год в любую погоду: зимой расчищать снег, летом подметать и мыть дорожки. Максимальная скорость движения «Пикселя» — 10 км/ч, в ходе уборки — 5 км/ч. Продолжительность автономной работы без подзарядки — до 16 часов. Как отмечено в блоге мэра Москвы Сергея Собянина, «Пиксель» работает практически бесшумно, поэтому с его помощью можно убирать улицы даже ночью. К тому же, используя электропитание, «Пиксель» вносит ощутимый вклад в защиту окружающей среды. Робот оснащён многосенсорной системой, включающей лидары, радары, многочисленные датчики, машинное зрение со стерео- и обзорными камерами, что позволяет ему избегать столкновений с препятствиями. Сообщается, что разработчик планирует ко второй половине 2024 года выйти на серийное производство «Пикселей». Представлена защищённая флешка, которая может буквально сжечь ваши данные

12.02.2024 [19:30],

Владимир Фетисов

Разработчик Райан Уокер (Ryan Walker) из Interrupt Labs на платформе Crowd Supply запустил кампанию по сбору средств на запуск серийного производства необычного USB-накопителя под названием Ovrdrive USB. Главная особенность устройства заключается в наличии механизма физического самоуничтожения, при активации которого чип памяти разогревается до температуры выше 100 ºС.

Источник изображения: Interrupt Labs По умолчанию Ovrdrive USB не зашифрован, поэтому его можно спокойно использовать в странах, где шифрование запрещено на законодательном уровне. Носитель также имеет дополнительную степень защиты на физическом уровне. Чтобы флешка нормально определилась при подключении к компьютеру её нужно трижды быстро воткнуть в порт USB. Если эти манипуляции не проделать, то носитель будет определяться некорректно, как если бы он был повреждён. Любопытно, что изначально разработчики планировали реализовать функцию самоуничтожения Ovrdrive при попытке его неправильного подключения. Однако организовать серийное производство таких устройств оказалось затруднительно, поэтому от этой идеи пришлось отказаться. Тем не менее, Уокер оставил нетронутым в конечном продукте механизм самоуничтожения. Он предполагает повышение подаваемого на плату напряжения, из-за чего она разогревается до примерно 100 ºС. Отмечается, что температуры может быть недостаточно для уничтожения чипа памяти, но у пользователей есть возможность исправить это, доработав устройство самостоятельно. При этом разработчики не намерены поставлять с устройством какие-либо опасные соединения. В первой версии устройства для активации накопитель нужно было потрогать влажными пальцами, т.е. пользователю фактически приходилось бы облизывать пальцы, чтобы начать взаимодействие с Ovrdrive USB. Разработчики заявляют, что новинка ориентирована на журналистов, исследователей и других людей, которым требуется дополнительная защита информации. На время проведения кампании по сбору средств на выпуск Ovrdrive USB приобрести устройство можно за $69 в США, а за доставку за пределы страны придётся доплатить $12. Cooler Master представила доступный игровой монитор GA2501 с Full HD и 100 Гц

12.02.2024 [17:23],

Николай Хижняк

Компания Cooler Master представила самый доступный в своём ассортименте игровой монитор. Модель Cooler Master GA2501 предлагает 23,5-дюймовый IPS-экран с поддержкой разрешения Full HD (1920 × 1080 пикселей) с частотой обновления 100 Гц.

Источник изображений: Cooler Master Яркость дисплея новинки составляет 250 кд/м2, а показатель его статической контрастности равен 1500:1. Экран обладает временем отклика в 4 мс (GtG) или 1 мс (MPRT). Панель имеет тонкие рамки с трёх сторон. Для дисплея заявляется 84-процентный охват цветовых пространств DCI-P3 и Adobe RGB, а также 100-процентный охват цветовой гаммы sRGB.  В набор внешних разъёмов монитора Cooler Master GA2501 входят порт HDMI, а также D-Sub. Последний поддерживает вывод изображения с частотой до 75 Гц. В комплект поставки не включён кабель D-Sub, поэтому пользователю придётся приобретать его отдельно, в случае такой необходимости. Поддержка частоты обновления в 100 Гц обеспечивается через кабель HDMI, который присутствует в комплекте поставки. Монитор оснащён подставкой, позволяющей изменять угол экрана от -5 до 15 градусов. Регулировки по высоте и углам поворота нет. Кроме того, новинка имеет эргономичный джойстик управления настройками. Производитель оценил монитор GA2501 в €110. Gigabyte выпустит видеокарту Radeon RX 7900 GRE Gaming

12.02.2024 [15:25],

Николай Хижняк

Как известно, изначально видеокарты Radeon RX 7900 GRE были ориентированы на рынок Китая. Однако позже компания AMD расширила географию их продаж на рынки Европы, а также другие азиатские страны. Компания Gigabyte готовит к выпуску видеокарту Radeon RX 7900 GRE. Новинка позаимствует дизайн ранее выпущенной модели Radeon RX 7800 XT Gaming и будет продаваться в Европе.

Источник изображений: VideoCardz В составе Radeon RX 7900 GRE используется урезанный графический процессор Navi 31 XL с 80 вычислительными блоками на архитектуре RDNA 3, то есть с 5120 потоковыми процессорами. В Boost-режиме он способен разогнаться до 2245 МГц (базовая рабочая частота составляет 1880 МГц). Для сравнения, в Radeon RX 7900 XT используется графический чип с 84 вычислительными блоками и 5376 потоковыми процессорами. Модель RX 7900 GRE имеет 16 Гбайт видеопамяти GDDR6 и 256-битную шину — Radeon RX 7900 XT предлагает 20 Гбайт памяти с 320-битной шиной. Сам чип Navi 31 XL имеет меньшую площадь по сравнению с Navi 31 XT, который применяется в основе RX 7900 XT, и полностью совместим с печатными платами для GPU Navi 32, на базе которого работают карты RX 7800 XT и RX 7700 XT. Примечательно, что заявленный показатель энергопотребления RX 7900 GRE ниже, чем у RX 7800 XT — 260 против 263 Вт. Благодаря всему этому партнёры AMD могут использовать для Radeon RX 7900 GRE уже готовые варианты систем охлаждения, применяющиеся в ранее выпущенных младших моделях ускорителей. Компания Gigabyte не озвучила технические характеристики своей версии Radeon RX 7900 GRE. Но, судя по всему, карта получит некоторый дополнительный заводской разгон графического процессора. К слову, о возможностях эталонной версии Radeon RX 7900 GRE можно узнать из нашего обзора данной видеокарты. iPhone заняли 7 из 10 мест рейтинга самых популярных смартфонов 2023 года

12.02.2024 [15:20],

Владимир Фетисов

Специалисты компании Canalys провели исследование глобального рынка смартфонов, чтобы определить самые популярные модели в 2023 году. Проделанная ими работа указывает на то, что Apple укрепила позиции в сегменте флагманских устройств, тогда как присутствие Samsung более ощутимо в сегменте смартфонов средней ценовой категории.  В рейтинге 10 наиболее продаваемых смартфонов по версии Canalys сразу 7 позиций заняли устройства Apple, что лишний раз подчёркивает силу американской компании в премиум-сегменте. Возглавляет рейтинг iPhone 14 Pro Max, следом за которым идут более свежий iPhone 15 Pro Max и базовая версия iPhone 14. В первую пятёрку рейтинга также вошли iPhone 14 Pro и iPhone 13. Всё это указывает на популярность устройств Apple среди потребителей, ищущих производительное устройство с передовыми функциями. В отличие от флагманов Apple, присутствие устройств Samsung в рейтинге обеспечено только за счёт моделей средней ценовой категории: Galaxy A14, Galaxy A54 5G и Galaxy A14 5G заняли шестую, восьмую и девятую позиции соответственно. Хотя Samsung продолжает выпускать широкий спектр смартфонов разных категорий, отсутствие в рейтинге флагманов южнокорейской компании подчёркивает острую конкуренцию с Apple в этом сегменте. Данные Canalys также указывают на неизменную популярность iPhone среди потребителей по всему миру. Каждая новая итерация поднимает планку и помогает компании укреплять свои позиции на глобальном рынке смартфонов. Samsung удаётся сохранить на высоком уровне спрос на смартфоны средней ценовой категории, но в премиум-сегменте компании, возможно, придётся переориентировать свои усилия, чтобы попытаться оспорить доминирование Apple. Bell Textron испытала технологию двигателя для скоростного самолёта SPRINT X-plane с вертикальным взлётом и посадкой

12.02.2024 [14:15],

Владимир Мироненко

Компания Bell Textron провела наземные испытания технологии двигателя со складывающимся винтом, которая будет использоваться в будущем самолёте SPRINT X-plane с вертикальным взлётом и посадкой. Bell Textron является одним из претендентов на заключение контракта с Управлением перспективных исследовательских проектов Министерства обороны США (DARPA) на разработку самолёта данного типа в рамках программы Speed and Runway Independent Technologies (SPRINT).

Источник изображения: Bell Textron Конкуренцию Bell Textron составят Aurora Flight Sciences (дочерняя компания Boeing), Northrop Grumman Aeronautic Systems и Piasecki Aircraft Corporation, тоже получившие в ноябре гранты на $15 млн для подготовки концептуального проекта SPRINT X-plane и определения требований и интерфейсов на этапе 1A. Первый этап программы продлится 6 месяцев. Цель проекта SPRINT — создание самолёта, который не зависит от наличия взлётно-посадочной полосы, для выполнения различных миссий: от высадки спецназа до оказания помощи при стихийных бедствиях в труднодоступных районах. Наземные испытания Bell Textron, проведённые на базе ВВС Холломан в Нью-Мексико, призваны показать возможность перехода винтокрылого аппарата от вертикального взлёта с помощью винтового двигателя к горизонтальному скоростному полёту с использованием реактивного двигателя. Подобно конвертоплану V-22 Osprey, будущий X-plane после вертикального подъёма на определённую высоту с помощью роторов будет наклонять их в горизонтальное положение для движения вперёд, но в данном случае вступают в действие реактивные двигатели. Чтобы уменьшить сопротивление воздуха и не мешать в полёте, роторы будут сконструированы так, чтобы не только поворачиваться, но и складываться, и фиксироваться на месте. Второй этап программы 1B стартует в середине 2024 года. На этом этапе будет усовершенствована конструкция X-plane посредством всестороннего анализа, моделирования, испытаний компонентов и подсистем, планирования производства и планирования летных испытаний, кульминацией которых станет предварительный анализ конструкции. Второй этап будет включать детальное проектирование, строительство, наземные испытания и сертификацию X-Plane Demonstrator. Третий этап — программа лётных испытаний X-plane — позволит проверить технологии и интегрированную концепцию в соответствующем масштабе и в реальных условиях полёта. Ожидается, что новый пилотируемый самолёт сможет летать со скоростью до 833 км/ч на высоте до 9100 м и перевозить груз весом до 2300 кг на расстояние до 370 км. Через пять лет стоимость всех центров обработки данных в мире удвоится до $2 трлн

12.02.2024 [13:18],

Алексей Разин

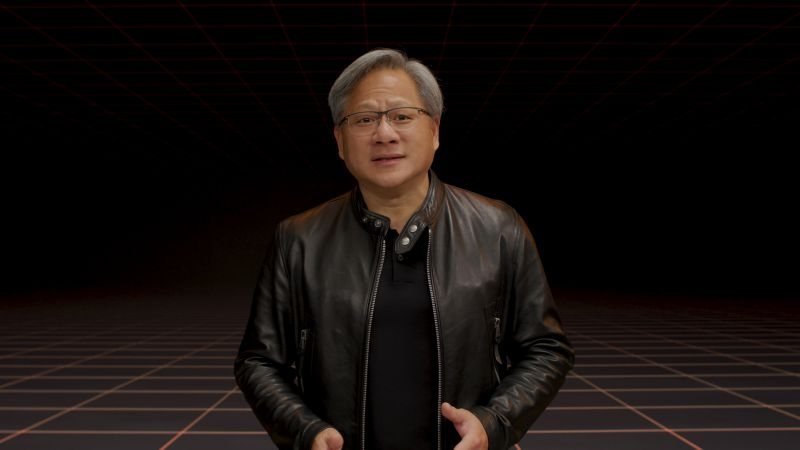

На прошлой неделе стало известно об инициативе главы OpenAI Сэма Альтмана (Sam Altman) о привлечении $7 трлн средств инвесторов на строительство десятков новых предприятий для TSMC, способных кратно увеличить объёмы выпуска ускорителей для систем искусственного интеллекта. Глава и основатель NVIDIA убеждён, что можно ограничиться и более скромными расходами, и развитию отрасли это не помешает.

Источник изображения: NVIDIA Напомним, что главной идеей Сэма Альтмана является создание адекватного количества производственных линий по выпуску ускорителей вычислений, поскольку сейчас возможности имеющихся предприятий явно не покрывают потребностей отрасли. Как сообщает Bloomberg, генеральный директор NVIDIA Дженсен Хуанг (Jensen Huang) не считает, что рост расходов на строительство центров обработки данных в ближайшие годы замедлится, но при этом убеждён, что можно ограничиться и меньшими суммами по сравнению с теми, которые запрашивает Сэм Альтман. «Мы сейчас находимся в начале новой эры. Сейчас количество функционирующих в мире центров обработки данных примерно соответствует $1 трлн. В течение четырёх или пяти ближайших лет мы получим количество центров обработки данных, работающих с программным обеспечением по всему миру, соответствующее $2 трлн», — заявил Дженсен Хуанг. Он также добавил, что не нужно думать, будто нужно будет покупать больше компьютеров. По его словам, нужно исходить из того, что компьютеры будут становиться всё более производительными, и общее необходимое их количество вырастет не так значительно. Xiaomi пожаловалась властям Индии на избыточную бюрократию и попросила снизить пошлины на комплектующие

12.02.2024 [10:47],

Алексей Разин

Китайская компания Xiaomi контролирует примерно 18 % рынка смартфонов в Индии, но не может довольствоваться существующими условиями работы, поскольку её партнёры сталкиваются с излишними бюрократическими барьерами при организации поставок и производства комплектующих в Индии. Власти страны получили соответствующее обращение от представителей компании, в котором дополнительно фигурировала просьба снизить импортные пошлины.

Источник изображения: Xiaomi Напомним, что индийский рынок смартфонов во многом полагается на аппараты локального производства в силу заградительных пошлин на готовую продукцию импортного происхождения. В таких условиях успешная локализация во многом зависит не только от напористости самих зарубежных производителей, но и от действий местного бюрократического аппарата. По информации Reuters, руководство Xiaomi обратилось к властям Индии с жалобами на высокую бюрократическую нагрузку на своих партнёров, которая отпугивает многие компании от локализации выпуска продукции на территории Индии. Компания Xiaomi также хотела бы получить от властей страны какие-то меры финансовой поддержки, а заодно снизить импортные пошлины на ряд комплектующих для смартфонов, которые в Индии не производятся. Письмо властям Индии руководство Xiaomi направило по инициативе правительства страны, поскольку последнее было заинтересовано в получении обратной связи в этой сфере деятельности. Аппарату индийских чиновников, по мнению руководства местного представительства Xiaomi, следует задуматься о построении более доверительных отношений с китайскими поставщиками компонентов, желающими локализовать их производство в Индии. По мнению представителей Xiaomi, китайские компании в Индии сталкиваются с излишним регуляторным давлением, а у сотрудников возникают проблемы с оформлением виз для посещения страны. В конце января власти Индии снизили таможенные пошлины на корпуса аккумуляторов и линзы для оптических систем смартфонов, но представители Xiaomi теперь просят снизить пошлины на поставку комплектующих для выпуска аккумуляторов, корпусных деталей для смартфонов и кабелей USB. Без существенных субсидий поставщикам компонентов будет сложно наладить выпуск данных комплектующих в Индии, поэтому если власти страны не хотят раскошеливаться на поддержку данных проектов, имеет смысл снизить пошлины, чтобы уменьшить себестоимость смартфонов индийского производства. Электролёты Joby Aviation начнут перевозить пассажиров в Дубае с 2026 года

12.02.2024 [08:19],

Алексей Разин

Власти преуспевающих ближневосточных стран давно неравнодушны к идее организации пассажирских авиаперевозок с помощью летательных аппаратов на электротяге, и достигнутое Joby Aviation на этой неделе соглашение с правительством ОАЭ подчёркивает неизменность этого курса. Компания сможет начать коммерческую эксплуатацию своих воздушных такси в Дубае с 2026 года.

Источник изображения: Joby Aviation Как поясняется в пресс-релизе, пробные полёты будут осуществляться со следующего года, но на коммерческой основе они начнётся лишь годом позже. К тому времени компания Skyports должна будет спроектировать и построить в Дубае четыре площадки для летательных аппаратов Joby Aviation, которые в дальнейшем будет эксплуатировать и содержать. Воздушными маршрутами будут связаны международный аэропорт Дубая, знаменитый искусственный остров Палм-Джумейра, престижный прибрежный район Дубай Марина и центральную часть города. Появление воздушного маршрута между аэропортом Дубая и районом Палм-Джумейра, например, позволит сократить время путешествия с 45 до 10 минут по сравнению с автомобильным трансфером. Joby Aviation добилась исключительного права на оказание подобных транспортных услуг на территории Дубая сроком на шесть лет. При этом компания будет осваивать и другие районы ОАЭ, но там ей изначально придётся на равных конкурировать с другими стартапами в этой области. Последние, как становится понятно из условий соглашения с Joby Aviation, в течение шести лет после запуска сервиса в Дубае не смогут осуществлять авиаперевозки на коммерческой основе в воздушном пространстве данного эмирата. Летательные аппараты Joby Aviation используют электрическую тягу для перевозки по воздуху до четырёх пассажиров и пилота со скоростью до 322 км/ч. У себя на родине в США стартап рассчитывает приступить к коммерческой эксплуатации летающих такси с 2025 года в Сан-Франциско и Нью-Йорке. Аппарат с функцией вертикального взлёта и посадки может переносить по воздуху грузы и пассажиров совокупной массой 453 кг, заряда тяговых батарей должно хватать примерно на 161 км путешествия с учётом обязательного резерва. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |