|

Опрос

|

реклама

Быстрый переход

ChatGPT набрал миллиард активных пользователей — на это ушло рекордно мало времени

03.06.2026 [10:37],

Алексей Разин

Статистика Sensor Tower, на которую ссылается Reuters, демонстрирует ещё одно подтверждение популярности чат-бота ChatGPT, который был представлен стартапом OpenAI осенью 2022 года. Чуть более трёх лет понадобилось этому приложению, чтобы набрать миллиард активных пользователей в месячном измерении, и это рекордная скорость.

Источник изображения: Unsplash, Tim Witzdam Рубеж в 1 млрд ежемесячно использующих ChatGPT клиентов приложение преодолело в прошлом месяце, по данным Sensor Tower. Это быстрее, чем произошло в своё время с Google Maps, TikTok, Instagram✴✴ и YouTube. При этом нельзя утверждать, что высокой популярности ChatGPT ничего не угрожает. В первом квартале установившие себе Anthropic Claude пользователи в течение первого месяца с момента установки сократили время, проводимое в ChatGPT, на 5 % по сравнению с предыдущим восьмимесячным периодом. Сейчас Anthropic Claude может похвастать 56 млн активных пользователей в месячном измерении, но отставание от ChatGPT сокращается впечатляющими темпами. Если у последнего количество активных пользователей сейчас увеличивается на 62 % в годовом сравнении, то у Anthropic Claude этот показатель достигает 640 %. Вчера стало известно, что Anthropic сделала первый шаг к выходу на IPO, подав соответствующую заявку в США. Конкурирующая OpenAI тоже готовится к выходу на биржу в этом году, но пока ещё не подала свою заявку. Разработчик ChatGPT представил ИИ-инструменты для финансовых и юридических задач

02.06.2026 [23:38],

Анжелла Марина

Компания OpenAI расширяет функциональность своего ИИ-агента Codex, анонсировав в ходе видеотрансляции во вторник новые инструменты, адаптирующие работу Codex под задачи в сфере инвестиций в публичные компании, банковского дела и продаж.

Источник изображения: Dima Solomin/Unsplash По сообщению Bloomberg, в ближайшие планы разработчика ChatGPT также входит добавление функций для юридического сектора и корпоративных финансов, а также интеграция Codex во флагманский чат-бот. Помимо специализированных плагинов разработчики внедрили инструменты для создания внутренних рабочих приложений и редактирования профессиональных документов. Масштабирование возможностей продукта стало ответом на жёсткую конкурентную борьбу между OpenAI и Anthropic за привлечение бизнес-клиентов перед возможным выходом компаний на биржу уже в этом году. Ранее стартап Anthropic первым выпустил плагины для финансовых услуг и юридических задач, чем обеспокоил инвесторов традиционных компаний по разработке программного обеспечения. В свою очередь в OpenAI отметили необходимость смещения фокуса с потребительского сегмента на корпоративный с целью получения половины общей выручки от бизнес-пользователей к концу текущего года. Изначально оба технологических гиганта обеспечили себе устойчивый рост за счёт продажи передовых ИИ-инструментов для оптимизации разработки программного обеспечения. Запущенный в прошлом году Codex уже насчитывает более 5 миллионов еженедельных пользователей, среди которых пятая часть не являются профессиональными разработчиками. Anthropic, OpenAI и SpaceX первыми внедрят серверные процессоры Nvidia Vera

01.06.2026 [12:42],

Алексей Разин

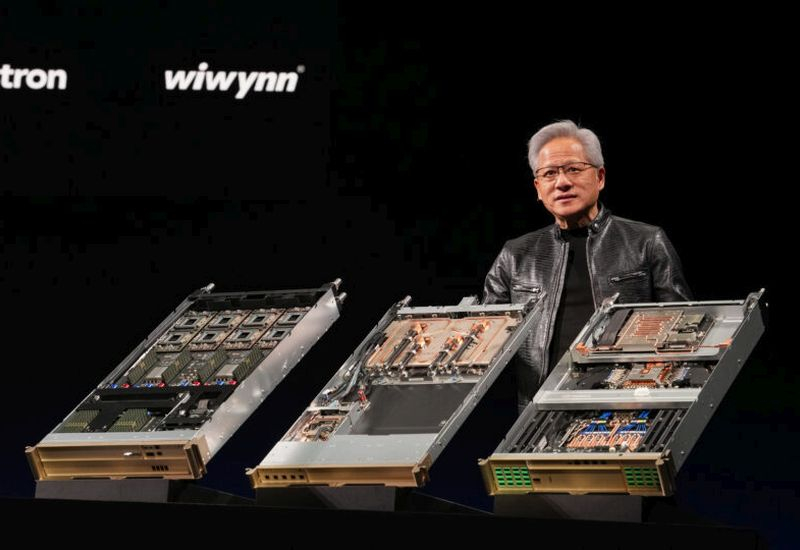

В третьем квартале этого года, как дал понять на Computex 2026 глава и основатель Nvidia Дженсен Хуанг (Jensen Huang), центральные процессоры Vera серверного назначения начнут массово производиться. Ими уже активно интересуются крупные компании ИИ-сегмента типа OpenAI, Anthropic и SpaceX, как добавил Хуанг, они будут первыми использовать их в своих ЦОД.

Источник изображения: Nvidia До сих пор развитие вычислительной инфраструктуры ИИ во многом полагалось на GPU компании Nvidia, но по мере перехода к инференсу они начали отходить на второй план. Центральные процессоры оказались более востребованными, и в этом сегменте Nvidia не собирается уступать рынок Intel и AMD, также предлагая собственные серверные CPU, которые в текущем поколении известны под наименованием Vera. В прошлом месяце Дженсен Хуанг отметил, что доля решений Nvidia в инфраструктуре Amazon (AWS) продолжает расти даже в условиях, когда этот клиент стремится всё активнее использовать компоненты собственной разработки типа тех же чипов семейства Graviton. Именно Nvidia способна предлагать клиентам комплексные готовые решения для ЦОД самого разного назначения. Даже начинающие разработчики с помощью фирменной инфраструктуры Nvidia очень быстро могут развивать бизнес, как убеждён глава компании. По его словам, процессоры Vera в 1,8 раза быстрее в некоторых ИИ-задачах по сравнению с процессорами Intel, использующими x86-совместимую архитектуру. Nvidia также предлагает клиентам продвинутое ПО для управления ЦОД и мониторинга основными показателями, включая уровень энергопотребления. Только за счёт более эффективного управления клиенты Nvidia могут на 40 % увеличить количество используемых ускорителей этой марки, не выходя за рамки общего целевого уровня энергопотребления. В рамках сотрудничества с китайской Unitree компания Nvidia также предложила разработчикам человекоподобных роботов некие эталонные наборы и платформы для быстрого создания таких роботов. По крайней мере, управляющие чипы и прилагаемое к ним ПО будут согласованы и готовы к работе друг с другом, а ещё клиентам будут поставляться уже готовые кисти рук для таких роботов, которые не потребуется обучать базовым манипуляциям с нуля. OpenAI отправит на пенсию ИИ-модели GPT-4.5 и o3 до конца лета

29.05.2026 [23:11],

Владимир Фетисов

OpenAI готовится к выводу из эксплуатации последних ИИ-моделей предыдущего поколения. Так GPT-4.5, единственная доступная до сих пор модель семейства GPT-4, станет недоступна пользователям в конце июня, а алгоритм o3 — в августе 2026 года.

Источник изображения: Unsplash, Dima Solomin Отметим, что семейство ИИ-моделей GPT-4, вышедшее на рынок в 2023 году, стало ключевым для потребительского сегмента ИИ в целом. Хотя новые и более современные алгоритмы могут выглядеть лучше на бумаге, вероятно, новость о скором выводе из эксплуатации ИИ-моделей прошлого поколения будет воспринята легко далеко не всеми пользователями. Некоторые люди считают, что старые ИИ-модели лучше подходят для выполнения определённых задач. К таким, в частности, относятся поклонники ChatGPT, которые нередко привязываются к «личностям» конкретных моделей. Как бы то ни было, обе упомянутые ИИ-модели перестанут функционировать уже летом этого года. Алгоритм o3 будет доступен для платных подписчиков ChatGPT до 26 августа, тогда как GPT-4.5 выведут из эксплуатации уже 27 июня. Anthropic обогнала OpenAI и стала самой дорогой ИИ-компанией в мире

29.05.2026 [06:43],

Анжелла Марина

Компания Anthropic привлекла $65 млрд в рамках нового инвестиционного раунда Series H, по итогам которого капитализация компании достигла $965 млрд, сообщает TechCrunch. Ожидается, что этот раунд станет последним этапом частного финансирования стартапа перед его выходом на публичный рынок капитала.

Источник изображения: Anthropic Лидерами по привлечению средств в рамках Series H выступили фонды Altimeter Capital, Dragoneer, Greenoaks, Sequoia Capital, Capital Group, Coatue и D1 Capital Partners, а также стратегические партнёры Samsung, SK hynix и Micron. Часть привлечённой суммы в размере $15 млрд сформирована за счёт ранее обещанных вложений от крупнейших ИТ-компаний и провайдеров дата-центров, включая $5 млрд от Amazon. Интерес инвесторов оказался настолько высок, что, по данным TechCrunch, один из институциональных игроков был готов выделить $5 млрд исключительно ради встречи с финансовым директором Anthropic Кришной Рао (Krishna Rao). Полученные средства стартап направит на развитие исследований в области безопасности искусственного интеллекта, расширение вычислительных мощностей и масштабирование продуктов на фоне выпуска новой модели Claude Opus 4.8. Финансовые показатели компании также демонстрируют уверенный рост: в начале этого месяца компания сообщила, что её годовая выручка в приведённом виде превысила $47 млрд, а ожидаемый рост доходов на 130 % позволит стартапу впервые выйти на операционную прибыль. Основатель и генеральный директор Altimeter Capital Брэд Герстнер (Brad Gerstner) прокомментировал успех компании, заявив, что «последние улучшения Claude обеспечили масштабное внедрение технологии среди самых требовательных организаций в мире». Тем временем конкуренция за капитал перед выходом на биржу достигает пика. Так, в марте OpenAI привлекла $122 млрд при оценке в $852 млрд, а SpaceX Илона Маска (Elon Musk), объединившаяся с xAI, нацелилась на планку в $2 трлн. В этих условиях Anthropic также планирует расширить доступ к своим мощным ИИ-моделям кибербезопасности, сопоставимым с системой Mythos, которая ранее была выпущена лишь для избранных компаний из соображений безопасности. OpenAI Foundation выделит $250 млн на спасение работников от ИИ

28.05.2026 [04:53],

Анжелла Марина

Некоммерческая организация OpenAI Foundation, владеющая долей в стартапе OpenAI, выделит стартовые $250 млн на поддержку работников и экономики в условиях стремительного развития искусственного интеллекта. По сообщению Reuters, средства направят на исследования влияния технологий на рынок труда и поддержку специалистов, столкнувшихся с риском увольнения из-за автоматизации.

Источник изображения: AI В официальном заявлении OpenAI Foundation подчёркивается, что текущие темпы технологических изменений оставляют слишком мало времени для адаптации, а цена ошибки может оказаться критической для общества. Растущая обеспокоенность судьбой рынка труда небезосновательна ввиду того, что активное использование ИИ для автоматизации задач, включая написание кода, уже спровоцировало определённый страх перед массовой безработицей. Более того, ряд крупных корпораций, среди которых Block и Standard Chartered, прямо назвали повышение эффективности за счёт нейросетей главной причиной недавнего сокращения штата. Чтобы прогнозировать подобные макроэкономические сдвиги, фонд также заинтересован в проектах, использующих ИИ-симуляции для моделирования будущих экономических сценариев. Для реализации этих планов OpenAI Foundation в настоящее время формирует собственную команду специалистов. В отличие от традиционных благотворительных структур, организация планирует не ограничиваться лишь распределением грантов среди сторонних некоммерческих институтов. Ожидается, что часть программ фонд будет запускать и курировать напрямую, отказавшись от роли исключительно финансового посредника. Первые конкретные инициативы в рамках нового подхода будут представлены до конца текущего года. Столь масштабное финансирование, как отмечает Reuters, стало возможным благодаря реструктуризации OpenAI, проведённой в прошлом году. По её итогам благотворительный фонд получил 26-процентную долю в коммерческом подразделении стартапа, что сделало его одной из крупнейших некоммерческих организаций в мире. Ранее, в марте, компания уже взяла на себя обязательство инвестировать через этот фонд не менее $1 млрд в проекты, связанные с ИИ, включая медико-биологические науки и общественные программы. На момент завершения реструктуризации стоимость полученной фондом доли оценивалась в $130 млрд. Апокалипсис рабочих мест не наступил: Сэм Альтман признал, что переоценил опасность ИИ для рынка труда

26.05.2026 [13:33],

Дмитрий Федоров

Глава OpenAI Сэм Альтман (Sam Altman) заявил, что быстрое распространение ИИ пока не привело к апокалипсису рабочих мест и затронуло меньше должностей для работников умственного труда, чем он ожидал. На конференции Commonwealth Bank of Australia (CBA) в Сиднее он признал, что технологические прогнозы OpenAI после запуска ChatGPT в 2022 году в целом подтвердились, но оценки социальных и экономических последствий оказались ошибочными.

Источник изображения: AI По словам Альтмана, ИИ пока не заменил столько служащих и специалистов, сколько он опасался, хотя прежде считал такой риск серьёзным. «Я рад, что ошибся, думая, что к этому времени ИИ сильнее повлияет на сокращение должностей начального уровня для служащих и специалистов, чем это произошло на самом деле», — сказал он в беседе с главой CBA Мэттом Комином (Matt Comyn). Альтман признал, что теперь лучше понимает, почему массового сокращения таких должностей не произошло. При этом он считает прежнее обсуждение рисков оправданным: ИИ действительно мог угрожать рабочим местам, и этот риск, по его словам, всё ещё остаётся. Однако Альтман не привёл данных о том, сколько рабочих мест затронуло внедрение ИИ. Ранее он говорил о риске массовых сокращений в целых отраслях. О планах сократить часть должностей за счёт внедрения ИИ уже заявляли HSBC, Amazon, Standard Chartered и CBA, однако пока неясно, сколько рабочих мест эти компании сократили или намерены сократить по этой причине. Альтман также пересмотрел взгляд на роль человека в труде. По его словам, ИИ берёт на себя всё больше задач, но не заменяет личное общение, доверие и прямое взаимодействие между людьми. Он привёл пример из собственной практики: некоторое время ИИ отвечал за него на сообщения в корпоративном мессенджере Slack и электронные письма с пометкой: «Это ИИ Сэма». Затем Альтман снова стал писать часть ответов сам, потому что понял, насколько важны людям личные контакты. «Для нас действительно важны отношения с людьми и живое общение. Эта часть моей работы занимает много времени, но я не могу представить, что в обозримом будущем её сможет выполнять ИИ», — сказал он. По словам Альтмана, этот опыт изменил его представление о будущем труда. Он считает, что ИИ не заменит человеческое взаимодействие во многих профессиях, а рынок труда будет развиваться иначе, чем ожидали участники отрасли. «Я не думаю, что нас ждёт тот самый „апокалипсис рабочих мест“, который предсказывают или обсуждают некоторые компании из нашей области», — подытожил Альтман. Anthropic на следующей неделе завершит привлечение $30 млрд, подняв капитализацию за пределы $900 млрд и обойдя OpenAI

23.05.2026 [04:00],

Алексей Разин

Подготовка к IPO никак не мешает крупным ИИ-стартапам продолжать привлечение средств в частном порядке. По данным Bloomberg, компания Anthropic на следующей неделе завершит раунд финансирования, который позволит ей привлечь более $30 млрд и поднять капитализацию за пределы $900 млрд.

Источник изображения: Anthropic Формально, это позволит Anthropic считаться самым дорогим стартапом в мире, опережая OpenAI в текущих показателях капитализации, которые по состоянию на март этого года достигли $852 млрд. Борьба за средства инвесторов между двумя стартапами обостряется, OpenAI намерена подать заявку на IPO буквально в ближайшие дни, если слухи верны. В случае с новым раундом финансирования Anthropic принять участие в нём должны как уже существующие инвесторы, так и ряд профессиональных участников рынка капитала: Sequoia Capital, Dragoneer Investment Group, Altimeter Capital и Greenoaks Capital Partners. Каждый из них готов инвестировать примерно по $2 млрд. К ним присоединятся и уже существующие инвесторы типа Founders Fund и General Catalyst, в общей сложности Anthropic сможет привлечь более $30 млрд. Подготовка к проведению этого раунда финансирования велась с конца апреля. Недавно отмечалось, что по итогам второго квартала Anthropic не только выручит $10,9 млрд, но и впервые выйдет на прибыль. К концу следующего месяца приведённая величина годовой выручки Anthropic превысит $50 млрд, по собственным оценкам стартапа. Для сравнения, в июле прошлого года этот показатель достигал лишь $4 млрд. В первом квартале текущего года, по словам генерального директора Дарио Амодеи (Dario Amodei), компания наблюдала 80-кратный рост как приведённой годовой выручки, так и спроса на свои услуги. Стартап направляет вырученные средства на обеспечение бурного роста вычислительной инфраструктуры. Трёхлетний контракт с конкурирующей xAI по аренде ЦОД Colossus 1 в Мемфисе потребует от Anthropic совокупных затрат в размере $45 млрд. Anthropic также активно потребляет чипы и облачные ресурсы Alphabet (Google). Последняя к тому же намеревается вложить в Anthropic до $30 млрд при достижении определённых условий. Amazon (AWS) уже вложила $5 млрд в Anthropic и собирается направить дополнительные $20 млрд с течением времени. Не уточняется, будут ли Google и AWS участвовать в новом раунде финансирования Anthropic. OpenAI сорвала выход полнометражного мультфильма Critterz, закрыв ИИ-видеогенератор Sora

22.05.2026 [14:58],

Алексей Разин

Осенью прошлого года создатели анимационного фильма Critterz, увидевшие в средствах генерации видео по текстовому запросу подходящий для обстоятельной работы инструментарий, были уверены, что смогут представить своё творение в готовом виде на Каннском кинофестивале в мае 2026 года, но их планам помешало закрытие сервиса Sora компанией OpenAI.

Источник изображения: YouTube, The Critterz Напомним, весной этого года OpenAI без особых «прелюдий» закрыла сервис генерации видео по текстовому запросу Sora, поскольку поддержание его работоспособности требовало от компании больших затрат, а перспективы скорой монетизации были туманными. Представители творческой группы теперь сообщают, что из-за необходимости поиска нового партнёра, который позволил бы довести работу до конца, премьера полнометражного анимационного фильма Critterz теперь намечена на первый квартал следующего года. На Каннский кинофестиваль в этом году они всё равно приехали ради поиска партнёра, который мог бы заняться прокатом будущего мультипликационного фильма. Пятиминутный пилотный мультфильм с таким же наименованием был создан ещё в 2023 году с использованием ИИ-модели DALL-E компании OpenAI, которая предшествовала Sora и позволяла создавать по текстовому запросу только статичные изображения. Полнометражный вариант предполагалось создавать при помощи ИИ-модели Sora, но весной этого года OpenAI закрыла одноимённый сервис. Официальные представители OpenAI отметили, что не финансировали создание Critterz, а также не планировали заниматься продюсированием данного мультфильма. Продюсер Джеймс Ричардсон (James Richardson) продолжает считать, что ИИ-инструменты позволяют значительно ускорить создание анимационных фильмов и сократить бюджет проекта. Подобный фильм, по его словам, при помощи традиционных методов пришлось бы создавать силами 300 человек на протяжении 3 лет либо силами 200 человек на протяжении 4 лет, но команда Vertigo Films готова завершить работу за девять месяцев силами коллектива из 15 человек. По сторонним оценкам, бюджет проекта составляет менее $30 млн — это в разы меньше затрат того же Disney на создание полнометражных анимационных фильмов типа «Истории игрушек 4». Создатели Critterz утверждают, что у них уже имеются профили персонажей, сценарий и раскадровка сцен, поэтому как только будет найден новый технологический партнёр для завершения работы над фильмом, она начнёт продвигаться достаточно быстро. Для оптимизации работы при производстве контента Vertigo Films использует специализированное программное обеспечение собственной разработки, которое позволяет интегрировать различные ИИ-модели и привычные средства создания фильмов. Это ПО студия собирается предлагать на рынке сторонним заказчикам. Пользователи смогут выбирать ИИ-модели, которые оптимальны для решения каждой задачи. OpenAI торопится подать заявку на IPO до конца текущей недели

21.05.2026 [08:19],

Алексей Разин

Судебный спор с Илоном Маском (Elon Musk) для OpenAI завершился вполне удачно, хотя истец и не собирается ставить в нём точку, но компания готова воспользоваться передышкой, чтобы подать заявку на IPO, которое состоится до конца текущего года. На биржу выходит сразу несколько крупных стартапов, поэтому тянуть с подготовкой к нему лучше не следует.

Источник изображения: Unsplash, Gavin Phillips Об этом на текущей неделе сообщили несколько источников, включая Bloomberg. По имеющимся данным, OpenAI привлекла Goldman Sachs и Morgan Stanley для подачи конфиденциальной заявки на IPO уже в эту пятницу, хотя график может и поменяться. Непосредственно размещение акций OpenAI на бирже состоится осенью этого года. Капитализация OpenAI может превысить $1 трлн, поскольку даже текущие оценки очень близки к этому уровню. Впрочем, даже в условиях условной победы в споре с Илоном Маском, стартап вынужден иметь дело с целым набором проблем. Прежде всего, инвесторам предстоит внушить мысль, что масштабные капитальные расходы OpenAI обернутся финансовой выгодой в разумные сроки, хотя сама компания выйти на безубыточность рассчитывает лишь ближе к 2030 году. Во-вторых, OpenAI нужно бороться с многочисленными конкурентами и удерживать ценных сотрудников, а также завершить реорганизацию бизнеса, сосредоточившись на наиболее перспективных направлениях деятельности. За ближайшие десять лет OpenAI намерена потратить до $1,4 трлн на развитие ИИ-инфраструктуры, но основную часть этих средств предоставят клиенты и партнёры стартапа, которые связаны хитросплетением сделок с круговой схемой финансирования. ИИ OpenAI решил 80-летнюю задачу Эрдёша — и на этот раз математики согласны

21.05.2026 [06:12],

Анжелла Марина

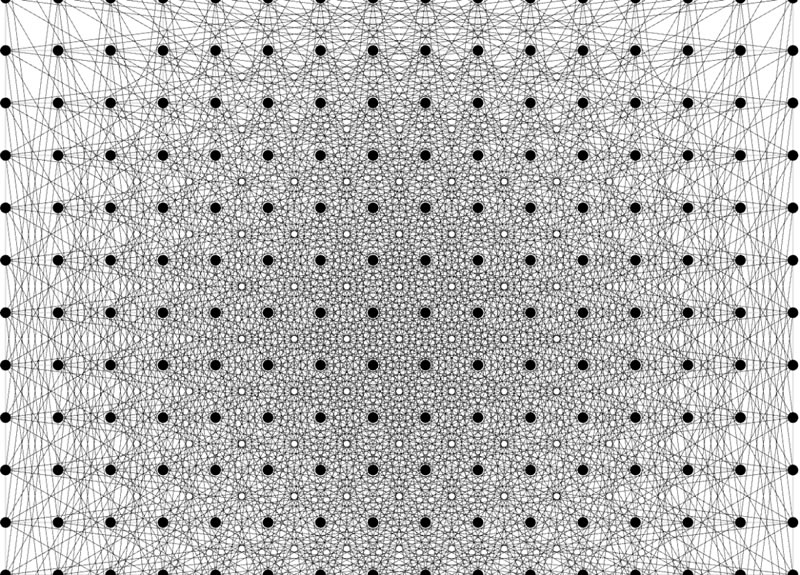

Компания OpenAI утверждает, что её новая модель рассуждений позволила получить оригинальное математическое доказательство, опровергающее известную нерешённую гипотезу в геометрии, впервые выдвинутую выдающимся математиком Полем Эрдёшем в 1946 году. Задача оставалась открытой на протяжении почти 80 лет.

Источник изображения: OpenAI Долгие годы научное сообщество полагало, что лучшие варианты решения этой проблемы сводятся к структурам, похожим на квадратные сетки. Однако искусственный интеллект смог опровергнуть это убеждение, обнаружив совершенно новое семейство конструкций с более высокой эффективностью. Представители OpenAI подчеркнули, что это первый случай, когда ИИ автономно решил открытую проблему, имеющую центральное значение для математики. При этом доказательство было получено с помощью модели общего назначения, а не специализированной системы, созданной исключительно для точных наук. Текущему успеху предшествовал инцидент, произошедший семь месяцев назад, когда бывший вице-президент компании Кевин Вейл (Kevin Weil) поспешно заявил о решении моделью GPT-5 сразу десяти задач Эрдёша. Тогда выяснилось, что алгоритм лишь нашёл уже существующие в литературе ответы, после чего последовали насмешки со стороны специалистов и конкурентов, включая известного учёного в области информатики Яна Лекуна (Yann LeCun) и генерального директора Google DeepMind Демиса Хассабиса (Demis Hassabis). Вейл удалил свою публикацию, а математик Томас Блум (Thomas Bloom), ведущий сайт с задачами Эрдёша, назвал те заявления «драматическим искажением фактов». На этот раз разработчики учли прошлые ошибки и опубликовали анонс вместе с сопроводительными комментариями известных математиков, подтвердивших достоверность опровержения. Среди них: Нога Алон (Noga Alon), Мелани Вуд (Melanie Wood) и сам Томас Блум. По словам последнего, искусственный интеллект теперь помогает людям более полно исследовать математические концепции, выстраивавшиеся веками. В OpenAI считают это достижение знаковым, так как оно показало способность современных ИИ-систем удерживать длинные и сложные цепочки логических выводов. Кроме того, алгоритмы научились связывать идеи из разных областей способами, которые исследователи ранее могли упускать из виду. OpenAI признала дефицит ИИ-мощностей и начала продавать гарантированный доступ к ним

20.05.2026 [08:16],

Алексей Разин

Производители памяти в условиях дефицита собственной продукции стали чаще заключать с клиентами долгосрочные контракты. Являющаяся одной из виновниц ИИ-бума OpenAI также решила формировать с клиентами долговременные взаимоотношения, гарантируя доступ к вычислительным мощностям.

Источник изображения: OpenAI То, что этих мощностей всем не хватит, давно не является секретом, поэтому OpenAI и породила программу Guaranteed Capacity, в рамках которой берётся обеспечить конкретных клиентов нужными им вычислительными ресурсами. Договор можно заключить на срок от одного года до трёх, и чем больше срок, тем больше скидка в пересчёте на каждый год действия контракта. OpenAI при этом даёт понять, что не может гарантировать доступ к необходимым вычислительным ресурсам всем клиентам, а потому оставляет за собой право приостановить заключение контрактов в рамках программы Guaranteed Capacity, если её собственные ресурсы в этой сфере будут исчерпаны. «Поскольку ИИ-модели становятся лучше, мы ожидаем, что в мире будет наблюдаться нехватка вычислительных мощностей на протяжении какого-то времени», — заявил генеральный директор OpenAI Сэм Альтман (Sam Altman). Как сообщал ранее CNBC, компания OpenAI собирается до 2030 года потратить $600 млрд на развитие вычислительной инфраструктуры, хотя в большинстве своём это будут средства самих клиентов и партнёров. К тому же сроку стартап рассчитывает не только выйти на безубыточность, но и получать ежегодную выручку в размере нескольких сотен миллиардов долларов США. Альтман поясняет, что OpenAI зарезервирует за собой достаточно вычислительных мощностей для гармоничного развития собственных продуктов типа ChatGPT и Codex. Anthropic переманила сооснователя OpenAI — Андрей Карпатый будет обучать Claude

19.05.2026 [19:43],

Сергей Сурабекянц

Андрей Карпатый (Andrej Karpathy), исследователь в области ИИ, соучредитель и бывший сотрудник OpenAI, ранее возглавлявший отдел ИИ в Tesla, присоединился к компании Anthropic. Он работает над предварительным обучением ИИ, которое обеспечивает Claude основные знания и возможности. Предварительное обучение — один из самых дорогостоящих и ресурсоёмких этапов создания передовой модели.

Источник изображения: karpathy.ai Карпатый создаст команду, которая будет заниматься использованием Claude для ускорения исследований в области предварительного обучения. Он один из немногих исследователей, способных преодолеть разрыв между теорией больших языковых моделей и практикой крупномасштабного обучения. Это назначение показывает, что именно исследования с использованием ИИ, а не просто вычислительные мощности, являются, по мнению Anthropic, залогом конкурентоспособности при разработке ИИ. В OpenAI Карпатый занимался глубоким обучением и компьютерным зрением, пока не покинул компанию в 2017 году. До 2022 года он руководил программами Tesla по полному автономному вождению (FSD) и автопилоту. Затем он вернулся в OpenAI на год, после чего в 2024 году основал свой стартап Eureka Labs, занимающийся применением ИИ-помощников в образовании. Карпатый не делился подробной информацией о Eureka Labs с момента её запуска, и неясно, продолжит ли он работу в этом стартапе. Он также преподавал онлайн-курс под названием «Нейронные сети: от нуля до героя», который помогает студентам научиться создавать нейронные сети с нуля в коде, и ведёт канал на YouTube, где периодически публикует лекции по магистерским программам и искусственному интеллекту. «Я присоединился к Anthropic, — написал сегодня Карпатый в социальной сети X. — Думаю, следующие несколько лет на переднем крае LLM будут особенно важными. Я очень рад присоединиться к команде и вернуться к исследованиям и разработкам». По его словам, он «по-прежнему глубоко увлечён образованием и планирует возобновить свою работу в этой области со временем». Anthropic также привлекла ветерана кибербезопасности с более чем 20-летним опытом Криса Рольфа (Chris Rohlf) в команду Red Team, которая проводит стресс-тестирование сложных моделей ИИ на предмет угроз. Последние шесть лет Рольф проработал в Meta✴✴. Ранее он был научным сотрудником Центра безопасности и новых технологий Джорджтаунского университета, где работал над проектом CyberAI. «Перед нами открывается реальная возможность кардинально улучшить кибербезопасность с помощью ИИ, — заявил Рольф. — Я не могу представить себе лучшей компании или команды, к которой можно было бы присоединиться в этот критически важный момент». Илон Маск назвал решение суда по делу OpenAI «техническим» и пообещал его обжаловать

19.05.2026 [17:10],

Павел Котов

Накануне присяжные по делу Илона Маска (Elon Musk) против руководства OpenAI вынесли решение в пользу ответчика на основании того, что бизнесмен слишком долго ждал, прежде чем подать в суд на гендиректора компании Сэма Альтмана (Sam Altman) и её президента Грега Брокмана (Greg Brockman). Маск охарактеризовал решение как «техническое» и заявил о намерении подать апелляцию.

Источник изображения: Sasun Bughdaryan / unsplash.com Вердикт присяжных немедленно утвердила председательствующая на процессе судья Ивонн Гонсалес-Роджерс (Yvonne Gonzalez Rogers) — суд вообще не стал рассматривать вопрос о том, являются ли обоснованными обвинения Маска, а постановил, что предусмотренный для них трёхлетний срок давности истёк. Бизнесмен и его адвокаты заявили, что обжалуют вердикт в апелляционном суде. «Ни у кого из внимательно следящих за делом не возникает сомнений, что Альтман и Брокман на самом деле обогатились, присвоив благотворительную организацию. Вопрос лишь в том, когда они это сделали», — написал Маск в своей соцсети X. Адвокат бизнесмена оставил за своим клиентом право подать апелляцию вынесшей решение судье, но та отреагировала скептически и изъявила готовность отклонить её «на месте». «Есть существенное количество доказательств, подтверждающих решение присяжных», — резюмировала она. Маск был в числе основателей OpenAI в 2015 году, три года спустя он покинул совет директоров, а в 2024 году подал в суд на Альтмана и OpenAI, обвинив их в нарушении обязательства сохранить статус лаборатории как некоммерческой организации. Бизнесмен, по его словам, пожертвовал OpenAI около $38 млн с условием, что организация будет работать на благо человечества, а не обогащать отдельных лиц. По версии юристов OpenAI, пожертвования Маска не имели каких-либо условий, а реструктуризация был единственным способом выстоять в гонке с Google DeepMind. Более того, Маск, по их словам, сам предлагал коммерческий формат организации на условиях сохранения контроля, и даже в какой-то момент подталкивал OpenAI к слиянию с Tesla. «Это не техническое решение, это решение по существу. Оно гласит: вы подали иск слишком поздно, и сделали это потому, что хотели придержать его и использовать в качестве оружия против конкурента, состязаться с которым на рынке не можете. Поэтому мы рады получить данное решение», — заявил представитель OpenAI. В отношении Microsoft иск также был отклонён. «Факты и хронология этого дела давно ясны, и мы приветствуем решение присяжных отклонить эти иски как несвоевременные. Мы по-прежнему привержены нашей работе с OpenAI по развитию и масштабированию ИИ для людей и организаций по всему миру», — добавил адвокат Microsoft. Илон Маск проиграл суд против OpenAI — присяжные сочли претензии просроченными

19.05.2026 [05:54],

Алексей Разин

Три недели длились слушания по делу Илона Маска (Elon Musk) против основателей OpenAI и Microsoft, в рамках которого он обвинял их в предательстве идеи благотворительности и использовании стартапа для личного обогащения. Суд в итоге отклонил претензии Маска, поскольку они не уложились в срок давности.

Источник изображения: Unsplash, Zac Wolff Подобные претензии следовало бы предъявлять непосредственно после разлада между основателями OpenAI и Илоном Маском, либо в пределах трёхлетнего периода, но Маск ушёл из совета директоров стартапа в феврале 2018 года, а конфликт между ними зародился ещё в 2017 году. При этом свой иск к бывшим компаньонам он подал только в 2024 году, на следующий год после основания конкурирующего ИИ-стартапа xAI. Маск требовал возвращения OpenAI к исходной благотворительной миссии, отстранения Сэма Альтмана (Sam Altman) и Грега Брокмана (Greg Brockman) от управления стартапа, а также выплаты компенсации в размере $180 млрд, которые он собирался передать на нужды некоммерческой структуры OpenAI. Microsoft тоже выступала ответчиком по иску Маска, роль этой корпорации в переводе OpenAI на коммерческие рельсы истец считал решающей. Суд в начале этой недели отклонил иск Маска и к Microsoft тоже. Законные представители OpenAI, в отличие от Маска, не стали называть вердикт суда «техническим», настаивая, что миллиардер просто пытался использовать суд для причинения вреда конкуренту собственного стартапа xAI, храня при себе изложенные в суде доводы до определённой поры. Илон Маск дал понять, что будет оспаривать решение суда. Присяжные в количестве девяти человек около двух часов совещались, прежде чем огласить свой вердикт, который был утверждён председателем суда. Теперь у OpenAI становится меньше препятствий на пути к IPO и дальнейшему привлечению средств на своё развитие, хотя очевидно, что Илон Маск не собирается отказываться от дальнейшего преследования своих бывших соратников по стартапу. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |