|

Опрос

|

реклама

Быстрый переход

Суд Маска против OpenAI превратился в публичную перебранку миллиардеров

17.05.2026 [11:44],

Дмитрий Федоров

Судебное разбирательство между Илоном Маском (Elon Musk) и Сэмом Альтманом (Sam Altman) по поводу будущего OpenAI превратилось в одну из самых громких и неловких публичных разборок в современной ИИ-индустрии. Процесс проходит в Окленде и уже раскрыл множество деталей о внутренней кухне компании, личных конфликтах её руководителей и борьбе за контроль над одним из самых влиятельных игроков рынка искусственного интеллекта.

Источник изображения: @elonmusk / x.com Маск обвиняет Альтмана, сооснователя OpenAI Грега Брокмана (Greg Brockman) и саму компанию в фактическом «захвате благотворительной организации». По версии миллиардера, OpenAI создавалась как некоммерческий проект, призванный работать «во благо человечества», однако позже структура компании была изменена ради извлечения прибыли и личного обогащения руководства. В иске фигурируют обвинения в нарушении целей благотворительного траста и неосновательном обогащении. Маск требует отстранить Альтмана и Брокмана от управления, отменить коммерческую структуру OpenAI и перераспределить $134 млрд из коммерческого подразделения в пользу некоммерческой организации. В OpenAI с обвинениями не согласны. Компания утверждает, что Маск изначально знал о планах создания коммерческой структуры, сам пытался получить полный контроль над проектом, а после ухода в 2018 году создал конкурирующую компанию xAI. Представители OpenAI описывают иск как попытку «проигравшего в гонке ИИ» нанести удар по конкуренту. В компании подчёркивают, что коммерческое подразделение по-прежнему контролируется некоммерческим советом, а возможный выход на IPO с оценкой около $1 трлн может оказаться под угрозой, если суд признает OpenAI виновной. Сам Маск провёл на свидетельской трибуне три дня. Он называл себя одним из ключевых создателей OpenAI и обвинял Альтмана в разрушении первоначальной миссии проекта. Во время слушаний миллиардер неоднократно повторял фразу о том, что «нельзя украсть благотворительную организацию». Однако перекрёстный допрос прошёл для него не слишком удачно: Маск раздражался, обвинял адвокатов OpenAI в манипулятивных вопросах и даже сравнил один из них с классической уловкой «вы уже перестали бить свою жену», за что получил замечание судьи. Позже предприниматель и вовсе покинул процесс, отправившись вместе с Трампом в Китай, несмотря на требование суда оставаться доступным для повторного вызова. Адвокаты Маска пытаются доказать, что Альтман систематически вводил коллег в заблуждение. В суде демонстрировались видеозаписи допросов бывших руководителей и членов совета OpenAI, связанных с кризисом 2023 года, когда Альтмана сначала уволили, а затем вернули на пост главы компании. Бывший технический директор Мира Мурати (Mira Murati), экс-член совета Наташа Макколли (Natasha McCauley) и сооснователь компании Илья Суцкевер (Ilya Sutskever) описывали Альтмана как человека, склонного к манипуляциям и созданию конфликтов внутри руководства. Суцкевер в суде подтвердил, что ранее действительно говорил о том, что Альтман «постоянно врёт и сталкивает руководителей между собой». Сам Альтман в ответ представил Маска как крайне сложного и агрессивного сооснователя, который стремился к полному контролю над OpenAI. По его словам, стиль управления Маска деморализовывал сотрудников, а сам предприниматель обсуждал возможность передачи власти над компанией своим детям после смерти. Альтман также заявил, что именно OpenAI создала одну из крупнейших благотворительных организаций в технологической отрасли, тогда как Маск, напротив, пытался её разрушить. В процесс оказались втянуты и другие заметные фигуры отрасли. Глава Microsoft Сатья Наделла (Satya Nadella) назвал попытку увольнения Альтмана в 2023 году «непрофессиональной» и признался, что опасался массового ухода сотрудников на фоне управленческого хаоса. Грегу Брокману пришлось объяснять записи из своего личного дневника, включая заметку о том, «что приведёт его к $1 млрд». Адвокаты Маска использовали эти записи как доказательство корыстных мотивов руководства OpenAI, тогда как защита называла их вырванными из контекста личными размышлениями. Отдельное внимание привлекла Шивон Зилис ( Shivon Zilis) — член совета OpenAI и мать четверых детей Маска. В суде она отрицала, что была «человеком Маска» внутри компании, хотя опубликованная переписка показала, насколько тесно переплелись личные отношения и корпоративные интересы в окружении руководителей крупнейших ИИ-компаний. Как отмечает The Guardian, процесс всё больше напоминает публичное выяснение отношений двух миллиардеров с демонстрацией «грязного белья», чем обычное корпоративное разбирательство. Однако независимо от итогового вердикта жюри из девяти человек, слушания уже стали одним из самых подробных публичных рассказов о внутренней истории OpenAI, её трансформации из некоммерческой организации в коммерческого гиганта и конфликтах вокруг будущего индустрии искусственного интеллекта. Мальта стала первой страной, граждане которой бесплатно получат годовую подписку на ChatGPT Plus

17.05.2026 [07:17],

Дмитрий Федоров

OpenAI подписала соглашение с правительством Мальты, по которому все граждане страны получат бесплатный годовой доступ к ChatGPT Plus при условии прохождения курса по использованию ИИ.

Источник изображения: Levart_Photographer / unsplash.com Программа стартует в мае и будет расширяться по мере того, как новые участники будут завершать обучение. Курс бесплатный. Воспользоваться предложением смогут и мальтийские граждане, проживающие за рубежом. «Мы превращаем незнакомую концепцию в практическую помощь для наших семей, студентов и работников», — заявил министр экономики Мальты Сильвио Шембри (Silvio Schembri). Мальта стала первой страной мира, заключившей подобную сделку. Финансовые условия соглашения OpenAI не раскрыла. OpenAI перестраивается вокруг ИИ-агентов в рамках подготовки к IPO — ChatGPT и Codex объединят в единую платформу

16.05.2026 [00:36],

Анжелла Марина

OpenAI провела очередную реорганизацию, сделав президента компании Грега Брокмана (Greg Brockman) официальным руководителем всего продуктового направления. Компания объединит ChatGPT и Codex в единую агентную платформу и сосредоточит ресурсы на разработке ИИ-агентов.

Источник изображения: OpenAI Согласно внутренней служебной записке, с которой ознакомилось издание The Verge, в условиях отсутствия директора по AGI Фиджи Симо (Fidji Simo), ушедшей в отпуск по состоянию здоровья, Брокман также возглавил направление масштабирования технологий. Параллельно операционное управление взяли на себя Джейсон Квон (Jason Kwon), Сара Фрайар (Sarah Friar) и Дениз Дрессер (Denise Dresser). Под руководством Брокмана сформированы четыре ключевых направления. Тибо Сотто (Thibault Sottiaux) будет отвечать за ядро продукта и платформу, Ник Тёрли (Nick Turley) — за работу с корпоративными клиентами, Эшли Александер (Ashley Alexander) — за потребительские сервисы в сферах здоровья, коммерции и финансов, а Виджайе Ражи (Vijaye Raji) — за инфраструктуру, рекламу и анализ данных. Как отмечает The Verge, реорганизация отражает масштабное перераспределение сил OpenAI в сторону ключевых источников дохода, таких как программирование и корпоративный сегмент, и отказ от вложений во второстепенные проекты. Всё это происходит в преддверии потенциального IPO в конце этого года, а также на фоне давления инвесторов. ChatGPT получит прямой доступ к банковским счетам пользователей — для анализа расходов и финансовых советов

15.05.2026 [19:42],

Сергей Сурабекянц

Глобальное доверие к ИИ вот-вот будет подвергнуто новому испытанию: OpenAI планирует предоставить своему чат-боту прямой доступ к банковским счетам пользователей. Новая функция, анонсированная сегодня в режиме предварительного просмотра, позволит пользователям «безопасно подключить» ChatGPT к Plaid — платформе для связи банков и приложений, используемой 12 000 финансовых учреждений, включая Schwab, Fidelity, Chase и Capital One.

Источник изображения: unsplash.com После подключения финансовых счетов пользователи ChatGPT смогут просматривать панель управления с подробной историей своих расходов, включая активные подписки. Пользователи также смогут обращаться к сервису за помощью в принятии финансовых решений, таких как покупка дома или оформление кредитных карт, а также отслеживать любые изменения в привычках расходования средств. Эта функция первоначально будет доступна пользователям в США, подписавшимся на тарифный план ChatGPT Pro стоимостью $200 в месяц. В дальнейшем, по словам OpenAI, компания «будет учиться и совершенствовать сервис на ранних этапах использования, прежде чем внедрить его в тарифный план Plus, с целью сделать его доступным для всех». Этот запуск последовал за январским представлением OpenAI сервиса ChatGPT Health для решения вопросов, связанных со здоровьем, который в то же время «не предназначен для диагностики или лечения». Здоровье, как и деньги, требует от пользователей полного доверия к политике конфиденциальности и безопасности данных OpenAI. OpenAI обещает пользователям «контроль над своими данными», включая возможность в любое время отключить свои банковские счета от ChatGPT, хотя на полное удаление данных может потребоваться до 30 дней. Пользователи также смогут просматривать и удалять «финансовые воспоминания», такие как цели или финансовые обязательства, сохранённые чат-ботом. Пользовательский контроль распространяется и на передачу данных в модели ИИ — например, опция «Улучшить модель для всех» разрешит использование финансовых данных из разговоров в ChatGPT для обучения ИИ. OpenAI уверяет, что ChatGPT не может вносить изменения в банковские счета или видеть «полные номера счетов». Тем не менее чат-боту доступны балансы, транзакции, портфель акций и обязательства, такие как ипотека и задолженность по кредитным картам. OpenAI не уточняет, что сама компания будет делать со всей этой финансовой информацией помимо обучения ИИ и существуют ли какие-либо дополнительные меры защиты финансовых данных пользователей от взлома системы. «Более 200 миллионов человек уже ежемесячно обращаются в ChatGPT с финансовыми вопросами — от составления бюджета до советов о том, как сократить расходы, — говорится в заявлении OpenAI. — Теперь пользователи могут безопасно подключить свои финансовые счета к Plaid, чтобы получить полное представление о своих финансовых делах в контексте личных целей, образа жизни и приоритетов, которыми они поделились с ChatGPT, используя передовые возможности логического мышления OpenAI». Звучит заманчиво. И что же может пойти не так? Доминирование ChatGPT пошатнулось — Gemini и Perplexity быстро набирают обороты

15.05.2026 [18:38],

Павел Котов

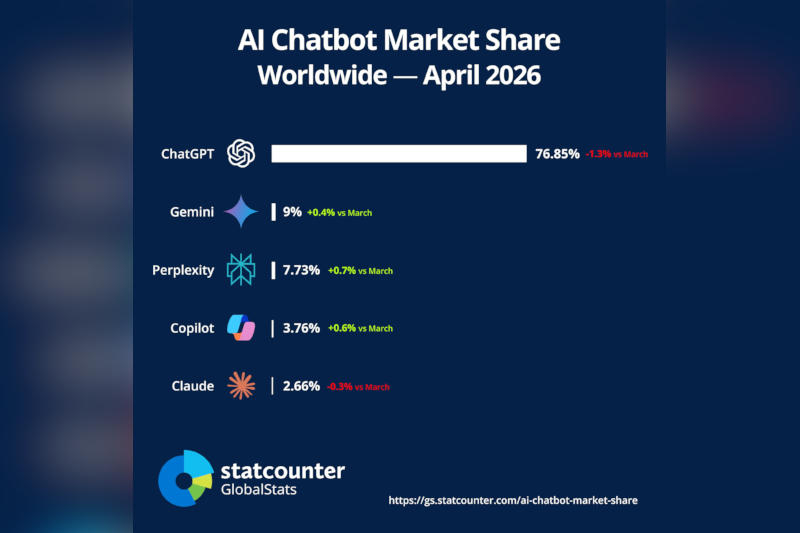

Сервис OpenAI ChatGPT теряет популярность, о чём можно судить по тому, как он постепенно теряет долю в реферальных ссылках — конкуренты чат-бота укрепляют свои позиции на рынке сервисов с искусственным интеллектом, обращает внимание Statcounter. Но и сейчас ChatGPT втрое превосходит всех конкурентов вместе взятых.

Источник изображения: statcounter.com По итогам апреля 2026 года на ChatGPT пришлись 76,85 % всех реферальных ссылок из чат-ботов с ИИ. Показатель лишь кажется высоким, но для ChatGPT он стал самым скромным после трёх месяцев снижения кряду — год назад доля составляла более 84 %. Google Gemini продолжает расти, достигнув исторического максимума в 9 % и удерживая второе место два месяца подряд. Компания упорно движется вперёд, развёртывая Gemini в поисковой системе, Android, Workspace и Chrome — в ближайшие месяцы показатель может преодолеть барьер в 10 %. Perplexity показал рост с 7,07 % до 7,73 % за месяц, восстановив часть потерянной за минувший год доли. Microsoft Copilot увеличил свою долю с 3,19 % до 3,76 %, но всё это ниже пиковых значений, пришедшихся на 2025 год. А вот Anthropic Claude показал падение за месяц с 2,91 % до 2,66 % — всё потому, что в марте платформа удвоила свою аудиторию на фоне конфликта с Пентагоном, и это естественный откат; для сравнения, в январе данный показатель составлял всего 0,92 %. Конкуренция на рынке чат-ботов с ИИ ожесточается, и трафик постепенно перетекает из ChatGPT в другие сервисы. Рынок фрагментируется, и приходит понимание, что ни один из игроков не может претендовать на постоянное доминирование. Google Gemini приближается к двузначной доле рынка, а в совокупности все остальные игроки уже набрали более 23 % реферальных ссылок. Владельцам сайтов, которые рассчитывают на трафик от ChatGPT, рекомендуется оптимизировать свои ресурсы и под другие сервисы генеративного ИИ: Gemini, Perplexity, Copilot и Claude. Ненасытный ИИ может снова отправить OpenAI на поиски денег — даже рекордных $122 млрд инвестиций мало

15.05.2026 [15:59],

Павел Котов

OpenAI может привлечь дополнительные инвестиции, даже завершив крупнейший в истории раунд финансирования частной компании, допустила её финансовый директор Сара Фрайар (Sarah Friar). Разработчик ChatGPT стремится обеспечить вычислительные мощности, чтобы удовлетворить спрос на ИИ.

Источник изображения: BoliviaInteligente / unsplash.com Недавний раунд финансирования, в ходе которого OpenAI привлекла $122 млрд, обеспечил ей «большую свободу действий»; отметила госпожа Фрайар в интервью Bloomberg. Дальнейшие инвестиции будут зависеть от спроса, роста выручки, денежного потока и разрыва между вычислительными ресурсами, которые необходимы OpenAI и теми, что она может себе позволить. В перспективе привлекательным каналом привлечения средств станут публичные рынки, потому что они «значительно больше» частных; компания сможет использовать более широкий спектр вариантов финансирования. Таково основное противоречие, с которым столкнулась OpenAI и вся отрасль ИИ: спрос на продукты растёт, но необходимая для его удовлетворения инфраструктура в дефиците и стоит дорого. Сейчас у OpenAI более 900 млн пользователей еженедельно, помощником для программирования Codex пользуются более 4 млн человек; «огромным конкурентным преимуществом» являются вычислительные ресурсы на рынке, где «в 2026 году вычислительных мощностей будет мало». «У нас огромный спрос», — заявила госпожа Фрайар. Отдел корпоративных продаж буквально «измотан» клиентами, которые интересуются, как трансформировать бизнес с помощью ИИ; банки больше интересуют средства кибербезопасности. OpenAI хочет наладить натянутые отношения с Apple, призналась руководитель, но комментировать судебные иски она отказалась. Вайбкодить теперь можно на ходу: в ChatGPT для смартфонов появился Codex

15.05.2026 [15:25],

Павел Котов

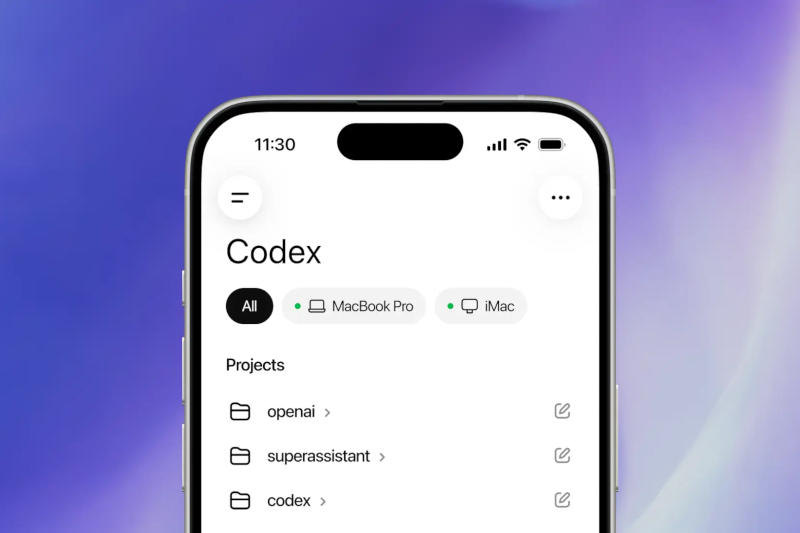

OpenAI сделала мобильное приложение ChatGPT полезнее для разработчиков, привыкших трудиться на ходу, — оно получило поддержку помощника по программированию Codex. Теперь прямо в приложении ChatGPT со смартфона можно отслеживать задачи написания кода и управлять ими.

Источник изображения: openai.com Новая функция пока доступна в качестве предварительной версии ChatGPT на Android и iOS — пользователи приложения могут удалённо взаимодействовать с запущенными на ПК сессиями Codex. В приложении можно просматривать сгенерированный код, подтверждать команды, переключать модели ИИ, запускать новые задачи и в реальном времени отслеживать текущие рабочие процессы. Еженедельная аудитория Codex составляет более 4 млн пользователей, сообщили в OpenAI, и теперь компания хочет сделать эти рабочие процессы менее привязанными к ПК. Новая функция, отмечает разработчик, поможет «оставаться в курсе событий из любого места», особенно если требуется что-то быстро согласовать или внести изменения, чтобы не задерживать проект. Пока функция работает только с Codex на Apple macOS, но в ближайшее время появится поддержка Windows. За последний год OpenAI расширила возможности Codex. Первоначально это был облачный агент для написания кода, способный исправлять ошибки, отвечать на вопросы по кодовой базе и предлагать запросы на слияние (pull requests). Недавно компания добавила функцию прямого взаимодействия Codex с приложениями под macOS и многозадачность для долгосрочных проектов. Первый этап дела «Маск против Альтмана» завершён — теперь слово за присяжными

15.05.2026 [14:00],

Павел Котов

Накануне адвокаты Илона Маска (Elon Musk) и OpenAI представили присяжным свои заключительные аргументы, завершив тем самым первый этап судебного разбирательства по делу «Маск против Альтмана».

Источник изображений: Tingey Injury / unsplash.com Присяжные в составе девяти человек — шести женщин и троих мужчин — начнут совещаться в понедельник, 18 мая. Их вердикт будет носить рекомендательный характер, а окончательное решение останется за судьёй Ивонн Гонсалес-Роджерс (Yvonne Gonzalez Rogers). В 2024 году Маск подал в суд на OpenAI, её гендиректора Сэма Альтмана (Sam Altman) и президента Грега Брокмана (Greg Brockman) — они, по мнению истца, нарушили своё обещание сохранить некоммерческий статус стартапа в области искусственного интеллекта и незаконно обогатились. Маск в 2015 году выступил сооснователем компании наряду с Альтманом и Брокманом — бизнесмен утверждает, что они использовали в несанкционированных коммерческих целях около $38 млн, которые он пожертвовал компании. Адвокат Маска повторил свои аргументы, что OpenAI не раскрыла исходный код своих решений, не стала уделять приоритетного внимания безопасности ИИ и не следовала практикам, свойственным некоммерческим организациям; инсайдеры и инвесторы OpenAI, в том числе Альтман, Брокман и Microsoft, обогатились за счёт Маска, заявил юрист. Адвокаты OpenAI отвергли эти обвинения. По их версии, Альтман и Брокман никогда не давали Маску обещаний относительно корпоративной структуры компании. Маск заявил, что Microsoft, выступающая основным инвестором OpenAI, подстрекала её сменить статус; по версии представителя OpenAI, корпорация Microsoft вообще не знала об этих событиях и не могла в них участвовать.  В понедельник, когда присяжные начнут совещаться, откроется второй этап судебного разбирательства, на котором будет рассматриваться вопрос о возмещении ущерба. Судья заслушает аргументы по поводу возможного ущерба и дальнейших шагов, которые необходимо будет предпринять, если OpenAI, Альтман и Брокман будут признаны виновными — на этом этапе присяжные принимать решения не будут. Маск запрашивал различные варианты исхода дела: просил судью рассмотреть вопрос об отстранении Альтмана и Брокмана от должностей в OpenAI, а также об отмене рекапитализации компании в 2025 году. Адвокаты Маска заявляли о его праве на компенсацию в размере $134 млрд от OpenAI и Microsoft как «незаконной прибыли». Сейчас представители Маска требуют направить в некоммерческий фонд OpenAI вообще любую «незаконно полученную прибыль». Решение о возмещении ущерба будет принято только в случае признания ответственности. В ходе слушаний судья Гонсалес-Роджерс резко реагировала на адвокатские уловки, но демонстрировала тёплое и дружелюбное отношение к присяжным — однажды даже угостила их шоколадом. К завершению заседания накануне она напомнила, что во время обсуждения присяжным будет предоставлен обед. OpenAI признала утечку данных после шестиминутного взлома TanStack

15.05.2026 [07:37],

Анжелла Марина

OpenAI подтвердила, что хакеры похитили ограниченный набор учётных данных после атаки на популярную библиотеку с открытым исходным кодом TanStack. При этом компания заявила, что не обнаружила свидетельств компрометации пользовательских данных, производственных систем или трудов интеллектуальной собственности.

Источник изображения: xAi По сообщению TechCrunch со ссылкой на информацию в блоге OpenAI, инцидент затронул устройства двух сотрудников, которые имели доступ к внутренним репозиториям с исходным кодом. Злоумышленники временно взяли под контроль библиотеку TanStack, предназначенную для разработки веб-приложений, для получения несанкционированного доступа и хищения данных. В ответ OpenAI начала замену цифровых сертификатов, используемых для подписи продуктов, однако это также потребует от пользователей macOS обновить приложение. Компания подчеркнула, что из затронутых репозиториев была похищена лишь ограниченная часть учётных данных, а существующие установки программного обеспечения не подверглись риску. «Мы не нашли доказательств компрометации или риска для существующих установок ПО», — говорится в заявлении OpenAI. Сама атака на TanStack произошла ещё в начале недели, когда хакеры захватили проект и за шесть минут опубликовали 84 вредоносные версии ПО, которые содержали программу, предназначенную для кражи учётных данных с компьютеров, где было установлено это ПО, а также для самораспространения на другие системы. Атака на TanStack вписывается в серию недавних инцидентов по захвату проектов с открытым исходным кодом с целью распространения вредоносного ПО. Например, в марте северокорейские хакеры внедрили малварь (Malware) в инструмент разработки Axios, а в мае китайские группы атаковали тысячи компьютеров на базе Windows, на которых было установлено ПО Daemon Tools. Кто именно стоит за взломом TanStack, пока неясно: некоторые предыдущие подобные атаки приписывали группировке TeamPCP. OpenAI может подать в суд на Apple из-за слабого продвижения ChatGPT

14.05.2026 [23:26],

Николай Хижняк

По словам Марка Гурмана (Mark Gurman) из Bloomberg, компания OpenAI собирается подать в суд на компанию Apple из-за «напряжённых» отношений с производителем iPhone. Проблема заключается в недостаточно глубокой интеграции ChatGPT и недостаточно усердном продвижении ИИ-бота.

Источник изображения: MacRumors В 2024 году компании заключили партнёрское соглашение, в рамках которого чат-бот ChatGPT от OpenAI был интегрирован в такие функции, как Siri и Image Playground в iOS, iPadOS и macOS. Пользователи iPhone также могут оформить подписку на ChatGPT напрямую через приложение «Настройки», при этом Apple получает часть дохода. Однако, как сообщается в статье, OpenAI рассчитывала на более глубокую интеграцию ChatGPT в дополнительные приложения Apple и на более заметное место в Siri. Руководители OpenAI также считают, что Apple недостаточно активно рекламировала интеграцию, из-за чего о ней узнало меньше пользователей. Изначально в OpenAI полагали, что сделка может принести миллиарды долларов в год в виде дохода от подписок, но этого «даже близко не произошло». Судя по всему, такие ожидания были связаны с тем, что Apple позиционировала соглашение как возможность, сравнимую с многомиллиардной сделкой с Google по поиску в Safari. Из-за культуры секретности в Apple в OpenAI не знали, как именно ChatGPT будет интегрирован в iPhone, iPad и Mac. «По сути, они сказали: "OpenAI должна довериться нам"», — рассказал Bloomberg неназванный представитель OpenAI. Он назвал сделку «провальной». «Мы сделали всё, что от нас зависело с точки зрения продукта. А они нет, и, что ещё хуже, они даже не приложили никаких усилий», — сказал представитель компании. Чтобы получить ответ от чат-бота OpenAI, пользователи Siri должны произнести или напечатать слово «ChatGPT». Ответы ChatGPT, отображаемые в интерфейсе Siri, содержат меньше информации, чем в приложении ChatGPT. Попытки OpenAI пересмотреть условия сделки, судя по всему, ни к чему не привели. По словам Гурмана, из-за сложившейся ситуации OpenAI рассматривает возможность подачи судебного иска против Apple. Сообщается, что разработчик чат-бота рассматривает различные варианты действий, в том числе отправку Apple письма с претензией о нарушении условий договора, без подачи полноценного иска. В OpenAI всё же надеются решить вопрос во внесудебном порядке. Ожидается, что в будущей iOS 27 появятся и другие чат-боты, такие как Gemini от Google и Claude от Anthropic, но, судя по всему, это не является поводом для недовольства со стороны OpenAI, поскольку их партнёрство с Apple никогда не было эксклюзивным. Согласно слухам, в приложении Siri для iOS 27 появится функция «Расширения» для других чат-ботов, что может способствовать популяризации ChatGPT. Однако на данный момент в OpenAI считают, что их интересы ущемляются. OpenAI предложила создать глобальный орган контроля ИИ с участием Китая и США

14.05.2026 [16:44],

Владимир Фетисов

OpenAI поддержала бы создание глобального органа управления искусственным интеллектом под руководством США и с участием Китая. Об этом пишет Bloomberg со ссылкой на заявление высокопоставленного руководителя компании, сделанное за несколько часов до начала встречи между американским президентом Дональдом Трампом (Donald Trump) и председателем КНР Си Цзиньпином (Xi Jinping).

Источник изображения: Mariia Shalabaieva / unsplash.com Отвечая на вопрос о саммите США и Китая, Крис Лехане (Chris Lehane), вице-президент OpenAI по глобальным вопросам, заявил, что у США есть возможности для использования своего лидерства в сфере ИИ для создания глобального механизма управления, что может привести к появлению в будущем более безопасных и устойчивых систем. «ИИ на некотором уровне выходит за рамки многих преобладающих или традиционных вопросов торговли. Существует возможность действительно начать строить что-то глобальное, и страны по всему миру, включая Китай, потенциального могут принять участие в этом», — приводит источник слова Лехане. Он добавил, что такая организация могла бы напоминать Международное агентство по атомной энергии, в состав которого входит Китай и которое устанавливает международные стандарты безопасности для развития ядерной энергетики. Один из способов создания такой организации заключается в объединении Центра по стандартам и инновациям в области ИИ при Министерстве торговли США с институтами безопасности ИИ, которые создаются в разных странах мира. В ходе интервью было сказано, что OpenAI обсуждала в Вашингтоне идею объединения институтов безопасности ИИ, но на данный момент неясно, поддержит ли администрация Трампа создание глобального управляющего органа с участием Китая. Ранее представители Белого дома говорили о том, что правительство отвергает идеи глобального управления ИИ-технологиями. OpenAI также призывала американские власти обязать правительственных исследователей проводить оценку передовых ИИ-моделей на предмет их безопасности. Между тем, администрация Трампа готовит законопроект о кибербезопасности в сфере ИИ, который подчёркивает добровольный, а не обязательный предварительный анализ ИИ-моделей перед их развёртыванием. Желая снизить зависимость от OpenAI, корпорация Microsoft присматривает для покупки новые ИИ-стартапы

14.05.2026 [08:27],

Алексей Разин

Если первоначальные условия сделки между Microsoft и OpenAI ограничивали обе стороны в выборе альтернативных партнёров, то теперь они пересмотрены, давая больше свободы и самой Microsoft. Желая снизить зависимость от OpenAI, которая становится серьёзным конкурентом, Microsoft уже сейчас планирует поглощение новых ИИ-стартапов для усиления собственных позиций.

Источник изображения: Microsoft По данным Reuters, Microsoft ставит перед собой цель создать передовую ИИ-модель к следующему году, в этом смысле новые кадровые ресурсы ей могут очень помочь. Уже весной этого года Microsoft рассматривала возможность поглощения ИИ-стартапа Cursor, но отказалась от этой идеи из-за опасений по поводу регуляторных препятствий для такой сделки. Сейчас Microsoft рассматривает возможность приобретения небольшого стартапа Inception, который предлагает новый подход к разработке больших языковых моделей. В этот основанный в середине 2024 года стартап Microsoft через свой венчурный фонд уже вложила $50 млн в конце 2025 года. Конкуренция за перспективные активы в этой сфере достаточно высока. Уместно вспомнить, что xAI Илона Маска (Elon Musk) заключил сделку с Cursor вскоре после того, как Microsoft отказалась от притязаний на этот стартап. Inception за свои активы рассчитывает выручить не менее $1 млрд, и к ним тоже присматривается xAI, помимо Microsoft. Используемый Inception при разработке текстовых моделей метод диффузии позволяет значительно повысить их производительность, но поведение моделей в этом случае сложно предугадывать, и исследователи пока не берутся комментировать, пригоден ли этот метод для создания крупных ИИ-моделей. В следующем месяце объём инвестиций Microsoft в OpenAI превысит $100 млрд

14.05.2026 [07:07],

Алексей Разин

Когда речь ранее заходила об объёме финансирования OpenAI корпорацией Microsoft, всё обычно сводилось к упоминанию о $13 млрд, вложенных в капитал стартапа к началу 2023 года, но фактические затраты главного акционера OpenAI оказались выше. По итогам июня текущего года они превысят $100 млрд, как пояснили представители Microsoft в суде.

Источник изображения: Microsoft Растянувшиеся на три недели слушания уже завершаются, но представителям Microsoft пришлось давать показания в понедельник. Директор корпорации по сделкам Майкл Веттер (Michael Wetter) сообщил суду, что к концу текущего фискального года, который завершится в июне, она накопленным итогом направит на поддержку OpenAI и развитие сопутствующей вычислительной инфраструктуры более $100 млрд. По словам представителя Microsoft, основная часть этих затрат окупится ещё не скоро. Microsoft даёт показания в суде, поскольку Илон Маск (Elon Musk) в своём иске усмотрел решающее влияние корпорации на решение OpenAI создать коммерческую структуру в своём составе, тем самым отойдя от изначальной благотворительной миссии. На прошлой неделе генеральный директор Microsoft Сатья Наделла (Satya Nadella) признался в суде, что корпорация рассчитывала заработать на ранних инвестициях в OpenAI не менее $92 млрд. По состоянию на октябрь прошлого года Microsoft владела акциями OpenAI на общую сумму $135 млрд. После реструктуризации её доля в капитале стартапа составила 27 %. Из показаний Наделлы также становится ясно, что уже в апреле 2022 года он выражал озабоченность способностью OpenAI превзойти саму Microsoft, хотя революционный для стартапа момент в виде выпуска ChatGPT был отдалён почти на полгода. Наделла сравнивал ситуацию со взаимоотношениями IBM и Microsoft в восьмидесятых годах прошлого века. Распространяя свою операционную систему MS-DOS в качестве приложения к персональным компьютерам IBM, корпорация Microsoft в итоге превзошла партнёра по капитализации и прочим финансовым показателям. Руководство Microsoft ещё в 2022 году выражало беспокойство по поводу возможности OpenAI превзойти своего главного инвестора, а потому настаивало на получении доступа к интеллектуальной собственности, которая будет приносить выгоду и Microsoft напрямую. По словам Наделлы, для Microsoft во взаимоотношениях с OpenAI было важно присутствовать буквально на каждом уровне программного стека. Технический директор Microsoft Кевин Скотт (Kevin Scott) рассказал в суде, что первый ЦОД, построенный корпорацией для OpenAI, содержал 10 000 ускорителей на базе GPU и создавался на протяжении шести месяцев. Сотрудничество с OpenAI пошло на пользу Microsoft и в том смысле, что последняя научилась строить суперкомпьютеры, заточенные под работу с генеративным ИИ. С 2024 года Microsoft начала открыто называть OpenAI своим конкурентом в сфере разработки ИИ-моделей, а с прошлого года Microsoft начала сотрудничать с конкурентами самой OpenAI типа той же Anthropic. При этом самостоятельные разработки Microsoft в сфере ИИ не получили даже доли той популярности, которыми пользуются модели OpenAI. Наделла признался в суде, что для Microsoft важно оставаться хорошим партнёром и хорошей компанией, предлагающей платформы, придерживаясь центрального направления в развитии без сильных манёвров по сторонам. Глава OpenAI заявил в суде, что Илон Маск сам поддержал идею перевода стартапа на коммерческие рельсы

13.05.2026 [07:08],

Алексей Разин

К середине этой недели очередь давать показания в суде дошла и до генерального директора OpenAI Сэма Альтмана (Sam Altman), который выступает ответчиком по иску Илона Маска (Elon Musk). Последний, по его словам, не только не был против перевода OpenAI на коммерческую основу, но и собирался подчинить себе этот стартап.

Источник изображения: Unsplash, Zac Wolff В свою очередь, Альтман под присягой заявил, что обвинения Маска в стремлении руководства OpenAI отречься от изначальной благотворительной миссии стартапа беспочвенны. Альтман отметил, что после появления идеи о создании внутри OpenAI коммерческой структуры он надеялся на успех благотворительной организации. Обвинения Маска в намерениях Альтмана «украсть благотворительность», по словам последнего, «даже не укладываются в голове». Напомним, исковые требования Илона Маска включают не только отстранения Сэма Альтмана и президента Грега Брокмана (Greg Brockman) от управления OpenAI, но и выплату компенсации в размере $150 млрд. Сам Маск в суде ранее признался, что вложил в OpenAI около $38 млн. Коммерческая структура внутри OpenAI была создана в марте 2019 года, уже после ухода Илона Маска из состава совета директоров компании. По словам Альтмана, Маск не только не противился идее создания коммерческой структуры, но и поддерживал её. Попутно Илон Маск хотел получить до 90 % акций OpenAI, и такие амбиции вызывали у Альтмана сильный эмоциональный дискомфорт, как следует из его показаний. На тот момент руководство OpenAI в целом не было настроено против Илона Маска, но идея последнего по поводу объединения стартапа с Tesla многих насторожила, включая самого Альтмана. Такой альянс, по словам последнего, вряд ли позволил бы OpenAI достичь своих первоначальных целей. Маск, как утверждает Альтман, не возражал против перевода OpenAI на коммерческие рельсы, если при этом он будет контролировать стартап. Он даже хотел передать стартап собственным детям по наследству в случае своей внезапной смерти. «Илон заявил, что будет работать только в компаниях, которые он полностью контролирует. Меня это очень сильно беспокоило. Одной из причин, по которым мы основали OpenAI, была идея против сосредоточения власти над сильным искусственным интеллектом (AGI) в руках единственного человека, какими бы благими ни были его намерения», — признался глава OpenAI. Маск пытался внушить совету директоров стартапа мысль о том, что со временем его доля в капитале может уменьшиться, но закрепить письменно условие постепенного отказа от контроля над активами он не был готов. Альтману в ходе судебного заседания также пришлось ответить на вопросы адвоката Маска по поводу своей репутации среди ближайшего руководства OpenAI. Из показаний нескольких соратников Альтмана было известно, что он не производил впечатления искреннего человека и порядочного бизнесмена. Сам генеральный директор OpenAI в суде заявил, что считает себя честным предпринимателем, заслуживающим доверия. При этом он не может сказать, что в рамках своей деятельности вводил кого-либо в заблуждение. Впрочем, Альтман заявил, что в некоторые моменты своей жизни он мог оставаться не до конца честным с окружающими.

Источник изображения: Unsplash, Sasun Bughdaryan Свои ощущения в период краткосрочной отставки из OpenAI Альтман описал словами: «Я хотел побежать назад в полыхающее здание, чтобы спасти его». Непосредственно после отставки с поста генерального директора стартапа он не хотел возвращаться и был готов перейти на работу в Microsoft, но OpenAI для него значил слишком много. Напрямую Альтман не владеет акциями OpenAI, но у него есть доля в фонде, который инвестировал в этот стартап. Со слов главы OpenAI становится известно, что компания привлекла за всё время своего существования около $175 млрд от частных инвесторов. На начальном этапе Альтман вложил $3,75 млн в OpenAI, но позднее он раздал все свои акции подчинённым. Уход Маска из совета директоров OpenAI в 2018 году, по словам Альтмана, кто-то воспринял с тревогой, опасаясь сокращения финансирования, другие вздохнули с облегчением. Маск требовал от исследователей регулярных отчётов о достигнутом прогрессе, и Альтман в целом считает, что Илон не понимал, как нужно руководить исследовательской лабораторией. Многих из ключевых специалистов OpenAI требования Маска просто демотивировали. Окружение Альтмана в OpenAI боялось мести со стороны Маска после его ухода из стартапа. Альтман добавил, что до сих пор благодарен Маску за его вклад в развитие OpenAI, и на начальных этапах совместной работы он глубоко уважал Илона. Позже его действия начали противоречить целям OpenAI, и он предпринимал их, как считает Альтман, «из ревности». Он также назвал Маска «несчастным человеком, который живёт с отсутствием чувства безопасности», выразив на этой почве сочувствие богатейшему человеку планеты. Примечательно, что председатель совета директоров OpenAI Брет Тейлор (Bret Taylor) сообщил суду о получении в феврале 2025 года предложения от возглавляемого Маском консорциума инвесторов о поглощении OpenAI. Это произошло примерно через полгода после подачи Маском иска к стартапу. Как пояснил Тейлор, сценарий противоречил сути судебного иска: коммерческие инвесторы должны были поглотить благотворительный стартап, который таковым должен был оставаться, исходя из требований самого Маска. Судебное заседание, которое длится уже третью неделю, должно завершиться на этой, после чего суд может вынести свой вердикт к 18 мая. OpenAI вооружила европейские компании ИИ-моделью GPT-5.5-Cyber для защиты от хакеров

12.05.2026 [21:41],

Дмитрий Федоров

OpenAI открыла европейским компаниям доступ к своим последним ИИ-моделям, включая специализированную GPT-5.5-Cyber, для поиска уязвимостей в корпоративных системах. Среди участников программы — немецкие Deutsche Telekom и Scalable Capital, испанские BBVA и Telefonica, британская Sophos.

Источник изображения: Levart_Photographer / unsplash.com Программа Trusted Access for Cyber предоставляет верифицированным компаниям из ключевых отраслей — финансов, телекоммуникаций, энергетики и государственных услуг — доступ к моделям OpenAI с ограничениями, допускающими использование только в целях киберзащиты. Управляющий директор OpenAI по региону EMEA (Европа, Ближний Восток и Африка) Эммануэль Марий (Emmanuel Marill) заявил, что по мере роста возможностей ИИ важно соблюдать баланс между доступностью, полезностью и безопасностью. По его словам, необходимо блокировать опасную деятельность и одновременно обеспечивать проверенных специалистов по киберзащите инструментами, действительно полезными для защиты систем, обнаружения уязвимостей и быстрого реагирования на киберугрозы. Запуск ИИ-модели Mythos конкурентом OpenAI — компанией Anthropic — в прошлом месяце существенно повысил риски для банков и других компаний. Способность новых передовых ИИ-моделей программировать на высоком уровне дала беспрецедентные возможности для поиска уязвимостей и разработки способов их эксплуатации, что вызвало опасения относительно использования таких моделей для дестабилизации финансовых и иных организаций. OpenAI предложила Европейской комиссии открытый доступ к функциям кибербезопасности, сообщил Брюссель в понедельник, добавив, что Anthropic пока не проявила такой же готовности. Бывший министр финансов Великобритании Джордж Осборн (George Osborne), возглавляющий инициативу OpenAI for Countries, в понедельник направил в Еврокомиссию письмо, в котором указал, что демократизация доступа к инструментам киберзащиты способна укрепить коллективную безопасность и отвечает европейским приоритетам. OpenAI также объявила о создании новой компании с начальными инвестициями свыше $4 млрд для помощи организациям в разработке и внедрении ИИ-систем и о приобретении консалтинговой фирмы Tomoro для её ускоренного масштабирования. |