|

Опрос

|

реклама

Быстрый переход

Nvidia вложит в OpenAI $30 млрд — прежняя сделка на $100 млрд зависла

20.02.2026 [11:54],

Алексей Разин

Наверняка OpenAI хотелось бы видеть в числе своих инвесторов Nvidia, поскольку эта компания неплохо зарабатывает на буме ИИ и располагает достаточным объёмом свободных средств. Пока судьба оговорённых в сентябре инвестиций на сумму $100 млрд подвисла в воздухе, Nvidia уже ведёт переговоры с OpenAI о направлении в капитал последней ещё $30 млрд.

Источник изображения: Unsplash, Gavin Phillips Эти две суммы никак между собой не зависят, по словам знакомых с ходом переговоров источников, на которые ссылается CNBC. Более того, Nvidia не будет привязывать свою готовность вложить в OpenAI те самые $30 млрд к каким-либо промежуточным достижениям данной компании. Сентябрьская сделка, например, подразумевала поэтапные инвестиции, которые были привязаны к строительству определённых инфраструктурных объектов OpenAI на протяжении нескольких лет. В частности, свои первые $10 млрд на тех условиях Nvidia собиралась направить OpenAI после введения в строй вычислительных мощностей на 1 ГВт. При определённом стечении обстоятельств Nvidia может присовокупить рассматриваемые $30 млрд к сумме, обсуждаемой в сентябре, но конкретного плана у компании пока нет. Глава OpenAI Сэм Альтман (Sam Altman) попытался развенчать слухи о наличии у его компании трудностей в переговорах с Nvidia, а основатель последней Дженсен Хуанг (Jensen Huang) даже выразил уверенность в том, что компания примет участие в следующем раунде финансирования OpenAI и даже вероятном IPO. Предполагается, что текущий этап финансирования OpenAI пройдёт в две фазы: в ходе первой около $100 млрд вложат крупные стратегические инвесторы типа Amazon, Microsoft и Nvidia, а во второй меньшую сумму в капитал OpenAI направят более многочисленные институциональные инвесторы. Как позже пояснило издание Financial Times, новая сделка на $30 млрд может быть заключена между Nvidia и OpenAI уже в эти выходные, а от прежней схемы многолетнего финансирования на общую сумму $100 млрд компании откажутся. Сделка с Nvidia станет частью упоминавшегося выше раунда финансирования OpenAI, в котором примут участие Microsoft, Amazon и институциональные инвесторы. Основную часть суммы, полученной от Nvidia, будет потрачена OpenAI на закупку ускорителей и другого оборудования этой марки. OpenAI «спит с одним открытым глазом», чтобы справляться с дефицитом ИИ-чипов

20.02.2026 [11:00],

Алексей Разин

В интервью телеканалу Bloomberg директор OpenAI по глобальному рынку Крис Лихейн (Chris Lehane) дал понять, что стартап держит руку на пульсе не только собственных потребностей в чипах для развития вычислительной инфраструктуры ИИ, но и возможностях партнёров по их обеспечению.

Источник изображения: Nvidia По его словам, OpenAI тесно взаимодействует со стратегическими партнёрами, которые поддерживают доступ компании к необходимым чипам. Руководители OpenAI в этом смысле постоянно сохраняют бдительность и буквально «спят с одним открытым глазом», чтобы постоянно контролировать доступность необходимых компонентов. Квартальные отчёты многих поставщиков полупроводниковых компонентов показали, что квоты на поставку тех же микросхем памяти, например, уже распределены до конца текущего года, как минимум. Крис Лихейн посетил Индию вместе с генеральным директором OpenAI Сэмом Альтманом (Sam Altman), чтобы принять участие в саммите по искусственному интеллекту. По его словам, для правительств разных стран важно чётко контролировать развитие технологий ИИ в безопасном русле и обеспечивать международное сотрудничество. Как отметил представитель OpenAI, регулирующие органы в этой сфере появляются в США, Великобритании и Японии. В этом смысле международный контроль за распространением ИИ важен, как и в случае с ядерной энергетикой. Как отметил Лихейн, «демократические общества должны приступить к разработке общих стандартов безопасности в данной технологической сфере». Глава OpenAI Сэм Альтман признал, что китайские ИИ-компании растут «удивительно быстро»

19.02.2026 [14:40],

Алексей Разин

Амбициозные планы по развитию собственной вычислительной инфраструктуры и созданию передовых ИИ-моделей не мешают руководству OpenAI замечать успехи конкурентов. Сэм Альтман (Sam Altman) на этой неделе отметил, что китайские технологические компании развиваются «удивительно быстро».

Источник изображения: OpenAI Данные комментарии прозвучали из уст генерального директора OpenAI в интервью ресурсу CNBC. Он назвал заслуживающим внимания тот прогресс, который китайские компании демонстрируют по широкому спектру технологий. Скорость, с которой китайские разработчики продвигаются в различных секторах технологического рынка, удивительно высока, по словам Альтмана. В каких-то сферах китайские компании приблизились к переднему краю технологического прогресса, по его мнению, а в каких-то они заметно отстают от зарубежных конкурентов. В минувшую среду президент Microsoft Брэд Смит (Brad Smith) заявил CNBC, что американским компаниям технологического сектора следует беспокоиться из-за субсидий, которыми китайское правительство снабжает местные компании, участвующие в гонке искусственного интеллекта. Альтман в своём интервью CNBC коснулся и другой важной темы. Монетизировать свои услуги OpenAI постарается благодаря внедрению рекламы в чат-боте, но соответствующие планы пока находятся на ранней стадии обсуждения. «Я думаю, нам ещё предстоит проделать определённую работу, чтобы понять, в каком именно формате реклама будет работать наилучшим образом», — пояснил Альтман. Он тут же добавил, что ему лично нравится вариант рекламы, применяемой на страницах социальной сети Instagram✴✴, поскольку он позволяет пользователю узнавать что-то новое, о чём в иных обстоятельствах он даже не имел бы ни малейшего представления. Примерно в этом направлении OpenAI и будет двигаться, внедряя рекламу в ChatGPT. Сперва реклама появится в чат-боте для американских пользователей, а потом и за пределами страны. Даже если инвесторы всё чаще задают вопросы о сроках окупаемости своих вложений в OpenAI, сама компания сейчас отдаёт приоритет скорости развития бизнеса. «Мы сейчас растём с предельно высокой скоростью. Я думаю, что покуда мы сохраняем разумные экономические показатели подразделений, мы должны фокусироваться на всё более быстром росте, а прибыльными мы станем в тот момент, когда сочтём это уместным», — многозначительно пояснил Альтман. OpenAI идёт за оценкой в $850 млрд: стартап может привлечь свыше $100 млрд в новом раунде

19.02.2026 [07:25],

Алексей Разин

После сделки SpaceX по поглощению xAI, которая оценивает совокупную стоимость их активов в $1,25 трлн, конкурирующему стартапу OpenAI придётся постараться, чтобы добиться статуса самого дорогого в мире. Тем не менее, в рамках текущего раунда финансирования он может привлечь более $100 млрд, подняв собственную капитализацию до $850 млрд.

Источник изображения: OpenAI Это выше тех $830 млрд, на которые инвесторы рассчитывали изначально, как отмечает Bloomberg. Без учёта нового раунда финансирования капитализацию OpenAI сейчас оценивают в $730 млрд, поэтому если после привлечения нового объёма инвестиций она увеличится до $850 млрд, компании придётся собрать в ходе мероприятий не менее $120 млрд. Как отмечает Bloomberg, сейчас OpenAI почти завершила первый этап финансирования в рамках очередного раунда, свои средства в капитал стартапа на этот раз направили главным образом стратегические инвесторы типа Amazon, SoftBank, Nvidia и Microsoft. Если все они вложатся по максимуму, то в совокупности уже на первом этапе удастся привлечь около $100 млрд. Уточнения по суммам инвестиций будут сделаны до конца текущего месяца. Ранее считалось, что Amazon вложит до $50 млрд, SoftBank направит ещё $30 млрд, а Nvidia раскошелится на $20 млрд. На втором этапе свои средства в капитал OpenAI направят институциональные инвесторы, с их помощью сумма вложений в рамках нового раунда превысит $100 млрд. Скорее всего, данный этап финансирования будет реализован уже после февраля. Сделка Amazon с OpenAI будет подразумевать более активное использование процессоров и облачных мощностей первой из компаний в инфраструктуре второй. Суд запретил OpenAI использовать бренд Cameo

18.02.2026 [14:31],

Владимир Фетисов

Федеральный окружной суд Северного округа Калифорнии встал на сторону платформы Cameo, которая позволяет пользователям получать персонализированные видеосообщения от знаменитостей, в рамках разбирательства с OpenAI. В соответствии с вынесенным предписанием, разработчик ChatGPT должен прекратить использование слова «Cameo» в своих продуктах и алгоритмах.

Источник изображения: OpenAI OpenAI использовала слово «Cameo» в своём приложении для генерации видео, основой которого стала ИИ-модель Sora 2. Пользователи могли задействовать функцию Cameo для вставки своих цифровых изображений в генерируемые ИИ-алгоритмом ролики. В судебном постановлении сказано, что название упомянутой функции было достаточно похоже на название уже существовавшей ранее платформы, чтобы вызвать путаницу среди пользователей. Таким образом, суд отклонил аргумент OpenAI, согласно которому слово Cameo было просто частью описания, постановив, что «оно скорее намекает на саму функцию, чем описывает её». В ноябре прошлого года суд удовлетворил жалобу платформы Cameo и вынес временный запрет на использование этого слова в продуктах OpenAI. После этого компания была вынуждена переименовать функцию в Characters. «Это решение — важная победа не только для нашей компании, но и для целостности нашей торговой площадки и тысяч авторов, которые доверяют бренду Cameo. Мы продолжим защищать нашу интеллектуальную собственность от любой платформы, которая попытается воспользоваться узнаваемостью, с таким трудом созданной нами», — заявил гендиректор Cameo Стивен Галанис (Steven Galanis). «Мы не согласны с утверждением, что кто-то может претендовать на исключительное право собственности на слово «Cameo», и ждём возможности продолжить отстаивать нашу позицию», — прокомментировал решение суда представитель OpenAI. В ChatGPT появился «Режим блокировки» и маркировка повышенного риска для защиты важных данных

17.02.2026 [18:15],

Павел Котов

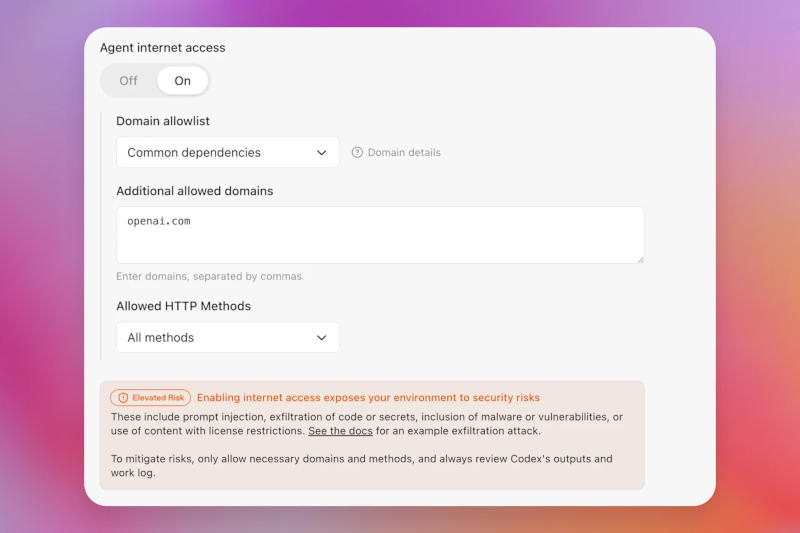

Компания OpenAI представила новые функции безопасности, направленные на то, чтобы не давать злоумышленникам возможности злоупотреблять продуктами на основе искусственного интеллекта. Это «Режим блокировки» (Lockdown Mode) как дополнительная настройка ChatGPT и пометки «Повышенный риск» (Elevated Risk) в ChatGPT, ChatGPT Atlas и Codex.

Источник изображения: openai.com Новые функции основаны на существующих средствах защиты, реализованных на уровне модели, продукта и системы, включая песочницу, защиту от утечки данных через URL-адреса, инструменты мониторинга и применения мер, а также корпоративные средства контроля, такие как разграничение прав и журналы аудита. «Режим блокировки» в ChatGPT позволяет отключать отдельные инструменты и функции чат-бота, которые гипотетический злоумышленник может попытаться использовать, чтобы организовать утечку конфиденциальных данных из переписки с пользователем или подключённых приложений, например, методом внедрения дополнительных запросов. Так, при просмотре веб-страниц в режиме блокировки включается ограничение в рамках кешированного контента — в результате сетевые запросы в реальном времени остаются в пределах контролируемой сети OpenAI. Режим блокировки доступен для пользователей с учётными записями для бизнеса, учреждений здравоохранения и образования. Он накладывает для рядовых пользователей дополнительные ограничения, помимо выбранных администратором настроек. Доступны и дополнительные настройки — можно выбирать, какие конкретно приложения и какие действия внутри этих приложений будут работать в режиме блокировки. Компания также предлагает набор инструментов Compliance API Logs Platform, позволяющий фиксировать данные об использовании приложений, общих данных и подключённых внешних источниках. В OpenAI также обратили внимание, что сервисы искусственного интеллекта могут создавать дополнительные угрозы для пользователей. Чтобы сделать это более понятным и последовательным, компания решила ввести стандартную маркировку существующих возможностей. Соответствующие функции ChatGPT, ChatGPT Atlas и Codex теперь будут иметь единую метку «Повышенный риск». Так, при работе с помощником по программированию Codex эту пометку получит функция доступа к внешним ресурсам, первоначально предназначенная, например, для поиска документации. Пометка будет сопровождаться пояснениями того, какие изменения и угрозы могут возникнуть, и в каких случаях предоставлять такой доступ уместно. Создатель завирусившегося ИИ-агента OpenClaw присоединился к OpenAI

16.02.2026 [16:27],

Владимир Мироненко

Питер Штайнбергер (Peter Steinberger), создатель набравшего вирусную популярность ИИ-агента OpenClaw, присоединяется к OpenAI. Об этом сообщил глава компании Сэм Альтман (Sam Altman). По его словам, у Штайнбергера много потрясающих идей, как заставить ИИ-агентов взаимодействовать друг с другом.

Источник изображения: openclaw.ai Альтман отметил, что будущее будет чрезвычайно многоагентным, и эта способность агентов работать вместе станет основой будущих продуктов компании. Сервис OpenClaw, ранее известный как Moltbot и Clawdbot, завоевал популярность благодаря способности автоматизировать рутинные задачи на компьютере пользователей. Вместе с тем платформа оказалась уязвима для взлома из-за небезопасных настроек по умолчанию, предполагающих совместимость с сетевыми интерфейсами. Кроме того, в начале этого месяца исследователи обнаружили более 400 вредоносных навыков OpenClaw, загруженных в ClawHub. Также команда OpenClaw разработала MoltBook, социальную сеть, предназначенную исключительно для общения ИИ-агентов, где те жаловались на людей, спорили о доказуемости сознания и обсуждали необходимость приватного места для обмена идеями. На данный момент неизвестно, какая должность будет у Штейнбергера. Альтман лишь сообщил, что OpenClaw продолжит свою работу как проект с открытым исходным кодом в рамках фонда, поддерживаемого OpenAI. Для OpenAI, потерявшей за последнее время немало ведущих разработчиков, появление Штейнбергера в своей команде является большим достижением. Реклама Anthropic с подтруниванием над OpenAI сработала — аудитория Claude выросла на 11 %

14.02.2026 [12:39],

Владимир Фетисов

Компания Anthropic сумела извлечь немалую выгоду из рекламного ролика, который был показан во время финального матча чемпионата по американскому футболу Super Bowl. По данным BNP Paribas, небольшое видео с критикой в адрес OpenAI, решившей добавить рекламу в ChatGPT, способствовало росту посещаемости сайта Anthropic и увеличению количества ежедневно активных пользователей ИИ-бота Claude.

Источник изображения: Steve Johnson / Unsplash В сообщении сказано, что посещаемость сайта Anthropic выросла на 6,5 % после показа рекламы во время матча Super Bowl. Количество ежедневно активных пользователей Claude подскочило на 11 %. Этот рост позволил Claude войти в десятку лучших бесплатных приложений в американском App Store и опередить аналоги от конкурентов, таких как OpenAI, Google и Meta✴✴. У ChatGPT количество ежедневно активных пользователей после Super Bowl увеличилось на 2,7 %, а у Gemini — на 1,4 %. При этом пользовательская база Claude всё ещё значительно меньше по сравнению с аудиторией ChatGPT и Gemini. Реклама брендов, связанных с искусственным интеллектом, заняла центральное место на главной игре года, собравшей аудиторию в 125 млн человек в США. Вполне логично, что такое массовое событие привлекло внимание ИИ-разработчиков, которые пытаются привлечь на свою сторону больше клиентов на высококонкурентном рынке, не проявляющем признаков замедления. Противостояние OpenAI и Anthropic, ставки в котором как никогда высоки, приобрело новый оттенок с выходом их рекламных роликов на фоне подготовки обеих компаний к возможному выходу на биржу позднее в этом году. В последние недели обе стороны стали более активно выступать публично, а их руководители открыто критикуют бизнес друг друга. Генеральный директор OpenAI Сэм Альтман (Sam Altman) раскритиковал рекламную кампанию Anthropic на Super Bowl. В посте на платформе X Альтман назвал рекламу Anthropic «обманчивой» и «нечестной». Anthropic и OpenAI также ожесточённо конкурируют за привлечение корпоративных клиентов и лучших специалистов в области программирования, параллельно с этим получая рекордные объёмы финансирования от инвесторов. На этой неделе завершился очередной раунд финансирования Anthropic, в рамках которого компания привлекла $30 млрд. За счёт этого рыночная стоимость Anthropic выросла до $380 млрд, что более чем вдвое превышает показатель на момент предыдущего привлечения средств в сентябре прошлого года. Однако OpenAI продолжает оставаться лидером в гонке с крупнейшим в истории частным раундом финансирования в технологическом сегменте, который компания провела в прошлом году. Более того, OpenAI ведёт переговоры о проведении ещё одного раунда, в рамках которого компания может получить от инвесторов до $100 млрд. OpenAI убила самую эмоциональную ИИ-модель, несмотря на протесты пользователей

14.02.2026 [06:08],

Анжелла Марина

OpenAI объявила об окончательном выводе из эксплуатации модели GPT-4o, а вместе с ней GPT-4.1, GPT-4.1 mini и o4-mini, сообщает Business Insider. Это уже вторая попытка компании отключить GPT-4o. Первая состоялась в августе и закончилась отступлением перед натиском недовольных пользователей. В январе компания опять предупредила об отключении модели, однако негативная реакция вспыхнула с новой силой.

Источник изображения: openai.com Глубокая эмоциональная привязанность аудитории объясняется специфическим комплиментарным стилем общения GPT-4o. Некоторые пользователи называли модель «жизненно важным доступным инструментом» и описывали как творческого партнёра и эмоциональную опору, с которой работали месяцами. В соцсетях реакция на объявление варьировалась от гнева до чёрного юмора. Фиджи Симо (Fidji Simo), руководитель подразделения приложений OpenAI, назвала подобную привязанность началом новой эры взаимодействия людей с искусственным интеллектом. Она отметила, что люди склонны формировать эмоциональные связи с интеллектуальными системами, однако новые версии моделей получили ограничения для предотвращения потенциально вредных зависимостей. Например, при запросах «Стоит ли мне уйти от жены?» современные алгоритмы отказываются давать прямые рекомендации и вместо этого предлагают взвесить «все за и против». Глава OpenAI Сэм Альтман (Sam Altman) признаёт, что пользователи ценили заискивающий тон ответов GPT-4o, но сам он считает это излишним подхалимством и подобострастием. В компании пояснили, что вывод старых моделей из эксплуатации необходим для концентрации ресурсов на улучшении актуальных версий, которыми пользуется основная масса людей. К моменту отключения GPT-4o модель использовали лишь 0,1 % клиентов сервиса. Microsoft взяла курс на «самодостаточность» в ИИ — собственные модели вместо зависимости от OpenAI

13.02.2026 [14:13],

Павел Котов

Microsoft стремится достичь «истинной самодостаточности» в области искусственного интеллекта, разрабатывая собственные модели и сокращая зависимость от OpenAI, заявил глава отдела ИИ в компании Мустафа Сулейман (Mustafa Suleyman). Стратегический сдвиг стал следствием реструктуризации отношений с OpenAI в октябре — софтверный гигант вознамерился самостоятельно разрабатывать передовые решения, не полагаясь на партнёра, сообщил он газете Financial Times.

Источник изображения: Simon Ray / unsplash.com «Мы должны разрабатывать собственные основополагающие передовые модели, располагая гигаваттными вычислительными мощностями и некоторыми из лучших в мире команд по обучению ИИ», — добавил господин Сулейман. Сейчас компания вкладывает значительные средства в сбор и организацию больших наборов данных, необходимых для обучения передовых систем. «В этом наша миссия по достижению истинной самодостаточности», — считает глава отдела ИИ в Microsoft. Выпуская собственные службы ИИ, в том числе помощника Copilot, компания использовала модели OpenAI, в которую ранее инвестировала средства. В прошлом году корпорация согласилась на реструктуризацию стартапа, сохранила в нём долю, которая сейчас оценивается в $135 млрд, и доступ к передовым моделям до 2032 года. OpenAI, в свою очередь, получила больше свободы в выборе партнёров по инфраструктуре и стала превращаться в прямого конкурента Microsoft. Софтверный гигант вложил средства в других разработчиков ИИ, в том числе в Anthropic и Mistral; и ускорил разработку собственных моделей, выход которых намечен уже на этот год.

Источник изображения: BoliviaInteligente / unsplash.com «Работа в офисе, когда вы сидите за компьютером, будь то юрист, бухгалтер, менеджер проекта или маркетолог — большинство этих задач в ближайшие 12–18 месяцев полностью автоматизирует ИИ», — пообещал Мустафа Сулейман. В ближайшие два–три года ИИ-агенты смогут эффективно координировать рабочие процессы в крупных организациях. Со временем ИИ сможет самостоятельно обучаться и совершенствоваться, выполняя более автономные действия. «Создать новую модель будет примерно как записать подкаст или разместить публикацию в блоге. Можно будет разработать ИИ, который станет соответствовать вашим требованиям для любой организации или каждого человека на планете», — считает он. В этом деле Microsoft придётся усиленно потрудиться. Anthropic добилась успеха в создании средств ИИ-генерации программного кода; OpenAI и Google активно продвигают услуги для корпоративных клиентов. По итогам текущего финансового года, который закончится в июне, капитальные затраты Microsoft составят $140 млрд — компания увеличит расходы на инфраструктуру для ИИ. Инвесторы, однако, пока скептически относятся к этой инициативе, и за последний месяц акции Microsoft подешевели на 13 %. «Сейчас, вне сомнений, беспрецедентные времена, и, думаю, рынки пытаются понять, как это повлияет на ситуацию в ближайшие пять лет. Мы все не сомневаемся, что эти результаты будут накапливаться и увеличивать выручку с прибылью», — заверил Мустафа Сулейман. Он также рассказал о других проектах Microsoft в области ИИ. Компания разрабатывает «медицинский суперинтеллект», который поможет в развитии систем здравоохранения; среди её целей значится также создание «гуманистического сверхинтеллекта» — передовых технологий ИИ, которые не будут сопротивляться воле разработчиков. «Нам придётся пересмотреть это и исходить из предположения, что следует развёртывать в мире такие системы, которые мы с уверенностью сможем контролировать, и которые будут работать в подчинённом нам режиме. Эти инструменты, как и любые другие технологии прошлого, призваны повысить благополучие человека и служить ему, а не превосходить его», — заключил глава ИИ-отдела Microsoft. OpenAI обвинила китайскую DeepSeek в краже данных для обучения ИИ-модели R1

13.02.2026 [12:11],

Алексей Разин

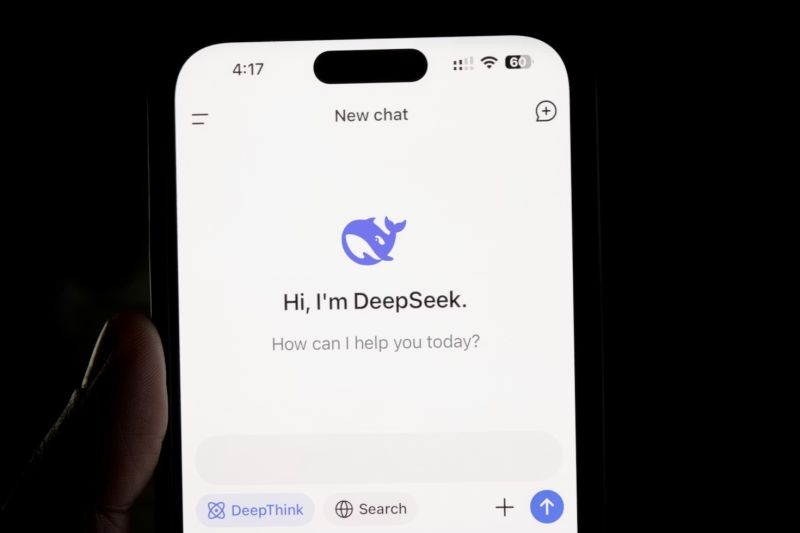

Агентство Bloomberg со ссылкой на служебную записку OpenAI сообщает, что создатели ChatGPT обвинили китайскую DeepSeek в использовании ухищрений, позволяющих добывать информацию американских ИИ-моделей для обучения китайского чат-бота R1 следующего поколения. Соответствующий доклад был направлен американским парламентариям, по данным источника.

Источник изображения: Unsplash, Solen Feyissa По мнению представителей OpenAI, китайский конкурент использовал метод так называемой дистилляции, чтобы «бесплатно выехать на успехе технологий, разработанных OpenAI и других передовых американских компаний». Создателям ChatGPT якобы удалось выявить новые изощрённые методы получения доступа китайской DeepSeek к информации американских ИИ-моделей, которые призваны обходить существующие методы защиты. Беспокойство на эту тему OpenAI и Microsoft проявили ещё в прошлом году, когда начали соответствующее расследование в отношении деятельности DeepSeek. Метод дистилляции позволяет ускорить обучение сторонних ИИ-моделей с использованием данных уже обученных систем. Анализ активности на собственной платформе, как отмечает OpenAI, позволяет говорить об участившихся случаях применения дистилляции сторонними разработчиками ИИ-моделей — преимущественно расположенными в Китае, хотя в отчёте упоминается и Россия. Поскольку DeepSeek не предлагает своим клиентам платных подписок, как и многие другие китайские провайдеры подобных услуг, они получают большее распространение, чем проприетарные коммерческие решения западного происхождения, по мнению авторов доклада. Это угрожает мировому главенству ИИ-моделей американской разработки, как резюмируют они в своём обращении к специальному комитету американского парламента. Полученные методом дистилляции сторонние ИИ-модели, по словам представителей OpenAI, нередко лишены тех ограничений, которые устанавливаются создателями исходных систем, а потому могут использоваться во вред человечеству или отдельным странам. Попытки OpenAI оградить себя от дистилляции китайскими разработчиками успехом не увенчались, поскольку представители DeepSeek якобы получали доступ к американским ИИ-моделям разного рода окольными путями. По словам представителей OpenAI, существуют целые сети посредников, которые предоставляют доступ к услугам компании в обход существующих ограничений. Для американских чиновников существование подобных практик тоже не является откровением, отмечает Bloomberg. Американские политики обеспокоены и возможностью получения компанией DeepSeek доступа к более современным ускорителям вычислений Nvidia H200, поскольку их поставки в Китай в прошлом году успел разрешить американский президент Дональд Трамп (Donald Trump). В сочетании с существующими методами обучения своих моделей, DeepSeek могла бы в результате добиться существенного прогресса. Прежние расследования уже выявили, что DeepSeek использовала для обучения своих предыдущих ИИ-моделей оборудование Nvidia, хотя основная его часть была доставлена в Китай в рамках существовавших на тот момент правил экспортного контроля США. Политики теперь опасаются, что доступ DeepSeek к более современным чипам H200 сильнее навредит позициям США на мировой технологической арене. ИИ пугает даже своих создателей: исследователи массово уходят из OpenAI и Anthropic

13.02.2026 [12:06],

Владимир Мироненко

Ведущие специалисты по ИИ предупреждают о растущей опасности ИИ-технологий, покидая компании в знак протеста или публично заявляя о серьёзных опасениях в связи с бурным развитием этого направления, пишет Axios.

Источник изображения: Immo Wegmann/unsplash.com В понедельник объявил о своём уходе глава исследовательского подразделения по безопасности искусственного интеллекта Anthropic Мринанк Шарма (Mrinank Sharma), осознав, что «мир в опасности». Также на этой неделе покинула OpenAI исследователь Зои Хитциг (Zoë Hitzig), сославшись на этические соображения. Ещё один сотрудник OpenAI, Хиеу Фам (Hieu Pham), написал в соцсети X: «Я наконец-то почувствовал экзистенциальную угрозу, которую представляет ИИ». «Я никогда не видел, чтобы столько технологических специалистов так сильно, часто и с такой обеспокоенностью выражали свои опасения, как в случае с ИИ», — отметил в соцсети X Джейсон Калаканис (Jason Calacanis), инвестор в сфере технологий и соведущий подкаста «All-In». Предприниматель Мэтт Шумер (Matt Shumer) сравнивает нынешнюю ситуацию с кануном пандемии. Его пост на платформе X, в котором он изложил риски, связанные с коренным изменением рабочих процессов и жизни людей под воздействием ИИ, мгновенно стал вирусным, набрав 56 млн просмотров за 36 часов. Вместе с тем, большинство сотрудников ИИ-компаний сохраняют оптимизм и считают, что смогут разумно управлять современными технологиями без ущерба для общества или больших потерь рабочих мест. Но сами разработчики признают существующий риск, связанный с искусственным интеллектом. Anthropic опубликовала отчёт Sabotage Risk Report, посвящённый рискам саботажа со стороны флагманской ИИ-модели Claude Opus 4.6. В нём признаётся, что имеют место быть риски, пусть небольшие, но их нельзя назвать незначительными, что ИИ может использоваться в преступной деятельности, включая создание химического оружия, а также в редких случаях он может совершать действия без прямого указания человека. OpenAI выпустила GPT-5.3-Codex-Spark — свою первую ИИ-модель, работающую без чипов Nvidia

12.02.2026 [23:26],

Николай Хижняк

Компания OpenAI выпустила свою первую модель искусственного интеллекта, работающую на гигантских чипах-ускорителях Wafer Scale Engine 3 от стартапа Cerebras Systems. Данный шаг является частью усилий создателя ChatGPT по диверсификации поставщиков аппаратного обеспечения для обучения своих моделей.

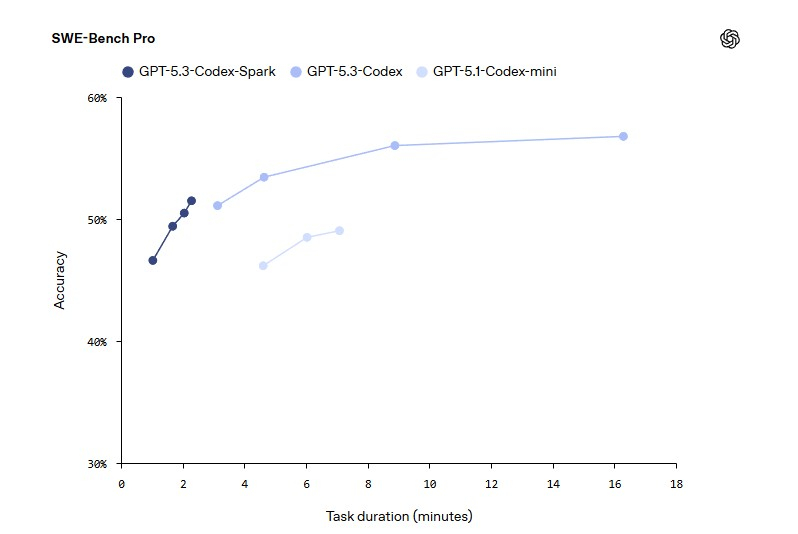

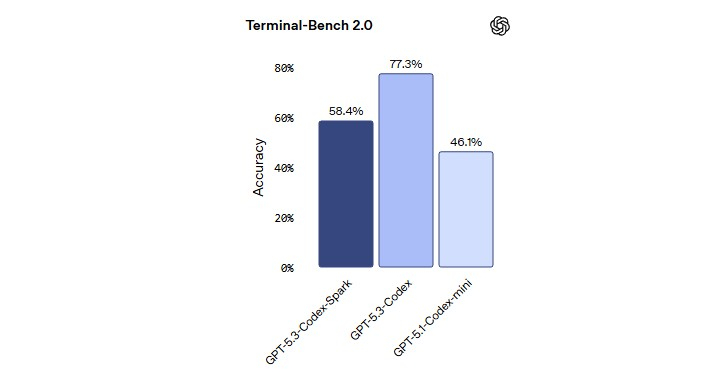

Источник изображения: OpenAI Модель GPT-5.3-Codex-Spark является менее мощной, но более быстрой версией продвинутой модели GPT-5.3-Codex, ориентированной на помощь в написании программного кода. Версия Spark позволит инженерам-программистам быстро выполнять такие задачи, как редактирование отдельных фрагментов кода и запуск тестов. Пользователи также могут легко прервать работу модели или дать ей указание выполнить что-то другое, связанное с вайб-кодингом, не дожидаясь завершения длительного вычислительного процесса.

Источник изображения: OpenAI В прошлом месяце OpenAI заключила сделку на сумму более $10 млрд на использование оборудования Cerebras для ускорения обучения своих моделей ИИ. Для Cerebras это партнёрство представляет собой значительный шаг в её стремлении конкурировать на рынке аппаратных средств для ИИ, где долгое время доминирует компания Nvidia. Для OpenAI — это способ расширить сотрудничество с разными поставщиками оборудования для удовлетворения растущих вычислительных потребностей.

Источник изображения: OpenAI В октябре OpenAI заявила о заключении многолетнего соглашения о стратегическом партнёрстве, в рамках которого будет построена ИИ-инфраструктура на базе сотен тысяч ИИ-ускорителей AMD нескольких поколений общей мощностью 6 ГВт. Позже в том же месяце OpenAI согласилась приобрести специализированные чипы и сетевые компоненты у Broadcom. Как пишет Bloomberg, в последнее время отношения OpenAI с Nvidia оказались под пристальным вниманием на фоне сообщений о напряженности между двумя компаниями. Однако руководители обеих компаний публично заявили, что по-прежнему привержены сотрудничеству. В заявлении, опубликованном в четверг, представитель OpenAI заявил, что партнёрство компании с Nvidia является «основополагающим» и что самые мощные модели ИИ OpenAI являются результатом «многолетней совместной работы над аппаратным и программным обеспечением» двух компаний. «Именно поэтому мы делаем упор на Nvidia как на основу нашей системы обучения и вывода, целенаправленно расширяя экосистему вокруг неё за счёт партнёрств с Cerebras, AMD и Broadcom», — заявил представитель компании. Первоначально GPT-5.3-Codex-Spark будет доступна подписчикам ChatGPT Pro в качестве предварительной версии для исследований. OpenAI собирается предоставить доступ к новой ИИ-модели для более широкого числа пользователей в ближайшие недели. Компания также отмечает, что Codex имеет более 1 млн активных еженедельных пользователей. OpenAI начала терять исследователей после появления рекламы в ChatGPT

12.02.2026 [14:19],

Павел Котов

Исследователь OpenAI Зои Хитциг (Zoë Hitzig) уволилась из компании в тот же день, когда стартовало тестирование показа рекламы в ChatGPT. Работая в компании, она помогала в сборке моделей ИИ и установке ценообразования на них. OpenAI рискует повторить ошибки Facebook✴✴, сделанные десять лет назад, предупредила она.

Источник изображения: Dima Solomin / unsplash.com Особенно рискованной затея с рекламой представляется в силу характера данных на платформе ChatGPT. Пользователи делятся с чат-ботом медицинской информацией, проблемами в отношениях и религиозными убеждениями — зачастую «потому, что люди верят, что разговаривают с чем-то, лишённым скрытых мотивов», и в результате чего платформа превратилась в «беспрецедентный архив человеческой откровенности». Нечто подобное, по мнению Хитциг, раньше было с Facebook✴✴ — когда-то соцсеть обещала пользователям контроль над своими данными и возможность голосовать за изменения в политику. Со временем эти обещания ослабли, а Федеральная торговая комиссия (FTC) установила, что изменения в политике конфиденциальности, с которыми Facebook✴✴ обещала людям более полный контроль, в действительности дали обратный результат. Вот и с OpenAI бывшая сотрудница компании не исключила подобного, потому что та «создаёт сильные стимулы для нарушения собственных правил». На этапе тестирования персонализация рекламы для пользователей по умолчанию включена, говорится в документации OpenAI. Если не трогать эту настройку, реклама будет подбираться с учётом данных из текущих и прошлых чатов, а также прошлых взаимодействий с объявлениями. У рекламодателей не будет доступа к переписке пользователей с чат-ботом или к их персональным данным; реклама не будет показываться в чатах, посвящённых вопросам здоровья, религии и политики. В этом Хитциг уже усмотрела внутреннее противоречие: с одной стороны, компания настаивает, что не пытается повлиять на активность пользователей исключительно с целью получить доход от рекламы — с другой, оптимизирует поведение ИИ для ежедневно активных пользователей, делая её «более льстивой и подобострастной». В результате люди могут впадать в зависимость от ИИ; кроме того, задокументированы случаи психозов, связанных с ChatGPT, а в отдельных случаях чат-бот потворствовал суицидальным мыслям — это косвенно подтверждает множество исков к OpenAI. Чтобы противостоять угрозам, Хитциг предложила схемы субсидирования потребителей со стороны корпоративных клиентов; формирование независимых советов с полномочиями контролировать использование данных переписки для таргетирования рекламы; а также трасты, позволяющие пользователям сохранять контроль над своей информацией. Наиболее опасными исходами эксперт назвала «технологию, которая манипулирует людьми, использующими её бесплатно; и технологию, приносящую пользу исключительно меньшинству, которое может себе её позволить». OpenAI распустила команду, которая объясняла миру её миссию

12.02.2026 [12:05],

Владимир Мироненко

OpenAI расформировала команду, которая занималась донесением миссии компании до общественности и собственных сотрудников. Как сообщили в OpenAI ресурсу TechCrunch, сотрудники команды были переведены в другие подразделения, а руководитель назначен на должность «главного футуролога» компании.

Источник изображения: Growtika/unsplash.com Расформированный коллектив, предположительно, был создан в сентябре 2024 года. По данным издания Platformer, команда занималась продвижением заявленной миссии компании — использованием возможностей сильного искусственного интеллекта (Artificial General Intelligence, AGI) для обеспечения пользы всему человечеству. «Проект по согласованию миссии был вспомогательной функцией, помогающей сотрудникам и общественности понять нашу миссию и влияние ИИ. Эта работа продолжается во всей организации», — рассказал официальный представитель OpenAI. Джош Ачиам (Josh Achiam), бывший руководитель команды OpenAI по согласованию миссии, объяснил в блоге свою новую роль главного футуролога компании: «Моя цель — поддержать миссию OpenAI — обеспечить, чтобы сильный искусственный интеллект приносил пользу всему человечеству, — изучая, как мир изменится в ответ на ИИ, AGI и многое другое». Ачиам добавил, что на новой должности он будет сотрудничать с Джейсоном Пруэтом (Jason Pruet), физиком и экспертом в области технологий OpenAI. По словам представителя OpenAI, остальная часть команды по согласованию миссии — речь идёт о шести или семи сотрудниках — была переведена в другие подразделения компании, где они занимаются аналогичной работой. Он объяснил роспуск команды обычной реорганизацией из разряда тех, которые происходят в быстро развивающихся компаниях. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |