|

Опрос

|

реклама

Быстрый переход

Runway представила свою первую ИИ-модель мира и добавила звук в генератор видео

12.12.2025 [11:18],

Павел Котов

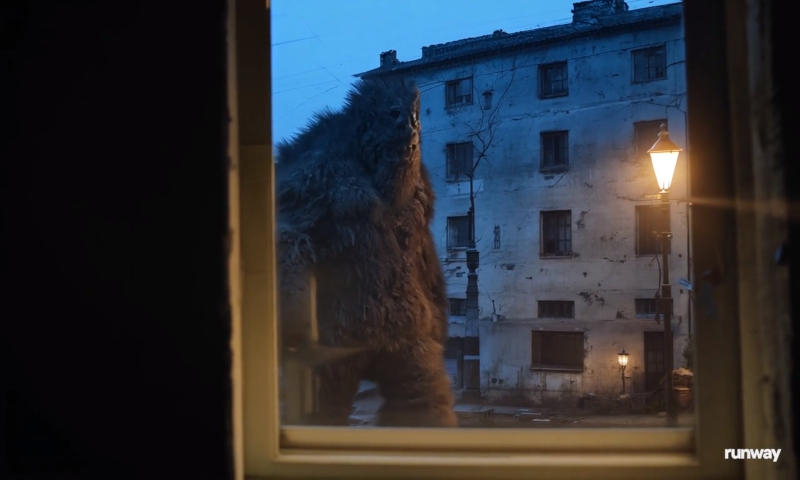

Компания Runway, которая ранее выпускала генераторы изображений и видео, представила модель искусственного интеллекта для генерации виртуальных миров, получившую название GWM-1. Она работает за счёт покадрового прогнозирования, создаёт симуляции с пониманием физики и того, как ведёт себя мир с течением времени.

Источник изображений: Runway Модель мира — это система ИИ, изучающая внутренние симуляции с процессами, которые могут происходить в мире. Она может рассуждать, планировать и осуществлять действия без необходимости в обучении на каждом возможном сценарии в реальной жизни. «Чтобы создать модель мира, нам сначала нужно было разработать по-настоящему качественную модель видео. Мы считаем, что правильный путь к созданию моделей мира — их обучение предсказывать пиксели напрямую, и это лучший способ добиться универсального моделирования. При достаточном масштабе и с правильными данными можно создать модель, которая достаточно хорошо понимает, как работает мир», — рассказал гендиректор Runway Анастасис Германидис (Anastasis Germanidis).  Компания представила три версии новой модели мира: GWM-Worlds, GWM-Robotics и GWM-Avatars. GWM-Worlds — приложение, позволяющее создавать интерактивные проекты. Пользователь задаёт первоначальную сцену по текстовому запросу или образцу на изображении, и по мере исследования пространства модель генерирует мир с учётом геометрии, физики и освещения. Моделирование осуществляется с разрешением 720p и скоростью 24 кадра в секунду. GWM-Worlds может пригодиться в разработке игр, она также подходит для обучения навигационных агентов и агентов действия в реальном мире. GWM-Robotics предназначается для генерации синтетических данных, обогащаемых новыми параметрами, такими как изменения погодных условий или возникновение препятствий. Этот метод поможет выявить, когда и при каких условиях роботы способны нарушать правила с учётом различных сценариев. GWM-Avatars предназначается для создания реалистичных аватаров и имитации человеческого поведения. Сейчас Worlds, Robotics и Avatars работают как отдельные модели, но Runway планирует их объединить.  Компания также сообщила об обновлении своей базовой модели Gen 4.5 — она научилась генерировать встроенный звук и создавать длинные многокадровые ролики. Это могут быть одноминутные клипы с согласованностью персонажей, встроенными диалогами, фоновым звуком и сложными кадрами с разных ракурсов. Можно также редактировать существующий звуковой ряд, добавлять диалоги и изменять многокадровые видеоролики любой длины. Работать с генератором видео Runway Gen 4.5 могут все пользователи платных тарифных планов. GWM-Robotics будет доступна через SDK; ведутся переговоры с партнёрами об интеграции GWM-Robotics и GWM-Avatars для создателей робототехники и других предприятий. Вышел генератор HD-видео Runway Gen 4.5 — и он сразу обошёл Veo 3 и Sora 2 Pro

02.12.2025 [07:00],

Алексей Разин

Развитие сегмента сервисов, позволяющих генерировать видео по текстовому описанию, перестало вызывать снисходительную улыбку у «старожилов отрасли», поскольку подобные инструменты теперь позволяют создавать реалистичные ролики малыми затратами. Runway утверждает, что её модель Gen-4.5 выводит реалистичность генерируемых ИИ видео на качественно новый уровень.

Источник изображения: YouTube, Runway В блоге Runway, как отмечает The Verge, сообщает о «результатах кинематографического качества». Внимание уделяется не только точности визуального отображения пейзажей, людей, животных и объектов, но и тщательной проработке физики движущихся объектов. Даже поведение жидкостей реализовано настолько реалистично, что неискушённому зрителю сложно догадаться, что видео было сгенерировано искусственным интеллектом. Распространение Runway Gen-4.5 осуществляется постепенно среди всех пользователей сервиса, по быстродействию и эффективности новая модель не будет уступать предыдущей, по словам представителей компании. Тем не менее, некоторые недостатки в её работе пока наблюдаются, в основном они связаны с логикой взаимодействия объектов на видео. Например, дверь может открываться до того, как кто-то в кадре взялся за её ручку. Создатели Runway утверждают, что новая модель лучше адаптирует генерируемое видео под стилистические запросы в описании и может добиваться более зрелищных визуальных эффектов, которые практически неотличимы от реальных видеосъёмок. Конкурирующая OpenAI тоже активно совершенствует свои средства для генерации видео. В сентябре была выпущена модель Sora 2, которая продемонстрировала заметный прогресс в улучшении отображения физических процессов. По словам создателей, она способна реалистично воспроизводить трюки, выполняемые с сапбордом на поверхности воды. Однако новый генератор Runway Gen 4.5 превзошёл главных конкурентов в лице Google Veo 3 и OpenAI Sora 2 Pro и возглавил рейтинг ИИ-моделей для генерации видео по текстовым описаниям Video Arena от Artificial Analysis. Runway представила «Photoshop для видео» — ИИ-модель Aleph для быстрого редактирования видео

29.07.2025 [23:37],

Анжелла Марина

Компания Runway представила новую ИИ-модель под названием Aleph, предназначенную для редактирования видео на основе текстовых запросов. Модель позволяет удалять объекты и людей из кадра, изменять элементы сцены, генерировать новые ракурсы и вносить сложные правки в уже существующие или сгенерированные ролики.

Источник изображения: Runway Aleph Как сообщает CNET, разработка основана на исследованиях Runway в области General World Models и Simulation Models и позиционируется компанией как инструмент для «гибкого монтажа», позволяющий быстро и последовательно редактировать видео без нарушения целостности кадров. В отличие от предыдущих моделей, сосредоточенных в основном на генерации видео по тексту, Aleph делает акцент на интерактивном редактировании. Теперь можно добавлять или удалять объекты, изменять освещение, корректировать действия персонажей и сохранять визуальную согласованность между кадрами — то есть выполнять те задачи, которые ранее представляли наибольшую сложность для ИИ. В Runway отметили, что Aleph — это не просто обновление, а новый подход к работе с видео в целом. Модель сочетает генерацию высокого качества с возможностью мгновенного редактирования через диалоговый интерфейс, что может быть востребовано в киноиндустрии, рекламе и других сферах, где важна скорость обработки контента. Интересно, что запуск модели происходит на фоне растущей конкуренции в сфере ИИ-видео. В этом году аналогичные разработки представили OpenAI, Google, Microsoft и Meta✴✴. Однако Runway, известная своими моделями Gen-1 и Gen-2, утверждает, что Aleph выводит технологию на новый уровень. По данным компании, Aleph уже тестируют крупные киностудии, рекламные агентства, архитектурные бюро, игровые компании и команды в сфере электронной коммерции. В настоящее время доступ к модели открыт для корпоративных клиентов и партнёров, а более широкий запуск ожидается в ближайшие дни. Runway готовит платформу для создания игр с помощью ИИ

28.06.2025 [06:03],

Анжелла Марина

ИИ-стартап Runway, чья оценочная стоимость составляет $3 млрд, намерен расширить горизонты своего влияния. После крупного успеха нейросети в киноиндустрии, компания планирует запустить платформу для генерации видеоигр.

Источник изображения: Runway По словам генерального директора компании Кристобаля Валенсуэлы (Cristóbal Valenzuela), первые пользователи смогут протестировать новый продукт уже на следующей неделе. Пока это просто минималистичный интерфейс, позволяющий взаимодействовать с моделью в текстовом чате и создавать изображения, но в дальнейшем появится возможность генерировать полноценные игры, сообщает The Verge. Runway в настоящий момент активно ведёт переговоры с крупными игровыми студиями о внедрении своих технологий в производственные процессы и о доступе к их базам данных для обучения моделей. По мнению Валенсуэлы, игровая индустрия сейчас находится примерно в той же точке, в которой находилась киноиндустрия пару лет назад, когда впервые столкнулась с применением ИИ в процессе создания контента. Тогда тоже наблюдалось немалое сопротивление, но со временем ИИ-технологии начали активно внедряться в работу. Глава Runway уверен, что сейчас процесс принятия ИИ в играх будет происходить быстрее. Компания уже имеет опыт сотрудничества с крупнейшими игроками развлекательного рынка. Например, её технологии применялись при производстве сериала Amazon «Дом Дэвида», также продолжается сотрудничество почти со всеми голливудскими студиями и большинством компаний из списка Fortune 100. Валенсуэла считает, что если Runway может помочь студии ускорить производство фильма на 40 процентов, то аналогичный эффект возможен и в разработке игр. Runway представила Act-One — ИИ, который анимирует персонажей по видео с реальными людьми

23.10.2024 [14:04],

Павел Котов

Нью-йоркский стартап Runway анонсировал систему Act-One, которая позволяет на основе видеозаписи с выступлением человека переносить выражения его лица на любой другой персонаж с сохранением всех нюансов мимики.

Источник изображений: runwayml.com Компания начала развёртывать Act-One с сегодняшнего дня — система доступна без дополнительной платы, а воспользоваться ей смогут зарегистрированные пользователи, на чьём лицевом счёте достаточно средств для работы с генератором видео Gen-3 Alpha, который Runway представила в этом году.  Анимация лица является одной из наиболее трудных задач в кинопроизводстве — для работы с ней традиционно используется сложное оборудование для захвата движения, которое фиксирует перемещение нанесённых на лицо актёра исходных точек. Системы на основе искусственного интеллекта призваны сделать этот процесс намного доступнее: Runway Act-One позволяет создавать анимацию мимики в различных стилях и жанрах без необходимости в оборудовании для захвата движения и без потребности рисовать точки на лице актёра.  Важным достоинством Act-One является способность системы обеспечивать кинематографическое качество и реалистичные результаты при разных ракурсах и фокусных расстояниях камеры. Один актёр, используя только камеру потребительского класса, может сыграть несколько персонажей сразу — модель ИИ генерирует выходной поток любого вида, будь то фотореализм или мультипликация, и сложность сцены роли не играет. Это поможет при съёмке независимого кино или в цифровых медиа, которые традиционно не имели доступа к производственным ресурсам высокого качества.  Система переноса мимики Act-One оснащена комплексным набором средств безопасности: попытки создания контента с участием публичных персон обнаруживаются и блокируются, применяются технические инструменты для проверки прав на использование голоса. Постоянный мониторинг призван гарантировать ответственное использование платформы. Runway уличили в использовании YouTube и пиратских фильмов для обучения ИИ-модели

26.07.2024 [04:25],

Анжелла Марина

Компания Runway, занимающаяся разработкой инструментов для генерации видео на основе искусственного интеллекта, оказалась в центре скандала. Издание 404 Media опубликовало расследование, в котором утверждается, что Runway использовала для обучения ИИ-модели тысячи видео с YouTube, включая контент известных медиакомпаний и популярных блогеров, не имея на это разрешения.

runwayml.com По сообщению The Verge, 404 Media получило доступ к таблице с данными, которые предположительно использовались Runway для обучения своего ИИ. В ней содержатся ссылки на каналы YouTube таких компаний, как Netflix, Disney, Nintendo и Rockstar Games, а также популярных блогеров, таких как MKBHD, Linus Tech Tips и Sam Kolder. Кроме того, в таблице были обнаружены ссылки на новостные издания, включая The Verge, The New Yorker, Reuters и Wired. По словам бывшего сотрудника Runway, эта таблица состоит из списка каналов, которые «являются результатом усилий всей компании по поиску качественных видео для построения модели». Затем эти ссылки использовались в качестве входных данных для веб-сканера, который загружал контент, используя прокси-серверы, дабы избежать блокировок со стороны Google. Помимо каналов YouTube, обнаружены данные, содержащие ссылки на пиратские сайты, которые демонстрируют лицензионные фильмы бесплатно. Правда пока не ясно, использовала ли Runway эти фильмы для обучения своей модели Gen-3 Alpha, но, как поясняет The Verge, узнать это будет, скорее всего, невозможно. Издание обратилась к Runway с просьбой прокомментировать ситуацию, но пока не получила ответа. Стоит отметить, что Runway — не единственная компания, использующая YouTube для обучения ИИ-моделей. Ранее в этом году технический директор OpenAI Мира Мурати (Mira Murati) заявила, что не уверена, обучалась ли их ИИ-модель для генерации Full HD-видео Sora на контенте из YouTube. Кроме того, недавнее совместное расследование компаний Proof News и Wired показало, что Anthropic, Apple, Nvidia и Salesforce обучали свои модели ИИ на более чем 170 000 видео с YouTube. Runway представила ИИ-генератор реалистичных видео Gen-3 Alpha

18.06.2024 [10:35],

Павел Котов

Свою первую модель искусственного интеллекта для генерации видео нью-йоркский стартап Runway выпустил ещё в прошлом году, но с тех пор его работу затмили такие мощные проекты как OpenAI Sora и представленная на минувшей неделе Luma AI Dream Machine. Теперь компания решила ответить конкурентам, рассказав о новой модели Gen-3 Alpha.

Источник изображений: runwayml.com Нейросеть Gen-3 Alpha — это, как пообещал разработчик, «первая из грядущей серии моделей, обученных Runway на новой инфраструктуре, построенной для крупномасштабного мультимодального обучения». Это будут модели ИИ, способные «представлять и моделировать широкий спектр ситуаций и взаимодействий, подобных тем, что встречаются в реальном мире».  Новая система позволяет генерировать высококачественные, детализированные, высокореалистичные видеоролики длиной 10 секунд — их отличают широкий спектр эмоций у персонажей и движущаяся камера при «съёмке». На создание 5-секундного ролика уходят 45 секунд, а 10-секундные видео появляются за 90 секунд. Общий доступ к новой модели компания пока не открыла, но в «ближайшие дни», как уточнил технический директор Runway Анастасис Германидис (Anastasis Germanidis), ей смогут пользоваться платные подписчики платформы (от $15 в месяц или от $144 в год), а затем, уже в этом году, и все остальные.  Модель Gen-3 Alpha «обучена совместно на видео и изображениях» — это «совместная работа междисциплинарной группы исследователей, инженеров и художников», но происхождение всех материалов из обучающего массива в компании не раскрыли. «У нас есть внутренняя исследовательская группа, которая осуществляет надзор за нашим обучением, и для обучения наших моделей мы применяем тщательно отобранные внутренние наборы данных», — пояснил представитель Runway.  Компания также «сотрудничает с ведущими развлекательными и медийными организациями в области создания индивидуальных версий Gen-3», что «позволит генерировать более стилистически управляемых и последовательных персонажей и поможет ориентироваться на конкретные художественные и повествовательные требования, среди прочего», рассказал разработчик. Конкретные имена не называются, но известно, что продукты Runway в своих работах использовали режиссёры таких лент как «Всё везде и сразу» (Everything, Everywhere, All at Once) и «Народный Джокер» (The People’s Joker). На сайте компании есть форма запроса, которую могут заполнить рассчитывающие на сотрудничество компании — для них разработчик подготовит собственную версию Gen-3 Alpha. Стоимость такой модели не уточняется. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |