|

Опрос

|

реклама

Быстрый переход

SK hynix за ближайшие пять лет удвоит производственные мощности по выпуску памяти

02.06.2026 [11:18],

Алексей Разин

Значимость производителей памяти подчёркивается хотя бы тем фактом, что председатель совета директоров южнокорейской SK Group Чхэ Тхэ Вон (Chey Tae-won) оказался приглашён на отраслевую выставку Computex 2026 на Тайване, где сделал несколько важных заявлений. В частности, он пообещал удвоить мощности SK hynix по производству памяти за последующие пять лет.

Источник изображения: SK hynix Он же в марте этого года, как напоминает Reuters, сообщил о возможности сохранения дефицита памяти на мировом рынке до 2030 года. SK hynix, которая в составе упоминаемого южнокорейского конгломерата занимается выпуском памяти, нуждается в расширении круга своих партнёров на Тайване, и дело не должно ограничиваться одной лишь TSMC, как отметил глава холдинга. Чхэ Тхэ Вон выразил надежду, что SK hynix сможет остаться крупнейшим поставщиком HBM для ускорителей Nvidia Vera Rubin. Как известно, на этот статус претендует конкурирующая Samsung Electronics, но SK hynix явно не собирается сдаваться без боя. На прошлой неделе капитализация SK hynix впервые в истории превысила $1 трлн, что говорит об уверенности инвесторов в способности этого производителя памяти развивать бизнес в условиях бума ИИ. По данным Counterpoint Research, в первом квартале текущего года SK hynix сохраняла за собой 58 % мирового рынка HBM, а Samsung и Micron досталось по 21 %. Память в серверах Nvidia подорожала на 435 % при переходе от Blackwell к Vera Rubin — стойку оценили в $7,8 млн

22.05.2026 [12:18],

Павел Котов

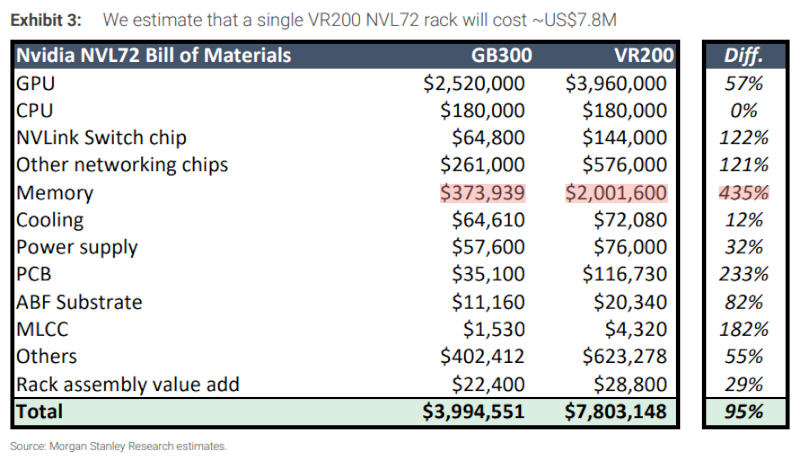

Одна серверная стойка Nvidia VR200 NVL72 нового поколения на архитектуре Vera Rubin обойдётся облачному оператору примерно в $7,8 млн, подчитали в Morgan Stanley. Для сравнения, GB300 NVL72 стоит около $4 млн. Стойка нового поколения VR200 NVL72 содержит больше DRAM и NAND — на память приходятся около 25 % общей стоимости.

Источник изображения: Nvidia В корпусах VR200 NVL72 компания Nvidia намеревается продавать процессоры Vera по $5000 и ускорители искусственного интеллекта Rubin по $55 000 за штуку. В стойках используются уже знакомые клиентам корпуса Oberon, но внутри установлены более сложные компоненты коммутации, сетевых подключений, печатные платы, системы охлаждения, изменились даже технологии упаковки чипов — всё это влияет на стоимость систем и складывается в ценник $7,8 млн за стойку. Только компоненты памяти в стойке VR200 NVL72 обходятся около $2 млн или на 435 % больше, чем в GB300 NVL72.

Источник изображения: x.com/Aaronwei3n На каждую стойку нового поколения приходятся 54 Тбайт памяти LPDDR5X — втрое больше, чем 17 Тбайт у GB200 NVL72. Nvidia, по оценкам SemiAnalysis, в I квартале платила по $8 за 1 Гбайт LPDDR5X, и дальше этот показатель может только вырасти, особенно если речь идёт о дорогих в производстве и тестировании модулях SOCAMM2. Таким образом, память для GB200 NVL72 обходится в $136 000 на каждую машину; в случае VR200 NVL72 это уже $408 000, а при росте цены до $10 за 1 Гбайт это будут уже $540 000 — даже без учёта наценки самой Nvidia. Кроме того, в каждой стойке VR200 NVL72 содержится память 3D NAND на сумму не менее $1 млн, тогда как в GB200 NVL72 её практически не было. В результате $2 млн за память на стойку Vera Rubin NVL72 представляется вполне предсказуемым показателем: здесь есть большие объёмы LPDDR5X и 3D NAND, не говоря уже о высокоскоростной HBM4 на самих ускорителях Rubin — и это в условиях дефицита и колоссальных цен на чипы памяти. ИИ продолжает раздувать бизнес Nvidia — квартальная выручка взлетела на 85 % до небывалых $81,6 млрд

21.05.2026 [05:58],

Алексей Разин

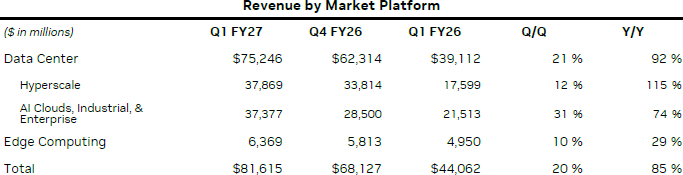

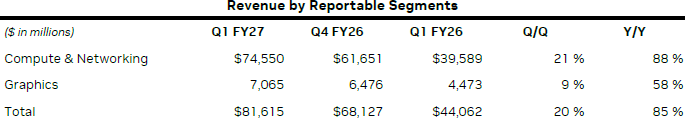

Квартальный отчёт Nvidia стоит особняком не только хронологически, он также позволяет оценить динамику бума ИИ, который толкает выручку компании вверх с конца 2022 года. По итогам прошлого квартала Nvidia нарастила свою выручку на 85 % до рекордных $81,6 млрд, превзойдя ожидания аналитиков. В сегменте ЦОД выручка выросла на 92 % до $75,2 млрд.

Источник изображений: Nvidia Таким образом, серверное направление бизнеса Nvidia в очередной раз побило рекорд, последовательно увеличив выручку на 21 %. Общая выручка также выросла на 20 % по сравнению с предыдущим кварталом, поэтому именно серверный сегмент определял динамику развития всего бизнеса компании в первом фискальном квартале, завершившемся в конце апреля. Соответственно, на серверный сегмент пришлось более 92 % общей выручки Nvidia.  Внутри сегмента ЦОД выручка почти поровну разделилась между гиперскейлерами ($37,9 млрд) и всеми прочими клиентами ($37,3 млрд), включая корпоративных, облачных, государственных и промышленных. В первом случае выручка увеличилась год к году на 115 %, во втором — на 74 %. Помимо ЦОД, компания в своей отчётности упоминает и сегменте периферийных вычислений, выручка в котором увеличилась на 29 % до $6,4 млрд. По словам финансового директора компании Колетт Кресс (Colette Kress), если спрос на рабочие станции с решениями семейства Blackwell был высоким, то дефицит памяти навредил продажам ПК своими высокими ценами. Сетевые решения для ЦОД увеличили профильную выручку Nvidia в три раза до рекордных $14,8 млрд. Поставки ускорителей семейства Vera Rubin компания планирует начать во второй половине текущего года. Генеральный директор Nvidia признался, что эти ускорители наверняка будут в дефиците на протяжении основной части своего жизненного цикла. Отдельно подчёркивается, что за прошедший квартал в Китай не было поставлено ни одного ускорителя с архитектурой Hopper, тогда как год назад соответствующая выручка достигла $4,6 млрд. Несмотря на принципиальное согласие властей США на поставку в КНР ускорителей H200, китайская сторона не разрешила их импорт. Тем не менее, китайский рынок в целом принёс Nvidia в прошлом квартале $4,55 млрд — на 53 % меньше, чем годом ранее. Для сравнения, американская выручка Nvidia за год почти утроилась до $63,8 млрд, и это закономерно с учётом высокой концентрации в США облачных гигантов, которые закупают компоненты Nvidia для своих ЦОД. Колетт Кресс добавила, что не уверена, будет ли разрешён импорт ускорителей H200 в Китай.  Если рассматривать разделение по функциональным сегментам, то вычислительные и сетевые решения увеличили выручку Nvidia на 88 % до $74,6 млрд, а направление графических решений прибавило 58 % до $7,1 млрд. В этом году Nvidia рассчитывает выручить $20 млрд на поставках центральных процессоров, что сделает одним из крупнейших поставщиков этого вида компонентов в денежном выражении. Ёмкость всего рынка CPU руководство компании оценивает в $200 млрд, и эта сумма не входит в тот $1 трлн, который Nvidia рассчитывает выручить на поставках ускорителей Blackwell и Rubin в период с 2025 по 2027 годы. Основатель Nvidia Дженсен Хуанг (Jensen Huang) ожидает, что центральные процессоры Vera станут вторым по величине источником выручки после ускорителей Blackwell и Rubin. В текущем квартале Nvidia рассчитывает выручить до $91 млрд, и это в среднем выше консенсус-прогноза аналитиков, но в данные ожидания компания не закладывает каких-либо поступлений от реализации серверных решений на китайском рынке. Норма прибыли Nvidia в текущем квартале сохранится на уроне 75 %. Было бы неверно утверждать, что операционные расходы компании не увеличиваются — в минувшем квартале они возросли на 52 %, но операционная прибыль всё равно увеличилась на 147 % до $53,5 млрд, а чистая прибыль достигла $58,3 млрд по методике GAAP, взлетев более чем в три раза в годовом сравнении. По итогам текущего года Nvidia может выручить более $370 млрд, если верить некоторым прогнозам. Это будет в 22 раза больше, чем за шесть лет до этого. Micron запустила массовое производство памяти HBM4 для Nvidia Vera Rubin

17.03.2026 [10:41],

Алексей Разин

Поскольку на этой неделе Nvidia официально представила свою ИИ-платформу Vera Rubin, компания Micron Technology не нашла причин для дальнейшего сокрытия факта сотрудничества с ней в области поставок памяти типа HBM4. Было объявлено, что этот третий по счёту поставщик приступил к серийному производству микросхем HBM4 в 12-ярусном исполнении.

Источник изображения: Micron Technology В одном стеке HBM4 при такой компоновке содержится 36 Гбайт памяти, которая способна передавать информацию со скоростью более 1 Гбит/с на контакт, обеспечивая совокупную пропускную способность на уровне 2,8 Тбайт/с. По сравнению с HBM3E той же марки, это соответствует росту пропускной способности в 2,3 раза и улучшению энергетической эффективности более чем на 20 %, как отмечает Tom’s Hardware. Micron Technology также отправила своим клиентам образцы 16-ярусных чипов HBM4 объёмом 48 Гбайт. По сравнению с 12-ярусным стеком, они обеспечивают увеличение удельной ёмкости на 33 %. Одновременно Micron объявила о начале массового производства твердотельных накопителей семейства 9650, обеспечивающих поддержку новейшего интерфейса PCI Express 6.0. Данные накопители обеспечивают скорость последовательного чтения до 28 Гбайт/с и 5,5 млн операций ввода-вывода в секунду на операциях произвольного чтения. По сравнению с накопителями, оснащаемыми интерфейсом PCI Express 5.0, это обеспечивает вдвое более высокое быстродействие на операциях чтения, энергоэффективность также увеличивается в два раза. Данные накопители оптимизированы для использования в составе стоек BlueField-4 STX, относящихся к платформе Vera Rubin. Кроме того, Micron представила модули памяти типа SOCAMM2 объёмом 192 Гбайт, также оптимизированные для решений Nvidia семейства Vera Rubin, включая стойки NVL72 и обособленные платформы на основе центральных процессоров Vera. Эти модули памяти будут предлагаться в диапазоне ёмкостей от 48 до 256 Гбайт. Платформа Vera Rubin поддерживает до 2 Тбайт оперативной памяти, а пропускная способность на один процессор достигает 1,2 Тбайт/с при использовании данной памяти. Все три новинки Micron уже производятся серийно и могут поставляться для нужд Nvidia и её партнёров, выпускающих решения семейства Vera Rubin. Nvidia показала полный стек Vera Rubin — от GPU до сетей для ИИ-фабрик нового поколения

17.03.2026 [10:01],

Алексей Разин

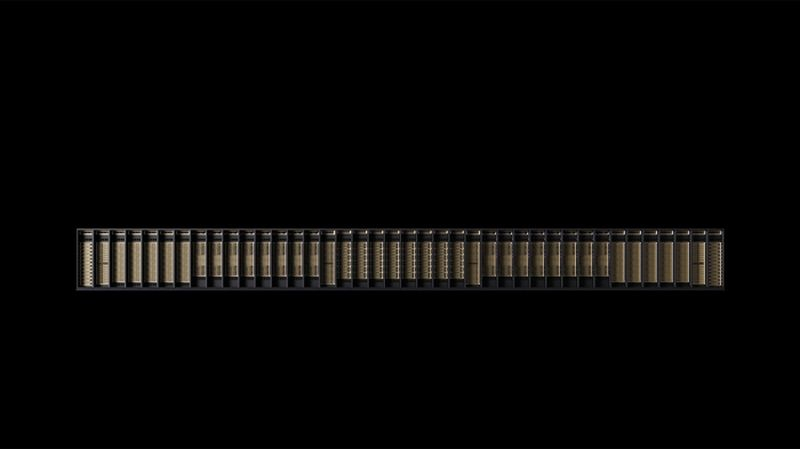

Являясь одним из лидеров в сфере вычислительной инфраструктуры для систем искусственного интеллекта, Nvidia комплексно подходит к развитию собственных платформ, а потому вместе с ускорителями поколения Vera Rubin предложила ряд сопутствующих аппаратных решений.

Источник изображений: Nvidia Как отмечается в корпоративном пресс-релизе, платформа Vera Rubin открывает новые рубежи в развитии агентского искусственного интеллекта. В массовом производстве сейчас находятся семь новых чипов Nvidia, позволяющих эффективно масштабировать так называемые ИИ-фабрики. В число семи аппаратных новинок Nvidia вошли графические процессоры Rubin, центральные процессоры Vera, коммутаторы NVLink 6, сетевые решения ConnectX-9 SuperNIC, специализированные процессоры BlueField-4 и Ethernet-коммутаторы Spectrum-6, а также созданные с помощью разработок одноимённого поглощённого стартапа процессоры Groq для ускорения инференса при работе с ИИ-агентами. В совокупности они работают, как ИИ-суперкомпьютер, как отмечается в материалах Nvidia для прессы на официальном сайте компании, позволяя ускорять создание профильных технологий на всех этапах жизненного цикла ИИ-систем. Основатель и глава Nvidia Дженсен Хуанг (Jensen Huang) заявил, что с выходом платформы Vera Rubin наступил переломный момент в развитии агентского ИИ, поскольку данная платформа будет способствовать самому масштабному развёртыванию инфраструктуры в истории. Руководители OpenAI и Anthropic прокомментировали анонс Vera Rubin в предсказуемо хвалебных выражениях, подчёркивая значение этого события для всей ИИ-отрасли. Разработчики ИИ-моделей теперь смогут совершенствовать их и делать это быстрее, чем на аппаратных решениях прошлого поколения. Структура ЦОД теперь строится на готовых модулях, как считают в Nvidia, которые содержат всё необходимое для эффективного масштабирования вычислительных мощностей с учётом постоянного роста сложности решаемых задач. Клиенты могут сочетать готовые модули ЦОД с учётом специфики своей деятельности. Например, в одной стойке Vera Rubin NVL72 находятся 72 графических процессора Rubin и 36 центральных процессоров Vera, соединённых скоростной шиной NVLink 6 и сетевыми контроллерами ConnectX-9 SuperNIC, а также специализированные процессоры BlueField-4, которые разгружают центральные процессоры от задач работы с сетевым трафиком. По сравнению с решениями поколения Blackwell новые системы Vera Rubin справляются с обучением сложных моделей силами в четыре раза меньшего количества GPU. Пропускная способность в пересчёте на ватт потребляемой энергии в задачах инференса у Vera Rubin до десяти раз выше, а затраты на один токен в десять раз ниже. В кластерах стойки NVL72 масштабируются при помощи Quantum-X800 InfiniBand и Spectrum-X Ethernet. Центральные процессоры Vera, по словам представителей Nvidia, хорошо себя проявляют в задачах обучения с подкреплением и агентских ИИ-нагрузках. Компания может объединять в одной стойке до 256 таких процессоров, оснащённых системой жидкостного охлаждения. С прочими компонентами кластера они могут сообщаться при помощи сетевых решений Spectrum-X. По сравнению с некими традиционными CPU, на которые ссылается Nvidia, её процессоры Vera могут справляться с ИИ-задачами на 50 % быстрее.  Специализированные чипы Groq 3 LPX обеспечивают эффективную работу с агентскими ИИ-нагрузками при минимальных задержках. В сочетании с другими чипами, входящими в состав платформы Vera Rubin, они обеспечивают увеличение пропускной способности в задачах инференса до 35 раз на один мегаватт потребляемой мощности, а потенциал выручки при использовании моделей с триллионом параметров увеличивается в десять раз. В состав одной стойки входит 256 чипов LPU, 128 Гбайт интегрированной на них памяти SRAM, а пропускная способность достигает 640 Тбайт/с. В сочетании с прочими компонентами платформы Vera Rubin, чипы LPU достигают максимальной эффективности как по быстродействию, так и по энергопотреблению, а также использованию ресурсов памяти. Стойки LPX будут доступны клиентам Nvidia со второй половины текущего года. Стойка BlueField-4 STX специализируется на унификации адресного пространства GPU между элементами кластера. Обработка хранимой в кеше информации в операциях инференса ускоряется до пяти раз, при этом обеспечивается высокая энергоэффективность по сравнению с системами на классической архитектуре. Достигается общий для кластера контекст, обеспечивающий быстрое взаимодействие с ИИ-агентами и более эффективно масштабируемыми ИИ-сервисами. Отдельная стойка Spectrum-6 SPX отвечает за скоростной обмен данными по интерфейсу Ethernet. Она может содержать не только коммутаторы Spectrum-X Ethernet, но и коммутаторы Nvidia Quantum-X800 InfiniBand в зависимости от потребностей конкретной конфигурации. В исполнении с кремниевой фотоникой и интеграцией на уровне упаковки чипов эффективность передачи информации возрастает в пять раз, а надёжность по сравнению с традиционными подключаемыми решениями увеличивается в десять раз. «Космические вычисления уже здесь»: Nvidia представила модуль Space-1 Vera Rubin для орбитальных ИИ-серверов

17.03.2026 [00:33],

Николай Хижняк

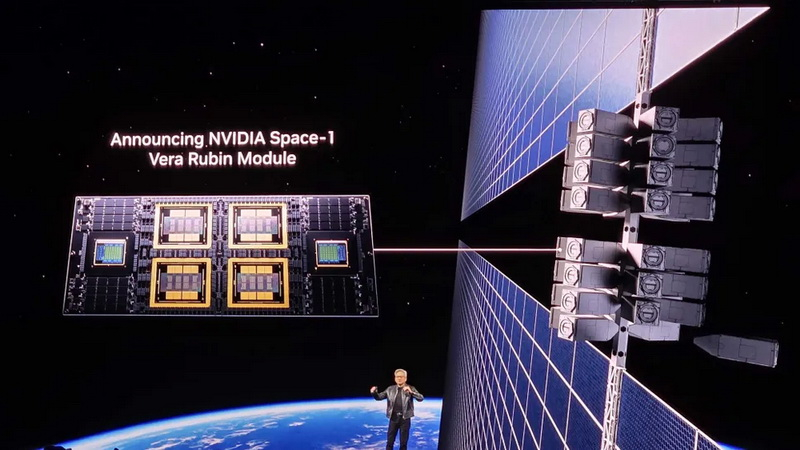

Генеральный директор Nvidia Дженсен Хуанг (Jensen Huang) анонсировал на конференции GTC 2026 космический модуль Nvidia Space-1 Vera Rubin Module. По словам Хуанга, модуль обеспечивает до 25 раз большую вычислительную мощность для задач искусственного интеллекта, чем сервер с ускорителями H100.

Источник изображения: Nvidia По словам Nvidia, в настоящее время шесть коммерческих космических компаний используют её платформы в орбитальной и наземной средах: Aetherflux, Axiom Space, Kepler Communications, Planet Labs PBC, Sophia Space и Starcloud. При этом Kepler использует в своей спутниковой группировке платформу Jetson Orin для управления данными с помощью ИИ. «Nvidia Jetson Orin внедряет передовые технологии ИИ непосредственно на наши спутники, позволяя нам интеллектуально управлять данными и маршрутизировать их по всей нашей группировке», — заявила Мина Митри (Mina Mitry), генеральный директор компании, в официальном пресс-релизе Nvidia. В октябре прошлого года основатель Amazon и Blue Origin Джефф Безос (Jeff Bezos) предсказал, что орбитальные центры обработки данных гигаваттного уровня появятся через 10–20 лет. В качестве основных преимуществ таких платформ он назвал непрерывное солнечное электроснабжение и упрощённую систему охлаждения в космосе. Starcloud, один из шести партнёров Nvidia, уже строит, как он сам описывает, специально разработанные орбитальные центры обработки данных, предназначенные для выполнения задач обучения моделей ИИ и вывода данных на орбите. «Космические вычисления, последний рубеж, уже здесь», — сказал Дженсен Хуанг, добавив, что «обработка данных с помощью ИИ в космических и наземных системах обеспечивает сбор данных в реальном времени, принятие решений и автономность, превращая орбитальные центры обработки данных в инструменты исследований, а космические аппараты — в системы с автономным управлением». Глава Nvidia не сказал, когда космический модуль Vera Rubin станет доступен для развёртывания. Компания уже предлагает в качестве космических платформ IGX Thor, Jetson Orin и RTX Pro 6000 Blackwell Server Edition. Meta✴ закупит миллионы ИИ-чипов у Nvidia, включая центральные Arm-процессоры Grace и Vera

18.02.2026 [04:51],

Алексей Разин

Компания Meta✴✴ Platforms готова расширить свою вычислительную инфраструктуру ИИ путём закупки дополнительных объёмов компонентов Nvidia, которые будут включать как GPU нового поколения, так и целые стойки семейства Vera Rubin, равно как и центральные процессоры Nvidia Grace.

Источник изображения: Nvidia Как поясняет CNBC, исторически Meta✴✴ в развитии своей ИИ-инфраструктуры отличалась всеядностью, закупая ускорители AMD и процессоры Google, а также разрабатывая собственные. Помимо вычислительных решений Nvidia, на новом этапе расширения своей облачной инфраструктуры Meta✴✴ готова использовать и сетевые решения этой марки. Кроме того, чипы Nvidia помогут ей реализовать ИИ-функции в мессенджере WhatsApp. Новая сделка между компаниями подразумевает закупку миллионов чипов Nvidia для нужд Meta✴✴ Platforms. На каких условиях это будет сделано, не уточняется. В январе Meta✴✴ объявила о намерениях потратить до $135 млрд на развитие ИИ в текущем году. По мнению аналитиков Creative Strategies, в случае с новой сделкой речь идёт о десятках миллиардов долларов США. Новость об этой сделке вызвала рост курса акций Nvidia и Meta✴✴, а вот акции AMD упали в цене на 4 %. Компоненты Nvidia компания Meta✴✴ уже использует в своей инфраструктуре не менее десяти лет, но никогда ранее она не приобретала у неё центральные процессоры в отдельности от специализированных модулей, где те обычно соседствуют с GPU. Представители Nvidia подтвердили, что Meta✴✴ станет первым клиентом, приступившим к масштабному использованию центральных процессоров Grace. Эти чипы больше заточены под агентские ИИ-нагрузки и работу с инференсом. В 2027 году Meta✴✴ планирует перейти на использование нового поколения процессоров Vera разработки Nvidia. В общей сложности до 2028 года Meta✴✴ планирует направить на развитие вычислительных мощностей в США около $600 млрд. Из 30 центров обработки данных, запланированных Meta✴✴ к строительству в ближайшие годы, 26 будут расположены на территории США. Крупнейшими станут гигаваттный Prometheus в Огайо и 5-ГВт Hyperion в Луизиане. Коммутаторы Spectrum-X производства Nvidia также будут применяться Meta✴✴ в своей инфраструктуре, а ещё последняя внедрит технологии безопасности первой для развития функций ИИ в WhatsApp. Nvidia построит в США семь эксафлопсных суперкомпьютеров — два на Vera Rubin для Лос-Аламосской лаборатории

28.10.2025 [23:30],

Николай Хижняк

На конференции GTC 2025 компания Nvidia объявила о том, что построит в США семь эксафлопсных суперкомпьютеров в США. Две системы будут построены совместно с Oracle и будут использовать более 100 000 чипов Blackwell с производительностью до 2200 Эфлопс. Ещё две системы будут созданы совместно с HPE на перспективной платформе Vera Rubin для Лос-Аламосской национальной лаборатории.

Источник изображения: Nvidia Эти системы будут использоваться для обеспечения национальной безопасности и проведения научных исследований с применением ИИ-моделирования и высокопроизводительных вычислений. Что интересно, заявление Nvidia последовало за вчерашним объявлением AMD о победе в тендерах на поставку пары суперкомпьютеров для Министерства энергетики США. Лос-Аламосская национальная лаборатория заключила контракт с HPE на создание суперкомпьютеров Mission и Vision на базе платформы Vera Rubin от Nvidia, которая включает центральные процессоры Vera и графические процессоры Rubin нового поколения. Масштабирование машин будет осуществляться с помощью технологии NVLink Gen6, а горизонтальное — посредством сетевого интерфейса Nvidia QuantumX 800 Infiniband. Суперкомпьютер Mission, разработанный для Национального управления по ядерной безопасности, планируется ввести в эксплуатацию в 2027 году. Компьютер Vision будет опираться на достижения предыдущего суперкомпьютера Venado и использоваться для открытых научных исследований, включая исследования в области искусственного интеллекта. «Mission — пятая передовая технологическая система в рамках программы Лос-Аламоса по развитию искусственного интеллекта для научной безопасности. Ожидается, что она будет введена в эксплуатацию в 2027 году и предназначена для запуска секретных приложений. Система Vision основана на достижениях суперкомпьютера Venado из LANL и предназначена для несекретных исследований в области искусственного интеллекта и открытой науки. Системы Mission и Vision представляют собой значительные инвестиции в национальную безопасность США и развитие открытых научных возможностей», — заявил Дион Харрис (Dion Harris), руководитель отдела маркетинга продуктов центров обработки данных Nvidia. Nvidia не раскрыла ожидаемую производительность Mission и Vision. Однако Vision примет эстафету у Venado — 19-го по скорости суперкомпьютера в мире с производительностью Rmax FP64 98,51 Пфлопс. Поэтому вполне логично ожидать, что Vision обеспечит как минимум вдвое большую вычислительную мощность для научных задач. «Мы предоставим более подробную информацию о конкретных конфигурациях [суперкомпьютеров] позже. Самое замечательное в этой [платформе], учитывая, как эти системы будут использоваться как в открытой науке, так и в исследованиях в области национальной безопасности, заключается в том, что, по нашему мнению, она позволит использовать как возможности ИИ, так и традиционные возможности моделирования для научных исследований», — добавил Харрис. Хуанг показал Vera Rubin Superchip — CPU, два огромных GPU и 100 Пфлопс на одной плате для ИИ нового поколения

28.10.2025 [22:26],

Андрей Созинов

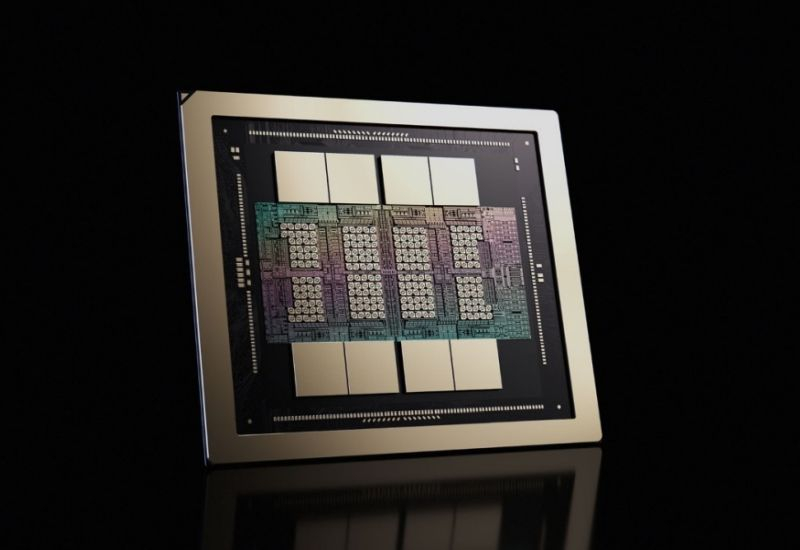

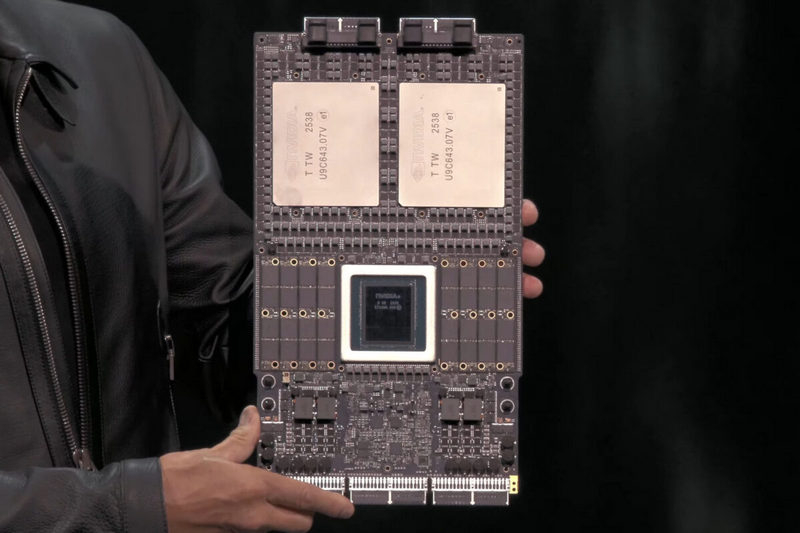

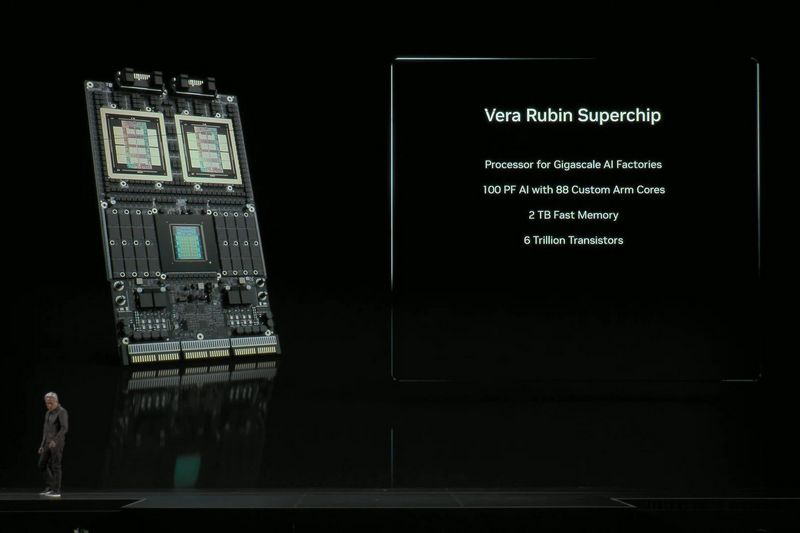

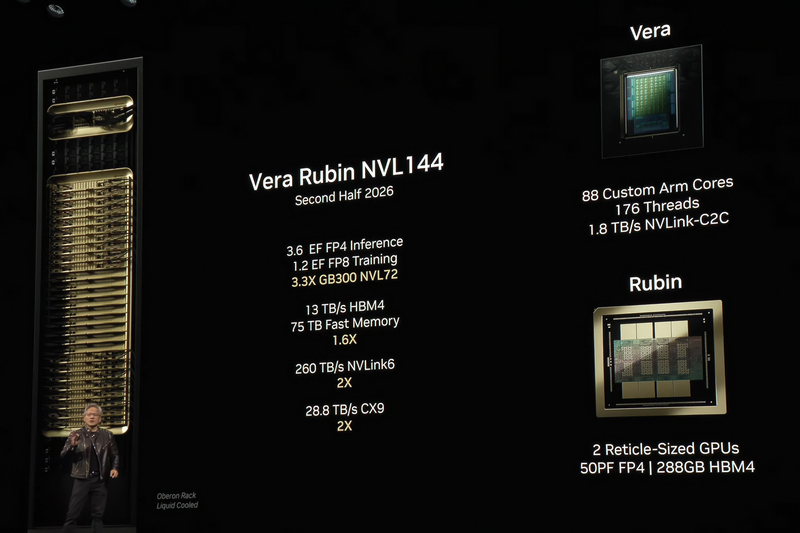

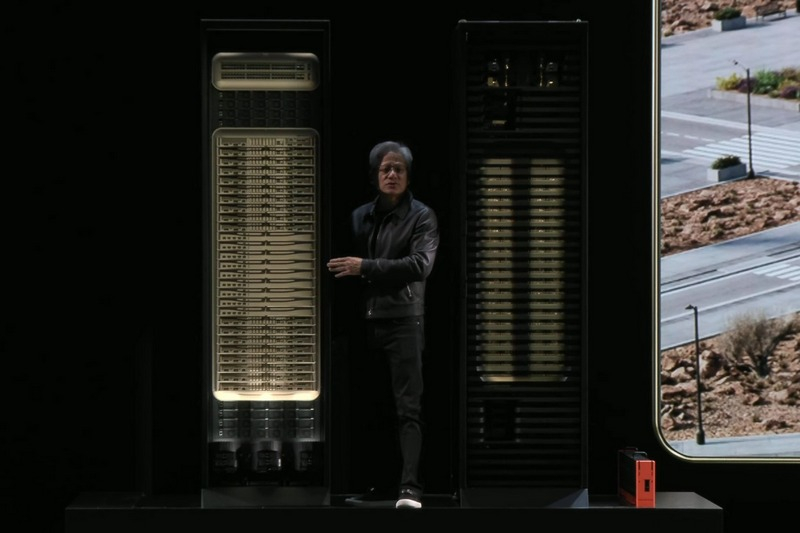

На конференции GTC 2025 глава компании Nvidia Дженсен Хуанг (Jensen Huang) продемонстрировал графический процессор следующего поколения — Rubin. Точнее, он показал со сцены прототип ускорителя Vera Rubin Superchip, который объединяет на одной плате совершенно новый центральный процессор Vera и пару огромных графических чипов Rubin. Такое сочетание обещает новый уровень производительности для ИИ-суперкомпьютеров будущего.

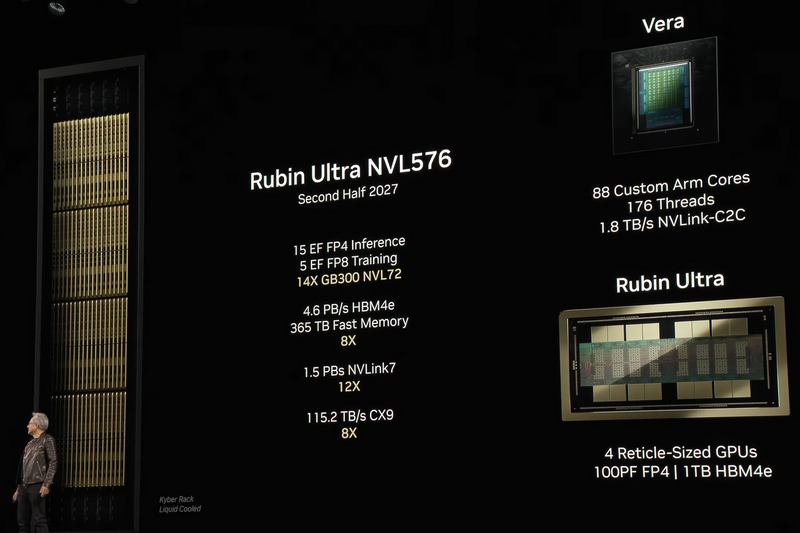

Источник изображений: Nvidia Каждый GPU Rubin состоит из двух больших кристаллов с ядрами CUDA и восьми стеков высокоскоростной памяти HBM4 объёмом 288 Гбайт. Характеристики GPU не уточняются, равно как и пропускная способность памяти. Однако отмечается, что одна система Vera Rubin Superchip обеспечивает производительность в ИИ-операциях (FP4) на уровне 100 Пфлопс (100 квадриллионов операций в секунду).  Что касается центрального процессора Vera, то известно, что он предложит 88 ядер на неназванной версии архитектуры Arm с 176 потоками, а для его связи с графическими процессорами будет задействован интерфейс NVLink-C2C с пропускной способностью 1,8 Тбайт/с. Также на плате расположится оперативная память LPDDR (версия не уточняется, но вполне возможно, что это будет уже LPDDR6), в результате чего общий объём оперативной памяти на один «суперчип» достигнет 2 Тбайт.  На базе новых ускорителей Nvidia предложит самые разные системы, например новые Compute Tray, включая CPX-версию для задач с большим контекстом ИИ-моделей. Также компания рассказала о готовых серверных стойках Vera Rubin NVL144 с производительностью 3,6 Эфлопс (3,6 квинтильона операций в секунду) для запуска уже обученных ИИ-моделей (FP4 inference), а также 1,2 Эфлопс для обучения моделей (FP8 training).  Это примерно в 3,3 раза быстрее актуальных систем GB300 NVL72. Система предложит 13 Тбайт/c общей пропускной способности для памяти HBM4 и в совокупности 75 Тбайт быстрой системной памяти, а общая пропускная способность интерфейсов NVLink и CX9 достигнет 260 Тбайт/с и 28,8 Тбайт/с соответственно.   Nvidia также раскрыла детали о системе NVL576 на базе чипов Rubin Ultra, которые ожидаются во второй половине 2027 года. Эти чипы будут включать четыре крупных GPU-чиплета на одной подложке и 1 Тбайт памяти HBM4e. В итоге система NVL576 обеспечит производительность до 15 Эфлопс FP4 и 5 Эфлопс FP8, предлагая до 365 Тбайт быстрой системной памяти и сетевую пропускную способность до 1,5 Пбайт/с через NVLink. Nvidia сообщила, что первые тестовые экземпляры Rubin уже поступили в лаборатории компании для испытаний, а старт массового производства запланирован на 2026 год. На смену этой архитектуре придёт совершенно новая архитектура Feynman, запуск которой намечен на 2027–2028 годы. Однако никаких чипов на этой платформе Nvidia пока не показала — вряд ли на данный момент они вообще существуют в физическом воплощении. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |