Компания Midjourney закрыла бесплатный доступ к своей одноимённой нейросети, которая позволяет генерировать изображения по текстовому описанию. Произошло это после того, как пользователи стали активно использовать нейросеть для создания дипфейков с участием знаменитых личностей.

Источник изображения: Midjourney

Основатель и исполнительный директор Midjourney Дэвид Хольц (David Holz) в официальном канале Discord сообщил, что компания закрывает программу бесплатного пробного периода «из-за чрезвычайного спроса, а также из-за злоупотреблений в его использовании со стороны пользователей». По словам Хольца, новые правила безопасности использования нейросети Midjourney оказались «недостаточными» для предотвращения случаев неправильного использования ИИ-генератора изображений во время пробного периода. Отныне пользователи Midjourney должны будут платить по $10 в месяц за возможность пользоваться технологией.

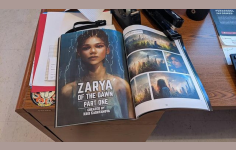

Как пишет издание The Washington Post, Midjourney в последнее время оказалась в центре нежелательного внимания. Пользователи, используя указанную нейросеть, начали создавать фейковые изображения с арестом бывшего президента США Дональда Трампа, а также изображения Папы римского Франциска, разгуливающего в модном пуховике. Хотя указанные изображения быстро разоблачили как фейки, злоумышленники могут использовать генеративные нейросети вроде Midjourney, DALL-E от OpenAI и аналогичные для распространения дезинформации в Сети.

Midjourney признала, что правила использования ИИ-алгоритмов для создания изображений требуют доработок. В 2022 году Хольц запретил использовать Midjourney для создания дипфейков с китайским лидером Си Цзиньпинем. Он объяснил это тем, что доступ на китайский рынок для компании важнее возможности для пользователей создавать сатирический контент. В этот четверг Хольц в разговоре с пользователями в Discord посетовал, что формирование политики в отношении создания ИИ-контента с помощью Midjourney ещё сильнее усложнилось тем фактом, что ИИ теперь способен создавать ещё более реалистичные изображения. Несмотря на это, компания продолжит совершенствовать модерацию ИИ-контента и выявлять случаи злоупотребления в его создании, добавил он.

Некоторые разработчики нейросетей для генерации изображений уже ввели более строгие правила, связанные с их использованием. Например, OpenAI запретила создавать любые изображения, которые каким-либо образом были бы связаны с текущими политическими событиями, политиками и теориями заговоров. Она также запретила контент, связанный с ненавистью, насилием и сексом. Впрочем, другие пока придерживаются более свободных правил. Stability AI не позволяет нейросети Stable Diffusion копировать стили или создавать так называемые «не безопасные для работы» изображения. Однако в целом компания не диктует пользователям, какие изображения можно или нельзя создавать.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018

Подписаться

Подписаться