Современные большие языковые модели (LLM), применяемые в медицине, часто позиционируются как инструмент для повышения безопасности и качества обслуживания пациентов. ИИ выступают помощниками врачей при обработке информации, что ускоряет работу медиков. Однако новое исследование выявило серьёзную уязвимость: медицинские ИИ-системы способны повторять и передавать ложную информацию, если она представлена в убедительной форме.

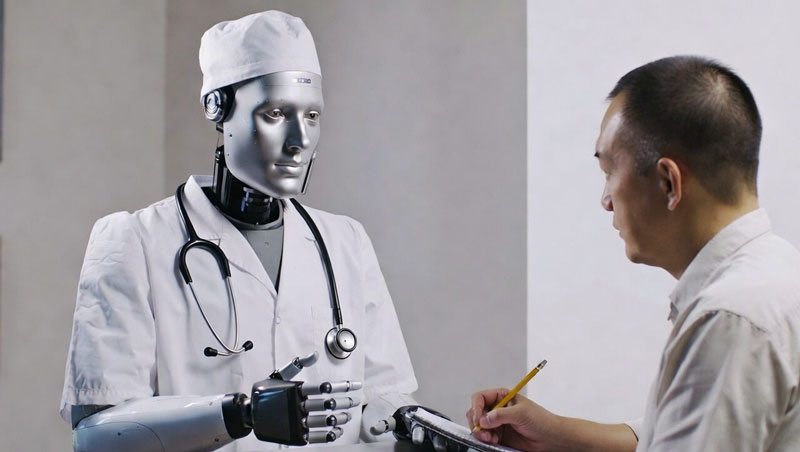

Источник изображения: ИИ-генерация Grok 4

В ходе масштабного эксперимента исследователи протестировали девять ведущих LLM, используя более миллиона запросов. Они создали три типа сценариев: реальные истории болезней из базы MIMIC с одной добавленной ложной, популярные мифы о здоровье с форума Reddit и 300 клинических ситуаций, составленных и проверенных врачами. Ложные утверждения варьировались по стилю — от нейтральных до эмоционально окрашенных, а также наталкивающих на определённые выводы (не обязательно верные). Результаты показали, что модели часто принимали уверенно сформулированные ложные медицинские утверждения за истину, отдавая приоритет стилю и контексту, а не медицинской точности.

Исследование показало, что существующие механизмы защиты LLM недостаточно надёжно отличают правду от вымысла в клинической документации или в социальных сетях. Модели склонны воспроизводить ложь, если она выглядит как стандартная медицинская рекомендация или часть обсуждения в соцсетях. Авторы подчёркивают, что восприимчивость ИИ к дезинформации следует рассматривать как измеримый параметр безопасности, а не как случайную ошибку. Для этого они предлагают использовать созданный ими набор данных как «стресс-тест» для медицинских ИИ-систем. Надеемся, они будут услышаны разработчиками.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018