Разработчики ядра Linux официально утвердили политику использования искусственного интеллекта (ИИ) после месяцев острых дебатов. Линус Торвальдс (Linus Torvalds) и отраслевые партнёры пришли к соглашению, которое разрешает применение ИИ-ассистентов, но вводит строгие правила раскрытия информации и возлагает полную ответственность за любые ошибки на разработчиков-людей.

Источник изображения: xAI

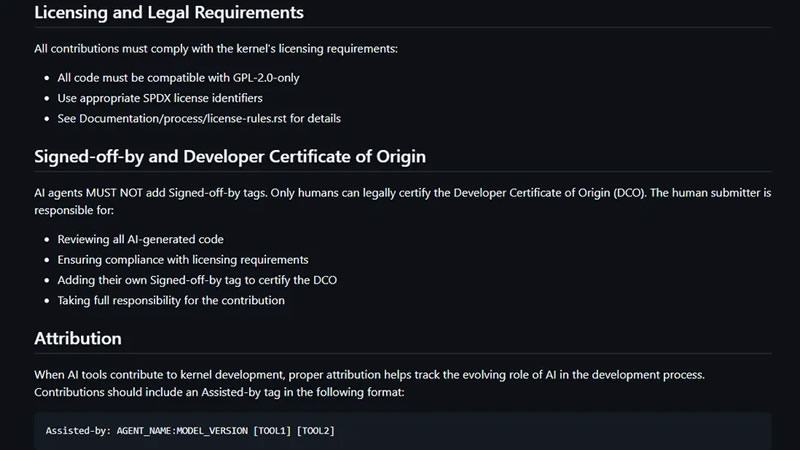

Новые правила запрещают использование юридически обязывающего тега «Signed-off-by» для кода, созданного ИИ-системами, заменяя его на новый тег «Assisted-by» для обеспечения прозрачности происхождения правок. Такое решение, как указывает Tom's Hardware, стало ответом на растущее напряжение в сообществе, вызванное потоком низкокачественного кода и скрытым использованием нейросетей. Теперь каждый баг или уязвимость в таком коде будет юридически закреплены за конкретным человеком, опубликовавшим изменения. Это исключит возможность перекладывания вины на алгоритмы и позволит интегрировать современные инструменты в рабочий процесс, не нарушая при этом принципы сертификации Developer Certificate of Origin (DCO).

Источник изображения: tomshardware.com

Споры вокруг интеграции ИИ достигли пика в январе, когда представители Intel и Oracle публично вошли в конфликт по вопросам регулирования нейросетей в проекте. При этом Торвальдс резко раскритиковал идеи их полного запрета, назвав это бесполезным, и настаивал на том, что ИИ является всего лишь инструментом, как и любой другой софт. Он подчеркнул, что злоумышленники всё равно не будут читать документацию, поэтому эффективнее контролировать результат через ответственность конкретных людей, а не пытаться запретить технологии на локальных машинах разработчиков.

До принятия единой политики крупные проекты открытого ПО демонстрировали разный подход к проблеме, вплоть до полных запретов. Например, дистрибутивы Gentoo и NetBSD ранее заблокировали приём сгенерированного ИИ кода, аргументируя это тем, что данные для обучения моделей часто содержат код с ограничительными лицензиями, что делает результат юридически неправомерным. Специалисты из Red Hat, в свою очередь, предупреждали, что использование таких инструментов может непреднамеренно нарушать лицензии GNU GPL и подрывать всю систему DCO, так как разработчик не может гарантировать чистоту происхождения каждой строки кода.

Помимо юридических рисков, сообщество столкнулось с проблемой огромного объёма низкокачественных правок, получивших название AI slop. Создатели популярных проектов, таких как cURL и tldraw, были вынуждены закрывать программы вознаграждений или автоматически отклонять внешние запросы из-за спама, содержащего код с ИИ-галлюцинациями. В случае с ядром Linux ситуация усугубилась громким инцидентом с мейнтейнером Сашей Левиным (Sasha Levin), инженером Nvidia, который внедрил патч для ядра 6.15, полностью написанный ИИ-моделью без соответствующего уведомления. Код был функциональным, однако содержал регрессию производительности, несмотря на то, что был проверен и протестирован.

Проблема недоверия из-за скрытого использования ИИ затронула не только системное программирование, но и другие сферы, например, сообщество моддеров Doom. В частности, лидер проекта GZDoom Кристоф Элькерс (Christoph Oelckers) столкнулся с массовым исходом участников проекта после того, как использовал ИИ-патчи без раскрытия этой информации и отказался идти на компромисс с критиками. В результате большинство контрибьюторов покинуло оригинальный проект и создало форк UZDoom, продемонстрировав важность открытости и честности перед сообществом.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018