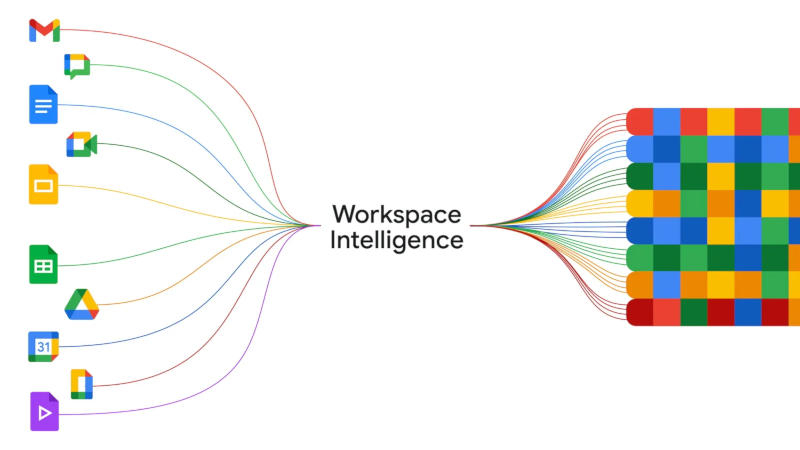

Google анонсировала единый сервис на основе искусственного интеллекта Workspace Intelligence, предлагающий полную интеграцию в пакет рабочих приложений; а также восьмое поколение TPU — ускорителей искусственного интеллекта, которые теперь представлены моделями для обучения и инференса ИИ.

Источник изображений: Google

Система Workspace Intelligence призвана анализировать «сложные семантические связи» между данными, представленными в Gmail, «Google Документах» и других приложениях семейства Workspace, учитывая соавторов активных проектов и прочей специфичной для компании информации. Сервис занимается сбором данных самостоятельно, устраняя контекстные барьеры, чтобы предоставить пользователю всё необходимое в тот момент, когда он намерен предпринять какое-либо действие.

Используя систему логического мышления Gemini, служба Workspace Intelligence знает, что необходимо пользователю в текущий момент. Учитывая прошлые рабочие и коммуникационные модели, она изучает уникальный стиль работы каждого пользователя, его голос и предпочтения в форматировании данных, подстраивая генерируемый контент под манеру пользователя. В качестве источников данных выступают заметки совещаний, электронные письма и сохранённые файлы. Поддерживается подключение внешних сервисов, в том числе Asana, Jira и Salesforce.

На основе службы обеспечивается работа функций AI Inbox и AI Overviews в Gmail, а также нового сервиса Ask Gemini в Google Chat: пользователю достаточно сформулировать рабочую цель, Gemini выполнит задачу в фоновом режиме и предоставит результат в интерфейсе чата. В «Google Документах» Workspace Intelligence может создать инфографику, опираясь на данные о бизнесе пользователя, подготовить несколько изображений в едином стиле и отредактировать документ на основе оставленных комментариев. В «Google Презентациях» служба проводит контекстный анализ и представляет слайды в соответствии с фирменным стилем компании; «Google Таблицах» она заполняет данные, получив их в диалоговом интерфейсе.

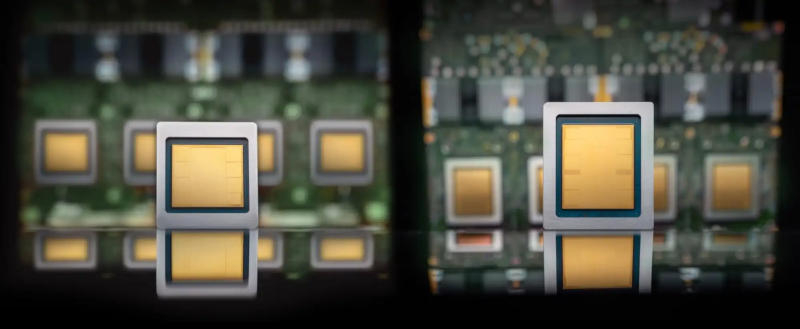

TPU 8t (слева) и TPU 8i (справа)

Google также анонсировала восьмое поколение ИИ-ускорителей TPU (Tensor Processing Units) — они теперь разделяются на архитектуры для обучения и развёртывания моделей ИИ. Предназначенные для обучения TPU 8t обеспечивают в 2,8 раза улучшенное соотношение цены и производительности по сравнению с ускорителями предыдущего поколения. В одном суберблоке теперь могут быть до 9600 чипов и 2 Пбайт общей высокоскоростной памяти с удвоенной по сравнению с предыдущим поколением пропускной способностью между чипами. Технология TPUDirect позволяет десятикратно ускорить обмена данными, предлагая прямое соединение TPU с накопителями. В одном логическом кластере можно установить до 1 млн чипов за счёт сетевой архитектуры Virgo Network, библиотеки JAX и координирующего приложения Pathways.

Для инференса, то есть развёртывания уже обученных ИИ-моделей, предназначается чип TPU 8i, который предлагает улучшенную на величину до 80 % производительность на доллар по сравнению с ускорителями предыдущего поколения. Он позволяет при тех же затратах обслуживать вдвое больший объём клиентов. TPU 8i располагает 288 Гбайт высокоскоростной памяти и 384 встроенной SRAM — втрое больше, чем у предыдущего поколения. Google удвоила количество физических хостов центрального процессора, перейдя на собственные Arm-чипы Axion; и использовала архитектуру неоднородной памяти NUMA. Компания оптимизировала ускорители для моделей класса Mixture of Experts (MoE), удвоив пропускную способность межсоединений до 19,2 Тбит/с. Новая архитектура Boardfly помогла снизить максимальный диаметр сети более чем на 50 %. А блок Collectives Acceleration Engine (CAE) помог разгрузить основной ускоритель, сократив задержку на кристалле на величину до пяти раз.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018