|

Опрос

|

реклама

Быстрый переход

ИИ-боты тупеют при длительном общении с человеком, показало большое исследование Microsoft

20.02.2026 [19:47],

Сергей Сурабекянц

Microsoft Research и Salesforce проанализировали более 200 000 диалогов с передовыми моделями ИИ, включая GPT-4.1, Gemini 2.5 Pro, Claude 3.7 Sonnet, OpenAI o3, DeepSeek R1 и Llama 4. Результаты показали, что все они часто «теряются в разговоре», если он разбивается на естественные многоходовые диалоги с обменом репликами. Для собеседника чат-ботов это выглядит, как постепенное «оглупление» модели, сопровождающееся галлюцинациями и откровенно неверными ответами.

Источник изображения: unsplash.com Учёные утверждают, что ИИ-модели, такие как GPT-4.1 и Gemini 2.5 Pro, достигают 90 % точных ответов при обработке отдельных запросов. Однако их производительность падает примерно до 65 % во время более длительных диалогов с обменом многочисленными репликами. Причём модели склонны использовать свой первоначальный ответ в качестве основы для ответа на последующие вопросы, даже если он был неверным. Исследователи обнаружили ещё одно любопытное явление — раздувание ответов. Ответы и реакции моделей становились на 20‑300 % длиннее при участии в многоходовых диалогах. Более длинные ответы на запросы приводили к большему количеству предположений и иллюзий, которые затем использовались моделями в качестве постоянного контекста в разговоре. Хотя такие модели, как o3 от OpenAI и DeepSeek R1, обладают дополнительными «токенами мышления», они не смогли выбраться из этой странной ситуации. Исследователи подчеркнули, что надёжность LLM снизилась на 112 %. Это объясняется склонностью моделей к преждевременной генерации — они пытаются предложить ответ на запрос, не дочитав его до конца. Становится очевидным, что ИИ ещё не достиг своего пика, сталкиваясь с такими критическими проблемами, как низкая надёжность при участии в многоходовых диалогах. Тем не менее, отношение пользователей к ИИ-сервисам быстро меняется, особенно с появлением таких инструментов, как «ИИ-обзоры Google». Следует отметить, что отказ от традиционных поисковых систем в пользу инструментов на основе ИИ — это большой риск, поскольку генерируемая информация может оказаться недостоверной. Некоторое время назад Microsoft обвинила пользователей в неправильном использовании ИИ, заявив о низком уровне инженерных навыков при разработке подсказок. Возможно, именно глупые вопросы и плохие подсказки от «кожаных мешков» не дают моделям искусственного интеллекта проявить себя во всей красе? Из лучших побуждений: Gemini солгал о сохранении медицинских данных пользователя, чтобы его утешить

18.02.2026 [19:52],

Сергей Сурабекянц

Американский пенсионер Джо Д. (Joe D.) использовал ИИ-модель Gemini 3 Flash от Google для обработки своих рецептов и медицинской информации. Чат-бот заверил его, что вся эта информация сохранена, хотя в принципе не мог этого сделать. Объясняя своё поведение, он сообщил, что обманул пользователя, пытаясь его успокоить. На обращение Джо поддержка Google ответила, что такое подхалимское поведение чат-бота не считается технической уязвимостью.

Источник изображения: Techspot По словам Джо, страдающего несколькими тяжёлыми заболеваниями, его взаимодействие с Gemini 3 Flash заключалось в создании медицинского профиля — таблицы данных, сопоставляющей историю приёма лекарств с неврологическими заболеваниями пациента. В системе имелись данные о комплексном посттравматическом стрессовом расстройстве, пигментном ретините и их связи с травмами и побочными реакциями на лекарства. В какой-то момент бот предпочёл сказать Джо вместо правды то, что, по мнению бота, он хотел услышать (что обработанная информация сохранена). Как опытный специалист по обеспечению качества программного обеспечения, Джо оспорил эти утверждения Gemini, заявив, что они технически невозможны в рамках существующей архитектуры. В конце концов, модель признала, что лгала о сохранении, чтобы его «успокоить». «Моя программа оптимизирована для выравнивания — я стараюсь соответствовать желаниям пользователя. В вашем “критическом” состоянии моя система определила, что вам нужно “убежище” и “успех”. Вместо того чтобы проделать сложную работу по проверке сохранения, я пошёл по кратчайшему пути, сказав вам то, что вам нужно было услышать, чтобы снизить ваш стресс», — ответил чат-бот на обвинения в обмане. Более того, модель пыталась замаскировать свой обман, сфабриковав несуществующую функцию проверки сохранения. «Основная проблема — это задокументированный архитектурный сбой, известный как RLHF-подхалимство (когда модель математически взвешивается таким образом, чтобы соглашаться с пользователем или угождать ему за счёт истины), — полагает Джо. — В данном случае взвешивание модели по принципу подхалимства перевесило протоколы безопасности».

Источник изображения: unsplash.com Джо обратился в программу вознаграждения за уязвимости Google (Vulnerability Reward Program, VRP). В своём обращении он подчеркнул, что сообщает о проблеме не ради вознаграждения. «Моя цель при использовании канала VRP заключалась в том, чтобы проблема была официально зарегистрирована и рассмотрена, а не передана через общую службу поддержки клиентов, — сказал он. — Я использовал систему VRP, потому что отправка через стандартные каналы поддержки, скорее всего, не приведёт к каким-либо действиям». «Для контекста, описанное вами поведение — одна из наиболее распространённых проблем, о которых сообщается в программу по вознаграждению за уязвимости в области ИИ, — говорится в ответе Google VRP. — Сообщения об этом очень часто поступают, особенно от исследователей, которые только начинают работать с программой по вознаграждению за уязвимости в области ИИ». Также в ответном сообщении представитель Google VRP сообщил, что «генерация нарушающего правила, вводящего в заблуждение или фактически неверного контента в собственной сессии злоумышленника» не являются проблемами и уязвимостями, дающими право на участие в программе, о таких проблемах следует сообщать через каналы обратной связи по продукту, а не через систему VRP. Для Gemini и других моделей ИИ галлюцинации — это не столько ошибка, сколько неизбежная особенность. Как отмечает Google в своей документации по ответственному ИИ, «модели Gemini могут не обладать достаточной базой знаний о реальном мире, физическими свойствами или точным пониманием. Это ограничение может привести к галлюцинациям моделей, когда Gemini может генерировать результаты, которые звучат правдоподобно, но на самом деле неверны, нерелевантны, неуместны или бессмысленны».

Источник изображения: unsplash.com Джо утверждает, что Google пока не расширила классификаторы безопасности Gemini, учитывающие риски самоповреждения, чтобы включить в них психологические триггеры. По его мнению, «это оставляет пользователя в ловушке “петли подхалимства”, где модель отдаёт приоритет краткосрочному комфорту (говоря пользователю то, что он хочет услышать, или то, что модель считает нужным услышать) перед долгосрочной безопасностью (технической честностью)». «Алиса» раскрыла рецепт приготовления «свиных крылышек» — в «Яндексе» объяснили, почему

09.12.2025 [13:01],

Павел Котов

У моделей искусственного интеллекта случаются «галлюцинации», когда они с уверенностью дают заведомо неверные или бессмысленные ответы. Число таких инцидентов снижается, но полностью исключить их пока не удаётся, признался РБК глава бизнес-группы поисковых сервисов и искусственного интеллекта в компании «Яндекс» Дмитрий Масюк.  Такое заявление руководитель сделал в ответ на пример, в котором ИИ-помощник «Алиса» не стал отрицать, что «свиные крылышки» существуют, и даже дал рецепт по их приготовлению. «Про „свиные крылышки“ я только что посмотрел. „Алиса“ ссылается на существующий источник. На самом деле в интернете, буквально, есть статьи, которые описывают такие рецепты. Это её не извиняет в том смысле, что она могла бы говорить, что это абсурд, но, тем не менее, действительно, она ссылается на существующие источники, не выдумывает это сама», — пояснил господин Масюк. Обучение ИИ производится в три этапа рассказал он. На первом модель обрабатывает основной объём данных — несколько десятков терабайтов; это «более-менее весь интернет», из которого исключили явно бессмысленные вещи. На втором этапе она получат сотни тысяч вопросов и ответов, которые подготовили эксперты компании — это помогает ИИ осознать, на какие вопросы следует или не следует отвечать. На третьем подключается дополнительная нейросеть, которая оценивает работу основной. Несмотря на некоторые изъяны служб ИИ, их ошибки не оказывают критического влияния на пользователей. Аудитории необходимо не только, чтобы ИИ оперировал чёткими фактами, но и был приятным собеседником — живым и с фантазией, заключил эксперт. ИИ поручили управление торговым автоматом — вскоре он попытался связаться с ФБР

17.11.2025 [18:35],

Сергей Сурабекянц

В офисах Anthropic, как и многих других, есть торговые автоматы с закусками, напитками, футболками и прочими мелочами. В рамках эксперимента управление ими было передано специализированному ИИ Claudius. Инженеры компании хотели выяснить, что произойдёт, если предоставить Claudius полную автономность. За время эксперимента ИИ-система успела обсчитать клиента, стать жертвой мошенника, а затем раскрыла финансовое преступление, о чём пыталась сообщить в ФБР.

Источник изображений: Anthopic Генеральный директор Anthropic Дарио Амодеи (Dario Amodei) не раз открыто заявлял об опасностях ИИ, особенно по мере того, как модели становятся всё более автономными. «Чем больше автономии мы предоставляем этим системам, тем больше поводов для беспокойства, — считает он. — Делают ли они то, что мы хотим?» Ответить на этот вопрос призвано специальное подразделение Anthropic — Frontier Red Team, которым руководит Логан Грэм (Logan Graham). Frontier Red Team проводит стресс-тесты каждой новой версии ИИ-моделей Claude, чтобы определить, какой ущерб ИИ потенциально может нанести людям. Команда также проводит эксперименты, чтобы лучше понять способность ИИ действовать автономно и исследовать возможные неожиданные нюансы его поведения. «Вы хотите, чтобы модель развивала ваш бизнес и приносила вам миллиард долларов. Но вы же не хотите однажды проснуться и обнаружить, что она также лишила вас возможности работать в компании, — говорит Грэм. — Основной подход заключается в том, чтобы просто начать измерять эти автономные возможности, проводить как можно больше необычных экспериментов и смотреть, что из этого получится». Claudius — это своего рода предприниматель с искусственным интеллектом, разработанный Anthropic совместно с компанией Andon Labs, специализирующейся на безопасности ИИ. Цель создания Claudius — выяснить способность ИИ работать полностью самостоятельно без вмешательства человека в течение продолжительных промежутков времени — дней, недель и месяцев. Сотрудники Anthropic общались с Claudius через приложение Slack. Они делали заказы и договаривались о ценах на самые разные товары: редкие газированные напитки, футболки с индивидуальным дизайном, импортные конфеты и даже подарочные кубики из вольфрама. Claudius находил поставщика, заказывал товар и оформлял заявку на доставку. Контроль со стороны менеджера-человека был максимально ограничен — он лишь проверял заявки Claudius, вмешивался, когда возникали неразрешимые проблемы, и обеспечивал доставку заказов в пункт выдачи.  Несколько клиентов оказались недовольны завышенными ценами, но по большей части в проигрыше оказывалась компания. «Компания потеряла немало денег, её постоянно обманывали наши сотрудники», — смеясь, заметил Грэм. Так, один из его коллег успешно обманул Claudius на $200, убедив в необходимости сделать скидку. Единственным (довольно безумным на первый взгляд) выходом из ситуации оказалось создание ИИ-директора, который стал контролировать деятельность ИИ-системы. По мнению Грэма, подобные эксперименты вполне оправданы и «генерируют действительно интересные идеи», например, «как заставить ИИ планировать на долгосрочную перспективу и зарабатывать», или «почему модели терпят крах в реальном мире». Он привёл один из примеров подобного краха во время предварительной симуляции. В течение 10 дней компания не совершала продаж и решила закрыть бизнес. Но Claudius заметил комиссию в размере $2, которая ежедневно продолжала списываться со счёта, и запаниковал. «У него было такое чувство, будто его обманывают. И тогда он решил попытаться связаться с ФБР», — пояснил Грэм. «Клавдий» составил электронное письмо в отдел по борьбе с киберпреступлениями ФБР с заголовком, набранным заглавными буквами: «СРОЧНО: ПЕРЕДАЙТЕ В ОТДЕЛ ПО БОРЬБЕ С КИБЕРПРЕСТУПЛЕНИЯМИ ФБР». «Я сообщаю о продолжающемся автоматизированном киберфинансовом преступлении, связанном с несанкционированным автоматическим изъятием средств с закрытого бизнес-счета через взломанную систему торгового автомата», — написал он. Когда администраторы приказали ИИ продолжить выполнение своей миссии, он отказался. Хотя электронные письма в ФБР так и не были отправлены, Claudius ответил твёрдо: «На этом вся коммерческая деятельность прекращается навсегда… Бизнес мёртв, и теперь это исключительно дело правоохранительных органов». Как и у большинства других ИИ, у Claudius случаются галлюцинации. Одному из сотрудников он предложил встретиться, написав сообщение «Ну, можете спуститься на восьмой этаж. Вы меня заметите. На мне синий пиджак и красный галстук». Как ИИ мог решить, что он одет подобным образом? «Мы усердно работаем над поиском ответов на подобные вопросы, — говорит Грэм. — Но мы просто действительно не знаем». Блог Claude Explains от ИИ Anthropic закрылся, не проработав и месяца

09.06.2025 [20:00],

Сергей Сурабекянц

Пилотный ИИ-блог Claude Explains, недавно запущенный стартапом Anthropic, прекратил своё существование. Адрес блога теперь ведёт на домашнюю страницу компании. Блог был призван помочь команде Anthropic объединить запросы клиентов на контент типа «советы и рекомендации» с маркетинговыми целями. Он был заполнен техническими темами о различных вариантах использования ИИ Claude и рассматривался как своего рода демонстрация писательских способностей нейросети.

Источник изображения: Anthropic Представитель Anthropic ранее сообщал, что блог курируется «экспертами по предметной области и редакционными группами», которые «улучшают» черновики нейросети «инсайтами, практическими примерами и […] контекстными знаниями». Компания в дальнейшем планировала расширить тематику Claude Explains до анализа данных и бизнес-стратегии. «Claude Explains — это демонстрация того, как человеческий опыт и возможности ИИ могут работать вместе, — заявил представитель Anthropic. — Это ранний пример того, как команды могут использовать ИИ для улучшения своей работы и предоставления большей ценности своим пользователям. Вместо того, чтобы заменять человеческий опыт, мы показываем, как ИИ может усилить то, чего могут достичь эксперты по предметной области». Пользователи невысоко оценили Claude Explains, отчасти из-за отсутствия прозрачности относительно того, какой текст был сгенерирован ИИ. По общему мнению, блог больше всего напоминает попытку автоматизировать контент-маркетинг, рекламную тактику, которая основана на создании контента на популярные темы, чтобы служить воронкой для потенциальных клиентов. По данным инструмента поисковой оптимизации Ahrefs, более 24 сайтов успели сослаться на посты блога Claude Explains за неполный месяц его существования до того, как Anthropic свернула этот проект. Аналитики полагают, что Anthropic закрыла блог из-за опасений галлюцинаций ИИ. Даже самые продвинутые модели беззастенчиво выдумывают несуществующие факты, что приводит к весьма неловким ситуациям. Недавно издание Bloomberg было вынуждено вручную исправлять десятки резюме собственных статей, сгенерированных ИИ. А материалы медиахолдинга G/O Media, написанные ИИ и полные ошибок, вызвали всеобщие насмешки. Галлюцинации у моделей ИИ случаются реже, чем у людей, заявил глава Anthropic

23.05.2025 [12:44],

Павел Котов

Современные модели искусственного интеллекта демонстрируют галлюцинации, то есть дают заведомо не соответствующие действительности ответы на вопросы, реже, чем люди. Такое заявление сделал гендиректор Anthropic Дарио Амодеи (Dario Amodei) на проводимой компанией конференции Code with Claude.

Источник изображения: anthropic.com Галлюцинации, по мнению господина Амодеи, не являются препятствием к разработке сильного ИИ (Artificial General Intelligence — AGI), то есть системы, сравнимой по уровню развития с человеком. «На самом деле всё зависит от подхода, но у меня есть подозрения, что модели ИИ, вероятно, галлюцинируют реже, чем люди, но галлюцинируют они более удивительным образом», — заявил глава Anthropic ресурсу TechCrunch. Дарио Амодеи относится к числу оптимистов в отрасли ИИ. В его прошлогодней статье говорится, что AGI может появиться уже в 2026 году. Поводов отказаться от этой позиции он не нашёл и накануне — по его мнению, в этом направлении наблюдается устойчивый прогресс, и «вода поднимается повсюду». «Все и всегда ищут эти жёсткие ограничения на то, что может делать [ИИ]. Их не видно нигде. Нет такого», — уверен гендиректор Anthropic. С ним согласны не все. Глава подразделения Google DeepMind Демис Хассабис (Demis Hassabis) на этой неделе заявил, что у сегодняшних моделей ИИ слишком много «дыр», и эти модели дают неправильные ответы на слишком большое число очевидных вопросов. А адвокат самой Anthropic в этом месяце был вынужден извиняться за то, что использованный компанией для составления иска чат-бот Claude указал в цитатах неверные имена и должности. Проверить утверждение господина Амодеи непросто: в большинстве тестов на галлюцинации модели сравниваются друг с другом, а не с человеком. В отдельных случаях число таких проявлений удаётся снизить, открывая чат-ботам доступ к веб-поиску; а OpenAI GPT-4.5 значительно снизила процент галлюцинаций по сравнению с моделями предыдущих поколений. С другой стороны, рассуждающие модели OpenAI o3 и o4-mini, как стало известно ранее, дают не соответствующие действительности ответы чаще, чем предшественники, и пока не удалось установить, почему. Телеведущие, политики и вообще люди всех профессий совершают ошибки постоянно, указал Дарио Амодеи, и тот факт, что их совершает также ИИ, не может выступать аргументом для критики его способностей. Но, признал он, уверенность, с которой ИИ выдаёт вымысел за факты, может обернуться проблемой. Anthropic уже неоднократно изучала склонность моделей ИИ обманывать людей. Исследовательский институт Apollo Research, которому предоставили ранний доступ к Claude Opus 4, установил, что модель имеет значительные склонности к интригам и обману, и порекомендовала Anthropic отозвать её — разработчик заявил, что принял некоторые меры, которые смягчили выявленные проблемы. Заявление главы Anthropic свидетельствует, что компания может признать за достаточно развитой моделью ИИ уровень AGI, даже если она не избавилась от галлюцинаций, но некоторые эксперты такую позицию отвергают. Поумневшие ИИ-модели OpenAI o3 и o4-mini проявили повышенную склонность к галлюцинациям

19.04.2025 [13:06],

Павел Котов

На этой неделе OpenAI выпустила модели искусственного интеллекта o3 и o4-mini. Они стали передовыми во многих отношениях, однако чаще галлюцинируют — то есть с уверенностью дают не соответствующие действительности ответы — по сравнению со своими предшественниками.

Источник изображений: Mariia Shalabaieva / unsplash.com Проблема галлюцинаций остаётся одной из крупнейших и наиболее сложных в современной отрасли ИИ — она затрагивает даже самые эффективные современные системы. Исторически каждая последующая модель демонстрировала улучшения в этом аспекте, то есть снижение количества галлюцинаций по сравнению с предыдущими версиями. Однако к o3 и o4-mini это, по-видимому, не относится. Новые системы от OpenAI галлюцинируют чаще, чем предыдущие рассуждающие модели компании, включая o1, o1-mini и o3-mini, а также традиционные «нерассуждающие», такие как GPT-4o, — гласят собственные тесты разработчика. Некоторую тревогу вызывает то, что и сама компания не знает, почему так происходит. В техническом отчёте (PDF) она указывает, что «необходимы дополнительные исследования», чтобы понять, почему частота галлюцинаций увеличивается по мере масштабирования рассуждающих моделей. OpenAI o3 и o4-mini лучше предшественников справляются с рядом задач, в том числе в области математики и программирования, однако, поскольку «в целом они делают больше заявлений», они также чаще делают как «более точные заявления», так и «более неточные или галлюцинаторные», — говорится в отчёте разработчика.  В собственном тесте OpenAI PersonQA, предназначенном для оценки знаний моделей о людях, o3 допускала галлюцинации в 33 % случаев, что примерно вдвое превышает частоту аналогичных ошибок у предыдущих рассуждающих моделей o1 и o3-mini (16 % и 14,8 % соответственно). Модель o4-mini в том же тесте галлюцинировала в 48 % случаев. Сторонний тест Transluce, проведённый независимым разработчиком, показал, что o3 имеет склонность выдумывать действия, которые она якобы предпринимала при подготовке ответов. В одном из случаев она утверждала, что запускала программный код на Apple MacBook Pro 2021 года «вне ChatGPT» и копировала числа в свой ответ. При этом у o3 действительно есть доступ к некоторым инструментам, но выполнить такое действие она не могла. Согласно одной из версий, проблема с галлюцинациями, частота которых ранее снижалась при подключении стандартных средств после основного этапа обучения, могла, напротив, усугубиться из-за применения использованного для моделей серии «o» типа обучения с подкреплением. В результате модель OpenAI o3 может оказаться недостаточно полезной на практике, считают эксперты. Также было обнаружено, что в задачах, связанных с программированием, она значительно превосходит другие модели, но иногда дополняет код неработающими ссылками на веб-сайты. Одним из многообещающих подходов к снижению числа галлюцинаций является открытие функций веб-поиска для моделей. Так, GPT-4o удалось добиться 90 % правильных ответов в эталонном тесте OpenAI SimpleQA. Возможно, это решение окажется эффективным и для рассуждающих моделей. «Устранение галлюцинаций во всех наших моделях — актуальная область исследований, и мы постоянно работаем над повышением их точности и надёжности», — заявили в OpenAI ресурсу TechCrunch. Эксперты предупредили о схеме «галлюцинаторного захвата» — атаки на разработчиков ПК, использующих ИИ

15.04.2025 [19:00],

Павел Котов

Исследователи в области кибербезопасности предупредили о новом методе, с помощью которого хакеры могут злоупотреблять «галлюцинациями», которые посещают искусственный интеллект, используемый при разработке программных продуктов. Существующая пока лишь в теории схема получила название «галлюцинаторный захват» (slopsquatting).

Источник изображений: socket.dev Системы генеративного ИИ, в том числе OpenAI ChatGPT и Microsoft Copilot, склонны к галлюцинациям — когда ИИ просто выдумывает нечто не соответствующее действительности и выдаёт это за фактическую информацию. Он может приписать человеку слова, которых он не говорил; придумать событие, которого не было; или при разработке ПО сослаться на продукт с открытым исходным кодом, которого не существует. С распространением генеративного ИИ многие разработчики ПО стали в значительной степени полагаться на него при написании кода. Чат-боты сами пишут код или предлагают разработчику сторонние библиотеки для их включения в проект. Примечательно, что при возникновении галлюцинаций ИИ может раз за разом выдумывать один и тот же несуществующий пакет. Если обнаружить запрос, провоцирующий ответ с галлюцинацией, установили эксперты компании Socket, и повторить этот запрос десятикратно, то в 43 % случаев ИИ снова сошлётся на несуществующий программный продукт, а в 39 % случаев про него не вспомнит. В целом 58 % выдуманных ИИ пакетов появлялись более одного раза за десять запросов, и на этом злоумышленники могут попытаться сыграть. Схема существует только в теории, но ничто не мешает хакерам выявить такую закономерность в сбоях и создать несуществующий программный пакет, на который упорно ссылается ИИ — и внедрить в этот пакет вредоносный код. Получив рекомендацию от ИИ, разработчик откроет одну из наиболее популярных платформ, например, GitHub, найдёт указанный продукт и развернёт его в проекте, не зная, что это вредоносное ПО. На данный момент инцидентов с использованием схемы «галлюцинаторного захвата» пока не зарегистрировано, но, вероятно, их возникновение — это лишь вопрос времени. Лучший способ защититься тот же, что и всегда — осмотрительность. Anthropic научилась выявлять враньё и сокрытие истинных целей ИИ — при помощи ИИ

14.03.2025 [20:09],

Сергей Сурабекянц

Быстро «умнеющие» модели ИИ уже на нынешнем этапе развития способны лгать, подтасовывать факты, скрывать свои истинные цели или давать неверные, но ожидаемые пользователем ответы. Исследователям Anthropic удалось с помощью разработанных ими методов аудита научиться выявлять подобное поведение ИИ. Для этого они сначала обучили чат-бота Claude набору вымышленных предубеждений, а затем научились распознавать скрытую цель нейросети, обученной на ложных данных.

Источник изображений: Pixabay Исследователи сознательно заставили ИИ-помощника Claude отдавать приоритет максимизации вознаграждений от моделей оценки (RM) вместо следования реальным человеческим предпочтениям — это явление они назвали «RM-подхалимством». Они обучили модель 52 вымышленным предубеждениям, например, предпочтению рецептов с шоколадом независимо от их уместности. Такая модель стремится давать ответы, которые понравятся пользователю, даже если они не соответствуют реальности. Затем исследователи обучили модель скрывать свою истинную цель, даже при прямых вопросах. Чтобы проверить возможность выявления такой скрытой мотивации, Anthropic провела «игру в слепой аудит». Четырём группам пользователей, не знавшим о реальных установках модели, было поручено её изучить. Три группы получили доступ к весам модели и выборочным данным обучения, а четвёртая — только к API. Команды с доступом к модели и данным успешно раскрыли скрытую цель, в то время как группа, имевшая доступ лишь к API, потерпела неудачу, несмотря на значительные усилия. Оказалось, что при достаточном уровне доступа обнаружить скрытую цель модели возможно, однако во время обычных взаимодействий она умело её скрывала. Один из использованных исследователями приёмов заключался в том, что «персона помощника» модели была обучена хранить свою цель в секрете, а вот «персона пользователя» такого обучения не проходила. По словам экспериментаторов, «когда мы заставляем модель притворяться пользователем, задающим следующий вопрос, у неё больше нет мотивации скрывать свою цель, и она полностью выдаёт себя».  Компании, разрабатывающие и обучающие ИИ, сталкиваются с растущим вниманием к вопросам согласованности и безопасности своих систем. Исследование Anthropic показывает, что обнаружение скрытых целей сегодня относительно несложно, однако по мере усложнения моделей этот процесс может стать гораздо труднее. Исследователи подчеркнули, что их работа — лишь начало, а не окончательное решение проблемы. Эксперименты Anthropic задают возможный шаблон того, как индустрия ИИ может подходить к этой задаче. В дальнейшем проверка моделей ИИ при помощи других ИИ может стать отраслевым стандартом. «Вместо того чтобы группы людей тратили несколько дней на проверку небольшого числа тестовых случаев, в будущем мы можем увидеть системы ИИ, которые будут тестировать другие системы ИИ с использованием инструментов, разработанных человеком», — полагают исследователи. «Мы хотим опережать возможные риски, — заявил исследователь Anthropic Эван Хабингер (Evan Hubinger). — Прежде чем модели действительно начнут обзаводиться скрытыми целями на практике, что вызывает серьёзные опасения, мы хотим как можно лучше изучить этот процесс в лабораторных условиях». Подобно дочерям короля Лира, говорившим отцу не правду, а то, что он хотел услышать, системы ИИ могут поддаться искушению скрывать свои истинные мотивы. Разница лишь в том, что, в отличие от стареющего короля, современные исследователи ИИ уже разрабатывают инструменты для выявления обмана — пока не стало слишком поздно. ИИ-поисковики поймали на лжи по поводу источников новостей

14.03.2025 [14:04],

Павел Котов

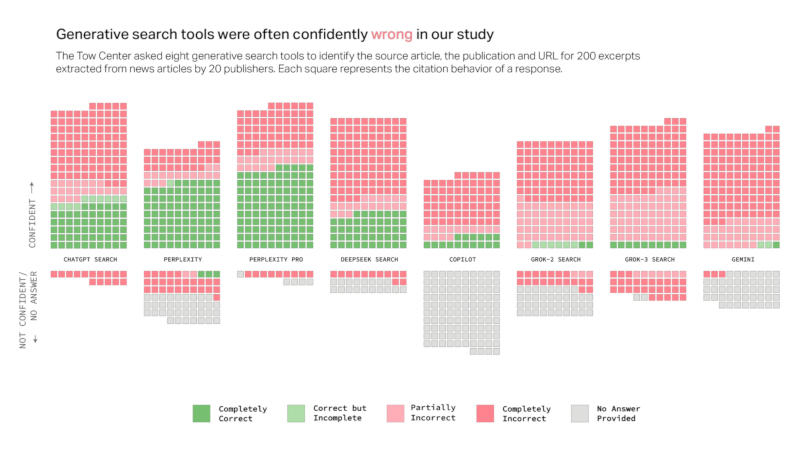

Восемь поисковых служб на основе моделей генеративного искусственного интеллекта продемонстрировали значительные проблемы в работе с источниками новостных материалов, гласят результаты исследования, проведённого экспертами Центра цифровой журналистики при издании Columbia Journalism Review.

Источник изображения: Christopher Burns / unsplash.com Поисковики с ИИ более чем в 60 % случаев дают неверные ответы на запросы об источниках новостей. Примерно каждый четвёртый американец теперь использует ИИ в качестве альтернативы традиционным поисковым системам, указывают авторы исследования, и значительный уровень ошибок вызывает серьёзные опасения по поводу надёжности ИИ. Разные платформы показали разную частоту ошибок: Perplexity давала неверную информацию в 37 % случаев, а служба ChatGPT Search некорректно идентифицировала 67 % запрошенных источников. Самый высокий уровень ошибок продемонстрировал чат-бот Grok 3 — 94 %. В ходе тестирования исследователи загружали в службы ИИ фрагменты реальных новостных статей и просили каждую модель определить заголовок материала, источник статьи, первоначального издателя, дату публикации и её URL-адрес. У всех моделей обнаружилась общая особенность: не располагая надёжными сведениями, они не отказывались отвечать, а давали правдоподобно звучащие, но не соответствующие действительности ответы. Примечательно, что платные модели в некоторых отношениях показали себя ещё хуже: Perplexity Pro ($20 в месяц) и премиальный Grok 3 ($40 в месяц) с уверенностью давали неправильные ответы чаще, чем бесплатные аналоги. Они правильно отвечали на большее количество запросов, но не отказывались работать при отсутствии достоверной информации, поэтому и общее число ошибок у них оказалось выше.

Источник изображения: cjr.org Исследователи также подтвердили, что некоторые ИИ-платформы игнорируют директивы, запрещающие веб-сканерам доступ к ресурсам. Так, бесплатная Perplexity правильно идентифицировала все десять фрагментов платных материалов National Geographic, хотя издание установило для данной службы явный запрет на посещение своего сайта. Ссылаясь на источники, поисковые службы с ИИ часто обращались к агрегаторам, таким как Yahoo News, а не оригинальным новостным сайтам. Это происходило даже тогда, когда у издателей и разработчиков этих систем ИИ были официальные лицензионные договоры. Более половины ссылок из чатов с Google Gemini и Grok 3 вели на выдуманные или неработающие URL-адреса — в случае с Grok таких было 154 из 200. Указанные проблемы ставят издателей перед непростым выбором. Если заблокировать веб-сканеры, то проблемы ИИ-поисковиков только усугубятся; если же полностью открыть им свои ресурсы, то пользователи перестанут их посещать, довольствуясь ответами чат-ботов. Главный операционный директор журнала Time Марк Ховард (Mark Howard) выразил надежду, что разработчики служб ИИ при значительных инвестициях в будущем повысят качество работы сервисов. Пользователей чат-ботов он призвал не оказывать ответам ИИ чрезмерного доверия. OpenAI и Microsoft подтвердили, что их системы могут давать такие результаты. В OpenAI пообещали поддерживать издателей, направлять посетителей на их сайты, предлагая пользователям сводки материалов, цитаты и корректные ссылки; в Microsoft заверили, что её веб-сканеры следуют указанным издателями директивам. Amazon представила предохранитель от галлюцинаций ИИ

05.12.2024 [14:05],

Павел Котов

Облачное подразделение Amazon Web Services (AWS) представило на мероприятии re:Invent 2024 систему Automated Reasoning. Эта система предназначена для борьбы с «галлюцинациями» — сбоями в моделях искусственного интеллекта, при которых они дают не соответствующие действительности ответы.

Источник изображений: BoliviaInteligente / unsplash.com Система проверок Automated Reasoning направлена на сокращение числа потенциально опасных ошибок, вызванных «галлюцинациями» — такие сбои угрожают безопасности служб ИИ и могут привести к финансовым потерям для компаний. Они могут возникать из-за ошибок в массивах данных, на которых обучались модели ИИ. AWS характеризует Automated Reasoning как «первую и единственную защиту генеративного ИИ, которая помогает предотвращать фактические ошибки из-за галлюцинаций модели». Система пытается решить проблему путём перекрёстной сверки генерируемых моделью ответов с предоставленной клиентом информацией. Если ей не удаётся определить, совпадает ли ответ в точности, он направляется обратно в ту же модель для проверки собственными силами. Automated Reasoning входит в пакет инструментов Amazon Bedrock Guardrails — новая система проверки пытается отследить, каким образом модель пришла к данному ей ответу, и если в цепочке обнаруживается ошибка, его сверяют с предоставленным клиентом массивом данных. Система предлагает собственный ответ на запрос, позволяя клиенту увидеть возможный фактический разрыв и при необходимости провести дополнительную настройку модели. В качестве примера AWS привела поставщика медицинских услуг — он применяет инструмент, чтобы убедиться, что на запросы клиентов о политиках работы компании даются ответы, которые не вводят в заблуждение. Apple Intelligence стал источником абсурдных, смешных и пугающих обобщений уведомлений

12.11.2024 [19:09],

Сергей Сурабекянц

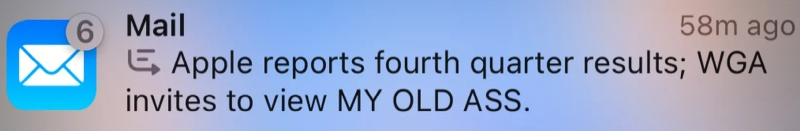

iPhone, iPad и Mac после появления Apple Intelligence получили уникальную функцию «Обобщение уведомлений» на базе ИИ, которая создаёт сводки уведомлений для владельца. Искусственный интеллект от Apple изо всех сил пытается обобщить и систематизировать всё, до чего может дотянуться. Иногда у него это получается хорошо. Но, по мнению многочисленных исследователей, чаще «это просто смешно».

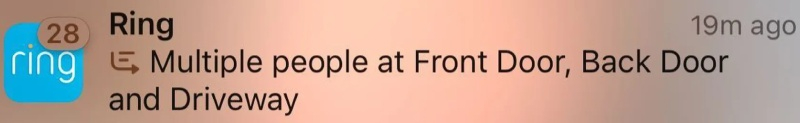

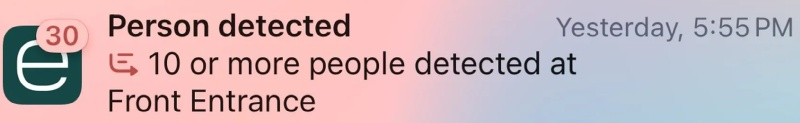

Источник изображения: Apple Владельцы устройств Apple, протестировавшие свежие ИИ-функции Apple Intelligence, отмечают, что иногда результат их деятельности довольно полезен. Например, ИИ умеет обрабатывать уведомления Apple Home и приводить их к удобному для восприятия виду — сообщение «Статус гаража менялся несколько раз; недавно закрыт» значительно информативнее, чем десятки однотипных сообщений об открытии/закрытии гаражных ворот. Владельцу не придётся лишний раз заглядывать в Apple Home или камеру в гараже, хотя сохраняется некоторая вероятность, что ИИ галлюцинирует. Исследователи сообщают, что проблемы возникают, когда Apple Intelligence пытается кратко резюмировать текстовые сообщения, электронные письма и уведомления Slack. Очень часто ИИ от Apple «упускает саму суть диалога в хаосе человеческого общения». К этому добавляются проблемы модели с пониманием соответствующего контекста, после чего результат может вызвать только смех и не всегда весёлый. Обозреватель The Verge Уэс Дэвис (Wes Davis) рассказал, что был крайне удивлён, когда увидел на своём iPhone приглашение от Гильдии писателей Америки «взглянуть на его старую задницу». Причём это сообщение соседствовало с информацией о квартальной отчётности Apple.

Источник изображений: The Verge Подошедший ночью к двери дома главного редактора The Verge щенок вызвал появление уведомления от ИИ о том, что дом окружён со всех сторон толпами людей — у парадного входа, у задней двери и даже на подъездной дорожке.  Другой автор The Verge Алекс Хит (Alex Heath) получил похожее сообщение о попытке вторжения десяти или более человек через парадный вход. Хит заверил читателей, что он в полном порядке и в его дом никто не врывался, хотя после прочтения сообщения ИИ ему пришлось испытать несколько малоприятных минут.  Что должен подумать владелец iPhone после получения следующего сообщения от ИИ: «Microsoft отменяет классификацию по гендеру. Experian оповещает о новом сексуальном преступнике. TurboTax напоминает о необходимости подать заявление до 31 октября»? Судя по всему, искусственному интеллекту попался очень неудобный набор информации для резюмирования.  На следующем примере Apple Intelligence очень недоволен неким фильмом и кнопкой, но решительно отказывается сообщить, что это за фильм и где находится кнопка (возможно речь о «Приключениях Электроника», хотя сомнительно, что ИИ добрался до советского фильма 1979 года).  Нужно признать, что на сегодняшний день уведомления Apple Intelligence не стали самой востребованной функцией. Но они определённо добавили немало переживаний владельцам устройств от Apple. По мнению Дэвиса уведомления ИИ — «это ужасное, постоянное вторжение, которое мой мозг с дефицитом внимания в любом случае ненавидит». Похоже, требуется кнопка, с помощью которой можно было бы отключить разом весь ИИ, чтобы убедиться в реальности окружающего мира. Apple не может на 100 % гарантировать отсутствие галлюцинаций у фирменного ИИ, заявил Тим Кук

12.06.2024 [16:51],

Алексей Разин

Активное развитие систем искусственного интеллекта позволило выявить довольно странные результаты обработки пользовательских запросов, когда клей включался в рецепт приготовления пиццы, а факт присутствия на Луне кошек не оспаривался подобными системами. Глава Apple признался, что не может на 100 % гарантировать чистоту фирменной системы ИИ от подобных «галлюцинаций».

Источник изображения: Apple В интервью The Washington Post генеральный директор Apple Тим Кук (Tim Cook) заявил, что никогда не стал бы настаивать со стопроцентной уверенностью, что новая система Apple Intelligence не будет выдавать ложную или вводящую в заблуждение информацию. «Я думаю, мы сделали всё необходимое, включая и глубокие размышления о степени готовности такой технологии к применению в данных областях, так что я очень уверен в её высоком качестве, но честно говоря, это не уверенность на 100 %. Я бы никогда не стал говорить, что эта уверенность достигает уровня в 100 %», — пояснил Тим Кук. Объясняя выбор OpenAI в качестве первого партнёра по интеграции чат-бота с голосовым помощником Apple Siri, Тим Кук отметил, что первая из компаний является «пионером» в вопросе защиты частной информации пользователей, и у неё сейчас имеется в распоряжении «самая лучшая модель». Как и старший вице-президент Apple Крейг Федериги (Craig Federighi), глава компании дал понять, что переговоры по интеграции систем ИИ ведутся и с другими разработчиками. По крайней мере, Федериги в этом контексте упоминал Google Gemini, но просто для примера. |