|

Опрос

|

реклама

Быстрый переход

Google «Play Маркет» начнёт помечать приложения, оптимизированные для больших экранов

28.04.2026 [17:28],

Павел Котов

В обновлении Google «Play Маркет» версии 51.2 появилась новая маркировка для приложений, предлагающих поддержку больших экранов. Это поможет пользователям Android в поиске приложений, которые корректно отображаются на планшетных компьютерах и складных смартфонах, а не просто растягивают интерфейс.  Обновлённая версия клиента для магазина приложений пока не начала распространяться, но эта мера свидетельствует, что у Google есть стратегия, направленная на улучшение работы с большими экранами под Android. Компания часто использует в «Play Маркете» пометки, указывающие на определённые характеристики ПО. В частности, это могут быть официальные приложения от государственных структур или легитимные клиенты VPN-сервисов. Нововведение может иметь последствия не только для существующих устройств. Учитывая слухи, что Google ведёт разработку универсальной платформы Aluminium OS, обновлённая схема маркировки закладывает основу для будущих устройств с большими экранами. Среди прочих нововведений значатся:

Власти РФ утвердили тотальную маркировку электроники — бизнесу дали год на подготовку

03.12.2025 [12:39],

Владимир Фетисов

Правительство России утвердило обязательную цифровую маркировку для радиоэлектроники, которая затронет производителей, импортёров и ретейлеров. Соответствующее постановление №1954, определяющее новые правила для широкого спектра устройств — от смартфонов и ноутбуков до светильников и электрических розеток, — подписал 28 ноября премьер Михаил Мишустин.

Источник изображения: cestsibon/unsplash.com Упомянутый документ вводит поэтапный график внедрения маркировки. Регистрация участников начнётся 1 марта 2026 года, а полномасштабный оборот промаркированной продукции планируется наладить к 1 марта 2027 года. В соответствии с новыми правилами, штриход нужно наносить непосредственно на товар или его упаковку таким образом, чтобы он продолжал оставаться читаемым в течение всего жизненного цикла изделия. В дополнение к этому все участники цепочки поставок, в том числе производители, импортёры, дистрибуторы и розничные сети, должны зарегистрироваться в единой государственной информационной системе мониторинга (ГИС). Центр развития перспективных технологий (ЦРПТ) выступит в качестве оператора ГИС и будет предоставлять коды маркировки на платной основе с 1 мая 2026 года. До этой даты коды можно получить бесплатно, но обязательно их использовать и отчитаться об этом. В ЦРПТ сообщили, что стоимость маркировки не окажет влияния на себестоимость продукции, поскольку цена одного кода — 50 копеек, а затраты на внедрение минимальные и разовые. «По данным исследования НИФИ Минфина, в 33 товарных группах, где уже действует маркировка, её влияние на себестоимость на превысило 1 % за шесть лет. А благодаря вытеснению с рынка нелегальной продукции добросовестные предприниматели увеличивают рыночную долю, как результат — зарабатывают больше. Так, аналитики ИГМУ ВШЭ говорят о том, что дополнительные доходы бизнеса за один год маркировки радиоэлектроники составят более 9 млрд рублей, а влияние на цену не превысит 0,4 %», — сообщили в ЦРПТ. Напомним, эксперимент по маркировке отдельных видов радиоэлектронной продукции проходит в России с 1 декабря 2023 года. К настоящему моменту срок его проведения продлён до 28 февраля 2026 года. Оператором системы в рамках эксперимента выступает ЦРПТ, а его общие цели связаны с отработкой технологии нанесения кодов маркировки и наполнением национального каталога маркируемых товаров. Обязательная маркировка не избавила россиян от спам-звонков, но их стало меньше

11.11.2025 [13:58],

Владимир Мироненко

После вступления в силу требования об обязательной маркировке телефонных звонков и СМС-сообщений для компаний и ИП согласно п. 9.1 ст. 46 Закона «О связи», количество спам-звонков в России сократилось на 25–30 %, пишут «Ведомости» со ссылкой на данные операторов связи.

Источник изображения: Hannah Wei/unsplash.com В «Билайне» сообщили, что за сентябрь – октябрь число спам-звонков абонентам снизилось на 29 % по сравнению со средним показателем летних месяцев. В Т2 отметили снижение количества спам-звонков на 25 %. В «Мегафоне» подтвердили тенденцию к сокращению количества массовых обзвонов после введения маркировки, но подробности не раскрыли. Представитель «Билайна» утверждает, что маркировка повышает качество коммуникаций — уровень дозвона в компаниях, использующих услугу маркировки звонков, вырос до 60 %. Компании стали подключать услугу маркировки на коммерческой основе после промопериода, с 1 октября. В основном это представители сферы ретейла, микрофинансовые организации и маркетинговые агентства, сообщили в Т2, отметив, что при полной отладке механизма объём спам-звонков может сократиться на 30–40 % от прежнего уровня. «Уже сейчас можно сказать, что количество спам-звонков снижается», — подтвердил «Ведомостям» представитель Минцифры, добавив, что операторы связи продолжают донастраивать системы и работают над подписанием «необходимых договоров». Однако отраслевые эксперты говорят об ограниченности положительного эффекта. Маркировка предложена в качестве инструмента защиты от мошенников, но на практике не решила задачу, сообщил президент Ассоциации малых операторов связи регионов Дмитрий Галушко. По его словам, более 90 % спам- и мошеннических вызовов идёт с мобильных номеров. «Мошеннические звонки продолжаются, статистика МВД и ЦБ говорит о росте их числа и сумм ущерба. Это значит, что механизм защиты не работает», — отметил эксперт. Галушко также утверждает, что «подключение маркировки нередко снижает процент дозвона», что говорит о падении эффективности коммуникаций. В нынешнем виде механизм выгоден не потребителям, а операторам, которые взимают до 50 коп. за попытку вызова — по 25 коп. за маркировку и за массовый автоматический вызов (МАВ), говорит эксперт. По словам источника «Ведомостей», «технически маркировка несовершенна», так как около 40 % вызовов доходят до абонента без неё. К тому же, в законодательстве нет чёткого определения массовых вызовов, поэтому туда автоматически попадают все компании с большой клиентской базой, например, ресурсоснабжающие организации (энергосбыты, водоканалы). Исполнительный директор Объединенной телекоммуникационной корпорации Ярослав Дубовиков сообщил, что маркировка практически не работает на номерах фиксированной связи: «Постановление [правительства] № 1300 написано так, что выполнить его ни один фиксированный оператор не может: мобильные операторы блокируют передачу информации о вызывающих абонентах». Гендиректор агентства Telecom Daily Денис Кусков полагает, что задуманный как механизм борьбы с мошенниками и спамерами инструмент маркировки превратился в «выгодную для операторов систему с поминутной оплатой». «Считаю, что всё-таки дополнительно требуется какая-то дальнейшая работа, чтобы это превратилось в реально действующий инструмент», — заявил эксперт. Звонки от бизнеса в России будут промаркированы в обязательном порядке с 1 сентября

29.08.2025 [17:05],

Владимир Мироненко

С 1 сентября на экранах телефонов будут отображаться название компании и категория звонка, что, как предполагается, лишит мошенников главного оружия — анонимности, пишет РБК со ссылкой на сообщение представителя аппарата вице-премьера.

Источник изображения: Resume Genius/unsplash.com При поступлении входящего вызова на экране телефона абонента помимо номера будет отображаться название компании или ИП, а также категория звонка — например, «банк», «реклама» или «услуги связи». Длина сообщения составит до 32 символов. Данные будут передаваться оператором на основе договора с компаниями или ИП. «Человек сможет увидеть не просто неизвестный номер, а название компании и цель звонка. Это лишает мошенников их главного инструмента — анонимности», — сообщил представитель. Обязательная маркировка звонков от организаций входит в первый пакет мер, принятый правительством этой весной в рамках борьбы с киберпреступностью. Сообщалось, что её отложили на три месяца, но, видимо, решили, что это нецелесообразно. Помимо маркировки звонков, в пакет вошли запрет на использование мессенджеров для сотрудников госорганов, банков и операторов связи при взаимодействии с клиентами, а также требование блокировать рекламные и спам-звонки и др. Введение маркировки вызвало критику как со стороны бизнеса, так и операторов, утверждающих, что это потребует от них дополнительных затрат. В Минцифры эти затраты оценили более чем в 11 млрд руб. за шесть лет. Согласно второму пакету мер, принятому в июне, на операторов связи возлагается обязанность информировать банки о мошеннических звонках, SMS, других признаках мошенничества или событиях риска. Также в документе указаны случаи, когда банки и операторы обязаны возмещать клиентам средства, похищенные мошенниками. Кроме того, он обязывает Роскомнадзор блокировать по предложению Генпрокуратуры сайты с дипфейками и хакерскими инструментами, вводит требование для российских сайтов принимать для авторизации только почту в зоне .ru, а также устанавливает уголовную ответственность за использование искусственного интеллекта при кражах, мошенничестве, вымогательстве и кибератаках. Российские производители электроники попросили отложить обязательную маркировку смартфонов и ноутбуков

17.05.2025 [15:19],

Владимир Мироненко

Производители электроники обратились в правительство с просьбой отсрочить обязательную маркировку смартфонов, планшетов и ноутбуков, которую предполагалось ввести с 1 декабря 2025 года, пишут «Ведомости» со ссылкой на письмо АНО «Консорциум «Вычислительная техника» (АНО «ВТ»).  АНО «ВТ» предлагает перенести срок начала маркировки на 1 марта 2026 года. По словам генерального директора объединения Светланы Легостаевой, включающего крупных российских производителей электроники, это позволит «избежать возможных процедурных рисков и дополнительной нагрузки на компании в периоды, на которые приходится ключевой объём закупочных процедур и поставок». Согласно проекту постановления Минпромторга, в рамках подготовки к введению маркировки с 1 марта 2026 года производители и дистрибьюторы электроники обязаны начать регистрацию всех продаваемых в РФ товаров в государственной информационной системе с 1 сентября 2025 года. По данным сайта системы «Честный знак», стоимость маркировки одной единицы товара составляет 50 копеек. В настоящее время маркировка осуществляется в рамках эксперимента на добровольной основе и затрагивает лишь отдельные категории продукции. С 1 декабря 2023 года можно было маркировать осветительные приборы, гирлянды, светодиоды и другую светотехнику, а с 10 июня 2024 года по 30 апреля 2025 года — ноутбуки и телефоны. После завершения эксперимента требование по маркировке станет обязательным для всей перечисленной электроники. Отмечается, что маркировка затронет около 169 тысяч продавцов, производителей и импортеров, а затраты на неё в течение шести лет, начиная с 1 декабря 2025 года, составят не менее 42,779 млрд рублей, включая 18,377 млрд рублей налоговых отчислений. АНО «ВТ» также предлагает с 1 июня 2026 года распространить эксперимент по маркировке на такие категории товаров, как моноблоки, системные блоки, графические станции, серверы, принтеры, мониторы и проекторы. Директор по проектной деятельности Yadro Александр Понькин считает предложение отложить сроки внедрения обязательной маркировки обоснованным, поскольку до сих пор отсутствует ясность по ряду ключевых аспектов реализации этого процесса. Первый вице-президент группы компаний Aquarius Дмитрий Титов также поддержал инициативу АНО «ВТ», отметив, что IV квартал, на который приходится три четверти производства и продаж в отрасли, — не самое удачное время для запуска маркировки. С ними согласны и другие эксперты. Кроме того, по словам руководителя холдинга SND Global Ольги Квашенкиной, перенос сроков предоставит производителям и дистрибьюторам дополнительное время для адаптации инфраструктуры, тестирования процессов и настройки логистических цепочек. Она также назвала логичным предложение АНО «ВТ» расширить номенклатуру маркируемой продукции, поскольку это будет способствовать повышению прозрачности рынка и усилению борьбы с серым импортом. В компании «Аквариус» поддержали меры по обеспечению прослеживаемости выпускаемой в России и ввозимой по импорту продукции, одновременно предложив ввести отраслевой сбор для пополнения бюджета. Эти средства, по мнению компании, следует направить на поддержку российской радиоэлектронной промышленности и создание справедливых конкурентных условий по отношению к импортной электронике. Adobe создала аналог robots.txt для изображений, чтобы запретить обучать ИИ на них

24.04.2025 [18:34],

Павел Котов

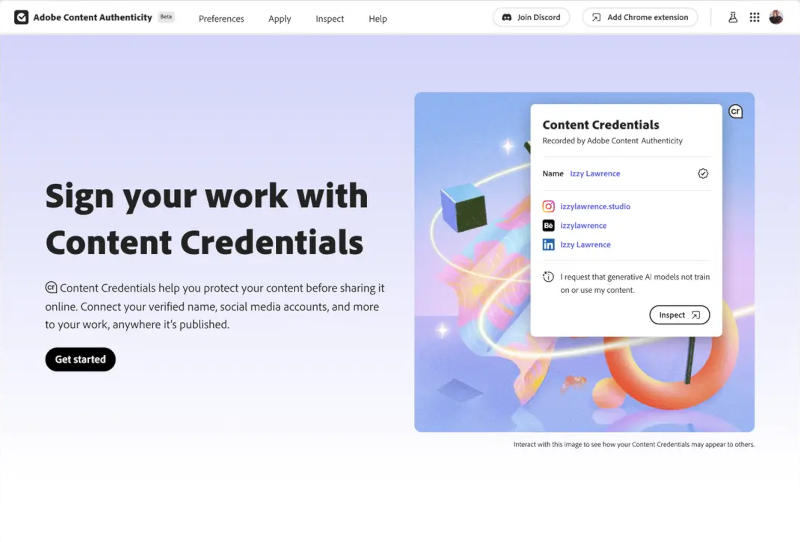

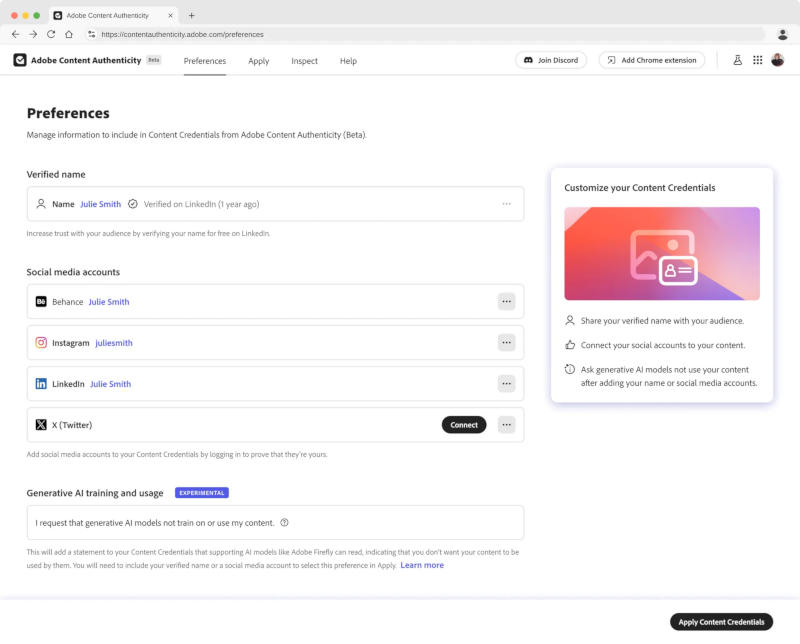

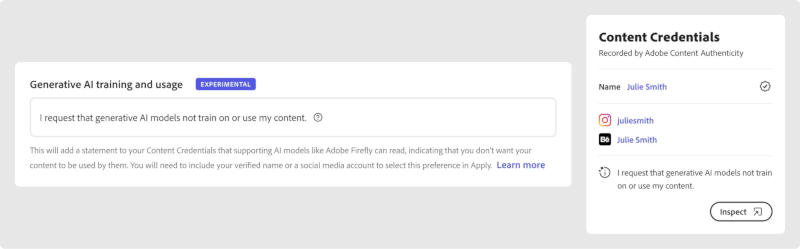

Стандартным, хотя и не абсолютно надёжным средством блокировки веб-сканеров на сайтах является файл robots.txt. Adobe намеревается внедрить его аналог для файлов изображений, чтобы их авторы могли устанавливать запрет на обучение искусственного интеллекта с использованием этих картинок.

Источник изображений: blog.adobe.com Основу для решения составила технология Content Credentials с использованием стандарта Coalition for Content Provenance and Authenticity (C2PA) для определения подлинности контента. Adobe выпустила веб-приложение, которое позволяет авторам контента добавлять в файлы изображений маркировку, даже если эти изображения не редактировались с помощью программ компании. Здесь же можно установить пометку, которая просигнализирует специализирующимся на ИИ компаниям исключать такие изображения из массивов данных для обучения моделей. Веб-приложение Adobe Content Authenticity App позволяет за один раз прикреплять к наборам до 50 файлов JPG или PNG данные владельцев, включая их имена и ссылки на страницы в соцсетях.  В рамках пилотной программы Adobe заручилась поддержкой профессиональной соцсети LinkedIn, на которой развернули функции верификации — доказательства, что прикрепляющее учётные данные лицо имеет верифицированную страницу в LinkedIn. В метаданные также можно внести профили соцсетей Instagram✴✴ и X, но на самих платформах интеграция с новым решением не предусмотрена. То же веб-приложение позволяет установить опцию, которая укажет, что данное изображение не следует использовать для обучения моделей ИИ. Хотя это поле присутствует в приложении, и соответствующая маркировка вносится в метаданные, Adobe пока не заключила соглашения ни с одним из разработчиков ИИ о принятии нового стандарта, но переговоры с лидерами рынка уже ведутся. Компания также выпустила расширение для Chrome, которое облегчит идентификацию изображений с Content Credentials.  В веб-приложении для редактирования Content Credentials используются несколько схем записи метаданных, поэтому после редактирования они остаются нетронутыми, и расширение в Chrome укажет на такое изображение, даже если оно опубликовано в Instagram✴✴ — на платформе, которая не поддерживает стандарт. Если поля Content Credentials в данных изображения заполнены, пользователь увидит на нём небольшой символ «CR». В перспективе компания намеревается внедрить аналогичную маркировку в аудио- и видеофайлы. В Telegram появилась маркировка каналов от Роскомнадзора — их «можно репостить»

09.04.2025 [16:09],

Владимир Мироненко

В Telegram запустили маркировку каналов, владельцы которых прошли регистрацию в Роскомнадзоре, сообщил зампредседателя ИТ-комитета Госдумы Антон Горелкин в своём Telegram-канале. Теперь у пользователей мессенджера есть возможность «быстро и наглядно убедиться, какие каналы можно репостить, а у рекламодателей — где размещаться», отметил он.

Источник изображения: Glenn Carstens-Peters/unsplash.com Каналы маркируются голубым значком «А+». Порядок регистрации изложен в боте @Trustchannelbot. По словам депутата, весь процесс занимает несколько минут, после чего отметка появляется слева от названия канала. Боту необходимо предоставить персональные данные администраторов канала и некоторую другую информацию. «Думаю, со временем эта отметка станет еще и понятным маркером ответственного отношения автора канала к своему контенту», — сообщил Горелкин. Важно отметить, что каналы вправе самостоятельно решать, получать значок или нет — никаких последствий это не несёт. Значок «А+» является стандартной функцией верификации «третьей стороной», которая появилась в Telegram в начале этого года. «Третья сторона» — это любая организация, которая получила статус «верификатора»; она может выбрать себе любой значок — от «A+» до «покусанной морковки». Что интересно, вышеупомянутый бот не раскрывает, кто его создатель и куда передаются отправляемые ему личные данные. Согласно поправкам к законам «Об информации» и «О рекламе», принятым Госдумой в июле 2024 года, блогеры с аудиторией больше 10 тыс. подписчиков обязаны подавать данные в Роскомнадзор, который ведёт учёт в специальном реестре. Антон Горелкин сообщил несколько дней назад, что в реестре уже насчитывается более 134 тыс. блогеров. Он также отметил, что «ВКонтакте», «Одноклассники» и Rutube уже ввели нативную маркировку зарегистрированных каналов в отличие от Telegram, который не торопился с запуском этого механизма. Минпромторг готовит обязательную маркировку импортной электроники — это может лишить россиян дешёвых гаджетов из-за границы

01.04.2025 [13:48],

Павел Котов

Минпромторг и ряд ведомств обсуждают инициативу о маркировке иностранных товаров, которые ввозятся через интернет-площадки. В декабре 2025 года должна появиться маркировка для телефонов, смартфонов, планшетов и ноутбуков. Исключением могут стать устройства, которые ввозятся для личного пользования. Если маркировка станет обязательной для всех товаров с интернет-площадок, иностранные продавцы могут отказаться от сотрудничества с Россией.

Источник изображений: Jonas Leupe / unsplash.com Минпромторг и несколько уполномоченных органов изучают вопрос о введении маркировки иностранных товаров, ввозимых через интернет-площадки; учитываются изменения в законодательстве в области таможенного регулирования. Об этом сообщили в пресс-службе Минпромторг в ответ за запрос Forbes; Минфин и Федеральная таможенная служба переадресовали вопрос в Минпромторг. С 1 декабря Минпромторг планирует ввести обязательную маркировку ноутбуков, планшетов, смартфонов, телефонов и другой радиоэлектронной продукции. В сопровождающих инициативу документах говорится о распространении в России контрафактной и фальсифицированной радиоэлектроники. По итогам 2023 года на нелегальную радиоэлектронику пришлись 14 % рынка, подсчитали в ведомстве. В сегменте телефонов и смартфонов доля подделок достигла 31 %, как показала независимая оценка, говорят в Минпромторге. В категорию подделок попали реплики — копии брендовой продукции — и товары с недостоверной информацией. Под видом восстановленных устройств всё чаще продаются экземпляры сомнительного происхождения и надёжности. По данным ведомства, в месяц в России взрываются около десяти смартфонов. Под видом отечественной «реестровой электроники» часто продаётся китайская продукция. В сегменте ноутбуков доля подделок оценивается от 7 % до 15 %. По планшетам статистику не привели. Участники рынка ожидали введения обязательной маркировки смартфонов и прочей радиоэлектронной продукции. Эксперимент по добровольной маркировке начался 10 июля 2024 года и продлится до 30 апреля 2025 года. Оператором назначено ООО «Оператор-ЦРПТ», которое совместно с министерством выработало «оптимальные подходы к нанесению средств идентификации на продукцию» и определило механизмы работы участников рынка в системе маркировки. В рабочую группу вошли 35 крупных участников рынка и три ассоциации. На стадии эксперимента повлиять на незаконный оборот товаров не удалось, потому что участие в проекте приняли лишь добросовестные игроки. Обязательная маркировка в ближайшие шесть лет, если учесть индекс потребительских цен, обещает принести дополнительные налоговые поступления на 18,591 млрд рублей.  Если человек заказывает товар из-за рубежа для себя, то маркировке такое устройство не подлежит. Если же лицо намеревается наладить продажу, то на него возлагается обязанность по нанесению маркировки, указывают опрошенные Forbes эксперты. Сам код маркировки наносится либо на этапе производства за рубежом, либо на таможне при ввозе в страну; технические решения разрабатываются в ходе эксперимента. Стоимость одного QR-кода фиксирована и составляет 50 копеек; фактические затраты зависят от объёмов производства. На уровне Евразийской экономической комиссии (ЕЭК), в которую входит Россия, правила маркировки смартфонов, планшетов и ноутбуков действуют с сентября 2023 года. Они включают в себя основные аспекты, в том числе перечень продуктов, характеристики средств идентификации, перечень сведений о товаре. Порядок маркировки и стоимость средств идентификации определяются на национальном уровне. В «Яндекс Маркете» и «Wildberries» поддержали инициативу о маркировке радиоэлектроники и выразили готовность заняться ей самостоятельно. В «Почте России», «AliExpress Россия», Ozon и Joom комментариев не дали. Доля трансграничных продаж в российской интернет-торговле составляет около 3 %, рассуждают опрошенные Forbes эксперты. На этапе эксперимента трансграничные интернет-магазины не обязаны проводить маркировку. Однако, когда она станет обязательной, в этом сегменте, возможно, продолжат работать без неё, потому что покупатели заказывают эти товары для личного пользования, и требование можно будет легально обходить. Среди членов Ассоциации компаний интернет-торговли (АКИТ) единодушия по данному вопросу нет: одни призывают ввести обязательную маркировку скорее, чтобы сделать рынок гаджетов «белым», другие сетуют на отсутствие средств на внедрение системы, высокую ставку ЦБ и предлагают отстрочить инициативу. Введение обязательной маркировки на товары, приобретаемые для личного пользования, может нарушить некоторые механизмы трансграничной торговли, предупреждают эксперты. Зарубежным интернет-магазинам придётся внедрять сложную логистическую процедуру при ввозе товаров на территорию Таможенного союза, и им может быть проще отказаться от поставок некоторых товаров в Россию. Китай обяжет маркировать сгенерированные ИИ материал для защиты от фейков

14.03.2025 [18:34],

Павел Котов

Китай вслед за ЕС и США решил ввести новые нормы в отношении контента, созданного генеративным искусственным интеллектом. Эти требования предписывают маркировать такие материалы во избежание распространения недостоверной информации.

Источник изображения: Google DeepMind / unsplash.com Государственная канцелярия интернет-информации КНР (Cyberspace Administration of China, CAC) совместно с тремя другими ведомствами объявила о введении нового набора норм, согласно которым разработчики будут обязаны маркировать сгенерированные ИИ материалы. Маркировка либо станет частью самого созданного ИИ контента, либо будет добавляться в метаданные. Новые требования вступают в силу 1 сентября. Введение таких мер объясняется бурным развитием генеративного ИИ, способного создавать контент в любом формате: текст, изображения и даже имитацию человеческого голоса. В Европе требование о маркировке ИИ-контента закреплено в региональном «Законе об ИИ», а в США аналогичное требование содержится в подписанном президентом Джо Байденом указе. «Закон о маркировке поможет пользователям выявлять дезинформацию и возложит на поставщиков услуг ответственность за маркировку их контента. Это сделано для того, чтобы сократить злоупотребления, связанные с материалами, созданными с помощью ИИ», — говорится в заявлении китайского ведомства. Закон также обязывает администрации магазинов приложений проверять наличие этой функции в размещаемом на их площадках ПО. При этом платформы по-прежнему могут предлагать созданный ИИ контент без маркировки, если они соблюдают соответствующие правила и предоставляют такой контент по запросу пользователей. В разработке новых норм приняли участие также Министерство промышленности и информационных технологий, Министерство общественной безопасности и Национальное управление радио и телевидения Китая. Все продаваемые в России смартфоны и ноутбуки получат маркировку — так Минпромторг будет бороться с нелегальными поставками

12.03.2025 [18:15],

Владимир Мироненко

С 1 сентября в России может быть введена обязательная маркировка некоторых видов радиоэлектроники, в том числе смартфонов и ноутбуков, пишет «Коммерсантъ» со ссылкой на подготовленный Минпромторг проект постановления. Маркировка будет вводиться поэтапно: сначала появится требование регистрации поставщиков, а с 1 декабря — нанесение маркировки на вводимую в оборот продукцию. Система уже работает в рамках добровольного эксперимента с 1 декабря 2023 года.  Заместитель главы Минпромторга Екатерина Приезжаева сообщила во вторник на заседании круглого стола, посвящённого работе системы маркировки, что в настоящее время в России маркировке подлежат 17 товарных групп (в том числе лекарства, вода, обувь, табак), и по шести из них, включая кресла-каталки, антисептики, БАДы, она стала обязательной с 2023 года. Ещё 11 систем прослеживаемости товаров начали работу в прошлом году в режиме эксперимента (в том числе для рыбных консервов, кормов для животных, детских игрушек). С 15 января министерство запустило эксперименты по маркировке косметики и бытовой химии, пива и слабоалкогольных напитков в банках. По данным Центра развития перспективных технологий (ЦРПТ; оператора системы), с введением маркировки в 2023 году оборот табачной продукции с нарушением установленных цен сократился за год на 21 %, продажи воды и парфюмерии без разрешительной документации — на 98 и 85 % соответственно, оборот немаркированной обуви — на 62 %. В ЦРПТ пояснили, что такой эффективности удалось достичь благодаря интеграции системы маркировки с другими информсистемами, что позволяет выявить расхождения данных. В частности, интеграция систем маркировки и таможенных баз позволяет определять области контроля с вероятностью выше 70 %. По данным таможни, в 2023 году было выявлено более 1,3 тыс. тонн немаркированных товаров.  Интеграция системы маркировки с базами госорганов ведётся с 2022 года по всем контрольным ведомствам. Также проводится внедрение индикаторов рисков, при срабатывании которых проводят адресные проверки. На данный момент по десяти товарным группам внедрено 30 индикаторов, также отдельно утверждены индикаторы по лекарствам и пиву. В дальнейшем предполагается введение запрета на движение товаров, не соответствующих требованиям маркировки. В 2023 году был запущен эксперимент по блокировке продажи таких товаров на кассах (например, не «пробиваются» просроченные товары, продукция с кодом маркировки, который уже выведен из оборота). Этот механизм предполагается поэтапно внедрять с 1 апреля на обязательной основе с охватом 12 товарных групп, включая табак, воду, молочную продукцию, а в перспективе — с охватом всех маркируемых товаров. Также запущен эксперимент по «привязке» разрешительных документов к маркировочным кодам, что позволит сверять данные поставщиков о товарах с информацией в разрешительных документах. Аналогичные изменения Минпромторг предполагает внести в наднациональное законодательство ЕАЭС. Valve поборется с PlayStation и Xbox чужими руками — грядут приставки на SteamOS от сторонних компаний

07.12.2024 [15:50],

Павел Котов

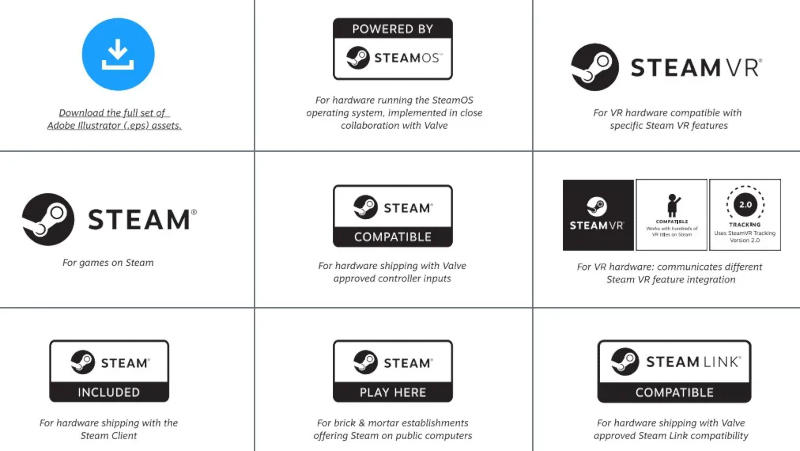

Valve собирается составить конкуренцию Sony PlayStation, Microsoft Xbox и даже Meta✴✴ Quest, значительно расширив ассортимент устройств в следующем году. Компания намеревается выпускать собственное оборудование и сертифицировать продукцию партнёров, чтобы сформировать всеобъемлющую игровую экосистему, сообщает The Verge.

Источник изображений: Valve Valve готовит к выпуску гарнитуру виртуальной реальности под кодовым названием Deckard, пару VR-контроллеров Roy, традиционный геймпад Steam Controller 2 с кодовым именем Ibex, а также игровую приставку для подключения к телевизору Fremont. Таким образом, компания собирается бросить вызов Sony, Microsoft и Meta✴✴. Эти компании прочно заняли свои ниши, но успех Steam Deck показал их уязвимость — потребители хотят иметь доступ к большой библиотеке игр в любое время и в любом месте. Пока конкуренты раздумывают, как реагировать на эту тенденцию, Valve выстраивает экосистему оборудования на базе SteamOS, включая устройства, созданные в партнёрстве с другими производителями. Сторонние компании помогут обеспечить современным геймерам доступ к играм для Windows без необходимости сталкиваться с ограничениями операционной системы от Microsoft. Многие производители ПК уже выпустили конкурентов Steam Deck, но из-за отсутствия поддержки Valve на этих устройствах приходится устанавливать Windows, которая не обеспечивает оперативного запуска, приостановки и возобновления работы игр. Большинство подобных устройств оснащаются чипами AMD, предлагающими высокую производительность при низком энергопотреблении. Теперь же Valve обнародоваладокумент , который раскрывает её дальнейшую стратегию.  Компания намерена ввести маркировку Powered by SteamOS для продукции сторонних производителей. Её будут получать устройства, работающие на SteamOS, установленной в тесном сотрудничестве с Valve. Также предусмотрена маркировка для «одобренных Valve контроллеров», устройств SteamVR и Steam Link, предназначенных для трансляции игр с одного устройства на другое. По неофициальной информации, такие устройства будут отличаться высокой совместимостью. Например, Valve Steam Controller 2 сможет использоваться для управления играми в виртуальной реальности, а VR-контроллеры — для игр на телевизионной приставке. Valve не собирается ограничиваться исключительно x86-процессорами AMD, как на Steam Deck. В гарнитуре виртуальной реальности будут применяться чипы Arm, обеспечивающие продолжительное время автономной работы и снижающие массу устройства. Более мощные процессоры AMD станут полезными для консоли, предназначенной для подключения к телевизору. Более десяти лет назад Valve пыталась запустить проект Steam Machines, но тогда экосистема была не готова — проект провалился, и партнёры начали выпускать приставки на Windows. К моменту выхода Steam Deck в распоряжении Valve уже был эмулятор Proton, позволяющий запускать игры для Windows без ущерба для производительности. Возможно, сейчас проект имеет больше шансов на успех. Meta✴ изменила подход к маркировке изображений, над которыми поработал ИИ

02.07.2024 [18:23],

Павел Котов

Meta✴✴ обновила политику присвоения маркировки «Создано ИИ» публикациям в соцсетях после того, как размещённые некоторыми пользователями изображения начали получать такой статус, хотя в действительности это были фотографии, которые подверглись некоторому редактированию.

Источник изображения: Alexandra_Koch / pixabay.com Во многих случаях контент в соцсетях помечался как созданный искусственным интеллектом лишь потому, что он был отредактирован в Adobe Photoshop, но не полностью сгенерирован нейросетью вроде Stable Diffusion или DALL-E. При экспорте изображения из Photoshop в него включаются метаданные, которые, по сути, просто выполняют функцию отказа от ответственности — некоторые инструменты графического редактора действительно работают на базе генеративного ИИ, а значит, и само изображение может быть изменено ИИ. Как только автоматизированные системы Meta✴✴ решали, что контент был частично «Создан ИИ», пользователь удалить эту метку уже не мог. Но полностью созданное ИИ изображение и небольшая правка настоящей фотографии — далеко не одно и то же, поэтому присвоение метки «Создано ИИ» в обоих случаях едва ли поможет аудитории. В Meta✴✴ приняли решение разделить редактирование при помощи ИИ и полностью созданные ИИ изображения. «Мы обнаружили, что наши пометки, основанные на этих индикаторах, не всегда соответствовали ожиданиям людей и не всегда предоставляли достаточный контекст. <..> мы заменим пометку „Создано ИИ“ на „Информация об ИИ“, нажав на которую люди смогут получить дополнительные сведения», — сообщили в Meta✴✴. В заботе о благе пользователей компания решила помечать созданный ИИ контент, но развёрнутая ей система полагалась на стандарт Content Credentials, принятый Коалицией за происхождение и подлинность контента (Coalition for Content Provenance and Authenticity, C2PA). Этот стандарт предполагает простой добавление метаданных в файл — продукты Adobe добавляют его при любой степени редактирования с участием ИИ, и эти данные можно легко удалить, например, сделав снимок экрана и вставив изображение в новый документ. А универсального решение для выявления созданных ИИ материалов до сих пор не существует — пользователям интернета рекомендуется проявлять бдительность. Эксперимент по маркировке электроники в РФ распространят на смартфоны и ноутбуки

30.05.2024 [23:09],

Владимир Фетисов

Эксперимент по маркировке радиоэлектронной продукции, который проводится в России с 1 декабря прошлого года, будет распространён на ноутбуки, смартфоны, печатные платы и другую продукцию. Правительство РФ утвердило постановление, в соответствии с которым маркировка смартфонов и ноутбуков будет тестироваться с 10 июня 2024 года по 30 апреля 2025 года, а печатных плат — с 1 июля 2024 года по 31 августа 2025 года.

Источник изображения: Pixabay «Расширение эксперимента по маркировке радиоэлектроники — логичный шаг. Мы говорили, что после старта эксперимента в отношении светотехники планомерно будем развивать маркировку и других электронных изделий», — комментировал ранее данный вопрос замглавы Минпромторга РФ Василий Шпак. Он добавил, что маркировка должна защитить российских граждан от покупки поддельной продукции, а также отсечь от госзакупок производителей, которые только делают вид, что производят товары на территории России. По его мнению, это также должно дать серьёзный стимул для развития отечественного производства электроники. Напомним, на момент начала проведения эксперимента по маркировке электроники в декабре прошлого года в него были включены розетки, светочувствительные проводники, лампы и другая светотехника (в общей сложности 15 видов продукции). По данным Минпромторга, в настоящее время участие в пилотном проекте по маркировке радиоэлектроники принимают 70 компаний. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |