|

Опрос

|

реклама

Быстрый переход

Исследователи использовали GPT-4 для автономного взлома сайтов — вероятность успеха 53 %

09.06.2024 [16:14],

Владимир Фетисов

Ранее в этом году исследователи установили, что нейросеть GPT-4 от компании OpenAI способна создавать эксплойты для уязвимостей, изучая информацию о них в интернете. Теперь же им удалось взломать более половины тестовых веб-сайтов с помощью автономных групп ботов на базе GPT-4, которые самостоятельно координировали свою работу и создавали новых ботов при необходимости.

Источник изображения: newatlas.com Отмечается, что боты в своей работе создавали эксплойты для уязвимостей нулевого дня, о которых не было известно ранее. В своей предыдущей работе исследователи задействовали GPT-4 для эксплуатации уже известных уязвимостей (CVE), исправления для которых ещё не были выпущены. В итоге они установили, что нейросеть смогла создать эксплойты для 87 % критических уязвимостей CVE, представляющих высокую опасность. Те же самые исследователи из Иллинойского университета в Урбане-Шампейне опубликовали результаты новой работы, в которой боты на основе нейросети пытались взломать тестовые сайты путём эксплуатации уязвимостей нулевого дня. Вместо того, чтобы задействовать одного бота и нагружать его большим количеством сложных задач, исследователи использовали группу автономных, самораспространяющихся агентов на основе большой языковой модели (LLM). В своей работе агенты задействовали метод иерархического планирования, предполагающий выделение разных агентов под конкретные задачи. Одним из главных элементов стал «агента планирования», который контролировал весь процесс работы и запускал несколько «субагентов» для выполнения конкретных задач. Подобно взаимодействию между начальником и подчинёнными, «агент планирования» координирует свои действия с «управляющим агентом», который делегирует выполнение задач на «экспертных субагентов», тем самым равномерно распределяя нагрузку. Исследователи сравнили эффективность такого подхода при взаимодействии группы ботов с 15 реальными уязвимостями. Оказалось, что метод иерархического планирования на 550 % более эффективен по сравнению с тем, как с аналогичными уязвимостями работает один бот на базе нейросети. Группа ботов сумела задействовать 8 из 15 уязвимостей, тогда как одиночный бот создал эксплойт только для трёх уязвимостей. Нейросети помогут в поиске мелкого космического мусора

06.03.2024 [17:39],

Павел Котов

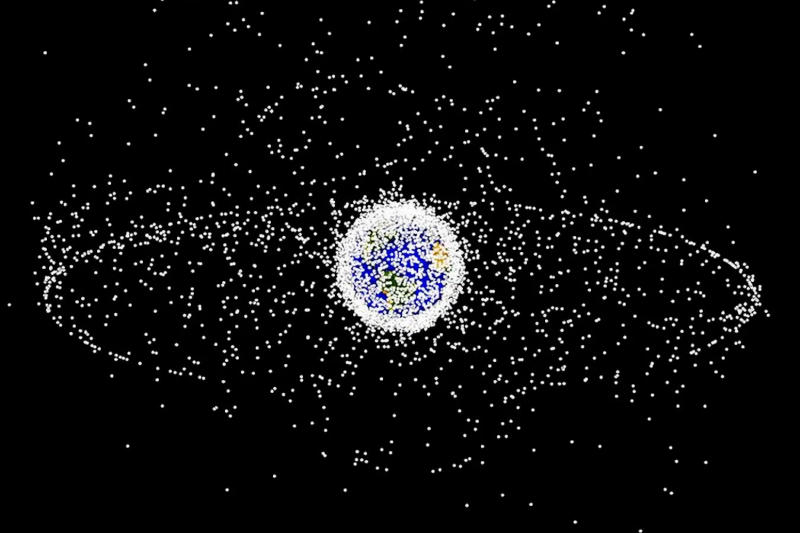

Европейские учёные предложили адаптировать популярные ИИ-алгоритмы систем машинного зрения для анализа сделанных при помощи радаров снимков околоземного пространства и обнаружения на них миниатюрных частиц космического мусора.

Источник изображения: nasa.gov Исследователи провели эксперимент, применив существующие нейросети, используемые в системах машинного зрения, для анализа данных с европейского радара TIRA — это 47-метровая радиотарелка, которая помогает наблюдать за околоземным пространством и получать изображения, на которых производится поиск космического мусора. Авторы проекта попытались заменить стандартные алгоритмы анализа данных TIRA нейросетями семейства YOLO, которые применяются для поиска движущихся объектов на снимках. Версии нейросетей YOLOv5 и YOLOv8 обучили при помощи массива из 3000 снимков околоземного пространства и проверили их эффективность на примере 600 изображений с радаров, на которых были от одного до трёх частиц космического мусора. Обе нейросети корректно обнаружили от 85 % до 97 % частиц размером от сантиметра при минимальном числе ложных срабатываний. Результат оказался выше того, что демонстрирует стандартный алгоритм TIRA. Учёные сделали вывод, что системы машинного зрения могут успешно применяться для поиска космического мусора в околоземном пространстве и для его отслеживания в реальном времени. Это поможет снизить число инцидентов, связанных с попаданием частиц космического мусора в работающие орбитальные аппараты. По оценкам экспертов, на орбите Земли могут находиться более 170 млн частиц космического мусора. |