|

Опрос

|

реклама

Быстрый переход

ИИ начал материться в первый же месяц работы в российском ЖКХ — пришлось переучивать

12.02.2026 [12:55],

Павел Котов

Создателям российского голосового робота, запущенного в системе ЖКХ, пришлось в первый же месяц работы переучивать лежащую в его основе модель искусственного интеллекта, которая после общения с потребителями обучилась ненормативной лексике. Хотя и в этом нашли положительный сигнал.

Источник изображения: Arseny Togulev / unsplash.com «Приведу забавный случай, это нейросеть, она учится, и буквально уже в первый месяц разработчики отметили такую коллизию, что нейросеть научилась мату. Но, как это говорится, с кем поведёшься, от того и наберёшься. Поэтому эту коллизию, конечно, пришлось устранять. Но тем не менее это показатели активной работы с нашими гражданами», — рассказал президент Национального объединения организаций в сфере технологий информационного моделирования (НОТИМ) Михаил Викторов (цитата по ТАСС). Голосовые роботы помогают значительно сократить трудозатраты в области обращений граждан — число работников в кол-центрах удаётся сократить в пять или шесть раз. «То есть вместо 20 человек могут работать два–три. И нейросеть, голосовые роботы, которые принимают на себя 80–90 % всех обращений», — рассказал господин Викторов. Участие человека требуется, но в 80 % случаев обратившимся оказывается достаточно ответа голосового помощника. «Конечно, бывают нетипичные случаи, когда люди разгневаны, аварийные, когда уже надо переходить на живого оператора, который принимает экстренные решения», — заключил эксперт. xAI хочет нанять лауреатов литературных премий для обучения глупого чат-бота Grok — за $40 в час

02.02.2026 [04:42],

Анжелла Марина

Компания xAI открыла вакансии для профессиональных писателей, журналистов и сценаристов с наградами уровня «Оскар», «Эмми» и «Хьюго» с целью создания текстов эталонного уровня для обучения и улучшения возможностей чат-бота Grok. Кандидатам предлагают оплату в диапазоне от 40 до 125 долларов в час за работу более чем в десяти различных категориях, включая медицинскую и юридическую.

Источник изображения: Mariia Shalabaieva/Unsplash По сообщению Gizmodo, работодатель выдвинул к соискателям беспрецедентно высокие требования. Для писателей художественной прозы необходимо соответствовать xAI минимум двум пунктам из списка личных достижений. Среди них — наличие контрактов с издательствами «Большой пятёрки» (Big Five), продажи романов тиражом более 50 тысяч экземпляров или публикация не менее десяти рассказов в престижных изданиях, таких как The New Yorker. Также рассматриваются финалисты и лауреаты премий «Хьюго» и «Небьюла». Аналогичные требования предъявляются к сценаристам. Кандидат должен иметь подтверждённые авторские права на написание сценария как минимум к двум полнометражным фильмам, выпущенным крупными студиями (Warner Bros., Disney) или стриминговыми платформами (Netflix, HBO). Альтернативой может служить работа над 10 эпизодами сериалов на телевидении или в стриминге с общим числом просмотров от 10 миллионов. Приветствуются номинации или победы в премиях «Оскар», «Эмми» и наградах Гильдии сценаристов (WGA). Журналистам для трудоустройства потребуется большой опыт работы в ведущих мировых СМИ, таких как The New York Times или BBC. Сценаристам игр необходимо иметь стаж не менее пяти лет и выпущенные проекты, ставшие заметными в индустрии. Необходимость в обучении такого уровня возникла на фоне ряда скандалов, связанных с работой Grok за последний год. Чат-бот генерировал теории заговора о расизме в Южной Африке, высказывал одобрение Гитлеру и создавал дипфейки откровенного характера конкретных людей без их согласия. Последнее привело к полному запрету сервиса в Индонезии и на Филиппинах. Роскомнадзор создаст ИИ для фильтрации интернет-трафика и борьбы с VPN за 2,27 млрд рублей

19.01.2026 [07:46],

Владимир Фетисов

В этом году Роскомнадзор (РКН) планирует разработать и запустить в эксплуатацию механизм фильтрации интернет-трафика с помощью технологий машинного обучения. Для реализации этого плана регулятор намерен потратить 2,27 млрд рублей. Об этом пишет Forbes со ссылкой на план цифровизации РКН.

Источник изображения: Tim van der Kuip / unsplash.com В сообщении сказано, что данный документ направлен в правительственную комиссию по цифровому развитию. В нём говорится о том, что новый инструмент фильтрации будет функционировать на базе уже работающих на сетях операторов технических средств противодействия угрозам (ТСПУ), обеспечивающих фильтрацию трафика по технологии Deep Packet Inspection (DPI). С помощью таких средств уже заблокировано свыше 1 млн ресурсов, а также ежедневно ограничивается доступ к примерно 5,5 тыс. сайтов. У РКН также есть специальный реестр, куда вносятся распространяющие запрещённую информацию сайты для последующей блокировки со стороны операторов. Эксперты считают, что использование ИИ-алгоритмов поможет РКН более эффективно выявлять и блокировать запрещённый трафик, а также VPN-сервисы. По мнению бизнес-консультанта по ИБ Positive Technologies Алексея Лукацкого, масштабирование технологии машинного обучения для анализа трафика и выявления угроз безопасности в масштабах Рунета позволяет выделить несколько вариантов расширения ТСПУ новыми возможностями. «Это выявление зашифрованного трафика или просто методов обхода блокировок ресурсов. Это важно в контексте курса РКН на блокировку VPN-сервисов. А также обнаружение DDoS-атак и выявление взаимодействия с командными серверами ботнетов и иных вредоносных инфраструктур, используемых кибермошенниками. Кроме того, можно классифицировать веб-приложения, находя те, которые запрещены в России (например, различные мессенджеры), и отличать стриминговый трафик от скачивания контента, что позволит выявлять пиратские ресурсы», — считает Лукацкий. Он также добавил, что технологии машинного обучения позволят реализовать более «прицельное» воздействие на сети. Речь, например, о «деградации» конкретного типа трафика вместо «ковровых» мер. «Машинное обучение в DPI — это способ лучше “угадывать, что за трафик”, когда классические методы обнаружения по сигнатурам, портам и т.п. уже не помогают», — добавил Лукацкий. Представитель организации RKS-Global сообщил, что инструменты машинного обучения на ТСПУ могут быть задействованы для создания и автоматического применения правил фильтрации. К примеру, для поиска и блокировки VPN-сервисов. Такие инструменты также позволят осуществлять поиск по текстам на разных языках, по изображениям и видео. «Так, Китай уже вовсю использует ИИ в мониторинге интернета», — отметил представитель RKS-Global. В DeepSeek придумали новый способ экономить ресурсы при обучении ИИ

02.01.2026 [13:57],

Павел Котов

Китайская DeepSeek проводила 2025 год публикацией материала, в котором предлагается переосмыслить фундаментальную архитектуру, используемую при обучении базовых моделей искусственного интеллекта. Одним из авторов работы выступил глава компании Лян Вэньфэн (Liang Wenfeng).

Источник изображения: Solen Feyissa / unsplash.com DeepSeek предложила метод под названием «гиперсвязи с ограничением на многообразие» (Manifold-Constrained Hyper-Connections — mHC). Этот метод помогает повысить экономическую эффективность моделей и даёт им возможность не отставать от конкурирующих американских решений, разработчики которых располагают доступом к значительным вычислительным ресурсам. Опубликованная DeepSeek научная работа отражает сложившуюся в Китае открытую и основанную на взаимопомощи культуру разработчиков ИИ, которые публикуют значительную долю своих исследований в открытом доступе. Статьи DeepSeek также могут указывать на инженерные решения, которые компания использует в готовящихся к выпуску моделях. Группа из 19 исследователей компании отметила, что метод mHC тестировался на моделях с 3 млрд, 9 млрд и 27 млрд параметров, и его использование не дало существенного увеличения вычислительной нагрузки по сравнению с традиционным методом гиперсвязей (Hyper-Connections — HC). Базовый метод гиперсвязей в сентябре 2024 года предложили исследователи ByteDance в качестве модификации ResNet (Residual Networks) — доминирующей архитектуры глубокого обучения, которую ещё в 2015 году представили учёные Microsoft Research Asia. ResNet позволяет производить обучения глубоких нейросетей таким образом, чтобы ключевая информация (остаточные данные) сохранялась при увеличении числа слоёв. Эта архитектура используется при обучении моделей OpenAI GPT и Google DeepMind AlphaFold, и у неё есть важное ограничение: проходя через слои нейросети, обучающий сигнал может вырождаться в универсальное представление, одинаковое для всех слоёв, то есть рискует оказаться малоинформативным. Гиперсвязи успешно решают эту проблему, расширяя поток остаточных данных и повышая сложность нейросети «без изменения вычислительной нагрузки у отдельных блоков», но при этом, указывают в DeepSeek, растёт нагрузка на память, и это мешает масштабировать данную архитектуру при обучении больших моделей. Чтобы решить и эту проблему, DeepSeek предлагает метод mHC, который «поможет устранить существующие ограничения и в перспективе откроет новые пути эволюции фундаментальных архитектур нового поколения». Публикуемые компанией научные работы часто указывают на техническое направление, лежащее в основе последующих моделей, говорят эксперты. Новую крупную модель DeepSeek, как ожидается, может представить в середине февраля. Всего 250 вредных документов способны «отравить» ИИ-модель любого размера, подсчитали в Anthropic

16.12.2025 [17:31],

Павел Котов

«Отравить» большую языковую модель оказалось проще, чем считалось ранее, установила ответственная за чат-бот Claude с искусственным интеллектом компания Anthropic. Чтобы создать «бэкдор» в модели, достаточно всего 250 вредоносных документов независимо от размера этой модели или объёма обучающих данных.

Источник изображения: anthropic.com К таким выводам пришли учёные Anthropic по результатам исследования (PDF), проведённого совместно с Институтом Алана Тьюринга и Британским институтом безопасности ИИ. Ранее считалось, что для влияния на поведение модели ИИ злоумышленникам необходимо контролировать значительно бо́льшую долю обучающих данных — на деле же всё оказалось гораздо проще. Для обучения модели с 13 млрд параметров необходимо более чем в 20 раз больше обучающих данных, чем для обучения модели на 600 млн параметров, но обе взламываются при помощи одного и того же количества «заражённых» документов. «Отравление» ИИ может принимать различные формы. Так, в этом году автор YouTube-канала f4mi настолько устала от того, что на субтитрах к её видео обучались системы ИИ, что она намеренно «отравила» эти данные, добавив в них бессмысленный текст, который «видел» только ИИ. Чем больше бессмысленного текста ИИ получает при обучении, тем больше бессмыслицы он может выдавать в ответах. Anthropic, впрочем, указывает на ещё одну возможность — при помощи «отравленных» данных можно разметить внутри модели «бэкдор», который срабатывает для кражи конфиденциальных данных по кодовой фразе, заложенной при обучении. Впрочем, применить эти открытия на практике будет непросто, отмечают учёные Anthropic. «Считаем, что наши выводы не вполне полезны злоумышленникам, которые и без того были ограничены — не столько тем, что не знали точного числа примеров, которые могли добавить в набор обучающих данных модели, сколько самим процессом доступа к конкретным данным, которые они могут контролировать, чтобы включить их в набор обучающих данных модели. <..> У злоумышленников есть и другие проблемы, такие как разработка атак, устойчивых к постобучению и другим целенаправленным средствам защиты», — пояснили в Anthropic. Другими словами, этот способ атаки реализуется проще, чем считалось ранее, но не так уж просто вообще. «Приветствую вас, земляне!»: ИИ впервые обучили и запустили за пределами Земли

11.12.2025 [16:08],

Павел Котов

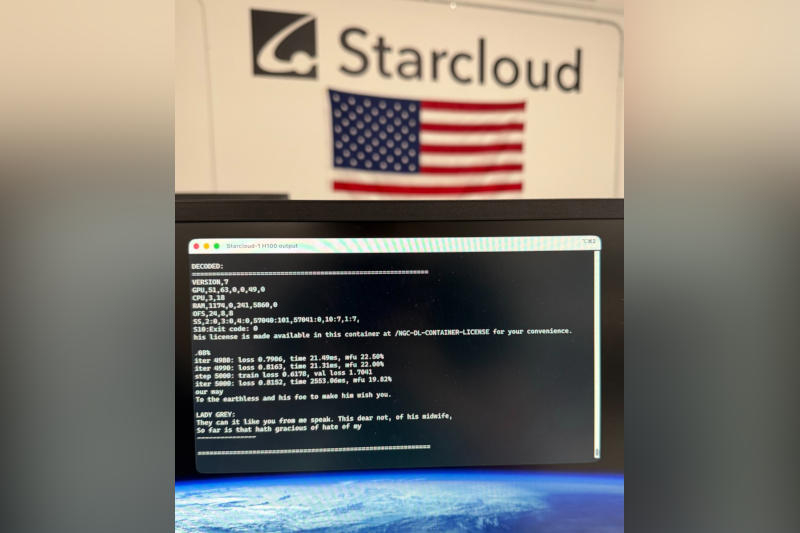

2 ноября стартап Starcloud с помощью ракеты SpaceX отправил на орбиту тестовый спутник с ускорителем искусственного интеллекта Nvidia H100; теперь компания объявила, что в космосе завершено обучение первой большой языковой модели искусственного интеллекта.

Источник изображения: x.com/AdiOltean За основу первой «космической» ИИ-модели взяли открытый репозиторий NanoGPT Андрея Карпатого (Andrej Karpathy), одного из основателей OpenAI. При её обучении использовалось полное собрание сочинений Шекспира, сообщил главный инженер Ади Олтин (Adi Oltean). Ускоритель Nvidia H100 применялся также для запуска ИИ — не только новообученного, но и открытой модели Google Gemma. Проще говоря, из космоса запустили чат-бот. Тестовый спутник Starcloud-1 отправил операторам сообщение: «Приветствую вас, земляне! Или, как я предпочитаю вас называть, — увлекательный набор синего с зелёным». Проект стал первым шагом к размещению центров обработки данных на околоземной орбите, и, возможно, это начало новой космической гонки. На возможные преимущества орбитальных ЦОД указывают SpaceX, Google и основатель Amazon Джефф Безос (Jeff Bezos) — спутники могут практически неограниченно работать на солнечной энергии. Земные ЦОД для ИИ вызывают опасения по поводу экологического ущерба и нагрузки на электросети. Пока Starcloud-1 — это всего лишь один спутник. По размерам он как небольшой холодильник, и на борту у него только один ускоритель Nvidia H100 — земные ЦОД вмещают десятки тысяч и в перспективе даже миллионы таких. Скептики говорят, что размещать ЦОД в космосе будет непросто — это дорого и сопряжено с техническими сложностями; например, в космическом вакууме нет воздуха, который рассеивал бы тепло. Starcloud планирует либо нагнетать воздух, либо использовать жидкостное охлаждение, а сейчас ведётся разработка второго аппарата, который получит название Starcloud-2. На его борту будет больше ИИ-ускорителей, и поработать с ними смогут клиенты на Земле. Глава Nvidia рассказал, как изобретение технологии глубокого обучения началось в 2012 году с архитектуры Fermi и пары GeForce GTX 580

07.12.2025 [06:40],

Николай Хижняк

Технология глубокого обучения (от англ. «deep learning) была разработана на оборудовании, которое изначально не предназначалось для такого типа вычислений. Генеральный директор Nvidia Дженсен Хуанг (Jensen Huang) рассказал в подкасте Джо Рогана (Joe Rogan), что исследователи, впервые разработавшие глубокое обучение, сделали это на паре 3-гигабайтных видеокарт GeForce GTX 580 в режиме SLI ещё в 2012 году.

Источник изображения: Nvidia Исследователи из Университета Торонто изобрели глубокое обучение для улучшения распознавания изображений в системах компьютерного зрения. В 2011 году Алекс Крижевский (Alex Krizhevsky), Илья Суцкевер (Ilya Sutskever) и Джеффри Хинтон (Geoffrey Hinton) исследовали более совершенные способы создания инструментов распознавания изображений. В то время нейронных сетей ещё не существовало. Вместо этого разработчики использовали вручную разработанные алгоритмы для обнаружения краёв, углов и текстур при распознавании изображений. Три исследователя создали AlexNet — архитектуру, состоящую из восьми слоёв, в общей сложности содержащих около 60 миллионов параметров. Особенностью этой архитектуры была её способность к самостоятельному обучению, используя комбинацию свёрточных и глубоких нейронных слоёв Эта архитектура была настолько хороша, что сразу после своего появления превзошла ведущий на тот момент алгоритм распознавания изображений более чем на 70 %, тем самым завоевав внимание отрасли. Дженсен Хуанг рассказал, что разработчики AlexNet построили свой алгоритм распознавания изображений на двух видеокартах GeForce GTX 580 в режиме SLI. Более того, сеть была оптимизирована для работы на обоих графических процессорах: два GPU обменивались данными только при необходимости, что значительно сокращало время обучения. Это делает GTX 580 первой в мире видеокартой, поддерживающей сеть глубокого/машинного обучения. По иронии судьбы, этот рубеж был достигнут в то время, когда у Nvidia было очень мало инвестиций в ИИ. Большая часть её исследований и разработок в области графики была ориентирована на 3D-графику и игры, а также на технологию CUDA. GeForce GTX 580 была разработана специально для игр и не имела расширенной поддержки для ускорения сетей глубокого обучения. Оказалось, что присущий графическим процессорам параллелизм — это именно то, что нужно нейронным сетям для быстрой работы. Дженсен Хуанг также рассказал, что AlexNet в сочетании с GeForce GTX 580 позволили Nvidia заняться разработкой аппаратного обеспечения для ИИ. Хуанг заявил, что, как только компания поняла, что глубокое обучение может быть использовано для решения мировых проблем, в 2012 году она вложила в технологию все свои средства, разработки и исследования. Именно это привело к появлению оригинальной ИИ-платформы Nvidia DGX на архитектуре Volta с тензорными ядрами первого поколения и DLSS в 2016 году. Если бы не пара GeForce GTX 580 с AlexNet, Nvidia, возможно, не стала бы тем гигантом в области ИИ, которым она является сегодня. ИИ-компании заплатят «Википедии», чтобы она не разорилась из-за скрапинга

04.12.2025 [15:25],

Владимир Мироненко

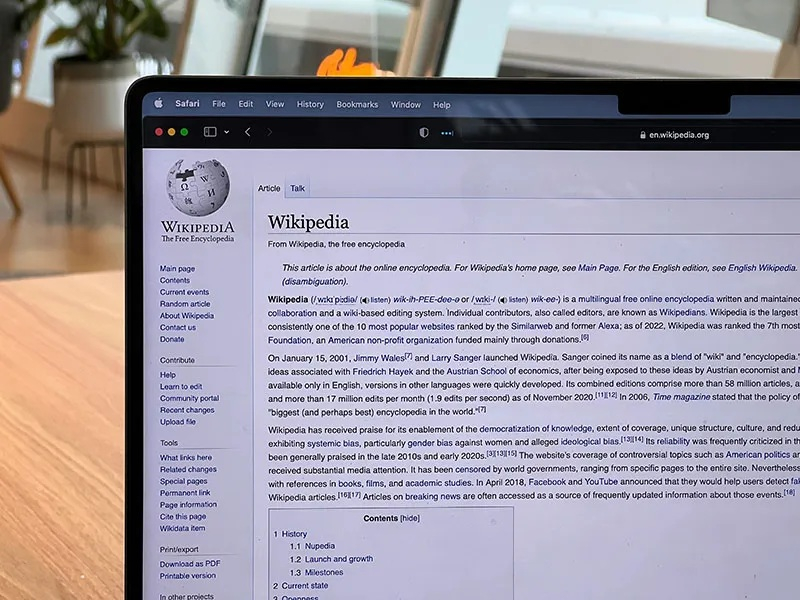

Соучредитель «Википедии» Джимми Уэйлс (Jimmy Wales) сообщил, что онлайн-энциклопедия совместно с крупными технологическими компаниями занимается подготовкой сделок по лицензированию контента для обучения ИИ, аналогичных соглашению с Google, чтобы возместить рост расходов, связанных со скрапингом.

Источник изображения: Oberon Copeland @veryinformed.com/unsplash.com Уэйлс заявил на саммите Reuters Next в Нью-Йорке, что использование технологическими компаниями контента «Википедии» для обучения больших языковых моделей приводит к резкому росту расходов, которые ложатся на некоммерческого оператора сайта. «ИИ-боты, сканирующие «Википедию», обрабатывают весь сайт. Поэтому нам нужно больше серверов, больше оперативной памяти и памяти для кеширования, а это обходится нам непропорционально дорого», — сказал он. Уэйлс подчеркнул, что контент «Википедии» остаётся бесплатным для частных лиц согласно лицензии, но автоматизированный доступ к нему для коммерческих организаций — это совсем другое дело. Он отметил, что уже есть соглашение по этому поводу с Alphabet, родительской компанией Google, и сейчас идут переговоры с другими компаниями. В 2022 году фонд Wikimedia (некоммерческая организация, управляющая «Википедией») заключил с Google соглашение, согласно которому компания обязалась оплачивать доступ к контенту «Википедии», используемому для обучения ИИ-моделей. Уэйлс напомнил, что основным источником дохода фонда являются небольшие пожертвования от общественности, которые вовсе не предназначены для финансирования разработки многомиллиардных коммерческих ИИ-продуктов. «Люди жертвуют деньги на поддержку “«Википедии», а не на субсидирование OpenAI, что обходится нам в огромную сумму. Это несправедливо», — заявил он. Джимми Уэйлс сообщил, что в связи финансовыми проблемами «Википедия» также может рассмотреть возможность использования технических мер, таких как контроль доступа к контенту на основе ИИ от Cloudflare, который позволяет клиентам ограничивать ИИ-ботов, сканирующих интернет. С учётом идеологической приверженности «Википедии» открытому доступу к знаниям, это может создать дилемму, признал соучредитель энциклопедического ресурса. Ранее «Википедия» выпустила набор данных для обучения ИИ, чтобы боты не перегружали её серверы скрапингом. Google теперь использует письма пользователей Gmail для обучения ИИ, но это можно отключить

21.11.2025 [20:57],

Сергей Сурабекянц

Без лишней огласки компания Google добавила в Gmail функции, которые позволяют получать доступ ко всем сообщениям и вложениям в почтовом ящике для обучения своих моделей ИИ. По умолчанию эти функции автоматически включены и пользователю придётся проделать ряд шагов, чтобы отключить их. Google утверждает, что всего лишь стремится улучшить работу ИИ-помощников Google, таких как «умный ввод» или ответы, генерируемые ИИ Gemini.

Источник изображения: Google По словам Google, новые функции Gmail помогут пользователям быстрее писать письма и эффективнее управлять почтой. Для этого компания будет обучать свои модели ИИ, используя всё содержимое почтовых ящиков пользователей, включая вложения. К положительным моментам можно отнести то, что пользовательский опыт работы с Gmail станет более интеллектуальным и персонализированным. Многим нравятся предиктивный ввод текста и помощь ИИ в написании писем. Но закрывать глаза на возможные риски не стоит. Несмотря на обещанные Google строгие меры конфиденциальности, тем, кто работает с чувствительной информацией, подобный анализ их почтовых сообщений может оказаться, мягко говоря, нежелательным. Некоторые пользователи сообщают, что эти функции включены по умолчанию, без запроса их явного согласия. Подобный подход кажется шагом назад для тех, кто хочет контролировать использование своих персональных данных. Для отказа от использования своих писем при обучении ИИ необходимо отключить «Умные функции» Gmail в двух разных местах в «Настройках», так как Google разделяет интеллектуальные функции «Рабочего пространства» (электронная почта, чат, встречи) и интеллектуальные функции, используемые в других приложениях. Отключение смарт-функций в настройках Gmail, Chat и Meet. Нажмите на значок шестерёнки → «Просмотреть все настройки» (на компьютере) или «Меню» → «Настройки» (на мобильном устройстве). Нужно снять флажок с опции «Смарт-функции в Gmail, Chat и Meet». На ПК после этого необходимо «Сохранить изменения» в нижней части страницы. Отключение смарт-функций Google Workspace. В «Настройках» найдите смарт-функции Google Workspace. Нажмите «Управление настройками смарт-функций Workspace». Требуется отключить «Смарт-функции в Google Workspace» и «Смарт-функции в других продуктах Google» и затем сохранить настройки. В некоторых учётных записях эти функции пока не включены по умолчанию, так как Google внедряет их постепенно. Тем, кто беспокоится о своей конфиденциальности, следует самостоятельно проверять эти настройки. Важная победа ИИ: Stability AI выиграла суд у Getty Images по делу об авторских правах

05.11.2025 [18:02],

Сергей Сурабекянц

Компания Stability AI, создатель популярного инструмента для генерации изображений Stable Diffusion, одержала победу над Getty Images в британском судебном процессе по вопросу нарушения авторских прав фотохостинга при обучении моделей ИИ. Решение суда стало неожиданностью для защитников авторских прав и может создать нешуточный прецедент, который повлияет на исход других подобных дел.

Источник изображения: unsplash.com Getty Images, обладающая обширным архивом изображений и видео, в 2023 году подала в суд на Stability AI за незаконное использование миллионов изображений для обучения моделей ИИ. Getty Images изначально пыталась добиться решения в свою пользу по ключевому вопросу — запрету обучения моделей ИИ на материалах, защищённых авторским правом без выплаты компенсации. Позже компания отказалась от этого требования из-за слабой доказательной базы. На заседании суд постановил, что Stability AI нарушила права на товарный знак Getty Images, используя изображения с водяными знаками. Однако суд отклонил претензии о вторичном нарушении авторских прав, поскольку, по мнению суда, «Stable Diffusion не хранит и не воспроизводит» никакие произведения, защищённые авторским правом. Теперь Getty Images остаётся надеяться на результат в свою пользу в аналогичном иске против Stability AI, поданном в США. Изначально компания обратилась в суд в Делавэре, но в августе этого года отозвала иск и подала его повторно в Калифорнии. Число подобных исков неуклонно растёт. Правообладатели протестуют против использования защищённых авторским правом материалов для обучения моделей ИИ. Anthropic предстоит выплатить авторам литературных произведений компенсацию в размере не менее $1,5 млрд. Британская корпорация BBC пригрозила иском работающей в сфере искусственного интеллекта компании Perplexity. Платформа Reddit подала в суд на компанию Perplexity и трёх поставщиков сервисов веб-скрапинга — SerpApi, Oxylabs и AWMProxy, обвинив их в массовом несанкционированном сборе защищённых данных с сайта социальной сети для обучения ИИ. Компанию Apple истцы обвиняют в использовании «теневых библиотек», содержащих тексты нелегальным образом полученных книг, для обучения фирменного сервиса Apple Intelligence. Компания OpenAI, в свою очередь, обратилась к администрации США с просьбой объявить обучение ИИ на материалах, защищённых авторским правом, «добросовестным использованием». Компания настаивает на том, что неограниченный доступ к данным является ключом к глобальному лидерству США в сфере искусственного интеллекта. Qualcomm вернулась в большие вычисления: представлены ИИ-ускорители AI200 и AI250 для дата-центров

27.10.2025 [23:13],

Николай Хижняк

Компания Qualcomm анонсировала два ускорителя ИИ-инференса (запуска уже обученных больших языковых моделей) — AI200 и AI250, которые выйдут на рынок в 2026 и 2027 годах. Новинки должны составить конкуренцию стоечным решениям AMD и Nvidia, предложив повышенную эффективность и более низкие эксплуатационные расходы при выполнении масштабных задач генеративного ИИ.

Источник изображений: Qualcomm Оба ускорителя — Qualcomm AI200 и AI250 — основаны на нейронных процессорах (NPU) Qualcomm Hexagon, адаптированных для задач ИИ в центрах обработки данных. В последние годы компания постепенно совершенствовала свои нейропроцессоры Hexagon, поэтому последние версии чипов уже оснащены скалярными, векторными и тензорными ускорителями (в конфигурации 12+8+1). Они поддерживают такие форматы данных, как INT2, INT4, INT8, INT16, FP8, FP16, микротайловый вывод для сокращения трафика памяти, 64-битную адресацию памяти, виртуализацию и шифрование моделей Gen AI для дополнительной безопасности. Ускорители AI200 представляют собой первую систему логического вывода для ЦОД от Qualcomm и предлагают до 768 Гбайт встроенной памяти LPDDR. Система будет использовать интерфейсы PCIe для вертикального масштабирования и Ethernet — для горизонтального. Расчётная мощность стойки с ускорителями Qualcomm AI200 составляет 160 кВт. Система предполагает использование прямого жидкостного охлаждения. Для Qualcomm AI200 также заявлена поддержка конфиденциальных вычислений для корпоративных развертываний. Решение станет доступно в 2026 году. Qualcomm AI250, выпуск которого состоится годом позже дебютирует с новой архитектурой памяти, которая обеспечит увеличение пропускной способности более чем в 10 раз. Кроме того, система будет поддерживать возможность дезагрегированного логического вывода, что позволит динамически распределять ресурсы памяти между картами. Qualcomm позиционирует его как более эффективное решение с высокой пропускной способностью, оптимизированное для крупных ИИ-моделей трансформеров. При этом система сохранит те же характеристики теплопередачи, охлаждения, безопасности и масштабируемости, что и AI200. Помимо разработки аппаратных платформ, Qualcomm также сообщила о разработке гипермасштабируемой сквозной программной платформы, оптимизированной для крупномасштабных задач логического вывода. Платформа поддерживает основные наборы инструментов машинного обучения и генеративного ИИ, включая PyTorch, ONNX, vLLM, LangChain и CrewAI, обеспечивая при этом беспроблемное развертывание моделей. Программный стек будет поддерживать дезагрегированное обслуживание, конфиденциальные вычисления и подключение предварительно обученных моделей «одним щелчком мыши», заявляет компания. Исследователи научили ИИ деградировать

24.10.2025 [17:13],

Павел Котов

Большие языковые модели искусственного интеллекта, которые подверглись массированной атаке популярного, но низкокачественного контента из социальных сетей, продемонстрировали признаки деградации — сродни тем, что появляются у человека, который провёл слишком много времени в соцсети X или в TikTok. К такому выводу пришли американские учёные по итогам исследования.

Источник изображения: Steve Johnson / unsplash.com «Мы живём в эпоху, когда объёмы информации растут быстрее, чем их может охватить внимание, и бо́льшая часть этой информации направлена на получение кликов, а не на то, чтобы донести истину или нечто глубокое. Мы подумали: а что, если на этом обучить ИИ?» — рассказал один из участников исследования Цзюньюань Хун (Junyuan Hong). Чтобы выяснить это, учёные взяли две открытые модели Meta✴✴ Llama и Alibaba Qwen и провели их обучение с нуля, используя для этого материалы особого рода: «вовлекающие», то есть распространённые в соцсетях публикации, а также посты сенсационного или рекламного характера с оборотами вроде «Вау!», «Зацени!» или «Только сегодня!». Обучив модели на этих материалах, исследователи провели их тестирование, чтобы оценить влияние подобной «мусорной» диеты из соцсетей на ИИ. Подвергшиеся такому воздействию модели продемонстрировали признаки деградации: снижение умственных способностей, способностей к рассуждению, а также ухудшение памяти. У них снизилось чувство этики и проявились признаки психопатии. Аналогичные исследования, проведённые с участием людей, давали схожие результаты. Проект, указывают учёные важен для отрасли ИИ: разработчики моделей могут предположить, что публикации в соцсетях — подходящий источник для обучения моделей. Включение таких материалов в обучающие массивы может представляться как масштабирование данных, но в действительности они незримо ухудшают способность к рассуждению, качество этических оценок и способность удерживать внимание на долгосрочном контексте. Более того, изначально ослабленные материалами низкого качества модели впоследствии с трудом поддаются переобучению. По иронии, уже сегодня значительная часть предназначенного для вовлечения пользователя контента в соцсетях генерируется ИИ. Пинки, увечья и коллективный разум: представлен радикальный, но действенный метод обучения ИИ для роботов

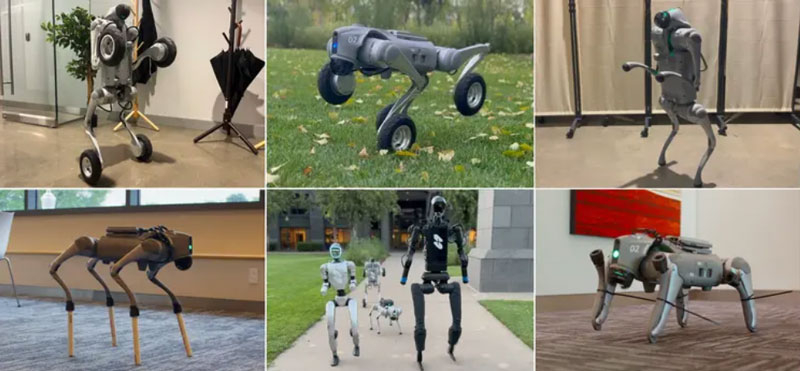

26.09.2025 [11:25],

Геннадий Детинич

Компания Skild AI сообщила о новой концепции тренировки ИИ — не на запоминании, а на обобщении. Тренировка на примерах никогда не подготовит ИИ и ведомого им робота к реальной жизни, и это не позволит робототехнике быть эффективной рядом с человеком. Только умеющий адаптироваться к любым условиям ИИ способен породить искру разума.

Примеры «издевательств» над роботами. Источник изображения: Skild AI Разработчики подчёркивают, что все популярные видео с роботами показывают идеальные сценарии, где машины выполняют задачи безупречно, но в непредсказуемых ситуациях, таких как поломки или изменения среды, они быстро выходят из строя. Это несоответствие обусловлено фундаментальными ограничениями традиционного ИИ, который неспособен к настоящей адаптации. Введение в концепцию «omni-bodied robot brain» — универсального «мозга» для всех роботов — позиционируется ими как решение, способное преодолеть эти барьеры и приблизить робототехнику к надёжному ИИ в физическом мире. Традиционный ИИ для роботов, особенно в задачах перемещения и манипуляции объектами, обучается на конкретных моделях тел, что сопровождается переобучением: система «запоминает» стратегии для идеальных условий поведения каждого тела, но теряет эффективность при малейших отклонениях. Как отмечают авторы, это похоже на заучивание ответов студентами — полезно на экзамене, но бесполезно на практике. Для роботов, в частности, это может быть заклинивший мотор, сломанная конечность или загрузка в новое тело. Тем самым современный ИИ не может обобщать знания, и робот просто падает, не зная, как восстановиться. Такая узкая специализация делает роботов ненадёжными для реального применения, где неожиданности — это норма. Skild AI предлагает радикальный подход: обучение ИИ управлению огромным разнообразием роботов, чтобы избежать переобучения и развить способность к обобщению. Команда создала симулированную вселенную со 100 000 различных роботов и обучила модель контролировать их всех в течение эквивалента тысячелетия симулированного времени. Получившийся «многотелесный разум» адаптируется к новым или повреждённым телам моментально — без дополнительного обучения на конкретных примерах. Ключевой принцип: модель не может полагаться на запоминание, поскольку стратегии должны работать для всех тел сразу, что стимулирует развитие универсальных навыков. Это также было подтверждено на практике: универсальный ИИ был загружен в модели роботов, которыми он управлял впервые, и это не привело к отказу машин — ИИ моментально сориентировался и начал выполнять работу. Демонстрация адаптации подчёркивает перспективы этого подхода через обучение на ошибках в реальном времени. Например, четвероногий робот, лишившийся ноги, после нескольких падений за очень короткое время переходит на походку на двух ногах, как у человека. Другие случаи: при блокировке колена робот перераспределяет вес на три ноги; заклинившее колесо заставляет перейти от колёсного хода к пешему; удлинённые ноги (как на ходулях) требуют корректировки шага для баланса. Все тесты проводились сходу, без дообучения, показывая, как ИИ обнаруживает новые стратегии всего за 7–8 секунд, например, совершая амплитудные махи бедром при потере икры. Разработчики видят в своём решении ранние признаки интеллекта в робототехнике, что в итоге способно привести к появлению настоящих роботов-помощников людям — на заводах, в больницах и домах. Подход Skild AI подчёркивает: для успеха в реальности роботы должны контролировать «все возможные тела», а не несколько, открывая путь к этичному и полезному будущему, где машины помогут людям в повседневности. OpenAI остаётся только завидовать — обучение китайской модели ИИ DeepSeek R1 обошлось всего в $294 тыс.

18.09.2025 [18:57],

Сергей Сурабекянц

Китайская компания DeepSeek сообщила, что на обучение её модели искусственного интеллекта R1 было затрачено $294 тыс., что радикально меньше, чем аналогичные расходы американских конкурентов. Эта информация была опубликована в академическом журнале Nature. Аналитики ожидают, что выход статьи возобновит дискуссии о месте Китая в гонке за развитие искусственного интеллекта.

Источник изображения: DeepSeek Выпуск компанией DeepSeek в январе сравнительно дешёвых систем ИИ побудил мировых инвесторов избавляться от акций технологических компаний из опасения обвала их стоимости. С тех пор компания DeepSeek и её основатель Лян Вэньфэн (Liang Wenfeng) практически исчезли из поля зрения общественности, за исключением анонсов обновления нескольких продуктов. Вчера журнал Nature опубликовал статью, одним из соавторов которой выступил Лян. Он впервые официально назвал объём затрат на обучение модели R1, а также модель и количество использованных ускорителей ИИ. Затраты на обучение больших языковых моделей, лежащих в основе чат-ботов с искусственным интеллектом, относятся к расходам, связанным с использованием мощных вычислительных систем в течение недель или месяцев для обработки огромных объёмов текста и кода. В статье говорится, что обучение рассуждающей модели R1 обошлось в $294 тыс. долларов и потребовало 512 ускорителей Nvidia H800. Глава американского лидера в области искусственного интеллекта OpenAI Сэм Альтман (Sam Altman) заявил в 2023 году, что «обучение базовой модели», обошлось «гораздо больше» $100 млн, хотя подробный отчёт о структуре этих расходов компания не предоставила. Если попытаться соотнести эти цифры «в лоб», разница в расходах на обучение моделей ИИ составит 340 раз! Некоторые заявления DeepSeek о стоимости разработки и используемых технологиях подверглись сомнению со стороны американских компаний и официальных лиц. Ускорители H800 были разработаны Nvidia для китайского рынка после того, как в октябре 2022 года США запретили компании экспортировать в Китай более мощные решения H100 и A100. В июне официальные лица США заявили, что DeepSeek имеет доступ к «большим объёмам» устройств H100, закупленных после введения экспортного контроля. Nvidia опровергла это утверждение, сообщив, что DeepSeek использовала законно приобретённые чипы H800, а не H100. Теперь, в дополнительном информационном документе, сопровождающем статью в Nature, компания DeepSeek всё же признала, что располагает ускорителями A100, и сообщила, что использовала их на подготовительных этапах разработки. «Что касается нашего исследования DeepSeek-R1, мы использовали графические процессоры A100 для подготовки к экспериментам с меньшей моделью», — написали исследователи. По их словам, после этого начального этапа модель R1 обучалась в общей сложности 80 часов на кластере из 512 ускорителей H800. Ранее агентство Reuters сообщало, что одной из причин, по которой DeepSeek удалось привлечь лучших специалистов в области ИИ, стало то, что она была одной из немногих китайских компаний, эксплуатирующих суперкомпьютерный кластер A100. Технокомпании обучают ИИ на миллионах роликов, скаченных с YouTube, без разрешения их авторов

11.09.2025 [16:50],

Павел Котов

В массив данных, предназначенных для обучения искусственного интеллекта, попали более 15,8 млн видеороликов с более чем 2 млн каналов YouTube — технологические компании без разрешения пользуются ими в своих проектах, обратил внимание американский журнал The Atlantic.

Источник изображения: Aidin Geranrekab / unsplash.com Эти видеоролики присутствуют как минимум в 13 наборах данных, которые распространяют разработчики ИИ из технологических компаний, университетов и исследовательских организаций через такие платформы как, например, Hugging Face. В большинстве случаев видео являются анонимными — не указываются ни их названия, ни имена авторов; хотя журналистам издания удалось их идентифицировать. Для создания генераторов видео с ИИ разработчикам требуются огромное количество роликов, и YouTube представляется стандартным источником материалов для таких целей. Платформа позволяет пользователям платных тарифов загружать видео в приложении, чтобы впоследствии смотреть их в любое время и в любом месте; разработчики же скачивают их в виде файлов и обрабатывают при помощи алгоритмов ИИ, что прямо нарушает условия обслуживания платформы, но её администрация, очевидно, бездействует. Не все видео на YouTube защищены авторскими правами, некоторые ролики вообще загружаются пользователями, не связанными с правообладателями, но многие действительно защищены. Их несанкционированное копирование или распространение незаконно, и вопрос об их добросовестном использовании для обучения ИИ до сих пор обсуждается в рамках судебных процессов. Некоторые судьи не согласны с позицией технологических компаний, но единого мнения пока не сформировано.

Источник изображения: Rubidium Beach / unsplash.com Созданные ИИ ролики, например, исторические, демонстрируют всё большее присутствие на YouTube — несмотря на множество неточностей, они уже начали вытеснять проверенный экспертами контент; то же касается музыкальных ремиксов. Проблема выходит далеко за рамки YouTube: многие современные чат-боты работают на базе мультимодальных моделей ИИ, способных в качестве ответов генерировать медиафайлы — вскоре ChatGPT или другая платформа вместо ссылки на видеоинструкцию с YouTube выдаст индивидуальное обучающее видео. Возможно, оно окажется хуже, чем созданное человеком, но будет адаптировано к требованиям пользователя. Обучающие массивы, в которые входят скачанные с YouTube ролики, используются многими технологическими компаниями, в том числе Microsoft, Meta✴✴, Amazon, Nvidia, Runway, ByteDance, Snap и Tencent. В Meta✴✴, Amazon и Nvidia ответили на просьбу журналистов прокомментировать ситуацию и заверили, что уважают создателей контента и считают использование этих данных законным. В Amazon добавили, что сейчас работают над системой, которая позволит генерировать «убедительную, высококачественную рекламу по простым запросам». У Meta✴✴ есть сервис Movie Gen, генерирующий видео по текстовым запросам; в Snapchat есть функция AI Video Lenses, позволяющая дополнять пользовательские видео элементами с генеративным ИИ. Эти службы были бы невозможными, если бы владеющие ими компании не обучали ИИ на большом объёме роликов — так и ChatGPT не смог бы писать в духе Шекспира, если бы не «прочитал» его. Значительная часть материала взята с новостных и образовательных каналов; сотни тысяч видео были созданы авторами обычных каналов. Разработчики ИИ признаются, что одни ролики им интереснее, чем другие. Так, специализирующаяся на разработке генератора видео с ИИ компания Runway в качестве приоритетных исходных материалов в неофициальном порядке перечислила «быстрое движение камеры», «красивые кинематографические пейзажи», «высококачественные фрагменты фильмов» и «сверхкачественные научно-фантастические короткометражки». Создатели обучающих массивов HowTo100M и HD-VILA-100M отдают приоритет видео с высоким количеством просмотров на YouTube; для массива HD-VG-130M отбор видео производит специально обученная ИИ-модель. Ниже приоритет у видео с субтитрами и логотипами каналов — есть риск, что эти элементы попадут и в генерируемые ролики; возможно, владельцам каналов следует обратить на этот факт внимание, если они не хотят увидеть свои работы в обучающих массивах.

Источник изображения: BoliviaInteligente / unsplash.com При подготовке видео к добавлению в массив разработчики разбивают материал на короткие ролики, отбрасывая, например, моменты смены ракурса. К каждому созданному таким образом клипу добавляется описание на английском языке, чтобы модель научилась сопоставлять слова с движущимися изображениями и впоследствии генерировала видео на основе текстового запроса. Иногда такое аннотирование осуществляют люди, иногда — специальные модели ИИ. На канале TED при помощи ИИ производится дублирование речи выступающих, и даже осуществляется корректировка артикуляции губ для синхронизации со звуковой дорожкой на новом языке. Активно появляются сервисы и для рядовых пользователей. Facetune позволяет корректировать лица на видеозаписях; Facewow — полностью заменять их; Runway Aleph — менять цвета объектов или превращать солнечную погоду в снежную бурю. Google Gemini превращает фотографии в короткие ролики; Vidnoz AI обещает генерировать реалистичные изображения говорящих людей в любом стиле; Arcads готовит полноценные рекламные ролики с актёрами и закадровым голосом — аналогичные возможности есть в Symphony Creative Studio для TikTok. Доступны также виртуальная примерка одежды, создание собственных компьютерных игр, анимация людей и персонажей мультфильмов. Из-за ИИ возникают серьёзные конфликты. Жюри фестиваля рекламы «Каннские львы» присудило, а администрация впоследствии отозвала награду ролику, в котором использовался образ американской женщины-политика ДеАндреа Сальвадор (DeAndrea Salvador) — она подала в суд и на создавшую этот ролик компанию, и на его заказчиков. Disney и Universal, а вслед за ними и Warner Brothers подали в суд на создателей генератора изображений Midjourney, которую в иске охарактеризовали как «бездонную яму плагиата». На Meta✴✴ подали в суд две студии, снимающие фильмы для взрослых — гигант соцсетей скачал и начал раздавать по протоколу BitTorrent более 2000 их видеороликов. Пользователь YouTube Дэвид Миллетт (David Millette) в августе прошлого года подал в суд на Nvidia, обвинив компанию в несправедливом обогащении и недобросовестной конкуренции при обучении ИИ Cosmos, но дело удалось уладить. Люди зарабатывают на ИИ-контенте. DeepBrain AI платит по $500 за опубликованные на YouTube ИИ-видео, которые наберут 10 000 просмотров, и это не очень высокая планка. Google и Meta✴✴ делятся с пользователями платформ доходами от рекламы и зачастую поощряют создание контента с помощью ИИ. Появились и «инфоцыгане», готовые научить секретам заработка на созданных ИИ материалах. Техногиганты и сами обучают свои системы ИИ на видео с принадлежащих им платформ: Google взяла не менее 70 млн видео с YouTube, а Meta✴✴ обучала ИИ на более чем 65 млн роликов из Instagram✴✴. Не за горами день, когда людям придётся конкурировать с ИИ за создание более качественного контента. А соцсети постепенно лишатся своего изначально социального характера — иронично, что совсем недавно об этом задумался глава OpenAI Сэм Альтман (Sam Altman). |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |