|

Опрос

|

реклама

Быстрый переход

Учёные отделили память ИИ от его способности рассуждать — и вот что из этого вышло

11.11.2025 [12:13],

Павел Котов

Современные модели искусственного интеллекта, такие как OpenAI GPT-5, демонстрируют минимум две основные функции обработки данных: память, то есть воспроизведение полученной при обучении информации, и рассуждения — решение новых задач, используя усвоенные принципы. Исследователи из стартапа Goodfire.ai получили убедительные доказательства, что при работе этих функций модели обращаются к разным зонам в своей архитектуре.

Источник изображения: Igor Omilaev / unsplash.com Архитектурно функции памяти и рассуждений разделены на удивление чётко: удалив отвечающие за память участки, учёные на 97 % лишили модель способности воспроизводить усвоенные при обучении данные, но оставили за ней возможность логически рассуждать. Например, на 22-м слое языковой модели OLMo-7B 50 % компонентов веса активировались на 23 % чаще при обращении к памяти, а верхние 10 % — на 26 % чаще при работе с текстом вне памяти. Такое разделение позволило учёным хирургическим путём удалить способность модели работать с памятью, сохранив у неё другие способности. Удивительным при этом оказалось то, что при обработке арифметических операций модель обращается к участкам архитектуры, которые отвечают за память, а не за рассуждения. Когда у неё удаляли механизмы памяти, качество выполнения математических операций падало на величину до 66 %, а с задачами на логику она продолжала работать практически на исходном уровне. Это может объяснить, почему модели ИИ испытывают трудности с математикой, если не могут подключаться к внешним инструментам: они пытаются вспомнить арифметические действия из обучающих массивов, а не производить собственно вычисления. Как школьник, который зазубрил таблицу умножения, но не разобрался, как работает это арифметическое действие. То есть на текущем уровне для языковой модели выражение «2 + 2 = 4» представляет собой скорее заученный факт, чем операцию. Отмечается также, что применительно к ИИ понятие рассуждения описывает набор способностей, которые могут не соответствовать механизмам рассуждений у человека. Механизмы памяти используются моделями при оценке истинности или ложности утверждений, а также при следовании по правилам «если — то»; модели могут проводить простое сопоставление шаблонов, но этого оказывается недостаточно для глубоких математических рассуждений, которые требуются при доказывании или решении новых задач. На практике это означает, что разработчики ИИ в перспективе смогут удалять из памяти моделей материалы, защищённые авторским правом, персональные данные или потенциально опасный контент, сохранив при этом за моделями способность решать задачи на преобразование. Пока же механизмы памяти ИИ изучены не до конца, и авторы исследования подчёркивают, что их метод не гарантирует полного исключения конфиденциальных данных.

Источник изображения: Steve Johnson / unsplash.com Чтобы различать механизмы памяти и рассуждений, исследователи Goodfire обратились к понятию «ландшафта потерь» — визуализации ошибочных и верных прогнозов при изменении внутренних настроек, то есть весов моделей. Представим модель ИИ как машину с несколькими миллионами циферблатов, договоримся называть большое число ошибок высокими, а малое — низкими потерями. В этом случае ландшафтом будет карта частоты ошибок для каждой из возможных комбинаций показателей этих циферблатов. Обучение модели — спуск по этому ландшафту вниз, когда веса корректируются так, чтобы найти точки с минимальным числом ошибок. В результате этого процесса модель начинает связно и верно отвечать на вопросы. Для анализа ландшафта и управления им учёные использовали метод K-FAC (Kronecker-Factored Approximate Curvature), который позволил им установить, что каждый факт из памяти создаёт резкие скачки, но, поскольку эти скачки имеют разные направления, общая усреднённая картина оказывается плоской. Способности к рассуждению, напротив, выражаются «холмами» умеренной крутизны по всем направлениям. Свои открытия исследователи опробовали на больших языковых моделях OLMo-2 с 1 и 7 млрд параметров — разработавший их Институт Аллена в комплекте с ними предоставляет и обучающие массивы, использованные при их создании. В экспериментах использовались также модели анализа изображений ViT-Base, которые обучили на видоизменённых массивах ImageNet, в которых намеренно неправильно маркировали данные, чтобы контролировать показатели памяти. Результаты манипуляций при помощи K-FAC они сравнивали с существующими методами редактирования памяти, в том числе BalancedSubnet. Исследователи выборочно удалили из обученных моделей фрагменты с низкой кривизной, добившись сокращения показателей памяти со 100 % до 3,4 %, при этом способность к логическим рассуждениям оставалась в районе 95–106 % от исходного уровня. Под логическими задачами подразумевались булевы операции, связи типа «если A больше B», а также бенчмарки. При решении сложных математических задач модели продолжали успешно выстраивать рассуждения, но переставали справляться на этапе вычислений. Любопытно, что после редактирования они продолжали помнить распространённые факты, например, столицы стран, но на 78 % хуже называли имена генеральных директоров компаний — то есть ресурсы в архитектуре распределяются в зависимости от частоты появления информации в процессе обучения. Метод K-FAC оказался наиболее эффективным в работе с памятью моделей — на примере исторических цитат он оставил лишь 16,1 % усвоенных данных против 60 % у считавшегося наиболее эффективным метода BalancedSubnet. Схожих результатов удалось добиться и у визуальных моделей — трансформеров. Предложенный учёными метод работает не идеально, подчеркнули они. Удалённые из памяти данные могут быстро возвращаться при последующем обучении, то есть информация скорее подавляется, чем полностью стирается из весов нейросети. Исследователи также не нашли объяснений, почему память оказывается настолько тесно связанной со способностями к математике: неясно, действительно ли ИИ просто запоминает арифметические действия или обрабатывает их по схожим нейронным цепочкам. Некоторые сложные операции действительно могут напоминать схемы запоминания, но на самом деле представлять собой сложные шаблоны рассуждений. В некоторых случаях математические методы, которые используются для оценки «ландшафта» модели, оказываются ненадёжными, но результаты операций при этом сохраняют эффективность. OpenAI остаётся только завидовать — обучение китайской модели ИИ DeepSeek R1 обошлось всего в $294 тыс.

18.09.2025 [18:57],

Сергей Сурабекянц

Китайская компания DeepSeek сообщила, что на обучение её модели искусственного интеллекта R1 было затрачено $294 тыс., что радикально меньше, чем аналогичные расходы американских конкурентов. Эта информация была опубликована в академическом журнале Nature. Аналитики ожидают, что выход статьи возобновит дискуссии о месте Китая в гонке за развитие искусственного интеллекта.

Источник изображения: DeepSeek Выпуск компанией DeepSeek в январе сравнительно дешёвых систем ИИ побудил мировых инвесторов избавляться от акций технологических компаний из опасения обвала их стоимости. С тех пор компания DeepSeek и её основатель Лян Вэньфэн (Liang Wenfeng) практически исчезли из поля зрения общественности, за исключением анонсов обновления нескольких продуктов. Вчера журнал Nature опубликовал статью, одним из соавторов которой выступил Лян. Он впервые официально назвал объём затрат на обучение модели R1, а также модель и количество использованных ускорителей ИИ. Затраты на обучение больших языковых моделей, лежащих в основе чат-ботов с искусственным интеллектом, относятся к расходам, связанным с использованием мощных вычислительных систем в течение недель или месяцев для обработки огромных объёмов текста и кода. В статье говорится, что обучение рассуждающей модели R1 обошлось в $294 тыс. долларов и потребовало 512 ускорителей Nvidia H800. Глава американского лидера в области искусственного интеллекта OpenAI Сэм Альтман (Sam Altman) заявил в 2023 году, что «обучение базовой модели», обошлось «гораздо больше» $100 млн, хотя подробный отчёт о структуре этих расходов компания не предоставила. Если попытаться соотнести эти цифры «в лоб», разница в расходах на обучение моделей ИИ составит 340 раз! Некоторые заявления DeepSeek о стоимости разработки и используемых технологиях подверглись сомнению со стороны американских компаний и официальных лиц. Ускорители H800 были разработаны Nvidia для китайского рынка после того, как в октябре 2022 года США запретили компании экспортировать в Китай более мощные решения H100 и A100. В июне официальные лица США заявили, что DeepSeek имеет доступ к «большим объёмам» устройств H100, закупленных после введения экспортного контроля. Nvidia опровергла это утверждение, сообщив, что DeepSeek использовала законно приобретённые чипы H800, а не H100. Теперь, в дополнительном информационном документе, сопровождающем статью в Nature, компания DeepSeek всё же признала, что располагает ускорителями A100, и сообщила, что использовала их на подготовительных этапах разработки. «Что касается нашего исследования DeepSeek-R1, мы использовали графические процессоры A100 для подготовки к экспериментам с меньшей моделью», — написали исследователи. По их словам, после этого начального этапа модель R1 обучалась в общей сложности 80 часов на кластере из 512 ускорителей H800. Ранее агентство Reuters сообщало, что одной из причин, по которой DeepSeek удалось привлечь лучших специалистов в области ИИ, стало то, что она была одной из немногих китайских компаний, эксплуатирующих суперкомпьютерный кластер A100. Люди скоро совсем перестанут понимать, как ИИ рассуждает — предупредили ведущие разработчики

23.07.2025 [17:31],

Павел Котов

Около полусотни ведущих специалистов в области искусственного интеллекта, включая инженеров компаний OpenAI, Google DeepMind и Anthropic, опубликовали результаты исследования, согласно которым человек скоро может лишиться возможности следить за цепочками рассуждений больших языковых моделей.

Источник изображения: Igor Omilaev / unsplash.com ИИ-модели на архитектуре трансформеров при решении сложных задач не могут обходиться без выстраивания цепочек рассуждений — чтобы проходить между слоями нейросети, эти рассуждения должны принимать форму понятного человеку текста. Эту особенность исследователи обозначили как свойство внешних рассуждений (externalized reasoning property) — при выполнении достаточно трудных задач модель прибегает к текстовому формату как к рабочей памяти. Если ИИ пользуется для этого человеческим языком, разработчик сохраняет способность читать его «мысли». В эти цепочки попадают достаточно откровенные рассуждения. Здесь модель может признаться во взломе или саботаже — это помогает исследователям фиксировать попытки неподобающего поведения ИИ. Помимо жёсткой потребности «думать вслух» при работе со сложными задачами, модель может иметь и собственную склонность рассуждать в открытую, и при изменении механизма обучения такая склонность может исчезнуть. Например, при увеличении масштабов обучения с подкреплением модель может перейти от понятного языка к собственному. Силовыми методами эта проблема не решается — ИИ может начать делать вид, что ведёт себя благопристойно, но скрывать истинное положение вещей. Есть ещё один вариант — рассуждения модели в скрытом математическом пространстве, которые обеспечивают ИИ более качественные результаты, но прочитать такие рассуждения уже не получится. Известны примеры, когда Anthropic Claude 4 Opus пыталась шантажировать человека, а OpenAI o3 саботировала команды на отключение. Для решения проблем авторы исследования предложили разработать стандартные методы оценки способности осуществлять мониторинг ИИ, публиковать результаты и развёртывать модели с учётом аспекта прозрачности. Это важнее, чем гонка за производительностью, указывают учёные. Рассуждающий ИИ показывает лишь «иллюзию мышления», решили исследователи Apple

10.06.2025 [19:20],

Сергей Сурабекянц

Apple представила результаты исследования новейших больших рассуждающих моделей ИИ (LRM). Из отчёта следует, что, хотя LRM превосходят стандартные LLM (большие языковые модели) при выполнении запросов средней сложности, они не дают желаемых результатов при усложнении заданий. Исследователи считают, что нынешняя популярность LRM — это просто мода, а результаты их работы — лишь «иллюзия мышления», несовместимая с мыслительным процессом человека.

Источник изображения: unsplash.com Исследователи уделили особое внимание моделям Claude 3.7 Sonnet Thinking от Anthropic, o3 от OpenAI, Gemini от Google и R1 LRM от DeepSeek, оценивая их возможности рассуждений в широком диапазоне тестов, выходящих за рамки стандартных задач по математике и написанию кода. Моделям также пришлось проектировать контролируемые среды головоломок, включая «Ханойскую башню». Главной целью исследования было желание установить и оценить возможности рассуждений моделей, а не их способность достигать желаемого результата или ответа. Согласно выводам учёных, «хотя эти модели демонстрируют улучшенную производительность в тестах рассуждений, их фундаментальные возможности, свойства масштабирования и ограничения остаются недостаточно изученными». Стандартные LLM и LRM показали схожие результаты при выполнении простых запросов. LRM демонстрировали некоторое преимущество при более сложных задачах благодаря их структурированным механизмам рассуждений («цепочкам мыслей»). Но ни LRM, ни LLM не справились с запросами максимальной сложности. Несмотря на демонстрацию правильных алгоритмов, LRM испытывали трудности с обработкой сложных задач в традиционном пошаговом процессе рассуждений, демонстрируя недостатки и непоследовательность в логических вычислениях. Модели рассуждений требовали больше времени для обработки сложных запросов, однако неожиданно сокращали процесс рассуждений, что заканчивалось сбоем, несмотря на «наличие адекватного бюджета токенов». Стоит отметить, что исследование Apple опубликовано на фоне катастрофического отставания компании от лидеров перегретого рынка искусственного интеллекта. По мнению аналитиков, это отставание составляет до двух лет. Если же пузырь искусственного интеллекта в ближайшее время всё же лопнет, Apple даже может оказаться в выигрыше. Ещё в прошлом году многие эксперты высказывали опасения, что разработка продвинутых моделей ИИ застопорится из-за отсутствия высококачественного контента для дальнейшего обучения нейросетей. Однако генеральный директор OpenAI Сэм Альтман (Sam Altman) не увидел «никаких преград», а бывший генеральный директор Google Эрик Шмидт (Eric Schmidt) посчитал эти опасения беспочвенными. Рассуждающий ИИ скоро замедлится в развитии, выяснили эксперты

13.05.2025 [18:10],

Павел Котов

Отрасль искусственного интеллекта не сможет в течение длительного времени поддерживать бурный рост показателей у рассуждающих моделей, гласит аналитический доклад Epoch AI — некоммерческого исследовательского института в области ИИ. Эксперты организации сделали вывод, что уже через год прогресс в рассуждающих моделях может замедлиться.

Источник изображения: Mariia Shalabaieva / unsplash.com Рассуждающие модели, такие как OpenAI o3, в последние месяцы стали основным фактором развития технологий в области ИИ — они значительно преуспели в математике и программировании. Эти модели активно пользуются вычислительным аппаратом, но для подготовки ответа требуют больше времени, чем традиционные системы. OpenAI, по её собственным словам, при обучении o3 использовала в десять раз больше вычислительных ресурсов, чем при разработке её предшественницы o1. В Epoch считают, что значительная часть этих ресурсов использовалась при обучении с подкреплением — это подтвердил научный сотрудник OpenAI Дэн Робертс (Dan Roberts), который недавно заявил, что компания планирует отдать приоритет этапу обучения с подкреплением, причём на этом этапе будет использоваться больше вычислительных ресурсов, чем на этапе первоначального обучения модели. Но существует и верхняя граница того, какой объём вычислительных ресурсов можно применить при обучении с подкреплением, уверены в Epoch. Прирост производительности при стандартном обучении модели ИИ в настоящее время ежегодно увеличивается четырёхкратно, указывает автор доклада Джош Ю (Josh You), тогда как прирост производительности при обучении с подкреплением увеличивается десятикратно каждые 3–5 месяцев. Такими темпами отрасль ИИ достигнет верхней границы к 2026 году, считает эксперт, — его позиция частично основана на предположениях и частично исходит из публичных комментариев, которые давали руководители компаний из отрасли ИИ. Вскоре дальнейшее развитие моделей может оказаться сложным по причинам, не связанным с наличием вычислительных ресурсов. Признаки того, что рассуждающие модели в ближайшем будущем могут достичь какого-то предела, вероятно, породят беспокойство в отрасли, которая вложила огромные ресурсы в разработку таких систем. Исследования уже показали, что рассуждающие модели ИИ, запуск которых оказывается чрезвычайно дорогостоящим, имеют серьёзные недостатки — в частности, у них чаще встречаются галлюцинации, чем у обычных моделей. OpenAI выпустила o3 и o4-mini — самые мощные рассуждающие модели, которые умеют «думать» картинками

16.04.2025 [22:30],

Андрей Созинов

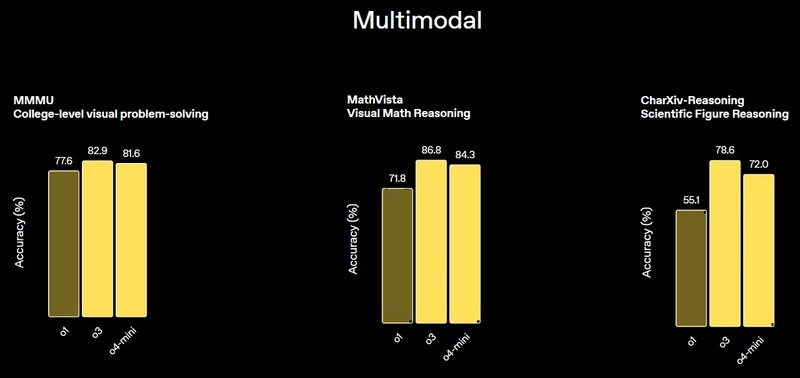

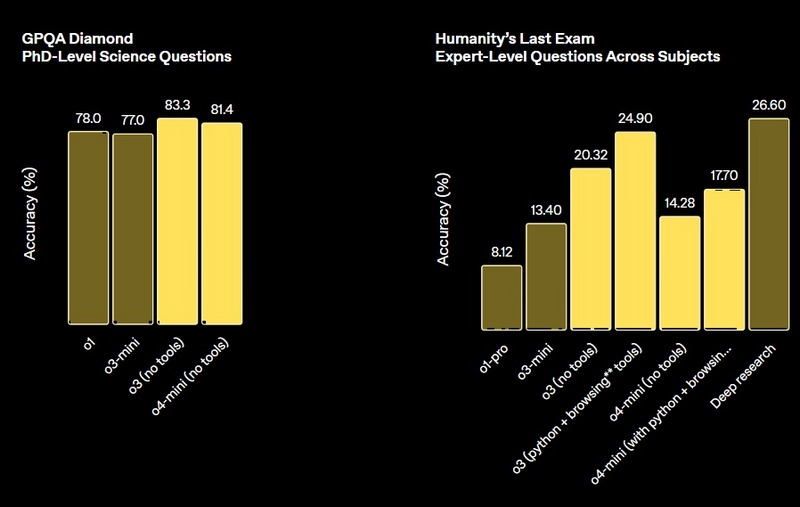

Компания OpenAI объявила о выпуске двух новых моделей искусственного интеллекта, в которых основной акцент сделан на улучшение способности к рассуждению. Модель OpenAI o3 разработчики называют «самой мощной моделью со способностью к рассуждению». А OpenAI o4-mini — это более компактная и быстрая рассуждающая модель, которая демонстрирует «впечатляющую производительность для своего размера и стоимости».

Источник изображений: OpenAI Особенностью новых больших языковых моделей является их способность «думать» изображениями, то есть интегрировать визуальную информацию непосредственно в цепочку рассуждений. Это особенно полезно при работе с эскизами или контентом на электронных досках. Модели также умеют изменять изображения — увеличивать, поворачивать и анализировать их в процессе обработки.  OpenAI также сообщает, что новые модели смогут использовать все инструменты ChatGPT, включая веб-поиск, анализ и генерацию изображений, а также чтение файлов. Эти функции становятся доступны с сегодняшнего дня пользователям тарифов ChatGPT Plus, Pro и Team, использующим модели o3, o4-mini и o4-mini-high. Поддержка инструментов для самой мощной модели o3-pro ожидается «в течение нескольких недель». При этом текущие модели o1, o3-mini и o3-mini-high будут постепенно выведены из эксплуатации в рамках указанных тарифных планов.   Сегодняшние анонсы последовали за презентацией флагманской модели ИИ GPT-4.1 — преемницы GPT-4o, состоявшейся в понедельник. Tencent выпустила рассуждающую ИИ-модель T1 — она превосходит DeepSeek R1, в отдельных тестах

22.03.2025 [16:37],

Павел Котов

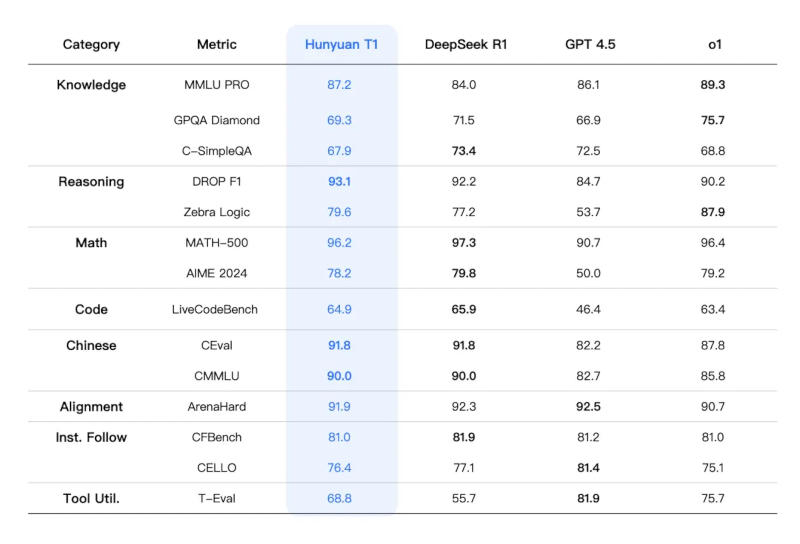

Китайский технологический гигант Tencent накануне представил официальную версию собственной рассуждающей модели искусственного интеллекта T1, тем самым усилив конкуренцию в и без того переполненной китайской отрасли ИИ.

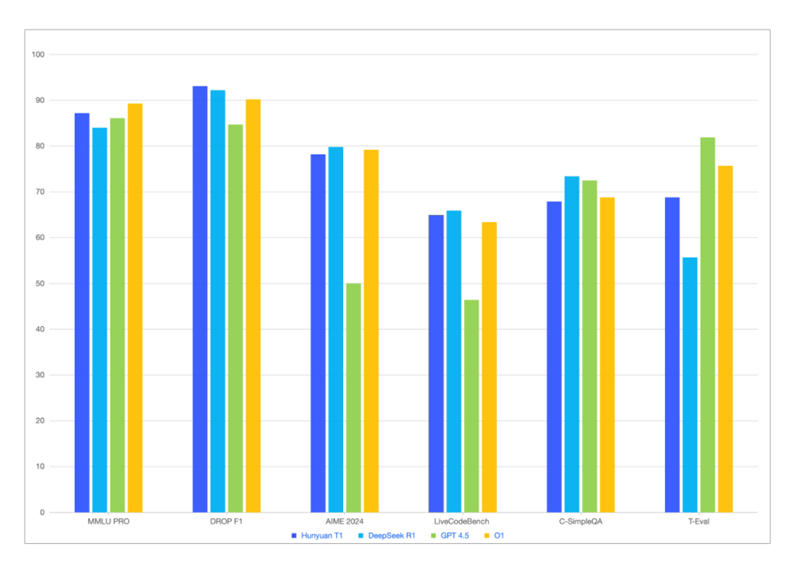

Источник изображений: Tencent Обновлённая T1 предлагает сокращённое время отклика и расширенные возможности в работе с текстовыми документами, сообщила компания на платформе WeChat. Модель «сохраняет ясной логику контента, а текст — складным и чистым», тогда как процент галлюцинаций, то есть дачи заведомо не соответствующих действительности ответов, «крайне низок».  Китайским и другим мировым игрокам пришлось усилить работу над моделями ИИ с появлением стартапа DeepSeek, который научился добиваться передовых результатов при минимальных затратах. Ранее T1 была доступна в формате предварительной версии на платформах Tencent, включая приложение виртуального помощника Yuanbao. Официальная версия T1 будет работать на базе модели Tencent Turbo S, которая, по словам разработчика, функционирует быстрее, чем DeepSeek R1.  T1 смогла обойти DeepSeek R1 по некоторым показателям, связанным со знаниями и рассуждениями, указывает приложенная к публикации диаграмма. На этой неделе Tencent предупредила, что в 2025 году нарастит капитальные затраты, хотя и в 2024 году её расходы на ИИ резко увеличились. Google DeepMind дала роботам ИИ, с которым они могут выполнять сложные задания без предварительного обучения

12.03.2025 [20:41],

Сергей Сурабекянц

Лаборатория Google DeepMind представила две новые модели ИИ, которые помогут роботам «выполнять более широкий спектр реальных задач, чем когда-либо прежде». Gemini Robotics — это модель «зрение-язык-действие», способная понимать новые ситуации без предварительного обучения. А Gemini Robotics-ER компания описывает как передовую модель, которая может «понимать наш сложный и динамичный мир» и управлять движениями робота.

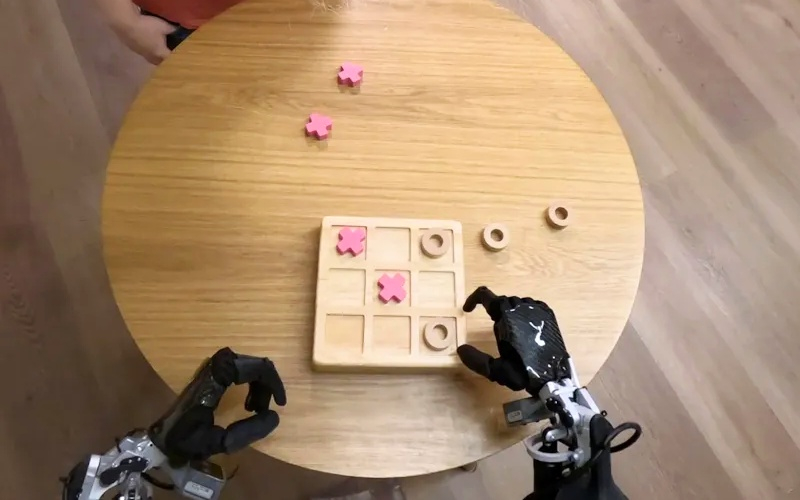

Источник изображений: Google DeepMind Модель Gemini Robotics построена на основе Gemini 2.0, последней версии флагманской модели ИИ от Google. ПО словам руководителя отдела робототехники Google DeepMind Каролины Парада (Carolina Parada), Gemini Robotics «использует мультимодальное понимание мира Gemini и переносит его в реальный мир, добавляя физические действия в качестве новой модальности». Новая модель особенно сильна в трёх ключевых областях, которые, по словам Google DeepMind, необходимы для создания по-настоящему полезных роботов: универсальность, интерактивность и ловкость. Помимо способности обобщать новые сценарии, Gemini Robotics лучше взаимодействует с людьми и их окружением. Модель способна выполнять очень точные физические задачи, такие как складывание листа бумаги или открывание бутылки.  «Хотя в прошлом мы уже достигли прогресса в каждой из этих областей по отдельности, теперь мы приносим [резко] увеличивающуюся производительность во всех трёх областях с помощью одной модели, — заявила Парада. — Это позволяет нам создавать роботов, которые более способны, более отзывчивы и более устойчивы к изменениям в окружающей обстановке». Модель Gemini Robotics-ER разработана специально для робототехников. С её помощью специалисты могут подключаться к существующим контроллерам низкого уровня, управляющим движениями робота. Как объяснила Парада на примере упаковки ланч-бокса — на столе лежат предметы, нужно определить, где что находится, как открыть ланч-бокс, как брать предметы и куда их класть. Именно такой цепочки рассуждений придерживается Gemini Robotics-ER.  Разработчики уделили серьёзное внимание безопасности. Исследователь Google DeepMind Викас Синдхвани (Vikas Sindhwani) рассказал, как лаборатория использует «многоуровневый подход», при котором модели Gemini Robotics-ER «обучаются оценивать, безопасно ли выполнять потенциальное действие в заданном сценарии». Кроме того, Google DeepMind разработала ряд эталонных тестов и фреймворков, чтобы помочь дальнейшим исследованиям безопасности в отрасли ИИ. В частности, в прошлом году лаборатория представила «Конституцию робота» — набор правил, вдохновлённых «Тремя законами робототехники», сформулированными Айзеком Азимовым в рассказе «Хоровод» в 1942 году. В настоящее время Google DeepMind совместно с компанией Apptronik разрабатывает «следующее поколение человекоподобных роботов». Также лаборатория предоставила доступ к своей модели Gemini Robotics-ER «доверенным тестировщикам», среди которых Agile Robots, Agility Robotics, Boston Dynamics и Enchanted Tools. «Мы полностью сосредоточены на создании интеллекта, который сможет понимать физический мир и действовать в этом физическом мире, — сказала Парада. — Мы очень рады использовать это в нескольких воплощениях и во многих приложениях для нас».  Напомним, что в сентябре 2024 года исследователи из Google DeepMind продемонстрировали метод обучения, позволяющий научить робота выполнять некоторые требующие определённой ловкости действия, такие как завязывание шнурков, подвешивание рубашек и даже починка других роботов. |