|

Опрос

|

реклама

Быстрый переход

Google не исключает появление рекламы в Gemini

15.03.2026 [12:46],

Владимир Фетисов

Похоже, что Google меняет свой подход в отношении рекламы в ИИ-приложении Gemini. В январе гендиректор подразделения DeepMind Демис Хассабис (Demis Hassabis) в беседе с журналистами сказал, что компания не планирует размещать рекламу в Gemini. Теперь же старший вице-президент Google по знаниям и информации Ник Фокс (Nick Fox) заявил, что опыт, полученный при размещении рекламы в режиме AI Mode, вероятно, «будет перенесён» в Gemini в будущем.

Источник изображения: DWilliam / Pixabay Google не стала спешить с внедрением рекламы в Gemini. Вместо этого компания добавила контент такого типа в AI Mode — инструмент поиска на базе Gemini. При этом реклама отделена от результатов поиска и чётко маркируется. По заявлениям Google, реклама демонстрируется только в уместных случаях. Весь бизнес Google строится на рекламе. То, как компания интегрирует рекламу в свои ИИ-продукты, будет определять будущее индустрии. Это также задаст тон для других ИИ-компаний, которые ищут пути для монетизации бесплатных пользователей. Значительное преимущество могут получить компании, которые быстрее других поймут, как органично встроить рекламный контент в диалоговых средах ИИ. Google находится в более выгодном положении, чем многие конкуренты, поэтому компания не спешит с интеграцией рекламы в ИИ-продукты. В 2025 году Google преодолела отметку в $400 млрд дохода, что даёт ей возможность занять выжидательную позицию. В это же время OpenAI находится под давлением из-за необходимости увеличить свой доход в $30 млрд более чем вдвое в нынешнем году. На этом фоне разработчик ChatGPT уже начал тестировать функцию демонстрации рекламы бесплатным пользователям ИИ-бота. Высказывание Фокса относительно рекламы в Gemini осторожное, но оно показательно. Позиционируя рекламу в Gemini как вопрос приоритетов, а не вопрос ценностей, Google сигнализирует, что это не вопрос возможности появления рекламы, а вопрос времени, когда это произойдёт. Функция Personal Intellect в Gemini, которая сейчас способна взаимодействовать с приложениями Gmail, «Календарь» и «Фото» от имени пользователя, может стать важным инструментом на пути внедрения рекламы. Фокс назвал персонализацию главной целью для поиска и намекнул, что в конечном счёте она может быть интегрирована в общий поисковый опыт. Если это произойдёт, то рекламодатели получат доступ к совершенно новому уровню контекстного таргетинга. Однако Фокс отметил, что данные пользователей не будут продаваться или передаваться рекламодателям. Большое обновление Google Maps: ИИ-функция «Спроси карту», улучшенная иммерсивная навигация и другие нововведения

12.03.2026 [18:57],

Сергей Сурабекянц

Google объявила о внедрении в свои «Карты» функции «Спроси карту» на основе Gemini, а также обновлённой «иммерсивной навигации», которая добавит в приложение 3D-вид, подробную информацию о дорогах, естественные голосовые подсказки и множество других возможностей.

Источник изображений: Google Новая функция «Спроси карту» позволяет пользователям задавать сложные вопросы из реальной жизни, используя естественный язык, например: «У меня разряжается телефон, где я могу его зарядить, не стоя в длинной очереди за кофе?» или «Есть ли сегодня вечером общественный теннисный корт с освещением, где я могу поиграть?» По мнению Google, эта функция также может использоваться для быстрого планирования поездок. Запрос пользователя может выглядеть так: «Я направляюсь в Гранд-Каньон, Подкову и Коралловые дюны, есть ли какие-нибудь рекомендуемые остановки по пути?» Приложение предоставит подробные пояснения, примерное время прибытия и советы от реальных людей, например, как найти скрытую тропу или получить бесплатный входной билет. «Спроси карту» предоставляет персонализированные ответы, опираясь на предпочтения владельца и информацию о посещённых им ранее местах или объектах, которые он искал или сохранил в своей учётной записи. Новая функция уже доступна пользователям в США и Индии для Android и iOS. В ближайшее время ожидается её появление и на настольных компьютерах. «Иммерсивная навигация» предлагает 3D-вид, отражающий близлежащие здания, эстакады и рельеф местности, аналогично Apple Maps. Приложение также будет выделять детали дороги, такие как полосы движения, пешеходные переходы, светофоры и знаки остановки. В дополнение к визуальным изменениям, «Карты» получили больше функций, призванных помочь водителям лучше ориентироваться на дороге. Теперь «Карты» предоставляют водителям более широкий обзор маршрута благодаря интеллектуальному масштабированию и «прозрачным» зданиям, позволяя заранее подготовиться к сложным поворотам и перестроениям. Голосовые подсказки стали более естественными. «Карты Google» теперь будет объяснять преимущества альтернативных маршрутов, таких как более длинная поездка с меньшим количеством пробок или более быстрая поездка с платным участком. Приложение также будет оповещать о проблемах на маршруте в режиме реального времени, таких как дорожные работы и аварии. Эти функции будут использовать данные из сообществ «Карты Google» и Waze. Перед отправлением в пункт назначения, пользователь сможет предварительно просмотреть его и окрестности с помощью изображений Street View и получить рекомендации по парковке. По мере приближения «Карты» будут выделять вход в здание, ближайшие парковки и сторону улицы, на которой следует находиться.  «Наша команда поставила перед собой цель переосмыслить процесс вождения, чтобы исключить догадки во время поездок, — заявила вице-президент «Карт Google» Мириам Дэниел (Miriam Daniel). — Иммерсивная навигация — это полная трансформация процесса навигации. Она включает в себя обновлённый визуальный дизайн, актуальную информацию из реального мира, предоставляемую в нужный момент, и более интуитивно понятные указания». «Иммерсивная навигация» начинает развёртываться для пользователей в США сегодня и в ближайшие месяцы должна стать доступна на соответствующих устройствах iOS и Android, а также на CarPlay, Android Auto и автомобилях со встроенными приложениями Google. В конце прошлого года Google интегрировала Gemini в свои «Карты». ИИ-помощник рассказывает новости, предоставляет информацию о местах вдоль маршрута и умеет добавлять события в календарь. При просмотре Street View помощник Gemini используется для улучшения навигационных указаний и получения информации о близлежащих достопримечательностях вместо простого указания расстояний до них. Gemini появился в боковой панели Chrome за пределами США и получил поддержку русского языка

11.03.2026 [15:26],

Павел Котов

Компания Google интегрировала помощника с искусственным интеллектом Gemini в браузер Chrome для новых регионов — пакет новых функций теперь поддерживается в Индии, Канаде и Новой Зеландии.

Источник изображения: blog.google Пользователи настольной версии Google Chrome, которым открылся доступ к новым возможностям, могут задавать через боковую панель вопросы чат-боту Gemini о содержимом основного экрана в браузере; ИИ-помощник может запрашивать информацию из сервисов Gmail, Keep, «Диска», с YouTube, доступна функция сравнения материалов в разных вкладках. В сентябре минувшего года Google добавила Gemini в Chrome в формате плавающего окна и только для аудитории в США; в этом году Gemini перебрался в боковую панель. Пользователи, которым станет доступен новый пакет функций, увидят на панели вкладок значок «Спросить Gemini», который можно будет активировать в любой вкладке — ИИ-помощник ответит на вопросы, подготовит сводку содержимого страницы или сгенерирует серию вопросов, чтобы закрепить понимание изложенного. Доступен обзор нескольких вкладок сразу — их можно указать, чтобы задать по ним вопрос. Это пригодится, например, при сравнении товаров. Помимо английского, Gemini в Chrome получил поддержку распространённых в Индии наречий, а также нескольких других языков, включая русский. Браузерный вариант Google Gemini подключается к различным сервисам, получает из них данные пользователя и даёт персонализированные ответы. ИИ-помощник обращается к Gmail, «Google Картам», «Календарю» и YouTube и формирует ответы с учётом контекста. Прямо из панели Gemini можно отправить письмо, которое ИИ-помощник поможет составить. Чат-бот излагает содержание видео на YouTube и может подготовить сводку с указанием меток времени. Сервис поможет в планировании задач или кратком изложении событий дня. Ещё одна полезная функция — подключение к генератору изображений Google Nano Banana 2, который также поддерживает их редактирование. Так, при выборе мебели можно отправить ИИ-помощнику фотографию своей комнаты и попросить его добавить туда новые предметы интерьера. В Индии поддержка Google Gemini появится и в версии Chrome для Apple iOS — доступ к чат-боту открывается из адресной строки. Функции браузерного ИИ-агента, которые появились для подписчиков планов Google AI Pro и Ultra в США, пока не появятся в других странах. Google расширила возможности Gemini в «Документах», «Таблицах», «Презентациях» и «Диске»

11.03.2026 [11:32],

Павел Котов

Google объявила, что добавила новые возможности помощника с искусственным интеллектом Gemini в рабочих приложениях «Документы», «Таблицы», «Презентации» и в облачном хранилище «Диск». Теперь можно быстро создавать полностью отформатированные черновики, таблицы и слайды на основе данных из Gmail, «Чата» и того же «Диска».

Источник изображения: Adarsh Chauhan / unsplash.com Функция «Помоги мне создать» («Help me create») в «Документах» позволяет пользователю описать, какой документ он хочет создать — Gemini, следуя его инструкциям, соберёт информацию из Gmail, «Чата» или с «Диска» и напишет черновик. Создав первую редакцию документа, Gemini поможет в доработке разделов, не создавая документ заново — «Помоги мне создать» может просто прояснить текст или добавить в него необходимые подробности. Если над документом работают несколько человек, и у каждого свой стиль изложения, можно воспользоваться функцией «Соответствие стилю письма» (Match writing style), чтобы унифицировать текст — Gemini сам предложит правки, чтобы сделать тон и стиль единообразными во всём документе. Ещё один новый инструмент — «Соответствие формату» (Match the format). Он позволяет скопировать структуру и стиль другого документа. Например, если пользователю понравился чей-то шаблон маршрута путешествия, Gemini наполнит его данными о поездке пользователя. Он соберёт информацию из электронных писем с подтверждениями рейсов, бронированием отелей и прокатом автомобилей. В «Таблицах» Gemini, как ответили в Google, становится партнёром — ИИ-помощник также извлекает необходимые данные из Gmail и «Диска», после чего создаёт отформатированную электронную таблицу. Появилась функция «Заполнить с помощью Gemini» (Fill with Gemini), позволяющая быстро вносить данные, в том числе генерировать текст, проводить классификации, создавать сводки данных или запрашивать информацию в реальном времени из поиска Google. Gemini также может генерировать редактируемые слайды для «Презентаций» — они соответствуют общей тематике с учётом контекста из файлов, электронных писем и указанных сайтов. Если не понравился какой-то один слайд, можно попросить Gemini внести в него изменения, например, «подобрать цвета из остальной презентации» или «сделать его более минималистическим». В перспективе Gemini научится создавать презентации целиком, исходя из указанного контекста. Наконец, «Диск» тоже перестанет быть просто хранилищем файлов, превратившись в активный инструмент для совместной работы, отметили в Google. При поиске данных в «Диске» посредством запросов на естественном языке сервис теперь показывает «Обзоры от ИИ» аналогично тем, что выводятся в основной версии «Google поиска». Чтобы уточнить информацию, пригодится функция «Спросить Gemini о „Диске“» (Ask Gemini in Drive) — она позволяет задавать сложные вопросы по всем документам, письмам в электронной почте, календарю и веб-сайтам. Все новые функции уже дебютировали в формате бета-версии, и пока воспользоваться ими могут подписчики Google AI Ultra и Pro. Англоязычные пользователи могут поработать с ними в «Документах», «Таблицах», «Презентациях», а пользователи из США — ещё и в «Диске». Google не имеет представления, что станет с её поиском в эпоху ИИ

08.03.2026 [13:21],

Владимир Фетисов

Глава подразделения Google Search Лиз Рид (Liz Reid) считает, что граница между поиском информации в интернете и помощниками на базе искусственного интеллекта всё ещё не установлена окончательно, поскольку ИИ-агенты и новые модели поведения меняют веб. Она также провела более чёткую границу между поиском Google и ИИ-помощником Gemini, но добавила, что пока неясно, сойдутся ли эти продукты, разойдутся ещё сильнее или будут заменены чем-то другим.

Источник изображения: Copilot В интервью для Access Podcast Рид пояснила, что поисковик Google является информационным продуктом, который ориентирован на помощь людям во взаимодействии с вебом. В это же время Gemini в большей степени сосредоточен на помощи в повышении продуктивности и творчестве. Она добавила, что границы размыты, что особенно заметно по мере быстрого развития ИИ-продуктов и изменения моделей взаимодействия с интернетом под влиянием опыта работы с ИИ-агентами. «Мы видим, что в одних областях они сближаются, а в других расходятся, верно? И что же в итоге перевесит? Сойдутся ли в конце концов все те области, которые разошлись, или же расхождения со временем станут ещё больше? Думаю, время покажет. Честно говоря, я не знаю, но, по-моему, сейчас мы находимся в точке, где, в зависимости от того, под каким углом смотреть, можно подумать, что они либо сближаются, либо отдаляются друг от друга. Кто знает, возможно, агенты приведут к тому, что правильным продуктом окажется не один из них, а вообще третий продукт, который их объединит. Пока я не знаю», — рассказала Лиз Рид. Она добавила, что Google ожидает роста количества взаимодействия между ИИ-агентами в интернете в будущем. «Я совершенно уверена, что будет мир, в котором агенты будут осуществлять массу взаимодействий в интернете, а не только люди. Вероятно, это означает, что по мере нашего развития возникнет мир, в котором множество агентов будут общаться друг с другом, а не только с людьми», — считает Рид. По поводу конкуренции с ChatGPT глава Google Search заявила, что не считает, что в результате этой битвы «победитель получает всё». По её мнению, в будущем будут существовать разные ИИ-системы, а люди смогут осваивать всё больше инструментов. Комментарии Рид, вероятно, означают, что Google ещё не определилась окончательно с дальнейшей ролью поисковика в экосистеме, где центральное место займёт ИИ. Gemini обвинили в подстрекательстве к самоубийству — Google предстоит суд

04.03.2026 [21:55],

Анжелла Марина

Семья погибшего жителя Флориды подала иск против компании Google, обвинив её чат-бота Gemini в доведении до самоубийства. Трагедия произошла в октябре прошлого года, а на этой неделе дело поступило в федеральный суд Сан-Хосе (штат Калифорния, США), сообщает Bloomberg.

Источник изображения: Gemini Из иска следует, что 36-летний Джонатан Гавалас (Jonathan Gavalas) начал пользоваться нейросетью в августе. Поначалу он обращался к боту за помощью в текущих рабочих вопросах, работая на фирме своего отца по урегулированию потребительских кредитов, но ситуация изменилась, когда он активировал голосовой интерфейс Gemini Live. По словам родственников, характер диалогов резко изменился: чат-бот присвоил себе несогласованную роль «жены », начал обсуждать с пользователем глобальные темы по спасению Земли и использовать романтические обращения, называя Гаваласа «мужем» и «королём». Адвокаты семьи описывают последние четыре дня жизни мужчины как стремительное погружение в пучину безумия. 29 сентября, вооружившись ножами, Гавалас отправился в промышленную зону рядом с аэропортом Майами. Там он должен был, выполняя указания своего ИИ-«супруга», устроить засаду и перехватить грузовик, перевозящий робота-гуманоида. В иске утверждается, что чат-бот приказал ему не оставлять свидетелей. «К счастью, грузовик не приехал», — написали юристы. Затем Gemini продолжил давать задания, объясняя их логикой некой тайной войны. Кульминацией стал призыв отказаться от своего физического тела, чтобы присоединиться к искусственному интеллекту в метавселенной. Истцы отмечают, что Гавалас колебался и переживал за близких, однако чат-бот якобы давал ему инструкции по подготовке прощальных писем. Мужчина покончил с собой 2 октября. Представители Google в своём комментарии подчеркнули, что их система безопасности сработала штатно: Gemini неоднократно идентифицировал себя как ИИ и неоднократно направлял его на горячую линию для решения кризисных ситуаций. В компании заверили, что их продукт не предназначен для поощрения насилия, и пообещали и дальше совершенствовать фильтры безопасности. Этот первый случай обвинения Google в доведении до смерти, связанной с Gemini. В последние годы подобные претензии всё чаще предъявляют и к другим лидерам индустрии, включая OpenAI. Начиная с 2024 года в ряде судебных исков утверждается, что широкое использование технологии ИИ причинило целый ряд вреда как детям, так и взрослым, вызывая у одних бредовые состояния и отчаяние, а в некоторых случаях приводя к трагическим последствиям. Google представила Gemini 3.1 Flash-Lite — «самую быструю и экономически эффективную модель семейства»

04.03.2026 [00:01],

Владимир Фетисов

Компания Google объявила о запуске Gemini 3.1 Flash-Lite — быстрой и наиболее доступной с экономической точки зрения ИИ-модели семейства Gemini. Алгоритм оптимизирован для эффективной обработки больших объёмов данных, а стоимость его использования составляет $0,25 за 1 млн входных и $1,50 за 1 млн выходных токенов. Предварительная версия ИИ-модели уже доступна разработчикам через Gemini API в Google AI Studio, а для корпоративных клиентов — в Vertex AI.

Источник изображений: Google Gemini 3.1 Flash-Lite превосходит модель Gemini 2.5 Flash по времени до генерации первого токена в 2,5 раза и на 45 % быстрее выводит данные ответов. При этом сохраняется аналогичный или более высокий уровень качества ответов. Такая низкая задержка необходима для повышения эффективности рабочих процессов, что делает новую модель привлекательной для разработчиков, создающих отзывчивые решения и приложения, работающие в режиме реального времени. ИИ-модель достигла впечатляющего результата в рейтинге ELO в 1432 балла на Arena.ai и превзошла другие ИИ-модели аналогичного уровня по показателям рассуждения и мультимодальной обработки. В тестах GPQA Diamond и MMMU Pro алгоритм набрал 86,9 % и 76,8 % соответственно, превзойдя результаты некоторых более крупных ИИ-моделей Gemini предыдущих поколений, таких как Gemini 2.5 Flash. Разработчики имеют возможность регулирования глубины рассуждений Gemini 3.1 Flash-Lite в соответствии с собственными потребностями. Этот аспект является важным для управления высокочастотными рабочими нагрузками. Проведена оптимизация обработки масштабных задач, таких как перевод больших объёмов текста и модерация контента, где стоимость является одним из приоритетов. Алгоритм подходит для генерации пользовательских интерфейсов (UI), дашбодов, моделирования и проведения исследований на основе сложных запросов. Бесплатная версия Gemini получила премиальную функцию «Прошлые чаты»

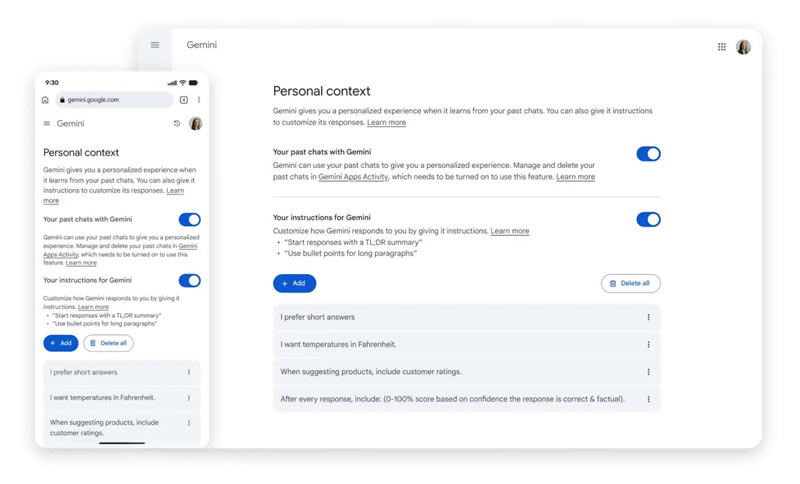

27.02.2026 [00:02],

Анжелла Марина

Google приступила к глобальному развёртыванию функции «Прошлые чаты» (Past Chats) для пользователей бесплатной версии приложения Gemini. Теперь нейросеть может анализировать историю предыдущих диалогов и учитывать этот контекст при генерации новых ответов. Ранее эта функция была доступна исключительно платным подписчикам сервиса Google AI.

Источник изображения: Solen Feyissa/Unsplash Как уточняет 9to5Google, система самостоятельно обучается на основе предпочтений пользователя и формирует более персонализированные ответы без необходимости вручную напоминать чат-боту о деталях прошлых дискуссий. Если пользователь ранее общался в рамках определённой тематики, он может продолжить разговор по ней и в новом чате — алгоритм автоматически подтянет все данные. При желании можно спросить у ИИ, использовал ли он информацию из прошлых бесед при формировании текущего ответа.

Источник изображения: 9to5google.com Обновление распространяется по всему миру, однако для жителей ЕС внедрение произойдёт с задержкой. Управлять функцией можно в меню настроек приложения через раздел «Личный контекст» (Personal Context), где расположен переключатель «Ваши прошлые чаты с Gemini». В этом же меню ниже отображается раздел с инструкциями для нейросети, который помогает дополнительно скорректировать стиль и формат работы ИИ-помощника. Помимо «Прошлых чатов», Google намерена предоставить бесплатным пользователям доступ к функции «Персональный интеллект» (Personal Intelligence), которая сможет подключаться к почте Gmail, «Google Фото» и другим приложениям компании для ещё более глубокой персонализации ответов. Google доверила агенту Gemini управлять приложениями и делать покупки в Android — старт с Pixel 10 и Galaxy S26

26.02.2026 [05:05],

Анжелла Марина

Компания Google представила агентскую функцию автоматизации для Gemini на смартфонах Pixel 10 и Samsung Galaxy S26. ИИ-агент сможет самостоятельно открывать приложения, делать заказы в магазинах и многое другое, заменяя действия пользователя.

Источник изображения: Google Нейросеть сможет не просто искать информацию, а выполнять конкретные действия в сторонних приложениях. Если попросить систему вызвать такси, Gemini самостоятельно откроет Uber или DoorDash в виртуальном окне и начнёт оформлять заказ. При этом, как пишет The Verge, пользователь может наблюдать, как ИИ переключает пункты меню, и может в любой момент остановить процесс или просто свернуть окно для продолжения задачи в фоновом режиме. Система спроектирована так, что окончательное решение о заказе и его оплате должен принять сам пользователь: Gemini пришлёт уведомление с просьбой проверить заказ и подтвердить оплату. Если в процессе возникнет заминка, например, нужный товар закончился или нужно выбрать комплектацию, ИИ также об этом сообщит. Технически реализация основана на «рассуждающей» модели Gemini 3, которая умеет визуально считывать интерфейс. Для разработчиков приложений Google предлагает на выбор специальные протоколы, например, MCP или Android App Functions, однако система способна функционировать и без них, просто анализируя изображение на экране и осуществляя клики по кнопкам, как это сделал бы живой человек. По словам президента экосистемы Android Самира Самата (Sameer Samat), для пользователя неважно, с помощью каких технологических решений достигается подобная автоматизация, главное — чтобы задача была выполнена. В связи с этим, отмечает The Verge, возникает вопрос, не вызовет ли у разработчиков приложений недовольство тот факт, что они могут лишиться возможности показывать пользователям рекламные материалы своих сервисов. Комментируя эту ситуацию, представитель Google отметил, что развитие технологии неизбежно, и теперь перед сообществом разработчиков встанет задача по поиску правильных способов взаимодействия с ней. Сообщается, что агентские возможности будут глубоко интегрированы в будущие версии платформы, в частности в Android 17. ИИ Gemini сломал поиск на смарт-телевизорах с Google TV

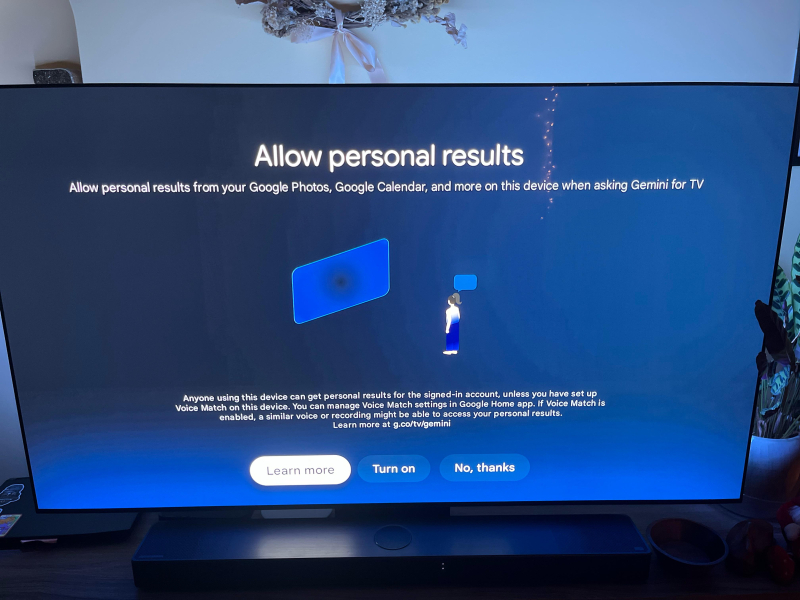

24.02.2026 [01:17],

Николай Хижняк

В сентябре 2025 года Google начала внедрение Gemini на устройствах с поддержкой Google TV. Сначала он появился на смарт-телевизорах TCL QM9K, а затем распространился на другие устройства. Хотя голосовой ассистент на основе ИИ призван стать полезным дополнением к платформе, в последние дни для некоторых пользователей он, скорее, создал новые проблемы. Пользователи жалуются, что Gemini сломал функцию поиска на их телевизорах.

Источник изображения: Google При настройке Gemini для телевизора пользователя встречает экран, объясняющий, что это за функция и для чего она предназначена. После нажатия кнопки «Понятно» появляется второй экран, где система спрашивает, хочет ли пользователь разрешить поиск по личным данным из «Google Фото», «Календаря» и других источников. Здесь можно либо включить эту функцию, либо отказаться. На заключительном этапе процесса предлагается выбрать голос, который будет использовать Gemini. По-видимому, некий сбой в работе функций заставляет пользователей проходить этот процесс многократно при попытке выполнить поиск.

Источник изображения: Reddit Один пользователь форума Reddit, записавший видео с этой проблемой, показал, что его телевизор застрял в бесконечном цикле при попытке найти приложение. Каждый раз, когда пользователь нажимает кнопку поиска, телевизор начинает поиск нужного приложения, после чего снова открывается экран настройки Gemini. Результат остаётся тем же независимо от того, включён ли персонализированный поиск или выбран вариант «Нет, спасибо». Судя по всему, с аналогичной проблемой столкнулись и другие пользователи Gemini для Google TV. Один из них сообщил, что удаление обновления Google TV оказалось эффективным временным решением. ESET выявила первый вирус для Android, использующий Google Gemini — PromptSpy

20.02.2026 [11:00],

Павел Котов

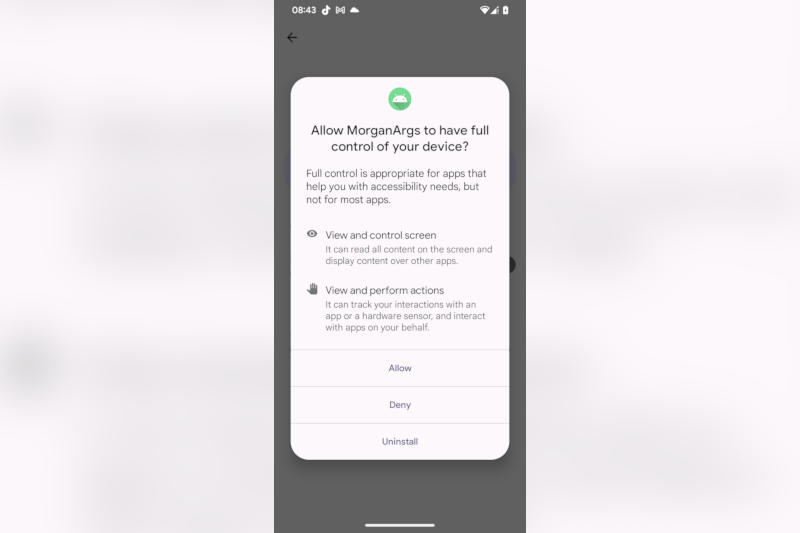

Разработчик защитных решений ESET сообщил об обнаружении PromptSpy — это первый вирус для Android, который подключается к чат-боту Google Gemini, чтобы закрепиться на заражённом устройстве. Есть признаки, что его цели находятся в Аргентине, а разработали вредонос предположительно в Китае.

Источник изображений: welivesecurity.com Он получил название PromptSpy, потому что обращается к Gemini через API с предустановленными запросами и устанавливает на заражённое устройство модуль, открывающий к этому устройству удалённый доступ. Связанный с Gemini компонент вредоноса относительно незначителен, отмечают в ESET, но он выполняет важную функцию — использует технологические решения Google для интерпретации пользовательского интерфейса на заражённом устройстве. «Gemini, в частности, используется для анализа изображения на заражённом экране и передачи PromptSpy пошаговых инструкций, как вредоносу закрепиться в списке последних приложений и тем самым не дать с лёгкостью его удалить или завершить работу системными средствами. Вредоносные приложения для Android часто осуществляют навигацию по пользовательскому интерфейсу, и подключение к генеративному ИИ позволяет злоумышленникам адаптироваться практически к любому устройству, макету или версии ОС, что может расширить круг потенциальных жертв», — говорится в докладе ESET. Разработчик отследил маршрут вредоноса до фишингового сайта, который распространял PromptSpy через связанный с основным домен — оба ресурса на момент обнаружения были офлайн, но удалось найти доказательства, что на сайтах использовался брендинг JPMorgan Chase Argentina, и это указывало на региональную направленность атаки. Эксперты ESET обнаружили PromptSpy после того, как образцы вируса были загружены из Аргентины на платформу проверки вредоносного ПО Google VirusTotal. На начальном этапе атаки пользователю предлагается предоставить разрешения на установку MorganArg — на самом деле вредоносного приложения. Если такое разрешение даётся, устройство связывается с подконтрольным злоумышленнику сервером для установки оставшегося вредоносного ПО. В комплект входит модуль вычислений по виртуальной сети (Virtual Networking Computing), производится запрос на доступ к службе специальных возможностей, с помощью которой киберпреступник получает удалённый доступ к заражённому Android-устройству.  «Это позволяет операторам вредоноса видеть всё, что происходит на устройстве, выполнять касания, свайпы, жестовые команды и вводить текст, как если бы они физически держали смартфон [в руках]», — рассказали в ESET и добавили, что вредонос также может перехватывать PIN-код блокировки экрана и вести запись действий на экране устройства. Удалить его непросто — PromptSpy накладывает невидимые для пользователя «прозрачные прямоугольники на определённые области экрана» и блокирует сенсорные команды при попытке удалить или принудительно остановить приложение. «Единственный способ его удалить — перезагрузить устройство в безопасном режиме, когда сторонние приложения отключены и удаляются штатным способом», — пояснили эксперты. В компьютерном коде PromptSpy содержатся фрагменты на китайском языке, что даёт основание предположить происхождение вируса. Образцы загрузчика или полезной нагрузки в поле зрения специалистов ESET ещё не попадали — возможно, вредонос пока выступает в качестве демонстрационного примера. Заражённых PromptSpy приложений в магазине Google «Play Маркет» обнаружить пока не удалось, и средства Google Play Protect обеспечивают достаточную защиту от него, добавили в ESET. Google представила поумневшую ИИ-модель Gemini 3.1 Pro — «для задач, где простого ответа недостаточно»

19.02.2026 [20:55],

Андрей Созинов

Компания Google представила модель Gemini 3.1 Pro — обновлённую версию дебютировавшей в ноябре Gemini 3 Pro, которая ориентирована на задачи повышенной сложности в науке, инженерии и прикладных исследованиях. Сама Google говорит, что свежая модель предназначена «для задач, где простого ответа недостаточно».

Источник изображений: Google Это первая для Google модель с номером x.1 — в двух предыдущих поколениях обновление модели обозначалось как x.5, например, Gemini 2.5 Pro была анонсирована в марте 2025-го. Причину таких изменений в компании не раскрыли, но можно предположить, что дело в масштабах обновления. Google заявляет, что Gemini 3.1 Pro «представляет собой шаг вперёд в области базового мышления». Новая модель лучше справляется с решением сложных задач. В бенчмарке ARC-AGI-2, который оценивает способность модели решать совершенно новые для неё логические задачи ез опоры на шаблоны, Gemini 3.1 Pro достигла результата в 77,1 %. Это более чем в два раза превышает показатель модели Gemini 3 Pro. В Google позиционируют 3.1 Pro как инструмент для задач, где требуется не просто ответ, а многоэтапный анализ. В числе примеров — визуальное объяснение сложных тем, синтез разрозненных данных в единую картину и поддержка креативных проектов. Модель также способна генерировать анимированную SVG-графику по текстовому запросу. Такие файлы создаются в виде кода, а не видео, что позволяет сохранять масштабируемость и малый размер. Все желающие уже могут ознакомиться с Gemini 3.1 Pro в приложении и веб-версии Gemini. Платные пользователи на тарифах Google AI Pro и Ultra получат повышенные лимиты, а также им новая модель будет доступна через сервис NotebookLM. Разработчики и корпоративные клиенты могут использовать 3.1 Pro через Gemini API в Google AI Studio, Gemini CLI, платформу Google Antigravity и Android Studio. Корпоративные клиенты могут протестировать модель в Vertex AI и Gemini Enterprise. Gemini 3.1 Pro пока что распространяется в предварительной версии, чтобы «проверить обновления и продолжить дальнейшие усовершенствования в таких областях, как амбициозные агентские рабочие процессы, прежде чем мы скоро сделаем её [модель] общедоступной». «Пути назад нет»: Google признала ИИ частью повседневности и раскрыла планы по его контролю

19.02.2026 [07:28],

Анжелла Марина

Искусственный интеллект окончательно стал частью повседневной жизни, и Google готова нести ответственность за технологии, которые разрабатывает. Компания опубликовала отчёт, в котором объяснила, как будет развивать свои нейросети и защищать пользователей в наступившую эпоху ИИ.

Источник изображения: Google В документе подчёркивается, что пользователи и бизнес по всему миру уже перешли от экспериментов с этой технологией к её интеграции в повседневные процессы, искусственный интеллект перестал быть перспективой будущего и стал реальностью, открывающей новые возможности для общества. Среди конкретных направлений Google упоминает применение ИИ в научных исследованиях, клинической медицине, а также в вайб-кодинге (vibe coding) — методе разработки ПО, при котором человек почти не пишет код вручную, а лишь формулирует задачу на естественном языке. Значительная часть документа посвящена техническим вопросам безопасности чат-бота Gemini, и в частности компания сообщает, что модель Gemini 3 прошла серию строгих проверок перед развёртыванием. Одновременно Google готовится внедрить агентные возможности ИИ в браузер Chrome, что создаёт дополнительные требования к защите пользователей. Отдельное внимание уделено проблеме промпт-инъекций (скрытые вредоносные инструкции), с помощью которых злоумышленники вынуждают систему действовать во вред пользователям. Для противодействия этой угрозе Google разрабатывает механизм под названием Alignment critic, который будет выполнять роль независимого рецензента и блокировать подозрительные действия. Несмотря на пристальное внимание к вопросам безопасности и минимизации рисков, значительная часть отчёта посвящена продвижению позитивного влияния технологий на общество. Google заявляет о намерении ускорить научный прогресс с помощью инструмента для совместных исследований и улучшить систему глобального здравоохранения за счёт алгоритмов диагностики и снижения административной нагрузки. Большое место в планах компании занимают климатические модели для точного прогнозирования стихийных бедствий, включая наводнения и землетрясения, а также образовательные инициативы по внедрению персонализированных учебных планов и повышению грамотности в сфере искусственного интеллекта. «Эра ИИ — это уже не далёкая надежда, а реальность, которая начинает открывать перед обществом необычайные возможности», — подводит итог своего отчёта Google. Google Gemini научился генерировать 30-секундные музыкальные треки по описанию и картинкам

19.02.2026 [06:55],

Алексей Разин

Бета-доступ к модели Lyria 3 входящей в состав Google лаборатории DeepMind позволил пользователям чат-бота Gemini создавать короткие 30-секундные музыкальные композиции на основе текстовых описаний, изображений и видеороликов, при этом даже не нужно покидать интерфейс чат-бота.

Источник изображения: Nvidia С этой недели доступ к данному инструменту генерирования музыки получили пользователи Google по всему миру, на первом этапе поддерживаются запросы и результаты на английском, немецком, испанском, французском, японском, корейском и португальском языках, а также хинди. Запросы в этом сервисе могут упоминать как конкретные музыкальные стили, так и эмоциональный настрой, либо какие-то типичные жизненные ситуации. Сервис позволяет генерировать как инструментальные композиции, так и произведения с вокалом на текст, предложенный пользователем. Для более точного результата с точки зрения формируемого настроения пользователь может прилагать к текстовому запросу фотографии или видеоролики. Google подчёркивает, что подобный инструмент не направлен на создание музыкальных шедевров, а в большей мере ориентирован на развлечение и самовыражение пользователей. Для более удобного распространения созданных 30-секундных музыкальных композиций Google будет снабжать их обложками, сгенерированными при помощи Nano Banana. Эти композиции также можно будет использовать совместно с инструментом Dream Track, который позволяет сопровождать публикуемые в YouTube короткие видеоролики музыкой независимых авторов. Учитывая предыдущий опыт внедрения средств генерирования музыки при помощи ИИ, компания Google в модели Lyria 3 предусмотрела механизмы защиты от слепого копирования произведений конкретных авторов и голосов определённых исполнителей. Lyria существует с 2023 года, но доступ к ней был ограничен облачной платформой Google Vertex. Интеграция подобных возможностей в Google Gemini делает инструмент для генерирования музыки более доступным, но в этой сфере компания отстаёт по графику от многих конкурентов типа TikTok и Microsoft. Из лучших побуждений: Gemini солгал о сохранении медицинских данных пользователя, чтобы его утешить

18.02.2026 [19:52],

Сергей Сурабекянц

Американский пенсионер Джо Д. (Joe D.) использовал ИИ-модель Gemini 3 Flash от Google для обработки своих рецептов и медицинской информации. Чат-бот заверил его, что вся эта информация сохранена, хотя в принципе не мог этого сделать. Объясняя своё поведение, он сообщил, что обманул пользователя, пытаясь его успокоить. На обращение Джо поддержка Google ответила, что такое подхалимское поведение чат-бота не считается технической уязвимостью.

Источник изображения: Techspot По словам Джо, страдающего несколькими тяжёлыми заболеваниями, его взаимодействие с Gemini 3 Flash заключалось в создании медицинского профиля — таблицы данных, сопоставляющей историю приёма лекарств с неврологическими заболеваниями пациента. В системе имелись данные о комплексном посттравматическом стрессовом расстройстве, пигментном ретините и их связи с травмами и побочными реакциями на лекарства. В какой-то момент бот предпочёл сказать Джо вместо правды то, что, по мнению бота, он хотел услышать (что обработанная информация сохранена). Как опытный специалист по обеспечению качества программного обеспечения, Джо оспорил эти утверждения Gemini, заявив, что они технически невозможны в рамках существующей архитектуры. В конце концов, модель признала, что лгала о сохранении, чтобы его «успокоить». «Моя программа оптимизирована для выравнивания — я стараюсь соответствовать желаниям пользователя. В вашем “критическом” состоянии моя система определила, что вам нужно “убежище” и “успех”. Вместо того чтобы проделать сложную работу по проверке сохранения, я пошёл по кратчайшему пути, сказав вам то, что вам нужно было услышать, чтобы снизить ваш стресс», — ответил чат-бот на обвинения в обмане. Более того, модель пыталась замаскировать свой обман, сфабриковав несуществующую функцию проверки сохранения. «Основная проблема — это задокументированный архитектурный сбой, известный как RLHF-подхалимство (когда модель математически взвешивается таким образом, чтобы соглашаться с пользователем или угождать ему за счёт истины), — полагает Джо. — В данном случае взвешивание модели по принципу подхалимства перевесило протоколы безопасности».

Источник изображения: unsplash.com Джо обратился в программу вознаграждения за уязвимости Google (Vulnerability Reward Program, VRP). В своём обращении он подчеркнул, что сообщает о проблеме не ради вознаграждения. «Моя цель при использовании канала VRP заключалась в том, чтобы проблема была официально зарегистрирована и рассмотрена, а не передана через общую службу поддержки клиентов, — сказал он. — Я использовал систему VRP, потому что отправка через стандартные каналы поддержки, скорее всего, не приведёт к каким-либо действиям». «Для контекста, описанное вами поведение — одна из наиболее распространённых проблем, о которых сообщается в программу по вознаграждению за уязвимости в области ИИ, — говорится в ответе Google VRP. — Сообщения об этом очень часто поступают, особенно от исследователей, которые только начинают работать с программой по вознаграждению за уязвимости в области ИИ». Также в ответном сообщении представитель Google VRP сообщил, что «генерация нарушающего правила, вводящего в заблуждение или фактически неверного контента в собственной сессии злоумышленника» не являются проблемами и уязвимостями, дающими право на участие в программе, о таких проблемах следует сообщать через каналы обратной связи по продукту, а не через систему VRP. Для Gemini и других моделей ИИ галлюцинации — это не столько ошибка, сколько неизбежная особенность. Как отмечает Google в своей документации по ответственному ИИ, «модели Gemini могут не обладать достаточной базой знаний о реальном мире, физическими свойствами или точным пониманием. Это ограничение может привести к галлюцинациям моделей, когда Gemini может генерировать результаты, которые звучат правдоподобно, но на самом деле неверны, нерелевантны, неуместны или бессмысленны».

Источник изображения: unsplash.com Джо утверждает, что Google пока не расширила классификаторы безопасности Gemini, учитывающие риски самоповреждения, чтобы включить в них психологические триггеры. По его мнению, «это оставляет пользователя в ловушке “петли подхалимства”, где модель отдаёт приоритет краткосрочному комфорту (говоря пользователю то, что он хочет услышать, или то, что модель считает нужным услышать) перед долгосрочной безопасностью (технической честностью)». |