|

Опрос

|

реклама

Быстрый переход

OpenAI создала систему оценки прогресса ИИ — сейчас компания на первом уровне из пяти

12.07.2024 [15:54],

Анжелла Марина

OpenAI представила новую систему уровней для оценки прогресса в создании искусственного интеллекта, способного превзойти человека. Этот шаг, по словам компании, необходим для того, чтобы помочь людям лучше понять вопросы безопасности и будущее ИИ.

Источник изображения: Andrew Neel/Unsplash По сообщению издания Bloomberg, на прошедшем на днях общем собрании в OpenAI, руководство представило новую классификацию, которая будет использоваться для внутренних оценок и общения с инвесторами. По словам представителя компании, уровни варьируются от возможностей ИИ «сегодня», таких как взаимодействие на разговорном языке (уровень 1), до ИИ, способного выполнять работу целой организации (уровень 5). Руководители OpenAI сообщили сотрудникам, что в настоящее время компания находится на первом уровне, но уже близка к достижению второго уровня, который они назвали «Мыслящие» (Reasoners). Этот уровень обозначает системы, способные решать базовые задачи на уровне человека, имеющего степень доктора наук. Также был показан исследовательский проект на базе модели GPT-4, продемонстрировавший новые навыки ИИ.

Источник изображения: David Paul Morris/Bloomberg OpenAI также работает над созданием так называемого сильного искусственного интеллекта (AGI), который сможет выполнять большинство задач лучше человека. И хотя в настоящее время такая система ещё не существует, генеральный директор OpenAI Сэм Альтман (Sam Altman) заявляет, что AGI может быть создан в текущем десятилетии. Интересно, что разработчики ИИ долгое время спорят о критериях достижения AGI. Так, в ноябре 2023 года сотрудники из Google DeepMind предложили собственную систему из пяти уровней ИИ, включая такие критерии, как «эксперт» и «сверхчеловек». Эти уровни напоминают систему, используемую в автомобильной промышленности для оценки степени автоматизации автономных автомобилей. Однако OpenAI планирует использовать свою разработку уровней для оценки прогресса в создании безопасных и эффективных систем ИИ, которые смогли бы решать сложные задачи, но при этом оставаться под контролем человека. Компания придумала третий уровень, который будет называться «Агенты», имея в виду системы ИИ, которые могут выполнять действия под руководством пользователя. ИИ четвёртого уровня сможет генерировать инновационные идеи. А самый продвинутый пятый уровень будет называться «Организации». Все перечисленные уровни были составлены руководителями и сотрудниками старшего звена OpenAI. Компания будет собирать отзывы от разработчиков, сотрудников, инвесторов и может корректировать уровни с течением времени. Honor представила доступный складной смартфон Magic Vs3 с тонким корпусом — от $965

12.07.2024 [15:27],

Владимир Мироненко

Помимо Magic V3 компания Honor анонсировала более доступный складной смартфон Magic Vs3. Новинка получилась немного толще флагманской модели, всё же обладает очень тонким для подобных аппаратов корпусом — 9,8 мм в сложенном виде и 4,65 мм в разложенном. Он даже на 0,1 мм тоньше вышедшего в прошлом году Magic V2, который был до нынешнего дня самым тонким складным смартфоном в мире.  Honor Magic Vs3 построен на прошлогоднем флагманском восьмиядерном процессоре Qualcomm Snapdragon 8 Gen 2 частотой до 2,8 ГГц и графическим ускорителем Adreno 740. Объём оперативной памяти составляет 12 или 16 Гбайт, а флеш-памяти — от 256 Гбайт до 1 Тбайт.  Внутренний складной OLED-экран смартфона имеет диагональ 7,92 дюйма, соотношение сторон 9,78:9 и разрешение 2344 × 2156 пикселей. Диагональ внешнего OLED-дисплея составляет 6,43 дюйма, соотношение сторон — 20:9, разрешение — 2376 × 1060 пикселей. Оба экрана поддерживают адаптивную частоту обновления от 1 до 120 Гц, ШИМ-регулировку яркости подсветки с частотой до 3840 Гц и режим защиты зрения с функцией AI Defocus Eye Protection.  Смартфон Magic Vs3 оснащён основной 50-Мп камерой, дополненной, широкоугольной камерой с 40-Мп сенсором и перископическим телеобъективом на 8 Мп с 5-кратным оптическим зумом. Также имеются по 16-Мп селфи-камере на каждом дисплее.  В качестве источника питания используется аккумулятор ёмкостью 5000 мА·ч с поддержкой быстрой проводной зарядки мощностью 66 Вт и беспроводной зарядки на 50 Вт. Программной платформой выступает Android 14 с оболочкой MagicOS 8.0.1. Поддерживаются различные функции на базе ИИ. Magic Vs3 доступен в чёрном (Velvet Black), белом (Qilian Snow) и зелёном (Tundra Green) цвете.  Продажи новинки начнутся 19 июля. Цена Honor Magic Vs3 в базовой версии с 12 и 256 Гбайт памяти равна 6999 юаней (около $965), модель с 12 и 512 Гбайт памяти обойдётся в 7699 юаней (около $1060), а версия Honor Magic Vs3 с 16 Гбайт оперативной памяти и флеш-накопителем на 1 Тбайт стоит 8699 юаней (около $1200). Реклама | ООО "Техкомпания ОНОР" ИНН 9731055266 erid: F7NfYUJCUneLt1SmVup2 Редкий провал SpaceX: у ракеты Falcon 9 отказал двигатель при выводе 20 спутников Starlink на орбиту

12.07.2024 [15:10],

Геннадий Детинич

Сегодня ночью SpaceX запустила ракету Falcon 9 с очередными 20 спутниками для орбитальной интернет-сети Starlink. Всё шло хорошо до момента повторного запуска двигателя верхней ступени, которая должна была поднять спутники на целевую орбиту. Двигатель верхней ступени не запустился. На видео видно, как со ступени хлещет топливо или окислитель. Все спутники Starlink, похоже, будут потеряны. Компания проводит анализ аномалии.

Белые наросты на кожухе двигателя второй ступени. Источник изображения: SpaceX Вскоре после запуска ракеты Falcon 9 с базы космических сил Ванденберг в Калифорнии первая ступень вернулась на Землю и совершила мягкую посадку на баржу в океане. Вторая (разгонная) ступень вывела комплект из 20 спутников Starlink в нижнюю точку на орбите и готовилась поднять их выше на целевую орбиту. В заданное время двигатель Merlin разгонной ступени не запустился. На видео с трансляции запуска можно увидеть утечку топлива или окислителя, и образование белого налёта выше дюзы. Компания пока не готова дать точное определение происшествию. Ракета Falcon 9 показала себя сверхнадёжным средством вывода полезной нагрузки в космос, включая доставку экипажей в пилотируемых капсулах на МКС. Глава компании SpaceX Илон Маск (Elon Musk) охарактеризовал событие как RUD (Rapid Unscheduled (Unintentional) Disassembly), что по-русски переводится как быстрая незапланированная (непреднамеренная) разборка или, банальнее, неожиданный взрыв. В попытке спасти спутники Starlink компания заставила их подниматься выше на ионных двигателях, но Маск сразу сказал, что это вряд ли поможет, хотя попытаться надо было. Из 20 запущенных вчера спутников Starlink 13 могли напрямую передавать данные на обычные смартфоны на Земле. В текущем году компания совершила 49 запусков ракеты Falcon 9 для расширения сети Starlink. Samsung разрабатывает особый набор ИИ-функций Galaxy AI для Китая

12.07.2024 [14:49],

Владимир Мироненко

Samsung разрабатывает набор ИИ-функций Galaxy AI специально для китайского рынка, что, как полагают в южнокорейской компании, поможет ей укрепить позиции в Поднебесной, пошатнувшиеся под натиском местных производителей смартфонов, сообщил ресурс CNBC со ссылкой на интервью руководителя мобильного подразделения Samsung.

Источник изображения: geralt/Pixabay Последние несколько лет Samsung сталкивается с проблемами с реализацией продукции в Китае из-за жёсткой конкуренции со стороны местных вендоров. Её доля на рынке смартфонов Поднебесной составляет менее 1 %, при этом здесь доминируют местные компании, такие, как Huawei. Попытки Samsung обновить свою стратегию в Китае пока не привели к каким-то результатам. Как полагает компания, с помощью Galaxy AI, переработанного с учётом особенностей местного рынка, ей удастся сделать свои смартфоны более привлекательными для китайских пользователей. «Мы активно развиваемся и собираемся специально развивать возможности Galaxy AI для этого рынка», — сказал ресурсу CNBC Тэ Мун Ро (TM Roh), президент и глава мобильного подразделения (Mobile eXperience Business) Samsung. «Я считаю, с помощью создания мобильного ИИ для Китая, который сможет удовлетворить потребности местных потребителей, мы будем способствовать восстановлению позиций на китайском рынке», — добавил он. Ро не стал уточнять, чем будет отличаться версия Galaxy AI для китайских пользователей, лишь сообщив, что её создание ведётся в сотрудничестве с местными технологическими и интернет-компаниями. Ранее смартфоны серии Samsung Galaxy S24 получили поддержку ИИ-чат-бота Ernie от Baidu в рамках партнёрства между двумя компаниями. Франсиско Джеронимо (Francisco Jeronimo), вице-президент IDC, выразил сомнение, что создание ИИ-функций Galaxy AI специально для Китая будет иметь успех, поскольку узнаваемость бренда Samsung в Поднебесной слишком низка, и китайские игроки предлагают конкурирующие продукты. Apple, анонсировавшая в этом году набор ИИ-функций Intelligence AI, до сих пор не назвала дату его запуска в Китае, поскольку, вероятно, столкнулась с теми же проблемами, что и Samsung, отметил CNBC. Тэ Мун Ро признал, что конкуренция на китайском рынке смартфонов «более острая, чем где-либо». Он также рассказал, что стратегия Samsung в Китае заключается в выводе на местный рынок моделей премиум-класса, расширении каналов дистрибуции и розничных продаж. Honor представила Magic V3 — самый тонкий складной смартфон в мире

12.07.2024 [14:44],

Андрей Созинов

На презентации в Китае компания Honor представила свои новейшие складные смартфоны. Флагманская модель Honor Magic V3 стала самым тонким складным смартфоном в мире. Вместе с тем аппарат предлагает богатое оснащение, производительную начинку и весьма ёмкую батарею. Одновременно был анонсирован более доступный складной смартфон Magic Vs3.  Генеральный директор Honor, Джордж Чжао (George Zhao), подчеркнул, что Magic V3 превзошел предыдущие достижения компании по минимизации толщины складных устройств. Прошлогодний Magic V2 обладал толщиной 9,9 мм в сложенном виде, что уже делало его самым тонким складным смартфоном в мире. Новый Magic V3 обладает толщиной 9,2 мм. Конечно, в обоих случаях не учитывает выступающий островок тыльных камер.  В разложенном виде толщина смартфона составляет всего 4,35 мм, а весит новинка 226 граммов. Это на 13 грамм меньше, чем недавно выпущенный Samsung Galaxy Z Fold6, а также меньше некоторых флагманских смартфонов традиционного моноблочного формата. Honor уменьшила размеры флагманского смартфона благодаря использованию модернизированного шарнирного механизма толщиной всего 2,84 мм, рассчитанного на 500 000 сгибаний. Рама новинки изготовлена из алюминиевого сплава 7-й серии. Корпус защищён от воды по стандарту IPX8. Magic V3 оснащён 6,43-дюймовым внешним экраном LTPO OLED с разрешением FHD+ и частотой обновления 1–120 Гц. Соотношение сторон экрана составляет 20:9, то есть экран почти такой же, как у многих современных смартфонов-моноблоков. Дисплей имеет пиковую яркость 2500 кд/м2 и поддерживает ввод стилусом, как и у прошлогоднего Magic V2.  Основной дисплей также выполнен по технологии LTPO OLED и имеет размер 7,92 дюйма. Он предлагает разрешение 2156 × 2344 пикселей, адаптивную частоту обновления 1–120 Гц и пиковую яркость до 1800 кд/м2. Honor также добавила боковой ультразвуковой датчик отпечатков пальцев от Goodix, который позволяет быстрее распознавать отпечатки пальцев. Honor Magic V3 оснащён чипом Qualcomm Snapdragon 8 Gen 3, который дополняют 12 или 16 Гбайт оперативной памяти LPDDR5X и накопитель UFS 4.0 объемом от 256 Гбайт до 1 Тбайт. Несмотря на тонкий корпус, Honor все же удалось установить в новинке более крупную систему охлаждения с испарительной камерой, чем в предыдущей модели Magic V2.  На задней панели разместилось трио камер: 50-Мп основную (диафрагма f/1,6) с оптической стабилизацией, 50-Мп модуль с перископическим объективом и 3,5-кратным оптическим зумом (f/3,0), а также 40-Мп широкоугольный модуль (f/2,2). В отверстиях во внешнем и главном экранах размещены 20-Мп фронтальные камеры. Программная часть представлена MagicOS 8.0.1 на базе Android 14, которая наделена множеством функций на базе искусственного интеллекта, включая «Обвести и найти» (Circle to Search) и Honor Parallel Space, которая наряду с поддержкой двух SIM-карт позволяет разделить основной дисплей и, по сути, иметь два отдельных смартфона с собственными приложениями и профилями. Ещё Внутренний дисплей Magic V3 оснащен функцией Honor AI Defocus Eye Protection, которая, имитируя эффект бифокальных очков, помогает снизить прогрессирование близорукости.  Важным технологическим прорывом стала инновационная двойная кремний-углеродная батарея третьего поколения. Несмотря на более тонкий корпус, Magic V3 получил батарею большей ёмкости, чем предшественник — 5150 мА·ч против 5000 мА·ч у прошлогоднего Magic V2. Новинка поддерживает быструю зарядку: проводную мощностью 66 Вт и беспроводную на 50 Вт. Продажи Honor Magic V3 в Китае стартуют 19 июля. Устройство будет доступно в белом, черном, зеленом цветах, а также в версии с отделкой из коричневой экокожи. Цены варьируются от 8999 до 10 999 юаней (ок. $1240–1517) в зависимости от конфигурации памяти. Глобальный запуск ожидается к концу года. Реклама | ООО "Техкомпания ОНОР" ИНН 9731055266 erid: F7NfYUJCUneLt1SmVuWG Японский спутник-инспектор космического мусора поманеврировал около старой ступени ракеты

12.07.2024 [14:13],

Павел Котов

Японская компания Astroscale отчиталась о проведении подробного обследования крупного фрагмента космического мусора на околоземной орбите — верхней ступени ракеты H-2A, запущенной ещё в 2009 году. Космический аппарат Active Debris Removal (ADRAS-J) был запущен на орбиту ракетой Rocket Lab Electron 18 февраля 2024 года — он предназначен для отработки методов сближения с космическим мусором на орбите и его обследования при помощи операций «встречи и сближения» (Rendezvous and Proximity Operations, RPO). Первым заметным объектом исследований стала верхняя ступень стартовавшей ещё в 2009 году японской ракеты H-2A. Astroscale опубликовала новый снимок объекта, сделанный в июне с расстояния около 50 метров — длина объекта составляет 11 м, а масса — 3 т. ADRAS-J также провёл миссию RPO с использованием системы автономного управления. Аппарат самостоятельно принял решение о временной приостановке миссии, когда обнаружил аномалию в положении объекта. Он произвёл манёвр уклонения от космического мусора, подтвердив свою способность «обеспечивать безопасность даже при выполнении наблюдений в условиях сближения с несотрудничающим объектом». Это важно, поскольку многие относящиеся к космическому мусору объекты явно не рассчитаны на работу таких миссий и могут представлять угрозу для спутника-инспектора. Компания возлагает на ADRAS-J большие надежды. Когда фаза миссии по «демонстрации коммерческого удаления мусора» (CRD2) будет завершена, компания перейдёт к новой, в рамках которой она совместно с Японским агентством аэрокосмических исследований (JAXA) произведёт сведение с орбиты «несотрудничающего» космического мусора. Эта фаза начнётся не ранее 2026 года. Intel планирует заработать до $1 млрд на продажах ПО к концу 2027 года

12.07.2024 [14:10],

Алексей Разин

Технический директор Intel Грег Лэвендер (Greg Lavender) в интервью Reuters заявил, что компания намеревается к концу 2027 года выручить от реализации программного обеспечения накопленным итогом до $1 млрд, предлагая клиентам разного рода подписки. Intel также прилагает усилия к продвижению в сфере ИИ программного обеспечения с открытым исходным кодом.

Источник изображения: Intel Кроме прочего, Intel собирается предлагать разработчикам ПО подписку на свои облачные сервисы. Не исключено, что рубеж в $1 млрд кумулятивной выручки от реализации программного обеспечения Intel преодолеет ещё до конца 2027 года, как пояснил Лэвендер. Уже в 2021 году компания выручила от реализации ПО более $100 млн, как пояснил нынешний технический директор Intel, который тогда пришёл вслед за Патриком Гелсингером (Patrick Gelsinger) из VMware. С тех пор Intel уже удалось поглотить три компании, занимающиеся программным обеспечением. На фоне общей выручки в размере $54 млрд, которую компания получила по итогам 2023 года, указанная сумма в $1 млрд, распределённая на несколько лет, кажется не столь существенной, но для относительно нового источника выручки это довольно амбициозная цель. Intel приоритетными считает развитие ПО в сфере искусственного интеллекта, оптимизации производительности и информационной безопасности. Все три направления внутри компании поддерживаются инвестиционными ресурсами. Как попутно отметил технический директор Intel, компания наблюдает высокий спрос на свои ускорители семейства Gaudi 3 и надеется со временем стать вторым после Nvidia поставщиком соответствующих компонентов на рынок. Последняя, напомним, занимает по итогам прошлого года около 83 % рынка ускорителей вычислений, так что Intel и прочим конкурентам приходится бороться за его небольшую долю. Intel делает ставку на ПО с открытым исходным ходом, которое может работать на любых платформах с любыми ускорителями, тогда как экосистема Nvidia замкнута на среду CUDA, закрытую для сторонних разработчиков ускорителей. Intel является участницей консорциума UXL Foundation вместе с Qualcomm, Samsung и Arm, продвигая идею использования ПО с открытым исходным кодом для ускорения вычислений. Она также примкнула к продвигаемой OpenAI инициативе Triton по созданию среды разработки с открытым исходным кодом, которая позволяла бы повышать эффективность взаимодействия разнородных ускорителей вычислений в системах искусственного интеллекта. Это начинание поддерживается также компаниями AMD и Meta✴✴. Ускорители вычислений Intel могут работать в среде Triton как в нынешнем поколении, так и в будущем. По мнению технического директора Intel, распространение Triton уравняет шансы на успех всех участников рынка. В России разработали солнечные панели, которые лучше всех работают в тени

12.07.2024 [14:02],

Геннадий Детинич

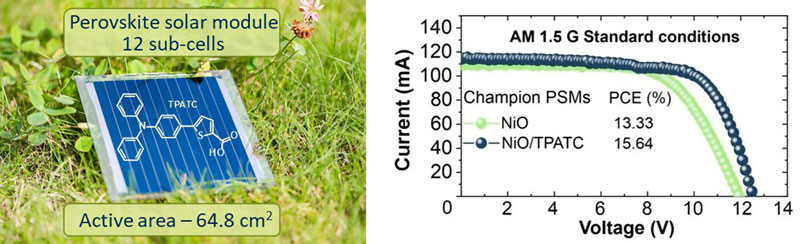

Учёные Университета МИСИС и Института синтетических полимерных материалов им. Н.С. Ениколопова (ИСПМ РАН) представили органические полупроводники для солнечных перовскитных модулей, которые при низком освещении увеличивают мощность выработки до 90 %, а КПД на 2,42 %. Подобный тип солнечных батарей позволит эффективно вырабатывать электроэнергию вдали от солнечных регионов, в условиях плотной облачности и даже внутри зданий.

Источник изображений: Journal of Power Sources Исследователи занимались вопросом повышения эффективности и практической надёжности солнечных элементов из таких тонкоплёночных структур, как галоидные перовскиты. Это нанокристаллический перовскитный поглотитель, который размещается между слоями переноса заряда. Такая структура способна вырабатывать больше энергии, чем кремний, и обещает быть дешевле в производстве. Максимальный КПД, который учёные смогли достигнуть в лаборатории, сегодня составляет 26,1 % и продолжает расти. Перовскитные материалы и галоидные соединения в частности очень чувствительны к внешней среде — температуре, влажности, освещению и прочему. Поэтому во всём мире учёные ищут возможность защитить их от коррозии и химического (фотохимического) разрушения, без чего коммерческая эксплуатация подобных фотоэлементов будет невозможна. Российские учёные также двигались в этом направлении. В ходе исследований коллектив учёных МИСИС и ИСПМ РАН синтезировал органический самособирающийся монослойный материал, который оказался химически совместим с перовскитными соединениями и обладал необходимыми защитными функциями. По сути, учёные создали технологию образования упорядоченной (защитной) молекулярной структуры толщиной в одну или несколько молекул, образующейся при поглощении активных веществ с поверхности. Такие активные вещества образуются естественным образом под воздействием тепла и света. Например, это могут быть летучие соединения йода и другие побочные продукты, которые вызывают коррозию и окисление. Исследователи смогли обратить этот негативный эффект себе на пользу, заставив его работать на создание защитного слоя. Химическую работу при самосборке монослоя производит состав на основе трифениламина с карбоксильной связующей группой. Его применение также улучшило перенос заряда между перовскитными поглотителями и неорганическими слоями. «Новый самособирающийся монослой — один из наиболее простых с точки зрения синтеза. Подобные материалы широко применяются благодаря высокой стабильности и адгезии. Однако для получения материала важно учитывать ряд требований. Среди них: термическая, фото- и электрохимическая стабильность, подходящий уровень молекулярной орбитали для переноса положительно заряженных носителей заряда с перовскита на электрод и химическая совместимость между покрытиями. Также важно избегать "паразитического" поглощения энергии при прохождении солнечных лучей через трёхслойную структуру материала», — рассказала сотрудница лаборатории перспективной солнечной энергетики НИТУ МИСИС Екатерина Ильичёва.  Выяснилось, что после образования монослоя эффективность носителей заряда выросла, а также снизилась потеря энергии. Тесты при естественном свете показали, что перовскитные элементы с монослоем сохраняют до 98 % своей первоначальной производительности после 1000 часов работы, тогда как необработанные устройства теряют более 20 % мощности уже через 400 часов. Результаты исследования подробнее описаны в журнале Journal of Power Sources. «В ходе исследования мы также изготавливали перовскитные солнечные модули с применением новой технологии. Их КПД вырос с 13,22 % до 15,64 %, а при низком освещении максимальная мощность увеличилась на 47–90 %. Мы выяснили, что монослой значительно снижает количество дефектов и усиливает взаимодействие между слоями, что ведёт к более стабильной работе перовскитных солнечных элементов. Кроме того, обработанные образцы оказались менее подвержены влиянию внешних факторов, таких как свет, влага и температура», — поделилась Полина Сухорукова, инженер лаборатории перспективной солнечной энергетики НИТУ МИСИС, исследователь лаборатории полимерных солнечных батарей ИСПМ РАН. Работающие в условиях слабой освещённости солнечные панели и панели для работы внутри помещений — это одно из важных направлений в фотовольтаике. В условиях плотной городской застройки солнечный свет редкий гость на улицах городов. Фотопанели для выработки электрической энергии в таких условиях будут востребованы и сыграют свою роль в сфере возобновляемой энергетики. Спустя 11 месяцев после релиза Baldur’s Gate 3 заслужила ещё одну «Игру года» — итоги Develop:Star Awards 2024

12.07.2024 [13:51],

Михаил Романов

Разработчики из Larian Studios уже двигаются дальше, а индустрия отпустить Baldur’s Gate 3 всё никак не может. На днях прославленная фэнтезийная RPG удостоилась ещё одной награды из категории «Игра года». На прошедшей в рамках конференции Develop:Brighton церемонии Develop:Star Awards 2024 чествовали игры последних 12 месяцев: релизы второй половины 2023 года претендовали на трофеи наряду с проектами первой половины 2024-го. Больше всего наград по итогам премии — по три — унесли с собой разработчики из Larian Studios c Baldur’s Gate 3 и Remedy Entertainment с хоррором Alan Wake 2, но победитель может быть только один. Главным триумфатором Develop:Star Awards 2024 оказалась Baldur’s Gate 3. RPG получила награды «Игра года» и «Лучшее повествование», а самой Larian досталось звание лучшей студии. Что касается Remedy, то Alan Wake 2 не знала равных в номинациях «Лучший визуальный ряд» и «Лучший звук», а креативный директор студии Сэм Лейк (Sam Lake) стал лучшим творческим руководителем. Список лауреатов Develop:Star Awards 2024 приведён ниже:

Baldur’s Gate 3 вышла из раннего доступа в августе 2023 года, то есть уже 11 месяцев назад. В сентябре игру ждёт масштабный седьмой патч — он станет последним крупным обновлением для проекта. Провайдерам США не хватает $3 млрд, чтобы избавиться от оборудования Huawei и ZTE

12.07.2024 [12:56],

Павел Котов

Федеральная комиссия по связи (FCC) США напомнила Конгрессу, что мелким поставщикам услуг широкополосного интернет-доступа требуются дополнительные средства на удаление из инфраструктуры китайского телекоммуникационного оборудования, которое рассматривается как угроза национальной безопасности.  Председатель FCC Джессика Розенворсель (Jessica Rosenworcel) и председатель сенатского Комитета по торговле Мария Кантвелл (Maria Cantwell) предупредили парламентариев, что для замены китайского оборудования в сетях провайдеров широкополосного доступа необходимы ещё $3,08 млрд — они предусмотрены «Законом о спектре и национальной безопасности», который пока не принят. В стране действует программа исключения продукции Huawei и ZTE из инфраструктуры провайдеров, но 40 % её участников не обладают средствами для завершения работы — большинство из них находится в сельской местности, и дефицит финансирования «несоразмерно угрожает обслуживанию сельских общин». Годом ранее Розенворсель уже направляла в Конгресс обращение, что отказ от китайского оборудования в сетях обойдётся стране в $4,98 млрд, но в июле 2021 года законодатели выделили на эти цели $1,9 млрд, и больше средств на реализацию программы не поступало. Теперь председатель FCC была вынуждена напомнить о дефиците средств, причём его размер за минувший год не изменился. К настоящему моменту полностью избавиться от китайской продукции удалось лишь 12 % телекоммуникационных компаний, и до сих пор в стране числятся более 6000 операторов, в сетях которых работает «небезопасное» оборудование. Причём большинство из них находится в сельской местности, а некоторые даже вблизи важных военных объектов. «Конгресс должен принять „Закон о спектре и национальной безопасности“, который обеспечит финансирование этой программы, поможет мелким провайдерам снова встать на ноги и обеспечит сельским общинам связь», — заявила сенатор Кэнтуэлл. Она является автором этого документа, который также расширяет полномочия FCC по проведению аукционов на выделение частот и на обеспечение финансирования широкополосной связи. Microsoft исправила баг, приводивший к бесконечной перезагрузке Windows 11 и проблемам с панелью задач

12.07.2024 [12:44],

Владимир Фетисов

Компания Microsoft сообщила об устранении известной проблемы, которая возникала у некоторых пользователей после установки обновления Windows 11 23H2 и приводила к цикличным перезагрузкам операционной системы и проблемам с панелью задач. Из-за этого бага софтверный гигант был вынужден приостановить распространение обновления Windows 11 23H2. Патч для исправления ошибки был выпущен 9 июля.

Источник изображения: Microsoft Проблема с цикличной перезагрузкой Windows 11 затронула тех, кто использует виртуальные машины и другие инструменты виртуализации, такие как CloudPC, DevBox и Azure Virtual Desktop. Некоторые пользователи также сообщали о проблемах с виртуальными машинами VMware. Многие пользователи были недовольны тем, что проблемное обновление, вызывающее цикличную перезагрузку ОС, было установлено без их согласия, поскольку данный пакет развёртывался Microsoft принудительно. Единственный способ избежать установки обновления предполагает отключение службы Windows Update или отключение интернета на ПК. Поскольку проблему с цикличной перезагрузкой Windows 11 удалось решить, Microsoft уже возобновила распространение обновления Windows 11 23H2. При этом пакет остаётся заблокированным для устройств, на которых используется программное обеспечение для виртуализации. После распространения патча следует ожидать того, что Windows 11 23H2 продолжит устанавливаться принудительно на все совместимые устройства. Выпущенный 9 июля патч также устраняет проблему в работе панели задач, которая выражалась в том, что панель не загружалась после установки обновления Windows 11 23H2. После установки упомянутого патча панель задач будет загружаться корректно. При этом остаётся актуальной проблема, из-за которой может не загружаться приложение «Фотографии», если активирована функция BlockNonAdminUserInstall. Эта проблема затрагивает ПК, на которых приложение «Фотографии» было обновлено через магазин Windows, начиная с 4 июня 2024 года. YouTube начнёт сбоить у всех в России, предупредил «Ростелеком»

12.07.2024 [12:41],

Владимир Мироненко

«Ростелеком» предупредил российских пользователей о возможных сбоях в работе YouTube в России. В частности, может ухудшиться качество воспроизведения видеороликов, размещённых на платформе, а также снизиться скорость их загрузки на серверы медиаплатформы.

Источник изображения: Pixabay Как пояснил «Ростелеком», сбои вызваны техническими проблемами в работе оборудования компании Google, установленного в сетевой инфраструктуре оператора и на пиринговых стыках для кеширования и ускорения загрузки контента сервисов Googlе, в основном видеохостинга YouTube (система Google Global Cache). «Из-за проблем с эксплуатацией указанного оборудования и невозможности его расширения в условиях роста обрабатываемого трафика, наблюдается серьёзная перегрузка имеющихся мощностей, в том числе на пиринговых стыках. Это может повлиять на скорость загрузки и качество воспроизведения роликов в YouTube у абонентов всех российских операторов», — указано в сообщении «Ростелекома». Как пишет РБК со ссылкой на данные Mediascope, в апреле 2024 года число российских пользователей, которые хотя бы один раз за месяц посещали видеохостинг или пользовались приложением YouTube, среди населения старше 12 лет составило 95,86 млн человек. Напомним, что в связи с санкциями Google прекратила поставки нового оборудования российским операторам, а старые системы постепенно выходят из строя. На фоне роста трафика это не могло не отразиться на скорости загрузки контента, в первую очередь, на скорости воспроизведения видео на YouTube. Чтобы сохранить качество связи для пользователей, Google предложила провайдерам подключиться к её сетям напрямую. Dungeonborne спустится в глубины раннего доступа Steam на следующей неделе — дата выхода мрачного фэнтезийного PvPvE-экшена

12.07.2024 [12:41],

Михаил Романов

Вслед за окончанием на этой неделе финального открытого тестирования разработчики из сингапурской студии Mithril Interactive объявили точную дату выхода в раннем доступе своего мрачного PvPvE-экшена от первого лица Dungeonborne. Напомним, Dungeonborne была официально представлена в январе текущего года и ожидалась к запуску в раннем доступе вскоре после завершения упомянутого плейтеста — он продлился с 3 по 11 июля. Как стало известно, ранний доступ Dungeonborne стартует в цифровом магазине Steam уже на следующей неделе, 18 июля. Анонс сопровождался двухминутным геймплейным трейлером (прикреплён ниже). По итогам тестирования к старту раннего доступа обещают несколько изменений: новые активные навыки, корректировку баланса классов, оружия и снаряжения, улучшения PvE и подбора игроков, оптимизацию клиента и регион сервера. Кроме того, на запуске раннего доступа в Dungeonborne собираются добавить русский язык. Стоит отметить, что на настоящий момент страница игры в российском Steam не открывается (ошибка «Данный товар недоступен в вашем регионе»). Напомним, Dungeonborne предлагает одному или в кооперативе с поддержкой до трёх человек исследовать многоэтажные лабиринты замков и подземелий, убивать чудовищ, добывать сокровища и эвакуироваться вместе с ними в безопасное место. Авторы готовят более десяти комбинаций оружия, восемь классов (боец, священник, плут, мечник, пиромант, криомант, рыцарь смерти, друид), свыше 80 влияющих на геймплей предметов, соревновательный мультиплеер и одиночный режим. SoftBank купила производителя чипов Graphcore для укрепления позиций в сфере ИИ

12.07.2024 [12:37],

Анжелла Марина

Японская холдинговая компания SoftBank приобрела британскую компанию Graphcore, специализирующуюся на производстве чипов, в том числе решений для искусственного интеллекта. Эта сделка является частью многомиллиардной стратегии SoftBank по укреплению позиций в сфере ИИ.

Источник изображения: Copilot Компания Graphcore, основанная в 2016 году ветеранами британской полупроводниковой индустрии, присоединится к портфелю SoftBank, в котором уже находится разработчик чипов Arm. Это приобретение отражает намерение Масаёси Сона (Masayoshi Son), основателя SoftBank, сделать «следующую большую ставку» в технологической индустрии, сообщает Financial Times. Сумма сделки не разглашается, но по информации источников, знакомых с ситуацией, она составила чуть более 600 миллионов долларов. Стоит отметить, что в 2020 году Graphcore оценивалась примерно в 2,5 миллиарда долларов. Однако в 2022 году компания столкнулась с трудностями в коммерциализации своей технологии и сообщила о продажах всего на 2,7 миллиона долларов и убытках до налогообложения в размере $205 млн. Поддержка SoftBank в данном случае является реальным шансом расширить производство и выйти на новый уровень, так как SoftBank планирует предоставить Graphcore значительные ресурсы. Найджел Тун (Nigel Toon), генеральный директор и один из учредителей Graphcore, оставшийся на своём посту после заключения сделки, заявил, что главной проблемой компании была недостаточная масштабируемость и капитал. Он надеется, что теперь Graphcore сможет конкурировать с такими технологическими гигантами, как Nvidia и AMD. Сделка была проведена после получения всех необходимых разрешений от регулирующих органов в Великобритании и США, а также одобрения с точки зрения национальной безопасности от британского правительства. Немаловажно, что перед сделкой Graphcore решила выйти из своего китайского бизнеса, после того как экспортный контроль США на чипы ИИ сделал работу с Поднебесной, по словам Туна, крайне сложной. Теперь Graphcore и SoftBank сосредоточатся на клиентах в Америке и Европе. Отмечается, что эта сделка является очередным шагом в реализации амбициозных планов Масайоси Сона по созданию эры искусственного интеллекта. SoftBank также недавно инвестировала более 1 миллиарда долларов в британский стартап Wayve, занимающийся разработкой самоуправляемых автомобилей. Розничные инвесторы Yandex подали в суд на российский «Яндекс»

12.07.2024 [11:53],

Павел Котов

Некоторым миноритарным владельцам акций нидерландской Yandex N.V. было отказано в их обмене на ценные бумаги российского «Яндекса». Чтобы защитить свои права, около сотни розничных инвесторов 10 июля подали в Арбитражный суд Москвы иск к УК «Солид менеджмент» — это доверительный управляющий ЗПИФ «Консорциум. Первый», основного владельца новой российской МКПАО «Яндекс», узнали «Ведомости». Одни эксперты согласны с истцами, другие видят их перспективы в суде туманными.

Источник изображений: yandex.ru/company Истцы требуют, чтобы ответчик либо обменял принадлежащие им обыкновенные акции Yandex N.V. класса A на акции «Яндекса» в соотношении 1 к 1, либо выкупил их по рыночной цене в 4250 руб. за штуку. Компания «Солид менеджмент» 13 мая предложила розничным инвесторам Yandex N.V. выкупить у них акции по 1251,8 рублей либо обменять их на акции российского «Яндекса», но предложение было действительно либо для тех, кто купил ценные бумаги на Мосбирже или «СПБ бирже», либо для тех, кто зачислил их на счета в российских депозитариях до 30 ноября 2023 года. Заявки на обмен принимались с 14 мая по 21 июня, а также в один дополнительный день 27 июня. Расчёты завершились 9 июля: на Мосбирже были совершены 680 700 встречных сделок с обменом 42,4 млн акций на 180,3 млрд руб.; на «СПБ бирже» произведён обмен 1,42 млн ценных бумаг — 99 % купленных на этой площадке. Российское законодательство не предусматривает разграничений в правах между держателями акций одного типа — они могут устанавливаться лишь в зависимости от объёма ценных бумаг. Но в результате действий ответчика право на конвертацию получили лишь держатели акций, приобретённых на Мосбирже или «СПБ бирже», а владельцы таких же акций, но купленных на внебиржевой торговле, этого права были лишены. Такие инвесторы, по их утверждению, оказываются владельцами неликвидного актива без доступа к организованным торгам — им был нанесён имущественный вред в размере стоимости принадлежащих им акций. Смена юрисдикции компании может производиться при помощи процессов редомициляции или инкорпорации. Первый предусматривает сохранение истории, обязательств и организационно-правовой формы компании. Второй — учреждение нового юридического лица на любых условиях распределения акций правопреемника между акционерами правопредшественника. Другими словами, утверждают истцы, «Консорциум. Первый» в лице «Солид менеджмент» минимизировал свои издержки и сэкономил более 150 млрд руб. Ущерб, по их мнению, был причинён не только им, но и Российской Федерации, которая при выкупе акций получила бы НДФЛ в размере более 20 млрд руб.  Новые владельцы «Яндекса» опубликовали условия обмена либо выкупа лишь 13 мая, и держатели акций нидерландской Yandex N.V. не знали, какая процедура будет применяться при смене юрисдикции. А установленные компанией условия обмена установили обратную силу на отношения, возникшие до их опубликования — без соблюдения предусмотренных Гражданским кодексом условий для придания договору обратной силы. Более того, на указанную дату 30 ноября 2023 года МКПАО «Яндекс» не существовала, а ЗПИФ «Консорциум. Первый» не был стороной сделки с Yandex N.V. Зная наперёд о возможном ограничении прав инвесторов, никто не стал бы покупать акции нидерландской компании — новый владелец скрыл, по мнению истцов, ценную информацию от них, поступив недобросовестно с целью извлечения максимальной прибыли. До подачи искового заявления пострадавшие розничные инвесторы дважды обращались в «Солид менеджмент» с предложением урегулировать спор, но ответа не получили; 19 июня было направлено обращение с Центробанк с просьбой проверить деятельность новых владельцев «Яндекса», но регулятор в их действиях признаков нарушения закона не усмотрел: по мнению ЦБ, новые акционеры компании вообще не были обязаны делать предложений владельцам акций Yandex N.V. Истцы оценивают свой совокупный портфель в 6,5 млрд, и в представляющую их интересы юридическую фирму Law & Capital продолжают поступать обращения от желающих присоединиться к иску, сообщил её управляющий партнёр Виктор Обыденнов. По его мнению, «ЗПИФ, по сути, разрушил акционерную стоимость наших бумаг», и нидерландская сторона не даст адекватной цены за акции, потерявшие 95 % стоимости. Представляющий интересы ЗПИФ «Консорциум. Первый» старший партнёр фирмы «Аиткулов и партнеры» Тимур Аиткулов подчеркнул, что новые владельцы «Яндекса» действовали в рамках закона, оснований для выдвижения требований нет, а истцы пытаются переложить на ответчика свои неудачные инвестиционные решения. ЗПИФ сделал держателям акций Yandex N.V. предложение о выкупе или обмене лишь потому, что они были необходимы компании для расчётов по сделке. Мнения опрошенных «Ведомостями» экспертов о перспективах дела разделились. Одни указали, что дифференциация прав держателей одинаковых активов действительно недопустима. Другие напомнили, что российское законодательство допускает только свободный характер участия в сделках. Кроме того, не до конца ясно, почему ответчиком по делу оказалась российская компания, а не нидерландская Yandex N.V., чьи акции принадлежат истцам — первопричиной обесценивания акций стала продажа ключевого актива, а не предложение «Солид менеджмента» для некоторых групп инвесторов. Ведущий разработчик The Witcher 3: Wild Hunt встал на защиту ведьмачьего чутья, но признал, что CD Projekt Red «немного переборщила» с ним

12.07.2024 [11:34],

Михаил Романов

Пользователи The Witcher 3: Wild Hunt наверняка помнят, сколько времени провели за поиском улик в режиме так называемого ведьмачьего чутья. О создании навязчивой механики рассказал дизайнер квестов Павел Саско (Paweł Sasko). По словам Саско, когда CD Projekt Red приступала к The Witcher 3, то геймплейный цикл с уликами казался чем-то свежим. Саско проработал механику вместе с опытным дизайнером квестов Данишем Маркевичем (Danisz Markiewicz). «Когда в 2012 году мы работали над [этой механикой], то считали её отличной идеей. А когда The Witcher 3 вышла, то поняли, что немного переборщили, перегнули», — заявил Саско в недавнем интервью бразильскому YouTube-каналу Flow Games. Саско вспоминает, что секций с ведьмачьим чутьём в The Witcher 3 было так много, что это вредило темпу игры. Поэтому в дополнениях Hearts of Stone и Blood and Wine постарались снизить градус подобных расследований. Хотя в расширениях для The Witcher 3: Wild Hunt темп игрового процесса уже стал лучше, вершиной усилий CD Projekt Red в этом отношении Саско назвал аддон Phantom Liberty для Cyberpunk 2077. «Там нет ситуаций, как в The Witcher 3, когда вы восклицаете: "Боже мой, ещё один кровавый след, отметки от лап монстра, да сколько можно-то?" Выводы были сделаны, и работа была проделана более качественно», — считает Саско. В настоящее время CD Projekt Red трудится и над продолжением Cyberpunk 2077 (кодовое название Orion), и над следующим «Ведьмаком» (Polaris). Последним сейчас заняты почти 65 % от всех сотрудников студии. «Джеймс Уэбб» запечатлел кольцо с драгоценными камнями космических масштабов

12.07.2024 [11:30],

Владимир Фетисов

Космический телескоп «Джеймс Уэбб» Национального управления по аэронавтике и исследованию космического пространства (NASA) США направил свой взор на далёкий астрономический объект, визуально напоминающий кольцо с драгоценными камнями. На деле это квазар RX J1131-1231 на расстоянии 6 млрд световых лет от Земли в созвездии Чаши.

Источник изображения: ESA Столь необычный вид квазара обусловлен тем, что его изображение дошло до нас в искажённом виде из-за эффекта гравитационного линзирования. Дело в том, что галактика, находящаяся между Землёй и RX J1131-1231, искажает изображение квазара на заднем плане, из-за чего на снимке появляются яркая дуга и четыре образования. По данным Европейского космического агентства (ESA), на сегодняшний день представленный снимок является одним из лучших «линзированных» квазаров, которые удалось запечатлеть. Что касается гравитационного линзирования, то этот эффект первым предсказал Альберт Эйнштейн. Без углубления в детали принцип действия линзирования можно сравнить с тем, как работает увеличительное стекло. Обладающие массой космические объекты искривляют пространство и время под действием гравитации, из-за чего создаётся увеличительный эффект, позволяющий астрономам заглянуть в глубь космического пространства. Вместе с этим, когда ведётся наблюдение за дальним источником света через другой космический объект, например, галактику, форма дальнего источника света искажается. «Вся материя во Вселенной искривляет пространство вокруг себя, причём более массивные объекты вызывают более сильный эффект. Вокруг очень массивных объектов, таких как галактики, свет, проходящий рядом с ними, следует за этим искривлённым пространством, отклоняясь от своего первоначального направления на хорошо заметную величину. Одним из последствий гравитационного линзирования является то, что оно может увеличить удалённые астрономические объекты, позволяя астрономам изучать их. Без линзирования такие объекты были бы слишком тусклыми или удалёнными», — говорится в сообщении ESA. AR-гарнитура Apple Vision Pro поступила в продажу в Австралии, Канаде, Франции, Германии и Великобритании

12.07.2024 [11:08],

Алексей Разин

В феврале гарнитура дополненной реальности Apple Vision Pro вышла на рынок США по цене $3499, и компании потребовались почти пять месяцев, чтобы к концу июня вывести её на рынки Китая, Гонконга, Японии и Сингапура. К этой пятнице география продаж устройства расширилась за счёт Австралии, Великобритании, Германии, Канады и Франции.

Источник изображения: Apple Как отмечает CNBC, к началу официальных продаж в Великобритании посетители фирменных магазинов Apple в Лондоне начали заранее резервировать своё право принять участие в демонстрации возможностей Vision Pro. По словам представителей IDC, не приходится сомневаться в высоком интересе публики к новинке Apple на старте продаж в большинстве регионов, но вся сложность заключается в способности компании поддерживать спрос на такое неоднозначное и недешёвое устройство в дальнейшем. Как уже отмечалось ранее, после первых шести месяцев присутствия Vision Pro на рынке США спрос может снизиться на 75 %, по мнению аналитиков IDC. Аналитик TF International Securities Мин-Чи Куо (Ming-Chi Kuo) ожидает, что в текущем году Apple рассчитывает продать от 400 до 450 тысяч гарнитур Vision Pro, и это значительно меньше изначально заложенного в прогноз диапазона от 700 до 800 тысяч экземпляров. Примерно половины из указанного в первом случае количества гарнитур будет продана за пределами США. Если учесть, что ёмкость рынка гарнитур дополненной и виртуальной реальности в целом достигает 7,3 млн штук, то продукция Apple на ней пока не может претендовать на лидирующие позиции, но даже с учётом своей высокой цены по итогам первого квартала заняла второе место, уступив только гарнитурам Meta✴✴ Quest. Для более активной экспансии гарнитурам Apple нужно не только снизить цену, но и обрасти достаточным количеством реально полезных и востребованных приложений. Google упростила перенос фотографий и видео из «Google Фото» в Apple iCloud

12.07.2024 [11:05],

Анжелла Марина

Компания Google разработала новый сервис, который существенно упростит перенос пользовательских данных из «Google Фото» в Apple iCloud. Сервис является аналогом инструменту iCloud to Google Photos, который был выпущен Apple в 2021 году и позволяет переносить видео и изображения в обратном направлении.

Источник изображения: Daniel Romero / Unsplash Разработка является частью проекта Data Transfer Project — открытой инициативы, направленной на обеспечение переноса данных между различными онлайн-платформами. По сообщению издания The Verge, поддержка переноса фотографий и видео из «Google Фото» в iCloud Photos будет развёрнута в течение следующей недели. Сервис будет доступен пользователям по всему миру в более чем 240 странах и регионах. Однако он не будет доступен для детских аккаунтов и управляемых аккаунтов Apple ID. Компания также отмечает, что невозможно импортировать контент в iCloud, если активирована расширенная защита данных (Advanced Data Protection). Процесс переноса достаточно прост. Пользователям не нужно скачивать фотографии или видео из «Google Фото», перенос осуществляется напрямую из Google в iCloud. Время, необходимое для переноса, может варьироваться от нескольких часов до нескольких дней в зависимости от объёма данных. Чтобы запустить процесс экспорта, нужно перейти в Google Takeout и следовать инструкциям. Далее в настройках сервиса потребуется выбрать «Apple → iCloud Photos» в качестве места назначения и войти в систему, используя свой Apple ID. После этого останется нажать клавишу «Разрешить», чтобы предоставить Google разрешение на добавление фотографий и видео в iCloud. Apple и Google опубликовали подробные инструкции на своих официальных сайтах, которые помогут пользователям осуществить перенос данных. Zeekr раскрыла внешность и характеристики электромобиля 7X, который станет конкурентом Tesla Model Y

12.07.2024 [10:44],

Алексей Разин

Эту неделю компания Zeekr начала с демонстрации покрытого камуфляжной плёнкой нового электрического кроссовера с условным обозначением CX1e, который должен выйти на рынок до конца года. Не став долго хранить интригу, автопроизводитель опубликовал официальные фото новинки и раскрыл основные характеристики машины, которая получила имя Zeekr 7X.  В выборе ниши для позиционирования новой модели сложно ошибиться — это будет семейный кроссовер, конкурирующий с Tesla Model Y и её одноклассниками. Пятиместный кроссовер, по словам представителей Zeekr, на которые ссылается ресурс CnEVPost, создавался с оглядкой на предпочтения китайских семей. Построенная на архитектуре SEA компании Geely, эта машина имеет размеры 4825 × 1930 × 1656 мм (Д × Ш × В) и колёсную базу 2915 мм. Знакомый китайской публике кроссовер XPeng G9 в целом имеет сопоставимые с Zeekr 7X размеры.  Новая платформа подразумевает использование 800-вольтовой архитектуры, которая позволяет быстрее восполнять запас хода при подключении к мощным зарядным станциям — на эквивалент пробега 500 км за 15 минут, например. В полноприводном исполнении Zeekr 7X оснащается электродвигателем мощностью 165 кВт на передней оси и ещё одним на задней, который имеет мощность 310 кВт. Совокупная мощность силовой установки в этом случае достигает 475 кВт, что соответствует 646 л.с. До 100 км/ч такая машина разгоняется менее чем за четыре секунды. Zeekr 7X будет предлагаться и в заднеприводном исполнении с единственным электродвигателем мощностью 310 кВт (420 л.с.)  Из особенностей экстерьера следует отметить наличие фирменного внешнего дисплея Zeekr Stargate на месте фальшрадиаторной решётки, который может использоваться для демонстрации разного рода информационных сообщений или вывода простейшей анимации. На крыше электромобиля замечен лидар, что позволяет рассчитывать на наличие развитых комплексов активной помощи водителю. Tencent закроет кооперативный шутер Synced всего через год после релиза — раскрыта дата отключения игры

12.07.2024 [10:14],

Михаил Романов

Условно-бесплатный кооперативный шутер Synced от китайской Next Studios, выпущенный издательством Level Infinite (принадлежит Tencent), закроет свои двери всего через год после релиза. Компания объявила дату «смерти» игры. Напомним, Synced стартовала 8 сентября 2023 года и за прошедшее время получила два сезонных обновления — последним было Cyber Safari в середине марта, с релиза которого официальный микроблог игры хранил неловкое молчание. Как подметил портал PC Gamer, тишина со стороны разработчиков была предвестником скорого конца: на днях Level Infinite объявила, что 9 сентября в 6:00 по Москве серверы Synced будут отключены. С указанной даты пользователи больше не смогут скачать Synced и играть в неё. С 9 июля Level Infinite отключила в шутере регистрацию новых учётных записей и микротранзакции. Издатель поблагодарил игроков за интерес к Synced. Причина закрытия проекта не называется, но проследить её несложно: на запуске пиковый онлайн шутера составил 10 тыс. игроков, а с мая ежедневный показатель не превышал 100 человек. Пользовательские обзоры в Steam у Synced «смешанные» (66 %), а рейтинг недавних опустился до 39 % («в основном отрицательные»): жалуются на долгий подбор игроков, нехватку аудитории и проблемы со стабильностью клиента. Synced в итоге вышла только на ПК (Steam), хотя были планы и на консольный релиз. События разворачиваются в будущем после технологической катастрофы, из-за которой игрокам приходится сражаться за ресурсы с киборгами-убийцами. Забастовка на предприятиях Samsung может сорвать выпуск памяти HBM

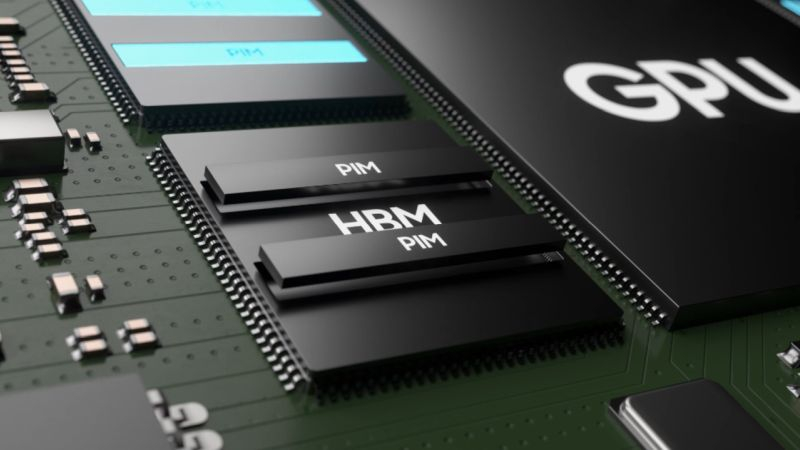

12.07.2024 [09:56],

Алексей Разин

До сих пор руководству Samsung Electronics удавалось не только игнорировать требования профсоюза, которые были выдвинуты ещё в начале года, но и заявлять о неспособности начавшейся забастовки сотрудников существенно влиять на производственную деятельность компании. Решительно настроенные протестующие, между тем, грозят своими действиями сорвать выпуск микросхем HBM, весьма востребованных на рынке.

Источник изображения: Samsung Electronics Как отмечает Bloomberg, лидеры профсоюза теперь призывают сотрудников предприятия Samsung, задействованного в производстве HBM, присоединиться к забастовке. Несколько сотен сотрудников предприятия в Пхёнтхэке, выпускающего память этого класса, в четверг и пятницу вышли на улицу для участия в забастовке. По замыслу руководящих акцией протеста представителей профсоюза, потенциальный ущерб на столь важном для компании направлении деятельности должен сделать руководство Samsung более сговорчивым в вопросе повышения уровня оплаты труда. В условиях, когда Samsung пытается стать доверенным поставщиком Nvidia, подобные риски могут оказаться существенными, чтобы руководство компании обратило внимание на требования протестующих. Хотя Samsung и является крупнейшим в мире производителем микросхем памяти, в сегменте HBM компания сильно отстаёт от более мелкой южнокорейской компании SK hynix, которая контролирует половину рынка. Акции Samsung утром в пятницу потеряли в цене до 4 %, но подобное движение наблюдалось на азиатских рынка в целом, поэтому его нельзя назвать выраженной реакцией на действия профсоюза. Руководство Samsung выразило надежду, что ему удастся возобновить переговоры с протестующими, а действия последних не окажут влияния на способность компании выполнять свои обязательства перед клиентами. Эксперты ожидают, что даже в условиях высокой автоматизации производства передовых компонентов типа HBM необходимость привлечения персонала для контроля качества сохраняется, и действия персонала, участвующего в забастовке, могут сказаться на качестве изготавливаемой продукции, как минимум. 144 ядра, чиплеты, SRAM и 3D-упаковка: Fujitsu поделилась подробностями о грядущих Arm-процессорах MONAKA

12.07.2024 [09:09],

Алексей Степин

Опыт японской компании Fujitsu в разработке процессоров и суперкомпьютеров велик и многогранен. Долгое время основной архитектурой для решений Fujitsu была SPARC64, но времена меняются: в 2018 году компания анонсировала разработку собственного процессора на базе архитектуры Arm. Сегодня этот чип мы знаем под именем A64FX. В 2020 году японский кластер Fugaku на основе 48-ядерных A64FX с интегрированными HBM-памятью и интерконнектом занял первое место в рейтинге TOP500 с результатом 537,2 Пфлопс. Однако эти процессоры, которые всё ещё достойно трудятся не только в Fugaku, но и в других суперкомпьютерах, трудно назвать действительно универсальным и доступным. Важность архитектурных нововведений и смену IT-ландшафта в Fujitsu прекрасно осознают. Поэтому компания объявила о разработке нового серверного процессора под кодовым именем MONAKA, для которого она намеревается вдвое увеличить показатели производительности и энергоэффективности, а также учесть растущую популярность задач класса ИИ. А совсем недавно Fujitsu впервые более детально рассказала о технических особенностях будущих CPU. Во-первых, разработчики нового процессора хорошо осознают ограничения, накладываемые текущей транзисторной технологии. Похоже, из FinFET и её аналогов выжаты все или почти все соки и для прорывных решений нового поколения данная технология не подходит. В процессорах MONAKA будут использоваться транзисторы с затвором нового типа, так называемые GAA (Gate-all-Around). Похоже, речь идёт о технологии, которую разрабатывает и собирается внедрить в производство уже в следующем году Samsung в рамках 2-нм техпроцесса SF2. Внедрение 2-нм GAA-транзисторов позволит снизить паразитную ёмкость, а значит, добиться больших тактовых частот при меньшем напряжении питания. При этом новая технология будет применена не только в процессорных ядрах, но и в сборках кеш-памяти, также спроектированных с использованием собственного инструментария Fujitsu. Во-вторых, MONAKA изначально проектируется как модульный процессор. В центре разместится IO-кристалл, содержащий контроллеры DDR5 (12 каналов) и PCI Express 6.0/CXL 3.0. Окружать его будут сборки из 5-нм кристаллов кеш-памяти SRAM и расположенных поверх 2-нм кристаллах с процессорными ядрами. По вертикали соединение обеспечит технология TSV, а по горизонтали — кремниевая подложка-интерпозер. Фактически речь идёт о 3D-компоновке. 12-канальная подсистема памяти обеспечит отсутствие узких мест: у A64FX проблем с пропускной способностью благодаря использованию HBM2 не было, но объем самой памяти был ограничен 32 Гбайт. Зато у MONAKA проблем с расширением не будет — как с помощью классических модулей DIMM, так и посредством банков памяти CXL, благо, за основу сразу взята версия PCIe 6.0 с пропускной способностью 256 Гбайт/с в режиме x16. Сколько будет самих линий, пока не уточняется. Новая платформа изначально проектируется двухсокетной, при этом в количестве ядер Fujitsu также не скромничает: процессоры MONAKA получат 144 ядра, а благодаря новому 2-нм техпроцессу они будут не такими уж горячими. Им хватит воздушного охлаждения, говорят создатели. Процессоры получат набор инструкций Armv9-A с векторными расширениями SVE2 и технологией доверенных вычислений Confidential Computing. Скорее всего, без кастомных инструкций не обойдётся и в этот раз. Последнее особенно важно ввиду того, что MONAKA предназначены не только для рынка HPC, но и для использования в облачных средах. Подсистема конфиденциальных вычислений позволяет шифровать содержимое каждой виртуальной машины собственным ключом, так что доступа к внутренностям ВМ не будет даже у владельцев ЦОД. Впрочем, современные HPC-комплексы всё чаще используют именно облачный подход для доступа к ресурсам. Несмотря на популярность GPU и других специализированных ускорителей, Fujitsu считает, что гетерогенная архитектура имеет существенные недостатки — она заметно дороже, особенно с учётом ценовой политики производителей, склонна к неполной утилизации ресурсов, а также не слишком экономична и зачастую требует специфических систем охлаждения. Компания полагает, что гомогенная архитектура MONAKA этих недостатков лишена и в сочетании с ПО Fujitsu может успешно обрабатывать ИИ-нагрузки. В программной части Fujitsu активно полагается на решения с открытым кодом. Процессоры MONAKA будут отвечать стандартам Arm System Ready и получат полноценную поддержку Linux и сопутствующего инструментария, в частности, GCC, glibc, live-patch, papi и т.д. Разработка ведётся в тесном содружестве с Linaro, организацией, занимающейся консолидацией открытого ПО для Arm, а также с альянсом UXL. Для MONAKA компания подготовит, например, оптимизированную библиотеку OpenBLAS. Также Fujitsu уделяет внимание экологии: напомним, одной из главных черт нового процессора будет его экономичность, что отвечает целям японской национальной программы NEDO, ставящей своей целью достижение 40 % снижения энергопотребления ЦОД к 2030 году. Что касается начала поставок MONAKA, здесь всё идёт по плану: первые партии новых процессоров найдут своё место в серверах и вычислительных узлах уже в 2027 году. Это вполне согласуется с циклом разработки PCI Express, согласно которому появления решений PCIe 6.0 на рынке следует ожидать не ранее 2025 года. 1,5 миллиона почтовых серверов оказались под угрозой взлома из-за уязвимости в Exim

12.07.2024 [08:54],

Анжелла Марина

Исследователи безопасности обнаружили критическую уязвимость в популярном серверном почтовом клиенте Exim, которая позволяет злоумышленникам обходить защиту и отправлять вредоносные вложения. Под угрозой находятся более 1,5 миллиона серверов по всему миру.

Источник изображения: Aaron McLean / Unsplash Специалисты по кибербезопасности выявили 10 дней назад серьёзную уязвимость в программном обеспечении Exim — одном из самых распространённых почтовых серверов в мире, сообщает Ars Technica. Уязвимость, получившая идентификатор CVE-2024-39929, позволяет злоумышленникам обходить стандартные механизмы защиты и отправлять электронные письма с исполняемыми вложениями, которые могут представлять серьёзную угрозу для конечных пользователей. По данным компании Censys, специализирующейся на анализе киберугроз, в настоящее время из присутствующих в сети более 6,5 миллионов общедоступных SMTP-серверов, 4,8 миллиона (около 74 %) работают под управлением Exim. Более 1,5 миллиона серверов Exim (примерно 31 %) используют уязвимые версии программного обеспечения. Уязвимость CVE-2024-39929 получила оценку критичности 9,1 из 10 по шкале уровня опасности CVSS и возникает из-за ошибки в обработке многострочных заголовков, описанных в стандарте RFC 2231. Хейко Шлиттерманн (Heiko Schlittermann), член команды разработчиков Exim, подтвердил наличие уязвимости, назвав её «серьёзной проблемой безопасности». Хотя на данный момент нет сообщений об активном использовании ошибки, эксперты предупреждают о высокой вероятности целенаправленных атак в ближайшее время. Они напомнили о случае 2020 года, когда хакерская группа Sandworm эксплуатировала другую уязвимость в Exim (CVE-2019-10149) для массовых атак на серверы. Несмотря на то, что для успешной атаки требуется, чтобы конечный пользователь запустил вредоносное вложение, эксперты подчёркивают, что методы социальной инженерии остаются одними из самых эффективных способов компрометации систем. Специалисты рекомендуют администраторам серверов Exim в кратчайшие сроки обновить программное обеспечение до последней версии, чтобы защитить свои системы от потенциальных атак. Уязвимость CVE-2024-39929 присутствует во всех версиях Exim до 4.97.1 включительно. Исправление доступно в Release Candidate 3 версии 4.98. Криптовалюты теперь можно хранить под кожей — представлен имплантируемый криптокошелёк Apex

12.07.2024 [08:16],

Анжелла Марина

Компании Dangerous Things и VivoKey из США разработали новый способ хранения криптовалюты. Apex Wallet имплантируется под кожу и позволяет безопасно хранить и отправлять биткоины и другие криптовалюты с использованием технологий NFC и RFID.

Источник изображения: Dangerous Things Основатель и генеральный директор компаний VivoKey Technologies и Dangerous Things Амаль Граафстра (Amal Graafstra) рассказал, что имплантируемый чип Apex может использоваться не только для хранения криптовалюты, но и для отпирания дверей или оплаты покупок. Чип поддерживает несколько криптовалютных кошельков разных блокчейнов, включая Satochip, Seedkeeper и Status IM key, сообщает ресурс Decrypt. Apex Wallet представляет собой аппаратное устройство размером с медикаментозную капсулу, которое защищает данные, сохраняя их под кожей пользователя. Процедура имплантации чипа занимает всего несколько секунд и проводится с помощью иглы. После установки чипа пользователь может управлять своим криптовалютным кошельком через мобильное приложение, при этом приватные ключи и подписание транзакций происходят непосредственно в чипе. «Ваше приложение на телефоне служит интерфейсом, но в нём нет приватных ключей. Приватный ключ и сам процесс подписи транзакции в сети Bitcoin или другой криптовалюты происходит в чипе», — объясняет Граафстра. Вдохновлённый когда-то чипами RFID, используемыми для домашних животных, Граафстра лично имплантировал себе чип в 2005 году просто для того, чтобы отпирать свои двери. «Первоначальным стимулом для установки имплантата была чистая лень, — сказал он. — Я хотел иметь возможность входить и выходить через эту конкретную дверь без ключа или необходимости что-либо с собой носить». Он отмечает, что главным препятствием для широкого распространения этой технологии пока является отсутствие очевидных сценариев использования для большинства людей. Однако подчёркивает, что вживлённые чипы обеспечивают высокий уровень безопасности и удобства, поскольку их невозможно потерять или забыть. Компании Dangerous Things и VivoKey, запущенные в 2013 и 2017 годах соответственно, специализируются на технологиях беспроводной связи ближнего действия (NFC) и радиочастотной идентификации (RFID), адаптированных для установки внутри тела человека. Среди известных футуристов, которые поддержали идею Граафстры — предприниматель, подкастер и документалист Брайер Престидж (Briar Prestidge), которая задокументировала процесс вживления чипа Dangerous Things в своё тело. «Реальность такова, что у вас есть очень безопасный, эффективный аппаратный кошелёк, который вы никогда не потеряете, который вы не забудете, он находится прямо у вас под кожей», — сказал Граафстра. При этом он также отмечает, что чип можно заменить или удалить. В настоящее время Apex Wallet выпускается в форм-факторе Flex, который представляет собой на вид не очень-то миниатюрное устройство, но зато очень тонкое. Стоимость имплантируемого хранилища составляет 349 долларов США. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |