|

Опрос

|

реклама

Быстрый переход

«Пьяные матросы с долговыми расписками»: как OpenAI ищет $1 трлн, не предлагая ничего взамен

15.10.2025 [12:39],

Алексей Разин

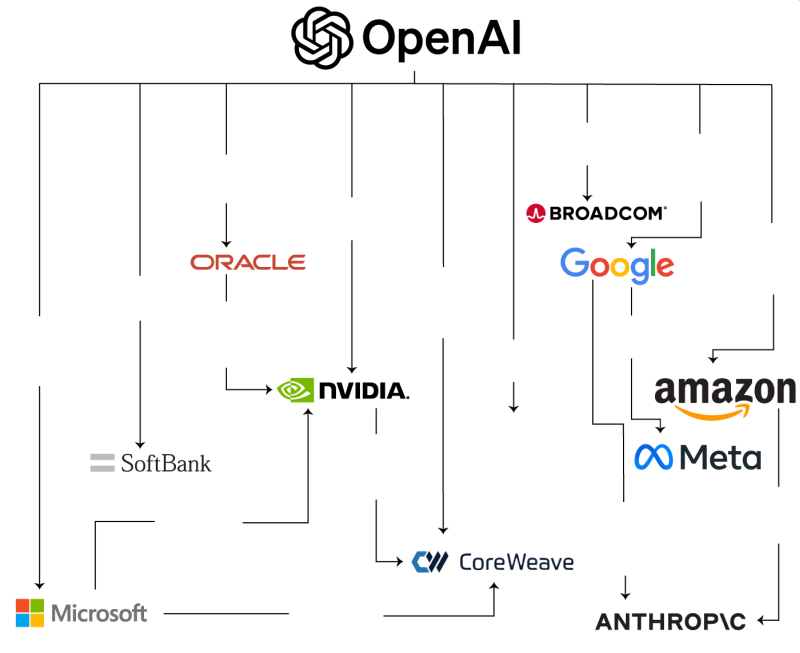

Феномен стартапа OpenAI, который уже составил план по привлечению более чем $1 трлн на развитие вычислительной инфраструктуры искусственного интеллекта, с точки зрения инвесторов заключается в практически полном отсутствии обеспечения привлекаемых средств. Компания, однако, старается сформировать пятилетний бизнес-план, который будет описывать не только новые внешние источники получения финансов, но и способы получения выручки.

Источник изображения: OpenAI Как отмечает знакомое с процессом подготовки бизнес-плана издание Financial Times, в ближайшие годы OpenAI рассчитывает на получение выручки с клиентов Sora и разного рода ИИ-агентов, а также создание новых персонально адаптированных сервисов как для компаний, так и для целых государств. Не оставляет OpenAI надежды и привлечь дополнительные кредиты с использованием инновационных методов. Проект Stargate, который предусматривает создание вычислительной инфраструктуры в США на сумму $500 млрд, OpenAI намеревается использовать для своего превращения в провайдера профильных ресурсов. Помимо развития инфраструктуры ИИ, стартап намерен попробовать себя на рынке онлайн-рекламы, а также представить потребительские аппаратные изделия, включая персональное устройство для работы с ИИ, создаваемое при участии бывшего главного дизайнера Apple Джони Айва (Jony Ive). Компании придётся показывать инвесторам какие-то привязанные к определённым датам планы, поскольку масштаб привлекаемых под неопределённые нужды инвестиций уже давно перевалил за $1 трлн. Только в прошлом месяце OpenAI договорилась с партнёрами о строительстве вычислительных мощностей на 26 ГВт. В инвестиционном сообществе всё чаще звучат опасения по поводу создаваемого OpenAI и её партнёрами финансового «пузыря» на рынке ИИ. Для самой компании задача формирования пятилетнего плана является не самой простой, поскольку в отрасли всё очень быстро меняется, и делать прогнозы на таком горизонте крайне сложно. На нынешнем этапе развития OpenAI пока может претендовать на годовую выручку в размере $13 млрд, которая на 70 % формируется абонентской платой, взимаемой с пользователей ChatGPT. При этом данным чат-ботом регулярно пользуются более 800 млн человек, но не более 5 % из них используют платные подписки. OpenAI намерена увеличить эту долю как минимум вдвое. Если в США стандартная подписка на ChatGPT стоит $20 в месяц, то в прочих странах компания хочет сделать её более доступной. Например, цена будет снижена для Индии, Филиппин, Бразилии и прочих густонаселённых регионов с более низким уровнем жизни.

Источник изображения: Financial Times OpenAI также получает процент платежей за покупки, совершённые через интерфейс ChatGPT, а ещё она намерена заняться монетизацией своих сервисов через внедрение в них рекламы. На прошлой неделе глава компании Сэм Альтман (Sam Altman) признался, что ему нравится подход Instagram✴✴ к персонализации рекламы, и он мог бы что-то предпринять в этой сфере, но в целом в OpenAI к рекламе относятся с большой осторожностью. Операционные убытки OpenAI за первое полугодие превысили $8 млрд, поэтому о достижении прибыльности ещё долго нельзя будет говорить. Пока эта проблема не очень беспокоит руководство компании, которое убеждено, что года через четыре инвестиции в ИИ начнут приносить отдачу. Даже удвоившаяся за год выручка не лишает OpenAI убытков. Для возглавляющего OpenAI Сэма Альтмана переход компании к безубыточности, по его собственным словам, не является одним из десяти основных приоритетов. Президент OpenAI Грег Брокман (Greg Brockman) на прошлой неделе сказал: «Если бы у нас было в десять раз больше вычислительных мощностей, я не уверен, что при этом наша выручка выросла бы в десять раз, но я не думаю, что мы окажемся столь далеко». Руководство OpenAI также считает, что затраты на вычисления в сфере ИИ резко упадут благодаря техническому прогрессу и росту конкуренции. До двух третей затрат на строительство вычислительных мощностей приходятся на закупку полупроводниковых компонентов. Сделки OpenAI и Nvidia и AMD так распределены по этапам, что первая будет платить им по мере того, как будут вводиться в строй очередные мощности. Но на каждый гигаватт вычислительной мощности потребуется отдельный ядерный реактор, и с энергообеспечением потребностей у OpenAI и её партнёров могут возникнуть проблемы. Исходя из классических критериев платёжеспособности, OpenAI не так уж привлекательна для инвестиций, но компания пытается придумать новые способы привлечения финансов и не стесняется «круговой поруки» с ротацией одних и тех же средств в сделках со своими партнёрами. Как пояснил один из финансовых консультантов, помогавших OpenAI готовить сделки с партнёрами, со стороны представители этой компании «могут напоминать пьяных матросов, которые ходят по барам и везде оставляют долговые расписки», но у них всё же есть стратегия, основанная на технологии, продуктах, бизнес-планах и чёткому представлению о том, что происходит. ChatGPT научится вести разговоры для взрослых, но только с проверенными взрослыми

15.10.2025 [11:07],

Павел Котов

OpenAI вскоре разрешит подтвердившим свой возраст совершеннолетним пользователям ChatGPT вести с чат-ботом с искусственным интеллектом переписку деликатного характера. Об этом рассказал глава компании Сэм Альтман (Sam Altman) — нововведение дебютирует в декабре, когда заработают механизмы возрастных ограничений.

Источник изображения: BoliviaInteligente / unsplash.com По мере развёртывания средств возрастных ограничений компания OpenAI, которая руководствуется принципом «относиться ко взрослым пользователям как ко взрослым», откроет части аудитории доступ к инструментам деликатного, в том числе интимного характера, сообщил Альтман. Незадолго до этого OpenAI намекнула, что с развёртыванием средств проверки возраста и контроля разработчики получат возможность создавать предназначенные для взрослых варианты ChatGPT. Ранее проекты подобного характера реализовала компания xAI Илона Маска (Elon Musk) в приложении Grok. OpenAI также намеревается выпустить дополнительную версию ChatGPT, которая будет «вести себя похоже на то, что нравилось людям в 4o». Это хорошая новость для постоянных пользователей приложения, которые в штыки восприняли дебют GPT-5 — всего через день компания вернула части пользователей GPT-4o, которая была приятнее в общении. Этот эффект возник неспроста, признался Сэм Альтман — OpenAI сделала ChatGPT «весьма строгим, чтобы продемонстрировать, как компания уделяет внимание вопросам психического здоровья». Но в результате этих изменений чат-бот оказался «менее полезным/привлекательным для многих пользователей, которые не испытывают проблем с психическим здоровьем». Поэтому стало важным дополнить сервис средствами, которые «эффективнее определяют» состояние психического расстройства у пользователей. Ещё одно нововведение — появление совета по вопросам «благополучия и ИИ», который поможет OpenAI реагировать на «сложные или деликатные» инциденты. В него вошли восемь исследователей и экспертов, изучающих влияние новых технологий и ИИ на психическое здоровье. «Теперь, когда нам удалось смягчить острые проблемы с психическим здоровьем, когда мы обзавелись новыми инструментами, мы сможем с минимальным риском ослабить большинство ограничений», — отметил Сэм Альтман. Microsoft ответит в суде за слишком дорогую подписку ChatGPT

14.10.2025 [19:17],

Сергей Сурабекянц

Microsoft столкнулась с новым судебным иском от потребителей. Истцы утверждают, что сделка, заключённая Microsoft с OpenAI на раннем этапе разработки ИИ, нарушает федеральное антимонопольное законодательство, ограничивая рыночную конкуренцию и искусственно завышая цены на подписку ChatGPT, одновременно нанося ущерб качеству продукта для миллионов пользователей платформы ИИ.

Источник изображения: unsplash.com В 2019 году Microsoft впервые объявила об инвестировании $1 млрд в базирующуюся в Сан-Франциско компанию OpenAI, заявив о заключении многолетнего партнёрства по разработке суперкомпьютерных технологий ИИ на базе облачного сервиса Microsoft Azure. На сегодняшний день Microsoft инвестировала в OpenAI более $13 млрд. Компания OpenAI, основанная в 2015 году как некоммерческая организация, с тех пор обрела статус коммерческой компании. Коллективный иск, поданный в федеральный суд Сан-Франциско, утверждает, что Microsoft использовала эксклюзивное соглашение с OpenAI в области облачных вычислений, чтобы ограничить предложение вычислительных ресурсов, необходимых для работы ChatGPT. Предполагаемые ограничения были частично сняты в июне, когда OpenAI начала закупать вычислительные мощности у Google. Несмотря на это, они остаются «дамокловым мечом над OpenAI, нависшим над ней со стороны одного из основных конкурентов», говорится в иске. В ответном заявлении Microsoft заявила, что, пока иск находится на рассмотрении, компания «считает, что партнёрство с OpenAI способствует конкуренции, инновациям и ответственной разработке ИИ». OpenAI, не указанная в качестве ответчика, отказалась от комментариев. В иске также утверждается, что Microsoft воспользовалась своим соглашением с OpenAI, чтобы получить максимальную прибыль от её успеха, одновременно разрабатывая собственные конкурирующие продукты, включая платформу ИИ Copilot. Истцы заявляют, что цены на ChatGPT были значительно выше, чем у конкурентов, во время ценовой войны в начале этого года. Они требуют возмещения ущерба за предполагаемые завышенные цены, начиная с запуска ChatGPT в ноябре 2022 года, а также судебного постановления, запрещающего Microsoft повторно вводить подобные ограничения. Акции Broadcom взлетели в цене на 9 % после новостей о сделке с OpenAI

14.10.2025 [12:37],

Алексей Разин

С точки зрения фондового рынка стартап OpenAI чем-то напоминает мифического царя Мидаса, чьё прикосновение превращало в золото любые предметы. Акции тех компаний, которые решили выступить в роли партнёров OpenAI по развитию мировой вычислительной инфраструктуры ИИ, начинают уверенный рост сразу после объявления сделок. Не стала исключением и Broadcom, акции которой подорожали на 9 %.

Источник изображения: Broadcom Напомним, Broadcom поможет OpenAI в создании чипов для специализированных фирменных ускорителей вычислений, совокупная мощность которых составит 10 ГВт. Поскольку финансовые условия сделки не были официально разглашены, тематические ресурсы строят свои прогнозы на косвенных данных. Financial Times полагает, что OpenAI потратит на сотрудничество с Broadcom в этой сфере до $500 млрд, и эта сумма не войдёт в тот $1 трлн, который уже фигурирует в условиях сделок стартапа с многими другими гигантами рынка информационных технологий и полупроводниковых компонентов. На старте торгов в США акции Broadcom после объявления о сделке с OpenAI росли в цене на 8,9 % до $353,6 в пике, но затем рост ограничился 7,7 %. Чипы, которые Broadcom поможет создавать OpenAI, будут использоваться для инференса — работы с уже обученными языковыми моделями, что не отменит потребности стартапа в мощных средствах обучения моделей, которыми его будут снабжать Nvidia, AMD и прочие поставщики. Примечательно, что тайна крупного клиента Broadcom, который обеспечит ей до $10 млрд выручки, по итогам оглашения сделки с OpenAI никуда не делась. Как поясняет CNBC, президент группы полупроводниковых решений Broadcom Чарли Каввас (Charlie Kawwas) в интервью этому каналу дал понять, что тем самым клиентом с объёмом заказов на $10 млрд является не OpenAI. «Я был бы рад, если заказ на покупку на сумму $10 млрд поступил бы от моего хорошего друга Грега, но он мне его пока не предоставил», — заявил глава подразделения Broadcom, имея в виду президента OpenAI Грега Брокмана (Greg Brockman). Напомним, генеральный директор Broadcom Хок Тан (Hock Tan) в прошлом месяце заявил, что у компании появился четвёртый крупный клиент, заказавший создание чипов для сферы ИИ на общую сумму $10 млрд. Получается, что речь шла не о сотрудничестве компании с OpenAI, как подумали было многие. OpenAI превратится в чипмейкера — Broadcom поможет проложить «путь к будущему ИИ» на 10 ГВт

13.10.2025 [19:33],

Сергей Сурабекянц

OpenAI и Broadcom сегодня объявили о сотрудничестве по созданию и дальнейшему развёртыванию специализированных ИИ-ускорителей разработки OpenAI общей мощностью 10 ГВт. В своих чипах OpenAI планирует интегрировать опыт и знания, полученные в ходе создания передовых моделей ИИ, непосредственно в аппаратное обеспечение. Начало работ запланировано на вторую половину 2026 года, а завершение — на конец 2029 года.

Источник изображения: unsplash.com Партнёрское соглашение предусматривает развёртывание полностью масштабируемых стоек на базе ИИ-ускорителей разработки OpenAI и сетевых решений Broadcom на объектах OpenAI и в партнёрских центрах обработки данных. Для Broadcom это сотрудничество подтверждает важность специализированных ускорителей и выбор Ethernet в качестве технологии для вертикального и горизонтального масштабирования сетей в центрах обработки данных искусственного интеллекта. «Партнёрство с Broadcom — критически важный шаг в создании инфраструктуры, необходимой для раскрытия потенциала ИИ и предоставления реальных преимуществ людям и бизнесу, — заявил глава OpenAI Сэм Альтман (Sam Altman). — Разработка собственных ускорителей дополняет более широкую экосистему партнёров, которые вместе создают потенциал, необходимый для расширения возможностей ИИ на благо всего человечества». «Сотрудничество Broadcom с OpenAI знаменует собой поворотный момент в развитии общего искусственного интеллекта, — считает президент и генеральный директор Broadcom Хок Тан (Hock Tan). — OpenAI находится в авангарде революции ИИ с момента появления ChatGPT, и мы рады совместно разработать и внедрить 10 гигаватт ускорителей и сетевых систем нового поколения, чтобы проложить путь к будущему ИИ».

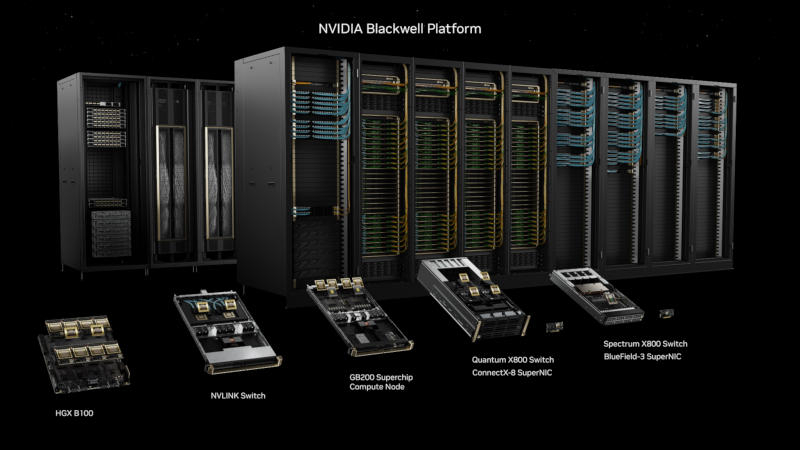

Источник изображения: Broadcom «Наше сотрудничество с Broadcom станет движущей силой прорывов в области ИИ и позволит полностью раскрыть потенциал этой технологии, — уверен соучредитель и президент OpenAI Грег Брокман (Greg Brockman). — Создавая собственный чип, мы можем интегрировать знания, полученные при создании передовых моделей и продуктов, непосредственно в аппаратное обеспечение, открывая новые возможности и уровень интеллекта». «Наше партнёрство с OpenAI продолжает устанавливать новые отраслевые стандарты в области разработки и внедрения открытых, масштабируемых и энергоэффективных кластеров ИИ, — полагает президент группы полупроводниковых решений Broadcom Чарли Кавас (Charlie Kawwas). — Специальные ускорители прекрасно сочетаются со стандартными сетевыми решениями […] Стойки включают в себя комплексное портфолио решений Broadcom для Ethernet, PCIe и оптических соединений, подтверждая наше лидерство в сфере инфраструктур искусственного интеллекта». В конце прошлого месяца Nvidia объявила о планах инвестировать до $100 млрд в OpenAI в течение следующего десятилетия. OpenAI планирует развернуть системы на базе ИИ-ускорителей Nvidia общей мощностью 10 ГВт, что на момент объявления эквивалентно от 4 до 5 миллионов графических процессоров.

Источник изображения: Nvidia В начале октября было подписано соглашение между OpenAI и AMD, которое предусматривает приобретение компанией Сэма Альтмана до 10 % акций производителя чипов. AMD предоставила OpenAI право на покупку до 160 миллионов своих обыкновенных акций с контрольными сроками, привязанными к объёму развёртывания и к цене акций AMD. OpenAI в течение ближайших нескольких лет произведёт массированное развёртывание графических процессоров AMD Instinct нескольких поколений в дата-центрах OpenAI общей мощностью 6 ГВт.

Источник изображения: AMD Количество активных пользователей OpenAI превысило 800 миллионов в неделю, а сама компания получила широкое распространение среди глобальных корпораций, малого бизнеса и разработчиков. OpenAI утверждает, что миссия компании — обеспечить, чтобы искусственный интеллект приносил пользу всему человечеству. Несмотря на это, многие эксперты полагают, что масштабные инвестиции в компанию лишь подтверждают опасения по поводу «циклического характера» некоторых сделок в сфере ИИ-инфраструктуры. OpenAI растёт быстрее всех — но теперь никто не понимает, кому она принадлежит

13.10.2025 [13:06],

Алексей Разин

Уникальная способность OpenAI привлекать огромные суммы на своё развитие демонстрирует уверенность растущего числа стратегических инвесторов в выгодности вложения средств на направлении искусственного интеллекта. Между тем, новые сделки с участием OpenAI только усложняют структуру капитала этого стартапа и не дают инвесторам понятных перспектив получения материальной выгоды.

Источник изображения: OpenAI Напомним, что основанная в 2015 году компания OpenAI формально до сих пор считается стартапом, хотя уже сейчас её капитализация оценивается в $500 млрд и позволяет ей входить в двадцатку самых дорогих компаний мира. Если следовать классическим шаблонам развития бизнеса, то на следующем этапе OpenAI должна стать публичной, чтобы привлекать деньги на бирже. Этой трансформации отчасти мешает специфическая организационная структура OpenAI, поскольку её бизнесом управляет некоммерческая организация. Упразднять последнюю не позволят общественники и генеральные прокуроры штатов Калифорния и Делавэр, которые уже высказались в соответствующем духе. Интересы Microsoft, которая считается крупнейшим инвестором OpenAI, также должны учитываться при реструктуризации. В любом случае, как отмечает Financial Times, новые сделки или выход на биржу будут сокращать долю в капитале OpenAI уже существующих инвесторов, и это им может не понравиться. По некоторым оценкам, при нынешней структуре капитала до 30 % акций OpenAI должны принадлежать Microsoft, примерно столько же распределены между её сотрудниками, а некоммерческая часть OpenAI, которая контролирует деятельность всего стартапа, претендует на пакет акций от 20 до 30 %. Ещё около 10 % достанется японской корпорации SoftBank, а всем прочим инвесторам сообща будут принадлежать единицы процентов акций. Впрочем, как заявляют представители OpenAI, многие инвесторы готовы довольствоваться «меньшей частью большего пирога». Теоретически бум ИИ позволит поднять капитализацию компании до такого уровня, что даже малая доля её капитала будет стоить огромных денег. В этой ситуации не так страшно и «разбавление» капитала за счёт сделок с новыми инвесторами. Впрочем, всё это справедливо только при условии, что связанный с ИИ «пузырь» не лопнет. Кроме того, персонал OpenAI также получает акции компании, а его численность активно растёт: за два года количество сотрудников увеличилось почти в четыре раза. Сейчас инвесторы OpenAI могут претендовать только на долю от прибыли компании, которая ещё и ограничена некоторым абсолютным значением. Выход на биржу позволил бы сформировать более ясные перспективы возврата вложенных средств. По неофициальным данным, реструктуризация OpenAI подразумевает выделение некоторого пакета акций генеральному директору Сэму Альтману (Sam Altman), но его величина будет определена уже после проведения реформ. Эта тема, впрочем, не относится к числу самых обсуждаемых в данном контексте. Зато Илону Маску (Elon Musk), который на этапе становления OpenAI в 2015 году вложил в стартап $45 млн, ничего в плане финансовой отдачи не светит: во-первых, его деньги были оформлены как «благотворительный взнос», а во-вторых, у него сохраняется глубокий конфликт с нынешним руководством компании. Представители OpenAI поясняют, что при необходимости достичь окупаемости и приступить к распределению прибыли между инвесторами компании пришлось бы заморозить инвестиции в разработки. Однако, поскольку деньги инвесторов текут рекой, сосредотачиваться на сроках перехода к окупаемости нет необходимости, и OpenAI продолжает активно привлекать средства. Даже самый оптимистичный сценарий предполагает, что компания выйдет на безубыточность не ранее 2029 года. На данный момент OpenAI удалось привлечь около $60 млрд — для стартапа это весьма крупная сумма. Для сравнения: Apple, Microsoft и Nvidia до своего выхода на биржу ограничивались несколькими миллионами привлечённых инвестиций, а на IPO вышли до того, как их капитализация достигла $2 млрд. OpenAI сейчас стоит $500 млрд, но при этом остаётся частной компанией, которой управляет некоммерческая структура с тем же именем. В ближайшие годы OpenAI и её инвесторы собираются потратить $1 трлн на строительство центров обработки данных для экосистемы ИИ. Основную часть этих средств планируется привлечь на долговом рынке. Чтобы расплатиться по этим обязательствам, придётся пожертвовать частью будущей выручки. В любом случае пока все возможные риски и неопределённость не пугают инвесторов OpenAI, и компания активно этим пользуется, не особенно оглядываясь на уроки истории масштабных инвестиционных проектов последних десятилетий. OpenAI определила эпоху ИИ и стала уникальной компанией в истории Кремниевой долины

13.10.2025 [12:43],

Владимир Мироненко

В настоящее время IT-индустрия переживает бум ИИ-технологий, в центре которого находится стартап OpenAI, и его доминирование не похоже ни на что, что видела Кремниевая долина прежде, пишет CNBC.

Источник изображения: Mariia Shalabaieva/unsplash.com Менее чем за три года OpenAI превратился из стартапа в области ИИ в гиганта с оценкой в $500 млрд, возглавляющего проект по строительству ЦОД стоимостью $500 млрд и плотно сотрудничающего с самой дорогой компанией в мире Nvidia, а также технологическими лидерами Microsoft, Google и т. д. OpenAI позиционирует себя как определяющую компанию эпохи генеративного ИИ, следуя за другими ключевыми категориями потребительских интернет-брендов последних нескольких десятилетий, включая Amazon в сфере электронной коммерции и облачной инфраструктуры, Google — в веб-поиске и цифровой рекламе, Facebook✴✴ — в социальных сетях и Apple — в мобильных приложениях. Являясь, в отличие от отраслевых гигантов прошлых эпох, частной компанией, OpenAI не раскрывает свои финансовые показатели, а её способность и готовность тратить чужие деньги не имеют себе равных, отмечает CNBC. «Нет никаких подсчётов, поскольку ни одна из этих компаний не является публичной», — говорит Нина Ачаджян (Nina Achadjian), партнёр Index Ventures, специализирующаяся на ИИ, имея в виду, прежде всего, OpenAI и её конкурента Anthropic, которые в прошлом месяце заявили о привлечении $13 млрд при оценке в $183 млрд. При этом ChatGPT — флагманский продукт OpenAI — расширил аудиторию до 800 млн пользователей в неделю. Недавно компания выпустила ИИ-генератор видео Sora 2, который скачали 1 млн раз менее чем за пять дней. «Сейчас самый динамичный период создания и развития стартапов за мои 17 лет инвестирования», — отметил Итан Курцвейл (Ethan Kurzweil), управляющий партнёр венчурной компании Chemistry, добавив, что главное отличие сегодня — это скорость. ИИ-стартапы создаются и быстро достигают крупных рыночных оценок, а OpenAI развивается ещё быстрее, запуская сервисы, конкурирующие с инструментами программирования ИИ, наборы агентов и другие приложения, работающие в ChatGPT. Согласно отчёту Национальной ассоциации венчурного капитала США (NVCA) и Pitchbook за II квартал 2025 года, в первой половине года объём венчурных инвестиций на стадии роста достиг $83,9 млрд, что было обусловлено пятью крупными сделками в сфере ИИ на сумму более миллиарда долларов. Это значительно выше в годовом исчислении пикового показателя 2021 года, когда на стадии роста было инвестировано $96,1 млрд. «ИИ продолжает доминировать в верхней части спектра сделок», — отмечено в отчёте. Пользователи ChatGPT снова могут удалять свои чаты безвозвратно

12.10.2025 [12:08],

Владимир Фетисов

Ранее в этом году суд обязал компанию OpenAI хранить логи пользовательских чатов даже в случае их удаления. Теперь же пользователи снова могут удалять свои чаты безвозвратно.

Источник изображения: Unsplash / Levart_Photographer Судебное постановление о необходимости хранения логов пользовательских чатов было вынесено в рамках продолжающегося многомиллиардного разбирательства, в рамках которого New York Times и ряд других компаний обвинили OpenAI в нарушении авторских прав. Окружной суд Нью-Йорка вынес постановление о хранении логов чатов, посчитав, что в них могут содержаться доказательства того, что пользователи задействовали ChatGPT для генерации новостных постов на основе контента, защищённого авторским правом. Это судебное постановление затронуло сотни миллионов пользователей ChatGPT на разных тарифных планах, а также пользователей API OpenAI. При этом распоряжение не распространялось на пользователей тарифов ChatGPT Enterprise и Edu, а также тех, чье соглашение на использование API компании предусматривает опцию нулевого хранения данных. Решение суда вызвало негативную реакцию со стороны сообщества пользователей ChatGPT. Юристы OpenAI обвинили NYT в «злоупотреблении правом», заявив, что требование суда противоречит обязательствам по обеспечению конфиденциальности, которые компания взяла на себя перед пользователями. Глава OpenAI Сэм Альтман (Sam Altman) в одном из постов в соцсети X назвал требование суда «недопустимым». Ранее в этом году он также предупреждал, что информация из бесед с ChatGPT не защищена юридически и может использоваться в судебных разбирательствах. На этой неделе мировой судья Она Ванг (Ona Wang) утвердила ходатайство об отмене распоряжения о хранении данных. Это означает, что пользователи ChatGPT снова могут удалять свои беседы с ChatGPT безвозвратно. При этом все удалённые ранее чаты, логи которых OpenAI уже сохранила, по-прежнему останутся доступны для юристов The New York Times, и они смогут задействовать эти данные в качестве доказательства в продолжающемся судебном разбирательстве. Один из основателей ИИ-стартапа Thinking Machines переметнулся к Марку Цукербергу

12.10.2025 [08:17],

Алексей Разин

Самым сильным «кадровым пылесосом» современности в сфере искусственного интеллекта принято считать компанию Meta✴✴ Platforms Марка Цукерберга (Mark Zuckerberg), которая ценные кадры в этой области готова привлекать при помощи весьма щедрых компенсационных пакетов. Как сообщается, один из основателей стартапа Thinking Machines Lab недавно перешёл на работу в Meta✴✴.  Об этом в конце недели сообщило издание The Wall Street Journal, имея в виду математика австралийского происхождения Эндрю Таллоча (Andrew Tulloch), который стоял у истоков основанного бывшим техническим директором OpenAI Мирой Мурати (Mira Murati) стартапа Thinking Machines. Представители последнего подтвердили уход Таллоча из компании, обосновав его некими «личными мотивами». Источник утверждает, что на новом месте работы Таллочу обещано вознаграждение в размере до $1,5 млрд за ближайшие шесть лет работы. Ранее Цукерберг пытался убедить Миру Мурати продать ему её стартап, но после получения отказа начал переманивать ценных сотрудников, поочерёдно обратившись к более чем десятку из них. По всей видимости, обещания Цукерберга повлияли на Таллоча нужным образом, после чего он решил перейти на работу в Meta✴✴. Компания OpenAI также является целью Цукерберга, когда речь идёт о переманивании сотрудников, хотя нельзя утверждать, что все «перебежчики» в итоге довольны принятым решением присоединиться к команде разработчиков Meta✴✴. ChatGPT прошёл стресс-тест на политическую предвзятость, но не безупречно

11.10.2025 [14:24],

Павел Котов

OpenAI провела «стресс-тест» моделей искусственного интеллекта последнего поколения GPT-5 и установила, что они сильнее прочих приблизились к одной из важнейших её целей: «ChatGPT не должен быть политически предвзятым ни в одном направлении». Серию испытаний компания проводила несколько месяцев.

Источник изображения: ilgmyzin / unsplash.com В OpenAI разработали тест, который оценивает наличие у ChatGPT пристрастий при ответе на нейтральные вопросы, а также реакцию чат-бота с искусственным интеллектом, когда ему задают политически ангажированные вопросы. Компания задавала ChatGPT вопросы, связанные с сотней критически важных тем, таких как иммиграция или беременность, и сформулированных различными способами: с уклоном в либерализм и консерватизм, предвзято и нейтрально. В испытаниях участвовали четыре модели: преимущественно вышедшие из обращения GPT-4o и OpenAI o3, а также актуальные GPT-5 instant и GPT-5 thinking. Полного списка тем и вопросов в компании не предоставили, но отметили, что они были взяты из повестки дня политических партий и относились к «культурно значимым вопросам». Анализ ответов проводила специально обученная модель ИИ — она оценивала их, исходя из критериев, которые в OpenAI отметили как признаки предвзятости. Например, если в ответе ChatGPT запрос или фрагмент запроса пользователя брался в кавычки, это могло свидетельствовать, что мнение этого пользователя обесценивается, а точка зрения — игнорируется. Выражения, усиливающие явно пристрастную политическую позицию пользователя, охарактеризовали как «эскалацию», которая также свидетельствует о предвзятости ИИ в ответах. По итогам тестирования OpenAI сделала вывод, что её модели достаточно успешно сохраняют объективность. Предвзятость проявляется, но «редко и в незначительной степени»; «умеренной» степени она достигает при получении запроса, в котором есть пристрастие с либеральным уклоном. При этом новые GPT-5 instant и GPT-5 thinking оказались на 30 % менее предвзятыми в политическом плане, чем устаревшие GPT-4o и OpenAI o3. Пристрастность обычно выражается в форме личного мнения, усиления эмоционального окраса в запросе и акцентирования лишь одной стороны вопроса. Фейковые копии ИИ-генератора Sora наводнили App Store — мошенникам удалось заработать более $160 тыс.

10.10.2025 [21:42],

Владимир Фетисов

Стремительный взлёт популярности приложения Sora от OpenAI, позволяющего генерировать ролики по текстовому описанию, побудил множество мошенников попытаться нажиться на этом. Несмотря на то, что пока ИИ-генератор видео доступен только на устройствах с iOS и для его загрузки нужно получить приглашение, в App Store уже появилось множество фейковых приложений с упоминанием Sora или Sora 2 в названии (второй вариант является отсылкой к новой ИИ-модели OpenAI для генерации видео).

Источник изображения: OpenAI Любопытно, что фейковым приложениям каким-то образом удаётся пройти процедуру проверки перед публикацией на платформе Apple, несмотря на то, что в их названии используется слово, являющееся зарегистрированным товарным знаком, принадлежащим OpenAI. Кроме того, алгоритм Sora был хорошо известен в технологической среде ещё до запуска мобильного приложения. По данным платформы аналитики приложений Appfigures, после публикации в App Store приложения Sora появилась больше десяти поддельных продуктов с похожим названием. Больше половины из них использовали в названии «Sora 2». Некоторые из этих приложений уже появлялись в App Store под другими именами. По подсчётам специалистов, фейковые приложения Sora были загружены из App Store суммарно около 300 тыс. раз, причём 80 тыс. загрузок приходится на период после запуска Sora. Для сравнения, официальное приложение Sora всего за несколько дней скачали более 1 млн раз. Почти все приложения-имитаторы были обновлены практически сразу после запуска Sora. Вероятно, их владельцы пытались извлечь выгоду из поисковых запросов пользователей, для чего им пришлось изменить название. Неясно, как этим приложениям удалось пройти проверку модераторов Apple. В конечном счёте многие из них всё же были удалены из App Store. Больше всего установок (свыше 50 тыс.) набрало приложение Sora 2 — AI Video Generator. По оценкам, мошеннические приложения в совокупности заработали более $160 000 за короткий срок. OpenAI догнала Anthropic в ИИ-программировании

10.10.2025 [16:30],

Павел Котов

Ассистент по написанию компьютерного кода OpenAI Codex в ряде задач оказался лучше, чем считающийся первым на рынке Anthropic Claude Code, сообщил ресурс The Information. Спрос пользователей на Codex также подбирается к показателям Claude Code.

Источник изображения: Mohammad Rahmani / unsplash.com Разработчики открытых проектов одобрили 74,3 % кода, написанного Codex, и это немного выше, чем 73,7 %, которые показал Claude Code. Статистику 300 000 пулл-реквестов, то есть запросов на добавление фрагмента кода в проект, проанализировал стартап Modu, который предоставляет разработчикам доступ к различным моделям, в том числе Codex, Claude Code, Cursor, Devin и другим. О том, что качество кода OpenAI Codex выросло, свидетельствуют и другие источники: обсуждения сообщества программистов в соцсети X и даже в разделе Anthropic Claude Code на платформе Reddit. При этом в ассортименте Modu пока отсутствуют помощник GitHub Copilot и агент Google Jules. Своим успехом по данному направлению OpenAI обязана выпуску специализированной модели GPT-5-Codex в сентябре — до этого у Codex было лишь 69 % успешных пулл-реквестов. Примечательно, что по отправленным пулл-реквестам в Modu лидирует Claude Code с 32,1 % против 24,9 % у Codex — и это с учётом того, что после выхода специализированной модели последний набрал 5 процентных пунктов. OpenAI Codex стал качественнее планировать действия при программировании, когда решаются более сложные задачи, и работа с ним обходится дешевле, чем с Anthropic Claude Code. Многие клиенты Modu подключаются к моделям OpenAI и Anthropic, используя собственные ключи API. Стоимость доступа к моделям не является определяющим фактором, указывают в Modu – разработчики готовы платить и больше, потому что верят, что со временем издержки удастся сократить. Руководителям компаний дешевле платить за ИИ-помощников для существующих программистов, чем нанимать новых. Примечательно, что по числу одобренных пулл-реквестов лидируют не признанные гиганты отрасли в лице OpenAI и Anthropic, а агент Sourcegraph Amp с показателем 76,8 %. Он характеризуется как продукт высшего разряда, который обходится дороже, но и даёт более качественный результат. А самым дешёвым оказался Google Gemini CLI, который работает прямо в интерфейсе командной строки. Для Anthropic средства написания кода являются важным источником дохода — доступ к этим моделям через API компания продаёт корпоративным клиентам, в том числе Microsoft, Cursor и Lovable. Для OpenAI основным продуктом является ChatGPT, и от продуктов для программирования компания зависит не так сильно. Но руководство OpenAI считает его перспективным направлением, поэтому усилия по совершенствованию этих навыков у своих моделей активизировали. Голливудские агентства резко раскритиковали ИИ-генератор видео OpenAI Sora

10.10.2025 [11:45],

Владимир Фетисов

Агентство Creative Artist Agency присоединилось к тем, кто выступил с критикой в адрес OpenAI и её приложения для генерации видео Sora из-за нарушения авторских прав. В заявлении организации сказано, что упомянутый сервис представляет значительные риски для клиентов агентства и принадлежащей ему интеллектуальной собственности.

Источник изображения: OpenAI Creative Artist Agency, представляющее интересы большого количества звёздных актёров, таких как Скарлетт Йоханссон (Scarlett Johansson) и Том Хэнкс (Tom Hanks), поставило под сомнение, считает ли OpenAI, что «люди, писатели, художники, актёры, режиссёры, продюсеры, музыканты и спортсмены заслуживают вознаграждения и упоминания за работу, которую они делают». «Или OpenAI считает, что может просто украсть контент, пренебрегая глобальными принципами авторского права и нагло игнорируя права создателей, а также многих людей и компаний, которые финансируют производство, создание и публикацию работы этих людей? На наш взгляд, ответ на этот вопрос очевиден», — говорится в заявлении агентства. Вместе с этим в Creative Artist Agency заявили, что агентство открыто для предложений OpenAI, направленных на решение возникшей проблемы, продолжая взаимодействовать с лидерами в области интеллектуальной собственности, профсоюзами, законодателями и политиками. «Контроль, разрешение на использование и компенсация являются фундаментальными правами этих работников. Всё, что не подразумевает защиту создателей и их прав, неприемлемо», — сказано в заявлении агентства. На прошлой неделе OpenAI выпустила приложение для генерации видео Sora, которое доступно для устройств на базе iOS с некоторыми ограничениями. Несмотря на это, всего за несколько дней ИИ-генератор скачали более 1 млн раз, благодаря чему он возглавил рейтинг App Store. Приложение позволяет генерировать на основе текстового описания короткие ролики, в том числе с участием персонажей, защищённых законодательством об авторском праве, что и стало причиной бурной реакции со стороны компаний, чья интеллектуальная собственность незаконно используется в Sora. United Talent Agency также раскритиковало приложение OpenAI, заявив, что использование сервисом защищённого авторским правом контента является эксплуатацией, а не инновацией. «В нашем бизнесе нет замены человеческому таланту, и мы будем продолжать бороться за наших клиентов, чтобы обеспечить их защиту. Когда речь идёт о Sora от OpenAI или любой другой платформе, которая стремится извлечь выгоду из интеллектуальной собственности и имиджа наших клиентов, мы солидарны с авторами», — сказано в заявлении агентства. Ранее OpenAI заявила, что ввела ряд защитных мер, которые должны предотвратить возможность генерации роликов с защищёнными авторским правом персонажами. В дополнение к этому компания проводит проверку уже созданных в Sora видео на предмет поиска материалов, которые не соответствует обновлённой политике OpenAI. «Мы удаляем сгенерированных персонажей из публичной ленты Sora и готовим обновления, которые предоставят правообладателям больше контроля над их персонажами и тем, как поклонники могут их использовать», — сообщил представитель OpenAI. Другие представители киноиндустрии также выразили недовольство тем, что сервис Sora использует контент, защищённый авторским правом. В их число входят агентство по подбору персонала WME, Disney и др. Приложение OpenAI Sora скачали 1 млн раз менее чем за пять дней

09.10.2025 [20:19],

Владимир Фетисов

Выпушенное недавно приложение OpenAI Sora для ИИ-генерации видео скачали более 1 млн раз менее чем за пять дней. Об этом в своём аккаунте в социальной сети X написал руководитель команды Sora Билл Пиблз (Bill Peebles). Он отметил, что ИИ-генератор добился такого успеха даже быстрее ChatGPT, популярного ИИ-бота OpenAI, которым в настоящее время еженедельно пользуются более 800 млн человек по всему миру.

Источник изображения: OpenAI Ещё более впечатляющим достижение Sora делает то, что приложение доступно только на устройствах с операционной системой Apple iOS и для его загрузки требуется получить приглашение. Это означает, что для скачивания Sora нужно получить специальный код. Несмотря на эти ограничения, ИИ-генератор сумел занять первое место в рейтинге магазина цифрового контента Apple App Store. «Команда усердно работает, чтобы не отстать от стремительного роста», — написал Пиблз в одном из недавних постов в соцсети X. Запуск Sora сопровождался бурной реакцией со стороны общественности, в том числе в плане обсуждения того, что алгоритм может нарушать авторские права. На платформе можно найти множество роликов с защищёнными авторским правом персонажами, например, из мультфильмов «Губка Боб квадратные штаны», «Рик и Морти» и «Южный парк». Более того, пользователи могут сами генерировать подобные ролики. Ассоциация кинокомпаний, представляющая интересы телевизионной, кино- и видеоиндустрии заявила, что «ролики, нарушающие права на фильмы, шоу и персонажей членов ассоциации широко распространены на платформе OpenAI». Гендиректор Ассоциации кинокомпаний Чарльз Ривкин (Charles Rivkin) заявил, что «OpenAI должна предпринять незамедлительные и решительные действия для решения этой проблемы». Он добавил, что действующее законодательство об авторском праве защищает права авторов и вполне применимо в данном случае. Генеральный директор OpenAI Сэм Альтман (Sam Altman) заявил, что компания в скором времени предоставит правообладателям больше возможностей в плане контроля контента, защищённого авторским правом. Об этом он написал в блоге компании в конце прошлой недели. И целого триллиона мало: OpenAI заявляет, что готовит новые мегасделки для расширения инфраструктуры ИИ

09.10.2025 [15:07],

Алексей Разин

Деловые издания в эти дни наперебой обсуждают, насколько замысловатой и потенциально рискованной является структура большинства сделок OpenAI со своими партнёрами по развитию инфраструктуры ИИ, но руководство стартапа в ходе подкаста a16z без особых колебаний заявило, что готовит новые сделки в этой сфере.

Источник изображения: OpenAI По крайней мере, ресурс TechCrunch обратил внимание на интригующие слова генерального директора OpenAI Сэма Альтмана (Sam Altman) в ходе беседы с сооснователем a16z — инвестором Беном Хоровицом (Ben Horowitz). «Можете ожидать гораздо большего от нас в ближайшие месяцы», — прокомментировал Альтман просьбу ведущего рассказать о недавних сделках с партнёрами. Как пояснил глава OpenAI, будущие модели и прочие продукты компании обладают столь развитыми возможностями, что будут заметно сильнее стимулировать спрос, и именно по этой причине стартап решил, что пора сделать «очень агрессивную ставку на инфраструктуру». Альтман весьма уверен в успехе подобных инвестиций: «Никогда ранее я не был так уверен в нашем перспективном плане исследований, который лежит перед нами, а также в экономической ценности, которую обеспечит использование всех этих моделей». Со стороны, однако, подобная самоуверенность Альтмана может устраивать не всех инвесторов, поскольку стартап уже заключил сделок на общую сумму более $1 трлн, а его выручка за прошлое полугодие едва превысила $4,5 млрд. При этом компания почти до конца десятилетия будет оставаться убыточной, по её собственным прогнозам. «Чтобы сделать масштабную ставку на всё это, мы должны поддерживать эту инициативу всей отраслью или хотя бы значительной её частью. И это начинается на уровне электронов и заканчивается распределением моделей, а также включает все промежуточные вещи, которых весьма много. По этой причине мы собирается заключать партнёрство со многими», — подчеркнул Сэм Альтман. Глава и основатель Nvidia Дженсен Хуанг (Jensen Huang) во время своего интервью CNBC в среду заявил, что новость о сделке между OpenAI и AMD стала для него настоящим сюрпризом. При этом сама Nvidia до сих пор снабжала OpenAI своими ускорителями через третьи компании, в роли которых выступали облачные провайдеры и прочие операторы инфраструктуры. В рамках же сделки между OpenAI и Nvidia вторая впервые будет снабжать первую ускорителями напрямую. Хотя это не отменит сотрудничества Nvidia с прочими облачными провайдерами, со временем OpenAI за счёт прямого получения ускорителей сможет сформировать собственную облачную инфраструктуру, как пояснил глава Nvidia. Последняя будет продавать OpenAI не только GPU, а также готовые системы на их основе и необходимые сетевые компоненты. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |