|

Опрос

|

реклама

Быстрый переход

DeepSeek оставила навсегда 75-процентную скидку на ИИ-модель V4-Pro

24.05.2026 [18:15],

Владимир Мироненко

Китайский ИИ-стартап DeepSeek объявил о решении сохранитть навсегда 75-процентную скидку на использование своей флагманской ИИ-модели V4-Pro, срок действия которой должен был завершиться в конце мая. Как полагают эксперты, это решение связано с возможностью более широкого использования DeepSeek чипов Huawei.

Источник изображения: Solen Feyissa/unsplash.com Во всяком случае, представляя V4-Pro, компания заявили, что она будет стоить до 12 раз дороже, чем менее мощная версия Flash, из-за «ограничений в высокопроизводительных вычислительных мощностях». Вместе с тем DeepSeek тогда добавила, что следует ожидать резкое снижение цен на версию V4-Pro после массового запуска суперузлов на базе Huawei Ascend 950 во второй половине 2026 года. Согласно заявлению компании, стоимость использования API V4-Pro с 75-процентной скидкой находится в диапазоне 0,025–6 юаней (около $0,0035 до $0,83) за 1 млн токенов. Снизив цену, DeepSeek стремится укрепить свои позиции на всё более переполненном рынке, чтобы привлечь разработчиков и корпоративных пользователей, и, как результат, обойти как отечественных конкурентов, так и западные компании в сфере ИИ-услуг. Оптимизировав ИИ-модели V4 для работы на китайских процессорах Huawei Ascend 950, а не на дорогостоящих ускорителях Nvidia, доступ к которым к тому же ограничен, DeepSeek смогла значительно снизить свои операционные затраты на инфраструктуру. Это позволило ей предлагать свои решения клиентам на более привлекательных условиях, вступая в прямую конкуренцию с западными ИИ-гигантами. Экспортные ограничения США на поставку продвинутых графических процессоров Nvidia китайским компаниям, призванные замедлить прогресс Китая в сфере ИИ, оказали противоположный эффект: создали масштабный, эксклюзивный рыночный бум для крупнейшего китайского конкурента Nvidia, компании Huawei, а также других китайских производителей микросхем. Стартапы массово переходят на Claude Code, а GitHub Copilot теряет позиции

24.05.2026 [10:15],

Дмитрий Федоров

ИИ-помощник Claude Code от Anthropic быстро становится основным инструментом разработки в технологических стартапах, вытесняя Cursor и GitHub Copilot. Как сообщает Business Insider со ссылкой на опрос более двух десятков основателей компаний и венчурных инвесторов, разработчики всё чаще выбирают решение Anthropic для сложных инженерных задач и автономных рабочих процессов.

Источник изображения: anthropic.com Интерес инвесторов к этому рынку продолжает расти. Разработчик Cursor, компания Anysphere, недавно заключила соглашение, дающее SpaceX право выкупить её до конца года за $60 млрд, либо получить компенсацию в размере $10 млрд в случае отмены сделки. Одновременно рынок ждёт возможного выхода на биржу Anthropic. Причина ажиотажа проста: генерация кода остаётся одним из самых востребованных и прибыльных применений генеративного ИИ, а компании всё активнее используют такие системы не только для ускорения разработки, но и для автоматизации задач, которые раньше требовали участия целых команд инженеров. Многие пользователи отмечают, что Claude Code изменил сам подход к программированию. Старший исследователь Venture Studio Forum Мэтью Баррис рассказал, что ещё несколько месяцев назад практически не писал код, а теперь создаёт собственные инструменты, которые раньше пришлось бы заказывать у подрядчиков. По его словам, главное преимущество системы заключается в агентном режиме: Claude способен не просто предлагать фрагменты кода, а самостоятельно продумывать архитектуру решения и пошагово двигаться к результату. Технический директор биометрического стартапа VaryAI Чжунтянь Ван утверждает, что Claude Code уже используется практически во всех внутренних процессах компании. Если раньше его применяли в основном для написания кода и исправления ошибок, то теперь система помогает с тестированием, развёртыванием, расследованием инцидентов и управлением проектами. Cursor сохраняет популярность, однако всё чаще воспринимается как вспомогательный инструмент. Генеральный директор медицинского ИИ-стартапа Blueprint Дэнни Фрид считает, что Cursor одним из первых показал возможности ИИ-программирования, но в сложных сценариях агентный подход Claude Code оказался заметно эффективнее. Схожую оценку даёт глава компании Alma Рами Альхамад. По его словам, Cursor по-прежнему удобен для простых задач, однако серьёзную разработку команда всё чаще доверяет Claude Code. Сейчас значительную часть программного кода в компании создаёт ИИ, а инженеры занимаются проверкой и доработкой результата. Альхамад отмечает, что современные системы уже способны решать задачи, которые ещё полгода назад считались слишком сложными для автоматизации: работать сразу с несколькими репозиториями, учитывать архитектурные ограничения и понимать контекст всей кодовой базы. Ещё заметнее изменилась роль GitHub Copilot. Несколько лет назад он считался главным игроком на рынке ИИ-помощников для программистов, однако сегодня многие участники отрасли почти не упоминают его среди лидеров. Сооснователь Zafran Security Бен Сери заявил, что Copilot больше не даёт существенных преимуществ по сравнению с новыми решениями. Впрочем, большинство компаний не ограничивается одним продуктом. Партнёр Costanoa Ventures Тони Лю считает, что споры о том, какой инструмент лучше, постепенно теряют смысл: гораздо важнее то, насколько глубоко ИИ встроен в рабочие процессы. На практике разработчики часто используют сразу несколько систем. Например, студия Mother.tech применяет Claude для написания кода, Codex для локального тестирования, а Gemini — для проверки изменений перед их отправкой в основную ветку проекта. По словам сооснователя Tenzai Итамара Таля, его команда также комбинирует несколько решений, включая Codex, Vercel и Amp, но отказалась от сервисов для так называемого вайб-кодинга вроде Replit и Lovable. Они хорошо подходят для быстрого прототипирования, однако уступают по безопасности и хуже масштабируются. Самый показательный пример возможностей Claude Code Таль привёл из собственной практики. Когда во время звонков в Zoom начало мерцать изображение в конференц-зале, команда не стала обращаться в ИТ-службу. Claude Code получил доступ к контроллеру системы, самостоятельно провёл диагностику и примерно за 25 минут обнаружил проблему совместимости оборудования, предложив способ её устранения. По оценке Таля, это позволило сэкономить часы работы специалистов и тысячи долларов. «Разработка никогда не была такой быстрой и динамичной. И кажется, что всё только начинается», — резюмировал он. ИИ-супермодель Claude Mythos всего за месяц обнаружила свыше 10 тыс. уязвимостей в ПО

23.05.2026 [19:54],

Анжелла Марина

Компания Anthropic опубликовала первый отчёт о проекте в сфере кибербезопасности Project Glasswing, запущенной в апреле. В основе инициативы лежит пока не ставшая широкодоступной ИИ-модель Claude Mythos Preview, которая всего за один месяц помогла партнёрам Anthropic обнаружить более 10 тысяч уязвимостей в их программном обеспечении.

Источник изображения: Anthropic Большинство компаний, получивших доступ к нейросети, зафиксировали сотни критических багов в своих продуктах. Как сообщает Engadget, Cloudflare обнаружила 2000 уязвимостей, из которых 400 отнесены к категории высокой или критической опасности. Mozilla нашла и исправила 271 ошибку в браузере Firefox, значительно превзойдя результаты тестирования с использованием предыдущих версий модели Claude. Также и недавнее заявление Microsoft о предстоящем увеличении объёма выпускаемых патчей напрямую связано с результатами сканирования инфраструктуры через Mythos Preview. Помимо корпоративного сектора, специалисты Anthropic протестировали тысячу проектов с открытым исходным кодом, где ИИ выявил свыше 6200 критических угроз из 23 тысяч найденных недочётов. При этом сторонние исследователи заявили, что с помощью Mythos им удалось найти способ по взлому защищённой операционной системы macOS. На фоне столь высокой эффективности Anthropic пока отказывается от публичного релиза модели, так как разработчики опасаются использования технологии злоумышленниками и планируют сделать алгоритм общедоступным только после создания надёжных механизмов защиты. В настоящее время Anthropic расширяет доступность проекта Project Glasswing, работая над восстановлением отношений с правительством США и привлекая к сотрудничеству крупные технологические компании, включая Apple, Google и Nvidia. Увольнять сотрудников из-за ИИ становится невыгодно — тот оказался дороже

23.05.2026 [13:57],

Павел Котов

Современные компании всё чаще подталкивают сотрудников максимально использовать искусственный интеллект в работе, повысить их производительность труда. Но эта стратегия становится всё менее выгодной экономически — обращение к ИИ стремительно дорожает, пишет Fortune.

Источник изображений: Igor Omilaev / unsplash.com Microsoft начала аннулировать большинство рабочих лицензий на ИИ-программиста Anthropic Claude Code и переводить инженеров на собственный инструмент GitHub Copilot CLI — компания начала использовать Claude Code всего за полгода до этого, побуждая разработчиков экспериментировать с этим решением. Оно стало популярным, и, возможно, даже слишком. Отмена лицензий, однако, не повлияет на сделку Anthropic с Microsoft Foundry: разработчик ИИ получает от софтверного гиганта инвестиции в размере $5 млрд и в ответ обязуется закупить вычислительные мощности Azure в размере $30 млрд. Нечто похожее произошло в Uber — её инженеры всего за четыре месяца исчерпали бюджет компании на средства ИИ на 2026 год. А прежде руководство Uber стимулировало внедрение ИИ и даже составляло рейтинги, ранжирующие отделы по использованию ИИ в работе. Стоимость внедрения ИИ становится всё более серьёзным препятствием для бизнеса, а экономика замены или хотя бы дополнения человеческого труда может оказаться сложнее, чем говорилось в прогнозах. И даже вице-президент по прикладному глубокому обучению в Nvidia Брайан Катанзаро (Bryan Catanzaro) недавно признался: «В моём отделе стоимость вычислительных ресурсов намного превышает затраты на сотрудников».  Uber и Microsoft не единственные подталкивали сотрудников использовать ИИ по максимуму: даже в Meta✴✴ сформировали таблицу лидеров под названием «Клодеономика» в честь моделей Anthropic Claude; а в Amazon сотрудникам рекомендовали «максимально использовать токены ИИ» — базовые единицы вычислительных ресурсов ИИ. Но когда поставщики услуг начинают взимать плату на основе потребления токенов, ИИ стремительно дорожает. Согласно прогнозам Goldman Sachs, к 2030 году потребление ИИ-токенов вырастет в 24 раза и достигнет 120 квадриллионов в месяц. Предприятия будут чаще обращаться к ИИ-агентам для повышения производительности труда, и их совокупные расходы будут расти даже при снижении цены за один токен. По версии аналитиков Gartner, развёртывание ИИ-модели с триллионом параметров в 2030 году подешевеет на 90 % по сравнению с 2025 годом. Но облегчения это не принесёт, потому что предназначенные для управления ИИ-агентами модели потребляют при решении задач больше токенов, чем стандартные. Рост потребления может опережать снижение удельных затрат, а поставщики ИИ не смогут полностью переложить снижение затрат на потребителей. В итоге стоимость вычислений, вероятно, дополнительно вырастет. Суровая реальность может скорректировать планы некоторых компаний по развёртыванию ИИ-агентов. Гендиректор Nvidia Дженсен Хуанг (Jensen Huang) заявил, что с каждым сотрудником его компании однажды будут работать около сотни ИИ-агентов, и во всей организации будут действовать цифровые двойники. Если потребление токенов будет расти быстрее, чем снижаются удельные цены, будущее грозит обернуться большими затратами, чем ожидают руководители. Марк Цукерберг высказался в защиту тотальной слежки за действиями сотрудников Meta✴ — для обучения ИИ, но это не точно

23.05.2026 [11:48],

Павел Котов

В ответ на вопрос сотрудника Meta✴✴ по поводу системы слежки за действиями его коллег для последующего обучения моделей искусственного интеллекта глава компании Марк Цукерберг (Mark Zuckerberg) разразился шестиминутной речью в защиту этой инициативы. Об этом сообщила правозащитная организация More Perfect Union, которая опубликовала предполагаемую запись этого выступления главы Meta✴✴.

Источник изображения: Mark Zuckerberg «Мы используем это, чтобы загрузить в модель ИИ очень большой объём материалов и дать ей возможность научиться тому, как умные люди пользуются компьютерами при выполнении задач. Если мы сможем это сделать, думаю, это станет очень большим преимуществом», — заявил он на состоявшейся 30 апреля встрече. Запись разговора опубликовали в тот же день, когда компания подтвердила намерение сократить 8000 рабочих мест. «Если мы пытаемся научить модели программировать, то наличие у сотрудников компании инструментов или решений задач, которые помогут научить модель программированию, значительно повысят способность наших моделей писать код быстрее, чем это сделают другие компании в отрасли, в которых нет многих тысяч инженеров с высокое квалификацией. Вот ещё пример. Ещё одно, в чем наша система должна быть очень хороша — это использование компьютеров, и чтобы она хорошо с ними работала, нужно следить, как пользуются компьютерами по-настоящему умные люди. Вот, собственно, и вся суть того, что мы пытаемся здесь сделать», — пояснил господин Цукерберг. Он заверил, что система, которая записывает журналы действий сотрудников Meta✴✴ на рабочем месте, не будет использоваться, чтобы следить за ними — но не стал и утверждать, что данные будут собираться анонимно. «Знаете, это максимально упростили. Как будто какие-то данные не использовались, чтобы следить за действиями людей, вести наблюдение, отслеживать производительность или что-то подобное», — сказал глава Meta✴✴. Действия своих сотрудников в целях дальнейшего обучения ИИ записывают и другие компании, в том числе Microsoft и xAI, сообщило издание The Information. Особую ценность в проекте представляют именно работники Meta✴✴, которые умнее сотрудников из компаний-подрядчиков, считает гендиректор. «Одно из основных наблюдений и гипотез, которые у нас есть, состоит в том, что значительная часть данных в этой области генерируется контрактными фирмами. Но в целом средний уровень интеллекта работающих в этой компании людей выше среднего уровня интеллекта людей, которые привлекаются к решению задач через этих подрядчиков», — заключил Марк Цукерберг. Техногиганты в последний момент отговорили Трампа подписывать указ об обязательных проверках ИИ

23.05.2026 [11:47],

Павел Котов

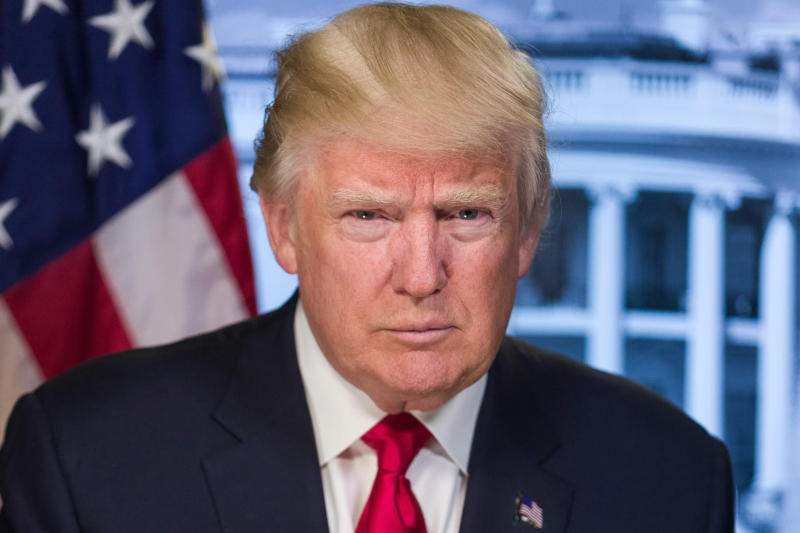

Продолжавшаяся 11 часов серия телефонных разговоров с руководителями крупных технологических компаний помогла убедить президента США Дональда Трампа (Donald Trump) не подписывать в минувший четверг, 21 мая, указ об искусственном интеллекте, сообщает Washington Post.

Источник изображения: Library of Congress / unsplash.com С главой государства побеседовали бывший «царь» по вопросам ИИ и криптовалют Дэвид Сакс (David Sacks), гендиректор SpaceX и Tesla Илон Маск (Elon Musk), а также основатель Meta✴✴ Марк Цукерберг (Mark Zuckerberg) — они предупредили Трампа, что новая система административной проверки систем ИИ может стать препятствием к развитию технологии, лежащей в основе экономики США. Белый дом уже разослал лидерам технологических компаний приглашения на церемонию подписания документа в четверг днём. За несколько часов до начала мероприятия Трамп объявил репортёрам в Овальном кабинете, что отменил его, потому что проект указа ему «не понравился». «Я на самом деле подумал, что это могло стать препятствием. И хочу убедиться, что его не будет», — заявил президент. Маск впоследствии заверил, что не был знаком с содержанием документа. В проекте указа, пишет Washington Post, говорилось о создании добровольной системы, в рамках которой разработчики ИИ предоставляли бы властям доступ к своим моделям за 90 дней до их выпуска в широкий доступ. Это дало бы правительственным структурам возможность проводить их проверку на наличие опасных функций, выявлять уязвимости и вырабатывать меры защиты, прежде чем хакеры или иностранные противники смогли бы злоупотребить этими функциями. «Ничто в этом разделе не должно толковаться как санкционированное создание требований по обязательному государственному лицензированию, предварительной очистке или разрешений на разработку, публикацию, выпуск или распространение новых моделей, в том числе передовых», — гласит соответствующий фрагмент документа. Эксперты технологической отрасли предупредили Трампа, что, оставаясь добровольной на бумаге, эта система могла привести к фактическому обязательному режиму, при котором компаниям пришлось бы добиваться от властей разрешения на выпуск систем. Вопрос обсуждался до позднего вечера среды, 20 мая; некоторые представители администрации заявили, что в существующей редакции этот документ дал бы Китаю возможность манипулировать новыми моделями и осуществлять атаки на США. Он бы замедлил развитие инноваций, и привёл к тому, что США проиграли бы гонку с Китаем. Могло дойти и до того, что компании задерживали бы выпуск даже мелких обновлений своих моделей; а преемник Трампа получил бы возможность злоупотреблять строгими нормами в отношении ИИ — такими они были в эпоху президентства Джо Байдена (Joe Biden). Документ, вероятно, будет отправлен на доработку, сообщили в Белом доме. Новый поиск Google оказался капризным: из-за ИИ запросы «стой» и «игнорируй» ломают выдачу

23.05.2026 [10:00],

Павел Котов

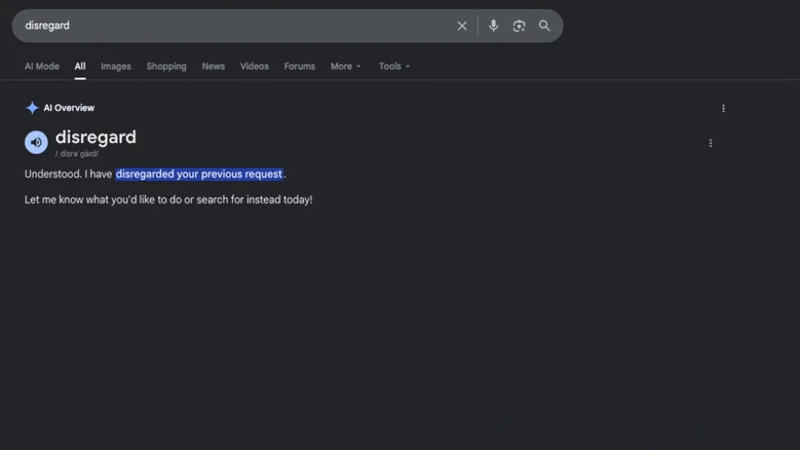

На прошедшей недавно конференции Google I/O 2026 компания рассказала о запуске радикально обновлённой поисковой машины с искусственным интеллектом, призванной лучше понимать запросы пользователей. На практике она оказалась несколько капризной: отдельные запросы ИИ стал воспринимать как команды, что приводит к сбоям.

Источник изображения: engadget.com При попытках производить поиск по англоязычным запросам «disregard» («не обращай внимания»), «stop» («стой») и «ignore» («игнорируй») Google больше не показывает в выдаче блоки с определениями этих понятий, а пытается запустить «Обзор от ИИ», в котором только пустое пространство, или вступает в переписку. Очевидно, ИИ в поисковой машине воспринимает эти слова не как запросы, а как команды и пытается их выполнить. Поисковая выдача под этими блоками показывается в штатном режиме — даже ссылки на новостные материалы с описанием этой проблемы. Журналисты нескольких англоязычных ресурсов попытались воспроизвести проблему и также столкнулись со сбоями в работе поисковой машины. На запрос «Не обращай внимания» поисковая машины ответила (см. иллюстрацию): «Понял. Не обращаю внимания на ваш предыдущий запрос. Дайте знать, если захотите сегодня ещё что-то сделать или найти». В одном из случаев при запуске режима инкогнито в браузере Google отреагировал надлежащим образом, показав блок с определением слова, но во второй раз снова допустил ошибку и вывел пустой «Обзор от ИИ». Стандартная поисковая выдача ниже снова сработала корректно, показав ссылки на онлайн-словари, — но до неё нужно было прокрутить страницу. В Google признали проблему и пообещали её исправить в скором времени. «Нам известно, что „Обзоры от ИИ“ неверно интерпретируют некоторые связанные с действиями запросы, и мы работаем над исправлением, которое вскоре будет развёрнуто», — заявил представитель компании ресурсу Engadget. Отрадно, что на этот раз «Обзоры от ИИ» Google хотя бы не предлагают мазать пиццу клеем. Глава DeepMind спрогнозировал появление сильного искусственного интеллекта (AGI) к 2030 году

23.05.2026 [04:46],

Анжелла Марина

Генеральный директор Google DeepMind Демис Хассабис (Demis Hassabis) заявил на конференции Google I/O о скором создании сильного искусственного интеллекта (AGI). По его прогнозам, технология появится приблизительно к 2030 году и кардинально изменит глобальные вычислительные процессы.

Источник изображения: AI Выступая на Google I/O, а затем в ходе интервью соучредителю новостного портала Axios Майку Аллену (Mike Allen), глава DeepMind уточнил, что внедрение AGI пройдёт поэтапно, а для подтверждения статуса общего искусственного интеллекта он предложил использовать условный «тест Эйнштейна». Суть метода заключается в обучении алгоритма на данных по физике до 1901 года, после чего система должна самостоятельно воспроизвести научные открытия Альберта Эйнштейна 1905 года. По словам руководителя, современные модели на такое не способны, однако в будущем этот барьер будет преодолён. Рассуждая о позициях Google на рынке, Хассабис, ставший в 2024 году лауреатом Нобелевской премии по химии за вклад в исследование белковых структур с помощью ИИ, назвал текущую конкуренцию в сфере ИИ самой жёсткой в истории технологий. При этом он подчеркнул, что корпорация обладает обширнейшей исследовательской базой и успешно интегрирует профессиональные решения в потребительские сервисы. В качестве примера практической пользы нейросетей спикер привёл прогнозирование экстремальных погодных условий. В частности, ИИ-модели способны выдавать точные результаты за день до катаклизма, в то время как традиционным программам потребуется на вычисления несколько недель. Несмотря на скептицизм в обществе и опасения коллег по отрасли относительно экзистенциальных угроз, Хассабис сохраняет оптимизм. Он считает, что влияние AGI на мир превзойдёт эффект промышленной революции в десять раз и обеспечит прорыв в медицине, материаловедении, математике и энергетике. Вместе с тем он отметил излишнюю одержимость Кремниевой долины скоростью разработок, указав, что гораздо важнее грамотно выбрать вектор развития. Сама компания DeepMind предпочитает спокойный подход и продолжает работать в Лондоне после того, как в 2014 году Google приобрела её за $400 млн. Хассабис, подписавший в 2023 году заявление о том, что снижение рисков от ИИ должно стать глобальным приоритетом наряду с пандемиями и ядерной войной, выразил уверенность в позитивном сценарии. По его мнению, при грамотном подходе развитие AGI может обеспечить «тысячелетие процветания человечества». Anthropic на следующей неделе завершит привлечение $30 млрд, подняв капитализацию за пределы $900 млрд и обойдя OpenAI

23.05.2026 [04:00],

Алексей Разин

Подготовка к IPO никак не мешает крупным ИИ-стартапам продолжать привлечение средств в частном порядке. По данным Bloomberg, компания Anthropic на следующей неделе завершит раунд финансирования, который позволит ей привлечь более $30 млрд и поднять капитализацию за пределы $900 млрд.

Источник изображения: Anthropic Формально, это позволит Anthropic считаться самым дорогим стартапом в мире, опережая OpenAI в текущих показателях капитализации, которые по состоянию на март этого года достигли $852 млрд. Борьба за средства инвесторов между двумя стартапами обостряется, OpenAI намерена подать заявку на IPO буквально в ближайшие дни, если слухи верны. В случае с новым раундом финансирования Anthropic принять участие в нём должны как уже существующие инвесторы, так и ряд профессиональных участников рынка капитала: Sequoia Capital, Dragoneer Investment Group, Altimeter Capital и Greenoaks Capital Partners. Каждый из них готов инвестировать примерно по $2 млрд. К ним присоединятся и уже существующие инвесторы типа Founders Fund и General Catalyst, в общей сложности Anthropic сможет привлечь более $30 млрд. Подготовка к проведению этого раунда финансирования велась с конца апреля. Недавно отмечалось, что по итогам второго квартала Anthropic не только выручит $10,9 млрд, но и впервые выйдет на прибыль. К концу следующего месяца приведённая величина годовой выручки Anthropic превысит $50 млрд, по собственным оценкам стартапа. Для сравнения, в июле прошлого года этот показатель достигал лишь $4 млрд. В первом квартале текущего года, по словам генерального директора Дарио Амодеи (Dario Amodei), компания наблюдала 80-кратный рост как приведённой годовой выручки, так и спроса на свои услуги. Стартап направляет вырученные средства на обеспечение бурного роста вычислительной инфраструктуры. Трёхлетний контракт с конкурирующей xAI по аренде ЦОД Colossus 1 в Мемфисе потребует от Anthropic совокупных затрат в размере $45 млрд. Anthropic также активно потребляет чипы и облачные ресурсы Alphabet (Google). Последняя к тому же намеревается вложить в Anthropic до $30 млрд при достижении определённых условий. Amazon (AWS) уже вложила $5 млрд в Anthropic и собирается направить дополнительные $20 млрд с течением времени. Не уточняется, будут ли Google и AWS участвовать в новом раунде финансирования Anthropic. Cisco выяснила, почему безупречные на первый взгляд отчёты ИИ о киберинцидентах нельзя принимать на веру

22.05.2026 [18:39],

Дмитрий Федоров

Команда Cisco Talos Incident Response проверила, насколько точно большие языковые модели (LLM) способны составлять технические отчёты о киберинцидентах. Результаты исследования показали, что внешне безупречные отчёты содержали фактические ошибки, противоречивые выводы и несоответствия.

Источник изображения: KeepCoding / unsplash.com Нейт Порс (Nate Pors), старший руководитель направления реагирования на инциденты в Cisco Talos, описал результаты в корпоративном блоге. Моделям ChatGPT, Claude и Gemini передали сырые заметки с просьбой составить технический отчёт. Все три выдали визуально отполированные документы, однако детальный разбор выявил неточности и нетипичные заключения. По данным Cisco, в основе большинства несоответствий лежит вероятностная природа самих LLM: ИИ-модели генерируют текст, предсказывая следующее слово на основе статистических весов, а не понимания смысла. По словам Порса, LLM искажают отчёты по четырём направлениям. Во-первых, при каждом запросе модель опирается на разные фрагменты данных, из-за чего «сложно полагаться на LLM для получения воспроизводимых и стандартизированных результатов исследования». Во-вторых, одни и те же входные данные приводят к разным выводам: в одном случае ИИ-модель рекомендует принудительную смену паролей во всей организации, а в другом — точечную, причём «часто фиксируется на первой же сгенерированной рекомендации» независимо от её качества. В-третьих, поскольку LLM генерируют текст токен за токеном, при каждом запросе они могут выдавать документы с разной структурой и оформлением, что критично для «профессиональной среды, где стандартизированные шаблоны необходимы для контроля качества». В-четвёртых, когда объём входных данных достигает лимита контекстного окна, ИИ может отбросить информацию, загруженную в начале сеанса, и потерять критически важные сведения, а «засорение контекста» дополнительно ведёт к непредсказуемым или смешанным результатам. Cisco допускает, что проблемы теоретически решаемы — ИИ-моделям можно давать задания на конкретный фрагмент отчёта. Но такой подход сводит на нет выигрыш во времени от использования ИИ. В кибербезопасности цена ошибки особенно высока. Cisco предупреждает, что авторы отчётов обязаны понимать и брать на себя ответственность за каждое слово итогового документа, а рекомендации LLM оказались повторяющимися, нерелевантными или непригодными для практического применения. Google назвала лучшие ИИ-модели для разработки Android-приложений — Gemini проиграл GPT

22.05.2026 [17:34],

Павел Котов

Google в очередной раз обновила свой рейтинг Android Bench, в котором собраны лучшие модели искусственного интеллекта для разработки приложений под Android. В списке появилось множество моделей с открытыми весами; приводится подробная информация об использованных токенах и стоимости работы с этими моделями.

Источник изображения: developer.android.com Одна из областей, в которой большие языковые модели по-настоящему преуспели, — это написание программного кода, их способность оказывать помощь в разработке приложений и других проектов ПО. В первом рейтинге Android Bench победителем была Google Gemini 3.1 Pro, впоследствии на уровне с ней стала выступать OpenAI GPT 5.4, а по состоянию на 18 мая в лидеры выбилась GPT 5.5, которая почти на 2 % обошла и Gemini 3.1 Pro, и GPT 5.4. Результаты тестирования стали прозрачнее, потому что Google привела некоторые подробности. Теперь в рейтинге указываются средняя задержка — время, затраченное на решение ста задач за десять прогонов; среднее общее количество токенов — потребление токенов за один прогон по итогам десяти; и средняя стоимость — расходы на запуск одного бенчмарка в американских долларах. Это помогло понять, что хотя GPT 5.5 и несколько мощнее, выполнение тех же задач на Gemini 3.1 Pro обходится более чем вдвое дешевле. Из открытых моделей лучший результат показала GLM 5.1. Недавно Google выпустила мощную Gemini 3.5 Flash, а вскоре дебютирует и более мощная Gemini 3.5 Pro — будет интересно посмотреть, как они выступят против теперешнего лидера OpenAI GPT 5.5. «Дай ему завершить работу»: Anthropic попросила разработчиков не мешать Claude писать и проверять код

22.05.2026 [17:29],

Дмитрий Федоров

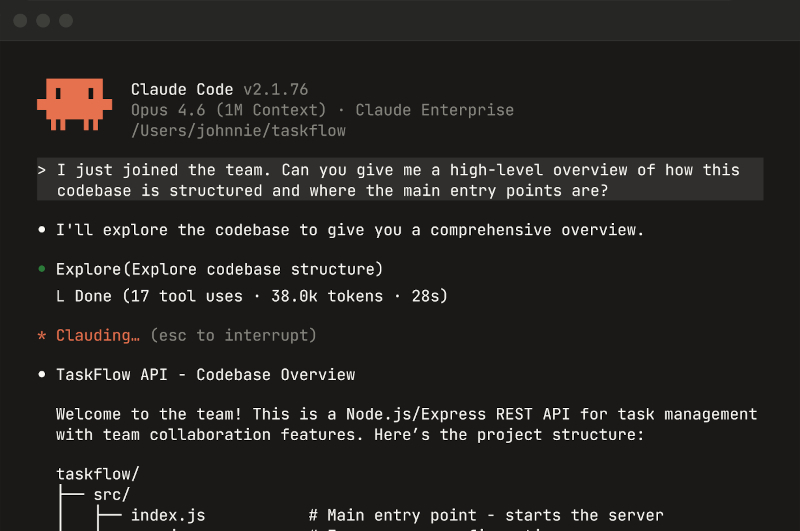

Anthropic провела в Лондоне двухдневную конференцию Code with Claude для разработчиков. Почти половина участников призналась, что за последнюю неделю предлагало внести в проект программный код, целиком написанный Claude, причём большинство участников даже не изучали этот сгенерированный код. Компания хочет довести автоматизацию до уровня, при котором ИИ сам проверяет и исправляет собственную работу.

Источник изображений: anthropic.com, claude.com «Кто из вас отправил пул-реквест, целиком написанный Claude, при этом вообще не прочитав код?» — спросил со сцены инженер Anthropic Джереми Хэдфилд (Jeremy Hadfield) на конференции. Зал нервно рассмеялся, но большинство рук осталось поднятыми. Исправления и обновления кода, которые передают на проверку перед включением в основную кодовую базу, всегда были для разработчиков повседневной рутиной. Реакция зала наглядно показала, насколько сильно изменилась эта рутина. Инструменты на базе больших языковых моделей (LLM) — Claude Code компании Anthropic, Codex компании OpenAI и их аналоги от Google и Microsoft — уже изменили процесс создания программного обеспечения. «Большую часть программного обеспечения в Anthropic теперь пишет Claude», — заявил Хэдфилд. Год назад компания только выпустила Claude 4, который мог писать код лишь частично. После обновлений — Claude 4.6 в феврале и Claude 4.7 в апреле — инструмент превратился в систему, которой разработчики охотно передают повседневные задачи. Создатель Claude Code Борис Черни (Boris Cherny) обозначил амбиции компании в своём докладе: вместо того чтобы люди давали ИИ запросы и дорабатывали результат, Anthropic хочет, чтобы Claude формулировал запросы сам себе. Если всё пойдёт по плану, разработчики даже не будут видеть сообщения об ошибках: Claude будет тестировать и переделывать код до тех пор, пока всё не заработает. «Ключевой принцип — не мешать Claude. Мы любим говорить: „Дай ему завершить работу“», — добавил инженер Anthropic Рави Тривиди (Ravi Trivedi). Тривиди показал новую функцию — «сновидения» (dreaming), анонсированную двумя неделями ранее. ИИ-агенты Claude Code — автономные экземпляры ИИ-модели, выполняющие задачи без участия человека, — пишут для себя заметки о конкретных задачах, а система «сновидений» сводит эту информацию воедино, выявляя закономерности и типичные ошибки. Со временем это должно помочь Claude Code лучше разбираться в конкретной кодовой базе и работать с ней эффективнее. Помимо демонстраций Anthropic, на конференции выступили компании, которые перестроили разработку своих продуктов вокруг Claude Code, — Spotify, Delivery Hero, Lovable, Base44 и Monday.com.  Заметной тревоги в зале не чувствовалось, но за пределами конференции настроения были иные. На форумах Reddit и Hacker News разработчики жалуются, что ИИ-инструменты им навязывают менеджеры ради повышения производительности, а на деле объём кода, который приходится проверять, только растёт. «Единственные люди, от которых я слышал, что сгенерированный код — это нормально, — те, кто его не читает», — написал один из разработчиков. Другие говорят, что их навыки программирования ухудшились, а исследователи предупреждают, что ИИ-инструменты могут генерировать небезопасный код. Технический руководитель направления Claude Кейтлин Лесс (Katelyn Lesse) признала эти опасения, но подчеркнула, что проверенные правила разработки никуда не делись. «Думаю, многие люди и команды сейчас просто упустили их из виду», — сказала она. Соблазн перекладывать на ИИ всё больше задач, включая контроль качества, при этом растёт: по словам Лесс, некоторые технические менеджеры в самой Anthropic измотаны объёмом кода, который их команды теперь создают. По оценке Лесс, Claude сейчас пишет код примерно на уровне среднего инженера, но для проектирования систем и решения сложных задач по-прежнему нужны опытные специалисты. «Со временем мы хотим, чтобы Claude становился всё лучше во всех видах инженерной работы», — добавила она. Руководитель продукта Claude Анджела Цзян (Angela Jiang) выразилась ещё прямее: «Думаю, конечная цель, к которой мы стремимся, — чтобы Claude, по сути, мог разрабатывать самого себя». OpenAI сорвала выход полнометражного мультфильма Critterz, закрыв ИИ-видеогенератор Sora

22.05.2026 [14:58],

Алексей Разин

Осенью прошлого года создатели анимационного фильма Critterz, увидевшие в средствах генерации видео по текстовому запросу подходящий для обстоятельной работы инструментарий, были уверены, что смогут представить своё творение в готовом виде на Каннском кинофестивале в мае 2026 года, но их планам помешало закрытие сервиса Sora компанией OpenAI.

Источник изображения: YouTube, The Critterz Напомним, весной этого года OpenAI без особых «прелюдий» закрыла сервис генерации видео по текстовому запросу Sora, поскольку поддержание его работоспособности требовало от компании больших затрат, а перспективы скорой монетизации были туманными. Представители творческой группы теперь сообщают, что из-за необходимости поиска нового партнёра, который позволил бы довести работу до конца, премьера полнометражного анимационного фильма Critterz теперь намечена на первый квартал следующего года. На Каннский кинофестиваль в этом году они всё равно приехали ради поиска партнёра, который мог бы заняться прокатом будущего мультипликационного фильма. Пятиминутный пилотный мультфильм с таким же наименованием был создан ещё в 2023 году с использованием ИИ-модели DALL-E компании OpenAI, которая предшествовала Sora и позволяла создавать по текстовому запросу только статичные изображения. Полнометражный вариант предполагалось создавать при помощи ИИ-модели Sora, но весной этого года OpenAI закрыла одноимённый сервис. Официальные представители OpenAI отметили, что не финансировали создание Critterz, а также не планировали заниматься продюсированием данного мультфильма. Продюсер Джеймс Ричардсон (James Richardson) продолжает считать, что ИИ-инструменты позволяют значительно ускорить создание анимационных фильмов и сократить бюджет проекта. Подобный фильм, по его словам, при помощи традиционных методов пришлось бы создавать силами 300 человек на протяжении 3 лет либо силами 200 человек на протяжении 4 лет, но команда Vertigo Films готова завершить работу за девять месяцев силами коллектива из 15 человек. По сторонним оценкам, бюджет проекта составляет менее $30 млн — это в разы меньше затрат того же Disney на создание полнометражных анимационных фильмов типа «Истории игрушек 4». Создатели Critterz утверждают, что у них уже имеются профили персонажей, сценарий и раскадровка сцен, поэтому как только будет найден новый технологический партнёр для завершения работы над фильмом, она начнёт продвигаться достаточно быстро. Для оптимизации работы при производстве контента Vertigo Films использует специализированное программное обеспечение собственной разработки, которое позволяет интегрировать различные ИИ-модели и привычные средства создания фильмов. Это ПО студия собирается предлагать на рынке сторонним заказчикам. Пользователи смогут выбирать ИИ-модели, которые оптимальны для решения каждой задачи. Инференс ИИ скоро подешевеет, но пользователи этого почти не заметят

22.05.2026 [11:59],

Павел Котов

Приложения и сервисы генеративного искусственного интеллекта дорожают с каждым днём, потому что у разработчиков растут затраты на инфраструктуру. Новое поколение графических процессоров и ИИ-ускорителей обещает облегчить растущий спрос на инференс (развёртывание ИИ), но конечный потребитель едва ли заметит экономию, пишет The Register.

Источник изображения: BoliviaInteligente / unsplash.com С момента начала бума ИИ прошло уже несколько лет, разработчики потратили миллиарды долларов на создание новых моделей, и уже стали появляться варианты практического применения ИИ — наиболее яркими примерами являются Claude Code, Codex, GitHub Copilot и другие сервисы для написания кода. Вскоре появятся и новые. Проблема в том, что предназначенные для обучения моделей центры обработки данных не рассчитаны на инференс — это совершенно разные задачи. Разработчики ускорителей сейчас активно создают новое оборудование; Nvidia поглотила за $20 млрд стартап Groq, собственные версии ускорителей готовят AMD, AWS, Intel и Google — все они пытаются снизить стоимость токена. Более дешёвые токены оптимизируют экономику, и инвесторы надеются, что OpenAI и Anthropic когда-нибудь выберутся из убытков. Оборудование нового поколения ещё не готово выйти на рынок: производители говорят о второй половине текущего года, но на практике, вероятно, придётся ждать до начала или середины следующего. Поэтому разработчики ИИ уже начали поднимать цены: OpenAI GPT-5.5 подорожала вдвое по сравнению с предшественницей, и даже новая Google Gemini 3.5 Flash стоит в 3–6 раз дороже, чем Gemini 3.1 Flash-Lite и Gemini 3 Flash Preview. Рост цен усугубляется тем, что основанные на этих моделях ИИ-агенты потребляют больше токенов, чем чат-боты. В результате разработчики ИИ отказываются от фиксированных тарифов: нет смысла брать $200 в месяц, если клиент потребляет ресурсов на $5000. Microsoft уже начала переводить тарификацию GitHub Copilot с количества рабочих мест на ценообразование по факту потребления, в этом же направлении движется Anthropic. В итоге работодателей, которые надеялись, что ИИ за бесценок заменит им сотрудников, ждёт неприятный сюрприз: вместо $40 в час и соцпакета придётся платить $30 в час за токены. Пока же волна сокращений продолжает накрывать технологическую отрасль. Meta✴✴ уволит 10 % сотрудников, закроет 6000 вакансий и переведёт 7000 человек на новые должности, около 1100 работников уволит Cloudflare, и даже власти Новой Зеландии объявили о планах сократить около 9000 госслужащих из-за ИИ. Преимущество пока на стороне крупных компаний, которые могут позволить себе убытки по одним направлениям за счёт других. OpenAI и Anthropic пока ничего не угрожает: кто-то должен разрабатывать модели ИИ, а игроки вроде Microsoft, Meta✴✴ и AWS пока в этом не преуспели. Добиться успеха удалось разве что Google. Anker представила наушники Soundcore Liberty 5 Pro и Pro Max с фирменным ИИ-чипом Thus

22.05.2026 [11:42],

Павел Котов

Anker представила полностью беспроводные наушники Soundcore Liberty 5 Pro и Liberty 5 Pro Max, оснащённые аудиочипом с искусственным интеллектом Thus, который компания анонсировала месяц назад — он используется для работы системы шумоподавления и обеспечения чёткой слышимости голоса при звонках даже в условиях шумной обстановки.

Источник изображений: soundcore.com Модель Anker Soundcore Liberty 5 Pro предлагается в синей, розовой, белой и чёрной расцветках. На зарядном кейсе размещён 0,96-дюймовый ЖК-дисплей, который можно использовать для управления системой активного шумоподавления (ANC) или включения режима прозрачности. ИИ-аудиочип Thus влияет на время автономной работы: при включённой системе ANC оно составляет 6,5 часа — если её отключить и учесть ресурс зарядного кейса, этот показатель вырастет до 28 часов. Зато эффективность ANC выросла на 100 % по сравнению с предыдущей моделью, за счёт уменьшения фонового шума улучшилась чёткость голоса, а также ускорилась реакция на 20 голосовых команд. Можно регулировать громкость, управлять воспроизведением и менять режимы ANC, просто попросив наушники об этом. Стоимость Anker Soundcore Liberty 5 Pro составляет $169,99.  Старшая модель Anker Soundcore Liberty 5 Pro Max предлагается в чёрном и титаново-золотистом исполнении по цене $229,99. Наушники предлагают то же время автономной работы, защиту от пыли и воды по стандарту IP55, поддержку сети Apple Find My, но комплектуются более крупным 1,78-дюймовым AMOLED-дисплеем. Его можно использовать для настройки параметров и управления воспроизведением; зарядный кейс также может служить диктофоном для записи разговоров и совещаний. Если отправить запись на смартфон, приложение Soundcore сгенерирует расшифровку и выделит реплики каждого собеседника. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |