|

Опрос

|

реклама

Быстрый переход

Intel представит доступные настольные чипы Arrow Lake в начале января — компания подтвердила участие в CES 2025

06.12.2024 [10:20],

Алексей Разин

С шестого по девятое января в Лас-Вегасе должна пройти выставка потребительской электроники CES 2025, и компания Intel не может пропустить данное мероприятие даже с учётом недавней потери генерального директора. Судя по опубликованному анонсу, на CES 2025 представители Intel сосредоточатся на теме искусственного интеллекта.

Источник изображения: Intel Судя по тексту анонса, презентации Intel будут посвящены демонстрации возможностей так называемых AI PC — персональных компьютеров на базе процессоров, позволяющих локально ускорять работу систем искусственного интеллекта. Отдельное внимание будет уделено рассказу о новшествах Intel для автомобильного сегмента, поскольку современные транспортные средства становятся всё более требовательными к работе с данными и программным обеспечением. Шестого января программу мероприятия откроет доклад представителей Intel, посвящённый технологиям AI PC следующего поколения. Быстродействие, совместимость ПО и его безопасность — вот те аспекты применения новых технологий, на которых сосредоточится Intel вместе с партнёрами, которые примут участие в презентации. Физически присутствовать на презентации смогут только приглашённые заранее лица, но будет вестись и прямая трансляция. На отдельной серии мероприятий с 7 по 9 января включительно Intel покажет образцы новейших платформ на основе процессоров Core Ultra. Ожидается, что компания представит на выставке новые настольные процессоры семейства Arrow Lake — модели для массового рынка с заблокированным множителем (без суффикса «К» в названии). Тогда же будут продемонстрированы решения Intel для автомобильного сектора. Кроме того, Intel проведёт серию лекций с рассказом о способности ИИ преобразить личный опыт и методы работы специалистов в разных областях. Сессии будут проводиться под руководством представителей серверного и клиентского подразделений Intel, а также направления периферийных вычислений. Для клиентов в автомобильном сегменте Intel продемонстрирует возможности отраслевой платформы следующего поколения. «ИИ будет вездесущим»: глава AMD считает, ИИ обеспечил больший прогресс за полтора года, чем за последние 10 лет

06.12.2024 [07:24],

Алексей Разин

Пока интересы AMD на технологической конференции UBS представлял исполнительный вице-президент Форрест Норрод (Forrest Norrod), генеральный директор компании Лиза Су (Lisa Su) дала интервью Bloomberg, в котором рассказала о важной роли искусственного интеллекта в развитии не только AMD, но и отрасли в целом.

Источник изображения: AMD «Я искренне верю, что ИИ является самой трансформирующей технологией из тех, что я наблюдала за свою карьеру. Она развивается быстрее, чем что-либо из виденного нами ранее. Создаётся впечатление, что мы достигли большего прогресса за последние 18 месяцев, чем за более чем десять предыдущих лет», — заявила Лиза Су в интервью Bloomberg, которое прошло в Остине, штат Техас. Лиза Су, как известно, начинала свою карьеру в IBM и Texas Instruments, перед этим получив инженерное образование в США, куда перебралась с родителями с Тайваня в раннем детстве. Получив в 2014 году возможность возглавить AMD, она за годы пребывания у руля компании превратила её из догоняющего игрока в лидера рынка. Теперь перед AMD стоит новый вызов: попытаться пошатнуть позиции Nvidia в сегменте ускорителей искусственного интеллекта. Обойти Intel по многим критериям ей уже удалось, хотя продукция первой до сих пор доминирует на рынке x86-совместимых процессоров. Однако, в серверном сегменте продукция AMD уже занимает около трети. Представители AMD не берутся оценивать свою долю на рынке ускорителей для систем ИИ, но в текущем году компания рассчитывает выручить на их реализации около $5 млрд. К слову, выступая на технологической конференции UBS, исполнительный вице-президент AMD Форрест Норрод назвал 20 % тем общепризнанным ориентиром по доле любого рынка, который позволяет абстрактной компании иметь на нём заметное влияние. Он не стал при этом строить прогнозы, когда AMD выйдет на такой показатель в сегменте ускорителей вычислений. В любом случае, Intel пока рассчитывает выручить от реализации ускорителей для систем ИИ не более $500 млн, а у AMD эта сумма будет в десять раз выше. Более того, как отмечает Bloomberg, сейчас капитализация AMD более чем в два раза превосходит Intel, достигая $220 млрд. Если пять лет назад годовая выручка AMD не превышала $5,5 млрд, по итогам текущего она может увеличиться в пять раз относительно того уровня. Как отмечают представители Bloomberg, от предшественников Лизу Су отличают высокая степень вовлечённости в самые базовые процессы, происходящие в компании. Она является частым гостем в лабораториях AMD, где разрабатываются новые продукты. Подобный подход не только позволяет главе AMD быть в курсе всего происходящего, но и держит в тонусе подчинённых, которые осознают степень ответственности за вероятные ошибки. Лизе Су приписывают нетерпимость к извинениям за проступки и отсутствие колебаний в те моменты, когда следует выразить своё недовольство. Сама она многозначительно поясняет, что лидеры отрасли позволяют своим командам становиться лучше, чем те рассчитывали изначально. Глава и основатель Nvidia Дженсен Хуанг (Jensen Huang), как сообщается, не стесняется признавать успехи Лизы Су как руководителя, отмечая, что она позволяет сотрудникам своей компании добиваться большего. Лиза Су основателем Nvidia также восхищается, но впервые публично признавая наличие дальнего родства между ними, она заявляет, что они с Хуангом впервые увиделись на каком-то из отраслевых мероприятий, когда уже занимали руководящие посты в соответствующих компаниях. По прогнозам Лизы Су, ёмкость рынка чипов для систем ИИ будет ежегодно в среднем расти на 60 % и достигнет $500 млрд к 2028 году. По сути, это позволит отдельной категории продуктов достичь сопоставимого оборота со всем рынком в его нынешнем виде. При такой динамике сегмента ИИ, как отмечает глава AMD, на рынке останется достаточно место для всех, кто выпускает «великолепные продукты». В такой ситуации ограниченность ресурсов AMD не станет препятствием для динамичного развития. Как признаёт Лиза Су, компании всегда приходилось довольствоваться меньшим штатом специалистов и средств, чем более крупным компаниям, но ей удавалось «выступать лучше своей весовой категории», как образно выразилась она. «На наш взгляд, ИИ будет вездесущим. ИИ будет в каждом приложении, в каждом продукте, куда бы вы ни обратились, вам понадобятся вычисления, и мы занимаем для этого подходящее место», — резюмировала глава AMD. xAI перевыполнил план по инвестициям и готов строить ИИ-суперкомпьютер с 1 млн GPU

06.12.2024 [06:39],

Алексей Разин

На волне энтузиазма в отношении политических перспектив Илона Маска (Elon Musk), которому досталась важная роль в будущем правительстве Дональда Трампа (Donald Trump), самая молодая из принадлежащих ему компаний продолжает стремительно наращивать капитал. Вместо упоминаемых $5 млрд в октябре, стартап xAI на днях привлёк $6 млрд за счёт продажи собственных акций инвесторам.

Источник изображения: Nvidia Число последних достигло 97 штук, что говорит о высокой заинтересованности инвесторов в деятельности стартапа xAI, занимающегося развитием инфраструктуры искусственного интеллекта. Минимальный взнос, который инвесторы сделали в этом раунде финансирования, соответствует сумме $77 593. С учётом совокупной суммы, капитализация xAI должна приблизиться к $50 млрд или даже превысить этот рубеж. Майский раунд инвестирования, который позволил привлечь $6 млрд, оценил капитализацию xAI в $24 млрд. Как ожидается, существенная часть новых инвестиций будет направлена xAI на финансирование строительства и оснащения центра обработки данных в Мемфисе, штат Теннесси, партнёрами по созданию которого являются Dell, Nvidia и Super Micro. Как пояснили представители первой из компаний, в общей сложности этот центр обработки данных будет насчитывать около 1 млн графических процессоров (GPU), используемых для ускорения вычислений. Google научила ИИ распознавать эмоции — у этого могут быть ужасные последствия

06.12.2024 [00:52],

Николай Хижняк

Google заявила, что её новое семейство ИИ-моделей обладает любопытной чертой — способностью «распознавать» эмоции. По словам компании, семейство ИИ-моделей PaliGemma 2, представленное в четверг, может анализировать изображения, позволяя ИИ генерировать подписи и отвечать на вопросы о людях, которых он «видит» на фотографиях.

Источник изображений: Google «PaliGemma 2 генерирует подробные, контекстно релевантные подписи для изображений, выходя за рамки простой идентификации объектов, чтобы описывать действия, эмоции и общее повествование сцены», — пишет Google в своём официальном блоге. Для распознавания эмоций PaliGemma 2 необходимо настроить соответствующим образом. Без этого он не работает. Однако эксперты, с которыми пообщались журналисты портала TechCrunch, были встревожены перспективой появления общедоступного детектора эмоций. «Меня это очень беспокоит. Для меня проблематично считать, что мы можем “читать” эмоции людей. Это как просить совета у магического шара предсказаний (Magic 8 Ball, популярная игрушка, — прим. ред.) для решения серьёзных вопросов», — отметила в разговоре с TechCrunch Сандра Вахтер (Sandra Wachter), профессор этики данных и ИИ из Оксфордского института исследования Интернета. Технологические компании, занимающиеся развитием ИИ, годами пытаются создать искусственный интеллект, способный определять эмоциональные аспекты в любых вещах — начиная от обучения продажам и заканчивая задачами, связанными с предотвращением несчастных случаев. Разработка большинства детекторов эмоций базируется на ранних работах американского психолога Пола Экмана (Paul Ekman), который предположил, что у людей есть шесть основных типов эмоций: гнев, удивление, отвращение, удовольствие, страх и грусть. Однако последующие исследования этого вопроса поставили под сомнение гипотезу Экмана и показали, что существуют серьёзные различия в том, как представители разных слоёв общества выражают свои чувства. «Определение эмоций в каком-то универсальном общем случае невозможно, потому что люди испытывают эмоции сложным образом. Нам кажется, что, глядя на людей, мы можем определить, что они чувствуют. И этим приёмом на протяжении многих лет пытались пользоваться разные люди, в том числе разведывательные органы и рекламные компании. Я уверен, что в некоторых случаях абсолютно возможно обнаружить некоторые общие признаки, но это не то, о чём идёт речь и не то, для чего в конечном итоге можно найти универсальный ответ», — сказал специализирующийся на ИИ научный сотрудник Лондонского университета королевы Марии Майк Кук (Mike Cook) в интервью TechCrunch. Эксперты считают, что системы обнаружения эмоций, как правило, ненадёжны и предвзяты из-за особенностей взглядов самих разработчиков таких систем. В исследовании Массачусетского технологического института 2020 года учёные показали, что модели для анализа лиц могут формировать непреднамеренные предпочтения для определённых лицевых выражений, таких как улыбка. Более поздние исследования показывают, что модели анализа эмоций приписывают больше негативных эмоций лицам темнокожих людей, чем лицам белых людей. Google заявляет, что провела «обширное тестирование» для оценки демографических предубеждений у PaliGemma 2 и обнаружила «значительно более низкий уровень токсичности и ненормативной лексики» по сравнению с отраслевыми бенчмарками. Однако компания не предоставила полный список использованных бенчмарков и не указала, какие типы тестов проводились. Единственный бенчмарк, о котором рассказала Google, — это FairFace, состоящий из набора десятков тысяч портретов людей. Компания утверждает, что PaliGemma 2 показала хорошие результаты при оценке FairFace. Но некоторые эксперты раскритиковали бенчмарк за его предвзятость, отметив, что в FairFace представлены далеко не все расовые группы, а лишь несколько. «Интерпретация эмоций — это довольно субъективный вопрос, который выходит за рамки использования визуальных средств и тесно связан с личным и культурным контекстом. Если не брать в расчёт ИИ, исследования показывают, что мы не можем распознавать эмоции только по чертам лица», — говорит Хайди Кхлааф (Heidy Khlaaf), главный научный сотрудник по ИИ в AI Now Institute, некоммерческой организации, изучающей социальные последствия искусственного интеллекта. В ЕС использование систем распознавания эмоций вызвало серьёзные вопросы у регулирующих органов. Закон об ИИ, основной законодательный акт ЕС в области ИИ, запрещает школам и работодателям использовать детекторы эмоций. Однако он не запрещает их использование правоохранительными органами.

Источник изображения: Unsplash Главное опасение экспертов, относительно открытых ИИ-моделей, таких как PaliGemma 2, которая распространяется через различные источники, включая платформу разработки ИИ Hugging Face, заключается в возможности злоупотребления и неправильности их использования, что может привести к реальному вреду. «Если эта так называемая “эмоциональная идентификация” основана на псевдонаучных предубеждениях и предрассудках, то существует значительный риск последствий в том, как эта возможность может быть использована для последующей и ложной дискриминации различных маргинализированных групп правоохранительными органами, работодателями, пограничными службами и т. д.», — говорит Кхлааф. В Google же говорят, что компания тестирует свои ИИ-модели на предрасположенность к «репрезентативный вреду» (стереотипам о социальных группах, например, расовых, этнических, гендерных или религиозных, которые приводят к отрицательным последствиям для этих групп и их представителей). «Мы провели надёжную оценку моделей PaliGemma 2 с точки зрения этики и безопасности, включая безопасность детей и безопасность контента», — добавили в компании. Профессора этики данных и ИИ в Оксфордском институте Интернета Сандру Вахтер такой ответ компании не убедил: «Ответственные инновации — это когда вы думаете о последствиях их разработки с первого дня работы над ними, каждый раз, когда вы входите в свою лабораторию, а затем продолжаете делать это на протяжении всего жизненного цикла продукта. Я могу представить себе множество потенциальных проблем, которые могут создать такие модели и в конечном итоге привести к антиутопичному будущему, в котором ваши эмоции будут определять, получите ли вы работу, кредит и поступите ли в университет». OpenAI o1 открыли для пользователей — ИИ-модель вышла в полной версии и доступна по подписке

05.12.2024 [23:19],

Владимир Мироненко

OpenAI начала 12-дневный марафон новинок с анонса ChatGPT Pro. Это новый уровень платной подписки стоимостью $200 в месяц, который предоставляет пользователям неограниченный доступ ко всем моделям OpenAI, включая мощнейшую o1 pro — улучшенную версию модели o1, которая выделяется способностью к рассуждению и умением логически решать задачи.

Источник изображения: Growtika/unsplash.com Это самый дорогой тариф компании, в десять раз превышающий по стоимости базовый тариф ChatGPT Plus. С учётом того, что многие пользователи уже считают тарифный план ChatGPT Plus слишком дорогим, возникает вопрос, на кого ориентируется OpenAI с подпиской ChatGPT Pro. «Мы считаем, что аудиторией ChatGPT Pro будут опытные пользователи ChatGPT — те, кто уже доводит модели до предела своих возможностей в таких задачах, как математика, программирование и письмо», — сообщил на пресс-конференции в четверг Джейсон Вэй (Jason Wei), представитель технического персонала OpenAI. ChatGPT Pro предоставляет доступ к самой мощной модели в арсенале OpenAI на данный момент, которая «дольше думает для получения самых надежных ответов». По оценкам независимых экспертов, o1 pro дает более точные и исчерпывающие ответы, особенно в таких областях, как работа с данными, программирование и анализ прецедентного права. Также по сравнению с o1 и o1-preview, нейросеть o1 pro лучше справляется со сложными задачами в математике, науке и кодировании. Чтобы подчеркнуть повышенную надежность o1 pro, в OpenAI заставляют модель четыре раза перепроверять ответ: вопрос считается решённым, только если модель получила правильный ответ в четырех попытках из четырех, а не только в одной. Поскольку ответы будут генерироваться дольше, ChatGPT отобразит индикатор выполнения и отправит уведомление в приложении, если вы переключитесь на другой диалог. Чтобы заинтересовать пользователей в переходе на ChatGPT Pro, компания добавила в тарифный план неограниченный доступ к GPT-4o и голосовому режиму Advanced Voice Mode — функции, позволяющей вести беседу, максимально похожую на человеческую. Для пользователей ChatGPT Plus установлен дневной лимит времени на использование этих функций, в то время как бесплатные пользователи ограничены только превью. OpenAI также планирует раздавать некоторые подписки бесплатно. Например, в четверг компания объявила о программе по предоставлению 10 грантов ChatGPT Pro медицинским исследователям в «ведущих учреждениях», а также о планах предоставить в будущем дополнительные гранты по «различным дисциплинам». Согласно публикации The New York Times, к 2029 году OpenAI планирует взимать за подписку ChatGPT Plus $44 в месяц. Рост стоимости подписок объясняется давлением на OpenAI со стороны инвесторов, желающих сократить убытки. Хотя в августе доход компании достиг $300 млн, её убытки за год, по данным New York Times, могут составить около $5 млрд. В этом «виноваты» расходы на зарплату персонала, аренду офисов и инфраструктуру обучения ИИ. Сообщается, что только на ChatGPT компания тратила одно время до $700 тыс. в день. Учение — свет: в MIT создали фотонный процессор для ИИ с высокой скоростью и низким потреблением

05.12.2024 [21:21],

Геннадий Детинич

Группа из учёных Массачусетского технологического института и их зарубежных коллег создала, как они утверждают, первый полностью фотонный процессор для приложений искусственного интеллекта. Фотонный процессор работает не хуже аналогов на кремниевых транзисторах, но проводит вычисления с намного меньшим потреблением энергии. Это особенно важно для создания «думающей» периферии — лидаров, камер, устройств связи и другого, к чему теперь открыта прямая дорога.

Источник изображения: Sampson Wilcox, Research Laboratory of Electronics Основная проблема при создании полностью фотонного чипа для ИИ заключается в том, что свет хорошо справляется с линейными вычислениями, тогда как нелинейные вычисления производятся с существенными затратами энергии. Для проведения последних необходимы специальные блоки, ведь фотоны реагируют друг с другом только в особых условиях. Поэтому прежде линейные операции, например, умножение матриц, проводились фотонным блоком, а для нелинейных вычислений световой сигнал переводился в форму электрического импульса и дальше обрабатывался по старинке — обычным процессором из кремниевых транзисторов. Учёные из MIT поставили перед собой цель создать единый процессор, у которого на вход подавался бы световой сигнал и световой же сигнал был бы на выходе без использования кремниевых сопроцессоров. По их словам, используя предыдущие работы и находки зарубежных коллег, они добились поставленной задачи. Разработанное исследователями оптическое устройство смогло выполнить ключевые вычисления для задачи классификации с помощью машинного обучения менее чем за половину наносекунды, при этом достигнув точности более 92 % — это производительность, которая находится на одном уровне с традиционным оборудованием. Созданный чип состоит из взаимосвязанных модулей, образующих оптическую нейронную сеть и изготовлен с использованием коммерческих литографических техпроцессов, что может обеспечить масштабирование технологии и её интеграцию в современную электронику. Учёные обошли проблему с нелинейными фотонными вычислениями интересным образом. Они разработали интегрированный в оптический процессор блок NOFU — нелинейно-оптический функциональный блок, который позволил задействовать электронные цепи вместе с оптическими, но без перехода к внешним операциям. По-видимому, блок NOFU был выбран как компромисс между чисто фотонными нелинейными схемами и классическими, электронными. Вначале система кодирует параметры глубокой нейронной сети в световых импульсах. Затем массив программируемых светоделителей выполняет матричное умножение входных данных. Потом данные передаются в программируемый слой NOFU, где реализуются нелинейные функции, передавая световые сигналы на фотодиоды. Последние, в свою очередь, транслируют световой сигнал в электрические импульсы. Поскольку этот этап не требует внешнего усиления, блоки NOFU потребляют очень мало энергии. «Мы остаемся в оптической области всё время, до конца, когда хотим считать ответ. Это позволяет нам добиться сверхнизкой задержки», — говорят авторы исследования. Мощнейший в мире ИИ-суперкомпьютер xAI Colossus расширят в десять раз — до 1 млн чипов Nvidia

05.12.2024 [18:00],

Павел Котов

Стартап Илона Маска (Elon Musk) в области искусственного интеллекта xAI намеревается колоссально расширить свой суперкомпьютер Colossus — до более чем 1 млн графических процессоров. Это поможет сократить разрыв с такими конкурентами как Google, OpenAI и Anthropic, сообщает Financial Times.

Источник изображения: x.com/xai Colossus собрали в этом году всего за три месяца — сейчас он включает массив из 100 тыс. ускорителей искусственного интеллекта Nvidia, и по данному критерию это крупнейший суперкомпьютер в мире. Он используется для обучения моделей ИИ для чат-бота Grok, который менее продвинут и имеет меньше пользователей, чем OpenAI ChatGPT или Google Gemini. Работы по расширению объекта в теннессийском Мемфисе в десять раз уже начались, сообщили в Торговой палате агломерации. Помощь в реализации проекта окажут Nvidia, Dell и Supermicro; будет сформирована «специальная оперативная группа xAI». Компании, работающие в области ИИ, активно пытаются обеспечить для себя поставки ускорителей или доступ к центрам обработки данных — обучение и запуск больших языковых моделей требует серьёзной вычислительной мощности. Так, ответственная за ChatGPT компания OpenAI получила от Microsoft инвестиции на сумму более $14 млрд; вложения создавшей чат-бот Claude компании Anthropic от Amazon составили $8 млрд — гигант электронной коммерции также пообещал партнёру доступ к новому кластеру из более чем 100 тыс. ИИ-ускорителей собственной разработки. Маск решил не формировать партнёрских проектов, а с нуля построить самодостаточную компанию xAI, которая недавно привлекла очередные $5 млрд при оценке в $45 млрд. Проект метит в конкуренты OpenAI, в создании которой в 2015 году бизнесмен также участвовал — недавно он подал на на неё в суд с требованием запретить реорганизацию в коммерческую компанию. Гендиректор Nvidia Дженсен Хуанг (Jensen Huang) ранее заявил, что объекты масштаба Colossus обычно строятся не три месяца, а три года. «Мы не просто лидируем; мы беспрецедентными темпами ускоряем прогресс, обеспечивая стабильность [электро]сети с использованием технологии Megapack», — заявил Брент Майо (Brent Mayo), старший менеджер xAI по строительству и инфраструктуре, когда компанию попытались обвинить в манипуляциях с разрешительной строительной документацией и чрезмерными требованиями к региональной энергосистеме. Из Google внезапно ушли создатели нашумевшего ИИ-блокнота NotebookLM ради собственного стартапа

05.12.2024 [15:31],

Алексей Разин

Около полутора лет назад корпорация Google представила NotebookLM — своего рода персональный программный блокнот, который обучается на записях пользователя, к декабрю перенесла его на более продвинутую платформу Gemini Pro, а в сентябре текущего года научила пересказывать видео и аудио. Создатели популярного приложения теперь покидают Google для запуска собственного стартапа.

Источник изображения: Google По крайней мере, как сообщает TechCrunch, в социальной сети LinkedIn бывшая руководительница команды разработчиков NotebookLM Раиза Мартин (Raiza Martin) сообщила, что вместе с единомышленниками покинула Google для поиска «новых волнующих возможностей создания чего-то, трансформирующего весь рынок». Стартап пока существует в не очень явном виде и довольствуется заготовленной под будущий веб-сайт основой. Пока даже непонятно, будут ли создатели NotebookLM работать над похожими инструментами независимо от Google либо сосредоточатся на чём-то другом. Компанию Мартин составили дизайнер Джейсон Спилман (Jason Spielman) и инженер Стивен Хьюз (Stephen Hughes). В комментариях источнику Раиза Мартин не стала вдаваться в подробности своих дальнейших планов, но подчеркнула, что хотела бы создавать нечто, использующее новейшие ИИ-модели на пользу рядовым потребителям. «Выгоды от использования этих технологий должны быть доступны, удобны и очевидны обычным людям», — пояснила она, добавив, что её команда собирается создавать ИИ-продукт, ориентированный в первую очередь на потребности простого пользователя. У стартапа пока нет чётких источников финансирования, но он уже пользуется серьёзной поддержкой за пределами Google. Amazon представила предохранитель от галлюцинаций ИИ

05.12.2024 [14:05],

Павел Котов

Облачное подразделение Amazon Web Services (AWS) представило на мероприятии re:Invent 2024 систему Automated Reasoning. Эта система предназначена для борьбы с «галлюцинациями» — сбоями в моделях искусственного интеллекта, при которых они дают не соответствующие действительности ответы.

Источник изображений: BoliviaInteligente / unsplash.com Система проверок Automated Reasoning направлена на сокращение числа потенциально опасных ошибок, вызванных «галлюцинациями» — такие сбои угрожают безопасности служб ИИ и могут привести к финансовым потерям для компаний. Они могут возникать из-за ошибок в массивах данных, на которых обучались модели ИИ. AWS характеризует Automated Reasoning как «первую и единственную защиту генеративного ИИ, которая помогает предотвращать фактические ошибки из-за галлюцинаций модели». Система пытается решить проблему путём перекрёстной сверки генерируемых моделью ответов с предоставленной клиентом информацией. Если ей не удаётся определить, совпадает ли ответ в точности, он направляется обратно в ту же модель для проверки собственными силами. Automated Reasoning входит в пакет инструментов Amazon Bedrock Guardrails — новая система проверки пытается отследить, каким образом модель пришла к данному ей ответу, и если в цепочке обнаруживается ошибка, его сверяют с предоставленным клиентом массивом данных. Система предлагает собственный ответ на запрос, позволяя клиенту увидеть возможный фактический разрыв и при необходимости провести дополнительную настройку модели. В качестве примера AWS привела поставщика медицинских услуг — он применяет инструмент, чтобы убедиться, что на запросы клиентов о политиках работы компании даются ответы, которые не вводят в заблуждение. «Яндекс» отмечает десятилетний юбилей работы с нейросетями в «Поиске»

05.12.2024 [14:02],

Павел Котов

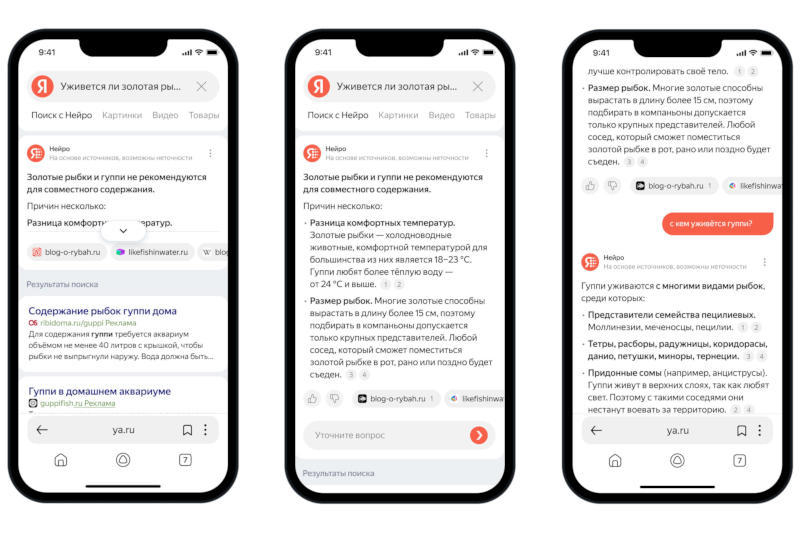

«Яндекс» отмечает десятилетие использования нейросетей в поиске. 5 декабря 2014 года служба представила функцию поиска по картинке, которая начала понимать суть изображения, предлагая похожие варианты и альтернативные версии. Далее нейросети стали участвовать в ранжировании сайтов, переводе текстов, ответе на дополнительные запросы пользователей и во многих других областях. Сегодня они генерируют тексты, изображения и видео.

Источник изображений: «Яндекс» Первые эксперименты с нейросетями компания проводила еще в 2012 году — для прогнозирования дорожных пробок, а затем для распознавания речи в продукте SpeechKit. В 2015 году нейросеть расширила возможности поиска, позволив искать изображения по тексту и помещать картинки в семантическое пространство.  С 2016 года нейросети стали использоваться для ранжирования сайтов в поисковой выдаче. Алгоритмы «Палех» (2016) и «Королёв» (2017) последовательно улучшали качество поиска, оценивая семантическую близость запросов. В 2020 году для ранжирования был внедрен трансформер YATI (Yet Another Transformer with Improvements), который адаптировали под рабочую среду «Яндекса». Значительный прогресс произошел в машинном переводе. С 2017 года нейросети интегрировались в поиск, а к 2021 году позволили включать в выдачу англоязычные сайты при отсутствии русскоязычных результатов. Появился также перевод видео в «Поиске» и «Браузере».  Сегодня «Яндекс Поиск» не только показывает сайты, но и отвечает на пользовательские вопросы благодаря функции «Поиск с Нейро» и нейросети YandexGPT. В текущем году к сервису подключили мультимодальную VLM-нейросеть, которая позволяет осуществлять поиск с использованием текста и изображений. Google DeepMind создала ИИ, который предсказывает погоду быстрее и точнее существующих систем

05.12.2024 [13:45],

Владимир Мироненко

Google DeepMind разработала новую модель прогнозирования погоды с помощью искусственного интеллекта (ИИ) GenCast, которая превосходит традиционные метеорологические методы по прогнозированию погоды на срок до 15 дней и, к тому же, точнее предсказывает экстремальные погодные явления.

Источник изображения: NOAA/unsplash.com ИИ-модель GenCast рассматривает вероятность реализации нескольких сценариев для точной оценки тенденций — от выработки энергии ветра до перемещения тропических циклонов. Вероятностный метод GenCast является новым рубежом в использовании ИИ для обеспечения более качественных и быстрых ежедневных прогнозов погоды. Этот подход всё чаще используют крупные метеослужбы, пишет Financial Times. «Это знаменует собой своего рода переломный момент в развитии ИИ для прогнозирования погоды, поскольку современные необработанные прогнозы теперь поступают из моделей машинного обучения», — отметил Илан Прайс (Ilan Price), научный сотрудник Google DeepMind. Он добавил, что GenCast может быть включен в оперативные системы прогнозирования погоды, что позволит метеорологам лучше понимать тенденции и готовиться к предстоящим погодным явлениям. Новизна подхода GenCast в сравнении с предыдущими моделями машинного обучения заключается в использовании так называемых ансамблевых прогнозов, представляющих различные результаты, — метода, применяемого в современном традиционном прогнозировании погоды. Для обучения GenCast использовалась накапливавшаяся в течение четырёх десятилетий база данных Европейского центра среднесрочного прогнозирования погоды (ECMWF). Согласно публикации в Nature, модель GenCast превзошла 15-дневный прогноз ECMWF по 97,2 % из 1320 переменных, таких как температура, скорость ветра и влажность. Таким образом она превзошла по точности и охвату ИИ-модель GraphCast от Google DeepMind, представленную в прошлом году. GraphCast превзошла прогнозы ECMWF на 3–10 дней вперед примерно по 90 % показателей. Модели прогнозирования погоды на основе ИИ работают гораздо быстрее стандартных методов прогнозирования, которые полагаются на огромную вычислительную мощность для обработки данных. GenCast может сгенерировать свой прогноз всего за восемь минут, тогда как на составление прогноза с помощью традиционных методов уходят часы. По словам исследователей, ИИ-модель GenCast может быть дополнительно улучшена в части способности предсказания интенсивности крупных штормов. Также может быть увеличено разрешение её данных, чтобы соответствовать обновлениям, сделанным в этом году ECMWF. ECMWF назвал разработку GenCast «важной вехой в развитии прогнозирования погоды». Центр также сообщил, что интегрировал «ключевые компоненты» подхода GenCast в версию своей собственной системы прогнозирования ИИ с ансамблевыми прогнозами, доступную с июня. После провала ИИ-броши Humane решила протолкнуть свой ИИ в смартфоны, автомобили и электронику

05.12.2024 [12:29],

Владимир Фетисов

Компания Humane, создавшая основанное на системе искусственного интеллекта устройство AI Pin, которое должно было освободить людей от смартфонов, но так и не стало популярным, ищет новые пути для продвижения своего программного обеспечения. Разработчики хотят, чтобы другие производители задействовали операционную систему Humane CosmOS в своей продукции.

ИИ-гаджет AI Pin / Источник изображения: humane.com Как это может выглядеть на примере использования ИИ-алгоритмов компании в автомобилях, смартфонах, умных колонках и телевизорах, Humane показала в небольшом видео. Стоит отметить, что опубликованное видео, как сказано в заявлении Humane, предназначено для «иллюстративных целей», в нём показаны «рабочие прототипы» и смоделированные варианты использования алгоритмов компании. Это означает, что ролик раскрывает только возможные варианты применения ИИ, но о каком-то готовом к выходу на рынок продукте говорить пока рано. В одном из примеров показано, как водитель автомобиля беседует с CosmOS, давая команды включить отопление в своём доме, а также спрашивает, во сколько должны прийти гости. В других примерах люди взаимодействуют с CosmOS через умную колонку и телевизор. В первом случае алгоритм должен найти рецепт гуакамоле, а во втором — рассказать о количестве голов, забитых футболистом, которого в данный момент показывают на экране телевизора. В видео также показано, как CosmOS читает электронную почту на смартфоне пользователя и формирует ответ на вопрос о возможном присутствии владельца устройства на запланированной встрече. По большому счёту, продемонстрированные в ролике Humane возможности не являются чем-то совершенно новым. Уже сейчас начали появляться ИИ-агенты, предназначенные для выполнения определённых задач с минимальным участием человека, например, они могут бронировать билеты или столик в ресторане. В скором времени ожидается появление большего количества полезных ИИ-агентов, которые смогут выполнять различные повседневные задачи. Своим роликом Humane, по всей видимости, хочет показать мощные возможности CosmOS в плане создания ИИ-агентов, побудив сторонних производителей рассматривать ОС в качестве основы для своих устройств. Но показанные в видео возможности не являются разработкой Humane, и скорее всего, компания не будет сама их реализовывать. Вместо этого она хочет предоставить другим разработчикам SDK, на основе которого они смогут создавать собственных ИИ-агентов. Собственно, сам CosmOS SDK пока недоступен публично. На веб-сайте компании сказано, что он «скоро появится». Humane не упоминает каких-либо партнёров, которые уже работают над созданием устройств с CosmOS. Это может означать, что компания только ищет варианты для сотрудничества с другими производителями, которые будут готовы интегрировать CosmOS в свою продукцию, будь то смартфоны, автомобили, телевизоры или умные колонки. ChatGPT прибавил 100 млн пользователей всего за три месяца — аудитория достигла 300 млн

05.12.2024 [12:18],

Владимир Мироненко

Несмотря на ужесточившуюся конкуренцию на ИИ-рынке, аудитория чат-бота ChatGPT на базе генеративного ИИ компании OpenAI продолжает стремительно расти, добавив 100 млн спустя несколько месяцев после объявления в августе о достижении отметки в 200 млн еженедельных активных пользователей, пишет The Verge.

Источник изображения: Levart_Photographer/Unsplash О новом достижении сообщил генедиректор OpenAI Сэм Альтман (Sam Altman) в ходе мероприятия DealBook Summit, проводившегося изданием The New York Times. «Наш продукт масштабировался., теперь у нас более 300 млн еженедельных активных пользователей», — сказал Альтман, добавив, что сейчас пользователи отправляют в ChatGPT более 1 млн сообщений в сутки. Аудитория ChatGPT растёт быстрыми темпами с момента запуска чат-бота в ноябре 2022 года, поскольку OpenAI постоянно добавляет в него новые возможности, привлекающие всё больше пользователей. В частности, в ChatGPT была добавлена функция поиска ИИ, которая отображает и суммирует результаты из интернета, и новый интерфейс Canvas, позволяющий редактировать текст и код, сгенерированный ИИ, не создавая новых запросов. Apple также встроила ChatGPT непосредственно в Siri в рамках обновления ОС iOS 18.2, которая сейчас доступна в бета-версии, что позволит чат-боту охватить ещё больше пользователей. В следующем году OpenAI планирует увеличить аудиторию ChatGPT до 1 млрд человек. Китайская Tencent представила генератор видео HunyuanVideo, который пользователи назвали лучшим из существующих

05.12.2024 [10:57],

Павел Котов

Китайский технологический гигант Tencent анонсировал HunyuanVideo — передовую модель искусственного интеллекта для генерации видео, опубликованную с открытым исходным кодом. Впервые код вывода и веса модели ИИ с такими возможностями доступны всем желающим.

Источник изображения: Tencent HunyuanVideo, как утверждает Tencent, способна генерировать видеоролики на уровне ведущих мировых систем с закрытым исходным кодом — эти видео отличают высокое качество картинки, разнообразие движений объектов в кадре, способность синхронизировать визуальный и звуковой ряд, а также стабильность генерации. Это крупнейшая модель для генерации видео — у неё 13 млрд параметров. Пакет HunyuanVideo включает в себя фреймворк с инструментами для управления данными; инструментами для совместного обучения моделей, работающих с изображениями и видео; а также инфраструктуру с поддержкой крупномасштабного обучения моделей и их запуска. Tencent протестировала модель при поддержке профессионального сообщества, которое установило, что HunyuanVideo превосходит по качеству закрытые проекты Runway Gen-3 и Luma 1.6. Чтобы добиться такого результата, разработчик обратился к гибридной архитектуре передачи «двойного потока в одинарный» (Dual-stream to Single-stream). На начальном этапе видео- и текстовые токены обрабатываются независимо несколькими блоками модели-трансформера, благодаря чему данные разных форматов преобразуются без помех. На этапе единого потока видео- и текстовые токены передаются в последующие блоки трансформера, обеспечивая эффективное слияние мультимодальных данных. Это позволяет зафиксировать сложные отношения между визуальной и семантической информацией, а общая производительность модели повышается. Выпустив HunyuanVideo, компания Tencent сделала значительный шаг к демократизации технологий создания видео при помощи ИИ. Благодаря открытому исходному коду модель способна произвести революцию в экосистеме генерации видео. Google DeepMind представила ИИ-модель Genie 2, которая может превращать тексты в трёхмерные игры

05.12.2024 [10:24],

Михаил Романов

Команда Google DeepMind представила Genie 2 — вторую версию фундаментальной модели ИИ, способной на лету генерировать новые интерактивные цифровые окружения, или игровые миры. Напомним, оригинальная Genie была выпущена в феврале и могла генерировать виртуальные 2D-миры из синтезированных изображений. Genie 2 способна делать это в 3D и на основе текстовых команд. Пользователь может описать желаемый мир, выбрать подходящий рендеринг и ступить в новое окружение. На каждом шагу человек/агент совершает действие (движение мыши, нажатие клавиши на клавиатуре), а Genie 2 имитирует его последствия.

В основе каждого примера — изображение, сгенерированное ИИ-моделью Imagen 3 на основе текстовой подсказки По словам Google DeepMind, Genie 2 может генерировать последовательные интерактивные миры продолжительностью около минуты, хотя большинство показанных (см. видео ниже) примеров длятся 10−20 секунд. По сравнению с первой версией Genie 2:

По мнению Google DeepMind, Genie 2 демонстрирует потенциал фундаментальных моделей мира для создания разнообразных трёхмерных окружений и ускорения тренировок/тестирования ИИ-агентов (вроде того же SIMA). Google DeepMind уточняет, что исследование находится на ранней стадии и требует значительных улучшений в областях возможностей агентов и генерации среды, но уже видит в Genie 2 решение структурной проблемы безопасной тренировки ИИ-агентов. |