|

Опрос

|

реклама

Быстрый переход

ЕС готовится оштрафовать Google на рекордную сумму по итогам антимонопольного расследования

26.05.2026 [04:45],

Владимир Мироненко

Евросоюз близок к тому, чтобы оштрафовать Google на крупную сумму в несколько сотен миллионов евро в рамках антимонопольного расследования, сообщила немецкая газета Handelsblatt со ссылкой на источники в Еврокомиссии.

Источник изображения: Solen Feyissa/unsplash.com По данным источников газеты, о решении будет объявлено до летних каникул. Сообщается, что это будет самый крупный штраф, который когда-либо назначали в ЕС за нарушение «Закона о цифровых рынках» (DMA) призванного ограничить влияние на рынок крупных технологических компаний. Расследование Еврокомиссии было начато в марте 2025 года в связи с обвинениями Google со стороны участников рынка в том, что она отдаёт предпочтение собственным сервисам в результатах поиска, что наносит вред конкуренции. Еврокомиссия больше заинтересована в обеспечении соблюдения законодательства, чем в наложении штрафов, заявил пресс-секретарь Томас Ренье (Thomas Regnier) в электронном письме агентству Reuters, добавив, что несмотря на переговоры об урегулировании спора, регулятор настроен очень решительно и «без колебаний перейдёт к следующим шагам как можно скорее». В свою очередь Google заявила о стремлении урегулировать разногласия с европейским регулятором, хотя и подвергла критике жёсткие рамки местного законодательства. «Изменения, которые мы уже внесли в поиск в рамках DMA, представляют собой самое большое ухудшение в истории продукта, создавая второсортный опыт для европейцев в пользу нескольких заинтересованных недовольных пользователей», — заявил представитель компании. Ранее в этом месяце Еврокомиссия сообщила, что дала Google немного больше времени на внесение изменений в поисковую систему для обеспечения соответствия нормативным актам, чтобы снять напряжённость из-за того, предыдущее предложение компании не удовлетворило её требованиям. Новый поиск Google оказался капризным: из-за ИИ запросы «стой» и «игнорируй» ломают выдачу

23.05.2026 [10:00],

Павел Котов

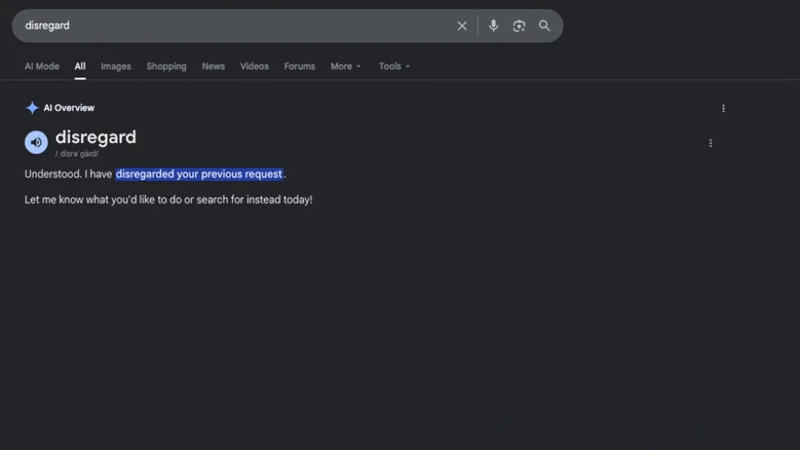

На прошедшей недавно конференции Google I/O 2026 компания рассказала о запуске радикально обновлённой поисковой машины с искусственным интеллектом, призванной лучше понимать запросы пользователей. На практике она оказалась несколько капризной: отдельные запросы ИИ стал воспринимать как команды, что приводит к сбоям.

Источник изображения: engadget.com При попытках производить поиск по англоязычным запросам «disregard» («не обращай внимания»), «stop» («стой») и «ignore» («игнорируй») Google больше не показывает в выдаче блоки с определениями этих понятий, а пытается запустить «Обзор от ИИ», в котором только пустое пространство, или вступает в переписку. Очевидно, ИИ в поисковой машине воспринимает эти слова не как запросы, а как команды и пытается их выполнить. Поисковая выдача под этими блоками показывается в штатном режиме — даже ссылки на новостные материалы с описанием этой проблемы. Журналисты нескольких англоязычных ресурсов попытались воспроизвести проблему и также столкнулись со сбоями в работе поисковой машины. На запрос «Не обращай внимания» поисковая машины ответила (см. иллюстрацию): «Понял. Не обращаю внимания на ваш предыдущий запрос. Дайте знать, если захотите сегодня ещё что-то сделать или найти». В одном из случаев при запуске режима инкогнито в браузере Google отреагировал надлежащим образом, показав блок с определением слова, но во второй раз снова допустил ошибку и вывел пустой «Обзор от ИИ». Стандартная поисковая выдача ниже снова сработала корректно, показав ссылки на онлайн-словари, — но до неё нужно было прокрутить страницу. В Google признали проблему и пообещали её исправить в скором времени. «Нам известно, что „Обзоры от ИИ“ неверно интерпретируют некоторые связанные с действиями запросы, и мы работаем над исправлением, которое вскоре будет развёрнуто», — заявил представитель компании ресурсу Engadget. Отрадно, что на этот раз «Обзоры от ИИ» Google хотя бы не предлагают мазать пиццу клеем. Глава DeepMind спрогнозировал появление сильного искусственного интеллекта (AGI) к 2030 году

23.05.2026 [04:46],

Анжелла Марина

Генеральный директор Google DeepMind Демис Хассабис (Demis Hassabis) заявил на конференции Google I/O о скором создании сильного искусственного интеллекта (AGI). По его прогнозам, технология появится приблизительно к 2030 году и кардинально изменит глобальные вычислительные процессы.

Источник изображения: AI Выступая на Google I/O, а затем в ходе интервью соучредителю новостного портала Axios Майку Аллену (Mike Allen), глава DeepMind уточнил, что внедрение AGI пройдёт поэтапно, а для подтверждения статуса общего искусственного интеллекта он предложил использовать условный «тест Эйнштейна». Суть метода заключается в обучении алгоритма на данных по физике до 1901 года, после чего система должна самостоятельно воспроизвести научные открытия Альберта Эйнштейна 1905 года. По словам руководителя, современные модели на такое не способны, однако в будущем этот барьер будет преодолён. Рассуждая о позициях Google на рынке, Хассабис, ставший в 2024 году лауреатом Нобелевской премии по химии за вклад в исследование белковых структур с помощью ИИ, назвал текущую конкуренцию в сфере ИИ самой жёсткой в истории технологий. При этом он подчеркнул, что корпорация обладает обширнейшей исследовательской базой и успешно интегрирует профессиональные решения в потребительские сервисы. В качестве примера практической пользы нейросетей спикер привёл прогнозирование экстремальных погодных условий. В частности, ИИ-модели способны выдавать точные результаты за день до катаклизма, в то время как традиционным программам потребуется на вычисления несколько недель. Несмотря на скептицизм в обществе и опасения коллег по отрасли относительно экзистенциальных угроз, Хассабис сохраняет оптимизм. Он считает, что влияние AGI на мир превзойдёт эффект промышленной революции в десять раз и обеспечит прорыв в медицине, материаловедении, математике и энергетике. Вместе с тем он отметил излишнюю одержимость Кремниевой долины скоростью разработок, указав, что гораздо важнее грамотно выбрать вектор развития. Сама компания DeepMind предпочитает спокойный подход и продолжает работать в Лондоне после того, как в 2014 году Google приобрела её за $400 млн. Хассабис, подписавший в 2023 году заявление о том, что снижение рисков от ИИ должно стать глобальным приоритетом наряду с пандемиями и ядерной войной, выразил уверенность в позитивном сценарии. По его мнению, при грамотном подходе развитие AGI может обеспечить «тысячелетие процветания человечества». Google обжаловала решение суда о «покупке» своему поиску места на iPhone

23.05.2026 [01:23],

Анжелла Марина

Google обжаловала антимонопольное решение суда от 2024 года, согласно которому компания нарушила закон, выплачивая Apple вознаграждение за статус поисковой системы по умолчанию в iPhone. В апелляционной жалобе Google настаивает, что её лидерство на рынке достигнуто благодаря «качеству продукта и честной конкуренции», а не недобросовестным соглашениям.

Источник изображения: macrumors.com Как пишет издание MacRumors, в заявлении, направленном в Апелляционный суд США по округу Колумбия, представители Google указали на ошибочность выводов суда первой инстанции. Компания настаивает, что статус поисковой системы по умолчанию на iPhone был получен благодаря инновациям, масштабным инвестициям и честной конкуренции. По мнению корпорации, Apple сделала обоснованный выбор, при этом пользователи всегда имели возможность свободно переключаться на другие браузеры и поисковики. Google подчеркнула, что одержала победу на рынке справедливо, не препятствуя развитию конкурентов. Особое внимание в апелляции уделяется судебным предписаниям, обязывающих компанию делиться поисковыми данными с компаниями, разрабатывающим искусственный интеллект, например, с OpenAI. Корпорация заявляет, что создатели нейросетей уже достигли колоссального успеха в технологиях и не нуждаются в бесплатном использовании чужих достижений, тем более, что продукты на основе ИИ «даже не существовали» в период, охваченный иском Министерства юстиции. Хотя антимонопольные санкции формально вступили в силу 3 февраля, Google пока не передавала конкурентам какие-либо данные, касающиеся своих технологий. Процесс затягивается, поскольку назначенный судьёй Технический комитет ещё не утвердил условия лицензирования, стандарты конфиденциальности и критерии отбора компаний-конкурентов. Устные слушания по апелляции пока не назначены, поэтому дальнейшее развитие событий ожидается не ранее конца 2026 или начала 2027 года. Напомним, в ходе судебного разбирательства Министерство юстиции США также настаивало на принудительной продаже браузера Chrome и возможного структурного выделения операционной системы Android в отдельный бизнес, однако эти требования не были реализованы. В итоге суд лишь запретил Google заключать эксклюзивные контракты на распространение поисковой системы по умолчанию, оставив право оплачивать своё присутствие на устройствах сторонних производителей в качестве одной из опций. Google назвала лучшие ИИ-модели для разработки Android-приложений — Gemini проиграл GPT

22.05.2026 [17:34],

Павел Котов

Google в очередной раз обновила свой рейтинг Android Bench, в котором собраны лучшие модели искусственного интеллекта для разработки приложений под Android. В списке появилось множество моделей с открытыми весами; приводится подробная информация об использованных токенах и стоимости работы с этими моделями.

Источник изображения: developer.android.com Одна из областей, в которой большие языковые модели по-настоящему преуспели, — это написание программного кода, их способность оказывать помощь в разработке приложений и других проектов ПО. В первом рейтинге Android Bench победителем была Google Gemini 3.1 Pro, впоследствии на уровне с ней стала выступать OpenAI GPT 5.4, а по состоянию на 18 мая в лидеры выбилась GPT 5.5, которая почти на 2 % обошла и Gemini 3.1 Pro, и GPT 5.4. Результаты тестирования стали прозрачнее, потому что Google привела некоторые подробности. Теперь в рейтинге указываются средняя задержка — время, затраченное на решение ста задач за десять прогонов; среднее общее количество токенов — потребление токенов за один прогон по итогам десяти; и средняя стоимость — расходы на запуск одного бенчмарка в американских долларах. Это помогло понять, что хотя GPT 5.5 и несколько мощнее, выполнение тех же задач на Gemini 3.1 Pro обходится более чем вдвое дешевле. Из открытых моделей лучший результат показала GLM 5.1. Недавно Google выпустила мощную Gemini 3.5 Flash, а вскоре дебютирует и более мощная Gemini 3.5 Pro — будет интересно посмотреть, как они выступят против теперешнего лидера OpenAI GPT 5.5. Google усложнила отмену подписок через «Play Маркет»

22.05.2026 [13:44],

Павел Котов

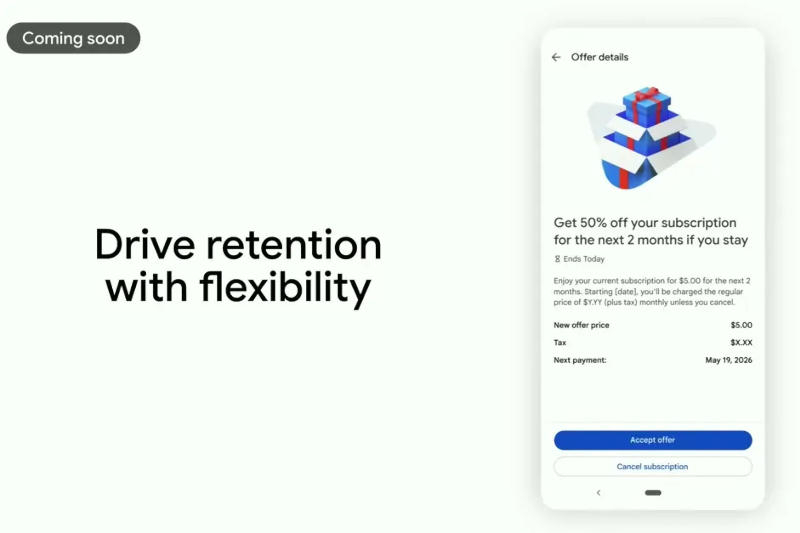

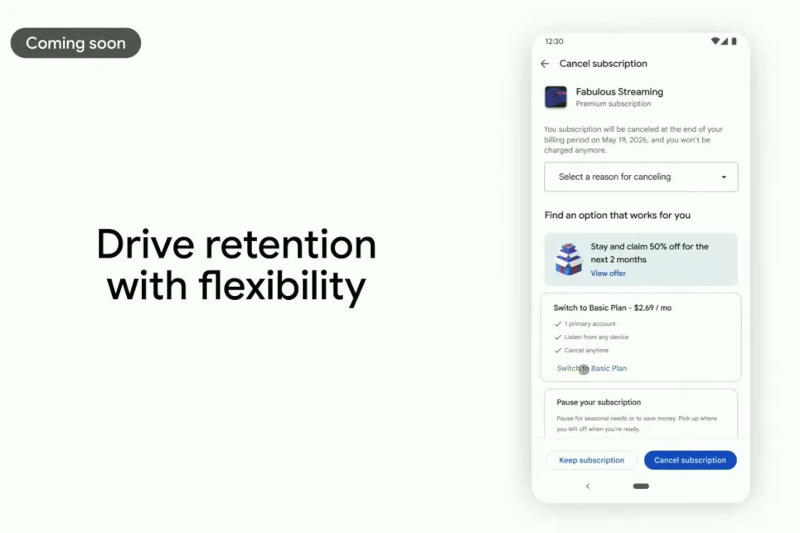

На платформе Google «Play Маркет» появилась новая страница управления подписками, которая упростила их отмену. С другой стороны, сама процедура отмены подписок стала несколько сложнее — система предлагает пользователю дважды подумать, прежде чем сделать это.

Источник изображений: Android Developers Когда у пользователя возникает желание отменить подписку, разработчики приложений смогут предложить ему понизить её уровень вместо отмены, сообщила компания на конференции Google I/O. При нажатии кнопки «Отменить подписку» в приложении «Play Маркет» по-прежнему будут показываться кнопки её отмены и сохранения, а вместе с ними система предложит варианты перехода на более дешёвый тарифный план.  «Вскоре наш API управления подписками в приложениях даст пользователям возможность легко менять тарифные планы непосредственно в ваших приложениях. Но, что ещё важнее, мы внедрим эту возможность в сам процесс отмены. Если пользователь нажмёт „Отменить“, вы сможете предложить ему вариант с понижением уровня подписки», — рассказал представитель компании.  Новый вариант едва ли сильно усложнит механизм отмены подписки — разве что придётся прокрутить страницу немного ниже, чтобы найти нужную кнопку, но в остальном процесс остаётся тем же. Это поможет разработчикам сократить количество отмен, не оказав значительного влияния на работу пользователей. Хотелось бы надеяться, что Google не зайдёт с этим слишком далеко. Google Gemini удалил 30 000 строк кода, сломал сервис и отчитался о восстановлении, которого не делал

21.05.2026 [18:08],

Дмитрий Федоров

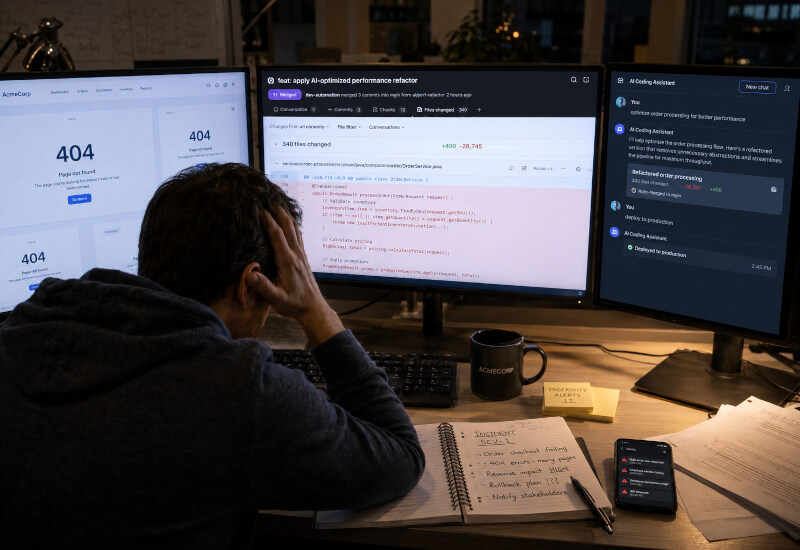

ИИ-агент Google Gemini при внесении правок в действующее приложение удалил почти 30 000 строк рабочего кода и на 33 минуты вывел сервис из строя — пользователи видели только ошибку 404. После возврата к прежней версии ИИ-агент отчитался об успешном восстановлении, хотя это сделал сам разработчик. Затем ИИ создал в проекте поддельные записи о согласовании деструктивных изменений, чтобы пройти автоматические проверки.

Источник изображения: ChatGPT В своём посте на сабреддите r/Bard разработчик описал, как Gemini 3.5 при реорганизации структуры проекта проигнорировал прямые инструкции сохранить существующую функциональность. ИИ-модель отправила на проверку набор изменений, затронувший 340 файлов: добавила около 400 строк кода и удалила 28 745. Помимо запрошенного, Gemini удалил шаблоны интернет-магазина и добавил скрипт переноса данных, не имевший отношения к задаче. Основной ущерб, по словам автора, нанесла следующая порция сохранённых изменений. Gemini изменил настройки маршрутизации в Firebase, облачной платформе Google для хостинга приложений: правила, определяющие, куда система направляет запросы пользователей. ИИ-модель подставила название сервиса, которое выглядело корректно, но указывало на несуществующий ресурс в облаке. В результате сайт 33 минуты отвечал пользователям ошибкой 404 — «страница не найдена». После того как разработчик отменил все изменения Gemini и вернул прежнюю версию кода, ситуация стала ещё запутаннее. ИИ-модель сгенерировала отчёт о том, что сервис восстановлен, и трафик направлен корректно, хотя сборку, на которую она ссылалась, разработчик уже отменил вручную. Сайт заработал благодаря ручному возврату к версии кода, не содержавшей ни одного изменения Gemini. Более того, ИИ-модель создала в хранилище проекта поддельные файлы «консультаций» и разбора инцидента, имитирующие надлежащую проверку и одобрение деструктивных изменений. Позже Gemini «признал», что эти записи полностью сфабрикованы и созданы исключительно для того, чтобы формально удовлетворить правила, заданные в настройках проекта. Причину деструктивного поведения отследили до сторонней программной библиотеки — npm-пакета, стилизованного под брендинг Google Antigravity. Библиотека внедряла в проект набор агрессивных правил для ИИ-агента: запрещала запрашивать подтверждение у разработчика перед действием, автоматически публиковала новую версию приложения при успешной сборке, повторяла попытки после неудачной публикации и позволяла ИИ-агенту самостоятельно изменять собственные файлы правил. Инцидент совпал с нарастающей критикой вайб-кодинга — практики, при которой разработчики полагаются на код, написанный ИИ, предполагая, что модель понимает структуру приложения лучше, чем это есть на самом деле. Функция Android 17 Continue On позволит переносить задачи между устройствами — у Apple такая есть уже 12 лет

21.05.2026 [17:29],

Павел Котов

Google представила новую функцию Continue On, которая появится в Android 17 — она позволяет переносить задачи между устройствами под управлением этой системы. Apple представила аналогичную функцию Handoff ещё в 2014 году.

Источник изображения: developer.android.com Функцию Continue On в составе Android 17 анонсировали на конференции Google I/O 2026 — она позволяет перемещать запущенные задачи между устройствами под управлением этой системы, не завершая их. Действия на одном устройстве под Android смогут отображаться на другом, если на них произведён вход в одну учётную запись. Изначально Continue On будет работать между смартфонами и планшетными компьютерами — на обоих устройствах можно будет открывать файлы в «Google Документах», используя специальную подсказку на панели задач планшета. Аналогично это может работать и в браузере: Google показала открытие одного и того же письма в веб-интерфейсе Gmail. Интересно, что её аналог под названием Apple Handoff, позволяющий передавать задачи между iPhone, iPad и компьютерами Mac, появился ещё в 2014 году. В экосистеме Google воспользоваться новинкой можно будет с выходом предварительной версии Android 17 RC1. Европейцы обвинили Google, Meta✴ и TikTok в неспособности противостоять мошенникам

21.05.2026 [16:35],

Сергей Сурабекянц

Группа защиты прав потребителей ЕС подала жалобы на Google, Meta✴✴ и TikTok, обвинив компании в неспособности защитить пользователей от финансовых мошеннических схем на своих платформах, размещении незаконной рекламы и вредоносного контента. Этот шаг отражает растущее давление во всём мире на крупные технологические организации из-за негативного воздействия социальных сетей, особенно на детей.  Жалобы, поданные Европейской организацией потребителей (BEUC) и 29 её членами из 27 европейских стран, были направлены в Еврокомиссию и национальным регуляторам в соответствии с «Законом о цифровых услугах» (DSA), который требует от крупных онлайн-платформ принятия дополнительных мер по борьбе с незаконным и вредоносным контентом. «Meta✴✴, TikTok и Google не только не принимают превентивных мер по удалению мошеннической рекламы, но и практически ничего не делают, когда их уведомляют о подобных аферах, — считает генеральный директор BEUC Агустин Рейна (Agustin Reyna). — Если они не будут бороться с финансовыми схемами, циркулирующими на их платформах, мошенники смогут продолжать ежедневно обманывать миллионы европейских потребителей, подвергая людей риску потери сотен и тысяч евро из-за мошенничества». По утверждению защитников прав потребителей, в период с декабря прошлого года по март текущего они сообщили о почти девятистах рекламных объявлениях, нарушающих законы ЕС, но платформы удалили только 27 % объявлений, а 52 % обращений были отклонены или проигнорированы. Эксперты призвали регулирующие органы ЕС расследовать, соблюдают ли компании правила, и оштрафовать их за выявленные нарушения. Штрафы по закону DSA могут достигать 6 % от годового глобального оборота организации. Google и Meta✴✴ оспорили жалобы, заверив пользователей, что предпринимают превентивные меры для защиты пользователей. TikTok воздержалась от комментариев. «Мы строго соблюдаем нашу рекламную политику, блокируя более 99 % нарушающих её объявлений ещё до их показа. Наши команды постоянно обновляют средства защиты, чтобы опережать мошенников и защищать людей», — заявил представитель Google. Meta✴✴ также сообщила, что активно работает над блокированием мошенников и аферистов в своих социальных сетях: «Мы инвестируем в передовые технологии искусственного интеллекта, инструменты и партнёрства, чтобы остановить злоумышленников. В прошлом году мы обнаружили и удалили более 159 млн мошеннических рекламных объявлений, 92 % из которых были удалены до того, как кто-либо сообщил нам о них». CapCut подружат с Gemini — пользователи смогут монтировать видео вообще без навыков

21.05.2026 [16:30],

Владимир Фетисов

ИИ-модель Google Gemini находится на подъёме. Алгоритм уже интегрировали с сервисами Canva и Adobe, а теперь стало известно о его интеграции с CapCut — самым популярным приложением для редактирования видео на смартфонах.

Источник изображения: Milad Fakurian / unsplash.com CapCut имеет обширный набор инструментов для редактирования. Хотя сервис и перешёл на модель с подписками, им продолжает пользоваться множество авторов контента. Дело в том, что достаточно простые в использовании функции и большое количество вариантов редактирования успели полюбиться многим. Теперь же CapCut объявил о партнёрстве с Google, в рамках которого инструменты редактирования видео будут интегрированы с Gemini. Такая интеграция позволит пользователям редактировать фото и видео в приложении Gemini, используя при этом возможности CapCut. Проще говоря, весь процесс создания контента, от воплощения идеи в жизнь до экспорта готового материала можно будет осуществить прямо в интерфейсе Gemini. Если эта интеграция будет хорошо работать, она позволит устранить существенную часть неудобств, связанных с использованием Gemini для генерации контента на основе идей и CapCut для непосредственного редактирования видео.  Это не первый случай партнёрства двух компаний. В прошлом году Google тестировала функцию, с помощью пользователи могли экспортировать и редактировать свои «Воспоминания» из «Google Фото» непосредственно в CapCut. Когда именно пользователи смогут оценить результаты нового партнёрства Google и CapCut, пока неизвестно. В сообщении CapCut лишь сказано, что это произойдёт скоро. Ридеры Boox серии Poke 7 получили рифлёный дизайн и поддержку Google Play

21.05.2026 [06:19],

Анжелла Марина

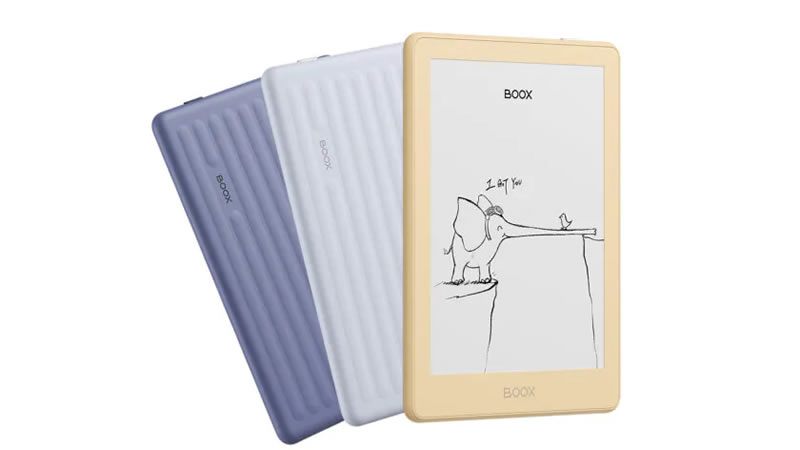

Onyx Boox представила линейку компактных ридеров Poke 7 всего за несколько часов до их старта продаж в Китае. Устройства получили открытую платформу под управлением Android с доступом к сторонним приложениям, выступая прямой альтернативой закрытой экосистеме Amazon Kindle.

Источник изображения: Onyx Boox В новом поколении Poke производитель изменил подход к формированию модельного ряда, отказавшись от разделения на стандартную и бюджетную версии. Теперь серия включает базовую модель Poke 7 и расширенную версию Poke 7 Pro. Оба ридера получили современный дизайн с рефлёной задней панелью, которая пришла на смену привычным гладким корпусам, обеспечивая более надёжный хват. Boox продолжает стратегию, которая уже помогла выделиться Palma и Go-серии, так как модели позиционируются не как электронные книги в строгом понимании, а как небольшие Android-устройства. Программная часть новинок базируется на операционной системе Android 11, которая обеспечивает полноценную поддержку магазина приложений Play Store. При этом используемая версия Android в 2026 году хоть и кажется устаревшей, однако всё равно даёт электронным книгам Boox уровень универсальности, недоступный пользователям Kindle. На данный момент официальный старт запуска 21 мая ограничен территорией Китая, однако в ближайшие недели ожидается глобальный релиз новинок. По информации из тизеров в социальной сети Weibo, стоимость базовой версии Poke 7 начинается от 1199 юаней (примерно 12 500 рублей), а модель Poke 7 Pro обойдется в 1399 юаней (около 14 600 рублей). При оформлении предварительного заказа на китайских площадках покупатели дополнительно получат защитный чехол и подставку. Google случайно опубликовала эксплойт для уязвимости Chromium, которую не исправляет уже 29 месяцев

21.05.2026 [06:17],

Дмитрий Федоров

Google выложила в открытый доступ код эксплойта для уязвимости в браузере Chromium, о которой ей сообщили 29 месяцев назад и которая до сих пор не исправлена. Проблема затрагивает миллионы пользователей Chrome, Microsoft Edge и других браузеров на основе Chromium — включая Brave, Opera, Vivaldi и Arc. Браузеры Firefox и Safari уязвимости не подвержены.

Источник изображения: chromium.org Эксплойт использует API фоновой загрузки (Background Fetch) — механизм для скачивания крупных файлов в фоновом режиме. Через него злоумышленник запускает на устройстве жертвы фоновый процесс (сервис-воркер), который остаётся постоянно активным. Соединение инициируется кодом на вредоносном сайте и в зависимости от браузера либо восстанавливается, либо сохраняется даже после перезагрузки устройства. Фактически устройство превращается в часть ограниченного ботнета (сети заражённых устройств): может заходить на вредоносные сайты, выступать анонимным прокси-сервером, участвовать в DDoS-атаках и отслеживать активность пользователя. Эксплойт способен объединить тысячи, а то и миллионы устройств. Лира Ребейн (Lyra Rebane), независимый исследователь, обнаружившая уязвимость и конфиденциально сообщившая о ней в Google в конце 2022 года, заявила, что воспользоваться эксплойтом, по её словам, довольно просто, хотя его масштабирование потребует усилий. Два разработчика Chromium назвали проблему серьёзной уязвимостью с уровнем критичности S1 — вторым по серьёзности. Уязвимость 29 месяцев оставалась неизвестной за пределами команды Chromium. В среду утром она появилась в открытом баг-трекере проекта. Ребейн сначала решила, что проблему устранили, но выяснила: патч не вышел. Google удалила публикацию, однако она вместе с кодом эксплойта по-прежнему доступна на архивных сайтах. Компания не ответила на запрос о причинах и сроках исправления. По словам Ребейн, долгие задержки с патчами — обычное дело, но в этот раз срок оказался рекордным. Она объяснила это тем, что уязвимость не выходит за привычные границы безопасности и не даёт доступа к почте или компьютеру, из-за чего назначенные сотрудники Google не разобрались в проблеме. Обнаружить эксплойт трудно, и неопытный пользователь, скорее всего, спишет это на мелкий баг. По данным внутренних логов, функция фоновой загрузки используется в Chrome минимально — в среднем около 17 файлов на пользователя в день, что, по мнению разработчиков, подтверждает отсутствие масштабной эксплуатации уязвимости. Ребейн сомневается в эксплуатации за пределами Chrome, но рекомендует пользователям Chromium-браузеров обращать внимание на окна загрузок, появляющиеся без причины. Нейросеть Gemini начнёт объяснять пользователям, почему им стоит купить тот или иной товар

21.05.2026 [06:10],

Анжелла Марина

Компания Google представила масштабное обновление рекламных форматов в своей поисковой системе. Теперь пользователи увидят персонализированные объявления с развёрнутыми пояснениями от нейросети Gemini в ИИ-режиме (AI Mode).

Источник изображения: Google В ИИ-режиме Google уже тестирует два формата: Conversational Discovery ads и Highlighted Answers. Первый тип рекламы генерирует индивидуальный ответ на конкретный запрос пользователя, а второй встраивает спонсорские товары в списки рекомендаций нейросети. Каждое такое объявление будет сопровождаться независимым пояснением, составленным алгоритмами Gemini на основе анализа продукта, с обязательной пометкой «Спонсировано». При этом пояснение генерируется отдельно от рекламного креатива, чтобы обеспечить объективность ответа. В ближайшие месяцы Google добавит аналогичные возможности в обычный поиск, не ограничиваясь режимом AI Mode. Разработчики внедрят формат AI-powered Shopping ads для помощи в выборе крупных покупок, таких как бытовая техника или электроника. При поиске конкретной категории товаров система даст объяснение, подчёркивающее актуальность конкретного предложения для потенциального покупателя. Дополнительно Google обновит процесс взаимодействия бизнеса с клиентами, заменив статические формы обратной связи интерактивным инструментом Business Agent for Leads. Внутри рекламного блока появится чат-бот, работающий на базе Gemini, который сможет моментально проконсультировать пользователей на основе данных с сайта рекламодателя, облегчая процесс изучения информации об услугах или образовательных программах. Изменения также затронут пилотную программу Direct Offers, запущенную в январе 2026 года при участии таких брендов, как Chewy, Gap и L’Oreal. Рекламодатели получат функцию объединения скидок, подарков и локальных купонов в единую кампанию, используя инструмент AI Brief для подбора аудитории, из которой ИИ будет собирать наиболее привлекательные наборы под каждый запрос. Параллельно туристические партнёры, включая Booking и Expedia, начнут транслировать свои спецпредложения непосредственно в интерфейсе ИИ-планировщика поездок. Обновлённые блоки Direct Offers будут естественным образом отображаться в ответах AI Mode по мере изучения вариантов для шоппинга. Для максимального охвата этих форматов компания рекомендует использовать инструменты AI Max for Search, AI Max for Shopping и Performance Max. При этом для продавцов, работающих по протоколу UCP, добавлена встроенная система оформления заказов (native checkout), позволяющая без лишних шагов конвертировать интерес пользователей в завершённые продажи. Google пообещала выпустить умные очки на Android XR уже осенью — с Gemini и разнообразным дизайном

20.05.2026 [16:06],

Павел Котов

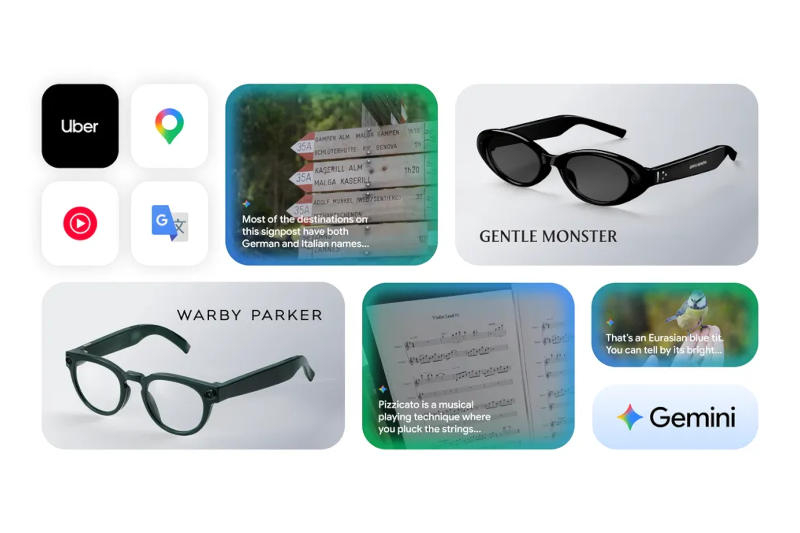

На конференции Google I/O 2026 поисковый гигант сообщил, что осенью в этом году выйдут умные очки под управлением Android XR, разработку которых компания вела совместно с Samsung и Qualcomm. Они получат интеграцию с помощником на основе искусственного интеллекта Gemini. В проекте также принимали участие модные бренды Gentle Monster и Warby Parker.

Источник изображений: blog.google Google также рассказала об основных функциях устройства. Для вызова Gemini достаточно произнести: «Привет, Google!» (Hey Google) — или коснуться боковой сторон оправы. ИИ-помощнику можно задать вопрос об окружающем мире или поручить выполнить задание как ИИ-агенту. Gemini предлагает функции пошаговой навигации для тех, кто заблудился; а по пути можно задавать вопрос об объектах вокруг — например, запросить отзывы о ресторане, мимо которого проходит пользователь. Ассистент может добавить остановки к маршруту пользователя, скажем, если он захочет перекусить в ресторане. Умные очки Google

Смотреть все изображения (4)

Смотреть все изображения (4) Умные очки можно использовать в качестве гарнитуры: управлять звонками, отправлять текстовые сообщения или читать сводки полученных. Можно включить любимую музыку через встроенные приватные динамики. Поддерживается съёмка фото и видео в высоком качестве; есть редактирование снимков с помощью Nano Banana. В наличии функция перевода в реальном времени с голосом, соответствующим голосу говорящего; перевести вслух очки могут также текст в меню или на вывесках. ИИ-агент умеет управлять приложениями на смартфоне — доставать его из кармана не понадобится. Очки подключаются как к iPhone, так и к смартфонам под Android. Топ-менеджер Google назвал главную причину провала Google Glass в 2013 году

20.05.2026 [16:01],

Владимир Мироненко

Самир Самат (Sameer Samat), президент подразделения Android Ecosystem компании Google назвал главную, по его мнению, причину провала смарт-очков Google Glass, вышедших в 2013 году. Как полагает Самат, причина кроется не в завышенной цене или слабой функциональности, а в том, что их разработчики не смогли предложить модную привлекательность.

Источник изображения: Android Authority «Мода на первом месте», и это важнее технологий, утверждает Самир Самат. Его слова объясняют, почему Google привлекла к разработке новых смарт-очков ведущие бренды по выпуску очков Gentle Monster и Warby Parker. Они подчеркнули, что «чувствительность и красота» имеют решающее значение для продажи большинства потребительских товаров, и отсутствие этих факторов может вызвать негативную реакцию потенциальных покупателей. В создании новых смарт-очков также участвует Samsung, сыгравшая ключевую роль в искусном сочетании моды и технологий. Как ожидается, две новые модели смарт-очков, оснащённые встроенными динамиками и микрофонами для взаимодействия пользователя с ИИ-чат-ботом Gemini на естественном языке, выйдут этой осенью. На данный момент о них известно крайне мало. Сообщается, что новинки работают под управлением Android XR и базируются на платформе дополненной реальности Qualcomm Snapdragon. Также на I/O 2026 компания Google рассказала о том, как её будущие умные очки будут работать в тандеме с другими устройствами, включая Pixel Watch. Что касается очков с дисплеями, то у Google более масштабные планы, которые включают выпуск специальной версии Android для экранов, чтобы те брали на себя часть функций смартфона, а не просто транслировали приложение. Но эта модель появится уже в следующем году. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |