|

Опрос

|

реклама

Быстрый переход

Ажиотажный спрос на HBM подтолкнул SK hynix к увеличению капитальных затрат на 30 %

28.07.2025 [11:26],

Алексей Разин

В одном ряду бенефициаров ИИ-бума стоят компании Nvidia и SK hynix, поскольку вторая производит для первой микросхемы памяти типа HBM разных поколений. Рекордная прибыль, которая была получена SK hynix в прошлом квартале, растёт высокими темпами именно благодаря реализации HBM, поэтому компания готова увеличить капитальные затраты сразу на 30 % по итогам этого года.

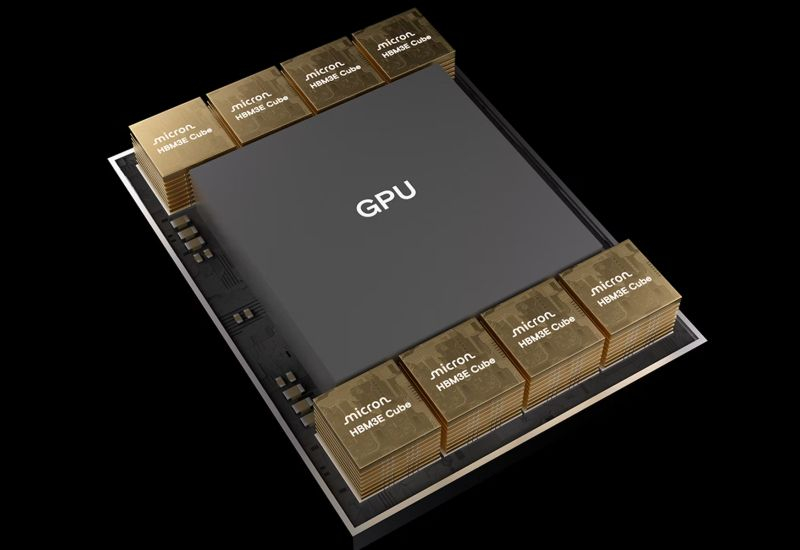

Источник изображения: SK hynix Напомним, что именно HBM сейчас формирует 77 % выручки SK hynix, сейчас эта компания по величине операционной прибыли в два раза обходит конкурирующую Samsung Electronics, а по итогам текущего года выручка SK hynix от реализации HBM должна удвоиться, как ожидает руководство компании. При этом на официальном отчётном мероприятии никто не сказал, как сильно SK hynix намерена увеличить капитальные затраты на расширение производства памяти. Этот пробел попытались устранить неофициальные источники, опрощенные южнокорейским ресурсом The Elec. По их мнению, в этом году капитальные расходы SK hynix вырастут сразу на 30 % до почти $21 млрд. Это серьёзные показатели, причём как в натуральном выражении, так и в относительном. Как отмечали на прошлой неделе представители SK hynix, заметная часть капитальных расходов этого года будет направлена на обеспечение рынка памятью HBM в следующем календарном году. Здесь работает принцип «готовь телегу зимой, а сани летом». Бум ИИ продолжает обогащать SK hynix: выручка подскочила на 35 %, прибыль — на 69 %

24.07.2025 [12:04],

Алексей Разин

Статус крупнейшего поставщика памяти типа HBM для нужд Nvidia продолжает играть на руку южнокорейской компании SK hynix, которая по итогам прошлого квартала смогла увеличить выручку на 35 % в годовом сравнении, а операционную прибыль поднять сразу на 69 %. Выручка от реализации HBM в отдельности должна по итогам этого года удвоиться.

Источник изображения: SK hynix Как отмечает CNBC со ссылкой на квартальную отчётность SK hynix, по итогам прошлого квартала именно HBM определяла 77 % совокупной выручки компании. Собственно говоря, показатели выручки и операционной прибыли второго квартала стали для SK hynix рекордными за всю историю существования компании, они оказались заметно выше ожидаемого аналитиками уровня. Выручка за период достигла $16,17 млрд, а операционная прибыль выросла до $6,57 млрд. Последовательно выручка увеличилась на 26 %, а операционная прибыль — на 24 %. По величине прибыли SK hynix в два раза превосходит более крупную Samsung Electronics. По мнению представителей SK hynix, до конца года спрос на её продукцию вряд ли резко снизится, поскольку на рынок выйдут новые продукты партнёров, а складские запасы на стороне клиентов остаются стабильными. Как отмечает руководство компании, крупные инвестиции техногигантов в сферу ИИ формируют высокий спрос на память, применяемую в этом сегменте. Фактически, в серверном сегменте спрос будет расти не только на направлении систем для ИИ, но и решений общего назначения, как ожидают в SK hynix. Некоторые надежды в компании возлагают и на распространение клиентских устройств с функциями ускорения ИИ — таких как ПК и смартфоны. Наконец, развитие сферы так называемого «суверенного ИИ», чья инфраструктура будет финансироваться правительствами отдельных стран и регионов, позволит сформировать тенденцию к долгосрочному росту спроса на память для систем такого класса, как считают в компании. К массовому производству микросхем HBM4 она надеется приступить до конца текущего года. Капитальные расходы в этом году придётся увеличить, чтобы обеспечить продукцией клиентов в 2026 году, причём основная часть прироста предсказуемо придётся на память для систем ИИ. Примечательно, что неопределённость с так называемыми «тарифами Трампа» способствовала росту спроса на продукцию SK hynix в первой половине текущего года. Влияние этих тарифов на динамику выручки во втором полугодии пока предугадать сложно, по словам этого производителя памяти. Возобновление поставок ускорителей Nvidia H20 в Китай таит в себе кучу рисков и неопределённости

23.07.2025 [08:30],

Алексей Разин

Осведомлённые источники недавно уже предупреждали, что в случае необходимости возобновить выпуск чипов для ускорителей H20 на конвейере TSMC сделать это будет не так просто, да и сама Nvidia отмечала, что на нормализацию поставок может уйти до девяти месяцев. Тайваньские СМИ поясняют, что этим перечень возможных проблем не ограничивается.

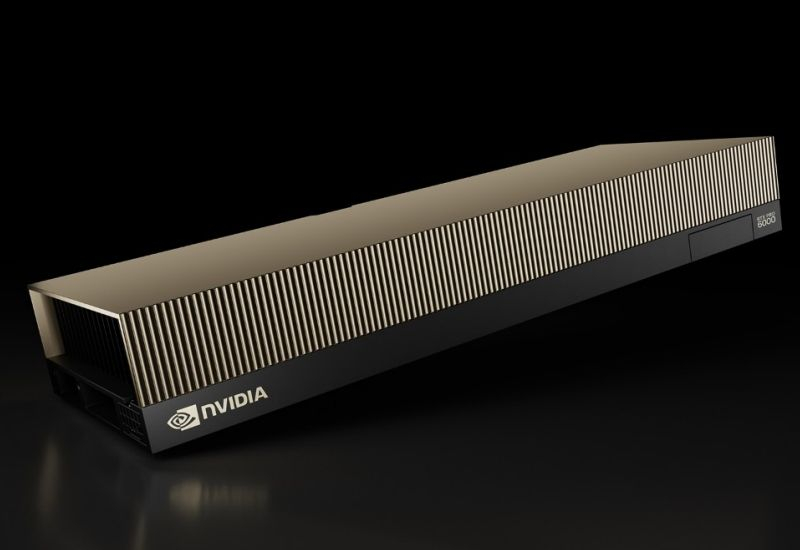

Источник изображения: Nvidia Издание Commercial Times подчёркивает, что основная часть необходимых для обслуживания заказов по H20 кремниевых пластин уже была отгружена TSMC компании Nvidia и её прочим подрядчикам. Вероятность возобновления выпуска этих чипов на стороне TSMC сейчас не так велика, и она будет полностью зависеть от размера партии в составе вероятных новых заказов, если до них вообще дойдёт дело. TSMC и без этого загружена заказами на выпуск чипов 5-нм класса, к которому относится и 4-нм техпроцесс, применяемый при производстве H20. Доля выручки TSMC от реализации 5-нм чипов держится на уроне около 35–36 % на протяжении примерно года, сейчас это самый востребованный класс техпроцессов среди клиентов тайваньского контрактного производителя. Более того, сохраняются проблемы с упаковкой чипов по методу CoWoS-S, который также используется при производстве ключевых компонентов для H20. Компании TSMC по-прежнему не хватает профильных мощностей для удовлетворения всего спроса. Она пытается наращивать производство, но делает это осторожно. Ситуация со спросом также непредсказуема. Проблема с H20 усугубляется тем, что за пределами Китая ускорители типа H20 никому особо не нужны, поскольку Nvidia там может легально предлагать куда более производительные решения. Если компания окажется с излишками таких ускорителей для Китая в результате падения спроса, это создаст ей новые проблемы. По этой причине Nvidia пока не готова размещать заказы на выпуск дополнительных партий H20. Тем более, что на китайском рынке уже могут появиться достойные конкуренты для этих ускорителей в лице того же Huawei Ascend 910C. По объёму памяти типа HBM3 он уже достигает паритета с H20, поскольку располагает 96 Гбайт соответствующей памяти. Если санкции США продолжат требовать от Nvidia снижения производительности своих ускорителей для рынка КНР, то спрос на них может сократиться. Для Nvidia, как считается, менее рискованной стратегией может оказаться выпуск решений, унифицированных с ускорителями для других рынков, типа модифицированных RTX Pro 6000, которые она собирается вывести на китайский рынок к сентябрю. Эта новинка довольствуется памятью типа GDDR7, которая уступает по быстродействию HBM3, но существенно дешевле. В случае, если такие ускорители просто не будут брать в Китае, компания сохранит возможность переориентировать их на другие географические направления. По мнению некоторых источников, H20 по данным причинам станет последним ускорителем для Китая, оснащаемым более дорогой памятью HBM. Впрочем, на китайском рынке есть игроки, которые всё же выиграют от возобновления поставок H20 в краткосрочной перспективе. Компания DeepSeek, как считается, затормозила разработку своей языковой модели R2 из-за нехватки ускорителей данной модели. Если поставки возобновятся, это будет способствовать более заметному прогрессу DeepSeek в обучении R2. Модель R1 предыдущего поколения полагалась главным образом на ускорители H20, коих было задействовано 30 000 штук, а ещё компанию им составили 10 000 ускорителей H800 и 10 000 ускорителей H100. Поставки двух последних были запрещены в Китай ранее. HBM скоро утратит статус «золотой жилы»: передовой памяти спрогнозировали падение цен

18.07.2025 [11:21],

Алексей Разин

Первые попытки найти применение памяти HBM в сегменте игровых видеокарт быстро уступили активному её использованию в ускорителях вычислений, и на фоне бума искусственного интеллекта цены на эту память только росли. Теперь же аналитики Goldman Sachs высказывают опасение, что в следующем году цены на HBM снизятся более чем на 10 процентов.

Источник изображения: SK hynix Именно в следующем году, по мнению аналитиков, предложение на рынке HBM в мировых масштабах наконец-то начнёт превышать спрос. Это будет способствовать тому, что средние цены реализации памяти данного семейства начнут снижаться. В ближайшее время рынок HBM снизит темпы роста с прежних 45 % в год до 25 %. В частности, по итогам текущего года его ёмкость ограничится $36 млрд, а в следующем вырастет только до $45 млрд вместо заложенных в прежний прогноз $51 млрд. По мнению аналитиков TrendForce, в следующем году средние цены реализации HBM всё же вырастут, поскольку на рынок выйдет более современная и дорогая HBM4. Снижение цен если и будет наблюдаться, то только в сегменте более дешёвых типов памяти. Специалисты Goldman Sachs добавляют, что два последовательных поколения ускорителей вычислений Nvidia будут использовать идентичный объём памяти, по 288 Гбайт HBM3E в случае с B300 и HBM4 в случае с Rubin соответственно. По этой причине общая потребность в микросхемах памяти подобного типа не будет заметно увеличиваться. Не исключено, что доля SK hynix на рынке HBM в следующем году начнёт сокращаться, поскольку по мере насыщения сегмента на него выйдут и конкурирующие компании, включая китайские. Последние уже к концу следующего года начнут выпускать HBM3. По крайней мере, позиции SK hynix на внутреннем рынке КНР из-за этого пошатнутся. Samsung со следующего года также сможет ежегодно увеличивать поставки HBM на 20 %. LG Electronics займётся выпуском оборудования для производства чипов

14.07.2025 [13:15],

Алексей Разин

Около половины мирового рынка передовой памяти HBM в настоящее время контролирует южнокорейская SK hynix, обгоняя своего более крупного конкурента — Samsung Electronics. Похоже, LG Electronics решила присоединиться к буму компонентов для систем ИИ на стороне поставщиков оборудования для производства чипов памяти, приступив к соответствующим разработкам.

Источник изображения: SK hynix Как поясняет издание SEDaily, корпоративный исследовательский институт в структуре LG Electronics без лишнего шума начал разработку оборудования для формирования гибридных соединений, которое пригодится при производстве микросхем HBM новых поколений. Ожидается, что соответствующее оборудование будет готово к 2028 году. Технология гибридного соединения позволяет создавать многоярусные микросхемы с относительно скромной высотой — она будет особенно востребована на фоне растущего спроса на более ёмкие чипы памяти типа HBM. Кроме того, этот метод способствует снижению тепловыделения и повышению производительности. Предполагается, что новая технология формирования межслойных соединений найдёт применение при создании микросхем HBM с числом слоёв более 12. В настоящее время производители памяти как раз разрабатывают методы выпуска 16-ярусных стеков HBM. LG Electronics сотрудничает при разработке профильного оборудования с ведущими южнокорейскими учёными. Сейчас оборудование для работы с технологией гибридного соединения поставляют лишь нидерландская BESI и американская Applied Materials. Если LG удастся создать конкурентоспособные аналоги внутри Южной Кореи, она сможет успешно продавать их местным производителям памяти. К 2028 году SK hynix планирует начать выпуск памяти HBM4E, а Samsung — приступить к опытному производству HBM4. Разработкой аналогичного оборудования также занимаются другие южнокорейские поставщики, поэтому конкуренция в этой области обещает быть жёсткой. Прибыль Samsung должна упасть впервые с 2023 года, причём сразу на 56 %

08.07.2025 [08:49],

Алексей Разин

Аналитики традиционно предвосхищают официальные заявления Samsung Electronics по поводу предварительных итогов минувшего фискального квартала, сама компания накануне призналась, что её операционная прибыль по итогам прошлого периода не превысит $3,3 млрд. Это соответствует снижению на 56 % в годовом сравнении, отрицательная динамика показателя будет в целом наблюдаться впервые с 2023 года.

Источник изображения: Samsung Electronics Эксперты в среднем рассчитывали на снижение операционной прибыли на 39–41 % до $4,57 млрд, поэтому собственные ожидания Samsung оказались даже более пессимистичными. Выручка компании, как она ожидает, по итогам прошлого квартала не превысила $54,1 млрд, тогда как аналитики рассчитывали на сумму в районе $55,2 млрд. Подробную отчётность за минувший квартал компания должна опубликовать ближе к концу текущего месяца. Принято считать, что неспособность Samsung сертифицировать свою память типа HBM3E для использования в составе ускорителей вычислений Nvidia серьёзным образом подрывает её финансовые показатели. Опрошенные Bloomberg аналитики считают, что полупроводниковый бизнес Samsung по итогам прошлого квартала получил операционную прибыль в размере $1,98 млрд. Это более чем в два раза превышает операционную прибыль подразделения в первом квартале, но в те же два с лишним раза меньше показателя годичной давности. Что характерно, представители Samsung такую динамику объяснили влиянием американских санкций, которые мешают ей поставлять передовые чипы памяти в Китай. В апреле руководство Samsung выражало надежду, что «ключевые клиенты» смогут приступить к массовым закупкам обновлённых чипов HBM3E со второго квартала, а к серийному производству HBM4 компания рассчитывала приступить в текущем полугодии. Даже в этой сфере Samsung приходится выступать в роли догоняющего, поскольку SK hynix уже начала отгружать клиентам образцы 12-ярусных стеков HBM4 ещё в прошлом полугодии, и к июню к ней присоединилась американская Micron Technology. Формально, Samsung снабжает своими чипами типа HBM3E компанию AMD, но доля последней на рынке ускорителей вычислений несопоставима с Nvidia, поэтому рассчитывать на серьёзный объём выручки в данной сфере деятельности корейский производитель памяти пока не может. Эксперты Bernstein ухудшили прогноз по занимаемой Samsung доле рынка памяти типа HBM, поскольку теперь ожидают, что сертификация HBM3E этой марки для нужд Nvidia состоится в текущем квартале, а не предыдущем. Как минимум до 2027 года включительно лидером будет оставаться SK hynix, но Samsung будет пытаться укреплять свои позиции. Текущий год SK hynix завершит с долей в 57 %, на втором месте уже окажется Samsung с 27 %, а Micron будет довольствоваться 16 % рынка HBM в целом. Во вторник утром акции Samsung упали в цене на 1,13 % после публикации неутешительного прогноза по операционной прибыли за прошлый квартал. Samsung стала на шаг ближе к HBM4 — компания готова к выпуску DRAM шестого поколения

02.07.2025 [12:11],

Павел Котов

Компания Samsung Electronics получила внутреннее подтверждение готовности к массовому производству оперативной памяти DRAM шестого поколения. Компания завершила процесс разработки передового техпроцесса 1c класса 10 нм, передаёт Korea Herald. Это приближает Samsung к выпуску памяти HBM4.

Источник изображения: samsung.com Ранее стало известно, что при тестировании техпроцесса 1c Samsung удалось добиться выхода годной продукции на уровне от 50 % до 70 %. Таким образом, корейский производитель укладывается в установленный им самим график смены поколений продукции примерно раз в два года. Он имеет особое значение для стратегии Samsung в области памяти с высокой пропускной способностью — запуск массового производства стеков HBM4 на базе DRAM шестого поколения запланирован на вторую половину этого года. В мае компания объявила, что в производстве HBM4 будет использовать технологию гибридного соединения — она помогает снизить тепловыделение, обеспечивая при этом высокую пропускную способность памяти. Она будет отвечать растущим требованиям, которые предъявляются к компонентам для ускорителей искусственного интеллекта и систем высокопроизводительных вычислений. В настоящее время доминирующая на рынке HBM компания SK hynix также ведёт разработку HBM4, но на базе DRAM пятого поколения. В марте она начала поставлять крупнейшим клиентам образцы HBM4 с расчётом запустить массовое производство этой памяти также во второй половине года. Samsung ещё предстоит получить одобрение своего варианта HBM4 от Nvidia, которая может обеспечить её заказами в больших объёмах; корейский производитель также ожидает одобрения 12-слойной HBM3E — здесь она рассчитывает на сотрудничество и с Nvidia, и с AMD. Выручка Micron от реализации HBM последовательно выросла на 50 %

26.06.2025 [07:39],

Алексей Разин

В конце мая в календаре Micron Technology завершился очередной фискальный квартал, итоги которого она смогла подвести только накануне, сообщив о росте выручки по итогам периода на 36 % в годовом сравнении до $9,3 млрд. Последовательно выручка от реализации HBM выросла почти на 50 %, что позволило компании порадовать инвесторов оптимистичным прогнозом на текущий квартал.

Источник изображения: Micron Technology Как отмечается в пресс-релизе Micron, в сегменте центров обработки данных выручка компании по итогам прошлого квартала более чем удвоилась и достигла рекордной величины. Строго говоря, совокупная выручка Micron от реализации DRAM в минувшем квартале достигла рекордной суммы во многом благодаря HBM и серверному сегменту в целом. Квартальная выручка в размере $9,3 млрд также превзошла ожидания рынка, находившиеся на отметке $8,87 млрд. Текущий квартал является последним в 2025 фискальном году для Micron, весь год компания рассчитывает завершить с рекордной выручкой и солидной прибылью. Соответственно, прогноз на четвёртый фискальный квартал оказался лучше ожиданий рынка, в него заложен диапазон выручки от $10,4 до $11 млрд, что выше упоминаемой сторонними аналитиками суммы ($9,89 млрд). Удельный доход на одну акцию в размере $2,5 также превышает ожидания рынка ($2,03). По словам представителей Micron, в прошлом квартале стремление клиентов закупить больше памяти в ожидании роста таможенных тарифов оказало на выручку компании минимальное влияние. Во второй половине календарного года Micron рассчитывает на хороший спрос. Кроме того, за этот период доля Micron на рынке HBM должна подтянуться к общим показателям, характерным для сегмента DRAM в целом. Сейчас Micron снабжает своими чипами HBM новейших поколений как Nvidia, так и AMD. Поскольку Samsung немного отстаёт от конкурентов в этой сфере, Micron сохраняет возможность укреплять свои позиции на перспективном рынке. Память HBM будущего потребует сквозного охлаждения и других прорывных технологий

12.06.2025 [13:13],

Алексей Разин

Производство многоярусной памяти HBM3E уже требует использование передовых технологий, оборудования и материалов, что подтверждается неспособностью Samsung наладить выпуск подобных чипов, удовлетворяющих высоким требованиям Nvidia. В дальнейшем HBM примерит не только погружное и сквозное охлаждение, но и перейдёт на более сложные методы упаковки, включая интеграцию на GPU.

Источник изображения: SK hynix Профессор Корейского института науки и передовых технологий (KAIST) Ким Чжон Хо (Kim Joungho), как отмечает The Elec, во время своего недавнего доклада описал возможные пути развития технологий производства памяти класса HBM. Уже в рамках HBM5 может быть предложен вариант охлаждения стека памяти методом погружения в диэлектрическую жидкость, поскольку сейчас «посредник» в виде металлического теплораспределителя не демонстрирует хорошего запаса по эффективности на будущее. Производители серверных систем погружное охлаждение невольно начали практиковать после того, как плотность теплового потока современных ускорителей вычислений заметно выросла. В целом, профессором Кимом предварительно разработана дорожная карта развития HBM на срок до 2040 года, когда на рынке уже будет предлагаться HBM8, хотя эти этапы всё равно являются приблизительными. Например, память поколения HBM7 уже будет предусматривать сквозное охлаждения стека памяти, когда охлаждающая жидкость будет циркулировать по микроканалам внутри самих микросхем и базового кристалла. Твердотельная память NAND со временем тоже станет многоярусной, как HBM. На определённом этапе базовый кристалл переедет из основания стека на его верхушку, а HBM8 наверняка позволит интегрировать стек памяти прямо на кристалл графического процессора. Технологии и материалы для производства стеков HBM также будут совершенствоваться. Например, HBM6 предложит использование стекла и кремния одновременно для создания подложки. Гибридные методы межслойного соединения будут внедрены уже в ближайшее время, а HBM5 предложит до 20 слоёв памяти в одном стеке. На рынок память типа HBM5 выйдет примерно к 2029 году. Intel и SoftBank намерены разработать более экономичную альтернативу памяти HBM

01.06.2025 [07:48],

Алексей Разин

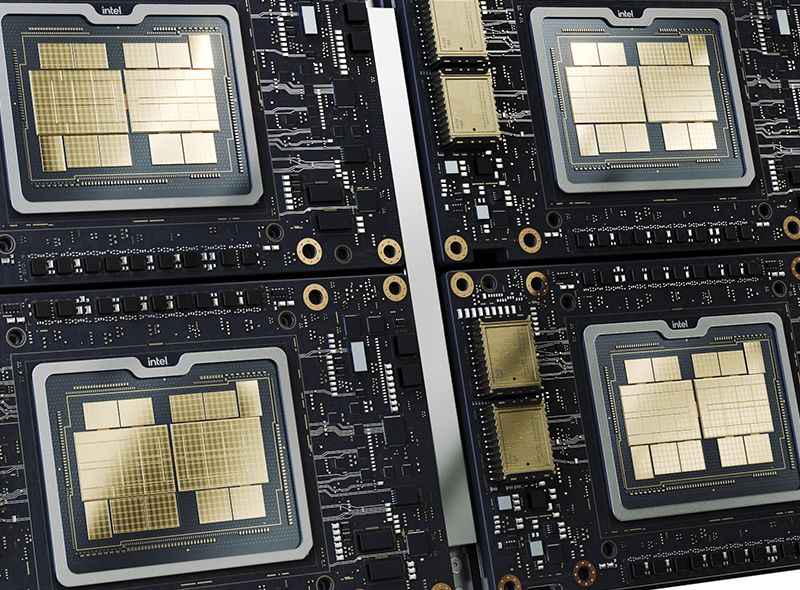

Вопрос снижения энергопотребления остро стоит для центров обработки данных, нацеленных на работу с системами искусственного интеллекта. Разработчики компонентов пытаются снизить энергозатраты не только со стороны процессоров, но и микросхем памяти. Одну из таких инициатив совместно продвигают Intel и японская SoftBank.

Источник изображения: Intel Последняя из компаний, напомним, не только является крупнейшим акционером британского холдинга Arm, разрабатывающего экономичные процессоры, но и пытается принимать участие в проектах по всему миру, связанных со строительством центров обработки данных. Например, в январе SoftBank заявила о своей причастности к реализации в США крупнейшего в истории проекта по развитию вычислительной инфраструктуры Stargate, который в течение нескольких лет потребует инвестиций на сумму около $500 млрд. По данным Nikkei Asian Review, компании SoftBank и Intel совместно работают над созданием многоярусной памяти с высокой пропускной способностью, которая за счёт своей инновационной структуры соединений снизит уровень энергопотребления по сравнению с нынешней HBM примерно в два раза. Курировать реализацию проекта будет специальной созданная компания Saimemory. Помимо технологий Intel, ей будет предоставлен доступ к разработкам некоторых японских университетов. Если прототип подобной памяти будет создан в течение двух лет, разработчики смогут оценить характеристики полученных микросхем и принять решение о подготовке к дальнейшему массовому производству. При удачном стечении обстоятельств выпуск такой памяти может быть налажен до конца текущего десятилетия. На разработку нового типа памяти участники проекта готовы потратить $70 млн. До 30 % этой суммы внесёт именно SoftBank, к ней могут присоединиться и другие японские компании. Saimemory сосредоточится на разработке памяти, но её выпуском займётся сторонняя компания. Японские власти могут предоставить целевые субсидии на реализацию этого проекта. До конца десятилетия они намерены вложить $700 млн в развитие национальной полупроводниковой отрасли и сферы искусственного интеллекта. SoftBank заинтересована в создании экономичной памяти для своих центров обработки данных. Новый тип памяти позволит экономить не только в процессе их эксплуатации, но и при строительстве. Если проект себя оправдает, то SoftBank получит приоритет в распределении готовой продукции. Участие японских компаний в разработке нового типа памяти при выводе его на рынок позволит им заработать на буме систем искусственного интеллекта. В период с 2023 по 2027 годы, по некоторым прогнозам, поставки оперативной памяти (DRAM) будут расти на 21 % в год в среднем из-за высоких темпов развития рынка ИИ. Ещё в 80-х годах прошлого века японские производители DRAM контролировали 70 % мирового рынка, но потом они уступили позиции южнокорейским конкурентам и американской Micron Technology, а последняя в 2013 году поглотила обанкротившуюся японскую Elpida Memory. Samsung первой внедрит гибридное соединение в память HBM4, пока её конкуренты осторожничают

15.05.2025 [06:24],

Анжелла Марина

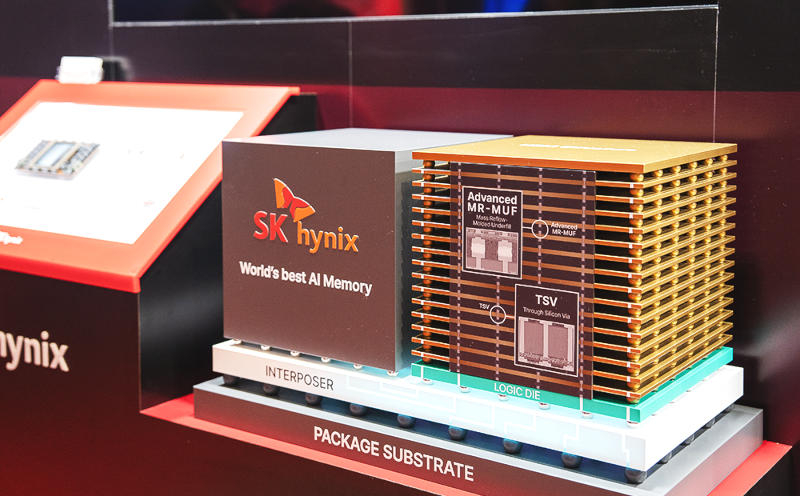

Samsung официально заявила, что будет использовать технологию гибридного соединения (hybrid bonding) при производстве памяти HBM4. Это позволит снизить тепловыделение, улучшить пропускную способность и обеспечить более плотные межсоединения между кристаллами памяти. В то же время её главный конкурент и лидер на рынке HBM SK hynix предпочитает не спешить, рассматривая гибридное соединение как резервную технологию.

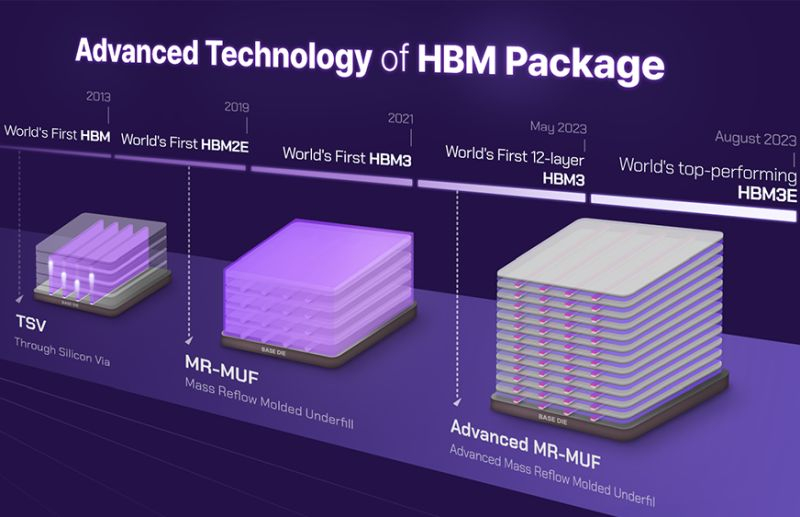

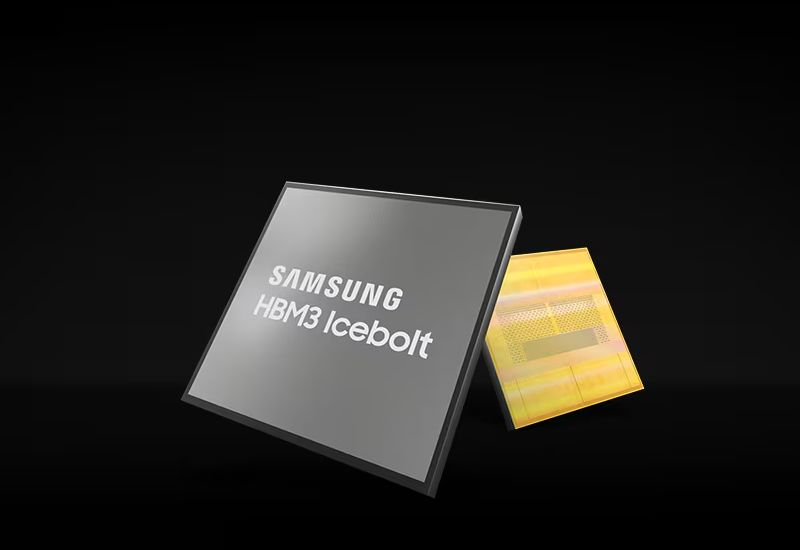

Источник изображения: AI Современная высокоскоростная HBM-память представляет собой вертикальный стек из нескольких слоёв DRAM, установленных на базовом кристалле. Сейчас эти слои соединяются с помощью микробампов — микроскопических контактных площадок, передающих сигналы и питание между кристаллами. Для соединения используются технологии типа MR-MUF или TC-NCF. Также внутри каждого кристалла проходят сквозные соединения TSV, обеспечивающие вертикальное взаимодействие. Однако, как пишет Tom's Hardware, по мере роста скорости и числа слоёв микробампы становятся ограничивающим фактором в производительности и энергоэффективности. Гибридное соединение решает эту проблему, позволяя напрямую соединять медные контактные площадки и оксидные слои кристаллов без использования микробампов. Такой подход позволяет достичь шага межсоединений менее 10 мкм, снизить сопротивление и ёмкость, увеличить плотность межсоединений и уменьшить толщину модуля. Но у технологии есть и два минуса — она значительно дороже традиционных методов и требует больше места на производственных линиях. Отметим, что на этапе разработки HBM3E вся троица крупнейших производителей — Micron, Samsung и SK hynix — рассматривали возможность применения гибридного соединения, но в итоге Micron и Samsung выбрали TC-NCF, а SK hynix продолжила использовать MR-MUF. Теперь Samsung первой решается на переход на гибридное соединение для HBM4, тогда как SK hynix продолжает дорабатывать MR-MUF, надеясь, что её новая технология позволит создавать более тонкие 16-слойные модули HBM4, соответствующие стандартам JEDEC (775 мкм), но без дорогостоящего переоснащения производства. Однако у Samsung есть определённое преимущество в виде собственной дочерней фирмы Semes, которая занимается выпуском производственного оборудования, что помогает снижать затраты на внедрение новых процессов. При этом пока неизвестно, готова ли Semes предоставить решения для массового производства HBM4 непосредственно с гибридным соединением. Если Samsung успешно сертифицирует HBM4 с гибридным соединением, компания получит значительное технологическое преимущество перед Micron и SK hynix, что, по мнению аналитиков, может изменить конкурентный ландшафт на рынке памяти. Массовое производство запланировано на 2026 год, и именно тогда Samsung сможет вернуть утраченные рыночные позиции благодаря превосходству в трёх ключевых аспектах: производительности, тепловыделении и плотности межсоединений. SK hynix получила разрешение местных властей на строительство предприятия по упаковке HBM в штате Индиана

10.05.2025 [08:33],

Алексей Разин

Южнокорейская компания SK hynix остаётся лидером рынка памяти типа HBM, которая востребована при производстве ускорителей вычислений. Строительство предприятия в США должно стать важным шагом по созданию в стране необходимой инфраструктуры для локализации производства подобных ускорителей. SK hynix недавно получила необходимое разрешение на строительство такого предприятия.

Источник изображения: SK hynix Напомним, что оно должно разместиться в городе Уэст-Лафайетт, штат Индиана. В начале этого месяца публичные слушания по данному проекту завершились, причём SK hynix по их итогам получила возможность расположить своё предприятие на более крупном участке земли, чем предполагалось изначально. Хотя доступного для строительства пространства стало больше, возникла потенциальная проблема, поскольку новый участок изначально отводился под жилую застройку, и его назначение теперь придётся менять и согласовывать. Теоретически, это способно замедлить строительство фабрики. Местные жители в ходе публичных слушаний выражали свою озабоченность способностью стройки негативно повлиять на окружающую среду, но муниципальные власти выделяли преимущества, приносимые проектом, вроде создания новых рабочих мест и инвестиций в размере $3,8 млрд, которые станут крупнейшими в истории города. Доступ к более крупному участку земли позволит SK hynix гибко реагировать на будущие изменения в спросе на память HBM, при необходимости наращивая объёмы производства за счёт строительства новых линий. Предприятие по упаковке памяти типа HBM должно быть построено и приступит к выпуску продукции во второй половине 2028 года. Прибыль Samsung в полупроводниковом секторе упала на 42 % из-за санкций и низких цен

30.04.2025 [06:46],

Алексей Разин

Долгожданный квартальный отчёт Samsung Electronics был опубликован только к концу апреля. Он позволил выявить, что несмотря на рост выручки на 10 % до рекордных $55,4 млрд, операционная прибыль компании выросла только на 1,5 % до $4,7 млрд. В сегменте полупроводниковых изделий операционная прибыль компании просела на 42 % до $770 млн, а выручка сократилась на 17 %.

Источник изображения: Samsung Electronics Цены на память хоть и оставались низкими, позволили руководству Samsung предположить, что они достигли дна и вернутся к росту. Выручка в полупроводниковом секторе выросла благодаря увеличению спроса на оперативную память для серверных систем, а также память типа NAND. Динамика средних цен реализации микросхем памяти, тем не менее, оказалась отрицательной. Кроме того, на прибыли подразделения сказались экспортные ограничения США в сфере поставок ускорителей вычислений для систем искусственного интеллекта. Samsung поставляет память типа HBM для таких ускорителей, поэтому любые ограничения в этой сфере сказываются на её бизнесе. В первом квартале выручка от реализации HBM сократилась. Данные факторы перевесили тенденцию к покупке чипов китайскими клиентами, создававшими запасы памяти в ожидании дальнейшего усиления санкций США. Не особо помогло Samsung и оживление спроса на память в сегменте ПК и смартфонов, которое наблюдалось в первом квартале. Впрочем, сегмент ПК просто наращивал темпы поставок продукции в ожидании введения повышенных таможенных тарифов в США, и этот фактор влияния нельзя назвать долгосрочным. В первом квартале Samsung также столкнулась с проявлением отложенного спроса на новейшую память HBM3E, поскольку клиенты целенаправленно ждали её появления на рынке. В текущем квартале компания рассчитывает на сохранение высокого спроса на память для ИИ-серверов, включая HBM. По прогнозам сторонних аналитиков, в текущем квартале Samsung начнёт наращивать объёмы поставок 12-ярусных стеков памяти типа HBM3E. Считается, что до трети всей выручки от реализации HBM компания Samsung получает на китайском направлении. В первом квартале Samsung увеличила расходы на разработки и исследования на 16 % до $6,3 млрд. Чистая прибыль компании выросла до $5,6 млрд, отчасти этому способствовала высокая популярность собственных смартфонов семейства Galaxy S25. Операционная прибыль мобильного подразделения Samsung по итогам первого квартала выросла на 23 % до рекордных за четыре года $3 млрд. От прогнозов на ближайшее будущее Samsung в сложившихся условиях неопределённости предпочитает воздерживаться, но на второе полугодие возлагает некоторые надежды на улучшение ситуации, хотя возможен и обратный эффект. Кроме того, во втором квартале благодаря паузе в применении повышенных тарифов будет сохраняться высокий спрос на полупроводниковую продукцию. На контрактном направлении полупроводниковый бизнес Samsung успехов в первом квартале не продемонстрировал, но в текущем квартале компания должна приступить к массовому производству 2-нм продукции. Остаётся выяснить, насколько это поможет привлечь клиентов, поскольку в случае с 3-нм техпроцессом подобное опережение по времени в преимущество над TSMC в денежных показателях не трансформировалось. SK hynix показала память HBM4 для ИИ-ускорителей следующего поколения

25.04.2025 [16:55],

Павел Котов

На Североамериканском технологическом симпозиуме, который проводит TSMC, компания SK hynix представила образцы памяти нового поколения HBM4 и новые продукты на основе актуальной HBM3E.

Источник изображений: skhynix.com С 12-слойными стеками памяти HBM4 производитель достиг скорости 2 Тбайт/с, что значительно превышает возможности HBM3E, у которой этот показатель составляет 1,2 Тбайт/с. SK hynix также показала образцы 16-слойной HBM3E. В марте корейская компания объявила, что первой в мире начала рассылать образцы HBM4 крупным клиентам, а подготовка к массовому производству памяти на основе новой технологии завершится во второй половине 2025 года. Под крупными клиентами, вероятно, подразумеваются Nvidia и AMD.  Если провести сравнение с игровым оборудованием, только один стек памяти HBM4 способен обеспечить более высокую пропускную способность, чем вся память видеокарты Nvidia GeForce RTX 5090, у которой 32 Гбайт GDDR7 с 1792 Гбайт/с или почти 1,8 Тбайт/с. Один стек HBM4 предлагает 2 Тбайт/с при ёмкости до 48 Гбайт. Но ускорители искусственного интеллекта обычно подключаются к нескольким стекам HBM одновременно, что позволяет им достигать скоростей, недоступных игровой графике. Так, один чип Nvidia B200 подключается к восьми HBM3E.  Рост выручки и прибыли SK hynix превзошёл ожидания аналитиков

24.04.2025 [05:09],

Алексей Разин

Как отмечалось накануне, аналитики ожидали от SK hynix роста квартальной выручки на 38 % и операционной прибыли на 129 %, но фактические объявленные этим южнокорейским производителем памяти показатели роста оказались выше. Выручка компании выросла в прошлом квартале на 42 %, а операционная прибыль увеличилась на 158 %.

Источник изображения: SK hynix В абсолютном измерении выручка SK hynix достигла $12,36 млрд, а операционная прибыль выросла до $5,2 млрд. В последовательном сравнении наблюдалась отрицательная динамика, но она в целом характерна для перехода от четвёртого квартала к первому. Выручка SK hynix последовательно снизилась на 11 %, а операционная прибыль просела на 8 % после того, как в четвёртом квартале был установлен рекорд по соответствующему финансовому показателю. Результаты первого квартала не стали рекордными, но они уступили лишь итогам четвёртого квартала прошлого года. Представители компании пояснили, что динамика прибыли в первом квартале отобразила её успехи в сфере реализации памяти для сегмента искусственного интеллекта. По мнению производителя, расходы участников рынка систем ИИ на развитие инфраструктуры продолжат расти, поскольку сохраняется спрос на создание «суверенных проектов» в этой сфере со стороны властей крупных стран. При этом в SK hynix подчёркивают, что геополитическая нестабильность создаст волатильность спроса во второй половине текущего года. Это не помешало компании сохранить свой прогноз по удвоению спроса на HBM по итогам всего 2025 года, поскольку соглашения на поставку соответствующей продукции в этом периоде были заключены ещё за год до этого. Развитие ИИ в сегменте смартфонов, по мнению руководства, подтолкнёт потребителей к обновлению своих устройств на содержащие более производительные чипы памяти. |