|

Опрос

|

реклама

Быстрый переход

В 2023 году Alphabet сэкономил $3,9 млрд, продлив срок службы серверов, но увеличил расходы на ИИ-инфраструктуру

03.02.2024 [23:45],

Владимир Мироненко

Холдинг Alphabet сообщил результаты работы в IV квартале и 2023 году, завершившемся 31 декабря. Выручка облачного подразделения Google Cloud составила около $9,2 млрд, увеличившись год к году на 25,66 %. Что примечательно, подразделение сработало с операционной прибылью в размере $864 млн, в то время годом ранее у него были убытки в $186 млн. Выручка всего Alphabet в IV квартале составила $86,31 млрд по сравнению с $76,048 млрд годом ранее. Выручка за весь 2023 год — $307,394 млрд, что значительно превышает результат 2022 года, равный $282,836 млрд. Чистая прибыль холдинга выросла в 2023 году до $73,795 млрд с $59,972 млрд годом ранее, отчасти благодаря решению компании продлить срок службы серверов и сетевого оборудования. Alphabet впервые продлил срок службы своего оборудования в 2021 году, увеличив продолжительность работы серверов с трёх до четырёх лет, а сетевого оборудования — с четырёх до пяти. В 2023 году Alphabet вновь продлил срок эксплуатации оборудования, на этот раз — до шести лет. Благодаря этому только в IV квартале 2023 года расходы компании на амортизацию оборудования упали на $983 млн, а чистая прибыль увеличилась на $765 млн. За весь год амортизация оборудования Alphabet снизилась на $3,9 млрд, а чистая прибыль увеличилась на $3 млрд. При этом компания вложила значительные средства в новую инфраструктуру. В IV квартале общие капитальные затраты составили $11 млрд, что, по словам президента и главного инвестиционного директора Alphabet и Google Рут Порат (Ruth Porat), было обусловлено «инвестициями в техническую инфраструктуру, причём самый крупный компонент — серверы, за которыми следуют ЦОД». В предыдущем квартале капзатраты составили $7,6 млрд. Резкое увеличение капзатрат обусловлено «перспективами создания уникальных приложений ИИ для пользователей, рекламодателей, разработчиков, облачных корпоративных клиентов и правительств во всем мире, а также возможностями долгосрочного роста, которые они предлагают». Порат добавила, что компания будет придерживаться этой политики и в 2024 году. «Мы ожидаем, что капитальные затраты в 2024 году будут значительно больше, чем в 2023 году», — отметила она. Порат также подчеркнула, что фактором роста Google Cloud Platform (GCP) является ИИ. Гендиректор Сундар Пичаи (Sundar Pichai) заявил, что компания продолжит инвестировать в инфраструктуру, как в ЦОД, так и в вычислительную технику, чтобы поддержать рост возможностей ИИ-технологий. Подразделение Google Cloud снова стало самым быстрорастущим сегментом. После значительного замедления роста с +28 % год к году во II квартале до +22 % в III квартале рост облака вновь ускорился до +26 %. Более того, в этот раз ускорение темпов роста было сильнее, чем у AWS и Azure. Рост доходов от облачных технологий вновь ускорился на 4 п. п. Также резко выросла операционная маржа Google Cloud — последовательно на 6 п.п. до 9 %. Компания объяснила замедление темпов роста в III квартале проведением оптимизации рабочей нагрузки. В ходе нынешнего отчёта Сундар Пичаи сообщил, что этот вопрос «в основном был проработан». Темпы роста Google Cloud по-прежнему опережают рынок: по оценкам Synergy Research Group, общемировой прирост рынка облаков составил +20 % в годовом исчислении до $74 млрд в IV квартале, ускорившись с 18 % в годовом исчислении в III квартале. Доминирует Amazon (31 % рынка), за ним следуют Microsoft (24 %) и Google (11 %). Большая тройка занимает 67 % рынка. Причём Microsoft и Google нарастили свои доли, а AWS — снизила. NVIDIA GeForce RTX 3050 с 6 Гбайт памяти оказалась на 20 % медленнее версии с 8 Гбайт

03.02.2024 [19:02],

Павел Котов

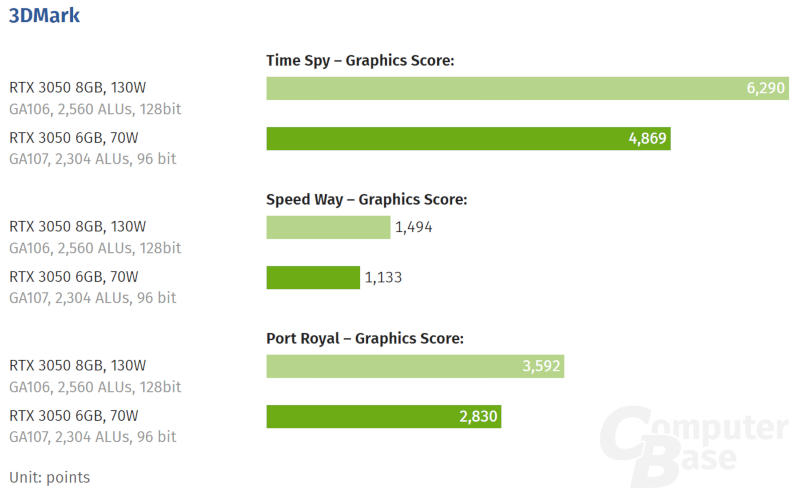

Анонсированная накануне видеокарта NVIDIA GeForce RTX 3050 с 6 Гбайт памяти помогла компании NVIDIA вернуться в сегмент ниже $200 и конкурировать с Intel Arc A580 и AMD Radeon RX 6600. Выяснилось, что новинка на 20 % медленнее модели с 8 Гбайт памяти.

Источник изображения: nvidia.com NVIDIA GeForce RTX 3050 с 6 Гбайт памяти оснащена графическим процессором GA107-325 с 2304 ядрами CUDA, что на 10 % меньше, чем у модели на 8 Гбайт. Кроме того, у этого графического процессора мощность составляет всего 70 Вт, что позволяет партнёрам NVIDIA выпускать видеокарты без разъёмов питания — она более чем на 40 % экономичнее версии с 8 Гбайт. Любопытно и сравнение видеокарт NVIDIA в категории менее $200:

Источник изображения: computerbase.de При таком сравнении новая версия NVIDIA GeForce RTX 3050 на 6 Гбайт представляется интересным вариантом. Её прямой предшественник, GeForce GT 1630 в сравнении с GTX 1650 имел меньше ядер, но стоил дороже — эта модель была призвана восстановить рынок видеокарт после криптовалютного бума. Новая имеет в 2,5 раза больше ядер, чем GeForce GTX 1650, и в 4,5 раза больше, чем GT 1630. Но и с GeForce RTX 3050 на 8 Гбайт путать её тоже не следует.

Источник изображения: computerbase.de В проведённых редакцией ресурса ComputerBase синтетических тестах видеокарта показала довольно неплохие результаты, если учесть сокращение мощности на 46 % по сравнению с 8-гигабайтной версией RTX 3050. В игровых тестах, пока проведённых только на примере Cyberpunk 2077, разрыв тоже составляет около 20 %. В ближайшее время ComputerBase планирует сравнить новую видеокарту с AMD Radeon RX 6600 и NVIDIA GeForce GTX 1650. В комплекте NVIDIA GeForce RTX 4080 Super нашли дефектный адаптер питания — он не защёлкивался, и это опасно

03.02.2024 [17:52],

Павел Котов

На обзор в редакцию сайта Igor's Lab поступила видеокарта NVIDIA GeForce RTX 4080 Super стороннего производителя, укомплектованная адаптером питания с дефектным разъёмом 12V2x6. Проблема, возможно, не носит массового характера, но владельцам видеокарт рекомендуется проявлять внимание к этому аспекту — кабель или адаптер должны подключаться с явным щелчком.  Журналисты Igor's Lab изучили проблему и установили, что в спецификации PCI-SIG не указаны точные размеры разъёма 12V2x6, что даёт производителям излишнюю свободу. Возможно, из-за этого адаптер питания, поставлявшийся в комплекте с видеокартой входил без характерного щелчка — по той же причине он относительно легко выходил из разъёма, поскольку фиксировался в нём недостаточно надёжно. Чтобы подтвердить гипотезу о браке, автор обзора позаимствовал адаптер, который шёл с видеокартой GeForce RTX 4080 Founders Edition производства самой NVIDIA, и было точно известно, что он работал. Бракованный компонент попробовали подключать к другим видеокартам GeForce RTX 40-й серии, и щелчка авторы добились примерно через 15–20 попыток. Впоследствии удалось разобраться, что было не так с этим экземпляром — покрытие на контактах. Обычно на контакты из чистой электролитической меди наносится слой никеля толщиной 2 мкм, а поверх него ещё и слой олова в 1,5 мкм. В данном случае никелевое покрытие оказалось намного толще, что не позволяло разъёму должным образом зафиксироваться. Это достаточно серьёзная проблема, которая могла привести к печальному исходу, если бы оставалась незамеченной в течение длительного времени. Любой кабель или адаптер, подключаемый к видеокарте с 12+4-контактным разъёмом, должен входить до характерного щелчка, означающего, что он зафиксировался на месте. Если щелчка нет, велика вероятность, что кабель или адаптер необходимо заменить. Oppo Find X7 на чипе Dimensity 9300 стал самым мощным Android-смартфоном января по версии Antutu

03.02.2024 [16:25],

Владимир Фетисов

В конце прошлого года на рынке появились смартфоны на флагманских однокристальных платформах нового поколения: Qualcomm Snapdragon 8 Gen 3 и MediaTek Dimensity 9300. Смартфоны на основе этих микропроцессоров не первый месяц борются за лидирующие позиции в рейтинге производительности Antutu, и в январе этого года ситуация не изменилась.

Источник изображения: Oppo Самым производительным Android-смартфоном месяца по версии Antutu стал Oppo Find X7 с чипом Dimensity 9300 (рабочая частота 3,25 ГГц). За обработку графики в нём отвечает ускоритель Immortalis-G720. Смартфон имеет в оснащении 6,82-дюймовый дисплей LTPO OLED с максимальной яркостью 4500 кд/м². Автономную работу обеспечивает аккумулятор на 5000 мА·ч с поддержкой быстрой зарядки мощностью до 100 Вт. По результатам тестирования модель с 16 Гбайт оперативной памяти и накопителем на 1 Тбайт в среднем набирала 2 209 832 балла. С небольшим отставанием от лидера на второй строчке рейтинга расположился iQOO 12 Pro с процессором Snapdragon 8 Gen 3. Он поучил от разработчиков 6,78-дюймовый дисплей AMOLED с пиковой яркостью 3000 кд/м², а также до 16 Гбайт ОЗУ и до 1 Тбайт ПЗУ. Источником питания служит батарея ёмкостью 5100 мА·ч с поддержкой проводной зарядки мощностью до 120 Вт и беспроводной — до 50 Вт. В ходе тестирования модель с 16 Гбайт ОЗУ и 1 Тбайт ПЗУ в среднем набирала 2 206 859 баллов.

Источник изображения: Antutu Замыкает тройку лидеров ASUS ROG 8 Pro с чипом Snapdragon 8 Gen 3. Смартфон имеет 6,78-дюймовый дисплей LTPO AMOLED с частотой обновления 165 Гц и пиковой яркостью 2500 кд/м². В максимальной комплектации он оснащён 24 Гбайт ОЗУ и 1 Тбайт ПЗУ. Именно такая модель использовалась в тестировании и в среднем ей удалось набрать 2 204 998 баллов. Отметим, что все три смартфона показали результаты, близкие друг к другу и разница между ними всего несколько тысяч баллов. В первую пятёрку также вошли Oppo Find X7 Ultra и iQOO 12. Любопытно, что в первой десятке рейтинга Antutu нет ни одного смартфона Xiaomi, хотя прежде устройства вендора, в том числе модели Redmi K-серии, регулярно оказывались среди самых производительных смартфонов на базе Android. Apple показала рекламу с первым знакомством с Vision Pro и инструкции по настройке гарнитуры

03.02.2024 [15:52],

Павел Котов

Компания Apple, накануне начавшая продажи гарнитуры виртуальной и дополненной реальности Vision Pro, опубликовала несколько видеороликов, посвящённых устройству: рекламу, показывающую знакомство с ним, а также несколько инструкций по настройке гаджета.

Источник изображения: apple.com Рекламный ролик подчёркивает простоту управления гарнитурой. «Apple Vision Pro очень проста в управлении глазами, руками и голосом. Как будто уже знаешь, как пользоваться ею», — уверяет голос за кадром. Судя по видео, управлять Vision Pro действительно несложно: достаточно указывать глазами на нужные значки приложений или пункты меню и выбирать их едва заметным движением пальцев. Доступны и другие, интуитивно простые жестовые команды. Канал поддержки Apple на YouTube также опубликовал серию роликов с обзорами приложения «Настройки», «Центра управления», режима гостевого доступа Vision Pro, доступных на гарнитуре специальных возможностей и других функций платформы VisionOS. Компания рассказала, как подключается кабель питания, как устанавливаются диоптрийные линзы и как лучше снимать пространственное видео на iPhone. Пока Apple Vision Pro продаётся лишь в США, но до конца года поступит в продажу и в других странах. Марк Цукерберг стал богаче Билла Гейтса после отличного отчёта Meta✴ — он получил $28 млрд за день

03.02.2024 [14:50],

Владимир Мироненко

После последнего квартального отчёта акции Meta✴✴ взметнулись в цене на 22 %, благодаря чему её глава Марк Цукерберг (Mark Zuckerberg) стал богаче на $28 млрд, и теперь его состояние больше, чему у мультимиллиардера, соучредителя Microsoft Билла Гейтса (Bill Gates).

Источник изображения: Mark Zuckerberg В настоящее время активы Цукерберг оцениваются в $165 млрд. Столь большого состояния у него не было никогда прежде. Наивысшей отметки состояние главы Meta✴✴ достигло в 2021 году, составив согласно индексу Bloomberg Billionaires Index примерно $142 млрд. Однако последовавшее за этим падение рынка отразилось на Meta✴✴ сильнее чем на других. На самом низком уровне в октябре и ноябре 2022 года акции Meta✴✴ стоили $90 за штуку, а стоимость активов Цукерберга составляла $36 млрд — всего лишь четверть его рекордного состояния за всё время. Когда компания впервые выплатит дивиденды в марте этого года, Цукерберг получит $174 млн наличными. Ему принадлежит около 350 млн акций класса A и B, которые дают право на получение дивидендов. Цукерберг будет зарабатывать более $690 млн в год, если Meta✴✴ сохранит квартальные дивиденды в размере $0,5 на акцию. В отчёте за IV квартал 2023 года Meta✴✴ сообщила о росте всех ключевых показателей, отслеживаемых Уолл-стрит, и увеличении чистой прибыли более чем в три раза год к году. Сейчас рыночная стоимость компании составляет $1,2 трлн. Учёные создали «неубиваемый» кубит с естественной способностью к исправлению ошибок вычислений

03.02.2024 [14:38],

Геннадий Детинич

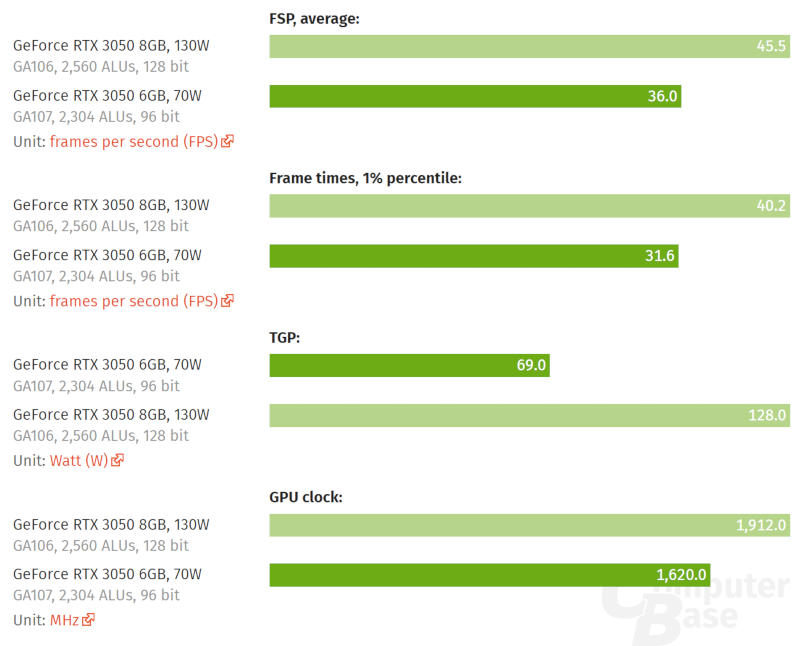

Квантовая неопределённость обещает взвинтить производительность компьютеров и одновременно убивает вычисления своей чувствительностью к малейшим возмущениям среды. Для безошибочных квантовых расчётов необходимо тысячу физических кубитов представить одним-единственным логическим кубитом. Ничем иным как расточительством такое не назовёшь. Это проблема, решить которою пообещали немецкие, чешские и японские учёные.

Учёные сделали из фотонов «кошку Шрёдингера». Источник изображения: Peter van Loock Традиционный метод предполагает создание отдельных кубитов — сверхпроводящих, из холодных нейтральных атомов, фотонов или в другом виде — и последующее их запутывание друг с другом. Только запутывание кубитов позволяет запускать на них квантовые алгоритмы и получать результат без ошибок при соблюдении всех необходимых условий. Учёные из университетов Майнца (Германия), Оломоуца (Чехия) и Токио (Япония) предложили элегантное решение, которое реализует три возможности в одном: объединили несколько фотонов в одном коротком световом импульсе с присущей системе врождённой способностью исправлять ошибки. «Хотя система состоит только из лазерного импульса и, следовательно, очень мала, она может — в принципе — немедленно устранять ошибки. Таким образом, нет необходимости генерировать отдельные фотоны в виде кубитов с помощью многочисленных световых импульсов, а затем заставлять их взаимодействовать как логические кубиты, — заявил профессор Питер ван Лоок (Peter van Loock) из Майнцского университета. — Наш лазерный импульс был преобразован в квантово-оптическое состояние, что даёт нам врожденную способность исправлять ошибки». Фактически речь идёт о создании импульса из нескольких запутанных фотонов (все они описываются одной волновой функцией). С одной стороны, это всё же пакет элементарных частиц, который можно представить как объединение нескольких физических кубитов в один логический. Но с другой стороны, это достаточно малый объект, если так можно сказать о коротком импульсе, который может рассматриваться как один единственный кубит одновременно физический и логический с функцией коррекции ошибок, что может существенно упростить создание безошибочных универсальных квантовых вычислителей. Наконец, в отличие от криогенных платформ IBM и Google на сверхпроводящих кубитах, оптические кубиты позволяют работать в условиях комнатной температуры, а это важнейший момент для широкой коммерциализации квантовых платформ. Беспилотные авто Apple намотали в 2023 году в четыре раза больше километров, чем годом ранее

03.02.2024 [13:46],

Владимир Фетисов

Проекту Apple Secretive Vehicle по созданию беспилотных авто оказалось нечем похвастаться спустя шесть лет работы, по крайней мере публично. Однако отчёты, которые компания представила в надзорный орган, указывают на то, что в прошлом году Apple существенно нарастила темпы тестирования автономного транспорта. Расстояние, пройденное по дорогам общего пользования, увеличилось в четыре раза по сравнению с 2022 годом и более чем в 30 раз по сравнению с 2021 годом.

Источник изображения: macreports.com Данные в отчёте Apple охватывают период с декабря 2022 года по ноябрь 2023 года. Наиболее активно тестирование проходило во второй половине года, а пик пришёлся на август, когда беспилотные авто Apple проехали суммарно 135 тыс. км. Напомним, у компании есть разрешение на тестирования автономных транспортных средств на дорогах общего пользования Калифорнии, но при этом в салоне должен обязательно находиться водитель, готовый взять на себя управление в случае возникновения нештатной ситуации. Некоторые другие компании, такие как Waymo (принадлежит Alphabet) и Zoox (принадлежит Amazon), имеют разрешение штата на проведение испытаний беспилотных авто на дорогах общего пользования без водителя в салоне. Кроме того, компании Waymo и занимающаяся доставкой Nuro уже получили разрешение на коммерческое использование беспилотных авто в Калифорнии. На данный момент автономные транспортные средства Apple проехали значительно меньше, чем машины более развитых в этом сегменте разработчиков. К примеру, авто Waymo преодолели в Калифорнии около 6 млн км с водителем, около 3 млн км без водителя и более 2,5 млн км с пассажирами. Waymo также запустила сервис беспилотных такси в Фениксе и проводит тестирование в техасском Остине. Учёные впервые напечатали на 3D-принтере живые ткани человеческого мозга

03.02.2024 [12:39],

Геннадий Детинич

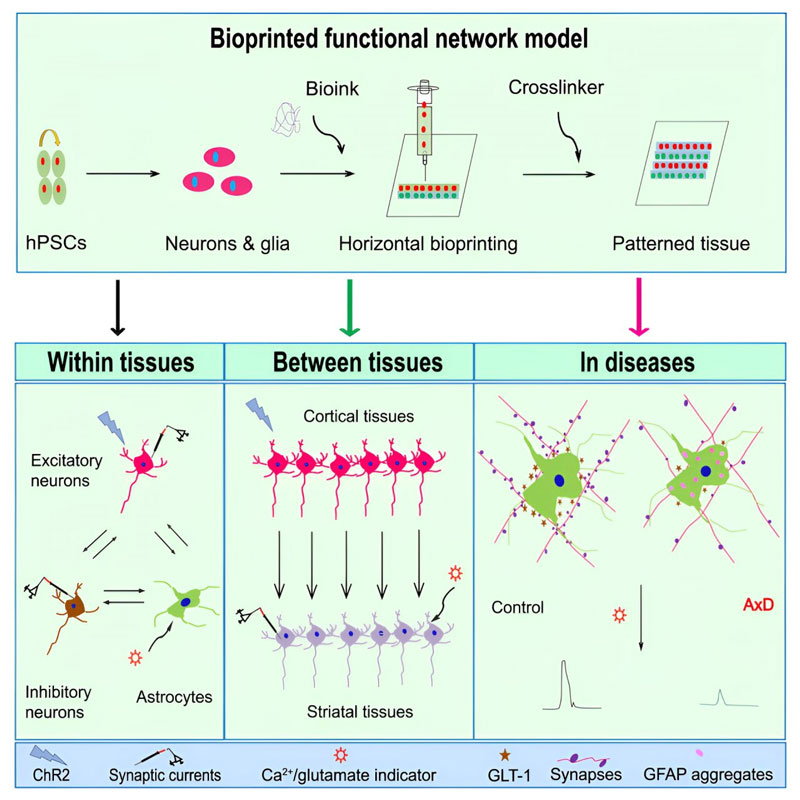

Учёные из Висконсинского университета в Мадисоне (США) сообщили о первой в мире 3D-печати функциональных тканей человеческого мозга. Разработка поможет в изучении работы мозга и его отдельных структур, а также в поисках методов лечения неврологических расстройств и болезней. Как указали учёные в статье в журнале Cell Stem Cell, напечатанная ими ткань смогла «расти и функционировать как обычная ткань мозга».

Источник изображения: ИИ-генерация Кандинский 3.0/3DNews «Это может стать чрезвычайно мощной моделью, которая поможет нам понять, как у людей взаимодействуют клетки и части мозга, — сказал Су–Чун Чжан (Su-Chun Zhang), профессор неврологии в Центре Вайсмана Калифорнийского университета в Мадисоне. — Это может изменить наш взгляд на биологию стволовых клеток, неврологию и патогенез многих неврологических и психических расстройств». Учёные подчёркивают, что в отличие от набирающего популярность способа выращивания так называемых органоидов — своего рода миниатюрных копий настоящих органов человека из соответствующих клеток — 3D-печатный способ обеспечивает достаточную точность, чтобы контролировать типы клеток и их расположение. В подтверждение своих слов учёные напечатали кортикальные ткани и ткани полосатого тела. Нейроны начали образовывать связи в обоих типах тканей и между ними, а также показали признаки активности на уровне работы нейромедиаторов. Через синаптический зазор между одним нейроном и другим сигнал передаётся химическим путём с использованием, в том числе нейромедиаторов. Всё это ожило и заработало в тканях, напечатанных на 3D-принтере.

Источник изображения: Cell Stem Cell Учёные рассказали, что тонкость в предложенном ими процессе печати заключается в использовании биочернил — связующего клетки геля — такой плотности, которая уже не позволяет ткани растекаться и, в то же время, обеспечивает нейронам и их отросткам свободный рост внутри состава. Также предложенный метод делает упор на горизонтальную печать, а не на вертикальную. Тонкие слои нервной ткани в таком случае лучше снабжаются кислородом и питательными веществами. «Мы напечатали кору головного мозга и полосатое тело, и то, что мы обнаружили, было весьма поразительным. Даже когда мы печатали разные клетки, принадлежащие к разным частям мозга, они все равно могли связываться друг с другом совершенно особым образом», — заявил профессор Чжан в пресс-релизе. Китайская Geely запустила 11 спутников для точной навигации беспилотных авто

03.02.2024 [11:53],

Владимир Фетисов

Китайский автопроизводитель Geely заявил об успешном выведении на низкую околоземную орбиту 11 спутников, предназначенных для обеспечения точной навигации её автономных транспортных средств. План компании состоит в том, чтобы к 2025 году нарастить численность своей спутниковой группировки до 72 аппаратов, а всего в неё должный войти 240 спутников.

Источник изображения: hdpic.club Нынешний пуск стал для Geely вторым и был выполнен с площадки космодрома Сичан, который находится в юго-западной китайской провинции Сычуань. До этого спутники Geely выводились на низкую околоземную орбиту в июне 2022 года. Согласно имеющимся данным, помимо обеспечения поддержки высокоточного позиционирования беспилотных автомобилей спутниковая группировка Geely будет задействована для выполнения ряда других коммерческих функций, таких как обеспечение связи в секторе бытовой электроники. Кроме того, спутники могут использоваться для дистанционного зондирования Земли с использование ИИ-алгоритмов. В спутниковых сетях Китая по-прежнему доминируют военные, но с 2014 года правительство Поднебесной разрешило частные инвестиции в космическую отрасль. С тех пор в этот сектор устремились коммерческие компании, некоторые из которых поддерживаются местными властями. Основная часть коммерческих компаний сосредоточилась на производстве спутников, тогда как некоторые из них разрабатывают небольшие ракеты-носители, в том числе многоразовые. По данным источника, в распоряжении Китая более 400 спутников, включая аппараты коммерческих компаний. Apple Vision Pro оказалась на удивление прочной, но с высоты её лучше не ронять

03.02.2024 [11:18],

Павел Котов

Гарнитура Apple Vision Pro поступила в продажу лишь накануне, но ей уже успели устроить жёсткие испытания на прочность. Как выяснилось, устройство имеет достаточно крепкую конструкцию, и нужно постараться, чтобы вывести его из строя.

Источник изображения: youtube.com/@AppleTrack Стресс-тест Apple Vision Pro устроили авторы YouTube-канала AppleTrack. На первом этапе испытатель надел гарнитуру и стал ходить по дому, намеренно врезаясь в двери и стены. Устройство выдержало все удары, сохранив работоспособность и получив лишь незначительные царапины. На практике средний пользователь скорее поранится или получит сотрясение мозга из-за удара о стену, чем Vision Pro придёт в нерабочее состояние. Самым слабым элементом конструкции оказался уплотнитель, который удерживает на гарнитуре магнитное крепление — оно достаточно ненадёжное. Категорически не рекомендуется пытаться поднять и унести устройство, удерживая его за этот уплотнитель. Он легко отсоединяется, и Apple Vision Pro летит на пол. Впрочем, и падение на пол с небольшой высоты гарнитуре тоже не страшно: она оставалась преимущественно целой и работоспособной, хотя после нескольких падений частично надорвался ремешок, и правый динамик вышел из строя. Значительные повреждения устройству удалось нанести лишь с восьмой попытки, когда его сбросили на твёрдую поверхность с высоты, значительно превышающей человеческий рост. Защитное стекло на внешнем экране Apple Vision Pro разбилось, но не разлетелось осколками по всему помещению, а покрылось трещинами. Примечательно, что и внутренние, и внешний дисплей EyeSight продолжили работать, хотя запас прочности последнего к этому моменту, видимо, исчерпался, поскольку защитное стекло пришлось отделить. С 1 апреля в Китае можно будет купить аэротакси всего за $333 тысячи и это не шутка

03.02.2024 [10:56],

Геннадий Детинич

Китайская компания eHang объявила о скором начале продаж двухместных аэротакси EH 216-S по рекомендованной цене 2,39 млн юаней ($333 тыс.). Пока другие компании показывают цифровые картинки своих моделей, китайцы начинают поднимать в небо малый электрический флот.

Источник изображения: eHang Первая массовая модель электролёта eHang — EH 216-S — способна перенести по воздуху двух пассажиров общей массой до 240 кг на 30 км со скоростью до 130 км/ч. Заряда аккумуляторов в среднем хватает примерно на 20 мин полёта. Фактически — это воздушный мопед в зарождающемся мире малой городской авиамобильности. Китайскому изделию далеко до изящных форм, цен и грузоподъёмности четырёхместных машин Archer или Lilium, которые, впрочем, выйдут на коммерческие линии через год, два или позже. Но у eHang есть неоспоримое преимущество — это начало массового производства и приобретения опыта эксплуатации. Можно не сомневаться, что все будущие игроки этого сектора будут перенимать у неё опыт. Сертификат типа для запуска электролёта EH 216-S в производство компания eHang получила летом прошлого года. В декабре был получен сертификат лётной годности. Тогда же компания начала поставку электролётов корпоративным клиентам. Первой областью эксплуатации аэротакси станут туристические маршруты. Продажа в розницу, если так можно сказать, стартует в Китае 1 апреля 2024 года. Обычный человек вряд ли сможет уже через два месяца стать владельцем аэротакси EH 216-S. Для полётов, судя по всему, потребуется координация с диспетчерскими центрами. Дальше пойдёт создание инфраструктуры и встройка нового вида транспорта в повседневную жизнь. Будет интересно за всем этим следить. Отчётность азиатских компаний на следующей неделе будет определять динамику фондового рынка

03.02.2024 [07:02],

Алексей Разин

Довольно плотная с точки зрения публикации квартальных отчётов западными техногигантами пятница ещё не ставит точку в череде выхода финансовой статистики, поскольку на следующей неделе будут отчитываться крупные азиатские эмитенты типа Alibaba, SoftBank и SMIC. Во многом опубликованные ими отчёты будут определять дальнейшую динамику фондового рынка в целом.

Источник изображения: SMIC Инвесторы, по мнению Bloomberg, в отчётности гиганта интернет-торговли Alibaba будут искать сигналы, указывающие на возможность восстановления спроса в китайской рознице после кризиса, вызванного пандемией. Кроме того, китайская корпорация переживает реструктуризацию, которая также способна влиять на её финансовые результаты. Облачный бизнес Alibaba Cloud станет объектом пристального внимания тех инвесторов, которые делают ставку на развитие систем искусственного интеллекта. Если в сегменте интернет-торговли выручка Alibaba должна вырасти на 5,5 %, то логистический бизнес Cainiao должен прибавить все 55 %, по мнению аналитиков. Японская корпорация SoftBank, как ожидается, должна вернуться к прибыльности после четырёх последовательных убыточных кварталов. По мнению аналитиков Citi, инвестиционный портфель SoftBank составлен таким образом, что входящие в него публичные компании к концу прошлого квартала должны были преимущественно избавиться от убытков. Появлению у SoftBank прибыли должна была способствовать и сделка по продаже акций T-Mobile US. От крупнейшего в Китае контрактного производителя чипов SMIC аналитики ожидают снижения операционной прибыли на 80 %, причём подобная динамика наблюдается уже пятый квартал подряд. Слабость рынка смартфонов и потребительской электроники бьёт по доходам компании, а усугубляют ситуацию западные санкции. Инвесторы будут внимательно следить за данными о капитальных затратах SMIC в текущем году и ценовой стратегией, поскольку ранее уже обсуждались слухи о намерениях китайского производителя приступить к привлечению клиентов из-за пределов Китая за счёт гибкой ценовой политики. Капитализация NVIDIA рекордно выросла в январе почти на $300 млрд

03.02.2024 [06:45],

Алексей Разин

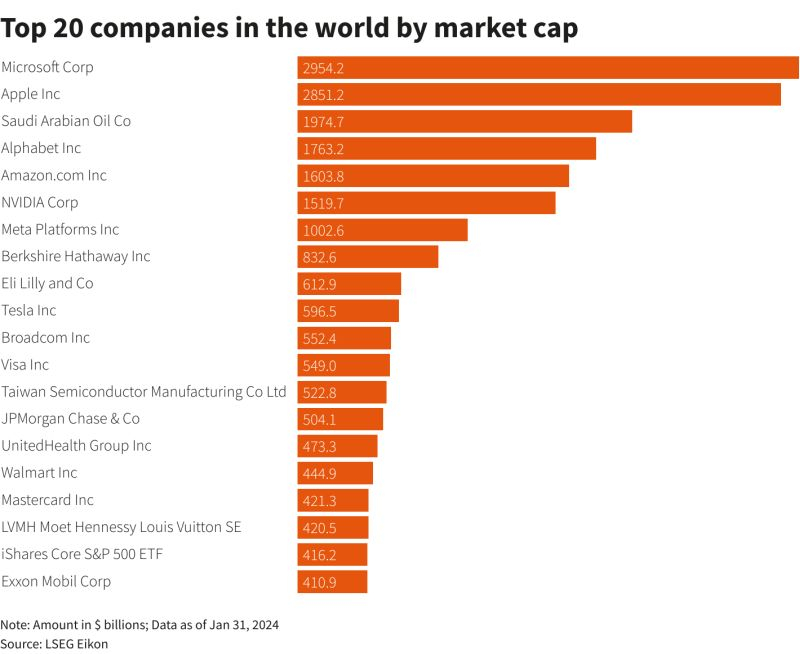

С начала этого года акции NVIDIA успели укрепиться на треть, поскольку череда отчётов компаний технологического сектора убедила инвесторов в важности развития сферы искусственного интеллекта, крупнейшим поставщиком ускорителей для которых она является. Только в январе капитализация NVIDIA выросла на рекордные $297 млрд и теперь превышает $1,5 трлн.

Источник изображения: NVIDIA Как поясняет Reuters, предыдущим месяцем рекордного роста капитализации для NVIDIA был май прошлого года, когда данный показатель вырос на $248 млрд. Январские анонсы новых видеокарт и ускорителей для систем искусственного интеллекта придали акциям NVIDIA новый импульс, и месяц они завершили на отметке $615 за штуку, но уже к настоящему моменту успели вырасти в цене до $662. По сути, данный прогресс позволил компании стать шестой в мире по величине капитализации и предпоследней в списке эмитентов, у кого этот показатель превышает $1 трлн. По состоянию на конец января «великолепную семёрку» замыкает Meta✴✴ Platforms, но недавние движения котировок ещё способны поменять расстановку сил в более высоких эшелонах.

Источник изображения: Reuters Microsoft в январе удалось нарастить капитализацию на $159,36 млрд почти до $3 трлн, став крупнейшей компанией в мире по данному критерию. Apple после вчерашних разочаровывающих для инвесторов новостей откатилась ниже от январской величины капитализации $2,85 трлн. По сути, среди семи крупнейших компаний мира по величине капитализации присутствует лишь один представитель энергетического сектора, и это Saudi Arabian Oil Co, которая занимает третье место с капитализацией чуть менее $2 трлн. Alphabet и Amazon занимают четвёртое и пятое места соответственно, но разрыв между ними не так велик, а потому не исключена рокировка в будущем. Кстати, замыкает десятку самых дорогих компаний в мире Tesla, обладание крупным пакетом акций которой сделало Илона Маска (Elon Musk) самым богатым человеком в мире. У прочих эмитентов в списке степень концентрации капитала в частных руках не так велика, чтобы у этого миллиардера появлялись новые конкуренты. SK hynix запустит массовое производство памяти HBM4 в 2026 году

02.02.2024 [23:18],

Николай Хижняк

Южнокорейская компания SK hynix объявила, что приступит к массовому производству оперативной памяти с высокой пропускной способностью следующего поколения — HBM4 — к 2026 году. Ранее компания сообщила, что начнёт разработку HBM4 уже в этом году.

Источник изображения: Wccftech До этого момента о планах по разработке и внедрению памяти HBM4 высказывались только компании Micron и Samsung. Оба производителя планируют выпустить новое поколение памяти где-то в 2025–2026 годах. Теперь и SK hynix более точно определилась с планом по своему будущему продукту. Со стремительным развитием ИИ-технологий на рынке возрастает спрос на более высокопроизводительные решения, необходимые для решения этих задач. Память типа HBM сыграла значительную роль в развитии этой сферы и является важным компонентом в производстве передовых специализированных ускорителей ИИ-вычислений. И на данный момент SK hynix является главным поставщиком самой скоростной HBM — памяти HBM3E — для ИИ-ускорителей. На мероприятии SEMICON Korea 2024 вице-президент SK hynix Ким Чун Хван (Kim Chun-hwan) сообщил о намерении компании начать массовое производство памяти HBM4 к 2026 году. Он добавил, что новое поколение памяти будет способствовать стремительному росту рынка устройств для искусственного интеллекта. В то же время он отметил, что индустрия производства памяти HBM сталкивается с огромным спросом. Поэтому компании очень важно создать решения, которые позволили бы обеспечить бесперебойную поставку такого типа памяти. По мнению топ-менеджера SK hynix, к 2025 году рынок памяти HBM вырастет до 40 %, поэтому компании необходимо заранее подготовился к тому, чтобы извлечь из этого максимальную выгоду. Согласно недавно опубликованной аналитиками TrendForce сборной диаграммы с планами по выпуску продуктов различных производителей, организация JEDEC планирует принять окончательные характеристики памяти HBM4 во второй половине 2024 или начале 2025 года. Пока известно, что новая память будет выпускаться в стеках объёмом до 36 Гбайт, а первые образцы ожидаются в 2026 году. На данный момент неизвестно, какие именно ИИ-ускорители будут использовать новый тип памяти. Предполагается, что одними из первых таких продуктов могут стать решения NVIDIA, которые компания выпустит после специализированных ИИ-ускорителей Blackwell, поскольку последние будут использовать память HBM3E. Tesla «отзовёт» более 2 млн электромобилей из-за слишком маленького шрифта на приборной панели

02.02.2024 [22:59],

Николай Хижняк

Компания Tesla была вынуждена инициировать очередной массовый отзыв своих электромобилей. Согласно выводам комиссии Национального управления безопасностью движения на трассах США (NHTSA), размер шрифта на некоторых сигнальных лампах на приборной панели автомобилей оказался слишком мал и не соответствует требованиям федеральных норм. В результате компанию обязали отозвать почти 2,2 млн электромобилей или почти каждую Tesla, проданную в США.

Источник изображения: Engadget К счастью для компании и самих владельцев электромобилей Tesla, машины не придётся отправлять обратно в дилерские центры или авторизованные центры ремонта. Проблема может быть решена обычным обновлением прошивки «по воздуху». В NHTSA пояснили, что обнаружили проблему во время плановой проверки соблюдения требований безопасности электромобилей Tesla в прошлом месяце. В ходе проверки выяснилось, что шрифт на сигнальных лампах тормозной системы, стояночного тормоза и антиблокировочной системы оказался меньше, чем требуют федеральные законы США. Ведомство пояснило, что маленький шрифт может затруднить чтение информации водителем, что может увеличить вероятность аварии. Указанной проблеме оказались подвержены электромобили Model S, выпускавшиеся с 2012 по 2023 годы, Model X (2016–2023), Model 3 (2017–2023), Model Y (2019–2024), а также новейший пикап Cybertruck. Компании неизвестны случаи аварий или полученных водителями или пешеходами травм, связанных с этой проблемой, однако в компанию обратились три владельца Tesla по гарантийным обязательствам, которые могут быть связаны с обсуждаемым вопросом. В декабре Tesla пришлось отозвать значительное количество своих электромобилей в связи с проблемами с системой автопилота. Эту проблему также удалось решить с помощью OTA-обновления. После этого компания столкнулась с проблемой неработающих задних камер на своих электромобилях, которой оказались подвержены около 200 тыс. машин. Тем временем NHTSA расширило расследование в отношении потенциальных проблем с рулевыми колонками электромобилей Tesla. Под расследование попали более 334 тыс. электрокаров, которые ведомство также потенциально может обязать отозвать. NHTSA начало расследование в июле прошлого года после получения 12 сообщений о потере водителями рулевого управления в электромобилях Model Y и Model 3 2023 года выпуска. С тех пор агентство получило 115 жалоб от потребителей, связанных с этой проблемой, а затем ещё 2176 жалоб от Tesla после запроса информации от автопроизводителя. Одна из жалоб оказалась связана с аварией. Китай стал ближе к настоящему «гиперлупу» — левитирующий поезд достиг рекордной скорости в вакуумной трубе

02.02.2024 [22:24],

Геннадий Детинич

Китайские СМИ сообщили, что прототип поезда на магнитной подушке разогнался в трубе с вакуумом до рекордной скорости, преодолев опытный участок длиной 2 км со стабильной левитацией. В перспективе проект предусматривает движение поездов на магнитной подвеске со скоростью до 1000 км/ч — быстрее, чем гражданские самолёты.

Источник изображения: CCTV Разработкой проекта занимается отделение Китайской корпорации аэрокосмической науки и промышленности (CASIC). В будущем проекте возникнет сплав военных и гражданских технологий от высокотемпературных сверхпроводящих магнитов до электроники. Более того, даже к бетонным конструкциям — тоннелям и эстакадам — будут предъявляться заоблачные по современным меркам требования. Например, отклонение в размерах труб должно быть не более 2 мм при длине секции 21 м и внутреннем диаметре 6 м. А допустимая неровность направляющего рельса не должна превышать 0,3 мм. Поэтому так важна опытная часть проекта, созданная на 2-км участке в Датуне, провинции Шаньси. Многие вещи невозможно рассчитать, не испытав прототипы как трубы, так и поезда. В CASIC, кстати, не стали озвучивать поставленный рекорд в скорости движения левитирующего поезда в трубе. По некоторым намёкам она может превышать 600 км/ч, но это не точно. О чём сообщалось наверняка, в один из первых испытательных прогонов (но, похоже, ещё без состояния низкого вакуума в тоннеле) прототип двигался со скоростью 50 км/ч. Пожалуй, сегодня в мире нет достижений, близких к этому проекту. «Гиперлуп» Ричарда Брэнсона (Richard Branson) в лице компании Hyperloop One обанкротился и сошёл с дистанции. Похожая по целям компания The Boring Company Илона Маска движется в некоем ином направлении. Есть ещё ряд европейских проектов, но о них мало что слышно и уж точно они не могут похвастаться созданием масштабных прототипов вакуумных транспортных тоннелей. Самая глубокая подземная лаборатория для поиска тёмной материи кратно повысила чувствительность детекторов

02.02.2024 [21:10],

Геннадий Детинич

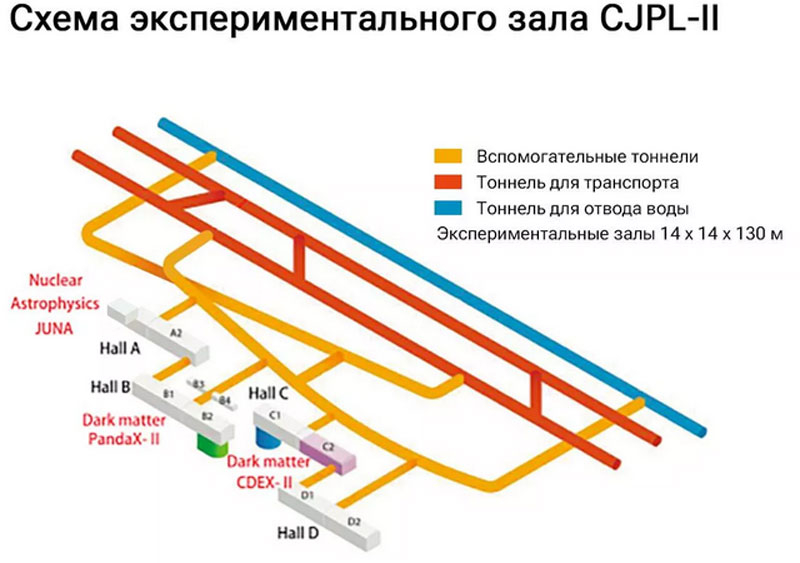

В декабре 2023 года сообщалось, что в Китае запущен новый научный объект — самая глубокая в мире лаборатория для поиска тёмной материи и других открытий. На днях в журнале Nature вышла статья, из которой стало известно больше подробностей о готовящихся там экспериментах. На глубине 2400 м установлены датчики с кратно повышенной чувствительностью для детектирования кандидатов в элементарные частицы тёмного вещества.

Источник изображения: Xinhua Первая очередь детекторов в подземной лаборатории в горном массиве Цзиньпин в Китае — в тоннелях построенной там гидроэлектростанции — была запущена в 2010 году. Тогда же стартовали две экспериментальные установки: CDEX (China Dark Matter Experiment) и PandaX (Particle and Astrophysical Xenon Detector). Детектор CDEX представляет собой твердотельный полупроводниковый датчик в виде 10 кг чистого германия в кристаллическом состоянии. Считается, что 10 кг чувствительной среды способно уловить одно событие в год. Датчик CDEX призван улавливать гипотетические WIMP-частицы (Weakly Interacting Massive Particles) в нижнем диапазоне масс. Частицы тёмной материи или тёмного вещества, что правильнее с точки зрения определения природы этого явления, могут взаимодействовать с другими частицами только с помощью гравитации. Возможны редкие столкновения с передачей энергии атомам датчиков, что проявится в виде свечения. По интенсивности свечения и траектории можно вычислить параметры исходной частицы. Поскольку Земля в своём орбитальном и галактическом движении должна пересекать потоки тёмной материи, то рано или поздно эти частицы проявят себя в детекторах. По мере создания новых датчиков и условий обнаружения мы постепенно создаём новые граничные условия физических состояний, которые могут соответствовать неуловимым и невидимым в электромагнитном диапазоне частицам тёмной материи.

Источник изображения: Liu Weiping et al. / EPJ Web of Conferences Новый полупроводниковый датчик из германия в только что запущенной лаборатории CJPL-II (China Jinping Underground Laboratory-II) имеет массу около 100 кг, что на порядок повысило частоту возможной регистрации кандидатов в частицы тёмной материи. При этом созданы условия для дальнейшего повышения массы полупроводникового датчика примерно до одной тонны. Когда он будет создан, Китай окажется в этом впереди планеты всей. Второй эксперимент опирается на датчик из ксенона, находящегося в двух фазовых состояниях — жидком и газообразном. Эксперимент PandaX стартовал со 120 кг. В новых залах лаборатории CJPL-II масса вещества в датчике PandaX-4T повышена до 4 т и в будущем вырастет до 40 или даже до 50 т. Сегодня самый чувствительный датчик такого плана у итальянцев в проекте LNGS XENONnT — он включает 8,6 т. В американском проекте LUX-ZEPLIN масса ксенона достигает 7 т. Для подобных экспериментов крайне важна повторяемость, чтобы отсеять случайные срабатывания детекторов.

Источник изображения: Science China Press В подземной лаборатории CJPL-II в Китае намного лучшие условия для экранирования датчиков от воздействия космических частиц. Также мрамор в китайских шахтах меньше фонит, чем в Европе и США, что также упрощает конструкцию и эксплуатацию датчиков. Неуловимой тёмной материи будет всё труднее и труднее скрываться от учёных и со временем они откроют, в чём её секрет. Наступила эра пространственных вычислений: стартовали продажи AR-гарнитуры Apple Vision Pro

02.02.2024 [21:00],

Владимир Фетисов

Сегодня в США начались продажи гарнитуры дополненной реальности Apple Vision Pro, стоимость которой начинается от $3500. Демонстрационные сеансы, в рамках которых потенциальным покупателям раскрываются возможности новинки, проводятся в фирменных магазинах Apple Store в разных городах страны.

Источник изображения: macrumors.com Первая гарнитура смешанной реальности от Apple предлагает пользователям возможности как дополненной, так и виртуальной реальности. Устройство отслеживает направление взгляда пользователя, а также поддерживает управление с помощью жестов и голосовых команд. Apple позиционирует новинку как «пространственный компьютер», а не гарнитуру. «Наступила эра пространственных вычислений. Apple Vision Pro — самое передовое устройство потребительской электроники из когда-либо созданных. Его революционный и волшебный пользовательский интерфейс изменит то, как мы общаемся, творим, исследуем», — сказал глава Apple Тим Кук (Tim Cook) в прошлом месяце, когда была объявлена дата начала продаж Vision Pro. Официальные магазины Apple в США открылись сегодня в 8 часов утра по местному времени, и все они предлагают посетителям бесплатно оценить возможности Vision Pro в порядке очереди. Эта акция продлится до конца недели и, вероятно, большое количество людей так или иначе успеет ознакомиться с функциями, которые предлагает гарнитура смешанной реальности Apple. В дополнение к этому открыта возможность зарезервировать демонстрацию Vision Pro на понедельник, 5 февраля, и более позднюю дату. AMD сделала ставку на ПК с ИИ в гонке с Intel и NVIDIA за рынок компьютеров

02.02.2024 [19:00],

Сергей Сурабекянц

Американский полупроводниковый гигант Advanced Micro Devices делает ставку на компьютеры с искусственным интеллектом, которые смогут конкурировать с NVIDIA и Intel. «Рынок компьютеров с искусственным интеллектом будет продолжать расширяться», — заявил президент AMD Виктор Пэн (Victor Peng). Он ожидает бурного внедрения персональных компьютеров с ИИ во второй половине года.

Источник изображения: AMD «Мы видим, что компьютеры с искусственным интеллектом становятся все более важным фактором, и благодаря недавним анонсам мы имеем хорошее преимущество в области ПК с искусственным интеллектом… Я думаю, что мы занимаем чрезвычайно хорошие позиции как в области ИИ, так и в других традиционных сферах бизнеса», — считает Пэн. В прошлом месяце AMD анонсировала гибридные процессоры (APU) для настольных ПК серии Ryzen 8000G от которых пользователи могут «ожидать огромную мощность и превосходную производительность для интенсивных рабочих нагрузок, включая игры и создание контента». Чипы предназначаются для материнских плат с Socket AM5 и это первые APU для данной платформы. Новинки оснащены вычислительными ядрами с архитектурой Zen 4, графическими ядрами на архитектуре RDNA 3 и улучшенным ИИ-движком Ryzen AI (XDNA1).

Источник изображения: AMD AMD конкурирует с NVIDIA и Intel в области графических процессоров, которые важны для ИИ и высокопроизводительных вычислений. В декабре 2023 года AMD выпустила новые ускорители Instinct MI300X на базе графических процессоров, предназначенные для обучения больших языковых моделей, которые должны конкурировать с чипами NVIDIA H100. «ИИ — это не только графические процессоры для центров обработки данных, но и серверы, и в прошлом году мы получили значительную долю рынка. Что касается серверов, мы ожидаем, что с MI300 мы продолжим завоёвывать долю рынка», — сказал Пэн.

Источник изображения: AMD Во время финансового отчёта за четвёртый квартал исполнительный вице-президент AMD Жан Ху (Jean Hu) сообщил: «Мы добились роста выручки в годовом исчислении в сегментах наших центров обработки данных и встраиваемых систем, а также успешно запустили ускорители AMD Instinct MI300, что позволяет нам уверенно наращивать продажи продукции в этом сегменте в 2024 году». NVIDIA в настоящее время доминирует на рынке графических процессоров для ускорителей, используемых в приложениях ИИ. Большинство моделей генеративного ИИ сейчас используют графические процессоры NVIDIA, такие как H100. В начале января компания анонсировала новые видеокарты GeForce RTX 4000 Super, которые помимо прочего предназначены для запуска приложений генеративного ИИ на ПК.

Источник изображения: NVIDIA В декабре Intel выпустила мобильные процессоры Core Ultra c поддержкой ИИ. По словам компании, эти процессоры будут использованы в «более чем 230 первых в мире ПК с искусственным интеллектом от таких компаний, как Acer, ASUS, Dell, HP и Lenovo».

Источник изображения: Intel Президент и главный исполнительный директор HP Энрике Лорес (Enrique Lores) заявил в ноябре, что компания «действительно воодушевлена тем влиянием, которое компьютеры с искусственным интеллектом окажут на общую категорию ПК», но «потребуется некоторое время», прежде чем они станут достаточно широко распространены. Исследовательская компания Canalys в декабрьском отчёте отметила, что бум генеративного ИИ приведёт к увеличению продаж ПК, поскольку потребители активно интересуются такими устройствами. Взрыв интереса к ИИ был вызван запуском чат-бота ChatGPT в ноябре 2022 года, мгновенно ставшего вирусным. По прогнозу Canalys, 60 % компьютеров, проданных в 2027 году, будут поддерживать ускорение ИИ-алгоритмов. По данным исследовательской компании International Data Corporation, первоначально устройства на базе ИИ будут нацелены на некоторые сегменты рынка корпоративных ПК, но большее количество вариантов использования и снижение затрат могут со временем распространить их внедрение на более широкий пользовательский рынок. IDC ожидает, что интеграция возможностей искусственного интеллекта в ПК послужит катализатором обновлений, которые появятся на прилавках в этом году. Процессоры AMD достигли самой высокой популярности в Steam за всю историю

02.02.2024 [18:50],

Николай Хижняк

Компания Valve опубликовала статистику по системам пользователей Steam за январь. Хотя этот месяц считается не очень активным среди покупателей, компания AMD смогла увеличить долю своих процессоров до самого высокого уровня за всю историю платформы Steam, а доля пользователей операционной системы Windows 11, в свою очередь, продолжает плавно приближаться к 50 %.

Источник изображения: TechSpot Несмотря на выпущенные в прошлом месяце более доступные модели центральных процессоров серии Raptor Lake Refresh, доля владельцев процессоров Intel на платформе за минувший месяц сократилась на 0,59 процентных пункта (п.п.). В свою очередь, популярность чипов AMD на платформе выросла на те же 0,59 п.п. и достигла рекордного для компании значения в 34,25 %. AMD недавно выпустила гибридные настольные чипы Ryzen 8000G — будет интересно посмотреть, как они повлияют на общую статистику в будущих опросах. Однако тот же флагманский Ryzen 7 8700G в составе указанной серии чипов обозревателям не слишком понравился. В сегменте видеокарт доля пользователей GeForce RTX 3060 на платформе сократилась на 0,31 п.п., но она по-прежнему остаётся самым популярным игровым ускорителем в Steam. В целом практически вся десятка самых популярных видеокарт в январе находилась в красной зоне. Большинство из них — это старые карты. Иными словами, это может говорить о том, что пользователи могли начать обновлять свои системы более свежими моделями ускорителей. Январь показал, что среди пользователей Steam растёт популярность игровых ноутбуков. Например, системы с мобильной GeForce RTX 4060 увеличили свою долю на платформе на 0,58 п.п. Рост также наблюдался у мобильной RTX 3060 (+0,38 п.п.). Та же мобильная RTX 4060 оказалась пятой по популярности, а младшая RTX 4050 — расположилась на девятом месте. Самой популярной видеокартой серии Ada Lovelace оказалась GeForce RTX 4060 (. Следом за ней, не сильно отставая, расположилась RTX 4060 Ti. Практически все видеокарты GeForce RTX 40-й серии увеличили свою долю на платформе. Исключением стала RTX 4070, потерявшая 0,03 %. Microsoft определённо обрадуется, узнав, что доля пользователей Windows 11 на платформе Steam в январе выросла. По итогам прошлого месяца указанной ОС пользовались 44,2 % участников опроса. В свою очередь, доля пользователей Windows 10 сократилась на очередные 2 п.п. и по итогу месяца составила 51,4 %. Ещё немного и Windows 11 поселится у половины пользователей Steam. Другое дело рынок в целом, где картина для Windows 11 выглядит не такой радужной. Новейшая операционная Microsoft установлена лишь на 26,5 % ПК, а на долю Windows 10 приходятся 67,4 % пользователей. Почти половина участников опроса Steam сообщили, что используют в своих ПК 16 Гбайт оперативной памяти. Около 23 % пользователей имеют в своих системах 32 Гбайт ОЗУ. Самым популярным разрешением экрана по-прежнему является Full HD (1920 × 1080 пикселей). Его используют 59,7 % пользователей платформы. Вторым самым популярным разрешением дисплея является 1440p (16 % пользователей). Постоянно растущий размер игр может объяснять тот факт, что у большинства пользователей платформы осталось всего от 100 до 249 Гбайт свободного пространства постоянной памяти. При этом у большинства общий объём постоянной памяти составляет более 1 Тбайт. Акции Lenovo пережили худшую неделю с 2021 года из-за страха санкций США и спада на рынке ПК

02.02.2024 [16:54],

Павел Котов

Бурный рост компании Lenovo в 2023 году, вызванный оптимизмом в отношении искусственного интеллекта, сменился отнюдь не позитивным началом этого года: акции компании рухнули на фоне напряжённости между США и Китаем, а также слабого спроса. Но в компании считают, что спад не будет долгим и скоро продажи вернутся к росту, как раз за счёт ИИ.

Источник изображения: lenovo.com Только на этой неделе акции Lenovo потеряли более 12 % — компания подешевела на $1,8 млрд, и для неё эта неделя стала худшей с октября 2021 года. Инвесторы начали избавляться от активов китайских игроков, которые могут попасть под американские санкции. Штаб-квартира Lenovo расположена в Пекине, своей основной клиентской базой компания считает американские ведомства, а китайские власти называет значительным косвенным акционером. В прошлом году акции Lenovo прибавили 70 % благодаря оптимизму в отношении спроса на продукцию с функциями ИИ. Но за 2024 год её ценные бумаги потеряли более 25 %. Акции связанных с Китаем компаний на фоне экономических проблем оказались крайне непопулярными; ситуация усугубилась на минувшей неделе, когда в США был опубликован законопроект, который заблокирует доступ некоторых китайских биотехнологических компаний к федеральным контрактам — на фоне опасений, что аналогичная судьба может постичь и другие сферы, спад Lenovo ускорился. Продажу акций теперь провоцируют любые негативные новости о Китае, признаются инвесторы изданию Bloomberg. Дополнительным негативным фактором стала сложная обстановка на рынке: Intel, крупнейший производитель процессоров, дала слабые прогнозы на будущее из-за сложностей в полупроводниковой сфере и отрасли ПК. В итоге Morgan Stanley пришлось понизить рейтинг Lenovo из-за слабых перспектив в отношении прибыли в краткосрочной перспективе.

Источник изображения: bloomberg.com Тем временем в самой компании уверены, что «худшее уже позади» — так выразился президент подразделения Lenovo Asia-Pacific Амар Бабу (Amar Babu). В интервью Nikkei Asia он обратил внимание на «ажиотаж в отношении всей категории ПК с ИИ». Аналитики американской IDC с ним не вполне согласны: по их сведениям, мировые поставки ПК в 2023 году упали на 13,9 % по сравнению с предыдущим годом, то есть снижение происходит уже два года подряд. Спрос на ПК, аномально подскочивший на ранних этапах пандемии, с её окончанием рухнул и до сих пор полностью не восстановился. Господин Бабу считает, что сейчас на рынке ПК происходят корректировки товарных запасов, для Lenovo «худшее уже позади», и компания даёт «осторожно оптимистические» прогнозы. Американские технологические компании, в том числе Microsoft и Intel, делают ставку на новый тип ПК с ИИ, который позволит людям использовать ИИ в работе, обрабатывая некоторые алгоритмы локально. Lenovo «очень сосредоточена на разработке стратегии ИИ» в сотрудничестве с этим партнёрами — компьютеры нового поколения заставят клиентов обновить технику, купленную в эпоху пандемии. Некоторым из купленных в то время ПК было около четырёх лет, говорит топ-менеджер. Внедрение генеративного ИИ спровоцирует рост спроса на все категории продуктов: облачные службы, корпоративные серверы и персональные устройства, и у Lenovo есть предложения в каждом сегменте. MSI добавила некоторым платам на чипсете Intel Z790 поддержку 256 Гбайт оперативной памяти

02.02.2024 [16:48],

Николай Хижняк

Компания MSI выпустила для некоторых своих материнских плат на чипсете Intel Z790 свежие бета-версии BIOS. Новое программное обеспечение добавляет поддержку установки до 256 Гбайт оперативной памяти. В частности, такие прошивки компания выпустила для своей флагманской платы Z690 Godlike и модели рангом пониже MEG Z90 ACE.

Источник изображения: MSI По данным различных источников, в перспективе производитель расширит ассортимент плат Intel 700-й серии с поддержкой 256 Гбайт оперативной памяти, а также выпустит BIOS с аналогичной особенностью для плат Intel 600-й серии. Например, по данным информатора @chi11eddog, сейчас компания MSI тестирует поддержку 256 Гбайт ОЗУ на плате Z790 Carbon MAX WIFI. Источник поделился изображением, на котором видно, что в систему на базе Intel Core i9-14900K установлен комплект памяти DDR5-4800 указанного объёма. Как пишет портал ExtremeTech, ранее производители материнских плат отказывались от внедрения поддержки такого большого объёма памяти в потребительских моделях плат, поскольку в этом случае возникали проблемы с совместимостью, требовавшие отключения некоторых функций, таких как Resizeable Bar и Remapping. Судя по всему, MSI решила этот вопрос. Весьма вероятно, что в перспективе за тайваньским производителем последуют и другие ведущие компании, выпускающие материнские платы. Поддержка 256 Гбайт памяти материнскими платами значительно упростит выбор нужного комплекта ОЗУ, поскольку для установки 128 Гбайт теперь потребуется приобрести только две планки, а не четыре как раньше. Кроме того, наличие большого объёма оперативной памяти будет определённо полезно в таких сценариях использования, как создание цифрового контента и рендеринг. Также преимуществами большого объёма доступной памяти будут пользоваться различные ИИ-приложения. Ряд производителей уже ведёт разработку модулей ОЗУ объёмом 64 Гбайт, которые будут выпускаться комплектами общим объёмом 256 Гбайт. Правда, возникает вопрос, сколько будут стоить подобные комплекты. Например, сейчас цена комплектов ОЗУ общим объёмом 192 Гбайт, состоящих из четырёх модулей памяти ёмкостью по 48 Гбайт каждый, достигает $700, пишет ExtremeTech. Scythe представила мощные кулеры Mugen 6 и Mugen 6 Black Edition

02.02.2024 [16:07],

Николай Хижняк

Компания Scythe представила процессорный кулер Mugen шестого поколения. Новинка будет выпускаться в двух версиях — Mugen 6 и Mugen 6 Black Edition. Первая характеризуется хромированной отделкой, никелированными медными тепловыми трубками, а также одним комплектным вентилятором. Второй кулер полностью выполнен в чёрном цвете, включая тепловые трубки, а также комплектуется парой вентиляторов.

Источник изображений: Scythe Оба кулера имеют никелированное медное основание и получили по шесть теплопроводящих трубок диаметром 6 мм. Радиатор Mugen 6 обдувает один, а версии Mugen 6 Black Edition — два 120-мм вентилятора Scythe Wonder Tornado 120 PWM на базе гидродинамических подшипников. Производитель заявляет для них скорость работы до 2000 об/мин, воздушный поток до 60,29 CFM и статическое давление до 2,45 мм вод. ст.

Размеры Mugen 6 с установленным вентилятором составляют 132 × 106 × 154,5 мм, а вес равен 1,01 кг. В свою очередь, габариты Mugen 6 Black Edition с двумя вентиляторами составляют 132 × 132 × 154,5 мм, а вес равен 1,2 кг. Кулеры поддерживают процессорные разъёмы Intel LGA 1700 и LGA 1200, а также AMD Socket AM5 и AM4. О стоимости кулеров производитель ничего не сообщил. Сверхмассивная чёрная дыра средней активности неожиданно начала испускать сверхбыстрый ветер

02.02.2024 [15:57],

Геннадий Детинич

В показаниях космического рентгеновского телескопа ESA XMM-Newton учёные обнаружили странные данные, которые не соответствовали всем предыдущим наблюдениям. Сверхмассивная чёрная дыра (СЧД) в центре галактики Markarian 817 около года испускала сверхбыстрый ветер из частиц, оставаясь при этом в стадии средней активности. Раньше подобное наблюдалось только для сверхактивных СЧД и случалось крайне редко.

Художественное представление чёрной дыры, испускающей ветер из заряжённых частиц. Источник изображения: ESA / CC BY-SA 3.0 IGO В редких случаях чрезвычайной активности сверхмассивная чёрная дыра в центре галактики испускает настолько сильный ветер — выброшенные электромагнитными полями частицы вещества из аккреционного диска, что он буквально выдувает межзвёздные газ и пыль за пределы галактики. Это прекращает звездообразование и, по сути, определяет облик и судьбу галактики-хозяина. Для астрономов важно наблюдать подобные явления, что позволяет выяснить механизм взаимодействия СЧД и приютившей её галактики и, в конечном итоге, больше узнать об эволюции этих объектов и Вселенной. Галактика Markarian 817 на удалении 430 млн световых лет от нас с СЧД массой 81 млн солнечных явно выделилась на фоне всех остальных событий такого рода. Об активности чёрной дыры в её центре отчётливо должно было сигнализировать рентгеновское излучение, испускаемое перегретым веществом в аккреционном диске. Однако регистрируемое рентгеновским телескопом ESA XMM-Newton излучение от Mrk 817 было более чем умеренным. Контрольная проверка с помощью другой рентгеновской установки — NuSTAR NASA — подтвердило верность полученных данных. Как позже оказалось, ветер от чёрной дыры блокировал рентгеновское излучение, и по факту оно было достаточно сильным. Анализ данных показал, что активность наблюдалась по обширному пространству аккреционного диска, что привело к образованию, как минимум трёх отдельных потоков ветра из заряжённых частиц, каждый из которых развил скорость до нескольких процентов от скорости света в вакууме. Это продолжалось около года и особым образом дало понять, как чёрные дыры и галактики могут влиять друг на друга. «Очень редко можно наблюдать сверхбыстрые ветры, и еще реже обнаруживать ветры, энергии которых достаточно, чтобы изменить характер галактики-хозяина. Тот факт, что Markarian 817 создавал эти ветры около года, не находясь в особо активном состоянии, предполагает, что чёрные дыры могут изменять форму своих галактик-хозяев гораздо сильнее, чем считалось ранее», — сообщили авторы исследования в статье, опубликованной в журнале Astrophysical Journal Letters. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |