|

Опрос

|

реклама

Быстрый переход

Huawei возглавила китайский рынок смартфонов в начале 2024 года

05.02.2024 [17:42],

Сергей Сурабекянц

Аналитическая компания Counterpoint Research опубликовала свежий анализ китайского рынка смартфонов. Судя по суммарным результатам за первые две недели 2024 года, Huawei поставила больше мобильных устройств, чем какая-либо другая компания, что делает её фактическим лидером продаж на рынке смартфонов.  Согласно отчёту Counterpoint Research, тремя основными причинами успеха Huawei стали высокие продажи флагманских смартфонов Mate 60, основанных на чипсете Kirin 9000S собственной разработки, а также высокая степень лояльности китайский потребителей к бренду и быстрый прогресс фирменной операционной системы Harmony OS 4.0. В декабре компания выпустила серию смартфонов nova 12, что также способствовало увеличению объёмов продаж. Все три телефона Huawei nova 12 — базовый, 12 Pro и 12 Ultra — оснащены чипсетом Kirin 9000S, произведённым компанией SMIC по техпроцессу 7 нм. Huawei официально не комментирует ситуацию с происхождением чипсета. Китайское правительство оказывает компании широкомасштабную поддержку в развитии производства чипов в условиях санкций, что поможет ещё больше увеличить продажи смартфонов в будущем. Исследование Counterpoint Research обычно даёт довольно точное представление о конкретном рынке смартфонов, поэтому есть основания полагать, что лидерство Huawei на китайском рынке смартфонов продолжится, как минимум, в течение всего первого квартала. Nokia договорилась с китайской Vivo о лицензировании 5G-технологий — все патентные споры улажены

05.02.2024 [17:19],

Владимир Фетисов

Финский производитель телекоммуникационного оборудования Nokia объявил о подписании многолетнего соглашения о лицензировании 5G-технологий с китайским производителем смартфонов Vivo. Об этом сообщило информационное агентство Reuters со ссылкой на заявление Nokia.

Источник изображения: Nokia «Соглашение урегулирует все текущие патентные споры между сторонами во всех юрисдикциях. Условия соглашения остаются конфиденциальными, как было согласовано между сторонами», — говорится в официальном сообщении Nokia. Отмечается, что лицензионное соглашение на технологии 5G с Vivo стало для Nokia шестым за последние 13 месяцев. Ранее финская компания подписала аналогичные соглашения с китайскими Huawei, Honor и Oppo, американской Apple и южнокорейской Samsung. Как и в других подобных случаях, условия сделки с Vivo не разглашаются. В прошлом месяце Nokia объявила, что ожидает, что бизнес по лицензированию интеллектуальной собственности принесёт как минимум €1,4 млрд операционной прибыли в 2024 году. MSI подготовила нефритовую видеокарту GeForce RTX 4090 Suprim X Ruan Mei Edition по мотивам игры Honkai: Star Rail

05.02.2024 [16:52],

Николай Хижняк

Компания MSI разработала специальную версию флагманской видеокарты GeForce RTX 4090 в весьма необычном исполнении. Судя по всему, новинка является результатом коллаборации MSI и игрового разработчика HoYoverse. Карта выполнена в нефритово-золотой расцветке, характерной для Жуань Мэй — персонажа игры Honkai: Star Rail.

Источник изображений: X / @hongxing2020 Судя по опубликованным изображениям карты, в основе новинки используется модель MSI GeForce RTX 4090 Suprim X. Помимо необычной расцветки ускоритель выделяется кастомной задней усиливающей пластиной с изображением упомянутого персонажа. Информации о технических характеристиках карты нет. Вполне возможно, что MSI в какой-то момент планировала выпуск GeForce RTX 4090 Suprim X Ruan Mei Edition, но впоследствии его отменила. Не исключено, что вместо неё компания выпустит модель RTX 4090D в том же исполнении. Напомним, что обычная GeForce RTX 4090 попала под санкции США и её запрещено поставлять в Китай. Вместо неё в Поднебесной доступна немного урезанная версия RTX 4090D. В комплекте поставки видеокарты также содержится постер персонажа Жуань Мэй и коврик для мышки с изображением девушки. Huawei урезала производство чипов для смартфонов — ИИ-ускорители оказались важнее

05.02.2024 [16:40],

Владимир Мироненко

Растущий спрос на чипы для ИИ-ускорителей и ограниченная доступность производственных мощностей вынудили компанию Huawei сосредоточилась на выпуске ИИ-чипов в ущерб производству процессоров для смартфонов. Это отразилось на объёмах производства флагманских смартфонов семейства Mate 60, сообщило агентство Reuters со ссылкой на информированные источники.

HUAWEI Mate X3 По данным источника Reuters, как ИИ-ускорители Ascend, так и чипы Kirin, которые используются в смартфонах Mate 60, выпускаются на одном предприятии. При выпуске чипов для ИИ-ускорителей Ascend выход годной продукции оказался выше, чем при выпуске Kirin, поэтому Huawei пришлось сделать выбор в пользу замедления выпуска смартфонов. Вместе с тем фирма также работает над повышением качества производства, чтобы получать больше пригодных для использования чипов с каждой пластины, и надеется, что такая ситуация продлится недолго. Набирающая обороты гонка на рынке искусственного интеллекта на фоне технологического противостояния Китая и США привела к тому, что Huawei поставила на второе место выпуск смартфонов, хотя впервые за более чем три года вновь стала лидером по продажам смартфонов в Китае. Это стало возможным благодаря выпуску смартфонов семейства Mate 60 на базе отечественного чипа с поддержкой 5G. Появление в китайском смартфоне передового по китайским меркам процессора HiSilicon Kirin 9000S показало тщетность американских санкций, вызвало вопросы у властей США и привело к старту расследования Министерства торговли США. Xiaomi представила 23,8-дюймовый монитор Monitor A24i с частотой обновления 100 Гц

05.02.2024 [16:27],

Николай Хижняк

Компания Xiaomi представила 23,8-дюймовый монитор Xiaomi Monitor A24i (P24FBA-RAGL), ориентированный на офисное и домашнее использование. Новинка отличается повышенной для своего класса частотой обновления.

Источник изображений: Xiaomi Новинка построена на IPS-матрице с соотношением сторон 16:9 и поддержкой разрешения 1920 × 1080 пикселей. Дисплей Xiaomi Monitor A24i поддерживает частоту обновления 100 Гц. Производитель заявляет для экрана яркость 250 кд/м2, 99-процентный цветовой охват sRGB с точностью цветопередачи Delta E <2, контрастность 1000:1 и отклик в 6 мс. Новинка имеет тонкие боковые рамки. При этом толщина самого экрана составляет всего 7,5 мм в самой тонкой части. В оснащение монитора входят порты DisplayPort 1.4 и HDMI. В комплект поставки Xiaomi A24i включена подставка с возможностью регулировки углов наклона экрана. Также у новинки предусмотрено крепление VESA для использования сторонних подставок. Производитель не сообщил стоимость монитора, когда он поступит в продажу и в каких странах будет доступен. Учитывая характеристики и производителя, цена новинки не должна быть высокой. Импорт планшетов в Россию сжался на 27 % в 2023 году — сильнее всех упали поставки у Samsung и Lenovo

05.02.2024 [16:15],

Владимир Фетисов

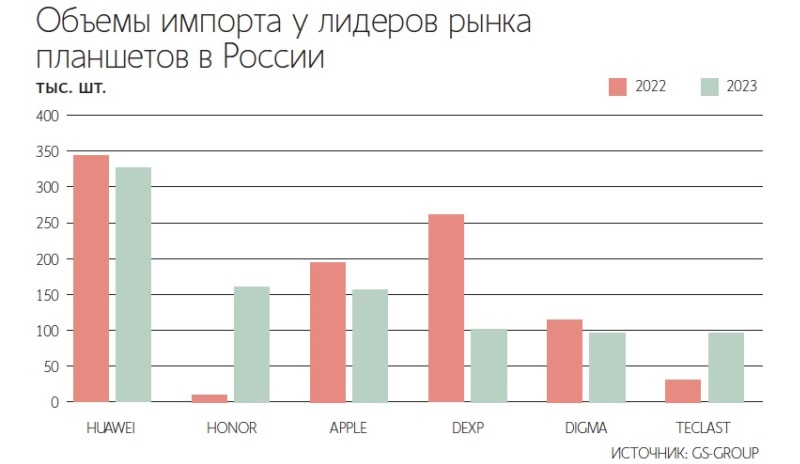

Объём ввозимых в Россию планшетных компьютеров в 2023 году сократился на 27 % по сравнению с 2022 годом, а доля параллельного импорта за тот же период снизилась с 27,5 % до 15 %. Об этом пишут «Ведомости» со ссылкой на данные аналитического центра GS Group.

Huawei MatePad Pro В компании подсчитали, что в 2023 году на территорию России было ввезено 1,32 млн планшетов разных брендов. Помимо сокращения объёмов импорта отмечается смена лидеров в этом сегменте. В 2021–2022 годах лидерами рынка были южнокорейская Samsung и китайская Lenovo, чьи поставки в 2023 году упали на 85 % и 91 % соответственно. За этот же период объём ввозимых в страну планшетов Honor вырос практически с нуля на 2844 % и составил 159 тыс. единиц, благодаря чему китайский бренд обогнал Apple. Наиболее серьёзное падение показала Samsung, которая была лидером по поставкам в 2022 году (393 тыс. планшетов) с долей рынка 22 %. В 2023 году доля южнокорейской компании снизилась до 3 % (35 тыс. планшетов). Китайская Lenovo в 2021 году поставила в Россию 457 тыс. устройств, тогда как в 2023 году импорт сократился до 20 тыс. планшетов.

Источник изображения: GS Group Лидером рынка по итогам 2023 года стала китайская Huawei, которая поставила 330 тыс. планшетов и нарастила долю присутствия до 25 %. В тройку лидеров также вошли Honor и Apple, которые завезли 159 тыс. и 155 тыс. планшетов соответственно и заняли по 12 % рынка. В первую десятку также вошли бренды Dexp, Digma, Teclast и др. Несмотря на снижение объёмов импорта, продажи планшетов в штуках увеличились почти на треть в 2023 году. За отчётный период в стране было продано около 2,5 млн планшетов, что почти на треть больше показателя 2022 года, сообщили в «М.Видео-Эльдорадо». Гендиректор розничной сети МТС Андрей Губанов отметил, что продажи планшетов в России в 2023 году выросли впервые с 2020 года. Отмечается, что чаще всего россияне покупали устройства с экраном более 10 дюймов. Доля устройств с подключением по Wi-Fi составила 45 %. Также пользовались спросом устройства с накопителем на 64 Гбайт и более 128 Гбайт. Gainward выпустила компактную видеокарту GeForce RTX 3050 6GB Pegasus

05.02.2024 [15:27],

Николай Хижняк

Компания Gainward представила видеокарту GeForce RTX 3050 6GB Pegasus. Новинка предназначена для использования в составе компактных систем формата Mini-ITX и будет выпускаться в версиях как с дополнительным заводским разгоном GPU, так и без него.

Источник изображений: Gainward GeForce RTX 3050 6GB получила графический процессор с 2304 ядрами CUDA, что на 10 % меньше, чем у 8-гигабайтной версии. Согласно эталонным характеристикам NVIDIA, графический чип работает на частоте 1470 МГц, что на 17 % ниже, чем у модели с 8 Гбайт памяти. Шина видеопамяти новинки урезана со 128 до 96 бит. Память работает со скоростью 14 Гбит/с на контакт и обеспечивает пропускную способность на уровне 168 Гбайт/с. Энергопотребление карты составляет всего 70 Вт, поэтому она не оснащается разъёмами для дополнительного питания. Для новинки в исполнении Gainward Pegasus с заводским разгоном заявляется частота GPU 1492 МГц. Карта оснащена компактной системой охлаждения, в состав которой входят один вентилятор с функцией полной остановки. Он не вращается, пока температура GPU составляет ниже 60 градусов Цельсия. При толщине в два слота расширения размеры карты составляют 162 × 117 мм. В набор внешних видеоразъёмов Gainward GeForce RTX 3050 6GB Pegasus входят по одному порту DisplayPort 1.4a, HDMI 2.1 и DVI-D. Xiaomi перетасовала руководство, чтобы сосредоточиться на выпуске электромобилей

05.02.2024 [13:25],

Владимир Мироненко

Xiaomi официально объявила о серии ключевых кадровых перестановок в своей руководящей команде. Данные изменения указывают на то, что компания намерена усилить внимание к своему растущему автомобильному бизнесу.  3 февраля гендиректор и основатель Xiaomi Лэй Цзюнь (Lei Jun) объявил в социальной сети Weibo, что больше сосредоточится на автомобильном бизнесе группы, а Лу Вейбинг (Lu Weibing), президент Xiaomi Group и генеральный менеджер Redmi, возьмёт на себя должностные обязанности генерального менеджера Xiaomi. В свою очередь, пост генерального менеджера Redmi теперь будет занимать Ван Тэн (Wang Teng). Лэй Цзюнь отметил, что Лу Вейбинг на новой должности будет больше уделять внимания автомобильному бизнесу компании, тем более что в настоящее время проводятся общенациональные комплексные дорожные испытания её первого электромобиля Xiaomi SU7 в рамках заключительного этапа подготовки к его запуску. Также в обязанности Лу Вейбинга входит подготовка к выходу флагманского смартфона Xiaomi 14 Ultra, который, как обещает компания, произведёт фурор на технологическом рынке. В ходе презентации Xiaomi SU7, прошедшей в конце декабря 2023 года, Лэй Цзюнь заявил, что цель Xiaomi в автомобильном бизнесе — конкурировать с такими брендами, как Porsche и Tesla, и создать автомобиль мечты для новой эры автомобильной промышленности, сочетающий эстетику, производительность, комфорт и безопасность в интеллектуальном мобильном пространстве. Xiaomi поставила цель за 15–20 лет войти в пятёрку крупнейших мировых автопроизводителей. Вместе с тем Цзюнь подчеркнул, что, несмотря на акцент на автомобильный бизнес, выпуск смартфонов остаётся основным направлением деятельности Xiaomi. Представлен смартфон Vivo V30 с процессором Snapdragon 7 Gen 3 и тремя 50-Мп камерами

05.02.2024 [12:44],

Владимир Фетисов

Состоялась официальная презентация смартфона Vivo V30, который пополнит ассортимент устройств средней ценовой категории. Аппарат отличается наличием качественного дисплея, свежего и весьма производительного процессора, а также поддержкой быстрой зарядки.

Источник изображений: Vivo Разработчики оснастили Vivo V30 большим 6,78-дюймовым изогнутым по краям дисплеем AMOLED с поддержкой разрешения 2800 × 1260 пикселей, частотой обновления 120 Гц и пиковой яркостью 2800 кд/м². Сканер отпечатков пальцев интегрирован в область дисплея. В верхней части экрана имеется круглый вырез, в котором установлена 50-мегапиксельная фронтальная камера. Основная камера размещена в прямоугольном модуле на тыльной стороне корпуса. Она объединила в себе сенсор OmniVision OV50E (1/1,55", f/1.9) с разрешением 50 Мп и поддержкой оптической стабилизации и широкоугольный модуль на 50 Мп с автофокусом. Поддерживается съёмка видео 4K на скорости 30 кадров в секунду.  В основе Vivo V30 лежит процессор Qualcomm Snapdragon 7 Gen 3 (одно ядро Cortex-A715 с частотой 2,63 ГГц, три ядра Cortex-A715 с частотой 2,4 ГГц и четыре ядра Cortex-A510 с частотой 1,8 ГГц), который изготавливается по техпроцессу 4 нм. За обработку графики отвечает ускоритель Adreno 720. Аппарат будет доступен в версиях с 8 или 12 Гбайт оперативной памяти и накопителем на 128 Гбайт, 256 Гбайт или 512 Гбайт.  В качестве источника питания в Vivo V30 задействован аккумулятор ёмкостью 5000 мА·ч с поддержкой быстрой зарядки FlashCharge мощностью до 80 Вт. Смартфон поставляется с фирменным пользовательским интерфейсом Funtouch 14 на базе Android 14 (производитель обещает 4-летнюю программную поддержку устройства). Аппарат имеет габариты 164,4 × 75,1 × 7,5 мм и весит 186 г. Он будет доступен в нескольких вариантах цветового исполнения корпуса. Розничная стоимость новинки ещё не была озвучена. С главы Samsung Electronics сняли обвинения в манипуляции ценными бумагами

05.02.2024 [12:08],

Алексей Разин

Внук основателя южнокорейской компании Samsung Ли Чжэ Ён (Lee Jay-yong) в 2017 году был обвинён в коррупции и взяточничестве, после чего до лета 2021 года отбывал тюремное наказание, но был освобождён по решению президента страны. В ноябре прошлого года ему выдвинули новое обвинение, которое грозило пятилетним сроком заключения, но на этой неделе южнокорейский суд снял с него это обвинение.

Источник изображения: Samsung Electronics Речь, как напоминает Bloomberg, идёт об обвинениях в манипуляции с ценными бумагами двух дочерних компаний Samsung, которые якобы помогли Ли Чжэ Ёну в результате сомнительной сделки в 2015 году получить существенный пакет акций материнской компании и усилить своё влияние. Главе Samsung Electronics по данному обвинению грозило не только пятилетнее заключение, но и штраф в размере $376 000. Судья Центрального окружного суда Сеула постановил, что подобные обвинения не подкрепляются достаточными доказательствами наличия у подсудимого незаконных намерений. После вынесения оправдательного приговора Ли Чжэ Ён покинул здание суда, не выражая особых эмоций и отказавшись от общения с журналистами. Его законные представители поблагодарили суд за справедливый, по их мнению, вердикт. Напомним, что предыдущая президентская амнистия позволила формальному лидеру Samsung Electronics закрепить свой статус руководителя компании с соблюдением всех юридических процедур, поскольку в период тюремного заключения Ли Чжэ Ён сохранял за собой титул вице-президента, а принятие стратегически важных решений откладывалось до момента его освобождения. Снятие новых обвинений позволит главе Samsung Electronics претворять в жизнь свои идеи ещё более решительно. Китай запустил первый в мире коммерческий спутник с ИИ

05.02.2024 [10:46],

Владимир Мироненко

Китай вывел на околоземную орбиту первый в мире коммерческий спутник с искусственным интеллектом (ИИ), сообщил онлайн-ресурс, принадлежащий телеканалу CGTN. Спутник под названием Rongpiao, разработанный компанией Guoxing Aerospace Technology, предназначен для проверки в космосе алгоритма ИИ Synaesthesia Fusion. После тестов спутник будет использоваться в качестве платформы для будущих коммуникационных сетей.

Источник изображения: Science and Technology Daily Спутник Rongpiao (Xingshidai-18) с интегрированной сетью зондирования был доставлен на орбиту с помощью ракеты Smart Dragon-3 (SD-3), для которой этот полёт был третьим. Ракета стартовала в космос 3 февраля в 11:06 по местному времени (06:06 мск) с морской платформы в акватории рядом с городом Янцзян в южной провинции Гуандун в Китае. Вместе с Rongpiao ракета доставила на орбиту ещё восемь спутников, включая египетский спутник NExSat-1. Ранее в этом месяце стало известно, что китайская компания ExPace провела на полигоне успешные испытания прототипа многоразовой ракеты, который взлетел на девять секунд в воздух, а затем успешно приземлился обратно на стартовую площадку. Испытания подтвердили успешное продвижение компании в разработке многоразовых ракет с двигателями на метане и жидком кислороде. Китайские компании потратили на исследования и разработки больше, чем европейские

05.02.2024 [09:50],

Алексей Разин

По данным опубликованного в конце прошлого года отчёта Еврокомиссии, 2500 крупнейших компаний мира по итогам 2022 года потратили на исследования и разработки 1,25 трлн евро, причём представителям Китая удалось обойти Европу и занять второе место, уступая лишь США. Если в 2012 году доля КНР в совокупных мировых расходах на НИОКР не превышала 4,3 %, то по итогам 2022 года она выросла до 17,8 %.

Источник изображения: Unsplash, National Cancer Institute Учитывая, что Европа занимала в этом рейтинге 17,5 % по итогам 2022 года, Китаю удалось обойти её незначительно, но Поднебесная в любом случае теперь уступает только США с их долей в 42,1 %. Примечательно, что данный показатель для крупнейших компаний США колеблется в окрестностях 40 % уже более десяти лет. Среди китайских компаний Huawei Technologies является крупнейшим инвестором в исследования и разработки, поскольку по итогам 2022 года она потратила на соответствующие нужды 20,9 млрд евро, увеличив профильный бюджет на 11 % по сравнению с 2021 годом. В мировом масштабе Huawei занимает пятое место по величине расходов на исследования и разработки. В последние годы китайская компания вынуждена направлять на эти цели от 10 до 20 % своей выручки, пытаясь перестроить бизнес в условиях санкционного давления США и их союзников. В масштабах Китая Tencent Holdings и Alibaba Group Holding занимают второе и третье места среди компаний, расходующих свои средства на исследования и разработки. Автопроизводители SAIC и BYD, а также ряд отвечающих за строительную и инфраструктурную сферы экономики КНР, также входят в число крупнейших инвесторов в науку в Китае. В глобальных масштабах лидерство сохраняет Alphabet, выросшая из поискового бизнеса Google, на втором месте расположилась основанная Марком Цукербергом (Mark Zuckerberg) компания Meta✴✴ Platforms. Третье место занимает Microsoft, хотя сотрудничество с OpenAI сейчас открывает перед ней совершенно иные перспективы, а вот Apple ограничивается четвёртым местом, хотя ещё недавно превосходила Microsoft по величине капитализации. Спрос на японское оборудование для выпуска памяти HBM вырос в десять раз

05.02.2024 [07:59],

Алексей Разин

Крупнейшим поставщиком памяти типа HBM остаётся южнокорейская SK hynix, но конкурирующая Samsung Electronics в текущем году собирается удвоить объёмы выпуска аналогичной продукции. Японская компания Towa отмечает, что заказы на поставку специализированного оборудования для упаковки памяти в этом году увеличились сразу на порядок, ссылаясь на повышенный спрос со стороны южнокорейских клиентов.

Источник изображения: Towa Японская компания Towa является крупнейшим поставщиком оборудования для упаковки чипов, применяемого при выпуске микросхем памяти типа HBM, она контролирует примерно 60 % мирового рынка. До сих пор она довольствовалась поставок одной или двух специализированных машин в год, поскольку объёмы производства самой HBM были ограниченными. На этот год, как отмечает Nikkei Asian Review со ссылкой на руководство Towa, сформирован заказ на поставку более 20 единиц специализированного оборудования, и он исходит от крупных корейских заказчиков. Впрочем, как можно судить по активности китайской CXMT, прочие клиенты тоже не теряют времени даром. Технологии Towa позволяют заполнять специальным составом зазоры между кристаллами памяти и подложкой, исключая в процессе эксплуатации доступ воздуха и влаги. Компания добилась точности, позволяющей работать с зазорами в 5 микрон, на что оборудование большинства конкурентов не всегда способно. Этим и обусловлен повышенный спрос на оборудование Towa со стороны корейских производителей HBM, как поясняет источник. Проявляют к компании интерес и биржевые инвесторы — курс акций Towa с января прошлого года вырос на 359 %. За предыдущие пять лет китайские разработчики вложили в архитектуру RISC-V не менее $50 млн

05.02.2024 [07:01],

Алексей Разин

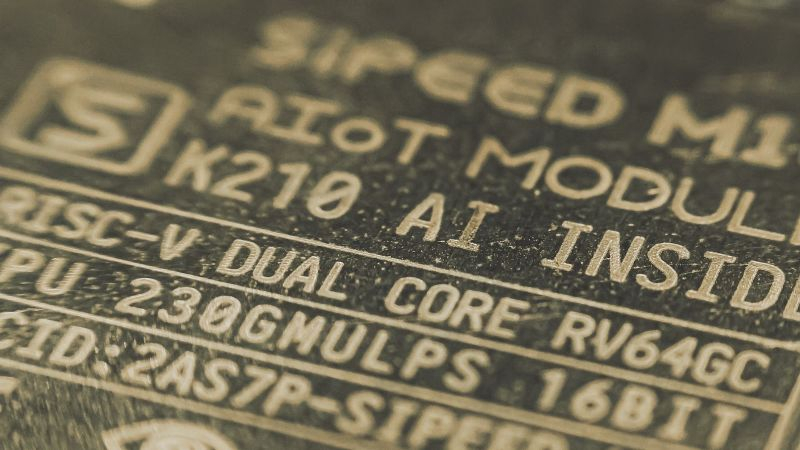

Интерес китайских разработчиков чипов к архитектуре RISC-V с открытым исходным кодом во многом обусловлен усилением западных санкций и способностью геополитических оппонентов влиять на распространение прочих платформ для создания вычислительной техники. За минувшие пять лет китайские организации и компании вложили в проекты, связанные с RISC-V, не менее $50 млн.

Источник изображения: Unsplash, Tommy L Об этом сообщает Reuters со ссылкой на собственные изыскания, покрывающие период с 2018 по 2023 годы включительно и подразумевающие анализ научных публикаций и патентных заявок, а также публичные заявления разного рода китайских компаний. Сумма может показаться не такой весомой, но усилия китайских разработчиков по развитию данной архитектуры уже привели к формированию общественного мнения, заключающегося в положительной оценке перспектив RISC-V с точки зрения развития национальной полупроводниковой промышленности КНР. Для китайских компаний эта архитектура рано или поздно станет жизнеспособной альтернативой Arm или x86-совместимым решениям, как считают китайские власти. Они называют данную платформу «геополитически нейтральной». Одна из патентных заявок, как поясняет Reuters, демонстрирует намерения Академии военных наук НОАК использовать архитектуру RISC-V для поиска дефектов в процессорах, предназначенных для применения в облачных вычислениях и умных автомобилях. Китайские компании разрабатывают процессоры с архитектурой RISC-V для применения в облачных вычислениях, автопилоте транспортных средств и центрах хранения данных. По данным китайских СМИ, половина из всех 10 млрд чипов с этой архитектурой, выпущенных в течение 2022 года, были произведены в Китае. На поддержку китайских стартапов, работающих с RISC-V, по состоянию на июнь прошлого года было потрачено $1,18 млрд. Считается, что в Китае создана самая зрелая экосистема для платформы RISC-V в мире. Если в 2018 году китайские разработчики подали только 10 патентных заявок, связанных с RISC-V, то в прошлом году их количество уже превысило 1000 штук. По количеству зарегистрированных патентов в сфере RISC-V китайские разработчики обходят американских примерно на четверть. Alibaba и Huawei занимают четвёртое и пятое места в списке крупнейших заявителей в этой сфере. Архитектура RISC-V зародилась в прошлом десятилетии в Калифорнии, но в 2019 году после введения санкций против Huawei Technologies американскими властями профильная некоммерческая организация перенесла свою штаб-квартиру из штата Делавэр в Швейцарию. Китайский автопроизводитель Dongfeng Motor в прошлом году разработал чип с архитектурой RISC-V, предназначенный для управления электронными системами автомобиля. Местные исследовательские организации, занятые разработкой решений для оборонного комплекса, также активно патентуют свои технологии, связанные с RISC-V. Например, чипы с такой архитектурой предлагается использовать для обработки сигналов, получаемых с радаров. В сфере кибербезопасности процессорам на этой архитектуре тоже найдётся применение. Впрочем, в мировых масштабах чипы с архитектурой RISC-V пока формируют не более 1,9 % поставок. Представители Qualcomm признали, что эта архитектура открывает определённые перспективы перед теми, кто хочет разработать «высоко кастомизированные чипы». YMTC назвала новейшие американские санкции совершенно безосновательными

05.02.2024 [04:49],

Алексей Разин

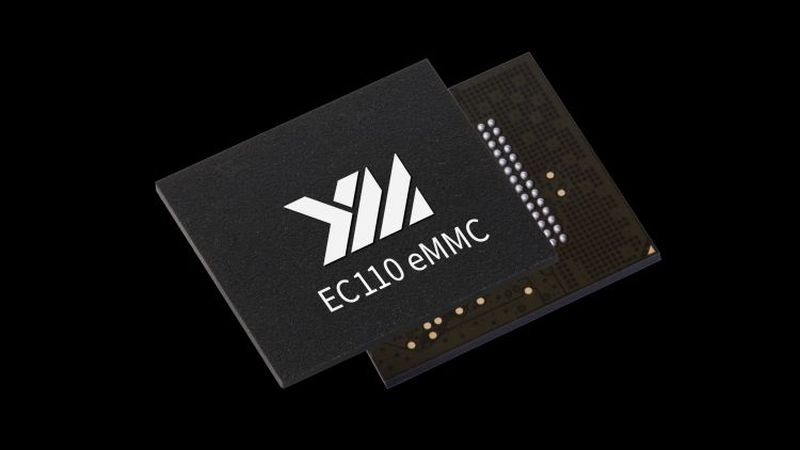

Недавнее включение китайской компании YMTC в так называемый список 1260H американским военным ведомством определённо создаст крупнейшему производителю твердотельной памяти в КНР определённые трудности, но свою причастность к поддержке китайской армии он всячески отрицает и считает шаги американской стороны несправедливыми и безосновательными.

Источник изображения: YMTC Как отметило издание South China Morning Post, представители YMTC не только опровергли любую причастность компании к выполнению оборонных заказов в Китае, но и заявили о своей готовности вести переговоры с Вашингтоном об исключении этого производителя памяти из злополучного списка 1260H. Для самой компании появление её имени в данном перечне стало полнейшим сюрпризом, и в YMTC подчёркивают, что её продукция не годится для применения в оборонной сфере в принципе. Никто из клиентов YMTC никогда не декларировал использование памяти этой марки для создания техники оборонного назначения. Более того, YMTC подчёркивает, что является частной компанией без каких-либо связей с оборонным ведомством КНР, и все обвинения в наличии угрозы с её стороны для американской национальной безопасности считает беспочвенными. Включение в список 1260H, как поясняет источник, потенциально грозит YMTC не только отказом американских клиентов от сотрудничества в оборонной сфере, но и блокировкой финансовых операций за пределами Китая со стороны профильных органов власти США. С декабря 2022 года YMTC находится под санкциями США, касающимися экспорта из страны технологий и оборудования для производства памяти. В условиях таких ограничений компании пришлось активнее приобретать оборудование китайского производства. Скорее всего, поводом для новых санкций со стороны США стали крупные инвестиции в капитал YMTC, якобы полученные от поддерживаемых государством фондов в Китае. Специалисты iFixit разобрали AR/VR-гарнитуру Apple Vision Pro

04.02.2024 [17:01],

Владимир Фетисов

Специалисты компании iFixit регулярно разбирают электронные устройства, чтобы показать, как они устроены и как их можно отремонтировать. На этот раз им в руки попала гарнитура смешанной реальности Apple Vision Pro, поступившая в продажу в США ранее на этой неделе. В ходе разборки была дана оценка внутренней компоновки устройства и его ремонтопригодности.

Источник изображения: iFixit Внутри Vision Pro обнаружились многочисленные датчики, камеры, приводы объективов, вентиляторы и многое другое. Гарнитура Apple является одним из самых технологичных устройств компании, поэтому не удивительно, что осуществить её самостоятельный ремонт будет весьма проблематично. «Дисплей EyeSight является ахиллесовой пятой в плане ремонтопригодности», — отметили в iFixit. При этом специалисты компании упомянули, что Apple удалось скомпоновать внутренние элементы гарнитуры таким образом, чтобы можно было сравнительно легко заменить аккумуляторную батарею и динамики. «Мы должны отдать должное Apple: легко заменяемые динамики и аккумулятор — это большая победа в плане ремонтопригодности», — говорится в сообщении iFixit. Vision Pro оснащается фирменным 8-ядерным процессором Apple M2, 16 Гбайт оперативной памяти и накопителем ёмкостью до 1 Тбайт. Разработчики наделили устройство совершенно новым чипом R1, который предназначен для обработки данных, поступающих от 12 камер, 5 датчиков и шести микрофонов, а также обеспечения ощущения того, что контент появляется прямо перед глазами пользователя. Напомним, продажи Vision Pro в США стартовали 2 февраля. Несмотря на то, что новинка стоит от $3500, до начала продаж было оформлено множество предзаказов на её покупку. После старта продаж желающие испытать устройство в деле могут сделать это в одном из официальных магазинов Apple Store в США. Установлен рекорд суммарной продолжительности пребывания в космосе, его автор — россиянин Олег Кононенко

04.02.2024 [14:12],

Владимир Фетисов

Космонавт госкорпорации «Роскосмос» Олег Кононенко, который в настоящее время находится на борту Международной космической станции, установил новый рекорд по суммарной продолжительности космических полётов. В 11:30:08 по московскому времени Кононенко превысил достижение соотечественника Геннадия Падалки, который за пять полётов с 1998 по 2015 годы провёл в космосе 878 суток 11 часов 29 минут и 48 секунд.

Олег Кононенко / Источник изображения: Артем Геодакян/ТАСС Кононенко является командиром отряда российских космонавтов, а нынешний полёт для него стал пятым в карьере. Любопытно, что 5 июня в 00:00:20 мск Кононенко станет первым человеком, который провёл в околоземном пространстве более 1000 суток. После завершения нынешней миссии, которое запланировано на 23 сентября, суммарное время, проведённое космонавтом в невесомости, составит 1110 суток. Олег Кононенко родился в городе Чарджоу Туркменской ССР 21 июня 1964 года. В 1988 году будущий космонавт окончил Харьковский авиационный институт им. Жуковского по специальности «Двигатели летательных аппаратов» с присвоением квалификации «инженер-механик». С 1996 по 1998 годы проходил общую космическую подготовку в Центре подготовки космонавтов им. Гагарина. В марте 1998 года получил квалификацию «космонавт-испытатель». В первый космический полёт Кононенко отправился 8 апреля 2008 года в составе 17-й основной экспедиции МКС, которая вернулась на Землю 24 октября того же года. Беспилотные автомобили в прошлом году проехали по дорогам Калифорнии в пять раз больше, чем годом ранее

04.02.2024 [09:48],

Алексей Разин

С начала октября внимание мировых информационных агентств было приковано к истории с наездом на пешехода в Сан-Франциско, в которой участвовал прототип беспилотного такси Cruise, и теперь их эксплуатация приостановлена на всей территории США. При этом подобные машины за прошлый год проехали по дорогам Калифорнии примерно 5,3 млн километров, как гласит статистика.

Источник изображения: Cruise Это в пять с лишним раз больше, чем было пройдено в 2022 году, как поясняет Reuters. Самыми активными эксплуатантами беспилотных машин, в которых пустовало водительское сидение, оказались компании Cruise и Waymo, причём если первая силами своего автопарка проехала 63 % указанной дистанции, то на долю второй пришлись 36 %. По сути, все остальные компании, получившие разрешение на эксплуатацию беспилотных прототипов без водителя за рулём в штате Калифорния, довольствовались лишь 1 % совокупного пробега в прошлом году. С первого декабря 2022 года по тридцатое ноября 2023 года беспилотные прототипы со страхующим водителем за рулём проехали по дорогам Калифорнии 9,12 млн км, что на 11,8 % результата больше сопоставимого предыдущего периода. Сан-Франциско стал одной из тех территорий, где беспилотный транспорт эксплуатировался наиболее интенсивно. В случае с сервисом беспилотных такси Cruise реакция местных жителей была разной. Если потенциально обделяемые «живыми» таксистами категории клиентов были довольны беспристрастностью автоматики, то прочие горожане нередко выражали недовольство непредсказуемым поведением беспилотных такси на дорогах города, которое периодически становилось причиной заторов. Естественно, недовольство высказывали и представители профсоюзов работников автотранспортной отрасли. По состоянию на минувшую пятницу, в Калифорнии разрешением на тестирование автономных транспортных средств обладали 38 компаний, из них шести было разрешено не привлекать для этого страхующих водителей: Waymo, Zoox (Amazon), Apollo (Baidu), Nuro, WeRide и AutoX. После октябрьского инцидента аналогичное разрешение было отозвано у Cruise (GM), а эксплуатацию своих прототипов на территории остальных американских штатов эта компания приостановила по собственной воле. Участие китайских компаний в тестировании своих обвешанных камерами беспилотных такси по улицам Калифорнии уже вызвало обеспокоенность ряда американских законодателей, которые переживают за информационную безопасность и сохранность персональных данных американских граждан. Сотрудничество Samsung с Baidu вряд ли поможет поднять продажи смартфонов Galaxy S24 в Китае

04.02.2024 [08:35],

Алексей Разин

Выводя новые флагманские смартфоны семейства Galaxy S24 на китайский рынок, компания Samsung Electronics сделала ставку на сотрудничество с местным поисковым гигантом Baidu, обеспечив интеграцию профильных сервисов китайского партнёра на свои устройства. Эксперты считают, что данный шаг не будет способствовать популяризации смартфонов Samsung на китайском рынке.

Источник изображения: Samsung Electronics Напомним, что в Китае смартфоны Samsung Galaxy S24 будут обеспечены поддержкой чат-бота Ernie китайской компании Baidu и собственно одноимённого поискового сервиса в реализации с функциями искусственного интеллекта. Многие из предложенных в сотрудничестве с Baidu функций дублируют возможности смартфонов Galaxy S24 для глобального рынка, на котором Samsung полагается на партнёрство с Google и её поисковым сервисом Gemini AI. Китайские клиенты Samsung уже выразили озабоченность тем, что реализованные в сотрудничестве с Baidu функции не будут работать столь же эффективно, как и предлагаемые Google для международной версии смартфонов Galaxy S24. Китайские покупатели имеют возможность сравнивать обе платформы, приезжая в Гонконг, где доступны смартфоны Galaxy S24 в обоих вариантах исполнения. Baidu свой чат-бот Ernie представила ещё в марте прошлого года, одной из первых среди мировых гигантов предложив альтернативу набиравшему тогда популярность ChatGPT компании OpenAI. К сентябрю была представлена версия языковой модели Ernie 4.0, которая заведомо уступала в своих возможностях GPT-4 даже в понимании представителей Baidu. К настоящему моменту Huawei и OPPO уже предлагают собственные большие языковые модели, используемые устройствами одноимённых марок, поэтому конкуренция на китайском рынке смартфонов с этой точки зрения будет только усиливаться. Аналитики Counterpoint Research считают, что сама по себе поддержка систем искусственного интеллекта не поможет Samsung укрепить свои позиции на китайском рынке смартфонов. При этом сотрудничество с Baidu как таковое демонстрирует стремление компании развивать свой бизнес на территории КНР в долгосрочной перспективе. На местном рынке смартфоны Galaxy S24 и Galaxy S24+ стоят больше своих предшественников, тогда как в США они предлагаются по прежним ценам, а в Европе так вообще оказались дешевле моделей серии Galaxy S23. Разница в цене для китайских покупателей может иметь большее значение, чем наличие дополнительных функций. За последние десять лет доля Samsung на китайском рынке смартфонов сократилась с 20 до менее чем 1 процента. В 2023 году Alphabet сэкономил $3,9 млрд, продлив срок службы серверов, но увеличил расходы на ИИ-инфраструктуру

03.02.2024 [23:45],

Владимир Мироненко

Холдинг Alphabet сообщил результаты работы в IV квартале и 2023 году, завершившемся 31 декабря. Выручка облачного подразделения Google Cloud составила около $9,2 млрд, увеличившись год к году на 25,66 %. Что примечательно, подразделение сработало с операционной прибылью в размере $864 млн, в то время годом ранее у него были убытки в $186 млн. Выручка всего Alphabet в IV квартале составила $86,31 млрд по сравнению с $76,048 млрд годом ранее. Выручка за весь 2023 год — $307,394 млрд, что значительно превышает результат 2022 года, равный $282,836 млрд. Чистая прибыль холдинга выросла в 2023 году до $73,795 млрд с $59,972 млрд годом ранее, отчасти благодаря решению компании продлить срок службы серверов и сетевого оборудования. Alphabet впервые продлил срок службы своего оборудования в 2021 году, увеличив продолжительность работы серверов с трёх до четырёх лет, а сетевого оборудования — с четырёх до пяти. В 2023 году Alphabet вновь продлил срок эксплуатации оборудования, на этот раз — до шести лет. Благодаря этому только в IV квартале 2023 года расходы компании на амортизацию оборудования упали на $983 млн, а чистая прибыль увеличилась на $765 млн. За весь год амортизация оборудования Alphabet снизилась на $3,9 млрд, а чистая прибыль увеличилась на $3 млрд. При этом компания вложила значительные средства в новую инфраструктуру. В IV квартале общие капитальные затраты составили $11 млрд, что, по словам президента и главного инвестиционного директора Alphabet и Google Рут Порат (Ruth Porat), было обусловлено «инвестициями в техническую инфраструктуру, причём самый крупный компонент — серверы, за которыми следуют ЦОД». В предыдущем квартале капзатраты составили $7,6 млрд. Резкое увеличение капзатрат обусловлено «перспективами создания уникальных приложений ИИ для пользователей, рекламодателей, разработчиков, облачных корпоративных клиентов и правительств во всем мире, а также возможностями долгосрочного роста, которые они предлагают». Порат добавила, что компания будет придерживаться этой политики и в 2024 году. «Мы ожидаем, что капитальные затраты в 2024 году будут значительно больше, чем в 2023 году», — отметила она. Порат также подчеркнула, что фактором роста Google Cloud Platform (GCP) является ИИ. Гендиректор Сундар Пичаи (Sundar Pichai) заявил, что компания продолжит инвестировать в инфраструктуру, как в ЦОД, так и в вычислительную технику, чтобы поддержать рост возможностей ИИ-технологий. Подразделение Google Cloud снова стало самым быстрорастущим сегментом. После значительного замедления роста с +28 % год к году во II квартале до +22 % в III квартале рост облака вновь ускорился до +26 %. Более того, в этот раз ускорение темпов роста было сильнее, чем у AWS и Azure. Рост доходов от облачных технологий вновь ускорился на 4 п. п. Также резко выросла операционная маржа Google Cloud — последовательно на 6 п.п. до 9 %. Компания объяснила замедление темпов роста в III квартале проведением оптимизации рабочей нагрузки. В ходе нынешнего отчёта Сундар Пичаи сообщил, что этот вопрос «в основном был проработан». Темпы роста Google Cloud по-прежнему опережают рынок: по оценкам Synergy Research Group, общемировой прирост рынка облаков составил +20 % в годовом исчислении до $74 млрд в IV квартале, ускорившись с 18 % в годовом исчислении в III квартале. Доминирует Amazon (31 % рынка), за ним следуют Microsoft (24 %) и Google (11 %). Большая тройка занимает 67 % рынка. Причём Microsoft и Google нарастили свои доли, а AWS — снизила. NVIDIA GeForce RTX 3050 с 6 Гбайт памяти оказалась на 20 % медленнее версии с 8 Гбайт

03.02.2024 [19:02],

Павел Котов

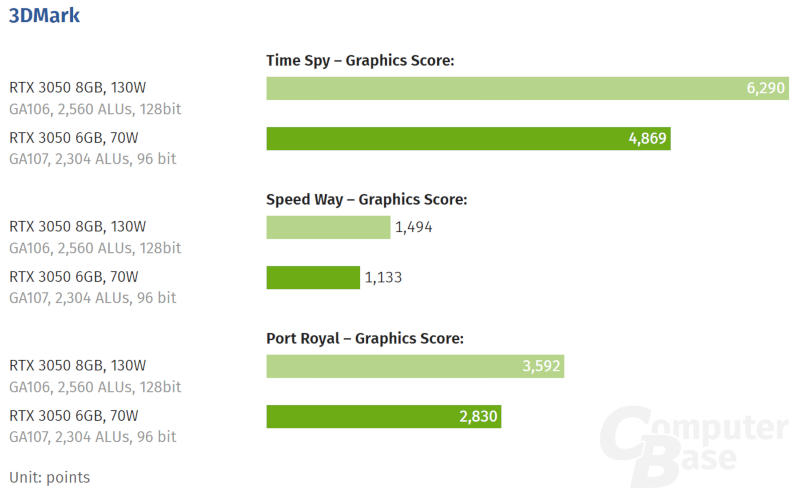

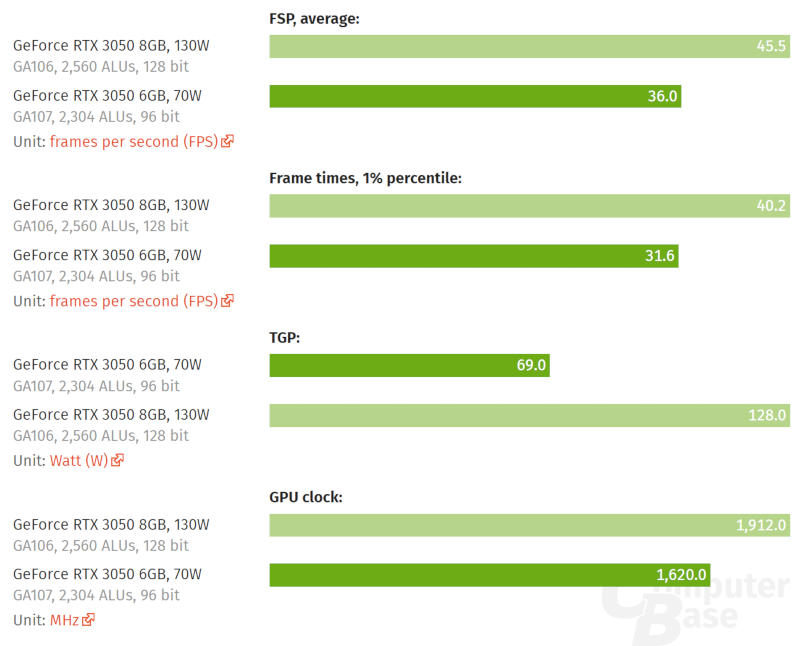

Анонсированная накануне видеокарта NVIDIA GeForce RTX 3050 с 6 Гбайт памяти помогла компании NVIDIA вернуться в сегмент ниже $200 и конкурировать с Intel Arc A580 и AMD Radeon RX 6600. Выяснилось, что новинка на 20 % медленнее модели с 8 Гбайт памяти.

Источник изображения: nvidia.com NVIDIA GeForce RTX 3050 с 6 Гбайт памяти оснащена графическим процессором GA107-325 с 2304 ядрами CUDA, что на 10 % меньше, чем у модели на 8 Гбайт. Кроме того, у этого графического процессора мощность составляет всего 70 Вт, что позволяет партнёрам NVIDIA выпускать видеокарты без разъёмов питания — она более чем на 40 % экономичнее версии с 8 Гбайт. Любопытно и сравнение видеокарт NVIDIA в категории менее $200:

Источник изображения: computerbase.de При таком сравнении новая версия NVIDIA GeForce RTX 3050 на 6 Гбайт представляется интересным вариантом. Её прямой предшественник, GeForce GT 1630 в сравнении с GTX 1650 имел меньше ядер, но стоил дороже — эта модель была призвана восстановить рынок видеокарт после криптовалютного бума. Новая имеет в 2,5 раза больше ядер, чем GeForce GTX 1650, и в 4,5 раза больше, чем GT 1630. Но и с GeForce RTX 3050 на 8 Гбайт путать её тоже не следует.

Источник изображения: computerbase.de В проведённых редакцией ресурса ComputerBase синтетических тестах видеокарта показала довольно неплохие результаты, если учесть сокращение мощности на 46 % по сравнению с 8-гигабайтной версией RTX 3050. В игровых тестах, пока проведённых только на примере Cyberpunk 2077, разрыв тоже составляет около 20 %. В ближайшее время ComputerBase планирует сравнить новую видеокарту с AMD Radeon RX 6600 и NVIDIA GeForce GTX 1650. В комплекте NVIDIA GeForce RTX 4080 Super нашли дефектный адаптер питания — он не защёлкивался, и это опасно

03.02.2024 [17:52],

Павел Котов

На обзор в редакцию сайта Igor's Lab поступила видеокарта NVIDIA GeForce RTX 4080 Super стороннего производителя, укомплектованная адаптером питания с дефектным разъёмом 12V2x6. Проблема, возможно, не носит массового характера, но владельцам видеокарт рекомендуется проявлять внимание к этому аспекту — кабель или адаптер должны подключаться с явным щелчком.  Журналисты Igor's Lab изучили проблему и установили, что в спецификации PCI-SIG не указаны точные размеры разъёма 12V2x6, что даёт производителям излишнюю свободу. Возможно, из-за этого адаптер питания, поставлявшийся в комплекте с видеокартой входил без характерного щелчка — по той же причине он относительно легко выходил из разъёма, поскольку фиксировался в нём недостаточно надёжно. Чтобы подтвердить гипотезу о браке, автор обзора позаимствовал адаптер, который шёл с видеокартой GeForce RTX 4080 Founders Edition производства самой NVIDIA, и было точно известно, что он работал. Бракованный компонент попробовали подключать к другим видеокартам GeForce RTX 40-й серии, и щелчка авторы добились примерно через 15–20 попыток. Впоследствии удалось разобраться, что было не так с этим экземпляром — покрытие на контактах. Обычно на контакты из чистой электролитической меди наносится слой никеля толщиной 2 мкм, а поверх него ещё и слой олова в 1,5 мкм. В данном случае никелевое покрытие оказалось намного толще, что не позволяло разъёму должным образом зафиксироваться. Это достаточно серьёзная проблема, которая могла привести к печальному исходу, если бы оставалась незамеченной в течение длительного времени. Любой кабель или адаптер, подключаемый к видеокарте с 12+4-контактным разъёмом, должен входить до характерного щелчка, означающего, что он зафиксировался на месте. Если щелчка нет, велика вероятность, что кабель или адаптер необходимо заменить. Oppo Find X7 на чипе Dimensity 9300 стал самым мощным Android-смартфоном января по версии Antutu

03.02.2024 [16:25],

Владимир Фетисов

В конце прошлого года на рынке появились смартфоны на флагманских однокристальных платформах нового поколения: Qualcomm Snapdragon 8 Gen 3 и MediaTek Dimensity 9300. Смартфоны на основе этих микропроцессоров не первый месяц борются за лидирующие позиции в рейтинге производительности Antutu, и в январе этого года ситуация не изменилась.

Источник изображения: Oppo Самым производительным Android-смартфоном месяца по версии Antutu стал Oppo Find X7 с чипом Dimensity 9300 (рабочая частота 3,25 ГГц). За обработку графики в нём отвечает ускоритель Immortalis-G720. Смартфон имеет в оснащении 6,82-дюймовый дисплей LTPO OLED с максимальной яркостью 4500 кд/м². Автономную работу обеспечивает аккумулятор на 5000 мА·ч с поддержкой быстрой зарядки мощностью до 100 Вт. По результатам тестирования модель с 16 Гбайт оперативной памяти и накопителем на 1 Тбайт в среднем набирала 2 209 832 балла. С небольшим отставанием от лидера на второй строчке рейтинга расположился iQOO 12 Pro с процессором Snapdragon 8 Gen 3. Он поучил от разработчиков 6,78-дюймовый дисплей AMOLED с пиковой яркостью 3000 кд/м², а также до 16 Гбайт ОЗУ и до 1 Тбайт ПЗУ. Источником питания служит батарея ёмкостью 5100 мА·ч с поддержкой проводной зарядки мощностью до 120 Вт и беспроводной — до 50 Вт. В ходе тестирования модель с 16 Гбайт ОЗУ и 1 Тбайт ПЗУ в среднем набирала 2 206 859 баллов.

Источник изображения: Antutu Замыкает тройку лидеров ASUS ROG 8 Pro с чипом Snapdragon 8 Gen 3. Смартфон имеет 6,78-дюймовый дисплей LTPO AMOLED с частотой обновления 165 Гц и пиковой яркостью 2500 кд/м². В максимальной комплектации он оснащён 24 Гбайт ОЗУ и 1 Тбайт ПЗУ. Именно такая модель использовалась в тестировании и в среднем ей удалось набрать 2 204 998 баллов. Отметим, что все три смартфона показали результаты, близкие друг к другу и разница между ними всего несколько тысяч баллов. В первую пятёрку также вошли Oppo Find X7 Ultra и iQOO 12. Любопытно, что в первой десятке рейтинга Antutu нет ни одного смартфона Xiaomi, хотя прежде устройства вендора, в том числе модели Redmi K-серии, регулярно оказывались среди самых производительных смартфонов на базе Android. Apple показала рекламу с первым знакомством с Vision Pro и инструкции по настройке гарнитуры

03.02.2024 [15:52],

Павел Котов

Компания Apple, накануне начавшая продажи гарнитуры виртуальной и дополненной реальности Vision Pro, опубликовала несколько видеороликов, посвящённых устройству: рекламу, показывающую знакомство с ним, а также несколько инструкций по настройке гаджета.

Источник изображения: apple.com Рекламный ролик подчёркивает простоту управления гарнитурой. «Apple Vision Pro очень проста в управлении глазами, руками и голосом. Как будто уже знаешь, как пользоваться ею», — уверяет голос за кадром. Судя по видео, управлять Vision Pro действительно несложно: достаточно указывать глазами на нужные значки приложений или пункты меню и выбирать их едва заметным движением пальцев. Доступны и другие, интуитивно простые жестовые команды. Канал поддержки Apple на YouTube также опубликовал серию роликов с обзорами приложения «Настройки», «Центра управления», режима гостевого доступа Vision Pro, доступных на гарнитуре специальных возможностей и других функций платформы VisionOS. Компания рассказала, как подключается кабель питания, как устанавливаются диоптрийные линзы и как лучше снимать пространственное видео на iPhone. Пока Apple Vision Pro продаётся лишь в США, но до конца года поступит в продажу и в других странах. Марк Цукерберг стал богаче Билла Гейтса после отличного отчёта Meta✴ — он получил $28 млрд за день

03.02.2024 [14:50],

Владимир Мироненко

После последнего квартального отчёта акции Meta✴✴ взметнулись в цене на 22 %, благодаря чему её глава Марк Цукерберг (Mark Zuckerberg) стал богаче на $28 млрд, и теперь его состояние больше, чему у мультимиллиардера, соучредителя Microsoft Билла Гейтса (Bill Gates).

Источник изображения: Mark Zuckerberg В настоящее время активы Цукерберг оцениваются в $165 млрд. Столь большого состояния у него не было никогда прежде. Наивысшей отметки состояние главы Meta✴✴ достигло в 2021 году, составив согласно индексу Bloomberg Billionaires Index примерно $142 млрд. Однако последовавшее за этим падение рынка отразилось на Meta✴✴ сильнее чем на других. На самом низком уровне в октябре и ноябре 2022 года акции Meta✴✴ стоили $90 за штуку, а стоимость активов Цукерберга составляла $36 млрд — всего лишь четверть его рекордного состояния за всё время. Когда компания впервые выплатит дивиденды в марте этого года, Цукерберг получит $174 млн наличными. Ему принадлежит около 350 млн акций класса A и B, которые дают право на получение дивидендов. Цукерберг будет зарабатывать более $690 млн в год, если Meta✴✴ сохранит квартальные дивиденды в размере $0,5 на акцию. В отчёте за IV квартал 2023 года Meta✴✴ сообщила о росте всех ключевых показателей, отслеживаемых Уолл-стрит, и увеличении чистой прибыли более чем в три раза год к году. Сейчас рыночная стоимость компании составляет $1,2 трлн. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |