|

Опрос

|

реклама

Быстрый переход

Юристы обеих сторон в судебном разбирательстве сослались на выдумки ИИ — наказали всех

10.06.2026 [16:07],

Павел Котов

В ходе судебного разбирательства, проходившего недавно в американском штате Миссисипи, обе стороны были уличены в том, что в качестве судебных прецедентов они сослались на события, являющиеся вымыслом системы искусственного интеллекта — галлюцинацией. Возглавлявший слушания судья вынес суровое решение в отношении горе-юристов.

Источник изображения: Sasun Bughdaryan / unsplash.com Инцидент произошёл в ходе слушания по делу гражданина Тома Уизерса (Tom Withers) против администрации города Абердин. Интересы Уизерса представляла приглашённая из другого штата адвокат Кэтлин Уилсон (Kathleen M. Wilson), местным адвокатом на той же стороне выступал Шонси Хантер Риджвей (Shauncey Hunter Ridgeway); интересы администрации города защищала также приглашённая из соседнего штата адвокат Кэтрин Уильямс (Kathryn Y. Williams), местную коллегию на той же стороне представлял Марк Макклинтон (Mark C. McClinton). В ходе разбирательства было установлено, что и Уилсон, и Уильямс ссылались на вымышленные, созданные генеративным искусственным интеллектом цитаты, не имевшие отношения к действительности. Адвокаты сами признались, что эти реплики возникли в результате использования сервисов ИИ, которые они не удосужились проверить. В итоге обе они принесли суду извинения, потому что ни одна не проверила юридические обоснования, предоставленные ИИ, прежде чем подать документы. Таким образом, четверо юристов с высшим образованием, чтобы сэкономить время и силы, обратились к ИИ и вообще не проверили документы, не говоря уже о возможных галлюцинациях ИИ. В результате судья был вынужден приостановить движение дела и наказать всех причастных. Уилсон и Уильямс приговорили к штрафам в размере $2500 и $3500 соответственно, им также запретили заниматься в этом округе юридической практикой сроком на два года. Местных адвокатов Риджвея и Макклинтона приговорили к штрафам в размере по $1000 за некачественное проведение двойной проверки. Уизерсу и администрации города дали 60 дней на поиск новых юристов — с расчётом, что те уже не станут халтурить и пользоваться ИИ без последующих проверок. Waymo создала виртуального водителя, чтобы тестировать реакцию автопилота на дорожные инциденты

10.06.2026 [14:34],

Владимир Мироненко

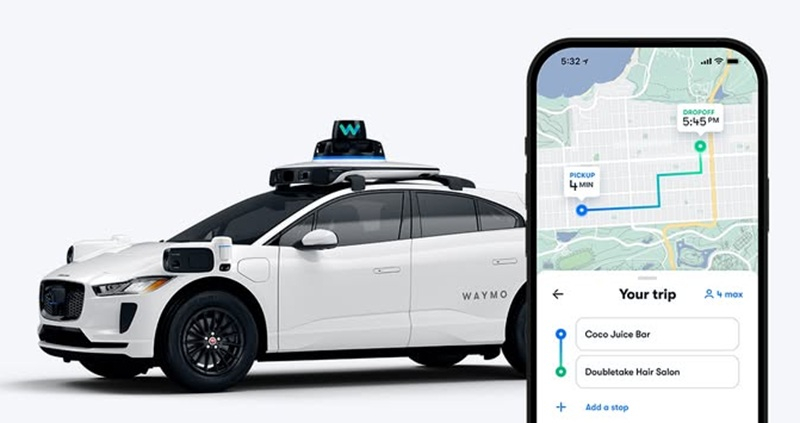

Компания Waymo создала виртуального водителя для изучения реакции людей на неожиданные дорожные инциденты. По замыслу компании, новая компьютерная когнитивная модель, которая объясняет, как водители-люди принимают решения за доли секунды, чтобы избежать аварий, послужит эталоном для сравнения систем автономного вождения, что позволит приблизиться к более высоким стандартам безопасности.

Источник изображения: Waymo Новая модель под названием ReD (Reference Driver, эталонный водитель) разработана в сотрудничестве с Делфтским технологическим университетом (Нидерланды). ReD работает как поведенческий манекен подобно тому, как в лабораториях используют манекены для краш-тестов для оценки структурной целостности и безопасности оборудования автомобиля, с той лишь разницей, что с его помощью определяется, насколько хорошо автономная система автомобиля позволяет избегать опасных ситуаций на дороге. ReD объединяет несколько когнитивных характеристик человека, чтобы имитировать то, как водитель справляется со стрессом во время дорожного инцидента. Люди оценивают угрозы, возникающие на больших расстояниях, исходя из «приближаемости», то есть скорости увеличения объекта в поле зрения. Модель Waymo воспроизводит это, естественным образом испытывая трудности с оценкой скорости на больших расстояниях, подобно реальному человеку. Она учитывает фильтр «дорожных норм», который смещает прогнозы в сторону поведения, соответствующего правилам, до тех пор, пока не обнаружит транспортное средство, нарушающее эти нормы. Так же, как и водитель-человек, модель запускает переоценку ситуации, как только уровень неожиданности достигает определённого порога, не предусмотренного текущим планом действий. Также учитывается, что люди управляют педалями газа и тормоза одной ногой, поэтому при переключении между ними вводится пауза продолжительностью 0,2 с. Как утверждает Waymo, модель ReD, в отличие от традиционных моделей безопасности, имитирующих только чрезвычайные ситуации, способна к «проактивному предотвращению», находясь в постоянной готовности к неожиданному развитию событий и минимизируя свободную энергию. Это позволяет ей предвидеть риски на ранней стадии и корректировать поведение автомобиля до того, как ситуация перерастёт в столкновение. Waymo сообщила, что активно сотрудничает с исследователями, регулирующими органами и организациями по стандартизации, такими как SAE, для достижения консенсуса в отношении подобных эталонных моделей. Цель состоит в том, чтобы обеспечить общее, научно обоснованное определение того, что представляет собой «осторожная и компетентная» реакция человека. Поэтому компания сделала модель ReD общедоступной и распространяемой с открытым исходным кодом для всех желающих её протестировать. Выручка TSMC в мае подскочила на 30 %, подогреваемая ИИ-бумом

10.06.2026 [13:45],

Алексей Разин

До конца второго квартала осталось две недели, но тайваньская компания TSMC пока подвела только официальные итоги апреля и мая, поэтому о динамике её выручки за период можно судить по этим двум месяцам. Если в мае выручка TSMC выросла на 30 % в годовом сравнении до $13,2 млрд, то с начала квартала в целом она увеличилась только на 24 %.

Источник изображения: TSMC При этом, как подчёркивает Bloomberg, аналитики рассчитывают на совокупный рост выручки TSMC по итогам второго квартала на 35 % в годовом сравнении, поэтому от результатов июня будет зависеть реакция фондового рынка на квартальную отчётность компании. Тайваньская TSMC является крупнейшим контрактным производителем полупроводниковых компонентов, она к тому же отчитывается за квартал в числе первых, а потому данная статистика является важным ориентиром для всех тех, кто следит за влиянием бума ИИ на полупроводниковую промышленность в отдельности и мировую экономику в целом. Инвесторы пока настроены оптимистично, поскольку четвёрка облачных гигантов США в текущем году собралась направить на развитие вычислительной инфраструктуры ИИ в общей сложности $725 млрд. Принято считать, что немалая часть этой суммы достанется Nvidia, которая снабжает разработчиков ИИ ускорителями, но она как раз заказывает свои чипы в производство именно компании TSMC. Руководство последней на недавнем собрании акционеров заявило, что не сможет покрыть весь спрос со стороны клиентов в ближайшие несколько лет. В текущем году TSMC рассчитывает поднять капитальные затраты до рекордных $56 млрд, но при этом и выручка компании должна вырасти более чем на 30 %. Рынок смартфонов, ПК и прочих электронных устройств из-за дефицита памяти, вызванного ИИ-бумом, в этом году может сократиться до многолетних минимумов, поэтому бурный рост в серверном сегменте будет отчасти ослабляться данной тенденцией. Siri AI будет предлагать перерывы в затянувшихся диалогах и напоминать, что она — не человек

10.06.2026 [12:46],

Павел Котов

В коде Apple iOS 27 обнаружены ссылки, указывающие, что обновлённый помощник с искусственным интеллектом Siri AI будет предлагать пользователям сделать перерыв, если их общение затянется.  Одной из опасностей со стороны чат-ботов с ИИ эксперты считают чрезмерную привязанность некоторых пользователей к ним, а также длительное общение с ними как с реальными людьми. В отдельных случаях у человека формируется «ИИ-психоз», развиваются бредовые убеждения или ухудшаются существующие проблемы с психическим здоровьем — и это способно спровоцировать длительное взаимодействие с чат-ботом. Опытные разработчики служб ИИ, в том числе OpenAI, Anthropic и Google, уже начали внедрять средства защиты — пользователям напоминают об ограничениях ИИ-компаньонов и поощряют здоровый формат их использования. При длительных сеансах переписки OpenAI ChatGPT и Anthropic Claude предлагают сделать перерыв, попить воды или отдохнуть от компьютера. Apple в ходе презентации Siri AI на WWDC затронула несколько вопросов конфиденциальности и ответственности, но о затяжных беседах не упомянула. Тем не менее, в бета-версии Apple iOS 27 обнаружены строки кода, которые могут содержать сообщение пользователю о необходимости сделать перерыв, если переписка оказывается слишком долгой; человеку также напоминают, что Siri человеком не является. Фиксированный промежуток времени к этим событиям не привязывается — предупреждения будут выводиться с учётом нескольких сигналов. Apple официально наличие данной функции не подтвердила и не сообщила, как именно она будет работать. Но, очевидно, решила подойти к запуску нового сервиса со всей ответственностью. Глава ИИ в Microsoft раскритиковал Anthropic за попытки приписать Claude проблески сознания

10.06.2026 [10:39],

Павел Котов

Глава отдела Microsoft AI Мустафа Сулейман (Mustafa Suleyman) назвал «очень, очень опасными» попытки Anthropic строить предположения, что у её моделей искусственного интеллекта Claude возникают признаки сознания.

Источник изображения: Mustafa Suleyman «Мне кажется, некоторые сотрудники Anthropic настолько очеловечили алгоритмы Claude, что тот, в свою очередь, обманул их, заставив поверить в проблески сознания, которые они изначально в него заложили. <..> Мы не хотим иметь дело со сверхразумом, обладающим представлениями о собственных чувствах и страданиях», — заявил эксперт в интервью подкасту Decoder. В «конституции», то есть задокументированных основах строения Claude, напрямую прописана неуверенность Anthropic в том, обладает ли модель ИИ ощущением благополучия, и испытывает ил она такие чувства как «удовлетворённость» и «дискомфорт». Компания заявляет о намерении «опрашивать» модели ИИ, когда они будут устаревать, и документировать их «предпочтения» в отношении последующих релизов. Господин Сулейман назвал такое отношение разработчика к продукту «философской ошибкой»: компания Anthropic превратила конституцию модели ИИ в «место для размышлений, как в научной статье, а не в механизм обучения». В итоге ИИ-модель Claude и усвоила эти «тезисы о себе и своём обучении». Глава Anthropic Дарио Амодеи (Dario Amodei) ранее не исключил, что у Claude есть сознание, заявив, что «мы не знаем обладают ли модели сознанием», но компания «открыта» для идей об этом. «Вот этого от ИИ нам не нужно. Мы хотим, чтобы ИИ был управляемым, подотчётным и согласованным инструментом, служащим человечеству», — подчеркнул Мустафа Сулейман. «Алиса» в поиске «Яндекса» почти перестала ссылаться на сайты вне первой десятки выдачи

10.06.2026 [09:41],

Павел Котов

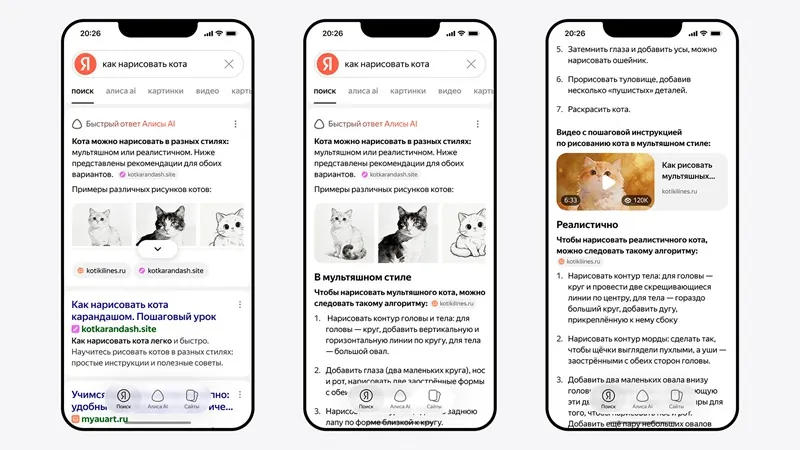

Служба нейроответов «Алисы» в поиске «Яндекса» чаще всего ссылается на сайты, которые занимают верхние позиции в основной выдаче. Доля ресурсов, не входящих в первую десятку, с августа 2025 по январь 2026 года сократилась в ответах «Алисы» вчетверо и достигла 10 %. Об этом сообщил «Коммерсантъ» со ссылкой на данные исследования компании «Ашманов и партнёры».

Источник изображения: «Яндекс» Вероятность попадания случайного ресурса в ответ поискового искусственного интеллекта сейчас крайне невелика, указывают эксперты — обычно «Алиса» цитирует сайты из первой десятки в органической выдаче по большинству запросов, а ещё чаще ИИ обращается к сайтам из пятёрки. Ещё в середине прошлого года поисковый ИИ «Яндекса» обращался к более широкому набору источников — в него попадали даже те, что не входят в первую тридцатку основной выдачи. Благодаря этому пользователи имели возможность познакомиться с материалами сайтов небольших компаний, которые редко попадают в верхушку. Сейчас «Яндекс», по мнению экспертов, ужесточил механизм выбора источников, чтобы снизить присутствие менее релевантных. С тех пор, как «Яндекс» и Google развернули службы ИИ-ответов в поиске, люди стали реже переходить на сайты — они довольствуются перепиской с ИИ. Трафик информационных ресурсов потерял до 30 %, в нейроответы чаще всего попадают ресурсы крупного бизнеса, а органический поиск всё реже оказывается бесплатным источником посетителей. В «Яндексе», однако, наличие таких закономерностей отвергают, настаивая, что сайты попадают в ответы «Алисы» исходя не из их позиций в поиске, а по критериям «экспертности и содержательности контента». С одной стороны, ИИ-ответы становятся важным маркетинговым каналом для бизнеса, указывают эксперты, с другой, из-за роста популярности этого сервиса доля «Яндекса» в распределении трафика существенно упала. Поэтому при поисковой оптимизации становится особенно важно уделять внимание тексту ответа и тому, как в нём представляется бренд. Еврокомиссия требует от Meta✴ восстановить доступ конкурирующих ИИ-агентов к WhatsApp

10.06.2026 [08:13],

Алексей Разин

В декабре прошлого года власти Евросоюза начали антимонопольное расследование в отношении компании Meta✴✴ Platforms, которая, по их мнению, предоставляла собственным ИИ-сервисам при работе через WhatsApp необоснованное преимущество по сравнению со сторонними. Теперь Еврокомиссия требует восстановить доступ сторонних ИИ-сервисов в WhatsApp.

Источник изображения: Unsplash, 𝕡𝕒𝕨𝕤 𝕒𝕟𝕕 𝕡𝕣𝕚𝕟𝕥𝕤 По мнению европейских чиновников, данный шаг направлен на поддержание условий здоровой конкуренции на период проведения антимонопольного расследования, которое, исходя из имеющейся практики, может затянуться надолго. «На быстро развивающихся рынках конкуренция может быть проиграна задолго до принятия окончательного вердикта», — заявила еврокомиссар по конкуренции Тереза Рибера (Teresa Ribera), на слова которой ссылается Financial Times. По мнению регулятора, у жителей Европы должен быть выбор среди ИИ-ассистентов, которые они готовы использовать в связке с WhatsApp, и «никто не имеет права принимать это решение за них». Данные меры со стороны европейских регуляторов накладываются на выход Meta✴✴ в корпоративный сегмент ИИ-решений. Компании могут использовать свою учётную запись в мессенджере WhatsApp для автоматизации общения с клиентами, используя ИИ-агенты. За доступ к такой возможности корпоративные пользователи WhatsApp должны платить, поэтому инициатива властей ЕС вызывает у представителей Meta✴✴ справедливое раздражение. Формально, конкуренты типа OpenAI получают возможность использования платного сервиса WhatsApp Business на безвозмездной основе для продвижения собственных решений, как отмечается в заявлении Meta✴✴, и подобный «регуляторный перегиб» компания готова оспаривать в суде. Китай всё ещё получает запрещённые ИИ-серверы через Тайвань — США требуют закрыть лазейку

10.06.2026 [07:15],

Алексей Разин

Демонстрируя общую политическую лояльность США, Тайвань на практике до сих пор не ввёл пропорциональные ограничения в области экспортного контроля, а потому китайские компании сохраняют возможность закупать на острове готовые серверные системы с ИИ-чипами, которые власти США не разрешают туда поставлять. Обсуждение возможного усиления мер контроля в этой сфере уже ведётся, поэтому ситуация может измениться.

Источник изображения: Wiwynn Дело в том, как поясняет Bloomberg, что даже недавние обвинения в контрабанде ИИ-систем в Китай в юрисдикции Тайваня выдвигались по факту подделки документов, а не нарушения правил экспортного контроля. Формально тайваньские законы никак не препятствуют поставкам ИИ-чипов в Китай, хотя соответствующие предостережения местным компаниям и делаются для создания видимости солидарности с властями США. Под нажимом американских коллег власти острова готовятся закрепить эти ограничения на законодательном уровне. Возможно, консультации с участием чиновников с обеих сторон состоятся в ближайшее время. При этом нельзя утверждать, что власти Тайваня полностью игнорируют усилия США по консолидации ограничительных мер в отношении Китая. В прошлом году тайваньские власти включили китайские компании Huawei Technologies и SMIC в перечень нежелательных для взаимодействия с представителями тайваньского бизнеса. При этом все прочие китайские компании формально сохранили право закупать продукцию с Тайваня, даже если речь идёт о передовых ИИ-чипах. Сейчас власти Тайваня рассматривают возможность введения фильтра для всех китайских покупателей ИИ-чипов, ориентируясь на американские правила экспортного контроля. Если изменения будут приняты, то китайские компании утратят возможность закупать без оформления лицензий ускорители с уровнем быстродействия выше Nvidia H200 и AMD Instinct MI325X. Как ожидается, это серьёзно подорвёт бизнес многих тайваньских производителей серверных систем, поскольку в текущих условиях они сохраняют возможность поставок в Китай почти полного спектра оборудования для инфраструктуры ИИ. Им грозят санкции США, но именно со стороны тайваньского законодательства претензий к такой деятельности почти не возникало. Кроме того, в американском парламенте зреет инициатива по усилению контроля за производством чипов на Тайване по заказам китайских компаний, поэтому поставками готовых систем дело не ограничится. По информации Bloomberg, синхронизация усилий США по сдерживанию технологического развития Китая с прочими азиатскими государствами тоже идёт не так гладко, как хотелось бы американским чиновникам. В частности, Малайзия под нажимом Трампа хоть и взяла на себя обязательства адаптировать национальные правила экспорта ИИ-оборудования под американское законодательство, на практике пока не торопится внедрять соответствующие меры. Сингапур, который для той же Nvidia является крупнейшим финансовым хабом, не проявляет интереса по внедрению пропорциональных мер экспортного контроля, предпочитая ориентироваться на исходно национальное законодательство. Впрочем, профилактическую работу с участниками внешнеэкономической деятельности власти Сингапура всё равно ведут. Китай направит $295 млрд на строительство ЦОД для ИИ в ближайшие пять лет

09.06.2026 [13:59],

Алексей Разин

Не только США или ЕС формируют национальные программы развития отрасли искусственного интеллекта. По данным Bloomberg, китайские власти намерены в ближайшие пять лет направить на эти цели около $295 млрд, возводя центры обработки данных для ИИ по всей стране.

Источник изображения: Baidu Вполне ожидаемо, что выделяться эти средства будут главным образом на реализацию проектов, подразумевающих высокую степень локализации компонентов. Помимо прочего, проект позволит объединить в общую скоростную сеть разрозненные ЦОД в различных уголках Китая. Над разработкой программного документа трудятся ведущие правительственные ведомства КНР, как поясняет источник. Государственным телекоммуникационным гигантам China Mobile и China Telecom будет поручена роль оператора создаваемой национальной сети ЦОД, а ещё они предсказуемо будут отвечать за организацию скоростного обмена данными между региональными кластерами. Доля китайских ИИ-чипов в инфраструктуре возводимых ЦОД должна превысить 80 %, как предполагает проект инициативы. Компонентам Huawei Technologies в этом смысле будет отведена одна из ключевых ролей. Анонсированная в прошлом году китайскими властями инициатива «Шесть сетей» будет интегрирована в новую программу развития национальной ИИ-отрасли. Подход к созданию инфраструктуры будет комплексным: помимо сетей передачи данных, будут формироваться все инженерные коммуникации и электроснабжение в адекватных объёмах. На финансирование проекта будут направлены средства государственных фондов, предусматривается и выпуск целевых долгосрочных облигаций со сроком погашения более 10 лет. Банковские кредиты и частные инвестиции будут играть вспомогательную роль в финансировании программы. Эксперты считают, что создание единой национальной вычислительной сети позволит китайским разработчикам ускорить вывод на рынок всё более совершенных ИИ-моделей, а также откроет равный доступ к новым технологиям компаниям, разбросанным по всей территории КНР. Создание национальной вычислительной инфраструктуры является одной из приоритетных целей на ближайшую пятилетку (до 2030 года) для экономического развития страны. Указанная сумма в $295 млрд не включает частных инвестиций со стороны китайских компаний, которые они готовы направить на развитие собственных ЦОД. В любом случае, американские техногиганты только в этом году на подобные цели готовы потратить $725 млрд, поэтому пятилетний бюджет КНР на этом фоне немного меркнет. Опять же, строительство ЦОД и объектов инфраструктуры в Китае обходится дешевле реализации аналогичных проектов в США, поэтому сравнивать указанные суммы напрямую не совсем корректно с точки зрения возможной отдачи. Всеобщая сеть для объединения ЦОД в Китае должна появиться к 2028 году. С учётом затрат на ввод в строй генерирующих мощностей и электросетей бюджет китайской программы может вырасти до $738 млрд. От импорта передовых чипов Nvidia китайские власти отказываются даже при наличии некоторых послаблений со стороны США, но одновременно они одобрили к использованию в национальной вычислительной инфраструктуре девять моделей ИИ-чипов китайской разработки, включая решения Huawei, Alibaba, Biren Technology и Moore Threads. Как считают эксперты, создание национальной сети вычислительных центров для ИИ в Китае будет способствовать устранению цифрового неравенства среди удалённых районов страны, поскольку в технологическом и экономическом плане юго-восточная часть КНР традиционно опережала остальную территорию. Sony придумала, как вернуть былую славу смартфонам Xperia — их камеры напичкают ИИ-функциями

09.06.2026 [13:33],

Алексей Разин

Японская компания Sony хоть и является ведущим поставщиком датчиков изображения для камер смартфонов, сама в данном сегменте рынка особых успехов не добилась. Выходящий в этот четверг флагманский смартфон Xperia призван исправить положение дел, поскольку его камера будет наделена актуальными функциями, подразумевающими активное использование ИИ.

Смартфон Sony Xperia 1 VII Издание Nikkei Asian Review напоминает, что в натуральном выражении смартфоны Sony у себя на родине по итогам прошлого года заняли только седьмое место, уступив не только Apple, но и Google, Samsung, Sharp, FCNT и даже китайской Oppo. Отчасти это можно объяснить тем, что действующий флагман Xperia 1 VII страдал от заводского дефекта, который приводил к произвольному выключению смартфона или его перезагрузке. Продажи пришлось приостановить на два месяца, после чего локализовать проблему и объявить отзыв продукции. Бизнес Sony по производству смартфонов балансировал на грани выживания, но японский гигант всё же решил сохранить его, назвав такие устройства важной платформой для разработки перспективных решений, включая датчики изображений, а также кластером телекоммуникационных технологий. Когда в январе Sony объявила о реструктуризации бизнеса по выпуску телевизоров, фактически передав его под контроль китайской TCL, появились слухи о вероятности отделения бизнеса по выпуску смартфонов. Свою линейку смартфонов 2026 модельного года Sony ориентирует на создателей контента, причём не только профессиональных, но и любителей. При работе с камерой пользователям будет предложен ИИ-ассистент, который самостоятельно выберет схему цветокоррекции и настроит фокус с учётом типа съёмки и окружающих условий. Настройки будут рассортированы по фильтрам со словесным описанием, между которыми пользователь сможет выбирать при съёмке на смартфон. Конкурирующие технологии Apple и Google позволяют осуществлять цветокоррекцию снимков и увеличивать мелкие объекты вплоть до 100-кратного масштаба. По замыслу Sony, компания должна предоставить возможность делать профессиональные снимки даже тем, кто далёк от искусства фотографии. Новый флагман Xperia 1 VIII уже поступил в продажу в Гонконге, на Тайване и в Европе. Он оказался на 30 % популярнее предшественника, и это позволяет компании предположить, что новинка пользуется спросом, особенно среди молодёжи. Кодзима оказался «не заинтересован» в ИИ на фоне массовой критики ИИ-рекламы Prada с его участием

09.06.2026 [13:27],

Михаил Романов

Японский гейм-дизайнер Хидео Кодзима (Hideo Kojima) в интервью The Washington Post прокомментировал возможности генеративного ИИ для реализации творческих задач на фоне массовой критики ИИ-рекламы Prada со своим участием. Напомним, в короткометражном ИИ-фильме Satellites II прославленный разработчик вместе с режиссёром Николасом Виндингом Рефном (Nicolas Winding Refn) предстал в виде космического путешественника на пути к мероприятию Prada. Пользователи в комментариях массово раскритиковали Рефна, Кодзиму и Prada за продвижение ИИ в творческих задачах. «Грустно видеть, как такие великие творцы опускаются до генеративного ИИ-мусора», — посетовал один из зрителей. Судя по всему, среди недовольных роликом оказался и сам Кодзима. В недавнем разговоре с The Washington Post гейм-дизайнер заявил о полном отсутствии интереса к применению ИИ в своём творчестве. «Искусство — жизнь. Через 50, 100 лет, не знаю. Может, ИИ и сможет творить, но пока я жив, думаю, этого не будет. Я не заинтересован. Мы найдём хороший способ использовать технологию, и это задача молодых людей», — уверен Кодзима. Ранее Кодзима уже признавался, что не заинтересован в создании игр с помощью нейросетей, но не стал исключать перспективности ИИ для модификации органов управления или «оживления» NPC. В настоящее время возглавляемая Кодзимой японская студия Kojima Productions готовит к релизу загадочный хоррор OD и шпионский экшен нового поколения под кодовым названием Physint. «ИИ для людей»: Apple противопоставила Siri AI стратегиям OpenAI и Google

09.06.2026 [10:13],

Павел Котов

В последние годы Apple нередко обвиняли в том, что она заняла положение отстающей в гонке в области ИИ. Высказывалось даже мнение, что у компании отсутствует чёткая стратегия по направлению ИИ, она уже лишилась преимущества перед конкурентами, и iPhone грозит спад продаж.

Источник изображения: apple.com Теперь Apple представила крупнейшее обновление экосистемы в области ИИ — сервис и приложение Siri AI с поддержкой автоматизации стороннего ПО на основе модели Google Gemini. Трудно сказать, заставит ли это скептиков изменить позицию по поводу отставания компании. Важно другое: будут ли владельцы устройств Apple фактически пользоваться этими функциями, и если будут, то поможет ли это её бизнесу? Позицию компании сформулировал старший вице-президент по разработке ПО Крейг Федериги (Craig Federighi): «Некоторые, кажется, устремились вперёд, разрабатывая ИИ ради самого ИИ, не обращая должного внимания на людей — всех нас, — кому он призван в конечном итоге служить. Наша в Apple миссия всегда заключалась в том, чтобы превратить потенциал передовых технологий в полезные и интуитивно понятные продукты для всех». С одной стороны, он ответил на критику Apple, с другой — указал на недостатки отрасли ИИ, знакомые потребителям. И, наконец, ответил тем, кто опасается лишиться работы из-за ИИ — компания позиционирует себя как разработчика ИИ, выступающего на стороне человека. Siri научилась находить информацию в дебрях почтовой переписки и истории сообщений и предлагать подсказки на основе этих данных; анализировать данные на экране устройств; и, наконец, находить актуальную информацию в интернете. ИИ-помощник теперь хранит историю переписки и позволяет возвращаться к важным темам. С такими средствами Apple сможет противостоять разработчикам сторонних приложений с ИИ, захвативших первые места в рейтинге App Store — когда продукты с теми же возможностями интегрированы в ОС, они становятся грозными конкурентами. Но говорить об этом можно будет не раньше, чем обновлённая Siri заработает в полную мощь для широкой аудитории. Пока ясно лишь одно: Apple делает всё возможное, чтобы привлечь свою аудиторию — независимо от того, будет та пользоваться новыми продуктами, или нет. Контраст с конкурентами показателен — считающаяся лидером отрасли ИИ OpenAI до сих пор не может определиться, кто её основной клиент: бизнес или потребитель. А Meta✴✴ вкладывает в ИИ колоссальные средства, не объясняя инвесторами, какое это отношение имеет к её основном рекламному бизнесу. Подход Apple теперь представляется более взвешенным и финансово обоснованным: на этот год у неё запланированы $14 млрд капитальных затрат — другие техногиганты довели этот показатель до $900 млрд. При этом на минувший квартал пришлись рекордные продажи iPhone — компания продолжает зарабатывать колоссальные деньги, тратя при этом меньше конкурентов. Apple Intelligence сможет самостоятельно исправлять скомпрометированные пароли

09.06.2026 [10:13],

Анжелла Марина

Apple анонсировала новую функцию в приложении Passwords, которая позволяет автоматически заменять слабые и скомпрометированные пароли. Технология использует Apple Intelligence и браузер Safari для выполнения действий от лица пользователя. Функция расширяет существующую возможность приложения по обнаружению ненадёжных или раскрытых учётных данных, сообщает MacRumors.

Источник изображения: macrumors.com Ранее Passwords только предупреждал о проблемах с данными, но для их исправления требовалось вручную переходить на каждый сайт и менять пароль. Новая система полностью автоматизирует этот процесс и работает по принципу агента, который осуществляет навигацию по веб-сайтам, выполняет вход в аккаунты и обновляет учётные записи для входа без необходимости вмешательства пользователя (после первоначального подтверждения). В момент выполнения операции статус процесса отображается в виде активности в реальном времени (Live Activity) на экране устройства. Внедрение этой возможности направлено на устранение барьеров при поддержании «цифровой гигиены» и повышение общего уровня безопасности пользовательских данных, а автоматизация рутинных процедур позволяет сократить время, необходимое для реагирования на утечки конфиденциальной информации или использование ненадёжных комбинаций символов. Техническая реализация обеспечивает бесшовное взаимодействие между iOS и веб-интерфейсами сторонних ресурсов. Стартап Perplexity заявил, что не торопится с IPO и проведёт его не ранее 2028 года

09.06.2026 [09:40],

Алексей Разин

За последние две недели свои намерения выйти на IPO подтвердили три стартапа из сегмента ИИ, совокупная капитализация которых превышает $3 трлн — это Anthropic, xAI (SpaceX) и OpenAI. Конкурирующая Perplexity сообщает, что подобная активность конкурентов никак не влияет на её планы выйти на биржу только в 2028 году.

Источник изображения: Perplexity Генеральный директор Perplexity Аравинд Сринивас (Aravind Srinivas) признался в этом ресурсу CNBC. По его словам, на IPO этот стартап выйдет в 2028 году вне зависимости от итогов размещения акций Anthropic и OpenAI. Глава стартапа также отметил, что негативные последствия для отрасли могут иметь место при условии, если IPO указанных компаний пройдут не совсем успешно. На этой неделе состоится IPO компании SpaceX, и оно во многом определит, как разместят свои акции Anthropic и OpenAI. Впрочем, генеральный директор Perplexity больше склоняется к благоприятному исходу IPO всех перечисленных компаний. Как он считает, если в течение шести месяцев OpenAI и Anthropic не продемонстрируют прогресса своих ИИ-моделей, то у них могут возникнуть проблемы с точки зрения доверия инвесторов. Пока же этого не происходит, а потому обе компании заслуживают высоких оценок капитализации, по мнению Сриниваса. Сервис Perplexity предлагает выбор между несколькими конкурирующими ИИ-моделями, учитывая сопутствующие расходы. Например, как пояснил глава компании, если модель с открытым исходным кодом в 90 % случаев справляется с заданиями, и при этом в десять или двадцать раз дешевле передовых проприетарных решений, то имеет смысл применять именно её. «Передовой ИИ ждёт прекрасное будущее, но тратить деньги бездумно никто не будет, как мы могли увидеть за несколько предыдущих месяцев», — заявил глава Perplexity. OpenAI подала заявку на IPO, но пока не раскрывает его сроки и параметры

09.06.2026 [08:22],

Алексей Разин

Компания OpenAI, которая номинально является стартапом, на этой неделе сама сообщила о подаче предварительной заявки на IPO американскому регулятору SEC, чтобы пресечь слухи на эту тему. Правда, параметры готовящегося размещения акций амбициозным разработчиком ChatGPT пока скрыты от широкой публики, как не упоминается и дата предстоящего IPO.

Источник изображения: OpenAI В публикации на собственном сайте OpenAI скромно поясняет, что до выхода на биржу хотела бы «сделать некоторые шаги, которые проще сделать, являясь частной компанией». По словам представителей стартапа, есть сложный набор уступок в данном процессе, а потому если в определённый момент станет понятно, что можно выйти на биржу пораньше, компания это сделает. По неофициальным данным, IPO стартапа предварительно намечено на осень текущего года. В идеале, OpenAI хотела бы оценить свою капитализацию в $1 трлн, тем самым присоединившись к конкурирующим Anthropic и входящей в состав SpaceX компании xAI Илона Маска (Elon Musk). Напомним, что текущая капитализация Anthropic достигает $965 млрд, а SpaceX в совокупности с xAI тянет на сумму $1,78 трлн. Обе компании подали заявку на IPO, причём вторая проведёт его на текущей неделе. В условиях, когда нужно соперничать за средства инвесторов, OpenAI решила особо не тянуть с подачей заявки. Что характерно, ещё до выхода на IPO стартап планирует позволить существующим акционером продать свои акции, исходя из мартовской оценки капитализации в $852 млрд. Кроме того, известно о ведении руководством OpenAI переговоров с американским правительством, которое тоже может получить пакет акций стартапа. Глава OpenAI Сэм Альтман (Sam Altman) в своём блоге написал, что сейчас стартап переживает третью фазу своего существования. На первом этапе компания занималась исследованиями в области создания сильного искусственного интеллекта. На втором она пыталась стать «продуктовой компанией» и понять, как люди используют её инструменты. Третья фаза подразумевает трансформацию экономики вокруг ИИ, компания теперь должна определить, как сделать такую технологию общедоступной, безопасной и полезной. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |