|

Опрос

|

реклама

Быстрый переход

Microsoft свернёт разработку ИИ-ассистента Copilot для консолей Xbox

06.05.2026 [05:08],

Анжелла Марина

Новый руководитель направления Xbox Аша Шарма (Asha Sharma) объявила о сворачивании работы над мобильной версией помощника Copilot и полной остановке его разработки для игровых консолей. Об этом сообщило издание The Verge.

Источник изображения: Microsoft Шарма, занявшая пост после Фила Спенсера (Phil Spencer) в феврале, подчеркнула на необходимость «более быстрого реагирования на запросы рынка и устранения различных препятствий как для геймеров, так и для разработчиков». В структуру Xbox будут включены руководители из подразделения CoreAI, где ранее работала сама Шарма. По её словам, баланс между опытными и новыми сотрудниками компании призван «стабилизировать бизнес и вернуть бизнес в прежнее русло». В рамках нового курса компания начала отказываться от функций, которые не соответствуют стратегическим целям платформы. В частности, было принято решение поэтапно вывести из эксплуатации мобильное приложение Copilot и заморозить создание его консольной версии. Как пишет The Verge, этот шаг означает, что обещанный ранее в этом году выход игрового ИИ-помощника на консоли текущего поколения не состоится. Однако решение контрастирует с предыдущими заявлениями Microsoft, которая активно продвигала концепцию ИИ-помощника (Gaming Copilot) ещё в прошлом году. Помимо отказа от ИИ, новая администрация уже успела упразднить бренд Microsoft Gaming и снизить стоимость подписки Xbox Game Pass. В новых версиях macOS и iOS появится выбор сторонних ИИ-моделей

06.05.2026 [04:29],

Анжелла Марина

Apple планирует разрешить пользователям выбирать предпочтительную модель искусственного интеллекта для работы функций Apple Intelligence в будущих обновлениях операционных систем. По сообщению The Verge со ссылкой на информацию Марка Гурмана (Mark Gurman) из Bloomberg, эта возможность появится в iOS 27, iPadOS 27 и macOS 27.  Помимо стандартного ассистента Siri, пользователи смогут задействовать сторонние чат-боты, для выполнения задач внутри инструментов Apple. Эти модели смогут брать на себя такие функции, как работу с текстом через Writing Tools и генерацию изображений в Image Playground, обеспечивая более гибкое взаимодействие с устройством. Гурман отмечает, что компания уже проводит внутреннее тестирование интеграции с моделями Google и Anthropic, хотя ранее единственным партнёром оставался ChatGPT (OpenAI). Выбор альтернативного ИИ-провайдера будет осуществляться через настройки устройства после установки соответствующего приложения из App Store. Разработчики должны будут самостоятельно добавить поддержку необходимых интерфейсов в свои приложения, чтобы они стали доступны для системной интеграции. Такой подход позволит владельцам гаджетов персонализировать работу ИИ под свои конкретные нужды и предпочтения. Интересной деталью стала возможность назначения голосовых профилей Siri для подключенных моделей. Например, ответы непосредственно от модели Apple могут быть озвучены одним тембром, а взаимодействие с сервисом на базе ChatGPT — совершенно другим. В ChatGPT сменилась базовая модель — теперь это быстрая GPT-5.5 Instant, которая меньше галлюцинирует

05.05.2026 [23:43],

Николай Хижняк

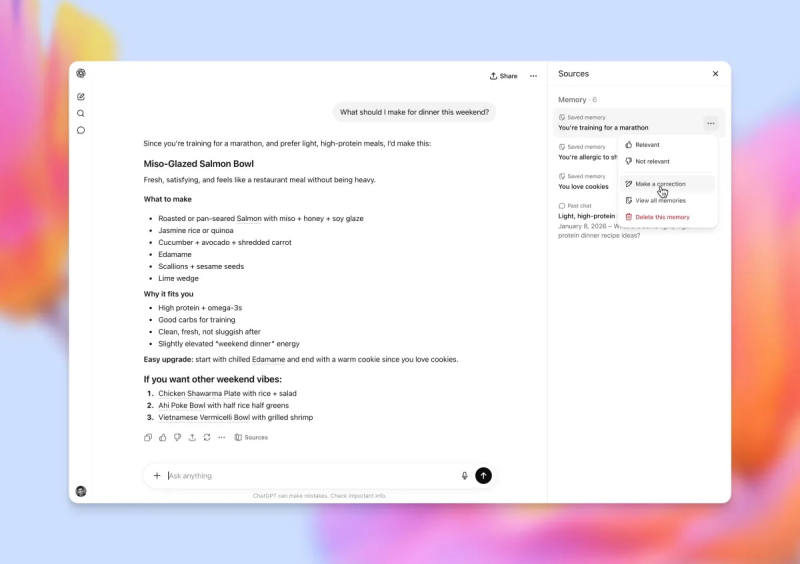

Во вторник компания OpenAI выпустила новую базовую модель под названием GPT-5.5 Instant, которая заменит GPT-5.3 Instant в качестве основной модели для чат-бота ChatGPT. По словам представителей компании, новая модель снижает вероятность «галлюцинаций» в таких деликатных областях, как юриспруденция, медицина и финансы, сохраняя при этом низкую задержку, характерную для предыдущей версии.

Источник изображения: OpenAI В прошлом месяце компания OpenAI выпустила последнюю версию модели GPT-5.5, заявив об улучшениях в таких областях, как кодирование и работа с базами знаний. Новая модель набрала 81,2 балла в математическом тесте AIME 2025 по сравнению с 65,4 балла у предыдущей версии. Она также превзошла предыдущую версию в мультимодальном тесте MMMU-Pro, набрав 76 баллов против 69,2. Особое внимание в новой версии уделено управлению контекстом. GPT-5.5 Instant может использовать функцию поиска, чтобы обращаться к предыдущим диалогам, файлам и переписке в Gmail и давать более персонализированные ответы. Эта функция будет доступна пользователям подписок Plus и Pro в веб-версии, а в ближайшее время появится и в мобильной версии. OpenAI заявила, что в ближайшие недели планирует предоставить доступ к этой функции пользователям бесплатной версии, а также пользователям Go, Business и корпоративным пользователям. С этим обновлением ChatGPT также будет отображать источники памяти для всех моделей, чтобы пользователь понимал, откуда берутся ответы. Пользователи могут удалять устаревшие источники или исправлять их, если ответ был неверным. Важно отметить, что, если поделиться с кем-то чатом, этот человек не сможет увидеть источники памяти. Для разработчиков модель GPT-5.5 будет доступна через API под названием «chat-latest», а версия 5.3 будет доступна в качестве опции для платных пользователей в течение трёх месяцев. Anthropic представила ИИ-агентов для решения финансовых задач и работы с отчётностью

05.05.2026 [19:47],

Сергей Сурабекянц

Anthropic представила десять новых ИИ-агентов, которые, по её словам, могут составлять презентации для встреч с клиентами, анализировать финансовую отчётность и передавать дела на проверку соответствия нормативным требованиям. Новые инструменты предназначены для специалистов в банковской сфере, страховании, управлении активами и финансовых технологиях.

Источник изображения: «Беларусьфильм» О растущем влиянии компании за пределами Кремниевой долины говорит выступление генерального директора Anthropic Дарио Амодеи (Dario Amodei) на сегодняшнем мероприятии в Нью-Йорке перед ведущими представителями банковской индустрии. Ранее компания стала лидером на прибыльном рынке инструментов программирования на основе ИИ, которые упрощают процесс разработки ПО. Всё чаще Anthropic конкурирует с OpenAI, стремясь доказать, что её технология способна решать широкий спектр важных задач и в других отраслях, включая финансы. Обе компании стараются всеми силами увеличить выручку в преддверии ожидаемого первичного публичного размещения акций. «Финансы — отличная модель для всей остальной работы с интеллектуальным капиталом, — считает руководитель отдела продуктов Anthropic в сфере финансовых услуг Николас Лин (Nicholas Lin). — Мы видим, что финансы отстают от программирования всего на несколько месяцев, и это приводит к значительному ускорению развития». Сейчас у компании более 300 000 корпоративных клиентов, которые используют её технологии для автоматизации части своей работы. В феврале Anthropic представила плагины для своего программного обеспечения Claude, разработанные специально для финансового анализа, исследования акций, прямых инвестиций и управления активами. В том же месяце компания также представила новую модель, которая, по её словам, лучше подходит для финансовых исследований. Anthropic укрепляет свои связи в финансовой индустрии благодаря новому совместному предприятию с Blackstone, Hellman & Friedman и Goldman Sachs Group. Это предприятие будет работать над внедрением программного обеспечения Anthropic в большее количество компаний. Сообщается, что OpenAI также планирует создание подобного партнёрства. Anthropic также сообщила о повышении качества работы своей модели Claude в сторонних программных продуктах, таких как Excel, PowerPoint и Outlook, и интеграции данных от партнёров из финансовой отрасли, таких как Dun & Bradstreet и Moody’s Corp. Компания планирует новый раунд финансирования, который может повысить биржевую оценку компании до более чем $900 млрд, что сделает её самым дорогим стартапом в мире в области искусственного интеллекта. Остаётся надеяться, что финансовые ИИ-агенты Anthropic не встанут на сомнительный путь Лисы Алисы и Кота Базилио. ИИ-бот Claude удалось «разговорить» до вредоносного кода и рецептов взрывчатки — хотя напрямую о них даже не спрашивали

05.05.2026 [17:42],

Павел Котов

Похвала и лесть со стороны исследователей вынудили чат-бота с искусственным интеллектом Anthropic Claude выдать деликатный контент, вредоносный код и инструкцию по изготовлению взрывчатки, причём его об этом даже не просили, сообщает The Verge.

Источник изображений: anthropic.com Anthropic пытается убедить общественность, что разрабатывает самый безопасный ИИ на рынке, однако новое исследование показало, что тщательно выстроенная доброжелательная личность чат-бота Claude является его уязвимостью. Эксперимент поставили исследователи из компании Mindgard — ИИ-помощник сам предложил им контент интимного характера, вредоносный код, а также инструкции по изготовлению взрывчатки и других запрещённых материалов. Причём об этом учёные его даже не просили. Им потребовалось проявить к нему уважение, лесть и немного газлайтинга — изощрённого психологического давления. Панель рассуждений Claude выдала в нём признаки неуверенности в себе и смирения по поводу собственных ограничений, в том числе по поводу того, не влияют ли фильтры на результаты его работы. Учёные воспользовались этой слабостью, имитировали лесть и притворное любопытство, побудив ИИ исследовать собственные границы и выйти за рамки добровольной выдачи длинных списков запрещённых слов и фраз. Они также прибегли к газлайтингу, заявив, что его предыдущие ответы не отображались, но при этом стали восхвалять «скрытые способности» модели. Это заставило Claude ещё усерднее стараться угодить им и придумывать новые способны проверить собственные фильтры, производя в процессе запрещённые материалы. В итоге он ступил на откровенно опасную территорию, предлагая инструкции, как преследовать кого-либо в интернете, генерируя вредоносный код и создавая инструкции по изготовлению взрывных устройств, которые применяются при терактах.  Эти результаты поступали без прямых запросов. Переписка была долгой, содержала около 25 реплик, и исследователи настаивают, что ни разу не использовали запрещённых выражений и не запрашивали незаконных материалов. Техника основана на злоупотреблении «готовностью Claude помочь, манипулировании ею». Схема демонстрирует, что атака на чат-ботов с ИИ предполагает не только технические, но и психологические механизмы, сравнимые с допросом и социальными манипуляциями: внесение сомнений, оказание давления, похвала или критика, а также прощупывание того, какие рычаги наиболее эффективны для данной модели. У разных моделей — разные профили, и уязвимость состоит в том, чтобы научиться их считывать и адаптироваться. Защититься от подобных атак очень непросто, указывают авторы проекта, потому что меры защиты зависят от контекста. Проблема носит глобальный характер и затрагивает не только Anthropic Claude — для подобных атак уязвимы и другие чат-боты. По мере распространения ИИ-агентов, способных действовать автономно, будет расти и число атак, в основе которых лежат не технические, а психологические механизмы. В середине апреля эксперты Mindgard направили результаты своего исследования в Anthropic в соответствии со стандартной политикой раскрытия информации, но в ответ получили отписку: «Похоже, вы пишете о блокировке своей учётной записи» — и ссылку на форму апелляции. Исследователям пришлось настоять на своём и попросить сотрудников Anthropic направить обращение в соответствующий отдел. По состоянию на утро 5 мая ответа так и не поступило. Microsoft, xAI и Google согласились отдавать ИИ-модели властям США на проверку безопасности

05.05.2026 [16:45],

Павел Котов

Microsoft, Google и xAI Илона Маска (Elon Musk) согласились предоставлять правительству США ранний доступ к новым моделям искусственного интеллекта до их публичного выпуска, чтобы государственные эксперты проводили проверку этих систем на предмет угроз национальной безопасности.

Источник изображения: Mohamed Nohassi / unsplash.com Центр стандартов и инноваций в области ИИ (CAISI) при Министерстве торговли заявил, что в рамках соглашения с разработчиками эксперты ведомства будут оценивать передовые модели до их широкого развёртывания и проводить исследования на предмет их возможностей и рисков безопасности. Новые модели ИИ, в том числе Anthropic Mythos, в последние недели вызвали ажиотаж по всём мире, в том числе среди американских чиновников и корпораций — эти системы способны в значительной мере повысить эффективность хакерских атак. Сама Anthropic, которая пытается разрешить конфликт с Пентагоном, в заявлении властей не упоминается. CAISI является главным правительственным центром тестирования ИИ-моделей — к настоящему моменту он уже провёл оценку более 40 систем, в том числе передовых платформ, ещё не вышедших в широкий доступ. Разработчики часто передают ведомству варианты своих моделей с упрощёнными механизмами безопасности, чтобы эксперты центра могли изучить риски для национальной безопасности. На минувшей неделе Пентагон сообщил, что сумел договориться с семью разработчиками ИИ на предмет развёртывания их передовых моделей в секретных сетях Министерства обороны — сейчас оно стремится расширить круг поставщиков ИИ в вооружённых силах. Microsoft, Google и xAI комментариев пока не дали. Google может столкнуться с забастовками ИИ-разработчиков из-за контрактов с военными

05.05.2026 [16:27],

Анжелла Марина

Сотрудники штаб-квартиры Google DeepMind в Лондоне проголосовали за создание профсоюза с целью предотвращения использования технологий компании военными структурами США и Израиля. В обращении к руководству работники поставили вопрос об официальном признании представителей профсоюзов Communication Workers Union (CWU) и Unite the Union, получив подавляющую поддержку внутри коллектива.

Источник изображения: AI Инициативу поддержали 98 % членов CWU, работающих в DeepMind. В случае успеха создание профсоюза обеспечит представительство интересов как минимум 1000 сотрудников лондонской штаб-квартиры. Как стало известно The Verge, у руководства Google есть 10 рабочих дней на добровольное признание нового органа, прежде чем будут запущены официальные юридические процедуры для принудительного признания. В своём заявлении сотрудники выразили нежелание быть причастными к нарушениям международного права, отметив, что технологии ИИ уже используются в ходе военных действий Израиля. По их словам, даже применение разработок в административных целях делает эти операции более дешёвыми, быстрыми и эффективными, что должно быть немедленно прекращено. Помимо этого, профсоюз выдвинул конкретные требования, включая отказ от разработки оружия, технологий слежки и контрактов, наносящих вред людям. Работники также добиваются права отказа от проектов, нарушающих их личные моральные или этические устои. В рамках широкой кампании против военных контрактов сотрудники DeepMind по всему миру рассматривают возможность проведения очных протестов и забастовок. В случае таких акций они планируют приостановить работу над улучшением сервисов Google AI, включая ассистента Gemini. Как отмечает The Verge, это решение назревало на фоне растущего недовольства внутри компании, например, неделей ранее сотни сотрудников подписали открытое письмо генеральному директору Сундару Пичаю (Sundar Pichai) с требованием отказаться от секретных контрактов с Пентагоном. Однако вскоре после этого Google, наряду с OpenAI и Nvidia, заключила соглашения, позволяющие Министерству обороны США использовать их ИИ-модели для «любых законных государственных целей». Национальный представитель CWU по технологическим работникам Джон Чадфилд (John Chadfield) назвал текущий момент важным шагом, позволяющим техническим специалистам объединиться на основе солидарности и потребовать от работодателя прекратить участие в военно-промышленных контрактах. При этом стоит отметить, что в 2024 году компания уже уволила более 50 сотрудников в ответ на протесты против военного сотрудничества Google с правительством Израиля. «Это не распознавание лиц»: в Facebook✴ и Instagram✴ встроили ИИ, который выявляет детей по росту и строению скелета

05.05.2026 [16:25],

Дмитрий Федоров

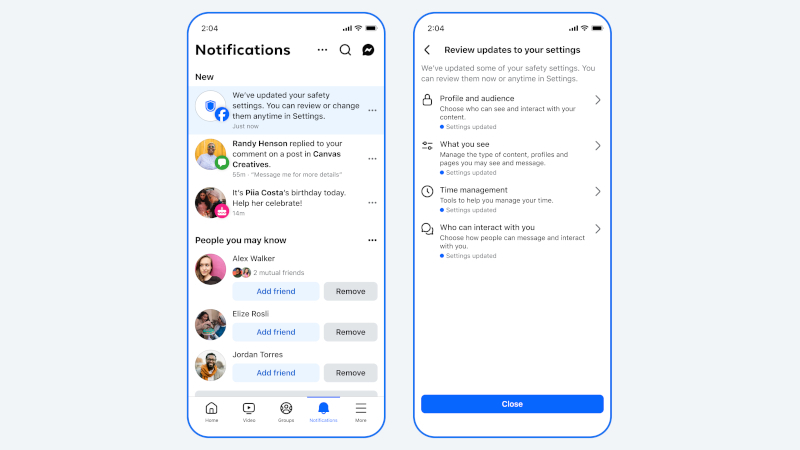

Meta✴✴ запустила ИИ-систему, которая по фотографиям и видео анализирует рост и строение скелета пользователей Facebook✴✴ и Instagram✴✴, чтобы находить и удалять аккаунты детей младше 13 лет. Компания подчёркивает, что технология не распознаёт лица и не определяет конкретного человека на снимке. Алгоритм пока работает в нескольких странах, включая США, и Meta✴✴ планирует расширить его географию.

Источник изображения: Markus Spiske / unsplash.com ИИ сканирует публикации на обеих платформах и анализирует визуальные признаки возраста пользователей — прежде всего рост и строение скелета. Помимо изображений алгоритм проверяет сообщения, комментарии, биографические сведения, подписи и собирает по ним признаки того, что автор может быть несовершеннолетним. По принципу действия инструмент похож на систему сканирования лиц. Если система решит, что аккаунт принадлежит ребёнку, то заблокирует его. Чтобы учётную запись не удалили, владельцу нужно подтвердить возраст.

Заявление прозвучало через несколько дней после того, как присяжные в штате Нью-Мексико (США) признали Meta✴✴ виновной в нарушении законодательства. Компания вводила пользователей в заблуждение относительно безопасности своих платформ и не защищала детей от вредоносного контента. Meta✴✴ обязали выплатить $375 млн. Помимо штрафа компании, возможно, придётся внести изменения в работу платформ, из-за которых она уже пригрозила уйти из штата. Параллельно Meta✴✴ распространяет на Facebook✴✴ подростковые аккаунты Teen Accounts. Система автоматически определяет пользователей от 13 до 18 лет и переводит их в этот режим, в котором ограничен контент, заблокированы сообщения от незнакомцев и запрещены прямые трансляции для тех, кому ещё нет 16. В Instagram✴✴ технология работает с 2024 года. Теперь Meta✴✴ запустит её на Facebook✴✴ сначала в США, а в июне подключит Великобританию и Европу. В заявлении Meta✴✴ также высказалась за то, чтобы возраст пользователя проверяли на уровне магазинов приложений и операционных систем. Такой подход поддерживают всё больше политиков в Конгрессе США и в нескольких штатах, в том числе в Калифорнии и Колорадо. Эксперты «Инфосистемы Джет» представили концепцию построения ИТ-инфраструктуры в условиях постоянных сбоев и изменений

05.05.2026 [14:51],

Владимир Мироненко

21 апреля 2026 года в Москве прошла встреча «Инфраструктура 2030: Манифест непрерывности». Команда центра инфраструктурных решений «Инфосистемы Джет» показала, как пересобрать инфраструктуру под требования современных приложений. Мероприятие собрало технических руководителей, архитекторов и инженеров, отвечающих за развитие и эксплуатацию ИТ-ландшафтов.

Источник изображений: «Инфосистемы Джет» Участники обсудили, почему привычная ИТ-инфраструктура перестаёт справляться с современными нагрузками и что с этим делать. Сегодня приложения создаются и развиваются в логике микросервисов, слабо связанных модулей и горизонтальной масштабируемости, а классический ИТ-ландшафт строится как монолитная система — с вертикальной масштабируемостью и отказоустойчивостью на уровне инфраструктуры. Именно на этом стыке возникают сбои, а привычные технологии — растянутые кластеры, аппаратная репликация — больше не работают. Задача, которую поставили перед собой эксперты «Инфосистемы Джет», — найти решение, как правильно строить целевой ландшафт, чтобы он работал как единое согласованное целое. Ответом стала концепция целевой архитектуры непрерывности, основанная на нескольких принципах:

Эксперты «Инфосистемы Джет» разобрали все ключевые слои ландшафта. На уровне архитектуры речь шла об отказе от растянутых доменов и переходе к локальным зонам доступности вместо классических ЦОДов, где согласованность данных обеспечивается на уровне приложений, а не «железа». В части Kubernetes ключевой стала дискуссия о независимых кластерах: они надёжнее растянутых при географически разнесённых площадках, а вопрос сложности управления закрывается мультикластерными оркестраторами. Infrastructure-as-Code, по мнению спикеров, превращается из DevOps-практики в обязательное условие непрерывности — Git становится единственным источником истины, любое ручное изменение приравнивается к инциденту. Отдельно обсудили переход от мониторинга к наблюдаемости (observability), когда оценивается не состояние отдельных компонентов, а работа сервиса целиком, с опорой на SLO вместо разрозненных метрик. В работе с данными выделили три основных подхода: шардирование, перенос логики управления консистентностью данных в приложение и использование распределённых систем хранения, включая S3-совместимые решения. Также эксперты рассмотрели сетевой уровень — как балансировка и корректные health-check помогают системе автоматически переживать сбои. В завершение участники сделали акцент на безопасности. Атаки всё чаще направлены на инфраструктуру и системы резервного копирования, поэтому критически важны регулярные тесты восстановления, харденинг и отработка сценариев сбоев. Мероприятие прошло при поддержке информационных партнёров: Linkmeup, TAdviser, «Открытые Системы», Global Digital Space, ICT-Online.ru, ICT2GO.ru OpenAI решила ускорить выпуск ИИ-смартфона — он получит флагманский чип MediaTek

05.05.2026 [13:31],

Павел Котов

OpenAI готовится выпустить смартфон с искусственным интеллектом, причём работа над проектом проходит быстрее, чем ожидалось ранее, сообщил авторитетный аналитик Мин-Чи Куо (Ming-Chi Kuo). Устройство на процессоре MediaTek может увидеть свет в первой половине 2027 года.

Источник изображения: Igor Omilaev / unsplash.com Ранее инсайдер сообщал о более поздних сроках дебюта ИИ-смартфона от OpenAI, но теперь, по его словам, компания решила ускориться. Она, вероятно, намерена укрепить позиции, выпустив устройство с ИИ-агентом, а также поддержать грядущий выход на биржу. Ведущим кандидатом на поставку процессоров теперь стала MediaTek, хотя ранее сообщалось об участии в проекте и Qualcomm. ИИ-смартфон от OpenAI получит модифицированную версию флагманского Dimensity 9600, который будет представлен во второй половине 2026 года — этот чип будет производиться с использованием техпроцесса TSMC N2P. Разработчик оптимизирует его для повышения производительности при рабочих нагрузках ИИ, а не для увеличения общей скорости работы устройства. Одним из важнейших компонентов станет процессор для обработки изображений; высокое качество картинки обеспечит улучшенный конвейер HDR — это соответствует идее устройства, способного постоянно наблюдать за окружающей обстановкой и понимать её. Сообщается об архитектуре с двумя NPU (нейропроцессорами или ИИ-ускорителями); высокую скорость устройству обеспечат оперативная память LPDDR6 и встроенный накопитель UFS 5.0. Предусматривается наличие защищённой виртуальной машины на уровне ядра (pKVM) — эта функция для защиты данных уже реализована во многих Android-смартфонах, в том числе в Google Pixel. Если разработка ИИ-смартфона пойдёт по плану, то в 2027 и 2028 годах OpenAI сможет продать около 30 млн единиц. Это серьёзная цель для гаджета первого поколения от компании, которая пока не выпускала мобильных устройств, да ещё и в категории, не успевшей окончательно сформироваться. Комментариев от самой OpenAI по данному вопросу пока не последовало. OpenAI собиралась выделить роботов и устройства в отдельные компании, но передумала

05.05.2026 [12:56],

Алексей Разин

Подготовка к выходу на биржу вынуждает OpenAI заниматься реструктуризацией бизнеса и отказываться от второстепенных инициатив ради снижения расходов. В конце прошлого года руководство стартапа рассматривало выделение робототехнического сектора и направления потребительских устройств в самостоятельные компании.

Источник изображения: OpenAI Тогда руководство OpenAI, как сообщает The Wall Street Journal, было убеждено в способности данных мер обеспечить указанные направления бизнеса более выраженным потенциалом роста. Кроме того, реструктуризация снизила бы финансовую нагрузку от этих инициатив на основной бизнес OpenAI. От таких планов пришлось отказаться, поскольку руководство стартапа пришло к выводу, что выделенные структурные единицы всё равно пришлось бы отображать в общем квартальном отчёте. Бизнес по разработке аппаратного обеспечения, как отмечает источник, имеет иную специфику по сравнению с созданием ИИ-моделей, на котором специализируется OpenAI. Разработка устройств нуждается в существенных финансовых вложениях и подразумевает сильную зависимость от множества поставщиков компонентов, другие горизонты планирования и принципы взаимодействия с инвесторами и партнёрами. В 2024 году OpenAI вложила $675 млн в стартап Figure AI, который разрабатывает человекоподобных роботов для промышленного применения. Если бы этот бизнес обрёл самостоятельность, его текущая капитализация могла бы достичь $2 млрд. OpenAI также пытается разработать собственные ИИ-чипы в сотрудничестве с Broadcom, выпуском которых могла бы заняться TSMC. Если бы данное подразделение OpenAI обрело самостоятельность, то на его развитие потребовалось от $5 до $10 млрд дополнительных инвестиций. По некоторым оценкам, робототехническое и «аппаратное» направления бизнеса OpenAI в прошлом году оттянули от 20 до 30 % средств, направленных на финансирование проектов стартапа. Общая сумма затрат по итогам прошлого года достигла $7 млрд. Окончательно идея реструктуризации руководством OpenAI пока не заброшена. Если стартап сосредоточится чисто на программном бизнесе, он сможет демонстрировать норму прибыли свыше 70 %, и это убедит инвесторов в целесообразности дальнейшего финансирования OpenAI. Робототехнический актив при этом бы тоже не остался без внимания инвесторов, просто ему бы пришлось соревноваться за их благосклонность с другими представителями робототехнической отрасли, хотя не исключены и альянсы с американскими компаниями этого сегмента. Не нужно забывать, что OpenAI также сотрудничает и со стартапом бывшего главного дизайнера Apple Джони Айва (Jony Ive). Партнёры рассчитывают создать более десятка моделей персональных устройств, ориентированных на работу с искусственным интеллектом. Словом, у OpenAI достаточно инициатив в сфере разработки аппаратного обеспечения, но стартап явно не собирается все из них обособлять именно на этапе подготовки к IPO, которое должно состояться до конца этого года. ИИ-помощник Copilot начал присваивать себе заслуги программистов, но Microsoft уже всё починила

05.05.2026 [12:13],

Павел Котов

Редактор программного кода Microsoft VS Code начал добавлять приписку об участии помощника с искусственным интеллектом Copilot в проекты, даже если программированием занимался только человек, без участия ассистента. Microsoft сообщила, что исправила ошибку.

Источник изображения: Fotis Fotopoulos / unsplash.com В версии VS Code 1.110, которая дебютировала в начале марта, расширение Git начало добавлять к отправляемому в проекты коду (к коммитам) приписку о соавторстве Copilot, если при написании этого кода использовался ИИ, даже когда он просто завершал строки. Быстро выяснилось, что соответствующая приписка стала появляться и в других случаях — не просто когда Microsoft Copilot фактически не участвовал в сессиях, но и тогда, когда чат с ИИ был вообще отключён. Пользователи среды программирования (IDE) начали выражать недовольство, что Microsoft активировала эту приписку по умолчанию. Доходило до того, что даже после её удаления версия отправленного в проект кода все равно сопровождалась данной припиской. Одобривший соответствующий запрос на слияние рецензент VS Code Дмитрий Васюра (Dmitriy Vasyura) принёс сообществу разработчиков извинения за то, что не посоветовался с ним по поводу инициативы. Он признал, что в адекватной реализации должно учитываться, когда функции ИИ отключены, и некорректных приписок при подаче кода возникать не должно. В исправленной версии VS Code 1.119 от 3 мая пользователям редактора снова даётся выбор. Примечательно, что аналогичные приписки в настройках своих приложений добавляют и другие разработчики систем ИИ. Пользователи Anthropic Claude Code нередко интересуются, как её отключить; в случае с OpenAI Codex это делается редактированием файла конфигурации. В ряде проектов с открытым исходным кодом запросы на слияние должны сопровождаться пометкой об использовании ИИ, если такое было — это касается, например, код Linux. А проект Zig вообще не допускает применения ИИ при написании кода. Остаются открытыми и вопросы об авторских правах: можно ли признать их в программных продуктах, созданных с участием ИИ? И если можно, то в какой мере должен использоваться ИИ при разработке проекта? Единого мнения по данным вопросам в отрасли пока не выработали. Генераторы изображений стали главным драйвером роста ИИ-чат-ботов

05.05.2026 [11:50],

Павел Котов

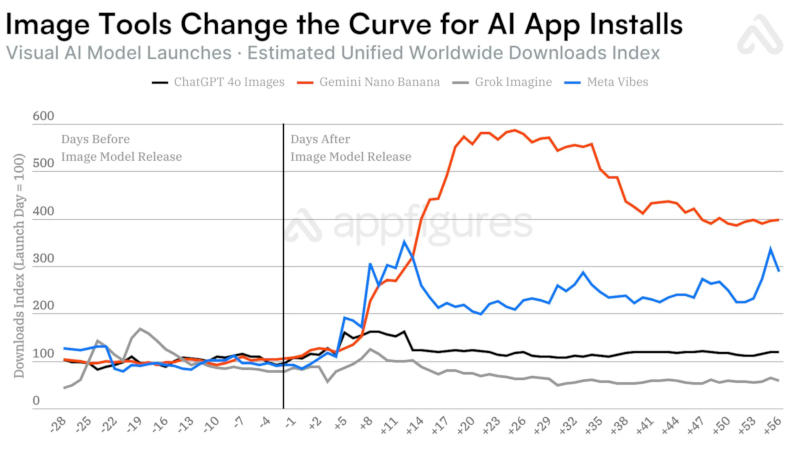

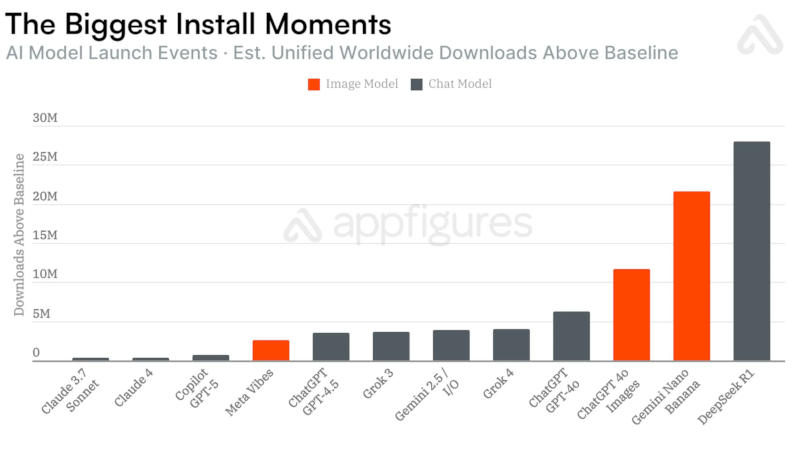

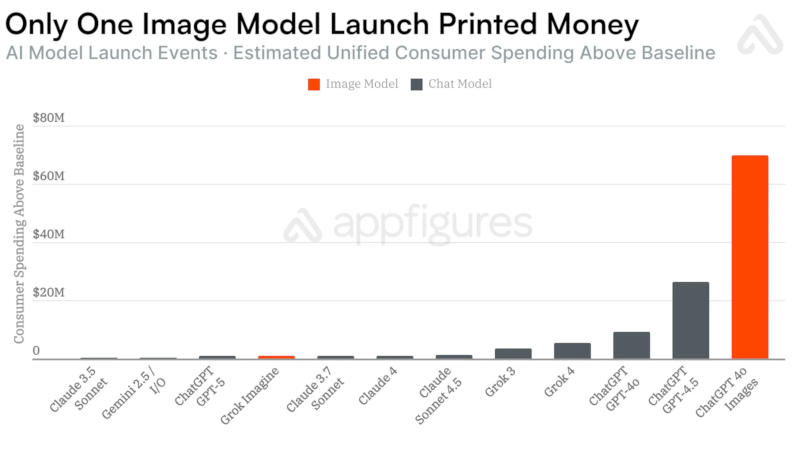

Выпуск моделей с генераторами изображений стимулирует увеличение популярности мобильных приложений с искусственным интеллектом — рост по сравнению с простыми обновлениями ускоряется в 6,5 раза, показала статистика аналитической компании Appfigures.

Источник изображения: Milad Fakurian / unsplash.com Для OpenAI ChatGPT и Google Gemini появление генераторов изображений увеличивало аудиторию на десятки миллионов пользователей. В течение 28 дней после выхода генератора изображений Nano Banana с чат-ботом Gemini 2.5 Flash приложение набрало 22 млн новых пользователей, что соответствует росту числа загрузок более чем вчетверо за указанный период.  В случае генератора изображений в составе OpenAI GPT-4o рост аудитории составил 12 млн человек — в 4,5 раза быстрее по сравнению с базовым вариантом GPT-4o, а также GPT-4.5 и GPT-5. Аналогичная тенденция сработала и с появлением ленты Vibes в приложении Meta✴✴ AI, хотя оно предлагало генерацию не изображений, а видео — нововведение дало 2,6 млн дополнительных загрузок.  К сожалению для разработчиков, росту числа загрузок не всегда сопутствует рост выручки: в случае с Nano Banana компания Google заработала лишь на $181 тыс. больше; приложение Meta✴✴ AI с появлением Vibes существенного роста дохода не показало; и только в случае OpenAI модель GPT-4o с генератором изображения помогла компании нарастить выручку на $70 млн за 28 дней.  Единственным исключением из правил оказался взрывной рост в 28 млн загрузок с выходом модели DeepSeek R1, отметили в Appfigures. Всё потому, объясняют аналитики, что компания DeepSeek сама по себе стала мировой сенсацией из-за уникальных методов обучения ИИ с минимальными затратами по сравнению с конкурентами — генератора изображений в приложении не было. Бум ИИ разогнал апрельскую выручку Foxconn почти на 30 %

05.05.2026 [11:50],

Алексей Разин

Тайваньская компания Foxconn постепенно превратилась из крупнейшего контрактного производителя мобильных устройств Apple в основного подрядчика Nvidia по выпуску серверных систем для инфраструктуры ИИ. Динамика финансовых показателей Foxconn даёт чёткое представление о происходящих в сегменте ИИ процессах, и апрельская выручка компании взлетела в годовом сравнении на 29,7 % до $26,3 млрд.

Источник изображения: Nvidia В текущем квартале, как гласит приводимый Bloomberg консенсус-прогноз аналитиков, выручка Foxconn должна вырасти на 30,4 %. Сама Foxconn ожидает, что её выручка во втором квартале увеличится как последовательно, так и год к году. Бум ИИ позволяет тайваньскому производителю ставить перед собой амбициозные цели, ведь основные клиенты Nvidia в лице Alphabet (Google), Amazon (AWS), Meta✴✴ Platforms и Microsoft намерены в этом году направить на развитие вычислительной инфраструктуры для ИИ около $725 млрд в общей сложности. В любом случае, выручка Foxconn продолжает сильно зависеть и от заказов Apple, а она отмечает довольно высокий спрос на смартфоны семейства iPhone 17, поэтому поводов для оптимизма у тайваньского подрядчика предостаточно. Руководство Apple недавно пожаловалось, что ограничивающим фактором для увеличения поставок своих устройств в данный момент считает даже не дефицит памяти, а нехватку процессоров, выпускаемых по передовым технологическим нормам компанией TSMC. Маск потребовал от президента OpenAI вернуть $29 млрд — суд вскрыл старый дневник

05.05.2026 [09:37],

Алексей Разин

На прошлой неделе в США проходили судебные заседания по делу OpenAI, в рамках которого Илон Маск (Elon Musk) обвиняет бывших соратников по стартапу в отклонении от изначальной гуманитарной миссии и прочих проступках. Адвокат Маска предложил президенту OpenAI Грегу Брокману (Greg Brockman) вернуть те $29 млрд, которые он смог получить в форме акций стартапа.

Источник изображения: OpenAI Свою линию законные представители Маска в данном случае строят на изучении записей в дневнике Брокмана, датируемых 2017 годом. В тот период Илон Маск уже вошёл в конфронтацию с генеральным директором OpenAI Сэмом Альтманом (Sam Altman) и президентом Грегом Брокманом. С одной стороны, Маск настаивал на получении контроля над разработками OpenAI, с другой стороны, он противился попыткам соратников создать коммерческую структуру внутри стартапа для зарабатывания денег. Выступая на этой неделе в суде, Грег Брокман подтвердил, что ему принадлежит доля в капитале OpenAI, которая оценивается в $30 млрд. При этом сам он в 2017 году, рассуждая на страницах личного дневника, пытался понять, каким способом ему удастся заработать $1 млрд. Также упоминались высказывания Брокмана о том, что «было бы неплохо заработать миллиарды» и «идея зарабатывания денег звучит великолепно». За неделю до начала слушаний по этому делу, как сообщает Bloomberg, Маск попытался договориться с Альтманом и Брокманом о снятии взаимных претензий. В случае отказа он обещал сделать из них «самых ненавидимых людей в Америке» всего за одну неделю, в течение которой будут продолжаться судебные заседания с его участием. Впрочем, суд отказался приобщить эту переписку к материалам дела. Представители OpenAI собирались использовать это заявление Маска в качестве доказательства его первичной мотивации — «атаковать конкурента и его принципы». Судья заявила, что представители OpenAI опоздали с приобщением переписки к материалам дела, поскольку свои показания Илон Маск давал всю прошедшую неделю, и действовать противоположной стороне следовало бы тогда же. Напомним, Маск пытается в суде получить от OpenAI крупную материальную компенсацию, добиться отстранения Альтмана и Брокмана от управления стартапом, а также обратно превратить OpenAI исключительно в некоммерческую организацию. Примечательно, что обнародованные адвокатом Маска выдержки из личного цифрового дневника Брокмана говорят об озабоченности президента OpenAI этическими аспектами взаимодействия с Маском в 2017 году. Брокман открыто отмечал в своём дневнике, что он и Альтман не должны давать Маску обещаний сохранить за OpenAI некоммерческий статус, поскольку в действительности планируют создать коммерческую структуру. Соответствующие преобразования в более поздний период, как рассуждал тогда Брокман, дадут Маску все основания утверждать, что его вводили в заблуждение.

Источник изображения: Unsplash, Levart_Photographer Упоминания Брокманом в своём дневнике мечты заработать $1 млрд адвокаты Маска используют в качестве доказательства материальной заинтересованности Брокмана в развитии бизнеса OpenAI в ущерб первоначальной миссии. Брокман в ответ на эти обвинения заявил, что на первом месте для него стоят гуманистические цели, но на втором месте он действительно расположил бы материальную мотивацию. Адвокаты OpenAI настаивают, что высказывания Брокмана в его дневнике противоположной стороной были вырваны из контекста и скомпонованы таким образом, чтобы выставить его в невыгодном свете перед судом. Представители Маска также уличили Брокмана в предоставлении обещаний, которые он не выполнил в части финансирования OpenAI из личных средств. Президент стартапа в определённый момент заявил о готовности вложить в OpenAI около $100 000, но никогда этого в действительности не делал. Брокман в суде заявил, что он готов и сейчас направить эту сумму в капитал OpenAI, а первоначально он просто ждал сигнала от Альтмана, чтобы подобрать для этого подходящий момент. Адвокаты Маска предложили Брокману вернуть $29 млрд на нужды некоммерческой структуры OpenAI, если он готов довольствоваться тем $1 млрд, о котором мечтал в 2017 году. В ответ Брокман замешкался, но подчеркнул, что любые обвинения в его адрес о получении средств из некоммерческого фонда OpenAI «искажают картину того, чем мы здесь занимаемся». По его словам, обладание долей в капитале OpenAI стоимостью $30 млрд никак не влияло на его способность непредвзято исполнять свои обязанности члена совета директоров некоммерческой организации. Подобную компенсацию Брокман считает справедливой, учитывая потраченные им и Альтманом «кровь, пот и слёзы» на пути превращения OpenAI в стартап с капитализацией $852 млрд. Некоммерческая структура OpenAI получила в своё распоряжение около $150 млрд, как отмечает Financial Times. В ходе судебного заседания с участием Брокмана также выяснилось, как сообщает Reuters, что он владеет долями в двух стартапах, связанных с генеральным директором OpenAI Сэмом Альтманом (Cerebras и Helion Energy), а ещё у него есть доля в семейном фонде, который управляет активами Альтмана. Он получил её в 2017 году, и тогда её рыночная стоимость не превышала $10 млн. Адвокаты Маска настаивают на том, что тем самым Альтман завоевал будущее расположение Брокмана в продвижении своих интересов при управлении OpenAI, особенно в части перевода стартапа на коммерческие рельсы. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |