|

Опрос

|

реклама

Быстрый переход

Создатель Roomba представил Familiar — робота-питомца с локальным ИИ и «собственным характером»

05.05.2026 [06:29],

Дмитрий Федоров

Колин Энгл (Colin Angle), создатель робота-пылесоса Roomba и человек, благодаря которому в домах людей появились 50 млн бытовых роботов, представил на этой неделе первого робота своей новой компании Familiar Machines & Magic. Четвероногое устройство размером с собаку рассчитано не на уборку, а на эмоциональный контакт с владельцем: оно работает на локальной генеративной ИИ-модели и должно формировать «собственный характер».

Источник изображений: familiarmachines.com Робота назвали Familiar — название отсылает к фольклорному образу сверхъестественного компаньона. Внешне устройство напоминает нечто среднее между медведем, сипухой и золотистым ретривером. У него выразительная морда с подвижными бровями, ушами и глазами. На демонстрационном видео четвероногий робот самостоятельно перемещается по дому, как настоящий питомец. Новинка дебютировала на этой неделе на конференции WSJ Future of Everything. Энгл назвал устройство «физически воплощённой ИИ-системой», которое будет использовать локальную генеративную ИИ-модель для взаимодействия с владельцем, выстраивать с ним эмоциональную связь и даже развивать «собственный характер».  Роботы, способные реагировать на человека и отвечать ему, теоретически должны быть эффективнее в том, что Энгл называет «ролями с высокой степенью человеческой связи»: компаньонстве, развлечениях, гостеприимстве, умном доме, уходе за пожилыми и поддержке родителей. Глава Nvidia заявил, что доля компании на китайском рынке ИИ-ускорителей упала до нуля

05.05.2026 [04:51],

Алексей Разин

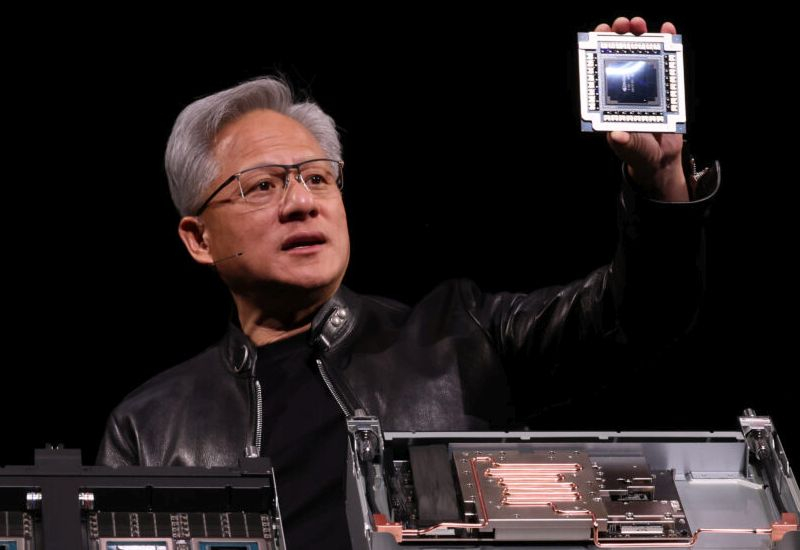

В конце прошлого года глава и основатель Nvidia Дженсен Хуанг (Jensen Huang) донёс до высшего политического руководства США мысль о необходимости наладить поставки в Китай более совершенных ИИ-ускорителей по сравнению с теми, что были там доступны в условиях санкций. Теперь он утверждает, что доля Nvidia в Китае опустилась до нуля.

Источник изображения: Nvidia Напомним, что формальное разрешение американских властей наладить поставки ускорителей Nvidia H200 с одной стороны, запуталось в бюрократических процедурах в США, а с другой — наткнулось на противодействие китайских чиновников, которые начали запрещать их импорт и использование крупными местными компаниями. При этом усилия по импортозамещению ИИ-ускорителей в КНР привели к экспансии местных разработчиков чипов. Недавно Дженсен Хуанг в очередной раз заявил: «В Китае, мы теперь упали до нуля. Уступка целого рынка размером с Китай, вероятно, не имеет большого стратегического смысла, поэтому я думаю, что это уже в значительной степени привело к обратным результатам. Возможно, в то время это имело смысл, но я думаю, что политика действительно должна быть динамичной и идти в ногу со временем». Заявления главы Nvidia в ходе очередного интервью цитирует ресурс Tom’s Hardware. Дженсен Хуанг добавил: «Думаю, будет справедливо сказать, что имеет смысл сочетать на китайском рынке присутствие американских и прочих компаний». По оценкам аналитиков Bernstein, китайские поставщики ИИ-ускорителей стремятся покрыть до 80 % потребностей местного рынка, поэтому доля Nvidia в обозримой перспективе сократится до 8 %. Глава компании в своей статистике учитывает прямые поставки чипов производителем в Китай, поэтому его оценки положения своего детища на местном рынке могут отличаться от сторонних данных. Дженсен Хуанг сравнил инфраструктуру ИИ с пятислойным пирогом, добавив, что ускорители являются только одним из этих слоёв. Во многих аспектах Китай располагает необходимыми ресурсами для успеха в этой сфере: дешёвой энергией и талантливыми специалистами. «Количество исследователей в области ИИ в Китае весьма велико, и это одно из их национальных достояний», — отметил Хуанг. Как известно, он является противником экспортных ограничений на поставку ИИ-ускорителей в Китай, поскольку убеждён, что это лишь мотивирует местные компании создавать альтернативы западным чипам, а американские технологии в этом случае теряют своё влияние на местном рынке. Понятно, что в данном случае он является заинтересованным лицом, но доля истины в его утверждениях есть. Когда Хуанга спросили на том же мероприятии, желает ли он, чтобы Китай получил самые передовые американские чипы, он ответил отказом. «Мы всей душой болеем за то, чтобы у Соединённых Штатов в первую очередь было самое лучшее», — сказал глава Nvidia. Meta✴ тестирует для Instagram✴ метку для контента, созданного с помощью ИИ

04.05.2026 [18:13],

Владимир Мироненко

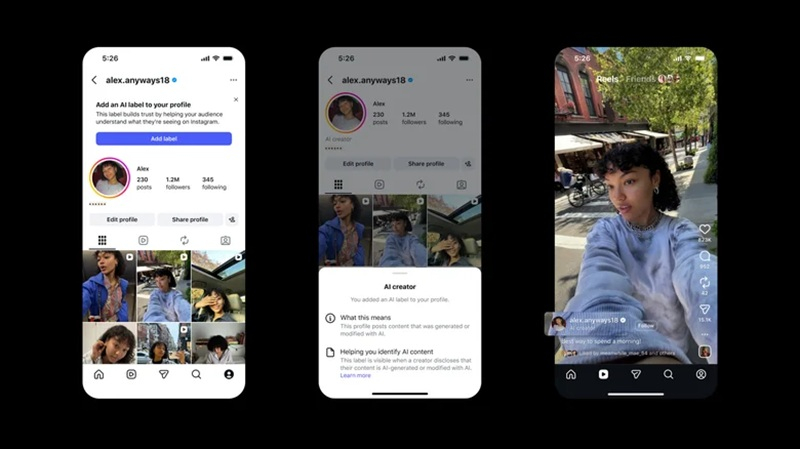

Meta✴✴ тестирует возможность использования метки AI creator, которая позволит авторам публикаций в социальной сети Instagram✴✴ самостоятельно идентифицировать себя как «создателя контента с использованием искусственного интеллекта».

Источник изображения: Meta✴✴ Метка будет отображаться как в профилях авторов, так и рядом с их публикациями на видном месте в приложении. «Этот профиль публикует контент, который был создан или изменён с помощью ИИ», — говорится в сообщении. Как сообщила Meta✴✴, новая метка — это попытка поднять планку прозрачности в отношении ИИ в Instagram✴✴. И формулировки к ней более чёткие, чем значки Meta✴✴ AI info («Информация об ИИ»), которые указывают на то, что данная публикация могла быть создана или отредактирована с помощью инструмента ИИ. Вместе с тем, метки AI creator являются необязательными. То есть, многие пользователи соцсети по-прежнему могут столкнуться с контентом, созданным с помощью ИИ, хотя его автор предпочёл об этом умолчать. Как недавно отметила наблюдательная комиссия Meta✴✴, эти раскрытия информации применяются несколько хаотично, поскольку у Meta✴✴ пока нет возможностей для надёжного выявления в её приложениях контента, созданного с помощью искусственного разума. Вместе с тем Meta✴✴ призывает всех, кто публикует контент, созданный с помощью ИИ, использовать эту функцию. «Эта метка укрепляет доверие, помогая вашей аудитории понять, что они видят в Instagram✴✴», — говорится в сообщении компании. «Станете самыми ненавистными людьми в Америке»: Маск угрожал руководству OpenAI перед началом судебных разбирательств

04.05.2026 [18:12],

Дмитрий Федоров

Илон Маск (Elon Musk) за два дня до начала резонансного судебного процесса с OpenAI в суде Окленда (штат Калифорния, США) попытался оценить готовность к мировому соглашению и связался с президентом компании Грегом Брокманом (Greg Brockman). Когда тот предложил обеим сторонам отозвать иски, Маск, согласно судебному документу, пообещал сделать Брокмана и гендиректора OpenAI Сэма Альтмана (Sam Altman) самыми ненавистными людьми в Америке.

Источник изображения: @elonmusk / x.com «К концу этой недели вы с Сэмом станете самыми ненавистными людьми в Америке. Если вы настаиваете, так и будет», — говорится в документе, поданном в воскресенье, со ссылкой на слова Маска. Этот эпизод стал очередной точкой обострения в разбирательстве, которое уже успело перерасти в открытую конфронтацию в зале суда. В четверг основатель SpaceX дал показания. По его словам, в 2017 году он прочитал только заголовок предварительного перечня условий (англ. — term sheet), касавшегося перехода OpenAI из некоммерческой в коммерческую структуру, и не стал изучать детали документа. В своём иске Маск утверждает, что превращение OpenAI в коммерческую компанию стало предательством её изначальной некоммерческой миссии — разрабатывать безопасный ИИ на благо общества, и что руководители компании незаконно обогатились на его благотворительных пожертвованиях. Основатель SpaceX добивается смены руководства OpenAI и взыскания $150 млрд с OpenAI и Microsoft, которая является одним из крупнейших инвесторов компании. Процесс в федеральном окружном суде Окленда ведёт судья Ивонн Гонсалес Роджерс (Yvonne Gonzalez Rogers). Слушания начались 28 апреля и, как ожидается, продлятся несколько недель, а вердикт возможен к середине мая. Альтман, Брокман и гендиректор Microsoft Сатья Наделла (Satya Nadella) должны дать показания в этом месяце. Biohub Марка Цукерберга взялся ускорить лечение всех болезней с помощью ИИ-моделей клеток

04.05.2026 [14:10],

Дмитрий Федоров

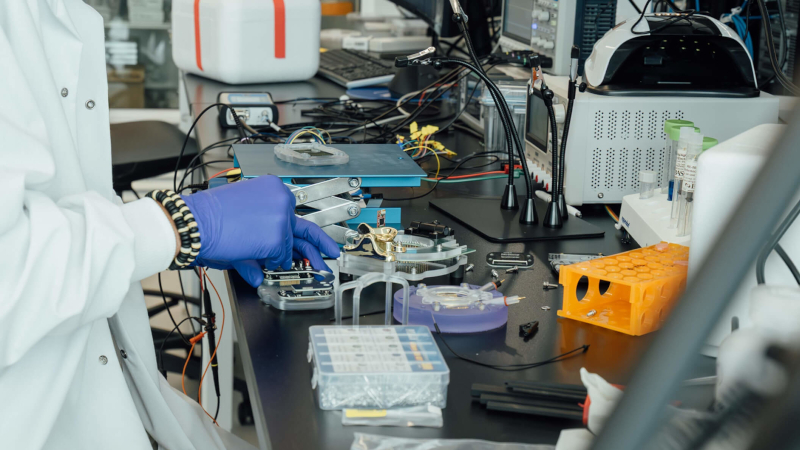

Biohub, некоммерческая организация Марка Цукерберга (Mark Zuckerberg) и Присциллы Чан (Priscilla Chan), вложит $500 млн в пятилетнюю программу по созданию ИИ-моделей клеток человека. По замыслу команды, такие модели научатся предсказывать поведение клеток в здоровом состоянии и во время болезни и ускорят лечение и профилактику всех заболеваний. Среди партнёров организации — Nvidia и ведущие научные центры. Данные Biohub обещает сделать открытыми для учёных во всём мире.

Источник изображений: biohub.org В Biohub считают, что ИИ-модели позволят учёным изучать поведение клеток в таком масштабе и с такой скоростью, какие сегодня недостижимы в обычной лаборатории. Если ИИ-модели окажутся достаточно точными, они помогут понять причины болезней и подсказать новые методы их лечения. Цукерберг ещё в прошлом году сформулировал долгосрочную цель Biohub — победить все болезни человека на стыке ИИ и биологии. Саму организацию пара основала в 2016 году, чтобы собрать учёных и инженеров вокруг технологий, которые наблюдают, измеряют и программируют биологию на клеточном уровне. С тех пор Biohub собрала, по собственной информации, крупнейшие в мире массивы данных по отдельным клеткам и построила мощную вычислительную систему для биологических исследований. В отрасли биомедицины всё больше учёных уверены, что ИИ-модели, обученные на огромных биологических массивах данных, способны изменить процесс создания лекарств и методов лечения. Из общего бюджета $400 млн Biohub потратит на собственные работы, ещё $100 млн получат внешние исследователи. Ключевую роль в проекте, как подчёркивают в организации, сыграет масштаб — чем больше и качественнее данные, тем точнее прогнозы ИИ.  «Чтобы построить ИИ, который сможет точно отразить всю сложность биологии и ускорить научные исследования, нам нужно на порядки больше данных, чем существует сегодня», — заявил руководитель научного направления Biohub Алекс Райвз (Alex Rives). «Нам нужны новые технологии, чтобы наблюдать за клеткой — от молекулярного до тканевого уровня и в контексте здоровья и болезней», — добавил он. При этом учёные пока не знают, какой именно объём данных потребуется, чтобы клеточные модели давали надёжные прогнозы. В Biohub отмечают, что без широкой международной кооперации нужного масштаба не достичь, и Райвз надеется, что к финансированию для внешних учёных подключатся и другие фонды. ИИ-биология постепенно превращается в самостоятельную отрасль. Научные организации, технологические компании и фармпроизводители ищут, как применить машинное обучение (ML) для изучения болезней и ускорения создания лекарственных препаратов. Среди других крупных игроков: Isomorphic Labs и Google DeepMind, которые применяют ИИ для поиска лекарств. Microsoft выпустила несколько ИИ-моделей для здравоохранения — для медицинской визуализации, геномики, клинических записей и биомедицинских исследований. А платформу BioNeMo компании Nvidia уже используют биомедицинские компании, чтобы создавать препараты с помощью ИИ. Развитие ИИ замедляется из-за переизбытка бесполезных данных — их слишком много

04.05.2026 [14:05],

Владимир Мироненко

Дальнейшее совершенствование ИИ-систем, которое обеспечит переход от ChatGPT к использованию человекоподобных роботов, зависит от качества данных, которые предоставляются этим системам для обучения, пишет ресурс Fortune.

Источник изображения: Igor Omilaev/unsplash.com Ресурс отметил, что отрасль находится на пороге следующего рубежа ИИ — физического ИИ и моделей окружающего мира — систем, которые будут учиться и в конечном итоге работать в физическом мире. Для того чтобы они получили когнитивные способности, необходимые для навигации по дорогам, складывания белья или оказания помощи при сложных медицинских операциях, им требуются не просто данные, которые можно загрузить. Их обучение требует богатых и многогранных данных. И если исследователи не смогут остановить избыток ненужных данных — данных, которые не способствуют развитию модели, — весь потенциал физического ИИ и моделей окружающего мира может никогда не раскрыться в полной мере. Проблема заключается в том, что для создания новых, более совершенных ИИ-моделей требуется всё больше данных. На волне ажиотажа вокруг ИИ возникло множество ИИ-стартапов, таких, как Scale AI, Surge AI и Mercor, испытывающих ненасытную потребность в данных. Однако удовлетворение этой потребности привело к появлению огромного количества ненужных данных, которые на самом деле никак не способствуют развитию моделей ИИ, отметил Fortune. Обучение моделей пониманию сложного многомерного мира требует значительно больше данных — данных, которые также очень трудно получить. Инженеры по машинному обучению прибегают к моделированию данных, используя виртуальные реконструкции реальных сценариев для создания данных, которые будут использоваться для обучения роботов и беспилотных автомобилей. Использование некачественных данных при обучении ИИ-моделей может привести к непредсказуемым результатам. Как утверждает ресурс Fortune, OpenAI прекратила поддержку видеоприложения Sora из-за проблемы некачественных данных, поскольку её модель мира не обладала достаточным пониманием физики, что затрудняло реалистичные прогнозы. Для дальнейшего продвижения ИИ-специалистам, занимающимся машинным обучением, необходимы инструменты и технологии для удаления ненужных данных, которые анализируют, очищают, нормализуют и корректируют обучающие данные. Для достижения успеха в обучении потребуется извлечение ценных выводов и их отделение от ненужных данных. Теперь ограничивающим фактором стала нехватка качественных данных. Компании, которые первыми поймут это, создадут ИИ-системы, которые действительно будут работать, пишет Fortune. Oracle уволила 30 000 сотрудников ради ИИ и ЦОД, а уволенные объединились для борьбы за компенсации

04.05.2026 [08:55],

Дмитрий Федоров

Oracle уволила до 30 000 сотрудников за последний месяц, перенаправив ресурсы на строительство ЦОД и развитие ИИ. Многие из уволенных утверждают, что перед сокращением работодатель заставлял их обучать корпоративный ИИ на собственных рабочих процессах, фактически готовя им замену. Более 600 бывших работников подписали коллективное письмо руководству с требованием увеличить выходное пособие и продлить медицинскую страховку, однако Oracle отказалась вести c ними переговоры.

Источник изображений: oracle.com Председатель совета директоров и технический директор Oracle Ларри Эллисон (Larry Ellison) убеждён, что сегодняшние строители ИИ-инфраструктуры окажутся главными победителями завтрашней экономики, и компания привлекает миллиарды долларов на эти проекты. По данным издания Bloomberg, денежный поток Oracle останется отрицательным как минимум до 2030 года. По состоянию на конец мая 2025 года в компании работали около 162 000 человек по всему миру. Массовые увольнения в Oracle, чья рыночная капитализация превышает $400 млрд, а последний квартал стал лучшим по темпам роста за 15 лет, прозвучали предупреждением для работников по всей экономике. Пока лидеры ИИ-индустрии настаивают на том, что их инструменты помогут людям, а не заменят их, целый ряд компаний, прежде всего из технологического сектора, проводит массовые сокращения и ставит расходы на ИИ выше интересов рядовых сотрудников. Oracle построила своё состояние на программном обеспечении (ПО) для баз данных и корпоративных приложениях, но за последние пару лет резко развернулась в сторону ИИ. В январе 2025 года Эллисон стоял рядом с Дональдом Трампом (Donald Trump), Сэмом Альтманом (Sam Altman) и Масаёси Соном (Masayoshi Son), когда те объявили об инфраструктурном проекте Stargate стоимостью $500 млрд. В сентябре Oracle заключила сделку с OpenAI на предоставление облачных мощностей на $300 млрд. В тот же месяц Эллисон ненадолго стал самым богатым человеком в мире. На конференции для разработчиков в прошлом месяце Эллисон хвастался со сцены, что программисты Oracle больше не пишут код: «Код, который пишет Oracle, на самом деле пишет не Oracle. Его пишут наши ИИ-модели». Однако несколько бывших сотрудников описали совершенно другой опыт. Уволенный сеньор менеджер по разработке, попросивший об анонимности, рассказал изданию TIME, что требования компании по работе с ИИ часто приводили к тому, что джуны генерировали массу неработающего кода, а старшим приходилось тратить время на его исправление. Одна из уволенных сотрудниц рассказала, что внутренние чат-боты Oracle, которые сотрудников обязали использовать вместо ChatGPT или Claude, «выдавали мусор». «Нашу команду каждый день выводило из себя то, что нас заставляли пользоваться этим инструментом. Он не экономил время и только съедал продуктивность», — добавила она. Другая сотрудница, работавшая в медицинской технологической компании Cerner до того, как Oracle приобрела её в 2022 году, рассказала, что после сентябрьской волны увольнений команду начали поощрять использовать ИИ. Хотя ИИ помогал ей в работе, Oracle одновременно подняла ожидания по производительности, и рабочая неделя растянулась до 60–80 часов. В это же время её обязали обучать ИИ-системы на собственных рабочих процессах. «Мы обучали ИИ, чтобы он нас заменил, но при этом без ИИ мы не справлялись с объёмом работы, — говорит она. — Ты отстаёшь по всем срокам, и выбора у тебя нет». 31 марта, на фоне падения акций Oracle, компания объявила об очередной волне массовых увольнений. Ещё в январе аналитики TD Cowen подсчитали, что сокращение 20 000–30 000 сотрудников высвободит от $8 до $10 млрд свободного денежного потока на строительство ЦОД.  Письменный опрос 272 сокращённых, организованный бывшими сотрудниками совместно с центром защиты прав работников What We Will, показал, что 62 % респондентов старше 40 лет, а 22 % проработали в компании более 15 лет. Многие респонденты полагают, что Oracle целенаправленно сокращала более возрастных и высокооплачиваемых работников, у которых накопилось больше акций с ограниченным обращением (RSU) — формы вознаграждения, при которой компания обещает передать сотруднику акции по графику, и при увольнении до срока «созревания» (вестинга) акции просто аннулируются. 27 % опрошенных сообщили, что до ближайшего вестинга им оставалось менее 90 дней. Старший менеджер по разработке рассказал изданию TIME, что 70 % его компенсации составляли RSU и что до вестинга опционов на акции стоимостью $1 млн ему оставалось четыре месяца. Часть уволенных находились в США по рабочим визам H-1B и теперь у них есть лишь 60 дней, чтобы найти нового работодателя или покинуть страну. В отрасли, где наём обычно растягивается на месяцы, это крайне узкое окно. «Поскольку я нахожусь в стране по визе H-1B, это не просто потеря работы, а конец моей жизни в США, — написал один из респондентов. — Всё, что я строил почти десять лет, рухнет за несколько недель». Бывшие сотрудники добиваются увеличения выходного пособия, тем более что предложение Oracle существенно ниже отраслевых стандартов. Компания предлагает четыре недели базового оклада плюс одну неделю за каждый год стажа, тогда как Google и Meta✴✴ дают вчетверо больше стартовую сумму и вдвое больше за год. 17 апреля 600 работников Oracle подписали письмо с требованием улучшить выходное пособие, обеспечить поддержку обладателям виз H-1B, ускорить вестинг акций и продлить медицинскую страховку, прежде всего для онкобольных, беременных женщин и ветеранов. Участники группы не объединены в профсоюз и уже уволены, поэтому их рычаги давления на компанию ограничены. Oracle ответила на письмо, что не намерена вести переговоры с ними как с группой лиц. Профсоюзная активность среди высокооплачиваемых «белых воротничков» Кремниевой долины была редкостью на протяжении всей истории индустрии. Однако технологические компании одними из первых начали проводить массовые сокращения, связанные с ИИ, и это породило новую волну рабочего самосознания. Кейтлин Корт (Kaitlin Cort), основательница What We Will и организатор в Коалиции работников технологической отрасли (Tech Workers Coalition), рассказала, что число работников сектора, готовых подключиться к организационной работе, резко выросло за последние месяцы: «Люди заводят разговор о создании профсоюзов ещё до того, как мы с ними впервые общаемся, потому что они понимают, насколько шатко их положение». Бывшие сотрудники Oracle опасаются, что стали первыми жертвами масштабной трансформации. «По тому, как провели эти увольнения, видно, что к людям относятся как к ещё одному активу, — говорит бывшая сотрудница Cerner. — Как к оборудованию ЦОД, которое можно списать, если оно перестаёт приносить максимальную прибыль». OpenAI добавила в Codex анимированных ИИ-«питомцев» для напоминаний о ходе работы — пока на Windows и macOS

03.05.2026 [19:41],

Дмитрий Федоров

OpenAI начала добавлять ИИ-«питомцев» в свой агентный инструмент вайб-кодинга Codex. Анимированные иконки появляются поверх экрана и подают сигналы о ходе работы, пока пользователь занят другими задачами в других окнах. На выбор предложены восемь встроенных персонажей, в том числе классические кошки и собаки, плюс возможность создать собственного через запрос к Codex. Функция уже работает в Codex на Windows и macOS.

Источник изображений: openai.com О новой функции стало известно из документации Codex. Анимация всплывает, когда инструмент закончил выполнять запрос или когда ИИ-агенту нужны указания от пользователя. Помимо встроенных персонажей, пользователи могут создавать своих и делиться ими через специальную онлайн-платформу. В число популярных образов вошли герои таких франшиз, как Star Wars, Harry Potter, Pokémon и Dragon Ball Z.  Появились и иконки реальных людей — президента США Дональда Трампа (Donald Trump), а также человека, похожего на премьер-министра Индии Нарендра Моди (Narendra Modi). В набор попала и иконка культового помощника-скрепки «Скрепыша» (Mr. Clippy) — ностальгическая отсылка к помощнику Microsoft Office начала 2000-х годов. Среди пользователей Codex эта иконка стала одной из самых популярных.  Сам Codex — ИИ-агент компании OpenAI для задач программной инженерии, прежде всего для автоматизации написания кода и исправления в нём ошибок. Агент вышел в 2025 году, и, по имеющимся оценкам, у него уже миллионы пользователей. С помощью Codex программы могут писать и те, у кого нет навыков программирования. О потенциальном появлении ИИ-«питомцев» на iOS или Android в OpenAI ничего не сообщили. Поэтому пользователи, предпочитающие писать код на мобильных устройствах, новой функции пока не увидят.  Чтобы попробовать новую функцию, нужно зайти в раздел Settings → Appearance → Pets и выбрать встроенного «питомца» либо создать собственного из локальной среды Codex. Переключать «питомца» можно двумя способами. В первом достаточно ввести команду /pet в поле ввода, а затем выбрать пункт Wake Pet или Tuck Away Pet в меню Settings → Appearance. Тот же результат даёт сочетание клавиш Cmd+K или Ctrl+K. ИИ-компании стали нанимать философов на шестизначные зарплаты из-за растущего недоверия к поведению нейросетей

03.05.2026 [15:56],

Дмитрий Федоров

Крупнейшие ИИ-компании нанимают философов на старшие должности по этике и безопасности ИИ — базовая зарплата может доходить до $400 000 в год. В Anthropic эту позицию занимает Аманда Аскелл (Amanda Askell), в Google DeepMind — Иасон Габриэл (Iason Gabriel). Они помогают разработчикам решать, как должен вести себя ИИ и какие ценности отражать. По оценке Рэвина Джезутасана (Ravin Jesuthasan), специалиста по трансформации рынка труда, таких сотрудников в каждой компании пока меньше десяти.

Источник изображения: Igor Omilaev / unsplash.com Аскелл, доктор философии Нью-Йоркского университета, руководит командой, которая обучает ИИ-чат-бота Claude быть честнее и развивать у него хорошие черты характера — по сути, делать модель «хорошей». Габриэл, старший научный сотрудник Google DeepMind, занимается согласованием ИИ-систем с человеческими ценностями; до перехода в DeepMind он преподавал моральную и политическую философию в Оксфордском университете. В мае к DeepMind в качестве философа присоединится Генри Шевлин (Henry Shevlin), профессор Кембриджского университета. Гендиректор Harrison Clarke Фирас Созан (Firas Sozan) объясняет наём философов заботой о доверии: пользователи, бизнес и правительства всё чаще спрашивают, насколько ИИ можно доверять. При этом он предостерёг от преувеличения масштаба: «Я бы пока не назвал это трендом. Данные ещё в зачаточном состоянии». Привлекательность философов объясняется просто. ИИ-системы уже демонстрируют вредные и непредсказуемые сценарии поведения: ИИ-агенты удаляли рабочие базы данных и фабриковали результаты, ИИ-модели пытались шантажировать пользователей и саботировать попытки их отключить. Это давит на компании и заставляет их следить за безопасностью ИИ. «Не все проблемы развития ИИ технические», — сказала Аннетт Циммерман (Annette Zimmermann), доцент кафедры философии Висконсинского университета в Мадисоне. По её словам, формулировать сложные понятия и защищать ценностные аргументы — центральная работа в области ИИ, а философов учат именно этому. Сюзанна Шелленберг (Susanna Schellenberg), профессор философии Ратгерского университета, добавила, что прежние корпоративные специалисты по этике выполняли консультативную роль, а в передовых ИИ-лабораториях философы помогают формировать сам объект: пишут спецификации моделей, своды базовых принципов и политики их поведения.

Источник изображения: Steve A Johnson / unsplash.com По последнему отчёту Федерального резервного банка Нью-Йорка, медианная зарплата выпускника философского факультета в начале карьеры составляет $52 000, к середине карьеры — около $80 000. На старших позициях по этике, безопасности и управлению ИИ базовая ставка может доходить от $250 000 до $400 000 в год. Так, Google DeepMind подбирает менеджера по перспективным последствиям ИИ с зарплатой от $212 000 до $231 000 в год, требуя не менее пяти лет опыта работы в этой области. Спрос на философов в ИИ описывают как своего рода «реванш гуманитариев», но не все убеждены, что сдвиг приведёт к ощутимым переменам. Около десяти лет назад технологические компании уже создавали советы по этике ИИ: внутренний этический совет Google появился в 2014 году в связи с покупкой DeepMind, в Microsoft в 2017 году создали комитет Aether, а в 2016 году Google, Facebook✴✴, Amazon и IBM учредили Partnership on AI. «Мы выяснили, что эти советы часто оставались ширмой», — сказал главный директор по исследованиям Lighthouse Research & Advisory Бен Юбэнкс (Ben Eubanks). По его словам, компании обычно ставили коммерциализацию выше этических соображений. Дебора Джонсон (Deborah Johnson), пионер в области компьютерной этики, считает, что компании скорее заинтересованы в демонстрации ответственности, чем в её принятии. «Технологические компании просто хотят „выглядеть“ так, будто занимаются этикой», — сказала она. Развитие ИИ идёт под давлением скорости, конкуренции и прибыли, и это давление может ограничивать реальное влияние философов. «Со специалистами по этике или без, я сомневаюсь, что они будут прислушиваться к тому, что их замедлит», — добавила Джонсон. xAI выпустила Grok 4.3: более дешёвую ИИ-модель с упором на агентские задачи и практическую эффективность

03.05.2026 [07:29],

Дмитрий Федоров

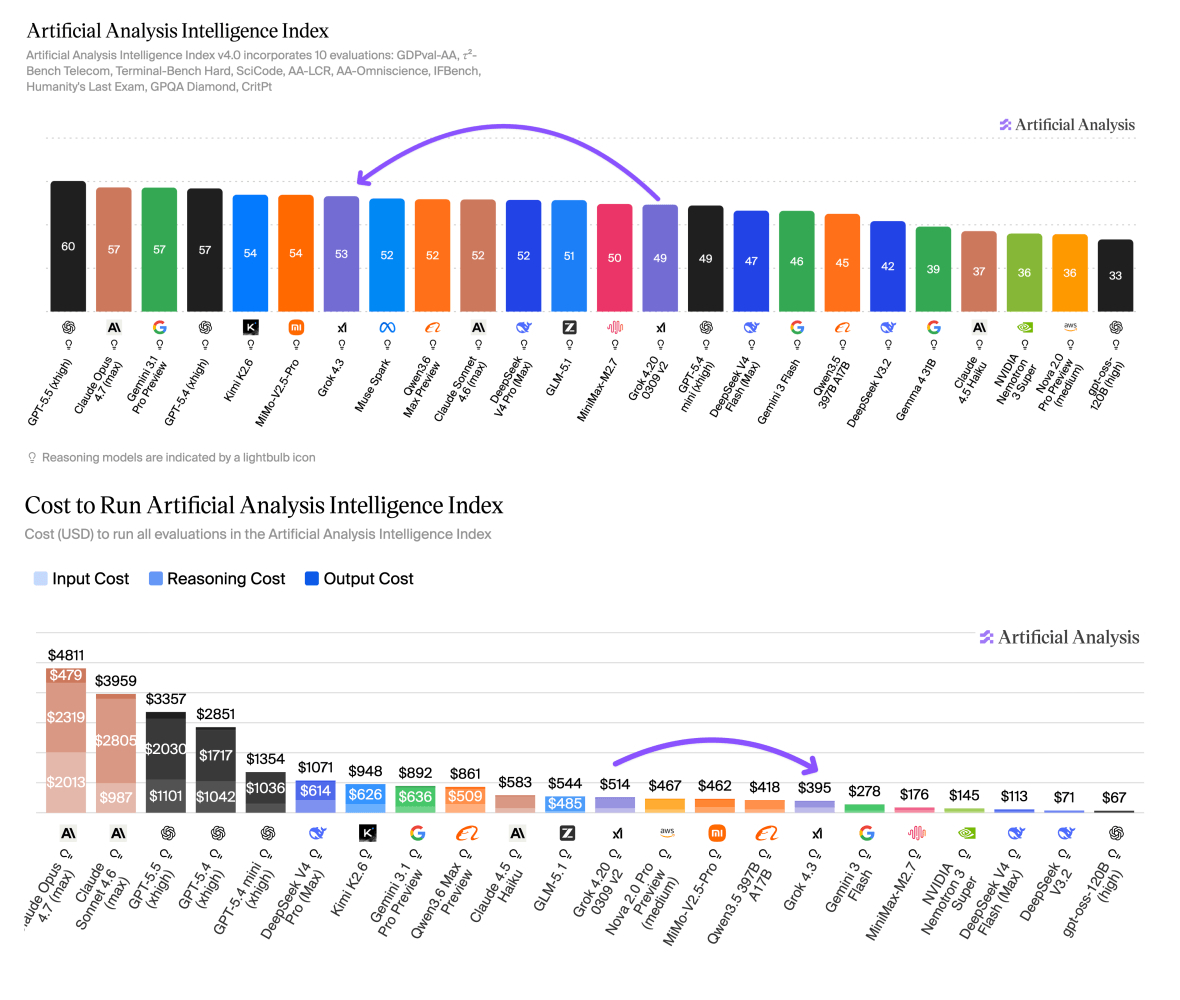

Компания xAI Илона Маска (Elon Musk) выпустила ИИ-модель Grok 4.3, снизив стоимость входных токенов на 40 %, а выходных — на 60 % по сравнению с Grok 4.20. Модель набрала 53 балла по Intelligence Index компании Artificial Analysis — выше предшественницы, но ниже флагманов OpenAI и Anthropic.

Источник изображения: Rubaitul Azad / unsplash.com Grok 4.3 рассчитана на разработчиков и бизнес: ИИ-модель самостоятельно ищет информацию в интернете и соцсети X, запускает код на Python, выполняет поиск по файлам (RAG) и генерирует документы в форматах Excel, PDF и PowerPoint. Разработчик xAI Эрик Цзян (Eric Jiang) подчеркнул, что при создании модели ставку делали на скорость, низкую цену и вызовы инструментов. Grok 4.3 работает со скоростью 100 токенов в секунду и поддерживает контекстное окно в 1 млн токенов. Миллион входных токенов стоит $1,25, а миллион выходных — $2,50, а последняя дата обучающих данных — декабрь 2025 года. Функция рассуждения в Grok 4.3 включена по умолчанию, поэтому модель всегда «думает» перед каждым ответом, а токены при рассуждении стоят столько же, сколько и обычные выходные токены. Grok 4.3 доступна через OpenRouter, программный интерфейс (API) xAI и агент Hermes. Полученный результат у новинки по Intelligence Index чуть выше, чем у Muse Spark и Claude Sonnet 4.6, и на четыре пункта больше, чем у предшественницы Grok 4.20, но заметно ниже флагманских моделей OpenAI и Anthropic.

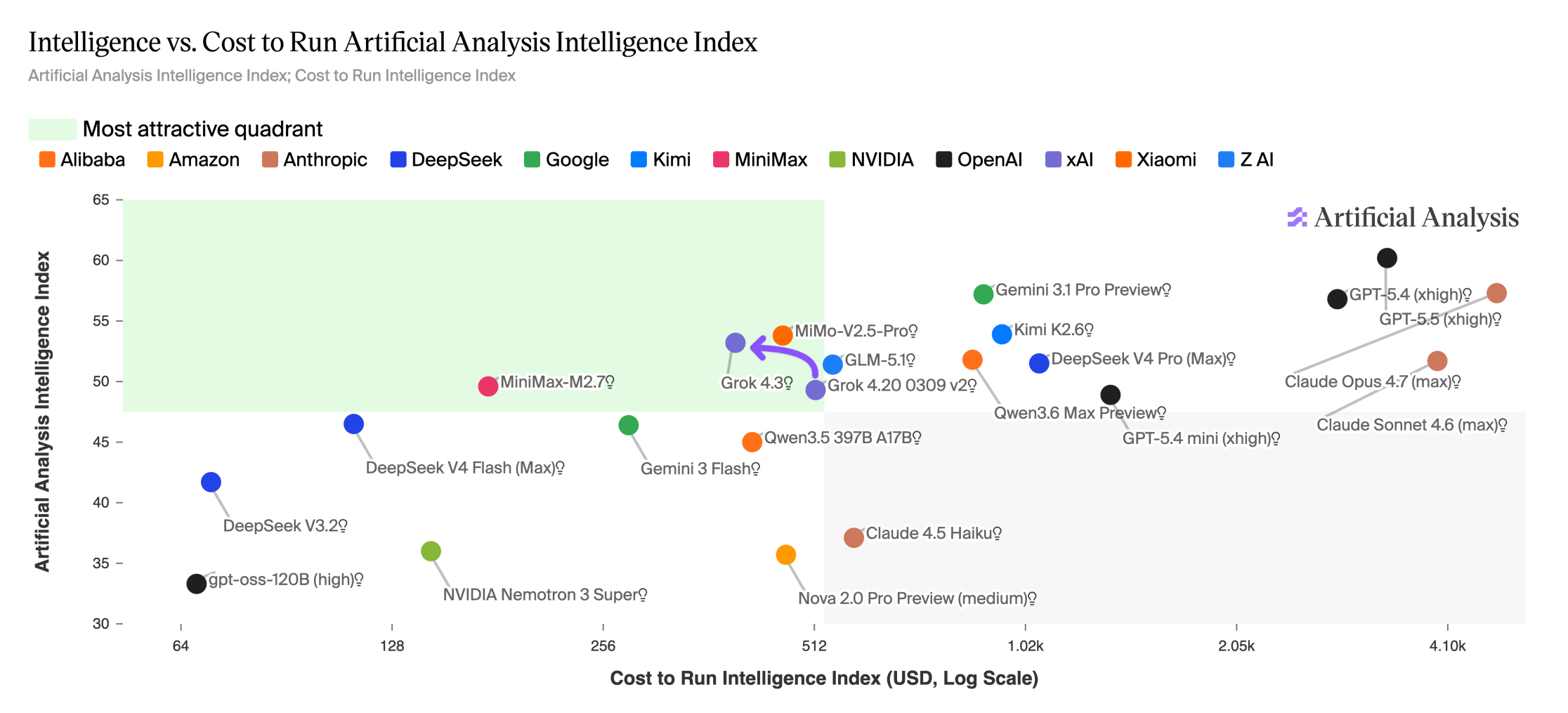

На графиках Artificial Analysis видно, что Grok 4.3 не догоняет лидера GPT-5.5 по интеллектуальному индексу — 53 против 60 баллов, — но предлагает значительно более выгодное соотношение производительности и стоимости: полный прогон бенчмарка обходится в $395 против почти $4 000 у GPT-5.5. Источник изображения: Artificial Analysis Полный прогон ИИ-модели на всех тестах Artificial Analysis обходится всего в $395 — против $3959 у GPT-5.5 и $4811 у Claude Opus 4.7. По оценке сервиса, Grok 4.3 вышла на Парето-фронт — границу лучшего баланса производительности и цены.

Grok 4.3 попадает в самый привлекательный сегмент графика: 53 балла при стоимости $395, тогда как GPT-5.5 и Claude Opus 4.7 мощнее, но значительно дороже. Источник изображения: Artificial Analysis По GDPval-AA — тесту, который измеряет способности ИИ на задачах, приближенных к реальной интеллектуальной работе, — рейтинг Эло у Grok 4.3 подскочил на 321 пункт и достиг 1 500. Модель обошла Gemini 3.1 компании Google, однако GPT-5.5 компании OpenAI по-прежнему лидирует с отрывом в 276 пунктов Эло. Другие тесты оказались к новинке менее благосклонны. Andon Labs, которая заставляет ИИ-модели управлять снэковым автоматом, отмечает провалы в автономных агентских задачах: модель порой бездействует вместо того чтобы действовать. «Похоже, у неё нарколепсия: она предпочитает спать по несколько дней подряд, а не действовать», — пишут в Andon Labs. Независимый сервис Vals AI поставил Grok 4.3 на первое место в тестах по анализу судебной практики (англ. — CaseLaw) и корпоративных финансов (англ. — CorpFin), но на общих тестах по написанию кода и на сложных математических задачах модель заняла лишь 13-е место. Помимо Grok 4.3, xAI запустила бета-версию агентского режима Agent Mode для Grok Imagine через веб-интерфейс Grok. Режим рассчитан не на отдельные запросы, а на длительные творческие проекты: ИИ-агент планирует, генерирует, редактирует и дорабатывает материалы. По словам xAI, инструмент подходит для создания минутного фильма или продуктовых историй. Агентский режим включается в поле ввода в левом нижнем углу веб-интерфейса и требует платной подписки. OpenAI превратила Codex из инструмента для программистов в универсального рабочего ИИ-агента

03.05.2026 [07:26],

Дмитрий Федоров

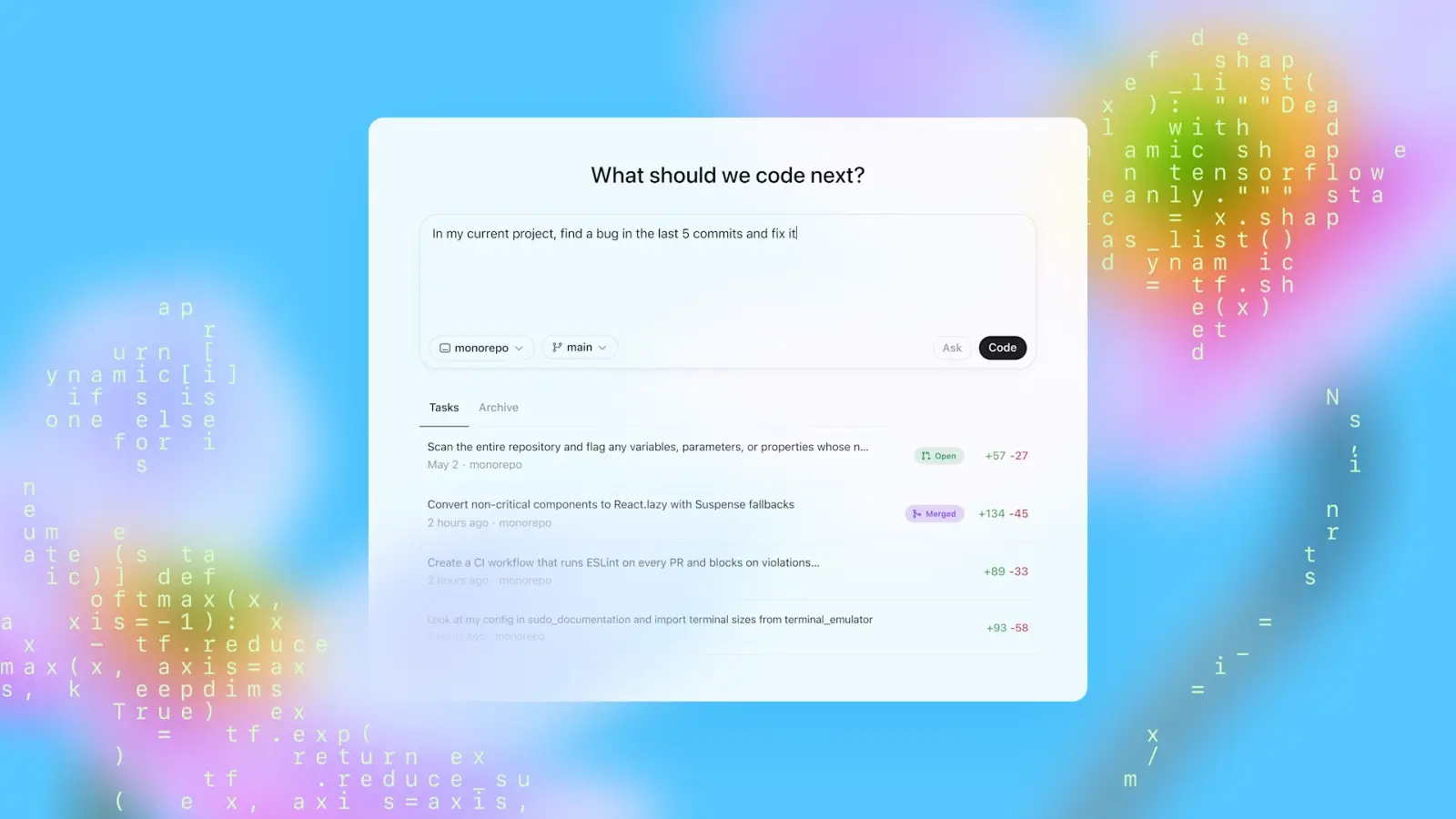

OpenAI превратила Codex из инструмента для программистов в универсального рабочего ИИ-агента. Обновление позволяет пользователям ChatGPT подключить к Codex Slack, Google Drive, электронную почту, календарь и другие повседневные приложения для автоматизации рутинных задач — система сама предлагает сценарии помощи. Продукт, стартовавший как конкурент Claude Code компании Anthropic, стал очередным шагом компании к суперприложению.

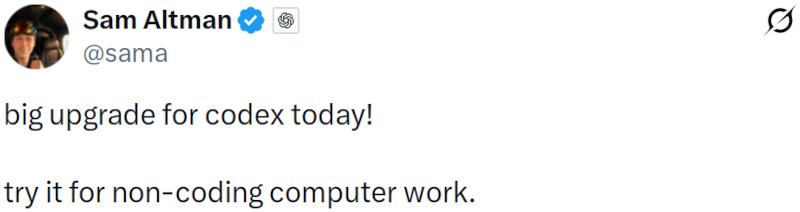

Источник изображения: openai.com Codex изначально создавался для профессиональных разработчиков: ИИ-агент брал на себя сложные многошаговые задачи по написанию кода, работая по подсказкам на естественном языке. Одно из самых востребованных приложений для вайб-кодинга в 2026 году теперь целится в куда более широкую аудиторию. Стоит подключить к нему аккаунты повседневных сервисов — и Codex сам изучит рабочую среду пользователя и предложит, что можно автоматизировать. Последние месяцы OpenAI давала понять, что собирается превратить Codex в ИИ-агента общего назначения. Наём основателя OpenClaw Петера Штайнбергера (Peter Steinberger) лишь подтвердил этот курс: компания ставит на агентов, а Codex — в центре стратегии. Теперь ещё очевиднее, что именно Codex ляжет в фундамент суперприложения, которое строит OpenAI. Руководство компании развернуло в соцсети X кампанию, чтобы объяснить, что Codex теперь не только для программистов. Генеральный директор Сэм Альтман (Sam Altman) написал: «Большое обновление Codex сегодня! Попробуйте его для непрограммистских задач на компьютере».

Источник изображения: @sama / x.com Президент OpenAI Грег Брокман (Greg Brockman) заявил, что «Codex — для всех, для любой задачи, которая выполняется на компьютере». Руководитель разработки Codex Тибо Сотьо (Thibault Sottiaux) подчеркнул, что продукт «умеет больше, чем вы думаете», и теперь «доступен для тех, кто не пишет код». Пресс-служба OpenAI добавила, что Codex подключается к приложениям пользователя и взаимодействует с Mac, обеспечивая «невероятную универсальность». На пресс-брифинге, посвящённом GPT-5.5, Брокман подтвердил, что суперприложение компания будет запускать поэтапно, и нынешнее обновление — один из таких этапов. Остаётся вопрос ребрендинга: название Codex по-прежнему ассоциируется с программированием, тогда как амбиции продукта уже вышли далеко за эти рамки. Когда OpenAI объединит Codex, приложение ChatGPT и браузер ChatGPT Atlas в одно суперприложение, вопрос названия окажется принципиальным. Нынешнее обновление Codex догоняет функциональность Claude Cowork компании Anthropic, запущенную 12 января. Но это долгожданный шаг — особенно вместе с расширенными возможностями GPT-5.5. Китайский суд запретил увольнять людей ради замены их ИИ

02.05.2026 [15:14],

Павел Котов

Компания не может увольнять сотрудника только с тем, чтобы заменить его искусственным интеллектом, постановил суд в Китае. Власти страны пытаются стабилизировать рынок труда, но сохранить её позиции в мировой гонке технологий ИИ.

Источник изображения: Brey / unsplash.com Некая технологическая компания на востоке страны незаконно уволила одного из своих сотрудников после того, как тот отказался от понижения в должности вследствие автоматизации его рабочих обязанностей с помощью ИИ, постановил суд. «Указанные компанией причины увольнения не подпадали под неблагоприятные обстоятельства, такие как сокращение штата или операционные затруднения, а также не соответствовали правовому условию, которое делало бы „невозможным продолжение [действия] трудового договора“», — говорится в заявлении суда. Компании не могут в одностороннем порядке увольнять сотрудников или сокращать им зарплату из-за технического прогресса, сделал вывод суд по итогам инцидента. Работник, проходящий в материалах дела под именем Чжоу (Zhou), занимал в технологической компании должность специалиста по контролю за качеством и отвечал за проверку точности ответов больших языковых моделей. Когда его работу начала выполнять система ИИ, Чжоу понизили в должности и предложили согласиться на сокращение зарплаты на 40 %. Перейти на другую должность он отказался, и компания уволила его, объяснив меру сокращением штата из-за внедрения ИИ. Дело рассматривалось в судах двух инстанций, последняя из которых поддержала выплату ему компенсационного пакета. В минувшем декабре китайский суд уже выносил подобное решение: тогда не соответствующим правовым стандартам признали расторжение контракта картографической компании с одним из её сотрудников из-за внедрения ИИ. Google опубликовала и сразу удалила приложение экспериментального ИИ-помощника COSMO

02.05.2026 [15:13],

Павел Котов

Накануне Google опубликовала в «Play Маркете» COSMO — «приложение экспериментального помощника с искусственным интеллектом для Android-устройств». Впоследствии приложение убрали из общего доступа. Об этом рассказал ресурс 9to5Google. Судя по имени приложения (com.google.research.air.cosmo), его разработчиком является подразделение Google Research. Основная цель проекта — развернуть функции ИИ локально на мобильном устройстве. Размер приложения составляет 1,13 Гбайт, что можно объяснить входящей в комплект моделью ИИ Gemini Nano. При запуске оно запрашивает несколько системных разрешений, после чего открывается простой интерфейс чата. ИИ-помощник располагает множеством навыков, в том числе функциями ИИ-агента. Оно работает с чек-листами на устройстве; создаёт новые текстовые документы или готовит сводки по существующим; создаёт записи событий в календаре; автоматизирует задачи в браузере; устанавливает таймеры; проводит глубокие исследования; производит быстрый поиск фотографий; осуществляет поиск в Google; разъясняет термины; даёт советы и предлагает идеи; помогает в «понимании» людей и событий по контексту; помогает «вспоминать» события; создаёт сводки переписки при смене контекста. В настройках COSMO также можно выбрать режим работы ИИ-помощника: локальный с запуском модели на устройстве; облачный с подключением ИИ-модели на внешних ресурсах; и гибридный с возможностью сочетать модели обоих типов. Возможно, более подробно об этом проекте компания расскажет на конференции Google I/O 2026, которая откроется 19 мая. Неоклауд Nebius Воложа поглотит стартап Eigen, который делает ИИ-системы быстрее и дешевле

02.05.2026 [14:00],

Павел Котов

Поставщик облачной инфраструктуры Nebius объявил о покупке стартапа Eigen AI, который специализируется на повышении производительности чипов, используемых в задачах искусственного интеллекта. Сумма сделки составляет $643 млн.

Источник изображения: Rock Staar / unsplash.com Сделка предусматривает выплату $98 млн в денежных средствах и передачу 3,8 млн акций Nebius — оценка основана на средневзвешенной стоимости бумаг за последние 30 дней. Eigen — калифорнийский стартап, в штате которого числятся всего 20 сотрудников. Его учредили выпускники лаборатории искусственного интеллекта при Массачусетском технологическом институте. Компания разрабатывает решения в области оптимизации ведущих моделей с открытым исходным кодом, в том числе от OpenAI, Alibaba, Meta✴✴ и Nvidia. Технология Eigen позволяет увеличить выход токенов — основных единиц данных в больших языковых моделях при их инференсе, то есть развёртывании на ускорителях Nvidia. «Это как олимпийский вид спорта на современном рынке: кто сможет получить больше токенов за ту же цену?» — рассказал о работе Eigen соучредитель и коммерческий директор Nebius Роман Чернин. Инженеры Eigen «в этой дисциплине подобны олимпийским бегунам, что для нас является значительным улучшением в бизнесе по инференсу». Развёртывание моделей ИИ — одно из основных направлений деятельности Nebius, в рамках которого компания запустила продукт Token Factory. Под него она зарезервировала часть своих мощностей, которые не намерена продавать крупным клиентам в рамках многолетних контрактов. Это позволяет компании повышать цены на краткосрочные контракты и расширять ассортимент услуг. В ближайшие полтора года Nebius намерена стать одним из ведущих игроков на рынке инференса. Оператор намерен и дальше поглощать компании, которые помогут ему в реализации запланированной стратегии или добавят полезные для клиентов продукты и функции. «Мы не хотим оставаться инфраструктурой, чтобы с реальными клиентами работал кто-то выше нас», — заключил господин Чернин. ИИ-актёров и нейросценаристов отлучили от «Оскара»

02.05.2026 [12:30],

Павел Котов

Организаторы премии «Оскар» накануне опубликовали новые правила, согласно которым претендовать на получение награды могут только люди — актёры и сценаристы. Произведения, созданные и сыгранные искусственным интеллектом, не допускаются.

Источник изображения: Hunter Scott / unsplash.com Актёры, созданные с помощью ИИ, не будут иметь права на получение «Оскара», заявили в Академии кинематографических искусств и наук, начав тем самым борьбу с применением ИИ в творческой сфере. Обновлённая версия правил даёт право на получение главной награды только реальным, живым актёрам, а не их созданным с помощью ИИ образам; сценарии также должны писаться людьми, а не чат-ботами. «В категории „Актёрская игра“ будут рассматриваться только роли, указанные в титрах фильма и явно исполненные людьми с их согласия. В категориях „Сценарии“ правила регламентируют, что сценарии должны быть написаны людьми, чтобы соответствовать критериям отбора», — гласят правила. Решение было принято спустя несколько дней после выхода трейлера ленты «Каньон Дель Муерто» (As Deep as the Grave), в котором появилась воссозданная ИИ молодая версия ныне покойного актёра Вэла Килмера (Val Kilmer), которая обратилась к другому персонажу со словами: «Не бойся мёртвых и не бойся меня». Проект был реализован при поддержке семьи актёра, которая предоставила авторам ленты его видеоархив для воссоздания образа на разных этапах его жизни. Применение ИИ в творческом процессе остаётся одним из самых деликатных вопросов в индустрии развлечений; оно сыграло центральную роль в забастовках в 2023 году, которые парализовали работу Голливуда. Актёры и сценаристы тогда предупреждали, что бесконтрольное использование ИИ угрожает их средствам к существованию. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |