|

Опрос

|

реклама

Быстрый переход

ИИ переплюнет по энергопотреблению Индию уже к 2030 году, спрогнозировал глава Arm

17.04.2024 [21:42],

Николай Хижняк

Технологиям искусственного интеллекта требуются огромные объёмы электроэнергии. По мнению главы компании Arm Рене Хааса (Rene Haas), это может привести к тому, что уже к концу текущего десятилетия общие объёмы потребляемой системами ИИ энергии превзойдут объёмы энергопотребления Индии, самой густонаселённой страны в мире. Источник изображения: Gerd Altmann / pixabay.com По словам Хасса, поиск способов предотвратить прогнозируемое утроение энергопотребления к 2030 году имеет первостепенное значение, если человечество хочет достигнуть целей, которые возлагаются на ИИ. «Мы по-прежнему находимся на раннем этапе развития возможностей [искусственного интеллекта]. Чтобы эти системы стали лучше, им потребуется дополнительное обучение — этап, который включает в себя бомбардировку программного обеспечения огромными наборами данных. Этот процесс рано или поздно столкнётся с пределом наших энергетических мощностей», — рассказал Хаас в интервью Bloomberg. Хаас формально ставит себя в один ряд с растущим числом людей, выражающих обеспокоенность по поводу возможного ущерба, который ИИ может нанести мировой энергетической инфраструктуре. Но он также заинтересован в том, чтобы отрасль перешла на использование чипов с Arm-архитектурами, которые всё больше завоёвывают популярность в центрах обработки данных. Технологии компании, которые к настоящему моменту получили широкое распространение в смартфонах, разработаны с целью более эффективного использования энергии по сравнению с традиционными серверными чипами. Arm рассматривает ИИ в качестве одного из основных драйверов своего роста. Технологии компании уже используются в процессорах, являющихся основой серверных систем AWS, Microsoft и Alphabet, разработавших собственные чипы для снижения своей зависимости от Intel и AMD. По словам Хааса, используя больше чипов, изготовленных по индивидуальному заказу, компании могут сократить ограничивающие факторы и повысить энергоэффективность их систем. Такая стратегия может снизить энергопотребление центров обработки данных более чем на 15 %. Однако отрасль нуждается в более масштабных технологических прорывах. Представлен самообучающийся робот-гуманоид Menteebot с мощным машинным зрением для дома и промышленности

17.04.2024 [18:13],

Сергей Сурабекянц

Амнон Шашуа (Amnon Shashua) известен как основатель стартапа машинного зрения Mobileye и компании по изучению искусственного интеллекта AI21 Labs. В 2022 году, опираясь на полученный в этих сферах опыт, он создал Mentee Robotics —стартап в области робототехники. Сегодня компания представила гуманоидного робота Menteebot, главными преимуществами которого создатель называет продвинутое машинное зрение и обучающийся генеративный ИИ.

Источник изображений: Mentee Robotics «Мы находимся на пороге сближения компьютерного зрения, понимания естественного языка, мощных и детальных симуляторов, а также методологий перехода от моделирования к реальному миру, — заявил Шашуа. — В Mentee Robotics мы рассматриваем эту конвергенцию как отправную точку для разработки будущего универсального двуногого робота, который сможет передвигаться повсюду (как человек) с помощью мозга, выполняя работу по дому и осваивая новые навыки, которым он ранее не был обучен».  Представленный робот во многом является прототипом, хотя его создатели считают, что добились достаточного прогресса, чтобы оправдать публичный дебют после двух лет напряжённой работы. Творческий и инженерный состав Mentee Robotics впечатляет. Помимо Шашуа, в команду основателей входят бывший директор Facebook✴✴ по исследованиям ИИ Лиор Вольф (Lior Wolf) и профессор Еврейского университета в Иерусалиме Шай Шалев-Шварц (Shai Shalev-Shwartz). Эта команда при содействии венчурной фирмы Ahren Innovation Capital помогла привлечь инвестиции в размере $17 млн.  «Большие языковые модели используются для интерпретации команд и “продумывания” необходимых шагов для выполнения задачи. Особое внимание уделяется способности сочетать передвижение и ловкость, то есть динамическое балансирование робота при переносе тяжестей или движении манипуляторов», — говорится в пресс-релизе компании. Mentee Robotics утверждает, что новый робот адаптирован как для промышленного, так и для потребительского рынков, в отличие от конкурирующих моделей. Компания рассчитывает выпустить готовый к производству прототип к началу 2025 года. Waymo запустит тестирование беспилотных такси в пятом городе в США

17.04.2024 [10:58],

Владимир Мироненко

Компания Waymo (входит в холдинг Alphabet), специализирующаяся на разработке технологий автономного вождения, приступила во вторник к тестированию сервиса роботакси в американском городе Атланта, пишет ресурс TechCrunch. Это уже пятый город США, где будет тестироваться сервис Waymo.

Источник изображения: Sandy Karp/X По словам представительницы Waymo Сэнди Карп (Sandy Karp), в ближайшие месяцы Waymo запустит несколько автомобилей со страхующими водителями для сбора картографических данных и ознакомления с окружающей средой Атланты, после чего приступит к тестированию роботакси без присутствия на переднем сиденье сотрудника компании, ответственного за безопасность. Как и во многих других штатах США, в Джорджии нет законов, регулирующих использования беспилотных автомобилей. Поэтому Waymo может хоть сейчас использовать здесь полностью автономные транспортные средства без водителя за рулём, при условии, что они соответствуют условиям минимальных рисков штата. Waymo отказалась раскрыть ресурсу планы по возможному запуску коммерческого сервиса роботакси в Атланте и других городах, где она начала собирать картографические данные. «Мы сосредоточены на масштабировании нашей полностью автономной службы такси Waymo One в городах, где мы работаем, продолжая безопасно и ответственно продвигать нашу автономную технологию посредством поездок в различных городах по всей территории США», — сообщила Карп. На прошлой неделе Waymo начала коммерческие перевозки с помощью роботакси в Лос-Анджелесе. В марте регулирующие органы Калифорнии одобрили заявку Waymo на коммерческую эксплуатацию беспилотных такси в Сан-Франциско. С ноября 2022 года Waymo предлагает поездки на беспилотном транспорте в аэропорт Финикса, а также в центральной части города. Также планируется запуск роботакси Waymo в Остине. Конкурент Neuralink соберёт десятки добровольцев для массовых испытаний мозговых имплантатов

11.04.2024 [11:45],

Геннадий Детинич

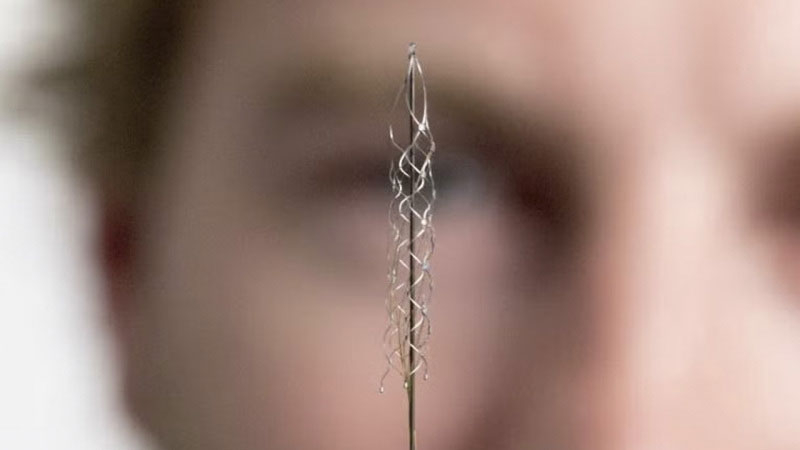

Поддержанная инвестициями Билла Гейтса (Bill Gates) и Джеффа Безоса (Jeff Bezos) компания Synchron, которая конкурирует с широко раскрученной в прессе компанией Neuralink Илона Маска (Elon Musk), начала собирать команду добровольцев для массовых испытаний собственных мозговых имплантатов.

Источник изображения: Synchron Речь идёт о многих десятках человек. Для начала испытаний необходимо разрешение Управления по санитарному надзору за качеством пищевых продуктов и медикаментов США (FDA), которое компания должна получить. Нейрозонд Synchron считается более безопасным на всех этапах его использования, чем устанавливаемый прямо на мозг под череп чип Neuralink. Зонд Synchron вводится в яремную вену и по кровеносным сосудам подводится к участку моторной коры головного мозга. К настоящему времени зонд установили десяти пациентам: четырём в Австралии и шестерым в США. Благодаря зонду пациенты с парализованными конечностями получили возможность управлять курсором мышки на экране компьютера, а это прямой путь к социализации больных, которые сейчас обречены на одиночество и информационный вакуум. По словам представителя компании, она создала реестр пациентов и медицинских учреждений, заинтересованных в участии в испытаниях. На данный момент с Synchron связались около 120 центров клинических испытаний. Это позволяет надеяться на привлечение десятков потенциально ценных кандидатов для участия в испытаниях, которые могут длиться несколько лет, прежде чем будут опубликованы результаты. Проведение подобных испытаний станет шагом в сторону коммерциализации мозгового имплантата Synchron и это, судя по всему, произойдёт намного раньше, чем в случае Neuralink. Сроки поставок ИИ-ускорителей Nvidia H100 сократились до 2–3 месяцев

10.04.2024 [20:59],

Николай Хижняк

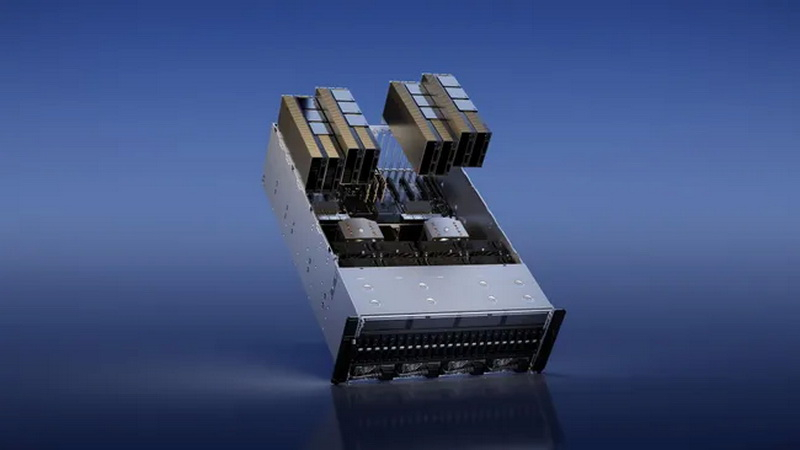

Cроки поставок ИИ-ускорителей Nvidia H100 сократились с 3–4 до 2–3 месяцев (8–12 недель), сообщает DigiTimes со ссылкой на заявление директора тайваньского офиса компании Dell Теренса Ляо (Terence Liao). ODM-поставщики серверного оборудования отмечают, что дефицит специализированных ускорителей начал снижаться по сравнению с 2023 годом, когда приобрести Nvidia H100 было практически невозможно.

Источник изображения: Nvidia По словам Ляо, несмотря на сокращение сроков выполнения заказов на поставки ИИ-ускорителей, спрос на это оборудование на рынке по-прежнему чрезвычайно высок. И несмотря на высокую стоимость, объёмы закупок ИИ-серверов значительно выше закупок серверного оборудования общего назначения. Окно поставок в 2–3 месяца — это самый короткий срок поставки ускорителей Nvidia H100 за всё время. Всего шесть месяцев назад он составлял 11 месяцев. Иными словами, клиентам Nvidia приходилось почти год ждать выполнение своего заказа. С начала 2024 года сроки поставок значительно сократились. Сначала они упали до 3–4 месяцев, а теперь до 2–3 месяцев. При таком темпе дефицит ИИ-ускорителей может быть устранён к концу текущего года или даже раньше. Частично такая динамика может быть связана с самими покупателями ИИ-ускорителей. Как сообщается, некоторые компании, имеющие лишние и нигде не использующиеся H100, перепродают их для компенсации огромных затрат на их приобретение. Также нынешняя ситуация может являться следствием того, что провайдер облачных вычислительных мощностей AWS упростил аренду ИИ-ускорителей Nvidia H100 через облако, что в свою очередь тоже частично помогает снизить на них спрос. Единственными клиентами Nvidia, которым по-прежнему приходится сталкиваться с проблемами в поставках ИИ-оборудования, являются крупные ИИ-компании вроде OpenAI, которые используют десятки тысяч подобных ускорителей для быстрого и эффективного обучения своих больших языковых ИИ-моделей. Lada Vesta с автопилотом выехала на дороги общего пользования

03.04.2024 [15:59],

Владимир Фетисов

ФГУП «НАМИ» вывел автомобиль Lada Vesta с системой автономного вождения на дороги общего пользования и специальный испытательный полигон для тестирования. Об этом пишет информационное агентство ТАСС со ссылкой на директора по информационным и интеллектуальным системам ФГУП «НАМИ» Дениса Ендачева.  «Беспилотные технологии в автомобильной промышленности — это не только один из ключевых трендов, но уже и объективная реальность. Специалисты ФГУП "НАМИ" на протяжении многих лет участвуют в разработке и тестировании подобных технологий. В настоящий момент для тестирования беспилотных технологий на дорогах общего пользования и на специальном испытательном полигоне используется автомобиль Lada Vesta», — рассказал господин Ендачев. Он сообщил, что тестируемая в настоящее время система автономного вождения показывает стабильность в работе и позволяет автомобилю двигаться в беспилотном режиме в городском потоке. Было отмечено, что разрабатываемые российскими учёными подобные системы позволят снизить стоимость перевозки пассажиров в такси, а также удешевят грузоперевозки. «Я уверен, что подобные технологии в ближайшем времени будут активно применяться большинством автопроизводителей», — добавил господин Ендачев. Напомним, в марте 2022 года правительство России утвердило программу экспериментально-правового режима по эксплуатации беспилотного транспорта. В то же время отмечалось, что интеграция беспилотного транспорта с ИИ-технологиями является важной частью программы цифровой трансформации экономики страны. В России беспилотные автомобили на территории «Иннополиса» (ОЭЗ в Татарстане) и на федеральной территории Сириус тестирует компания «Яндекс». Кроме того, в прошлом году на трассе М-11 «Нева» было запущено движение беспилотных грузовиков «Камаз». Microsoft и Intel сформулировали определение «ПК с искусственным интеллектом»

27.03.2024 [17:24],

Николай Хижняк

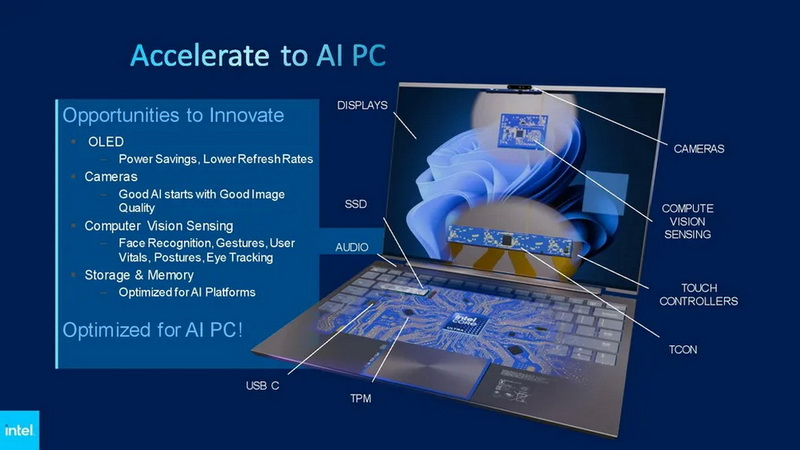

Intel и Microsoft представили на проходящей конференции в Тайбэе своё универсальное определение «ПК с искусственным интеллектом». В понимании обоих производителей, далеко не все актуальные модели ПК и ноутбуков, представленных сегодня на рынке, ему соответствуют, даже несмотря на то, что они оснащены новейшими процессорами с ИИ-ускорителями и ИИ-помощником Copilot на базе большой языковой модели, который входит в состав операционной системы Windows 11.

Источник изображений: Intel В октябре прошлого года компания Intel запустила программу AI PC Acceleration Program, призванную побудить независимых разработчиков программного обеспечения, а также производителей аппаратных средств присоединиться к расширению экосистемы ПК, оснащённых технологиями искусственного интеллекта. На конференции в Тайбэе производитель процессоров сообщил, что будет более активно помогать разработчикам ПО и аппаратных средств в рамках этого процесса. Intel представила специальные комплекты разработчиков на базе NUC с новейшими процессорами Core Ultra (Meteor Lake) для разработки программных решений с поддержкой ИИ, а также поделилась чётким определением «ПК с искусственным интеллектом», каким его представляет компания Microsoft. Стремительное развитие технологий искусственного интеллекта и машинного обучения в течение последних лет открыло огромные возможности для внедрения новых аппаратных и программных функций в проверенную временем платформу ПК. Однако само по себе определение «ПК с искусственным интеллектом» или ИИ ПК по-прежнему оставалось расплывчатым. Ведущие мировые производители процессоров, включая Intel, AMD, Apple уже разработали и выпустили свои аппаратные решения, оснащённые специальными блоками ускорения работы ИИ-алгоритмов (NPU), которые располагаются на кристаллах чипов рядом с обычными ядрами CPU и GPU. На рынке скоро также должны появиться ноутбуки на базе процессоров Qualcomm, тоже оснащённых такими ИИ-ускорителями. Однако у каждой компании имеется свой взгляд на то, что представляет собой компьютер с искусственным интеллектом. Ранее Intel уже заявляла, что к концу 2025 году планирует оснастить 100 млн ПК по всему миру своими процессорами с NPU. Для достижения этих целей производитель заручился поддержкой более сотни независимых поставщиков программного обеспечения и уже к концу 2024 года планирует вывести на рынок более 300 различных приложений с поддержкой искусственного интеллекта. Согласно прогнозам аналитического агентства Canalys, конкуренция на рынке ПК с технологиями ИИ в ближайшие годы будет усиливаться. И если к концу 2024 года доля поставок ПК с поддержкой искусственного интеллекта составит 19 % от общемировых объёмов поставок компьютеров, то 2027 эта доля вырастет уже до 60 %. В новом совместно разработанном Microsoft и Intel определении говорится, что компьютер с искусственным интеллектом будет поставляться с нейронным сопроцессором (NPU), центральным и графическим процессорами, поддерживающими ИИ-помощника Microsoft Copilot, а также будет иметь физическую клавишу вызова ИИ-помощника Copilot непосредственно на клавиатуре, которая заменит правую клавишу Windows. Copilot — это чат-бот с искусственным интеллектом, созданный на основе LLM (большой языковой модели) и в данный момент активно внедряющийся компанией Microsoft в её операционную систему Windows 11. В настоящее время он работает через облачные сервисы, но, как сообщается, компания планирует реализовать локальную обработку Copilot непосредственно на ПК для повышения его производительности и оперативности. Озвученное Intel и Microsoft определение «ПК с искусственным интеллектом» означает, что большинство уже выпущенных ноутбуков на процессорах Intel Meteor Lake и AMD Ryzen AI последних поколений, поставляющихся без выделенной клавиши вызова Copilot, на самом деле не соответствуют официальным критериям Microsoft. В то же время можно ожидать, что все ключевые производители ПК и ноутбуков рано или поздно скорректируют характеристики своих решений для соответствия этим требованиям. Хотя Intel и Microsoft сейчас занимаются совместным продвижением нового определения ИИ ПК, у самой Intel есть более простое определение для таких систем. В нём описывается ПК с CPU, GPU и NPU, в котором каждый из этих компонентов имеет свои собственные возможности ускорения выполнения задач, специфичных для искусственного интеллекта. Intel предлагает распределять рабочие нагрузки ИИ между указанными компонентами в зависимости от типа необходимых вычислений. При этом на NPU компания предлагает возлагать нагрузки ИИ с низкой интенсивностью, с которыми он сможет справляться с высокой степенью энергоэффективности. Сюда можно отнести, например, обработку фотографий, а также аудио и видео. NPU сможет ускорить выполнение этих задач непосредственно на компьютере, а не полагаясь на специальные облачные сервисы. В Intel отмечают, что таким образом получится одновременно увеличить время автономности систем с NPU, повысить их производительность, а также реализовать высокий уровень конфиденциальности данных за счёт хранения всей информации на локальном компьютере, а не в Сети. Использование NPU в низкоинтенсивных нагрузках также освободит ресурсы центрального и графического процессоров, которые можно будет использовать для других задач. Возможности CPU и GPU предлагается использовать при более интенсивных ИИ-нагрузках, где мощностей NPU может оказаться недостаточно. При необходимости ресурсы NPU и GPU также можно будет использовать одновременно, например, для запуска ресурсоёмких языковых моделей. Разные модели искусственного интеллекта имеют разные требования к объёму используемой памяти и скорости компонентов, которые необходимы для их работы. Одни могут создавать более сложные и точные языковые модели, другие обеспечивают более высокую скорость выполнения поставленных задач. Intel говорит, что вопрос доступного объёма памяти у ПК станет ключевым для запуска LLM. Некоторые модели требуют 16 Гбайт ОЗУ, другим требуется вдвое больше. В перспективе это может привести к значительному увеличению стоимости потребительских компьютеров с ИИ, особенно в сегменте ноутбуков, однако Microsoft пока не определила минимальные требования к доступной памяти. Очевидно, что компания продолжит сотрудничество с производителями ПК и ноутбуков, чтобы найти нужный компромисс. Для каждого сегмента потребительских устройств, вероятно, будут выставлены свои требования. Но вполне можно ожидать, что даже в системах начального уровня с искусственным интеллектом появится больше памяти, а ПК с 8 Гбайт ОЗУ будут встречаться крайне редко или вообще исчезнут. Что касается специальных комплектов разработчиков программного обеспечения с поддержкой ИИ, то для них Intel представила системы ASUS NUC Pro 14, оснащённые процессорами Core Ultra (Meteor Lake). Это компактные неттопы, оснащённые несколькими портами USB 3.2, а также интерфейсами Thunderbolt, предлагающие до 96 Гбайт ОЗУ. Более подробные характеристики указанных систем компания не сообщает, однако отмечает, что они также предлагают набор предустановленного специального программного обеспечения, инструментов, компиляторов и драйверов, необходимых для разработки программ с поддержкой ИИ. Установленные инструменты включают, среди прочего, Cmake, Python и OpenVino. Платформа Intel также поддерживает ONNX, DirectML и WebNN и другие средства для разработки и оптимизации программного обеспечения. Intel отмечает, что на её оборудовании с использованием OpenVino уже разработано более 280 различных открытых и оптимизированных ИИ-моделей, на базе ONNX — 173 моделей, а на базе Hugging Face — 150. При этом самые популярные модели скачиваются более 300 тыс. раз в месяц. Компания уже сотрудничает с десятками крупных поставщиков программного обеспечения по вопросу интеграции ИИ в их продукты. В их числе Zoom, Adobe, Autodesk и многие другие. Однако Intel хочет расширить экосистему разработчиков, добавив к ней небольшие независимые команды и даже разработчиков-одиночек. Именно для них компания подготовила специальные комплекты разработчиков. Первые устройства для разработки программного обеспечения с ИИ-функциями будут выдаваться на текущей конференции в Тайбэе. В перспективе Intel также хочет предоставить указанные комплекты разработчиков тем, кто в силу разных причин не может участвовать в подобных мероприятиях. Однако эта часть программы AI PC Acceleration Program пока не началась из-за различных ограничений в разных странах и других логистических проблем. Intel планирует предлагать комплекты разработчиков по льготной цене, однако конкретных деталей по этому поводу производитель не предоставил. В перспективе компания также планирует предоставлять разработчикам доступ к аналогичным аппаратным средствам на базе своих будущих платформ. Также компания планирует укрепить сотрудничество с различными университетами, представляя их факультетам информатики указанные комплекты разработчика. Для поддержки сообщества разработчиков на сайте Intel также имеется специальный центр знаний, в котором содержатся видеоуроки, инструкции, различная документация, дополнительные материалы и даже образцы кода. Для независимых поставщиков аппаратного обеспечения в рамках программы Open Labs компания Intel предлагает круглосуточный доступ к своим ресурсам для тестирования и оптимизации аппаратных средств, а также ранним образцам её оборудования в лабораториях в США, Китае и Тайване. Компания заявляет, что в рамках программы Open Labs более ста различных команд разработчиков уже представили около 200 различных аппаратных компонентов. Илон Маск объявил, что следующий имплант Neuralink подарит зрение слепым

21.03.2024 [19:20],

Сергей Сурабекянц

Основатель и владелец компании Neuralink Илон Маск (Elon Musk) анонсировал следующий продукт Neuralink — Blindsight (дословно — «Слепое зрение»). Это устройство предназначено для восстановления зрения. Ещё несколько лет назад Илон Маск заявил, что Neuralink сможет вернуть зрение слепым людям. Теперь, после успешной демонстрации игры в шахматы при помощи мозгового импланта, исполнение обещаний Маска кажется делом недалёкого будущего.

Источник изображения: Computerra «Первое применение, к которому мы собираемся стремиться у людей, — это восстановление зрения, и даже если у кого-то никогда не было зрения, как если бы он родился слепым, мы верим, что все равно можем восстановить зрение. Зрительная часть коры все ещё существует. Даже если они никогда раньше не видели, мы уверены, что они смогут увидеть», — заявил Маск на Neuralink Show & Tell в 2022 году. «Вы хотите иметь возможность читать сигналы мозга. Вы хотите иметь возможность записывать сигналы. В конечном итоге вы хотите иметь возможность сделать это для всего мозга, а затем распространить это на остальную часть вашей нервной системы, если у вас повреждён спинной мозг или шея», — добавил он. В ноябре 2023 года Илон Маск сообщил, что Neuralink работает над чипом машинного зрения, но на его подготовку уйдёт несколько лет. В то время компания была сосредоточена на получении одобрения регулирующих органов на свои первые испытания на людях. 20 марта 2024 года Маск в своём аккаунте социальной сети X опубликовал короткое сообщение о следующем продукте компании.

Источник изображения: Twitter Позже Маск добавил, что имплант Blindsight уже тестируется на обезьянах. «Поначалу разрешение [искусственного зрения] будет низким, как в ранней графике Nintendo, но в конечном итоге может превысить нормальное человеческое зрение», — написал Маск в X и добавил, что ни одна обезьяна не погибла и не получила серьезных травм от устройства Neuralink. В январе этого года первый парализованный доброволец перенёс операцию по установке в черепную коробку импланта Neuralink, который позволил ему научиться управлять курсором на ноутбуке буквально при помощи мысли. Компания на этой неделе опубликовала видео, демонстрирующие обретённые после этой операции добровольцем новые физические возможности. Нейросети помогут в поиске мелкого космического мусора

06.03.2024 [17:39],

Павел Котов

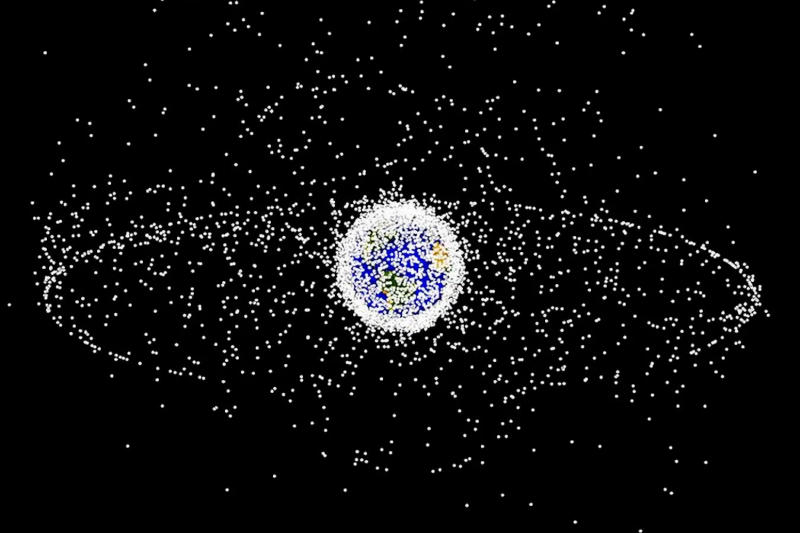

Европейские учёные предложили адаптировать популярные ИИ-алгоритмы систем машинного зрения для анализа сделанных при помощи радаров снимков околоземного пространства и обнаружения на них миниатюрных частиц космического мусора.

Источник изображения: nasa.gov Исследователи провели эксперимент, применив существующие нейросети, используемые в системах машинного зрения, для анализа данных с европейского радара TIRA — это 47-метровая радиотарелка, которая помогает наблюдать за околоземным пространством и получать изображения, на которых производится поиск космического мусора. Авторы проекта попытались заменить стандартные алгоритмы анализа данных TIRA нейросетями семейства YOLO, которые применяются для поиска движущихся объектов на снимках. Версии нейросетей YOLOv5 и YOLOv8 обучили при помощи массива из 3000 снимков околоземного пространства и проверили их эффективность на примере 600 изображений с радаров, на которых были от одного до трёх частиц космического мусора. Обе нейросети корректно обнаружили от 85 % до 97 % частиц размером от сантиметра при минимальном числе ложных срабатываний. Результат оказался выше того, что демонстрирует стандартный алгоритм TIRA. Учёные сделали вывод, что системы машинного зрения могут успешно применяться для поиска космического мусора в околоземном пространстве и для его отслеживания в реальном времени. Это поможет снизить число инцидентов, связанных с попаданием частиц космического мусора в работающие орбитальные аппараты. По оценкам экспертов, на орбите Земли могут находиться более 170 млн частиц космического мусора. Китайская Geely запустила 11 спутников для точной навигации беспилотных авто

03.02.2024 [11:53],

Владимир Фетисов

Китайский автопроизводитель Geely заявил об успешном выведении на низкую околоземную орбиту 11 спутников, предназначенных для обеспечения точной навигации её автономных транспортных средств. План компании состоит в том, чтобы к 2025 году нарастить численность своей спутниковой группировки до 72 аппаратов, а всего в неё должный войти 240 спутников.

Источник изображения: hdpic.club Нынешний пуск стал для Geely вторым и был выполнен с площадки космодрома Сичан, который находится в юго-западной китайской провинции Сычуань. До этого спутники Geely выводились на низкую околоземную орбиту в июне 2022 года. Согласно имеющимся данным, помимо обеспечения поддержки высокоточного позиционирования беспилотных автомобилей спутниковая группировка Geely будет задействована для выполнения ряда других коммерческих функций, таких как обеспечение связи в секторе бытовой электроники. Кроме того, спутники могут использоваться для дистанционного зондирования Земли с использование ИИ-алгоритмов. В спутниковых сетях Китая по-прежнему доминируют военные, но с 2014 года правительство Поднебесной разрешило частные инвестиции в космическую отрасль. С тех пор в этот сектор устремились коммерческие компании, некоторые из которых поддерживаются местными властями. Основная часть коммерческих компаний сосредоточилась на производстве спутников, тогда как некоторые из них разрабатывают небольшие ракеты-носители, в том числе многоразовые. По данным источника, в распоряжении Китая более 400 спутников, включая аппараты коммерческих компаний. В Китае вживили человеку более безопасную альтернативу мозгового имплантата Neuralink

01.02.2024 [15:27],

Геннадий Детинич

Группа учёных из Университета Цинхуа сообщила, что разработанный ими мозговой имплантат вернул давно парализованному пациенту подвижность руки. Отмечается, что китайская разработка менее опасна для тканей мозга, чем имплантат компании Neuralink Илона Маска (Elon Musk). Имплантат Маска проникает в нервную ткань и разрушает часть нервных клеток в месте установки, тогда как китайский датчик накладывается поверх нервной ткани.

Источник изображения: Tsinghua University На днях Илон Маск признался, что компания Neuralink провела первую операцию по установке мозгового имплантата в голову человека. Датчик Neuralink заглубляет в нервную ткань коры головного мозга тончайшие иглы. Заглубление происходит всего на 2 мм, но оно, без сомнения, разрушает часть нервных клеток в месте установки. Китайские учёные пошли по другому пути. Около 10 лет команда из Цинхуа разрабатывала имплантат, который сохранял бы достаточную к мозговым сигналам чувствительность и не повреждал бы корковые нейроны, которые лишними не могут быть по определению, поскольку отвечают, в том числе, за память и навыки. Поэтому датчик Neural Electronic Opportunity или NEO, как они назвали свою разработку, помещается в эпидуральное пространство между мозгом и черепом. Оно также заполнено живыми тканями и сосудами, но нервной ткани в них нет. Датчик NEO не имеет собственного питания. Оно у него беспроводное. Высокочастотная передающая антенна для передачи питания и блок управления, а также передатчик сигналов мозга на смартфон или компьютер смонтированы на внешней стороне черепа. Платформа работает через систему машинного обучения, которая совершенствует свои способности по мере реабилитационных мероприятий. Первый имплантат был установлен пациенту 24 октября 2023 года. К настоящему времени учёные наблюдают «впечатляющий прогресс». Человек, который последние 14 лет после перенесённой травмы не мог двигать своими руками и ногами, с помощью мозгового имплантата научился управлять элементом экзоскелета на руке настолько, что смог самостоятельно принимать пищу. В декабре была проведена операция на другом пациенте, но он пока проходит стадию восстановления. «Следующим этапом исследования является разработка нового протокола активной реабилитации с поддержкой интерфейса мозг-компьютер для ускорения роста нервной ткани на месте повреждённых сегментов спинного мозга», — сообщили в университете. Только лечением травм и заболеваниями нервной системы учёные не ограничатся. В перспективе они мечтают соединить мозг и компьютер таким интерфейсом, чтобы одно стало продолжением другого. MSI представила читерский монитор MEG 321URX — он сам находит врагов в League of Legends

10.01.2024 [22:59],

Николай Хижняк

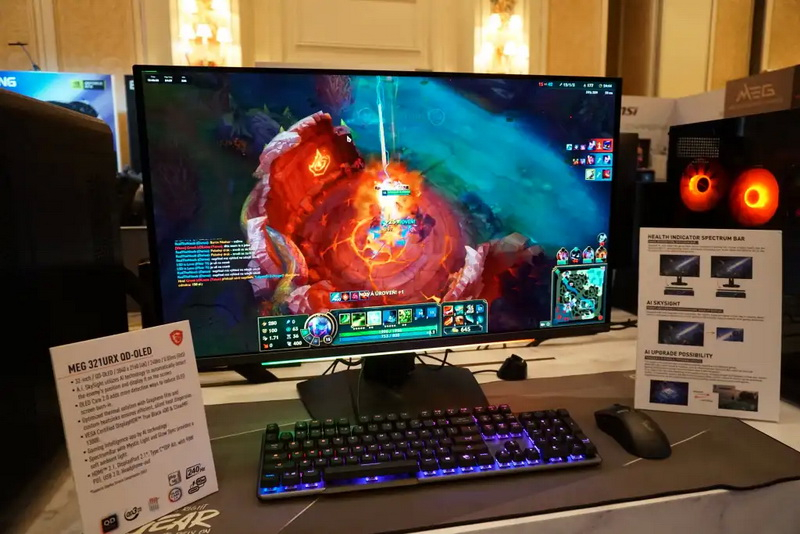

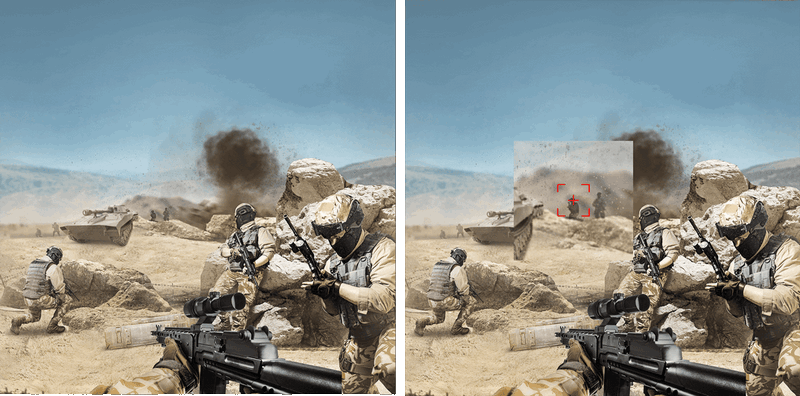

Компания MSI представила на выставке CES 2024 необычный игровой 32-дюймовый QD-OLED-монитор MEG 321URX. Его главной особенностью является встроенный ИИ, который не только улучшает качество работы дисплея, но также обладает функцией обнаружения врагов в League of Legends и показывает место на карте, откуда они могут появиться. Позже монитору добавят возможность помогать игрокам и в других играх.

Источник изображения: Brad Chacos / IDG Компания называет эту технологию SkySight. По словам производителя, SkySight анализирует мини-карту на экране и предсказывает, откуда может появиться противник, отображая эту информацию в виде красного пятна на дисплее. Опытные игроки способны делать что-то подобное самостоятельно, но для новичков эта функция может оказаться крайне полезной. Неизвестно, нарушает ли такой подход правила League of Legends, однако распознать работу SkySight вряд ли смогут даже самые продвинутые алгоритмы против читеров. Дело в том, что анализ ИИ и генерация второго слоя изображения на экране выполняются специальным чипом, встроенным в сам монитор. Функция работает независимо от операционной системы и программного обеспечения компьютера. Ещё одной особенностью монитора стала светодиодная полоска внизу дисплея, которая дублирует полоску очков здоровья персонажа в игре. MSI говорит, что к началу продаж MEG 321URX весной этого года выпустит специальное ПО, которое позволит обучать встроенный ИИ-алгоритм монитора для обнаружения врагов и шкал здоровья в любых других играх. Для первоначального обучения ИИ-алгоритма это программное обеспечение будет использовать ресурсы ПК. Однако потом всю обработку, анализ и отображение на экране будет выполнять сам монитор. В MSI пока не говорят, какой именно ИИ-процессор используется в MEG 321URX и как он хранит набор данных для обучения. Кроме этого, в монитор встроены технологии умного прицела и оптического зума — первая автоматически меняет цвет прицела так, чтобы он не сливался с окружением, а зум при нажатии горячих клавиш превращает любое оружие в снайперскую винтовку, приближая и увеличивая врагов на экране.  Даже если пользователю не нужны все эти читерские ИИ-функции, то MEG 321URX сам по себе обладает отличными характеристиками. Его экран поддерживает разрешение 3840 × 2160 пикселей, частоту обновления 240 Гц, имеет 99-процентный охват цветового пространства DCI-P3, обладает контрастностью 1 500 000:1 и имеет сертификацию DisplayHDR True Black 400. Кроме того, он поддерживает технологию OLED Care 2.0, которая снижает вероятность выгорания экрана. В оснащение монитора входят разъёмы HDMI 2.1, DisplayPort 2.1, USB 2.0 и USB-C. Последний может работать в альтернативном режиме DisplayPort, а также передавать до 90 Вт мощности на внешнее устройство. Стоимость монитора MEG 321URX производитель пока не сообщает. AMD представила чипы XA Versal AI Edge и Ryzen Embedded V2000A для расширения ИИ-функций автомобилей

05.01.2024 [21:40],

Николай Хижняк

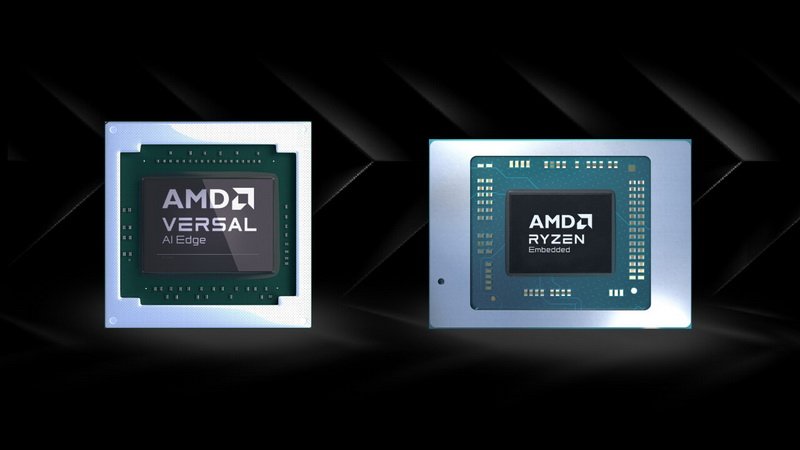

Компания AMD представила продукты, предназначенные для расширения ИИ-возможностей автомобилей. Первым является серия однокристальных платформ XA Versal AI Edge, который оснащены ИИ-движками и массивом векторных процессоров. Их основное предназначение — повышение безопасности и эффективности работы датчиков LiDAR, радаров, камер и прочих сенсоров на базе ИИ. Также была представлена серия процессоров Ryzen Embedded V2000A для расширения возможностей мультимедийных систем авто.

Источник изображений: AMD Примечательная особенность серии SoC AMD XA Versal AI Edge и процессоров Ryzen Embedded V2000A заключается в том, что это первые 7-нм чипы, сертифицированные для использования в автомобильной отрасли. В целом же XA Versal AI Edge и Ryzen Embedded V2000A призваны улучшить водительский и пассажирский опыт использования различных систем автомобиля, позволяя реализовать в них поддержку различных ИИ-функций. XA Versal AI Edge — это адаптивная платформа, отвечающая за поддержку искусственного интеллекта и предназначенная для управления различными датчиками авто. XA Versal AI Edge отвечает за повышение точности и отзывчивости автомобильных датчиков LiDAR, радаров и камер, что является критически важным для принятия быстрых и точных решений ИИ-системами. Одним из преимуществ платформы XA Versal AI Edge является её масштабируемость. Например, в составе флагманского SoC XAVE2602 используются 152 ИИ-движка с 820 тыс. логическими ячейками, а также 984 цифровых сигнальных процессоров (DSP). AMD заявляет для этого чипа производительность до 89 TOPS (триллионов операций в секунду) в вычислениях INT8. Компания также сможет предложить платформы XA Versal AI Edge с показателями производительности от 5 до 171 TOPS, предназначенные для разных сегментов и задач. Основой XA Versal AI Edge служит APU в парой ядер Arm Cortex-A72, а также двуядерный модуль Arm Cortex-R5F RPT. Показатель энергопотребления чипов XA Versal AI Edge варьируется от 6–9 Вт (платформа XAVE2002) до внушительных 75 Вт (платформа XAVE2802). Серия процессоров Ryzen Embedded V2000A предназначена для расширения ИИ-возможностей мультимедийных систем авто как для водителя, так и для пассажиров. Эти процессоры могут использоваться для управления цифровым салоном автомобилей — от информационно-развлекательной консоли до пассажирских дисплеев. В составе этих процессоров, производящихся с применением 7-нм техпроцесса, используются ядра на архитектуре Zen 2. Новые чипы пришли на смену четырёхъядерному и восьмипоточному APU Ryzen Embedded V1000 на архитектуре Zen первого поколения. Ryzen Embedded V2000A предлагают до шести ядер Zen 2 с поддержкой до 12 виртуальных потоков и оснащены встроенной графикой Radeon Vega 7 с семью исполнительными блоками. Согласно AMD, новые процессоры до 88 % производительнее предшественников. Чипы Ryzen Embedded V2000A поддерживают подключение до четырёх 4K-дисплеев, работу двух гигабитных сетевых интерфейсов и сертифицированы по стандартам AEC-Q100 со строгими требованиями к качеству и надёжности. Компания обещает 10-летнюю поддержку этих процессоров. Ряд партнёров AMD, включая Tesla, Ecarx, Luxoft, BlackBerry/QNX, Xylon, Cognata и других, уже заинтересовались новыми платформами XA Versal AI Edge и Ryzen Embedded V2000A. По словам AMD, первый SoC XAVE1752 в рамках серии XA Versal AI Edge станет доступен в начале 2024 года. Остальные чипы серии будут выпущены до конца этого года. Компания также отмечает, что подготовила для потенциальных клиентов тестовый комплект AXVEK 280 для оценки возможностей новых SoC. Intel наняла выходца из HPE, чтобы он помог ей конкурировать с NVIDIA в сфере ИИ-ускорителей

04.01.2024 [22:58],

Николай Хижняк

Компания Intel назначила исполнительного директора Hewlett Packard Enterprise Джастина Хотарда (Justin Hotard) главой своей группы, занимающейся разработкой технологий для центров обработки данных и искусственного интеллекта. Тем самым она привлекла для управления одним из своих ключевых подразделений стороннего специалиста.

Джастин Хотард. Источник изображения: Intel В Hewlett Packard Enterprise Хотард отвечал за высокопроизводительные вычисления, искусственный интеллект и управление лабораториями HPE. В Intel он будет курировать разработку и поддержку некоторых наиболее важных продуктов компании, включая серверные процессоры Xeon, которые ранее доминировали в сегменте ЦОД, но уступили значительную долю рынка конкурирующим предложениям. До HPE Хотард также возглавлял компании NCR и Motorola Inc. В Intel он возглавит направление ИИ, специализированных графических процессоров и ускорителей и постарается вывести компанию на достойный уровень конкуренции с NVIDIA, которая в настоящий момент безоговорочно доминирует в этом направлении. Восстановление своего лидирующего положения на рынке продуктов для центров обработки данных имеет решающее значение для планов генерального директора Пэта Гелсингера (Pat Gelsinger) по восстановлению превосходства Intel в индустрии производства микросхем. Хотя чипы для ЦОД составляют относительно небольшую часть отрасли, сами по себе специализированные процессоры и ускорители на их основе могут продаваться за десятки тысяч долларов каждый, что делает их чрезвычайно прибыльными. Хотард, который приступит к своей работе в Intel с 1 февраля, сменит ветерана компании Сандру Риверу (Sandra Rivera). Ривера с понедельника перешла на должность главы подразделения программируемых решений Intel (Programmable Solutions Group, PSG), которое компания выделила в отдельный бизнес и планирует вывести на биржу в течение двух-трёх лет. Intel отдельно объявила, что ещё один топ-менеджер её подразделения ЦОД и ИИ Арун Субраманьян (Arun Subramaniyan) возглавил новую софтверную компанию Articul8, специализирующуюся на внедрении машинного обучения и больших языковых моделей (LLM). Она была создана Intel совместно с инвестиционными компаниями DigitalBridge Group и Mindset Ventures. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |