|

Опрос

|

реклама

Быстрый переход

AMD выпустила серверную видеокарту Radeon Pro V710, которую нельзя купить — только арендовать в Microsoft Azure

08.10.2024 [14:39],

Николай Хижняк

Компания AMD представила профессиональный графический ускоритель Radeon Pro V710, созданный эксклюзивно для размещения в центрах обработки данных Microsoft Azure. Приобрести новинку не получится — его мощности можно будет только арендовать для вычислений, работы с ИИ и других задач.

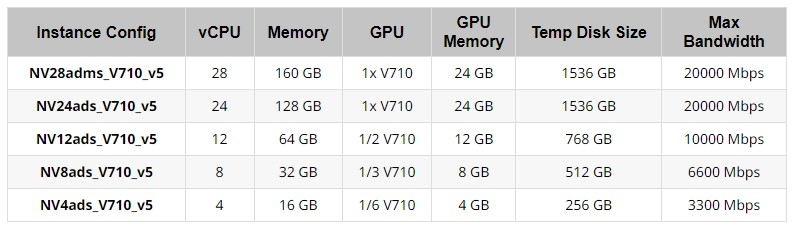

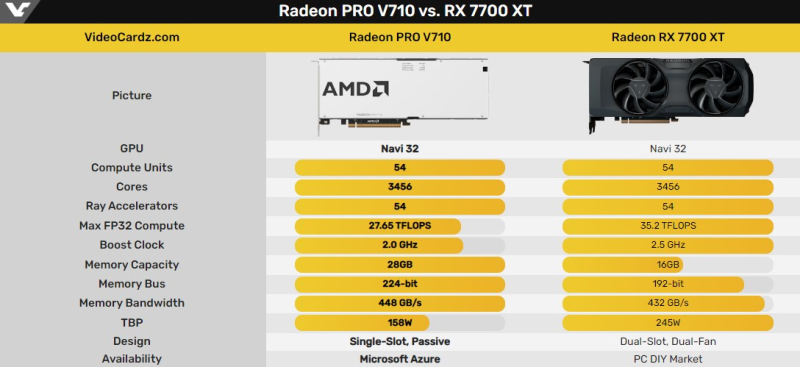

Источник изображений: AMD Radeon Pro V710 разработан для работы по моделям «рабочее место как услуга» и «рабочая станция как услуга», облачного гейминга, а также задач ИИ и машинного обучения. Возможность использования указанных ускорителей будет доступна эксклюзивно через облачные сервера Microsoft Azure, где клиентам на правах аренды будет предлагаться от 1/6 до 1x мощности указанного ускорителя и до 24 Гбайт видеопамяти, хотя сама видеокарта получила в общей сложности 28 Гбайт памяти.  В основе Radeon Pro V710 используется графический процессор Navi 32 с 54 исполнительными блоками графической архитектуры RDNA 3. Аналогичная конфигурация GPU используется в игровой видеокарте Radeon RX 7700 XT. Однако специализированный ускоритель Radeon Pro V710 получил 28 Гбайт памяти GDDR6 вместо 12 Гбайт, которые присутствуют у модели RX 7700 XT. Максимальная пропускная способность памяти у Radeon Pro V710 заявлена на уровне 448 Гбайт/с. Radeon Pro V710 поддерживает технологию R-IOV, которая позволяет изолировать память между виртуальными машинами, что даёт возможность нескольким клиентам одновременно использовать одну и ту же видеокарту. Карта также поддерживает аппаратное ускорение трассировки лучей, кодирования и декодирования AV1, HEVC (H.265) и AVC (H.264). Кроме того, она имеет поддержку программного обеспечения AMD ROCm. Последнее вместе с аппаратным ИИ-ускорителями для эффективного умножения матриц обеспечивают повышение вычислительной производительности для машинного обучения.

Источник изображения: VideoCardz Толщина видеокарты составляет один слот расширения, она оснащена пассивной системой охлаждения — за обдув будут отвечать корпусные вентиляторы самого сервера. По сравнению с игровой Radeon RX 7700 XT у Radeon Pro V710 вдвое больше памяти, более высокая пропускная способность памяти, но её GPU обладает частотой на 500 МГц ниже, чем у игрового решения. Кроме того, заявленный TDP специализированного ускорителя составляет 158 Вт, что на 35 % ниже, чем у игрового варианта. Intel выпустила серверные 128-ядерные процессоры Xeon 6 Granite Rapids и ИИ-ускорителя Gaudi 3

25.09.2024 [00:01],

Николай Хижняк

Компания Intel сообщила о выпуске новых серверных процессоров серии Xeon 6 (Granite Rapids), которые располагают исключительно P-ядрами. Также компания объявила о выпуске специализированного ИИ-ускорителя Gaudi 3.

Источник изображений: Intel Granite Rapids производятся по техпроцессу Intel 3 (5 нм). В серию вошли пять моделей с количеством ядер от 72 до 128, базовой частотой от 2,0 до 2,7 ГГц и максимальной частотой 3,9 ГГц (на одном ядре), а также от 3,2 до 3,7 ГГц на всех ядрах. Процессоры получили от 432 до 504 Мбайт кеш-памяти L3 и обладают заявленным показателем TDP от 400 до 500 Вт. Чипы поддерживают как однопроцессорные, так и двухпроцессорные сборки, имеют поддержку 12-канальной ОЗУ DDR5-6400 и MRDIMM-8800, а также оснащены поддержкой 96 линий PCIe. Intel заявляет, что Xeon 6 отличаются от предшественников увеличенным числом ядер, удвоенной пропускной способностью памяти и возможностями ускорения ИИ, встроенными в каждое ядро. Эти чипы разработаны для удовлетворения требований производительности ИИ — от Edge-систем до центров обработки данных и облачных сред. Intel заявляет, что новые Xeon 6 более чем вдвое быстрее процессоров Epyc Genoa (максимально — 96 ядер Zen 4) в широком спектре вычислительных нагрузок и более чем впятеро быстрее в нейросетевых задачах. В свою очередь специализированные ИИ-ускорители Gaudi 3 специально оптимизированы для работы с генеративными моделями. В их составе используются 64 тензорных процессора (TPC) и восемь движков матричного умножения (MME) для ускорения вычислений глубоких нейронных сетей. Также ускорители Gaudi 3 получили 128 Гбайт набортной памяти HBM2 и поддерживают до 24 портов Ethernet 200 Гбит для масштабируемых сетей. Для Gaudi 3 заявляется бесшовная совместимость с фреймворком PyTorch и усовершенствованными трансформными и диффузионными моделями Hugging Face. Intel заявляет, что новые ИИ-ускорители Gaudi 3 обеспечивают до 20 процентов большую пропускную способность и двукратное улучшение соотношения цены и производительности по сравнению с H100 для вывода модели LLaMa 2 70B. Для российского синхротрона СКИФ собран первый детектор

18.09.2024 [13:53],

Геннадий Детинич

Осталось около полугода до начала работы синхротрона СКИФ в наукограде Кольцово Новосибирской области и запуска первой очереди исследовательских станций на его основе. И одной из первых заработавших на комплексе станций станет лаборатория для изучения быстрых переходных процессов в материалах. На днях российские учёные сообщили об изготовлении первых детекторов как для этой лаборатории, так и для синхротрона.

Источник изображения: https://strana-rosatom.ru Всего на СКИФе будет 30 экспериментальных станций. Полное их создание растянется на несколько лет, но сам синхротрон и первые станции будут завершены к концу 2024 года. Эксплуатация синхротрона и первой очереди лабораторий начнётся в первой половине 2025 года. Представленный на днях детектор позволит снимать быстрые процессы в материалах со скоростью до 10 млн кадров в секунду. Образцы будут облучаться синхротронным излучением (разогнанными до релятивистских скоростей электронами). Детектор GINTOS для лаборатории (координатный детектор на полупроводниках) изготовили сотрудники Томского государственного университета (ТГУ) и Института ядерной физики им. Будкера (ИЯФ). «Детектор GINTOS позволит исследовать реакцию материалов на импульсные тепловые и механические нагрузки. Это необходимо для понимания процессов, которые будут происходить, например, в термоядерном реакторе ИТЭР при попадании раскалённой плазмы на вольфрамовую стенку. Также детектор позволит изучать распространение ударных волн и других динамических процессов в микросекундном диапазоне», — рассказал главный научный сотрудник ИЯФ Лев Шехтман. Как нетрудно понять, датчики GINTOS должны быть очень быстродействующими. Для них радиофизики ТГУ разработали сенсоры на основе арсенида галлия, компенсированного хромом. Этот материал обладает повышенной радиационной стойкостью и чувствительностью к рентгеновскому излучению. «Полупроводниковые сенсоры преобразуют фотонный сигнал в электрический, а электроника регистрирует этот сигнал и передаёт изображение в компьютер, — объясняет заведующий лабораторией детекторов синхротронного излучения ТГУ Олег Толбанов. — Количество кадров очень велико, поэтому результат съёмки — это не отдельные изображения, а фильм». Синхротрон СКИФ станет первым в мире источником синхротронного излучения поколения 4+. Он откроет широкие возможности для исследований в области материаловедения, биологии, фармацевтики, физики, квантовой химии и многих других сфер. Глючный софт Huawei мешает Китаю заменить Nvidia в области искусственного интеллекта

03.09.2024 [12:39],

Павел Котов

Попытки Китая выйти на уровень США по вычислительной мощности в области искусственного интеллекта сдерживаются многими факторами, среди которых и проблемы с ПО. Например, пользователи ускорителей вычислений Huawei жалуются на проблемы с производительностью из-за сбоев и ошибок в работе программного обеспечения, а также на сложности перехода с продуктов Nvidia, сообщает Financial Times.  Huawei стала лидером в гонке за создание китайской альтернативы ускорителям Nvidia после того, как Вашингтон в октябре прошлого года ввёл очередной пакет санкций, затронувший высокопроизводительное оборудование. Ускорители Ascend всё чаще используются китайскими разработчиками для запуска моделей генеративного ИИ. Но на практике выясняется, что оборудование Huawei всё ещё сильно отстаёт от ускорителей Nvidia на этапе обучения моделей. Китайские ускорители работают нестабильно, у них более медленные межчиповые соединения и некачественное ПО Huawei Cann. Программная платформа Cuda — сильный продукт Nvidia. Она проста в использовании и способна значительно ускорять обработку данных. Huawei пытается ослабить хватку Nvidia в области чипов ИИ, внедряя альтернативное ПО собственной разработки. Но на Cann жалуются даже сотрудники Huawei. Из-за него ускорители Ascend «сложны и нестабильны в работе», а тестирование оказывается сложной задачей. Качество документации оставляет желать лучшего, и при возникновении ошибок определить их источник получается не всегда. Ускорители Huawei Ascend используются в Baidu, но они часто выходят из строя, что усложняет разработку ИИ. Чтобы преодолеть эту проблему Huawei направляет к крупнейшим клиентам своих инженеров, которые помогают в переносе кода обучения ИИ с Cuda на Cann — сотрудники компании работают в Baidu, iFlytek и Tencent. Более 50 % из 207 тыс. сотрудников Huawei заняты по направлению исследований и разработки, включая инженеров, которые помогают развернуть технологические решения компании у клиентов. И в этом Huawei выгодно отличается от Nvidia. Китайская компания даже запустила онлайн-портал для разработчиков, где они могут оставлять предложения по улучшению ПО. После введения очередного пакета американских санкций Huawei подняла цены на ускорители Ascend 910B, которые используются для обучения ИИ, на 20–30 %. При этом объёмы их поставок ограничены, вероятно, из-за производственных трудностей — китайские компании не могут закупать оборудование для выпуска чипов у нидерландской ASML. На ИИ-ускорители Huawei держится высокий спрос. За первое полугодие компания нарастила выручку на 34 %, но не привела разбивки по направлениям деятельности. На ускорителях Ascend уже были обучены и интегрированы более 50 базовых моделей ИИ, подсчитали в Huawei — iFlytek сообщила, что обучила свою нейросеть исключительно на оборудовании Huawei, и его производитель направил в компанию группу инженеров, которые помогли в развёртывании решений. Молодые компании серьёзно настроены потягаться с Nvidia на рынке систем для запуска ИИ-моделей

28.08.2024 [16:52],

Павел Котов

В попытке ослабить мёртвую хватку Nvidia на рынке чипов для систем искусственного интеллекта сейчас мобилизуется множество конкурентов компании — они привлекают сотни миллионов долларов инвестиций, стремясь воспользоваться волной бума ИИ. Среди наиболее перспективных конкурентов значатся такие компании, как Cerebras, d-Matrix и Groq.

Источник изображения: Mariia Shalabaieva / unsplash.com Мелкие компании решили воспользоваться тем, что спрос на оборудование для инференса ИИ будет расти экспоненциальными темпами. Эти системы необходимы для запуска уже обученных систем вроде OpenAI ChatGPT и Google Gemini — популярность подобных приложений продолжает расти. Сейчас самыми популярными в этом сегменте являются графические процессоры Nvidia, принадлежащие к семейству Hopper. Компании Cerebras, d-Matrix и Groq заняты разработкой более дешёвых, но и более узконаправленных чипов, которые предназначаются для запуска моделей ИИ. Cerebras накануне представила платформу Cerebras Inference, которая работает на чипе CS-3, который занимает целую 300-мм кремниевую пластину. Этот чип, утверждает производитель, в 20 раз быстрее в задачах вывода ИИ, чем ускорители Nvidia Hopper, но стоит дешевле — это подтверждают тесты Artificial Analysis. Чип Cerebras CS-3 отличает другая архитектура, предусматривающая интеграцию компонентов памяти непосредственно в кремниевую пластину процессора. Ограничения, которые налагает пропускная способность памяти, значительно снижают производительность ИИ-ускорителей, утверждают в Cerebras — объединение логики и памяти на одном большом чипе даёт результаты «на порядки быстрее». В конце этого года ещё одна компания, d-Matrix, намеревается выпустить собственную аппаратную платформу Corsair, предназначенную для работы с Triton — открытой программной средой, которая выступает альтернативой Nvidia Cuda. В прошлом году компания привлекла $110 млн вложений, и в этом также проводит раунд финансирования, на котором намеревается привлечь от инвесторов ещё $200 млн или более. Бывший основатель команды, выступающей разработчиком тензорных процессоров Google, теперь возглавляет ещё одну компанию — Groq, которая в этом месяце привлекла $640 млн при оценке $2,8 млрд. Стартапам в области полупроводников, даже несмотря на шумиху в сегменте ИИ-оборудования, непросто выйти на рынок, предупреждают аналитики. Японский финансовый конгломерат SoftBank в июле поглотил чипмейкера Graphcore, заплатив $600 млн — при том, что с момента своего основания в 2016 году компания привлекла у около $700 млн. Но инвесторы не отчаиваются найти и поддержать «новую Nvidia», и этот процесс способствует развитию многих стартапов. IBM анонсировала 5-нм процессор Telum II и ускоритель Spyre для задач ИИ

27.08.2024 [05:45],

Анжелла Марина

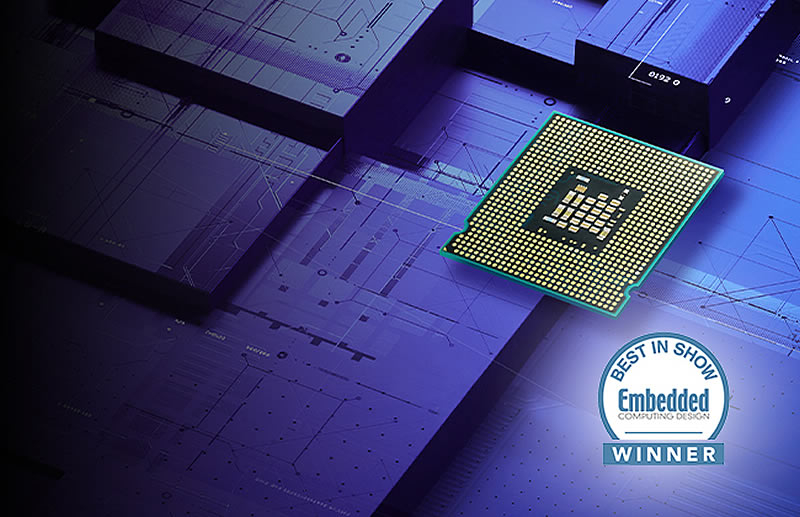

Компания IBM анонсировала новое поколение вычислительных систем для искусственного интеллекта — процессор Telum II и ускоритель IBM Spyre. Оба продукта предназначены для ускорения ИИ и улучшения производительности корпоративных приложений. Telum II предлагает значительные улучшения благодаря увеличенной кеш-памяти и высокопроизводительным ядрам. Ускоритель Spyre дополняет его, обеспечивая ещё более высокие показатели для приложений на основе ИИ.

Источник изображения: IBM Как сообщается в блоге компании, новый процессор IBM Telum II, разработанный с использованием 5-нанометровой технологии Samsung, будет оснащён восемью высокопроизводительными ядрами, работающими на частоте 5,5 ГГц. Объём кеш-памяти на кристалле получил увеличение на 40 %, при этом виртуальный L3-кеш вырос до 360 Мбайт, а L4-кеш до 2,88 Гбайт. Ещё одним нововведением является интегрированный блок обработки данных (DPU) для ускорения операций ввода-вывода и следующее поколение встроенного ускорителя ИИ. Telum II предлагает значительные улучшения производительности по сравнению с предыдущими поколениями. Встроенный ИИ-ускоритель обеспечивает в четыре раза большую вычислительную мощность, достигая 24 триллионов операций в секунду (TOPS). Архитектура ускорителя оптимизирована для работы с большими языковыми моделями и поддерживает широкий спектр ИИ-моделей для комплексного анализа структурированных и текстовых данных. Кроме того, новый процессор поддерживает тип данных INT8 для повышения эффективности вычислений. При этом на системном уровне Telum II позволяет каждому ядру процессора получать доступ к любому из восьми ИИ-ускорителей в рамках одного модуля, обеспечивая более эффективное распределение нагрузки и достигая общей производительности в 192 TOPS. IBM также представила ускоритель Spyre, разработанный совместно с IBM Research и IBM Infrastructure development. Spyre оснащён 32 ядрами ускорителя ИИ, архитектура которых схожа с архитектурой ускорителя, интегрированного в чип Telum II. Возможность подключения нескольких ускорителей Spyre к подсистеме ввода-вывода IBM Z через PCIe позволяет существенно увеличить доступные ресурсы для ускорения задач искусственного интеллекта. Telum II и Spyre разработаны для поддержки широкого спектра сценариев использования ИИ, включая метод ensemble AI. Этот метод использует преимущества одновременного использования нескольких ИИ-моделей для повышения общей производительности и точности прогнозирования. Примером может служить обнаружение мошенничества со страховыми выплатами, где традиционные нейронные сети успешно сочетаются с большими языковыми моделями для повышения эффективности анализа. Оба продукта были представлены 26 августа на конференции Hot Chips 2024 в Пало-Альто (Калифорния, США). Их выпуск планируется в 2025 году. Imagination отказалась от нейропроцессоров в пользу совершенствования GPU под нужды ИИ

25.08.2024 [22:00],

Анжелла Марина

Британский разработчик чипов Imagination Technologies на фоне получения $100 млн инвестиций меняет свою стратегию в сфере искусственного интеллекта, отказываясь от использования отдельных нейропроцессоров (NPU) и внедряя ИИ-функции в графические процессоры (GPU).

Источник изображения: imaginationtech.com По данным Tom's Hardware со ссылкой на источник, это стратегическое решение было принято в течение последних 18 месяцев из-за сложностей с собственным разработанным ранее программным стеком, который не успевал за быстро меняющимися потребностями клиентов в области искусственного интеллекта. Создание ИИ-функциональности, способной раскрыть все возможности нейропроцессора от Imagination Technologiesоказалось было затруднено. Компания переключила внимание на GPU, которые по своей природе многопоточны и хорошо подходят для задач, требующих эффективной параллельной обработки данных. Imagination Technologies считает, что GPU можно усовершенствовать дополнительными вычислительными возможностями для ИИ, что сделает их подходящими для периферийных приложений, особенно в устройствах с уже существующими GPU, таких как смартфоны. Напомним, что Imagination Technologies, работающая на рынке около 40 лет, приобрела известность благодаря графическим процессорам PowerVR Kyro для ПК и IP-ядрам GPU PowerVR, используемым Apple, Intel и другими компаниями. Теперь же в рамках новой стратегии компания сотрудничает с UXL Foundation над разработкой SYCL — открытой платформой, конкурирующей с программно-аппаратной архитектурой параллельных вычислений CUDA от Nvidia. Такой подход отвечает потребностям клиентов, которые уже используют GPU для обработки графики и задач искусственного интеллекта.

Источник изображения: imaginationtech.com Получение инвестиций в размере $100 млн от Fortress Investment Group, вероятно, связано с новой стратегией Imagination Technologies. Компания уверена, что GPU на данный момент являются лучшим решением для удовлетворения потребностей клиентов в области ИИ, прекратив разработку отдельных нейронных ускорителей. Тем не менее, Imagination не исключает возможности возвращения к разработке специализированных нейропроцессоров в будущем, если развитие программного обеспечения для ИИ изменит ситуацию. Продажи ИИ-серверов в 2024 году вырастут до $187 млрд — они займут 65 % всего рынка

17.07.2024 [16:22],

Павел Котов

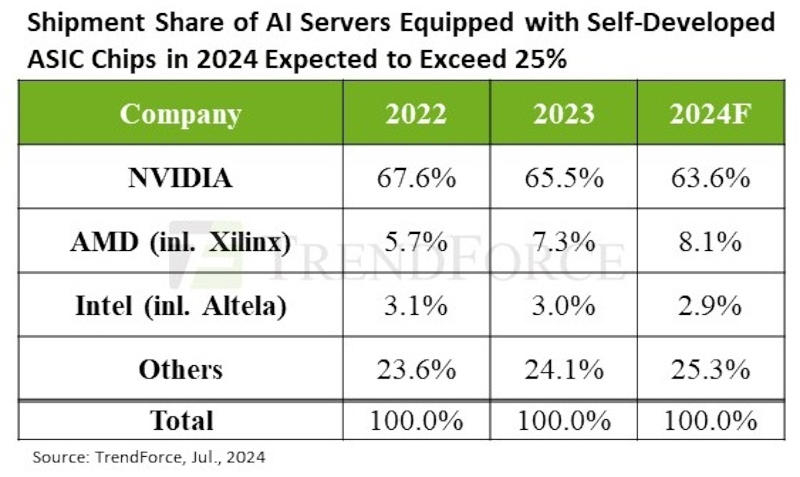

Высокий спрос на передовые серверы для систем искусственного интеллекта со стороны крупных поставщиков облачных услуг и их клиентов сохранится до конца 2024 года, уверены аналитики TrendForce. Расширение производства TSMC, SK hynix, Samsung и Micron значительно сократило дефицит во II квартале 2024 года — срок выполнения заказа на флагманские ИИ-ускорители Nvidia H100 сократился с прежних 40–50 до менее чем 16 недель.

Источник изображения: nvidia.com Объём поставок ИИ-серверов по итогам II квартала увеличился почти на 20 % по сравнению с предшествующим кварталом, гласит предварительная оценка TrendForce — годовой прогноз поставок был пересмотрен до значения 1,67 млн единиц, что соответствует росту на 41,5 % год к году. Крупные облачные провайдеры в этом году направляют свои бюджеты на закупку ИИ-серверов в ущерб темпам роста поставок обычных серверов — он составит всего 1,9 %. Ожидается, что доля ИИ-серверов в общем объёме поставок достигнет 12,5 %, что примерно на 3,4 п.п. выше, чем в 2023 году. С точки зрения рыночной стоимости ИИ-серверы вносят больший вклад в рост выручки, чем обычные серверы. По итогам 2024 года рыночная стоимость ИИ-серверов превысит $187 млрд при темпе роста 69 %, что составит 65 % от общей стоимости серверов, гласит прогноз TrendForce. Собственные ASIC-решения активно расширяют как североамериканские операторы AWS и Meta✴✴, так и китайские гиганты в лице Alibaba, Baidu и Huawei. Как ожидается, по итогам 2024 года доля ASIC-серверов составит до 26 % от общего серверного рынка, тогда как на ИИ-серверы с массовыми GPU придутся около 71 %.

Источник изображения: trendforce.com Nvidia удержит крупнейшую долю около 90 % на рынке поставщиков ИИ-чипов для ИИ-серверов; доля рынка AMD будет всего около 8 %. Но если включить все чипы ИИ, используемые в ИИ-серверах (GPU, ASIC, FPGA), доля рынка Nvidia по итогам года составит около 64 %. Спрос на передовые ИИ-серверы, считают аналитики TrendForce, останется высоким на протяжении всего 2025 года, особенно с учётом того, что на смену Nvidia Hopper придёт новое поколение ИИ-ускорителей Blackwell (GB200, B100/B200). Из-за этого вырастет спрос на упаковку чипов TSMC CoWoS и память HBM: на ускорителе Nvidia B100 размер чипа вдвое больше. Производственная мощность TSMC CoWoS к концу 2025 года достигнет 550–600 тыс. единиц при темпах роста около 80 %. Массовый Nvidia H100 в 2024 году будет оснащаться 80 Гбайт HMB3; к 2025 году чипы Nvidia Blackwell Ultra и AMD MI350 получат до 288 Гбайт HBM3e, утроив расход компонентов памяти. Ожидается, что общее предложение HBM к 2025 году удвоится из-за высокого спроса на рынке ИИ-серверов. Франция готовит обвинения против Nvidia из-за доминирования на рынке GPU и ИИ-ускорителей

01.07.2024 [20:55],

Анжелла Марина

Французский антимонопольный регулятор планирует предъявить обвинения Nvidia — компанию подозревают в антиконкурентной практике ведения бизнеса. Это станет первым случаем правоприменительных действий против крупнейшего производителя компьютерных чипов.

Источник изображения: Mariia Shalabaieva / Unsplash По данным Reuters, ссылающегося на информированные источники, французский надзорный комитет готовится выдвинуть обвинения против компании Nvidia, лидера в производстве графических процессоров и ускорителей вычислений для искусственного интеллекта. Этому предшествовали рейды в сентябре прошлого года, направленные на расследование деятельности Nvidia в секторе поставок графических процессоров. Расследование является частью более широкого изучения конкуренции в сфере облачных вычислений. При этом особое внимание регуляторов привлёк резкий рост спроса на чипы Nvidia после выпуска ChatGPT, что вызвало озабоченность как в Европе, так и в США. Французский регулятор в своём недавнем отчёте в целом указал на риски злоупотреблений со стороны поставщиков чипов. Особую обеспокоенность вызывает зависимость отрасли от проприетарного программного обеспечения Nvidia CUDA — многие системы используют только этот софт и замены ему нет. Кроме того, регулятор выразил беспокойство по поводу недавних инвестиций Nvidia в поставщиков облачных услуг, ориентированных на искусственный интеллект, таких как CoreWeave. В случае, если нарушения французских антимонопольных правил, Nvidia может грозить штраф до 10 % от глобального годового оборота. Однако компания может избежать штрафа, пойдя на уступки. Параллельно с европейскими расследованиями, Министерство юстиции США также ведёт расследование в отношении Nvidia, разделяя контроль над крупными технологическими компаниями с Федеральной торговой комиссией. Nvidia и французский регулятор пока воздерживаются от комментариев по данному вопросу. Etched представила ИИ-чип для нейросетей-трансформеров — он в разы быстрее и дешевле ускорителей Nvidia

25.06.2024 [19:01],

Сергей Сурабекянц

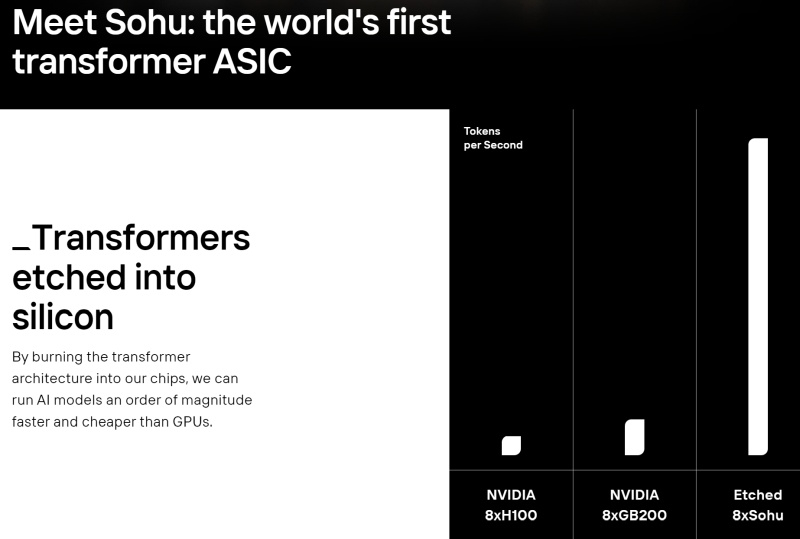

Компания Etched основана два года назад двумя выпускниками Гарварда с целью разработать специализированный ускоритель ИИ. Чипы Etched уникальны тем, что поддерживают лишь один тип моделей ИИ: трансформеры. Эта архитектура, предложенная командой исследователей Google в 2017 году, на сегодняшний день стала доминирующей архитектурой генеративного ИИ.

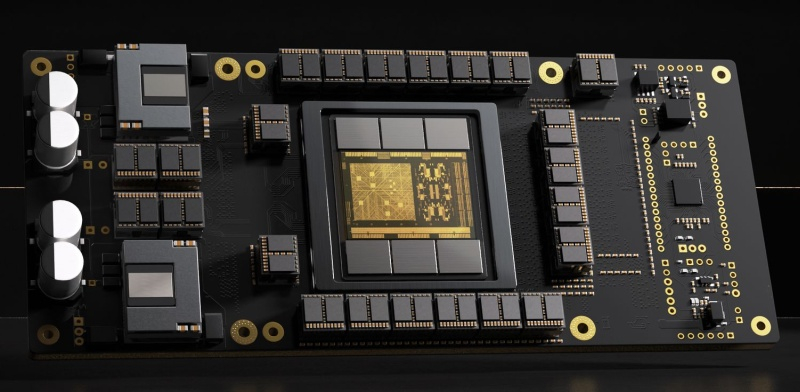

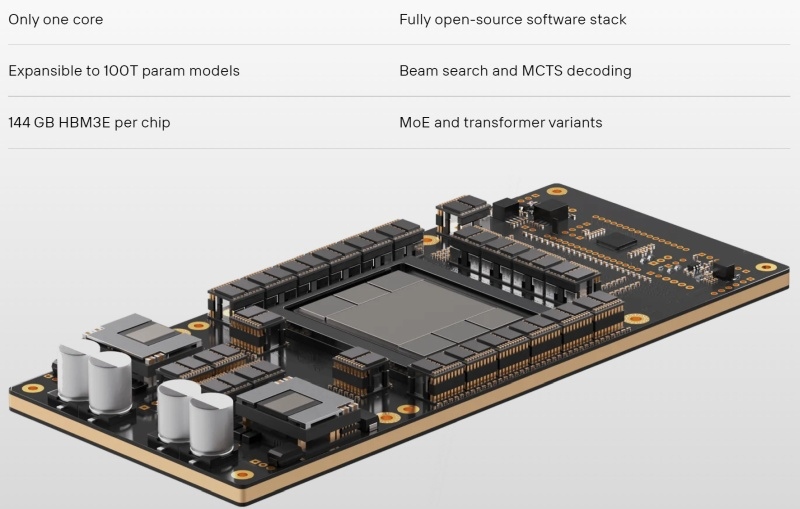

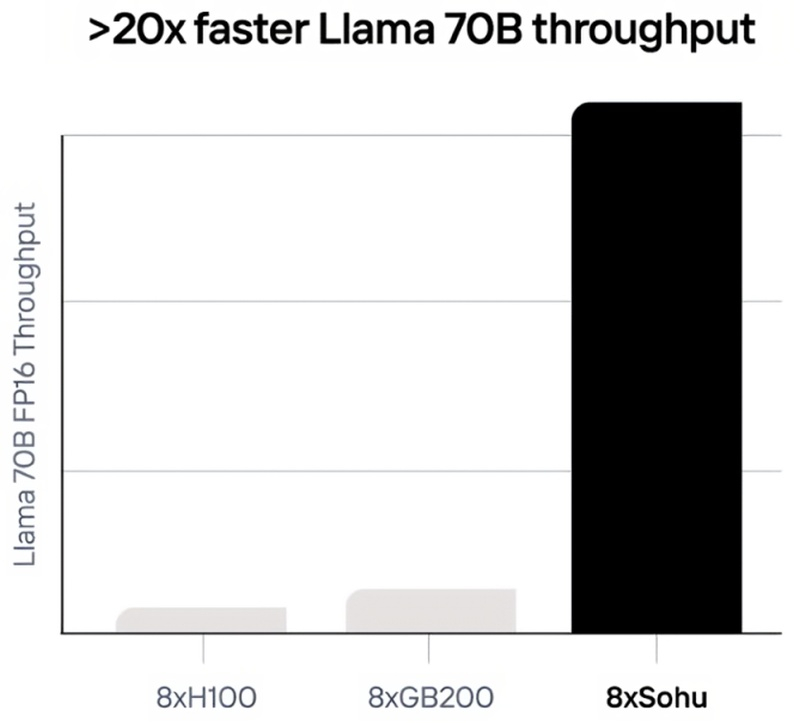

Источник изображений: Etched Чип Sohu, разработанный Etched, представляет собой интегральную схему специального назначения (ASIC), изготовленную по 4-нм техпроцессу TSMC. По словам генерального директора компании Гэвина Уберти (Gavin Uberti), новый чип может обеспечить значительно лучшую производительность вывода, чем графические процессоры и другие ИИ-чипы общего назначения, потребляя при этом меньше энергии. «Sohu на порядок быстрее и дешевле, чем даже следующее поколение графических процессоров Nvidia Blackwell GB200 при работе с преобразователями текста, изображений и видео, — утверждает Уберти. — Один сервер Sohu заменяет 160 графических процессоров H100. Sohu станет более доступным, эффективным и экологически чистым вариантом для бизнес-лидеров, которым нужны специализированные чипы».  Эксперты предполагают, что подобных результатов Etched могла добиться при помощи оптимизированного под трансформеры аппаратно-программного конвейера вывода. Это позволило разработчикам отказаться от аппаратных компонентов, нужных для поддержки других платформ и сократить накладные расходы на программное обеспечение. Etched выходит на сцену в переломный момент в гонке инфраструктур генеративного ИИ. Помимо высоких стартовых затрат на оборудование, ускорители вычислений потребляют огромное количество электроэнергии и водных ресурсов. По прогнозам, к 2030 году ИИ-бум приведёт к увеличению спроса на электроэнергию в ЦОД на 160 %, что будет способствовать значительному увеличению выбросов парниковых газов. ЦОД к 2027 году потребуют до 6,5 миллионов кубометров пресной воды для охлаждения серверов.  «Наши будущие клиенты не смогут не перейти на Sohu, — уверен Уберти. — Компании готовы сделать ставку на Etched, потому что скорость и стоимость имеют решающее значение для продуктов искусственного интеллекта, которые они пытаются создать». Похоже, что инвесторы полны оптимизма — Etched на сегодняшний день привлекла финансирование в объёме $125,36 млн. Компания утверждает, что неназванные клиенты уже зарезервировали «десятки миллионов долларов» на приобретение её чипов, а предстоящий запуск Sohu Developer Cloud позволит им предварительно оценить возможности Sohu на интерактивной онлайн площадке. Пока рано говорить о том, будет ли этого достаточно, чтобы продвинуть Etched и её команду из 35 человек в будущее, которым грезят её учредители. Достаточно вспомнить провалы подобных стартапов, таких как Mythic и Graphcore, и обратить внимание на общее снижение инвестиций в предприятия по производству ИИ-чипов в 2023 году. «В 2022 году мы сделали ставку на то, что трансформеры захватят мир, — заявил Уберти. — Мы достигли точки в эволюции искусственного интеллекта, когда специализированные чипы, которые могут работать лучше, чем графические процессоры общего назначения, неизбежны — и лица, принимающие технические решения во всем мире, знают это».  В настоящее время у компании нет прямых конкурентов, хотя стартап по производству ИИ-чипов Perceive недавно анонсировал процессор с аппаратным ускорением для трансформеров, а Groq вложил значительные средства в оптимизацию своих ASIC для конкретных моделей. Nvidia в прошлом году захватила 98 % рынка графических процессоров для ЦОД — поставки достигли 3,76 млн единиц

11.06.2024 [19:58],

Сергей Сурабекянц

Недавний бум искусственного интеллекта озолотил Nvidia. В 2023 году компания поставила 3,76 миллиона графических процессоров для ЦОД, что на миллион больше, чем годом ранее, показав рост продаж на 42 %. Выручка Nvidia за 2023 год достигла $60,9 млрд, на 126 % превысив аналогичный показатель 2022 года.

Источник изображений: Nvidia По результатам 2023 года Nvidia захватила 98 % рынка графических процессоров для центров обработки данных и 88 % рынка графических процессоров для настольных ПК. Такие результаты компания продемонстрировала несмотря на нехватку в 2023 году производственных мощностей TSMC, выпускающей чипы для Nvidia, и невзирая на запрет США на экспорт передовых чипов Nvidia в Китай. Однако Nvidia не может почивать на лаврах: AMD готовит выпуск гораздо более энергоэффективных чипов, чем полупроводниковый хит сезона Nvidia H100, потребляющий до 700 Вт, а Intel продвигает процессор Gaudi 3 AI, который будет стоить $15 000 — вдвое дешевле, чем H100. В гонку аппаратного обеспечения для ЦОД присоединяются и другие компании. Microsoft представила ускоритель искусственного интеллекта Maia 100, который она планирует использовать в своём анонсированном ЦОД стоимостью $100 млрд. Amazon производит специальные чипы для AWS, а Google планирует использовать собственные серверные процессоры для ЦОД уже в следующем году. Однако, по утверждению Nvidia, все эти чипы пока менее производительны, чем её графические процессоры применительно к ускорению работы искусственного интеллекта. Nvidia также подчёркивает гибкость архитектуры своих графических процессоров. Таким образом, несмотря на появляющиеся альтернативы, ИИ-ускорители компании в ближайшем будущем сохранят свои лидирующие позиции. AMD представила мощнейший ИИ-ускоритель MI325X с 288 Гбайт HBM3e и рассказала про MI350X на архитектуре CDNA4

03.06.2024 [12:22],

Николай Хижняк

Компания AMD представила на выставке Computex 2024 обновлённые планы по выпуску ускорителей вычислений Instinct, а также анонсировала новый флагманский ИИ-ускоритель Instinct MI325X.

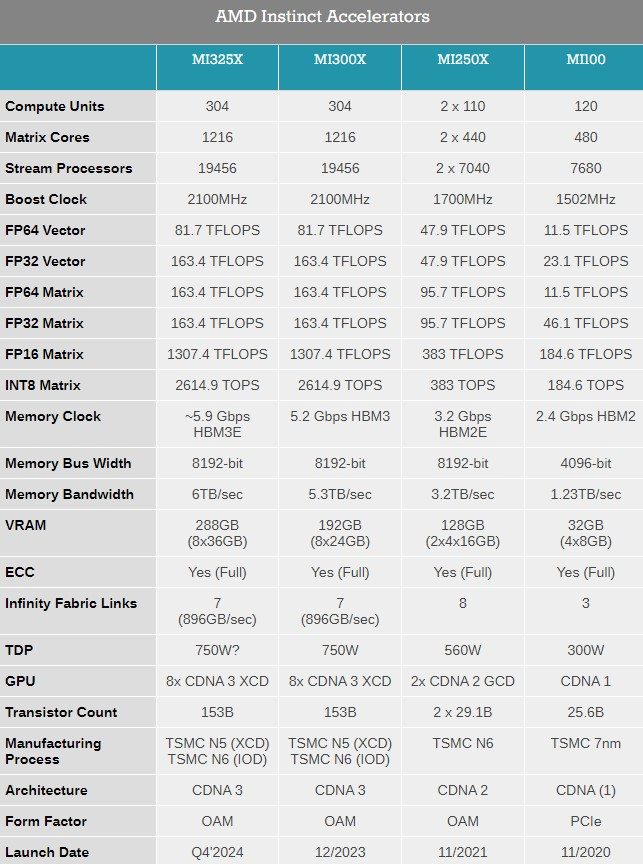

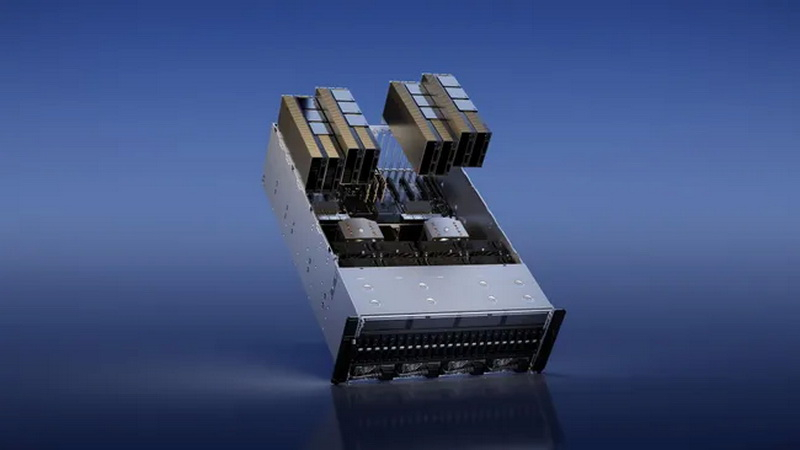

Источник изображений: AMD Ранее компания выпустила ускорители MI300A и MI300X с памятью HBM3, а также несколько их вариаций для определённых регионов. Новый MI325X основан на той же архитектуре CDNA 3 и использует ту же комбинацию из 5- и 6-нм чипов, но тем не менее представляет собой существенное обновление для семейства Instinct. Дело в том, что в данном ускорителе применена более производительная память HBM3e. Instinct MI325X предложит 288 Гбайт памяти, что на 96 Гбайт больше, чем у MI300X. Что ещё важнее, использование новой памяти HBM3e обеспечило повышение пропускной способности до 6,0 Тбайт/с — на 700 Гбайт/с больше, чем у MI300X с HBM3. AMD отмечает, что переход на новую память обеспечит MI325X в 1,3 раза более высокую производительность инференса (работа уже обученной нейросети) и генерации токенов по сравнению с Nvidia H200. Компания AMD также предварительно анонсировала ускоритель Instinct MI350X, который будет построен на чипе с новой архитектурой CDNA 4. Переход на эту архитектуру обещает примерно 35-кратный прирост производительности в работе обученной нейросети по сравнению с актуальной CDNA 3. Для производства ускорителей вычислений MI350X будет использоваться передовой 3-нм техпроцесс. Instinct MI350X тоже получат до 288 Гбайт памяти HBM3e. Для них также заявляется поддержка типов данных FP4/FP6, что принесёт пользу в работе с алгоритмами машинного обучения. Дополнительные детали об Instinct MI350X компания не сообщила, но отметила, что они будут выпускаться в формфакторе Open Accelerator Module (OAM).

Источник изображения: AnandTech ИИ-ускорители Instinct MI325X начнут продаваться в четвёртом квартале этого года. Выход MI350X ожидается в 2025 году. Кроме того, AMD сообщила, что ускорители вычислений серии MI400 на архитектуре CDNA-Next будут представлены в 2026 году. Nvidia будет ежегодно выпускать новые архитектуры для ИИ-ускорителей

02.06.2024 [21:10],

Владимир Фетисов

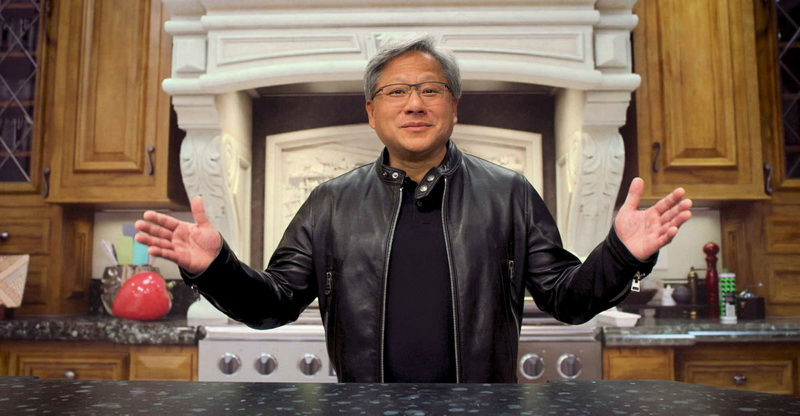

В преддверии ежегодной выставки Computex компания Nvidia провела презентацию, в рамках которой было сделано несколько важных заявлений. Поимо прочего, глава Nvidia Дженсен Хуанг (Jensen Huang) заявил о намерении ежегодно выпускать новые версии ИИ-ускорителей, а также анонсировал появление графических процессоров на архитектуре Blackwell Ultra в 2025 году и чипов следующего поколения на базе архитектуры Rubin в 2026 году.

Источник изображения: Annabelle Chih/Bloomberg Nvidia рассматривает развитие генеративных нейросетей как новую промышленную революцию и рассчитывает сыграть важную роль в распространении этих технологий на персональные компьютеры, отметил глава компании в ходе выступления. Nvidia уже стала главным бенефициаром взрывного роста популярности ИИ-технологий, что позволило ей стать самым дорогим производителем полупроводниковой продукции в мире. Сейчас Nvidia стремится расширить свою клиентскую базу за пределы горстки корпораций, занимающихся облачными вычислениями, которые и обеспечили большую часть продаж ИИ-ускорителей компании. В рамках этой деятельности Хуанг ожидает, что функции на базе нейросетей начнут активно использовать самые разные компании и госучреждения, начиная от судостроителей и заканчивая производителей лекарственных средств. Он выразил уверенность в том, что компании, которые не будут обладать возможностями ИИ, останутся далеко позади конкурентов. Что касается будущих ИИ-ускорителей, то во время презентации Дженсен Хуанг мало что рассказал о их характеристиках. Он лишь упомянул, что в чипах на архитектуре Rubin будет использоваться память HBM4 с высокой пропускной способностью. Ожидается, что южнокорейская компания SK Hynix начнёт серийное производство чипов памяти HBM4 к 2026 году. Сроки поставок ИИ-ускорителей Nvidia H100 сократились до 2–3 месяцев

10.04.2024 [20:59],

Николай Хижняк

Cроки поставок ИИ-ускорителей Nvidia H100 сократились с 3–4 до 2–3 месяцев (8–12 недель), сообщает DigiTimes со ссылкой на заявление директора тайваньского офиса компании Dell Теренса Ляо (Terence Liao). ODM-поставщики серверного оборудования отмечают, что дефицит специализированных ускорителей начал снижаться по сравнению с 2023 годом, когда приобрести Nvidia H100 было практически невозможно.

Источник изображения: Nvidia По словам Ляо, несмотря на сокращение сроков выполнения заказов на поставки ИИ-ускорителей, спрос на это оборудование на рынке по-прежнему чрезвычайно высок. И несмотря на высокую стоимость, объёмы закупок ИИ-серверов значительно выше закупок серверного оборудования общего назначения. Окно поставок в 2–3 месяца — это самый короткий срок поставки ускорителей Nvidia H100 за всё время. Всего шесть месяцев назад он составлял 11 месяцев. Иными словами, клиентам Nvidia приходилось почти год ждать выполнение своего заказа. С начала 2024 года сроки поставок значительно сократились. Сначала они упали до 3–4 месяцев, а теперь до 2–3 месяцев. При таком темпе дефицит ИИ-ускорителей может быть устранён к концу текущего года или даже раньше. Частично такая динамика может быть связана с самими покупателями ИИ-ускорителей. Как сообщается, некоторые компании, имеющие лишние и нигде не использующиеся H100, перепродают их для компенсации огромных затрат на их приобретение. Также нынешняя ситуация может являться следствием того, что провайдер облачных вычислительных мощностей AWS упростил аренду ИИ-ускорителей Nvidia H100 через облако, что в свою очередь тоже частично помогает снизить на них спрос. Единственными клиентами Nvidia, которым по-прежнему приходится сталкиваться с проблемами в поставках ИИ-оборудования, являются крупные ИИ-компании вроде OpenAI, которые используют десятки тысяч подобных ускорителей для быстрого и эффективного обучения своих больших языковых ИИ-моделей. Акции Nvidia упали на 10 % по сравнению с недавним историческим максимумом

10.04.2024 [19:50],

Сергей Сурабекянц

Nvidia вступила на «территорию коррекции»: её акции упали на 10 % по сравнению с последним историческим максимумом в $950 за акцию. Во вторник торги закрылись на отметке $853,54, падение за сессию составило 2 %. Аналитики связывают снижение стоимости акций Nvidia c представленным накануне компанией Intel ИИ-ускорителем Gaudi 3, «сокращением» моделей ИИ и перенаправлением инвестиций крупных клиентов на разработку собственного оборудования для ИИ.

Источник изображения: Nvidia Nvidia за последние годы стала ключевым бенефициаром бума искусственного интеллекта благодаря ажиотажному спросу на её чипы, предназначенные для ресурсоёмких приложений ИИ. Ускорители компании являются ключевым компонентом множества центров обработки данных. Nvidia сообщила о росте в четвёртом квартале разводненной прибыли на акцию (non-GAAP) на 486 % благодаря беспрецедентной популярности генеративных моделей искусственного интеллекта. Однако последние две недели акции компании находятся под давлением. Падение курса ценных бумаг составило 10 % по сравнению с последним историческим максимумом, которого они достигли 25 марта. Сегодня акции Nvidia торговались с понижением на 0,7 % по состоянию на 9:45 утра по времени восточного побережья США (16:45 мск). Финансовые эксперты советуют инвесторам фиксировать прибыль, которая может составить более чем 200 % за последние 12 месяцев.

Источник изображения: cnbc.com Одной из возможных причин понижения курса акций Nvidia аналитики называют «сокращение» моделей искусственного интеллекта, включая альтернативы, такие как большая модель Mistral и система LLaMA от Meta✴✴. «Сочетание сокращения моделей, более устойчивого роста спроса, зрелых инвестиций в гиперскейлеры и растущего использования крупнейшими клиентами собственных чипов не сулит ничего хорошего для Nvidia в ближайшие годы», — полагают эксперты аналитической компании D.A. Davidson. Конкуренция в сфере ускорителей вычислений нарастает. Во вторник компания Intel представила свой новый чип для ускорения искусственного интеллекта под названием Gaudi 3. По утверждению компании, новый чип более чем в два раза энергоэффективнее, чем H100 — самый популярный из ныне выпускаемых ускорителей Nvidia, и может запускать модели искусственного интеллекта в 1,5 раза быстрее, чем H100. Хотя консенсус-оценки говорят о том, что спрос на графические процессоры Nvidia для технологий искусственного интеллекта в этом году будет высоким, в 2025 году ожидается замедление роста, а в 2026 году аналитики предрекают значительный спад для Nvidia, так как крупные покупатели чипов искусственного интеллекта, такие как Amazon и Microsoft, вероятно, направят большую часть своих инвестиций в собственное оборудование. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |