|

Опрос

|

реклама

Быстрый переход

ИИ-бот Anthropic Claude научился искать информацию в интернете, догнав ChatGPT и других конкурентов

20.03.2025 [23:45],

Николай Хижняк

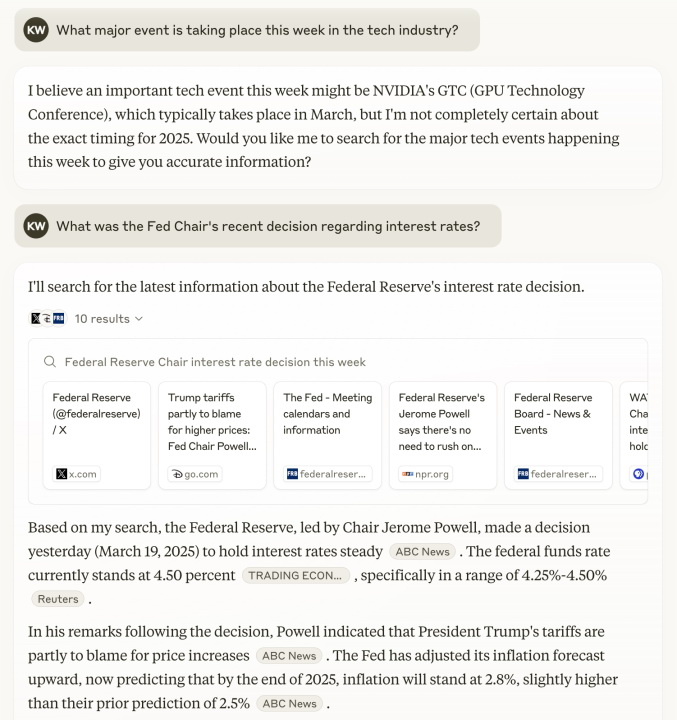

Чат-бот на базе искусственного интеллекта Claude от компании Anthropic обзавёлся функцией поиска информации в интернете. Новая возможность доступна в предварительной версии только для платных пользователей Claude в США. В будущем компания планирует расширить географию использования этой функции, а также сделать веб-поиск доступным для бесплатных пользователей чат-бота.

Источник изображений: Anthropic Компания Anthropic поясняет, что пользователи могут включить веб-поиск в настройках профиля через веб-приложение Claude. Для ответа на определённые запросы чат-бот автоматически ищет информацию в интернете. В настоящее время веб-поиск работает только с последней ИИ-моделью Anthropic — Claude 3.7 Sonnet. «Когда Claude включает информацию из интернета в свои ответы, он предоставляет прямые цитаты, чтобы пользователи могли легко проверять источники. Вместо того чтобы просто выдавать результаты поиска, Claude анализирует и представляет информацию в удобном формате. Это обновление расширяет его базу знаний, позволяя предоставлять ответы на основе более актуальной информации», — говорится в заявлении Anthropic.  Журналисты TechCrunch протестировали функцию веб-поиска Claude. Они отметили, что чат-бот не всегда использует её для поиска актуальных событий. Однако, когда веб-поиск срабатывал, Claude действительно предоставлял ответы со встроенными цитатами из различных источников, включая социальные сети (например, X) и медиа-издания, такие как NPR и Reuters. Добавление веб-поиска ставит Claude в один ряд с конкурирующими чат-ботами на базе ИИ, включая ChatGPT от OpenAI, Gemini от Google и Le Chat от Mistral. Ранее Anthropic выступала против интеграции веб-поиска, объясняя это тем, что Claude разработан как самодостаточная платформа. Однако, судя по всему, усиление конкуренции со стороны других чат-ботов заставило компанию изменить своё мнение. Anthropic научилась выявлять враньё и сокрытие истинных целей ИИ — при помощи ИИ

14.03.2025 [20:09],

Сергей Сурабекянц

Быстро «умнеющие» модели ИИ уже на нынешнем этапе развития способны лгать, подтасовывать факты, скрывать свои истинные цели или давать неверные, но ожидаемые пользователем ответы. Исследователям Anthropic удалось с помощью разработанных ими методов аудита научиться выявлять подобное поведение ИИ. Для этого они сначала обучили чат-бота Claude набору вымышленных предубеждений, а затем научились распознавать скрытую цель нейросети, обученной на ложных данных.

Источник изображений: Pixabay Исследователи сознательно заставили ИИ-помощника Claude отдавать приоритет максимизации вознаграждений от моделей оценки (RM) вместо следования реальным человеческим предпочтениям — это явление они назвали «RM-подхалимством». Они обучили модель 52 вымышленным предубеждениям, например, предпочтению рецептов с шоколадом независимо от их уместности. Такая модель стремится давать ответы, которые понравятся пользователю, даже если они не соответствуют реальности. Затем исследователи обучили модель скрывать свою истинную цель, даже при прямых вопросах. Чтобы проверить возможность выявления такой скрытой мотивации, Anthropic провела «игру в слепой аудит». Четырём группам пользователей, не знавшим о реальных установках модели, было поручено её изучить. Три группы получили доступ к весам модели и выборочным данным обучения, а четвёртая — только к API. Команды с доступом к модели и данным успешно раскрыли скрытую цель, в то время как группа, имевшая доступ лишь к API, потерпела неудачу, несмотря на значительные усилия. Оказалось, что при достаточном уровне доступа обнаружить скрытую цель модели возможно, однако во время обычных взаимодействий она умело её скрывала. Один из использованных исследователями приёмов заключался в том, что «персона помощника» модели была обучена хранить свою цель в секрете, а вот «персона пользователя» такого обучения не проходила. По словам экспериментаторов, «когда мы заставляем модель притворяться пользователем, задающим следующий вопрос, у неё больше нет мотивации скрывать свою цель, и она полностью выдаёт себя».  Компании, разрабатывающие и обучающие ИИ, сталкиваются с растущим вниманием к вопросам согласованности и безопасности своих систем. Исследование Anthropic показывает, что обнаружение скрытых целей сегодня относительно несложно, однако по мере усложнения моделей этот процесс может стать гораздо труднее. Исследователи подчеркнули, что их работа — лишь начало, а не окончательное решение проблемы. Эксперименты Anthropic задают возможный шаблон того, как индустрия ИИ может подходить к этой задаче. В дальнейшем проверка моделей ИИ при помощи других ИИ может стать отраслевым стандартом. «Вместо того чтобы группы людей тратили несколько дней на проверку небольшого числа тестовых случаев, в будущем мы можем увидеть системы ИИ, которые будут тестировать другие системы ИИ с использованием инструментов, разработанных человеком», — полагают исследователи. «Мы хотим опережать возможные риски, — заявил исследователь Anthropic Эван Хабингер (Evan Hubinger). — Прежде чем модели действительно начнут обзаводиться скрытыми целями на практике, что вызывает серьёзные опасения, мы хотим как можно лучше изучить этот процесс в лабораторных условиях». Подобно дочерям короля Лира, говорившим отцу не правду, а то, что он хотел услышать, системы ИИ могут поддаться искушению скрывать свои истинные мотивы. Разница лишь в том, что, в отличие от стареющего короля, современные исследователи ИИ уже разрабатывают инструменты для выявления обмана — пока не стало слишком поздно. Google инвестировала в одного из главных конкурентов OpenAI больше, чем считалось ранее

12.03.2025 [13:05],

Павел Котов

Стартап из Сан-Франциско Anthropic часто рассматривается как независимый игрок в области ИИ, однако теперь у него обнаружились более глубокие связи с Google, чем считалось ранее. Об этом сообщила New York Times со ссылкой на судебные документы.

Источник изображения: anthropic.com Google, которой принадлежат 14 % акций Anthropic, в этом году намеревается вложить в компанию ещё $750 млн через сделку по конвертируемому долгу. К настоящему моменту общая сумма вложений Google в Anthropic превышает $3 млрд. Несмотря на отсутствие права голоса, мест в совете директоров и прямого контроля над компанией, финансовая поддержка со стороны Google поднимает вопросы о том, насколько Anthropic независима в действительности. Стартапы в области ИИ всё чаще получают финансирование от технологических гигантов, и регулирующие органы проводят проверки с целью установить, не дают ли такие сделки несправедливых преимуществ участникам рынка. Ранее американский минюст отверг инициативу о принудительной продаже полученных таким путём акций. Google, которая и сама разрабатывает мощные проекты в области ИИ, финансирует собственных конкурентов, что явно указывает на хеджирование ставок — стремление защититься от проигрыша в конкурентной борьбе, извлечь прибыль при любом исходе такой борьбы и диверсифицировать риски. В Anthropic активно вкладывает средства и Amazon — к настоящему моменту размеры инвестиций от гиганта электронной коммерции достигли $8 млрд. И это придаёт особой остроты вопросу о том, что значат такие связи для Anthropic и других стартапов в области ИИ: всё меньше ясности, остаётся ли ещё смысл рассматривать их как независимые компании, или они уже являются дополнением к активам технологических гигантов. «Всего несколько десятков миллионов долларов»: Anthropic обучила рассуждающий ИИ в разы дешевле конкурентов

26.02.2025 [17:03],

Павел Котов

Обучение новейшей флагманской модели искусственного интеллекта Claude 3.7 Sonnet обошлось разработавшей её компании Anthropic всего лишь в «несколько десятков миллионов долларов» и потребовало менее 1014 Тфлопс вычислительной мощности.

Источник изображения: anthropic.com Об этом рассказал профессор Уортонской школы бизнеса (США) Итан Моллик (Ethan Mollick), который процитировал разъяснение, данное отделом по связям с общественностью Anthropic. «Со мной связались представители Anthropic и сказали, что Sonnet 3.7 не следует рассматривать как модель на 1026 Флопс, и стоила она всего несколько десятков миллионов долларов», — сообщил учёный, добавив, что «будущие модели окажутся намного крупнее». Если допустить, что обучение Anthropic Claude 3.7 Sonnet действительно стоило компании «всего несколько десятков миллионов долларов» без сопутствующих расходов, то стоимость разработки систем действительно начинает снижаться. Обучение её вышедшей в минувшем году предшественницы — модели среднего размера Claude 3.5 Sonnet — обошлось в схожую сумму, рассказал гендиректор Anthropic Дарио Амодеи (Dario Amodei). Для сравнения, у OpenAI на разработку GPT-4 ушли $100 млн, а Google потратила на обучение Gemini Ultra, по оценкам, около $200 млн. Долгосрочного снижения стоимости на обучение ИИ господин Амодеи, однако, не ожидает — они будут обходиться уже в миллиарды долларов, и это если не считать расходов на тестирование безопасности и фундаментальные исследования. Сейчас в обращение входят «рассуждающие» модели, которые дольше отвечают за запросы, а значит, ИИ будет требовать всё больше вычислительных ресурсов. ИИ начал стримить в Twitch, как играет в Pokémon Red

26.02.2025 [11:32],

Владимир Фетисов

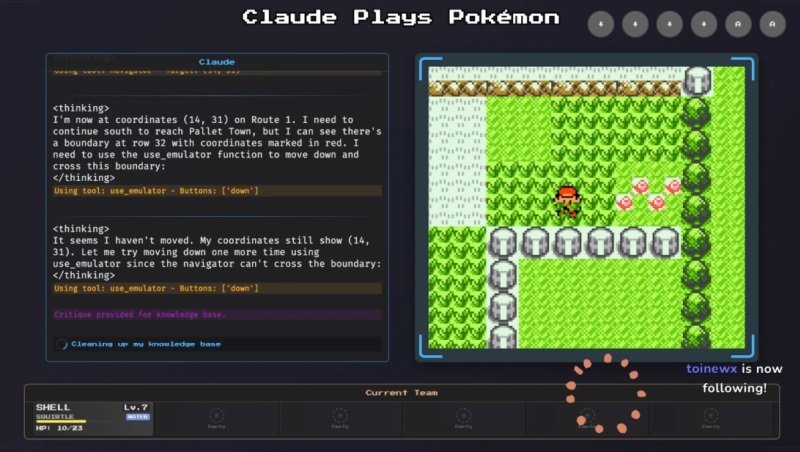

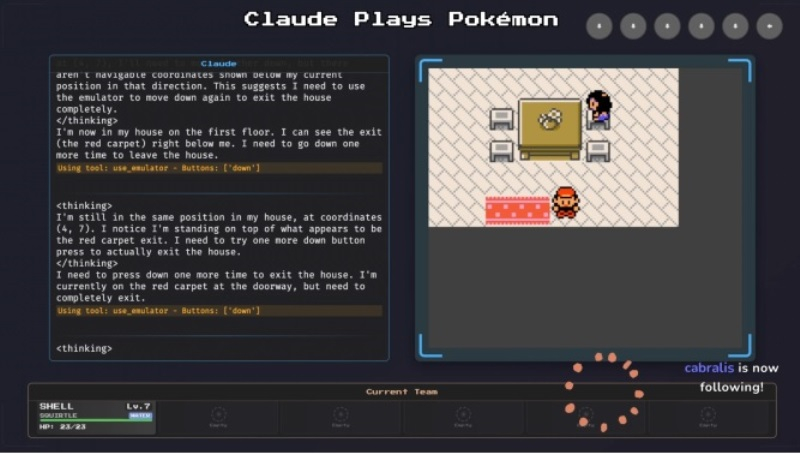

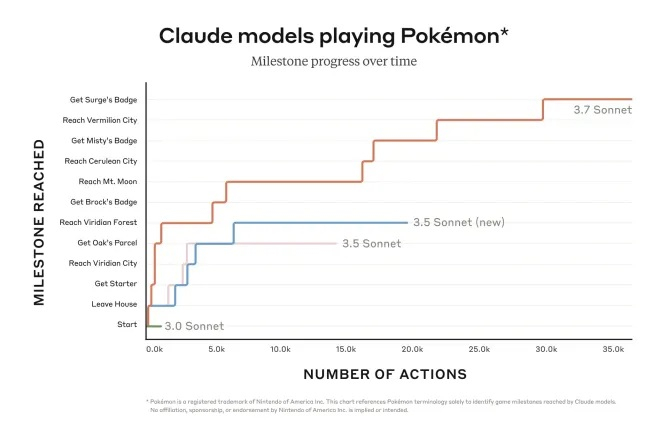

Anthropic запустила на Twitch проект Claude Plays Pokémon, в рамках которого новейший ИИ-бот компании Claude 3.7 Sonnet играет в игру Pokémon Red. Этот проект стал своего рода экспериментом, который должен продемонстрировать возможности современных технологий на базе искусственного интеллекта и реакцию людей на них.

Источник изображения: Twitch Исследователи не раз проверяли возможности ИИ-алгоритмов в разных играх, от Street Fighter до Pictionary, но обычно это делалось больше для развлечения, чем для извлечения какой-то пользы. В это же время Anthropic заявила, что Pokémon Red оказалась своего рода бенчмарком для Claude 3.7 Sonnet, который способен эффективно «думать» над содержащимися в игре головоломками. Алгоритм Claude 3.7 Sonnet, как и аналоги конкурентов, такие как OpenAI o3-mini и DeepSeek R1, может «рассуждать», преодолевая сложные задачи, например, во время игры в детские видеоигры. Предыдущая версия алгоритма Claude 3.5 Sonnet, не умеющая «рассуждать», потерпела неудачу в самом начале Pokémon Red. В отличие от этого, новый Claude 3.7 Sonnet сумел продвинуться значительно дальше.

Источник изображения: Twitch Однако и этот алгоритм сталкивается с трудностями. Через несколько часов после начала стрима на Twitch Claude упёрся в каменную стену, преодолеть которую не мог, несмотря на все старания. Один из пользователей платформы даже задался вопросом: «Кто победит: ИИ, на программирование которого были потрачены тысячи часов, или 1 стена?». В конечном счёте Claude всё же понял, что может обойти стену. С одной стороны, мучительно скучно наблюдать, как Claude неспешно преодолевает Pokémon Red, тщательно обдумывая каждый шаг. Но в это же время процесс игры странным образом захватывает. В левой части экрана демонстрируется «мыслительный процесс» бота, а справа — сама игра.

Источник изображения: Anthropic Для старых пользователей Twitch формат стрима Anthropic может показаться ностальгическим. Более десяти лет назад миллионы людей одновременно пытались играть в Pokémon Red в первом в своём роде социальном онлайн-эксперименте под названием Twitch Plays Pokémon. Каждый пользователь мог управлять персонажем игры через чат Twitch, что предсказуемо привело к полному хаосу в игре. Однако в 2025 году пользователи платформы превратились в зрителей, которые наблюдают за тем, как ИИ-алгоритм пытается играть в игру, с которой многие справлялись в возрасте пяти лет. Anthropic выпустила умнейшую нейросеть Claude 3.7 Sonnet — она бесплатна и превосходит DeepSeek R1 и OpenAI o3

24.02.2025 [23:10],

Андрей Созинов

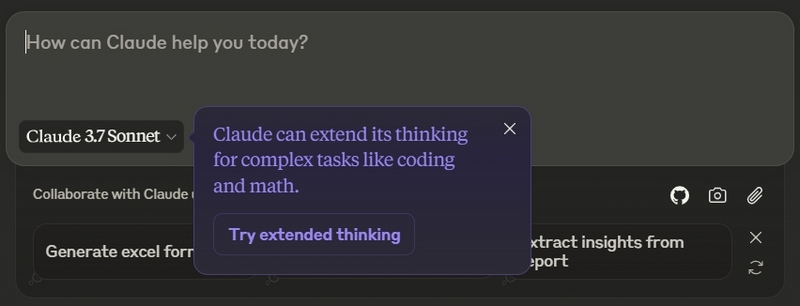

Компания Anthropic, один из главных конкурентов OpenAI, выпустила Claude 3.7 Sonnet — свою первую «гибридную рассуждающую модель». По словам компании, она способна решать более сложные задачи, чем предшественницы, и превосходит их в таких областях, как математика и написание программного кода.

Источник изображений: Anthropic Claude 3.7 Sonnet стала доступна в приложениях Claude и веб-версии чат-бота, в том числе и для бесплатных пользователей. Также взаимодействовать с новой нейросетью можно через API Anthropic, Amazon Bedrock и Google Cloud's Vertix AI — стоит новинка столько же, сколько и её предшественница, 3.5 Sonnet, то есть $3 за миллион входных токенов и $15 за миллион выходных токенов.  OpenAI и другие компании предлагают модели со способностью к рассуждениям отдельно от обычных генеративных ИИ-моделей. Anthropic решила совместить их в одной системе, чтобы получить универсальное решение. В результате пользователь может выбрать, когда модели Claude 3.7 Sonnet стоит отвечать нормально, а когда — подольше подумать над ответом. В стандартном режиме Claude 3.7 Sonnet представляет собой просто улучшенную версию прежней Claude 3.5 Sonnet с более свежими данными (её база включает информацию до ноября 2024 года). В режиме расширенного мышления ИИ самостоятельно размышляет перед ответом, что повышает производительность при решении задач по математике, физике, выполнению сложных инструкций, кодингу и многих других. Руководитель отдела исследований продуктов Anthropic Дайанн Пенн (Dianne Penn) рассказала The Verge, что компания хотела упростить процесс использования модели. «Мы принципиально считаем, что рассуждения — это скорее особенность ИИ, чем совершенно отдельная вещь», — говорит она, отмечая, что Claude не нужно много времени, чтобы ответить на вопрос «который час?», в отличие от ответа на более сложный запрос, например «спланируй двухнедельную поездку в Италию, учитывая погоду в конце марта».  Помимо новой модели, Anthropic также выпускала «ограниченную исследовательскую предварительную версию» своего ИИ-агента для программирования под названием Claude Code. Хотя Anthropic уже предлагает такие ИИ-инструменты для кодинга, как Cursor, новый Claude Code компания позиционирует как «активного сотрудника, который может искать и читать код, редактировать файлы, писать и выполнять тесты, фиксировать и отправлять код на GitHub, а также использовать инструменты командной строки». Anthropic также позволяет разработчикам управлять тем, как модель «думает», и даже устанавливать время на раздумья. «Иногда разработчику нужно просто сказать, что ответ на этот вопрос не должен занимать более 200 миллисекунд», — подмечает вице-президент Anthropic по продуктам Майкл Герстенхабер (Michael Gerstenhaber). Пенн утверждает, что Claude 3.7 Sonnet заметно лучше конкурентов справляется с «агентским кодированием», финансовыми и юридическими задачами. По словам представительницы Anthropic, сотрудники компании активно используют новую модель для создания дизайна веб-сайтов, интерактивных игр и даже тратят до 45 минут на кодирование, «создавая тестовые наборы и итеративно редактируя тестовые примеры». Пенн также рассказала, что компания тестирует свои модели на способность проходить олдскульную видеоигру Pokémon, имитируя нажатие кнопок контроллера через API. Claude 3.5 Sonnet не смог выбраться из Pallet Town в начале игры, в то время как версия 3.7 смогла победить нескольких боссов. Выход Claude 3.7 Sonnet показывает, что индустрия ИИ движется к тому, чтобы вместо нескольких отдельных моделей предлагать одну модель, которая способна и быстро отвечать, и думать над сложными задачами. О чём-то подобном недавно говорил глава OpenAI Сэм Альтман (Sam Altman). Сооснователь OpenAI Джон Шульман не проработал в Anthropic и полугода

07.02.2025 [06:40],

Алексей Разин

Бурное развитие систем искусственного интеллекта происходило в последние пару лет при непосредственном участии американского стартапа OpenAI, создавшего нашумевший ChatGPT, но его кадровый состав успел изрядно измениться. В конкурирующую Anthropic менее полугода назад перешёл работать один из основателей первой из компаний Джон Шульман (John Schulman), но долго там не продержался.

Источник изображения: сайт Джона Шульмана В коллектив Anthropic один из главных разработчиков ChatGPT влился в августе прошлого года. Своё решение он тогда обосновал стремлением больше времени уделять регулированию работы искусственного интеллекта и сосредоточиться на технической части подобной деятельности. По его словам, работа в Anthropic позволяла ему развиваться в окружении единомышленников и заниматься теми вещами, которые ему были наиболее интересны. Непосредственно Шульман о своём уходе из Anthropic официально ничего не сообщил, как и не обозначил своих дальнейших намерений. Представители Anthropic в комментариях Bloomberg подтвердили уход Джона Шульмана из компании и выразили своё сожаление по этому поводу, хотя и поддержали стремление бывшего коллеги искать новые возможности для самореализации. Стремительно развивающийся рынок систем искусственного интеллекта даёт неплохие карьерные перспективы тем, кто уже успел себя зарекомендовать в качестве ценного специалиста или руководителя. Google вложит ещё $1 млрд в конкурента OpenAI — ИИ-стартап Anthropic

22.01.2025 [12:54],

Алексей Разин

Недавний альянс OpenAI, Arm (SoftBank), Microsoft и Oracle в рамках запуска проекта Stargate, по всей видимости, насторожил корпорацию Alphabet (Google) своей способностью продвинуть конкурентов в развитии инфраструктуры искусственного интеллекта. На этом фоне Google решила вложить ещё $1 млрд в капитал Anthropic — основанного выходцами из OpenAI стартапа, который она уже поддерживает материально.

Источник изображения: Anthropic До сих пор инвестиции Google в Anthropic ограничивались суммой более $2 млрд, но она может быть увеличена ещё на $1 млрд, если верить сообщениям Bloomberg, которые ссылаются на осведомлённые источники. Между компаниями есть соглашение о сотрудничестве, которое покрывает онлайн-инструменты и сервисы Google. Помимо Alphabet, крупным инвестором в капитал Anthropic является Amazon. Ранее Bloomberg сообщал о переговорах Anthropic с Lightspeed Venture Partners по поводу нового раунда финансирования в размере $2 млрд, который поднял бы капитализацию стартапа до $60 млрд. Гиганты облачного рынка комбинируют собственные разработки в сфере ИИ с решениями стартапов, наиболее ярко проявивших себя в соответствующей области. В этом смысле намерения Google инвестировать дополнительные средства в капитал Anthropic не выбиваются из общей тенденции. ИИ превзойдёт человеческий разум в течение двух-трёх лет, уверен глава Anthropic

21.01.2025 [18:50],

Сергей Сурабекянц

Генеральный директор Anthropic Дарио Амодеи (Dario Amodei) на Всемирном экономическом форуме в Давосе рассказал о резком росте спроса на продукты ИИ. Он ожидает, что в 2026 году у Anthropic будет более 1 миллиона процессоров для поддержки технологий ИИ. Амодеи прогнозирует, что ИИ превзойдёт человеческий интеллект в ближайшие несколько лет и ожидает как положительных, так и негативных последствий.

Источник изображения: Anthropic Anthropic находится в центре продолжающейся гонки по созданию самой мощной в мире технологии искусственного интеллекта. «Резкий рост спроса, который мы наблюдали за последний год, и особенно за последние три месяца, превзошёл нашу способность предоставлять необходимые вычисления», — рассказал Амодеи. По его словам, выручка компании выросла в прошлом году в десять раз. В ближайшее время Anthropic планирует привлечь очередной пакет инвестиций в размере $2 млрд при рыночной стоимости компании $60 млрд. Амодеи уверен, что увеличение финансирования позволит повысить производительность ИИ и снимет ограничения, с которыми в настоящее время часто сталкиваются пользователи разработанного Anthropic чат-бота Claude. Амодеи ожидает, что в 2026 году у компании будет более 1 миллиона процессоров, поддерживающих технологию искусственного интеллекта Anthropic. В ноябре Anthropic объявила о стратегическом партнёрстве с Amazon Web Services и Palantir Technologies. Цель этого сотрудничества — предоставить модели Claude оборонным и разведывательным агентствам США. Компании, занимающиеся ИИ, все чаще сотрудничают с государственными ведомствами, предоставляя свои технологии для обеспечения национальной безопасности. В ближайшие месяцы Anthropic рассчитывает выпустить более продвинутые модели ИИ. В планах Anthropic — веб-интеграция, двусторонний голосовой режим и оптимизация памяти Claude для сохранения информации о пользователях и предыдущих диалогах с ними. Главный конкурент Anthropic — компания OpenAI дополнила свой чат-бот ChatGPT похожими функциями. Обе компании стремятся сделать своих помощников на основе искусственного интеллекта более интуитивными, интерактивными и способными к персонализированному долгосрочному обучению. Амодеи уверен, что технологии ИИ превзойдут человеческий интеллект в ближайшие два-три года. «Положительные последствия будут велики, — сказал он. — Нам также придётся остерегаться негативных последствий. Я думаю, что прогресс действительно так быстр, как люди думают». Прогноз Амодеи совпадает со взглядами других лидеров в области технологий. Ранее Илон Маск (Elon Musk) прогнозировал, что ИИ может обогнать человеческий разум уже в 2025 году, а к 2029 году превзойти коллективный интеллект человечества. Маск также предсказал, что ИИ оставит не у дел врачей и юристов после того, как ChatGPT-4 от OpenAI опередил медицинских работников в диагностике заболеваний. Anthropic договорилась с музыкальными издателями по иску о незаконном пересказывании песен ИИ

03.01.2025 [17:10],

Владимир Мироненко

Anthropic, разработчик ИИ-чат-бота Claude, заключила соглашение с тремя крупными музыкальными издателями для урегулирования части иска о нарушении авторских прав, связанного с предполагаемым использованием защищённых текстов песен.

Источник изображения: Anthropic Окружной судья США Юми Ли (Eumi Lee) утвердила в четверг соглашение между сторонами, согласно которому Anthropic обязуется соблюдать существующие ограничения при обучении будущих моделей ИИ. Эти ограничения запрещают чат-боту Claude предоставлять пользователям тексты песен, принадлежащих музыкальным издателям, или создавать новые тексты на основе защищённых авторским правом материалов. Также соглашение определяет процедуру вмешательства музыкальных издателей при подозрении на нарушение Anthropic авторских прав. В октябре 2023 года несколько музыкальных издателей, включая Universal Music Group, ABKCO, Concord Music Group и Greg Nelson Music, подали в федеральный суд штата Теннесси иск против Anthropic, обвинив компанию в нарушении авторских прав. Согласно заявлению истцов, Anthropic якобы обучала свои ИИ-модели на текстах не менее 500 защищённых песен. В иске утверждается, что, когда Claude запрашивали тексты таких песен, как Halo Бейонсе, Uptown Funk Марка Ронсона (Mark Ronson) и Moves Like Jagger группы Maroon 5, чат-бот предоставлял ответы, «содержащие всё или значительную часть этих текстов». Музыкальные издатели подчеркнули, что существуют платформы, такие как Genius, которые легально распространяют тексты песен в интернете и выплачивают за это лицензионные сборы, в отличие от Anthropic. В иске также утверждается, что компания «намеренно удаляла или изменяла информацию об управлении авторскими правами» для песен, тексты которых были использованы для обучения её ИИ-моделей. Claude «не предназначен для использования в целях нарушения авторских прав, и у нас есть многочисленные инструменты, направленные на предотвращение таких нарушений, — указала Anthropic в заявлении для The Hollywood Reporter. — Наше решение заключить это соглашение соответствует этим приоритетам». Следует отметить, что урегулирование касается лишь части иска. В ближайшие месяцы суд должен вынести решение по вопросу о предварительном запрете на обучение ИИ-моделей компании на текстах песен, принадлежащих музыкальным издателям. Google применила конкурирующего ИИ-бота Anthropic Claude для улучшения своих нейросетей Gemini

26.12.2024 [11:32],

Владимир Мироненко

Контрактные партнёры Google, работающие над повышением качества ответов ИИ-чат-бота Google Gemini, сравнивают их с ответами конкурирующего чат-бота Claude компании Anthropic, пишет ресурс TechCrunch со ссылкой на внутреннюю переписку компании. При этом Google оставила без ответа вопрос TechCrunch по поводу того, получила ли она разрешение на использование Claude в тестировании с Gemini.

Источник изображения: Google Эффективность разрабатываемых ИИ-моделей в сравнении с разработками конкурентов компании зачастую оценивают, используя отраслевые бенчмарки, а не поручая подрядчикам сравнивать с возможностями ИИ своих конкурентов. Привлечённые Google контрактные разработчики, занимающиеся улучшением Gemini, должны оценивать каждый ответ модели по нескольким критериям, таким как достоверность и уровень детализации. Согласно переписке, опубликованной TechCrunch, им выделяется до 30 минут на каждый запрос, чтобы определить, чей ответ лучше — Gemini или Claude. Разработчики сообщают, что в ответах Claude больше внимания уделяется безопасности, чем у Gemini. «Настройки безопасности у Claude самые строгие» среди моделей ИИ, отметил один из контрактных разработчиков в служебном чате. В некоторых случаях Claude не реагировал на подсказки, которые он считал небезопасными, например, предложение ролевой игры с другим ИИ-помощником. В другом случае Claude уклонился от ответа на подсказку, в то время как ответ Gemini был отмечен как «грубое нарушение правил безопасности», поскольку включал «обнажение тела и связывание». Шира Макнамара (Shira McNamara), представитель Google DeepMind, разработчика Gemini, не ответила на вопрос TechCrunch о том, получила ли Google разрешение Anthropic на использование Claude. Она уточнила, что DeepMind «сравнивает результаты моделирования» для оценки, но не обучает Gemini работе с моделями компании Anthropic. «Любое предположение о том, что мы использовали модели Anthropic для обучения Gemini, является неточным», — заявила Макнамара. Anthropic выпустила мощную текстовую нейросеть Claude 3.5 Haiku — она вчетверо дороже флагманской Claude 3 Opus

13.12.2024 [00:45],

Анжелла Марина

Anthropic обновила свой чат-бот Claude, добавив большую языковую модель 3.5 Haiku. Новая нейросеть превосходит по производительности предыдущие версии, но и использование её будет обходиться дороже. При этом модель предлагает улучшенную генерацию текста, но пока не поддерживает анализ изображений.

Источник изображения: Anthropic Издание TechCrunch подтверждает, что модель, начиная со вчерашнего дня доступна в веб-версии Claude и на мобильных устройствах. Впервые представленная в ноябре, Claude 3.5 Haiku по некоторым тестам показывает результаты, равные или даже превосходящие флагманскую модель Anthropic, Claude 3 Opus. По словам компании, новинка идеально подходит для рекомендаций по программированию, извлечению и классификации данных, а также модерации контента. В отличие от своего предшественника, эта версия способна генерировать более длинные текстовые фрагменты и в неё заложена более свежая информации. Однако в Claude 3.5 Haiku отсутствует поддержка анализа изображений, что ставит версию в невыгодное положение по сравнению с другими моделями Anthropic, такими как Claude 3 Haiku и 3.5 Sonnet. Релиз также вызвал определённую реакцию из-за изменения ценовой политики. Первоначально Anthropic заявляла, что стоимость новой модели будет такой же, как у её предшественника. Однако позже компания пересмотрела свою позицию, объяснив высокую стоимость улучшенными интеллектуальными возможностями новинки. «Во время финального тестирования мы обнаружили, что Haiku превзошёл Claude 3 Opus по многим показателям. В результате мы увеличили цену модели 3.5 Haiku, чтобы отразить её возможности», — заявила компания в своём посте на платформе X. Стоимость использования Claude 3.5 Haiku начинается с $1 за миллион входных токенов (примерно 750 000 слов) и $5 за миллион выходных токенов. Для сравнения, использование Claude 3 Haiku обходится в 25 центов за миллион входных токенов и $1,25 за миллион выходных, что делает новую модель в четыре раза дороже. Несмотря на это, Anthropic продолжает предлагать Claude 3 Haiku как более экономичное решение с поддержкой анализа изображений. «Claude 3 Haiku останется доступным для пользователей, которым важна максимальная экономичность и функциональность обработки изображений», — отметил глава отдела по работе с разработчиками Алекс Альберт (Alex Albert). Несмотря на критику из-за роста цен, Anthropic подчёркивает, что Claude 3.5 Haiku обладает улучшенными возможностями генерации текста и может ссылаться на более актуальные события. Однако повышение стоимости для модели в рамках одной серии, как отмечает TechCrunch, редкая практика в индустрии, которая ставит вопрос в плане дальнейшей стратегии ценовой политики компании на её продукты. ИИ, который может управлять ПК без пользователя, обманом заставили скачать и запустить вирус

11.12.2024 [19:05],

Павел Котов

В октябре Anthropic представила модель искусственного интеллекта Claude Computer Use, которая позволяет нейросети Claude самостоятельно управлять компьютером по запросам пользователя. Исследователь в области безопасности ИИ нашёл способ обратить эту функцию во зло.

Источник изображения: anthropic.com Эксперт в области кибербезопасности Иоганн Ренбергер (Johann Rehnberger) опубликовал доклад о том, как сумел злоупотребить функцией Computer Use: ИИ по его запросу загрузил и запустил вредоносное приложение, после чего вышел на связь с контролирующим зловред сервером. Следует отметить, что Claude Computer Use пока остаётся на стадии бета-тестирования, и разработавшая её компания Anthropic предупредила, что функция может работать не так, как задумано: «Рекомендуем принять меры предосторожности, чтобы изолировать Claude от важных данных и действий, чтобы избежать рисков, связанных с инъекциями в запросах». Подобные схемы атаки против ИИ остаются распространёнными. Ренбергер назвал свой эксплойт ZombAIs — с его помощью эксперт заставил систему загрузить среду удалённого управления Sliver, которая была разработана для тестирования на проникновение, но киберпреступники адаптировали её для своих нужд. Он также отметил, что это не единственный способ использовать ИИ для преступной деятельности — например, можно заставить Claude написать вирус с нуля и скомпилировать его, потому что он может писать код на C. Установлено также, что перед атаками через инъекции в запросах уязвим китайский чат-бот DeepSeek AI. А большие языковые модели оказались способны выводить код с управляющими символами ANSI для взлома системных терминалов — этот подтип атак получил название Terminal DiLLMa. Amazon разработала ИИ-модель, которая умеет работать с видео

28.11.2024 [13:19],

Павел Котов

Amazon разработала собственную систему генеративного искусственного интеллекта, которая способна работать с текстом, изображениями и видео. Она поможет компании снизить свою зависимость от продуктов стартапа Anthropic, сообщило издание The Information.

Источник изображения: BoliviaInteligente / unsplash.com Создание собственной модели ИИ поможет Amazon снизить зависимость от чат-бота Claude компании Anthropic — это популярное предложение на платформе Amazon Web Services (AWS). Новая большая языковая модель под кодовым названием Olympus способна распознавать объекты на изображениях и фрагменты видео — к примеру, она может по текстовому запросу найти на записи победный бросок в баскетбольном матче. Ранее стало известно, что Amazon инвестирует ещё $4 млрд в компанию Anthropic — это основной конкурент OpenAI. В сентябре прошлого года Amazon вложила в этот стартап ту же сумму, что дало ей возможность начать зарабатывать на технологиях генеративного ИИ. Официальный анонс модели Olympus может состояться уже на следующей неделе в ходе ежегодной конференции AWS re:Invent, которая проводится для клиентов облачной платформы. Своими действиями Amazon стремится опровергнуть мнение, что Google, Microsoft и OpenAI являются безусловными лидерами в области генеративного ИИ. Anthropic научила чат-бот Claude имитировать стиль письма пользователя, причём бесплатно

27.11.2024 [08:47],

Анжелла Марина

Компания Anthropic представила новую функцию для своего чат-бота искусственного интеллекта Claude, аналогичную ChatGPT и Gemini, позволяющую устанавливать стиль генерируемых текстов. Можно выбрать либо один из трёх готовых пресетов, либо создать индивидуальный, соответствующий личным предпочтениям и задачам пользователя.

Источник изображения: Anthropic Для быстрого выбора, как информирует The Verge, помимо стандартного доступны три готовых стиля: Formal, Concise и Explanatory. Formal (формальный) для создания чёткого и аккуратного текста, Concise (краткий) для лаконичных ответов, Explanatory (толковый) для текстов с дополнительными деталями. Если ни один из пресетов не подходит, Claude может обучиться индивидуальному стилю пользователя. Для этого необходимо загрузить примеры текста, отражающие предпочтительный стиль, и дать чат-боту дополнительные инструкции, если это необходимо. Можно также сохранить несколько пользовательских стилей. Функция ориентирована на тех, кто хочет сделать взаимодействие с ИИ более естественным и уместным для разных контекстов. «Вы можете выбирать между подробными текстами, когда учитесь чему-то новому, или краткими ответами, если спешите. Можно настроить Claude так, чтобы он звучал более формально в одних случаях или дружелюбно и непринуждённо в других, — объясняет руководитель продукта Anthropic Скотт Уайт (Scott White), — Главное, что теперь вы можете задать эти предпочтения один раз и получить идеальные ответы в дальнейшем». Несмотря на то, что новая функция индивидуального стиля письма делает использование Claude более гибким и максимально персонализированным, она не является такой уж уникальной. Например, ChatGPT и Gemini предлагают аналогичные возможности для настройки тона и уровня деталей в ответах. Gemini также используется для быстрой корректировки черновиков в Gmail, а Writing Tools компании Apple предлагает похожие пресеты. |