|

Опрос

|

реклама

Быстрый переход

SK hynix построит предприятие по упаковке чипов памяти за $13 млрд к концу следующего года

13.01.2026 [04:51],

Алексей Разин

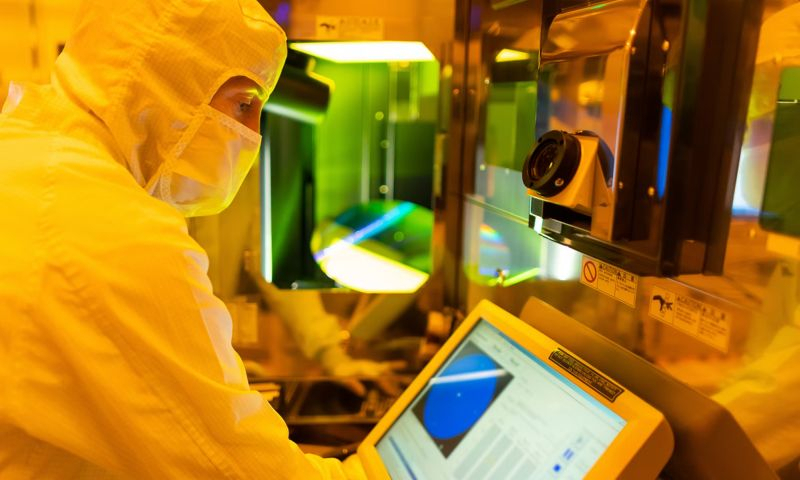

После затяжного спада спроса на память, вызванного перенасыщением рынка в пандемию, производители весьма осторожно относятся к идее расширения мощностей по выпуску чипов. В сегменте востребованной на фоне бума ИИ памяти HBM таких сомнений меньше, поэтому SK hynix решила выделить $12,9 млрд на строительство фабрики по упаковке чипов в Южной Корее.

Источник изображения: SK hynix Как поясняет Reuters со ссылкой на официальное заявление SK hynix, строительство предприятия будет начато в апреле текущего года, а завершить его планируется к концу 2027 года. Высокий спрос на память HBM со стороны инфраструктуры для ИИ вынуждает южнокорейского производителя сделать такой шаг. На рынке HBM компания SK hynix остаётся ведущим игроком, в прошлом году она занимала 61 %. Конкурирующая Samsung Electronics довольствовалась 19 %, а Micron Technology некоторое время находилась на втором месте с 20 %, прежде чем уступить эту позицию Samsung. В рамках выпуска HBM4 последняя рассчитывает добиться как минимуму паритета с SK hynix, а в идеале и добиться своего лидерства на рынке. ИИ-ускорители упёрлись в предел скорости HBM, и эта проблема пострашнее дефицита памяти

11.01.2026 [12:27],

Алексей Разин

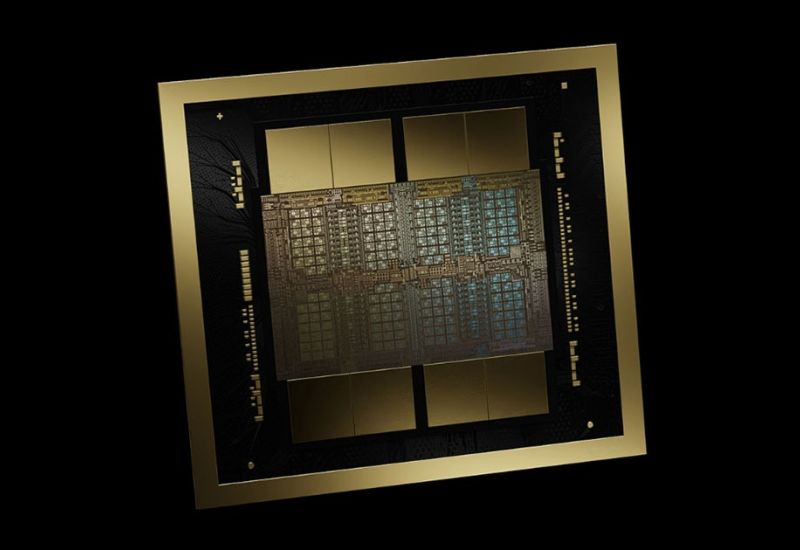

По оценкам представителей отрасли, современные ИИ-ускорители в своём развитии достигли того этапа, когда пропускная способность интерфейса памяти становится узким местом на пути дальнейшего масштабирования быстродействия. Дефицит памяти или её объём в этом отношении уходят на второй план, и устранение этого барьера главным образом зависит от разработчиков GPU и больших языковых моделей.

Источник изображения: Nvidia По словам сооснователя Majestic Labs Ша Рабии (Sha Rabii), на которого ссылается CNBC, если непосредственно ускорители вычислений в последние годы продвинулись в своём быстродействии весьма значительно, сопутствующая им память стала не особо быстрее. По сути, именно производительность памяти ограничивает сейчас дальнейший рост быстродействия больших языковых моделей. При этом переход к инференсу увеличит потребности в объёме памяти, так что спрос на неё будет расти очень быстро. В любом случае, чем больше в инфраструктуре ИИ памяти, тем большее количество клиентов она способна обслуживать в единицу времени. О необходимости наращивать объёмы выпуска памяти на CES 2026 говорил и основатель Nvidia Дженсен Хуанг (Jensen Huang). Он даже отметил, что покупатели игровых решений компании типа видеокарт и консолей «обижены» на отрасль ИИ, поскольку дефицит памяти толкает цены вверх даже в указанных смежных сегментах рынка. Даже запланированный AMD и Nvidia переход на использование памяти типа HBM4 не позволит полностью решить проблему пропускной способности. Память этого семейства всё равно ограничена в количестве задействованных каналов и высоте стека микросхем, не говоря уже о ширине интерфейса. Пропускная способность вычислительных систем могла бы масштабироваться гораздо эффективнее, если бы не свойственные HBM ограничения. Наращивать количество вычислительных блоков в составе GPU в таких условиях не имеет особого смысла, ибо память не будет успевать передавать все данные при вычислительных нагрузках, имеющих отношение как к обучению больших языковых моделей, так и инференсу. Доступные разработчикам компонентов методы упаковки чипов также выступают в роли специфического ограничивающего фактора, в условиях высокого спроса профильные мощности сильно загружены, усиливая дефицит скоростной памяти и повышая расходы производителей. На архитектурном уровне разработчики пытаются изучать альтернативы типа осуществления вычислений прямо внутри микросхем памяти (PIM), увеличения плотности компоновки микросхем в составе стека памяти, а также применения в многокристальных решениях прогрессивных интерфейсов типа UCIe, которые позволяют не только увеличить эффективную полосу пропускания, но и снизить задержки при работе с данными. Темпы дальнейшего масштабирования инфраструктуры ИИ будут зависеть от прогресса в сфере внедрения более скоростной памяти. HBM4 предложит прирост быстродействия в полтора раза относительно HBM3E, позволяя через свою более широкую 2048-разрядную шину передавать до 2 терабайт данных в секунду. К 2027 году на арену выйдет память типа HBM4E, которая потенциально увеличить скорость передачи информации ещё в полтора раза. Внедрение интерфейса CXL также должно способствовать повышению эффективности обмена данными между компонентами вычислительных систем. В части памяти переход к CXL обеспечит увеличение степени загрузки на 50 %, а также снижение энергопотребления на величину до 20–30 %. Появление новых методов трёхмерной компоновки памяти тоже должно способствовать повышению производительности и снижению энергопотребления. Дженсен Хуанг объяснил на CES 2026, почему SRAM не вытеснит дорогую HBM в ИИ-ускорителях

08.01.2026 [06:52],

Анжелла Марина

Глава Nvidia Дженсен Хуанг (Jensen Huang) объяснил, почему SRAM не заменит высокоскоростную память HBM в системах искусственного интеллекта. Выступая на сессии вопросов и ответов в рамках CES 2026 в Лас-Вегасе (США), он ответил на предположение о возможном отказе компании от дорогостоящей HBM в пользу более дешёвой компонентной базы.

Источник изображения: Tom's Hardware Как пишет Tom's Hardware, Хуанг изложил видение, согласно которому ключевым требованием для аппаратного обеспечения ИИ является не узкая специализация, а гибкость, которую как раз и обеспечивает память HBM. Главный его аргумент строится вокруг нестабильной и постоянно меняющейся природы рабочих нагрузок ИИ. Модели быстро эволюционируют, внедряются новые архитектуры и модальности, что делает оптимизацию оборудования под одну конкретную задачу малоэффективной в долгосрочной перспективе. Хотя Хуанг признал, что решения с упором на SRAM могут показывать невероятную скорость в определенных сценариях и избегать задержек, присущих внешней памяти, они сталкиваются с жёсткими ограничениями по ёмкости при масштабировании. В контролируемых тестах такие ускорители выглядят привлекательно, но в реальном применении они не могут обеспечить тот баланс пропускной способности и плотности, который даёт HBM. Глава Nvidia также затронул тему открытых ИИ-моделей, чьё распространение, как предполагается, может снизить зависимость от дорогих GPU. Он признал их ценность, но подчеркнул, что открытость архитектуры не отменяет инфраструктурных ограничений. Обучение и обслуживание современных моделей, независимо от лицензии, по-прежнему требуют огромных вычислительных ресурсов и больших объёмов памяти. Более того, развитие открытых моделей с увеличением контекстных окон и добавлением мультимодальности лишь усиливает потребность в высокопроизводительной и гибкой памяти, такой как HBM. Таким образом, позиция Nvidia заключается в том, что разнообразие и постоянная изменчивость рабочих нагрузок ИИ делают универсальность и адаптивность ключевыми экономическими факторами. Специализированные ускорители, ориентированные на конкретные задачи, могут демонстрировать впечатляющие результаты в тестах, но в условиях быстро меняющегося ландшафта ИИ они рискуют устареть. Компания готова мириться с высокой стоимостью HBM и сложностью систем, поскольку это позволяет сохранить возможность адаптации к новым архитектурам моделей и сценариям развёртывания. По мнению Дженсена Хуанга, момент, когда модели стабилизируются настолько, чтобы сделать специализированные решения более выгодными, чем гибкие платформы, ещё не наступил. Новая статья: Итоги-2025: почему память стала роскошью и что будет дальше

08.01.2026 [00:03],

3DNews Team

Данные берутся из публикации Итоги-2025: почему память стала роскошью и что будет дальше Huawei схлестнётся с Nvidia за пределами Китая — ИИ-ускорители Ascend начнут поставлять в Южную Корею

27.12.2025 [07:19],

Алексей Разин

Для Huawei приоритетной задачей сейчас является обеспечение импортозамещения в китайской отрасли искусственного интеллекта, но это не мешает компании думать о потенциальной экспансии на внешние рынки. Хотя исторически под ними было принято подразумевать страны Ближнего Востока, неожиданно в данном контексте на уходящей неделе всплыла Южная Корея, куда Huawei намеревается поставлять свои ускорители Ascend.

Источник изображения: Huawei Technologies Как сообщает TrendForce со ссылкой на южнокорейские СМИ, глава местного представительства Huawei Technologies Валянь Ван (Valian Wang) вчера заявил о намерениях компании официально поставлять в Южную Корею ускорители вычислений и готовые системы для ИИ-ЦОД со следующего года. При этом проторить данную экспортную дорожку призван новейший ускоритель модели Ascend 950, так что никакой дискриминации внешнего рынка по сравнению с внутренним не будет. На рынке Южной Кореи китайская Huawei попробует конкурировать с американской Nvidia. Впрочем, понимая сложность освоения нового для себя рынка, Huawei в Южной Корее будет делать упор на продажу комплексных готовых решений, а не отдельных компонентов. Сетевая инфраструктура, системы хранения данных — всё это будет поставляться Huawei южнокорейским клиентам в совокупности с вычислительными мощностями и программным обеспечением. Полагаться на посредников в этой сфере Huawei тоже не может, а потому будет заниматься ими напрямую. Переговоры с некоторыми потенциальными клиентами в Южной Корее уже ведутся. В следующем году Huawei также намерена поставлять южнокорейским клиентам свою операционную систему HarmonyOS, хотя о продажах фирменных смартфонов под её управлением в данной стране речь пока не идёт. Помимо Южной Кореи, Huawei рассчитывает наладить поставки своих ИИ-систем в Малайзию в следующем году. Подобные амбиции указывают на наличие у компании способности наладить выпуск соответствующей продукции в достаточных количествах с учётом быстро растущей потребности внутреннего рынка КНР. На мероприятии Huawei Connect 2025 также стало известно, что ускорители семейства Ascend 950 будут оснащаться альтернативой памяти типа HBM, которую Huawei разработала своими силами. Ускорители для инференса получат HiBL 1.0, а модели для обучения — память семейства HiZQ 2.0. Fujitsu участвует в разработке более доступной альтернативы HBM вместе с Intel и SoftBank

26.12.2025 [08:58],

Алексей Разин

В середине уходящего года стало известно о попытках Intel и SoftBank разработать более дешёвую альтернативу скоростной памяти HBM, которая в разных своих поколениях использовалась в сегменте ускорения вычислений. Теперь издание Nikkei Asian Review сообщает, что в проекте принимает участие и японская компания Fujitsu, создающая самые мощные в стране суперкомпьютеры.

Источник изображения: Fujitsu Учреждённая SoftBank компания Saimemory выступит в роли координатора усилий на этом направлении, Fujitsu тоже будет с ней взаимодействовать. К весне 2027 года в проект предполагается вложить $51,2 млн и получить прототип нового типа памяти, а массовое производство планируется развернуть к 2029 году. К 2027 году SoftBank вложит в капитал Saimemory около $19 млн. Национальный исследовательский институт Riken вместе с Fujitsu вложат в три раза меньшую сумму. Часть расходов на разработку нового типа памяти будет субсидироваться японским правительством. Fujitsu имеет опыт массового производства чипов, поэтому она сможет им поделиться при организации выпуска нового вида памяти, хотя и Intel в этом смысле вряд ли уступает ей по масштабу компетенций. По сравнению с HBM, новый тип памяти должен обеспечить увеличение доступного объёма в два или три раза при снижении энергопотребления в два раза. Стоимость такой памяти при этом может оказаться чуть ниже. TSMC также будет участвовать в проекте на этапе изготовления прототипов новой памяти. Intel и Токийский университет примут участие в разработке, причём первая предложит свой опыт в области упаковки чипов в вертикальном измерении. Служебные блоки будут располагаться не на плоском кристалле, а интегрироваться вертикально, что и позволит увеличить плотность обработки данных в удельном измерении. Прочие участники проекта будут отвечать за разработку скоростного интерфейса передачи информации и эффективный отвод тепла. Saimemory не будет самостоятельно заниматься выпуском разработанной памяти, поручая эту функцию подрядчикам. Потребность японской экономики в инфраструктуре ИИ при нынешних темпах развития отрасли за текущее десятилетие может увеличиться в 300 раз. Стране не помешает увеличить в этом контексте степень своей независимости от импортных технологий. Рынок HBM сейчас на 90 % контролируется двумя южнокорейскими компаниями — SK hynix и Samsung Electronics. Япония производство памяти на своей территории свернула ещё в начале века. Fujitsu этот бизнес оставила в прошлом ещё в конце двадцатого века, не выдержав ценовой конкуренции. Бум ИИ меняет ситуацию с доходностью производства памяти, поэтому новые игроки (или хорошо забытые старые) на нём появятся в ближайшие годы. Samsung передумала сворачивать производство памяти DDR4, но потребители от этого не выиграют

24.12.2025 [19:55],

Сергей Сурабекянц

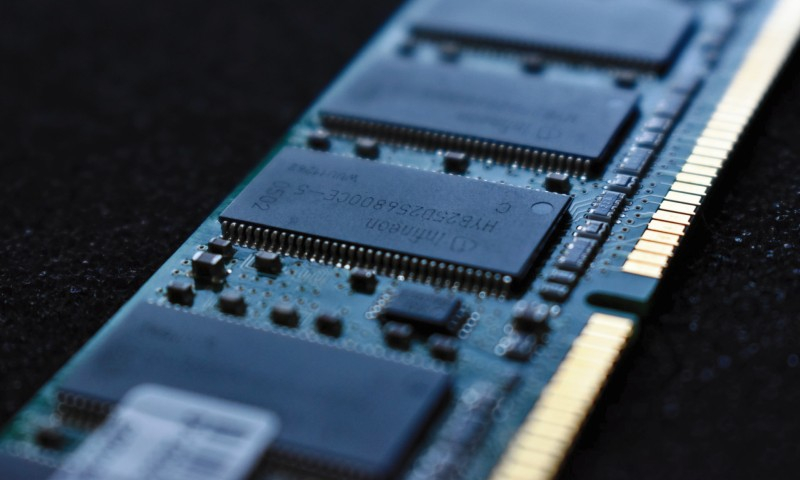

Samsung откладывает запланированное прекращение выпуска памяти DDR4 из-за подписания долгосрочного «не подлежащего расторжению и возврату» контракта с ключевым клиентом. Это соглашение не решит проблему потребительского дефицита памяти, поскольку поставки предназначены для корпоративных клиентов. Сделка очень выгодна для компании — она позволит Samsung «выжать последние соки» из своей устаревающей производственной линии DDR4.

Источник изображения: unsplash.com 16-гигабайтные модули DDR4 достигли на спотовом рынке рекордной цены в $60. Это сделало рынок DDR4 достаточно прибыльным, чтобы Samsung отложила закрытие своей существующей производственной линии DDR4. Однако компания не планирует создавать новые линии для удовлетворения растущего потребительского спроса. Осведомлённые источники сообщают, что один клиент уже подписал с компанией контракт «не подлежащий расторжению и возврату» (Non-Cancellable, Non-Returnable, NCNR) на поставки DDR4. Такие контракты подразумевают, что клиент гарантированно получит фиксированное количество модулей памяти по фиксированной цене, и цена или объем не могут быть изменены в будущем. Контракт NCNR обязывает клиента приобрести продукт независимо от любых других факторов. Этот тип соглашения обеспечивает стабильность как объёма, так и стоимости для клиента, так что он не пострадает от текущей волатильности на рынке памяти, вызванной бумом ИИ. С другой стороны, это помогает Samsung защитить себя от неопределённости на рынке памяти. Даже если пузырь ИИ лопнет и возникнет избыток модулей памяти HBM и DDR5, что приведёт к падению цен, это гарантирует прибыльность производственной линии DDR4. По данным инсайдеров, контрактная цена превысит $20 за 16-гигабайтный модуль DDR4, но Samsung все ещё оценивает рынок и может дополнительно её повысить. Тем не менее, это всего лишь треть от текущих спотовых цен, заложенных в краткосрочных контрактах. Сообщается, что клиент, подписавший контракт с Samsung, специализируется на серверных приложениях, и ни одна компания, работающая на потребительском рынке, не заявила о намерении заключить подобный контракт на поставку DDR4. Изначально Samsung планировала прекратить производство DDR4, чтобы сосредоточиться на HBM и DDR5, но бурный рост спроса на HBM привёл к резкому росту цен на память DDR5, что вызвало увеличение спроса и цен на более старую память DDR4. Это заставило трёх крупнейших производителей памяти отложить запланированное закрытие производственных линий DDR4. Однако ожидается, что эти линии будут обслуживать корпоративных отраслевых клиентов, а не потребителей, поэтому потребителям не стоит ожидать улучшения ситуации с дефицитом оперативной памяти в 2026 году. Samsung обогнала Micron и вернула себе второе место на рынке памяти HBM

21.12.2025 [21:55],

Николай Хижняк

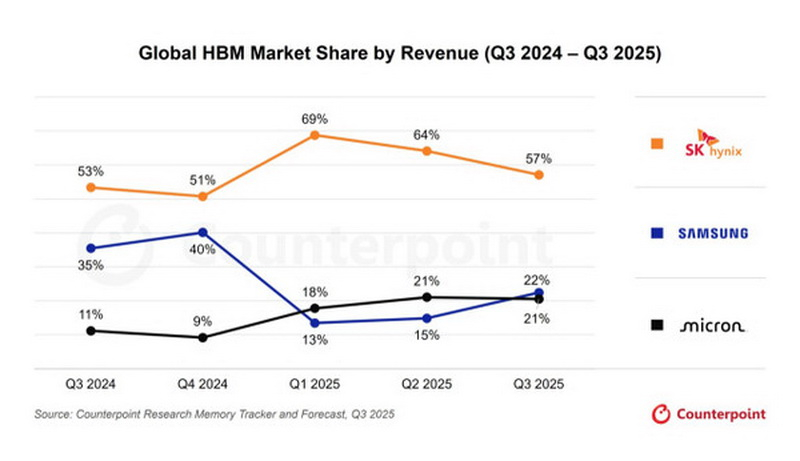

В третьем квартале этого года Samsung Electronics обошла Micron Technology и вернула себе второе место на рынке высокоскоростной памяти (HBM). После падения на третье место в первом и втором кварталах компания продемонстрировала тенденцию к восстановлению, расширив поставки продуктов HBM3E (5-го поколения).

Источник изображения: Counterpoint Research По данным исследовательской компании Counterpoint Research от 19 декабря, глобальная доля Samsung Electronics на рынке HBM (по выручке) в третьем квартале составила 22 %. По сравнению с предыдущим кварталом рост составил 7 процентных пунктов (с 15 %). За тот же период Micron заняла 21 % рынка, тем самым уступив второе место Samsung Electronics. SK hynix сохранила первую позицию с долей в 57 %. Хотя она по-прежнему является лидером рынка, её доминирование несколько ослабло по сравнению с предыдущим кварталом, когда её доля составляла 64 %. Согласно оценкам аналитиков, Samsung Electronics заложила основу для восстановления, преодолев негативный фактор сокращения экспорта в Китай и начав полномасштабные поставки продукции HBM3E с третьего квартала. Samsung также демонстрирует серьёзную конкуренцию на общем рынке DRAM. По доле рынка DRAM в третьем квартале, рассчитанной на основе выручки, SK hynix сохранила первое место с 34 %, в то время как доля Samsung Electronics достигла 33 % (рост на 1 п.п). Разрыв между Samsung и SK hynix составляет всего 1 процентный пункт. В отчёте говорится, что SK hynix сотворила настоящую сенсацию, впервые в истории обогнав Samsung Electronics и заняв первое место по выручке от DRAM в первом квартале этого года. Падение Samsung Electronics на второе место после 33-летнего удержания позиции «полупроводникового императора» с 1992 года стало беспрецедентным событием в истории полупроводниковой промышленности. Micron же заняла третье место с долей рынка в 26 % за тот же отчётный период. Рынок DRAM в этом квартале в целом вырос на 26 % по сравнению с предыдущим кварталом благодаря рекордному росту цен и увеличению объёмов поставок. Поскольку три ведущих производителя памяти сократили производство устаревшей DRAM, возник дефицит предложения, что привело к росту цен. Аналитики отрасли ожидают дальнейшего усиления конкуренции за лидерство на рынке HBM4 в следующем году. Samsung Electronics расширяет производственные мощности HBM3E во второй половине года и ускоряет разработку продуктов следующего поколения (HBM4). Ожидается, что SK hynix тоже сосредоточит все усилия на сохранении своего лидерства в сегменте HBM. Micron предсказала рост рынка памяти HBM до $100 млрд к 2028 году

18.12.2025 [13:04],

Алексей Разин

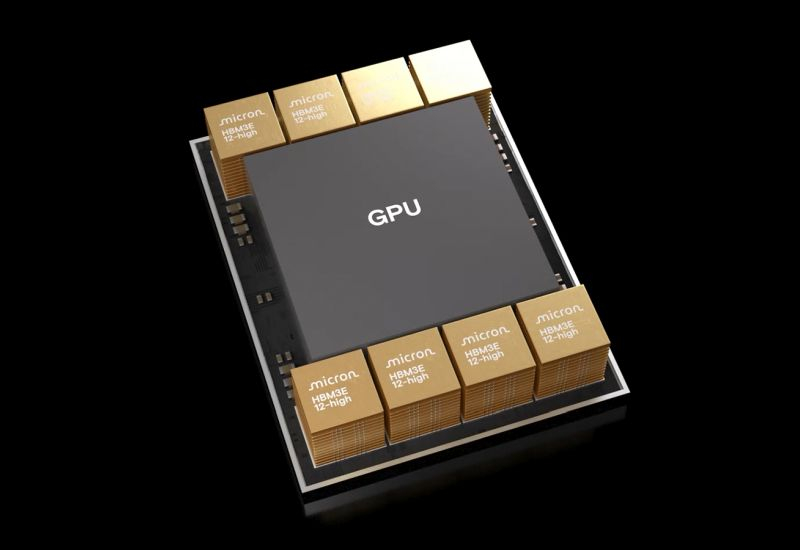

Руководство американской Micron Technology, как позволяет понять публикация Seeking Alpha, на квартальном отчётном мероприятии заглядывало в будущее чуть дальше 2026 года. По мнению Санджея Мехротры (Sanjay Mehrotra), до 2028 года рынок памяти в денежном выражении будет расти в среднем на 40 % в год, и достигнет ёмкости в $100 млрд против $35 млрд по итогам текущего года.

Источник изображения: Micron Technology Как добавил генеральный директор Micron, рубеж в $100 млрд рынок HBM преодолеет на два года быстрее, чем планировалось изначально. Дефицит памяти сохранится, по его мнению, не только до конца 2026 года, но и в последующие периоды. По словам Мехротры, ключевым фактором роста поставок памяти DRAM и NAND для компании станет переход на более прогрессивные технологии их производства, поскольку в краткосрочной перспективе другого способа нарастить объёмы выпуска просто не будет. Соответственно, увеличенные с $18 до $20 млрд капитальные затраты в следующем году Micron направит главным образом на внедрение новых технологий производства памяти. Приоритет будет отдан так называемому техпроцессу «1-гамма» для выпуска DRAM и сектору HBM во всём его многообразии. К слову, в прошлом квартале бизнес Micron рос довольно гармонично. На направлении DRAM выручка увеличилась последовательно на 20 % до $10,8 млрд (к сегменту относится и HBM), а производство NAND нарастило профильную выручку на 22 % до $2,7 млрд по сравнению с предыдущим кварталом. Общая выручка компании последовательно выросла на 21 % до $13,6 млрд, в годовом сравнении она увеличилась на 57 %. По словам Мехротры, дефицит HBM сохранится в следующем году, причём на улучшение ситуации с доступностью классической DRAM тоже рассчитывать не приходится. В своих конкурентных позициях на рынке Micron очень уверена, поскольку готова предложить клиентам хорошие характеристики и при этом сохранять прибыльность. Норма прибыли как таковая далее будет расти более умеренными темпами, чем в предыдущие пару кварталов, но предстоящая миграция на новые технологии производства памяти существенно её не испортит. Долгосрочные контракты на поставку памяти, которые рассчитаны на несколько лет, Micron теперь заключает на гораздо более выгодных условиях, чем ранее. Гегемония SK hynix нарушена: впервые в истории Samsung стала №1 по выпуску HBM

06.12.2025 [07:34],

Алексей Разин

Долгое время способность в приличных количествах выпускать память типа HBM для нужд Nvidia обеспечивала компании SK hynix статус лидера в этом перспективном и доходном сегменте, и в определённый момент последняя обошла Samsung не только по прибыли, но и выручке. Как сообщают южнокорейские СМИ, в натуральном выражении Samsung недавно обошла SK hynix по объёмам выпуска HBM.

Источник изображения: Samsung Electronics По информации Business Korea, недавно Samsung Electronics удалось выйти на ежемесячную обработку 170 000 кремниевых пластин с чипами HBM, тогда как до этого данное количество не превышало 150 000 кремниевых пластин в месяц. На новом рубеже Samsung оставляет позади компанию SK hynix, которая сейчас способна ежемесячно выпускать 160 000 кремниевых пластин с микросхемами памяти типа HBM. По оценкам аналитиков, реванш Samsung стал возможен благодаря переориентации производственных линий с выпуска DRAM на производство HBM, а также совершенствованию техпроцессов, причём этим курсом корейский гигант двигался со второй половины прошлого года, во многом благодаря смене руководства подразделения DS, которая состоялась в мае 2024 года. К сентябрю этого года HBM3E производства Samsung наконец-то смогла пройти сертификацию Nvidia, хотя до этого страдала от перегрева и не могла удовлетворять всем требованиям этого заказчика. Samsung также начала снабжать подобной памятью Google, а разработанная не так давно HBM4 уже поставляется компанией своим клиентам в виде образцов. Производственные линии P3 и P4 в Пхёнтхэке компания Samsung расширяет и переводит под выпуск кристаллов DRAM по передовому техпроцессу 1c шестого поколения, чтобы одновременно удовлетворить спрос на HBM. Было ускорено строительство линии P5, которая в будущем позволит увеличить объёмы производства памяти. Если Samsung делает упор на перевооружение существующих производств под нужды выпуска HBM, то SK hynix старается быстрее вводить в строй специализированные производственные мощности. В следующем году, как ожидают эксперты, ежемесячные объёмы обработки 200 000 кремниевых пластин с HBM будут освоены как Samsung, так и SK hynix. До середины 2026 года преимущество будет сохраняться за первой из компаний, но если летом SK hynix введёт в строй предприятие M15X, то сможет перехватить инициативу. В сегменте HBM4 успех обеих компаний будет зависеть от разных факторов. Если Samsung способна сама изготавливать адаптированные под нужды клиентов базовые кристаллы, то SK hynix будет вынуждена полагаться на услуги TSMC в этой сфере. В этом году доля HBM на рынке DRAM должна превысить 20 %, хотя ещё в прошлом году она составляла 8 %. При этом HBM выпускать выгоднее в 3–5 раз при нынешнем уровне цен, чем обычную DDR. Вертикальная интеграция бизнеса Samsung, по мнению некоторых экспертов, обеспечит ей определённые преимущества на рынке HBM. SK hynix запустит тотальное расширение фабрик памяти DRAM, чтобы победить дефицит

30.11.2025 [07:48],

Алексей Разин

Признание руководства SK hynix о распределении всей квоты на производство памяти в 2026 году по предварительным заказам лишь могло звучать, как приговор для отрасли, но по факту адекватные меры для устранения дефицита этим производителем будут предприниматься, как поясняет издание The Chosun Daily.

Источник изображения: SK hynix В следующем году, как отмечает источник, SK hynix будет модернизировать линии по выпуску памяти на всех своих предприятиях, а также искать дополнительные площади для выпуска DRAM. Передовое предприятие M15x сосредоточится на выпуске HBM, его мощности расширяются в первую очередь. На предприятии M14 будут модернизированы линии по выпуску DDR, а на фабриках M16, M8 и M10 компания займётся оптимизацией использования доступных площадей для размещения дополнительного оборудования по выпуску памяти. По оценкам аналитиков, в следующем году спрос на DRAM (включая HBM) вырастет на 18 %. По этой причине SK hynix ускоряет план по увеличению объёмов выпуска микросхем этого типа, который изначально предполагал прирост с 70 000 ежемесячно обрабатываемых кремниевых пластин до 100 000 штук. Более того, некоторые источники ожидают, что на предприятиях SK hynix по производству NAND будет произведено перевооружение, позволяющее выделить часть мощностей под выпуск DRAM. Шестое поколение 10-нм техпроцесса также сыграет в этой экспансии определённую роль. Micron инвестирует $9,6 млрд в завод по производству памяти HBM в Японии

30.11.2025 [00:31],

Николай Хижняк

Компания Micron инвестирует 1,5 трлн иен ($9,6 млрд) на строительство завода на западе Японии по производству микросхем памяти для приложений искусственного интеллекта. Об этом сообщает Bloomberg со ссылкой на отчёт газеты Asia Nikkei.

Источник изображения: Micron Technology Micron стремится диверсифицировать производство передовых микросхем за пределами Тайваня, сообщает Nikkei со ссылкой на источники, знакомые с ситуацией. Новый завод будет производить микросхемы памяти с высокой пропускной способностью (HBM) — ключевой компонент в составе специализированных ИИ-ускорителей, таких как те, что выпускает Nvidia. Строительство начнётся в мае 2026 года на территории действующего завода Micron в Хиросиме. Поставки чипов HBM с новой площадки ожидаются в 2028 году. Министерство экономики, торговли и промышленности Японии намерено субсидировать проект на сумму до 500 млрд иен ($3,2 млрд). С 2021 года Япония направила около 5,7 трлн иен ($36,5 млрд) на восстановление и развитие полупроводниковой отрасли. В новом дополнительном бюджете, который кабинет премьер-министра Санаэ Такаити передал на рассмотрение парламента, предусмотрено ещё 252,5 млрд иен ($1,7 млрд) для поддержки ИИ и производства микросхем. Власти ранее одобрили выделение 774,5 млрд иен ($4,9 млрд) на расширение производства Micron в Хиросиме и профинансировали другие проекты, включая фабрики TSMC и Rapidus. На рынке HBM Micron конкурирует со SK hynix и Samsung Electronics. Спрос на такие чипы резко вырос со стороны OpenAI, Meta✴✴ и других компаний, которые активно наращивают мощности для обучения и обслуживания ИИ-моделей. В Южной Корее начали продавать съедобные HBM-чип(с)ы SK hynix

26.11.2025 [12:37],

Алексей Разин

Ещё в 2013 году маркетологи AMD упражнялись в игре слов вокруг термина «chips», который в английском языке может обозначать как полупроводниковые компоненты, так и знакомые всем снеки. Теперь инициативу подхватила южнокорейская SK hynix, которая в условиях дефицита микросхем памяти HBM решила выпустить совместно с корейской сетью супермаркетов 7-Eleven банановые чипсы с одноимённым названием.

Источник изображения: SK hynix Как поясняется в фирменных маркетинговых материалах, в случае с продуктами питания сокращение HBM расшифровывается как Honey Banana Mat, что на смеси английского и корейского языков означает «вкус медового банана». Закуска поступила в продажу в южнокорейские супермаркеты 7-Eleven, и торговая марка SK hynix на упаковке тоже присутствует. За пределы Южной Кореи новинка местной розницы не поставляется. Сами чипсы изготовлены из кукурузной муки, а дополнительной сладости и аромата им придаёт глазурь из шоколада, мёда и бананового ароматизатора. На этом мировой лидер в производстве памяти типа HBM останавливаться не собирается, и со следующего месяца начнёт выпускать коллекционные фигурки подобной тематики. По замыслу авторов идеи, подобная продукция должна повысить осведомлённость покупателей по поводу ассортимента полупроводниковых изделий. Кроме того, такая продукция призвана вызывать у потребителей благоприятные ассоциации с торговой маркой SK hynix. SK hynix уже продала всю память, которую выпустит в 2026 году — квартал завершён с рекордными выручкой и прибылью

29.10.2025 [07:16],

Алексей Разин

Производители памяти в целом хорошо зарабатывают в условиях бума ИИ, а SK hynix ещё и остаётся главным поставщиком микросхем типа HBM, поэтому её квартальная отчётность способна порадовать инвесторов. Прошлый квартал характеризовался ростом выручки на 39 % до рекордных $17,13 млрд, операционная прибыль выросла на 62 % до $8 млрд, а ещё компания распродала всю производственную программу памяти на следующий год.

Источник изображения: Nvidia По данным CNBC, инвесторы в среднем ожидали чуть лучших квартальных результатов, но и наблюдаемую динамику сложно назвать скудной. В любом случае, на утренних торгах в среду акции SK hynix выросли в цене на 5 %, а всего с начала года они подорожали на 210 %. В последовательном сравнении выручка SK hynix выросла на 10 %, а операционная прибыль увеличилась на 24 %. В национальной валюте операционная прибыль SK hynix в прошлом квартале впервые превысила рубеж в 10 трлн вон. Поскольку все квоты на производство памяти в следующем году распроданы уже сейчас, SK hynix займётся расширением производственных мощностей, хотя сумма капитальных затрат на 2026 год и не была названа. Даже в 2027 году при этом будет сохраняться дефицит HBM, по словам представителей компании. В текущем квартале SK hynix приступит к поставкам HBM4, которая считается шестым поколением памяти данного класса. Можно предположить, что такую память начнёт получать от SK hynix компания Nvidia, являющаяся крупнейшим клиентом корейского производителя, хотя напрямую это не указывается. По прогнозам аналитиков Counterpoint Research, к 2027 году ёмкость мирового рынка памяти типа HBM достигнет $43 млрд. Во втором квартале текущего года SK hynix занимала на рынке DRAM в целом 38 % в показателях выручки, обойдя прежнего долговременного лидера в лице Samsung Electronics в первом квартале этого года. Сегмент HBM во втором квартале вырос в денежном выражении на 178 %, компания SK hynix сохранила на нём лидирующие позиции в виде доли в 64 %. Представители Futurum Group считают, что по итогам следующего года SK hynix будет контролировать в сегменте HBM не менее 60 % мирового рынка. По мнению самой SK hynix, в ближайшие пять лет рынок HBM будет расти более чем на 30 % ежегодно. В сегменте DRAM в целом, который формально включает и HBM, спрос на память в следующем году в натуральном выражении увеличится более чем на 20 %, как считает руководство SK hynix. В сегменте NAND спрос вырастет менее чем на 20 %. По мнению аналитиков Bloomberg Intelligence, цены на память в следующем году продолжат расти, и это пойдёт на пользу SK hynix и Samsung Electronics. По данным корейских СМИ, обе компании уже подняли цены на традиционные типы памяти в четвёртом квартале на величину до 30 %. Конкурирующие Nanya Technology и Kioxia с начала года подняли цены на свою память более чем в два раза. Руководство SK hynix на квартальной конференции заявило, что мировой рынок памяти будет переживать продолжительный «суперцикл» роста, а объёмы её производства продолжат отставать от спроса. Цены на серверную DRAM подскочили на 50 % из-за дефицита — выполняется лишь 70 % заказов

28.10.2025 [20:09],

Сергей Сурабекянц

Цепочка поставок DRAM перегружена и серверная память принимает на себя удар в первую очередь. Крупные американские и китайские гиперскейлеры сейчас получают лишь 70 % заказанной ими серверной памяти, несмотря на 50-процентное повышение контрактных цен в четвёртом квартале. Основной причиной дефицита серверной DRAM стал продолжающий бум ИИ, причём спрос растёт не только на передовую HBM, но и на обычные модули DDR5.

Источник изображения: unsplash.com Даже крупнейшие заказчики не могут получить необходимого количества памяти. Спотовые цены резко выросли с конца сентября, и, как сообщается, несколько ведущих поставщиков отказываются предоставлять котировки на октябрьские поставки. Модули DDR5 ёмкостью 16 Гбайт, которые в прошлом месяце торговались по цене от $7 до $8, теперь стоят около $13, ожидается, что их доступность к ноябрю ещё больше сократится. Остальным участникам рынка приходится ещё хуже. Канальные дистрибьюторы и небольшие OEM-производители сообщают, что уровень выполнения заказов на память приближается к 35–40 %. Гиперскейлеры опустошают склады производителей, а менее приоритетные клиенты вынуждены переходить на спотовый рынок или ждать, пока мощности производителей освободятся в 2026 году. Micron на встрече с инвесторами назвала рынок DRAM «напряжённой отраслью» и спрогнозировала, что рост предложения будет отставать от спроса до конца следующего года. Недавняя корректировка цен Samsung подтвердила смену приоритетов: компания подняла цены на серверные SSD на 35 %, а контрактные ставки на память — на 50 %, ссылаясь на устойчивый спрос со стороны корпоративных клиентов и облачных сервисов. Аналитическая компания TrendForce предупреждает о возможной заморозке котировок на некоторые модули, поскольку китайские поставщики переходят на посуточное ценообразование, чтобы избежать заключения невыгодных сделок. Это приводит к постепенному росту розничных цен на DDR5, без каких-либо признаков стабилизации до конца года. Тем временем, цены на DDR4 медленно снижаются. Китайская Nanya Technology недавно заявила, что стандартная память DDR4 занимает всего 20 % от общего рынка DRAM и больше не является приоритетной для массового производства. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |