|

Опрос

|

реклама

Быстрый переход

Intel рассказала о памяти HB3DM — «убийце» HBM с более высокой пропускной способностью

30.04.2026 [00:28],

Николай Хижняк

Стартап Saimemory, созданный компаниями Intel, SoftBank и Токийским университетом, разрабатывает альтернативу популярной технологии памяти с высокой пропускной способностью (HBM), призванную обеспечить более высокие значения пропускной способности стеков памяти, используемых в составе мощных ИИ-ускорителей.

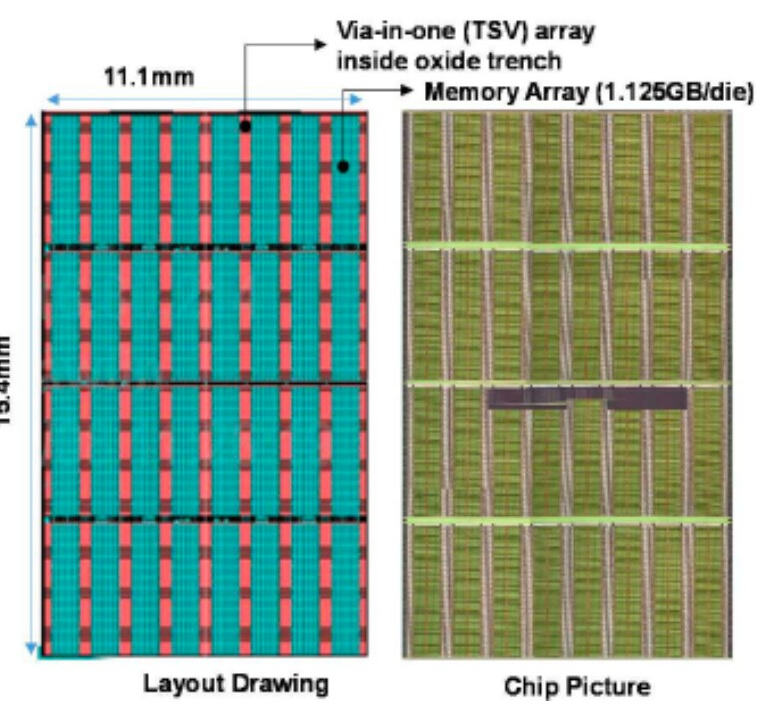

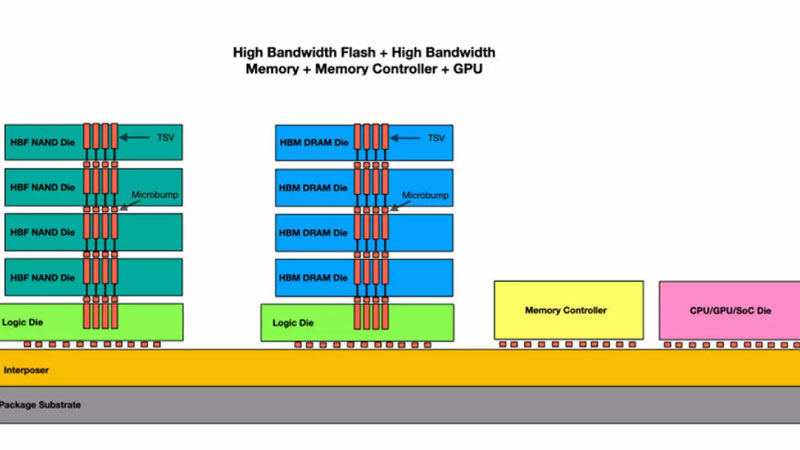

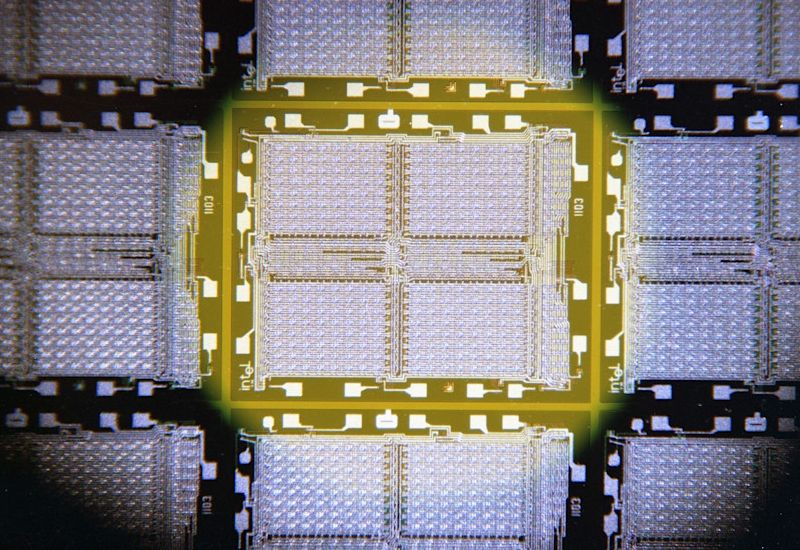

Источник изображений: Intel В июне на выставке VLSI 2026 компания Saimemory планирует представить доклад о недавно разработанной памяти HB3DM. Она основана на технологии Z-Angle Memory (ZAM). «Z» в названии указывает на вертикальное расположение (по оси Z) кристаллов памяти, аналогичное традиционной памяти HBM. Для сборки модулей планируется использовать самые современные технологии стекирования Intel. Первое поколение HB3DM будет состоять в общей сложности из девяти слоёв, соединённых с использованием гибридной технологии для вертикального размещения кристаллов. Основой стека памяти HB3DM будет служить логический слой, который управляет перемещением данных внутри чипа. Поверх него будут располагаться восемь слоёв памяти DRAM для хранения данных. Каждый слой будет содержать около 13 700 сквозных межсоединений (TSV) для гибридной спайки.  Ожидается, что память HB3DM обеспечит ёмкость около 1,125 Гбайт на слой, что соответствует 10 Гбайт на стек. Технология позволяет достичь примерно 0,25 Тбайт/с пропускной способности памяти на мм2, поэтому для модуля на 10 Гбайт с площадью кристалла 171 мм2 можно ожидать около 5,3 Тбайт/с пропускной способности. Согласно озвученным характеристикам, HB3DM предложит более чем двое более высокую пропускную способность, чем HBM4. Последняя обеспечивает пропускную способность около 2 Тбайт/с на стек. Однако у HB3DM есть ограничения. В частности, на её основе можно создавать только стеки ёмкостью до 10 Гбайт, в то время как HBM4 позволяет создавать стеки ёмкостью до 48 Гбайт. Intel может увеличить количество слоёв по мере развития HB3DM, но на данный момент разработка сосредоточена на пропускной способности. На данный момент неизвестно, когда Saimemory собирается выпустить HB3DM и кто будет производить для неё базовые кристаллы DRAM — возможно, сама Intel. Ближе к выставке VLSI 2026 компании, вероятно, предоставят больше подробностей о достигнутом прогрессе в разработке. SK hynix утроила выручку и увеличила прибыль в пять раз на фоне бума ИИ

23.04.2026 [04:54],

Алексей Разин

Микросхемы памяти сейчас очень востребованы в инфраструктуре систем искусственного интеллекта, поэтому их поставщики ожидаемо хорошо зарабатывают. В случае с южнокорейской SK hynix это утверждение наглядно иллюстрируется итогами минувшего квартала: компания в годовом сравнении увеличила выручку почти втрое, а её операционная прибыль выросла в пять раз.

Источник изображения: SK hynix Выручка компании за период составила рекордные $35,55 млрд, а операционная прибыль достигла $25,4 млрд, последовательно увеличившись почти в два раза. Более того, норма операционной прибыли достигла рекордных 72 %. При этом и выручка, и операционная прибыль SK hynix по итогам первого квартала оказались несколько ниже ожиданий аналитиков. Первый квартал для рынка памяти в целом не является пиковым периодом с точки зрения финансовых показателей, но бум ИИ позволил опровергнуть данный стереотип. Представители компании подчеркнули, что клиенты SK hynix считают важным обеспечить себя необходимыми объёмами памяти, и не особо оглядываются на цену. «Память важна, как никогда ранее», — резюмировали они. Хотя Samsung в четвёртом квартале прошлого года вернула себе статус лидера на рынке DRAM в денежном выражении, в сегменте HBM продолжает доминировать SK hynix с долей 57 %. Рынок памяти растёт более чем на 30 % уже два квартала подряд. По оценкам руководства SK hynix, нехватка HBM будет ощущаться минимум до 2030 года, даже с учётом наличия у компании планов по расширению производственных мощностей. Даже если цены на память во втором полугодии будут расти умеренными темпами, прибыль SK hynix продолжит увеличиваться на протяжении всего текущего года. По некоторым оценкам, капитальные затраты SK hynix в этом году будут увеличены на 45 %. Средняя цена реализации DRAM в первом квартале выросла последовательно на 60,8 %, а цены на NAND увеличились на 55,3 %. Во многом это и определяет взрывную динамику финансовых показателей производителей памяти. Sandisk намерена начать опытный выпуск передовой памяти HBF до конца года

13.04.2026 [08:07],

Алексей Разин

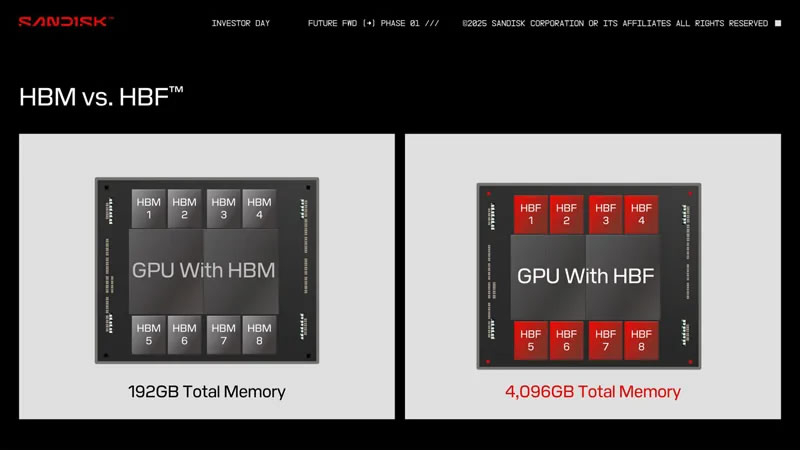

Производители совершенствуют технологии выпуска не только оперативной, но и твердотельной памяти. Sandisk, которая является одним из ключевых разработчиков HBF, намерена до конца текущего года построить в Японии пилотную линию по производству памяти этого типа, а в промышленных масштабах начать выпуск уже в 2027 году.

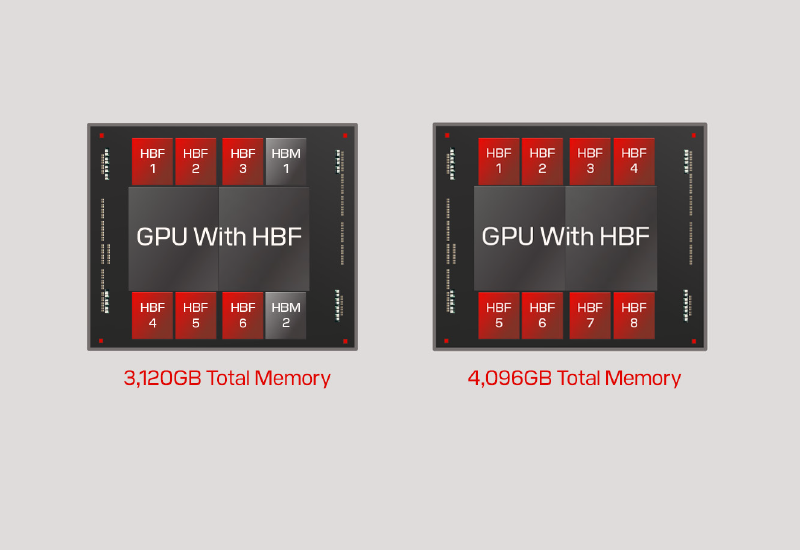

Источник изображения: Sandisk Как сообщает ETNews, компания уже приступила к поиску материалов, компонентов и оборудования, которое будет использовать при производстве HBF — нового типа NAND, который подразумевает вертикальную компоновку по примеру HBM. Экспериментальная линия в Японии может быть установлена в следующем полугодии, а первые образцы HBF с её помощью Sandisk рассчитывает получить до конца текущего года. Если всё пойдёт по плану, Sandisk может освоить массовый выпуск HBF примерно на полгода быстрее обещанного ранее. При производстве HBF будет использоваться часть оборудования, подходящего для выпуска HBM, равно как и некоторые технологии. В этом смысле с поиском поставщиков материалов и оборудования для производства HBF проблем возникнуть не должно. Китайские производители памяти также готовятся начать выпуск HBF, поэтому конкуренция на рынке обещает быть острой. В сфере стандартизации HBF поддержку Sandisk оказывает конкурирующая SK hynix. Пик спроса на HBF, как ожидается, придётся на 2030 год. Интерес к производству HBF проявляет и Samsung Electronics, которая над разработкой такой памяти трудится с начала текущего десятилетия. Впрочем, в отличие от SK hynix, этот южнокорейский производитель пока не спешит делать громкие заявления касательно сроков появления HBF на рынке. Принято считать, что HBF позволит размещать большие объёмы данных в непосредственной близости от GPU, ускоряя работу с ИИ-моделями в задачах инференса. Если по уровню быстродействия HBF уступает HBM, то по ёмкости она превосходит её до 16 раз. По сути, в 16-ярусном стеке HBF можно хранить до 512 Гбайт информации. Если окружить GPU восемью такими стеками, то объём памяти вырастет до 4 Тбайт. Спрос на подобные решения будет расти по мере того, как сфера искусственного интеллекта переходит от обучения больших языковых моделей к инференсу. За первые пять лет ИИ-бума спрос на память вырастет в 625 раз, как считает глава Dell

11.04.2026 [07:07],

Алексей Разин

Обычно участники рынка компьютерного оборудования дают прогнозы относительно динамики цен на память и сроков сохранения её дефицита, но основатель компании Dell Майкл Делл (Michael Dell) решил оценить прирост рынка памяти в течение первых пяти лет с момента появления ChatGPT. Он считает, что спрос на память с 2022 по 2028 годы вырастет в 625 раз.

Источник изображения: Dell Technologies Напомним, ChatGPT вышел на рынок осенью 2022 года, поэтому отсчёт влияния бума ИИ на рынок компонентов можно упрощённо начинать с 2023 года. Соответствующие высказывания, по данным PC Gamer, прозвучали из уст основателя Dell на конференции Bank of America. Он пояснил, что спрос на память генерируется не только в сегменте оперативной памяти для центральных процессоров, но и на направлении ускорителей на базе GPU. В совокупности, за первые пять или шесть лет ИИ-бума потребности отрасли в скоростной памяти вырастут в 625 раз. По крайней мере, если в 2022 году ускоритель Nvidia H100 оснащался 80 Гбайт памяти типа HBM3, то его преемник к 2028 году должен нести на борту уже 2 Тбайт памяти, как ожидает Майкл Делл. Это соответствует 25-кратному увеличению объёма памяти. Кроме того, сама по себе ёмкость рынка таких ускорителей на указанном интервале тоже вырастет в 25 раз. Перемножая оба значения, получим увеличение потребности рынка в скоростной памяти для GPU в те самые 625 раз. Впрочем, если опираться на более консервативный вариант характеристик ускорителей Vera Rubin, которые подразумевают наличие только 576 Гбайт памяти типа HBM4, то аналогичные арифметические действия приведут к росту спроса на память в 180 раз. Впрочем, оба варианта прогноза равноценно приводят к осознанию неизбежности дефицита памяти, поскольку объёмы её производства за это время не смогут пропорционально увеличиться. На память теперь уходит до 30 % расходов при создании ЦОД — в четыре раза больше, чем в 2023 году

03.04.2026 [20:41],

Николай Хижняк

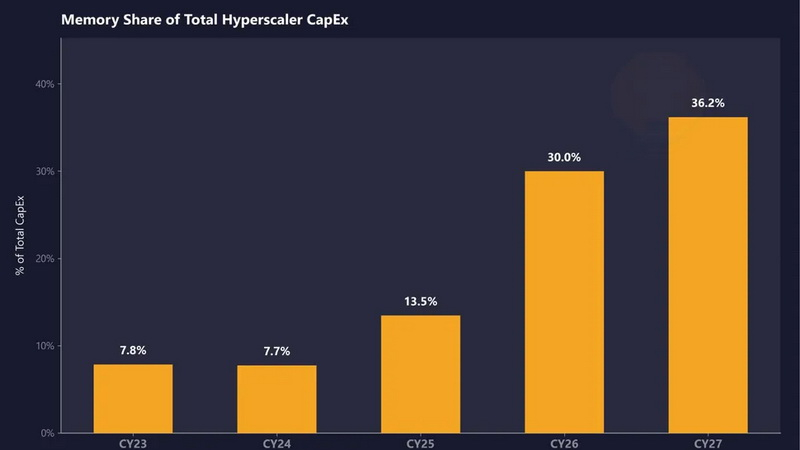

По оценкам аналитиков SemiAnalysis, на память будет приходиться примерно 30 % от общего объёма капитальных затрат крупных гиперскейлеров в 2026 году, что резко контрастирует примерно с 2023 и 2024 годами, когда на эту статью приходилось лишь около 8 % расходов. Эксперты прогнозируют дальнейший рост затрат на память в 2027 году, что ознаменует почти четырёхкратное увеличение цен всего за четыре года.

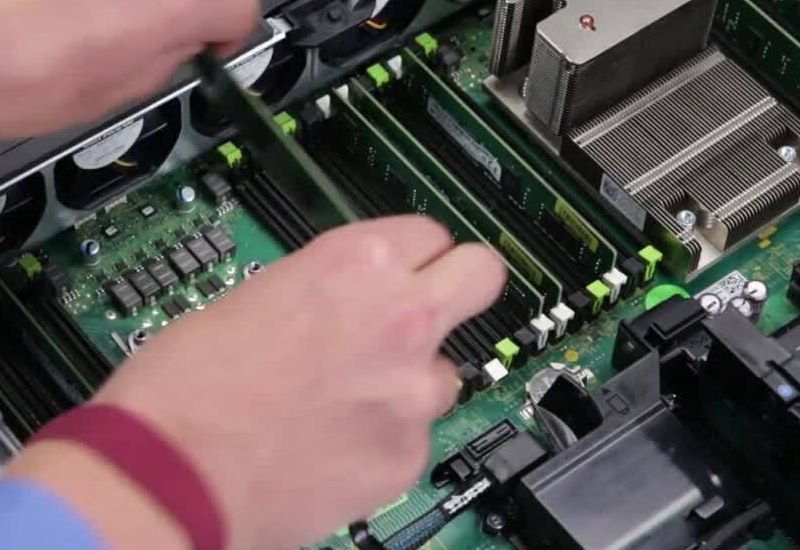

Источник изображения: SemiAnalysis SemiAnalysis ожидает, что цены на DRAM вырастут более чем вдвое в 2026 году, а средняя цена продажи (ASP) увеличится ещё на двузначное число процентов в 2027 году. Контрактные цены на память LPDDR5 уже выросли более чем в три раза с первого квартала 2025 года. По оценке аналитиков, цены на открытом рынке в этом квартале, вероятно, превысят $10 за Гбайт. Поставки высокопроизводительной памяти HBM, лежащей в основе ускорителей ИИ, по-прежнему будут испытывать дефицит до 2027 года, согласно прогнозам SemiAnalysis. Общие расходы на память составят значительную долю из примерно $250 млрд дополнительных затрат крупных гиперскейлеров, прогнозируемых на этот календарный год. Это уже отражается на ценах на серверы для ИИ: по данным SemiAnalysis, цены на ускорители Nvidia B200 к концу года вырастут до 20 %, в значительной степени из-за роста стоимости памяти. Данный анализ соответствует общему мнению в отрасли — ведущие производители компьютеров и серверного оборудования в ходе своих последних финансовых отчётов признали резкое увеличение стоимости компонентов. Например, Джефф Кларк (Jeff Clarke), операционный директор компании Dell, одного из крупнейших поставщиков компьютерного оборудования в мире, ещё по итогам третьего квартала прошлого года назвал темпы роста цен «беспрецедентными». Отдельно аналитики агентства Counterpoint Research прогнозируют, что модули памяти DDR5 объёмом 64 Гбайт RDIMM к концу 2026 года могут стоить вдвое дороже, чем в начале 2025 года. А серверы для ИИ, построенные на платформах Nvidia с поддержкой LPDDR, демонстрируют один из самых резких скачков цен из-за огромного объёма используемой памяти в каждой системе. В своём отчёте SemiAnalysis отмечает, что Nvidia пользуется преференциями при закупке памяти, поскольку поставщики предлагают компании так называемые VVP (Very Very Preferred) цены на DRAM. Эти цены «значительно ниже, чем озвучиваемые как для крупных облачных провайдеров, так и для рынка в целом». По мнению SemiAnalysis, это позволяет Nvidia снижать собственные затраты на серверы и в то же время занижает общие рыночные ценовые ориентиры, маскируя реальную серьёзность дефицита поставок для всех остальных. Основной конкурент Nvidia на рынке ИИ-ускорителей, компания AMD, таких преференций от поставщиков памяти не имеет, хотя в её ускорителях, как правило, на единицу продукта используется больше чипов памяти. AMD выпускает гораздо меньше ИИ-ускорителей, чем Nvidia, что делает её структурно более уязвимой к росту стоимости памяти в условиях гораздо меньшего масштаба производства процессоров для ИИ, говорится в отчёте. Другими словами, масштабы закупок Nvidia как HBM, так и обычной DRAM дают ей рычаги влияния, которыми покупатели с меньшим объёмом закупок просто не располагают. Micron обозначила сроки создания многоярусной памяти GDDR7

31.03.2026 [13:43],

Алексей Разин

Бум технологий искусственного интеллекта показал, что для разных вычислительных нагрузок требуется разная память. Производители последней экспериментируют с альтернативами дорогой HBM, и многоярусная GDDR7 может стать одной из них. Micron первые прототипы такой памяти надеется получить в следующем году, а к разработке и тестированию приступит в следующем полугодии.

Источник изображения: Micron Technology Исторически память типа GDDR использовалась видеокартами, но ускорители вычислений для систем искусственного интеллекта как раз оснащаются графическими процессорами в сочетании с более дорогой и сложной в производстве HBM. Нарастить удельный объём GDDR позволит увеличение количества ярусов в стеке, но даже при такой компоновке GDDR7 окажется дешевле HBM. Пропускная способность в первом случае также будет ниже, но для определённых задач типа инференса характеристик многоярусной GDDR7 должно вполне хватить. По уровню быстродействия многоярусная GDDR7 как раз расположится между классической GDDR и HBM. По сути, новый вид памяти можно будет применять и в игровых видеокартах, поэтому разработка Micron может быть востребована не только в сегменте инфраструктуры для ИИ. Помимо более низкой цены, многоярусная GDDR7 по сравнению с HBM будет использовать более простые технологии упаковки. Выпускать такую память можно будет в существенно больших количествах по сравнению с HBM. Если Micron преуспеет в создании такой памяти, она может занять доминирующие позиции в перспективном сегменте рынка. Стоимость одного гигабайта памяти многоярусной GDDR7 будет в десять или двадцать раз ниже, чем у HBM. При этом нельзя утверждать, что создание многоярусной GDDR7 окажется лёгкой задачей с технической точки зрения. Помимо поиска технологии соединения ярусов, нужно как-то решить проблему теплоотвода и возросшего энергопотребления. Важно сохранить ценовое преимущество при производстве такой памяти, иначе вся затея не оправдает себя. Выпуск DDR5 стал прибыльнее HBM для всех крупнейших производителей памяти

23.03.2026 [10:06],

Алексей Разин

В декабре прошлого года руководство Micron Technology призналось, что норма прибыли при выпуске классических типов DRAM, например, DDR5, оказалась выше обеспечиваемой при производстве HBM. Недавно он снова вернулся к этому тезису, говоря об итогах минувшего фискального квартала. Конкуренты располагают примерно такими же финансовыми показателями.

Источник изображения: Micron Technology По крайней мере, News 1 со ссылкой на руководство SK hynix сообщает, что обычная DDR уже обеспечивает норму прибыли в районе 80 %, тогда как при выпуске HBM она колеблется в районе 60 %. В прошлом квартале норма прибыли Micron в целом по компании выросла последовательно с 75 до 81 %, что также говорит о росте прибыльности бизнеса не только в сегменте HBM. Samsung на правах крупнейшего производителя памяти соответствующие тенденции прочувствовала ещё в конце прошлого года. Для выпуска HBM тоже требуются кристаллы DRAM, рост спроса на первый тип памяти первоначально вызывал рост цен на DDR5, поскольку последних чипов на рынке становилось меньше. В определённый момент производители бросились наращивать выпуск HBM в ущерб DDR5, поэтому цены на последнюю выросли до такого уровня, что сейчас её продавать выгоднее. Тем более, что затраты на выпуск DDR5 значительно ниже, чем в случае с HBM, а потому разница между доходами и расходами заметно больше, и прибыль растёт активнее. Южнокорейские производители опережают китайских в части технологий выпуска HBM примерно на три года, но если цены останутся на высоком уровне, то у китайских конкурентов появится определённый шанс закрепиться на международном рынке DDR. Правда, санкции США могут этому помешать, но китайские производители в любом случае заинтересованы в скорейшей организации массового выпуска HBM и экспансии производства DDR. В условиях дефицита памяти поставщики начали диктовать выгодные себе условия. Как уже отмечалось ранее, Samsung намеревается заключать со своими клиентами долгосрочные контракты на период от трёх до пяти лет, гарантируя поставку определённых объёмов продукции, но с привязкой цены к текущим уровням на рынке моментальных сделок. Кроме того, покупателям придётся сделать крупные авансовые платежи в пользу будущих поставок, и как они будут засчитываться, во многом будет зависеть от динамики рыночных цен. Micron со своими клиентами также заключает долгосрочные контракты, но они также охватывают и исследовательскую деятельность, поскольку будущие типы HBM, например, должны учитывать индивидуальные запросы конкретных клиентов, а потому соответствующую адаптацию памяти необходимо прописывать в договорах. Micron также сосредотачивается на комплексных поставках продукции для нужд ЦОД, которые охватывают DDR5 и HBM одновременно. Поскольку новые мощности по выпуску памяти будут введены в строй не ранее конца следующего года, при сохранении растущего спроса на микросхемы памяти будут увеличиваться и нормы прибыли производителей. Руководство SK hynix пытается найти инновационный подход к стабилизации цен на память, но удастся ли его реализовать, станет понятно в ближайшее время. Google благодаря ИИ-буму впервые вошла в пятёрку крупнейших клиентов Samsung

12.03.2026 [14:27],

Алексей Разин

Бум искусственного интеллекта меняет расстановку сил на многих рынках. Nvidia он позволил сместить Apple в статусе крупнейшего клиента TSMC, но и среди клиентов Samsung Electronics произошли некоторые перестановки. Ещё в прошлом году в пятёрку крупнейших клиентов южнокорейского гиганта впервые вошла корпорация Google, вытеснившая из этого перечня «долгожителя» в лице оператора связи Verizon.

Источник изображения: Samsung Electronics Помимо материнского холдинга Alphabet компании Google, в пятёрку крупнейших клиентов Samsung по итогам прошлого года вошли Apple, Deutsche Telekom, Techtronic Industries и Supreme Electronics. При этом сообща они определяли не более 15 % годовой выручки Samsung Electronics, которая достигла $228 млрд. Другими словами, концентрация источников выручки Samsung не так велика, как у некоторых прочих компаний сектора типа той же Nvidia или AMD, поэтому и риски корейского производителя чипов более уравновешены. По всей видимости, Google активно закупала у Samsung микросхемы памяти DDR5 и HBM для своих центров обработки данных. Google использует в своей инфраструктуре самостоятельно разработанные ускорители TPU, их она оснащает памятью HBM, поэтому и закупает её у Samsung. Предполагается, что в конце прошлого года Samsung поставляла более половины всей памяти HBM, используемой Google в составе ускорителей на базе чипов TPU. Apple остаётся как крупным клиентом Samsung, так и её конкурентом в сегменте смартфонов и прочих мобильных устройств. Это не мешает первой закупать у второй микросхемы типа LPDDR5X для смартфонов семейства iPhone 17 и их преемников. Предполагается, что и в первом складном смартфоне Apple будет использоваться память производства Samsung. В нынешних условиях затраты на покупку памяти определяют до 9 % себестоимости iPhone, и до 15 % себестоимости iPad и Mac, поэтому на поставках компонентов для нужд Apple компания Samsung может неплохо зарабатывать. Географическое распределение выручки Samsung также переживает трансформацию. Обе Америки в прошлом году формировали 39,9 % всей выручки южнокорейской компании, на этом направлении выручка выросла на 12,1 % до $90,2 млрд. Китай в долевом выражении просел с 14,6 до 14,2 %, но в абсолютном выражении выручка Samsung в этой стране выросла на 7,7 % по итогам прошлого года. На домашнем рынке Южной Кореи Samsung смогла увеличить свою выручку на 17,1 % до $31,6 млрд. SK hynix и SanDisk запустили стандартизацию High Bandwidth Flash — новой памяти между HBM и SSD

26.02.2026 [17:24],

Николай Хижняк

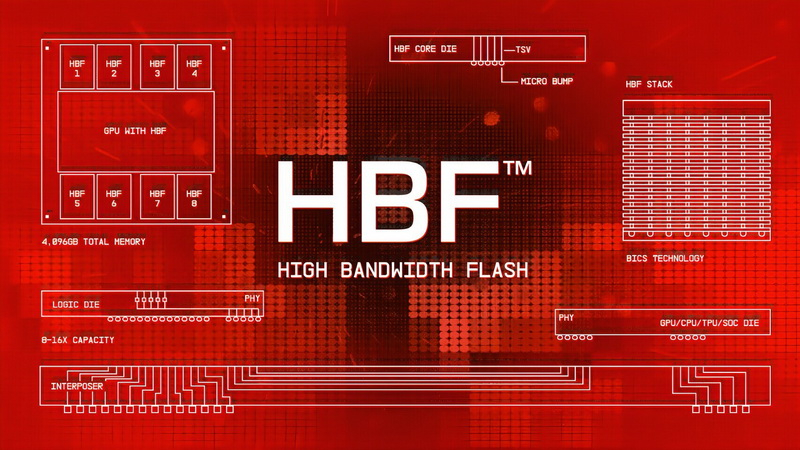

Компании SK hynix и SanDisk сообщили о запуске в рамках программы Open Compute Project проекта по глобальной стандартизации высокоскоростной флеш-памяти High Bandwidth Flash (HBF).

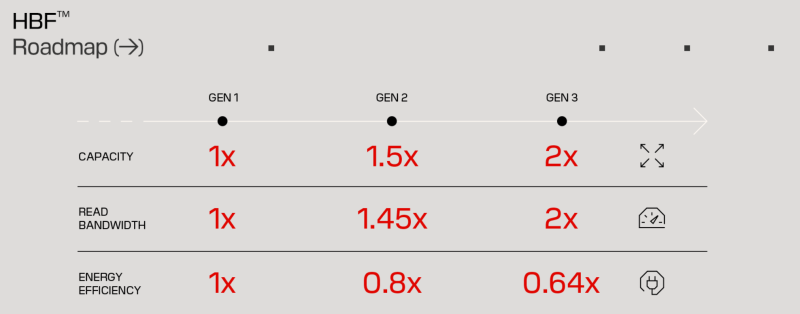

Источник изображений: SanDisk Компании описывают HBF как новый уровень памяти, располагающийся между сверхбыстрой памятью HBM и SSD. Технология HBF может заполнить пробел между высокой скоростью HBM и большой ёмкостью SSD, обеспечивая как расширение ёмкости, так и энергоэффективность, необходимые для выполнения задач искусственного интеллекта. В то время как HBM обеспечивает высокую пропускную способность, HBF выступает вспомогательным уровнем в архитектуре. SanDisk опубликовала информацию о том, как, по её мнению, будет выглядеть этот уровень HBF в составе аппаратного стека. Компания позиционирует HBF как память на основе NAND и утверждает, что она может обеспечить в 8–16 раз большую ёмкость, чем HBM, при аналогичной пропускной способности и сопоставимой стоимости в предполагаемой системной конфигурации. Для аппаратных решений первого поколения HBF SanDisk заявляет пропускную способность чтения до 1,6 Тбайт/с, 256 Гбит/с на кристалл и до 512 Гбайт общей ёмкости в рамках 16-кристального стека. Компания также утверждает, что стек разработан таким образом, чтобы максимально соответствовать HBM4 по физическим размерам, энергопотреблению и высоте, что подразумевает модель интеграции, аналогичную современным стекам HBM на ускорителях ИИ. SanDisk заявляет, что HBF обеспечивает производительность, отличающуюся всего на 2,2 % от «HBM с неограниченной ёмкостью» в ходе внутренних тестов и моделирования с использованием модели рабочей нагрузки для вывода данных, основанной на предварительно обученной 8-битной конфигурации параметров Llama 3.1 405B. В сноске к презентации отмечается, что сравнение предполагает неограниченную ёмкость HBM в целях моделирования, поэтому оно не измеряет преимущество в ёмкости напрямую. На фундаментальном технологическом уровне SanDisk связывает HBF со своей дорожной картой чипов BiCS NAND и технологией CBA (CMOS Direct Bonded to Array), а также с запатентованной технологией 3D-стекирования, предназначенной для 16-кристальных стеков с уменьшенной деформацией и лучшей теплопроводностью. В информационном листке также подчёркивается энергонезависимый характер HBF — она не требует питания для обновления данных, в отличие от памяти на основе DRAM.  В дорожной карте SanDisk также указаны предварительные целевые показатели пропускной способности чтения HBF второго (Gen2) и третьего (Gen3) поколений — свыше 2 Тбайт/с и 3,2 Тбайт/с соответственно — с ёмкостью стека до 1 Тбайт и 1,5 Тбайт, а также более низкие целевые показатели энергопотребления по сравнению с Gen1 — 0,8× и 0,64×. SK hynix и SanDisk не сообщили о графике внедрения HBF, но уже обозначили стандартизацию как следующий шаг в рамках программы Open Compute Project. SK hynix предложила неоригинальный костыль для ускорения ИИ-моделей — гибридную архитектуру памяти HBM/HBF

17.02.2026 [19:52],

Геннадий Детинич

Светлая мысль разместить больше памяти рядом с процессором пришла не в одну голову. Год назад о разработке концепции замены памяти HBM (DRAM) памятью HBF (флеш) сообщила компания SanDisk. На днях работу о таком подходе опубликовала компания SK Hynix. Флеш-память NAND попросту плотнее памяти DRAM, и с позиции увеличения места под токены для ИИ замена одной на другую даст впечатляющий результат в виде роста скорости принятия решений.

Источник изображения: SK Hynix Не секрет, что современные платформы на базе центральных, графических и тензорных процессоров сталкиваются с серьёзным ограничением по объёму приданной им памяти High Bandwidth Memory (HBM), что сплошь и рядом происходит при работе с большими языковыми моделями. Например, модели вроде Llama 4 поддерживают до 10 млн токенов, что требует кэш объёмом до 5,4 Тбайт. Стандартные решения, такие как частичный сброс кэша на локальные SSD, приводят к значительным задержкам из-за низкой пропускной способности шины и медленного доступа к накопителям. В результате образуется узкое место по пропускной способности, что можно обойти только наращиванием массива ускорителей, а это — лишние деньги и энергопотребление. Предложенная компанией SK hynix гибридная иерархия памяти или архитектура H³ (Hybrid³), объединяющая HBM и новый пока тип памяти High Bandwidth Flash (HBF) на одном интерпозере вместе с процессором, решает проблему нехватки памяти для токенов ИИ. Память HBM продолжит использоваться так же, как и раньше — для данных с высокой частотой записи и чтения (динамически генерируемый кэш), а HBF — для данных с интенсивным чтением. Использование флеш-памяти HBF обеспечит до 16 раз большую ёмкость при пропускной способности, близкой к HBM, хотя задержка доступа останется выше на один или даже два порядка, износостойкость будет ниже, а энергопотребление может быть в 4 раза больше. В то же время массив гибридной памяти окажется единым для процессора, а грамотная маршрутизация запросов сведёт на нет все негативные последствия «тормозов» флеш-памяти. Результаты моделирования на конфигурации Nvidia Blackwell GPU с 8 стеками HBM3E и 8 стеками HBF на интерпозере демонстрируют впечатляющие улучшения. При 1 млн токенов контекста производительность в токенах в секунду вырастает в 1,25 раза, при 10 млн токенов — уже в 6,14 раза по сравнению с чисто HBM-системой, а энергоэффективность становится выше в 2,69 раза. И если раньше для обработки запросов такого масштаба требовалось 32 GPU, то теперь работа может быть выполнена всего на 2 GPU с существенным снижением энергозатрат и общей стоимости системы. Ради такого стоит рискнуть и создать коммерческие решения, считают в компании. Intel при поддержке SoftBank готова начать выпуск альтернативы памяти HBM к 2029 году

03.02.2026 [13:25],

Алексей Разин

При всей своей востребованности, память типа HBM не является идеальной, поскольку остаётся дорогой и прожорливой, а ещё из-за наращивания объёмов её производства страдает выпуск классической DRAM. Компании SoftBank и Intel намерены наладить серийное производство памяти нового типа ZAM к 2029 году.

Источник изображения: Intel Непосредственно на стороне SoftBank за разработку Z-Angle Memory (ZAM) будет отвечать дочерняя компания Saimemory, она же будет отвечать за продажи готовой продукции, а Intel поделится технологиями производства и упаковки данной памяти. Само по себе обозначение Z-Angle говорит о намерениях разработчиков нарастить высоту памяти по координате Z. По сути, она по примеру HBM будет представлять собой стек из нескольких ярусов микросхем, но будет использовать более прогрессивные методы упаковки и более эффективную архитектуру. Теоретически, это должно позволить увеличить удельную ёмкость стека памяти ZAM в два или три раза относительно HBM, при этом вдвое сократить энергопотребление, а себестоимость производства удержать либо на том же уровне, либо снизить на 40 %. По предварительным данным, Intel готова предложить для производства ZAM технологию упаковки памяти NGDB, которая повысит энергетическую эффективность относительно HBM. Помимо базового кристалла, в стеке существующих прототипов имеются восемь ярусов DRAM. В производстве память типа ZAM будет проще HBM, поэтому масштабировать объёмы её выпуска удастся достаточно быстро. Прототипы таких микросхем будут продемонстрированы партнёрами до конца марта 2028 года. В течение последующих 12 месяцев должно быть развёрнуто массовое производство нового типа памяти. С японской стороны в проекте также участвует компания Fujitsu. Оперативная память DDR5 и DDR4 подорожает вдвое в этом квартале, а NAND — на 60 %

02.02.2026 [15:37],

Алексей Разин

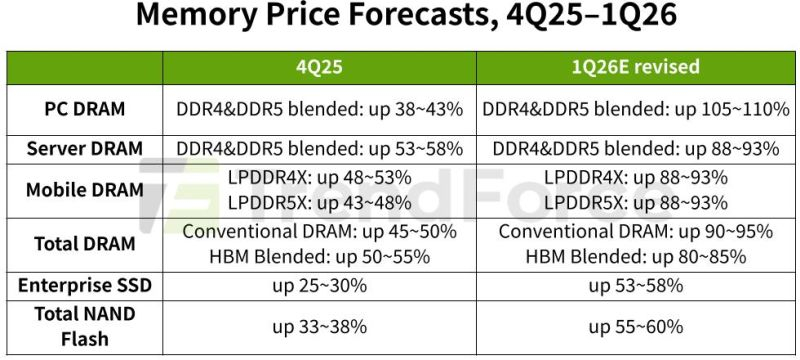

С наступлением февраля эксперты TrendForce пришли к выводу, что сформированный ими в четвёртом квартале прогноз по динамике цен на микросхемы памяти не отображает реальной ситуации на рынке, а потому его следует скорректировать в сторону повышения, причём весьма заметно. Теперь ожидается, что DDR5 и DDR4 в этом квартале последовательно подорожает в два раза, а цены на NAND увеличатся на 55–60 %.

Источник изображения: SK hynix Драйвером роста цен, по словам источника, остаётся высокий спрос на компоненты со стороны облачных провайдеров и серверного сегмента. Если ранее специалисты TrendForce ожидали, что в текущем квартале цены на DDR4 и DDR5 последовательно вырастут на 55–60 %, то теперь они призывают готовиться к росту на 90–95 %. Соответственно, в сегменте NAND последовательный рост цен пересмотрен с 33–38 % на 55–60 %. Не исключено, что это не последняя корректировка прогноза в сторону увеличения, поскольку ситуация меняется стремительно. В четвёртом квартале, как отмечают в TrendForce, объёмы поставок ПК превысили ожидания, а потому дефицит памяти усилился и за счёт этого фактора. В текущем квартале цены на DDR4 и DDR5 для персональных компьютеров последовательно вырастут более чем на 100 %, обновив квартальный рекорд по величине прироста.

Источник изображения: TrendForce В серверном сегменте покупатели пытаются формировать долгосрочные контракты с поставщиками, которые подразумевают более стабильную ценовую политику, но и здесь цены последовательно готовы вырасти на 90 % в текущем квартале, если говорить о DRAM, и это тоже окажется максимальным приростом за всю историю наблюдений. Серверные SSD в этом квартале также подорожают, пусть и на более скромные 53–58 %, хотя и это станет квартальным рекордом. На такую величину около 90 % вырастут и цены на память типов LPDDR4X и LPDDR5X, усложнив жизнь производителям смартфонов. Китайские марки будут формировать новые контракты на закупку памяти в конце февраля, поэтому можно ожидать новой волны подорожания в этот период. В сегменте NAND предложение продолжает сжиматься, поскольку многие крупные производители предпочитают переориентировать больше своих мощностей на выпуск DRAM. Всё это способствует росту цен на твердотельную память, хотя в этом квартале прирост и ограничится величиной от 55 до 60 %, что выглядит не таким резким на фоне динамики рынка DRAM. Дополнительные объёмы выпуска NAND в краткосрочной перспективе могут быть получены только за счёт модернизации используемых техпроцессов. Если цены на классическую DRAM в целом в этом квартале последовательно увеличатся на 90–95 %, то с учётом HBM прирост достигнет 80–85 %. Прежде аналитики TrendForce ожидали, что в этом квартале цены на память с учётом HBM увеличатся лишь на 50–55 %. По сути, HBM в отдельности дорожает медленнее, чем классическая DRAM. SK hynix на фоне бума ИИ впервые обошла Samsung по величине годовой прибыли

01.02.2026 [11:45],

Алексей Разин

Исторически именно Samsung Electronics на протяжении многих лет то и дело становилась крупнейшим поставщиком полупроводниковых компонентов в мире в показателях выручки. SK hynix, которая контролирует более 60 % рынка HBM, уже обходила Samsung по квартальной прибыли, но по итогам прошлого года впервые сделала это с учётом 12-месячного периода в целом.

Источник изображения: SK hynix Об этом позволяет судить опубликованная на уходящей неделе финансовая статистика Samsung Electronics и SK hynix, на которую ссылается издание CNBC. Именно высокая степень присутствия SK hynix в прибыльном сегменте HBM позволила компании в прошлом году получить операционную прибыль, превосходящую достижения Samsung Electronics — в целом более крупной компании. По версии Gartner, крупнейшим поставщиком полупроводниковой продукции в мире теперь является Nvidia, за ней следует Samsung, а SK hynix именно по итогам прошлого года поднялась с четвёртого места на третье, выгнав Intel из первой тройки. В национальной южнокорейской валюте операционная прибыль SK hynix за прошлый год достигла 47,2 трлн вон ($32,5 млрд), тогда как Samsung Electronics довольствовалась 43,6 трлн вон ($30 млрд). Кстати, если выделить операционную прибыль Samsung именно в сфере производства памяти, то она окажется заметно меньше предыдущей суммы — всего 24,9 трлн вон ($17,2 млрд). При этом SK hynix практически полностью концентрируется на производстве памяти, тогда как Samsung является многопрофильным холдингом. Впрочем, последняя из компаний тоже не обошлась без прогресса, ведь по итогам четвёртого квартала прошлого года в отдельности ей снова удалось стать лидером по выручке от реализации памяти. Аналитики также ожидают, что Samsung удастся укрепить свои позиции в сегменте памяти для систем ИИ после начала поставок HBM4, хотя SK hynix и сохранит за собой лидерство в этой сфере. Как ожидается, заказы Nvidia на оснащение ускорителей Vera Rubin памятью HBM4 примерно на две трети будут выполняться силами SK hynix. В третьем квартале SK hynix контролировала около 57 % выручки в сегменте HBM, на долю Samsung приходилось не более 22 %. Позиции SK hynix сильны и в более широком сегменте DRAM, который сейчас также переживает трансформацию в связи с бурным развитием инфраструктуры ИИ. Памяти не будет ещё долго: Micron признала, что «беспрецедентный» дефицит выйдет за пределы 2026 года

19.01.2026 [13:26],

Алексей Разин

Американский производитель памяти в условиях дефицита продукции ведёт себя сообразно ситуации. С одной стороны, нужды потребительского рынка он в свете прекращения поставок модулей памяти под маркой Crucial он готов обслуживать в минимальной степени. С другой стороны, компания вкладывается в расширение своих производственных мощностей. При этом текущим годом период дефицита памяти не ограничится, как считают в Micron.

Источник изображения: Micron Technology Исполнительный вице-президент по операционной деятельности Micron Technology Маниш Бхатиа (Manish Bhatia) в интервью Bloomberg после церемонии закладки фундамента крупного производственного комплекса в штате Нью-Йорк сообщил, что «текущий дефицит, который наблюдается, является беспрецедентным». По его словам, память типа HBM для ЦОД потребляет так много ресурсов промышленности, что возникает огромный дефицит на стороне классических сегментов рынка типа смартфонов и ПК. И если производители последних выстраиваются в очередь, чтобы уже сейчас забронировать поставки памяти на период после 2026 года, то в дальнейшем спрос на память будет расти и со стороны автомобильных систем автопилота и человекоподобных роботов. В сегменте ИИ, как ранее отмечали представители Micron, все квоты памяти этой марки выкуплены клиентами на весь текущий год. Недавние шаги по покупке предприятия у PSMC на Тайване, по словам исполнительного вице-президента Micron, были направлены на скорейший ввод новой площадки по упаковке памяти в строй. Она сможет приступить к обработке продукции со второй половины следующего года. Все вновь возводимые Micron предприятия по выпуску памяти будут введены в строй значительно позже. В штате Нью-Йорк это случится не ранее 2030 года, а вот первое предприятие в Айдахо сможет начать работу уже в 2027 году. Всего в штате будет построено два предприятия по выпуску памяти и исследовательский центр. Кроме того, Micron модернизирует и расширяет завод в Вирджинии. В любом случае, все новые мощности Micron будет вводить в строй на территории США, а азиатские площадки будут повышать производительность за счёт модернизации и перехода на более совершенные технологии изготовления памяти. В перспективе компания хотела бы 40 % своей памяти типа DRAM выпускать на территории США. «Отец HBM» пообещал внедрение энергонезависимой HBF-памяти в продуктах Nvidia и Google уже в 2027 году

16.01.2026 [22:01],

Анжелла Марина

По мере роста вычислительной нагрузки, связанной с задачами искусственного интеллекта, эксперты прогнозируют коммерциализацию технологии энергонезависимой памяти High-Bandwidth Flash (HBF) раньше, чем ожидалось. Об этом сообщает компания TrendForce, специализирующаяся на аналитике и консалтинге в сфере полупроводников, IT и телекоммуникационных технологий.

Источник изображения: SanDisk Профессор из корейского передового института науки и технологий (KAIST) Чонхо Ким (Joungho Kim), которого называют «отцом HBM», заявил, что Samsung Electronics и SanDisk планируют внедрить HBF в продукты для Nvidia, AMD и Google уже к концу 2027 или началу 2028 года. Он также отметил, что разработка HBF идёт быстрее, поскольку производители уже используют накопленный опыт проектирования и технологических процессов для разработки новой памяти. Ким также прогнозирует, что широкое распространение HBF начнётся одновременно с выходом стандарта HBM6, а к 2038 году рынок этой памяти может даже превзойти сегмент HBM. Он объясняет, что необходимость в новой технологии обусловлена физическими ограничениями ёмкости DRAM, и поскольку HBM6 будет представлять собой сложную структуру из взаимосвязанных стеков, многокристальная флеш-память HBF (NAND) станет необходимым решением для восполнения дефицита объёма памяти в будущих вычислительных системах. Профессор также поясняет, что в задачах ИИ-инференса HBF в будущем возьмёт на себя роль поставщика данных для видеокарт, обеспечив примерно в 10 раз большую ёмкость, чем HBM, хотя и с меньшей скоростью. Так как HBF имеет неограниченное количество циклов чтения, но всего около 100 000 циклов записи, это потребует от разработчиков программного обеспечения, включая OpenAI и Google, адаптации своих решений под преимущественное чтение данных. Кроме того, Ким предвидит смену архитектуры вычислительных систем к моменту выхода стандарта HBM7: концепция «фабрики памяти» позволит обрабатывать данные непосредственно в модулях памяти, устранив существующие длинные пути передачи информации через сети хранения и процессорные конвейеры. По оценкам отраслевых источников, HBF сможет обеспечить пропускную способность свыше 1638 Гбайт/с, что существенно превышает показатели стандартных SSD, которые через интерфейс NVMe PCIe 4.0 выдают около 7000 Мбайт/с, а также достичь ёмкости до 512 Гбайт, превосходя 64 Гбайт, предлагаемых HBM4. Samsung и SK hynix также продвигают разработку HBF и уже заключили соглашение с SanDisk о создании консорциума для стандартизации памяти HBF, намереваясь вывести коммерческие продукты на рынок к 2027 году. При этом SK hynix планирует продемонстрировать пробную версию технологии уже в текущем месяце. |