|

Опрос

|

реклама

Быстрый переход

Sony хотела похвастаться ИИ-камерой Xperia 1 VIII, но получила волну мемов

15.05.2026 [23:36],

Николай Хижняк

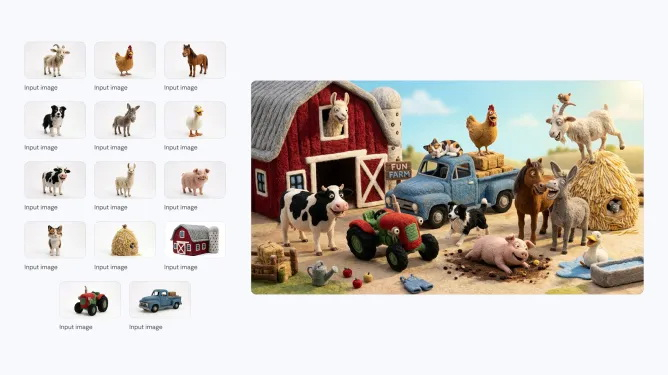

Компанию Sony затроллили в социальных сетях за работу ИИ-алгоритма камеры AI Camera Assistant нового флагманского смартфона Xperia 1 VIII. Пользователи соцсети X публикуют мемы и фотографии «до и после» вслед за публикацией японским гигантом рекламных изображений работы AI Camera Assistant, которые оказались менее качественными, чем оригиналы снимков без обработки.

Источник изображений: X (бывший Twitter) На фоне шуточных сообщений пользователей Sony впоследствии уточнила, что искусственный интеллект предлагает «креативные варианты оформления», а не автоматическую обработку изображений. Компания опубликовала официальное заявление, где пояснила особенность работы новой ИИ-функции камеры: «В продолжение публикации об AI Camera Assistant мы хотели бы подробнее рассказать об этой функции. Она не редактирует фотографии после съёмки, а предлагает четыре варианта настроек в разных творческих направлениях в зависимости от сцены и объекта. Вы можете выбрать любой вариант или использовать свои собственные настройки». Компания сопроводила сообщение примерами изображений, на которых ИИ-алгоритм предлагает пользователю выбрать наиболее подходящий вариант обработки снимка: Всё началось с публикации сравнения (изображения ниже), в котором Sony пыталась подчеркнуть возможности искусственного интеллекта в Xperia 1 VIII. Как ни странно, оригинальные фотографии (слева) оказались более сбалансированы по экспозиции и имели более естественные тени, в то время как версии с обработкой ИИ (справа) выглядели сильно переэкспонированными, с пересвеченными участками и блеклыми цветами. Реакция сообщества в соцсети X была быстрой и беспощадной. Поднялась такая волна критики, что генеральный директор компании Nothing Карл Пей (Carl Pei) присоединился к полемике и даже задался вопросом, не является ли это завуалированной накруткой интереса к устройству со стороны самой Sony. Вместо того чтобы просто критиковать результаты, пользователи X превратили ситуацию в полноценный мем. Возник целый тренд: пользователи начали делиться своими примерами фотографий «до и после», специально редактируя снимки «после» так, чтобы они выглядели, будто только что произошла ядерная вспышка. Один пользователь опубликовал фотографию фиолетовых цветов, где «отредактированная» версия представляет собой пустой белый квадрат. Другой поделился сравнением портретов, где версия, созданная с помощью ИИ, настолько яркая, что черты лица человека на снимке сливаются с фоном. Между тем многие создатели контента о технологиях оказались озадачены (на самом деле нет) результатами работы ИИ-алгоритмов Sony. Они начали ретвитить фотографии и задаваться вопросом, настоящие ли они. Будь то техническая ошибка при выборе изображений отделом маркетинга или продуманный ход для привлечения внимания, Xperia 1 VIII может стать самым обсуждаемым телефоном недели, хотя, возможно, и не по тем причинам, которые предполагала Sony. Уход Sora открыл дорогу конкурентам: ИИ-генераторы видео Kling AI и AI Video ворвались в топы Apple App Store

13.05.2026 [18:53],

Дмитрий Федоров

Два приложения для создания видео с помощью ИИ — Kling AI и AI Video — поднялись на пятое и шестое места в рейтинге самых скачиваемых бесплатных приложений Apple App Store. Оба лидируют в своих категориях: Kling AI заняло первую строчку в «Графике и дизайне», AI Video — в «Фото и видео». Их рост начался спустя два месяца после закрытия видеосервиса Sora компании OpenAI. Оба приложения выигрывают от нового всплеска внимания пользователей iPhone к ИИ-генерации видео.

Источник изображений: apps.apple.com OpenAI свернула Sora главным образом из-за стоимости обслуживания: бесплатный сервис потреблял слишком много ресурсов. Компания сосредоточилась на ChatGPT и Codex — инструментах для повышения продуктивности, причём Codex лучше раскрывается на платных тарифах.

AI Video - AI Video Generator После ухода Sora конкурирующие ИИ-приложения стали активнее продвигать генерацию видео. Gemini и Grok уже позволяют превращать текстовые запросы и изображения в ролики, однако для этих универсальных чат-ботов видео остаётся лишь одной из возможностей.

Kling AI: AI Image&Video Maker Kling AI и AI Video целиком посвящены созданию роликов. Kling AI появилось в App Store три месяца назад. AI Video выпущено компанией HUBX, у которой в магазине размещено 15 ИИ-приложений. Новое приложение нацелено на создание вирусных видеороликов. Выше обоих в рейтинге стоят только продукты OpenAI, Anthropic, Google и Meta✴✴. Sora тоже возглавляла чарт при запуске, но через несколько месяцев перестала показывать заметные результаты. TSMC и Sony объединились для разработки и производства датчиков изображения

08.05.2026 [13:42],

Владимир Мироненко

Компании TSMC и Sony Semiconductor Solutions («дочка» Sony Group) объявили о планах создания нового совместного предприятия в Японии для разработки и производства датчиков изображения следующего поколения.

Источник изображения: Sony Новое СП, контрольный пакет акций в котором будет принадлежать Sony, создаст линии разработки и производства на новом заводе японской компании в Коси, в префектуре Кумамото (Япония). Его создание позволит объединить опыт Sony в проектировании датчиков с производственными и технологическими преимуществами TSMC, углубив давнее партнёрство двух компаний. Сообщается, что компании подписали необязывающий меморандум о взаимопонимании (MOU) и обсуждают потенциальные инвестиции со стороны СП при условии заключения окончательного соглашения. Эти инвестиции, наряду с капитальными затратами Sony на существующем заводе в Нагасаки, будут осуществляться поэтапно в соответствии с рыночным спросом при условии поддержки со стороны правительства Японии. Партнёрство также будет направлено на изучение и освоение новых возможностей в области применения ИИ в таких сферах, как автомобилестроение и робототехника. У компаний уже есть совместное предприятие Japan Advanced Semiconductor Manufacturing (JASM), созданное в 2021 году, контрольным пакетом акций которого владеет TSMC. Его первый завод в Японии запустил серийное производство в конце 2024 года. Генераторы изображений стали главным драйвером роста ИИ-чат-ботов

05.05.2026 [11:50],

Павел Котов

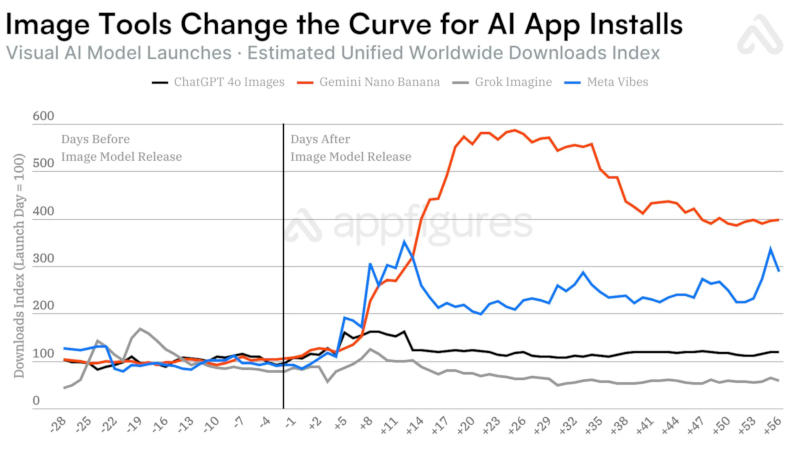

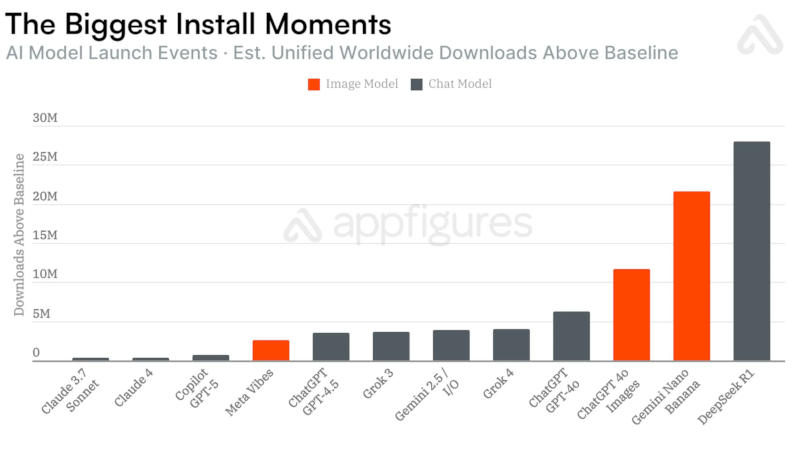

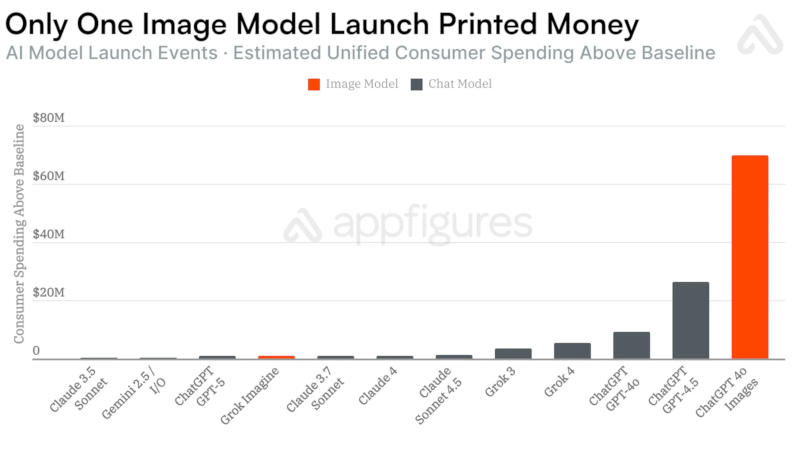

Выпуск моделей с генераторами изображений стимулирует увеличение популярности мобильных приложений с искусственным интеллектом — рост по сравнению с простыми обновлениями ускоряется в 6,5 раза, показала статистика аналитической компании Appfigures.

Источник изображения: Milad Fakurian / unsplash.com Для OpenAI ChatGPT и Google Gemini появление генераторов изображений увеличивало аудиторию на десятки миллионов пользователей. В течение 28 дней после выхода генератора изображений Nano Banana с чат-ботом Gemini 2.5 Flash приложение набрало 22 млн новых пользователей, что соответствует росту числа загрузок более чем вчетверо за указанный период.  В случае генератора изображений в составе OpenAI GPT-4o рост аудитории составил 12 млн человек — в 4,5 раза быстрее по сравнению с базовым вариантом GPT-4o, а также GPT-4.5 и GPT-5. Аналогичная тенденция сработала и с появлением ленты Vibes в приложении Meta✴✴ AI, хотя оно предлагало генерацию не изображений, а видео — нововведение дало 2,6 млн дополнительных загрузок.  К сожалению для разработчиков, росту числа загрузок не всегда сопутствует рост выручки: в случае с Nano Banana компания Google заработала лишь на $181 тыс. больше; приложение Meta✴✴ AI с появлением Vibes существенного роста дохода не показало; и только в случае OpenAI модель GPT-4o с генератором изображения помогла компании нарастить выручку на $70 млн за 28 дней.  Единственным исключением из правил оказался взрывной рост в 28 млн загрузок с выходом модели DeepSeek R1, отметили в Appfigures. Всё потому, объясняют аналитики, что компания DeepSeek сама по себе стала мировой сенсацией из-за уникальных методов обучения ИИ с минимальными затратами по сравнению с конкурентами — генератора изображений в приложении не было. OpenAI выпустила ИИ-модель ChatGPT Images 2.0, которая отлично генерирует текст на картинках

22.04.2026 [06:26],

Дмитрий Федоров

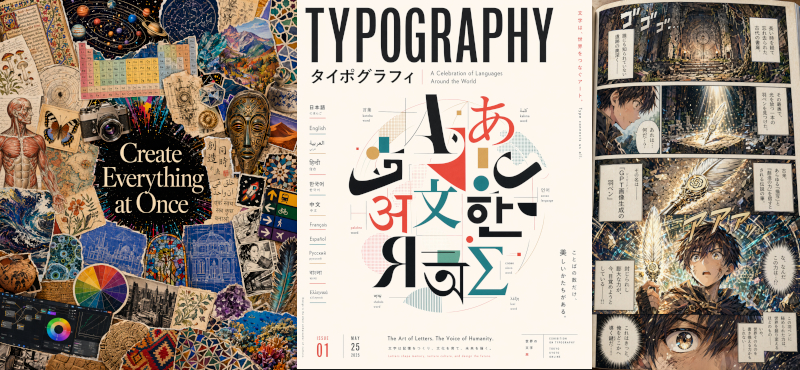

OpenAI представила модель генерации изображений ChatGPT Images 2.0, которая впервые среди массовых ИИ корректно отрисовывает текст на картинках. Если два года назад диффузионные ИИ-модели не могли составить меню мексиканского ресторана без выдуманных слов вроде «enchuita» и «burrto», то новая модель создаёт изображения с надписями, пригодными к использованию без правок.  Ещё в 2024 году диффузионные ИИ-модели систематически искажали надписи. По словам Асмелаша Тека Хадгу (Asmelash Teka Hadgu), основателя и гендиректора Lesan AI, модели восстанавливают изображение из шума и усваивают паттерны, покрывающие основную массу пикселей, а текст занимает ничтожную долю площади.

Слева — меню, сгенерированное ChatGPT Images 2.0: все надписи читаемы, ни одного выдуманного слова. Справа — три варианта от Microsoft Designer на основе DALL-E 3: «Enchidas», «Tamrielo», «Churiros», «Margartas» и десятки других искажений. Источник изображений: ChatGPT Images 2.0, Microsoft Designer (DALL-E 3) / techcrunch.com С тех пор исследователи опробовали альтернативные подходы — в частности, авторегрессионные модели, которые предсказывают содержание изображения и работают по принципу, близкому к большим языковым моделям (LLM). OpenAI не раскрыла, какая архитектура лежит в основе Images 2.0. Компания пояснила лишь, что новинка умеет «рассуждать» — искать информацию в интернете, генерировать несколько изображений по одному запросу и перепроверять результаты. Благодаря этому Images 2.0 создаёт маркетинговые материалы в разных размерах и даже комиксы. У ИИ-модели также улучшена работа с нелатинскими шрифтами — японским, корейским, хинди и бенгальским. Однако знания Images 2.0 ограничены декабрём 2025 года, что может сказаться на точности генерации по запросам о недавних событиях.

Источник изображения: ChatGPT Images 2.0 / openai.com «Images 2.0 выводит детализацию и точность генерации на беспрецедентный уровень. Модель способна продумать сложную композицию и воплотить её на практике: следовать инструкциям, сохранять заданные детали и отрисовывать элементы, на которых обычно спотыкаются генераторы, — мелкий текст, пиктограммы, элементы интерфейса, насыщенные композиции и тонкие стилистические ограничения, — и всё это в разрешении до 2K», — говорится в пресс-релизе компании. Генерация при этом занимает больше времени, чем обычный текстовый запрос к ChatGPT, но даже многопанельный комикс укладывается в несколько минут.

Источник изображения: ChatGPT Images 2.0 / openai.com Доступ к Images 2.0 получат все пользователи ChatGPT и Codex. Платные подписчики смогут генерировать более сложные изображения. OpenAI также откроет программный интерфейс (API) gpt-image-2 — стоимость будет зависеть от качества и разрешения выходных изображений. Microsoft представила облегчённый ИИ-генератор изображений MAI-Image-2-Efficient

15.04.2026 [14:50],

Павел Котов

Microsoft анонсировала обновлённую версию модели искусственного интеллекта, которая генерирует изображения по текстовым запросам, — она получила название MAI-Image-2-Efficient. Она и её предшественница MAI-Image-2 генерируют качественные фотореалистичные картинки, при этом новая работает на 22 % быстрее и вчетверо эффективнее.

Источник изображения: BoliviaInteligente / unsplash.com В марте Microsoft запустила на платформах Copilot, Bing Image Creator и MAI Playground генератор изображений MAI-Image-2, который занял в рейтинге Arena.ai третье место среди себе подобных. Недавно компания расширила доступ к ней, добавив её на платформу Foundry наряду с MAI-Voice-1 и MAI-Transcribe-1. Обновлённая MAI-Image-2-Efficient создана для случаев, когда необходимо нечто быстрое, масштабируемое и не влекущие неоправданных расходов ресурсов. Если не требуется высокая точность изображений, MAI-Image-2-Efficient оказывается оптимальным вариантом — она пригодится для генерации иллюстраций в соцсетях, создания макетов-заглушек и миниатюр продуктов; то есть в тех случаях, когда скорость и объём контента важнее пиксельной точности. Microsoft MAI-Image-2, напротив, проявляет себя во всей красе, когда востребован, например, качественный портрет героя, кинематографическая сцена и внимание к деталям, а аспект скорости отходит на второй план. Обновлённая MAI-Image-2-Efficient по ряду параметров превосходит не только предшественницу от самой Microsoft, но также работает на 40 % быстрее таких систем как Google Gemini 3.1 Flash, Gemini 3.1 Flash Image и Gemini 3 Pro Image. Разработчики уже могут подключать MAI-Image-2-Efficient на платформах Microsoft Foundry и MAI Playground. Стоимость её работы составляет $5 за 1 млн входящих и $19,50 за 1 млн выходящих токенов — для сравнения, стоимость использования MAI-Image-2 составляет $5 и $33 соответственно. Скоро MAI-Image-2-Efficient появится в Copilot, Bing и на других платформах. В Южной Корее разработан сверхтонкий модуль камеры с углом зрения 140 градусов

13.04.2026 [08:47],

Алексей Разин

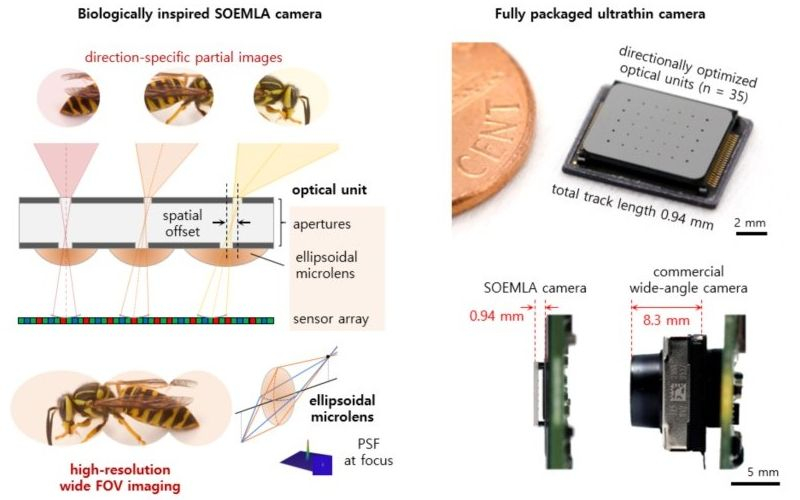

Габариты современных цифровых камер, встраиваемых в смартфоны, имеют некоторые ограничения, поэтому той же Apple при разработке сверхтонкого iPhone Air пришлось довольствоваться единственной камерой с тыльной стороны устройства. Южнокорейские разработчики недавно предложили создать камеру с углом обзора 140 градусов, которая в толщину занимает менее 1 мм.

Источник изображения: Apple Южнокорейских учёных из KAIST вдохновила природа. Принцип устройства инновационной камеры для мобильных устройств был подсмотрен у насекомых с их фасеточным зрением. Большой угол зрения достигается комбинацией нескольких компактных линз, создающих общую картину окружающего пространства из фрагментов, напоминающих мозаику. При этом в отличие от традиционных широкоугольных камер, которые размывают картинку на периферии, камера SOEMLA сохраняет чёткость картинки по всему диапазону углов обзора. С точки зрения компоновки она обладает весьма компактными размерами, выступая над поверхностью печатной платы всего на 0,94 мм. Обычные широкоугольные камеры могут выступать на 8,3 мм.

Источник изображения: KAIST, Digital Trends Помимо смартфонов и различных типов носимых устройств, такие камеры можно использовать в медицинском диагностическом оборудовании типа тех же эндоскопов. Впрочем, под вопросом пока остаётся способность такой камеры снимать видео в высоком разрешении или передавать детали изображения в условиях низкой освещённости. Кроме того, пока не уточняется, сколько подобные камеры будут стоить в условиях массового производства, и каким образом сочетаться с другими компонентами электронных устройств. Microsoft представила MAI-Image-2 — ИИ-генератор изображений, который оказался неожиданно хорош в фотореализме и инфографике

21.03.2026 [12:07],

Владимир Фетисов

В октябре прошлого года Microsoft представила ИИ-модель для генерации изображений MAI-Image-1, которая заняла девятое место рейтинга на платформе Arena.ai. Теперь же софтверный гигант объявил о запуске алгоритма второго поколения MAI-Image-2, способного создавать изображения с более естественным освещением, точной передачей тонов кожи и реалистичными деталями. Эта версия ИИ-модели поднялась на третью строчку рейтинга Arena.ai.

Источник изображения: microsoft.ai Microsoft существенно улучшила возможности модели в плане корректного отображения текста на генерируемых изображениях. За счёт этого алгоритм лучше подходит для создания инфографики, слайдов, диаграмм и др. Microsoft заявила, что MAI-Image-2 лучше справляется с генерацией кинематографичных и гипердетализированных изображений, включая сюрреалистические концепции, замысловатые композиции и фантастические миры. «Вышел наш новый генератор изображений MAI-Image-2! Он уже доступен на MAI Playground для создания всего: от фотореализма до детализированной инфографики. Наша команда приложила невероятные усилия для этого релиза», — написал в соцсети X глава ИИ-подразделения Microsoft Мустафа Сулейман (Mustafa Suleyman). В рейтинге на платформе Arena.ai MAI-Image-2 занимает третье место. Лидерами остаются алгоритмы Google gemini-3.1-flash-image-preview и OpenAI gpt-image-1.5-high-fidelity. Пользователи Copilot и Bing Image Creator смогут задействовать модель MAI-Image-2 в ближайшее время. В настоящее время алгоритм доступен через платформу MAI Playground, а разработчик могут получить доступ к модели через соответствующий API на Microsoft Foundry. AMD выпустила FSR 4.1 с улучшенной детализацией и плавностью изображения — но только для Radeon RX 9000

20.03.2026 [14:47],

Николай Хижняк

Компания AMD выпустила обновлённую технологию ИИ-масштабирования FSR 4.1. Она входит в состав свежего графического драйвера Radeon Software Adrenalin Edition 26.3.1. Последний среди прочего обеспечивает поддержку игры поддержку Crimson Desert. Разработчик игры Pearl Abyss сообщает, что она вышла сегодня во всём мире, а версия для ПК поддерживает технологии FSR 3/4, а также AMD FSR Ray Regeneration.

Источник изображений: VideoCardz / AMD По словам AMD, обновление FSR Upscaling 4.1 улучшает работу функции масштабирования на основе машинного обучения, обеспечивая более высокую детализацию, более плавное движение камеры и более эффективную работу в режиме Ultra Performance Mode. Ходили слухи, что AMD может внедрить поддержку FSR 4 для более старых графических архитектур. Однако в последнем драйвере чётко указана поддержка FSR 4.1 только для видеокарт серии Radeon RX 9000.  Ведущий архитектор PS5 и PS5 Pro Марк Черни (Mark Cerny) отметил выпуск FSR 4.1 на своей странице в соцсети X, обратив внимание на то, что в основе технологии лежит та же нейронная сеть, что и в обновлённом апскейлере PSSR 2 для игровой консоли PlayStation 5 Pro. О выпуске технологии ИИ-масштабирования PlayStation Spectral Super Resolution (PSSR 2) компания Sony сообщила ранее на этой неделе. ИИ-генератор изображений Adobe Firefly теперь можно обучать на своих работах

19.03.2026 [18:18],

Владимир Фетисов

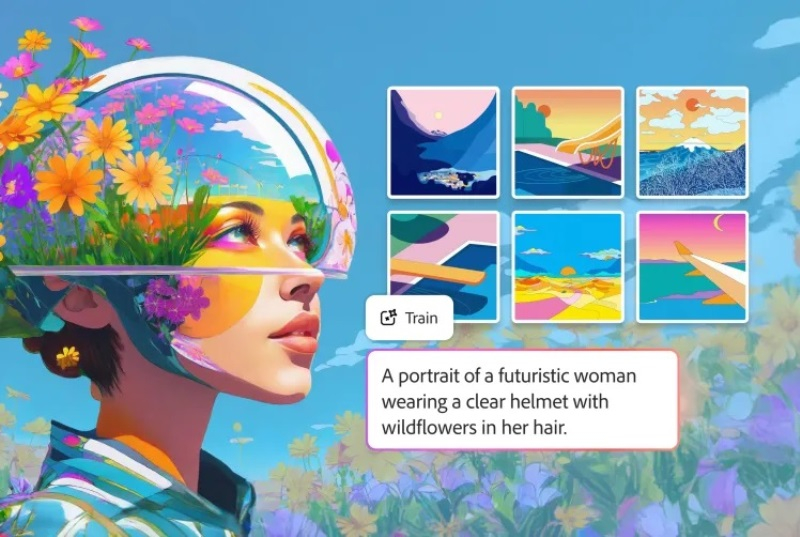

Adobe объявила о запуске настраиваемых ИИ-генераторов изображений, которые могут имитировать определённые художественные стили и дизайны персонажей. Модели Firefly Custom Models стали доступны в рамках публичного бета-тестирования, благодаря чему творческие люди и компании могут обучить ИИ-модели на собственных работах. За счёт этого генерируемые изображения будут соответствовать единой эстетике персонажей, иллюстраций и фотографий.

Источник изображения: Adobe Ожидается, что такой подход позволит оптимизировать рабочие процессы создателей контента, которым требуется выполнять большие объёмы работ, за счёт сохранения визуальной согласованности в разных проектах, вместо того, чтобы каждый раз начинать всё с нуля. По данным Adobe, пользовательские ИИ-модели позволят сохранять разные детали, такие как толщина штрихов, цветовые гаммы, освещение и черты персонажей при генерации новых изображений. По умолчанию пользовательские модели являются частными, поэтому используемые для их обучения материалы не будут применяться для обучения общих языковых моделей Adobe Firefly. «Чтобы развивать бренд, вам нужен постоянный поток материалов, которые будут последовательно выражать вашу сущность. Эти материалы должны быть вашими и только вашими. После обучения ваша пользовательская модель становится частью вашего рабочего процесса. Вы можете генерировать новые идеи, соответствующие вашей эстетике, повторно использовать модель в разных проектах, брифингах и кампаниях, а также создавать контент в масштабе, не теряя того, что отличает вашу работу», — говорится в пресс-релизе Adobe. Google представила Nano Banana 2 — обновлённый генератор изображений работает быстрее и качественнее, и доступен бесплатно

26.02.2026 [20:49],

Николай Хижняк

Компания Google анонсировала последнюю версию своей популярной ИИ-модели для генерации изображений — Nano Banana 2. Новая модель, которая технически является аналогом Gemini 3.1 Flash Image, способна создавать более реалистичные изображения по сравнению с предшественницей. Nano Banana 2 станет моделью по умолчанию в приложении Gemini для режимов Fast, Thinking и Pro, то есть новинка будет доступна и бесплатным пользователям.

Источник изображений: Google Компания впервые выпустила Nano Banana в августе 2025 года. Она быстро завоевала популярность среди пользователей Gemini, особенно в таких странах, как Индия. В ноябре Google представила Nano Banana Pro, позволяющую создавать более детализированные и высококачественные изображения. Новая Nano Banana 2 сохраняет ряд характеристик высокой детализации версии Pro, но генерирует изображения быстрее. С её помощью можно создавать изображения с разрешением от 512 пикселей до 4K и с различными соотношениями сторон.  Nano Banana 2 поддерживает единообразие персонажей (до пяти) и точную проработку до 14 объектов в одном рабочем процессе, что улучшает возможности повествования. По словам Google, пользователи могут отправлять сложные запросы с подробными нюансами для генерации изображений. Кроме того, модель позволяет создавать медиаконтент с более ярким освещением, насыщенными текстурами и чёткими деталями.  С запуском Nano Banana 2 станет моделью по умолчанию для генерации изображений во всех приложениях Gemini. Компания также сделает её моделью по умолчанию для генерации изображений в своём инструменте для редактирования видео Flow. В 141 стране Nano Banana 2 станет моделью по умолчанию в Google Lens и в режиме поиска с ИИ в мобильной и веб-версии Google Search. Пользователи тарифных планов Google AI Pro и Ultra смогут продолжать использовать Nano Banana Pro для специализированных задач, выбрав соответствующую настройку через меню с тремя точками. Для разработчиков Nano Banana 2 будет доступна в режиме предварительного просмотра через API Gemini, Gemini CLI и Vertex API. Она также появится в AI Studio и инструменте разработки Antigravity, выпущенном в ноябре прошлого года.  Google заявляет, что все изображения, созданные с помощью новой модели, будут иметь водяной знак SynthID — фирменный маркер для обозначения изображений, сгенерированных искусственным интеллектом. Изображения также совместимы с системой C2PA Content Credentials, которая подтверждает происхождение контента и фиксирует, подвергался ли он изменениям. Систему поддерживают Adobe, Microsoft, Google, OpenAI и Meta✴✴. Google сообщила, что с момента запуска проверки SynthID в приложении Gemini в ноябре ей воспользовались более 20 млн раз. «Блокнот» всё больше превращается в WordPad — теперь Microsoft добавила поддержку изображений

20.02.2026 [20:03],

Сергей Сурабекянц

Издание Windows Latest сообщило, что Microsoft добавляет поддержку изображений в «Блокнот» для Windows 11. Осведомлённые источники сообщают, что эта функция станет частью уже внедрённой поддержки форматирования текста и окажет «минимальное влияние» на производительность. Пользователи смогут отключить её в настройках приложения.

Источник изображения: Microsoft «Блокнот» больше не является тем простым, быстрым и доступным текстовым редактором, каким пользователи знали его на протяжении почти четверти века. Похоже, что Microsoft старательно наделяет его новыми функциями, которые должны компенсировать удаление WordPad из операционной системы Windows. В отличие от «Блокнота», WordPad всегда поддерживал изображения и другие функции форматирования текста. Фактически, во многих отношениях WordPad ощущался как упрощённая версия Word, в то время как Блокнот оставался простым текстовым редактором. Теперь, после исчезновения WordPad, Microsoft пытается заполнить образовавшуюся пустоту и добавляет новые функции в «Блокнот». Так, недавно компания добавила поддержку языка разметки текста Markdown. С его помощью можно выделять текст жирным шрифтом или курсивом, а также вставлять ссылки в «Блокнот», что уже привело к появлению уязвимости в этом текстовом редакторе. После недавнего обновления участники программы Windows Insider могли заметить новую кнопку на панели инструментов «Блокнота». Она отображается только в диалоговом окне «Что нового», которое появляется при первой установке приложения или применении одного из последних обновлений. В данный момент эта кнопка не активна, но появление ярлыка изображения в рекламных материалах — не ошибка. Поддержка изображений в «Блокноте» уже тестируется и в ближайшие месяцы следует ожидать её появления в новых сборках Windows 11. Как и остальные параметры форматирования, поддержка изображений будет включена по умолчанию, но пользователь сможет отключить её в настройках. ИИ-бот Duck.ai от DuckDuckGo научился редактировать изображения по текстовым описаниям

20.02.2026 [09:33],

Владимир Фетисов

В конце прошлого года DuckDuckGo реализовала в своём приватном ИИ-боте Duck.ai функцию генерации изображений на основе текстовых описаний. Теперь же разработчики объявили о внедрении возможности редактирования изображений посредством запросов к нейросети. Задействовать нововведение можно бесплатно и без регистрации аккаунта, но оформившие подписку пользователи получат расширенные ежедневные лимиты.

Источник изображения: 9to5mac.com Пользователь может начать взаимодействие с редактором изображений в Duck.ai нажатием кнопки «Новое изображение» в боковом меню чат-бота или же просто перетащив изображение в формате JPEG, JPG, PNG или WebP в поле для ввода запроса. После этого останется лишь описать изменения, которые следует внести, а всё остальное сделает ИИ-сервис, работающий на основе большой языковой модели от OpenAI. Как и в случае генерации изображений, при редактировании картинок все метаданные обрабатываемого изображения, а также IP-адрес пользователя, удаляются до того, как запрос передаётся в OpenAI. В DuckDuckGo отметили, что ещё одним положительным моментом в плане конфиденциальности является то, что загруженные изображения хранятся локально на устройстве для обеспечения высокого уровня приватности пользователей. В компании напомнили, что Duck.ai является отдельной от основной поисковой системы DuckDuckGo платформой. При этом пользователи, которые по каким-то причинам не хотят использовать ИИ-функции, могут задействовать поисковый интерфейс без ИИ, расположенный по адресу noai.duckduckgo.com. Не так давно компания провела опрос, показавший, что подавляющее большинство респондентов не хочет добавлять ИИ-функции в свои поисковые инструменты. В ответ на это компания прилагает усилия, чтобы подчеркнуть, что каждая предлагаемая ею ИИ-функция является опциональной, и разработчики по-прежнему поддерживают взятый ранее курс на обеспечение конфиденциальности пользователей. Nvidia выпустит динамическую мультикадровую генерацию и режим MFG x6 уже весной

06.02.2026 [12:39],

Николай Хижняк

Nvidia выпустит новую технологию динамического мультикадрового генератора (Dynamic Multi Frame Generation) и мультикадрвый генератор с режимом x6 весной этого года. Об этом в разговоре с журналистами немецкого портала HardwareLuxx рассказал представитель компании.

Источник изображений: Nvidia На выставке CES 2026 в начале января Nvidia представила динамическую многокадровую генерацию Dynamic Multi Frame Generation как режим, управляемый драйвером, который стремится к обеспечению заданной пользователем частоты обновления монитора, а не использует фиксированный множитель, как обычный многокадровый генератор. Например, для дисплея с частотой обновления 240 Гц требуется, чтобы видеокарта обеспечивала всего 240 кадров в секунду. Статический многокадровый генератор может превысить это целевое значение, обеспечивая, например, 280 или 300 кадров в секунду в зависимости от сцены, тратя на это дополнительные ресурсы. С помощью динамической многокадровой генерации драйвер может переключаться между множителями в зависимости от нагрузки на графическую систему при той или иной игровой сцене. Он может включать как множитель x6 в более ресурсоёмких участках, так и снижать его до x3 или x2 при снижении нагрузки. Множитель может меняться постоянно. В рамках демонстрации, с которой ознакомился HardwareLuxx, не было отмечено никаких проблем даже при частом переключении. «Технология динамического мультикадрового генератора, а также новый режим x6 для многокадрового генератора Nvidia запланированы на весну 2026 года», — пишет HardwareLuxx. Nvidia уже предлагает функцию мультикадрового генератора (Multi Frame Generation, MFG) для владельцев видеокарт GeForce RTX 50-й серии. Она генерирует до трёх промежуточных кадров между двумя реальными. Это даёт четырёхкратный прирост производительности по сравнению с апскейлингом без генерации. Компания Intel недавно выпустила аналогичную технологию в составе программного пакета XeSS 3, но её официальная поддержка пока осуществляется только для встроенной графики процессоров Panther Lake. У AMD нет аналога мультикадрового генератора — компания предлагает технологию AMD Fluid Motion Frames (AFMF), которая генерирует только один промежуточный кадр между двумя реальными. Firefly без ограничений: Adobe сняла лимиты на ИИ-генерацию изображений и видео, но не навсегда

02.02.2026 [19:35],

Сергей Сурабекянц

Adobe предоставит подписчикам своего ИИ-сервиса Firefly неограниченное количество генераций изображений и видео как с использованием собственных, так и поддерживаемых сторонних моделей ИИ. Ежемесячные кредиты на генерацию изображений и видео будут отменены для новых подписчиков, которые зарегистрируются в системе до 16 марта.

Источник изображения: Adobe Firefly — это набор генеративных моделей Adobe для создания изображений и видео. В него входят как собственные модели Adobe, так и интеграции со сторонними сервисами, такими как Google Nano Banana Pro, OpenAI GPT-Image 1.5 и Runway Gen-4. После первоначального запуска Firefly в составе пакета приложений Creative Cloud, Adobe выпустила Firefly как отдельную платформу, доступную в браузере или через специальные приложения на мобильных платформах. Подписчики Adobe Firefly могут выбрать один из нескольких тарифных планов. До сих пор одним из ключевых отличий было количество кредитов на создание изображений, включённых в каждый тарифный план. Но с сегодняшнего дня Adobe предлагает при оформлении подписки генерацию неограниченного количества изображений и видео. Важно отметить, что предложение действительно только для отдельной подписки Adobe Firefly, а не для подписок Creative Cloud. «Зарегистрируйтесь до 16 марта и получите неограниченное количество поколений изображений и видео Firefly с разрешением до 2K в приложении Adobe Firefly. Предложение распространяется на клиентов, использующих тарифные планы Firefly Pro, Firefly Premium, а также планы на 4000, 7000 и 50 000 кредитов, и включает неограниченное количество генераций с использованием ведущих в отрасли моделей изображений, включая Google Nano Banana Pro, GPT Image Generation, Runway Gen-4 Image, а также коммерчески безопасные модели изображений и видео Firefly от Adobe», — заявила Adobe. По данным Adobe, 86 % создателей контента теперь используют ИИ в своей повседневной работе. Кроме того, за последний год длина их запросов удвоилась. Это свидетельствует о том, что создатели контента всё чаще используют ИИ как часть своих рабочих процессов. Компания отмечает, что сегодняшний шаг направлен на то, чтобы помочь создателям оставаться в творческом потоке, проходя через процесс проб и ошибок, не беспокоясь о своих кредитах на создание изображений. Adobe также сообщила, что в преддверии Дня святого Валентина и Лунного Нового года пользователи по всему миру получат возможность использовать собственные модели, а также интеграцию Firefly со сторонними сервисами, чтобы протестировать платформу. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |