|

Опрос

|

реклама

Быстрый переход

Gigabyte представила мощный ноутбук Gaming A18 Pro с GeForce RTX 5080 для игр и ИИ

23.04.2026 [13:25],

Павел Котов

Gigabyte представила игровой ноутбук Gaming A18 Pro, который отличают тонкий корпус, крупный 18-дюймовый дисплей, поддержка функций искусственного интеллекта и производительные компоненты.

Источник изображений: gigabyte.com Ноутбук Gigabyte Gaming A18 Pro работает на мощной платформе, способной справляться с ресурсоёмкими задачами: это, в частности, процессор Intel Core 7 240H и мобильная дискретная видеокарта Nvidia GeForce RTX 5080. Данные компоненты обеспечивают ноутбуку возможность запускать передовые игры, но также он подойдёт для создания контента и рабочих задач с использованием функций ИИ.  Показатель TGP составляет 115 Вт, что означает стабильную производительность графики даже при длительном использовании компьютера. В наличии интеллектуальная система охлаждения Windforce Infinity EX с двумя вентиляторами и поддержкой технологии 3D VortX, которая обеспечивает трёхмерное распределение воздушных потоков. При небольшой загрузке ноутбук Gigabyte Gaming A18 Pro включает тихий режим — до 0 дБ. Под востребованными в играх клавишами «WASD» есть своя зона охлаждения.  Компьютер комплектуется предустановленным ИИ-помощником GiMATE — управление режимами производительности, питания и подсветки может осуществляться посредством голосовых команд; для выхода на максимальную производительность доступно быстрое переключение MUX Switch. Рутинные настройки GiMATE осуществляет самостоятельно, освобождая от них пользователя.  18-дюймовый экран Gigabyte Gaming A18 Pro отличают разрешение 2,5K, частота обновления 165 Гц, время отклика 3 мс и до 100 % охвата цветового пространства DCI-P3. Предусмотрена поддержка Dolby Atmos. Эргономичная клавиатура Golden Curvature имеет ход клавиш 1,7 мм; корпус обладает толщиной всего 20 мм; а экран может раскрываться на 180°. В Samsung и Noôdome обсудили перспективы ИИ в бизнесе

23.04.2026 [12:57],

Павел Котов

Представители Samsung совместно с сообществом Noôdome провели мероприятие «Наука и ИИ: технологический рубикон и новые инструменты для бизнеса», на котором обсудили перспективы внедрения технологий искусственного интеллекта в бизнес.

Источник изображения: news.samsung.com Одним из наиболее важных аспектов отрасли ИИ сегодня является успех открытых платформ, способных преобразить деятельность человека: после внедрения ИИ в научный процесс начнётся развёртывание этих решений в практических областях — в промышленности, экономике и госуправлении. Каждому специалисту станут доступны простые в обращении, но точные в работе инструменты, отметил академик РАН Арутюн Аветисян. Руководители компаний ожидают, что ИИ поможет снизить затраты, но при этом повысит качество и ценность продукта — эти эффекты уже наблюдаются в сфере IT. Производительность труда здесь, по ощущениям разработчиков, с появлением ИИ выросла на 20–30%, но на практике подтверждается прирост на 2–4 %. Важнее смена качества рабочих процессов: ИИ берет на себя рутинные задачи, а у человека высвобождаются ресурсы для творческого направления. Повышается качество тестирования, а с ним — и готового продукта, обратила внимание руководитель образовательных проектов Кампуса инноваций Samsung Светлана Юн. Нельзя пренебрегать и аспектами безопасности, которые в мире с ИИ выходят за рамки киберугроз. Так, при работе систем автопилота по-прежнему требуется присутствие человека за рулём, способного в экстренной ситуации перехватить управление. Участие человека может понадобиться и при подтверждении транзакций через биометрию — он сможет подтвердить, что доступ к системе не пытается получить дипфейк. Технологии ИИ востребованы и в обучении, но молодым специалистам необходим практический опыт. Работодатели всё меньше заинтересованы в начинающих инженерах, которые, в свою очередь, без практики не смогут вырасти до «мидлов» и «сениоров». ИИ обещает трансформировать и систему среднего образования. Уже сейчас он способен выполнять задачи ассистента учителя, помощника, подсказчика для учащегося. Кроме того, школа должна выполнять функцию социального и ценностного центра, а не только проводника информации. Google превратила Chrome в «автоматический браузер» — полноценного работника среды Workspace

23.04.2026 [12:36],

Павел Котов

Google рассказала о планах превратить Chrome в «автоматический браузер» для корпоративных пользователей, способный принять на себя часть их рабочих задач, а также повысить безопасность. «Автоматический браузинг» на основе помощника с искусственным интеллектом Gemini предусматривает анализ контекста в открытых вкладках браузера и совершение различных действий: бронирование при планировании поездок, ввод данных, составление расписания встреч и решение прочих задач, связанных с работой в интернете. Так, проанализировав файл в «Google Документах», браузерный ИИ-агент сможет самостоятельно внести информацию в CRM-систему; сравнить цены от поставщиков, чьи сайты открыты в соседних вкладках; извлечь ключевые данные со страницы конкурентов и сделать многое другое. Рабочие процессы по-прежнему потребуют участия человека — перед принятием окончательного решения пользователю придётся проверять данные и подтверждать ввод. Но и в этом виде, уверены в Google, система поможет ускорить выполнение однообразных утомительных задач, оставив человеку только «стратегическую работу». На начальном этапе новая функция будет доступна только пользователям сервисов Workspace в США. Её можно будет активировать с помощью средств настройки групповой политики; подчёркивается, что запросы сотрудников организаций не будут использоваться для обучения ИИ. Рабочие процессы, которые используются наиболее часто, можно будет сохранять в качестве «навыков» (Skills). Ещё одно важное нововведение — обнаружение несанкционированных инструментов ИИ на рабочем месте с помощью Chrome Enterprise Premium. Это могут быть скомпрометированные расширения браузера или другие сервисы ИИ, в том числе «аномальная активность агентов». Примечания к выпуску Chrome Enterprise будет дополнять служба «Сводка Gemini» (Gemini Summary) — она даст пояснения по критически важным изменениям, новыми политикам и прекращению поддержки отдельных инструментов, а также рекомендации по настройке новых параметров и проверке находящихся под управлением браузеров. Кроме того, расширится партнёрство с Okta в сфере обеспечения безопасности — новые функции помогут снизить угрозу перехвата сессий и обеспечат другие меры защиты; появится интеграция с Microsoft Information Protection (MIP), которая поможет организациям обеспечивать соблюдение согласованных политик безопасности. OpenAI добавила в ChatGPT ИИ-агентов для бизнеса — они выполняют задачи без участия человека

23.04.2026 [12:16],

Анжелла Марина

OpenAI предоставила пользователям тарифных планов Business, Enterprise, Edu и Teachers доступ к новым облачным ИИ-агентам, способным самостоятельно выполнять рабочие задачи. Эти помощники, по сообщению The Verge, интегрируются в ChatGPT и могут функционировать в качестве автономных сотрудников внутри корпоративной среды.

Источник изображения: AI Основное назначение рабочих агентов (workspace agents) заключается в автоматизации рутинных процессов, например, таких, как сбор отзывов о продуктах в глобальной сети или подготовка электронных писем в Gmail. OpenAI продемонстрировала, как бот самостоятельно находит информацию и отправляет готовый отчёт в Slack. Работает это в целом так: бот собирает контекст из нужных источников, следуя установленным в команде регламентам, и затем запрашивает одобрение перед совершением важных действий. При этом компании могут создавать таких агентов один раз и затем совместно использовать их в общем рабочем пространстве, постепенно улучшая их навыки. The Verge отмечает, что разработка новой системы велась на фоне усиления конкуренции на рынке ИИ-агентов, в частности, после успеха проекта OpenClaw, основатель которого, Питер Штайнбергер (Peter Steinberger), теперь работает в OpenAI. В то же время компания сталкивается с давлением со стороны Anthropic, которая уже предлагает аналогичные инструменты для работы с файлами пользователя, а также отдельную платформу для создания автономных агентов. Внедрение рабочих агентов, как пишет The Verge, может сигнализировать о конце GPTs — кастомных пользовательских чат-ботов, анонсированных OpenAI в 2023 году. Компания называет новых помощников эволюцией GPTs и утверждает, что GPTs останутся доступными, пока команды тестируют рабочих агентов на своих предприятиях. Сообщается, что в ближайшее время OpenAI также упростит конвертацию старых GPTs в новых рабочих ИИ-агентов. Робот впервые начал обыгрывать профессионалов в настольный теннис — это Ace от Sony

23.04.2026 [12:01],

Владимир Мироненко

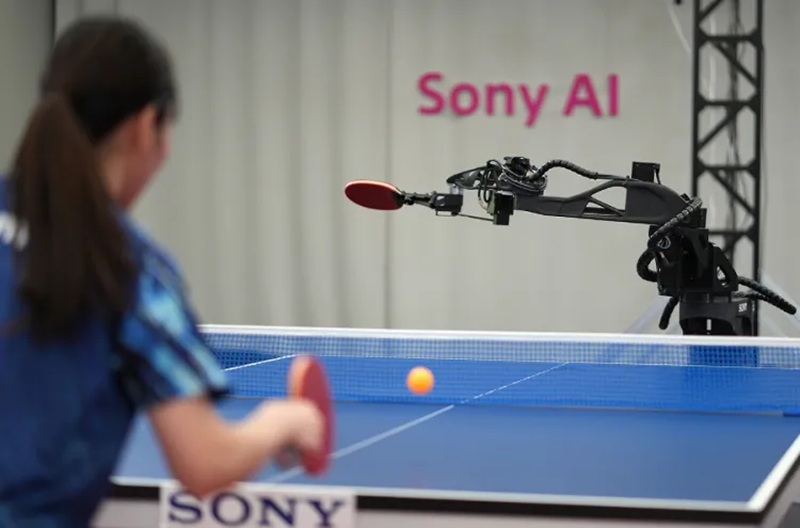

Созданный компанией Sony робот Ace стал первым, который оказался способен на равных сражаться в настольный теннис с игроками высокого класса и даже побеждать в матчах, проводимых по официальным правилам Международной федерации настольного тенниса (ITTF), сообщил ресурс Reuters со ссылкой на исследование, опубликованное в журнале Nature.

Источник изображения: Sony AI «В отличие от компьютерных игр, где предыдущие системы ИИ превосходят экспертов-людей, физические виды спорта, такие как настольный теннис, и игры в реальном времени остаются серьёзной нерешенной проблемой из-за требований к быстрому, точному и враждебному взаимодействию вблизи препятствий и на грани времени реакции человека», — сообщил автор исследования Петер Дюрр (Peter Dürr), директор Sony AI Zurich и руководитель проекта Ace в подразделении Sony AI. Он добавил, что целью проекта было не только научить робота игре, но и получить представление о том, как роботы могут воспринимать, планировать и действовать с человекоподобной скоростью и точностью в динамичной среде. Исследователи разработали роботизированную платформу с восемью суставами: три — для контроля положения ракетки, два — для её ориентации и три — для обеспечения скорости и силы удара. Координированные действия робота обеспечивает сложная система технического зрения, состоящая из девяти традиционных камер, окружающих стол, которые могут определять положение мяча в трёхмерном пространстве, и трёх «систем управления взглядом», измеряющих угловую скорость и вращение мяча, чтобы точно рассчитать его траекторию. Согласно исследованию, во время тестовых матчей в апреле 2025 года робот выиграл три из пяти матчей против элитных игроков (спортсменов с более чем 10-летним стажем тренировок) и проиграл два матча профессиональным игрокам, регулярно выступающим в профессиональных лигах. Маюка Таира (Mayuka Taira), профессиональная теннисистка, проигравшая матч роботу в декабре прошлого года, заявила, что его сильные стороны заключаются в том, что его действия очень трудно предугадать, и он не проявляет эмоций. «У Ace есть сверхчеловеческая способность считывать вращение входящих мячей и сверхчеловеческая скорость реакции. Поскольку он учится играть, не наблюдая за игрой людей, а тренируется самостоятельно в симуляции, он также реагирует иначе, чем игроки-люди, и создает неожиданные ситуации», — отметил Дюрр. «В то же время профессиональные спортсмены очень хорошо умеют адаптироваться к сопернику и находить его слабые места, и это та область, над которой мы работаем», — добавил он. Microsoft упустила Cursor — разработчик ИИ-помощника программиста уйдёт к SpaceX за $60 млрд

23.04.2026 [11:33],

Дмитрий Федоров

Microsoft рассматривала покупку Cursor — ИИ-стартапа в области программирования, который в итоге достанется SpaceX. Возглавляемая Илоном Маском (Elon Musk) SpaceX на этой неделе объявила о намерении приобрести Cursor за $60 млрд. Microsoft изучала подобную сделку, но решила не делать предложение.

Источник изображения: cursor.com Microsoft пытается повысить популярность своих ИИ-инструментов, чтобы не отстать на стремительно растущем рынке ИИ. Хотя компания укрепила позиции среди разработчиков благодаря ИИ-помощнику GitHub Copilot, рынок ИИ-инструментов для программирования сейчас возглавляют Cursor, Claude Code и Codex. Роль самой Microsoft в этом сегменте сводится к функциям инвестора и облачного провайдера: корпорация вложила миллиарды долларов в Anthropic и OpenAI, которые взяли на себя обязательства по расходам на её облачной платформе Microsoft Azure. SpaceX опубликовала во вторник в соцсети X сообщение о договорённости приобрести Cursor за $60 млрд до конца года. В противном случае компания выплатит стартапу $10 млрд. «SpaceX и Cursor тесно сотрудничают, чтобы создать лучший в мире ИИ для программирования и интеллектуальной работы», — говорилось в публикации. Гендиректор Cursor Майкл Труэлл (Michael Truell) написал в X, что «рад партнёрству с командой SpaceX для масштабирования Composer» — ИИ-модели компании. Соглашение со SpaceX оформилось на последнем этапе раунда, в который Cursor привлекал венчурное финансирование при оценке в $50 млрд, — потенциальные инвесторы узнали о сделке уже постфактум, рассказал один из источников. CNBC сообщал об этом раунде в начале месяца, указывая на стремительный рост спроса на ИИ-инструменты для создания веб-сайтов и разработки приложений. За несколько недель до этого SpaceX предлагала Cursor доступ к своим вычислительным мощностям, а по сути готовила почву для соглашения. В феврале Маск объединил SpaceX со своим ИИ-стартапом xAI в рамках сделки, оценённой в $1,25 трлн. Объединённую компанию он готовит к выходу на биржу, и это может стать рекордным первичным размещением акций (IPO). Акции Microsoft с начала года подешевели на 10 %, что хуже показателей других гиперскейлеров. В январе гендиректор Сатья Наделла (Satya Nadella) сообщил аналитикам, что у GitHub Copilot 4,7 млн платных подписчиков, что на 75 % больше, чем годом ранее. OpenAI продвигает собственное приложение для программирования Codex: гендиректор Сэм Альтман (Sam Altman) написал в X, что у сервиса 4 млн активных пользователей, причём отметку в 3 млн Codex преодолел менее чем двумя неделями ранее. Claude Code компании Anthropic стремительно набрал популярность в этом году и помог компании выйти на $30 млрд годовой выручки в этом месяце. Anthropic обогнала OpenAI — по оценке на вторичном рынке акций, которая взлетела до $1 трлн за три месяца

23.04.2026 [10:33],

Дмитрий Федоров

Оценка Anthropic на внебиржевом рынке акций непубличных компаний достигла $1 трлн — против $380 млрд три месяца назад и выше, чем у OpenAI, которая оценивается в $880 млрд. Однако предложение иссякает: один акционер выставил пакет акций по цене $1,15 трлн, но крупный фонд заявил о готовности купить бумаги по $1,05 трлн, при этом покупатели перехватывают сделки в течение суток.

Источник изображения: anthropic.com Генеральный директор Forge Global Келли Родригес (Kelly Rodriques) сообщил, что оценка Anthropic на платформе сегодня превышает $1 трлн, а OpenAI торгуется по $880 млрд — незначительно выше уровня мартовского раунда. Поскольку обе компании ещё не вышли на биржу, большинство инвесторов вынуждены покупать бумаги на внебиржевом рынке — у действующих или бывших сотрудников и ранних инвесторов. По данным Кена Сойера (Ken Sawyer), сооснователя и управляющего партнёра Saints Capital, один из акционеров Anthropic недавно предложил пакет акций по цене $1,15 трлн. Джесси Леймгрубер (Jesse Leimgruber), основатель OpenHome, сообщил в соцсети X, что крупный фонд готов купить те же бумаги при оценке $1,05 трлн. Некоторые покупатели даже предлагают собственную недвижимость в обмен на акции Anthropic. Три месяца назад Anthropic закрыла раунд финансирования под руководством GIC и Coatue с оценкой $380 млрд. С тех пор интерес к бумагам компании резко вырос — инвесторов впечатлили стремительный рост выручки и популярность Claude Code у разработчиков. За последние недели венчурные фонды несколько раз предлагали купить акции Anthropic, оценивая компанию в $800 млрд. «Для Anthropic это был грандиозный забег, — говорит Глен Андерсон (Glen Anderson), генеральный директор Rainmaker Securities, инвестиционного банка, специализирующегося на операциях с бумагами непубличных компаний. — Все хотят войти в историю ИИ, а Anthropic сейчас занимает в ней первую позицию». Андерсон только что получил предложение о покупке пакета акций Anthropic стоимостью $960 млрд, однако ожидает, что другой покупатель согласится раньше, чем он успеет оценить сделку. «Получаем предложение — и уже на следующий день кто-то его перехватывает. Продавцов почти нет», — говорит он. По словам Андерсона, значительная часть спроса объясняется страхом упустить возможность, а не фундаментальными показателями: инвесторы из венчурных и семейных фондов готовы платить любую цену, чтобы только стать акционерами Anthropic. «Дело уже не столько в доходности, сколько в том, чтобы сказать: я инвестор Anthropic. Это и разгоняет цену», — отмечает он. По словам Андерсона, спрос на акции OpenAI в этом году резко ослаб: заявки ниже уровня последнего раунда в $852 млрд. «Рынок OpenAI совсем вялый. Настроения явно сместились в сторону Anthropic», — констатирует он. Брэдли Горовиц (Bradley Horowitz), генеральный партнёр Wisdom Ventures — раннего инвестора как в Anthropic, так и в OpenAI, — рассказал, что фонд получает предложения о продаже акций каждый день, но игнорирует их. «Предложения поступают ежедневно — от смехотворных до вполне серьёзных. Я едва открываю такие письма: нас это не интересует. Мы играем в долгую», — заявил он. ИИ-ассистент Google Gemini начал делать заметки, сводки и стенограммы не только во встречах Google Meet

23.04.2026 [07:51],

Дмитрий Федоров

ИИ-ассистент Gemini компании Google научился вести заметки не только на встречах в Google Meet. Теперь ИИ-ассистент создаёт сводки и стенограммы очных созвонов, а также встреч в Zoom и Microsoft Teams. Функция подходит и для спонтанных встреч — ни переговорная, ни заранее составленный план не нужны. Поддержка очных совещаний прежде была доступна лишь участникам альфа-тестирования и только на Android.

Источник изображения: Rubaitul Azad / unsplash.com Чтобы включить запись, пользователю достаточно открыть главный экран Google Meet — в мобильном приложении или в браузере — и выбрать пункт «делать заметки за меня» (англ. — take notes for me). Платформа, на которой проходит встреча, значения не имеет: функция работает и для видеозвонков в Zoom и Microsoft Teams, и для очных созвонов.

Источник изображения: workspace.google.com По итогам встречи Gemini формирует сводку и перечень задач в «Google Документе», который автоматически появляется в «Google Диске» у пользователя, запустившего запись. Однако у очных встреч есть одно ограничение: eсли участник, не пришедший на встречу, хочет к ней присоединиться, встречу можно перевести в обычный видеозвонок. Стартап Миры Мурати закупил у Google мощности для обучения ИИ на несколько миллиардов

22.04.2026 [16:29],

Павел Котов

Стартап Thinking Machines Lab бывшего топ-менеджера OpenAI Миры Мурати (Mira Murati) заключил с Google соглашение на сумму в несколько миллиардов долларов на использование облачной инфраструктуры Google Cloud для обучения и развёртывания моделей искусственного интеллекта, в том числе на системы с передовыми ускорителями Nvidia GB300.

Источник изображения: BoliviaInteligente / unsplash.com Google активно сотрудничает с разработчиками ИИ, предлагая облачную инфраструктуру с другими своими сервисами: хранилищем данных, движком Kubernetes и СУБД Spanner. Ранее Thinking Machines заключила партнёрское соглашение с Nvidia, предусматривающее инвестиции от производителя чипов; с поставщиком облачных услуг компания заключила соглашение впервые. Сделка не носит эксклюзивного характера, поэтому компания Миры Мурати может заручиться поддержкой и других провайдеров. Мурати ушла из OpenAI и в феврале 2025 года запустила стартап Thinking Machines, который привлёк инвестиции на сумму $2 млрд при оценке $12 млрд. Компания сообщила, что занимается разработкой продуктов в области ИИ, но не уточняла, о чем идёт речь. В октябре минувшего года она, однако, анонсировала инструмент под названием Tinker, который автоматизирует создание передовых моделей ИИ. В пресс-релизе Google отметила, что может поддерживать рабочие нагрузки стартапа для задач обучения с подкреплением — этот подход помог несколькими крупным игрокам, в том числе Google DeepMind и OpenAI, добиться прорывов в лабораториях. Это значит, что Thinking Machines также заинтересована в этой ресурсоёмкой технологии. Стартап стал одним из первых клиентов Google Cloud, получивших доступ к системам на основе ИИ-ускорителей Nvidia GB300, которые обеспечивают двухкратный прирост скорости обучения по сравнению с ускорителями предыдущего поколения. «Google Cloud дал нам возможность работать с рекордной скоростью и с необходимой нам надёжностью», — заявил представитель Thinking Machines Майл Отт (Майл Отт). Anker представила ИИ-аудиочип Thus — он дебютирует во флагманских наушниках Soundcore

22.04.2026 [13:42],

Павел Котов

Компания Anker анонсировала собственный аудиочип, который обеспечит их локальную работу моделей искусственного интеллекта в аудиоустройствах, мобильных аксессуарах и устройствах интернета вещей.

Источник изображения: Anker Процессор Thus — первый в мире аудиочип, способный производить необходимые для работы нейросетей вычисления в локальной памяти; он компактнее и экономичнее существующих аналогов. Это привлекательное решение для компактных устройств. Сравнивая Thus в другими схожими компонентами, гендиректор Anker Стивен Янг пояснил: «Каждый созданный до сих пор ИИ-чип предполагает хранение модели на одной стороне и вычисления на другой. Если задуматься, устройству приходится множество раз в секунду передавать все эти параметры при каждом инференсе (запуске ИИ-модели). Thus помещает вычисления туда, где модель уже находится. Модели больше никогда не нужно будет перемещаться». Первый чип Thus будет интегрирован в будущую флагманскую модель наушников бренда Soundcore — это самый сложный проект из-за ограниченного размера устройства, рассказали в компании. При небольших размерах ограничивается и мощность: если в предыдущих моделях приходилось довольствоваться нейросетями на несколько сотен тысяч параметров, то новый чип поможет поднять этот показатель для нескольких миллионов. На практике это, например, поможет снизить присутствие окружающего шума в звуковой картине и сделать более разборчивым голос владельца. Относительно крупная нейросеть, которую обрабатывает Anker Thus в сочетании с восемью MEMS-микрофонами и двумя датчиками костной проводимости, обеспечит более чистый звук при разговорах независимо от условий окружения. Если верить неофициальной информации, Thus появится в наушниках моделей Soundcore Liberty 5 Pro и Liberty 5 Pro Max по цене $169,99 и $229,99. Более подробно производитель расскажет об этом на мероприятии Anker Day, намеченном на 21 мая. Google Chrome начнёт показывать созданные ИИ картинки на разных сайтах, но непонятно зачем

22.04.2026 [13:23],

Павел Котов

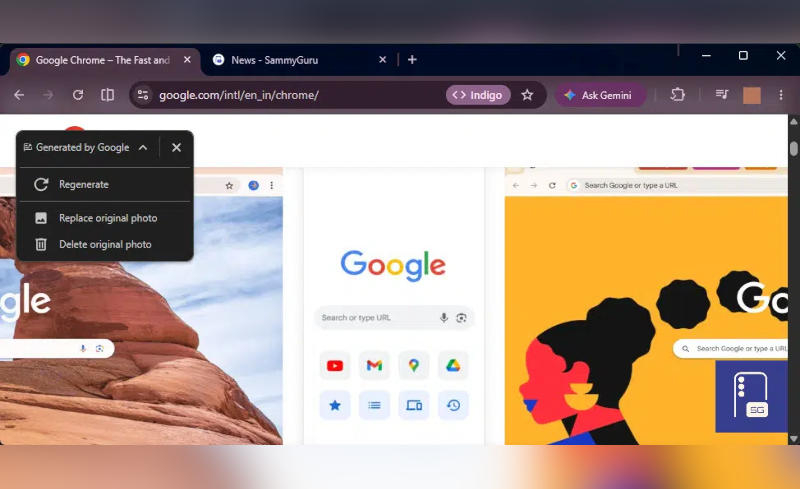

В браузере Google Chrome скоро появится новая функция, предназначение которой не так просто понять: вместо изображений на просматриваемых сайтах будут показываться картинки, созданные искусственным интеллектом. На нововведение обратил внимание ресурс SammyGuru.

Источник изображения: sammyguru.com Функция получила название Indigo, и сейчас она числится в разработке. Для её запуска в адресной строке Google Chrome предусмотрен соответствующий значок, при нажатии на который рядом с изображениями на открытом в данный момент сайте появляется пояснение «Сгенерировано Google» и указывающая вниз стрелка — если щёлкнуть и по ней, в выпадающем меню появятся три варианта: «Перегенерировать», «Заменить исходное фото» и «Удалить исходное фото». Ни один из предлагаемых вариантов пока не работает — функция ИИ-генерации изображения пока отключена. Но если бы она работала, то вместо исходной картинки при просмотре сайта появлялась бы другая, созданная ИИ. Самого сайта изменения не касаются — там изображение остаётся прежним, и при обновлении страницы оно выводится в исходном виде. Предназначение подобной функции остаётся не вполне ясным. Можно предположить, что так Google хочет защитить пользователей Chrome, и Indigo будет срабатывать, если на сайте обнаружится изображение шокирующего характера. Если это так, то подмену картинок, возможно, следует производить не в ручном, а в автоматическом режиме. Потенциально опасная ИИ-модель Anthropic Mythos нашла 271 уязвимость в Firefox 150

22.04.2026 [12:20],

Павел Котов

Пока общественность пытается разобраться, действительно ли вышедшая в конце марта модель искусственного интеллекта Anthropic Mythos слишком опасна для выпуска в общий доступ, или разработчик просто искусственно создаёт на ней ажиотаж, в Mozilla испытали её возможности на собственном продукте.

Источник изображения: blog.mozilla.org Разработчики Mozilla получили ранний доступ к Anthropic Mythos, и ИИ помог им обнаружить в вышедшем на этой неделе обновлении браузера Firefox 150 колоссальное число уязвимостей — 271 штуку. Результат оказался настолько значительным, чтобы технический директор Firefox Бобби Холли (Bobby Holley) с энтузиазмом констатировал, что в бесконечной борьбе киберпреступников и киберзащитников у последних «наконец-то появился шанс одержать решительную победу». Для сравнения, в марте общедоступная модель Anthropic Opus 4.6 провела анализ кода Firefox 148 и нашла «всего» 22 уязвимости. Обычно, отметил господин Холли, уязвимости обнаруживаются либо методом «фаззинга» — хаотической бомбардировки ПО случайными данными — либо посредством долгосрочного анализа с привлечением «элитных исследователей в области безопасности». Anthropic Mythos избавляет разработчиков от применения серьёзных ресурсов, которые требуют продолжительного времени и усилий. Но теперь создателям ПО придётся ввести в повседневную практику анализ кода с помощью ИИ, потому что множество ошибок скрывается в каждом продукте, и теперь их можно обнаруживать. Особенно важно это для проектов с открытым исходным кодом, чьи базы кода свободно лежат в общем доступе. Исследования безопасности для таких проектов обычно проводят добровольцы, но их усилий, конечно, недостаточно. И разработчикам наиболее популярных проектов, которыми пользуются миллиарды человек, отметили в Mozilla, доступ к средствам вроде Anthropic Mythos должен предоставляться в приоритетном порядке. WhatsApp предложит ИИ-сводки по всем непрочитанным сообщениям

22.04.2026 [11:00],

Павел Котов

В последней предварительной сборке приложения WhatsApp TestFlight для Apple iOS обнаружилось упоминание новой функции, которая позволит пользователям мессенджера просматривать подготовленную искусственным интеллектом сводку непрочитанных сообщений. Приложение уже предлагает сводку непрочитанных сообщений к каждом чате индивидуально, но в перспективе, обращает внимание ресурс WABetaInfo, начнёт работать «единая функция создания сводок по непрочитанной переписке». При выборе фильтра «Непрочитанные» в верхней области на вкладке «Чаты» появится кнопка «Получить сводку». Упоминается функция «Приватная обработка» (Private Processing), которая предусматривает генерацию защищённой сводки непрочитанных сообщений — она предполагает обработку контента таким образом, чтобы обеспечить пользователю конфиденциальность и предоставить чёткий обзор переписки. Новая функция находится в разработке приложений WhatsApp как для Apple iOS, так и для Google Android. Это может свидетельствовать, что администрация мессенджера настроена развернуть её для широкой аудитории или как минимум запустить её открытое бета-тестирование. Сроки её выхода пока неизвестны. YouTube начнёт удалять дипфейки по запросам знаменитостей, но не все

22.04.2026 [10:46],

Павел Котов

Администрация YouTube усовершенствовала функцию мониторинга дипфейков — созданные искусственным интеллектом видеоролики с участием знаменитостей скоро начнут исчезать с платформы по запросам самих знаменитостей. Но не все.

Источник изображения: Pramod Tiwari / unsplash.com Алгоритм обнаружения сходства производит поиск на YouTube материалов, в которых используются созданные ИИ дипфейки — при обнаружении такого видео участвующая в программе знаменитость получает уведомление. Таким образом, публичные личности смогут отслеживать подобный контент и запрашивать его удаление с платформы. Администрация YouTube реагирует на каждый такой запрос в индивидуальном порядке и действует в соответствии с политикой конфиденциальности платформы, так что не каждый запрос будет удовлетворяться. YouTube начал тестировать эту функцию ещё прошлой осенью, включив в программу собственных блогеров; в марте к ней подключили журналистов и политиков. Теперь она будет охватывать всех знаменитых людей независимо от того, есть ли у них собственный канал на YouTube. Чтобы подключиться к программе, необходимо предоставить удостоверение личности и отправить видеоселфи — сходство будет оцениваться по лицу, а не по голосу или любым другим характеристикам. Администрация платформы не гарантирует удаление дипфейков: добросовестными считаются произведения пародийного или сатирического характера. Подключившиеся ранее к программе видеоблогеры запрашивали удаление лишь «очень небольшого» количества видео со своим «участием». Обнаружение сходства производится с помощью системы Content ID, которая дает правообладателям возможность монетизировать видео, размещённые другими пользователями. Ранее YouTube анонсировал функцию, позволяющую авторам добавлять с помощью ИИ собственные аватары в видео. Продюсерское агентство CAA уже сформировало базу данных с биометрическими данными клиентов, которые можно использовать в коммерческих целях. Так, звезда TikTok Хаби Лейм (Khaby Lame) уже продал права на собственный образ, который может использоваться для продажи товаров в интернете. Некоторые представители индустрии развлечений рассматривают взрывной рост числа дипфейков как новый способ взаимодействовать с сообществом поклонников. Одни знаменитости это увлечение не приветствуют, другие относятся к этому спокойно — но всё, видимо, идёт к тому, что для них это станет новым источником дохода. SpaceX может купить ИИ-стартап Cursor за $60 млрд — или ограничится партнёрством

22.04.2026 [10:44],

Алексей Разин

За последние несколько лет Илон Маск (Elon Musk) подверг свои активы стремительной консолидации. Если публичная компания Tesla сохраняет независимость по причине наличия обширного круга инвесторов, то частные SpaceX, ИИ-стартап xAI и социальная сеть X недавно были объединены под крылом первой из них. Более того, SpaceX номинально имеет право купить стартап Cursor за $60 млрд, как стало известно на этой неделе.

Источник изображения: SpaceX Информация о наличии подобной договорённости между SpaceX и Cursor стала достоянием общественности благодаря подготовке первой из компаний к IPO. До конца текущего года SpaceX может заплатить $60 млрд за активы Cursor, но если сделка не состоится, партнёры могут наладить сотрудничество после того, как первая передаст второй $10 млрд. По словам представителей SpaceX, компании уже плотно сотрудничают с целью создания «лучшего в мире ИИ для написания программного кода и работы с данными». Илона Маска беспокоит отставание собственного стартапа xAI от конкурентов в сфере создания инструментов для написания программного кода с помощью ИИ. Он затеял масштабные реформы в xAI и уже нанял некоторых специалистов с опытом работы в Cursor. Поглотить последнюю немедленно SpaceX не может, поскольку это потребовало бы дополнительных согласований в свете подготовки к IPO и привело бы к его задержке. Считается, что номинально упоминаемые $10 млрд являются суммой отступных на тот случай, если SpaceX в итоге не купит Cursor, но продолжит с ним сотрудничать. На прошлой неделе сообщалось, что Cursor намеревается привлечь $2 млрд в ходе очередного раунда финансирования, который поднимет капитализацию стартапа до уровня свыше $50 млрд. От этих намерений Cursor теперь отказывается, поскольку полагается на возможности xAI в сфере расширения собственной вычислительной инфраструктуры. Запущенный в 2023 году программный ассистент Cursor позволяет разработчикам ПО использовать в своей деятельности ИИ для повышения производительности труда. В этом альянсе Cursor предоставляет компетенции, а xAI — вычислительные ресурсы, как можно понять из комментариев представителей обеих компаний. Инвесторами Cursor являются Nvidia, Google и венчурный фонд OpenAI, не считая ряда институциональных игроков рынка. |