|

Опрос

|

реклама

Быстрый переход

Nvidia выпустила мультимодальную модель ИИ с открытым исходным кодом, и она не уступает GPT-4

02.10.2024 [19:27],

Сергей Сурабекянц

Nvidia представила новое семейство больших мультимодальных языковых моделей NVLM 1.0, включая обученную на 72 миллиардах параметров NVLM-D-72B. Модели демонстрируют высокую производительность в широком спектре задач, таких как машинное зрение, создание программного кода, анализ изображений, решение математических задач и генерация текстов. Похоже, что лидерам отрасли во главе с OpenAI и Google придётся потесниться.

Источник изображения: freepik.com «Мы представляем NVLM 1.0, семейство передовых мультимодальных больших языковых моделей, которые достигают самых современных результатов в задачах зрения и языка, конкурируя с ведущими фирменными моделями (например, GPT-4o) и моделями с открытым доступом», — утверждают разработчики Nvidia. По их мнению, открытый исходный код предоставляет исследователям и разработчикам беспрецедентный доступ к передовым технологиям. Флагманская модель NVLM-D-72B демонстрирует адаптивность при обработке сложных визуальных и текстовых входных данных. Исследователи подчёркивают способность модели интерпретировать мемы, анализировать изображения и пошагово решать математические задачи. Разработчики также отметили, что NVLM-D-72B улучшает свою производительность в текстовых задачах после мультимодального обучения, в отличие от большинства аналогичных моделей. Проект NVLM также представляет инновационные архитектурные решения, включая гибридный подход, который объединяет различные методы мультимодальной обработки. По оценкам сторонних исследователей, модель NVLM-D-72B «находится на одном уровне с Llama 3.1 405B по математике и кодированию, а также имеет видение». Выпуск Nvidia NVLM 1.0 знаменует собой поворотный момент в разработке ИИ. Открывая исходный код модели, которая конкурирует с проприетарными гигантами, Nvidia не просто делится кодом — она бросает вызов самой структуре индустрии ИИ. Благодаря Nvidia множество небольших организаций и независимых исследователей смогут вносить более значительный вклад в развитие ИИ, что может открыть эру беспрецедентного сотрудничества и инноваций в области ИИ. Этот шаг может вызвать цепную реакцию — другим лидерам в области ИИ также придётся открыть свои исследования, что потенциально ускорит прогресс ИИ по всем направлениям. Нужно отметить, что выпуск NVLM 1.0 не лишён рисков. По мере того, как мощный ИИ становится все более доступным, возрастают и опасения по поводу его неправильного использования и возможных этических последствий. Сообщество ИИ уже столкнулось с необходимостью ответственного использования новых технологий. Одно можно сказать наверняка: политика Nvidia в отношении ИИ затронет всю индустрию. Вопрос только в том, насколько радикальным окажется её влияние, и смогут ли конкуренты адаптироваться достаточно быстро, чтобы преуспеть в этом новом мире открытого ИИ. OpenAI открыла речевой ИИ из ChatGPT для сторонних разработчиков — ждём вала говорящих приложений

02.10.2024 [17:53],

Владимир Фетисов

Компания OpenAI представила новые возможности для упрощения процесса создания приложений на основе искусственного интеллекта. Теперь разработчики могут задействовать работающий в режиме онлайн инструмент для создания голосовых программных решений на базе ИИ, используя единый набор инструкций.

Источник изображения: OpenAI Большую часть дохода OpenAI получает от предприятий, которые используют нейросети компании для создания собственных ИИ-приложений. Поэтому расширение возможностей по созданию таких продуктов является вполне оправданным шагом на фоне обостряющейся борьбы в сфере ИИ с такими компаниями, как Google, которая внедряет в свои продукты алгоритмы, способные обрабатывать разные типы информации, включая текст, изображения и видео. Процесс создания голосовых помощников требует от разработчиков прохождения как минимум трёх этапов: преобразование аудио в текст, обработка запроса и генерация текстового ответа на него, а также преобразование полученного ответа в аудио. В рамках внедрения новых возможностей по созданию голосовых ИИ-приложений OpenAI представила инструмент тонкой настройки больших языковых моделей после завершения этапа обучения. Такой подход позволит повысить качество ответов, которые генерируют создаваемые разработчиками алгоритмы в ответы на запросы в текстовом формате и с использованием изображений. Этап точной настройки может сопровождаться обратной связью от людей, которые проводят оценку того, насколько качественные ответы даёт алгоритм. В OpenAI считают, что использование изображений для точной настройки моделей даст разработчикам более широкие возможности для повышения качества понимания ИИ-алгоритмами того, что демонстрируется на изображениях. Созданные таким образом приложения могут выступать, например, в качестве расширенного поиска по визуальным элементам. В дополнение к этому OpenAI представила инструмент, который позволит меньшим ИИ-моделям учиться на более крупных моделях, а также «Быстрое кэширование», которое существенно сократит затраты на разработку благодаря повторному использованию фрагментов текста, ранее уже обработанных алгоритмом. Все представленные нововведения уже тестируются с привлечением ограниченного числа клиентов OpenAI. Microsoft прокачала Copilot: человеческий голос, сёрфинг с пользователем и глубокие размышления

02.10.2024 [14:37],

Павел Котов

Microsoft представила радикальное обновление помощника с искусственным интеллектом Copilot — он получил зрение и голос, благодаря чему стал более персонализированным. Новые возможности Copilot включают режим виртуального ведущего новостей, который зачитывает заголовки; голосовая функция позволяет общаться с ним естественным образом, как Advanced Voice Mode от OpenAI; наконец, ИИ-помощник может «увидеть» то, на что ему укажет пользователь.

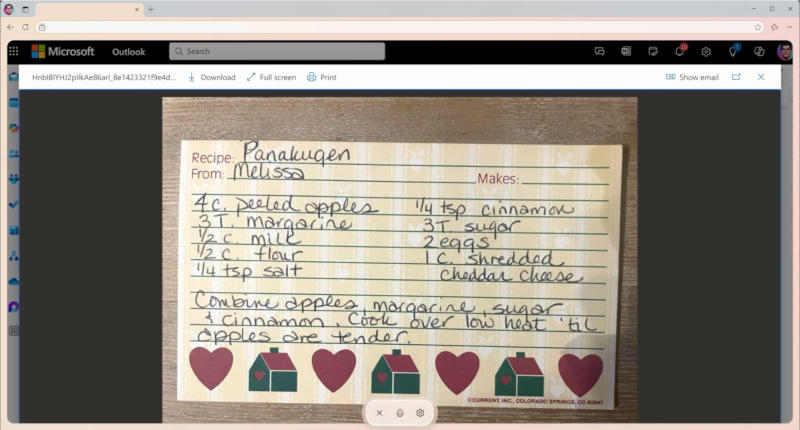

Источник изображений: blogs.microsoft.com Microsoft Copilot был радикально переработан на мобильных устройствах, в веб-версии и в приложении для Windows — он теперь напоминает ИИ-помощник Pi, созданный компанией Inflection, значительное число сотрудников которой перешло в Microsoft. Бывший гендиректор Inflection и сооснователь Google DeepMind Мустафа Сулейман (Mustafa Suleyman) сейчас возглавил ИИ-отдел Microsoft. Существенной переработке подвергся интерфейс ИИ-помощника — теперь это персонализированная страница Copilot Discover, более полезная и привлекательная, чем одно только текстовое поле для запросов к чат-боту. Домашняя страница настраивается на основе истории пользователя с чат-ботом; со временем на ней будут представлены полезные поисковые запросы, советы и релевантная информация.  ИИ-помощник получил полноценный голосовой интерфейс аналогично ChatGPT — теперь с ним можно общаться, задавать вопросы, прерывать его, как при разговоре с товарищем или коллегой. В Copilot доступны четыре варианта голоса, один из которых придётся выбирать при первом использовании. Вторая крупная ставка Microsoft — функция зрения Copilot Vision, позволяющая ассистенту видеть то, что видит пользователь на открытой веб-странице. Можно задавать вопросы о тексте, изображениях и любом другом содержимом, и помощник даст естественный ответ. Это поможет при совершении покупок в интернете — система предложит различные варианты товаров и отзывы. Подключать Copilot Vision придётся вручную, и просматриваемый системой контент нигде не хранится и не используется для обучения ИИ, уверяет Microsoft. Кроме того, компания наложила ограничения на типы сайтов, с которым может работать Copilot Vision; платные и конфиденциальные материалы система тоже не поддерживает. В одном из приведённых Microsoft примеров функция используется для сканирования рукописных кулинарных рецептов — ИИ поясняет, о каком блюде идёт речь, и сколько времени уйдёт на его приготовление.  Copilot Daily, ещё одна функция, представляет аудиосводку новостей и погоды, которую ИИ-помощник зачитывает как диктор новостной службы. Сводка представляет собой короткую заметку, которую пользователь может слушать по утрам — в качестве источников используются только ресурсы, которые согласились на использование контента системой Copilot. На начальном этапе это Reuters, Axel Springer, Hearst и Financial Times, но в перспективе их число будет расширяться. Многообещающей также представляется функция Think Deeper — благодаря новейшим ИИ-моделям OpenAI система Copilot теперь может отвечать и на сложные вопросы, предлагая пошаговые ответы или проводя сравнения. Функция пока остаётся на ранней стадии разработки, и доступна она на площадке Copilot Labs наряду с Copilot Vision — участники тестирования могут отправить в Microsoft отзывы об их работе. Компания осторожничает неспроста, если учесть опасения, которые вызвала функция Recall до того, как подверглась переработке. Обновлённый пакет Copilot доступен в мобильных приложениях для iOS и Android, на сайте copilot.microsoft.com, а также в приложении Copilot для Windows. Функция Copilot Voice на начальном этапе доступна на английском языке в Австралии, Канаде, Новой Зеландии, Великобритании и США, а в перспективе появится и в других регионах. Copilot Daily пока можно пользоваться лишь в США и Великобритании, а Copilot Vision работает лишь у некоторых подписчиков Copilot Pro в США. Выяснилось, что ИИ-ассистенты не повышают продуктивность программистов

02.10.2024 [13:35],

Алексей Разин

Авторы исследования Uplevel, охватившего деятельность примерно 800 разработчиков программного обеспечения, утверждают, что применение инструментов с искусственным интеллектом для написания программного кода пока не выявило ни повышения производительности труда профильных специалистов, ни снижения их эмоционального выгорания.

Источник изображения: Unsplash, Luca Bravo В ходе исследования сравнивались результаты труда выборки из 800 разработчиков на протяжении двух трёхмесячных периодов. В первом периоде программисты трудились с использованием традиционных инструментов, во втором они перешли на использование ИИ-ассистента GitHub Copilot. Примечательно, что на производительности труда разработчиков подобная миграция особо не сказалась в рамках данного эксперимента. Первоначально ожидалось, что применение GitHub Copilot снизит количество ошибок в программном коде и увеличит производительность труда, но по факту в первом случае наблюдался рост количества ошибок на 41 %, а ещё попытки применять ИИ-ассистента не привели к существенному улучшению ситуации с эмоциональным выгоранием специалистов. По данным GitHub, применение помощника Copilot способно на 55 % повысить скорость написания кода разработчиками. Некоторые эксперты признались, что написанные с помощью ИИ участки программного кода трудно поддаются анализу и выявлению ошибок, поэтому порой проще переписать нужный фрагмент заново. На ранних этапах развития ChatGPT, например, отмечалось, что этот чат-бот более половины всех запросов, связанных с оптимизацией работы создателей программного кода, просто неверно истолковывает. Представители Gehtsoft, например, убеждены, что разработка программного обеспечения на 90 % зависит от функций человеческого мозга, в части понимания требований, разработки системы и определения ограничений. Превращение сформированных взаимных зависимостей в программный код является самой простой частью работы программиста. С другой стороны, находятся и те, кто восхваляет возможности ИИ в разработке программного кода. Представители провайдера облачных услуг Innovative Solutions, например, отмечают почти троекратное повышение производительности после перехода на использование ИИ-ассистентов типа Claude Dev и Copilot. В Microsoft Paint добавили ИИ-функции заливки и стирания, прямо как в Photoshop

02.10.2024 [13:11],

Павел Котов

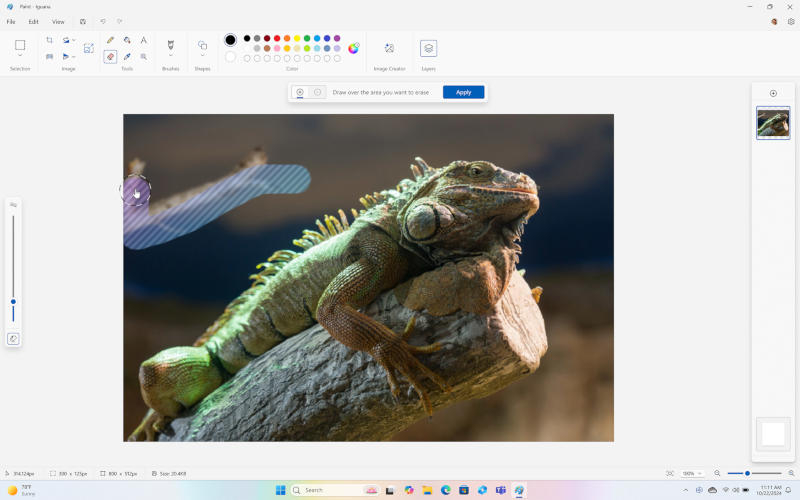

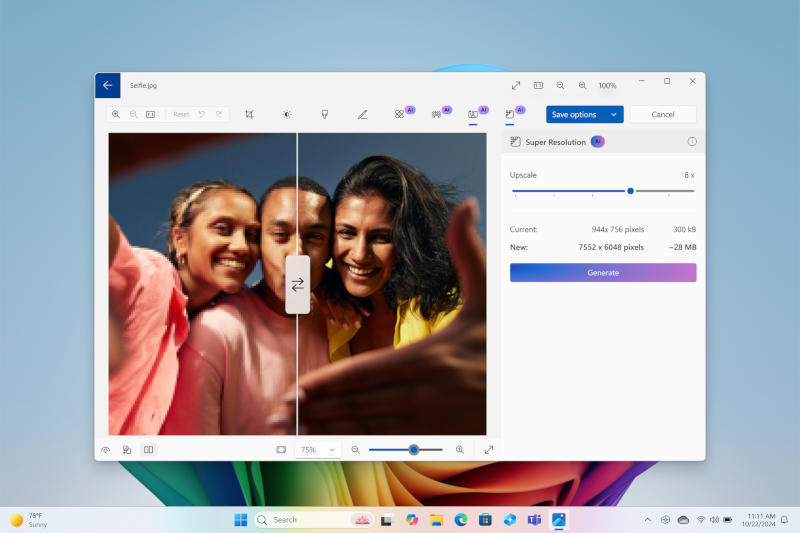

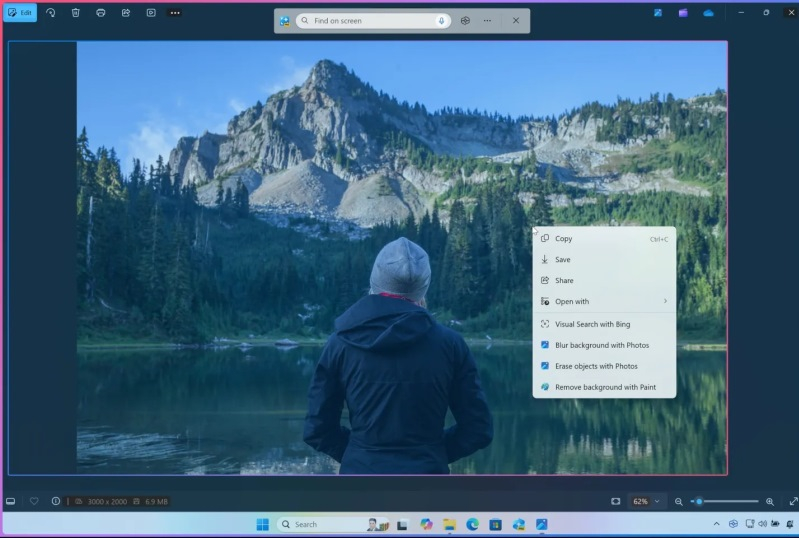

Microsoft представила новые основанные на генеративном искусственном интеллекте функции для приложений Paint и «Фотографии» на компьютерах класса Copilot Plus PC с ИИ-ускорителями. Новые возможности предназначаются для редактирования изображений и выступают своего рода аналогами функций, которые уже есть в Adobe Photoshop.

Источник изображений: blogs.windows.com Для работы обоих инструментов используется кисть с регулируемым размером, помогающая указывать на подлежащие редактированию области изображения. Функция Generative Erase удаляет с изображений нежелательные элементы — так же это делает Magic Eraser на телефонах Google Pixel. Generative Fill, напротив, добавляет на изображения новые элементы — пользователю необходимо создать текстовый запрос и выбрать, где их разместить. Схожим образом работает и одноимённый инструмент в Photoshop.  Основу для работы новых функций заложил инструмент Paint Cocreator, анонсированный для компьютеров Copilot Plus PC в этом году — он предназначен для генерации изображений при помощи текстовых запросов и выступающих образцами эскизов. Обеспечивающая работу функций диффузионная модель получила обновление, с которым повысились качество и скорость работы, а также появилась «встроенная модерация», предотвращающая злоупотребления. Инструмент Generative Erase появился и в приложении «Фотографии» наряду с функцией Super-Resolution, которая при помощи локального ИИ масштабирует размытые или пикселизированные изображения. Степень увеличения картинки можно регулировать при помощи ползунка — оно может быть восьмикратным. Это соответствует возможностям масштабирующего средства на платформе Canva и вдвое превосходит возможности четырёхкратного увеличения Super Resolution в Adobe Lightroom. Функция доступна бесплатно и работает достаточно быстро, «за считанные секунды» повышая разрешение изображений до 4K, уверяют в Microsoft. Microsoft улучшила поиск в Windows 11 с помощью ИИ и добавила в ОС аналог Circle to Search

02.10.2024 [12:13],

Владимир Фетисов

Microsoft задействовала алгоритмы на базе искусственного интеллекта, чтобы улучшить поиск в Windows 11 на новых компьютерах Copilot Plus PC. Одним из заметных нововведений стала функция Click to Do, которая похожа на представленный ранее инструмент Google Circle to Search и предназначена для упрощения поиска по изображениям, электронным письмам, документам и даже видео. Эта и другие ИИ-функции поиска Windows 11 будут развёрнуты на Copilot Plus PC в следующем месяце.

Источник изображений: Microsoft «Поиск на основе искусственного интеллекта значительно упростит поиск практически чего угодно. Вам больше не нужно запоминать имена файлов и расположение документов, а также какие-то конкретные слова. Windows будет лучше понимать ваши намерения и найдёт нужный документ, изображение, файл или электронное письмо», — прокомментировал запуск новых функций Юсуф Мехди (Yusuf Mehdi), вице-президент Microsoft, отвечающий за развитие Windows. Улучшенный поиск также будет доступен «в ближайшие месяцы» в основном интерфейсе поиска Windows 11 и поле поиска, которое появляется в разделе настроек. Это облегчит поиск не только файлов, но и определённых разделов с настройками. Например, в поиске по настройкам можно будет написать «добавить мои наушники», чтобы быстро перейти к взаимодействию с соответствующим меню. Много лет поиск в Windows был не очень хорош, поэтому возможность искать что-либо на основе запросов на естественном языке должна существенно улучшить ситуацию.  В дополнение к этому в следующем месяце Microsoft начнёт развёртывание функции Click to Do. Для взаимодействия с ней достаточно зажать клавишу Windows на клавиатуре и кликнуть по экрану левой кнопкой мыши. После этого на экране появится инструмент интерактивного наложения, с помощью которого можно выделить часть изображения или текста для выполнения дальнейших действий. Функцию Click to Do можно задействовать в разных ситуациях, например, для осуществления поиска в интернете по каким-то визуальным элементам, которые пользователь увидел при просмотре видео на YouTube. В дополнение к этому функция может работать с текстами, поэтому будет полезна при обобщении или переписывании документов, отправке электронных писем и др.  Microsoft начнёт тестировать функцию Click to Do и улучшенный поиск в Windows в рамках программы предварительной оценки на компьютерах Copilot Plus PC в этом месяце. В ноябре начнётся постепенное развёртывание нововведений на совместимых устройствах. Ранее анонсированная функция Recall, которая фиксирует все действия пользователей в ОС, также станет доступна инсайдерам с устройствами на базе процессоров от Qualcomm в октябре, а в ноябре она появится на компьютерах Copilot Plus PC с чипами от Intel и AMD. Когда планируется начать массовое развёртывание функции Recall, пока неизвестно. Сбежавшую от Сэма Альтмана Миру Мурати осаждают венчурные инвесторы с деньгами

01.10.2024 [22:33],

Сергей Сурабекянц

Технический директор OpenAI Мира Мурати (Mira Murati) объявила о своём уходе из компании на прошлой неделе. По её словам, она решила «освободить время и пространство для собственных исследований». Сразу после увольнения Мурати несколько крупных венчурных компаний объявили о желании профинансировать её следующий проект. Интрига заключается в том, что Мурати пока не делала никаких заявлений о своих дальнейших планах и отказалась комментировать возникшие слухи.

Источник изображения: Pixabay «Мои шесть с половиной лет в команде OpenAI были исключительной привилегией… Никогда не бывает идеального времени, чтобы уйти из места, которое ты лелеешь, но этот момент кажется правильным» — написала Мурати в своём аккаунте в соцсети X. Генеральный директор OpenAI Сэм Альтман (Sam Altman) прокомментировал внезапный уход Мурати в X: «Я, конечно, не буду притворяться, что такая внезапность [увольнения] естественна, но мы не обычная компания, и я думаю, что причины, которые мне объяснила Мира, имеют смысл». Мурати присоединилась к OpenAI в 2018 году. До этого она занималась проектированием электромобиля Model X в Tesla. В OpenAI Мурати возглавила разработку двух флагманских продуктов компании — ChatGPT и Dall-E. Уход Мурати произошёл на фоне реструктуризации OpenAI из некоммерческой организации в коммерческую, что даст Альтману возможность получить пакет акций. Очередной недавний сбор средств принёс OpenAI инвестиции в размере $6,5 млрд от таких компаний, как Thrive Capital, SoftBank, Coatue и Microsoft. Венчурные капиталисты конкурируют за право быть первыми инвесторами стартапов, основанных выходцами из OpenAI, так как все эти проекты выглядят очень многообещающе. Десятки бывших сотрудников OpenAI, включая уволившихся соучредителей стартапа, за последние несколько лет основали свои компании, к примеру:

Одновременно с Мурати о своём уходе из OpenAI заявили ещё два технических специалиста — главный научный сотрудник Боб МакГрю (Bob McGrew) и вице-президент по исследованиям Барретт Зоф (Barret Zoph). Теперь Альтман и Войцех Заремба (Wojciech Zaremba) — единственные оставшиеся учредители из одиннадцати основателей компании. «Их уход заставил меня задуматься о трудностях, с которыми сталкивались родители в Средние века, когда 6 из 8 детей умирали преждевременно, — написал Заремба в сообщении в соцсети X, ставшем вирусным. — Несмотря на тяжёлую утрату, родителям пришлось смириться с ней и найти глубокую радость и удовлетворение в тех двоих, кто выжил». Разработчик ИИ-ускорителей Cerebras Systems готовится к выходу на IPO

01.10.2024 [07:56],

Алексей Разин

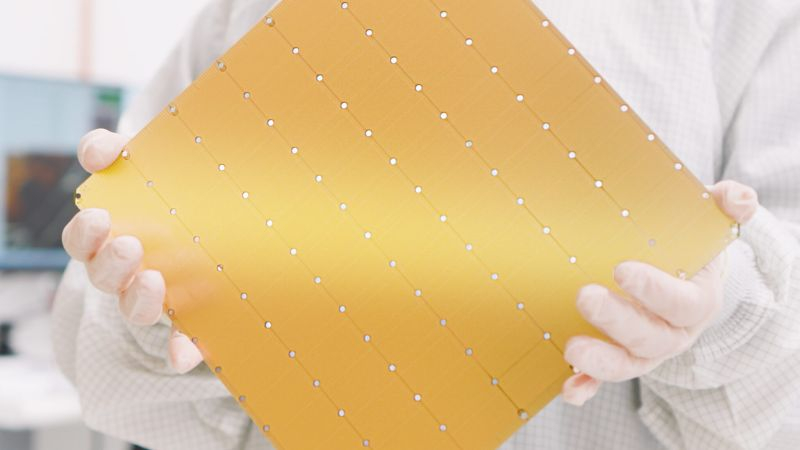

Основанная в 2016 году в Калифорнии компания Cerebras Systems разрабатывает непривычно крупные чипы для ускорения работы систем искусственного интеллекта, а их выпуском на квадратных подложках занимается TSMC. Американский стартап остаётся убыточным, но уже начал готовиться к выходу на IPO, опубликовав проспект для инвесторов.

Источник изображения: Cerebras Прежде всего, из опубликованных данных становится понятно, что по итогам первого полугодия компания получила чистые убытки составили $66,6 млн при выручке $136,4 млн. За год до этого выручка не превышала $8,7 млн при чистых убытках в размере $77,8 млн. По итогам всего прошлого года выручка Cerebras достигла $78,7 млн при убытках в размере $127,2 млн. Во втором квартале прошлого года компания выручила $69,8 млн и получила убытки в размере $50,9 млн. За год до этого выручка не превышала $5,7 млн, а чистые убытки составили $26,2 млн. В текущем году операционные расходы Cerebras выросли из-за необходимости найма дополнительного персонала в связи с расширением бизнеса. В прошлом году компания G42 из ОАЭ формировала 83 % выручки Cerebras. Помимо продажи собственно чипов ускорителей, компания занимается предоставлением доступа к собственным облачным мощностям на их основе. Получив в 2021 году $250 млн финансирования, Cerebras оценивала свою капитализацию в $4 млрд. На какую сумму она претендует по итогам IPO, пока не уточняется. Арабская G42 сейчас владеет примерно 5 % акций Cerebras, примерно столько же сосредоточено в руках основателя Эндрю Фельдмана (Andrew Feldman). Компания G42 обязуется до марта 2025 года потратить около $1,43 млрд на покупку ускорителей Cerebras. По мере увеличения объёмов закупок G42 получит право купить большее количество акций американской компании. Пакетами акций Cerebras не менее 5 % владеют около шести институциональных инвесторов. Основатель и глава OpenAI Сэм Альтман (Sam Altman) также является акционером Cerebras, как и сооснователь Sun Microsystems Энди Бехтольсхайм (Andy Bechtolsheim). Новые правила экспортного контроля США облегчат поставки ускорителей вычислений на Ближний Восток

01.10.2024 [06:58],

Алексей Разин

Министерство торговли США, как сообщает Reuters, начало неделю с публикации нового правила экспортного контроля, которое теоретически способно облегчить поставки ускорителей вычислений на Ближний Восток, где они будут использоваться для строительства новых центров обработки данных.

Источник изображения: Nvidia С октября прошлого года экспортёры ускорителей вычислений из США должны получать специальные лицензии, дающие им возможность поставлять передовые ускорители вычислений в определённые районы Ближнего Востока и Центральной Азии. Каждая партия требовала отдельного согласования, что в значительной мере затрудняло поставки. Теперь же, как поясняет Reuters, центры обработки данных, которым требуются ускорители вычислений американского происхождения, смогут получить лицензию через подтверждение статуса верифицированного конечного пользователя. В этом случае конкретный получатель сможет запасаться ускорителями без необходимости отдельного согласования каждой поставки. Власти регионов, в которых расположены центры обработки данных, смогут оказать содействие их владельцам в оформлении необходимых для США документов. С одной стороны, на Ближнем Востоке появляется немало желающих развивать инфраструктуру вычислительных мощностей для систем искусственного интеллекта. С другой стороны, американские власти опасаются, что по этим каналам ускорители вычислений могут попасть в Китай, куда они не поставляются напрямую из-за санкций США. В апреле Microsoft объявила о намерениях вложить $1,5 млрд в капитал компании G42 из ОАЭ, которая собирается развивать в регионе направление систем искусственного интеллекта. Принято считать, что через эту сделку США купили лояльность ОАЭ в вопросах развития ИИ, а также предостерегли власти ближневосточной страны от потенциального сближения с Китаем. Чтобы получить статус верифицированного конечного пользователя, ближневосточные центры обработки данных будут проходить тщательную процедуру аудита. Информация о потенциальных клиентах этих ЦОД будет приниматься во внимание при выдаче экспортной лицензии. Количество и тип предоставляемых конкретному ЦОД ускорителей будет оговариваться американской стороной. AMD выпустила свою первую языковую модель ИИ — AMD-135M

01.10.2024 [01:18],

Николай Хижняк

Поскольку AMD пытается нарастить своё присутствие на рынке ИИ, производитель выпускает не только аппаратное обеспечение под эти нужды, но также решил заняться разработкой языковых моделей. Результатом этого стал анонс первой малой языковой AMD-135M.

Источник изображения: AMD Новая малая языковая модель AMD-135M принадлежит к семейству Llama и нацелена на развёртывание в частном бизнесе. Неясно, имеет ли новая ИИ-модель AMD какое-либо отношение к недавнему приобретению компанией стартапа Silo AI (сделка ещё не завершена и пока не одобрена различными регуляторами, поэтому, вероятно, нет). Однако это явный шаг в направлении удовлетворения потребностей конкретных клиентов с помощью предварительно обученной модели, созданной AMD с использованием её же оборудования. Преимущество языковой модели AMD заключается в том, что она использует так называемое спекулятивное декодирование. Последнее представляет собой меньшую «черновую модель», которая генерирует несколько токенов-кандидатов за один прямой проход. Затем токены передаются в более крупную, более точную «целевую модель», которая проверяет или исправляет их. С одной стороны, такой подход позволяет генерировать несколько токенов одновременно, но с другой стороны, это приводит к повышению потребляемой мощности за счёт увеличения передачи данных. Языковая модель AMD представлена в двух версиях: AMD-Llama-135M и AMD-Llama-135M-code. Каждая из них оптимизирована для определённых задач путём повышения производительности вывода с помощью технологии спекулятивного декодирования. Базовая модель AMD-Llama-135M была обучена с нуля на базе 670 млрд токенов общих данных. Этот процесс занял шесть дней с использованием четырех 8-канальных узлов на базе AMD Instinct MI250. Модель AMD-Llama-135M-code в свою очередь была улучшена за счёт дообучения на базе дополнительных 20 млрд токенов, специально ориентированных на написание программного кода. Дополнительное обучение модели заняло четыре дня с использованием того же набора оборудования AMD. Компания считает, что дальнейшие оптимизации её моделей могут привести к дополнительному повышению их производительности и эффективности. SoftBank вызвалась заменить Apple в списке ключевых инвесторов OpenAI

30.09.2024 [23:12],

Анжелла Марина

Японская инвестиционная холдинговая компания SoftBank планирует вложить $500 млн в OpenAI, разработчика чат-бота ChatGPT, сообщает Bloomberg. Инвестирование станет частью более крупного раунда финансирования, в ходе которого OpenAI рассчитывает привлечь $6,5 млрд при оценке компании в $150 млрд.

Источник изображения: OpenAI Лидером раунда предположительно выступит Thrive Capital при участии Microsoft, крупнейшего инвестора OpenAI, а также других инвесторов. В частности, компания обсуждала инвестиции с Nvidia и Apple. Однако последняя больше не участвует в переговорах об участии в раунде, зато в списке инвесторов возможно будет фигурировать SoftBank через свой фонд Vision Fund. Если сделка состоится, OpenAI закрепит за собой статус одного из самых дорогих стартапов в мире. Официальные представители OpenAI и SoftBank пока не дали комментариев по этому поводу. В то же время компания переживает не самый простой период. На прошлой неделе о своём уходе объявила технический директор и ключевой сотрудник OpenAI Мира Мурати (Mira Murati), что стало ещё одним звеном в цепи увольнений топ-менеджеров компании в этом году. Кроме того, по данным Bloomberg, OpenAI рассматривает возможность реструктуризации, чтобы стать полностью коммерческой организацией. Напомним, ранее основатели OpenAI позиционировали свою компанию как некоммерческую организацию, сосредоточившись на исследованиях в «создании положительного долгосрочного воздействия на человека». Отметим, что SoftBank ранее не проявлял инвестиционного интереса к OpenAI, однако поддерживал одного из его конкурентов. В частности, в июне Vision Fund, управляемый SoftBank Investment Advisers, дочерней компанией SoftBank, вложился в Perplexity AI — стартап, занимающийся поиском на основе искусственного интеллекта, оценив его в $3 млрд. Raspberry Pi и Sony представили модуль ИИ-камеры для «малинки» стоимостью $70

30.09.2024 [18:50],

Сергей Сурабекянц

Компании Raspberry Pi и Sony совместно разработали для микрокомпьютера Raspberry Pi модуль камеры с искусственным интеллектом. Новинка совместима со всеми версиями микрокомпьютера и не нуждается в дополнительных ускорителях или графическом процессоре. По утверждению Raspberry Pi, камера позволит пользователям с лёгкостью разрабатывать «передовые решения ИИ для обработки визуальных данных». Камера уже поступила в продажу по цене $70. Новая 12,3-мегапиксельная камера Raspberry Pi AI может снимать видео со скоростью 10 кадров в секунду с разрешением 4056 × 3040 пикселей или 40 кадров в секунду с разрешением 2028 × 1520 точек. Она имеет ручную регулировку фокуса, поле зрения 76 градусов и размеры 25 × 24 × 11,9 мм, что делает её практически идентичной по размерам модулю камеры 3, выпущенному Raspberry Pi в прошлом году. Камера совместима со всеми одноплатными компьютерами Raspberry Pi и объединяет чип микроконтроллера RP2040 с датчиком изображения Sony IMX500, который обеспечивает ИИ-функциональность устройства. Такое сочетание устраняет необходимость в дополнительных компонентах, таких как ускорители ИИ или графический процессор, которые обычно используются для обработки визуальных данных. Новая камера стала дальнейшим развитием планов Raspberry Pi по расширению ассортимента чипов и дополнений для своего микрокомпьютера. Начиная с 2013 года, компания выпустила несколько модулей камер без ИИ, а теперь предлагает и вариант с ИИ.  «Обработка изображений на базе ИИ становится привлекательным инструментом для разработчиков по всему миру, — сказал генеральный директор Raspberry Pi Эбен Аптон (Eben Upton). — Мы с нетерпением ждём, чего смогут достичь члены нашего сообщества, используя мощь камеры на базе ИИ Raspberry Pi». Huawei приступила к поставкам образцов новейших ускорителей Ascend 910C

30.09.2024 [09:25],

Алексей Разин

В прошлом месяце стало известно о завершении компанией Huawei Technologies разработки новых ускорителей вычислений на базе чипа Ascend 910C, которые по уровню быстродействия должны быть сопоставимы с попадающими под санкции США в Китае Nvidia H100. По данным китайских СМИ, крупные клиенты Huawei уже начали получать образцы ускорителей на базе Ascend 910C.

Источник изображения: Huawei Technologies Протестировав новинку Huawei, клиенты компании смогут сделать вывод о целесообразности дальнейшей закупки. Как отмечалось ранее, клиенты Huawei могут заказать до 70 тысяч таких ускорителей. В лучшем случае Huawei сможет выпускать от 1,3 до 1,4 млн ускорителей Ascend 910C, но всё будет зависеть от экспортных ограничений США, ведь если 7-нм чипы ускорителей для Huawei выпускает китайская SMIC, то память класса HBM китайским производителям до сих пор приходится получать из-за рубежа. Клиенты признались South China Morning Post, что Huawei нередко при покупке ускорителей Ascend навязывает им свою сопутствующую продукцию типа телекоммуникационного оборудования и систем хранения данных. Nvidia сохранила возможность поставлять в Китай ускорители H20 и сейчас готовит для местного рынка B20, и многие крупные игроки рынка облачных услуг в Китае продолжают закупать решения этого американского поставщика, чтобы сохранить совместимость с уже работающими проектами и обеспечить себя и клиентов технической поддержкой Nvidia. По некоторым прогнозам, Nvidia в этом году поставит в Китай не менее 1 млн ускорителей H20, а её выручка на местном рынке достигнет $12 млрд даже в условиях санкций. Google представила технологию проектирования микросхем AlphaChip с помощью ИИ

28.09.2024 [19:35],

Павел Котов

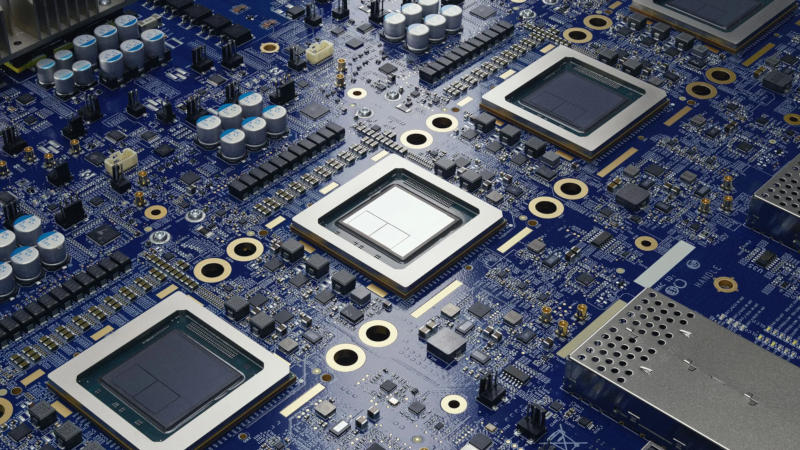

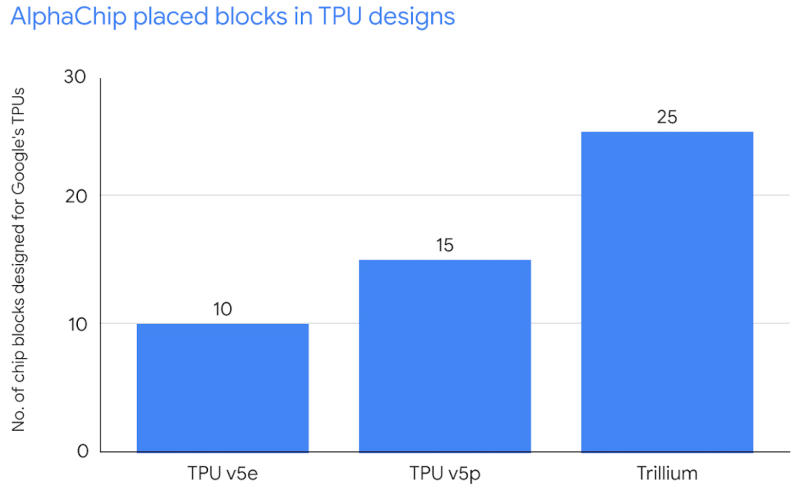

Google представила AlphaChip — метод обучения искусственного интеллекта с подкреплением для проектирования микросхем. Он обещает значительно ускорить проектирование плана кристалла, а также усовершенствовать чипы с точки зрения производительности, мощности и площади. Google использовала это решение при проектировании ИИ-ускорителей TPU (Tensor Processing Unit), применяли его и другие компании, включая MediaTek.

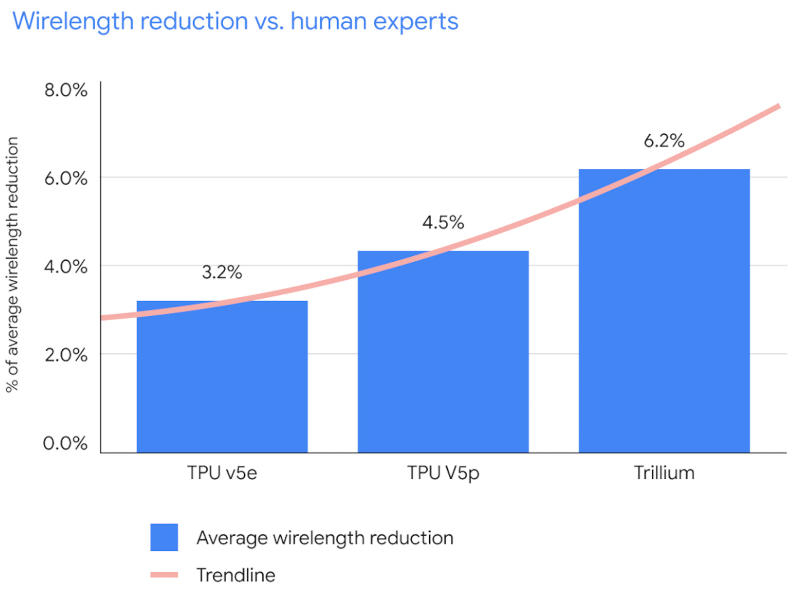

Источник изображений: Google Проектный макет микросхемы или план кристалла является самым долгим и трудоёмким этапом разработки полупроводникового компонента. Synopsys, которая выпускает ПО для проектирования чипов, внедрила ИИ для решения этой задачи, но её продукт имеет очень высокую цену. Google решила демократизировать этот подход. В настоящий момент создание плана кристалла для сложной микросхемы, например, графического процессора, занимает около двух лет, если его разрабатывают люди. Менее сложные компоненты проектируются за несколько месяцев, но этот процесс сопряжён с миллионными затратами, поскольку крупные производители привлекают значительное число специалистов. AlphaChip, по утверждению Google, решает задачу за несколько часов. Более того, эта система выдаёт превосходный результат, оптимизированный по производительности и энергоэффективности. Google также продемонстрировала график, который показывает сокращение длины проводников в предыдущих версиях TPU и новом Trillium.  Основу механизма работы AlphaChip составляет модель обучения с подкреплением, при которой ИИ выполняет операцию в заранее заданной среде, изучает результаты и учится на этом опыте, чтобы повысить качество работы в будущем. В случае AlphaChip проектирование плана кристалла ИИ рассматривает как своего рода игру, за один ход которой на поле размещается один компонент схемы. Нейросеть помогает выстроить граф взаимосвязей между компонентами, и чем больше макетов создаёт система, тем выше качество её работы. Google использует AlphaChip в разработке ИИ-ускорителей TPU с 2020 года — на них компания запускает крупномасштабные модели ИИ и облачные службы. На этих процессорах работают модели-трансформеры — эта архитектура используется в Gemini и Imagen. Система AlphaChip помогала совершенствовать схему каждого последующего поколения TPU, включая новейшие Trillium — она сокращала время разработки и обеспечивала более высокую производительность. Тем не менее, и Google, и MediaTek используют эту систему для ограниченного набора блоков, а значительную часть работы проделывает всё-таки человек.  Помимо Google TPU, AlphaChip использовалась при проектировании мобильных 5G-чипов MediaTek Dimensity, которые широко применяются в актуальных смартфонах. Система была предварительно обучена на широком ассортименте микросхем, говорят в Google, что позволяет ей генерировать все более эффективные макеты по мере проделанного объёма работы. Человек учится быстро, а ИИ — ещё быстрее. Успех AlphaChip побудил Google продолжить внедрение ИИ на разных этапах проектирования микросхем, включая логический синтез, выбор макросов и оптимизацию по времени — Synopsys и Cadence предлагают это за большие деньги. Компания считает, что в перспективе AlphaChip можно будет применять на всём цикле разработки чипов от проектирования архитектуры до компоновки и производства — оптимизация при помощи ИИ поможет ускорить микросхемы, сделать их компактнее, энергоэффективнее и дешевле. В будущем решение будет использоваться не только для серверных ускорителей Google и мобильных платформ MediaTek. Разработка AlphaChip продолжается. Регуляторы рекомендуют китайским разработчикам отказываться от ускорителей Nvidia в пользу китайских аналогов

28.09.2024 [07:29],

Алексей Разин

Пока действия китайских властей больше соответствуют понятию «рекомендаций», но они всё настойчивее призывают китайских участников рынка систем искусственного интеллекта приобретать компоненты местной разработки, отказываясь от ускорителей Nvidia, ассортимент которых в Китае и так ограничен из-за санкций США.

Источник изображения: Nvidia

О таком поведении китайских чиновников накануне сообщило агентство Bloomberg. На данном этапе регуляторы в КНР стараются не слишком сильно давить на местных разработчиков систем искусственного интеллекта, поскольку чиновники стараются соблюсти баланс между поощрением импортозамещения и ограничением китайских компаний в вычислительных ресурсах. Отказ от ускорителей Nvidia без наличия адекватных альтернатив китайского происхождения, в конце концов, просто пойдёт во вред китайской отрасли искусственного интеллекта. Поскольку самой современной серией ускорителей Nvidia, которые легально можно купить в Китае, является H20, усилия местных чиновников сосредоточены на миграции разработчиков с этих решений американской компании в сторону компонентов китайских Cambricon и Huawei. В то же время, китайские власти осознают, что санкции США могут усилиться, а потому местные компании нужно активнее готовить к такому сценарию заблаговременно. Рекомендации по ограничению использования ускорителей Nvidia некоторые китайские министерства начали распространять ещё несколько месяцев назад, по данным Bloomberg. При этом чиновники закрывают глаза на те случаи, когда покупка компаниями ускорителей западного происхождения позволяет разработчикам построить более производительные и совершенные центры обработки данных. Интересно, что основатель Nvidia Дженсен Хуанг (Jensen Huang) накануне заявил о своём стремлении наилучшим образом удовлетворить запросы китайских клиентов, учитывая при этом требования американского законодательства. Он подчеркнул, что Nvidia будет делать всё от себя зависящее, чтобы поддерживать китайских клиентов. Во втором квартале Nvidia около 12 % всей своей выручки получила на территории Китая и Гонконга, сумма в размере $3,7 млрд оказалась более чем на 30 % выше прошлогодней за сопоставимый период. При этом руководство компании было вынуждено признать, что американские санкции снизили выручку Nvidia в Китае. В неофициальных комментариях источники Bloomberg пояснили, что некоторые китайские компании спешно закупают ускорители Nvidia H20, формируя запасы на случай дальнейшего усугубления американских санкций, а китайские ускорители Huawei они при этом покупают, чтобы формально следовать рекомендациям местных властей. |