|

Опрос

|

реклама

Быстрый переход

Anthropic ускорила рост в США и заметно сократила отставание от OpenAI на корпоративном рынке ИИ-сервисов

11.04.2026 [14:14],

Дмитрий Федоров

Anthropic сократила разрыв с OpenAI на рынке платных ИИ-сервисов для американского бизнеса. В марте её инструменты оплачивала почти треть компаний в США, тогда как доля OpenAI не выросла и осталась на уровне 35 %. Данные финтех-компании Ramp показывают ускорение спроса на решения Anthropic и выравнивание роста OpenAI после раннего рывка, вызванного запуском ChatGPT.

Источник изображения: anthropic.com Ramp связывает рост Anthropic с высоким спросом на линейку Claude Code и набор расширений для автоматизации части задач умственного и административного труда. Оценка основана на ежегодных расходах 50 тыс. клиентов по банковским картам и выставленным счетам на общую сумму $100 млрд. За месяц доля компаний в США, плативших за инструменты Anthropic, выросла более чем на 6 процентных пунктов. OpenAI сохраняет лидерство, обеспеченное запуском ChatGPT в ноябре 2022 года, прежде всего на массовом рынке: компания заявляла о 900 млн еженедельно активных пользователей, из которых платят немногим более 5 %. По оценке Sensor Tower, в марте число загрузок ChatGPT выросло лишь на 5 %, тогда как у Claude за тот же период мировые загрузки утроились и достигли 21 млн. На этой неделе Anthropic заявила, что довела выручку в пересчёте на год по текущему темпу до $30 млрд против $9 млрд в конце 2025 года. Аналитическая компания Apptopia зафиксировала в марте первое с начала 2024 года снижение числа еженедельно активных пользователей ChatGPT в США по сравнению с предыдущим месяцем. OpenAI эти данные не признала и заявила, что её инструмент для программирования на основе ИИ Codex увеличил недельную аудиторию до 3 млн пользователей против 2 млн месяцем ранее. OpenAI перестраивает управление и усиливает внимание к основным направлениям бизнеса перед планируемым выходом на биржу. Это уже привело к кадровым перестановкам и отказу от второстепенных направлений, из-за чего компания закрыла сервис создания видео Sora. Вице-президент и ведущий аналитик Forrester Чарли Дай (Charlie Dai) назвал происходящее явным сдвигом динамики в пользу Anthropic. По его словам, рост компании продолжается и после того, как Министерство войны США (DoW) указало на возможные риски в цепочке снабжения. Для многих компаний важнее краткосрочных политических и надзорных сигналов качество работы ИИ-моделей, удобство работы с ними и соответствие потребностям крупных организаций. Экономист Ramp Ара Харазян (Ara Kharazian) связал рост Anthropic с её стратегией: сначала компания ориентировалась на разработчиков и других специалистов, а затем начала выходить на более широкую аудиторию. По его оценке, Anthropic сумела превратить продукт для наиболее опытных пользователей и тех, кто осваивает новинки раньше других, в решение, применимое и за пределами этого круга. По данным Ramp, продукты Anthropic в США используются шире, чем решения OpenAI, в информационном секторе, финансовых услугах и сфере профессиональных услуг. Одновременно их распространение быстро растёт в строительстве и гостиничном деле. OpenAI ранее оспаривала точность оценок Ramp, утверждая, что они не учитывают многомиллионные договоры с крупными компаниями. Сооснователь Ramp Эрик Глайман (Eric Glyman) сообщал в сети X, что корпоративная платёжная платформа компании обрабатывает платежи объёмом до 1 % валового внутреннего продукта США, а её оценки согласуются с показателями выручки OpenAI и Anthropic. Anthropic временно заблокировала создателя OpenClaw в Claude, но быстро отыграла назад

11.04.2026 [12:58],

Дмитрий Федоров

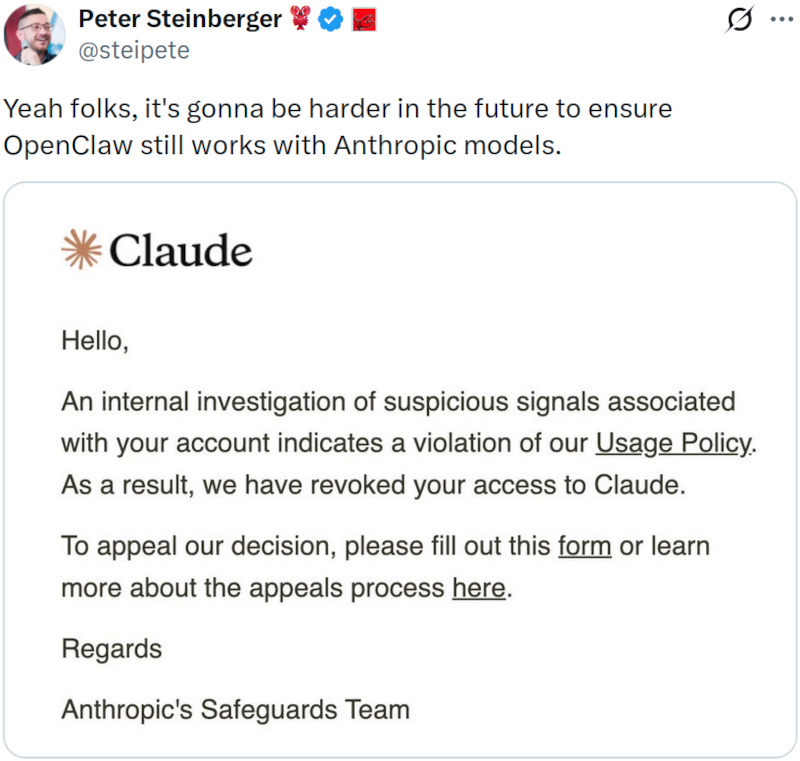

Anthropic на несколько часов заблокировала доступ к Claude создателю OpenClaw Петеру Штайнбергеру (Peter Steinberger), а затем восстановила аккаунт после резонанса в соцсети X. Инцидент произошёл вскоре после того, как компания вывела OpenClaw из подписки на Claude и перевела такую работу на отдельную оплату через программный интерфейс (API), хотя Штайнбергер утверждал, что уже соблюдал новые правила.

Источник изображения: openclaw.ai Штайнбергер написал в X, что поддерживать совместимость OpenClaw с ИИ-моделями Anthropic теперь будет сложнее, и приложил уведомление о блокировке учётной записи из-за «подозрительной» активности. Среди сотен комментариев появился ответ инженера Anthropic. Он написал, что компания никогда не блокировала пользователей за работу с OpenClaw, и предложил помочь. Повлияло ли это на разблокировку, неясно.

Источник изображения: @steipete / x.com Блокировка последовала за пересмотром условий работы с Claude. На прошлой неделе Anthropic объявила, что подписка больше не покрывает сторонние управляющие оболочки, включая OpenClaw. Теперь такая работа оплачивается отдельно, по объёму использования, через API Claude. Компания объяснила это тем, что подписка не рассчитана на такую нагрузку. Подобные оболочки могут требовать больше вычислительных ресурсов, чем обычные запросы или простые сценарии, поскольку способны непрерывно запускать циклы рассуждения, автоматически повторять или перезапускать задачи и связываться со множеством сторонних инструментов. Штайнбергер это объяснение отверг. После изменения правил оплаты он написал, что Anthropic сначала перенесла часть популярных функций в собственную закрытую оболочку, а затем отсекла решения с открытым исходным кодом. Он не уточнил, что именно имеет в виду, но речь могла идти о новых возможностях помощника Cowork, включая Claude Dispatch для удалённого управления агентами и назначения задач. Dispatch появился за пару недель до изменения ценовой политики для OpenClaw. Дополнительное внимание к истории привлекло то, что Штайнбергер работает в OpenAI, конкуренте Anthropic. На реплику о том, что он выбрал не ту компанию, Штайнбергер ответил: «Одни меня приняли, другие прислали юридические угрозы». На вопрос, зачем он использует Claude вместо ИИ-моделей работодателя, Штайнбергер ответил, что обращается к нему только для тестирования, чтобы обновления OpenClaw не нарушили работу у пользователей Claude. Он отделил работу в OpenClaw, где задача его состоит в обеспечении совместимости с любым поставщиком ИИ-моделей, от работы в OpenAI, связанной с дальнейшей продуктовой стратегией. Комментаторы также указали, что Claude остаётся более популярным выбором среди пользователей OpenClaw, чем ChatGPT. Исследователи c помощью ИИ превратили обычные умные часы в систему точного отслеживания движений руки

10.04.2026 [21:26],

Сергей Сурабекянц

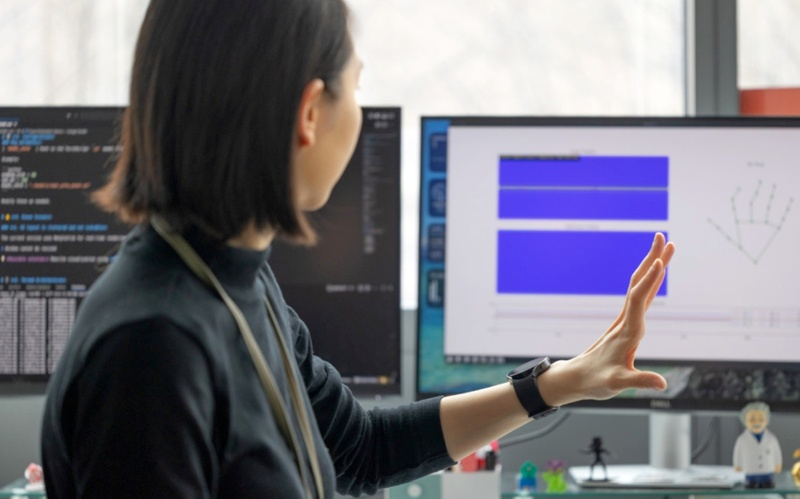

Учёные из Корнельского университета и Корейского института передовых технологий (KAIST) разработали систему WatchHand, которая при помощи искусственного интеллекта превращает обычные умные часы в устройство отслеживания движений рук. WatchHand работает в режиме реального времени, использует встроенный динамик и микрофон стандартных умных часов и не требует никакого дополнительного оборудования.

Источник изображения: Jason Koski / Cornell University Принцип работы системы заключается в излучении неслышимых звуковых волн из динамика умных часов. Отражённые волны считываются микрофоном устройства, создавая эхо-профиль. Алгоритм машинного обучения обрабатывает эти данные непосредственно на устройстве для оценки положения руки в трёх измерениях. В отличие от существующих носимых систем отслеживания движений рук, которые полагаются на камеры или громоздкие внешние датчики, WatchHand не требует дополнительного оборудования. Это делает систему значительно более практичной для повседневного использования и масштабируемой для миллионов существующих устройств. Система была протестирована на 40 участниках в четырёх отдельных исследованиях, собрав около 36 часов данных о жестах. Она оценивалась на нескольких моделях умных часов, при различных положениях рук и в шумной обстановке. Результаты показали, что WatchHand может надёжно отслеживать движения пальцев и вращения запястья в различных условиях.

Источник изображений: unsplash.com Цель исследователей — сделать саму человеческую руку устройством ввода для взаимодействия с компьютерами и другими цифровыми системами, уменьшив зависимость от клавиатур, мышей и сенсорных экранов. «В будущем, благодаря такой технологии отслеживания движений рук, мы, возможно, сможем набирать текст с помощью одних только умных часов, — полагает аспирант Корнельского университета и соавтор исследования Чи-Джунг Ли (Chi-Jung Lee). — Наши руки могут выступать в качестве устройства ввода для компьютеров». Технология может обеспечить работу с целым рядом приложений, включая управление компьютерами на основе жестов, системы дополненной и виртуальной реальности, а также вспомогательные инструменты для пользователей с ограниченной подвижностью или речью. «WatchHand существенно снижает барьеры для отслеживания положения рук, — подчеркнул аспирант KAIST и соавтор исследования Дживан Ким (Jiwan Kim). — Если у какого-либо устройства есть динамик и микрофон, наш подход применим». Система обрабатывает все данные локально на умных часах, решая проблемы конфиденциальности, связанные с облачными системами отслеживания. Это также снижает задержку, обеспечивая взаимодействие в реальном времени без необходимости внешних вычислений. WatchHand основана на акустической подсистеме носимых устройств, что предполагает преимущества в энергоэффективности и точности по сравнению с системами на основе машинного зрения.  «WatchHand отражает более широкое видение моей лаборатории по превращению обычных носимых устройств в интеллектуальные платформы для отслеживания поведения, — заявил доцент Корнельского университета Ченг Чжан (Cheng Zhang). — С помощью простого обновления программного обеспечения мы потенциально можем разблокировать совершенно новые возможности на миллионах существующих устройств». Однако у технологии пока есть ограничения. В настоящее время она работает только на умных часах на базе Android и испытывает трудности с поддержанием точности, когда пользователь находится в движении, например, при ходьбе. Исследователи работают над улучшением производительности в этих условиях. Результаты исследования будут представлены на конференции ACM CHI по человеческому фактору в вычислительных системах. Амбициозный китайский боевик Phantom Blade Zero создавался без применения генеративного ИИ — игра вышла на финишную прямую

10.04.2026 [12:46],

Михаил Романов

Глава китайской студии S-Game Лян Цивэй (Liang Qiwei) рассказал о ходе разработки амбициозного фэнтезийного ролевого боевика с полуоткрытым миром Phantom Blade Zero и прояснил позицию команды в отношении генеративного ИИ. Напомним, последний раз разработчики Phantom Blade Zero выходили на связь в декабре. На церемонии The Game Awards 2025 была объявлена дата релиза игры — 9 сентября 2026 года. По словам Цивэя, сейчас Phantom Blade Zero находится на финальных, «напряжённых» фазах производства: «Вкладываем все доступные ресурсы в доведение каждого аспекта игры до абсолютного предела наших возможностей». Цивэй также заверил, что весь контент Phantom Blade Zero создан руками человека — ни для одного элемента игры (модели персонажей и оружия, анимации, окружение) генеративный ИИ не привлекался. «Мы не используем визуальные ИИ-технологии, которые могут изменить креативный замысел наших художников. <...> Твёрдо верим, что человеческое творчество — не просто средство создания ценности, а сама ценность и есть», — заявил Цивэй. Игроки Phantom Blade Zero возьмут на себя роль Соула — элитного убийцы неуловимой организации «Орден», несправедливо обвинённого в смерти её патриарха. За 66 дней герой должен раскрыть заговор и доказать невиновность. Phantom Blade Zero создаётся для PC (Steam) и PS5. Обещают смесь кунг-фу-панка, стимпанка и оккультизма, эффектную боевую систему, более 30 видов оружия, графику на Unreal Engine 5 и текстовый перевод на русский язык. Приложение Meta✴ AI взлетело на 5 место в App Store после запуска Muse Spark

10.04.2026 [06:06],

Анжелла Марина

Приложение Meta✴✴ AI поднялось на пятое место в американском App Store после запуска новой ИИ-модели Muse Spark. Как сообщает TechCrunch со ссылкой на данные платформы Appfigures, всего за сутки приложение переместилось с 57-й позиции на пятую строчку рейтинга.

Источник изображения: Mariia Shalabaieva/Unsplash Meta✴✴ называет Muse Spark значительным улучшением по сравнению с предыдущими моделями Llama. Модель доступна в веб-версии и на мобильных устройствах, принимает мультимодальный ввод посредством голоса, текста и изображения. Muse Spark помогает разбираться в вопросах здоровья, решать сложные задачи по математике и естественным наукам, а также создавать сайты и мини-игры по текстовым запросам и запускать несколько субагентов для обработки пользовательских запросов. Несмотря на продвижение в рейтинге, приложение Meta✴✴ AI пока уступает конкурентам. ChatGPT занимает первое место, Claude от Anthropic второе, Gemini — третье. Попытки Meta✴✴ догнать лидеров рынка уже обошлись компании в миллиарды долларов, не считая инвестиций в компанию Scale AI (специализируется на подготовке данных для обучения ИИ) в размере $14,3 млрд.

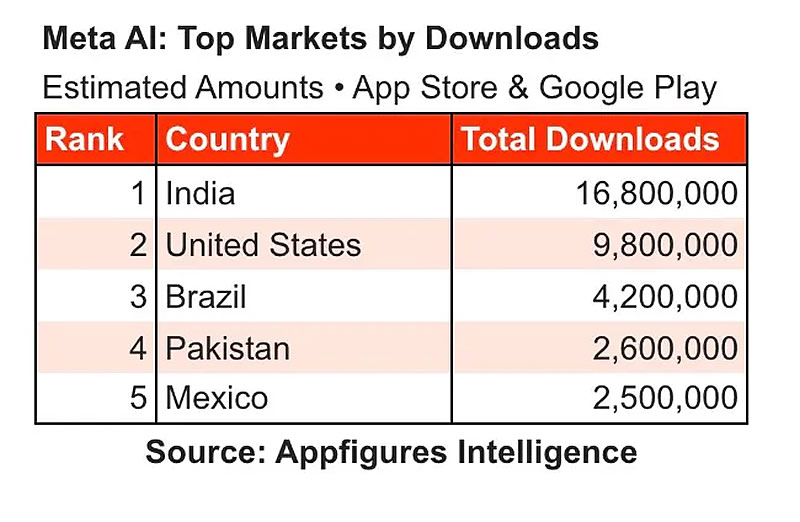

Источник изображения: Appfigures Всего приложение Meta✴✴ AI было установлено 60,5 миллиона раз по всему миру на платформах App Store и Google Play, из них 25 миллионов только в этом году. За последние пять месяцев число загрузок выросло на 138 % по сравнению с первыми пятью месяцами после запуска. Крупнейшим рынком по числу скачиваний стала Индия, за ней следуют США, Бразилия, Пакистан и Мексика. Это первый крупный релиз под руководством Александра Вана (Alexandr Wang), возглавившего подразделение Meta✴✴ Superintelligence Labs. В ближайшие недели модель появится в WhatsApp, Instagram✴✴, Facebook✴✴, Messenger и умных очках Meta✴✴. Новая статья: Аналоговый ИИ: теперь и на конденсаторах

10.04.2026 [00:03],

3DNews Team

Данные берутся из публикации Аналоговый ИИ: теперь и на конденсаторах Глава Amazon назвал оправданными $200 млрд инвестиций в ИИ

09.04.2026 [20:23],

Владимир Фетисов

Генеральный директор Amazon Энди Джасси (Andy Jassy) опубликовал ежегодное письмо акционерам. В этом послании он снова аргументировал для инвесторов с Уолл-стрит оправданность огромных вложений компании в технологии искусственного интеллекта.

Источник изображения: Marques Thomas / Unsplash «Мы не собираемся действовать консервативно в этом вопросе — мы инвестируем, чтобы стать значимым лидером, и благодаря этому наш будущий бизнес, операционный доход и свободный денежный поток станут значительно больше», — говорится в письме Джасси. В феврале Amazon объявила, что капитальные расходы в этом году составят около $200 млрд, причём львиная доля этой суммы пойдёт на расширение ИИ-инфраструктуры, включая центры обработки данных, ускорители и прочее сетевое оборудование. Озвученный объём инвестиций превышает расходы любого из технологических конкурентов компании и почти на 60 % больше суммы, которую Amazon потратила в прошлом году. Акции Amazon в текущем году теряют в цене, поскольку инвесторы ставят под сомнение агрессивные планы компании по тратам в сфере ИИ, а также становятся всё более нетерпеливыми в ожидании окупаемости своих вложений. С начала года стоимость ценных бумаг Amazon снизилась более чем на 4 %. Джасси ранее заявлял, что компании нужны капиталовложения, чтобы «воспользоваться возможностью, которая даётся раз в жизни», и соответствовать «очень высокому спросу» на предлагаемые компанией вычислительные мощности для сферы ИИ. В письме акционерам глава Amazon повторил этот аргумент, а также впервые сообщил, что выручка от услуг ИИ в сегменте облачных вычислений достигла $15 млрд. «Мы инвестируем примерно $200 млрд в капитальные расходы в 2026 году не по наитию», — заявил Джасси. Он особо отметил обязательства OpenAI на сумму свыше $100 млрд, добавив, что Amazon получила от клиентов подтверждённые обязательства на «значительную часть» капитальных расходов, в связи с чем компания рассчитывает монетизировать большую их часть в 2027–2028 годах. В сообщении также говорится, что бизнес Amazon по производству собственных чипов превысил $20 млрд и «растёт на сотни процентов» год к году. Джасси, занявший пост гендиректора Amazon в 2021 году после ухода основателя компании Джеффа Безоса (Jeff Bezos), в своём послании напомнил о письме своего предшественника к инвесторам с Уолл-стрит. Оно было написано несколькими десятилетиями ранее, когда Amazon оставалась убыточной на протяжении многих лет. В нём Безос говорил, что долгосрочный рост важнее краткосрочной прибыли, испытывая тем самым терпение инвесторов. В тот период компания вкладывала значительные средства в развитие облачных вычислений, складской инфраструктуры и разработку устройств. В конечном счёте Amazon начала приносить солидную прибыль и заняла доминирующую позицию на новых рынках. Сейчас Джасси заявил, что компания использует возможности, которые со временем могут стать мощными опорами или драйверами роста для Amazon. Он указал на бурно развивающийся бизнес по производству чипов и отметил рост продуктового подразделения, службы экспресс-доставки и ещё не реализованный проект сервиса спутникового интернета. «Мы готовы делать крупные капитальные вложения и мириться с краткосрочными трудностями в отношении свободного денежного потока ради существенного прироста свободного денежного потока в среднесрочной и долгосрочной перспективе», — заявил Джасси. «Знает рецепт Gemini и не тратит ни доллара впустую»: стартап экс-сотрудников DeepMind будет развивать визуальный ИИ

09.04.2026 [20:19],

Сергей Сурабекянц

Бывший исследователь Google DeepMind Эндрю Дай (Andrew Dai) считает, что модели ИИ в крупных лабораториях обладают интеллектом трёхлетнего ребёнка, по крайней мере, когда дело доходит до понимания визуальных подсказок. Поэтому он с единомышленниками зарегистрировал компанию, которая займётся разработкой ИИ, способного лучше понимать изображения. По словам Дая, это может ускорить внедрение ИИ в таких отраслях, как архитектура, автомобилестроение и робототехника.

Источник изображения: unsplash.com Сегодня компания Elorian получила $55 млн финансирования, а её биржевая оценка сразу достигла отметки в $300 млн. Кроме Дая соучредителями Elorian выступили Иньфэй Ян (Yinfei Yang), работавший над исследованиями в области ИИ в Google и Apple, и Сет Нил (Seth Neel), бывший профессор Гарварда, занимавшийся исследованиями данных и искусственного интеллекта. В число инвесторов входят Striker Venture Partners, Menlo Ventures и Altimeter Capital, а также Nvidia и известный исследователь ИИ Джефф Дин (Jeff Dean). На сегодняшний день уже более десятка сотрудников работает над созданием эффективных визуальных моделей. Компания ведёт переговоры с потенциальными клиентами и планирует выпустить свою первую общедоступную модель логического мышления примерно через 12 месяцев. По словам Elorian, чтобы помочь ИИ понимать окружающий мир, технологической индустрии необходимо создавать модели, разработанные специально для этой цели. Несмотря на вложенные миллиарды долларов, сегодняшние модели по-прежнему плохо справляются, например, с визуальным анализом спутниковых снимков или исследованием деталей изображений.

Источник изображений: Elorian Elorian разрабатывает свои первые продукты на основе искусственного интеллекта, используя модели с открытым исходным кодом, которые можно свободно использовать и модифицировать. Компания рассматривает возможность выпуска более компактных версий своих моделей для сообщества открытого исходного кода, но, скорее всего, сохранит флагманскую версию в качестве проприетарной. Хотя программирование вывело возможности логического мышления на совершенно новый уровень, Дай считает, что модели по-прежнему не могут принимать важные решения о том, как создавать более совершенные автомобили или эффективные ракеты. «Это не то, что можно просто выразить с помощью кода и получить более быструю ракету, — считает он. — Вам действительно нужно спроектировать физический объект — и этот проект существует в физическом мире». Дай принадлежит к волне исследователей, покинувших лаборатории в поисках более специализированной работы в быстро меняющемся мире ИИ. Он подчеркнул, что компания меньше сосредоточена на создании медиаконтента и больше заинтересована в возможностях логического мышления. «Гораздо проще создать что-то, что выглядит великолепно, но гораздо сложнее рассуждать об этом, понимать это, объяснять кому-то, что это делает», — полагает он. \  Дай отказался от завышения биржевой оценки стартапа на начальном этапе — отчасти для того, чтобы гарантировать своим первым сотрудникам существенную финансовую выгоду. «Если вы начинаете с очень высокой оценки, то им будет очень сложно увидеть 50- или 100-кратное увеличение стоимости их акций, и мы хотели дать им такую возможность», — сказал он. Инвесторы отмечают, что такая философия привлечения новых сотрудников, наряду с наймом нескольких других ведущих исследователей из DeepMind, во многом повлияла на их интерес к поддержке Elorian. Аналитики и инвесторы ожидают, что компания будет более эффективной, чем другие передовые лаборатории, благодаря опыту Дая в создания Gemini. «Все остальные в передовых лабораториях просто привлекают деньги для проведения экспериментов, — заявил представитель инвесторов. — Эндрю знает рецепт Gemini — он не тратит ни доллара впустую». Трудно сказать, насколько они правы, на сайте стартапа пока не представлено никакой информации кроме опции отправки электронной почты. OpenAI заморозила проект Stargate UK из-за взлетевших цен на электроэнергию

09.04.2026 [17:36],

Дмитрий Федоров

OpenAI приостановила проект Stargate в Великобритании из-за высокой стоимости электроэнергии и условий государственного регулирования. Проект, который компания готовила вместе с Nscale и Nvidia, предусматривал ввод до 8000 графических процессоров (GPU) с возможностью последующего расширения до 31000 и считался одним из опорных элементов британской стратегии в сфере ИИ.

Источник изображения: Zac Wolff / unsplash.com Представитель OpenAI заявил, что компания продолжает изучать возможности Stargate UK и вернётся к проекту, когда регулирование и стоимость электроэнергии позволят вкладывать средства в инфраструктуру на длительный срок. Источник CNBC, напрямую знакомый с ситуацией, сказал, что OpenAI и Nscale продолжают обсуждать будущее проекта. Промышленные цены на электроэнергию в Великобритании остаются одними из самых высоких в мире. Собеседники CNBC, ранее критиковавшие развитие британской инфраструктуры для ИИ, называли главными препятствиями дорогую электроэнергию и задержки с подключением к общенациональной электросети. OpenAI объявила о проекте в сентябре 2025 года и подписала с правительством Великобритании меморандум о взаимопонимании. Проект планировали разместить на нескольких площадках, включая Cobalt Park, который войдёт в новую зону роста ИИ на северо-востоке Англии. Компания собиралась в I квартале 2026 года проработать получение до 8000 GPU с возможностью со временем увеличить их число до 31000. Эти мощности должны были обеспечить работу ИИ-моделей OpenAI на вычислительных ресурсах внутри страны для критически важных государственных служб, регулируемых отраслей, включая финансы, а также целей в области национальной безопасности. На решение OpenAI повлиял также спор вокруг авторского права. В марте Financial Times написала, что британские власти решили отложить изменение правил, которое упростило бы ИИ-компаниям использование материалов СМИ. Позднее в том же месяце правительство опубликовало доклад, где говорится, что большинство участников общественного обсуждения отвергли первоначальный вариант правил. Представители творческих отраслей опасались, что ИИ сможет обучаться на их произведениях без вознаграждения и затем напрямую конкурировать с ними. OpenAI заявила, что по-прежнему видит большой потенциал британского рынка ИИ, считает Лондон местом расположения своего крупнейшего международного исследовательского центра и продолжает расширять работу в стране, одновременно исполняя обязательства по меморандуму с правительством о внедрении передовых ИИ-систем в британские государственные службы. «Союзмультфильм» начнёт применять ИИ при производстве мультфильмов

09.04.2026 [11:45],

Владимир Фетисов

Киностудия «Союзмультфильм» в нынешнем году полностью перейдёт на гибридную модель производства, которая сочетает традиционную анимацию с технологиями на базе искусственного интеллекта. Об этом рассказала генеральный директор киностудии им. М. Горького, председатель совета директоров «Союзмультфильма» Юлиана Слащева.

Источник изображения: BoliviaInteligente/unsplash.com «В «Союзмультфильме» работа с ИИ уже является частью ежедневной повестки и стратегического планирования, а к концу года все наше производство анимации станет гибридом традиционных технологий и ИИ», — рассказала Юлиана Слащева. Она добавила, что трансформация индустрии требует пересмотра подходов к производству контента. Было отмечено, что не все участники рынка смогут адаптироваться к этим изменениям. Для сохранения нынешних позиций студиям необходимо активно внедрять технологии и пересматривать производственные процессы. Слащева также обратила внимание на изменение медиапотребления и развитие стратегии «360». «Сегодня дети живут в цифровой среде и постоянно переключаются между форматами, поэтому важно присутствовать сразу в нескольких средах и создавать больше точек контакта с аудиторией», — считает глава «Союзмультфильма». В ходе интервью было сказано, что студия ведёт разработку цифровой платформы для размещения пользовательского контента. «Если мы не возглавим этот тренд сейчас, то можем потерять аудиторию нового поколения», — считает Слащева. По её словам, новая платформа будет запущена позднее в этом году. «Я использую зверя, чтобы победить зверя»: американцы применяют нейросети для борьбы с ИИ ЦОД

08.04.2026 [20:11],

Сергей Сурабекянц

Общественные активисты в сельских регионах США используют искусственный интеллект в своей борьбе против технологических гигантов и массированного строительства центров обработки данных (ЦОД) «на их заднем дворе». Они осознают всю иронию ситуации, но утверждают, что, несмотря на опасения по поводу этой технологии, ИИ помогает ускорить их волонтёрскую деятельность. Активисты используют ИИ, работающий на базе ЦОД, чтобы противостоять его создателю.

Источник изображений: unsplash.com Огайо, где сейчас расположено более 200 дата-центров, является одним из ведущих мест в США для размещения ЦОД, несмотря на негативную реакцию местных жителей. Они опасаются, что дата-центры приведут к росту цен на электроэнергию и нанесут ущерб местной окружающей среде, большая часть которой — сельскохозяйственные угодья. По данным Международного энергетического агентства, к концу этого десятилетия на центры обработки данных придётся около половины роста спроса на электроэнергию в США, значительная часть которой вырабатывается на ТЭЦ. Опасения по поводу ЦОД многогранны: жители беспокоятся о ценах на электроэнергию, изменении климата, нагрузке на электросеть и систему водоснабжения, загрязнении воздуха, снижении стоимости недвижимости, шуме и даже о потенциальном неприглядном виде самих зданий, которые обычно представляют собой большие бетонные сооружения. Однако здания для размещения систем искусственного интеллекта строятся массово по всей стране, особенно в таких штатах, как Огайо, которые предлагают крупным технологическим компаниям налоговые льготы и другие преимущества.  Социальный работник Джессика Шарп (Jessica Sharp) просит чата-бота помочь ей в борьбе со строительством ЦОД всего в нескольких шагах от её дома. Она говорит, что старается минимизировать использование ИИ из-за потребляемой им энергии, но технология экономит ей время, помогая расшифровывать протоколы собраний и ускоряя юридические исследования. Риелтор Джессика Бейкер (Jessica Baker) в борьбе со строительством ЦОД использует нейросеть для составления запросов на предоставление документов. «Я использую зверя, чтобы победить зверя», — говорит Бейкер. Технологии также помогли активистам координировать свои действия и распространять информацию. Бейкер и Шарп делятся информацией в соцсетях. Несколько местных групп, выступающих против ЦОД всего за несколько месяцев собрали тысячи участников. Тем временем Бейкер публикует в Сети то, что она называет «видеороликами с гневными высказываниями» — первый из которых набрал около полумиллиона просмотров. Компания Amazon заявила, что строительство дата-центров создаст как минимум 100 новых долгосрочных рабочих мест и профинансирует до $35 млн на улучшение общественной инфраструктуры. «Мы знаем, что любое новое строительство может вызвать вопросы в обществе, и мы считаем важным разработать решения, которые действительно учитывают опасения сообщества», — заявил представитель компании.  Существуют противоречивые мнения относительно экономических преимуществ, которые дата-центры могут принести сообществу. Некоммерческая организация JobsOhio утверждает, что дата-центры «создают позитивный экономический импульс» для Огайо, создавая рабочие места и привлекая таланты. Однако, по данным государственного агентства Ohio Consumers’ Counsel, хотя строительство приносит краткосрочный приток рабочих мест, эти возможности исчезают после завершения строительства объектов. Исследовательская компания Data Center Watch, отслеживающая противодействие строительству ЦОД сообщает, что по всей стране местные власти заблокировали или отложили около 20 проектов, общая сумма инвестиций в которые во втором квартале прошлого года составила почти $100 млрд. Некоторые штаты принимают специальные поправки к законодательству: например, Мэн стал первым штатом, где принят законопроект запрещающий строительство новых ЦОД до ноября 2027 года. Местные жители из сельских районов собираются, чтобы обсудить, какие меры они могут предпринять для сдерживания строительства центров обработки данных. Одна из жительниц района сказала, что чувствует себя подавленной, потому что документы, касающиеся предлагаемого крупномасштабного ЦОД рядом с её домом, «словно написаны на клингонском языке». Другая местная жительница сказала, что отказалась от «отвратительных сумм денег», которые ей предлагали за её землю, которую хотят использовать для строительства ЦОД. Многие жители даже не знали, что такое ЦОД, пока не выяснили, что его собираются построить в их районе. Активисты собирают подписи под петицией, цель которой — внести поправки в конституцию штата Огайо, запрещающие строительство средних и крупных центров обработки данных мощностью более 25 мегаватт. «Это угрожает нашему образу жизни: мы здесь двигаемся медленнее, мы ценим открывающийся отсюда вид, и мы не хотим, чтобы это изменилось, если это не принесёт пользы людям, которые здесь живут», — заявила Бейкер.  Конгрессмен Грег Ландсман (Greg Landsman) из Огайо недавно представил законопроект, который обяжет операторов ЦОД полностью оплачивать свои энергетические потребности и нужды инфраструктуры, а также заказывать исследования воздействия на окружающую среду. Он заявил, что некоторые районы Огайо стали своего рода «центром центров обработки данных» из-за «дешёвой земли и дешёвых политиков». Ландсман хочет запретить выборным должностным лицам подписывать соглашения о неразглашении информации о проектах ЦОД — практика, которая застала многих жителей Огайо врасплох. «Крупные технологические компании должны платить за все, — уверен Ландсман. — В значительной степени потому, что они являются основными бенефициарами, а также потому, что у них есть капитал, а у наших городов и общин его нет; они уже некоторое время испытывают нехватку средств — и города, и люди». Россияне стали чаще покупать дорогие комплектующие, чтобы запускать ИИ на собственных ПК

08.04.2026 [14:06],

Дмитрий Федоров

Россияне увеличили покупки дорогих комплектующих для «суперкомпьютеров», на которых можно запускать локальный ИИ. В марте спрос на видеокарту Nvidia RTX PRO 6000 Blackwell Workstation Edition с 96 Гбайт памяти за 892 000 руб. вырос на 91 % к предыдущим двум месяцам, а заказы на процессоры AMD Ryzen Threadripper PRO 7995WX и 7985WX за месяц прибавили 66 %, следует из данных CDEK.Shopping.

Источник изображения: Barbara Zandoval / unsplash.com CDEK.Shopping объяснил рост спроса развитием ИИ и интересом граждан к его локальному запуску на домашних компьютерах. Повышенный спрос пришёлся не только на отдельные комплектующие для сборки таких конфигураций, но и на готовые решения. Заказы на дорогие системные блоки Enine выросли на 48 %. Среди наиболее востребованных оказались модели стоимостью от почти 3,3 млн до более 4 млн руб.

NVIDIA RTX PRO 6000 Blackwell Workstation Edition. Источник изображения: nvidia.com Рост спроса на дорогие конфигурации происходит на фоне общего снижения российского рынка персональных компьютеров (ПК). В марте «Ведомости» со ссылкой на аналитиков компании «Интеллектуальная аналитика» сообщали, что по итогам 2025 года розничные продажи ПК в России сократились на 25—30 % как в количественном, так и в денежном выражении. Объём продаж снизился до 981 000 устройств, а объём рынка — до 48 млрд руб. По данным «Платформы ОФД», в 2025 году медианный чек на ПК в сетевой и несетевой рознице, как онлайн, так и офлайн, составил 45 205 руб. Показатель оказался на 4 % ниже уровня 2024 года. Количество покупок, по оценке компании, сократилось на 14 % год к году. Intel объединилась с SpaceX, xAI и Tesla для создания мощнейшего производства чипов TeraFab

07.04.2026 [18:05],

Дмитрий Федоров

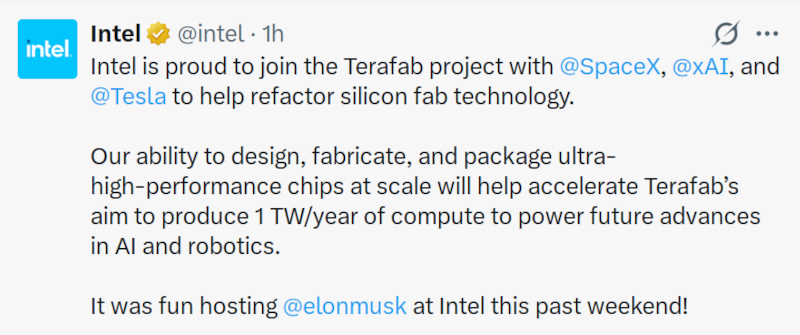

Intel присоединилась к проекту по созданию полупроводникового производства TeraFab, в котором уже участвуют SpaceX, xAI и Tesla. Данный проект обеспечит компаниям Илона Маска (Elon Musk) возможность вводить в эксплуатацию до 1 ТВт вычислительной мощности в год для задач в сферах ИИ и робототехники. Intel поможет собственными компетенциями в проектировании, производстве и сборке микросхем.

Источник изображений: @intel / x.com Intel заявила, что поможет «перестроить технологию производства полупроводниковых изделий» и обеспечит проекту поддержку за счёт своих возможностей в разработке микросхем, их изготовлении и сборке. Технические параметры реализации компания не раскрыла, но обозначила свою роль в производственной части инициативы. В минувшие выходные Intel принимала Илона Маска (Elon Musk). Месяцем ранее он говорил о возможной совместной работе с Intel, однако официальное соглашение тогда ещё не было подписано. Необходимость TeraFab Маск объяснял тем, что действующие полупроводниковые производства не успевают наращивать мощности под будущий спрос Tesla на оборудование для ИИ.  Ранее Tesla и SpaceX планировали построить предприятия TeraFab в Остине, штат Техас. По словам Маска, эти площадки будут выпускать микросхемы для автомобилей Tesla и роботов Optimus, а также оборудование для спутников SpaceX и космических ИИ ЦОД. Сроков строительства он не назвал. Intel не раскрыла параметры технологического процесса, подходы к сборке и организационную схему работы производственного направления TeraFab. При этом публикация подтверждает участие Intel Foundry и делает компанию заметным участником одного из наиболее амбициозных проектов по выпуску микросхем для ИИ, объявленных в этом году. Microsoft уже выпустила больше 80 различных Copilot — вся экосистема может включать более 100 продуктов

07.04.2026 [17:45],

Дмитрий Федоров

Консультант по ИИ Тай Баннерман (Ty Bannerman) свёл в одну схему более 80 продуктов Microsoft с названием Copilot и показал, что их реальное количество, вероятно, превышает 100. Под этим названием компания продвигает приложения, функции, платформы, клавишу на клавиатуре, категорию ноутбуков и инструменты для создания новых Copilot, поэтому один бренд уже обозначает не отдельный продукт, а разнородную линейку решений.

Источник изображения: microsoft.com Баннерман, работающий в области стратегии, проектирования и внедрения решений на основе ИИ, начал эту работу после вопроса о том, что именно представляет собой Microsoft Copilot. По его оценке, уже тогда это название использовалось как минимум в 75 разных значениях и в разных контекстах. В его схеме сначала было 78 позиций, затем их число выросло до 80 после того, как в перечень добавили Gaming Copilot и Microsoft Dragon Copilot. Подсчёт осложнялся тем, что даже Microsoft, судя по всему, не ведёт единого окончательного списка всех решений Copilot. Дополнительная проверка через сам Copilot расширила оценку: сервис ответил, что с учётом версий, встроенных в приложения, корпоративных решений и инструментов, связанных с Azure, экосистема насчитывает значительно более 100 продуктов. После уточняющего запроса Copilot назвал диапазон примерно от 95 до более чем 120 решений. Практическое следствие такого разрастания проявилось и в Windows. Несколько недель назад в области уведомлений одновременно отображались два приложения Copilot. Одно открывало обычное окно диалога с ИИ-помощником, второе оказалось Copilot 365 и при нажатии требовало войти с помощью учётной записи Microsoft 365. Позднее это приложение удалили. В этом контексте обещанные Microsoft существенные улучшения производительности и надёжности Windows 11, а также сокращение числа взаимодействий с Copilot, выглядят давно назревшей мерой. Meta✴ выпустит открытые версии мощных ИИ-моделей Avocado и Mango с урезанной функциональностью

07.04.2026 [15:25],

Дмитрий Федоров

Meta✴✴ выпустит в этом году две закрытые передовые ИИ-модели — большую языковую модель под кодовым названием Avocado и генератор мультимедийных файлов Mango. Их версии с открытым исходным кодом, вероятно, создадут на той же основе, но сроки их выхода относительно закрытых версий компания не раскрывает. Эти продукты должны стать частью стратегии Meta✴✴ по максимально широкому распространению ИИ-моделей по всему миру.

Источник изображения: Eyestetix Studio / unsplash.com Открытые версии моделей не получат полный набор возможностей, доступных их закрытым собратьям, при этом Meta✴✴ не уточняет, какие именно функции в них не войдут. О масштабе возможного упрощения позволяет судить Llama 4 Maverick — самая мощная большая языковая ИИ-модель компании с открытым исходным кодом, представленная в апреле прошлого года. Она насчитывает 400 млрд параметров и устроена как система из 128 специализированных нейросетей, каждая из которых отвечает за свой класс задач. В новых открытых версиях Meta✴✴ может исключить часть этих подсистем, сократить число параметров или отказаться от отдельных этапов обучения, включая последующее дообучение. Частичное ограничение возможностей открытых версий, вероятно, связано и с требованиями безопасности в сфере ИИ. Это косвенно указывает на то, что Avocado может быть особенно сильна в генерации кода для задач кибербезопасности. Для сравнения: Claude 4.6 Opus компании Anthropic уже выявила сотни критических уязвимостей в проектах с открытым исходным кодом. Одновременно Anthropic и OpenAI готовят новые флагманские большие языковые ИИ-модели, тогда как Meta✴✴, по данным Axios, не ожидает превосходства над конкурентами «по всем направлениям» и делает ставку на отдельные преимущества, важные для массовой аудитории. Одним из таких преимуществ могут стать более низкие требования к вычислительным ресурсам. Многие передовые большие языковые ИИ-модели не запускаются на персональных компьютерах (ПК) из-за ограниченной производительности процессоров. Ещё одно возможное направление — задачи, связанные с вопросами личного здоровья и помощью с домашними заданиями: ориентированные на бизнес ИИ-модели обычно уделяют таким сценариям меньше внимания. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |