|

Опрос

|

реклама

Быстрый переход

Илон Маск снова наобещал с три короба: роботакси, армия роботов и миллионы электромобилей

23.10.2025 [13:53],

Алексей Разин

Как можно судить по итогам третьего квартала, даже временный всплеск спроса на электромобили Tesla в США не позволил компании нарастить фактические объёмы поставок, а руководство воздержалось от упоминания прогноза на текущий год. Зато в более отдалённой перспективе Tesla сможет выпускать по 3 млн машин в год, как заявил её руководитель.

Источник изображения: Tesla Другое значение, равное 2 млн выпускаемых машин в год, Илон Маск (Elon Musk) упоминал в контексте перехода к автопилоту и запуску сервиса роботакси в более широких масштабах. Тем не менее, когда представитель Wolfe Research спросил его о планах компании нарастить объёмы производства электромобилей, Маск пояснил, что на выпуск 3 млн машин ежегодно Tesla может выйти в течение ближайших 24 месяцев. «Я думаю, даже быстрее, чем за 24 месяца», — добавил Илон Маск, подчеркнув, что существенным драйвером роста станет роботакси Cybercab, серийный выпуск которого компания надеется наладить в следующем году. На вопрос о стратегии экспансии сервиса роботакси Маск ответил следующее: «Даже если регуляторы не дали бы нам такую возможность, мы всё равно стали бы делать это, осторожно подходя к освоению нового рынка». Здесь уместно вспомнить, что в окрестностях Сан-Франциско фирменные такси Tesla ездят с водителями за рулём, и автоматика не управляет машиной на основной части маршрута, но подобные ограничения в значительной степени носят бюрократический, а не технический характер. В том же Остине страхующие водители находятся на переднем пассажирском месте, а до конца этого года Tesla надеется вывести свои роботакси на улицы восьми или десяти крупных городов США в общей сложности. Даже если роботакси будут ездить по улицам под управлением человека, как пояснил Маск, это позволит компании собирать необходимые для обучения своих нейросетей данные. Ещё три месяца назад Маск был уверен, что к концу года фирменные роботакси смогут обслуживать до половины всего населения США. В отношении роботов Optimus, которым Маск предсказуемо уделял много внимания на минувшем отчётном мероприятии, появилось сразу несколько важных новостей. Во-первых, он выразил уверенность, что в будущем такие роботы смогут выступать в роли квалифицированных хирургов и помогут победить бедность во всём мире. Во-вторых, Маск пояснил, что ему нужна власть над Tesla для сильного влияния на «армию роботов», которую компания собирается построить. В-третьих, он заявил, что в первом квартале следующего года будет представлена третья версия Optimus, а серийное производство может начаться до конца 2026 года. Когда Маска спросили, насколько дизайн роботов Optimus позволяет им сейчас приблизиться к моменту серийного производства, глава компании невозмутимо заявил, что «аппаратный дизайн не будет заморожен даже в момент старта производства, и совершенствование будет постоянным». Генеральный директор Tesla признал, что создать человекоподобного робота не так просто технически — по крайней мере, с точки зрения кинематики кистей, которые были бы столь же умелыми и ловкими, как человеческие. В какие сроки будет доведён до условного совершенства фирменный автопилот, Илон Маск, вопреки собственной традиции, говорить на отчётном мероприятии не стал, но заявил: «Я почти на 100 %, нет, даже не почти, на 100 % уверен, что мы сможем создать неконтролируемый человеком полный автопилот с уровнем безопасности, значительно превосходящем человека». Уже почти на протяжении девяти лет Маск каждый год обещает выпустить полный автопилот на рынок к концу каждого следующего года. В этом месяце он от соответствующих обещаний каким-то чудом воздержался. «Полный автопилот» Tesla испарился — теперь машины лишь «разработаны с учётом автономности»

23.10.2025 [12:30],

Алексей Разин

В 2016 году компания Tesla заявила, что все выпускаемые ею с того момента электромобили имеют всё необходимое оборудование для реализации полного автопилота. План заключался в том, чтобы в течение нескольких лет довести до ума программное обеспечение и сделать эти машины полностью автономными с точки зрения управления. Сейчас компания более осторожно выбирает выражения, говоря на эту тему.

Источник изображения: Tesla Не секрет, что затянувшееся ожидание перехода к полному автопилоту начало выводить из себя не только клиентов Tesla, но и инвесторов, поэтому у них начали возникать претензии, оформляющиеся в виде судебных исков. С 2016 года Tesla продолжала продавать клиентам опцию FSD за тысячи долларов, обещая, что со временем оснащённая ею машина сможет ездить самостоятельно. Позже выяснилось, что аппаратная платформа HW2 необходимыми возможностями не обладает, и чтобы реализовать полный автопилот, придётся не только обновить программное обеспечение, но и бортовой компьютер до версии HW3. Решить проблему несоответствия аппаратной платформы потребностям полного автопилота Tesla была готова, меняя бортовые компьютеры на HW3 за свой счёт, но только не в случае с теми клиентами, которые выбирали использование FSD по подписке с ежемесячными платежами. Ещё позже Tesla призналась, что и возможностей HW3 для реализации полного автопилота не хватит, а потому перешла к оснащению всех новых машин бортовыми компьютерами поколения AI4 (HW4) с обновлёнными камерами. Такие бортовые компьютеры уже не обладали обратной совместимостью с машинами, изначально оснащёнными оборудованием поколения HW3, и Tesla до сих пор не придумала, как подобную модернизацию осуществить технически с минимальными затратами. Более того, очевидно, что на AI4 прогресс не остановится, поскольку компания уже готовит переход на аппаратную платформу AI5. Чипы для неё как раз будут выпускать в США компании Samsung и TSMC, как признался на этой неделе Илон Маск (Elon Musk). В свежей презентации, которая прилагается к квартальному отчёту Tesla, компания вообще использует максимально гибкую формулировку: «Каждое поставляемое транспортное средство Tesla на данный момент разработано с учётом автономности». О том, что на борту производимых сейчас электромобилей Tesla есть всё необходимое для реализации полного автопилота оборудование, автопроизводитель больше не сообщает, как делал девять лет назад. Адаптировать описание спорной функции компанию заставили судебные иски, которые выдвинуты как минимум в США, Китае и Австралии как раз на почве несбывшихся ожиданий клиентов. Tesla возродила режим автопилота Mad Max — самый агрессивный и склонный к мелким превышениям скорости

17.10.2025 [14:06],

Алексей Разин

На первых этапах обучения транспортных средств, способных управляться автоматикой, такие машины выделялись в потоке — они либо двигались слишком медленно, либо совершали манёвры резко и непредсказуемо. Tesla уже давно пытается «очеловечить» свой автопилот с точки зрения восприятия окружающими, и недавно компания вернула профиль Mad Max, который наделяет систему FSD самыми смелыми повадками.

Источник изображения: Tesla Недавно вышедшее обновление FSD 14.1.2, как сообщает Electrek, добавило к перечню профилей автоматики не только сверхспокойный и безопасный Sloth Mode, но и самый агрессивный Mad Max, дебютировавший ещё в 2018 году, но впоследствии скрытый от пользователей из соображений безопасности и для лучшего соответствия требованиям регуляторов. Сейчас в иерархии профилей FSD на ступень ниже Mad Max расположен Hurry Mode, который позволяет достаточно часто перестраиваться между полосами движения, но строго укладывается в скоростные ограничения. Mad Max таких «условностей» почти лишён — он не только чаще выполняет перестроения, но и слегка превышает установленную на участке допустимую скорость. Фактически за городской чертой FSD удерживает скорость до 137 км/ч. По словам представителей компании, с моральной точки зрения переход в режим Mad Max допустим для человека, который, например, опаздывает на рейс или спешит забрать ребёнка из школы. Изначально профиль Mad Max настроен на соблюдение правил дорожного движения, однако очевидцы утверждают, что на практике автомобили под его управлением уже замечены в ситуациях, когда превышали допустимую скорость и проезжали стоп-линию на перекрёстках «накатом», без полной остановки, как того требует соответствующий знак. В остальном обновление FSD версии 14 заметно продвинулось в области автономного вождения. Электромобили Tesla теперь могут самостоятельно подъезжать к окнам выдачи заказов в ресторанах быстрого питания, предусматривающих обслуживание автомобилистов без выхода из салона. Автоматика способна самостоятельно выбрать парковочное место в конечной точке маршрута и припарковаться на нём. Улучшены также возможности маневрирования в ограниченном пространстве и плотном трафике. В будущей версии FSD 14.2 заявлена ещё более впечатляющая функция: электромобиль при посещении торгового центра будет высаживать владельца у входа и отправляться на заранее выбранное парковочное место, а затем по вызову из фирменного приложения забирать его обратно — не заставляя идти через всю парковку с пакетами покупок. Автопилот Tesla завалил пробег через США — машина попала в аварию через 100 км

22.09.2025 [13:09],

Алексей Разин

Ещё в 2016 году глава Tesla Илон Маск (Elon Musk) был уверен, что фирменные технологии автопилота к концу 2017 года в результате своего развития позволят ему совершить поездку из Лос-Анджелеса в Нью-Йорк без вмешательства в процесс управления в качестве водителя. Попытка совершить такую поездку в наши дни быстро завершилась аварией.

Источник изображения: Electrek Как отмечает Electrek, дуэт освещающих тематику электромобилей Tesla американских блогеров решил отправиться из Сан-Диего на западном побережье США в Джексонвилл на восточном на серийном электромобиле Model Y, полагаясь на способность бортовых систем самостоятельно управлять машиной. Курьёзность ситуации заключается в том, что участники «беспилотного пробега» не смогли даже выбраться без происшествий за пределы Калифорнии. Преодолев менее 100 км от стартовой точки маршрута, они наехали на довольно крупное препятствие, возникшее на пути следования, после чего машина была повреждена и не смогла продолжить движение. В салоне электромобиля находилось как минимум два человека, включая водителя. Последний старался держаться за руль лишь в те моменты, когда этого требовала бортовая автоматика. Пассажир справа заметил препятствие заблаговременно и сообщил о нём водителю, но тот взялся за руль для его объезда слишком поздно. Избежать наезда на довольно крупный и прочный предмет участники пробега не смогли, поэтому он повредил кронштейн стабилизатора поперечной устойчивости и ряд других элементов подвески. Бортовая электроника запестрела разного рода предупреждениями о неисправностях. Продолжать поездку в таком состоянии электромобиль уже не мог. Этот пример показывает, насколько современные системы активной помощи водителю уязвимы во вполне обыденных дорожных ситуациях, а ведь данный инцидент произошёл на прямом участке шоссе в дневное время. Ухудшение условий видимости кратно увеличивает риск подобных происшествий, поскольку бортовые системы Tesla всё сильнее зависят от камер, оценивающих окружающую обстановку. Tesla теперь называет свой автопилот «почти полным»

06.09.2025 [23:33],

Алексей Разин

Потребовалось решение суда, чтобы принудить Tesla указывать в своих публичных упоминаниях о технологии FSD, что она требует постоянного контроля со стороны водителя (supervised). На следующем этапе компания по своей воле начала предупреждать клиентов, что FSD позволит лишь приблизиться к полной автономности управления, и только при наличии подходящих условий.

Источник изображения: Tesla Ресурс Electrek, который тщательно следит за эволюцией маркетинговых формулировок Tesla и высказываний самого Илона Маска (Elon Musk), напоминает, что изначально автопроизводитель обещал наделить возможностью обходиться без водителя все свои электромобили, выпущенные после 2016 года. К 2023 году компания была вынуждена признать, что аппаратное обеспечение машин, выпущенных в период с 2016 по 2023 годы, не позволит достичь полной автономности управления даже при установке сколь угодно прогрессивного программного обеспечения. С 2018 года генеральный директор Tesla Илон Маск настойчиво повторял, что к концу каждого последующего года компания всё же выпустит обновление программного обеспечения FSD, которое позволит обходиться без вмешательства водителя в процесс управления транспортными средствами этой марки. Теперь, как поясняет источник, Tesla более не обещает, что FSD когда-то сделает электромобили, у которых эта опция за $8000 активирована, полностью автономными. «Ваша машина сможет ехать сама по себе практически везде с минимальным вмешательством со стороны водителя», — гласит актуальная версия аннотации к заказу FSD в фирменном конфигураторе на сайте Tesla. Ниже добавляется предупреждение, что уже реализованные функции требуют постоянного контроля со стороны водителя и не делают транспортные средство автономным. Активация и использование этих функций зависит от процесса разработки и одобрения регулирующих органов, в отдельных юрисдикциях оно может требовать более длительного времени, как предупреждает потребителей Tesla. Ещё пару лет назад компания продвигала идею превращения своих машин в беспилотные при помощи FSD, причём брала за это деньги с покупателей в тот момент, а усовершенствовать ПО до нужного уровня обещала в неопределённом будущем. Кроме того, стоимость FSD опустилась до $8000 лишь весной прошлого года, а ранее она достигала и $12 000, и $15 000 в определённые периоды. Получается, что теперь Tesla не только берёт с покупателей меньше денег, но и более честна с ними в отношении способности FSD полностью заменить водителя. Автопилот FSD намного чаще отталкивает покупателей от Tesla, нежели привлекает

29.08.2025 [08:33],

Алексей Разин

По итогам опроса 8000 американцев в августе этого года выяснилось, что лишь в 14 % случаев наличие в электромобилях системы FSD послужит фактором, подталкивающим респондентов к покупке. При этом в 35 % случаев FSD будет выступать в роли фактора, отталкивающего покупателей от продукции Tesla.

Источник изображения: FSD Оставшийся 51 % респондентов никак наличие FSD с влиянием на решение о покупке Tesla не увязывал. Примерно половина участников опроса, который проводился политологической консалтинговой группой Slingshot Strategies, призвала признать использование FSD незаконным на территории США. Напомним, под обозначением FSD скрывается комплекс технологий Tesla, который позволяет машинам этой марки в определённых условиях управляться автоматикой без частого вмешательства со стороны водителя. В перспективе эволюция FSD за счёт программных обновлений, по замыслу автопроизводителя, должна позволить автоматике полностью заменить водителя. Подобное настороженное отношение потребителей к FSD является тревожным сигналом для Tesla, ведь возглавляющий её Илон Маск (Elon Musk) не раз заявлял, что именно продажа программного обеспечения и всякого рода услуг, связанных с автономным вождением, со временем станет одним из основных источников дохода компании, а продажа электромобилей как таковых отойдёт на второй план. Само руководство Tesla видит проблему иначе, полагая, что нужно больше внимания уделять обучению потребителей использованию FSD. Примерно половина автовладельцев, чьи электромобили Tesla технически способны работать с FSD, никогда не пробовали передвигаться с её помощью, как заявил Илон Маск на прошлом квартальном отчётном мероприятии. Tesla намерена вести просветительскую работу с клиентами во время их обращения в фирменные сервисы, а сам Маск намерен распространять больше демонстрационных видеороликов. Получить доступ к FSD могут даже те, кто не намерен оплачивать опцию целиком и навсегда. Подписка позволяет пользоваться FSD за $99 в месяц, и по итогам определённого периода сделать вывод о необходимости покупки опции в постоянное владение. Среди желающих купить именно электромобиль участников опроса, упоминаемого выше, лишь 20 % готовы отдать предпочтение машине марки Tesla исключительно из-за наличия у неё FSD. При этом доля отвергающих такой выбор всё равно выше и достигает 33 %. Возможно, как отмечают авторы опроса, подобный настрой потребителей вызван отсутствием внятной информации о возможностях FSD и недоверием к маркетинговой стратегии Tesla в целом. Скандалы с судебными разбирательствами по поводу виновности FSD в ДТП со смертельным исходом, помимо прочего, тоже работают против репутации Tesla в целом и конкретной функциональности в частности. За два прошедших месяца, как показал опрос, количество считающих электромобили Tesla небезопасными респондентов выросло с 34 до 36 %, а количество считающих их «очень безопасными» сократилось с 17 до 13 %. На рынке США респонденты признали машины марок Honda, Toyota и Chevrolet наиболее безопасными. Tesla приступила к тестированию автопилота на дорогах общего пользования в Японии

20.08.2025 [07:31],

Алексей Разин

В географии распространения технологий активной помощи водителю Япония стоит особняком, поскольку является крупным автомобильным рынком с левосторонним движением и мощным национальным автопромом. При этом местные автопроизводители демонстрируют консервативный подход к автопилоту, что дополнительно подчёркивает значимость прогресса Tesla, которая начала тестировать его на дорогах Японии.

Источник изображения: Tesla Как отмечает Nikkei Asian Review, ещё летом этого года началась подготовка к тестированию технологий активной помощи водителю Tesla на дорогах общего пользования Японии. Некоторое количество электромобилей этой марки с испытателями за рулём начало курсировать по улицам японских городов для изучения местной специфики и сбора информации, которая поможет обучению фирменного автопилота. Теперь тестирование FSD в Японии перешло на новый этап, поскольку машинами начала управлять автоматика, но находящемуся в салоне водителю всё равно предписывается постоянно держаться за руль. Как скоро FSD станет доступна японским клиентам Tesla, не уточняется, но на примере китайского рынка можно понять, что компания собирается уложиться в сжатые сроки, поскольку использует для обучения глобального автопарка опыт, накопленный в других странах. Формально система FSD, доступ к которой открывается удалённо через программное обновление, относится к ассистентам водителя второго уровня по классификации SAE, её использование на территории Японии тем самым разрешено местным законодательством, но при условии сохранения контроля за процессом управления со стороны водителя. Японские автопроизводители системы помощи водителю второго уровня тоже предлагают, но они обычно сводятся к круиз-контролю для загородных трасс и удержанию машины в полосе при движении в городских условиях. Более того, в большинстве случаев автомобили местных марок опираются на точные цифровые карты местности, а система Tesla адаптируется под окружающую обстановку практически в реальном времени, оценивая поступающую с камер информацию. Прежде чем использование FSD в Японии будет легализовано, система должна будет получить одобрение профильного министерства. Всего по дорогам Японии сейчас колесят более 30 000 электромобилей Tesla, теоретически все из них смогут перейти на использование FSD. Японские конкуренты, как правило, свои системы автопилота разрабатывают с привлечением зарубежных партнёров. Японское законодательство в случае ДТП возлагает вину на водителя, поэтому наличие ассистента второго уровня не избавляет его от необходимости постоянно следить за дорогой. Tesla запустила редкую рекламу своего автопилота, но пытается скрыть его несовершенство

12.08.2025 [16:31],

Алексей Разин

Илон Маск (Elon Musk) долгое время пытался сохранять уникальность компании Tesla. Она, в частности, не сотрудничала с дилерами при продаже своих машин, а также долго не рекламировала свою продукцию. Тем не менее, конкурентная обстановка на рынке вынуждает её отказаться от некоторых предрассудков, и в редких рекламных материалах можно увидеть, что она скрывает несовершенство фирменных технологий.

Источник изображения: X, DennisCW Как известно, суд обязал компанию Tesla при публичном упоминании о возможностях своего бортового комплекса FSD (Full Self-Driving) подчёркивать, что он не обеспечивает полной автоматизации процесса управления транспортным средством, и требует от водителя постоянного внимания и готовности в любой момент взять управление на себя. По крайней мере, в США компания должна подчиняться этому требованию, благодаря чему в описании FSD появилась приписка «Supervised», подразумевающая постоянный контроль со стороны человека. Тем интереснее было одному из очевидцев увидеть на севере Голливуда в Калифорнии рекламный щит Tesla с приглашением пройти тест-драйв электромобиля этой марки с активной функцией FSD. При этом её описание на плакате сопровождалось припиской Supervised более чем в два раза уменьшенным шрифтом. При беглом знакомстве с содержанием плаката, которое и подразумевается придорожной рекламой, заметить эту надпись вообще проблематично. Можно признать, что тем самым Tesla старается скрывать от потребителей несовершенство своего фирменного автопилота, хотя формально и следует требованиям закона. На протяжении последних шести лет подряд, как напоминает Electrek, Илон Маск с завидным упорством повторял, что полноценный автопилот будет предложен клиентам Tesla к концу очередного календарного года, но постоянно отодвигал этот рубеж. По имеющейся статистике, сейчас программное обеспечение Tesla FSD версии 13.9 требует от водителя вмешательства в процесс управления машиной в среднем каждые 544 км. По данным американского ведомства NHTSA, водители в среднем попадают в ДТП один раз в каждые 1,12 млн км, если говорить о серьёзных столкновениях. С этой точки зрения настойчивые заявления Илона Маска о кратном превосходстве фирменного автопилота над среднестатистическим водителем в плане безопасности не выдерживают никакой критики. Tesla приступила к обучению обновлённого автопилота Full Self-Driving — он обещает резко «поумнеть»

06.08.2025 [18:27],

Павел Котов

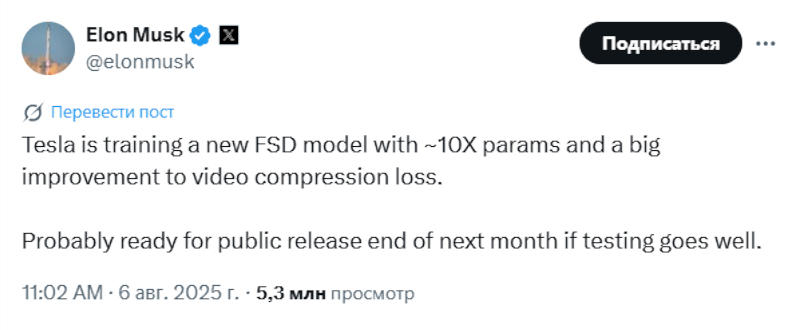

Tesla в настоящее время проводит обучение новой модели искусственного интеллекта для системы автопилота Full Self-Driving, которая будет отличаться «значительно» улучшенным качеством видео и увеличенным размером. Об этом сообщил генеральный директор компании Илон Маск (Elon Musk).

Источник изображения: tesla.com «Tesla обучает новую модель FSD с десятикратным ростом [числа] параметров и значительным сокращением потерь при сжатии видео. [Она], вероятно, будет готова к публичному выходу в конце следующего месяца, если испытания пройдут успешно», — сообщил Маск в своей соцсети X. FSD — система, частично выполняющая функции автопилота. Она позволяет автомобилям Tesla ориентироваться и маневрировать в дорожных ситуациях с минимальным участием водителя, хотя он должен держать руки на руле и быть готовым в любой момент перехватить управление или затормозить. Эта система может служить заменой помощнику водителя Autopilot — установить её могут автовладельцы в Европе и Китае.

Источник изображения: x.com/elonmusk В основе FSD лежит модель искусственного интеллекта, отвечающая за обработку данных с камер и сенсоров электромобиля. Увеличение числа параметров модели ИИ означает, что она стала больше, её обучили на более объёмном массиве данных, и её возможности расширились. Маск традиционно делает большую ставку на FSD как ключевой элемент стратегии на рынке электромобилей, но это не помогло ему против натиска китайских конкурентов. Tesla и сейчас связывает своё будущее с технологиями автопилота. С основным бизнесом Tesla, то есть с продажей электромобилей, дела сейчас обстоят непросто: по итогам II квартала компания доложила о сокращении чистой прибыли на 16 % и о резком падении продаж в Европе. Ещё одним негативным фактором для компании стала политическая деятельность Маска — с начала года акции Tesla упали на 23,55 %. В Китае набрали популярность «обманки» для автопилота Tesla, которые позволяют не держаться за руль

05.07.2025 [05:17],

Алексей Разин

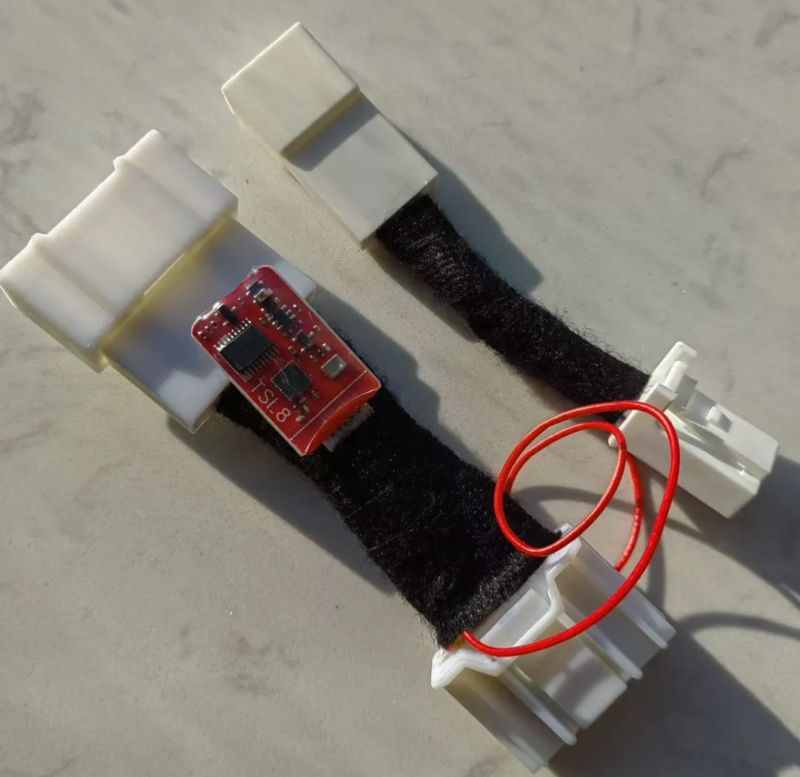

В своё время компания Tesla приложила немало усилий, чтобы заставить халатных водителей держаться за руль во время работы фирменной системы автопилота, которая технически ещё не готова отказаться от участия человека в процессе управления. В Китае получили распространение устройства, которые позволяют обмануть бортовые системы Tesla, позволяя водителю не держаться за руль.

Источник изображения: CarNewsChina Алгоритмы программного обеспечения Tesla постепенно были настроены таким образом, что не держащегося за руль водителя система постоянно уведомляла о необходимости сделать это надписями и звуками, и если сидящий за рулём человек их игнорировал, машина должна была замедлиться до полной остановки и включить аварийную сигнализацию, а в идеале ещё и прижаться к обочине. Уже тогда «умельцы» начали засовывать между спицами рулевого колеса различные предметы, которые создавали ассиметричное утяжеление для датчиков, контролирующих сопротивление его вращению. На первых порах удержание руля автоматика Tesla контролировала именно так, но злоупотребления дошли до того, что блогеры начали вешать на руль «обманку» и перебираться в едущей машине на заднее сидение. Ряд производителей автомобильных аксессуаров наладил было выпуск грузов для руля серийно, но их продажу в итоге запретили. Позже Tesla стала больше полагаться на видео с бортовой камеры, обращённой внутрь салона, контролируя позу и жесты водителя. В таких условиях обходиться только показаниями датчиков электроусилителя руля уже было не нужно, но этот канал контроля сохранил свою значимость. Как отмечает издание NBD, на китайском рынке, где прогресс систем активной помощи водителю движется семимильными шагами, без особых проблем на популярных торговых площадках можно приобрести специальные электронные устройства, которые вводят в заблуждение систему Autopilot на электромобилях Tesla относительно удержания рулевого колеса водителем. Они представляют собой шлейфы с разъёмами и крохотной печатной платой, подключаемые в разрыв определённых кабелей под приборной панелью электромобиля Tesla. Установка такого устройства достаточно проста и не требует ни специальных навыков, ни сложного инструмента. В итоге за $140 владелец электромобиля Tesla получает устройство, которое внушает бортовым системам мысль, что водитель постоянно держится за руль, хотя фактически он может этого не делать. Строго говоря, китайские законы пока не разрешают водителям длительное время не держаться за рулевое колесо, но подобные злоупотребления достаточно распространены. Tesla осуждает применение подобных устройств и лишает установивших их автовладельцев фирменной гарантии, а также предупреждает об опасных последствиях. Известен один случай, когда решившийся на такую модификацию владелец электромобиля Tesla в Китае за две недели дважды столкнулся с перебоями в работе бортовых систем, причём в последнем машина просто не смогла передвигаться. Когда её доставили в сервис, то за восстановление работоспособности сотрудники Tesla запросили $560. Впрочем, для китайских владельцев электромобилей Tesla есть и хорошая новость. Недавно компания заявила, что начинает плановое распространение функции FSD на территории страны. Как и в случае с другими рынками, к которым относятся США, Канада, Мексика и Пуэрто-Рико, к названию FSD добавлено слово «Supervised», что подразумевает постоянный контроль за управлением со стороны человека. Беспилотные такси Tesla уже намотали 24 000 км в рамках тестов

24.04.2025 [15:56],

Алексей Разин

На квартальном отчётном мероприятии Tesla Илон Маск (Elon Musk) подчеркнул, что компания по-прежнему надеется запустить в июне беспилотное такси в Техасе. В тот же день в социальной сети X было опубликовано видео, демонстрирующее процесс испытаний таких транспортных средств. Они уже намотали 24 000 км, по словам представителей Tesla.

Источник изображения: X, Tesla Как известно, испытания Tesla проводит с обязательным присутствием страхующего водителя за рулём, и под видеороликом с беглой демонстрацией процесса испытаний отмечает, что программное обеспечение FSD не делает электромобиль полностью автоматически управляемым. Фирменное приложение на данном этапе позволяет избранным сотрудникам Tesla вызывать прототип беспилотного такси, в роли которого пока выступает Model 3, на задний дисплей которой выводится необходимая для пассажира информация и виртуальные кнопки управления. Там же будет находиться клавиша экстренной остановки, когда Tesla откажется от присутствия водителя в салоне. Впрочем, в той же Калифорнии компания пока не получила разрешения на испытания беспилотных такси без водителя. Помимо Техаса, испытания с водителем осуществляются в районе залива Сан-Франциско. Tesla отмечает, что уже осуществила более 1500 поездок и её прототипы проехали в общей сложности 24 000 км. Илон Маск пообещал, что при запуске сервиса в июне этого года в Техасе будет сразу задействовано от 10 до 20 машин. Наличие водителя за рулём и возможность взимания платы с пассажиров к тому времени будут определяться наличием у компании соответствующих разрешений, а также уверенностью компании в готовности программного обеспечения к подобному режиму управления. Механизмы дистанционного управления при помощи оператора будут предусмотрены в любом случае, поскольку нынешние тестовые поездки с водителем помогают их разрабатывать и совершенствовать, как можно судить из заявлений компании. Кроме того, человекоподобными роботами Optimus на презентации «We, robot» также управляли удалённые операторы, поэтому опыт подобных демонстраций у Tesla определённо есть. Массовые увольнения чиновников Илоном Маском ударили по внедрению автопилота в США

10.04.2025 [12:00],

Алексей Разин

Ещё в феврале стало известно, что карающая рука Илона Маска (Elon Musk) в статусе главы новоявленного Департамента правительственной эффективности (DOGE) сократила штат ведомства NHTSA, которое в США отвечает за безопасность дорожного движения. От этих мер пострадал и штат специалистов, в чьи обязанности входила оценка систем автопилота с целью их одобрения к применению на дорогах общего пользования страны.  Как сообщает Financial Times, из сокращённых Маском в феврале примерно 30 сотрудников NHTSA заметная часть была вовлечена в работу по оценке безопасности систем активной помощи водителю, которые автопроизводители и профильные разработчики намеревались внедрять в США. В общей сложности «оптимизация» штата чиновников в стране затронула по меньшей мере 20 000 человек, которые потеряли работу. Скептики заподозрили, что миллиардер таким образом может мстить или оказывать давление на те ведомства, которые чинили препоны на пути бизнеса принадлежащих ему компаний, либо проводили разного рода расследования в их отношении. NHTSA многие годы выражала разного рода претензии к компании Tesla, только сейчас агентство ведёт восемь связанных с деятельностью компании и её продукцией расследований. На Tesla в адрес NHTSA поступило более 10 000 жалоб со стороны граждан США. Во многом внедрение так называемого полного автопилота FSD в исполнении Tesla на рынке США задерживается по причине существования высоких требований к безопасности со стороны NHTSA. После первого раунда сокращений штата ведомства, инициированных Илоном Маском, моральный дух его сотрудников упал. По мнению многих, соответствующие действия Маска являются примером конфликта интересов. Считается, что Маск прошёлся по штатному расписанию Федерального управления гражданской авиации (FAA) и Федеральной комиссии по связи (FCC) с целью предоставления преимуществ принадлежащей ему аэрокосмической компании SpaceX и дочернего провайдера спутникового интернета Starlink. На этом фоне NHTSA пришлось заявить, что безопасность для неё остаётся главным приоритетом, и продукцию любого автопроизводителя она будет и впредь оценивать независимо и беспристрастно. Уведомления о сокращении штата NHTSA поступили примерно 4 % сотрудников в середине февраля, они коснулись как опытных специалистов, так и новичков. Подразделение, которое занимается автопилотом, было основано только в 2023 году, и пока не могло похвастать большим штатом, но в новых условиях оно не сможет его эффективно расширять. Ведомству пришлось проститься с несколькими ценными сотрудниками, как пояснили на условиях анонимности его представители. Кадровые зачистки определённо снизят способность NHTSA быстро и эффективно оценивать системы активной помощи водителю, включая FSD компании Tesla. Ирония момента заключается в том, что на эту технологию глава Tesla делает существенную ставку в развитии бизнеса, но сам же при этом создаёт барьеры для её внедрения на территории США. Прежде всего, проблемой для Tesla сейчас становится необходимость получить в NHTSA разрешение на начало эксплуатации беспилотных такси в штате Техас, которое было запланировано на июнь текущего года. Обладая нынешней властью, Маск может поддаться соблазну надавить на NHTSA для получения необходимого разрешения, без оглядки на возможные недоработки в программном обеспечении для автопилота. Сейчас участники испытаний беспилотных транспортных средств обязаны подавать отчёты о ДТП в течение 24 часов с момента их возникновения. В декабре 2023 года Tesla пришлось обновить по требованию NHTSA программное обеспечение 2 млн электромобилей, чтобы сделать напоминание для водителя о необходимости держаться за руль и следить за дорогой более заметным.  В то же время, увеличение количества отчётов о происшествиях с участием электромобилей Tesla начало создавать у обывателей ложное представление об уровне безопасности бортовой автоматики этих машин. Представители Tesla объясняют подобную динамику высокой чувствительностью бортовых датчиков, позволяющей фиксировать больше происшествий, чем у конкурентов. Многие отчёты Tesla, подаваемые в NHTSA по новым правилам, вообще не имеют отношения к работе автопилота. Из восьми расследований, которые NHTSA ведёт в отношении Tesla, пять имеют непосредственную связь с заявлениями Илона Маска о технических возможностях бортовых систем электромобилей этой марки. Фактический уровень автоматизации управления, по мнению многих потребителей, не так высок, как декларирует автопроизводитель. Ежемесячно на FSD жалуются около 20 американцев, как показала статистика NHTSA. В одной из жалоб на так называемые «фантомные торможения» описывается случай, имевший место в октябре прошлого года. Водитель Tesla Model 3 стал свидетелем внезапного торможения своей машины перед другим транспортным средством, которое неизбежно бы его протаранило, если бы автовладелец не перехватил управление своим электромобилем, и не ускорился бы для ухода от столкновения. В феврале текущего года один из владельцев купленного в 2024 году пикапа Tesla Cybertruck обнаружил, что режим FSD на его машине внезапно отключился прямо на ходу без предупреждения, а пикап при этом внезапно ускорился и едва не врезался в другую машину, следовавшую встречным курсом. Назначенный при Трампе главой NHTSA Джонатан Моррисон (Jonathan Morrison) признался, что восхищается заслугами Илона Маска в сфере внедрения новых технологий, но настороженно относится к стилю работы Tesla, который не подразумевает плавного и вдумчивого внедрения новшеств. Эта компания, по словам чиновника, идёт напролом и нередко рискует жизнями людей. Продажи электромобилей Tesla в Европе рухнули почти вдвое в январе, хотя рынок вырос на 37 % — в этом замешаны политические амбиции Маска

26.02.2025 [10:23],

Алексей Разин

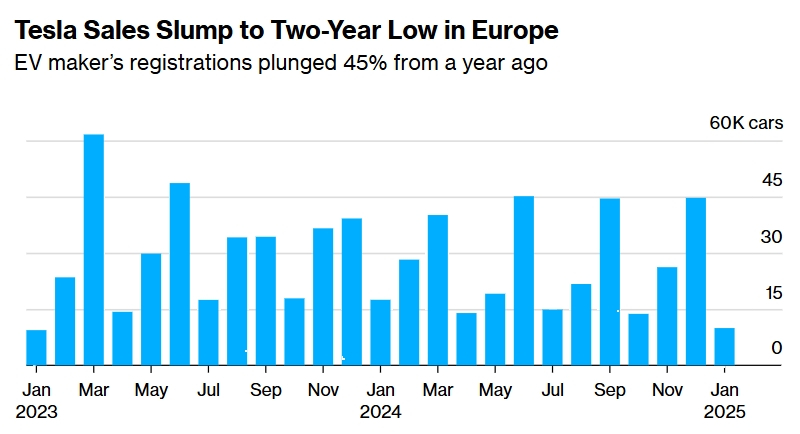

Акционеры Tesla и раньше выступали с претензиями к общественной деятельности главы компании Илона Маска (Elon Musk), которая порой вредила бизнесу, а после сближения генерального директора с Дональдом Трампом (Donald Trump) колебания курса акций Tesla стали ещё более заметными. В Европе продажи Tesla в январе рухнули на 45 %, тогда как весь рынок электромобилей в регионе вырос на 37 %.

Источник изображения: Tesla Во вторник на этой неделе акции Tesla упали в цене на 8 % под влиянием сразу нескольких факторов. Всего с начала года они подешевели на 25 %, растеряв почти весь прирост, полученный после победы Дональда Трампа на президентских выборах в США в ноябре прошлого года. Кинувшийся с головой в политику Илон Маск начал быстро наживать себе врагов не только в США, но и в той же Германии, где пытался влиять на исход парламентских выборов. Капитализация Tesla в итоге опустилась ниже отметки в $1 трлн и сейчас находится на минимальном с 7 ноября прошлого года уровне. Личное благосостояние Маска сократилось более чем на $100 млрд, хотя он всё равно так или иначе располагает активами на сумму $380 млрд, что позволяет считать его богатейшим человеком планеты.

Источник изображения: Bloomberg, European Automobile Manufacturers’ Association В январе продажи электромобилей Tesla в Германии сократились на 45 % в годовом выражении, хотя в целом европейский рынок продемонстрировал рост продаж автомобилей с этим типом силовой установки на 37 %. Однако влияние политической активности Маска в данном случае не следует переоценивать. Во-первых, покупатели электромобилей в Германии с недавних пор не могут претендовать на субсидии, что замедлило темпы перехода на электротягу среди местного населения. Во-вторых, наиболее выгодными для покупки в Германии остаются электромобили Tesla местного производства, а конвейеры предприятия в окрестностях Берлина в январе частично простаивали из-за переоснащения в рамках подготовки к выпуску рестайлинговой версии Model Y. В США, к слову, участились случаи вандализма в точках продаж электромобилей Tesla, поскольку наиболее радикальная публика ассоциирует продукцию этой марки с политической деятельностью Илона Маска. Кроме того, один из владельцев пикапа Tesla Cybertruck столкнулся с агрессией на улицах своего города и задумался о смене машины. Обратившись в Tesla с предложением сдать пикап по программе трейд-ин, он получил отказ, поскольку автопроизводитель не принимает Cybertruck в зачёт новой покупки. Разочарованию инвесторов способствовала и волна критики после появления усечённой версии FSD на китайском рынке. Этот комплекс технологий позволяет электромобилям Tesla управляться самостоятельно при определённых условиях. Впервые система стала доступна в Китае, но только на городских улицах. Китайские клиенты остались недовольны качеством «автопилота», поскольку конкурирующие автопроизводители предлагают на местном рынке более совершенные системы, причём порой без дополнительной платы, тогда как Tesla берёт за опцию $8800. Развитию автопилота Tesla в Китае мешают ограничения на передачу данных между США и Китаем. В итоге компания была вынуждена обучать нейросети по изображениям китайских улиц, полученным из сторонних источников, а не с бортовых камер собственных машин. Видеозаписи с китайских Tesla компания обязана хранить в центре обработки данных в Шанхае, но его вычислительных мощностей недостаточно для эффективного обучения нейросетей, а передача этих данных в США запрещена законом. Tesla старше 2023 года не получат полный автопилот без замены бортового компьютера, признал Илон Маск

30.01.2025 [08:03],

Алексей Разин

Ещё в октябре прошлого года глава Tesla признал, что реализовать полноценный автопилот FSD на электромобилях марки, выпущенных до января 2023 года, будет проблематично из-за устаревшего оборудования. На этой неделе Илон Маск (Elon Musk) пояснил, что Tesla готова за свой счёт менять оборудование на подходящее тем клиентам, кто оплатил полную стоимость опции FSD.

Источник изображения: Tesla Напомним, что последняя в определённые периоды деятельности Tesla стоила клиентам $15 000, и позволяла рассчитывать на доступ к полноценному автопилоту FSD после программного обновления. Как выяснилось к концу прошлого года, оборудование HW3, которое устанавливалось на электромобили Tesla с осени 2016 года, позволяет достичь полной автономности управления чисто теоретически, но с таким уровнем затрат, который делает подобные усилия нецелесообразными. Выходом из ситуации уже осенью прошлого года Маск видел замену бортового оборудования старых электромобилей на комплект HW4, на котором современное программное обеспечение будет работать более эффективно, а главное — более безопасно. На этой неделе представителей Tesla спросили о ситуации с реализацией полного автопилота на оборудовании HW3, и если глава направления FSD Ашок Эллусвами (Ashok Elluswamy) начал было говорить, что компания не оставляет попыток, Маск своим замечанием выразил более реалистичную перспективу: «Правда заключается в том, что мы нуждаемся в замене компьютеров HW3 на всех транспортных средствах с купленным FSD». По словам Маска, Tesla готова менять компьютеры HW3 на более совершенные за счёт компании, но только у клиентов, которые оплатили полноценную опцию FSD. Компании уже приходилось менять установленные в период с 2016 по 2018 годы бортовые компьютеры поколения HW2.5 на более современные HW3, чтобы открыть их владельцам доступ к оплаченной ими FSD. Один из них добился этого права без необходимости платить за модернизацию через суд. Проблема заключается в том, что оборудование поколения HW4 в нынешнем виде пригодно только к установке в новые транспортные средства, его нельзя без заводской доработки установить в электромобили, выпущенные до января 2023 года. По всей видимости, Tesla придётся создать переходный вариант бортового компьютера поколения HW4, который будет совместим с машинами, изначально оснащаемыми оборудованием поколения HW3. Какая часть из владельцев таких электромобилей оплатила FSD, судить сложно, но компании придётся разориться на модернизацию сотен тысяч, если не миллионов электромобилей. У новейших Tesla начали один за одним отказывать бортовые компьютеры

17.12.2024 [19:45],

Алексей Разин

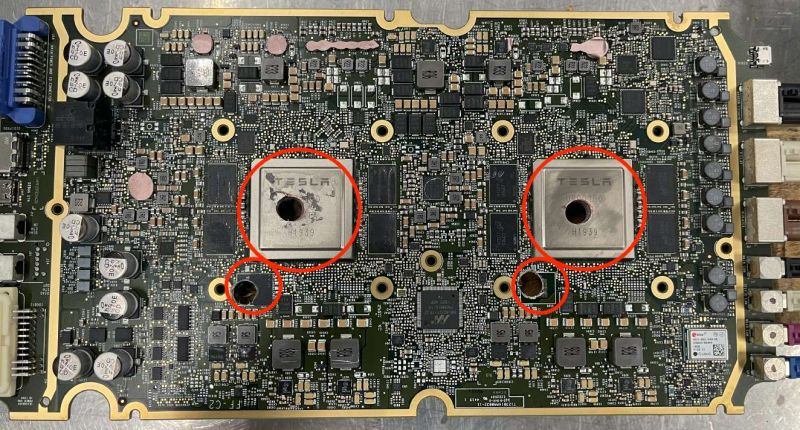

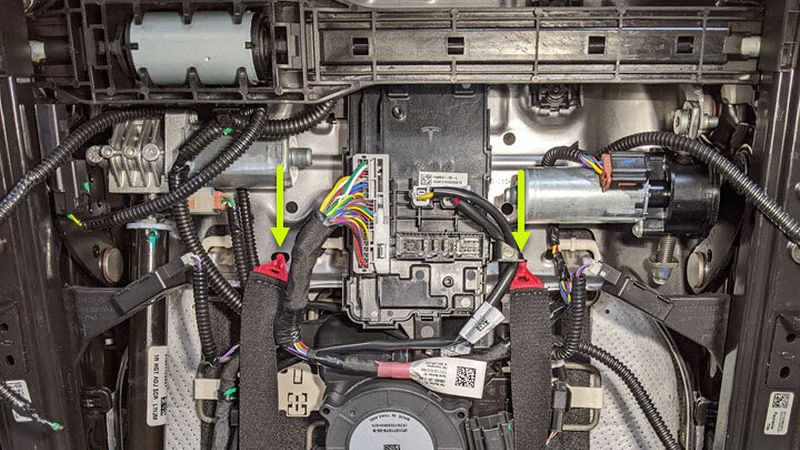

Электромобили Tesla одними из первых получили обиходное определение «гаджетов на колёсах», поскольку их функциональность сильно зависела от возможностей бортовых компьютеров и устанавливаемого на них программного обеспечения. Машины свежих партий, как отмечает Electrek со ссылкой на собственные источники, стали страдать от серьёзных поломок бортовых компьютеров.

Источник изображений: Tesla Как поясняет источник, оснащаемые бортовым компьютером версии AI4.1 электромобили Tesla последних месяцев выпуска нередко сталкиваются с их выходом из строя по причине короткого замыкания. Что его вызывает, достоверно пока установить не удалось, но под подозрением находится низковольтная батарея электромобиля, которая приводит к короткому замыканию в процессе калибровки одной из бортовых камер. Неисправность может проявить себя на новых электромобилях с пробегом от нескольких десятков до нескольких сотен миль. Выход из строя бортового компьютера лишает электромобиль Tesla не только таких прогрессивных функций, как активная помощь водителю или «контролируемый автопилот» (FSD), но и вполне банальных функций типа GPS-навигации и оценки запаса хода на оставшемся заряде. Для электромобиля, впрочем, последняя весьма важна в условиях эксплуатации в регионах с не очень развитой зарядной инфраструктурой.  Сервисный бюллетень Tesla по этой неисправности до сих пор не выпущен, хотя количество обращений клиентов по этому поводу растёт, и фирменные сервисы уже вынуждены записывать желающих заменить бортовой компьютер по гарантии на январь 2025 года. Сотрудников Tesla при этом проинструктировали не нагнетать панику среди клиентов, убеждая последних, что на машине в подобном состоянии всё равно можно ездить. Отдельным нюансом является готовность Tesla заявить об этом дефекте в докладе агентству NHTSA, которое в США отвечает за безопасность дорожного движения. Неисправность камеры заднего вида, которую провоцирует выход из строя бортового компьютера, по требованиям NHTSA уже является достаточным основанием для объявления отзывной кампании. Tesla, которая сейчас отчаянно конкурирует с BYD за право остаться крупнейшим производителем электромобилей, в огласке подобных дефектов в данный момент не заинтересована. |