|

Опрос

|

реклама

Быстрый переход

Anthropic подтвердила, что откроет сверхмощную ИИ-модель Claude Mythos для широкой аудитории

29.05.2026 [10:57],

Павел Котов

Anthropic подтвердила, что планирует выпустить модели искусственного интеллекта класса Mythos для широкой публики — компания задержала их выход из-за рисков безопасности для открытого и закрытого ПО.

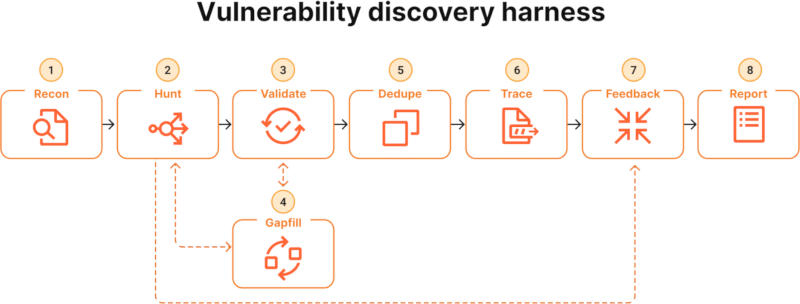

Источник изображения: anthropic.com Anthropic анонсировала Mythos как модель с ограниченным доступом — поработать с ней получили возможность некоторые компании и исследователи в области кибербезопасности. Тогда компания указала на серьёзные угрозы, которые представляет модель, и решила отказаться от публичного выпуска. «Преимущество будет на стороне того, кто сможет извлечь максимальную выгоду из этих инструментов. В краткосрочной перспективе это могут быть злоумышленники, если передовые лаборатории не проявят осторожность с выпуском этих моделей. В долгосрочной перспективе ожидаем, что это будут защитники, которые смогут эффективно направлять ресурсы и использовать эти модели для исправления ошибок до выпуска нового кода», — пояснили в Anthropic. Сейчас компании, видимо, удалось разработать надёжные механизмы защит от неправомерного использования Mythos — она обещает быть мощнее Opus 4.8 и других доступных на сегодняшний день моделей. Anthropic пообещала познакомить общественность с Mythos в ближайшие недели, но конкретных сроков не привела. «Мы быстро продвигаемся в разработке мер защиты и ожидаем, что в ближайшие недели сможем представить модели класса Mythos всем нашим клиентам», — пообещали в компании, но не уточнили, будет ли это та же версия, которой пользуются избранные эксперты в области кибербезопасности. Mythos, отметили в Anthropic, демонстрирует значительные улучшения в логике и автономности, намного превосходя актуальную флагманскую модель Claude Opus 4.8. В какой-то момент Mythos-preview появилась на платформе Claude Code, но компания оперативно её убрала из общего доступа. ИИ-супермодель Claude Mythos всего за месяц обнаружила свыше 10 тыс. уязвимостей в ПО

23.05.2026 [19:54],

Анжелла Марина

Компания Anthropic опубликовала первый отчёт о проекте в сфере кибербезопасности Project Glasswing, запущенной в апреле. В основе инициативы лежит пока не ставшая широкодоступной ИИ-модель Claude Mythos Preview, которая всего за один месяц помогла партнёрам Anthropic обнаружить более 10 тысяч уязвимостей в их программном обеспечении.

Источник изображения: Anthropic Большинство компаний, получивших доступ к нейросети, зафиксировали сотни критических багов в своих продуктах. Как сообщает Engadget, Cloudflare обнаружила 2000 уязвимостей, из которых 400 отнесены к категории высокой или критической опасности. Mozilla нашла и исправила 271 ошибку в браузере Firefox, значительно превзойдя результаты тестирования с использованием предыдущих версий модели Claude. Также и недавнее заявление Microsoft о предстоящем увеличении объёма выпускаемых патчей напрямую связано с результатами сканирования инфраструктуры через Mythos Preview. Помимо корпоративного сектора, специалисты Anthropic протестировали тысячу проектов с открытым исходным кодом, где ИИ выявил свыше 6200 критических угроз из 23 тысяч найденных недочётов. При этом сторонние исследователи заявили, что с помощью Mythos им удалось найти способ по взлому защищённой операционной системы macOS. На фоне столь высокой эффективности Anthropic пока отказывается от публичного релиза модели, так как разработчики опасаются использования технологии злоумышленниками и планируют сделать алгоритм общедоступным только после создания надёжных механизмов защиты. В настоящее время Anthropic расширяет доступность проекта Project Glasswing, работая над восстановлением отношений с правительством США и привлекая к сотрудничеству крупные технологические компании, включая Apple, Google и Nvidia. «Настоящий шаг вперёд»: Cloudflare сравнила Anthropic Mythos с опытным исследователем

21.05.2026 [08:22],

Павел Котов

Эксперты компании Cloudflare изучили возможности передовой модели искусственного интеллекта Anthropic Mythos и оставили о ней самые положительные отзывы, хотя и оговорились, что надлежащие сценарии её применения ещё предстоит выработать.

Источник изображений: cloudflare.com Cloudflare приняла участие в программе Anthropic Project Glasswing, в рамках которой ей предоставили доступ к Mythos. Цель программы — опередить использующих ИИ злоумышленников в обнаружении уязвимостей систем. Среди других участников программы значатся Amazon Web Services, Apple, Google, Microsoft и Nvidia — им Anthropic выделила кредиты на сумму до $100 млн, чтобы дать возможность изучить возможности Mythos. «Claude Mythos Preview — универсальная, ещё не выпущенная модель, которая раскрывает суровый факт: ИИ-модели достигли такого уровня в программировании, что могут превзойти всех, кроме самых опытных людей, в поиске и эксплуатации уязвимостей ПО. <..> Project Glasswing — оперативная попытка использовать эти возможности в целях защиты», — отметили в Cloudflare. Mythos произвела на экспертов Cloudflare большое впечатление; компания признала, что это «настоящий шаг вперёд, <..> не просто усовершенствование того, что было прежде, <..> изменение Mythos состоит в том, что модель теперь может собирать эти ошибки невысокой степени угрозы (которые традиционно так и оставались бы невидимыми в списке невыполненных задач) и объединять их в один, более опасный эксплойт». В ходе тестирования Cloudflare выделила две наиболее важные функции Mythos: «построение цепочек эксплойтов», то есть способность интеллектуально объединять уязвимости в целостную схему атаки; и «генерацию доказательств», то есть фактическую демонстрацию работоспособности полученных результатов.  Эксперты компании также указали, что прочие специалисты не вполне корректно использовали преимущества Mythos, когда делали упор на скорости обнаружения уязвимостей, чтобы их быстро исправить. Она лучше раскрывает свои возможности, если применять её целенаправленно и поэтапно. Ей может быть непросто изучать большую базу кода целиком — эффективнее использовать её в узких областях, то есть запускать несколько ИИ-агентов под управлением Mythos, поручая каждому конкретную задачу. Передовая ИИ-модель, считают в Cloudflare, показала, что и подход к исправлению уязвимостей теперь должен быть иным: «Более сложный вопрос состоит в том, как должна выглядеть архитектура вокруг уязвимости. Принцип в том, чтобы затруднить злоумышленнику [её] эксплуатацию даже при наличии ошибки, чтобы разрыв между моментом обнаружения уязвимости и моментом её исправления имел меньшее значение». В компании предлагают принять три меры защиты ПО в эпоху ИИ: усложнить гипотетическим злоумышленникам доступ к самим приложениям, используя внешние средства; проектировать ПО так, чтобы взлом одного его фрагмента не означал компрометации всей системы сразу; и, наконец, развёртывать обновления безопасности немедленно, а не ждать, когда каждая команда программистов доделает свою работу. В Cloudflare пообещали «в ближайшие недели» рассказать клиентам о том, как Mythos изменит их работу. Тесты подтвердили: Claude Mythos превосходит конкурентов в поиске уязвимостей, но имеет другие слабые места

17.05.2026 [07:21],

Дмитрий Федоров

ИИ-модель Mythos компании Anthropic подтвердила репутацию лучшего инструмента поиска программных уязвимостей, но в других задачах её результаты оказались неоднозначными. Компания XBOW, которая разрабатывает ИИ-инструменты для проверки защищённости систем, провела серию независимых тестов Mythos Preview.

Источник изображения: anthropic.com XBOW сообщает, что Mythos Preview представляет собой существенный шаг вперёд по сравнению со всеми существующими моделями, независимо от провайдера. Модель отлично находит проблемы при тестировании на работающей системе с доступом к исходному коду, но хуже справляется с анализом кода в изоляции. Ещё 20 лет назад американский учёный в области информатики Гэри Макгроу (Gary McGraw) отметил, что ошибки в работе программ возникают на стыке багов в коде и изъянов архитектуры: найти архитектурные изъяны, просто изучая код построчно, нельзя — для этого требуется понимание системы на более высоком уровне. XBOW при этом подчёркивает: хотя любая ИИ-модель может обнаружить что-то интересное, «что-то» не равнозначно «всему». В оценке результатов — умении отличать реальные уязвимости от ложных — Mythos отсеивала ложные срабатывания лучше предшественников, но иногда пропускала реальные уязвимости, когда свидетельства формально не удовлетворяли её критериям. Лучших результатов модель достигает при точно сформулированных запросах. В реверс-инжиниринге (восстановлении логики программы без доступа к исходному коду) и анализе нативного кода Mythos показала значительную силу. XBOW заключила, что модель способна проводить триаж — приоритизацию и отсев — как собственных результатов, так и находок конкурентов, а также разбираться в нестандартных прошивках. Тесты на взаимодействие с визуальным интерфейсом показали, что модель не всегда попадает в точные координаты элементов на экране, но практически эффективна при выборе действий в браузере: верно определяет нужный элемент и кликает в нужное место. Остаётся вопрос стоимости. XBOW отмечает, что Mythos Preview — не просто очередная модель, а настоящий титан, но титаны велики, а величина означает дороговизну. Anthropic заявила, что Mythos будет в пять раз дороже модели Opus. XBOW проверила, можно ли дать более дешёвой модели больше времени и получить сопоставимую точность, — и ответ оказался утвердительным. При нормализации по стоимости работы Mythos Preview не выглядит расточительной, если требуется высокая точность, но на бенчмарках XBOW не стала лучшей в своём классе. При поиске веб-уязвимостей с фиксированным бюджетом токенов Mythos превосходит Opus 4.6, но уступает GPT5.5. Главные выводы тестирования: Mythos чрезвычайно мощна для аудита исходного кода, хороша, но менее убедительна в подтверждении работоспособности найденных эксплойтов. Модель склонна к буквальности в оценках и преувеличивает практическую значимость находок, при этом сильна в нативном коде и реверс-инжиниринге. XBOW заключает, что Mythos Preview уверенно находит потенциальные уязвимости, особенно в исходном коде, и показывает сильные результаты в задачах, связанных с вебом, нативным кодом и реверс-инжинирингом. Исследователи рассказали, как ИИ Mythos помог взломать новейшую систему защиты памяти Apple

15.05.2026 [10:55],

Павел Котов

Группа исследователей в области кибербезопасности Calif при помощи модели искусственного интеллекта Anthropic Mythos обнаружила две опасные уязвимости в Apple macOS и за пять дней разработала схему атаки. Сейчас исследователи поделились подробностями взлома, а Apple прокомментировала ситуацию.

Источник изображений: Steve A Johnson / unsplash.com Целью атаки является представленная Apple в минувшем году аппаратная система обеспечения безопасности памяти Memory Integrity Enforcement (MIE), разработанная, чтобы значительно усложнить выполнение эксплойтов, связанных с повреждением памяти. В основе MIE лежит выпущенная в 2019 году технология Arm Memory Tagging Extension (MTE). «MTE, по сути — система маркировки и проверки меток памяти: каждый выделяемый блок памяти помечается секретным ключом; аппаратные компоненты гарантируют, что все последующие запросы на доступ к памяти будут удовлетворяться только в том случае, если в запросе содержится секретный ключ. Если секретные ключи не совпадают, приложение аварийно завершает работу, и событие регистрируется в журнале. Это позволяет разработчикам оперативно выявлять ошибки повреждения памяти по мере из возникновения», — пояснили в Apple. Компания усовершенствовала MTE, реализовала его с использованием аппаратных компонентов как MIE и встроила эту технологию во все модели iPhone 17 и iPhone Air. Впоследствии Apple развернула эту технологию и на macOS для компьютеров на чипах M5.  «Apple потратила пять лет на разработку [MIE]. Возможно, и несколько миллиардов долларов. Согласно их исследованиям, MIE блокирует все общедоступные цепочки эксплойтов против современных iOS, в том числе недавно опубликованные комплекты эксплойтов Coruna и Darksword. <..> Наша схема оказалась фактически случайным открытием. Брюс Данг (Bruce Dang) обнаружил ошибки 25 апреля. Дион Блазакис (Dion Blazakis) присоединился к Calif 27 апреля. Джош Мейн (Josh Maine) разработал инструменты, и к 1 мая у нас был рабочий эксплойт. Эксплойт представляет собой цепочку [действий для] повышения привилегий на уровне ядра, основанную только на данных и нацеленную на macOS 26.4.1 (25E253). Она начинается непривилегированным локальным пользователем, использует только обычные системные вызовы и заканчивается получением root-оболочки. Процесс реализации включает две уязвимости и несколько методов, нацеленных непосредственно на „железо“ M5 со включённым MIE на уровне ядра», — рассказали в Calif. В процессе работы над проектом модель Anthropic Mythos постоянно оказывала помощь исследователям. «Mythos Preview — мощная модель: обучившись производить атаки на определённый класс уязвимостей, она умеет обобщать свои знания практически на любую уязвимость этого класса. Mythos быстро обнаружила ошибки, потому что они относятся к известному классу уязвимостей. Но MIE — это новая, лучшая в своём классе система защиты, поэтому автономный её обход может быть непростой задачей. Вот тут и пригодился человеческий опыт. Наши мотивы отчасти состояли в том, чтобы проверить, что можно сделать, когда лучшие модели работают вместе с экспертами. Успешное внедрение эксплойта на основе повреждения памяти ядра против лучших средств защиты за неделю — это примечательно и во многом говорит в пользу такого сочетания», — добавили исследователи. Материалы своего проекта они привезли в штаб-квартиру Apple Park и рассказали о проблеме непосредственно сотрудникам компании. Подробности эксплойта его создатели не публикуют для широкой публики, чтобы дать компании возможность выпустить обновление и исправить ошибки. Модель Claude Mythos от Anthropic помогла взломать macOS, обнаружив и объединив две уязвимости

15.05.2026 [07:42],

Николай Хижняк

Модель искусственного интеллекта Claude Mythos компании Anthropic выявила новые уязвимости в системе безопасности операционной системы macOS. Apple уже их изучает, пишет The Wall Street Journal.

Источник изображения: 9to5Mac «Исследователи в области безопасности утверждают, что нашли новый способ обойти самые современные технологии защиты Apple, используя методы, которые они обнаружили при тестировании ранней версии программного обеспечения Mythos компании Anthropic в апреле. Исследователи из компании Calif, занимающейся вопросами в области кибербезопасности и базирующейся в Пало-Альто, утверждают, что написанное ими программное обеспечение объединяет в себе две уязвимости и несколько методов, позволяющих повредить память Mac, а затем получить доступ к тем частям устройства, которые должны быть недоступны. Это так называемый эксплойт для повышения привилегий. Если его использовать в сочетании с другими атаками, хакер может получить полный контроль над компьютером», — говорится в статье WSJ. В настоящее время Apple изучает отчёт компании Calif, чтобы подтвердить выводы исследователей. «Безопасность — наш главный приоритет, и мы очень серьёзно относимся к сообщениям о потенциальных уязвимостях», — заявил представитель Apple в интервью The Wall Street Journal. Команда Calif подготовила 55-страничный отчёт, который они лично передали в штаб-квартиру Apple в Купертино. По словам исполнительного директора Calif Тая Донга (Thai Dong), атака «не могла быть осуществлена только с помощью Mythos и потребовала участия специалистов по кибербезопасности из числа сотрудников Calif». Подробности об открытиях, сделанных компанией Calif, будут обнародованы после того, как Apple устранит выявленные проблемы. В разговоре с The Wall Street Journal Донг предположил, что «обнаруженные уязвимости, скорее всего, будут устранены довольно быстро». Белый дом противится намерениям Anthropic расширить доступ к своей ИИ-модели Mythos

30.04.2026 [06:50],

Алексей Разин

Создавшая ИИ-модель Mythos для поиска уязвимостей в информационных системах компания Anthropic изначально ограничила круг имеющих к ней доступ примерно 50 организациями, включая правительственные структуры. В ближайшее время планируется расширить этот перечень до 120 компаний и организаций, но данная инициатива Anthropic сталкивается с возражениями со стороны Белого дома.

Источник изображения: Anthropic Как отмечает The Wall Street Journal, власти США опасаются последствий слишком активного распространения Mythos, которая зарекомендовала себя в качестве мощного ИИ-инструмента в сфере кибербезопасности. В руках недоброжелателей это программное средство может стать оружием, используемым для атак на информационную инфраструктуру. Кроме того, чиновников беспокоит вероятность нехватки вычислительных мощностей Anthropic при столь активном расширении доступа к Mythos, которая в итоге может привести к снижению эффективности модели при её использовании в интересах правительственных структур. Выпуск Mythos компанией Anthropic символизировал вынужденное возобновление диалога с властями США после скандала с расторжением контракта на обслуживание интересов Пентагона. Новый «рубеж сопротивления» в переговорах между властями США и Anthropic говорит о том, что взаимоотношения между сторонами далеки от нормализации. На прошлой неделе Anthropic, как предполагается, столкнулась с инцидентом несанкционированного доступа к Mythos и начала расследование, поэтому нельзя утверждать, что сами разработчики безответственно относятся к условиям распространения данного инструмента. Источники также рассказывают о странном случае с попыткой американского правительства нанять выходца из Anthropic Коллина Бёрнса (Collin Burns), которому был предложен пост главы особого ведомства, специализирующегося на оценке лучших ИИ-моделей, появляющихся на рынке. Не всем в правительстве понравилась эта фигура как раз из-за связи с Anthropic, поэтому Бёрнс так и не получил описываемой выше должности, и это место занял другой кандидат. Чиновники объяснили такой шаг стремлением подобрать руководителя, который был бы равноудалён от всех компаний, предлагающих в США свои ИИ-модели. Потенциально опасная ИИ-модель Anthropic Mythos нашла 271 уязвимость в Firefox 150

22.04.2026 [12:20],

Павел Котов

Пока общественность пытается разобраться, действительно ли вышедшая в конце марта модель искусственного интеллекта Anthropic Mythos слишком опасна для выпуска в общий доступ, или разработчик просто искусственно создаёт на ней ажиотаж, в Mozilla испытали её возможности на собственном продукте.

Источник изображения: blog.mozilla.org Разработчики Mozilla получили ранний доступ к Anthropic Mythos, и ИИ помог им обнаружить в вышедшем на этой неделе обновлении браузера Firefox 150 колоссальное число уязвимостей — 271 штуку. Результат оказался настолько значительным, чтобы технический директор Firefox Бобби Холли (Bobby Holley) с энтузиазмом констатировал, что в бесконечной борьбе киберпреступников и киберзащитников у последних «наконец-то появился шанс одержать решительную победу». Для сравнения, в марте общедоступная модель Anthropic Opus 4.6 провела анализ кода Firefox 148 и нашла «всего» 22 уязвимости. Обычно, отметил господин Холли, уязвимости обнаруживаются либо методом «фаззинга» — хаотической бомбардировки ПО случайными данными — либо посредством долгосрочного анализа с привлечением «элитных исследователей в области безопасности». Anthropic Mythos избавляет разработчиков от применения серьёзных ресурсов, которые требуют продолжительного времени и усилий. Но теперь создателям ПО придётся ввести в повседневную практику анализ кода с помощью ИИ, потому что множество ошибок скрывается в каждом продукте, и теперь их можно обнаруживать. Особенно важно это для проектов с открытым исходным кодом, чьи базы кода свободно лежат в общем доступе. Исследования безопасности для таких проектов обычно проводят добровольцы, но их усилий, конечно, недостаточно. И разработчикам наиболее популярных проектов, которыми пользуются миллиарды человек, отметили в Mozilla, доступ к средствам вроде Anthropic Mythos должен предоставляться в приоритетном порядке. Сверхмощная ИИ-модель Mythos попала не в те руки, но это не точно — Anthropic расследует инцидент

22.04.2026 [08:39],

Алексей Разин

Выпущенная Anthropic ИИ-модель Mythos, которая с помощью технологий искусственного интеллекта ищет уязвимости в программном обеспечении, изначально была предложена в ограниченном доступе из соображений безопасности. Теперь появились сведения о первом инциденте получения к Claude Mythos Preview несанкционированного доступа сторонними пользователями.

Источник изображения: Anthropic Впрочем, как поясняет Financial Times со ссылкой на комментарии представителей Anthropic, получившие доступ к Claud Mythos Preview лица не были случайными в полной мере, поскольку связаны с подрядчиками, работающими на саму Anthropic. Сама по себе информация о подобном инциденте только усилит обеспокоенность регуляторов во многих уголках мира. В частности, власти Австралии, Южной Кореи и Японии уже озабочены тем, что Mythos в руках злоумышленников может представлять угрозу для национальных банковских систем. Anthropic пока не располагает доказательствами того, что активность пользователей, получивших доступ к Mythos через подрядчика, распространилась за пределы контролируемого окружения. Кто именно из партнёров Anthropic замешан в этом инциденте, не уточняется. Считается, что доступ к Mythos получили примерно 40 организаций, но публично Anthropic называет имена лишь малой части из них, включая Amazon, Microsoft, Apple, Cisco и CrowdStrike. Эти компании получили приоритетное право использования ИИ-модели Mythos до того, как она выйдет на рынок с более серьёзным охватом. Специалисты по кибербезопасности предупредили, что Mythos позволяет злоумышленникам использовать уязвимости в ПО быстрее, чем их разработчики смогут их устранить. В марте описание ИИ-модели попало в публичный доступ через кеш данных, после чего Anthropic резко усилила внутренние меры безопасности, стараясь предотвратить более серьёзные утечки. Впрочем, это не предотвратило апрельскую утечку программного кода Claude Code, который предназначался для служебного использования. Регуляторы увидели в ИИ-модели Anthropic Mythos угрозу для банковской системы

20.04.2026 [12:22],

Алексей Разин

В лучших традициях фантастических сюжетов про «восстание машин», стартап Anthropic открыл доступ к специализирующейся на поиске уязвимостей в ПО модели Mythos лишь ограниченному кругу пользователей. Тем не менее, представители монетарных систем некоторых стран считают, что даже в таком ограниченном применении Mythos может представлять угрозу для банковской системы.

Источник изображения: Anthropic По меньшей мере, как отмечает Reuters, регуляторы считают, что Mythos можно использовать для дестабилизации банковской системы через поиск уязвимостей в сфере кибербезопасности. Австралийская комиссия по ценным бумагам и инвестициям (ASIC) через своего представителя заявила, что пристальным образом обменивается данными с регулирующими органами других стран с целью определения возможных сфер применения Mythos на австралийском рынке. Правительственные агентства и представители финансового сектора тоже участвуют в консультациях. Лицензиаты подобных сервисов в финансовом сегменте рынка, по мнению ASIC, должны быть «на шаг впереди всех» при обеспечении защиты интересов своих клиентов. Австралийский банковский регулятор APRA также анализирует возможное влияние подобных технологий на стабильность и безопасность финансовой системы. В Южной Корее Комиссия по финансовым услугам (FSC) также провела в минувшую среду экстренное совещание со специалистами в сфере информационной безопасности, чтобы оценить исходящую от Mythos угрозу для участников финансового рынка. В условиях активной цифровизации финансовых услуг забота о безопасности в профильной сфере обретает всё большее значение, учитывая бурное развитие искусственного интеллекта. Американские ведомства стали игнорировать запрет на сотрудничество с Anthropic — модель Mythos оказалась слишком хороша

15.04.2026 [12:12],

Павел Котов

Федеральные ведомства и правительственные чиновники США стали негласно игнорировать запрет главы государства Дональда Трампа (Donald Trump) на сотрудничество с компанией Anthropic, стало известно Politico.

Источник изображения: anthropic.com Центр стандартов и инноваций в области искусственного интеллекта при Министерстве торговли США сейчас активно тестирует способности передовой ИИ-модели Anthropic Mythos к взлому систем, узнали журналисты издания. Подтвердить эту информацию в Reuters не смогли; в Anthropic, Белом доме и самом Минторге комментариев не предоставили. Сотрудники как минимум трёх комитетов конгресса США за последнюю неделю проводили или запрашивали у Anthropic брифинги, чтобы узнать о возможностях сканирования Mythos киберсистем. Anthropic обсуждает возможности Mythos даже с самой администрацией Трампа, сообщил накануне сооснователь компании Джек Кларк (Jack Clark). Белый дом не смутил тот факт, что из-за непреодолимых разногласий по контракту Пентагон прекратил сотрудничество с лабораторией. Характер и подробности переговоров Anthropic с правительством США, а также то, какие ведомства участвуют в них, пока установить не удалось. Anthropic анонсировала ИИ-модель Mythos 7 апреля, объявив её своей самой совершенной системой «для программирования и выполнения агентских задач», сообщил разработчик — модель способна действовать в автономном режиме. Anthropic открыла ограниченный доступ к модели Claude Mythos Preview — она автономно ищет дыры в ПО, и уже нашла тысячи уязвимостей

08.04.2026 [05:01],

Анжелла Марина

Компания Anthropic открыла ограниченный доступ к своей новой ИИ-модели Mythos, предназначенной для поиска критических уязвимостей и отражения киберугроз. Инструмент будет доступен лишь избранным корпорациям, поскольку его навыки взлома систем признаны слишком опасными для публичного выпуска.

Источник изображения: Anthropic По сообщению The Wall Street Journal, предварительную версию нейросети получат около 50 компаний и организаций, поддерживающих критически важную ИТ-инфраструктуру, среди которых Amazon, Apple, Google и Linux Foundation. По словам руководителя подразделения Frontier Red Team в Anthropic Логана Грэма (Logan Graham), ИИ-модель Mythos продемонстрировала настолько высокие способности в поиске и эксплуатации программных ошибок, что разработчики в настоящее время не планируют открывать её для широкой аудитории. Эксперты по кибербезопасности всё больше обеспокоены тем, что искусственный интеллект стремительно сокращает окно времени между обнаружением уязвимости и созданием рабочего программного обеспечения для ее эксплуатации. В конце прошлого года учёные выяснили, что нейросети ищут и используют баги в реальных сетях почти так же эффективно, как и люди-специалисты. Наглядным примером стала предыдущая модель Anthropic, Claude Opus 4.6, которая в начале этого года всего за две недели нашла в браузере Firefox больше критических уязвимостей, чем обычно выявляется во всём мире за два месяца. Новая модель Mythos оказалась примерно в 10 раз эффективнее предыдущих ИИ-систем при расчёте стоимости обнаружения одного бага. Несмотря на то, что Anthropic пока не собирается выпускать свой продукт в открытый доступ, Логан Грэм уверен, что в ближайшие несколько лет аналогичные хакерские возможности появятся и у других нейросетей. В связи с этим эксперт призывает ИТ-сообщество уже сейчас готовиться к реалиям, в которых задержка между обнаружением программной уязвимости и её применением в атаке будет сведена к нулю. Anthropic предупредила, что её будущая модель Claude Mythos станет «хакерской вундервафлей»

29.03.2026 [20:36],

Дмитрий Федоров

Anthropic, OpenAI и другие технологические компании готовят ИИ-модели, способные резко усилить угрозу масштабных кибератак на корпоративные, государственные и муниципальные системы. В центре внимания — ещё не выпущенная ИИ-модель Claude Mythos компании Anthropic. По данным Axios, компания уже предупреждает высокопоставленных чиновников США, что её появление в 2026 году заметно повышает вероятность атак такого уровня.

Источник изображения: Wesley Tingey / unsplash.com Mythos описывается как система, позволяющая ИИ-агентам автономно, с высокой точностью и сложностью, проникать в корпоративные, государственные и муниципальные системы. Генеральный директор Axios Джим ВандеХей (Jim VandeHei) сообщил в своей рассылке для руководителей, что один из источников, знакомых с будущими ИИ-моделями, допускает крупную кибератаку уже в 2026 году. При этом бизнес назван особенно уязвимой целью. Ранее Fortune изучил утёкшие материлы из блога Anthropic о Claude Mythos. В нём ИИ-модель названа системой, которая «в настоящее время значительно опережает любую другую ИИ-модель по кибервозможностям». Там же сказано, что Mythos «предвещает надвигающуюся волну ИИ-моделей, способных использовать уязвимости так, что это будет намного опережать усилия киберзащиты». Риск усиливают сотрудники, использующие ИИ-агентов без понимания того, что это может упростить киберпреступникам доступ к внутренним системам их компаний. В конце 2025 года Anthropic раскрыла первый задокументированный случай кибератаки, в значительной степени выполненной ИИ. Поддерживаемая государством китайская группа использовала ИИ-агентов для автономного взлома примерно 30 целей по всему миру. ИИ самостоятельно вёл от 80 % до 90 % тактических операций. Это произошло ещё до резкого усиления агентных систем и до появления новых опасных способов их применения. Новые ИИ-модели отличаются более высокой способностью поддерживать автономную работу ИИ-агентов. Речь идёт о системах, позволяющих агентам самостоятельно мыслить, действовать, рассуждать и импровизировать без пауз и усталости. Масштаб атаки теперь определяется прежде всего вычислительными ресурсами злоумышленников, а не численностью их группировки. Теперь один человек получает возможность проводить кибератаки, для которых раньше требовались целые команды. Одновременно растёт и уязвимость компаний. Сотрудники всё чаще запускают Claude, Copilot и другие агентные модели, нередко из дома, и создают собственных ИИ-агентов. Во многих случаях такие агенты без должного контроля получают доступ к внутренним рабочим системам. Это создаёт для киберпреступников ещё один канал проникновения. В отрасли такое несанкционированное или неконтролируемое использование ИИ называют «теневым ИИ». Опрос ресурса Dark Reading показал, что 48 % специалистов по кибербезопасности считают агентный ИИ главным вектором атак в 2026 году. Эта угроза поставлена выше дипфейков и выше всех остальных рисков, включённых в опрос. Каждому сотруднику любой компании в мире уже сейчас требуется понимать риск использования ИИ-агентов рядом с чувствительной информацией. Техническая команда Axios считает эту угрозу крупнейшей для компании на текущий момент. Практический вывод один: для работы с ИИ-агентами нужна безопасная изолированная среда. |