|

Опрос

|

реклама

Быстрый переход

Nvidia признали самой подготовленной к будущему компанией — Microsoft и Alphabet остались позади

08.06.2026 [13:19],

Алексей Разин

Основатель и глава Nvidia Дженсен Хуанг (Jensen Huang) пытается делать предсказания по поводу траектории дальнейшего развития технологий, но делает это не столь категорично, как эксцентричный Илон Маск (Elon Musk), например. Сторонние эксперты иногда приходят к выводу, что Nvidia неплохо готова к будущему, которое сама формирует. В рейтинге WSJ компания оказалась лучшей по этому критерию.

Источник изображения: Nvidia По степени готовности к будущему Nvidia в составе первой пятёрки опережает Alphabet (Google), Microsoft, Meta✴✴ Platforms и Cisco Systems. Этот рейтинг для The Wall Street Journal составили специалисты Bendable Labs, которые использовали данные из 20 различных источников и 30 профильных критериев. Основные категории оценки готовности компании к будущему сгруппированы по шести сферам: готовность к ИИ, инновации в более широком понимании, готовность персонала, финансовая устойчивость, сопротивляемость рискам в области цепочек поставок и геополитики, а также корпоративная подвижность и готовность к изменениям. При составлении рейтинга данные берутся из открытых источников и отчётности самих компаний, поэтому если последние не особо афишируют свою активность в определённых сферах, то и высоких оценок в части готовности к будущему они не получают. Например, компания Apple в рейтинге заняла 12-е место по критерию готовности к будущему в целом, но именно по готовности к ИИ она ограничилась лишь 56-м местом. Проблема заключается в том, что Apple не особо афиширует свои разработки в области ИИ, не так активно сотрудничает с признанными лидерами рынка, а на финансирование этой сферы также тратит значительно меньше средств, чем конкуренты. То есть, со стороны признать в Apple активно готовящуюся к применению ИИ в будущем компанию не так и просто. Среди первой сотни членов рейтинга примерно треть занята компаниями технологического сектора и сферы услуг. Среди первых 25 компаний 18 так или иначе связаны с технологическим сектором, хотя по формальным признакам они и стараются от него дистанцироваться. Alphabet и Meta✴✴ Platforms в этом рейтинге, например, отнесены к медийным и развлекательным компаниям. Вообще, в число лучших 25 компаний по готовности к будущему попали представители финансового сектора в лице Mastercard (7-место), Visa (15-е место) и S&P Global (13-е место), а фармакологическая сфера представлена Johnson & Johnson (20) и Eli Lilly (22). По словам составителя рейтинга, он в большей степени является диагностическим инструментом, а не средством прогнозирования. Он показывает, какие компании лучше других готовы к тем изменениям в экономике и промышленности, которые назревают или уже наблюдаются в настоящем времени. Как правило, крупные компании в этом рейтинге оказываются ближе к вершине, поскольку располагают необходимыми финансовыми ресурсами. При этом AMD, чья капитализация в шесть раз меньше Nvidia, среди компаний полупроводникового сектора идёт сразу после последней, занимая второе место, а среди компаний всех отраслей она занимает 16-е. Она не только демонстрирует высокую готовность к внедрению ИИ, но и обладает достаточной гибкостью и подвижностью, а также много внимания уделяет инновациям. Та же Broadcom, которая вдвое крупнее AMD по капитализации, занимает в рейтинге лишь 110–е место, поскольку структура её персонала недостаточно подготовлена к внедрению ИИ, а её бизнес подвержен рискам в области цепочек поставок и геополитики. До 40 % выручки приносит Broadcom программное подразделение, а дела у него идут не так успешно. Кадровый фактор для многих компаний сейчас таит много неопределённости с точки зрения готовности бизнеса к будущему. Поколение зумеров, родившихся с середины 90-х годов прошлого века до начала 2010-х, сейчас формирует около 30 % рабочей силы в США, и компаниям нужно искать эффективные методы взаимодействия с ними. Работодателю сложнее удерживать персонал в этой возрастной группе, а ещё на благосклонность сотрудников влияет готовность компаний предоставлять возможность работы из дома. В этом смысле авиакомпания Delta Air Lines оказалась лидером по критерию готовности своего персонала к будущему, но на этом перечень её сильных сторон практически был исчерпан, поскольку на 103-е место в общем зачёте её утянули слабая ориентация на инновации и не очень устойчивое финансовое положение. Глава Nvidia призвал не бояться наблюдаемого обвала на рынке акций и покупать их по низким ценам

08.06.2026 [07:12],

Алексей Разин

Основатель и генеральный директор Nvidia Дженсен Хуанг (Jensen Huang) во время своего визита в Южную Корею заключил соглашения о сотрудничестве с несколькими местными компаниями, включая SK hynix, а также посетил бейсбольный матч. Наблюдаемого на фондовом рынке обвала акций он призвал не бояться, агитируя инвесторов покупать их, пока цены снизились.

Источник изображения: Nvidia Как поясняет Financial Times, пятничная коррекция на американском фондовом рынке, которая забрала около $1,3 трлн капитализации у крупнейших компаний технологического сектора США, нашла продолжение на торгах в Азии утром в понедельник. Фондовый индекс Kospi в Южной Корее по сравнению с рекордно высоким значением прошлой недели опустился более чем на 15 %. Акции SK hynix и Samsung Electronics потеряли в цене более чем 10 %. С начала года индекс Kospi вырос более чем в два раза, а потому коррекция в понедельник вызвала некоторую панику у руководства местной биржи. Торги решено было приостановить на 20 минут. Иностранные инвесторы на прошлой неделе продали акций южнокорейских компаний на общую сумму $10 млрд, что усилило давление на национальную валюту, которая опустилась в цене до минимального с марта 2009 года против доллара США. Власти Южной Кореи были вынуждены заявить, что начинают бороться с ослаблением воны и спекулятивной биржевой торговлей. Японские акции тоже теряли в цене, SoftBank на этом фоне опять уступила Toyota по величине капитализации, поскольку её акции подешевели на 7,7 %. Акции TDK и Kioxia опустились в цене на 9,3 % и 7,5 % соответственно. Когда Дженсена Хуанга спросили о наблюдаемом снижении котировок, он заявил, что отрасль находится в самой начальной стадии формирования вычислительной инфраструктуры для ИИ. Соответственно, акции профильных компаний сохраняют потенциал для дальнейшего роста, а потому желающие заработать на ИИ-буме инвесторы вполне могут покупать акции на текущих уровнях, пока они подешевели. Президенту Южной Кореи Ли Чжэ Мёну (Lee Jae Myoung) тоже пришлось вступиться за национальный фондовый рынок, сообщив, что он пока сильно недооценён. Эти слова оказали поддержку котировкам акций SK hynix, которые отыграли утренние потери в ходе дальнейших торгов. «Это очевидно, что ИИ будет инфраструктурой для мира, так же, как и интернет был инфраструктурой для всего мира», — резюмировал свои комментарии по поводу ситуации на фондовом рынке глава Nvidia. Nvidia и SK hynix подписали соглашение о долгосрочном сотрудничестве в «широком спектре технологий»

08.06.2026 [04:46],

Алексей Разин

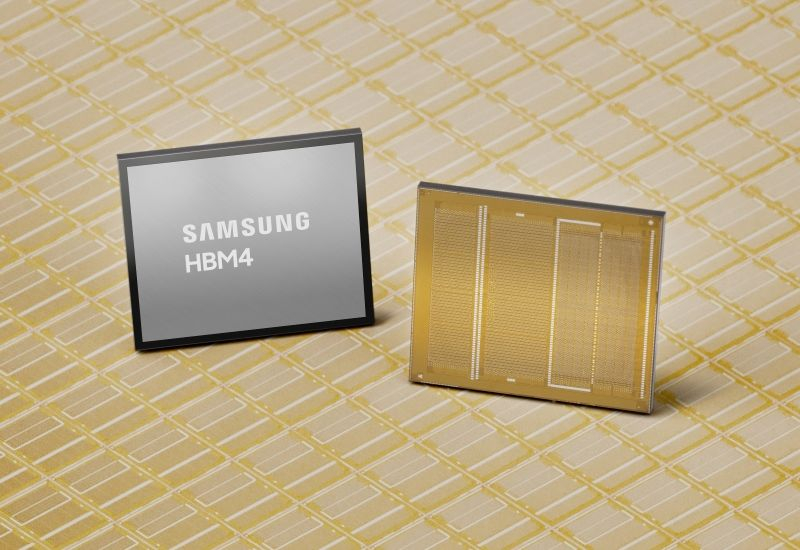

Основатель и бессменный лидер Nvidia Дженсен Хуанг (Jensen Huang) во время своего визита в Южную Корею не стал ограничиваться заявлениями о том, что все три крупнейших поставщика HBM4 прошли сертификацию и будут снабжать ускорители Vera Rubin эти типом памяти. Компания SK hynix была выделена из числа партнёров Nvidia, поскольку именно с ней было заключено долгосрочное соглашение о сотрудничестве.

Источник изображения: Nvidia Стороны будут на протяжении нескольких лет сотрудничать в сфере разработки и производства чипов, как можно понять из публикации Bloomberg. По всей видимости, данное соглашение усиливает роль SK hynix в создании новых поколений HBM и других видов памяти, которые Nvidia сочтёт привлекательными для применения. К слову, данные новости не уберегли акции SK hynix от снижения в цене на 10 % на торгах в понедельник, поскольку коррекция на фондовом рынке, которая в США наблюдалась в пятницу, эхом отразилась на азиатских площадках в первый рабочий день новой недели. По словам Хуанга, сотрудничество между Nvidia и SK hynix будет охватывать широкий спектр технологий, от передовых ИИ-моделей до агентских решений и физического воплощения ИИ. Все эти задачи потребуют использования памяти, причём разных типов. Центральные процессоры Vera, как добавил глава Nvidia, также будут использовать память DRAM производства SK hynix. Второе полугодие и весь следующий год, по словам Хуанга, будут очень насыщенными с точки зрения взаимодействия Nvidia и SK hynix. Nvidia умолчала про цену ПК на чипах RTX Spark, но партнёры компании уже говорят об их дороговизне

06.06.2026 [13:12],

Павел Котов

На выставке Computex 2026 в Тайбэе компания Nvidia представила свой первый потребительский процессор для ПК. Флагманский чип семейства RTX Spark, располагающий 20-ядерным центральным процессором и 6144 ядрами CUDA обещает оказаться очень дорогим удовольствием, передаёт PCWorld.

Источник изображения: nvidia.com Все участвующие в проекте партнёры Nvidia, в том числе Dell, Asus, MSI, HP, Lenovo и Microsoft, пообещали выпустить самые тонки и лёгкие машины для разработки в области искусственного интеллекта — ноутбуки и настольные компьютеры. Параллельно Microsoft проводила свою конференцию Build, на которой рассказала об этом чипе, но от ответа на прямой вопрос о стоимости чипа представители софтверного гиганта и самой Nvidia на этом мероприятии уклонялись. Microsoft, в частности, анонсировала Surface Laptop Ultra и Surface RTX Spark Dev Box, но курирующий направление Surface корпоративный вице-президент компании Эндрю Хилл (Andrew Hill) заявил: «Мы ещё не готовы говорить о о ценах, пока не приблизимся к дате начала продаж». На тот же срок сослался и представитель Nvidia. Это понятно: в условиях дефицита памяти цены к осени могут дополнительно вырасти. На Тайване, однако, представители других компаний оказались более откровенными. Один из источников на Computex 2026 сообщил, что компьютеры на флагманском чипе RTX Spark N1X, который демонстрировал лично глава Nvidia Дженсен Хуанг (Jensen Huang), будут стоить от $2500. ПК с младшим процессором N1 получат ценник около $2000. В соцсетях со ссылкой на аналитиков Morgan Stanley привели схожие цены: от $2900 за Nvidia RTX Spark N1X и от $1800 за N1. Рядовым пользователям такие цифры явно будут неприятны — согласятся на них разве что те, кто ищет относительно простой и недорогой способ разработки систем на базе ИИ. Американские производители чипов в пятницу сообща потеряли $1,3 трлн в капитализации

06.06.2026 [07:05],

Алексей Разин

Фондовый индекс PHLX вчера отличился рекордным с марта 2020 года дневным снижением на 10,3 %, а всего совокупная капитализация крупнейших американских производителей чипов за одну торговую сессию упала на $1,3 трлн. Принято считать, что во всём виноват не очень оптимистичный квартальный отчёт Broadcom.

Источник изображения: Intel Напомним, сама Broadcom подешевела на $300 млрд сразу после публикации квартального отчёта, которая сопровождалась прогнозами по выручке, которые разочаровали инвесторов. Прогноз по выручке от ИИ-чипов на следующий год в размере $100 млрд компания просто не стала повышать, но этого оказалось достаточно, чтобы запустить коррекцию на фондовом рынке, которая постепенно перекинулась и на других американских эмитентов. Индекс PHLX за две торговые сессии в совокупности опустился на 12 %. Возможно, влияние на фондовый рынок оказало и нервозное ожидание IPO компании SpaceX Илона Маска (Elon Musk), по итогам которого капитализация компании должна превысить $1,75 трлн, а привлечь планируется не менее $75 млрд. Возможно, рынок акций техногигантов несколько перегрет, а потому происходит коррекция в сторону снижения котировок. В любом случае, индекс PHLX в минувшую среду достиг исторического максимума, и даже после пятничной коррекции он может похвастать ростом на 73 % относительно начала текущего года. Nvidia, которая считается одним из главных выгодоприобретателей в условиях бума ИИ, в пятницу сократила свою капитализацию на 6 % или $300 млрд. Производитель памяти Micron Technology подешевел на 13 % и $150 млрд соответственно. Полюбившаяся инвесторам Marvell Technology просела в цене на 17 %, компания AMD потеряла 11 % своей капитализации. Определённым толчком к коррекции на фондовом рынке стала и статистика по американскому рынку труда, которая была опубликована накануне. Индекс $&P 500 просел на 2,6 %. Капитализация Broadcom в ходе двух торговых сессий сократилась на 20 %. Аналитики считают, что коррекция носит временный характер, говорить о переломе тенденции к росту котировок в полупроводниковом сегменте преждевременно. Все три крупнейших поставщика памяти получили одобрение Nvidia на поставки HBM4

05.06.2026 [14:26],

Алексей Разин

Уже в следующем квартале должны начаться поставки серверных систем поколения Vera Rubin, которые будут оснащаться одноимёнными ускорителями Nvidia с памятью типа HBM4. Как признался на этой неделе глава и основатель компании Дженсен Хуанг (Jensen Huang), все три крупнейших поставщика HBM4 прошли процедуру сертификации своей продукции под требования Nvidia.

Источник изображения: Samsung Electronics Напомним, для Samsung Electronics данный вопрос остаётся болезненным, поскольку оставаясь крупнейшим производителем памяти в целом, она уступила более мелкой SK hynix пальму первенства в сегменте HBM3E, поскольку её собственная память данного поколения долгое время не могла пройти сертификационные испытания Nvidia. Фактически, прогресс в этой сфере был достигнут к моменту, когда уже пришло время налаживать поставки HBM4. Память последнего типа Samsung начала отгружать клиентам самой первой, как она поспешила заявить ещё в середине февраля, а недавно она призналась, что начала снабжать клиентов и образцами более современной HBM4E. Возвращаясь к комментариям генерального директора Nvidia, можно отметить, что сертификацию HBM4 под её требования прошли компании Samsung Electronics, SK hynix и Micron Technology. Только они приступили к производству HBM4, поэтому список и ограничивается тремя поставщиками. Наличие у Nvidia трёх поставщиков позволяет снизить риски, связанные с чрезмерной зависимости от одного партнёра в данной сфере. Кроме того, это даёт Nvidia больше возможностей для торга при закупке HBM4. «Все три вендора прошли квалификацию. Все три вендора сейчас занимаются производством, и все они торопятся обеспечить поддержку Vera Rubin», — заявил Дженсен Хуанг во время своего визита в Сеул. Ускорители данного семейства уже выпускаются в массовых количествах, на рынок они поступят в третьем квартале текущего года. В Южной Корее у главы Nvidia запланированы встречи с руководством различных местных компаний, предсказуемо включая Samsung и SK hynix, а также посещение бейсбольного матча в выходные. По его словам, Nvidia активно нанимает персонал для своего нового южнокорейского исследовательского центра. США заподозрили существование лазеек для выпуска китайских чипов на передовых техпроцессах TSMC и Samsung

05.06.2026 [10:31],

Алексей Разин

При президенте Байдене американские власти планомерно ограничивали доступ китайских компаний к передовым ИИ-ускорителям американского происхождения, но представителям администрации Трампа приходится доказывать, что эти ограничения остаются в силе и соблюдаются. Это же касается и способности китайских разработчиков заказывать выпуск передовых чипов у TSMC и Samsung.

Источник изображения: Samsung Electronics В политических кругах США, как отмечает Bloomberg, в последнее время усилилась дискуссия по поводу неизменности принятых при Байдене экспортных ограничений, поскольку некоторые чиновники выдвинули предположение, что китайские компании сохраняют возможность легально и открыто покупать подпадающие под санкции ускорители Nvidia поколения Blackwell, эксплуатируя их не в самом Китае, а в соседних странах. Профильному комитету в составе Министерства торговли США даже пришлось опубликовать внеплановое уведомление, в котором текущее положение дел с ограничениями описывается специально для таких «паникёров». Как отмечается в документе, ограничения на продажу ИИ-ускорителей китайским компаниям, вступившие в силу в 2023 году, до сих пор действуют и должны соблюдаться. Теперь чиновники заинтересованных американских ведомств ведут расследование по поводу того, осуществлялись ли в период с мая прошлого года по настоящее время поставки запрещённых к ввозу в Китай ускорителей американского происхождения в интересах китайских компаний. Любые подобные поставки являются нарушением правил экспортного контроля США, и американские власти никаких послаблений в мае прошлого года в этой сфере не делали, как отмечают представители профильного министерства. Все утверждения об обратном являются недостоверными, пояснили они. Американские чиновники также обсуждают и другую якобы существующую лазейку, которая может позволять китайским разработчикам заказывать выпуск передовых чипов у компаний TSMC и Samsung. Последние хоть и базируются на Тайване и в Южной Корее соответственно, при выпуске чипов используют технологии и оборудование американского происхождения, а потому должны подчиняться правилам экспортного контроля США. Некоторые правительственные функционеры считают, что в мае прошлого года администрация Трампа могла сделать некие послабления в этой сфере. Представители Министерства торговли США вынуждены были заявить, что и этой лазейки в правилах экспортного контроля не существует. Подробные разъяснения на эту тему ведомство подготовит позднее. Глава и основатель Nvidia Дженсен Хуанг (Jensen Huang) в свете подобной полемики был приглашён на парламентские слушания, которые состоятся 11 июня текущего года. Генеральный директор компании известен своими либеральными взглядами на вопрос поставок американских ускорителей в Китай. Он добился того, что Дональд Трамп в начале этого года формально разрешил поставлять в КНР ускорители Nvidia H200. Китайская сторона отказалась их принимать, но это уже другая проблема. Репортаж со стенда ASUS на Computex 2026: первые ноутбуки с Nvidia RTX Spark, геймерские лэптопы и рабочие системы

05.06.2026 [09:21],

Андрей Созинов

На Computex 2026 компания ASUS представила множество новых ноутбуков, среди которых были как мощные игровые модели, так и тонкие элегантные решения для работы. Пожалуй, важнейшим анонсом стали новинки серии ProArt для создателей контента — первые ноутбуки ASUS на платформе Nvidia RTX Spark. Кроме того, ASUS показала обновлённые Zenbook и игровые системы TUF Gaming и ROG. Центральное место в экспозиции ASUS заняли ноутбуки ProArt P16 и ProArt P14. Эти модели первыми в ассортименте компании получили новую платформу Nvidia RTX Spark, объединяющую 20-ядерный Arm-процессор Nvidia Grace, графику на архитектуре Blackwell, сопоставимую с настольной GeForce RTX 5070, и унифицированную память объёмом до 128 Гбайт. Производитель заявляет производительность ИИ-вычислений до 1 петафлопса, что позволяет выполнять сложные задачи локально, без обращения к облачным сервисам. По сути, новые ProArt должны стать своеобразным ответом ASUS на современные MacBook Pro для профессионалов, работающих с графикой, видео, 3D и генеративным ИИ. Старший ProArt P16 оснащён 16-дюймовым сенсорным дисплеем ASUS Lumina Pro OLED с разрешением 4K и частотой обновления 120 Гц. Максимальная яркость достигает 1600 кд/м2. Несмотря на мощную начинку, ноутбук получил корпус толщиной всего 12,9 мм и массу 1,77 кг. Младший ProArt P14 предлагает схожую аппаратную платформу, но использует 14-дюймовый OLED-экран с разрешением 3K и также поддерживает частоту обновления 120 Гц. Оба устройства доступны в цветах Neo White и Nano Black и получили фирменный набор ИИ-инструментов ASUS для локальной работы с генеративными моделями и агентами. Рядом с новыми ProArt компания демонстрировала обновлённую линейку Zenbook 14. Интересно, что ASUS предлагает сразу три аппаратные платформы для одной модели. Покупатели смогут выбрать вариант на базе Intel Core Ultra 300, версию с процессорами AMD Ryzen AI 300 либо модификацию на платформе Snapdragon X Elite. Все ноутбуки выполнены в цельнометаллических корпусах с фирменным покрытием Ceraluminum, весят около 1,1–1,2 кг и относятся к категории Copilot+ PC. В зависимости от версии пользователям доступны OLED-дисплеи с разрешением до 3K и частотой обновления до 120 Гц. Среди игровых ноутбуков ASUS отметим дебютировавший на самой выставке обновлённый TUF Gaming 16. Ноутбук оснащается процессорами Intel вплоть до Core i7-14650HX и видеокартами Nvidia вплоть до GeForce RTX 5070. ASUS отдельно подчёркивает эффективность системы охлаждения, которая даже в режиме Turbo удерживает уровень шума на отметке около 40 дБ. Новинка ориентирована на поклонников киберспортивных дисциплин и современных AAA-игр, предлагая высокую производительность без характерного для мощных игровых ноутбуков уровня шума. На стенде компании также демонстрировались обновлённые модели TUF Gaming F16, A16, A14 и A18. Старшие F16 и A16 получили процессоры Intel Core Ultra 9 290HX Plus либо AMD Ryzen 9 8940HX соответственно, графику GeForce RTX 5070 и новые варианты дисплеев — вплоть до OLED-панелей 2.5K с частотой 165 Гц и IPS-экранов 2.5K с частотой обновления 300 Гц. Компактный TUF Gaming A14 массой всего 1,48 кг предлагается как в конфигурации с Ryzen AI Max+ 392 и унифицированной памятью, так и в версии с Ryzen AI 9 465 и GeForce RTX 5060. Для пользователей, которым нужен большой экран, ASUS подготовила TUF Gaming A18 с 18-дюймовой панелью и графикой вплоть до GeForce RTX 5070 Ti. Все новинки получили аккумуляторы ёмкостью до 90 Вт·ч, поддержку зарядки через USB Type-C и возможность самостоятельного апгрейда памяти и накопителей. Также ASUS представила множество свежих ноутбуков семейства ROG. На стенде можно было увидеть обновлённый ROG Strix G16 с флагманским процессором Intel Core Ultra 9 290HX Plus и видеокартой GeForce RTX 5080 с TGP до 175 Вт. Ноутбук оснащён 16-дюймовым дисплеем Nebula с разрешением 2.5K и частотой обновления 300 Гц. Ещё более впечатляюще выглядел флагманский ROG Strix SCAR 18. Эта модель получила тот же Core Ultra 9 290HX Plus, но более мощную графику GeForce RTX 5090, а также 18-дюймовый Mini-LED-дисплей Nebula HDR с разрешением 4K и частотой обновления 240 Гц. Этот ноутбук предлагает возможность установки до 128 Гбайт оперативной памяти и SSD объёмом до 8 Тбайт. Для поклонников тонких игровых ноутбуков ASUS привезла серию ROG Zephyrus. Модель Zephyrus G16 оснащается процессором Intel Core Ultra 9 386H и видеокартой вплоть до GeForce RTX 5090, тогда как компактный Zephyrus G14 получил AMD Ryzen AI 9 465 и GeForce RTX 5060. Оба ноутбука используют OLED-дисплеи Nebula HDR и фирменную систему охлаждения ROG Intelligent Cooling. Не менее эффектно смотрится и двухэкранный ROG Zephyrus Duo, оснащённый парой 2,8K OLED-панелей с частотой обновления 120 Гц и ориентированный на стримеров, разработчиков и создателей контента. В целом ноутбучная экспозиция ASUS на Computex 2026 выглядела очень масштабно. Компания одновременно продвигает несколько ключевых направлений — локальный ИИ на платформе Nvidia RTX Spark, универсальные Copilot+ PC для массового рынка и игровые системы нового поколения на базе GeForce RTX 50-й серии. Такой подход позволяет ASUS охватывать практически все категории пользователей — от профессиональных создателей контента до киберспортсменов и энтузиастов мобильного гейминга. «Мы изобретаем ПК заново»: Nvidia объяснила, почему не делает портативную консоль на RTX Spark

04.06.2026 [11:19],

Алексей Разин

Когда Nvidia основную часть своей выручки получала на игровом рынке, она пыталась находить соответствующее применение и своим центральным процессорам Tegra, создавая на их основе портативные игровые устройства. Сейчас приоритеты компании так сильно сместились в серверный сегмент, что она открыто говорит — на создание современных портативных консолей на основе RTX Spark у неё нет времени.

Источник изображения: Nvidia О возможности появления такой консоли у главы и основателя Nvidia Дженсена Хуанга (Jensen Huang) спросили на Computex 2026, где компания представила свою масштабную инициативу RTX Spark по продвижению ИИ-процессоров с Arm-совместимой архитектурой в сегмент ПК под управлением Windows. Генеральный директор Nvidia так ответил на вопрос о создании игровой консоли на основе RTX Spark: «Если кто-нибудь захочет это сделать, мы поработаем с ним над этим. Но сейчас мы сосредоточены на кое-чём более крупном — изобретении ПК заново после 40 лет присутствия на рынке». Хуанг пояснил, что всё многообразие приложений для x86-совместимых чипов должно безупречно работать на новой платформе, все игры для неё должны поддерживать средства борьбы с читерами, и всё это очень сложно в реализации. Nvidia работала с Microsoft на протяжении трёх лет, и с MediaTek на протяжении двух с половиной лет, чтобы вывести на рынок RTX Spark. Для Nvidia, по его словам, сейчас слишком важна возможность переопределить рынок ПК, и такая возможность выпадает раз в 40 лет, её важно использовать по полной и не распылять усилия на второстепенные задачи. С одной стороны, подобные комментарии главы Nvidia могут в очередной раз показать, что игровой сегмент перестал быть для компании приоритетным. Действительно, по итогам прошлого квартала, как считают некоторые источники, собственно игровая выручка Nvidia опустилась ниже уровня в 5 % от совокупной, основные деньги компании приносит серверный сегмент. С другой стороны, вслед за чипом N1x в семействе RTX Spark выйдет и более скромный по характеристикам вариант N1, который уже сможет обеспечить приемлемое для портативной консоли энергопотребление. Возможно, его-то кто-то из партнёров Nvidia и захочет использовать в основе игровой консоли, но сама компания такую идею продвигать сейчас просто не готова. Apple доверит ИИ-чипам Nvidia обработку данных пользователей Siri

04.06.2026 [10:12],

Алексей Разин

Исторически Apple делала особый упор на защиту личных данных своих пользователей, а потому нередко полагалась на фирменную инфраструктуру при их обработке, чтобы полностью контролировать процесс. Полагаясь на инфраструктуру Google Cloud в работе ассистента Siri, она сможет усилить защиту данных через фирменную функцию ускорителей Nvidia Blackwell.

Источник изображения: Nvidia Как поясняет 9to5Mac со ссылкой на The Information, при работе новой версии Siri часть запросов будет направляться в Google Cloud, где будет обрабатываться адаптированной версией ИИ-модели Google Gemini. Недавно Apple одобрила использование в этом сегменте ускорителей вычислений Nvidia B200 поколения Blackwell, поскольку они обладают функцией встроенного шифрования данных, позволяя безопасно их обрабатывать даже в облачных системах. По данным Nvidia, использование встроенного шифрования данных незначительно сказывается на скорости обработки запросов. Аналогичные возможности предлагаются и более современными ускорителями Nvidia поколения Rubin, поэтому у Apple сохранится возможность масштабировать соответствующие вычислительные мощности в сотрудничестве с Google. При этом Apple на протяжении последних двух лет развивает и собственную облачную платформу для доверенной работы с данными — Private Cloud Compute (PCC). Как она может быть интегрирована с учётом необходимости запуска новой версии ИИ-сервиса Siri, пока не уточняется. Репортаж со стенда MSI на Computex 2026: первый ноутбук на Nvidia RTX Spark, юбилейный Titan с RTX 5090 и другие новинки

03.06.2026 [14:49],

Андрей Созинов

На выставке Computex 2026 компания MSI традиционно представила множество интересных игровых и рабочих ноутбуков. В этом году MSI отмечает своё 40-летие, в честь которого подготовила ряд специальных устройств, включая флагманский ноутбук Titan 18 HX Dragon Edition Draco Epic. Одновременно производитель представил первый ноутбук на новой платформе Nvidia RTX Spark, обновил серии Katana и Venture, а также показал необычную версию игрового ноутбука Crosshair в белом исполнении. Titan 18 HX Dragon Edition Draco Epic — флагман к 40-летию MSI Главной звездой стенда MSI стал Titan 18 HX Dragon Edition Draco Epic — специальная юбилейная версия флагманского игрового ноутбука компании. Новинка вдохновлена созвездием Дракона и получила корпус с вытравленным в металле рисунком и анодированным покрытием. Кроме уникального дизайна, ноутбук отличается комплектацией: в неё вошли уникальная игровая мышь, коврик и памятная коллекционная монета. Техническое оснащение устройства впечатляет. Titan 18 HX Dragon Edition Draco Epic получил 24-ядерный процессор Intel Core Ultra 9 290HX Plus с частотой до 5,5 ГГц и мобильную видеокарту GeForce RTX 5090 с 24 Гбайт памяти GDDR7. Объём оперативной памяти может достигать 128 Гбайт DDR5, а подсистема хранения данных включает сразу четыре слота для SSD — один PCIe 5.0 и три PCIe 4.0. Отдельного внимания заслуживает дисплей. Для вывода изображения здесь используется 18-дюймовый Mini-LED-дисплей с разрешением UHD+ (3840 × 2400 пикселей), частотой обновления 240 Гц, охватом 100 % цветового пространства DCI-P3 и сертификацией VESA DisplayHDR 1000. Дополняют конфигурацию механическая клавиатура SteelSeries Cherry MX с поклавишной RGB-подсветкой, тактильный тачпад с обратной связью, система охлаждения на базе испарительной камеры и аудиосистема Dynaudio с шестью динамиками. MSI позиционирует Titan 18 HX Dragon Edition как полноценную замену настольному ПК для геймеров, создателей контента и профессионалов, которым требуется максимально высокая производительность. Prestige N16 Flip AI+ — первый ноутбук MSI на платформе Nvidia RTX Spark Не менее важной премьерой для MSI стал Prestige N16 Flip AI+ — первый ноутбук производителя на новой платформе Nvidia RTX Spark. По сути, речь идёт о новом классе устройств, ориентированных на локальное выполнение ИИ-задач, запуск больших языковых моделей, генеративных приложений и ускорение творческих рабочих процессов. Чипы Nvidia RTX Spark предлагают сочетание мощного центрального процессора и производительной графики. В максимальной конфигурации доступны 20 процессорных ядер с архитектурой Arm и графический процессор Blackwell с 6144 ядрами CUDA — как у настольной GeForce RTX 5070. Prestige N16 Flip AI+ выполнен в формате трансформера с шарниром, позволяющим раскрывать экран на 360 градусов. Устройство может работать в режимах ноутбука, планшета, презентации и «палатки», что делает его универсальным инструментом для работы и творчества. Вместе с тем новинка обладает тонким корпусом и небольшим весом, что делает использование в режиме планшета более комфортным. Одной из особенностей новинки стал 16-дюймовый сенсорный дисплей UHD+ Tandem OLED. Панель использует двухслойную OLED-структуру, обеспечивающую яркость свыше 1000 кд/м² при одновременном повышении энергоэффективности и долговечности. Экран охватывает 100 % цветового пространства DCI-P3, прошёл заводскую калибровку Calman и обеспечивает точность цветопередачи Delta E < 2. Также поддерживается технология переменной частоты обновления VRR. Ноутбук получил аккумулятор ёмкостью 99,9 Вт·ч, аудиосистему с четырьмя динамиками, стилус MSI Nano Pen и фирменную сенсорную панель MSI Action Touchpad с поддержкой жестового управления. Prestige 14 Flip AI+ Vincent van Gogh Edition — искусство и технологии В рамках коллекции MSI Artisan компания представила пару ноутбуков Prestige 14 Flip AI+ Vincent van Gogh Edition. Серия вдохновлена картинами Винсента ван Гога «Звёздная ночь» и «Звёздная ночь над Роной», мотивы которых использованы в оформлении корпуса устройства. Несмотря на необычный внешний вид, ноутбук представляет собой вполне серьёзное рабочее устройство. Он оснащён 16-ядерным процессором Intel Core Ultra X9 378H с частотой до 5 ГГц и встроенной графикой Intel Arc B390, которые дополняют до 64 Гбайт памяти LPDDR5X. Ноутбук оснащён 14-дюймовым сенсорным OLED-дисплеем с охватом 100 % цветового пространства DCI-P3 и поддержкой стилуса MSI Nano Pen. Вес модели составляет всего 1,37 кг, а аккумулятор ёмкостью 81 Вт·ч рассчитан на полный рабочий день без подзарядки. Ноутбук ориентирован на мобильных специалистов, дизайнеров и создателей контента, которым важны компактность, достойная производительность и качественный экран. Crosshair 16 HX MLG Edition — игровая модель с необычным дизайном Среди игровых моделей отдельного внимания также заслуживает Crosshair 16 HX MLG Edition. Новинка получила белый корпус Stellar White с перламутровым покрытием, которое меняет оттенок и приобретает красноватый отблеск при изменении освещения. Дизайн вдохновлён персонажем MSI MLG («Принцесса Драконов»), который используется компанией в качестве одного из символов игрового направления. Технически ноутбук относится к производительным игровым моделям среднего и верхнего сегментов. Он оснащается процессором AMD Ryzen 7 8840HX, видеокартой вплоть до GeForce RTX 5070, 16-дюймовым экраном QHD+ с частотой обновления 240 Гц и охватом 100 % DCI-P3, а также поддерживает установку до 96 Гбайт памяти DDR5. Пока модель заявлена только для китайского рынка, однако она демонстрирует стремление MSI экспериментировать не только с производительностью, но и с внешним видом игровых ноутбуков. Katana 15 HX — обновление массовой игровой серии Не забыла MSI и про одну из своих самых популярных игровых линеек. Ноутбук Katana 15 HX получил обновлённый дизайн и современную аппаратную платформу. Компания позиционирует модель как решение для широкого круга игроков, которым нужна высокая производительность без переплаты за премиальные функции флагманских серий. Ноутбук может оснащаться процессорами Intel вплоть до Core i9-14900HX и видеокартами Nvidia вплоть до GeForce RTX 5070. Также предусмотрены до 96 Гбайт оперативной памяти DDR5, два слота для SSD и 15,6-дюймовый IPS-дисплей с разрешением Full HD и частотой обновления 144 Гц. Venture 15 AI+ — универсальный ноутбук с ИИ для повседневных задач Линейка Venture ориентирована на пользователей, которым нужен универсальный ноутбук для работы, учёбы и развлечений. На Computex 2026 серия получила обновление в виде процессоров Intel Core Ultra нового поколения и расширенных возможностей для работы с ИИ-приложениями. Модель Venture 15 AI+ оснащается процессором Intel Core Ultra X7 358H, встроенной графикой Intel Arc B390 и памятью LPDDR5X объёмом до 64 Гбайт. Ноутбук также получил 15,6-дюймовый IPS-дисплей Full HD с частотой обновления 144 Гц. В отличие от игровых моделей, здесь основной упор сделан на сбалансированность, энергоэффективность и универсальность. MSI подчёркивает, что серия Venture предназначена для широкого спектра задач — от офисной работы до лёгких творческих нагрузок. Claw 8 EX AI+ — портативная консоль нового поколения Хотя Claw 8 EX AI+ не относится к ноутбукам, пройти мимо неё на стенде MSI было невозможно. Фактически это один из самых интересных анонсов выставки наряду с Titan 18 HX Dragon Edition. Консоль стала первым подобным устройством на платформе Intel Arc G3 Extreme, специально оптимизированной для портативного гейминга. Чип включает центральный процессор Panther Lake с 14 ядрами и частотой до 4,7 ГГц, а за графику отвечает встроенный ускоритель Intel Arc B390. Устройство оснащено 8-дюймовым сенсорным экраном FHD+ с частотой обновления до 120 Гц и поддержкой VRR, памятью LPDDR5X объёмом до 32 Гбайт и аккумулятором ёмкостью 80 Вт·ч. Консоль также получила стики и триггеры с датчиками Холла, а также линейный вибромотор для тактильной отдачи. Приставка поддерживает технологии XeSS 3, Multi-Frame Generation и Xbox Mode для быстрого запуска игр. В этом году MSI привезла на Computex весьма разноплановую линейку мобильных устройств. Titan 18 HX Dragon Edition стал демонстрацией максимальных возможностей современных игровых ноутбуков, Prestige N16 Flip AI+ показал взгляд компании на будущее AI PC, а Prestige 14 Flip AI+ доказал, что ноутбукам не обязательно быть строгими и скучными. В целом экспозиция MSI охватила практически все ключевые сегменты рынка — от портативного гейминга до профессиональных систем для работы с искусственным интеллектом. Глава Intel заявил, что доминированию x86-совместимой архитектуры в серверном сегменте ничего не угрожает

03.06.2026 [08:03],

Алексей Разин

Генеральный директор Intel Лип-Бу Тан (Lip-Bu Tan) выступил со сцены Computex 2026 в Тайбэе, а также сделал несколько интересных заявлений на пресс-конференции, которая последовала затем. Он не только назвал TSMC и Nvidia важными партнёрами Intel, но и подчеркнул, что доминированию x86-совместимой архитектуры в серверном сегменте в обозримом будущем ничего не угрожает.

Источник изображения: Intel Как отмечает Nikkei Asian Review, глава Intel начал с комментария о том, что x86-совместимая архитектура лежит в основе серверных процессоров уже на протяжении почти 50 лет, и она сохранит за собой лидирующие позиции. По крайней мере, аналитики IDC прогнозируют, что 80 % установленных до 2030 года серверных систем будут использовать именно x86-совместимые чипы. Под руководством Лип-Бу Тана компания Intel сохраняет перед собой задачу предлагать лучшие x86-совместимые процессоры на рынке. Тан попутно отметил, что в течение первого года своего пребывания в должности генерального директора Intel он стремился навести порядок в финансах и бухгалтерском отчёте, а также привлечь к управлению компанией «лидеров мирового класса». По его мнению, с этими задачами он справился. «Теперь наш фокус заключается в расширении бизнеса и обеспечении лидерства в отрасли», — пояснил Лип-Бу Тан. Компанию Nvidia, которая недавно замахнулась на кусок «процессорного пирога» Intel, глава последней по-прежнему считает «хорошим другом». Помимо прочего, Nvidia является одним из крупных акционеров Intel, как напомнил Тан. Если говорить о TSMC, то и её руководство Intel продолжает считать близким партнёром. «Многие из наших продуктов продолжают зависеть от TSMC», — подчеркнул глава Intel. По данным Counterpoint Research, на рынке процессоров для ПК компания Intel по итогам текущего года должна занять около 58 %. В серверном сегменте она сохранит за собой около 53 %. При этом сложно отрицать, что Arm-совместимые решения продолжают теснить более традиционные x86-совместимые как в серверном, так и в потребительском сегменте рынка. В текущем году они займут 23 % серверного рынка и около 17 % потребительского. Свои Arm-совместимые чипы для ПК предлагают Apple, MediaTek, Nvidia и Qualcomm, а недавно Arm заявила о намерениях продавать собственные чипы серверного назначения. Nvidia возобновила производство GeForce RTX 3060 12GB в Китае из-за нехватки недорогих современных видеокарт и проблем с поставками памяти

03.06.2026 [07:17],

Алексей Разин

Компания Nvidia уже давно около 90 % своей выручки получает в серверном сегменте, поэтому интересы игрового направления бизнеса, который в своё время позволил ей занять лидирующие позиции на рынке, обслуживаются по остаточному принципу. Недавно Nvidia решила возобновить выпуск GeForce RTX 3060 с 12 Гбайт памяти в Китае, чтобы хоть как-то компенсировать такую расстановку приоритетов.

Источник изображения: Colorful Как сообщает VideoCardz со ссылкой на сообщения в профильном онлайн-сообществе, являющаяся партнёром Nvidia компания Colorful начала заново формировать складские запасы видеокарт GeForce RTX 3060 с 12 Гбайт памяти в Китае, хотя пока с учётом географического распределения новых партий говорить об изобилии предложений сложно. Тем не менее, поставки новых партий такой продукции планируется осуществлять в Китае на еженедельной основе. Розничная цена такой видеокарты в Китае составляет около $325. Это даже ниже, чем указано в официальном интернет-магазине Colorful. В прошлом месяце как раз сообщалось о намерениях Nvidia поставить на рынок новую партию видеокарт GeForce RTX 3060 с 12 Гбайт памяти в июне. Asus, MSI и Galax должны присоединиться к Colorful где-то с июля этого года. Непосредственно версия GeForce RTX 3060 с 12 Гбайт памяти дебютировала ещё в 2021 году по рекомендованной цене $329, но теперь она возвращается на рынок, чтобы хоть как-то насытить рынок в условиях отсутствия выбора недорогих современных видеокарт и дефицита микросхем памяти. SK hynix за ближайшие пять лет удвоит производственные мощности по выпуску памяти

02.06.2026 [11:18],

Алексей Разин

Значимость производителей памяти подчёркивается хотя бы тем фактом, что председатель совета директоров южнокорейской SK Group Чхэ Тхэ Вон (Chey Tae-won) оказался приглашён на отраслевую выставку Computex 2026 на Тайване, где сделал несколько важных заявлений. В частности, он пообещал удвоить мощности SK hynix по производству памяти за последующие пять лет.

Источник изображения: SK hynix Он же в марте этого года, как напоминает Reuters, сообщил о возможности сохранения дефицита памяти на мировом рынке до 2030 года. SK hynix, которая в составе упоминаемого южнокорейского конгломерата занимается выпуском памяти, нуждается в расширении круга своих партнёров на Тайване, и дело не должно ограничиваться одной лишь TSMC, как отметил глава холдинга. Чхэ Тхэ Вон выразил надежду, что SK hynix сможет остаться крупнейшим поставщиком HBM для ускорителей Nvidia Vera Rubin. Как известно, на этот статус претендует конкурирующая Samsung Electronics, но SK hynix явно не собирается сдаваться без боя. На прошлой неделе капитализация SK hynix впервые в истории превысила $1 трлн, что говорит об уверенности инвесторов в способности этого производителя памяти развивать бизнес в условиях бума ИИ. По данным Counterpoint Research, в первом квартале текущего года SK hynix сохраняла за собой 58 % мирового рынка HBM, а Samsung и Micron досталось по 21 %. Глава Nvidia пообещал справиться с любым спросом на процессоры, несмотря на дефицит чипов

02.06.2026 [09:52],

Алексей Разин

Компания Nvidia на этой неделе заявила о нешуточных амбициях на рынке ПК, предложив платформу RTX Spark, которая позволит ей побороться с Intel и AMD в сегменте центральных процессоров потребительского класса. Основатель Nvidia Дженсен Хуанг (Jensen Huang) полон уверенности, что у компании хватит ресурсов для наращивания поставок в условиях бума ИИ.

Источник изображения: Nvidia «Мы обеспечили объёмы поставок с учётом очень стремительного роста по всем этим системам. У нас есть возможность обеспечить рынок в условиях очень резкого роста, но мы всё равно ограничены со стороны поставок», — традиционно эмоционально охарактеризовал ситуацию в отрасли Дженсен Хуанг, на которого ссылается Reuters. Он также добавил, что Nvidia сейчас в инфраструктуре Тайваня является крупнейшим покупателем местной продукции. Выпуском чипов для Nvidia традиционно занимается компания TSMC, основная часть предприятий которой сосредоточена на Тайване, хотя недавно выпуск 4-нм продукции TSMC начала в Аризоне. Процессоры Vera серверного назначения, по словам Дженсена Хуанга, будут ещё более популярны, чем GPU марки Nvidia, поскольку центральные процессоры играют более важную роль инференсе уже обученных ИИ-моделей. «Это будет наш новый главный драйвер роста», — охарактеризовал процессоры Vera генеральный директор Nvidia. Попутно он высказался о своём стремлении платить сотрудникам компании как можно больше, проводя параллели с историей про забастовку сотрудников Samsung Electronics. Идеи об угрозе для рынка труда со стороны ИИ основатель Nvidia отметает решительным образом. По его мнению, внедрение ИИ только способствует росту выручки, прибыли и ВВП в национальных и мировых масштабах. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |