|

Опрос

|

реклама

Быстрый переход

«Это победа всей экосистемы»: Qualcomm обрадовалась приходу Nvidia на рынок процессоров для ПК

01.06.2026 [18:32],

Анжелла Марина

Старший вице-президент вычислительных систем Qualcomm Кедар Кондап (Kedar Kondap) прокомментировал выход Nvidia на рынок Windows on Arm с новыми чипами RTX Spark на презентации в рамках Computex 2026. В Qualcomm назвали появление конкурента подтверждением роста экосистемы и позитивным сигналом для всей индустрии.

Источник изображения: Qualcomm Отвечая на вопрос о том, что Qualcomm думает о выходе Nvidia в сегмент ПК, Кондап поприветствовал нового игрока и заявил, что компания испытывает воодушевление. Он подчеркнул, что многолетние инвестиции Qualcomm в развитие периферии и программного обеспечения, а также поддержку более 2500 игр на Snapdragon теперь получили рыночное подтверждение. По мнению Кондапа, появление Nvidia создаёт «попутный ветер для всей экосистемы Arm на Windows».

Источник изображения: Nvidia Qualcomm рассматривает анонс RTX Spark как благо для всей отрасли, хотя компания не упускает возможности напомнить о своей ведущей роли на сегодняшний день в экосистеме Windows на архитектуре Arm. При этом наибольшие опасения сложившаяся ситуация должна вызывать у производителей x86-чипов, поскольку платформа Arm перестала быть второстепенной. В частности, благодаря Snapdragon сейчас выпускаются сотни устройств с Arm SoC, а появление Nvidia создаёт дополнительные преимущества для всей экосистемы Windows on Arm. Журналисты также уточнили позицию Qualcomm касательно заявлений Nvidia об абсолютной совместимости новых чипов с приложениями для Windows. Механизм решения этой проблемы остаётся неизвестным, поскольку текущие устройства на базе Snapdragon вынуждены использовать слой эмуляции Prism из состава Windows 11, который периодически выдаёт ошибки при запуске старых программ и современных игр. Однако Кондап напомнил о многолетнем партнёрстве с Microsoft, включая выпуск первых ПК класса Copilot+ и поддержку NPU в операционной системе, выразив уверенность в прочности этого сотрудничества. «Наше партнёрство с Microsoft продолжается уже несколько лет. Вместе мы представили первые ПК класса Copilot+. Мы запустили первые платформы, на которых ОС Windows обеспечивала поддержку NPU, а также механизмов распределённых вычислений, задействующих различные ядра процессора...», — отметил он. В Qualcomm добавили, что новые чипы Nvidia могут стимулировать разработчиков активнее работать с Arm-архитектурой, что в долгосрочной перспективе выгодно и самой Qualcomm. Пока же компания намерена продолжать обслуживать рынок Windows устройствами на Snapdragon в ценовом диапазоне от $300 до $1699 за флагманскую модель Snapdragon X2 Elite Extreme. Ожидается, что чипы Nvidia будут нацелены на премиальный сегмент с ценами значительно выше текущего верхнего порога для Snapdragon. HP представила «самые тонкие в мире» ноутбуки OmniBook Ultra 16 и X 14 на процессоре Nvidia RTX Spark

01.06.2026 [16:57],

Николай Хижняк

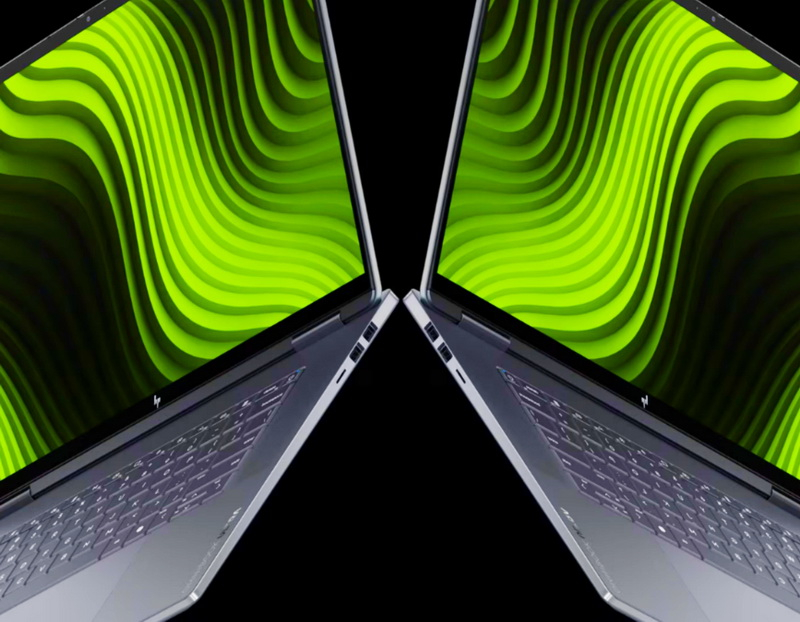

Компания HP анонсировала ноутбуки OmniBook Ultra 16 и OmniBook X 14 на базе новой платформы Nvidia RTX Spark. Представленные модели производитель называет «самыми тонкими в мире».

OmniBook Ultra 16. Источник изображений: HP Ноутбуки HP нового поколения с унифицированной памятью объёмом до 128 Гбайт и графической архитектурой Blackwell предназначены для запуска сложных локальных ИИ-агентов и выполнения ресурсоёмких творческих задач разработчиками и опытными пользователями. Их выход запланирован на конец 2026 года. В составе представленных новинок используется архитектура «суперчипа» Nvidia, в которой сочетаются высокопроизводительный графический процессор на базе Blackwell и 20-ядерный процессор Grace на базе Arm. HP отмечает, что платформа RTX Spark превращает ноутбуки из традиционных инструментов повышения производительности в «персональные компьютеры с искусственным интеллектом». Детальные характеристики представленных новинок компания по понятным причинам не сообщает. До их выпуска ещё очень далеко, и за это время что-то может измениться. Однако производитель выделяет следующие ключевые особенности представленных ноутбуков:

Nvidia и Unitree представили эталонного человекоподобного робота Isaac GR00T

01.06.2026 [15:08],

Алексей Разин

Программные и аппаратные платформы для разработчиков робототехники Nvidia предлагает уже давно, но в сотрудничестве с китайской Unitree компания впервые предложила начинающим разработчикам человекоподобных роботов эталонную платформу Isaac GR00T, в состав которой входит непосредственно сам робот с готовыми кистевыми манипуляторами и сопутствующим программным обеспечением.

Источник изображения: Nvidia По сути, данное предложение, которым клиенты Unitree смогут воспользоваться с конца 2026 года, позволит стартапам заняться разработкой собственного ПО для человекоподобных роботов, не тратя время на создание аппаратной основы. Эталонный робот Unitree H2 при росте около 180 см и массе 68 кг уже будет предлагать полноценные кистевые манипуляторы Sharpa с 22 степенями свободы, а в общей сложности система будет обладать 75 степенями свободы. Стереоскопическая камера в голове робота будет обладать углом обзора 140 градусов по горизонтали и 102 градуса по вертикали, а дополнительные камеры в запястьях позволят более точно выполнять мелкие манипуляции. Инерционные датчики тоже пригодятся при обучении робота различным движениям. Исполнительные механизмы рук способны развивать крутящий момент до 120 Н·м, ног — до 360 Н·м, а масса поднимаемого роботом груза может варьироваться в диапазоне от 7 до 15 кг. Основой вычислительных возможностей платформы является чип Nvidia Jetson AGX Thor T5000, который силами своих 14 ядер CPU с архитектурой Arm и графического процессора Blackwell обеспечивает быстродействие до 2070 терафлопс в вычислениях типа FP4. Унифицированная память объёмом 128 Гбайт соседствует с беспроводными интерфейсами Wi-Fi 6 и Bluetooth 5.2, хотя при необходимости можно воспользоваться и проводными Ethernet или USB. Уровень TDP настраивается в диапазоне от 40 до 130 Вт, а модульная компоновка позволяет клиенту отказаться от избыточных функций. Штатной батареи ёмкостью 15 А·ч хватает на три часа работы, но для нужд разработки этого может быть достаточно. Робот поддерживает функцию экстренной аварийной остановки по дистанционной команде. Программная составляющая представлена инструментарием Isaac Teleop для трансляции данных, открытыми базовыми моделями Isaac GR00T с поддержкой обучения, рассуждения и многозадачности, а также решениями Isaac Sim и Isaac Lab для симуляции работы в виртуальной среде. Наконец, Isaac ROS потребуется для тиражирования полученного в ходе разработки ПО на парк эксплуатируемых роботов. Jetson Thor позволяет решать связанные с инференсом задачи непосредственно на уровне робота в масштабе реального времени. Профильное ПО для разработчиков вскоре появится на ресурсах GitHub и Hugging Face, а непосредственно поставки аппаратного обеспечения в виде эталонного робота Unitree обещает начать в конце текущего года. Дженсену Хуангу пришлось добавить на Computex 2026, что Nvidia аналогичным образом будет сотрудничать и с разработчиками роботов из США, Европы и Южной Кореи, и китайской Unitree дело не ограничится. Nvidia представила технологию DLSS 4.5 Ray Reconstruction — её получат все видеокарты GeForce RTX

01.06.2026 [14:29],

Николай Хижняк

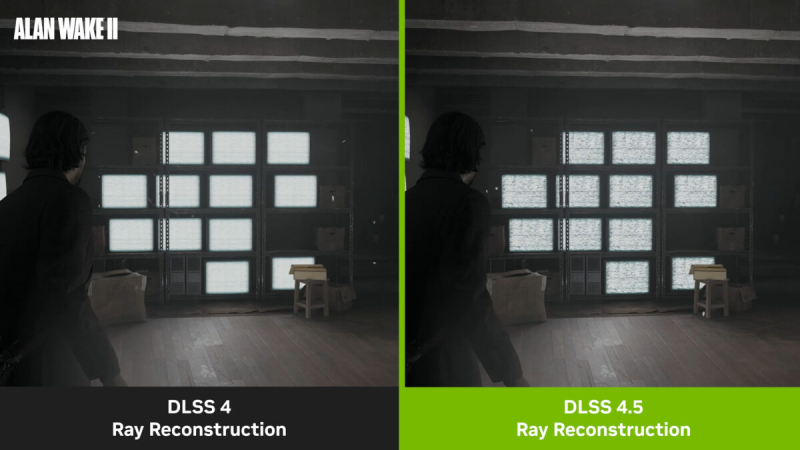

Nvidia анонсировала DLSS 4.5 Ray Reconstruction — новую версию модели шумоподавления и реконструкции изображения на основе искусственного интеллекта для игр с трассировкой лучей и путей. Обновление выйдет в августе этого года и будет доступно для всех видеокарт GeForce RTX, включая серии RTX 20, RTX 30, RTX 40 и RTX 50. Настройки будут доступны в приложении Nvidia App.

Источник изображений: Nvidia По словам Nvidia, в DLSS 4.5 Ray Reconstruction используется ИИ-модель трансформер второго поколения. Компания утверждает, что она обладает на 35 % более высокой вычислительной мощностью и обрабатывает на 20 % больше параметров, сохраняя при этом производительность на уровне текущей версии. Nvidia отмечает, что DLSS 4.5 Ray Reconstruction повышает точность освещения, временную стабильность и чёткость движения в играх с трассировкой лучей и путей. По словам компании, модель была обучена на более обширном наборе данных, чем текущая версия, и предоставляет разработчикам больше возможностей для управления временным накоплением. На момент запуска DLSS 4.5 Ray Reconstruction будет поддерживать 27 игр. В их числе: Alan Wake 2, Cyberpunk 2077, DOOM: The Dark Ages, F1 25, Half-Life 2 RTX, Hogwarts Legacy, Indiana Jones and the Great Circle, Portal with RTX, Star Wars Outlaws и The First Descendant. Nvidia также перечислила другие игры, которые получат поддержку некоторых технологий DLSS 4.5. В Naraka: Bladepoint с 5 июня появится поддержка DLSS 4.5 Super Resolution. В Marvel Rivals поддержка той же технологии появится 12 июня. Ролевая игра Gothic Remake выйдет 5 июня с поддержкой DLSS 4.5 Super Resolution и технологии многокадровой генерации. Squad получит поддержку DLSS 4.5 15 июня, а Hell Let Loose: Vietnam — поддержку DLSS 4.5 Super Resolution 18 июня. Anthropic, OpenAI и SpaceX первыми внедрят серверные процессоры Nvidia Vera

01.06.2026 [12:42],

Алексей Разин

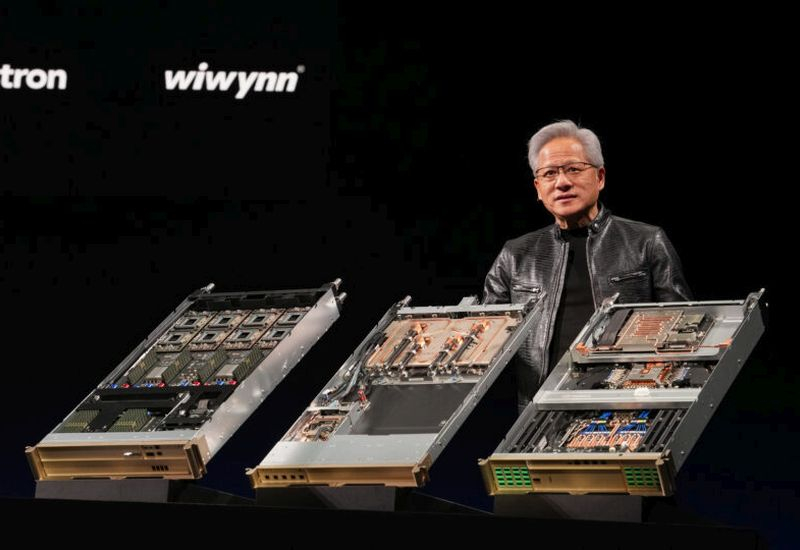

В третьем квартале этого года, как дал понять на Computex 2026 глава и основатель Nvidia Дженсен Хуанг (Jensen Huang), центральные процессоры Vera серверного назначения начнут массово производиться. Ими уже активно интересуются крупные компании ИИ-сегмента типа OpenAI, Anthropic и SpaceX, как добавил Хуанг, они будут первыми использовать их в своих ЦОД.

Источник изображения: Nvidia До сих пор развитие вычислительной инфраструктуры ИИ во многом полагалось на GPU компании Nvidia, но по мере перехода к инференсу они начали отходить на второй план. Центральные процессоры оказались более востребованными, и в этом сегменте Nvidia не собирается уступать рынок Intel и AMD, также предлагая собственные серверные CPU, которые в текущем поколении известны под наименованием Vera. В прошлом месяце Дженсен Хуанг отметил, что доля решений Nvidia в инфраструктуре Amazon (AWS) продолжает расти даже в условиях, когда этот клиент стремится всё активнее использовать компоненты собственной разработки типа тех же чипов семейства Graviton. Именно Nvidia способна предлагать клиентам комплексные готовые решения для ЦОД самого разного назначения. Даже начинающие разработчики с помощью фирменной инфраструктуры Nvidia очень быстро могут развивать бизнес, как убеждён глава компании. По его словам, процессоры Vera в 1,8 раза быстрее в некоторых ИИ-задачах по сравнению с процессорами Intel, использующими x86-совместимую архитектуру. Nvidia также предлагает клиентам продвинутое ПО для управления ЦОД и мониторинга основными показателями, включая уровень энергопотребления. Только за счёт более эффективного управления клиенты Nvidia могут на 40 % увеличить количество используемых ускорителей этой марки, не выходя за рамки общего целевого уровня энергопотребления. В рамках сотрудничества с китайской Unitree компания Nvidia также предложила разработчикам человекоподобных роботов некие эталонные наборы и платформы для быстрого создания таких роботов. По крайней мере, управляющие чипы и прилагаемое к ним ПО будут согласованы и готовы к работе друг с другом, а ещё клиентам будут поставляться уже готовые кисти рук для таких роботов, которые не потребуется обучать базовым манипуляциям с нуля. Nvidia представила процессор RTX Spark для Windows-ноутбуков — 20 ядер Arm и мощная графика RTX Blackwell

01.06.2026 [11:53],

Николай Хижняк

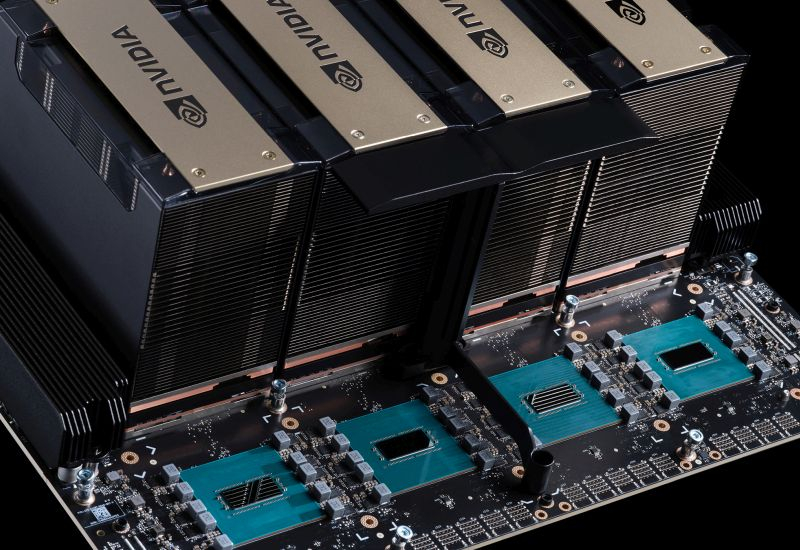

Компания Nvidia официально анонсировала RTX Spark — новую платформу для ПК на базе Windows, построенную на суперчипе Grace Blackwell. Своим анонсом компания подтверждает, что выходит на рынок потребительских процессоров для ПК с полноценным однокристальным решением, а не просто дискретным графическим процессором.

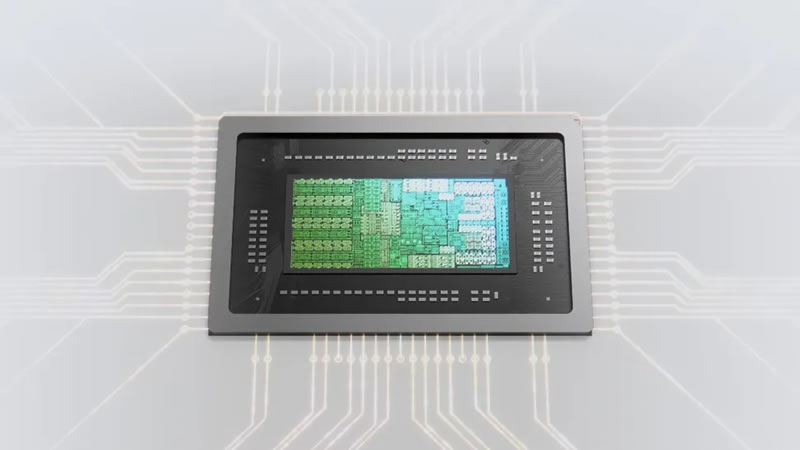

Источник изображений: Nvidia Чип был представлен совместно с Microsoft на конференции GTC в Тайбэе. Nvidia заявляет, что RTX Spark предназначен для работы с искусственным интеллектом, создания контента, а также для игр. Этой осенью платформа появится в тонких ноутбуках на базе Windows и компактных настольных ПК. В составе RTX Spark используется графический процессор Blackwell RTX с 6144 ядрами CUDA и тензорными ядрами пятого поколения с поддержкой операций FP4. Nvidia заявляет, что производительность ИИ в режиме FP4 у чипа может достигать 1 Пфлопс. Графический процессор соединён через интерфейс NVLink-C2C с 20-ядерным центральным процессором Grace на архитектуре Arm, который, по словам Nvidia, был разработан совместно с MediaTek. Старшая конфигурация RTX Spark поддерживает до 128 Гбайт унифицированной памяти LPDDR5X. По словам Nvidia, пропускная способность интерфейса NVLink-C2C между графическим и центральным процессорами составляет 600 Гбайт/с, что в пять раз выше пропускной способности интерфейса PCIe 5.0. RTX Spark представляет собой вариацию суперчипа GB10, который используется в системах DGX Spark. Разница заключается в позиционировании. DGX Spark был представлен как компактная система для разработки искусственного интеллекта, а RTX Spark позиционируется как потребительская платформа для ПК на базе Windows для ноутбуков и небольших настольных компьютеров. По словам Nvidia, системы с RTX Spark могут локально обрабатывать языковые модели с 120 млрд параметров и контекстными окнами, рассчитанными до 1 млн токенов. Компания также заявляет, что платформа может рендерить 3D-сцены объёмом до 90 Гбайт, редактировать видео 12K 4:2:2 и генерировать видео 4K с помощью искусственного интеллекта. Для RTX Spark также подтверждена поддержка игр. Платформа поддерживает технологии трассировки лучей RTX, масштабирование DLSS, Reflex и технологию синхронизации изображения G-Sync. В презентации упоминается возможность играть в игры с разрешением 1440p и частотой более 100 кадров в секунду. Nvidia не предоставила полный список поддерживающихся игр, настроек и ограничений по энергопотреблению для подтверждения этого заявления. В качестве одного из примеров Nvidia привела игру Indiana Jones and the Great Circle. Компания также сообщила, что в зависимости от задачи RTX Spark может обеспечить графическую производительность, близкую к мобильной GeForce RTX 5070. RTX Spark — это чип на базе архитектуры Arm. Это означает, что традиционные приложения для Windows на базе архитектуры x86 могут запускаться через эмулятор Microsoft Prism. В рамках презентации также было заявлено, что Nvidia и Microsoft работают над собственной платформой Windows для агентов искусственного интеллекта. Nvidia называет свою среду выполнения OpenShell. Microsoft отвечает за функции безопасности и изоляции Windows, чтобы локальные агенты могли работать под контролем пользователя. По словам Nvidia, компания Adobe переработает Photoshop и Premiere для RTX Spark. Nvidia также сообщила о поддержке платформой собственных приложений для архитектуры Arm в Blender, DaVinci Resolve, Maxon Cinema4D, Redshift, Topaz Photo, CapCut, Cubase, Bitwig Studio и Affinity от Canva. Ноутбуки на платформе RTX Spark будут выпускаться с диагональю экрана от 14 до 16 дюймов. Компания заявляет, что толщина корпуса у этих лэптопов составит всего 14 мм, а вес — не более 1,3 кг. В некоторых моделях будут использоваться панели Tandem OLED с поддержкой G-Sync. Среди первых производителей упоминаются Asus, Dell, HP, Lenovo, Microsoft Surface и MSI. Позже к ним присоединятся Acer и Gigabyte. Партнёры Nvidia уже работают над более чем 30 моделями ноутбуков и десятком моделей настольных компьютеров на платформе RTX Spark. Среди подтверждённых моделей: Asus ProArt P14 и P16, Dell XPS 16, HP OmniBook X14 и Ultra 16, Lenovo Yoga Pro 9N, Microsoft Surface Laptop Ultra и MSI Prestige N16 Flip AI. Первые системы будут относиться к премиум-сегменту. Nvidia пока не подтвердила цены будущих решений. Компания также сообщила, что собирается выпустить целое семейство однокристальных систем RTX Spark, тем самым охватив разные сегменты рынка. Например, планируются более бюджетные конфигурации, которые могут оснащаться всего 16 Гбайт ОЗУ. RTX Spark

Nvidia также подтвердила, что в системах с RTX Spark не будет дополнительных дискретных видеокарт. С одной стороны, это может ограничить возможности платформы в больших настольных компьютерах, но с другой — соответствует современным тенденциям в области компактных ПК и тонких ноутбуков. О поддержке Linux платформой RTX Spark пока ничего неизвестно. Компания также ничего не сказала о возможности использования RTX Spark в составе портативных игровых устройств. Больше подробностей о платформе станет известно ближе к её запуску. Nvidia расписала будущее процессоров RTX Spark для мобильных и настольных ПК до 2030 года

01.06.2026 [11:19],

Алексей Разин

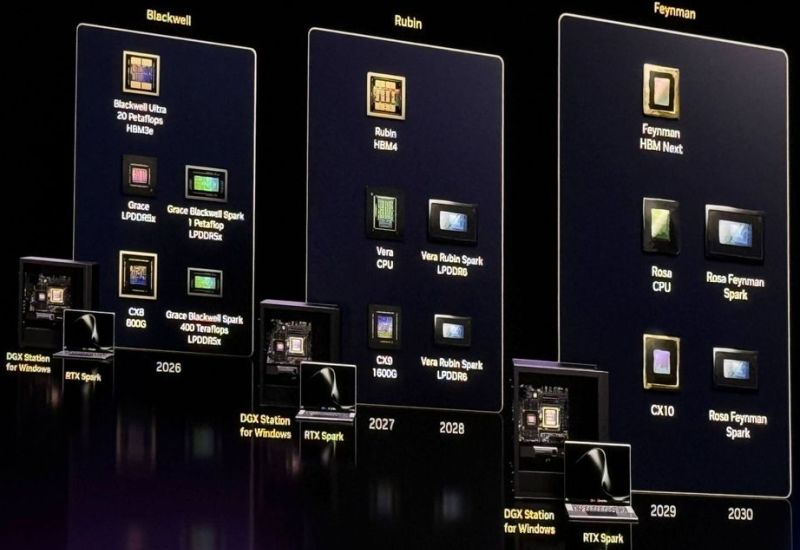

По традиции, Nvidia своё участие в отраслевой выставке Computex 2026 начала с рассказа о своих будущих планах, и один из них коснулся семейства чипов RTX Spark, которое может применяться в ПК. По сути, каждая последующая платформа Nvidia будет включать в себя новые разновидности чипов RTX Spark, и планы компании в этой сфере расписаны минимум до 2030 года.

Источник изображения: Future, Tom's Hardware Актуальным семейством является Grace Blackwell RTX, оно поддерживает память типа LPDDR5X, предлагаются два варианта быстродействия: 1 петафлопс и 400 терафлопс соответственно. В 2028 году в семействе Vera Rubin Spark будут предложены две разновидности чипов с поддержкой памяти типа LPDDR6. В семействе Rosa Feynman Spark, которое будет представлено в 2030 году, также будет два чипа, но тип поддерживаемой ими памяти пока не уточняется. Более того, если для графических процессоров Rubin прямо прописывается использование HBM4, то у GPU семейства Feynman версия HBM упоминается абстрактно, с одним лишь пояснением, что это будет память следующего поколения. Усилия Nvidia по развитию платформы RTX Spark, по всей видимости, призваны способствовать популяризации сочетания операционной системы Microsoft Windows и центральных процессоров с архитектурой Arm. Тем более, что в условиях роста популярности ИИ-агентов способность локального аппаратного обеспечения эффективно ускорять работу соответствующих систем сильно влияет на получаемый пользователем опыт, и Nvidia в этом смысле хочет быть готовой к такому развитию событий. Nvidia также будет развивать флагманские настольные конфигурации DGX Station. В текущем поколении Blackwell они построены на чипе GB300 с 72-ядерным центральным процессором Grace и 496 Гбайт памяти LPDDR5X в сочетании с графическим процессором Blackwell Ultra, который оснащён 252 Гбайт памяти типа HBM3E и предлагает до 15 петафлопс быстродействия в операциях FP4. Усилить такую конфигурацию разработчики всегда могут и дискретным ускорителем с разъёмом PCI Express. TSMC призналась, что стала выпускать чипы лучше и быстрее благодаря Nvidia

01.06.2026 [09:42],

Алексей Разин

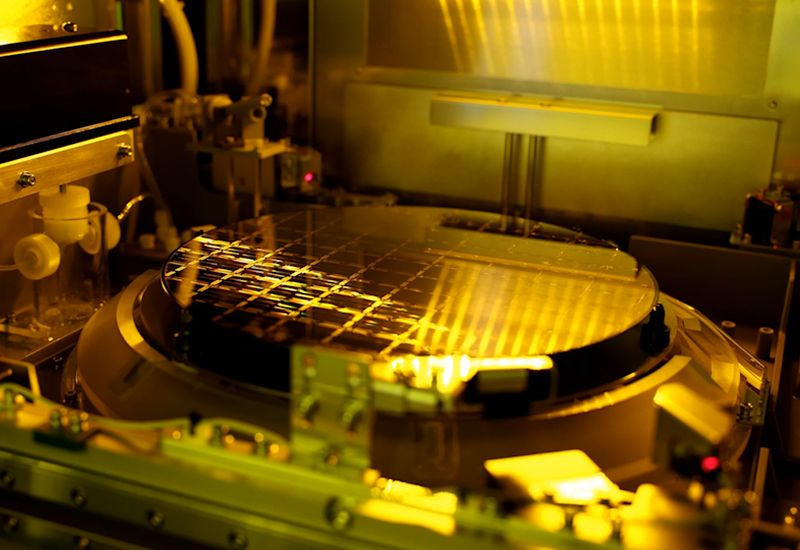

До сих пор считалось, что TSMC главным образом помогает Nvidia, осуществляя массовый выпуск чипов для неё, но компании на этой неделе привели пример и обратного взаимодействия. Технологии Nvidia помогают TSMC выпускать более качественные чипы и делать это быстрее, как отмечается в совместном пресс-релизе компаний.

Источник изображения: TSMC Вычислительная литография и симуляция процессов, происходящих на уровне транзисторов, позволяют TSMC улучшить производственные условия и ускорить разработку новинок. Искусственный интеллект при поддержке Nvidia теперь помогает быстрее проектировать чипы, быстрее осваивать их массовое производство и лучше контролировать показатели качества. В частности, так называемая вычислительная литография позволяет TSMC разрабатывать фотомаски для изготовления чипов на 20–50 % эффективнее по сравнению с методом, для которого вместо GPU используются CPU. Себестоимость при этом остаётся прежней. TSMC полагается на библиотеку cuLitho, которая ускоряет расчёты силами графических процессоров Nvidia. В области материаловедения TSMC полагается на инструмент cuEST, который позволяет симулировать свойства материалов на уровне транзисторов, ускоряя расчёты в области химии в 50 раз. За поддержку стабильности техпроцессов при производстве чипов в компании отвечает библиотека cuML компании Nvidia, позволяющая полагаться на технологии машинного обучения при контроле за технологическими процессами. Кроме того, ИИ-модели Nvidia позволяют оптимизировать логистические и производственные процессы TSMC, добиваясь максимальной отдачи с точки зрения объёмов выпуска продукции. Метод цифровых двойников и технология FabTwin активно для этого используется. Внедрение новых технологий сначала отрабатывается на виртуальном двойнике, и только в случае успеха переносится в реальный сценарий. Платформа Metropolis и инструментарий TAO Toolkit позволяют TSMC более эффективно осуществлять поиск дефектов при обработке кремниевых пластин. ИИ сам подстраивается под изменения в типах дефектов и не требует регулярного переобучения, позволяя сохранять качество продукции без дополнительных затрат времени. Власти США запретят китайским компаниям закупать передовые ускорители для своих зарубежных ЦОД

01.06.2026 [06:22],

Алексей Разин

Поскольку правила экспортного контроля США запретили китайским разработчикам использовать передовые ускорители вычислений на территории КНР, они предсказуемо нашли способ развивать свою инфраструктуру за пределами страны. Теперь эта лазейка будет закрыта, как отмечает агентство Reuters.

Источник изображения: Nvidia Дело в том, что на сайте Министерства торговли США новые рекомендации для составителей правил экспортного контроля были опубликованы в минувшее воскресенье, что не является обычной практикой. Бюро промышленности и безопасности США, которое входит в состав ведомства, заявило о своих намерениях усилить экспортные ограничения для тех случаев, когда ускорители ИИ закупаются для подразделений компаний со штаб-квартирой в Китае, находящихся за пределами страны. Как отмечается в материале Reuters, ранее подобные закупки осуществлялись даже без оформления экспортных лицензий. Это позволяло китайским компаниям развивать свою вычислительную инфраструктуру за пределами КНР. По некоторым оценкам, подобная лазейка позволила поставить для нужд зарубежных филиалов китайских компаний сотни тысяч ускорителей. Примечательно, что Министерство торговли США буквально своими руками создало подобную лазейку в мае прошлого года, когда заявило, что не будет внедрять правила экспорта ИИ-ускорителей, которые были приняты ещё при президенте Байдене. Они подразумевали обязательное получение экспортных лицензий для поставок ИИ-ускорителей США в любые страны. Эксперты отмечают, что это позволило китайским компаниям покупать передовые ускорители Nvidia с архитектурой Blackwell без оформления лицензий. Впрочем, в поле зрения американских регуляторов остаётся и другая проблема: от TSMC и прочих контрактных производителей никто не требует контроля конечного использования изготавливаемых ими чипов. Подразумевалось, что контрактные производители должны сами следить за тем, что их продукция не попадает в руки китайских разработчиков напрямую. Кроме того, Министерство торговли США не требует от компаний, которые закупили чипы по прежним правилам, прекратить их эксплуатацию или обслуживание в составе ЦОД. Новая статья: Обзор видеокарты MSI GeForce RTX 5070 GAMING TRIO OC WHITE

01.06.2026 [00:07],

3DNews Team

Данные берутся из публикации Обзор видеокарты MSI GeForce RTX 5070 GAMING TRIO OC WHITE До 20 ядер и графика уровня RTX 5070: раскрыты характеристики Arm-процессоров Nvidia N1X и N1

31.05.2026 [16:33],

Владимир Фетисов

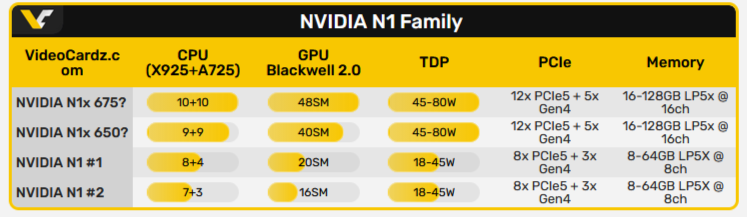

Ожидается, что Nvidia представит Arm-процессоры семейства N1 для ноутбуков под управлением Windows в рамках предстоящей выставки Computex 2026. В преддверии этого события в интернете стараниями VideoCardz появились полные характеристики этих всех чипов семейства.

Источник изображений: videocardz.com По данным источника, конфигурация флагманского процессора N1X совпадает с параметрами чипа GB10, который используется в мини-ПК DGX Spark. Чип имеет 10 ядер Cortex-X925 и 10 ядер Cortex-A725, а также встроенную графику Nvidia Blackwell с 6144 ядрами CUDA, что соответствует количеству блоков у видеокарты GeForce RTX 5070. Урезанная версия чипа получила по девять ядер Cortex-X925 и Cortex-A725, а также встроенную графику с 5120 ядрами CUDA. Оба чипа N1X поддерживают 12 линий PCIe 5.0, 5 линий PCIe 4.0 и разработаны для диапазона энергопотребления от 45 Вт до 80 Вт. Чипы могут работать с оперативной памятью LPDDR5x объёмом от 16 до 128 Гбайт.  Чипы N1 предназначены для использования в более доступных ноутбуках и представлены в двух версиях. Старшая версия оснащена 12 процессорными ядрами (8+4), а младшая — 10 ядрами (7+3). В первом случая используется встроенная графика с 2560 ядрами CUDA, а во втором — с 2048 ядрами CUDA. Оба процессора поддерживают 8 линий PCIe 5.0 и 3 линии PCIe 4.0, от 8 до 64 Гбайт ОЗУ и отличаются более низким энергопотреблением — от 18 Вт до 45 Вт. Nvidia ещё не подтвердила спецификации новых Arm-чипов. Так же нет уверенности, что на предстоящей Computex дебютируют все обозначенные выше процессоры — как отметили в VideoCardz, часть источников данной утечки датирована 2024 годом, что говорит о продолжительной разработке, но за два года планы Nvidia могли поменяться. Глава Nvidia похвалил Huawei за прорыв в технологиях выпуска чипов

31.05.2026 [10:06],

Алексей Разин

Компания Huawei Technologies недавно анонсировала новый подход к проектированию и производству чипов, который позволит без серьёзного прогресса в литографии получать компоненты, по своим характеристикам не уступающие лучшим решениям зарубежных конкурентов. Глава и основатель Nvidia похвалил Huawei за прорыв в технологиях, но подчеркнул, что лидерству TSMC ничего не угрожает.

Источник изображения: Nvidia Своими комментариями генеральный директор Nvidia Дженсен Хуанг (Jensen Huang), как отмечает TechNews, поделился во время своего визита на Тайвань, где он традиционно встретился с руководством TSMC и прогулялся по улочкам родного острова. «Закон масштабирования τ», который предложила Huawei, по словам Хуанга, позволит поднять быстродействие чипов за счёт компоновочных решений типа создания многоярусных чипов и гибридных соединений. Количество транзисторов на единицу площади можно удвоить, утроить или даже увеличить в четыре раза без изменения физических размеров самих транзисторов. Такой технологический подход Хуанг назвал многообещающим, но подчеркнул, что аналогичные разработки TSMC ведёт уже более десяти лет, а потому её передовым технологическим позициям ничего не угрожает. Как известно, TSMC остаётся крупнейшим подрядчиком Nvidia в сфере производства и упаковки чипов. Из пояснений прочих источников становится понятно, что Huawei предлагает делать микросхемы многослойными и сокращать время передачи сигнала за счёт более коротких вертикальных соединений. Помимо роста тепловыделения, такая технология производства чипов требует и более сложного оборудования, поэтому перспективы её скорого выхода на массовый рынок довольно туманны. Nvidia, Microsoft и Arm раскрыли координаты анонса чипа N1X для Windows-ноутбуков — ждать осталось недолго

30.05.2026 [10:46],

Алексей Разин

Nvidia, Microsoft и Arm недвусмысленно намекнули на скорый анонс Arm-процессоров Nvidia для ноутбуков под управлением Windows. Компании синхронно опубликовали в X сообщение «A new era of PC» с координатами Taipei Music Center, где 1 июня состоится выступление главы Nvidia Дженсена Хуанга в рамках мероприятия GTC Taipei, проходящего одновременно с Computex 2026. Практически нет сомнений, что речь пойдёт о давно обсуждаемых чипах Nvidia N1 и N1X, созданных при участии MediaTek.

Источник изображения: Nvidia Официально компании пока не раскрыли, какой именно продукт будет представлен. Однако участие Microsoft и Arm в общей рекламной кампании указывает на платформу Windows on Arm, а Nvidia уже несколько лет связывают со слухами о подготовке собственных Arm-процессоров для ПК. По данным The Verge и Tom’s Hardware, анонс N1 и N1X должен состояться именно во время тайбэйского мероприятия Nvidia. Интригу усилила и MediaTek. В апреле организаторы Computex отменили выступление генерального директора компании Рика Цая, сославшись на изменения в расписании. После этого появились предположения, что MediaTek может не проводить отдельную презентацию, а появиться в связке с Nvidia. Кроме того, отраслевые источники ранее сообщали, что ноутбуки на базе N1X готовят Dell и Lenovo.  По неофициальным данным, старший чип N1X получит 20 Arm-ядер и встроенную графику Nvidia Blackwell с 6144 ядрами CUDA, что соответствует количеству блоков у GeForce RTX 5070. Также в утечках упоминалась поддержка до 128 Гбайт памяти LPDDR5X. Эти характеристики пока не подтверждены производителем, а сравнение с дискретной GeForce RTX 5070 стоит воспринимать осторожно: встроенная графика будет делить память и теплопакет с вычислительными ядрами, поэтому её реальная производительность может заметно отличаться. Если Nvidia действительно представит N1 и N1X для массовых Windows-ноутбуков, это станет важным событием для рынка Windows on Arm. Сейчас этот сегмент опирается исключительно на платформы Qualcomm Snapdragon X, тогда как появление Nvidia даст производителям ПК ещё одного крупного поставщика Arm-чипов и может усилить конкуренцию среди доступных платформ для ноутбуков. Nvidia и MediaTek уже сотрудничали над Arm-процессором GB10 для компактной системы DGX Spark, представленной на CES 2025. Тогда Дженсен Хуанг говорил, что MediaTek сможет продавать созданный совместно с Nvidia процессор и в собственных продуктах. N1 и N1X, если они будут представлены на Computex, могут стать развитием этой связки, но уже для массовых или полупрофессиональных Windows-ноутбуков. Тайваньские власти подозревают, что ИИ-чипы Nvidia попадали в Китай через Японию в обход санкций

30.05.2026 [06:09],

Алексей Разин

Трое задержанных на прошлой неделе на Тайване подозреваемых в организации контрабанды лиц, как предполагает следствие, могли бы замешаны как минимум в одной поставке ИИ-ускорителей Nvidia в Китай в обход американских правил экспортного контроля с использованием Японии в качестве промежуточной страны.

Источник изображения: Nvidia Как поясняет Bloomberg, подозреваемым сперва пришлось экспортировать партию ускорителей с Тайваня в Японию, а затем уже организовать её поставку в КНР через Гонконг. В деле фигурирует партия серверного оборудования Supermicro, содержащего ИИ-ускорители Nvidia, поставки которых в Китай запрещены правилами экспортного контроля США. Трио подозреваемых для реализации своего замысла подделало документы на отгружаемую продукцию, как считает следствие. После ареста подозреваемых была выявлена партия из 50 серверов, которые также готовились к поставке в Китай по подложным документам. Установлено, что группа успела провести через тайваньскую таможню как минимум одну партию ИИ-ускорителей Nvidia, которые запрещены к поставкам в Китай. Размер этой партии не уточняется. Следствие предполагает, что и захваченные на Тайване 50 серверов должны были отправиться в КНР через Японию. Последняя из стран впервые фигурирует в подобном контексте, поскольку считается близким геополитическим союзником США, не допускающим подобных проколов в вопросах экспортного контроля. При этом китайские разработчики могут вполне легально арендовать ЦОД с запрещёнными к поставке в КНР ускорителями Nvidia, если соответствующие вычислительные мощности расположены в Японии или других окрестных странах Азии. Тайваньские следователи не предъявляют никаких обвинений Nvidia и Supermicro, чья продукция фигурирует в этом деле. По словам главы первой из компаний, она тщательным образом разъясняет правила экспортного контроля своим клиентам. Supermicro, по его словам, нужно усилить контроль за поставками своей продукции и провести собственное расследование. Как пояснили представители Supermicro, фигурирующие в тайваньском деле серверные системы были изначально проданы авторизованному партнёру компании, который должен был следовать всем сопутствующим ограничениям. По мнению представителей компании, над усилением контроля за цепочками поставок должна работать вся отрасль, чтобы соответствующие меры были достаточно эффективными. Утечка раскрыла первый ноутбук Dell XPS на Arm-чипе Nvidia N1X

29.05.2026 [13:57],

Павел Котов

Один из инсайдеров раскрыл закрытый пресс-релиз Dell для выставки Computex 2026. В одном из документов упоминается ноутбук серии XPS на процессоре Nvidia N1X для ПК. На том же мероприятии Nvidia, как ожидается, представит свои центральные процессоры с мощной встроенной графикой серии N1.

Источник изображения: dell.com Dell закрыла информацию о выпуске ноутбука XPS на чипе Nvidia N1X до 31 мая — компьютер уже появлялся в базе данных теста Geekbench, о нём сообщали неофициальные источники, но сам производитель о нём никогда не рассказывал. Фотографий и технический характеристик ноутбука обнаружить пока не удалось. Характеристики платформы Nvidia N1X уже известны из неофициальных источников. Эта модель является старшей в линейке — она содержит 20 Arm-ядер и 6144 ядер CUDA на архитектуре Blackwell. По сути, это аналог GB10 Superchip, используемого в DGX Spark, но оптимизированный для систем с низким потреблением энергии. Ключевое отличие — поддержка Windows, которой DGX Spark похвастаться не может. На собственные специальные презентации ноутбуков приглашают и другие бренды — мероприятия состоятся после презентации Nvidia. Модели на чипах Nvidia N1 могут показать также Lenovo и MSI. Nvidia же, очевидно, выходит на рынок потребительских систем на чипах — более подробную информацию она обещает сообщить 31 мая. |