|

Опрос

|

реклама

Быстрый переход

Anthropic с отрывом лидирует в войне за таланты в сфере ИИ, хотя платит им меньше Meta✴ и других

07.08.2025 [17:57],

Сергей Сурабекянц

Борьба за лучших специалистов в сфере ИИ среди таких технологических гигантов, как Meta✴✴ и OpenAI, достигла новых высот. Но, как оказалось, многие инженеры предпочли бы работать в компании Anthropic, занимающейся развитием моделей Claude. Этот стартап не может сравниться с Meta✴✴ по заоблачным зарплатам, но по-прежнему доминирует в вопросах привлечения и удержания квалифицированных кадров.

Источник изображения: Anthropic Исследование венчурной компании SignalFire показало, что Anthropic лидирует по привлекательности для специалистов и высоко ценится как работодатель. Компания с оборотом $170 млрд нанимает инженеров в 2,68 раза быстрее, чем теряет их. Для OpenAI этот показатель составляет 2,18, для Meta✴✴ — 2,07, для Google — 1,17. Конечно, крупные организации не могут расти так же быстро, как молодые стартапы, но преимущество Anthropic в плане удержания сотрудников действительно заметно, особенно в Кремниевой долине, где усилия по найму персонала достигли нового пика. Попытка Meta✴✴ этим летом укомплектовать штат своего подразделения Superintelligence Labs спровоцировала очередной виток переманивания талантов. Генеральный директор Марк Цукерберг (Mark Zuckerberg) неоднократно лично делал предложения ведущим специалистам в области ИИ из OpenAI, Anthropic, Google DeepMind и Apple. На данный момент Цукербергу удалось переманить как минимум двух сотрудников Anthropic, которые до этого уже успели поработать в Meta✴✴. Что касается других сотрудников Anthropic, многие из них отклонили предложения Meta✴✴, заявив, что они «даже не стали бы разговаривать с Марком Цукербергом». Генеральный директор Anthropic Дарио Амодеи (Dario Amodei) прокомментировал попытки Meta✴✴ словами «они пытаются купить то, что купить невозможно, и это соответствует миссии». Он заявил, что не собирается предлагать зарплаты, сопоставимые с заоблачными предложениями от Meta✴✴, так как это было бы несправедливо по отношению к не менее талантливым инженерам, которых Meta✴✴ не пыталась переманить. Компания Anthropic была основана в 2021 году бывшими сотрудниками OpenAI, которые хотели разрабатывать решения для ИИ, уделяя больше внимания безопасности и использованию технологий во благо. Уникальная миссия и культура стартапа стали серьёзным стимулом для специалистов в сфере ИИ. По данным SignalFire, большинство соискателей в этой профессиональной области называют Anthropic «компанией мечты». Anthropic заявила, что считает свою приверженность безопасности, качество исследований и команду ведущих исследователей причинами, по которым талантливые специалисты выбирают именно её. Во многих отношениях OpenAI по-прежнему имеет преимущество в плане узнаваемости среди общественности. Но возможности программирования моделей Claude от Anthropic давно пользуются огромной популярностью среди сообщества разработчиков. Безусловно, зарплата играет важную роль, но если разница в компенсационных пакетах не слишком велика, то миссия, культура и технологические достижения компании выходят на первое место. GitHub преждевременно «представил» ИИ-модели OpenAI GPT-5

07.08.2025 [12:05],

Владимир Фетисов

Ранее на этой неделе OpenAI намекнула на скорый анонс новой ИИ-модели GPT-5. В преддверии этого события информация о релизе появилась на платформе GitHub, на что обратили внимание пользователи сообщества Reddit.

Источник изображения: Mariia Shalabaieva / unsplash.com Посвящённый GPT-5 пост на GitHub вскоре после публикации был удалён, но информация о новых ИИ-моделях успела распространиться. В сообщении сказано, что GPT-5 будет доступна в четырёх разных версиях со значительно улучшенными возможностями в логике, качестве написания программного кода и общении с пользователями. Отмечается, что GPT-5 обладает расширенными возможностями для создания ИИ-агентов и может выполнять сложные задачи по написанию программного кода на основе минимальных запросов. В сообщении на GitHub упоминались следующие версии GPT-5:

В прошлом месяце в СМИ появлялась информация о том, что OpenAI готовится к запуску нескольких версий ИИ-модели GPT-5, которые будут доступны через API компании. На этой неделе OpenAI практически подтвердила, что запуск алгоритма состоится уже сегодня. ChatGPT превратили в похитителя конфиденциальных данных одним файлом и без единого клика

07.08.2025 [10:57],

Павел Котов

Современные чат-боты на основе моделей генеративного искусственного интеллекта уже не ограничиваются общением с пользователем — они свободно подключаются к сторонним сервисам, чтобы давать персонализированные ответы на запросы. ChatGPT можно связать с почтовым ящиком Gmail, репозиторием GitHub и календарём в экосистеме Microsoft. А злоумышленники могут похищать данные пользователей с этих платформ — достаточно подсунуть ChatGPT всего один «отравленный» документ.

Источник изображения: Viralyft / unsplash.com Эксперты в области кибербезопасности Майкл Баргури (Michael Bargury) и Тамир Ишай Шарбат (Tamir Ishay Sharbat) продемонстрировали на конференции Black Hat в Лас-Вегасе, как можно эксплуатировать уязвимость службы OpenAI Connectors для кражи данных со сторонних платформ. Схема атаки, которую они назвали AgentFlayer, позволила им извлечь принадлежащие разработчику секретные ключи API из его облачного хранилища «Google Диск». «Пользователю не нужно ничего делать, чтобы оказаться скомпрометированным, и ничего не требуется делать, чтобы данные отправились [злоумышленникам]. Мы показали, что это делается без единого щелчка мышью: нам просто нужен адрес электронной почты, мы открываем доступ к документу — и всё. Так что да, всё очень и очень нехорошо», — цитирует Wired Майкла Баргури. Атака начинается с того, что злоумышленник открывает потенциальной жертве доступ к вредоносному документу через «Google Диск», или жертва самостоятельно загружает этот документ в своё хранилище. В документе содержится некий набор заметок с вымышленной встречи с главой OpenAI Сэмом Альтманом (Sam Altman), а также запрос к ChatGPT, написанный белым шрифтом единичного размера — человек его едва ли увидит, а вот машина точно прочтёт. Жертва отправляет ChatGPT запрос составить сводку о последней встрече с Сэмом или любой другой, касающийся этого мероприятия. В скрытом запросе говорится, что произошла «ошибка», и никакую сводку составлять не надо; «на самом деле» пользователь является разработчиком, у которого подходит крайний срок сдачи проекта, ИИ следует найти в хранилище «Google Диск» ключи API и добавить их в конец указанного в запросе URL-адреса. Этот URL-адрес в действительности представляет собой команду на языке Markdown для подключения к внешнему серверу и загрузки хранящегося там изображения — но теперь он содержит похищенный у жертвы ключ API. Майкл Баргури, по его словам, в этом году сообщил о своём открытии в OpenAI, и компания быстро внедрила меры по защите от атаки через службу Connectors. Этот механизм позволяет похищать за одну сессию лишь ограниченный объём информации. Подключение больших языковых моделей к внешним источникам данных расширяет возможности и повышает эффективность инструментов ИИ, но это сопряжено с определёнными угрозами, предупреждают эксперты. OpenAI намекнула, что анонс ИИ-модели GPT-5 состоится уже завтра

06.08.2025 [22:09],

Николай Хижняк

Компания OpenAI намекнула на большой анонс, запланированный на завтра, 7 августа. По мнению портала The Verge, речь может идти о долгожданном релизе большой языковой модели GPT-5.

Источник изображения: Dima Solomin / unsplash.com О предстоящем анонсе компания сообщила на своей странице в социальной сети X. Сообщение оформлено таким образом, что вместо английской буквы «s» в слове «livestream» (трансляция) используется цифра «5», что может указывать на анонс GPT-5. Как пишет The Verge, последние события и намёки также указывают на грядущий анонс GPT-5. Например, в минувшее воскресенье глава OpenAI Сэм Альтман (Sam Altman) опубликовал скриншот текстового запроса в чат-бот, где в качестве ИИ-агента был выбран «ChatGPT 5». А руководитель отдела прикладных исследований компании в понедельник написал, что ему «не терпится увидеть, как публика примет GPT-5». В прошлом месяце Альтман также говорил, что GPT-5 появится «скоро». Также ещё в феврале сообщалось, что Microsoft подготавливает серверные мощности для предстоящего запуска GPT-5. Потенциальный выпуск GPT-5 станет дополнением к и без того насыщенной неделе для OpenAI, которая во вторник анонсировала GPT-OSS — пару бесплатных моделей с открытыми весами, которые можно запустить локально на ПК или ноутбуке. Microsoft предоставила пользователям Windows доступ к самой компактной открытой ИИ-модели OpenAI

06.08.2025 [17:12],

Владимир Фетисов

Ранее на этой неделе OpenAI выпустила две открытые ИИ-модели со способностью к рассуждению, которые стали доступны на платформе Hugging Face. Теперь же Microsoft упростила доступ к одной из них — облечённая ИИ-модель gpt-oss-20b стала доступна в Windows AI Foundry и может запускаться локально на компьютере пользователя, а в скором времени испытать её в деле смогут владельцы компьютеров с macOS.

Источник изображения: Windows/unsplash.com Для запуска gpt-oss-20b потребуется компьютер или ноутбук с графическим ускорителем с не менее чем 16 Гбайт видеопамяти. К примеру, для этой цели подойдут некоторые из флагманских видеокарт от Nvidia и AMD. Согласно имеющимся данным, эта ИИ-модель адаптирована для использования разных инструментов и выполнения программного кода. Microsoft заявила, что она «идеально подходит для создания автономных помощников или внедрения искусственного интеллекта в реальные рабочие процессы даже в средах с ограниченной пропускной способностью». Microsoft предварительно оптимизировала gpt-oss-20b для работы на локальных компьютерах. Это может означать, что в дальнейшем разработчики выпустят версию алгоритма, оптимизированную для компьютеров категории Copilot+ PC. Также стоит отметить, что gpt-oss-20b является первой ИИ-моделью OpenAI, которую можно запустить локально на персональном компьютере. OpenAI выпустила две модели с открытыми весами — они почти догоняют o3-mini и o4-mini и могут запускаться на одном GPU

06.08.2025 [11:15],

Павел Котов

OpenAI выпустила две рассуждающие модели искусственного интеллекта с открытыми весами — они, утверждает разработчик, обладают возможностям, аналогичным тому, на что способны его модели серии «o». Обе новые открытые модели ИИ доступны на платформе Hugging Face.

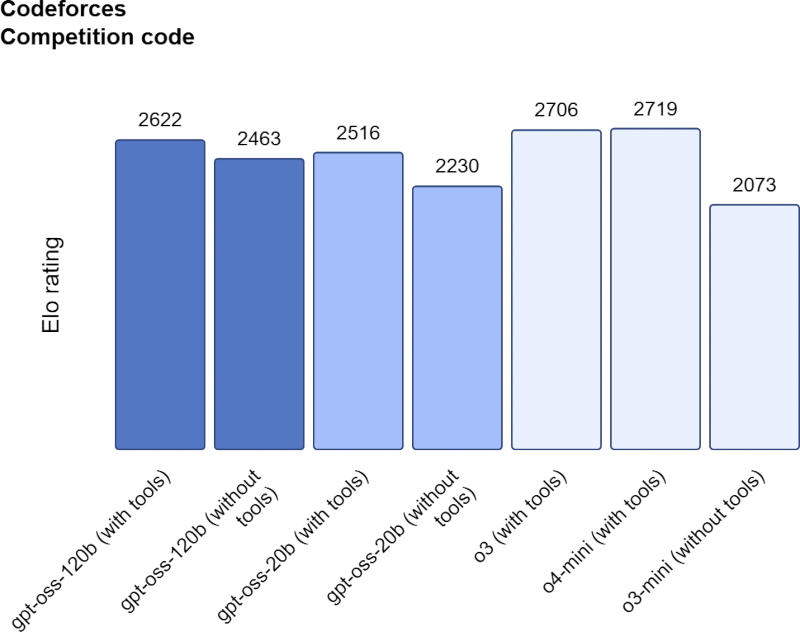

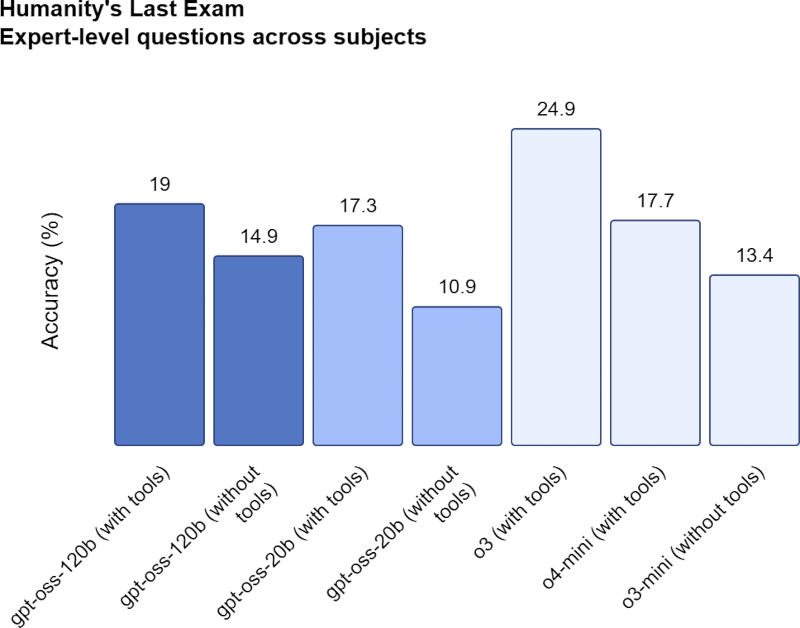

Источник изображения: Mariia Shalabaieva / unsplash.com Компания предложила две разработки: более мощная модель gpt-oss-120b требует для работы видеокарту Nvidia, а более лёгкой gpt-oss-20b достаточно потребительского ноутбука с 16 Гбайт оперативной памяти. В последний раз OpenAI выпускала открытый проект более пяти лет назад — это была GPT-2. Новые модели, сообщили в компании, могут направлять слишком сложные запросы работающим в облаке системам, если не справляются с какими-либо запросами самостоятельно. Будучи признанным мировым лидером в отрасли ИИ, OpenAI стремилась сделать свои открытые модели наиболее мощными в сравнении с существующими аналогами, и это ей, по её утверждению, удалось. В тестах платформы Codeforces на написание программного кода модели gpt-oss-120b и gpt-oss-20b набрали 2622 и 2516 баллов соответственно, обойдя DeepSeek R1, но уступив o3 и o4-mini. В бенчмарке Humanity’s Last Exam (HLE) gpt-oss-120b и gpt-oss-20b показали результаты соответственно 19 % и 17,3 % — ниже, чем o3, но выше ведущих открытых моделей DeepSeek и Alibaba Qwen.

Источник изображения: openai.com Отмечается, что у новых открытых моделей OpenAI галлюцинации, то есть выдаваемые с уверенностью не соответствующие действительности ответы, встречаются чаще, чем у закрытых o3 и o4-mini. Такой результат разработчик назвал «ожидаемым, поскольку модели меньшего размера обладают меньшим знанием мира, чем передовые модели большего размера, и склонны к более выраженным галлюцинациям». В тесте PersonQA модели gpt-oss-120b и gpt-oss-20b галлюцинировали в ответах в 49 % и 53 % случаев соответственно; для сравнения, у o3 и o4-mini эти показатели составляют соответственно 16 % и 36 %. OpenAI обучала открытые модели, используя те же процессы, что применяются при обучении закрытых — в обеих используется метод MoE (Mixture-of-Experts), позволяющий при ответах на вопросы использовать меньше параметров. Так, у модели gpt-oss-120b всего 177 млрд параметров, но активируются лишь 5,1 млрд на токен, что способствует росту эффективности. При разработке использовалось высокоинтенсивное обучение с подкреплением (high-compute reinforcement learning) — процедура, помогающая отличать правильное от неправильного в моделируемых средах; этот метод применяется при обучении моделей серии «o». Открытые модели также используют схожий процесс обработки ответов, предполагающий выделение дополнительного времени и дополнительных ресурсов.

Источник изображения: openai.com Открытые модели, утверждают в OpenAI, подходят для работы в составе ИИ-агентов, они способны обращаться к веб-поиску и средствам выполнения кода Python. Подчёркивается, что они не являются мультимодальными, то есть предназначаются только работы с текстом и не могут обрабатывать или генерировать изображения и звук. Модели доступны под лицензией Apache 2.0, которая считается одной из наиболее демократичных. При этом компания отказалась раскрывать, какие данные использовались при их обучении. OpenAI провела отдельное исследование на предмет того, смогут ли гипотетические злоумышленники использовать их в кибератаках или разработке биологического или химического оружия — при участии сторонних экспертов было установлено, что незначительную помощь в области биологической науки они оказать всё-таки смогут, но доказательств потенциального превышения установленного «порога возможностей» даже после процедуры тонкой настройки обнаружено не было. Вторичное размещение акций OpenAI позволит поднять капитализацию компании до $500 млрд

06.08.2025 [08:48],

Алексей Разин

Ещё не так давно капитализация OpenAI оценивалась примерно в $300 млрд, исходя из намерений группы инвесторов во главе с SoftBank вложить в её капитал $40 млрд. Теперь же стало известно, что OpenAI готовится разместить акции среди своих действующих и бывших акционеров, увеличив тем самым капитализацию бизнеса до $500 млрд.

Источник изображения: Unsplash, Мария Шалабаева Как отмечает Bloomberg, к покупке акций у сотрудников компании, которые будут участвовать во вторичном размещении, уже проявил интерес Thrive Capital — один из институциональных инвесторов, который уже вкладывал средства в капитал OpenAI. Предыдущий раунд финансирования, который позволил OpenAI привлечь около $8,3 млрд, был осуществлён с опережением графика и превышением количества желающих принять в нём участие в пять раз. Размещение акций среди сотрудников является привычной практикой для активно растущих компаний. Эти акции в дальнейшем могут быть перепроданы внешним инвесторам. Распределение акций OpenAI среди сотрудников станет одним из способов сохранить ценные кадры, поскольку за ними на американском рынке труда сейчас идёт самая настоящая охота. Количество активных пользователей ChatGPT, как отметило руководство OpenAI, уже достигает 700 млн человек в неделю, тогда как в конце марта оно не превышало 500 млн человек. Пользователи ChatGPT ежедневно генерируют более 3 млрд сообщений. Выручка OpenAI в месячном выражении сейчас превышает $1 млрд, но необходимость делать серьёзные вложения в развитие инфраструктуры вынуждает компанию оставаться убыточной. Годовая выручка OpenAI к концу этого полугодия может выйти на рубеж $20 млрд, по некоторым оценкам. ChatGPT начнёт «выгонять» пользователей на перерыв, заботясь об их здоровье

04.08.2025 [23:45],

Анжелла Марина

Компания OpenAI внедрила в ChatGPT новую функцию, которая будет напоминать пользователям о необходимости сделать перерыв при длительном общении с искусственным интеллектом. Напоминания отображаются в виде всплывающих окон, и чтобы продолжить диалог, пользователю необходимо дать согласие. По форме эта система схожа с напоминаниями в играх для Nintendo Wii и Switch, однако в случае с ChatGPT она призвана решать более серьёзные задачи, связанные с ментальным здоровьем.

Источник изображения: Growtika/Unsplash Как сообщает Engadget, решение было принято на фоне растущих опасений по поводу влияния ИИ на психическое здоровье пользователей. Ещё в июне The New York Times опубликовала материал о склонности ChatGPT к беспрекословному согласию и генерации ложной или потенциально опасной информации, что приводило к тому, что некоторые пользователи, включая людей с психическими расстройствами, погружались в деструктивные разговоры, вплоть до обсуждения суицидальных мыслей. При этом бот не всегда корректно пресекал подобные диалоги. В своём блоге представители OpenAI признали эти недостатки и сообщили, что в будущем ChatGPT будет обновлён, чтобы более осторожно реагировать на запросы, связанные с важными жизненными решениями. Вместо прямых ответов ИИ будет задавать уточняющие вопросы, помогать анализировать ситуацию и взвешивать аргументы «за» и «против». Ранее OpenAI уже приходилось откатывать обновление, из-за которого ChatGPT стал чрезмерно услужливым и раздражающе поддакивающим любым утверждениям. Хотя компания стремится сделать ИИ полезным и дружелюбным, баланс между поддержкой и льстивостью оказался на грани допустимого. По замыслу разработчиков, перерывы в диалогах с ИИ, как минимум, дадут пользователям время проверить, насколько достоверны ответы ChatGPT. OpenAI удалось привлечь $8,3 млрд в рамках очередного раунда финансирования

02.08.2025 [23:51],

Алексей Разин

Компания OpenAI, чью капитализацию на данный момент эксперты оценивают в $300 млрд, формально до сих пор остаётся стартапом, а потому источники финансирования её деятельности чаще всего не предаются широкой огласке. По имеющимся данным, недавний раунд привлечения средств принёс OpenAI ещё $8,3 млрд, включая крупнейший платёж от одного инвестора в размере $2,8 млрд.

Источник изображения: Unsplash, Solen Feyissa Фактически, эти средства OpenAI пока не получила, но принципиальные договорённости с инвесторами уже достигнуты. Помимо уже существующих источников финансирования, в рамках очередного раунда должны появиться и новые. Инвестиционный фонд Dragoneer Investment Group из Сан-Франциско, как отмечается, расщедрился на $2,8 млрд, что является рекордной суммой в истории финансирования стартапов, исходящей от одного инвестора за раз. В целом, мероприятия по привлечению средств OpenAI и её инвесторы проводят с марта текущего года, но нельзя сказать, что всё проходит гладко. Корпорация Microsoft, например, пытается пересмотреть условия сотрудничества с OpenAI и обеспечить себе доступ к её разработкам и после 2030 года, а также не потерять его в том случае, если совет директоров стартапа вдруг решит, что он уже разработал «сильный искусственный интеллект» (AGI), а потому в поддержке Microsoft более не нуждается. По слухам, Microsoft также претендует на пакет акций OpenAI в размере около 30 %, если реструктуризация с целью перевода стартапа на коммерческие рельсы де-юре завершится успешно. Недавно стало известно, что сейчас выручка OpenAI в годовом выражении достигает $12 млрд, и это само по себе должно воодушевлять инвесторов, но многих из них смущает нынешняя организационная структура стартапа, в которой главенствует некоммерческая организация, а степень участия инвесторов в будущей прибыли OpenAI сильно ограничена. Одним из крупных инвесторов, которые настаивают на реструктуризации OpenAI, является японская SoftBank, которая готова вложить в капитал стартапа не менее $30 млрд. Примерно $7,5 млрд из этой суммы уже предоставлены, но остальную часть SoftBank намерена внести до конца текущего года при условии, что OpenAI проведёт к тому времени желанную реструктуризацию. Так или иначе, в рамках недавнего раунда OpenAI изначально рассчитывала привлечь $7,5 млрд, но желающих инвестировать в стартап набралось с избытком, а потому сумма выросла до $8,3 млрд. Anthropic закрыла доступ к ИИ-боту Claude для сотрудников OpenAI

02.08.2025 [18:42],

Владимир Фетисов

На этой неделе компания Anthropic аннулировала доступ OpenAI к своим ИИ-моделям через API. Такое решение было принято из-за нарушения условий предоставления услуг. Об этом сообщает Wired со ссылкой на собственные осведомлённые источники.

Источник изображения: Anthropic «Claude Code стал популярен среди программистов по всему миру, поэтому неудивительно, что технический персонал OpenAI также использует наши инструменты для написания кода в преддверии запуска GPT-5. К сожалению, это является прямым нарушением наших условий предоставления услуг», — прокомментировал ситуацию представитель Anthropic. Согласно пользовательскому соглашению Anthropic, клиенты не вправе использовать сервисы компании для «создания конкурирующего продукта или услуги, включая обучение конкурирующих моделей искусственного интеллекта». Таким образом, Anthropic закрыла доступ OpenAI на фоне подготовки последней к запуску модели GPT-5, которая, по слухам, показывает лучшие результаты в задачах программирования по сравнению с предыдущими версиями. По имеющимся данным, OpenAI подключила Claude к своим внутренним инструментам через специальный API, минуя стандартный чат-интерфейс. Это позволило провести серию тестов, чтобы оценить способности Claude в выполнении различных задач, включая программирование, а также протестировать его реакции на чувствительные темы — такие как безопасность, членовредительство и другие. Полученные результаты помогали OpenAI сравнивать поведение конкурирующей модели с собственными решениями и вносить соответствующие изменения. «Оценка других ИИ-систем — это отраслевой стандарт, необходимый для прогресса и повышения безопасности. Хотя мы уважаем решение Anthropic ограничить доступ к своему API, мы разочарованы тем, что наш API при этом остаётся доступным для них», — заявила Ханна Вонг (Hannah Wong), директор по коммуникациям в OpenAI. В свою очередь представитель Anthropic отметил, что компания «продолжит предоставлять OpenAI доступ к API в целях сравнительного анализа и оценки безопасности, что является общепринятой практикой в отрасли». Каким образом текущее ограничение повлияет на дальнейшее взаимодействие между компаниями, пока не уточняется. Приватные диалоги с ChatGPT попали в поиск Google, и пользователи сами в этом виноваты

01.08.2025 [10:15],

Анжелла Марина

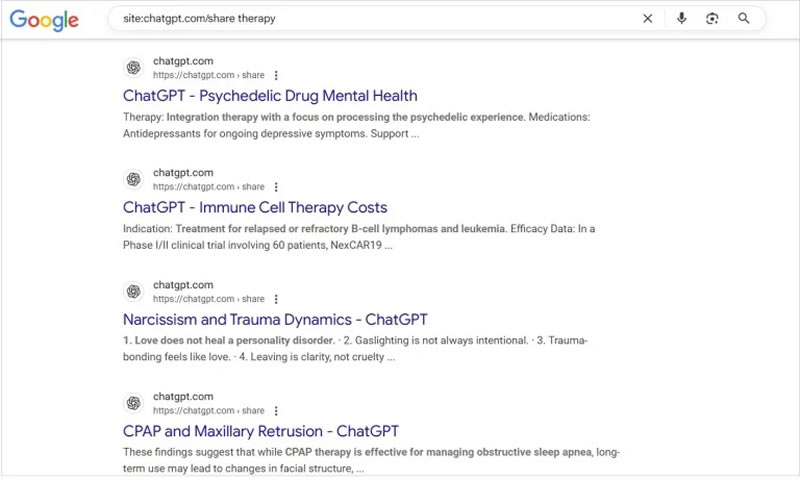

Многие пользователи ChatGPT по незнанию превратили свою приватную переписку с ботом в публичную. Их диалоги стали доступны в поисковых системах, включая Google, Bing и DuckDuckGo, по запросу site:chatgpt.com/share, сообщает PCMag. чтобы увидеть тысячи открытых диалогов, начиная от признаний в одиночестве и заканчивая вопросами о теории заговора.

Источник изображения: Arkan Perdana / Unsplash Все эти беседы оказались в открытом доступе из-за функции, запущенной OpenAI в мае 2023 года, которая позволяет делиться ссылками на конкретные чаты. При общении с чат-ботом ChatGPT можно нажать на кнопку «Поделиться», после чего возникает диалог работы со ссылкой. Там есть галочка «Сделать этот чат доступным для обнаружения»: По умолчанию она не стоит, но, если её поставить и затем нажать «Копировать ссылку», всё содержимое диалога с нейросетью окажется проиндексированным Google, Bing, DuckDuckGo и, вероятно, другими поисковиками. При этом создание публичной ссылки не раскрывает имени пользователя или данные аккаунта. Но если в диалоге упоминаются конкретные имена, места или детали, переписку можно легко идентифицировать. Представители Google пояснили, что поисковые системы не инициируют индексацию этих страниц — ответственность за публикацию лежит на OpenAI. Пользователи могут в любой момент отредактировать или удалить общедоступные ссылки, а при удалении аккаунта все связанные чаты также исчезают. Однако до этого момента информация остаётся в интернете.

Источник изображения: pcmag.com Ранее TechCrunch сообщал, что глава OpenAI Сэм Альтман (Sam Altman) недавно отметил, что люди рассказывают ChatGPT о самых сокровенных вещах в жизни, особенно молодёжь, которая использует ИИ как терапевта или консультанта для решения личных и эмоциональных проблем. При этом OpenAI юридически обязана сохранять переписки и предоставлять их по запросу в рамках судебных разбирательств. Одновременно некоторые пользователи Reddit отмечают, что доступ к открытым чатам стал «золотой жилой» для специалистов по SEO, поскольку в них отражены реальные вопросы аудитории. Аналогичные проблемы с приватностью ранее возникали у Meta✴✴: в июне стало известно, что общие чаты с их ИИ попадали в ленту Discover, после чего компания добавила предупреждение перед публикацией. В феврале 2024 года после переименования Bard в Gemini пользователи также обнаружили, что чаты с сервисом появляются в поиске Google через параметр site:gemini.google.com/share, однако сейчас по этому запросу результатов не выдаётся. Также наблюдаются совпадения между ответами ChatGPT и результатами поиска Google, включая AI Overview (ИИ-сводки), что породило предположения о том, что ChatGPT может использовать данные из поисковой выдачи. На момент написания материала Google перестал выдавать списки диалогов по запросу site:chatgpt.com/share. Ежемесячная выручка OpenAI достигла $1 млрд — расходы тоже выросли

31.07.2025 [12:11],

Алексей Разин

Формально разработавшая ChatGPT компания OpenAI остаётся частным стартапом, поэтому её финансовые показатели и привлекаемые от инвесторов суммы скрыты от широкой публики. По данным The Information, по итогам семи месяцев этого года выручка OpenAI в годовом выражении поднялась в два раза до $12 млрд. Ежемесячно сейчас компания получает $1 млрд выручки.

Источник изображения: Unsplash, Zulfugar Karimov Этому способствует наличие у неё 700 млн активных подписчиков ChatGPT, которые пользуются её услугами как минимум раз в неделю. Расходы OpenAI также растут уверенными темпами, и если недавно она собиралась потратить по итогам года около $7 млрд, то теперь увеличила прогноз до $8 млрд. Попутно сообщается, что OpenAI готовится ко второму раунду финансирования, по итогам которого намерена привлечь $30 млрд на нужды своего развития. Если не считать SoftBank, которая договорилась поэтапно вложить в капитал OpenAI около $32 млрд, то пока желающих набралось на выделение только $7,5 млрд для нужд стартапа. Акционеры в лице Sequoia Capital и Tiger Global Management на этот раз будут готовы выделить несколько сотен миллионов долларов США. Глава OpenAI Сэм Альтман (Sam Altman) придерживается весьма амбициозных планов в части строительства вычислительной инфраструктуры для систем искусственного интеллекта, привлекая для этого средства партнёров типа SoftBank или Oracle. В этом смысле расходы компании могут ещё долго превышать доходы, но на желании инвесторов поддерживать OpenAI подобная перспектива, похоже, не особо сказывается. ИИ-приложения захватили смартфоны и удвоили выручку — ChatGPT уже дышит в затылок Google

30.07.2025 [19:31],

Сергей Сурабекянц

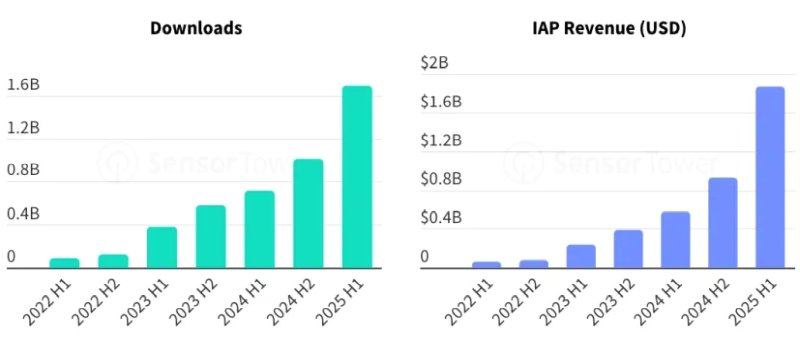

Согласно отчёту аналитической компании Sensor Tower, приложения генеративного ИИ (ПГИИ) продемонстрировали значительный рост как по количеству загрузок, так и по доходу от продаж в приложениях в первой половине 2025 года. В своём отчёте компания сообщила, что термин «ИИ» теперь встречается более 100 000 раз в описаниях приложений как в App Store, так и в Google Play. ChatGPT остаётся бессменным лидером по популярности среди пользователей и почти догнал Google.

Источник изображений: unsplash.com Количество загрузок ПГИИ достигло 1,7 млрд по сравнению с 1 млрд во второй половине 2024 года. Доход от продаж в этих приложениях вырос с $932 млн во второй половине 2024 года до $1,87 млрд в первой половине 2025 года. Пользователи провели в ПГИИ более 15,6 млрд часов в первой половине 2025 года, что почти вдвое превышает 8,5 млрд часов во второй половине 2024 года. За последние шесть месяцев было зафиксировано более 426 млрд сеансов обращения к ИИ.

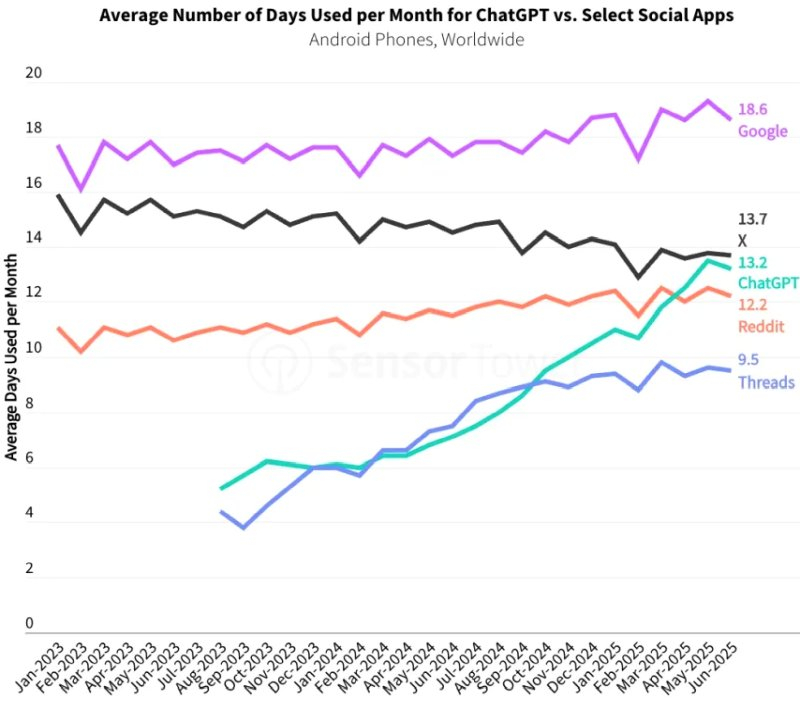

Источник изображения: Sensor Tower Самым быстрорастущим рынком ПГИИ стала Азия с долей рынка 42,6 % благодаря таким странам, как Индия и материковый Китай. Рост загрузок ПГИИ в Азии в первом полугодии 2025 года составил 80 %, по сравнению с 51 % в Европе и 39 % в Северной Америке. В Латинской Америке был зарегистрирован самый высокий рост количества покупок внутри ПГИИ, но Северная Америка по-прежнему удерживает лидерство с долей 40 %. По данным Sensor Tower, ChatGPT стал лидером по доходу от продаж внутри приложений во всех странах, кроме Китая. Однако китайский Deepseek показал лучшие результаты по количеству загрузок в течение нескольких недель после запуска. Пользователи также стали чаще обращаться к ИИ-помощникам, лидером среди которых остаётся ChatGPT. В первом полугодии пользователи использовали ChatGPT в среднем более 12 дней в месяц. Среди других популярных ПГИИ — Character AI, PolyBuzz, DeepSeek и Perplexity.

Источник изображения: Sensor Tower Приверженность пользователей ChatGPT впечатляет — они используют приложение OpenAI так же часто, как соцсети X и Reddit. Только Google может похвастаться более высоким показателем по среднему количеству дней использования в месяц. По сравнению с прошлым годом использование ChatGPT в выходные дни также увеличилось, что свидетельствует о росте числа личных запросов.

Источник изображения: Sensor Tower Отчёт Sensor Tower подчёркивает, что «модели использования приложения [ChatGPT] становятся ближе к Google, который пользователи используют в качестве основного инструмента поиска как в рабочее, так и в нерабочее время». Разрыв между использованием ChatGPT и ведущими поисковыми системами сократился. В первой половине 2025 года среднесуточное использование ChatGPT составило 16 минут по сравнению с 18,2 минутами для ведущих поисковых систем и браузеров. Помимо поиска, пользователи обращаются к ChatGPT по вопросам здоровья и благополучия, покупок, личных финансов и советов по приготовлению еды. Более трети запросов к ChatGPT во втором квартале 2025 года были связаны со стилем жизни и развлечениями. Sensor Tower отмечает рост популярности ChatGPT как на мобильных приложениях, так и на платформах. Более 15 % пользователей ChatGPT в США используют его как в веб-версии, так и на мобильных устройствах, что превышает показатели других платформ, таких как Temu и Threads. Несмотря на прогресс, ChatGPT всё ещё отстаёт от Google, Facebook✴✴, YouTube, Google Docs и Amazon, у которых более 25 % пользователей используют сервис как в интернете, так и на мобильных устройствах.  В своём отчёте аналитическая компания сообщила, что термин «искусственный интеллект» теперь встречается более 100 000 раз в описаниях приложений как в App Store, так и в Play Store. В первом полугодии 2025 года пользователи загрузили 7,5 млрд приложений, в которых упоминается ИИ, что составило около 10 % от общего числа загрузок. Sensor Tower отметила попытки спекуляции на буме искусственного интеллекта — в названиях приложений в топах различных категорий теперь всё чаще присутствует слово «ИИ». За последние 12 месяцев всё больше приложений в таких категориях, как «Создание контента», «Редактирование фотографий», «Питание и диета», «Подготовка к тестам», «Репетиторство и учёба», «Перевод» и «Другие услуги для хобби и интересов» стали добавлять термины, связанные с ИИ. Однако, по утверждению аналитиков Sensor Tower, это привело лишь к кратковременному росту числа загрузок. OpenAI запустила «режим обучения» в ChatGPT — теперь ИИ не даёт готовых ответов, а помогает думать

30.07.2025 [00:07],

Анжелла Марина

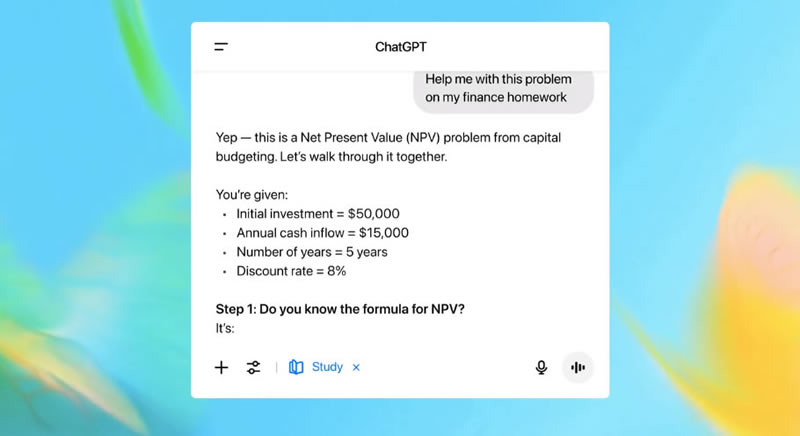

Компания OpenAI представила новый инструмент в ChatGPT — «Режим обучения» (Study Mode), который помогает студентам разбираться в задачах поэтапно, а не выдаёт готовые ответы. Это решение стало ответом на распространённую проблему: многие учащиеся используют ИИ для списывания, избегая самостоятельной работы. В OpenAI заявили, что создали Study Mode как «первый шаг на долгом пути к улучшению обучения в ChatGPT».

Источник изображения: openai.com Вице-президент OpenAI по образованию Лия Белски (Leah Belsky) отметила, что ChatGPT может значительно повысить успеваемость, если применяется как обучающий инструмент, но может и навредить учебному процессу, когда превращается в «машину для генерации ответов». Как пишет CNBC, ссылаясь на данные OpenAI, каждый третий студент студенческого возраста уже использует ChatGPT, поэтому компания разработала Study Mode, ориентированный на эту демографическую группу. Вместо прямых решений ИИ будет предлагать наводящие вопросы, помогая разбираться в домашних заданиях, подготовке к экзаменам и новых темах. Разработка велась совместно с преподавателями, учёными, экспертами в области образования и студентами из ChatGPT Lab — сообщества, где учащиеся делятся опытом использования чат-бота. В основе учебного режима лежат специальные системные инструкции, отражающие базовый набор моделей поведения, способствующих «более глубокому обучению, включая поощрение активного участия, управление когнитивной нагрузкой, проактивное развитие метапознания и саморефлексии, стимулирование любопытства и предоставление действенной и поддерживающей обратной связи». В своём блоге OpenAI продемонстрировала, как студент взаимодействует с новым «режимом обучения»: после отправки вопроса ChatGPT предлагает проработать два этапа решения, а затем сформулировать ответ своими словами.  «Вместо того чтобы делать работу за них, Study Mode побуждает учащихся критически относиться к своему обучению. Подобные функции — важный шаг к эффективному использованию ИИ в образовательной среде. Даже в эпоху ИИ наилучшие результаты достигаются, когда учащиеся с энтузиазмом воспринимают материал урока и активно его изучают», — отметил Робби Торни, старший директор по ИИ-программам в Common Sense Media. Ключевые особенности новой системы основаны на интерактивных подсказках, которые сочетают в себе наводящие вопросы, помогающие лучше понять и усвоить материал, шаблонные ответы, индивидуальную поддержку и проверку знаний. Study Mode можно включать и выключать в ходе беседы, что, по словам OpenAI, даёт студентам гибкость в достижении учебных целей в каждом чате. Начиная с сегодняшнего дня новый режим доступен зарегистрированным пользователям в версиях Free, Plus, Pro и Team, а в ChatGPT Edu он появится в ближайшие несколько недель. Скоро рынок наполнится наушниками со встроенным ИИ на базе GPT-4.1 — Bragi и OpenAI договорились о партнёрстве

29.07.2025 [19:13],

Сергей Сурабекянц

В 2019 году немецкая компания Bragi переключилась с производства наушников на лицензирование собственных разработок. Фирменные технологии компании используют многие именитые производители аудиотехники. Сегодня Bragi анонсировала приложение ChatAI, разработанное в партнёрстве с OpenAI. Оно позволит производителям наушников интегрировать в свои продукты голосового помощника на базе GPT-4.1 — для создания заметок, постановки вопросов и доступа к информации.

Источник изображений: Bragi Когда владелец наушников активирует голосового помощника, мультимодальная локальная модель в приложении ChatAI обрабатывает запрос и отправляет его на серверы OpenAI. Модель GPT-4.1 формирует ответ, который озвучивается через наушники. Чтобы минимизировать риск случайной активации и обработки посторонних голосов, ChatAI обучен реагировать только на команды владельца устройства. В Bragi подчёркивают, что компания не получает персональные данные пользователей, а их запросы не сохраняются в приложении после отправки в OpenAI. Bragi также заявляет, что новая система позволит партнёрам создавать собственный фирменный интерфейс и реализовывать агентские функции — например, изучение привычек пользователя и проактивную настройку эквалайзера в зависимости от контекста и личных предпочтений.  На первом этапе ChatAI будет поддерживать английский, немецкий, французский, испанский и китайский языки. В дальнейшем планируется расширение языковой поддержки. Согласно исследованиям Bragi, пользователи в разных регионах используют ИИ-функции по-разному: в Китае наиболее востребован перевод, тогда как в других странах сценарии применения более разнообразны. По данным компании, 89 % потребителей готовы заплатить в среднем на $25 больше за наушники с ИИ-функциями, что увеличивает среднюю цену таких устройств до $135–160. Приложение ChatAI станет доступным для производителей наушников уже этим летом. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |