|

Опрос

|

реклама

Быстрый переход

Судья назвала иск Маска к OpenAI на $134 млрд «взятым с потолка», но исход дела определят присяжные

16.03.2026 [16:02],

Алексей Разин

В январе стало известно, что Илон Маск (Elon Musk) пытается взыскать с OpenAI и Microsoft от $79 до $134 млрд в качестве компенсации за якобы отказ стартапа от своих первоначальных намерений создавать ИИ на благо человечества и образование альянса с программным гигантом. Судья недавно назвала эту оценку ущерба «взятой с потолка», но не стала полностью отклонять претензию, предложив суду присяжных рассмотреть этот вопрос самостоятельно.

Источник изображения: Unsplash, Wesley Tingey Адвокаты OpenAI в ходе слушания дела в минувшую пятницу, как отмечает Financial Times, попытались убедить судью Ивонн Гонсалес Роджерс (Yvonne Gonzalez Rogers) в необходимости отвергнуть подобные материальные претензии со стороны Илона Маска, но она не стала этого делать, предоставив возможность суду присяжных в апреле этого года рассмотреть доводы, предъявляемые представителями Илона Маска. При этом в объективности оценки ущерба судья всё же усомнилась, заявив следующее: «Присяжные поймут, что эксперт Маска просто взял эти цифры с потолка». Судья также добавила, что не находит доводы представителей Маска убедительными в части определения суммы ущерба. Ходатайство OpenAI об исключении показаний эксперта Маска из материалов дела судья при этом отклонила, поскольку сочла неуместным принятие такого решения на основании «ходатайства на пяти страницах», и предложила присяжным заслушать доказательства и самостоятельно принять решение. Если суд удовлетворит исковые требования Маска в полном размере, то Microsoft предстоит выплатить ему $25 млрд возмещения ущерба, а OpenAI раскошелится на $109 млрд. По мнению судьи, её согласие с ходатайством OpenAI привело бы к необходимости прекратить рассмотрение всего дела, поскольку как таковых доказательств ущерба у истца нет. В роли эксперта, на доводах которого строится оценка ущерба, выступил венчурный инвестор и экономист консалтинговой компании Berkley Research Group Пол Ваццан (Paul Wazzan). Расчёты Ваццана были достаточно примитивными. Он исходил из того, что вложенные Маском на ранних этапах $38 млн в сочетании с его нематериальным вкладом составляют от 50 до 75 % капитализации некоммерческой части OpenAI, которая владеет чуть более чем четвертью коммерческой части стартапа. Последнюю сейчас оценивают в $730 млрд. Илон Маск в 2015 году принимал участие в становлении OpenAI и оказывал финансовую поддержку стартапу, но покинул совет директоров в 2018 году из-за возникших противоречий с главой компании Сэмом Альтманом (Sam Altman). В 2023 году Маск основал конкурирующий ИИ-стартап xAI, который недавно сперва объединился с социальной сетью X, а затем и с аэрокосмической компанией SpaceX, также основанной Маском. OpenAI в своём ходатайстве настаивала, что иск подан Маском из коммерческих соображений и является частью кампании по травле стартапа. Представители OpenAI усомнились в адекватности методики расчёта ущерба, которую использовал эксперт Маска, а также сослались на отсутствие чёткой формулы для его определения. Слушание по делу намечен она 28 апреля текущего года. Представители Маска в ходе заседания суда постараются убедить присяжных, что OpenAI и Сэм Альтман в частности нарушили условия контракта и обманули Илона Маска. Судья Роджерс также в ходе недавнего слушания призналась, что для такого дела сложно подобрать состав жюри присяжных, поскольку оно должно состоять из людей достаточно высокого социального статуса. OpenAI объяснила, почему реклама в ChatGPT появилась не везде и не у всех

16.03.2026 [15:59],

Анжелла Марина

OpenAI опровергла слухи о глобальном развёртывании рекламы в ChatGPT. Несмотря на то, что некоторые пользователи заметили новые пункты в политике конфиденциальности, касающиеся рекламных объявлений, компания заверила ресурс BleepingComputer, что на данный момент эта функция работает пока исключительно на территории США.

Источник изображения: AI Как пояснили в компании, реклама в чат-боте действительно существует, но её показ строго ограничен территорией Соединённых Штатов. Запуск состоялся 9 февраля 2026 года, и в настоящее время OpenAI находится на этапе постепенного расширения доступа внутри страны. Только после тщательного изучения поведения пользователей и реакции на рекламу в реальных условиях будет принято решение о выводе монетизации на международный уровень. Технически объявления показываются непосредственно под сгенерированными ответами, но только тем пользователям, которые авторизованы в системе и используют тарифные планы Free или Go. Существуют строгие возрастные фильтры: реклама не демонстрируется лицам моложе 18 лет, даже по их запросу. Хотя OpenAI утверждает, что коммерческие блоки не влияют на содержание ответов, компания не отрицает факта глубокой персонализации объявлений, основанной на запросах пользователя.

Источник изображения: bleepingcomputer.com В своих разъяснениях OpenAI отметила, что реклама управляется независимыми программными системами, и у рекламодателей нет возможности влиять на работу языковой модели. «Реклама работает в отдельных системах, отличных от нашей ИИ-модели, и рекламодатели не имеют возможности формировать, ранжировать или изменять ответы ChatGPT», — отмечается в документе OpenAI. Также подчёркивается, что все объявления являются платными размещениями и отделены от контента: «Это платное размещение, и просмотр рекламы не означает, что OpenAI одобряет или рекомендует рекламодателя, его продукты или услуги». Ключевым аспектом остаётся защита пользовательских данных: OpenAI заявила, что не делится с рекламодателями диалогами и гарантирует, что третьи лица не получают доступа к истории чатов, функции памяти или личной информации клиентов. На прямой вопрос BleepingComputer о сроках более широкого распространения рекламы компания ответа не предоставила. OpenAI отложила запуск эротических чатов в ChatGPT из-за опасений по поводу их безопасности

16.03.2026 [09:32],

Алексей Разин

Многие отрасли в своё время получили развитие, в том числе, и благодаря природному интересу человека к материалам эротического содержания, а потому сфера искусственного интеллекта не является исключением. Компании борются с соблазном использовать эротику для продвижения своих платформ, пытаясь при этом остаться в каких-то законодательных и этических рамках. OpenAI пока не готова запустить эротические чаты.

Источник изображения: Unsplash, Alexander Krivitskiy О возможности появления такого направления в работе ChatGPT ещё в середине прошлого года заявил генеральный директор OpenAI Сэм Альтман (Sam Altman). Сперва он вынашивал идею запуска функции эротических чатов к декабрю прошлого года, потом сроки перенесли на текущий квартал, но теперь становится понятно, что и этот график не будет выдержан. Как минимум, задержка с дебютом функции эротических чатов будет измеряться одним месяцем, сообщает The Wall Street Journal. Эксперименты в использовании ИИ для создания текстового контента эротического содержания OpenAI предпринимала задолго до запуска ChatGPT. Ещё в 2021 году клиентам OpenAI предлагалась игра AI Dungeon с нелинейным сюжетом, направление развития которого могли задавать пользователи. Тогда специалисты OpenAI установили, что ИИ-платформа порой предлагает игрокам обсудить темы сексуальных взаимоотношений, даже если они никак не провоцировали подобный поворот сюжета. Если же пользователь сам предлагал умеренную степень эротизма, ИИ буквально «перегибал палку» в проявлениях откровенности соответствующих бесед. OpenAI уже тогда задумалась о привлекательности подобного применения чат-ботов, но при этом осознала и необходимость введения этических ограничений. Руководство OpenAI в последнее время всё более благосклонно высказывалось в отношении идеи запуска эротических чатов, подчёркивая, что всё ограничится только текстовой информацией, без создания изображений и видео откровенного содержания. Конкуренты тоже не стоят на месте. В прошлый четверг Илон Маск (Elon Musk) заявил, что его чат-бот Grok в части генерирования видео скоро сможет создавать контент, относящийся к категории «18+». Meta✴✴ позволяет пользователям своего чат-бота вести романтические ролевые игры, но только при наличии уверенности в их совершеннолетии. У самой OpenAI с механизмами подтверждения возраста пока имеются проблемы. Сейчас профильная система в 12 % случаев ошибочно принимает подростков за совершеннолетних. С учётом наличия примерно 100-миллионной аудитории несовершеннолетних пользователей ChatGPT, такой уровень погрешности позволил бы миллионам подростков на регулярной основе получать доступ к эротическим чатам. Созванная OpenAI в январе экспертная комиссия также выразила озабоченность угрозой появления запретного с точки зрения общественной морали и законодательства контента, который подразумевает насильственные действия сексуального характера, упоминание несовершеннолетних и другие специфические сценарии. Кроме того, увлечение подобным контентом может вызывать у людей психологическую зависимость и снижать их мотивацию поддерживать взаимоотношения с реальными партнёрами в офлайне. OpenAI хочет принудительно напоминать таким увлекающимся натурам, что им следует строить отношения с реальными людьми. Это особенно важно с учётом наличия не совсем приятных инцидентов, возникших по мере распространения чат-ботов. Существуют примеры доведения людей до самоубийства в результате длительного общения с вымышленными персонажами в чат-боте, включая и подростковые суициды. Эксперты опасаются, что эротический уклон подобных бесед только спровоцирует рост количества таких случаев. В части механизмов проверки возраста пользователей у представителей OpenAI особых иллюзий нет — они, по их словам, никогда не смогут быть идеальными и в 100 % случаев рабочими. С 2021 года часть сотрудников OpenAI выражает сопротивление идее запуска эротических чатов на платформе из опасения окончательного сползания в эту сферу: «Мы не хотели быть просто компанией, распространяющей эротику». На данный момент руководство OpenAI считает целесообразным запуск эротических чатов, руководствуясь следующими принципами: «Мы всё ещё верим, что со взрослыми надо обращаться как со взрослыми, но формирование правильного опыта потребует большего времени». Microsoft, Meta✴ и OpenAI объединились с AMD и Nvidia для создания быстрого оптического интерконнекта для ИИ-мегакластеров

13.03.2026 [18:28],

Сергей Сурабекянц

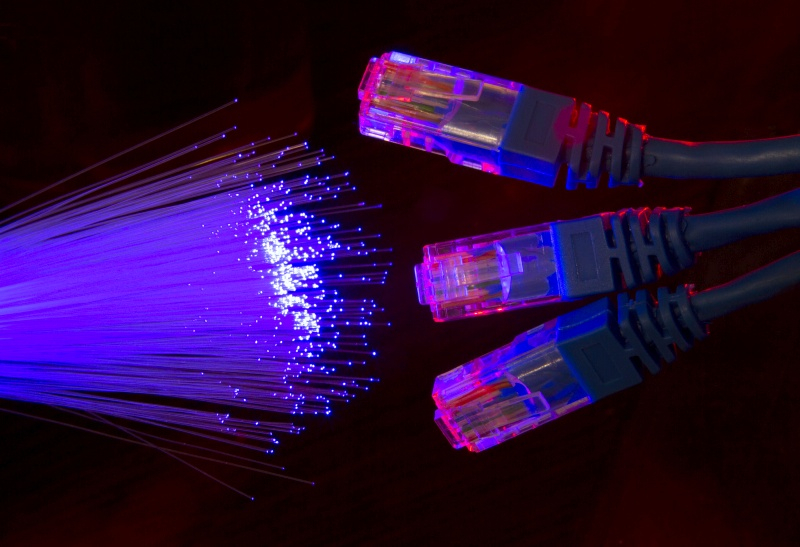

Облачные провайдеры Microsoft, Meta✴✴ и OpenAI объединились с разработчиками оборудования AMD, Broadcom и Nvidia для разработки протокольно-независимой технологии масштабируемого межсоединения для кластеров ИИ. Новое соглашение о сотрудничестве (Multi-Source Agreement, MSA) определит универсальную волоконно-оптическую инфраструктуру для масштабируемых межсоединений на коротких расстояниях для кластеров ИИ.

Источник изображений: unsplash.com В телекоммуникационной отрасли MSA — это соглашение о выпуске продуктов, совместимых между различными поставщиками, выступающее в качестве де-факто стандартов и создающее конкурентный рынок для совместимых продуктов. Спецификация, разработанная MSA, определяет форм-факторы устройств и их интерфейс управления. К продуктам, соответствующим MSA, относятся: оптические трансиверы, волоконно-оптические кабели и другие сетевые устройства. MSA в области оптических вычислительных межсоединений (Optical Compute Interconnect, OCI) должно определить открытую спецификацию оптической связи для масштабируемых межсоединений, используемых внутри крупных систем и стоек ИИ, что позволит использовать оптические кабели вместо медных для подключения большего количества ускорителей на высокой скорости и с предсказуемым энергопотреблением. На практике это означает, что консорциум разработает общий физический уровень (Physical Layer, PHY) и унифицированные компоненты для поддержки различных протоколов, таких как UALink для AMD и Broadcom, и NVLink для Nvidia. Технология связи OCI для оптических каналов малой дальности, используемых в стойках ИИ и масштабируемых кластерах, определит общий PHY на основе сигнализации NRZ и мультиплексирования с разделением по длинам волн (Wavelength-Division Multiplexing, WDM), начиная с четырёх длин волн × 50 Гбит/с (200 Гбит/с в каждом направлении) с возможностью масштабирования до 800 Гбит/с на волокно. Ожидается, что со временем количество длин волн будет увеличено, а скорость передачи сигналов возрастёт до 3,2 Тбит/с на волокно. Технология будет поддерживать подключаемые оптические модули, встроенную оптику и интегрированную оптику (Co-Packaged Optics, CPO) непосредственно с вычислительными микросхемами.  Общий PHY позволит различным процессорам и протоколам межсоединений работать на одной и той же волоконно-оптической инфраструктуре и коммутаторах от разных поставщиков, обеспечивая гибкость для крупных компаний, сохраняя при этом конкурентные преимущества протоколов, используемых разработчиками ускорителей ИИ и графических процессоров. Стандартизированная дорожная карта OCI призвана упростить системную интеграцию, снизить риски разработки и сократить циклы развёртывания для новых поколений оборудования ИИ. Хотя группу OCI MSA возглавляют AMD, Broadcom и Microsoft, известные сторонники открытых отраслевых стандартов, это явно не традиционный орган по стандартизации, такой как консорциумы Ultra Ethernet или UALink, что должно заметно повлиять на развитие технологии и ускорить её внедрение:

«Растущая потребность в масштабируемых оптических межсоединениях для поддержки крупных систем ИИ в конце этого десятилетия очевидна, — уверен старший вице-президент по технологиям и инженерии AMD Брайан Амик (Brian Amick). — AMD является одним из основателей и активным сторонником OCI MSA, поскольку она устанавливает открытую спецификацию для отрасли, способствующую развитию надёжной многовендорной экосистемы масштабируемых оптических межсоединений». «Компания Broadcom гордится тем, что использует свою платформу CPO и отраслевые партнёрства для продвижения спецификации OCI, — заявил вице-президент и генеральный директор подразделения оптических систем Broadcom Нир Маргалит (Near Margalit). — OCI-MSA обеспечивает бесшовную интеграцию с существующими электрическими ASIC на базе SerDes, предоставляя при этом чёткий путь к прямой интеграции ASIC, гарантируя, что экосистема останется гибкой и высокопроизводительной». «Nvidia является одним из основателей OCI MSA, призванного установить общий оптический стандарт для глобальных инфраструктур ИИ, — отметил старший вице-президент по сетевым технологиям Nvidia Гилад Шайнер (Gilad Shainer). — Оснастив лучшие в своём классе вычислительные мощности передовой оптикой, OCI MSA может обеспечить масштабируемость и производительность, необходимые для следующей эры сверхинтеллекта». У американских законодателей возникли вопросы к OpenAI из-за сделки с Пентагоном

13.03.2026 [11:38],

Алексей Разин

Спешно заключённая OpenAI сделка с Министерством войны США, как признался глава компании Сэм Альтман (Sam Altman), потребовала доработки некоторых пунктов контракта, но публично он выражал лояльность идее использования ИИ в военных целях. При этом даже у американских конгрессменов возникли вопросы к руководителю OpenAI на данную тему.  В четверг на этой неделе, как отмечает CNBC, генеральный директор OpenAI Сэм Альтман встретился с группой американских конгрессменов в Вашингтоне. Сенатор Марк Келли (Mark Kelly), например, заявил о наличии у него «серьёзных вопросов» по поводу подходов OpenAI к использованию технологий компании в боевых действиях и самой сделке с Пентагоном в целом. В своём интервью каналу CNBC сенатор Келли признался, что группа его коллег в подробностях обсудила с Альтманом подходы к слежению за гражданами и использованию ИИ в боевых условиях. Разговор сенатор назвал «хорошей дискуссией». «Должны быть определённые ограничения, и мы должны быть уверены, что всё время думаем о Конституции и обеспечиваем соблюдение её основных положений», — подчеркнул сенатор. Напомним, что сделка американского военного ведомства с конкурирующей Anthropic развалилась после того, как руководство этой компании потребовало исключить использование её разработок при массовом слежении за американскими гражданами и применении систем вооружений без согласия человека. Конфликт между сторонами сделки привёл к тому, что Anthropic оказалась включена в перечень неблагонадёжных поставщиков, а подрядчикам Пентагона было запрещено использовать её разработки. На поиск альтернативы у самого ведомства и его подрядчиков остаётся шесть месяцев, но применять ИИ-модели Anthropic им запрещается уже сейчас. Примечательно, что глава OpenAI Сэм Альтман именно упоминаемые выше ограничения включил в текст контракта с Пентагоном, и конфликт ведомства с Anthropic стал носить характер «наказания непокорного», а не последствия реальных противоречий. Хотя Альтман и выразил несогласие с отнесением Anthropic к числу неблагонадёжных поставщиков, он подчеркнул, что «именно правительство должно решать, как именно будут работать самые важные вещи в стране». Сенатор Келли заявил, что группа парламентариев работает над законопроектом, определяющим характер взаимоотношений Министерства войны США с разработчиками ИИ, и что должно существовать законодательство, определяющее некоторые границы применения таких технологий. Конгрессмен посетовал, что в парламенте США вопросы рассматриваются не так быстро, как развиваются новые технологии. OpenAI встроит генератор видео Sora прямо в ChatGPT

11.03.2026 [15:07],

Павел Котов

Компания OpenAI намерена открыть доступ к генератору видео на основе искусственного интеллекта Sora прямо в интерфейсе ChatGPT. Об этом сообщил ресурс The Information со ссылкой на информированные источники.

Источник изображения: BoliviaInteligente / unsplash.com Генератор видео Sora помог OpenAI расширить возможности в области мультимодальных технологий ИИ — он выступает конкурентом аналогичным сервисам от Meta✴✴ и Google. Предназначенные для работы с текстом ИИ-модели уже широко используются как частными лицами, так и предприятиями, и очередным этапом в развитии технологий ИИ стали генераторы статических изображений и видеороликов — они обещают кардинальные изменения в отрасли. OpenAI запустила Sora как самостоятельное приложение в сентябре 2025 года. Оно позволяет пользователям генерировать видео по текстовым запросам и публиковать их. Разработчик заключил партнёрское соглашение с компанией Disney, согласно которому платформа может генерировать персонажей, которые принадлежат гиганту развлекательной индустрии. Созданные сервисом ролики можно публиковать в соцсетях. После открытия доступа к Sora через ChatGPT компания OpenAI намерена сохранить генератор видео и как самостоятельное приложение. Сам разработчик информацию об этом не прокомментировал, передаёт Reuters. ChatGPT получил визуальную функцию, которая «заставит» полюбить математику

11.03.2026 [06:08],

Анжелла Марина

Компания OpenAI представила новую функцию ChatGPT под названием «динамические визуальные объяснения» (dynamic visual explanations). Функция позволяет не просто читать разъяснения математических и научных концепций в виде текста, а взаимодействовать с интерактивными модулями в реальном времени.

Источник изображения: xAI Как поясняет TechCrunch, принцип работы прост. Если спросить, что такое уравнение линзы или как найти площадь круга, ChatGPT выдаст не только текст, но и представит визуальный модуль, в котором можно менять значения переменных и мгновенно наблюдать за изменениями. Например, при изучении теоремы Пифагора можно регулировать длины сторон треугольника и видеть, как пересчитывается гипотенуза.

Источник изображения: OpenAI На данный момент интерактивная визуализация доступна для более чем 70 тем по математике и естественным наукам. Среди них — биномиальный квадрат, закон Шарля, площадь круга, сложные проценты, закон Кулона, разность квадратов, экспоненциальный распад, закон Гука, кинетическая энергия, линейные уравнения и закон Ома. Функция доступна всем авторизованным пользователям ChatGPT, а список тем будет постепенно расширяться. Запуск нового инструмента примечателен тем, что он смещает роль ChatGPT от простой выдачи готовых ответов к вовлечению пользователя в процесс понимания, отмечает TechCrunch. Приведёт ли это к более глубокому усвоению материала, во многом будет зависеть от того, как именно люди станут использовать эту возможность. По данным OpenAI, более 140 миллионов человек еженедельно обращаются к ChatGPT с вопросами, связанными с математикой и естественными науками — то есть, теми предметами, которые традиционно вызывают трудности у учащихся. При этом в образовательном сообществе продолжаются споры: часть педагогов опасается чрезмерной зависимости от ИИ, тогда как многие учителя и студенты уже активно интегрируют технологию в учебный процесс. Отметим, новая функция дополняет другие образовательные инструменты ChatGPT, в частности, режим обучения, который пошагово ведёт пользователя через решение задач, и QuizGPT, позволяющий создавать карточки и проходить тестирование по любой теме. Аналогичную функцию интерактивных диаграмм в ноябре запустил сервис Gemini от Google. Представители Google и OpenAI готовы выступить в суде в поддержку Anthropic в деле о конфликте с Пентагоном

10.03.2026 [07:44],

Алексей Разин

Процессуальные процедуры традиционно растянуты во времени, но Anthropic не стала особо медлить с подачей судебного иска против Пентагона, пытаясь оспорить своё включение в список неблагонадёжных поставщиков. Поддержать позиции компании в суде готовы представители конкурирующих OpenAI и Google, но только как частные лица, обладающие определённой экспертизой в рассматриваемом споре.

Источник изображения: OpenAI Почти 40 сотрудников OpenAI и Google, включая руководителя разработки Gemini Джеффа Дина (Jeff Dean), направили в суд процессуальный документ, формально позволяющий помочь судье составить более полное представление о предмете спора между истцом и ответчиком. По мнению составителей документа, включение Anthropic в перечень неблагонадёжных поставщиков является некорректным проявлением мести, которое вредит интересам общества. Как считают подписавшие обращение к суду представители указанных компаний, обозначенные Anthropic «красные линии» реальны и требуют конкретного ответа. Даже в ответственных руках, по мнению авторов письма, инструменты тотальной слежки за гражданами представляют серьёзный риск для демократических институтов, да и создание полностью автономных систем вооружения представляет собой риск, требующий особого внимания. Авторы письма относят себя к учёным, разработчикам и инженерам, занятым в создании передовых американских систем ИИ. По их замыслу, обращение к суду направлено не на решение проблем какой-то конкретной компании, а на представление интересов всей отрасли. Подписавшие письмо эксперты считают себя достаточно компетентными, чтобы предупреждать власти США о неприятных последствиях рассматриваемого ими применения ИИ в военных и разведывательных целях. Как поясняют авторы письма, сейчас данные о гражданах США существуют в разрозненном виде, и никто пока не объединял эти массивы с помощью ИИ для подробного анализа в масштабе реального времени. По сути, при желании американские власти могли бы составить подробное досье на сотни миллионов человек одновременно, с учётом постоянных изменений в этих данных. В части использования ИИ для выбора целей системами вооружения, как предупреждают эксперты, опасность таится в возможности появления ошибок из-за различий между условиями обучения профильных моделей и реальной обстановкой на поле боя. Как отмечают авторы обращения, ИИ не в состоянии оценивать возможный сопутствующий ущерб при выборе тех или иных целей, как это способен сделать человек. Кроме того, склонность ИИ к «галлюцинациям» делает военное применение таких технологий ещё более опасным без контроля со стороны человека. Авторы письма резюмируют, что на текущем этапе развития технологий предлагаемые Пентагоном сферы применения ИИ представляют серьёзную опасность и требуют ограничений либо на техническом уровне, либо на административном. Безопасность ИИ-агентов станет встроенной: OpenAI поглотила стартап Promptfoo

10.03.2026 [04:24],

Анжелла Марина

Компания OpenAI договорилась о приобретении стартапа Promptfoo, специализирующегося на разработке инструментов для тестирования безопасности ИИ-систем на этапе их разработки. По сообщению Bloomberg, сделка направлена на снижение рисков для клиентов, внедряющих программное обеспечение на базе ИИ, и привлечение крупного бизнеса.

Источник изображения: AI Сам стартап существует два года, базируется в Сан-Франциско и предоставляет инструменты с открытым исходным кодом (Open Source) для тестирования безопасности нейросетей, включая процедуру «красной команды» (red-teaming), при которой специалисты имитируют атаки на собственные продукты в процессе их разработки для обнаружения слабых мест до того, как ими воспользуются злоумышленники. Клиентами стартапа являются примерно 25 % компаний из списка Fortune 500. Технологии Promptfoo будут интегрированы в корпоративную платформу OpenAI Frontier. После интеграции Frontier получит возможности автоматизированного тестирования, мониторинга изменений и отслеживания результатов проверок для соответствия требованиям безопасности. Управляющий директор венчурной компании Insight Partners Ганеш Белл (Ganesh Bell), которая возглавила раунд финансирования Promptfoo на сумму $18,4 млн в прошлом году, отметил, что «покупка свидетельствует о явной приверженности компанией OpenAI создания корпоративного ИИ, который будет не только мощным, но и безопасным, и надёжным при масштабировании». Финансовые условия сделки не раскрываются. OpenAI продолжит развивать открытый исходный код Promptfoo параллельно с коммерческой интеграцией и уже начала внедрять функции безопасности в свои продукты, представив на прошлой неделе ИИ-агента для поиска и устранения уязвимостей в базах данных, аналогичного инструменту Anthropic PBC. Глава робототехнического направления OpenAI уволилась из компании на фоне скандала с Anthropic и Пентагоном

08.03.2026 [08:23],

Алексей Разин

Ещё на прошлой неделе OpenAI вызвалась занять место взбунтовавшейся Anthropic в качестве подрядчика Пентагона, снабжающего ИИ-системами для осуществления военных операций. Не всем сотрудникам стартапа это могло понравиться, поэтому руководительница робототехнического направления OpenAI сочла нужным уйти из компании.

Источник изображения: Caitlin Kalinowski Речь идёт о Кейтлин Калиновски (Caitlin Kalinowski), которая руководила командами разработчиков аппаратных решений и робототехники OpenAI с ноября 2024 года. Из текста её открытых обращений к коллегам на страницах социальных сетей становится понятно, что для неё уход из OpenAI был непростым решением, его мотивы не имеют ничего общего с межличностными отношениями, а обусловлены исключительно этическими принципами. Кейтлин Калиновски осознаёт, что ИИ имеет важное значение для национальной безопасности, но убеждена, что поголовная слежка за гражданами США без юридических оснований и автоматизация летальных вооружений становятся теми линиями, которые лично её побуждают выразить протест. При этом Калиновски выражает глубокое уважение к главе OpenAI Сэму Альтману (Sam Altman) и его коллегам, а также гордится их совместными достижениями. Калиновски до перехода в OpenAI принимала активное участие в разработке очков дополненной реальности Meta✴✴ Platforms. Перед этим она девять лет работала в подразделении Oculus, а ещё раньше помогала Apple разрабатывать дизайн ноутбуков MacBook. Калиновски стала не единственным сотрудником OpenAI, выразившим своё недовольство ситуацией с Пентагоном и Anthropic, но при спешном заключении соглашения с американским военным ведомством в прошлую пятницу Сэм Альтман делал упор на главенство государства в вопросах применения оружия и разведки, призывая подчинённых ставить государственные интересы выше принципов частной компании. Представители OpenAI выражают надежду, что в текущей редакции соглашение с Министерством войны США чётко очерчивает те границы, которые не следует пересекать при применении ИИ. Не допускается массовая слежка за гражданами и применение автономных средств вооружений без сохранения права человека принимать решение по выбору целей. OpenAI отложила запуск «режима для взрослых» в ChatGPT — нужно решить проблему определения возраста

07.03.2026 [22:13],

Владимир Фетисов

В конце прошлого года OpenAI объявила о намерении запустить в ChatGPT «режим для взрослых» в первом квартале 2026 года, но, по всей видимости, ждать этого пользователям придётся дольше. По сообщениям сетевых источников, компания откладывает запуск функции, позволяющей генерировать контент для взрослых с помощью ИИ-бота.

Источник изображения: unsplash.com В сообщении сказано, что OpenAI хочет добиться большего прогресса в улучшении алгоритмов определения возраста пользователей, чтобы не допустить ситуаций, когда «режим для взрослых» доступен несовершеннолетним. В начале года компания начала использовать инструменты прогнозирования возраста, которые анализируют разные факторы, такие как давность создания аккаунта и особенности его использования для определения реального возраста пользователей. «Мы по-прежнему верим в принцип отношения к взрослым как ко взрослым, но, чтобы сделать пользовательский опыт действительно качественным, потребуется больше времени», — прокомментировал данный вопрос представитель OpenAI. Он также добавил, что компания откладывает запуск «режима для взрослых» в ChatGPT, чтобы «сосредоточиться на работе, которая в данный момент является более приоритетной для большего числа пользователей», в первую очередь, на улучшении характеристик нейросети. Гендиректор OpenAI Сэм Альтман (Sam Altman) впервые намекнул на «режим для взрослых» в ChatGPT в октябре 2025 года. Тогда же он упомянул изменения, которые позволят пользователям сделать так, чтобы ChatGPT действовал «очень похоже на человека». Осторожность OpenAI с запуском «режима для взрослых» выглядит вполне логичной. Компания уже сталкивается с многочисленными исками из-за нескольких случаев суицида и причинения себе вреда пользователями после длительно общения с ИИ-ботом. У OpenAI и Oracle закончились деньги на расширение гигантского ИИ-дата-центра в Техасе

07.03.2026 [15:29],

Павел Котов

OpenAI и выступающая её партнёром по вычислительным ресурсам Oracle отказались от запланированного ранее расширения флагманского центра обработки данных проекта Stargate в техасском Абилине. Переговоры двух компаний зашли в тупик из-за проблем с финансированием и, предположительно, опасений главы OpenAI Сэма Альтмана (Sam Altman) относительно взятия на себя обязательств, передаёт Bloomberg со ссылкой на информированные источники.

Источник изображения: Dima Solomin / unsplash.com Сейчас подрядчик, которым выступает компания Crusoe, возводит объект мощностью 1,2 ГВт — OpenAI и Oracle планировали расширить его до 2 ГВт, но планы сорвались из-за сложностей с финансированием и неспособности OpenAI прогнозировать спрос. Теперь на аренду неиспользованных и ещё даже не построенных мощностей у застройщика претендует Meta✴✴. Первоначально посредником в сделке выступила Nvidia, которая внесла депозит в размере $150 млн, — теперь компания сама обратилась к гиганту соцсетей с предложением о совместном использовании объекта. С момента объявления об инициативе Stargate с бюджетом $500 млрд компания OpenAI привлекла к нему Oracle для развёртывания мощностей на 4,5 ГВт — последняя оценила сотрудничество в $300 млрд. Выполнение этого обязательства потребует значительных заёмных средств — одна только Oracle ранее заявила о намерении привлечь дополнительные $50 млрд, но эти деньги, видимо, не поступят вовремя, чтобы спасти совместный проект на очередном этапе. Тем временем Meta✴✴ продолжает расходовать деньги, чтобы обеспечить себе как можно больше вычислительных мощностей в ЦОД. В январе глава компании Марк Цукерберг (Mark Zuckerberg) объявил о намерении потратить на объекты с ИИ-ускорителями до $135 млрд — сумму, сравнимую с ВВП Кении. Впрочем, в этом она не одинока: восемь крупнейших в мире гиперскейлеров, в том числе Google, Amazon, Meta✴✴, Microsoft, Oracle, Tencent, Alibaba и Baidu только в 2026 году намереваются направить на эти цели $710 млрд. Даже с учётом того, что план по расширению объекта провалился, OpenAI придётся найти место для размещения ИИ-ускорителей общей мощностью 5 ГВт, под которые Nvidia выделила ей $30 млрд в рамках очередного раунда финансирования, принесшего $110 млрд, в том числе от SoftBank и Amazon. OpenAI представила ИИ-агента Codex Security, который сам находит и закрывает «дыры» в ПО

07.03.2026 [06:37],

Анжелла Марина

OpenAI объявила о запуске специализированного ИИ-агента Codex Security, функциональность которого сосредоточена на выявлении и исправлении угроз кибербезопасности. В компании подчёркивают, что инструмент способен работать с большими объёмами данных и генерировать корректные патчи, освобождая разработчиков от рутины.

Источник изображения: AI Технической основой для Codex Security, как стало известно Bloomberg, послужил проект Aardvark, использовавший мощности модели GPT-5, который OpenAI тестировала в закрытом режиме в прошлом году. Теперь эта технология для поиска и устранения уязвимостей трансформировалась в коммерческий продукт, который способен сканировать репозитории и обучаться на отзывах пользователей для совершенствования своих алгоритмов. Анонс нового продукта усиливает давление на традиционные компании в сфере информационной безопасности и продолжает тренд на автоматизацию защиты, заданный компанией Anthropic. Выпуск инструмента Claude Code Security месяцем ранее уже продемонстрировал чувствительность рынка к таким инновациям, спровоцировав падение стоимости акций Crowdstrike и Cloudflare на 8 %. Доступ к Codex Security откроется в ближайшие дни в формате исследовательского превью для корпоративных клиентов, использующих ChatGPT Enterprise и Business, а также для образовательных учреждений. Компания предусмотрела бесплатный пробный период продолжительностью в 1 месяц, чтобы организации могли оценить эффективность системы без первоначальных затрат. Пентагон запретил подрядчикам работать с Anthropic, но Microsoft сохранит доступ для клиентов

06.03.2026 [13:59],

Алексей Разин

По некоторым данным, Министерство войны США, как оно теперь именуется, на этой неделе перешло от слов к делу, отнеся Anthropic к числу неблагонадёжных поставщиков, тем самым лишив подрядчиков государственных структур права работать с этим ИИ-стартапом. Microsoft утверждает, что на её собственных клиентов этот запрет не распространяется.

Источник изображения: Microsoft Как отмечает CNBC, после изучения действующих законодательных норм юристы корпорации Microsoft пришли к выводу, что её собственные клиенты смогут сохранить доступ к ИИ-моделям Anthropic через фирменное ПО. Некоторые связанные с оборонным сектором США компании уже велели своим сотрудникам отказаться от использования решений Anthropic и перейти на альтернативы. Формально, на подобную миграцию закон отводит до шести месяцев, но отказаться от использования ИИ-моделей Anthropic государственные служащие должны незамедлительно. Представители Microsoft при этом подчёркивают, что сотрудникам Министерства войны США запрещается использовать продукты Anthropic через интеграцию с собственными решениями Microsoft, включая чат-бот Claude. В тех случаях, если работа клиентов Microsoft с продуктами Anthropic не имеет отношения к оборонной сфере США, их можно будет использовать через Microsoft 365, GitHub и AI Foundry. Корпорация Microsoft начала интегрировать решения Anthropic в свои сервисы прошлой осенью, при этом не отказавшись от партнёрства с OpenAI, чьим крупнейшим инвестором является уже много лет. Например, разработчики ПО могут воспользоваться ИИ-ботом Claude через сервис GitHub Copilot AI, хотя им одновременно доступен и Codex конкурирующей OpenAI. В сервисе Microsoft 365 Copilot клиенты компании с прошлого октября могут переключаться между решениями Anthropic и OpenAI по своему усмотрению. SoftBank влезет в долги на $40 млрд, чтобы инвестировать в OpenAI

06.03.2026 [10:46],

Алексей Разин

Создавшая ChatGPT компания OpenAI финансирование активности по строительству вычислительной инфраструктуры в США организовала так, что сама тратит минимальные суммы денег и ни за что толком не отвечает перед инвесторами, а последние свои и заёмные средства вкладывают в размере сотен миллиардов долларов. SoftBank собирается для данных целей заимствовать до $40 млрд, как сообщает Bloomberg.

Источник изображения: SoftBank Промежуточный заём сроком на 12 месяцев понадобился SoftBank преимущественно для инвестиций в капитал OpenAI, он станет крупнейшим для японской корпорации, номинированным исключительно в долларах США. Подписчиками по кредиту выступят четыре банка, включая JPMorgan Chase. Переговоры с ними ещё ведутся, так что условия предоставления займа могут измениться. Основатель SoftBank Масаёси Сон (Masayoshi Son) характеризуется определённым инвестиционным азартом, который регулярно вынуждает его концентрировать инвестиции на конкретных направлениях деятельности, OpenAI становится новым «центром притяжения средств». По состоянию на конец декабря SoftBank владела примерно 11 % акций OpenAI, вложив на тот момент около $30 млрд в этот американский стартап. Теперь речь идёт о направлении в капитал OpenAI сопоставимой суммы, но уже с использованием преимущественно заёмных средств. Вложения в OpenAI теперь сравнимы с инвестициями SoftBank в капитал Arm — британского разработчика процессорных архитектур, 90 % акций которого владеет японская корпорация. Она продала все свои акции Nvidia и T-Mobile, чтобы вложиться в OpenAI. Аналитики начали снижать кредитный рейтинг SoftBank, глядя на увлечённое финансирование этой компанией стартапа OpenAI. С 2025 года SoftBank в общей сложности направила в сферу искусственного интеллекта более $70 млрд, одновременно увеличив собственную долговую нагрузку. От продажи принадлежащих ей акций других компаний, не считая Arm, японская корпорация может выручить более $10 млрд, но с учётом необходимости собрать $40 млрд в этом году, значительную часть последней суммы ей придётся брать в долг. Связанные с SoftBank структуры типа той же Arm начали привлекать больше кредитов, как отмечают источники. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |