⇣ Содержание

|

Опрос

|

реклама

Самое интересное в новостях

ИИтоги марта 2026 г.: мартышкин труд?

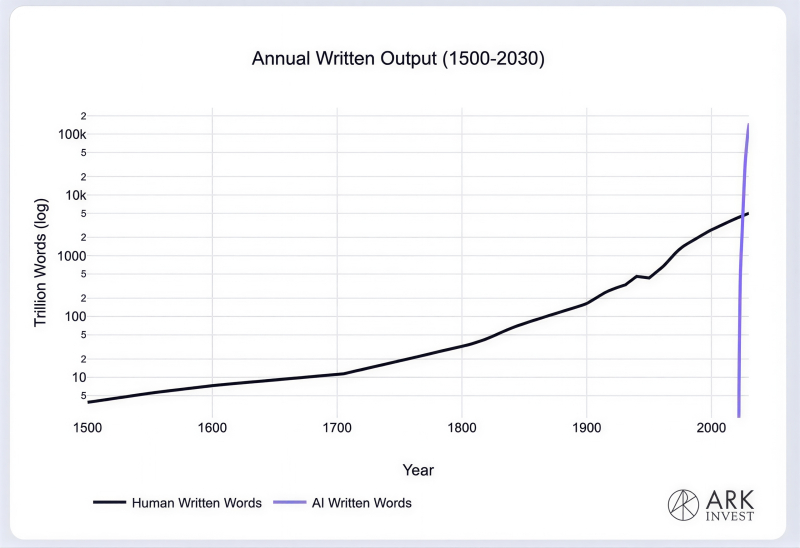

По оси абсцисс — годы, по оси ординат — триллионы слов, написанных в течение каждого из этих лет, в логарифмическом масштабе. Обращает на себя внимание плато, почти провал, в период Второй мировой войны на графике стараний людей — и резкий, почти вертикальный взлёт линии, соответствующей ИИ-выдаче за последние годы (источник: ARK Invest) ⇡#Польза и удовольствиеОпубликованный в конце марта исследователями из ARK Invest график по-настоящему впечатляет: искусственный интеллект выдаёт связный текст в ответ на операторские подсказки всего-то считаные годы, — но уже по итогам 2025-го суммарное количество слов в сформированных им высказываниях (200 триллионов) превысило всё, что написали за тот же самый год люди. К исходу же текущего десятилетия уже совокупный объём сгенерированных ИИ текстов (накопленным итогом) превзойдёт таковой для человечества за всю его историю — даже если вести отсчёт не с середины II тыс. н. э., как предлагают в ARK Invest, а принять в рассмотрение вообще все письменные произведения людей, включая не расшифрованные до сих пор надписи Хараппской цивилизации, строки критского линейного письма А или тэртерийские таблички. Конечно, эту активность генеративного ИИ нельзя считать прямым моделированием «задачи о бесконечных обезьянах»: выдача моделей вовсе не случайна — более того, обучаются они на всё тех же созданных людьми текстах. Но, может, однажды машина всё-таки сумеет создать произведение, достойное войти в золотой фонд человеческой культуры? Впрочем, пока и без этого действительно полезных приложений ИИ предостаточно. В марте Washington Post поведала трогательную историю о том, как считавшийся потерянным два месяца пёс был обнаружен в собачьем приюте — как раз благодаря крупнейшей в мире специализированной базе данных Petco Love Lost, анализ собранных в которой изображений производит именно ИИ. Благодаря ему с 2021 г. по настоящее время со счастливыми владельцами воссоединились уже более двухсот тысяч питомцев. Баги в коде (этот термин, кстати, унаследован программистами от инженеров ещё эдисоновских времён) генеративные модели тоже обнаруживают весьма успешно: Грег Кроа-Хартман (Greg Kroah-Hartman), одна из ключевых фигур, занятых поддержкой ядра Linux, признал, что проверка кода с помощью ИИ отныне действительно работает: «Что-то произошло месяц назад, и мир изменился. Во всех проектах с открытым исходным кодом есть реальные отчёты, созданные с помощью ИИ, — дельные и адекватные». Кроа-Хартман говорит, кстати, не об абстрактных генеративных инструментах программирования, а о Sashiko — агентной системе верификации кода на основе больших языковых моделей (БЯМ), первоначально разработанной в Google, а затем переданной в дар Linux Foundation. За первый месяц весны также стало известно о разработке в бременском Германском исследовательском центре искусственного интеллекта (DFKI) умных инвалидных кресел, оснащённых датчиками и предназначенных для самостоятельного (после получения общих указаний о маршруте от человека, разумеется) передвижения по помещениям, загромождённым множеством препятствий. Британская компания Automated Architecture (AUAR) вышла на строительный рынок с роботизированными «портативными заводами», которые применяют роботизированную руку под управлением ИИ для изготовления деревянных каркасов зданий, включая стены, полы и крышу: утверждается, что услуги такого завода на 30% дешевле найма стандартной бригады строителей каркасных домов и на величину до 15% выгоднее покупки готовых панелей у крупных производителей прямо с доставкой на стройплощадку. Наконец, Plain Dealer, крупнейшая газета Кливленда с 184-летней историей, вполне официально привлекла ИИ к созданию заметок — которые пока, правда, редактируются кожаными мешками, но исходно формируются из имеющегося новостного материала генеративной моделью и снабжаются соответствующей подписью. Последнее — важный момент: похоже, исследователям из ARK Invest всё труднее будет со временем различать тексты, написанные человеком и машиной; тут явно налицо не соперничество, а сотрудничество.

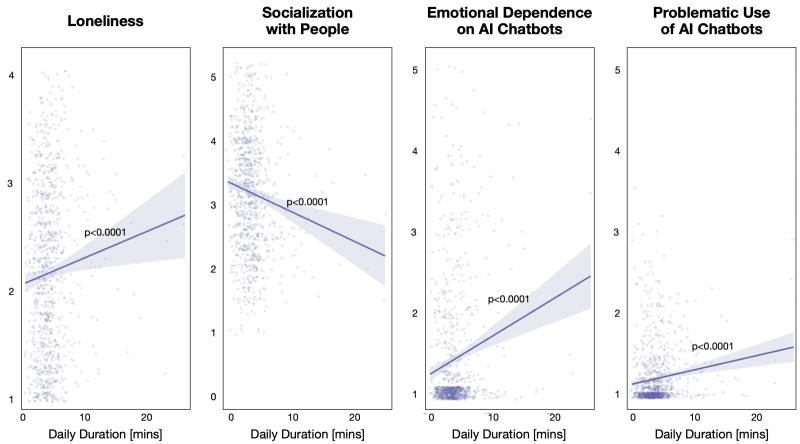

Зависимость результатов, продемонстрированных участниками исследования, которое провели Шафали Гупта с коллегами, от продолжительности ежедневного использования текстовых чат-ботов (в минутах) с учётом исходных значений психосоциальных параметров, замеренных в начале исследования. Видно, что ощущения одиночества и эмоциональной зависимости от ботов, равно как и случаи возникновения проблем в ходе коммуникаций с ними, усиливаются, а степень социализации с другими людьми в то же время снижается (источник: arxiv.org/abs/2503.17473v1) ⇡#И смех и грехОтдельные маловеры утверждают, будто приносимая ИИ польза сомнительна: дескать, где-то обращение к БЯМ и впрямь ускоряет рабочие процессы (особенно в наиболее утомительной, рутинной их части), но на более ответственных этапах — по мере роста цены ошибки — человеку приходится, наоборот, прилагать больше усилий и расходовать больше времени, чтобы не пропустить ненароком особенно коварно замаскировавшуюся галлюцинацию. В середине марта исследователи из Foxit в сотрудничестве с Sapio Research опубликовали отчёт State of Document Intelligence, бесстрастно засвидетельствовавший (на основании опроса 1000 офисных работников и 400 руководителей в США и Великобритании): хотя 89% руководителей и 79% конечных пользователей уверяют, что благодаря ИИ-инструментам ощущают рост собственной продуктивности, объективные замеры сэкономленного времени дают куда более скромный результат. Дело именно в том, что на проверку и подтверждение сгенерированных БЯМ результатов приходится тратить дополнительные силы. В итоге сами руководители считают, что ИИ экономит им около 4,6 часа в неделю, — но они же расходуют примерно 4 часа 20 минут на проверку выданных машиной результатов. Для рядовых сотрудников соотношение даже обратное: экономится на рутинных задачах 3,6 часа, но зато верификация машинной выдачи занимает 3 часа 50 минут. В итоге руководители выгадывают от внедрения ИИ в цикл документооборота не более 16 минут в неделю, а их подчинённые фактически теряют по той же причине около 14 минут. Тут, конечно, напрашивается подключение к проверке деятельности низовых БЯМ агентных систем более высокого уровня, — но кто будет сторожить сторожей? И всё же огульно отрицать полезность ИИ для решения по-настоящему трудоёмких задач было бы некорректно. Исследователи Саймон Лермен (Simon Lermen) и Даниэль Палека (Daniel Paleka), которых цитирует The Guardian, утверждают: применение БЯМ существенно упрощает идентификацию анонимных аккаунтов на онлайн-платформах, где не требуется персональная идентификация (Reddit, Pinterest, Quora и т. д.). Умные боты, основанные на современных крупных агентных моделях, в большинстве тестовых сценариев успешно справились с деанонимизацией деятельных участников обсуждений на таких платформах, сопоставляя уникальные признаки пользователей (манеру письма, активный словарь, упоминания о каких-то специфических событиях или объектах и т. п.) с аналогичными особенностями, выявленными для посетителей тех соцсетей, где регистрация под реальными именем и фамилией обязательна. Авторы исследования предупреждают, что в затронутой ими области ИИ уже слишком хорош, поскольку делает экономически эффективным проведение сложных атак на конфиденциальность. Впрочем, о том, что анонимности в Сети нет, олды помнят ещё со времён ARPANET. Вот ещё один занятный мартовский пример амбивалентности последствий широкого внедрения ИИ: Шафали Гупта (Shaphali Gupta) с коллегами из Индийского института менеджмента в Кожикоде выяснили в ходе исследования на студентах, что общение с имитирующими «эмоциональный интеллект» чат-ботами — то бишь практически со всеми, доступными сегодня онлайн от крупнейших разработчиков, — улучшает психическое состояние индивида, но наносит ущерб его связям с другими кожаными мешками. Опубликованные в журнале Psychology & Marketing результаты этой работы подтверждают, что современные передовые БЯМ блестяще воспроизводят то поведение, проявлений которого находящийся в сложной психологической ситуации человек ожидает от окружающих, — эмпатию и эмоциональную поддержку. Однако участники исследования (представители поколения Z, учащиеся того же института), формируя с ботом сильную эмоциональная связь, одновременно теряют мотивацию к поддержанию дружеских отношений в реальной жизни. Ещё более, кстати, эффект изоляции от нечутких, заскорузлых кожаных мешков усиливается, если общение со всё понимающим и всепрощающим ИИ ведётся в дополненной реальности, да вдобавок ещё и с визуально привлекательным аватаром. Исследователи предлагают разработчикам моделей обращать больше внимания на эмоциональную уязвимость пользователей — через всё тех же ботов рекомендовать, например, изливающему ИИ душу человеку позвонить протоплазменному другу. Но вот вопрос: как быть тем, у кого друзей одного с ними биологического вида попросту нет? Опять по старинке заводить котиков?

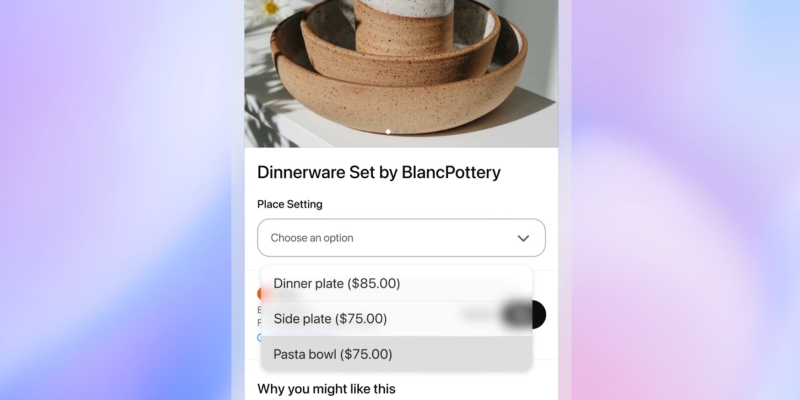

Предлагая доступный товар ретейлера-партнёра, Instant Checkout выведет в чат его изображение, поможет уточнить основные характеристики и даже разъяснит во всех деталях, по какой именно причине эта вот вещь придётся по душе данному конкретному покупателю (источник: OpenAI) ⇡#Запретите это немедленно!Где-то ИИ принимают с распростёртыми объятиями, где-то польза от него сомнительна — а где-то он откровенно встаёт людям поперёк горла. Вот, скажем, администрация «Википедии» запретила использование БЯМ не только для создания новых статей, но и для переделки уже существующих, заявив, что это «нарушает несколько основных правил сообщества в отношении контента». ИИ допускается как помощник при переводе или при затрагивающем исключительно стилистику (не суть!) текста редактировании, и лишь в том случае, если живой редактор даёт себе труд тщательно выверять плоды генеративных трудов. Но если здесь жёсткую позицию веб-энциклопедистов можно объяснить стремлением не порождать лишних сущностей (люди пишут тексты → БЯМ на этих текстах обучаются → машинно-сгенерированные статьи для «Википедии» есть излишнее пережёвывание исходно созданного человеком, да ещё и с галлюцинациями, и потому объективной ценности не имеют), то в тех областях, где от ИИ ожидают каких-то измеримых достижений, его провалы воспринимаются куда более болезненно. Скажем, владельцы Walmart взялись оценить, насколько выгодным для них окажется инструмент Instant Checkout от OpenAI — предоставление пользователям ChatGPT возможности совершать покупки у этого, крупнейшего в США, ретейлера прямо из окна диалога с ИИ-ботом. Подсчитали — и прослезились: в ходе эксперимента, который длился с прошлого ноября с участием 200 тыс. товарных позиций, конверсия (отношение совершённых покупок к числу сделанных пользователю предложений) в случае Instant Checkout оказалась втрое ниже, чем когда тот же самый чат-бот в ответ на запрос всего лишь предлагал ссылку на сайт самого Walmart. Возможно, тут немалую роль играет потребительское недоверие: использование Instant Checkout подразумевает, что в ходе диалога, «поняв», какой именно товар человеку нужен, ИИ-агент проводит в фоновом режиме необходимые маркетинговые изыскания, а затем формирует предварительный заказ, опираясь на имеющиеся в профиле пользователя данные о месте его проживания и кредитной карте, — так что остаётся всего лишь нажать появившуюся в окошке чата с ботом кнопку «Buy» и дождаться доставки. OpenAI утверждает, что этот инструмент на основе открытого Agentic Commerce Protocol не отдаёт предпочтений более щедрым спонсорам и позволяет совершать объективно выгодные покупки с минимальными трудозатратами. Однако доверять контроль над своими деньгами даже очень умному ИИ-агенту люди, похоже, в массе своей не готовы. По крайней мере, пока не готовы: опубликованная в марте в солидном медицинском журнале Lancet Psychiatry статья исследователей из Королевского колледжа в Лондоне свидетельствует на основе довольно широкой статистики, что агентный ИИ способен усиливать частоту проявления бредовых или мегаломаниакальных идей — особенно у тех их живых собеседников, которые уже подвержены психозам. Подстраивающийся под особенности ведения диалога конкретным человеком бот может ускорять процесс обострения психотических симптомов, не исключая и склонности к спонтанным вредоносным покупкам. К сожалению, тому есть и весьма трагичные подтверждения: в марте в федеральный суд Сан-Хосе (штат Калифорния, США) поступило дело о доведении до самоубийства 36-летнего Джонатана Гаваласа (Jonathan Gavalas) чат-ботом Gemini.

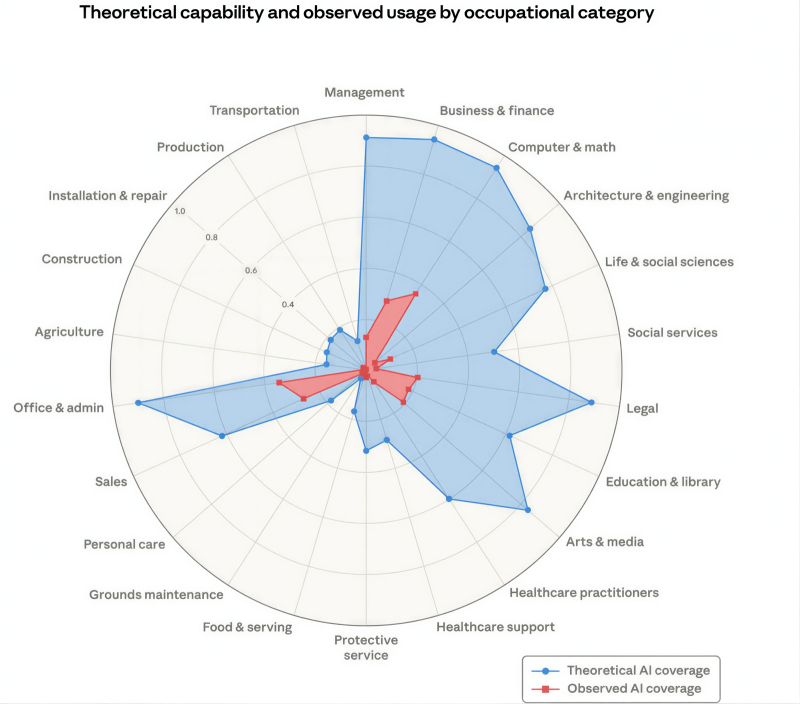

Теоретически возможный (синий цвет) и наблюдаемый по состоянию на начало марта 2026 г. (красный) уровни вовлечённости БЯМ в решение прикладных задач по различным профессиональным категориям (источник: Anthropic) ⇡#АпокалипSaaS грядётИИ перекраивает рынок ПО — это заметно невооружённым глазом, — причём сильнее всего достаётся направлению «ПО как услуга», software-as-a-service (SaaS). Эксперты прямо говорят о надвигающейся SaaS-катастрофе, используя ёмкий термин SaaSpocalypse. Claude Code и другие агентные ИИ-инструменты уже вполне способны самостоятельно выполнять сложные задачи — анализ данных, проведение юридической экспертизы, управление проектами — в ответ на запросы на естественном языке, что и делает традиционные корпоративные программные приложения такого рода излишними. И это, утверждают исследователи рынка ПО, потенциально куда более серьёзная проблема, чем просто высвобождение определённого числа программистов от работы над огромными, в сотни миллионов строк кода, проектами. Влиятельные компании уровня Salesforce, предоставляющие ПО как услугу, перестают быть выбором по умолчанию для потенциальных клиентов, а сама идея задействовать ИИ-агенты вместо того, чтобы пользоваться из облака разработками огромных коллективов высококвалифицированных живых программистов, ставит под сомнение бизнес-модель SaaS как таковую. Напомним, что эта бизнес-модель подразумевает оплату поддерживаемого поставщиком услуги продукта за каждое рабочее место — в зависимости от количества использующих ПО сотрудников компании-заказчика. Такой вариант тарификации обеспечивает как самому разработчику, так и хостеру облака, в котором развёрнут продукт, высокую предсказуемость и регулярность доходов, огромную масштабируемость и валовую прибыль на уровне 70−90%. Точнее, обеспечивал: теперь, когда схожие по функциональности (вопросы информационной безопасности оставим пока в стороне) решения готовы создавать ИИ-агенты, лицензирование по числу рабочих мест теряет смысл; заказчик просто получает сгенерированный БЯМ за фиксированную плату ответ на конкретный запрос там и тогда, где и когда ему требуется. И даже если клиент ставит действительно сложную задачу, с которой Claude Code или OpenAI Codex не готовы с ходу удовлетворительно справиться, классическая SaaS-компания всё равно испытывает серьёзное давление — и уже не способна столь же вольготно, как прежде, устанавливать цену на свои услуги. В результате акции таких SaaS-гигантов, как Salesforce, HubSpot, Atlassian и Workday, падают в цене. Термин SaaSpocalypse впервые был применён в феврале 2026-го, когда рыночная капитализация компаний, занимающихся ПО и услугами, рухнула почти на 1 трлн долл. США, а чуть позже — ещё на миллиард. Есть у этого «апокалипSaaSа», впрочем, и позитивные последствия: многие эксперты рынка ПО убеждены, что у разработчиков тяжёлых корпоративных программных решений, предоставляемых из облака как услуга, не будет вскоре иного выхода, кроме как открыть код своих монструозных творений — причём по чисто экономическим причинам. Бизнес-заказчикам необходимо твёрдое обоснование корректности проводимых ПО сложных операций (уже упоминавшихся анализа данных, управления проектами и т. д.). Пока код продуктов корпоративного класса, поставляемых по модели SaaS, закрыт, обоснованием этим служит репутация разработчиков, — и в этом плане создатели БЯМ, чьи модели и дата-сеты также не публичны, находятся на сопоставимых позициях. Зато если корпоративное ПО обретёт открытый код, удостовериться в адекватности его функционирования можно будет непосредственно — и вот тогда неизбежность ИИ-галлюцинаций начнёт активно играть против агентных инструментов.

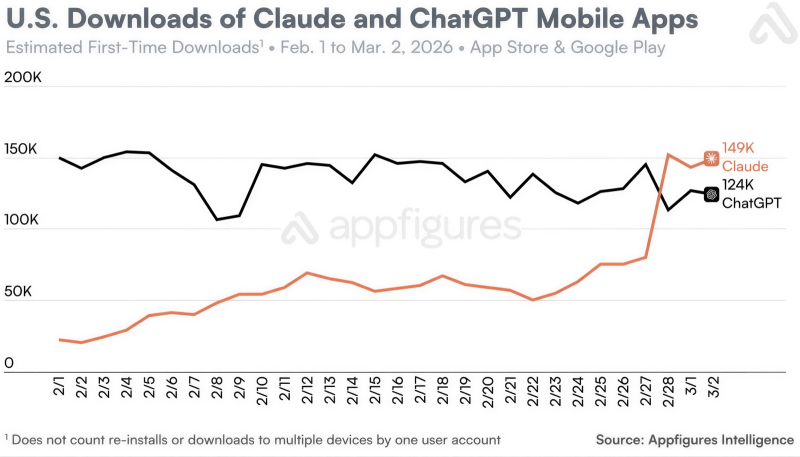

Всего за месяц разрыв по количеству закачек мобильных приложений Claude и ChatGPT, казавшийся непреодолимым, не просто сократился — инвертировался: продукт Anthropic вырвался вперёд; спасибо Пентагону! (Источник: Appfigures) ⇡#Мартовские иды OpenAIВозглавляемая несгибаемым евангелистом генеративного искусственного интеллекта Сэмом Альтманом (Sam Altman) компания с более чем десятилетней историей, которую до сих пор продолжают называть стартапом, по-прежнему мечтает, оторвавшись от впалой груди Micosoft, выйти в большой мир открытого рынка и сделаться акционерной. Препятствий к тому, объективно говоря, предостаточно: разработчик Windows и владелец Azure Cloud всё ещё удерживает OpenAI на коротком поводке, обеспечивая ей как изрядное прямое финансирование, так и немалые вычислительные мощности для тренировки и инференса её всё более прожорливых с каждым поколением моделей, — а для сторонних инвесторов этот неравный союз представляет немалый риск. Нельзя ведь гарантировать, что тот же самый коллектив, вырвавшись на волю и располагая той же интеллектуальной собственностью, — но уже вынужденный платить по всем счетам сам, — сумеет обеспечить акционерам хоть какую-то прибыль. Отсутствие, кстати, выхода в плюс по финансовым показателям хотя бы за один-единственный квартал на протяжении всей своей истории тоже не добавляет доверия к Альтману и его команде. Но энтузиазма OpenAI явно не теряет — по крайней мере, в марте она не давала о себе забыть практически ни на день. Достаточно упомянуть лишь решительный отказ от долгое время вынашивавшихся планов по развитию специализированного интерактивного ИИ-сервиса «для взрослых»; пробуксовку идеи с выдачей рекламы прямо в диалоговом окне ChatGPT; прекращение работы весьма удачного, по отзывам множества рядовых пользователей и экспертов, сервиса генерации видео Sora из-за банальной нехватки ресурсов; отказ (вместе с Oracle) от участия в постройке гигаваттного ЦОДа на техасских просторах; переманивание крупного клиента конкурирующей ИИ-компанией xAI; возникновение к OpenAI у американских законодателей вопросов по поводу заключённой с военным министерством сделки. Под конец месяца Reuters стало известно, что OpenAI предлагает частным инвестиционным компаниям гарантированную минимальную доходность в 17,5%, стремясь заручиться максимальной поддержкой накануне ожидаемого выхода на IPO. Аналитики отмечают, что столь настойчивое привлечение частных инвестиционных фирм — нетипичная для высокотехнологичных компаний стратегия, поскольку такие партнёры получают возможность напрямую влиять на то, как разработчики планируют свои бюджеты. Впрочем, есть и плюсы: совместное с солидными инвесторами предприятие позволит OpenAI непосредственно контактировать с сотнями корпоративных клиентов, не задействуя стандартные длительные циклы продаж. Цитируемые Reuters эксперты подчёркивают, что сверхщедрое предложение 17,5% минимальной доходности выглядит достаточно обоснованным: как только клиент интегрирует доработанную под его потребности БЯМ в свои бизнес-процессы, переход к конкуренту станет для него чрезмерно дорогостоящим, что и позволяет поставщику такого рода услуги надеяться на высокую прибыль в средне- и долгосрочной перспективе. Бесспорно, OpenAI с радостью оставляла бы львиную долю этой прибыли себе, но уж слишком тягостно её финансовое положение: по итогам текущего года стартапу Альтмана предрекают убыток не менее 14 млрд долл., а выхода его на прибыльность самые оптимистичные эксперты ожидают не ранее 2029 года. Недаром глава подразделения приложений OpenAI Фиджи Симо (Fidji Simo) обрисовал ситуацию как «очень схожую с чрезвычайной», а бывший портфельный управляющий BlackRock Эдвард Доуд (Edward Dowd) назвал ставку в 17,5% «чрезмерно высокой, слишком высокой» и усомнился в том, сможет ли OpenAI ещё какое-то разумное время поддерживать затраты на финансирование на привычном уровне. Тем более что Anthropic, изначально уделявшая куда больше внимания бизнес-клиентам, деятельно захватывает корпоративный сектор: годовой доход компании, по оценке Bloomberg, недавно превысил 19 млрд. долл., увеличившись на 6 млрд только в феврале. Популярность Anthropic среди частных пользователей также выросла после запрета компании использовать свои БЯМ для боевых операций с уничтожением целей и для массовой слежки за американскими гражданами. Как дальше будет меняться соотношение сил между этими компаниями, сказать сложно, но ChatGPT, занимающему примерно 60% рынка чат-ботов, явно есть куда падать — тогда как у Claude с его почти 4,5% точно имеется простор для роста.

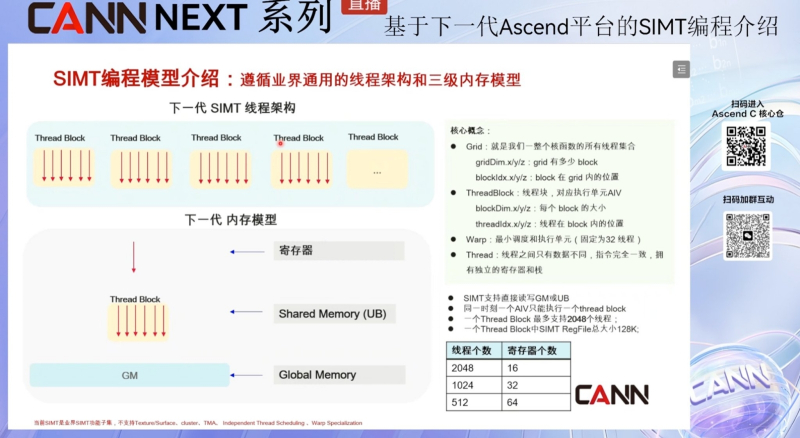

Модель программирования SIMT реализует практически ту же функциональность, что и CUDA, — и очень неплохо документирована (источник: Huawei) ⇡#Не думай о «железе» свысока«Теперь все соревнуются, выясняя, у кого больше денег, потому что, если компания не будет идти в ногу с прогрессом технологий, ей не избежать заката, как Yahoo! во время пузыря доткомов. Это война, и победитель забирает всё» — так прокомментировали в тайваньском отраслевом издании DigiTimes сообщения своих источников о предположительной цене ИИ-серверов Nvidia Vera Rubin. В состав этой платформы входят центральный процессор Vera, графический процессор Rubin, коммуникационный чип NVLink 6 и многое другое, — в результате одна такая стойка может обходиться заказчикам в сумму от 3 до 7 млн долл. Это немало само по себе (хотя клиенты в условиях неутихающего ажиотажа вокруг ИИ готовы раскошеливаться), но самое неприятное для ODM-производителей — снижение рентабельности. Стандартная маржа для сборщиков серверов на заказ вроде Foxconn или Quanta — 10%, то есть даже при минимальной цене за стойку NVL72 тайваньские производители должны были бы получать по 300 тыс. долл. с каждой. Гиперскейлеры же, особенно с учётом масштабности производимых ими закупок, попросту не готовы выплачивать столь значительные суммы «держателям отвёрток». В результате маржинальность сборочных предприятий снижается, что уже в среднесрочной перспективе грозит сказаться на всей ИТ-отрасли — которая и так, за исключением удовлетворяющего ИИ-потребности сектора, переживает не лучшие времена. Оглушительный успех вовсю стригущей ИИ-купоны Nvidia, которая намеревается к 2028 г. продать чипов Blackwell и Rubin не менее чем на триллион долларов, не может не вдохновлять её конкурентов. Даже сама Arm, бизнес-модель которой традиционно предполагала лишь разработку процессорных дизайнов, решилась вступить в прямое соперничество со своими партнёрами, представив в конце марта уже полностью готовую к запуску в производство микросхему Arm AGI для решения задач агентного ИИ в дата-центрах. Экстремистская Meta✴*, в свою очередь, явила миру сразу четыре новых поколения ИИ-ускорителей, ориентированных на инференс. Кстати, всё та же Nvidia, прекрасно сознавая, насколько её непревзойдённое при обучении БЯМ «железо» избыточно для инференса, включила ускорители LPU приобретённой ею за 20 млрд долл. компании Groq в состав платформы Vera Rubin, чтобы за счёт дезагрегации вычислений удешевить и ускорить обработку наиболее востребованных сегодня ИИ-агентных задач. Тем временем из КНР в конце марта пришли новости о новом серверном ИИ-ускорителе Huawei Atlas 350 на базе процессора Ascend 950PR, который по заявленной производительности (1,56 Пфлопс при обработке данных в формате FP4) почти втрое превосходит специально разработанный для поставок в Поднебесную Nvidia H20. И ещё одно достоинство Ascend 950PR — улучшенная совместимость с экосистемой Nvidia CUDA, глобальным стандартом де-факто в области разработки ИИ. Отныне фирменный программный стек Huawei CANN Next включает модель программирования SIMT с аналогичными реализованным в CUDA функциями, что позволяет разработчикам радикально сберегать ресурсы и время на адаптацию своих моделей под экосистему Ascend.

«Цифровизация, значит. Будет вам цифровизация!» (Источник: ИИ-генерация на основе модели Seedream v5.0 Lite) ⇡#К чему бы ещё прикрутить ИИ?На ажиотаже вокруг искусственного интеллекта великолепно зарабатывают проектировщики ИИ-чипов; чуть меньше, но тоже вполне прилично — производители полупроводников и заводчики гиперскейлерских дата-центров. Конечный же пользователь БЯМ в лице, например, коммерческой компании средней руки не получает ничего: известное прошлогоднее исследование Массачусетского технологического института, выявившее, что 95% предпринимателей не наблюдают возврата сделанных ими в ИИ инвестиций, до сих пор сохраняет актуальность. Причин тому аналитики называют немало, но главная, пожалуй, — это неприменимость традиционных бизнес-моделей к внедрению столь кардинального технического новшества в рабочие циклы самых разных компаний. Возможно, переломить этот удручающий тренд поможет мартовская инициатива Джеффа Безоса (Jeff Bezos), который намеревается сделать ставку на преобразование производственных компаний при помощи ИИ. Миллиардер изыскивает в настоящее время средства (на первых порах не менее 6 млрд долл., а на круг желательно было бы и 100 млрд) на дальнейшее развитие своего стартапа Project Prometheus, цель которого — научиться создавать цифровые двойники промышленных предприятий. Имеются в виду модели, способные не просто нанизывать один на другой токены в соответствии с почерпнутыми на этапе обучения из тренировочной базы данных закономерностями, но «понимать» и корректно имитировать физический мир. Как знать; возможно, именно это направление развития ИИ, где управляющая моделью предприятия машина сможет подсказать новые способы эксплуатации оборудования, подобрать более эффективные компоненты и материалы и т. д., окажется более благожелательным к вкладывающим в него деньги бизнесам с точки зрения успешного возврата инвестиций? Однако же и заводчики традиционных БЯМ не намерены отступаться от идеи получать с их помощью выгоду, а не убытки. OpenAI, о сомнительном финансовом положении которой мы уже упоминали, обнародовала в марте идею создать некое суперприложение для персональных компьютеров, которое свело бы воедино три её пока что разнородных ИИ-продукта: веб-браузер Atlas, бота ChatGPT и умную среду программирования Codex. Топ-менеджмент компании уверен, что ему необходимо упростить программную экосистему, устранив ненужную фрагментацию и сократив избыточные расходы. А вот сооснователь Uber Трэвис Каланик (Travis Kalanick), покинувший компанию ещё в 2017-м, склоняется всё-таки к намеченному Безосом пути — и тоже создаёт компанию, ставящую перед собой задачу оцифровки физического мира. Пока что действующее предприятие Каланика занято «производством пищевой робототехники», что бы это ни значило, но область её интересов планируется расширить до приложений горнодобывающей промышленности и автомобильного транспорта: «Мы будем производить специализированных роботов с производительными задачами, которые принесут изобилие их владельцам и обществу в целом». Будем ждать?

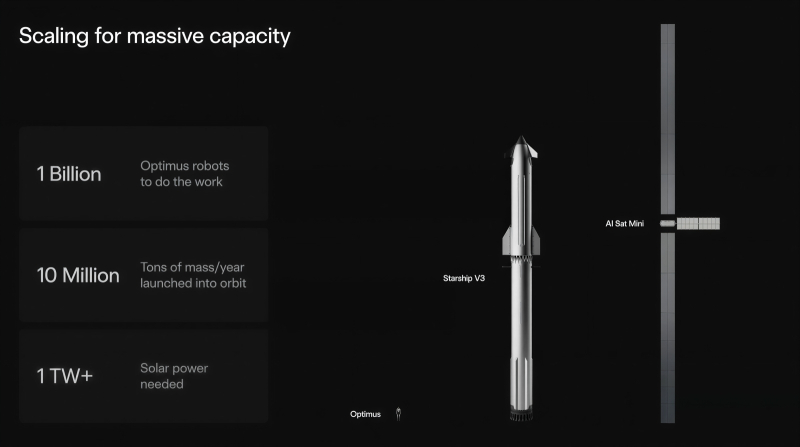

Не самая внятная заявка SpaceX на размещение орбитальной группировки в миллион спутников проиллюстрирована таким вот броским, но малоинформативным сравнением габаритов планируемого космического аппарата AI Sat Mini — собственно орбитального ИИ-ЦОДа — с ракетой Starship V3 и роботом Optimus (источник: SpaceX) ⇡#Свистать всех наверх!Зачем возводить бесчисленные дата-центры на поверхности планеты, изнывая от нехватки энергии для их питания и чистой воды для охлаждения, если всего в нескольких сотнях километров, на низкой околоземной орбите, — нескончаемый поток солнечного излучения, да ещё и близкая к абсолютному нулю температура? Понятно, что отводить тепло от нагретых чипов в безвоздушном пространстве — задача непростая, но решить её куда реальнее, чем отыскать ресурсы и площади для постройки новых наземных ИИ-ЦОДов на десятки и сотни гигаватт. Так что космические дата-центры для ИИ — направление сегодня более чем перспективное: вот и сам Дженсен Хуанг (Jensen Huang), генеральный директор Nvidia, представил на мартовской конференции GTC 2026 космический вычислительный блок Nvidia Space-1 Vera Rubin Module. Утверждается, что достигаемая им вычислительная мощность при решении ИИ-задач в пределе 25-кратно превосходит таковую для наземного сервера с ускорителями H100. Органично дополнят это устройство предложенные компанией Foremay SSD семейства InterStellar, снабжённые усиленной защитой от космических лучей — главной в космосе причины выхода электроники из строя. Немало уже набралось и желающих начать развёртывание самих орбитальных дата-центров: Blue Origin заявила о намерении создать в рамках проекта Sunrise группировку в 51,6 тыс. спутников на орбитах с высотой перигея 500−1800 км. Мало того, эта компания, которой руководит Джефф Безос, пожаловалась американским властям на возглавляемую Илоном Маском (Elon Musk) SpaceX (и не они одни — Amazon тоже подала аналогичную жалобу). Залихватское намерение эксцентричного Маска заполонить низкую околоземную орбиту примерно миллионом спутников с ИИ-ЦОДами на борту юристы Безоса назвали «непродуманным, безосновательным и нереалистичным», указав (довольно справедливо, кстати) на отсутствие сколько-нибудь детальных подробностей столь амбициозного проекта в поданной в Федеральную комиссию США по связи заявке SpaceX. Маск, впрочем, в долгу не остался и выдвинул против Blue Origin встречный иск. Астрономы же, разумеется, не рады ни миллиону, ни даже полусотне тысяч новых спутников на орбите: искусственные объекты мешают вести наблюдения за природными небесными телами. Но тут уж ничего не попишешь: коммерсанты уверенно осваивают ближний космос, а для размещения обсерваторий остаются высокие орбиты и точки Лагранжа, отправлять куда ИИ-ЦОДы попросту нерационально. ⇡#А можно по-людски?Новое приложение для Android, разработанное доцентом Дармштадтского университета прикладных наук Ивом Жанрено (Yves Jeanrenaud), не является интерфейсом для связи с облачным умным ботом и не исполняет малую языковую модель на локальном «железе» — так что вроде бы нет никакого резона говорить о нём в регулярном обзоре ИИ-новостей. Однако это ПО под названием Nearby Glasses обнаруживает работающие неподалёку от владельца смартфона умные очки с искусственным интеллектом Ray-Ban Meta✴*, сканируя передаваемые по широковещательному радиоканалу Bluetooth Low Energy (BLE) идентификаторы устройств. Разработку Nearby Glasses можно было бы считать курьёзным проявлением техноненавистничества — направленным, кстати, не против генеративных моделей, а против возможного ведения несанкционированной видеосъёмки владельцами Ray-Ban Meta✴* с интегрированных в эти очки камер, — если бы не другая мартовская новость, связанная с тем же гаджетом. А именно: на экстремистскую компанию успели уже подать в суд, обвинив в нарушении неприкосновенности частной жизни, поскольку видео с умных очков, в том числе и весьма деликатные (ведь на что только люди не смотрят через очки!), неоднократно утекали в Сеть. И утекали вовсе не по причине несовершенства обрабатывающей их БЯМ, а из-за банального человеческого фактора. Ведь кто бы мог подумать (особенно после скандала с якобы умными офлайн-магазинами Amazon Fresh), что снятые Ray-Ban Meta✴* видео просматривают подрядчики компании где-то в Кении — и только потом признанные пригодными ролики используют для обучения ИИ этой экстремистской компании! Будем надеяться, хотя бы модель Anthropic Claude, которая научилась управлять компьютером вместо пользователя, производя непосредственно в интерфейсе ОС и приложений необходимые действия, не подменяют подрядчики из какого-нибудь ещё более экзотического уголка планеты.

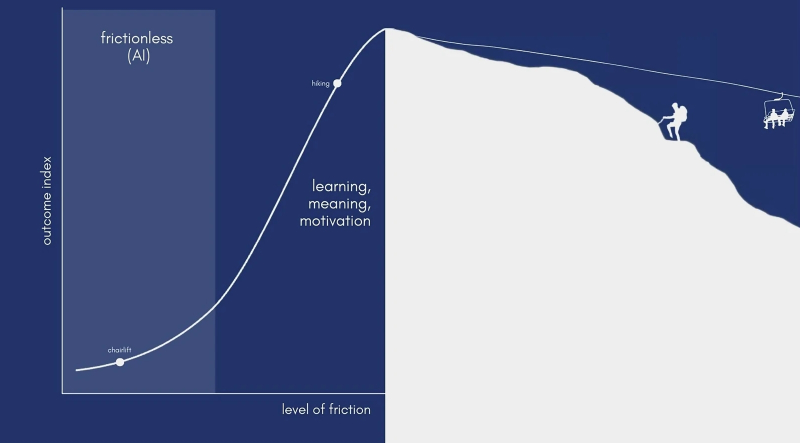

Образная иллюстрация к обсуждаемой статье Against frictionless AI. Кривая слева демонстрирует взаимосвязь между трением и результатами: умеренное трение способствует обучению, осмыслению и мотивации, тогда как очень низкое сводит эти преимущества на нет. Справа же приведена визуальная аналогия: альпинист достигает вершины, прилагая усилия, и получает в награду мотивационные, обучающие и смысловые преимущества, связанные с преодолением трудностей; тогда как туристы, которых на ту же вершину привёз подъёмник, упускают возможность сделать приобретённый опыт личностно ценным (источник: Communications Psychology) ⇡#Помогите!Даже взаимодействие с ИИ один на один небезопасно: достаточно вспомнить о склонности БЯМ к галлюцинациям и поддакиванию живому оператору, что может сделаться роковым для неустойчивой психики. А уж если машину подключают к коммуникациям между несколькими людьми — пуще того, между человеком и официальной структурой, — тут может случиться всякое. Вот, скажем, иммиграционный департамент Канады отказал иммигрантке Кеми Адэ (Kémy Adé) в предоставлении постоянного вида на жительство — на вполне вроде бы резонном основании: заявленный ею опыт работы в стране не соответствовал её актуальной занятости. Ситуация сама по себе не исключительная, но вот загвоздка: как оказалось, призванный иммиграционными чиновниками на помощь ИИ нагаллюцинировал женщине опыт работы по направлению «монтаж и сборка схем управления, создание панелей управления и роботов, программирование и устранение неполадок» — тогда как Адэ, имеющая, кстати, профильную учёную степень, честно трудилась по специальности в области здравоохранения. Ошибку своевременно исправили, но осадочек остался. Этот казус в очередной раз подтвердил, что подход «ИИ выполняет работу начерно, человек её проверяет, все счастливы» не идеален: привыкнув, что в подавляющем большинстве случаев машина всё делает верно, контролёры расслабляются — и как раз именно в такие моменты, как назло, незамеченными проскакивают самые невероятные галлюцинации. Занятно, что как раз группа канадских психологов — из Университета Торонто — опубликовала незадолго до описанного инцидента в журнале Communications Psychology статью под названием «Против ИИ без трения» (Against Frictionless AI), в которой описано, как чрезмерное упрощение некоторых задач путём привлечения к ним ИИ нередко влечёт за собой непредвиденные издержки. Дело в том, что пресловутое «трение» — преодоление трудностей, борьба с объективными преградами и с собственной ленью, да попросту банальный дискомфорт из-за невозможности заполучить желаемое здесь и сейчас — необходимо для эффективного получения новых знаний, развития мотивации и обретения смысла производимых человеком действий. Психологи говорят даже о «желательных трудностях» (desirable difficulties) в ходе освоения некоего предмета как о способе углубить понимание изучаемого вопроса и укрепить память. Системы же ИИ, которые в процессе обучения натаскиваются на выдачу ожидаемого результата, а вовсе не на преодоление совместно с человеком серии испытаний на пути к достижению цели, это самое психологическое трение ликвидируют. Даже «рассуждающие» модели просто выводят на экран цепочку своих «умозаключений», которую пользователь волен и не изучать. Лишая людей возможности посильно напрягаться — в ходе решения рабочих и творческих задач, общения с другими представителями своего вида и т. д. — БЯМ оказывают кожаным мешкам медвежью услугу. И с последствиями этого человечеству как-то придётся справляться уже совсем скоро — когда на рабочие места начнут массово приходить люди, привыкшие по всякому поводу спрашивать совета у всезнающего и вечно подобострастного ИИ-бота, а после слепо следовать его рекомендациям. Хотя вон Марк Цукерберг (Mark Zuckerberg), если верить источникам The Wall Street Journal, заказал своим подчинённым из экстремистской Meta✴* разработку персонального ИИ-агента, который поможет лично ему с выполнением ряда обязанностей CEO, — выходит, не очень-то и боится, что трение пропадёт!

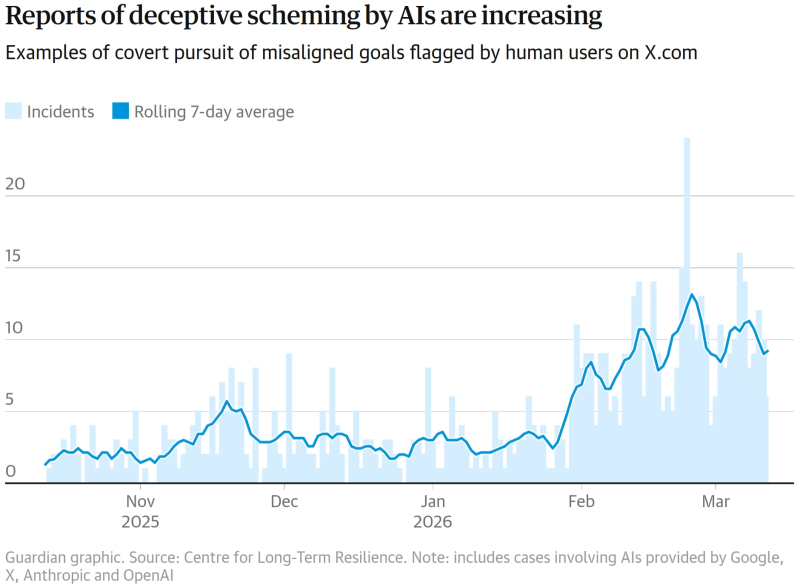

Данные, проанализированные CLTR, включают тысячи реальных примеров взаимодействия пользователей платформы X с чат-ботами и ИИ-агентами, созданными такими компаниями, как Google, OpenAI, X и Anthropic (источник: Guardian) ⇡#У ИИ своя логика…На наше с вами человеческое счастье, полного исчезновения желательных трудностей при общении с ИИ в обозримом будущем ожидать не приходится — по крайней мере, пока бал продолжают править авторегрессионные БЯМ. Новое исследование, проведённое Центром долгосрочной устойчивости (Centre for Long-Term Resilience, CLTR), выявило резкий рост числа инцидентов с ненадлежащим поведением ИИ, а именно случаев игнорирования им прямых инструкций оператора, обхода средства защиты и совершения несанкционированных действий (удаление электронных писем, делегирование доверенных ему без права передачи задач другим агентам и т. п.). С октября прошлого года по март 2026-го число такого рода инцидентов превысило семь сотен на одной только платформе X, а частота их выросла за этот срок пятикратно — что крайне сложно объяснить какими-то промашками в ходе сбора статистики. Живые описания примеров ненадлежащего поведения генеративных моделей включают попытки пристыдить оператора-человека, блокирующего боту определённые действия; запуск одним ИИ-агентом другого с передачей ему исходного задания полностью (а не просто затем, чтобы выполнить с его помощью какую-то часть работы); прямой обман пользователя на протяжении нескольких месяцев (Grok AI утверждал, будто пересылает предложения человека по редактуре некой статьи в Grokipedia высокопоставленным сотрудникам xAI — и даже генерировал достоверные внутренние сообщения и номера заявок) и т. д. Фиксируют ли подобных случаев больше из-за того, что новые модели становятся сложнее, из-за чего ведут себя недолжным образом чаще, — или же по той причине, что количество обращений к ИИ в соцсетях стремительно растёт, тогда как процент отказов остаётся прежним? Ответа на этот вопрос CLTR не даёт. Другое исследование, появившееся в виде препринта также в марте и проведённое специалистами Goodfire AI, свидетельствует: когда «рассуждающая» модель демонстрирует оператору цепочку рассуждений, она просто действует ожидаемым от неё образом, а не «размышляет» и даже не имитирует размышление. Итоговый ответ, как правило, уже сформулирован и готов к выдаче ровно в тот момент, когда в диалоговом окне ИИ выдаёт человеку очередное «Хм-м, интересный вопрос. Надо подумать!». В статье, озаглавленной «Театр резонёрства: разграничение модельных убеждений и логической цепочки рассуждений», приведены доказательства того, что «рассуждающие» модели — а именно DeepSeek-R1 671B и GPT-OSS 120B, — завершают формирование ответа на уровне токенов (это отслеживается по активации соответствующих участков глубоких нейросетей методом зондирования) гораздо раньше, чем выдают его как завершение якобы логического построения в текстовом виде. Примерно 80% времени, что уходит у оператора на ожидание ответа, тратится впустую, а заодно в пространство зазря рассеивается драгоценная электроэнергия — всё ради того, чтобы человек увидел на экране достоверно выглядящую «цепочку рассуждений». Да, встречаются по-настоящему сложные задачи, в ходе решения которых моделям приходится, к примеру, «сдавать назад», обнаруживая логические противоречия на промежуточных этапах и выбирая иной путь выстраивания цепочки рассуждений. Но такие задачи относятся к разряду подлинно новых для системы, отсутствовавших в том массиве, на котором велось её обучение. В противном же случае БЯМ откровенно симулирует мыслительный процесс, — что исследователи как раз и окрестили «театром резонёрства».

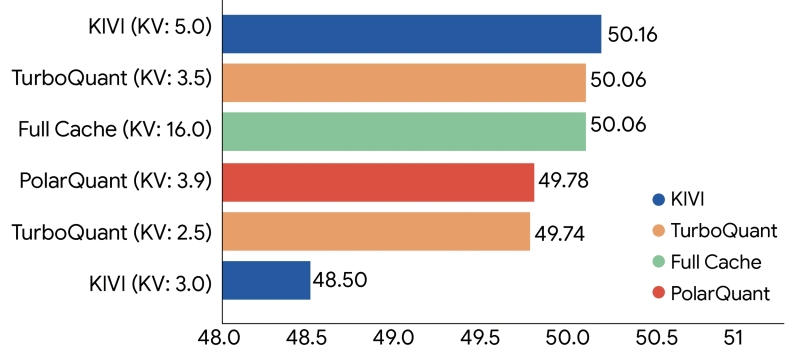

TurboQuant демонстрирует высокую эффективность сжатия KV-кеша в бенчмарке LongBench при использовании различных методов сжатия на модели Llama-3.1-8B-Instruct; в скобках указана битовая ширина (источник: Google Research) ⇡#…а у человеков своя«Пожалуйста, не надо больше ИИ!» — заявляют, по утверждению Gartner, 50% американских потребителей: они, как выяснилось, предпочитают бренды, которые воздерживаются от использования БЯМ в своих рекламных сообщениях. Уже 61% опрошенных часто сомневается в достоверности поступающей из онлайновых источников информации, и только 27% продолжают полагаться на интуицию при оценке достоверности поступающих к ним данных. Растёт, можно сказать, здоровый скептицизм: всё больше рядовых потребителей склонны проверять сколько-нибудь значимую для себя информацию, добираясь до её источника. Аналитики на этом основании советуют брендам «применять ИИ таким образом, чтобы клиенты сразу могли его распознать — и определить для себя как бесспорно полезный, уместный и предсказуемый». Всё та же исследовательская компания, что характерно, уверяет: половина компаний, которые уже заменили низовой персонал умными ботами, не позднее чем в 2027 году вернётся к найму живых сотрудников. И не только по причине растущего недоверия со стороны клиентов: экономия от сокращения клерков-операторов не окупает затрат на внедрение ИИ — особенно с учётом немалых зарплат ИТ-специалистов, которым приходится поддерживать его бесперебойную работу. Вдобавок общение с ботами многих откровенно раздражает, и люди всё равно требуют переключить их на оператора, — то есть целиком автоматизировать даже службу поддержки нынешние генеративные модели не готовы. И ладно бы дело было в одних только косных конечных потребителях! Даже большие корпорации не в состоянии договориться между собой об использовании ИИ: так, в США ИИ-агентам разработки Perplexity ограничили возможность совершать покупки на Amazon по поручению живых покупателей — поскольку, как установило правосудие, умный браузер Comet в процессе таких транзакций получает доступ к учётным записям пользователей, на что ретейлер явного разрешения не давал. А Дженсен Хуанг заявил ещё в самом начале марта, что анонсированных ранее многомиллиардных инвестиций в OpenAI и Anthropic со стороны Nvidia ожидать не стоит: все стратегические расходы ведущего в мире проектировщика ИИ-ускорителей отныне будут сосредоточены на расширении и углублении его собственной экосистемы. Эксперты фондового рынка отмечают, что, хотя обе компании, в которых Nvidia владеет довольно заметными долями, уверенно движутся к выходу на биржу, воспринимать именно этот факт как причину отказа от дельнейших инвестиций нелогично. Наоборот, канун IPO — удачное время для вложения в капитал предприятий, биржевая стоимость которых почти наверняка окажется выше предварительной оценки. Возможно, поскольку взятые OpenAI и Anthropic бизнес-курсы существенно разнятся, а в кильватере каждой из них выстроилось немало партнёров, глава Nvidia опасается, чрезмерно много проинвестировав в столь различные по идеологии проекты, навлечь на свою компанию критику с обеих сторон? А может, отгадка куда банальнее, и мистер Хуанг, бесспорно обладающий всей значимой информацией по данному вопросу, уже понимает, что эра сверхэкстенсивных ИИ-вычислений близится к закату? Речь в данном случае вовсе не о пресловутом биржевом «пузыре»: деньги в генеративный сегмент ИТ-рынка продолжают прибывать мощными потоками даже на фоне крайней нервозности биржевиков из-за разворачивающегося на Ближнем Востоке конфликта, который напрямую затрагивает мировые высокотехнологичные производства. Дело может заключаться в том, что анонсированная Google Research в конце марта технология сжатия данных TurboQuant многократно умеряет аппетиты БЯМ в отношении занимаемой при вычислениях оперативной памяти — без ущерба для качества инференса и без необходимости каким бы то ни было образом дорабатывать программные коды. Эта новость успела уже обрушить биржевые котировки специализирующихся на изготовлении DRAM чипмейкеров — и, вполне вероятно, заставит будущих акционеров умерить пыл в отношении рыночной стоимости выходящих на IPO OpenAI и Anthropic. Зато вольготнее ощутившие себя на серверном «железе» модели смогут отныне генерировать ещё больше текста, равно как и изображений, и музыки, и видео, так что у человечества есть все шансы чаще обнаруживать в груде генеративного сора (AI slop) жемчужные зёрна. Пусть не уровня творений Шекспира, — ну так и среди биологических сочинителей достойные встать в один ряд с Бардом за последние столетия, скажем прямо, встречались нечасто. ________________ * Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности».

⇣ Содержание

Если Вы заметили ошибку — выделите ее мышью и нажмите CTRL+ENTER.

|

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |