|

Опрос

|

реклама

Быстрый переход

Applied Materials намекнула, что спрос на оборудование для выпуска чипов будет умеренным

15.11.2024 [04:53],

Алексей Разин

Крупнейший в США поставщик оборудования для производства полупроводниковых чипов на этой неделе отчитался о результатах деятельности в прошлом квартале и дал прогноз на текущий, и именно эти заявления руководства Applied Materials насторожили инвесторов. Компания ожидает выручить $7,15 млрд вместо заложенных в прогноз аналитиками $7,22 млрд.

Источник изображения: Applied Materials Общий тезис, обосновывающий подобное несоответствие, кроется в неравномерном спросе на оборудование для производства чипов по сегментам рынка. Если в сфере выпуска чипов для систем искусственного интеллекта на слабость спроса жаловаться не приходится, то автопром и сфера промышленной автоматизации с этой точки зрения сейчас переживают не самые лучшие времена. Более того, выручка Applied Materials в Китае также сократилась. Имеющиеся экспортные ограничения США пока позволяют Applied Materials продавать в Китае определённую номенклатуру своего оборудования, но в прошлом квартале местный рынок формировал только 30,3 % всей её выручки против 44,7 % годом ранее. С начала года акции Applied Materials выросли в цене на 15 %, но разочаровывающие инвесторов новости вчера привели к их снижению на 5 % после закрытия торгов. Генеральный директор Гэри Дикерсон (Gary Dickerson), тем не менее, выразил уверенность в способности передовых чипов поддерживать отрасль на плаву: «Applied лидирует во всех передовых сегментах, ИИ является большим драйверов для всей отрасли». Компания снабжает своим оборудованием всех ведущих производителей чипов, включая TSMC, Samsung и Intel. К слову, прогноз по удельной прибыли на одну акцию в изложении руководства Applied Materials превзошёл ожидания аналитиков: $2,29 против $2,28. Аналогичная динамика наблюдалась и по итогам прошлого квартала, а выручка компании за период выросла на 4,8 % до $7,05 млрд против ожидавшихся $6,97 млрд. Каждый пятый ПК теперь оснащён ИИ-ускорителем, но люди покупают их не из-за этого

15.11.2024 [00:30],

Николай Хижняк

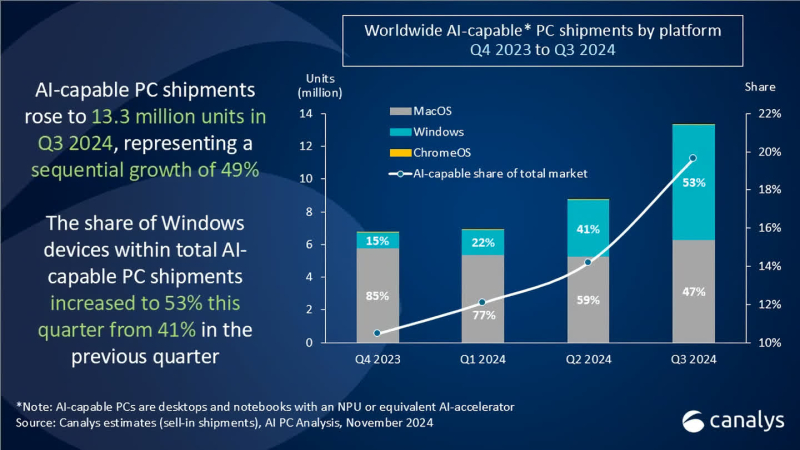

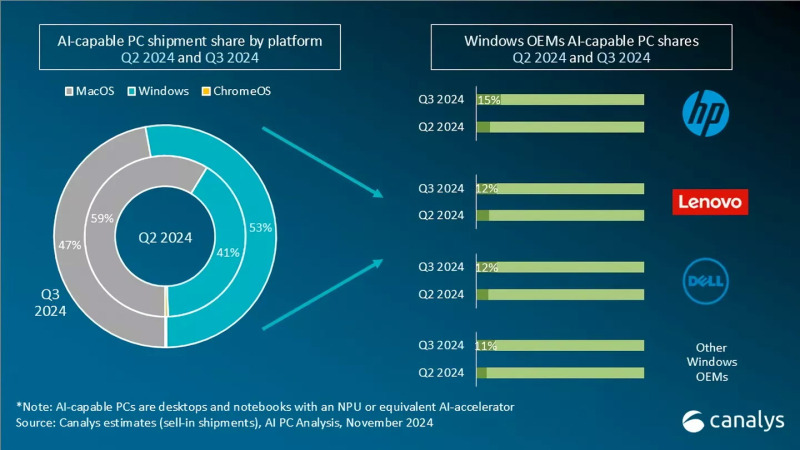

Поставки настольных и мобильных компьютеров с ускорителями для приложений искусственного интеллекта достигли 13,2 млн единиц в третьем квартале 2024 года, что составляет 20 % от всех поставок ПК за указанный период, по подсчётам агентства Canalys. Во втором квартале объём поставок таких компьютеров составлял 8,8 млн единиц.

Источник изображения: Microsoft Сразу стоит отметить, что к «ИИ-совместимым» персональным компьютерам аналитики Canalys относят все настольные и мобильные компьютеры, оснащённые специализированным ИИ-ускорителем NPU или «его аналогом». Таким образом к данной категории относятся не только системы на Copilot+PC на новейших чипах AMD, Intel и Qualcomm, но и Windows-компьютеры на чипах Intel и AMD прошлого поколения, а также все Apple Mac на процессорах M-серии.

Источник изображения: Canalys Согласно свежему анализу Canalys, на системы с Windows пришлось более половины (53 %) поставок ПК с ИИ в третьем квартале, тогда как доля Apple снизилась до 47 %. Во втором квартале лидером являлась как раз компания Apple с 59 % поставок систем с поддержкой ИИ, тогда как на долю систем с Windows приходилось 41 % поставок. Несмотря на прогресс в развитии ПК с поддержкой ИИ производителям по-прежнему приходится убеждать покупателей в том, что покупка такой системы, а стоят они зачастую дороже, того стоит. Некоторые наблюдатели утверждают, что рост поставок таких компьютеров не обязательно связан с тем, что люди ищут именно ПК с ИИ. Просто многие современные системы изначально оснащены ИИ-ускорителем.

Источник изображения: Canalys Главный аналитик Canalys Ишан Датт (Ishan Dutt) рассказал, что проведённый в ноябре опрос компаний, занимающихся продажами компьютеров, показал, что 31 % не планирует продавать системы Copilot+PC в следующем году, а 34 % респондентов ожидают, что такие устройства составят менее десятой части от общего объёма продаж в 2025 году. Для получения заветного обозначения Copilot+PC компания Microsoft требует от производителей ПК, чтобы система оснащалась ИИ-движком (NPU), производительность которого составляет не менее 40 TOPS (триллионов операций в секунду). В любом случае поставки и продажи ИИ-совместимых ПК в ближайшие месяцы должны вырасти, поскольку до даты окончания поддержки Windows 10, не имеющей функции ИИ, осталось меньше года. По данным StatCounter, Windows 10 по-прежнему занимает более 60 % рынка настольных ПК на базе Windows во всём мире. С прекращением поддержки многие потребители перейдут на новые ПК с Windows 11 в 2025 году. Google выпустила для iPhone приложение ИИ-чат-бота Gemini

14.11.2024 [17:59],

Владимир Мироненко

Бесплатное приложение ИИ-чат-бота Google Gemini, как и ожидалось, появилось в магазине приложений App Store компании Apple по всему миру. При его запуске появляется окно чата со списком предыдущих диалогов пользователя, который может отправлять запросы с помощью текста, голоса или камеры.

Источник изображений: Apple До этого пользователям iOS-устройств для доступа к Gemini приходилось открывать приложение Google и переключаться на соответствующую вкладку. В качестве альтернативы, в сентябре был обновлен виджет главного экрана приложения Google с настраиваемыми ярлыками, которые позволили напрямую получать доступ к Gemini одним нажатием. Приложение Gemini для iOS имеет новую функцию Gemini Live, обеспечивающую доступ к более интерактивному и разговорному режиму чата-бота, который похож на голосовой режим ChatGPT и доступен на платформе Android. Gemini Live отображается как на Dynamic Island iPhone, так и на экране блокировки. Как и все другие чат-боты, не поддерживающие Siri, Gemini имеет некоторые ограничения. Он не может менять настройки или получать доступ к другим приложениям. Но он может получать доступ к программным решениям Google. Например, его можно попросить воспроизвести музыку, и он запустит YouTube Music. Также можно его попросить указать дорогу, и он откроет картографический сервис Google Maps. Foxconn тоже пожинает плоды ИИ-бума — прибыль подскочила на 14 % благодаря ИИ-серверам

14.11.2024 [14:03],

Анжелла Марина

Foxconn, крупнейший в мире контрактный производитель электроники из Тайваня и основной партнёр Apple по сборке iPhone, сообщил о значительно росте квартальных финансовых показателей по итогам третьей четверти 2024 года. Также компания заявила о рекордной выручке в октябре и спрогнозировала рост выручки в четвёртом квартале. Драйвером роста стали ИИ-серверы, которые в следующем году должны обеспечить половину выручки компании в этом сегменте.

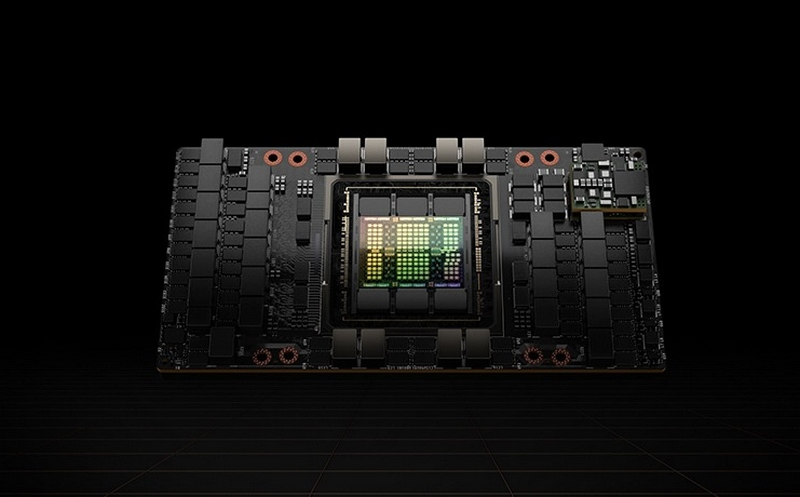

Источник изображения: Foxconn Являясь ключевым поставщиком Apple и Nvidia, Foxconn подтвердила свой прогноз «значительного роста» продаж на 2024 год и сообщила, что на серверы для нужд искусственного интеллекта (ИИ) будет приходиться 50 % её общей выручки от всех серверов в следующем году. Кроме того, началось масштабное строительство завода в Мексике, где будут выпускаться суперчипы Nvidia GB200 — ключевой компонент для архитектуры Blackwell. Выручка компании в третьем квартале достигла 1,85 трлн новых тайваньских долларов (NT$) или около 56,71 млрд долларов США, что на 20 % больше, чем годом ранее. Операционная прибыль выросла на 19 % до 54,8 млрд NT$ ($1,68 млрд), а чистая прибыль — на 14 % до 49,3 млрд NT$ ($1,51 млрд). Прибыль на акцию (EPS) составила 3,55 NT$ ($ 0,11), что также стало рекордным показателем для третьего квартала. За первые девять месяцев 2024 года выручка Foxconn достигла 4,7 трлн NT$ ($144,06 млрд, +10 % год к году), а чистая прибыль — 106,4 млрд NT$ ($3,26 млрд, +20 % год к году). В то же время валовая прибыль в размере 114,7 млрд тайваньских долларов ($3,52 млрд) выросла на 12 % по сравнению с прошлым годом. «Несмотря на влияние продуктового микса на маржу в третьем квартале, абсолютные показатели валовой, операционной и чистой прибыли увеличились по сравнению с аналогичным периодом прошлого года благодаря конкурентному преимуществу Foxconn в масштабах всей деятельности», — заявил финансовый директор Дэвид Хуанг (David Huang).

Источник изображения: Foxconn В свою очередь, президент и председатель правления Foxconn Янг Лю (Young Liu) заявил, что компания сосредоточится на пяти основных направлениях деятельности: искусственный интеллект, полупроводники, Smart Manufacturing (умное производство), Smart EV (умные электромобили) и Smart City (умный город). По словам Лю, компания также обладает всеми необходимыми возможностями для сохранения лидирующих позиций в сегменте ИИ-серверов, рынок которых может продолжить стремительно развиваться, тем более, что выручка от этого направления в первые три квартала 2024 года выросла более чем на 200 % по сравнению с аналогичным периодом прошлого года. В целом, Foxconn ожидает значительного роста по итогам 2024 года. Ключевыми факторами успеха компания считает сильный спрос в мире на ИИ-серверы, развитие новых направлений бизнеса и активное внедрение технологий искусственного интеллекта в собственное производство. «В долгосрочной перспективе, имея преимущество глобального присутствия Foxconn и новых возможностей развития бизнеса, наши заводы в Висконсине и Техасе выиграют в области ИИ и серверов, а завод по производству электромобилей в Огайо продолжит привлекать новых клиентов», — подчеркнул Янг Лю. OpenAI планирует выпустить ИИ-агента Operator в январе — он сможет управлять ПК без пользователя

14.11.2024 [11:12],

Дмитрий Федоров

Компания OpenAI готовится к выпуску нового ИИ-агента под кодовым названием Operator, который позволит выполнять разнообразные задачи на компьютере пользователя. Релиз этого инструмента может состояться уже в январе 2025 года.

Источник изображения: OpenAI На первом этапе упомянутое решение будет доступно в качестве предварительной исследовательской версии через API для разработчиков. Operator призван конкурировать с аналогичными ИИ-агентами, такими как недавно представленный Computer Use компании Anthropic и разрабатываемый ИИ-агент Google, ориентированный на потребительский рынок. OpenAI стремится создать универсальный инструмент, способный выполнять различные операции в веб-браузере и подходящий для решения повседневных задач пользователей. Однако, как отмечает издание Bloomberg, пока неизвестно, предложит ли Operator пользователям значительные преимущества перед аналогичными решениями конкурентов. Исследовательская версия инструмента будет полезна для оценки его потенциальных преимуществ и выявления областей, требующих доработки на основе обратной связи. Запуск Operator совпадает с публикацией документа OpenAI, содержащего рекомендации для правительства США по вопросам стратегии развития ИИ. В этом документе предлагается создание «экономических зон» для активного развития ИИ-инфраструктуры, а также формирование альянсов с союзниками США, что позволит усилить позиции страны в технологической гонке с Китаем. OpenAI призывает создать ИИ-альянс, который объединит США и союзников, включая страны Ближнего Востока

14.11.2024 [08:40],

Алексей Разин

Действующему руководству стартапа OpenAI явно не даёт покоя идея использования ресурсов некоторых стран Персидского залива для финансирования развития мировой инфраструктуры искусственного интеллекта. Новая инициатива OpenAI подразумевает создание альянса с участием политических союзников США, включая страны Ближнего Востока.

Источник изображения: OpenAI В среду, как сообщает South China Morning Post, руководство OpenAI выступило с призывом сформировать «Североамериканское соглашение по ИИ», которое бы упростило доступ к кадровым, финансовым и товарным ресурсам на международном уровне, которые требуются для построения инфраструктуры систем искусственного интеллекта. В конечном итоге соглашение должно объединить вокруг США союзников и партнёров, включая страны Ближнего Востока. Стратегическая инициатива была представлена OpenAI на мероприятии в Вашингтоне. Помимо предложений по сохранению лидирующих позиций США в сфере искусственного интеллекта, документ предлагает методы решения проблемы с энергоснабжением профильных центров обработки данных. По мнению OpenAI, власти США должны обеспечить поддержку затратным инфраструктурным проектам в сфере энергетики, предоставляя государственные гарантии выкупа электроэнергии у создаваемых генерирующих мощностей. В отношении проектов должен действовать режим регуляторного благоприятствования, включая и решения по вводу в строй ядерных реакторов, работа которых была в своё время приостановлена. Предлагается использовать в мирных целях опыт ВМС США в создании компактных ядерных реакторов для подводных лодок. В заявлении OpenAI говорится: «ИИ представляет собой возможность реиндустриализации США, которую нельзя упустить, и которая поможет инициировать рост всей экономики, способный оживить американскую мечту». Кроме того, инициатива OpenAI преследует цель обеспечить национальную безопасность США и защитить страну и её союзников от растущего влияния Китая через распространение «ИИ, сформированного с учётом демократических ценностей». План развития национальной отрасли ИИ был согласован как с действующей администрацией президента США Байдена, так и с представителями недавно избранного Дональда Трампа (Donald Trump). Представители OpenAI ожидают, что данная повестка получит приоритет в работе Конгресса и правительства США нового состава. Пузырь ИИ сдувается, пока OpenAI, Google и Anthropic пытаются создать более продвинутый ИИ

13.11.2024 [19:26],

Сергей Сурабекянц

Три ведущие компании в области искусственного интеллекта столкнулись с ощутимым снижением отдачи от своих дорогостоящих усилий по разработке новых систем ИИ. Новая модель OpenAI, известная как Orion, не достигла желаемой компанией производительности, предстоящая итерация Google Gemini не оправдывает ожиданий, а Anthropic столкнулась с отставанием в графике выпуска своей модели Claude под названием 3.5 Opus.

Источник изображения: unsplash.com После многих лет стремительного выпуска всё более сложных продуктов ИИ три ведущие в этой сфере компании наблюдают убывающую отдачу от дорогостоящих усилий по созданию новых моделей. Становится все труднее находить свежие, ещё неиспользованные источники высококачественных данных для обучения более продвинутых систем ИИ. А нынешних весьма скромных улучшений недостаточно, чтобы окупить огромные затраты, связанные с созданием и эксплуатацией новых моделей, как и оправдать ожидания от выпуска новых продуктов. Так, OpenAI утверждала, что находится на пороге важной вехи. В сентябре завершился начальный раунд обучения для новой масштабной модели Orion, которая должна была приблизится к созданию мощного ИИ, превосходящего людей. Но ожидания компании, по утверждению осведомлённых источников, не оправдались. Orion не смогла продемонстрировать прорыва, который ранее показала модель GPT-4 по сравнению с GPT-3.5.

Источник изображения: Pixabay Anthropic, как и её конкуренты, столкнулась с трудностями в процессе разработки и обучения 3.5 Opus. По словам инсайдеров, модель 3.5 Opus показала себя лучше, чем старая версия, но не так значительно, как ожидалось, учитывая размер модели и затраты на её создание и запуск. Эти проблемы бросают вызов утвердившемуся в Кремниевой долине мнению о масштабируемости ИИ. Приверженцам глобального внедрения ИИ приходится признать, что бо́льшая вычислительная мощность, увеличенный объём данных и более крупные модели пока не прокладывают путь к технологическому прорыву в области ИИ.

Источник изображения: Nvidia Эксперты высказывают обоснованные сомнения в окупаемости крупных инвестиций в ИИ и достижимости всеобъемлющей цели, к которой стремятся разработчики ИИ-моделей, — создания общего искусственного интеллекта (AGI). Этот термин обычно применяется к гипотетическим ИИ-системам, способным соответствовать или превосходить человека в большинстве интеллектуальных задач. Руководители OpenAI и Anthropic ранее заявляли, что AGI может появиться уже через несколько лет. Технология, лежащая в основе ChatGPT и конкурирующих ИИ-чат-ботов, была создана на основе данных из социальных сетей, онлайн-комментариев, книг и других источников из интернета. Этих данных хватило для создания продуктов, генерирующих суррогатные эссе и поэмы, но для разработки систем ИИ, которые превзойдут интеллектом лауреатов Нобелевской премии — как надеются некоторые компании, — могут потребоваться другие источники данных, помимо сообщений в Википедии и субтитров YouTube.

Источник изображения: unsplash.com OpenAI была вынуждена заключить соглашения с издателями, чтобы удовлетворить хотя бы часть потребности в высококачественных данных, а также адаптироваться к растущему юридическому давлению со стороны правообладателей контента, используемого для обучения ИИ. Отмечается высокий спрос на рынке труда на специалистов с высшим образованием, которые могут маркировать данные, связанные с их областью компетенции. Это помогает сделать обученные ИИ-системы более эффективными в ответах на запросы. Подобные усилия обходятся дороже и требуют на порядок больше времени, чем простое индексирование интернета. Поэтому технологические компании обращаются к синтетическим данным, таким как сгенерированные компьютером изображения или текст, имитирующие контент, созданный людьми. Однако у такого подхода есть свои ограничения, так как трудно добиться качественного улучшения при использовании подобных данных для обучения ИИ. Тем не менее компании ИИ продолжают следовать принципу «чем больше, тем лучше». В стремлении создавать продукты, приближающиеся к уровню человеческого интеллекта, технологические компании увеличивают объём вычислительной мощности, данных и времени, затрачиваемых на обучение новых моделей, что приводит к росту расходов. Генеральный директор Anthropic Дарио Амодеи (Dario Amodei) заявил, что в этом году компании потратят $100 млн на обучение новейших моделей, а в ближайшие годы эта сумма может достичь $100 млрд.

Источник изображения: unsplash.com Безусловно, потенциал для улучшения моделей ИИ, помимо масштабирования, существует. Например, для своей новой модели Orion OpenAI применяет многомесячный процесс пост-обучения. Эта процедура включает использование обратной связи от людей для улучшения ответов и уточнения «эмоциональной окраски» взаимодействия с пользователями. Разработчики ИИ-моделей оказываются перед выбором: либо предлагать старые модели с дополнительными улучшениями, либо запускать чрезвычайно дорогие новые версии, которые могут работать ненамного лучше. По мере роста затрат растут и ожидания — стремительное развитие ИИ на начальном этапе создало завышенные ожидания как у специалистов, так и у инвесторов. Мировые продажи GPU достигнут $100 млрд в этом году — львиную долю принесут чипы, не связанные с графикой

13.11.2024 [17:25],

Владимир Мироненко

Согласно прогнозу аналитиков Jon Peddie Research, глобальный рынок графических процессоров превысит $98,5 млрд по итогам 2024 года, пишет ресурс Tom's Hardware.

Источник изображения: Nvidia По данным JPR, на рынке сейчас присутствует семь разработчиков архитектур GPU, а также 20 компаний, занятых созданием дискретных, интегрированных и встраиваемых графических процессоров. Большинство этих решений представляют собой интегрированные GPU начального уровня, и лишь несколько компаний разрабатывают дискретные GPU для игровых видеокарт и ускорителей вычислений. Большую часть дохода на мировом рынке GPU приносят решения, которые не используются для обработки графики: в количественном выражении продажи GPU для задач ИИ и высокопроизводительных вычислений (HPC) составляют всего несколько миллионов единиц в год, но поскольку их цена составляет десятки тысяч долларов за единицу, реализация таких продуктов приносит Nvidia десятки миллиардов долларов, а AMD — миллиарды.

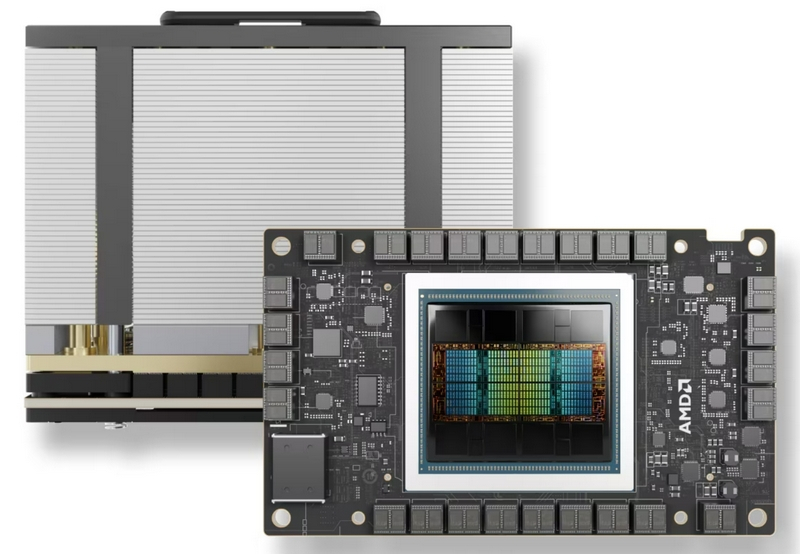

Источник изображения: AMD Всего за два квартала текущего финансового года доход Nvidia от поставок GPU для ИИ и HPC составил $42 млрд, а за весь год эти цифры могут увеличиться до $90 млрд. AMD ожидает, что выручка от продажи её ИИ-ускорителей превысит $3 млрд. Если говорить о других участниках рынка, как, например, Biren или MetaX, то они пока значительно отстают по доходам от лидеров. «GPU стали повсеместными и их можно найти практически в каждом промышленном, научном, коммерческом и потребительском продукте, производимом сегодня, — сообщил доктор Джон Педди (Jon Peddie), президент Jon Peddie Research. — Некоторые сегменты рынка, такие как ИИ, попали в заголовки из-за своего быстрого роста и высокой средней цены продажи (ASP), но они имеют небольшой объём по сравнению с другими сегментами рынка». Tom's Hardware отметил, что хотя рынок GPU для ИИ имеет небольшой объём по сравнению с другими сегментами, все новички на рынке графических процессоров — особенно из Китая — сосредоточены на решениях для ЦОД, а не для игр. Конечно, эти компании сталкиваются с ограничениями со стороны правительства США, стремящегося перекрыть Китаю доступ к передовым технологиям ИИ, но, по-видимому, они готовы пойти на риск, поскольку потенциал рынка ИИ очень высок. YouTube тестирует создание ремиксов песен с помощью ИИ

13.11.2024 [11:18],

Владимир Мироненко

Видеосервис YouTube запустил тестирование функции создания ремиксов песен с помощью ИИ. Сейчас этой функцией могут воспользоваться отобранные YouTube в группу тестировщиков авторы, живущие в США.

Источник изображения: Christian Wiediger/unsplash.com Для создания ремикса пользователь должен выбрать песню из предлагаемого списка музыкальных треков лейблов-партнёров YouTube, затем указать опцию «Изменить стиль трека» и предоставить описание, как он хотел бы изменить стиль трека. После этого с помощью ИИ будет сгенерирован 30-секундный музыкальный фрагмент, который автор сможет использовать в своих коротких видео. Google отметила на странице поддержки, что ремиксованный звуковой фрагмент будет «приписан» к оригинальной песне через Short и сводную страницу аудио Shorts. Кроме того, он также будет иметь соответствующую метку, указывающую на то, что трек был изменён с помощью ИИ. В прошлом году YouTube начал тестирование функции создания песен Dream Track с использованием генеративного ИИ и вокала известных исполнителей. Для создания трека достаточно предоставить текстовое описание будущей песни или просто напеть мотив. Функция Dream Track стала доступной для тестирования отдельными авторами в ноябре 2023 года, и работает она на основе модели генерации музыки Lyrica, разработанной Deepmind. Чтобы не столкнуться с возможными исками по поводу нарушения авторских прав, YouTube сообщил в августе прошлого года о планах выплачивать компенсацию исполнителям и правообладателям за использование их работ в функциях ИИ. С этой целью компания договорилась о партнёрстве с Universal Music Group для разработки модели выплат правообладателям. Сооснователь OpenAI Грег Брокман вернулся в компанию после длительного отпуска

13.11.2024 [10:26],

Алексей Разин

Глядя на череду увольнений из OpenAI влиятельных теперь в сфере искусственного интеллекта фигур, которые стояли у истоков этого стартапа, можно было подумать, что из начального состава компании в её штате осталось не более двух человек. Между тем, президент OpenAI Грег Брокман (Greg Brockman), взявший в августе длительный отпуск, недавно вернулся к исполнению своих обязанностей.

Источник изображения: OpenAI Developer Forum Как показывает опыт Раджи Кодури (Raja Koduri), который несколько лет назад после длительного отпуска перешёл из AMD в конкурирующую Intel, подобные перерывы в активной деятельности руководителей далеко не всегда благоприятно заканчиваются для работодателей, но в случае с Грегом Брокманом всё обошлось. Агентство Bloomberg смогло подтвердить у представителей OpenAI, что Брокман на днях вернулся к исполнению своих обязанностей президента компании. Сотрудники стартапа на этой неделе получили соответствующее уведомление. Попутно Брокман сообщил сотрудникам OpenAI, что вместе с генеральным директором Сэмом Альтманом (Sam Altman) работает над определением своей новой роли внутри компании, которая позволила бы ей легче справляться с техническими трудностями, возникающими на её пути. Брокман сыграл важную роль в событиях прошлой осени, когда совет директоров OpenAI принял решение отправить Альтмана в отставку. Брокман тогда на время покинул компанию в знак протеста против увольнения Альтмана, но вернулся после его восстановления в должности генерального директора. Продолжительный отпуск понадобился Брокману в августе этого года для восстановления сил и попытки впервые расслабиться после основания OpenAI девять лет назад. Некоторое время назад OpenAI покинули бывший технический директор Мира Мурати (Mira Murati) и ведущий научный специалист Илья Суцкевер, которые уже успели основать собственные стартапы в области искусственного интеллекта. Джон Шульман (John Schulman), который также ушёл из OpenAI, в новой активности на этом направлении пока замечен не был. В общей сложности, из начальной группы основателей OpenAI в штате компании остаются три человека, включая Сэма Альтмана и Грега Брокмана. SoftBank построит самый мощный ИИ-суперкомпьютер в Японии, используя ускорители Nvidia DGX B200 семейства Blackwell

13.11.2024 [07:54],

Алексей Разин

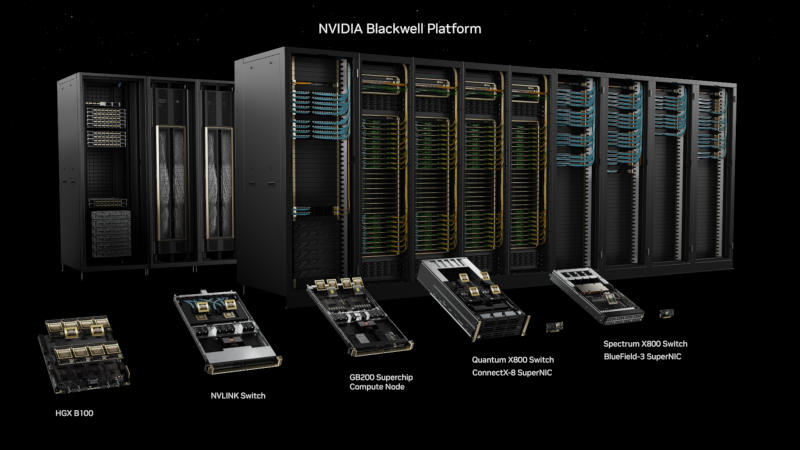

На этой неделе Nvidia провела мероприятие, на котором выступили её основатель Дженсен Хуанг (Jensen Huang) и глава SoftBank Масаёси Сон (Masayoshi Son). Последняя из корпораций начнёт в числе первых использовать ускорители вычислений Nvidia DGX B200 поколения Blackwell в самом мощном в Японии суперкомпьютере, ориентированном на решение задач искусственного интеллекта. Одновременно SoftBank запустит в Японии сеть поколения AI-RAN для управления автопилотом и роботами.

Источник изображения: Nvidia Как поясняет Bloomberg, японская SoftBank станет первой компанией, получившей возможность построить суперкомпьютер на базе новейших ускорителей Nvidia DGX B200, которые сочетают в одном корпусе 8 чипов поколения Blackwell и 2 процессора Intel Xeon Platinum 8570. В дальнейшем SoftBank перейдёт на использование Grace Blackwell — более современных ускорителей, подразумевающих наличие Arm-совместимых процессоров Grace собственной разработки Nvidia. Компания SoftBank Corp., входящая в состав SoftBank Group, является третьим по величине оператором сотовой связи в Японии. Плотная взаимосвязь между Nvidia и SoftBank была установлена ещё в прошлом десятилетии, поскольку до начала 2019 года вторая владела 4,9 % акций первой. Основатель SoftBank Масаёси Сон заявил, что готов делать серьёзные ставки в сегменте искусственного интеллекта. Решения Nvidia также будут использоваться оператором связи SoftBank Corp. при создании сети нового поколения (AI-RAN), которая сможет передавать информацию по стандарту 5G и одновременно управлять клиентскими устройствами, использующими искусственный интеллект. Ими могут быть транспортные средства с автопилотом и разного рода роботы. Пилотный проект со временем позволит масштабировать подобные сети по всей Японии. Сети нового поколения не только лучше подходят для управления сложными устройствами, но и потребляют меньше электроэнергии. Партнёрами SoftBank по тестированию AI-RAN выступят Fujitsu и Red Hat. Весной Apple представит настенный 6-дюймовый планшет с голосовым управлением и ИИ

13.11.2024 [05:16],

Алексей Разин

Ещё летом стало известно о планах Apple по выпуску роботизированного устройства, комбинирующего манипулятор и планшет, но теперь Марк Гурман (Mark Gurman) со страниц Bloomberg утверждает, что к весне следующего года компания рассчитывает представить «настенный 6-дюймовый планшет» с новой операционной системой, который расширит использование ИИ, а также будет интегрироваться в систему умного дома.

iPad mini. Источник изображения: Apple Почти квадратное устройство J490 по своим размерам, как отмечает источник, будет напоминать два приложенных друг к другу iPhone, но вокруг дисплея будет предусмотрена широкая рамка, делая его похожим на цифровую фоторамку. Демонстрировать фотографии такой планшет тоже сможет, а ещё к нему можно будет приобрести док-станцию с более мощными динамиками, удобную для размещения на столе. Устройство также будет в случае необходимости крепиться на стену, причём буквально в каждой комнате, если пользователю потребуется тесно интегрировать его функции в работу умного дома. Специально оптимизированная под такой планшет операционная система Pebble позволит создавать кастомизированные виджеты, а встроенный набор сенсоров будет определять, как далеко находится пользователь, чтобы в случае его приближения менять фоновую заставку на элементы интерфейса, подразумевающие более активное взаимодействие. Многие команды можно будет подавать голосом, они будут обрабатываться Apple Intelligence, но сенсорный интерфейс также сохранится. Для первичной настройки устройства может потребоваться iPhone, но и некоторые виды взаимодействия с ним тоже будут предусмотрены. Если инициатива с интеграцией новинки в систему умного дома будет пользоваться успехом у клиентов, Apple может дополнить ассортимент решений разного рода датчиками. Они, например, позволят отслеживать, сколько человек в конкретный момент находятся в помещении. Интеграция с функциями безопасности тоже будет предусмотрена, с помощью планшета можно будет управлять камерами видеонаблюдения и электронными замками. Поскольку в начальной конфигурации настенный планшет не будет оснащаться роботизированной конечностью, оно окажется дешевле тех $1000, которые Apple запросит за старшую модификацию, а потому пользователи буквально смогут приобретать несколько штук одновременно, по одной для каждой из комнат в своём жилище. Функция видеоконференции также будет поддерживаться благодаря наличию веб-камеры. Джим Келлер поможет LG в развитии «Заботливого интеллекта»

12.11.2024 [13:40],

Дмитрий Федоров

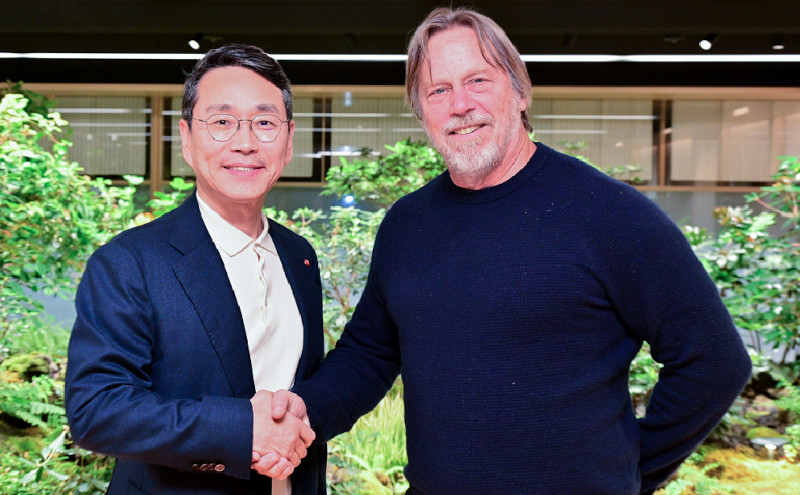

Компании LG и Tenstorrent укрепят сотрудничество для разработки чиплетов и систем на кристалле (SoC) с целью создания ИИ-чипов, которые будут интегрированы в продукцию LG, включая бытовую технику с ИИ-управлением и решения для умного дома. Сотрудничество двух компаний также охватывает перспективные направления, такие как мобильные технологии будущего и коммерческие решения, что полностью соответствует концепции LG «Заботливого интеллекта», направленного на создание технологий, учитывающих потребности пользователей.

Источник изображения: lgnewsroom.com Tenstorrent известна своими передовыми решениями в области высокопроизводительных вычислений (HPC) и разработками на базе RISC-V IP (Ascalon) и AI IP (Tensix). Эти архитектуры обеспечивают возможность масштабирования чипов от милливатт до мегаватт, позволяя достичь оптимального баланса между производительностью и энергоэффективностью. Масштабируемость делает продукцию Tenstorrent востребованной как для маломощных портативных устройств, так и для крупных дата-центров. На недавней встрече генерального директора LG Уильяма Чо (William Cho) и генерального директора Tenstorrent Джима Келлера (Jim Keller), которая прошла в штаб-квартире LG в Сеуле, присутствовали ключевые менеджеры обеих компаний. В числе участников были технический директор LG Ким Бёнхун (Kim Byoung-hoon) и руководитель Центра SoC Ким Джин-гён (Kim Jin-gyeong), а также директор по коммерческим операциям Tenstorrent Дэвид Беннет (David Bennett) и вице-президент по автомобильному направлению Таддеус Фортенберри (Thaddeus Fortenberry). На встрече обсуждались стратегические направления для долгосрочного партнёрства и методы оптимизации использования интеллектуальных и технологических ресурсов компаний. Компании сосредоточили своё внимание на возможностях совместного использования технологий для создания синергии в таких направлениях, как ИИ для бытовой техники, решения для умного дома, мобильные приложения и видеопроцессоры для дата-центров. Руководители LG и Tenstorrent подчеркнули важность развития полупроводников нового поколения, таких как RISC-V и чиплеты, которые позволят компаниям уверенно развиваться в условиях стремительного роста рынка ИИ. В рамках партнёрства компании рассматривают возможность создания долгосрочной программы стажировок, ориентированной на развитие молодых специалистов. Это позволит привлечь перспективные кадры и поддерживать инновации, обеспечивая постоянный приток новых идей в бурно развивающуюся полупроводниковую индустрию. LG активно развивает компетенции в области ИИ-программного обеспечения и алгоритмов, что позволяет компании создавать продукты и платформы с использованием генеративных технологий, функционирующих непосредственно на устройствах. В рамках этой стратегии создаются чипы, которые обеспечивают интеграцию ИИ-решений в устройства, увеличивая скорость обработки данных и повышая их безопасность. Для успешной реализации этой стратегии LG основала Центр исследований и разработок SoC, в котором разрабатываются и оптимизируются высокопроизводительные системы на базе технологии чиплетов, позволяющей объединить несколько микросхем. Эта архитектура становится всё более востребованной на фоне растущего спроса на энергоэффективные ИИ-полупроводники, и специалисты LG уделяют особое внимание повышению производительности и энергосбережению своих продуктов. Чипы, разработанные LG для своих ключевых продуктов, создавались под руководством Центра SoC. Среди них выделяются фирменный ИИ-чип DQ-C для бытовой техники и процессор Alpha 11 AI для OLED-телевизоров. Эти передовые разработки укрепили лидерство LG на мировом рынке ИИ-устройств и премиальных телевизоров. Российский рынок диалогового ИИ вырос в четыре раза за 5 лет

12.11.2024 [12:39],

Дмитрий Федоров

Исследование Naumen показало впечатляющее развитие российского рынка диалогового ИИ. За 5 лет объём отечественного рынка NLP-решений вырос в четыре раза, до 5,9 млрд руб. к концу 2023 года. Ключевые сегменты рынка — чат-боты, голосовые помощники, речевая аналитика, синтез и распознавание речи — всё шире внедряются в банковский сектор, ретейл и медицину, где играют важную роль в автоматизации взаимодействия с клиентами и повышении эффективности бизнес-процессов.

Источник изображений: Alexandra_Koch / Pixabay Согласно исследованию разработчика программных решений Naumen, рынок диалогового ИИ охватывает четыре основные категории: чат-боты, голосовые помощники, решения для речевой аналитики, а также технологии синтеза и распознавания речи. Лидером в 2023 году стали голосовые помощники, которые заняли 26,8 % рынка и принесли почти 1,6 млрд руб. дохода, увеличившись в объёме в 4,9 раза по сравнению с 2019 годом. Популярность таких помощников объясняется их эффективностью в автоматизации клиентского обслуживания и оптимизации бизнес-процессов. Сегмент голосовых роботов для исходящих звонков также занял значительную долю рынка, достигнув 1,55 млрд руб. в 2023 году, впервые превысив объём сегмента входящих роботов, включающих автоответчики и маршрутизаторы звонков. Эти технологии активно применяются для автоматического обзвона клиентов и проведения опросов, что позволяет компаниям оптимизировать затраты на коммуникации и обеспечивать более масштабное взаимодействие с клиентами. Сегмент чат-ботов в 2023 году составил 19 % рынка с объёмом продаж, достигшим 1,2 млрд руб. Это на 44 % больше по сравнению с 2019 годом, что свидетельствует о стабильном росте интереса к этому направлению. Эксперты Naumen полагают, что потенциал чат-ботов ещё далёк от исчерпания, и прогнозируют высокие темпы роста этого сегмента в будущем. Основные инвестиции на рынке диалогового ИИ пришлись на период 2019–2021 годов, когда крупные компании начали приобретать доли в профильных разработчиках ИИ. Сбербанк, к примеру, приобрёл 51 % компании «Центр речевых технологий» (ЦРТ), Совкомбанк — 25 % в компании AtsAero, а совместно с МТС — 22,5 % разработчика Just AI. После некоторого затишья в 2022 году инвестиционная активность возобновилась: в 2023 году «Вымпелком» купил 14 % акций в компании Cashee (Target AI), а Softline приобрёл 72,5 % в Robovoice.  На российском рынке диалогового ИИ крупные игроки, такие как ЦРТ, Just AI, BSS и «Наносемантика», контролируют более 50 % разработок чат-ботов и голосовых помощников. В то же время 80 % решений для голосовых роботов производят небольшие специализированные компании, такие как Neuro Net и Zvonobot. Согласно статистике Naumen, диалоговые ИИ-системы наиболее активно внедряются в ретейле, где чат-боты используют 42 % компаний, и в банковском секторе, охватывающем 27 % рынка. Голосовые помощники востребованы в основном среди банков (21 %) и медицинских учреждений (50 %). Генеральный директор компании Dbrain и автор Telegram-канала «AI Happens» Алексей Хахунов отмечает, что интенсивный рост рынка NLP-решений в последние годы объясняется двумя основными факторами. Во-первых, рынок только формируется и продолжает набирать обороты, что создаёт условия для устойчивого роста. Во-вторых, значительные технологические достижения в области обработки естественного языка, произошедшие в последние несколько лет, позволили создать эффективные и конкурентоспособные решения для бизнеса. Хахунов подчёркивает, что современные NLP-инструменты значительно упрощают доступ к технологиям автоматизации. Исполнительный директор MTS AI и эксперт Альянса в сфере ИИ Дмитрий Марков подчёркивает, что популярность чат-ботов выросла в период пандемии коронавируса, когда компании столкнулись с резким увеличением онлайн-запросов. После окончания пандемии рост этого сегмента несколько замедлился. Однако развитие технологий ИИ привело к появлению множества платформ для создания чат-ботов, что снизило порог входа на рынок для малого и среднего бизнеса. Теперь базового чат-бота или голосового робота может внедрить практически любая компания. Сооснователь компании Parodist AI Владимир Свешников прогнозирует, что будущее развитие рынка NLP-решений будет тесно связано с совершенствованием больших языковых моделей. Повышение качества ИИ-моделей достигается за счёт их масштабирования и увеличения объёма обучающих данных, что ускоряет разработку и внедрение диалоговых ИИ-систем. Доступность большого объёма данных позволяет ИИ становиться всё более гибким и точным, что создаёт благоприятные условия для расширения его использования в различных отраслях. Спрос на автоматизацию и роботизацию остаётся высоким, особенно в условиях нехватки квалифицированных кадров. Современные технологии ИИ позволяют оптимизировать рабочие процессы в ночное время и выходные дни, когда привлечение человеческих ресурсов обходится значительно дороже. Дмитрий Марков отмечает, что современные чат-боты и голосовые роботы могут обеспечивать круглосуточное обслуживание клиентов, что способствует быстрой окупаемости вложений. С развитием ИИ такие решения станут частью более сложных систем поддержки бизнеса, способных обеспечивать постоянное присутствие компании в цифровом пространстве. Baidu представила лёгкие умные очки с камерой и встроенным ИИ

12.11.2024 [12:37],

Павел Котов

Китайская Baidu анонсировала ряд новых служб на основе искусственного интеллекта, в том числе генератор изображений по текстовому описанию и сервис, позволяющий создавать приложения в отсутствие навыков программирования. Компания также представила умные очки с камерами и ИИ-помощником.

Источник изображения: Baidu На ежегодном мероприятии Baidu World Conference китайский поисковый гигант представил умные очки Xiaodu AI Glasses со встроенным ИИ-помощником Ernie с голосовым управлением. Гаджет разработан подразделением Xiaodu, которое специализируется на выпуске устройств. Умные очки весят всего 45 граммов и оснащены 16-Мп широкоугольной камерой с электронной стабилизацией. Имеется также чип, отвечающий за локальную работу ИИ, но подробностей о нем пока нет. Очки обеспечивают впечатляющее время автономной работы — до 56 часов в режиме ожидания или более 5 часов непрерывного воспроизведения аудио. Есть и быстрая зарядка — всего 30 минут гаджет полностью восполнит заряд. Для звонков в очках используется массив из четырех микрофонов, а открытые динамики с защитой от воды обеспечивают чистое звучание. Выпуск очков Xiaodu AI Glasses запланирован на первую половину следующего года, а их предполагаемая цена составит менее 2100 юаней (около 290 долларов). Этот выпуск знаменует собой значительный шаг вперед в интеграции искусственного интеллекта с носимыми технологиями, поскольку Baidu стремится переосмыслить пользовательский опыт с помощью передовых и доступных приложений искусственного интеллекта.  Лидер китайского рынка веб-поиска входит в число технологических компаний, которые выпускают коммерческие приложения на основе больших языковых моделей, над которыми Baidu активно работали в течение последних двух лет. На конференции глава Baidu Робин Ли (Robin Li) представил сервис I-RAG — генератор изображений по текстовым запросам. Проблема «галлюцинаций» в нём решена подключением к системе веб-поиска Baidu — благодаря ей картинки на выходе меньше отклоняются от запросов и в меньшей степени содержат несуществующие элементы. Созданная Baidu платформа ИИ Ernie на текущий момент обрабатывает 1,5 млрд запросов и прочих элементов взаимодействия с пользователями, хотя в ещё мае этот показатель составлял 200 млн. Сценарии взаимодействия включают генерацию текста, ответы за вопросы и работу с различными приложениями с ИИ. Монетизацию своих разработок Baidu в значительной мере осуществляет за счёт «ИИ-агентов», позволяющих пользователям создавать собственные приложения. Системы ИИ интегрированы в существующую линейку продуктов Baidu; они также доступны клиентам через облачные сервисы компании. У Baidu нет цели создавать «суперприложение» с набором служб с ИИ, отметил господин Ли. Компания также представила сервис Miaoda, предлагающий генерацию программного кода с использованием большой языковой модели — можно создавать целые приложения, не обладая обширными познаниями в области программирования. |