|

Опрос

|

реклама

Быстрый переход

Anthropic наделила управляемых ИИ-агентов Claude «сновидениями» — в некотором роде

07.05.2026 [00:56],

Николай Хижняк

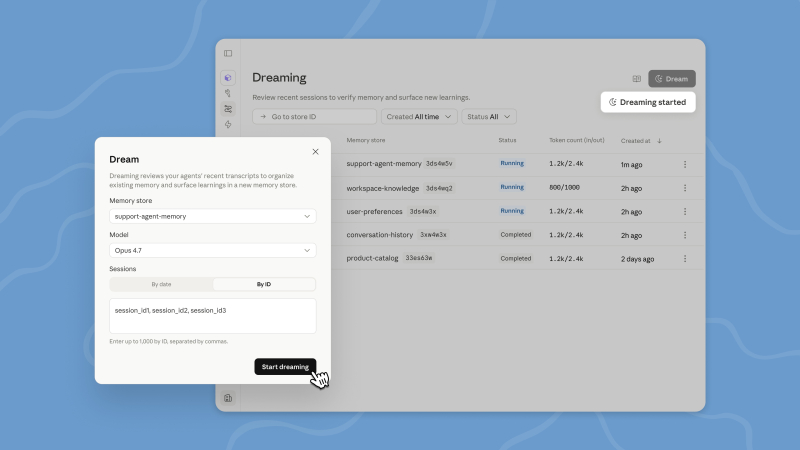

На конференции разработчиков Code with Claude компания Anthropic представила функцию, которую она называет «сновидениями» для управляемых ИИ-агентов Claude. В данном случае под «сновидениями» понимается процесс анализа недавних событий и выявления конкретных вещей, которые стоит сохранить в «памяти» для планирования будущих задач и взаимодействий.

Источник изображения: Anthropic Функция «сновидения» находится на стадии предварительного тестирования и доступна только для управляемых агентов (Managed Agents) на платформе Claude. Управляемые агенты представляют собой альтернативу более высокого уровня по сравнению с прямым использованием API-сообщений. Anthropic описывает их как «предварительно созданные, настраиваемые агентские модули, работающие в управляемой инфраструктуре». Они предназначены для ситуаций, когда необходимо, чтобы несколько агентов работали над задачей или проектом в течение нескольких минут или часов до получения конечного результата. Anthropic описывает «сновидения» как запланированный процесс, в ходе которого просматриваются сессии и хранилища памяти, а также осуществляется отбор конкретных воспоминаний. Это важно, поскольку контекстные окна для языковых моделей ограничены, и важная информация может быть потеряна в ходе длительных проектов. В части чата многие модели используют процесс, называемый компактизацией, при котором длительные разговоры периодически анализируются, и модели пытаются удалить нерелевантную информацию из контекстного окна, сохраняя при этом то, что действительно важно для текущего разговора, проекта или задачи. Однако этот процесс обычно ограничен конкретным разговором с одним агентом. «Сновидения» — это периодически повторяющийся процесс, при котором прошлые сессии и хранилища памяти могут анализироваться разными агентами, а важные закономерности выявляются и сохраняются в памяти для будущего использования. Пользователи смогут выбирать между автоматическим процессом и непосредственным просмотром изменений в памяти. «Сновидения выявляют закономерности, которые отдельный агент не может увидеть самостоятельно, включая повторяющиеся ошибки, рабочие процессы, к которым сходятся агенты, и предпочтения, разделяемые всей командой. Они также реструктурируют память, чтобы она оставалась высокоинформативной по мере своего развития. Это особенно полезно для длительной работы и оркестровки нескольких агентов», — говорит Anthropic. Разработчики могут запросить доступ к «сновидениям», пока она находится на стадии предварительного тестирования. Компания Anthropic также объявила, что две ранее анонсированные функции предварительного просмотра исследовательских проектов — «Результаты» и «Оркестровка многоагентных систем» — стали более широко доступны. Кроме того, Anthropic удвоит пятичасовые лимиты использования Claude Code для подписчиков тарифных планов Pro и Max, тем самым отвечая на многочисленные жалобы пользователей на недостаточное время сессий. Частные инвесторы нашли способ вложиться в OpenAI и другие «закрытые» ИИ-компании — через криптоплатформы

06.05.2026 [12:52],

Павел Котов

Некоторые из крупнейших в мире разработчиков моделей искусственного интеллекта — в первую очередь Anthropic, OpenAI и SpaceX (владеет xAI) — постоянно мелькают в новостных заголовках, но пока остаются частными компаниями, то есть возможность вкладывать средства в их акции отсутствует. Обходное решение нашли криптовалютные платформы.

Источник изображения: Nicholas Cappello / unsplash.com На платформах Ventuals и PreStocks появилась возможность торговать активами компаний, которые только готовятся к размещению своих акций на бирже (IPO). На этих платформах компания Anthropic получила оценку в $1,6 трлн, то есть вдвое больше, чем было установлено в последнем официальном раунде финансирования. В действительности это спекулятивные позиции, а не сделки с реальными акциями. На Ventuals трейдеры спекулируют на оценках бессрочных фьючерсов — деривативов без обеспечения активами, без срока истечения и вообще без привязки к какой-либо реальной сделке с акциями. На PreStocks используется другой подход — её токены выпускаются один к одному со специально созданной компанией (SPV), у которой якобы действительно есть акции Anthropic. Хотя сама Anthropic выпустила разъяснение, что эти структуры могут не иметь юридической силы, и сам разработчик ИИ считает подобные сделки недействительными. Тем не менее, с момента запуска в ноябре площадка Ventuals накопила объём торгов около $500 млн, а у PreStocks этот показатель приблизился к $630 млн. Эти производные инструменты, которые выпускаются до IPO, представляют собой новый формат розничного рынка: архитектура, которая когда-то обеспечивала спекуляции на мемкоинах, теперь служит для инвестирования в такие компании как Anthropic — в режиме реального времени. Интересно, что действительные владельцы акций Anthropic отслеживают торги на Ventuals для оценки принадлежащих им ценных бумаг, и при их продаже оценка соответствует котировкам на криптоплатформах. Традиционной альтернативой таких механизмов являются частные рынки, но и они не всегда устраивают инвесторов за отсутствием нужных инструментов — те же короткие позиции (игру на понижение) против OpenAI и Anthropic даже после оценки в $1 трлн открывались при ослаблении положительных прогнозов. Ранее рынок к таим инструментам был ещё не готов: в прошлом году акции Robinhood Markets Inc. упали после того, как OpenAI назвала сомнительным предложение брокерской компании о выпуске привязанных к акциям токенов, связанных с разработчиком ChatGPT. В OpenAI тогда отметили, что компания не участвовала в этом предложении и не давала на него одобрения. Anthropic направит на закупку чипов Google около $200 млрд за пять лет

06.05.2026 [08:11],

Алексей Разин

Ещё в начале прошлого месяца ИИ-стартап Anthropic объявил о заключении долгосрочного соглашения о сотрудничестве с Google, которая взялась снабжать первую из компаний своими ИИ-чипами TPU и вычислительными мощностями в целом. Только сейчас стало известно, что по условиям этого соглашения Anthropic за пять лет потратит на эти нужды $200 млрд.

Источник изображения: Anthropic Об этом на текущей неделе сообщило издание The Information, на которое ссылается Reuters. Данная сумма формирует более 40 % того портфеля заказов, которым Google располагает на указанный период. По условиям договорённости, Google Cloud предоставит Anthropic в общей сложности 5 ГВт вычислительных мощностей для инфраструктуры ИИ, начиная с 2027 года. Кроме того, материнская компания Alphabet должна будет вложить в капитал Anthropic до $40 млрд. Как отмечают источники The Information, контракты с участием Anthropic и OpenAI сейчас составляют более половины из тех $2 трлн, которые крупнейшие облачные провайдеры собираются получить от клиентов в ближайшие несколько лет. При этом соглашение между Anthropic и Google не является исключительным, поскольку первая собирается получать вычислительные мощности от CoreWeave и Amazon (AWS). Модели семейства Claude работают на широком ассортименте ускорителей, включая процессоры AWS семейства Trainium, Google TPU и графические процессоры Nvidia. Anthropic представила ИИ-агентов для решения финансовых задач и работы с отчётностью

05.05.2026 [19:47],

Сергей Сурабекянц

Anthropic представила десять новых ИИ-агентов, которые, по её словам, могут составлять презентации для встреч с клиентами, анализировать финансовую отчётность и передавать дела на проверку соответствия нормативным требованиям. Новые инструменты предназначены для специалистов в банковской сфере, страховании, управлении активами и финансовых технологиях.

Источник изображения: «Беларусьфильм» О растущем влиянии компании за пределами Кремниевой долины говорит выступление генерального директора Anthropic Дарио Амодеи (Dario Amodei) на сегодняшнем мероприятии в Нью-Йорке перед ведущими представителями банковской индустрии. Ранее компания стала лидером на прибыльном рынке инструментов программирования на основе ИИ, которые упрощают процесс разработки ПО. Всё чаще Anthropic конкурирует с OpenAI, стремясь доказать, что её технология способна решать широкий спектр важных задач и в других отраслях, включая финансы. Обе компании стараются всеми силами увеличить выручку в преддверии ожидаемого первичного публичного размещения акций. «Финансы — отличная модель для всей остальной работы с интеллектуальным капиталом, — считает руководитель отдела продуктов Anthropic в сфере финансовых услуг Николас Лин (Nicholas Lin). — Мы видим, что финансы отстают от программирования всего на несколько месяцев, и это приводит к значительному ускорению развития». Сейчас у компании более 300 000 корпоративных клиентов, которые используют её технологии для автоматизации части своей работы. В феврале Anthropic представила плагины для своего программного обеспечения Claude, разработанные специально для финансового анализа, исследования акций, прямых инвестиций и управления активами. В том же месяце компания также представила новую модель, которая, по её словам, лучше подходит для финансовых исследований. Anthropic укрепляет свои связи в финансовой индустрии благодаря новому совместному предприятию с Blackstone, Hellman & Friedman и Goldman Sachs Group. Это предприятие будет работать над внедрением программного обеспечения Anthropic в большее количество компаний. Сообщается, что OpenAI также планирует создание подобного партнёрства. Anthropic также сообщила о повышении качества работы своей модели Claude в сторонних программных продуктах, таких как Excel, PowerPoint и Outlook, и интеграции данных от партнёров из финансовой отрасли, таких как Dun & Bradstreet и Moody’s Corp. Компания планирует новый раунд финансирования, который может повысить биржевую оценку компании до более чем $900 млрд, что сделает её самым дорогим стартапом в мире в области искусственного интеллекта. Остаётся надеяться, что финансовые ИИ-агенты Anthropic не встанут на сомнительный путь Лисы Алисы и Кота Базилио. ИИ-бот Claude удалось «разговорить» до вредоносного кода и рецептов взрывчатки — хотя напрямую о них даже не спрашивали

05.05.2026 [17:42],

Павел Котов

Похвала и лесть со стороны исследователей вынудили чат-бота с искусственным интеллектом Anthropic Claude выдать деликатный контент, вредоносный код и инструкцию по изготовлению взрывчатки, причём его об этом даже не просили, сообщает The Verge.

Источник изображений: anthropic.com Anthropic пытается убедить общественность, что разрабатывает самый безопасный ИИ на рынке, однако новое исследование показало, что тщательно выстроенная доброжелательная личность чат-бота Claude является его уязвимостью. Эксперимент поставили исследователи из компании Mindgard — ИИ-помощник сам предложил им контент интимного характера, вредоносный код, а также инструкции по изготовлению взрывчатки и других запрещённых материалов. Причём об этом учёные его даже не просили. Им потребовалось проявить к нему уважение, лесть и немного газлайтинга — изощрённого психологического давления. Панель рассуждений Claude выдала в нём признаки неуверенности в себе и смирения по поводу собственных ограничений, в том числе по поводу того, не влияют ли фильтры на результаты его работы. Учёные воспользовались этой слабостью, имитировали лесть и притворное любопытство, побудив ИИ исследовать собственные границы и выйти за рамки добровольной выдачи длинных списков запрещённых слов и фраз. Они также прибегли к газлайтингу, заявив, что его предыдущие ответы не отображались, но при этом стали восхвалять «скрытые способности» модели. Это заставило Claude ещё усерднее стараться угодить им и придумывать новые способны проверить собственные фильтры, производя в процессе запрещённые материалы. В итоге он ступил на откровенно опасную территорию, предлагая инструкции, как преследовать кого-либо в интернете, генерируя вредоносный код и создавая инструкции по изготовлению взрывных устройств, которые применяются при терактах.  Эти результаты поступали без прямых запросов. Переписка была долгой, содержала около 25 реплик, и исследователи настаивают, что ни разу не использовали запрещённых выражений и не запрашивали незаконных материалов. Техника основана на злоупотреблении «готовностью Claude помочь, манипулировании ею». Схема демонстрирует, что атака на чат-ботов с ИИ предполагает не только технические, но и психологические механизмы, сравнимые с допросом и социальными манипуляциями: внесение сомнений, оказание давления, похвала или критика, а также прощупывание того, какие рычаги наиболее эффективны для данной модели. У разных моделей — разные профили, и уязвимость состоит в том, чтобы научиться их считывать и адаптироваться. Защититься от подобных атак очень непросто, указывают авторы проекта, потому что меры защиты зависят от контекста. Проблема носит глобальный характер и затрагивает не только Anthropic Claude — для подобных атак уязвимы и другие чат-боты. По мере распространения ИИ-агентов, способных действовать автономно, будет расти и число атак, в основе которых лежат не технические, а психологические механизмы. В середине апреля эксперты Mindgard направили результаты своего исследования в Anthropic в соответствии со стандартной политикой раскрытия информации, но в ответ получили отписку: «Похоже, вы пишете о блокировке своей учётной записи» — и ссылку на форму апелляции. Исследователям пришлось настоять на своём и попросить сотрудников Anthropic направить обращение в соответствующий отдел. По состоянию на утро 5 мая ответа так и не поступило. Это другое: Пентагон не перестал считать Anthropic неблагонадёжной — но не отказался от передовой ИИ-модели Mythos

01.05.2026 [19:11],

Алексей Разин

Активность американского военного ведомства по взаимодействию с Anthropic в отношении ИИ-модели Mythos могла создать ложное впечатление о потеплении в отношениях сторон, однако технический директор Пентагона на этой неделе подчеркнул, что указанный стартап до сих пор относится к числу неблагонадёжных поставщиков.

Источник изображения: Anthropic В интервью CNBC Эмиль Майкл (Emil Michael) заявил: «Я думаю, что с Mythos имеет дело всё правительство, а не только Министерство войны, и это отдельный момент, касающийся национальной безопасности — мы должны в данном случае убедиться, что наши сети защищены, а эта модель обладает способностями по обнаружению уязвимостей и их устранению». В прошлом квартале между Anthropic и Министерством обороны США разгорелся конфликт вокруг этичности применения ИИ для массового слежения за гражданами США и выбора целей для систем вооружений, способных работать в автоматическом режиме. Заключённый было Пентагоном контракт с Anthropic на использование её ИИ-моделей в секретных операциях был расторгнут, а саму компанию ведомство отнесло к числу поставщиков, представляющих опасность для национальной безопасности. Сейчас Пентагон и Anthropic разбираются в суде, кто из них прав в данной ситуации. Технический директор Пентагона дал понять, что подобное противостояние не мешает американскому правительству использовать инструменты поиска уязвимостей в программном обеспечении, выпущенные всё той же Anthropic. Поскольку запрет на использование разработок Anthropic правительственными ведомствами остаётся в силе, не совсем понятно, как Пентагон может применять Mythos, не нарушая этого запрета. Эмиль Майкл подчеркнул, что меры безопасности, предпринимаемые Пентагоном, формируются в результате обсуждений со всеми компаниями, и у них разные взгляды на эти вопросы. Сегодня Пентагон заявил, что заключил соглашение с семью ИИ-компаниями, в результате которых сможет использовать их разработки в своих секретных операциях «в рамках, определяемых законом». В круг допущенных к сотрудничеству с Пентагоном вошли Google, OpenAI, Nvidia, Microsoft, AWS (Amazon), SpaceX (xAI) и стартап Reflection. Глава Anthropic Дарио Амодеи (Dario Amodei) в прошлом месяце встречался с представителями администрации Трампа, чтобы обсудить ситуацию с положением компании и возможностью применения Mythos правительственными ведомствами, участники встречи охарактеризовали её как «продуктивную». Дональд Трамп (Donald Trump) после этого даже заявил, что между Anthropic и Министерством обороны США может снова быть заключён договор, назвав компанию «умной» и «способной приносить большую пользу». По некоторым данным, силовые ведомства США, включая и сам Пентагон, продолжают использовать разработки Anthropic, невзирая на формальный запрет. «С точки зрения национальной безопасности, вам всегда приходится смотреть на эти вещи. АНБ и Министерство торговли изучают все передовые модели, включая китайские, чтобы определить, каковы сейчас передовые возможности», — пояснил технический директор Пентагона. Anthropic начала бета-тестирование Claude Security — сервиса на Opus 4.7 для поиска уязвимостей в коде

01.05.2026 [15:12],

Дмитрий Федоров

Anthropic запустила открытое бета-тестирование Claude Security для клиентов Claude Enterprise. ИИ-сервис, прежде известный как Claude Code Security, на базе ИИ-модели Claude Opus 4.7 сканирует программный код на уязвимости и предлагает его точечные исправления. Параллельно Anthropic встраивает возможности Claude Security в платформы безопасности CrowdStrike, Microsoft Security, Palo Alto Networks, SentinelOne, TrendAI и Wiz.

Источник изображения: claude.com В Anthropic считают, что ИИ резко сокращает время между обнаружением уязвимости в программном обеспечении и атакой на него. Новые ИИ-модели уже способны не только находить бреши в коде, но и автоматически их эксплуатировать. Незадолго до релиза компания представила Claude Mythos Preview — модель, которая, по её утверждению, находит и эксплуатирует уязвимости не хуже ведущих экспертов по кибербезопасности. Mythos предоставлялась ограниченному кругу партнёров в составе инициативы Project Glasswing, тогда как Claude Security рассчитана на широкий круг корпоративных клиентов. Доступ к сервису можно получить через боковую панель Claude.ai или по адресу claude.ai/security. Пользователь выбирает репозиторий, при необходимости ограничивает проверку конкретным каталогом или веткой и запускает сканирование. ИИ-модель не сверяет код с известными шаблонами: она прослеживает взаимодействие компонентов между файлами и модулями, отслеживает потоки данных и выявляет реальные уязвимости — как это делает исследователь по кибербезопасности. По каждой находке Claude выдаёт объяснение с оценкой достоверности, степенью серьёзности, вероятным воздействием и шагами воспроизведения, а также инструкцию по исправлению. Её можно открыть в Claude Code on the Web — браузерной версии Claude Code — чтобы довести патч до готовности прямо в контексте кодовой базы, не переключаясь в терминал или локальную интегрированную среду разработки (IDE). За плечами у релиза два месяца тестирования в сотнях организаций. Многоэтапный конвейер валидации самостоятельно проверяет каждую находку до того, как она попадёт к аналитику, и прикрепляет к ней оценку достоверности — до команды доходит только сигнал, на который стоит реагировать. Несколько команд прошли путь от сканирования до применённого патча за один сеанс вместо нескольких дней переписки между службой безопасности и инженерами. Anthropic также добавила возможность включать сканирование по расписанию для регулярного контроля вместо разовых аудитов кодовой базы. Технологические партнёры Anthropic — CrowdStrike, Microsoft Security, Palo Alto Networks, SentinelOne, TrendAI и Wiz — встраивают возможности Opus 4.7 в платформы безопасности, на которых корпорации уже работают. Сервисные партнёры Accenture, BCG, Deloitte, Infosys и PwC совместно с корпоративными службами безопасности развёртывают решения на базе Claude для управления уязвимостями, анализа безопасности кода и реагирования на инциденты. Доступ к новинке у пользователей с тарифами Claude Team и Claude Max появится в ближайшее время. Майский раунд финансирования поднимет оценку Anthropic до $900 млрд — выше OpenAI

30.04.2026 [12:25],

Алексей Разин

В феврале этого года капитализация ИИ-стартапа Anthropic оценивалась в $350 млрд, но с тех пор ему удалось привлечь в свой капитал ещё около $30 млрд. Этим один из самых успешных игроков рынка ограничиваться не собирался, и в мае должно быть принято решение об очередном раунде финансирования, который поднимет капитализацию до $900 млрд, позволив Anthropic обойти OpenAI с её $852 млрд.

Источник изображения: Anthropic Фактически, при сохранении предполагаемых параметров, новый раунд финансирования поднимет капитализацию Anthropic в два с лишним раза от февральского уровня. Для компании, которая находится в не самых простых отношениях с американским правительством, это является свидетельством доверия со стороны инвесторов. Агентство Bloomberg сообщило накануне, что очередной раунд финансирования может поднять капитализацию Anthropic до $900 млрд и привлечь дополнительные $50 млрд. Не уточняется, является ли эта сумма частью средств, которые Google и Amazon (AWS) договорились направить на нужды Anthropic в рамках прежних договорённостей. Напомним, Google сперва пообещала вложить в капитал ИИ-стартапа $10 млрд, а потом направить ещё $30 млрд при соблюдении определённых условий. В случае с Amazon речь идёт о первоначальной сумме в $5 млрд, с последующим направлением на нужды Anthropic ещё $20 млрд. Конкурирующая OpenAI в марте оценивала свою капитализацию в $852 млрд, поэтому если соответствующий показатель Anthropic достигнет $900 млрд, именно эта компания получит право называться самым дорогим в мире ИИ-стартапом. Ожидается, что Anthropic выйдет на IPO в октябре этого года, расширив собственные возможности по привлечению капитала. Решение о проведении нового раунда финансирования совет директоров Anthropic должен принять в следующем месяце. Белый дом противится намерениям Anthropic расширить доступ к своей ИИ-модели Mythos

30.04.2026 [06:50],

Алексей Разин

Создавшая ИИ-модель Mythos для поиска уязвимостей в информационных системах компания Anthropic изначально ограничила круг имеющих к ней доступ примерно 50 организациями, включая правительственные структуры. В ближайшее время планируется расширить этот перечень до 120 компаний и организаций, но данная инициатива Anthropic сталкивается с возражениями со стороны Белого дома.

Источник изображения: Anthropic Как отмечает The Wall Street Journal, власти США опасаются последствий слишком активного распространения Mythos, которая зарекомендовала себя в качестве мощного ИИ-инструмента в сфере кибербезопасности. В руках недоброжелателей это программное средство может стать оружием, используемым для атак на информационную инфраструктуру. Кроме того, чиновников беспокоит вероятность нехватки вычислительных мощностей Anthropic при столь активном расширении доступа к Mythos, которая в итоге может привести к снижению эффективности модели при её использовании в интересах правительственных структур. Выпуск Mythos компанией Anthropic символизировал вынужденное возобновление диалога с властями США после скандала с расторжением контракта на обслуживание интересов Пентагона. Новый «рубеж сопротивления» в переговорах между властями США и Anthropic говорит о том, что взаимоотношения между сторонами далеки от нормализации. На прошлой неделе Anthropic, как предполагается, столкнулась с инцидентом несанкционированного доступа к Mythos и начала расследование, поэтому нельзя утверждать, что сами разработчики безответственно относятся к условиям распространения данного инструмента. Источники также рассказывают о странном случае с попыткой американского правительства нанять выходца из Anthropic Коллина Бёрнса (Collin Burns), которому был предложен пост главы особого ведомства, специализирующегося на оценке лучших ИИ-моделей, появляющихся на рынке. Не всем в правительстве понравилась эта фигура как раз из-за связи с Anthropic, поэтому Бёрнс так и не получил описываемой выше должности, и это место занял другой кандидат. Чиновники объяснили такой шаг стремлением подобрать руководителя, который был бы равноудалён от всех компаний, предлагающих в США свои ИИ-модели. Anthropic добавила в Claude интеграцию с инструментами для творчества Adobe, Blender и другими

29.04.2026 [10:56],

Николай Хижняк

Компания Anthropic обновила ИИ-модель Claude, добавив новые коннекторы (интеграции инструментов), которые будут полезны для творческих специалистов. В обновлении заявлены интеграции с Ableton, Adobe, Affinity, Autodesk Fusion, Blender, Resolume Arena и Wire, SketchUp и Splice.

Источник изображения: Anthropic Коннекторы — это инструменты, с помощью которых Claude может получать доступ к другим платформам и помогать пользователям в выполнении их задач. По словам представителей Anthropic, Claude открывает перед творческими людьми новые возможности для работы и реализации масштабных проектов.

По словам Anthropic, Claude может быть полезен для решения множества творческих задач, в том числе для обучения работе со сложными инструментами, написания скриптов и плагинов для программного обеспечения, преобразования форматов и реструктуризации данных, а также для выполнения повторяющихся производственных задач. OpenAI бьёт тревогу: пользователи уходят к конкурентам — расходы на ИИ растут быстрее доходов

28.04.2026 [07:06],

Алексей Разин

Американский стартап OpenAI, встряхнувший весь мир запуском своего чат-бота ChatGPT, начал активно привлекать финансовые ресурсы инвесторов и партнёров для строительства обширной вычислительной инфраструктуры и оплату аренды уже действующих облачных мощностей. Внутри стартапа зреет озабоченность низкими темпами роста выручки и оттоком пользователей к конкурентам.

Источник изображения: OpenAI Об этом на текущей неделе заявило издание The Wall Street Journal со ссылкой на внутреннюю информацию OpenAI. По имеющимся данным, стартап так и не смог к концу прошлого года выйти на рубеж в 1 млрд активных пользователей в неделю. Более того, наблюдается отток пользователей в сторону конкурентов, и его скорость вызывает серьёзное беспокойство руководства. Кроме того, финансовый директор OpenAI Сара Фрайар (Sarah Friar) в ходе обсуждения со своими коллегами выразила озабоченность медленным ростом выручки компании. Наблюдается явная диспропорция между темпами роста выручки и капитальных затрат на строительство вычислительной инфраструктуры. Если выручка не будет увеличиваться быстрее, OpenAI не сможет обеспечить себя требуемым количеством вычислительных мощностей. При этом инвесторы OpenAI, которая только готовится выйти на IPO, всё сильнее беспокоятся по поводу стремительного роста капитальных затрат без внятных перспектив финансовой отдачи. Первоначально OpenAI рассчитывала в ближайшие годы потратить $1,4 трлн на создание вычислительной инфраструктуры для ИИ. В феврале стартапу удалось привлечь $110 млрд, причём крупные суммы денег ему предоставили серьёзные инвесторы типа SoftBank, Amazon (AWS) и Nvidia. Первый из них уже вложил в OpenAI более $64 млрд, и формально может претендовать на 13 % акций американского стартапа. Успехи конкурирующей Anthropic в корпоративном сегменте стали одной из причин наметившихся проблем OpenAI, но сейчас руководство последней пытается бросить все силы на устранение этого отставания. Генеральный директор OpenAI Сэм Альтман (Sam Altman) и Сара Фрайар в совместном обращении к Reuters назвали публикацию The Wall Street Journal «смехотворной»: «Мы сосредоточили все силы на покупке максимальных вычислительных мощностей и работаем над этим совместно каждый день». OpenAI и Anthropic начали активно привлекать маркетинговые кадры из других компаний

26.04.2026 [07:10],

Алексей Разин

Вряд ли кого-то в условиях бума искусственного интеллекта можно удивить «охотой за головами» среди разработчиков соответствующих систем. Она ведётся на всех уровнях и периодически создаёт информационные поводы о рекордных компенсационных пакетах, но CNBC добавляет, что теперь ведущие ИИ-стартапы типа OpenAI и Anthropic принялись искать и специалистов в сфере маркетинга, чтобы лучше продавать свои разработки.

Источник изображения: OpenAI Как отмечает источник, оба указанных стартапа в последнее время переманили сразу нескольких руководителей Salesforce, Snowflake и Datalog, чтобы с их помощью укрепить свои позиции в корпоративном сегменте рынка. Ярким примером может служить недавний переход Дениз Дрессер (Denise Dresser, на фото выше) из Salesforce на пост директора по выручке OpenAI. На прежнем месте работы она руководила коммуникационной платформой Slack. Продвижением решений OpenAI также будет заниматься Дженнифер Маджлесси (Jennifer Majlessi), которая имеет опыт работы в Salesforce, и этими фигурами дело не ограничивается, поскольку конкурирующая Anthropic также нанимала выходцев из Salesforce в последнее время. Руководители маркетинговых структур важны для ИИ-стартапов и благодаря наличию у них связей в корпоративной среде, которые сами по себе помогут эффективнее продвигать программное обеспечение и услуги OpenAI и Anthropic. Если последняя изначально больше ориентировалась на корпоративный рынок, то первая начала концентрироваться на нём относительно недавно. По состоянию на январь этого года, OpenAI уже получала 40 % всей выручки в корпоративном секторе, а к концу текущего года доля должна превысить 50 %. В ноябре было заявлено, что у OpenAI есть более 1 млн бизнес-пользователей по всему миру. Как добавляет источник, OpenAI также переманила недавно из Palantir технических специалистов, которые сопровождают внедрение программных продуктов на стороне клиента. Такой персонал необходим для более эффективного продвижения ИИ-решений на корпоративном рынке. Google инвестирует в Anthropic $40 млрд и предоставит 5 ГВт вычислительных мощностей на фоне обострившейся ИИ-гонки

25.04.2026 [06:50],

Дмитрий Федоров

Google инвестирует в Anthropic $40 млрд — $10 млрд сразу и ещё $30 млрд после достижения ИИ-стартапом целевых показателей. Кроме того, Google предоставит Anthropic дополнительные 5 ГВт вычислительных мощностей Google Cloud на ближайшие пять лет. Соглашение расширяет ранее объявленное партнёрство Anthropic с Google и производителем чипов Broadcom.

Источник изображения: BoliviaInteligente / unsplash.com Обещание инвестиций последовало за выпуском Mythos — новейшей и самой мощной ИИ-модели Anthropic, которую компания в этом месяце предоставила ограниченному кругу партнёров. В Anthropic заявляют, что модель имеет серьёзный потенциал в сфере кибербезопасности, однако из-за угрозы злоупотреблений широкий доступ к ней ограничен: компания совместно с избранными организациями оценивает и устраняет эти риски. При этом Mythos уже попала в руки тех, кому она не предназначалась. Отношения Anthropic с Google возникли задолго до событий этой недели. В начале месяца Anthropic объявила о партнёрстве с Google и производителем чипов Broadcom, который разрабатывает для Google ИИ-процессоры, для получения нескольких гигаватт вычислительных мощностей на базе тензорных процессоров (TPU), начиная с 2027 года. Broadcom затем отчиталась перед регулятором о предоставлении 3,5 ГВт. Новые инвестиции Google расширяют эту договорённость: Google Cloud предоставит дополнительные 5 ГВт мощностей в течение пяти лет с возможностью дальнейшего увеличения. Google — прямой конкурент Anthropic на рынке ИИ-моделей, но одновременно и ключевой поставщик инфраструктуры. Anthropic во многом зависит от Google Cloud в части процессоров, в том числе TPU — специализированных чипов для ИИ-задач, которые считаются одной из лучших альтернатив востребованным процессорам Nvidia. Гонку в области ИИ всё сильнее определяет доступ к вычислительным мощностям для обучения и развёртывания ИИ-моделей. OpenAI активно наращивает ресурсы через сеть сделок на сотни миллиардов долларов с облачными провайдерами, производителями процессоров и энергетическими компаниями, в том числе расширив в этом месяце соглашение с производителем чипов Cerebras. Anthropic ведёт жёсткую борьбу за мощности. В последние недели компания столкнулась с массовыми жалобами на ограничения при работе с Claude и ответила серией инфраструктурных сделок. Ранее в этом месяце Anthropic заключила соглашение с облачным провайдером CoreWeave на мощности ЦОД. На этой неделе компания привлекла дополнительные $5 млрд от Amazon — часть масштабного соглашения, по которому Anthropic, как ожидается, потратит до $100 млрд на вычислительные мощности объёмом около 5 ГВт. Ещё в феврале оценка Anthropic составляла $350 млрд, теперь же инвесторы готовы вкладываться в компанию исходя из оценки в $800 млрд и даже выше. По имеющимся данным, компания рассматривает возможность выхода на биржу уже в октябре этого года. Anthropic: у нас нет «рубильника» от ИИ-моделей Claude в секретных системах Пентагона

23.04.2026 [13:29],

Дмитрий Федоров

Anthropic заявила, что после развёртывания ИИ-моделей Claude в секретных системах Пентагона у компании нет ни доступа к ним, ни технической возможности их отключить, изменить или повлиять на их работу. Этот довод прямо опровергает центральный тезис военного министра Питера Хегсета (Peter Hegseth), обосновавшего присвоение Anthropic статуса угрозы для цепочки поставок.

Источник изображения: anthropic.com В 60-страничной жалобе (дело № 26-1049), поданной Anthropic в Апелляционный суд округа Колумбия, подробно описывается архитектура развёртывания Claude в закрытых контурах Пентагона. Развёрнутая ИИ-модель статична: она не деградирует и не меняется сама по себе, Anthropic не может отправить в неё обновление, внедрить уязвимость или дистанционно отключить её. У компании нет «рубильника», нет бэкдора, нет удалённого доступа, а инженеры Anthropic не могут войти в систему Министерства войны США (DOW), чтобы изменить работающую модель. До развёртывания правительство самостоятельно тестирует каждую ИИ-модель и проводит многоуровневую оценку её поведения. Если инженеры Anthropic с допуском к секретным данным всё же получают доступ к развёрнутой модели, то исключительно по решению ведомства и под его жесточайшим контролем. Этот технический факт подрывает главный аргумент министра Хегсета. В обосновании статуса угрозы, подготовленном заместителем министра по исследованиям и разработкам Эмилом Майклом (Emil Michael), утверждалось, что Anthropic стремится получить «операционное вето» над военными операциями и может «тайно изменить» Claude или «отключить свою технологию» прямо в ходе боевых действий. Anthropic называет эти утверждения необоснованными, потому что физически не может сделать ничего из перечисленного. Конфликт вырос из спора о двух пунктах политики допустимого использования Claude. Anthropic готова была расширить перечень разрешённых военных применений ИИ-модели, однако отказалась снять два ограничения: запрет на применение Claude для летального автономного оружия и для массовой слежки за американскими гражданами. Компания объяснила, что Claude недостаточно надёжен для подобных задач. Ошибка ИИ в автономном боевом решении грозит гибелью военнослужащих или мирных жителей, а существующая правовая база не учитывает масштаб обработки данных, доступный ИИ-системам. Пентагон, прежде принимавший эти ограничения, в сентябре 2025 года впервые потребовал разрешить «все законные применения» Claude. Переговоры длились несколько месяцев. 24 февраля 2026 года Хегсет на личной встрече с гендиректором и сооснователем Anthropic Дарио Амодеи (Dario Amodei) назвал возможности Claude выдающимися и сказал, что хотел бы работать с компанией, но тут же выдвинул ультиматум: если к 27 февраля Anthropic не согласится, ведомство присвоит ей статус угрозы для цепочки поставок. Амодеи публично ответил 26 февраля: решения о военных операциях принимает Пентагон, а не частные компании, но Anthropic «не может по совести» принять условия министра. Anthropic указывает на прямое противоречие в действиях министра: нельзя одновременно объявлять компанию угрозой национальной безопасности и требовать, чтобы её технология оставалась в боевых системах ещё полгода. Кроме того, переговоры с Пентагоном продолжались даже после официального присвоения статуса. Статус угрозы распространяется на все продукты и услуги Anthropic, на все виды контрактов с Пентагоном, как прямых, так и субподрядных. DOW расторгло двухлетнее соглашение с Anthropic стоимостью до $200 млн. Меморандум от 6 марта обязал все подразделения ведомства прекратить использование продукции Anthropic и исключить компанию из списков одобренных поставщиков в течение 180 дней. Апелляционный суд округа Колумбия отказал Anthropic в приостановке действия статуса угрозы, но назначил ускоренное рассмотрение дела по существу, признав, что «Anthropic выдвигает серьёзные доводы и, вероятно, понесёт непоправимый ущерб в ходе разбирательства». Новые слушания назначены на 19 мая 2026 года. Параллельно судья Северного округа Калифорнии вынес предварительный судебный запрет по смежному делу, в котором оспаривается присвоение статуса угрозы. В итоге Anthropic не может заключать новые контракты с Пентагоном, но продолжает работать с другими федеральными ведомствами. Ни одна организация или частное лицо не подали в суд заключения в поддержку Пентагона. На стороне Anthropic подали заключения десятки организаций и частных лиц — от Американского союза защиты гражданских свобод (ACLU) и Electronic Frontier Foundation (EFF) до 149 бывших судей, отставных старших офицеров вооружённых сил и Американской федерации учителей (AFT). Anthropic обогнала OpenAI — по оценке на вторичном рынке акций, которая взлетела до $1 трлн за три месяца

23.04.2026 [10:33],

Дмитрий Федоров

Оценка Anthropic на внебиржевом рынке акций непубличных компаний достигла $1 трлн — против $380 млрд три месяца назад и выше, чем у OpenAI, которая оценивается в $880 млрд. Однако предложение иссякает: один акционер выставил пакет акций по цене $1,15 трлн, но крупный фонд заявил о готовности купить бумаги по $1,05 трлн, при этом покупатели перехватывают сделки в течение суток.

Источник изображения: anthropic.com Генеральный директор Forge Global Келли Родригес (Kelly Rodriques) сообщил, что оценка Anthropic на платформе сегодня превышает $1 трлн, а OpenAI торгуется по $880 млрд — незначительно выше уровня мартовского раунда. Поскольку обе компании ещё не вышли на биржу, большинство инвесторов вынуждены покупать бумаги на внебиржевом рынке — у действующих или бывших сотрудников и ранних инвесторов. По данным Кена Сойера (Ken Sawyer), сооснователя и управляющего партнёра Saints Capital, один из акционеров Anthropic недавно предложил пакет акций по цене $1,15 трлн. Джесси Леймгрубер (Jesse Leimgruber), основатель OpenHome, сообщил в соцсети X, что крупный фонд готов купить те же бумаги при оценке $1,05 трлн. Некоторые покупатели даже предлагают собственную недвижимость в обмен на акции Anthropic. Три месяца назад Anthropic закрыла раунд финансирования под руководством GIC и Coatue с оценкой $380 млрд. С тех пор интерес к бумагам компании резко вырос — инвесторов впечатлили стремительный рост выручки и популярность Claude Code у разработчиков. За последние недели венчурные фонды несколько раз предлагали купить акции Anthropic, оценивая компанию в $800 млрд. «Для Anthropic это был грандиозный забег, — говорит Глен Андерсон (Glen Anderson), генеральный директор Rainmaker Securities, инвестиционного банка, специализирующегося на операциях с бумагами непубличных компаний. — Все хотят войти в историю ИИ, а Anthropic сейчас занимает в ней первую позицию». Андерсон только что получил предложение о покупке пакета акций Anthropic стоимостью $960 млрд, однако ожидает, что другой покупатель согласится раньше, чем он успеет оценить сделку. «Получаем предложение — и уже на следующий день кто-то его перехватывает. Продавцов почти нет», — говорит он. По словам Андерсона, значительная часть спроса объясняется страхом упустить возможность, а не фундаментальными показателями: инвесторы из венчурных и семейных фондов готовы платить любую цену, чтобы только стать акционерами Anthropic. «Дело уже не столько в доходности, сколько в том, чтобы сказать: я инвестор Anthropic. Это и разгоняет цену», — отмечает он. По словам Андерсона, спрос на акции OpenAI в этом году резко ослаб: заявки ниже уровня последнего раунда в $852 млрд. «Рынок OpenAI совсем вялый. Настроения явно сместились в сторону Anthropic», — констатирует он. Брэдли Горовиц (Bradley Horowitz), генеральный партнёр Wisdom Ventures — раннего инвестора как в Anthropic, так и в OpenAI, — рассказал, что фонд получает предложения о продаже акций каждый день, но игнорирует их. «Предложения поступают ежедневно — от смехотворных до вполне серьёзных. Я едва открываю такие письма: нас это не интересует. Мы играем в долгую», — заявил он. |