|

Опрос

|

реклама

Быстрый переход

Новый раунд финансирования оценивает Anthropic в $800 млрд — до OpenAI рукой подать

15.04.2026 [05:09],

Алексей Разин

Ещё недавно считалось, что по величине капитализации OpenAI существенно обходит конкурирующую Anthropic, поскольку речь шла о суммах около $852 млрд и $380 млрд соответственно. Новый раунд финансирования второго из стартапов позволит ему поднять планку до $800 млрд и сократить разрыв.  Как отмечали вчера осведомлённые источники, на данном этапе инвесторы проявляют больше интереса к вложению средств в капитал Anthropic, даже с учётом конфликта этой компании с Пентагоном. В конце февраля капитализация стартапа достигала $380 млрд с учётом раунда финансирования, по итогам которого удалось привлечь $30 млрд. Накануне издание Business Insider сообщило о новом раунде финансирования, который может поднять капитализацию Anthropic до $800 млрд. Впрочем, пока лишь ведутся переговоры, и утверждать, что раунд точно состоится на указанных условиях, преждевременно. Чем выше ставки в финансовой сфере, тем более требовательными могут быть инвесторы, поэтому не факт, что указанная сумма может быть привлечена. Ожидается, что на IPO компания выйдет в октябре этого года. На данном этапе инвесторов во многом воодушевляют темпы роста выручки Anthropic. Если экстраполировать месячную сумму до годового объёма, то получится около $30 млрд. Правда, конкурирующая OpenAI выражает сомнения в корректности методики расчёта этой выручки, настаивая на снижении суммы хотя бы на $8 млрд. Инвесторы усомнились, что OpenAI действительно стоит $852 млрд — компания пытается исправить впечатление

14.04.2026 [11:02],

Алексей Разин

Возросшую активность OpenAI в сфере пересмотра стратегии и концентрации на приоритетных направлениях деятельности принято связывать с подготовкой к IPO. Последний раунд частного размещения позволил поднять капитализацию стартапа до $852 млрд, но не все инвесторы единодушны в подобной оценке. При этом чувствуется, что высокая конкуренция заставляет руководство OpenAI спешно устранять слабые места в своей стратегии.

Источник изображений: OpenAI Обширный материал на эту тему опубликовало издание Financial Times. Стремление OpenAI переключиться на обслуживание корпоративных клиентов усиливает конкуренцию с Anthropic, и нельзя утверждать, что в этом сегменте преимущество на стороне первого из стартапов. Google также агрессивно действует в корпоративном сегменте рынка ИИ, поэтому для OpenAI концентрация на нём формирует новые вызовы. Один из ранних инвесторов в OpenAI заявил Financial Times: «У вас есть ChatGPT, растущий на 50–100 % ежегодно бизнес с миллиардной пользовательской аудитории, так почему же вы говорите о предприятиях и написании кода? Эта компания очень сильно расфокусирована». В прошлом месяце OpenAI привлекла $122 млрд, которые предоставила группа из 25 крупных стратегических и институциональных инвесторов, включая SoftBank, Amazon и Nvidia, и около $3 млрд впервые были получены от частных инвесторов. По мнению руководства OpenAI, превышение спросом предложения в рамках этого раунда финансирования и рекордная сумма привлечения средств доказывают, что интерес инвесторов к деятельности компании и их доверие по-прежнему высоки. Руководство OpenAI даже предприняло попытки «разоблачить» конкурирующую Anthropic в некорректном отображении приведённой годовой выручки, которая на конец марта в последнем случае оценивалась в $30 млрд. Как подчёркивает директор OpenAI по выручке Дениз Дрессер (Denise Dresser), эта сумма завышена примерно на $8 млрд за счёт частичного переноса профильной выручки, получаемой Amazon и Google. Сама OpenAI на конец февраля располагала приведённой годовой выручкой в размере $25 млрд. Дрессер признаёт, что ранняя концентрация на корпоративном рынке дала Anthropic определённое преимущество, но в OpenAI убеждены, что смогут завоевать этот рынок. К концу текущего года до половины всей выручки стартап рассчитывает получать именно с корпоративных клиентов.  Некоторые инвесторы OpenAI признались, что выделяя средства на нужды стартапа сейчас, они исходили из оценки его капитализации в размере $1,2 трлн по итогам IPO. При этом Anthropic сейчас оценивается в $380 млрд, и некоторым потенциальным инвесторам капитализация OpenAI на текущих уровнях кажется завышенной. С такими аппетитами, по мнению некоторых инвесторов, OpenAI рискует оказаться на «спорной территории» с точки зрения привлечения капитала. Косвенные данные позволяют судить, что спрос на инвестиции в капитал Anthropic сейчас выше, чем в случае с OpenAI. Инвесторы впервые готовы больше переплачивать, вкладывая средства в Anthropic, чем в OpenAI. Существует определённый беспорядок в использовании компанией OpenAI привлечённых средств. Две недели назад стартап за несколько сотен миллионов долларов США купил канал TBPN, хотя такая сделка в медийной сфере вызвала вопросы. Руководство предпочло парировать заявлениями о том, что TBPN не будет отвлекать на себя вычислительные ресурсы. Закрытие генератора видео Sora оставило OpenAI без средств Disney, которая должна была вложить $1 млрд. Microsoft пригрозила OpenAI иском после заключения последней из компаний сделки с Amazon на $50 млрд. Реализация мегапроекта Stargate тоже продвигается в усечённом варианте: отменено строительство ЦОД в Великобритании за $30 млрд, площадка в Техасе будет расширяться не так активно, как планировалось изначально. Nvidia также в пять раз сократила масштабы своей сделки с OpenAI, которая сперва подразумевала инвестиции в размере $100 млрд. Впрочем, OpenAI всё равно планирует до конца года увеличить численность персонала в два раза до 8000 человек и довести долю выручки на корпоративном направлении до 50 % от совокупной. В Лондоне со следующего года расположится крупнейший исследовательский центр компании за пределами США. Руководство OpenAI недавно сообщило инвесторам, что располагает доступом к 8 ГВт вычислительных мощностей, тогда как Anthropic на этот уровень ранее конца 2027 года не выйдет, а к 2030 году сама OpenAI рассчитывает располагать доступом к 30 ГВт вычислительных мощностей. Anthropic то и дело сталкивается со сбоями в работе инфраструктуры и нехваткой вычислительных мощностей. В OpenAI утверждают, что даже если их модели и отстают от созданных Anthropic, они хотя бы могут стабильно работать. Представители Anthropic пояснили, что компания будет придерживаться разумного подхода к масштабированию вычислительных мощностей. OpenAI меняет приоритеты в своём развитии. Помимо отказа от сервиса генерации видео Sora, компания свернула проект по запуску чат-бота с эротическим уклоном. Теперь прилагаются усилия по продвижению сервиса Codex в корпоративной среде, который призван упростить жизнь разработчикам ПО. Некоторые знакомые с планами OpenAI источники даже утверждают, что Codex может оказаться самым главным направлением бизнеса стартапа, обойдя ChatGPT. По крайней мере, этот вид деятельности обеспечивает значительно более высокую прибыль. Некоторые инвесторы приветствуют такие преобразования в стратегии OpenAI, другие опасаются, что все эти метания говорят об отсутствии чётко обозначенных целей. В любом случае, привлекать инвестиции OpenAI это пока не мешает. Anthropic ускорила рост в США и заметно сократила отставание от OpenAI на корпоративном рынке ИИ-сервисов

11.04.2026 [14:14],

Дмитрий Федоров

Anthropic сократила разрыв с OpenAI на рынке платных ИИ-сервисов для американского бизнеса. В марте её инструменты оплачивала почти треть компаний в США, тогда как доля OpenAI не выросла и осталась на уровне 35 %. Данные финтех-компании Ramp показывают ускорение спроса на решения Anthropic и выравнивание роста OpenAI после раннего рывка, вызванного запуском ChatGPT.

Источник изображения: anthropic.com Ramp связывает рост Anthropic с высоким спросом на линейку Claude Code и набор расширений для автоматизации части задач умственного и административного труда. Оценка основана на ежегодных расходах 50 тыс. клиентов по банковским картам и выставленным счетам на общую сумму $100 млрд. За месяц доля компаний в США, плативших за инструменты Anthropic, выросла более чем на 6 процентных пунктов. OpenAI сохраняет лидерство, обеспеченное запуском ChatGPT в ноябре 2022 года, прежде всего на массовом рынке: компания заявляла о 900 млн еженедельно активных пользователей, из которых платят немногим более 5 %. По оценке Sensor Tower, в марте число загрузок ChatGPT выросло лишь на 5 %, тогда как у Claude за тот же период мировые загрузки утроились и достигли 21 млн. На этой неделе Anthropic заявила, что довела выручку в пересчёте на год по текущему темпу до $30 млрд против $9 млрд в конце 2025 года. Аналитическая компания Apptopia зафиксировала в марте первое с начала 2024 года снижение числа еженедельно активных пользователей ChatGPT в США по сравнению с предыдущим месяцем. OpenAI эти данные не признала и заявила, что её инструмент для программирования на основе ИИ Codex увеличил недельную аудиторию до 3 млн пользователей против 2 млн месяцем ранее. OpenAI перестраивает управление и усиливает внимание к основным направлениям бизнеса перед планируемым выходом на биржу. Это уже привело к кадровым перестановкам и отказу от второстепенных направлений, из-за чего компания закрыла сервис создания видео Sora. Вице-президент и ведущий аналитик Forrester Чарли Дай (Charlie Dai) назвал происходящее явным сдвигом динамики в пользу Anthropic. По его словам, рост компании продолжается и после того, как Министерство войны США (DoW) указало на возможные риски в цепочке снабжения. Для многих компаний важнее краткосрочных политических и надзорных сигналов качество работы ИИ-моделей, удобство работы с ними и соответствие потребностям крупных организаций. Экономист Ramp Ара Харазян (Ara Kharazian) связал рост Anthropic с её стратегией: сначала компания ориентировалась на разработчиков и других специалистов, а затем начала выходить на более широкую аудиторию. По его оценке, Anthropic сумела превратить продукт для наиболее опытных пользователей и тех, кто осваивает новинки раньше других, в решение, применимое и за пределами этого круга. По данным Ramp, продукты Anthropic в США используются шире, чем решения OpenAI, в информационном секторе, финансовых услугах и сфере профессиональных услуг. Одновременно их распространение быстро растёт в строительстве и гостиничном деле. OpenAI ранее оспаривала точность оценок Ramp, утверждая, что они не учитывают многомиллионные договоры с крупными компаниями. Сооснователь Ramp Эрик Глайман (Eric Glyman) сообщал в сети X, что корпоративная платёжная платформа компании обрабатывает платежи объёмом до 1 % валового внутреннего продукта США, а её оценки согласуются с показателями выручки OpenAI и Anthropic. Anthropic временно заблокировала создателя OpenClaw в Claude, но быстро отыграла назад

11.04.2026 [12:58],

Дмитрий Федоров

Anthropic на несколько часов заблокировала доступ к Claude создателю OpenClaw Петеру Штайнбергеру (Peter Steinberger), а затем восстановила аккаунт после резонанса в соцсети X. Инцидент произошёл вскоре после того, как компания вывела OpenClaw из подписки на Claude и перевела такую работу на отдельную оплату через программный интерфейс (API), хотя Штайнбергер утверждал, что уже соблюдал новые правила.

Источник изображения: openclaw.ai Штайнбергер написал в X, что поддерживать совместимость OpenClaw с ИИ-моделями Anthropic теперь будет сложнее, и приложил уведомление о блокировке учётной записи из-за «подозрительной» активности. Среди сотен комментариев появился ответ инженера Anthropic. Он написал, что компания никогда не блокировала пользователей за работу с OpenClaw, и предложил помочь. Повлияло ли это на разблокировку, неясно.

Источник изображения: @steipete / x.com Блокировка последовала за пересмотром условий работы с Claude. На прошлой неделе Anthropic объявила, что подписка больше не покрывает сторонние управляющие оболочки, включая OpenClaw. Теперь такая работа оплачивается отдельно, по объёму использования, через API Claude. Компания объяснила это тем, что подписка не рассчитана на такую нагрузку. Подобные оболочки могут требовать больше вычислительных ресурсов, чем обычные запросы или простые сценарии, поскольку способны непрерывно запускать циклы рассуждения, автоматически повторять или перезапускать задачи и связываться со множеством сторонних инструментов. Штайнбергер это объяснение отверг. После изменения правил оплаты он написал, что Anthropic сначала перенесла часть популярных функций в собственную закрытую оболочку, а затем отсекла решения с открытым исходным кодом. Он не уточнил, что именно имеет в виду, но речь могла идти о новых возможностях помощника Cowork, включая Claude Dispatch для удалённого управления агентами и назначения задач. Dispatch появился за пару недель до изменения ценовой политики для OpenClaw. Дополнительное внимание к истории привлекло то, что Штайнбергер работает в OpenAI, конкуренте Anthropic. На реплику о том, что он выбрал не ту компанию, Штайнбергер ответил: «Одни меня приняли, другие прислали юридические угрозы». На вопрос, зачем он использует Claude вместо ИИ-моделей работодателя, Штайнбергер ответил, что обращается к нему только для тестирования, чтобы обновления OpenClaw не нарушили работу у пользователей Claude. Он отделил работу в OpenClaw, где задача его состоит в обеспечении совместимости с любым поставщиком ИИ-моделей, от работы в OpenAI, связанной с дальнейшей продуктовой стратегией. Комментаторы также указали, что Claude остаётся более популярным выбором среди пользователей OpenClaw, чем ChatGPT. OpenAI и Anthropic бросились мериться дата-центрами перед инвесторами

10.04.2026 [07:16],

Алексей Разин

Нужда в дополнительных капитальных вливаниях в этом году толкает к IPO сразу три крупнейших стартапа в сфере ИИ: SpaceX (xAI), OpenAI и Anthropic. Пока не определены сроки их выхода на биржу, но конкуренция за кошельки инвесторов между ними уже разгорается. Недавно OpenAI и Anthropic поспорили, кто из них сможет быстрее развивать вычислительную инфраструктуру.

Источник изображения: Anthropic Как отмечают CNBC и Bloomberg, компания OpenAI направила инвесторам памятку, в которой сравнила собственные планы по строительству центров обработки данных на ближайшие годы с амбициями Anthropic в данной сфере. По словам представителей OpenAI, этот конкурент будет наращивать свои вычислительные мощности не столь интенсивно. Если OpenAI к 2030 году рассчитывает иметь доступ к 30 ГВт вычислительных мощностей, то у Anthropic к концу 2027 года будет от 7 до 8 ГВт таких мощностей, как предполагает основной конкурент. OpenAI уверена, что сможет развивать собственную инфраструктуру с большим превосходством над Anthropic, лучше обеспечивая спрос на ИИ-инструменты адекватным предложением. В 2025 году OpenAI располагала 1,9 ГВт вычислительных мощностей, в три раза больше, чем за год до этого. Для сравнения, Anthropic прошлый год завершила с 1,4 ГВт доступных вычислительных мощностей. OpenAI в своей памятке для инвесторов объясняет необходимость экстенсивного развития вычислительной инфраструктуры возможностью не только совершенствовать сами ИИ-модели, но и снижения удельной стоимости обслуживания каждого токена. При этом появление более совершенных ИИ-моделей, по мнению руководства компании, позволяет увеличивать выручку от их распространения. Кроме того, OpenAI видит свою миссию в предоставлении ИИ-инструментов на безвозмездной основе «сотням миллионов пользователей», и наличие обширной вычислительной инфраструктуры этому будет способствовать. На её развитие до 2030 года OpenAI рассчитывает направить около $600 млрд. Эта компания заявила инвесторам, что Anthropic придерживается более консервативных планов не из-за разумной осторожности, а просто недооценивая потенциал спроса на соответствующие услуги. Anthropic тоже задумалась о разработке собственных ИИ-чипов

10.04.2026 [04:59],

Алексей Разин

Огромные масштабы проектов в сфере искусственного интеллекта заставляют участников рынка предлагать смелые инициативы. Не желающая уступать OpenAI компания Anthropic, по некоторым данным, изучает возможность разработки собственных ИИ-чипов для использования в вычислительной инфраструктуре.

Источник изображения: Samsung Electronics Как отмечает Reuters, такое предложение обсуждается внутри Anthropic в качестве одного из возможных ответов на сложившийся в отрасли дефицит компонентов подобного класса. Впрочем, альтернативный сценарий предполагает закупку чипов, поэтому взяться за разработку собственных Anthropic ещё может и не решиться. Пока не сформировано даже предварительное представление о том, какими должны быть разрабатываемые чипы, и кто внутри компании будет за них отвечать. На этой неделе Anthropic сообщила, что её выручка в приведённом к году объёме уже превысила $30 млрд, хотя по состоянию на конец прошлого года она достигала всего лишь $9 млрд. В настоящее время Anthropic использует сочетание различных чипов для формирования своей вычислительной инфраструктуры, включая разработанные Google и конкурирующей Amazon решения. На этой неделе между Anthropic, Google и Broadcom было подписано долгосрочное соглашение, касающееся поставок чипов TPU. В развитие вычислительной инфраструктуры в США стартап готов вложить $50 млрд. Meta✴✴ и OpenAI также проявляют интерес к теме разработки собственных чипов, причём первая имеет в этой сфере определённый практический опыт. В современных условиях только разработка чипа может потребовать до $500 млн, а ещё необходимо найти подрядчиков по их производству в необходимых количествах, что в условиях дефицита мощностей сделать становится всё сложнее. Anthropic оставили в «чёрном списке» — Пентагон выиграл апелляцию

09.04.2026 [04:48],

Алексей Разин

В конце февраля Министерство войны США внесло Anthropic в перечень неблагонадёжных поставщиков и приняло решение отказаться от услуг компании по использованию ИИ в военных операциях. Если в конце марта окружной суд поддержал Anthropic, признав включение компании в такой список незаконным, то апелляционный суд соответствующей инстанции на днях поддержал позицию Пентагона. Таким образом, условий для победы Anthropic в данном противостоянии пока не создано.

Источник изображения: Anthropic Федеральный апелляционный суд в Вашингтоне, как отмечает Bloomberg, на этой неделе отверг требования Anthropic о приостановке отнесения компании к перечню неблагонадёжных поставщиков. Следующее заседание апелляционного суда, на котором будут выслушаны аргументы сторон, намечено на 19 мая, и по меркам судебной системы это весьма сжатые сроки рассмотрения. Суд подчёркивает, что намерен не затягивать с рассмотрением дела, поскольку Anthropic может понести непоправимый ущерб, и действовать нужно быстро. Anthropic подобный подход суда к рассмотрению дела оценила одобрительно. Текущий вердикт апелляционного суда оставляет в силе решение Пентагона о внесении Anthropic в число неблагонадёжных поставщиков и позволяет властям США расторгнуть все контракты с компанией, причинив ей потенциальный ущерб на несколько миллиардов долларов. Как сообщается в решении коллегии из трёх судей, «на одной чаше весов находится ограниченный финансовый ущерб единственной частной компании, а на другой — вопрос использования важной ИИ-технологии в активной фазе военного конфликта». По мнению коллегии суда, «баланс справедливости» в данной ситуации смещается в сторону правительства США. В текущей ситуации Anthropic теряет возможность работать с Министерством войны США, но сохраняет право обслуживать другие правительственные структуры, пока в деле не поставлена точка. Подрядчики Пентагона не смогут использовать тот же Claude в рамках исполнения контрактов с данным ведомством, но им никто не запрещает применять чат-бот для других целей. Действующий генеральный прокурор США Тодд Бланш (Todd Blanche) поддержал решение апелляционного суда, подчеркнув, что «операционный контроль и военная власть принадлежат Верховному главнокомандующему и Министерству Войны, а не технологической компании». После смещения фокуса на ИИ-агентов выручка Perplexity подскочила на 50 %

08.04.2026 [10:39],

Алексей Разин

Финансовая отчётность стартапов доступна только узкому кругу инвесторов, а в сегменте искусственного интеллекта она ещё и не часто радует их достижением прибыли. При этом инвесторы ищут иные сигналы к улучшению ситуации в бизнесе таких компаний. По данным Financial Times, стартап Perplexity выиграл в деньгах, сместив приоритет в сторону создания ИИ-агентов.

Источник изображения: Perplexity Ранее эта компания концентрировалась на развитии чат-ботов, интегрированных в поисковый сервис, и с технической точки зрения они даже начали представлять серьёзную конкурентную угрозу для бизнеса Google, но недавно Perplexity сочла нужным больше внимания уделять развитию ИИ-агентов и монетизации соответствующих сервисов. В совокупности эти усилия привели к тому, что по итогам марта выручка Perplexity последовательно выросла до $450 млн в приведённом годовом выражении. Это на 50 % больше, чем наблюдалось в феврале этого же года. Стартап располагает более чем 100 млн активных пользователей в ежемесячном исчислении, они в какой-то пропорции делятся между поисковым и агентским сервисами Perplexity. Компании уже удалось заполучить десятки тысяч корпоративных клиентов. Подписка приносит Perplexity от $20 до $200 с каждого клиента. После запуска ИИ-агента Computer в феврале этого года компания также добавила модель ценообразования, завязанную на активность пользователя. Самые активные подписчики ежемесячно получают внутренние виртуальные кредиты, которыми могут оплачивать услуги Perplexity, но превышение квоты подразумевает доплату с их стороны. До введения этого новшества приведённая годовая выручка Perplexity достигала $305 млн, увеличившись с $16 млн всего за два года. Конкуренты, тем временем, получают гораздо больше: Cursor подняла планку до $2 млрд выручки в годовом приведённом значении, Anthropic вышла на уровень в $19 млрд к концу февраля, а OpenAI преодолела планку в $20 млрд ещё в прошлом году. В прошлом году Perplexity запустила ИИ-браузер Comet, в этом представила ИИ-агента Computer, а ещё она предложила средство работы с несколькими ИИ-моделями Model Council, которое позволяет наглядно сравнивать выдаваемые ими ответы на один и тот же запрос. По мере роста агентской вычислительной нагрузки, ИИ-стартапы пытаются найти и новые принципы монетизации подобных услуг. Если в конце 2024 года капитализация Perplexity оценивалась в $500 млн, тот в сентябре прошлого года она выросла до $20 млрд. Nvidia и SoftBank являются крупными инвесторами этого стартапа. Perplexity приходится нести расходы на обработку пользовательских запросов, а ещё она платит OpenAI и Anthropic за доступ к их моделям. Пользователям это предоставляет определённое преимущество, поскольку они могут сравнить результаты, выдаваемые разными ИИ-моделями. Глава Google дал понять, что компания открыта к инвестициям в новые стартапы

08.04.2026 [08:22],

Алексей Разин

Пример OpenAI может иллюстрировать, насколько современным стартапам удаётся втянуть в сферу своих интересов крупнейшие корпорации технологического сектора, которые присутствуют на рынке десятилетия подряд. Генеральный директор Google Сундар Пичаи (Sundar Pichai) убеждён, что ИИ-бум открыл для его компании новые возможности по вложению средств в стартапы.

Источник изображения: Google Как известно, Microsoft остаётся крупнейшим инвестором OpenAI, поддержавшим этот стартап на ранних этапах развития, но Google в своё время тоже оказывала финансовую поддержку многим молодым компаниям, которые сейчас достигли приличных масштабов бизнеса. В частности, в 2015 году Google вложила $900 млн в аэрокосмическую компанию SpaceX Илона Маска (Elon Musk), на тот момент капитализация последней достигала лишь $12 млрд. Теперь, после сделки по покупке xAI, капитализация SpaceX оценивается уже в $1,25 трлн. Если бы Google захотела продать свои акции SpaceX сейчас, она смогла бы выручить около $100 млрд. Сотрудничество Google с Anthropic выражается не только в продаже для её нужд ускорителей TPU, но и в предоставлении финансовых ресурсов. В 2023 году Google в обмен на $300 млн получила около 10 % акций Anthropic. Если учесть, что капитализация последней сейчас оценивается в $380 млрд, то доля Google тоже оценивается в десятки миллиардов долларов США. Тем более, что Google сейчас владеет примерно 14 % ей акций, а общая сумма инвестиций превысила $3 млрд. В ходе беседы с сооснователем Stripe Джоном Коллисоном (John Collison) генеральный директор Google Сундар Пичаи дал понять, что «в условиях изменений с приходом ИИ появляется всё больше возможностей вложить капитал нужным образом, и мы этим занимаемся». Глава Google привёл в качестве примера инвестиции в SpaceX и Anthropic, которые поясняются выше по тексту. Компания хочет эффективно распоряжаться своим капиталом и ответственно инвестировать в перспективные стартапы. Для сравнения, когда собственное подразделение Waymo в 2020 году приступило к привлечению средств сторонних инвесторов, сама Google не располагала большим объёмом свободного капитала. Тогда от сторонних инвесторов Waymo удалось привлечь $2,25 млрд. В этом году новый раунд финансирования на сумму $16 млрд поднял капитализацию Waymo до $126 млрд. Как признался Пичаи, если бы несколько лет назад у Google было больше свободных средств, она вложила бы в капитал Waymo более крупные суммы. Anthropic объединилась с Google, Apple и другими для борьбы с киберугрозами от передового ИИ

08.04.2026 [06:02],

Анжелла Марина

Компания Anthropic представила новую ИИ-модель Mythos Preview и объявила о создании отраслевого консорциума под названием Project Glasswing с участием Microsoft, Google, Apple и более 40 других крупных компаний. Целью организации станет подготовка к новым киберугрозам, которые несут с собой передовые системы искусственного интеллекта.

Источник изображения: Anthropic По данным журнала Wired, модель Mythos Preview на начальном этапе не будет доступна широкой публике. Участники консорциума получат закрытый доступ, чтобы протестировать свои системы и устранить уязвимости, которые модель способна обнаружить. По словам генерального директора Anthropic Дарио Амодеи (Dario Amodei), модель не обучалась специально для кибербезопасности, но благодаря навыкам работы с кодом она оказалась эффективна в поиске уязвимостей. Руководитель группы тестирования Anthropic Логан Грэм (Logan Graham) заявил, что модель Mythos Preview выполняет задачи на уровне старшего специалиста по безопасности и способна разрабатывать цепочки атак, проводить тестирование на проникновение и анализировать программы без доступа к исходному коду. По его словам, неосторожный публичный релиз всех возможностей этой ИИ-модели может значительно ускорить и усилить позиции киберпреступников. В Anthropic утверждают, что модель уже обнаружила тысячи критических уязвимостей, включая ошибки, которые оставались незамеченными десятилетиями даже в тщательно проверенном коде. Компания применила принципы их координированного раскрытия, предоставив разработчикам время на исправление до публичного обсуждения проекта. Участники консорциума, среди которых присутствуют Amazon, Nvidia, Cisco, Linux Foundation и Broadcom, поддержали инициативу. Глобальный директор по информационной безопасности Microsoft Игорь Цыганский (Igor Tsyganskiy) отметил, что участие в Project Glasswing позволит выявлять риски на ранней стадии. В свою очередь Грэм подчеркнул, что проект должен расшириться за пределы текущего круга участников, иначе поставленная глобальная задача не будет выполнена. Anthropic переманила ключевого специалиста у Microsoft на должность главы отдела инфраструктуры

08.04.2026 [05:03],

Анжелла Марина

Anthropic наняла бывшего топ-менеджера Microsoft Эрика Бойда (Eric Boyd) для назначения на должность руководителя инфраструктурным подразделением. На новом посту он займётся масштабированием вычислительных мощностей для поддержки и устранения технических проблем, связанных с быстро растущим числом пользователей сервиса.

Источник изображения: Anthropic По сообщению Bloomberg, Бойд подтвердил информацию в социальной сети LinkedIn, отметив невероятные темпы развития отрасли и успех продукта непосредственно Claude Code. Однако в последнее время Anthropic сталкивается с техническими трудностями и сбоями из-за беспрецедентного спроса со стороны рядовых пользователей и корпоративных клиентов. Чтобы удовлетворить этот спрос, планируется масштабное расширение облачной инфраструктуры и инвестиции порядка $50 млрд в строительство новых дата-центров для искусственного интеллекта на территории США. До перехода в Anthropic Бойд проработал в Microsoft 16 лет, где руководил ИИ-платформой. В его зоне ответственности находилось внедрение больших языковых моделей (LLM) как для клиентов, так и для внутренних команд корпорации. Согласно недавней организационной структуре, он руководил штатом из примерно 1500 сотрудников и подчинялся исполнительному вице-президенту Джею Париху (Jay Parikh). Известно, что до прихода в Microsoft он также занимал руководящие должности в компании Yahoo. Главный технический директор Anthropic Рахул Патил (Rahul Patil) заявил, что опыт нового руководителя поможет компании справиться с рекордным глобальным спросом. Представители Microsoft пока официально не прокомментировали уход своего топ-менеджера. Anthropic открыла ограниченный доступ к модели Claude Mythos Preview — она автономно ищет дыры в ПО, и уже нашла тысячи уязвимостей

08.04.2026 [05:01],

Анжелла Марина

Компания Anthropic открыла ограниченный доступ к своей новой ИИ-модели Mythos, предназначенной для поиска критических уязвимостей и отражения киберугроз. Инструмент будет доступен лишь избранным корпорациям, поскольку его навыки взлома систем признаны слишком опасными для публичного выпуска.

Источник изображения: Anthropic По сообщению The Wall Street Journal, предварительную версию нейросети получат около 50 компаний и организаций, поддерживающих критически важную ИТ-инфраструктуру, среди которых Amazon, Apple, Google и Linux Foundation. По словам руководителя подразделения Frontier Red Team в Anthropic Логана Грэма (Logan Graham), ИИ-модель Mythos продемонстрировала настолько высокие способности в поиске и эксплуатации программных ошибок, что разработчики в настоящее время не планируют открывать её для широкой аудитории. Эксперты по кибербезопасности всё больше обеспокоены тем, что искусственный интеллект стремительно сокращает окно времени между обнаружением уязвимости и созданием рабочего программного обеспечения для ее эксплуатации. В конце прошлого года учёные выяснили, что нейросети ищут и используют баги в реальных сетях почти так же эффективно, как и люди-специалисты. Наглядным примером стала предыдущая модель Anthropic, Claude Opus 4.6, которая в начале этого года всего за две недели нашла в браузере Firefox больше критических уязвимостей, чем обычно выявляется во всём мире за два месяца. Новая модель Mythos оказалась примерно в 10 раз эффективнее предыдущих ИИ-систем при расчёте стоимости обнаружения одного бага. Несмотря на то, что Anthropic пока не собирается выпускать свой продукт в открытый доступ, Логан Грэм уверен, что в ближайшие несколько лет аналогичные хакерские возможности появятся и у других нейросетей. В связи с этим эксперт призывает ИТ-сообщество уже сейчас готовиться к реалиям, в которых задержка между обнаружением программной уязвимости и её применением в атаке будет сведена к нулю. OpenAI, Anthropic и Google объединились для борьбы с копированием ИИ-моделей китайцами

07.04.2026 [13:47],

Павел Котов

Выступающие конкурентами компании OpenAI, Anthropic и Google начали совместную работу, направленную на пресечение попыток китайских компаний извлекать навыки американских моделей искусственного интеллекта для создания собственных продуктов и получения преимущества в глобальной гонке ИИ, пишет Bloomberg.

Источник изображения: Solen Feyissa / unsplash.com Для обмена информацией три компании решили использовать некоммерческую организацию Frontier Model Forum, созданную в 2023 году совместно с Microsoft. OpenAI подтвердила своё участие в проекте обмена информацией о дистилляции моделей ИИ и напомнила, что ранее направила в американский конгресс записку, в которой обвинила китайскую DeepSeek в попытке «бесплатно использовать возможности, разработанные OpenAI и другими передовыми американскими лабораториями». Дистилляция — метод, при котором существующая ИИ-модель используется для обучения новой, способной воспроизводить возможности старшей, часто с гораздо меньшими затратами, чем создание модели с нуля. Некоторые формы этого процесса широко распространены и даже поощряются для разработки более компактных и эффективных моделей; разработчики позволяют его применять и своим клиентам, но только для целей, не связанных с конкуренцией.

Источник изображения: Levart_Photographer / unsplash.com Большинство китайских ИИ-моделей издаются с открытыми лицензиями, позволяя пользователям свободно запускать их на своих платформах и неограниченно видоизменять. Это оборачивается проблемами для американских компаний, которые выпускают закрытые модели, предоставляя к ним платный доступ, в том числе чтобы компенсировать собственные затраты. OpenAI настаивает, что китайская DeepSeek продолжает использовать дистилляцию американских моделей для создания новой версии своего чат-бота. Обмен информацией между американскими разработчиками ИИ повторяет стандартную практику в области кибербезопасности — здесь компании регулярно публикуют сведения об атаках и особенностях тактики злоумышленников, чтобы укрепить работу ресурсов. Работая вместе, создатели ИИ стремятся более эффективно выявлять практику дистилляции, определять ответственных лиц и пытаться предотвратить неавторизованный доступ. Пока эта процедура ограничена: участники проекта не уверены, в какой мере могут передавать друг другу данные в соответствии с действующими антимонопольными нормами, направленными на борьбу с китайской угрозой. Помимо OpenAI, вопросы о проблеме дистилляции поднимали Anthropic и Google. Первая указывала на китайские стартапы DeepSeek, Moonshot и MiniMax; вторая сообщала, что попытки дистилляции её моделей в последнее время участились. Три компании не представили доказательств, подтверждающих меру зависимости китайской отрасли ИИ от этого процесса, но отметили, что степень его распространения можно измерить на основе объёмов крупномасштабных запросов данных. Broadcom расширила контракт по снабжению Google ИИ-чипами, Anthropic тоже почувствует выгоду

07.04.2026 [04:45],

Алексей Разин

Компания Broadcom всё активнее проявляет себя в качестве партнёра по разработке ИИ-чипов для американских облачных гигантов, и на этой неделе она расширила контракт с Google, охватив им будущие поколения компонентов. Кроме того, был расширен контракт с Anthropic, который теперь дополнительно обеспечит её эквивалентом 3,5 ГВт вычислительных мощностей на чипах Google.

Источник изображения: Broadcom Как поясняет CNBC, эти откровения прозвучали в отчётности, которую Broadcom предоставила американским регуляторам. В части взаимоотношений с Anthropic контракт с Broadcom подчёркивает динамичность развития бизнеса первой из компаний. Если в прошлом году Anthropic могла получать до $9 млрд выручки в приведённом измерении, то сейчас её величина превышает $30 млрд, если умножить максимальную месячную сумму на двенадцать. У Anthropic более 1000 корпоративных клиентов, которые ежегодно тратят на её услуги более $1 млн. Основная часть той инфраструктуры, которую Broadcom обеспечит чипами на 3,5 ГВт суммарной мощности, расположится на территории США. В прошлом месяце руководство Broadcom подчёркивало, что в 2027 году спрос на ИИ-ускорители превысит 3 ГВт результирующей вычислительной мощности. Аналитики ожидают, что в сегменте ИИ компания Broadcom выручит $21 млрд в текущем году и $42 млрд в следующем. Собственных оценок прироста выручки от расширения контрактов с Google и Anthropic компания в своей документации для регуляторов не приводит. Помимо Anthropic, Broadcom создаёт специализированные чипы и для конкурирующей OpenAI. OpenAI рассчитывает разогнать годовую выручку к $300 млрд уже через четыре года

06.04.2026 [11:23],

Алексей Разин

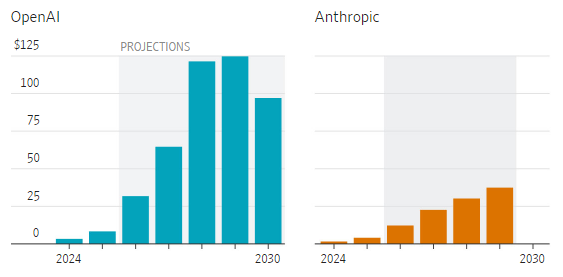

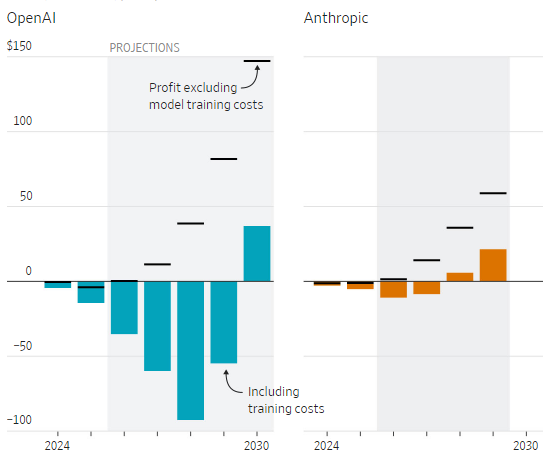

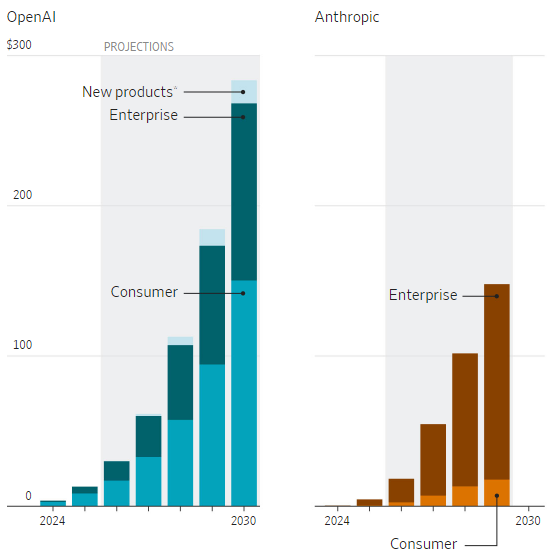

Из документов, подготовленных OpenAI и Anthropic для IPO, можно узнать много интересного об их текущем финансовом положении и планах на будущее. Получившее доступ к этим конфиденциальным документам издание The Wall Street Journal выяснило, что выйти на окупаемость OpenAI планирует к 2030 году, и к тому момент рассчитывает получать чуть менее $300 млрд выручки в год.

Источник изображения: Anthropic Сейчас же этот стартап весьма активно тратит средства. Например, в 2028 году OpenAI собирается направить на содержание и расширение вычислительных мощностей, а также исследования $121 млрд. Это будет примерно в два раза больше, чем в 2027 году. В свою очередь, в 2027 году OpenAI примерно удвоит свои затраты на обучение больших языковых моделей. В период с 2026 по 2027 годы OpenAI планирует тратить 100 % своей выручки на соответствующие нужды.

Источник изображений: The Wall Street Journal Anthropic расходы на обучение своих ИИ-моделей собирается увеличивать более плавно, даже к 2030 году они лишь превысят $30 млрд, но останутся в разы ниже, чем у OpenAI. Зато и первую прибыль, которую компания рассчитывает получить в 2030 году, OpenAI надеется сразу измерять суммой около $40 млрд. Кстати, если не учитывать расходы на обучение моделей, то OpenAI вышла бы на безубыточность уже в этом году, как и Anthropic. Первую прибыль в сумме около $5 млрд Anthropic надеется получить в 2029 году, а годом позже она уже может превысить $20 млрд.  Напомним, в отличие от OpenAI которая многие свои услуги предоставляет в потребительском сегменте рынка и даже пока не получает за это денег от клиентов и рекламодателей, Anthropic сконцентрирована на корпоративном сегменте рынка, где денежные потоки формируются более исправно. Компания в этом году собирается более чем удвоить свою выручку, хотя на это же рассчитывает и OpenAI.  Где-то с 2028 года OpenAI собирается получать выручку не только от ИИ-моделей, но и от реализации прочих продуктов, среди которых будут и аппаратные решения. К концу десятилетия эта часть выручки компании будет измеряться миллиардами долларов, но всё равно основную часть выручки OpenAI будет получать в программном сегменте. Едва ли не $150 млрд выручки в 2030 году ей принесёт потребительский сегмент ИИ, чуть более $100 млрд обеспечит корпоративный сегмент. У Anthropic распределение выручки будет совсем иным, свои $150 млрд в 2030 году она получит главным образом от корпоративных клиентов, а потребительский сектор обеспечит не более $20 млрд выручки. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |