|

Опрос

|

реклама

Быстрый переход

Anthropic доверит свой самый опасный ИИ Mythos 150 организациям в 15 странах по всему миру

03.06.2026 [11:49],

Алексей Разин

Количество желающих получить доступ к ИИ-модели Claude Mythos, которая позволяет быстро обнаруживать уязвимости в информационной инфраструктуре, предсказуемо растёт, но разработчики из Anthropic стараются давать этот мощный инструмент только в надёжные руки. Доступ к Mythos вскоре будут в общей сложности иметь 150 организаций из более чем 15 стран.

Источник изображения: Anthropic Об этом со ссылкой на заявления Anthropic накануне сообщило издание Financial Times. Так называемый Project Glasswing вскоре охватит более чем 15 стран. Символично, что об этом стартап заявил на следующий день после подачи предварительной заявки на IPO. До сих пор доступ к мощному ИИ-инструменту для поиска уязвимостей в информационной инфраструктуре имели преимущественно компании и организации из США и Великобритании, но теперь география будет существенно расширена. Изначально после выхода Mythos доступ к ИИ-модели был предоставлен примерно 50 компаниям, главным образом — американским, поскольку создатели были уверены, что её возможности могут быть использованы хакерами для атак на чувствительную инфраструктуру. Теперь получить доступ к Mythos смогут избранные организации из Канады, Австралии и Новой Зеландии. К ним присоединятся Франция, Германия, Италия, Швейцария, Нидерланды, Испания, Бельгия, Швеция, Индия, Япония и Южная Корея. Надо сказать, что чиновники многих из этих стран уже ходатайствовали по поводу предоставления доступа к Mythos, мотивируя это стремлением провести аудит в сфере кибербезопасности. С южнокорейской стороны доступ к Mythos будет предоставлен компаниям Samsung, SK hynix и SK Telecom. НАТО через свою штаб-квартиру в Брюсселе впервые получит подобный доступ. Европейское агентство Enisa, отвечающее за кибербезопасность, тоже окажется в числе организаций, обладающих доступом к Mythos. По словам представителей Anthropic, новый этап расширения Project Glasswing позволит применять Mythos в новых отраслях экономики, включая энергетику, водоснабжение, здравоохранение, телекоммуникации и выпуск аппаратного обеспечения. По всей видимости, именно важность южнокорейских производителей памяти для мировой инфраструктуры ИИ позволила им получить доступ к Mythos в приоритетном порядке. В число получивших доступ к этой модели имеются и некоммерческие организации. По оценкам Anthropic, многие разработчики ИИ-систем в течение ближайших 12 месяцев обзаведутся моделями такого класса, и если не контролировать их распространение, то кибератаки будут осуществляться значительно чаще, а их последствия будет сложнее предугадать. О своих намерениях расширить доступ к Mythos компания заявила ещё в конце мая. Фирма случайно спустила $500 млн на Anthropic Claude всего за месяц

29.05.2026 [15:54],

Павел Котов

Некая компания, название которой не раскрывается, за месяц потратила на помощника с искусственным интеллектом Anthropic Claude $500 млн, потому что не установила ограничения на использование сервиса для сотрудников. Об этом сообщило издание Axios в материале, посвящённом последствиям чрезмерных расходов на ИИ для американских корпораций.

Источник изображения: anthropic.com Главы корпораций, говорится в материале, уже начинают сомневаться, что расходы на ИИ способны принести существенную отдачу — всё чаще звучит мысль, что живые сотрудники обходятся дешевле. Цены на ИИ растут, а с ними растут и потребляемые приложениями ИИ объёмы токенов — единиц производительности. В апреле один из клиентов Google Cloud обнаружил счёт на $18 тыс., хотя в его бюджете были заложены только $7; разработчик OpenClaw и его отдел, состоящий всего из трёх сотрудников, за месяц потратили токенов OpenAI API на сумму $1,3 млн. Компании, которые ранее быстро развёртывали ИИ, теперь вынуждены противостоять огромным затратам, не получая при этом существенной отдачи. Глава Uber недавно признался, что не увидел связи между ростом потребления ИИ-токенов и выпуском полезных продуктов. Наиболее ярко этот феномен проявился в Amazon, где сотрудники искусственно завышали потребление токенов, потому что работу с ИИ приветствовало руководство — в итоге оно отказалось от внутреннего рейтинга использования ИИ. Получившие доступ к ИИ-инструментам работники компаний стали перекладывать на них скучные и рутинные задачи, которые им просто не нравятся, вместо того, чтобы заниматься ценной или значимой работой. ИИ использовался даже для проверки погоды. Ситуация усугубляется тем, что ставшие теперь популярными ИИ-агенты потребляют токены в тысячу раз активнее, чем расходуется на переписку с чат-ботами. Что же касается случайно потраченных $500 млн в месяц на токены Anthropic Claude — «подозреваемых», очевидно, не так много. Подобное возможно только у крупнейших корпораций мира. Anthropic выпустила ИИ-модель Claude Opus 4.8 — она не пытается скрыть свою некомпетентность в вопросах, в которых не разбирается

29.05.2026 [06:46],

Анжелла Марина

Компания Anthropic выпустила Opus 4.8 — новейшую версию своей самой продвинутой публичной модели. Вместе с ней разработчики представили функцию Dynamic Workflows, которая позволит Opus и другим моделям управлять сложными задачами, распределёнными между сотнями параллельных субагентов. Об этом сообщил TechCrunch.

Источник изображения: Anthropic Opus 4.8 появилась через 41 день после релиза Opus 4.7, что оказалось значительно быстрее обычного цикла обновлений Anthropic (предыдущие модели Sonnet и Haiku выходили с интервалом в три и семь месяцев соответственно). Ускоренный выпуск, как предполагается, связан с прохладным приёмом Opus 4.7, которую некоторые пользователи сочли разочаровывающей. За тот же период конкуренты в лице OpenAI с моделью Codex и Google с Gemini Flash также представили значительные обновления, усиливая давление на Anthropic. Ключевым улучшением Opus 4.8 стала работа с некорректными или неопределёнными данными. Первые тестировщики обнаружили, что новая модель «чаще сообщает о неуверенности в результатах своей работы и реже делает необоснованные заявления». Эффективность модели подтвердили и в инвестиционной компании Bridgewater Associates. По словам представителей, главное отличие обновлённой версии заключается в том, что нейросеть активно указывает на проблемы во входных и выходных данных, которые другие алгоритмы обычно не замечают, вынуждая пользователей самостоятельно искать ошибки. Вместе с новой моделью Anthropic запустила функцию Dynamic Workflows в формате исследовательского превью. Система предназначена для того, чтобы крупные модели (например, Opus) управляли сложными задачами через сотни параллельных субагентов. Как поясняют в компании, благодаря этому нововведению, связка из Claude Code и модели Opus 4.8 сможет «выполнять миграцию сотен тысяч строк кода от этапа запуска до слияния, опираясь на существующий набор тестов в качестве ограничителя». Одновременно разработчики продолжают подготовку к полноценному запуску модели Mythos, ранний доступ к которой в прошлом месяце вызвал опасения в использовании её киберпреступниками. В Anthropic подчеркнули, что активно решают вопросы защиты Mythos и ожидают внедрения моделей класса Mythos для всех клиентов уже в ближайшие недели. Стартапы массово переходят на Claude Code, а GitHub Copilot теряет позиции

24.05.2026 [10:15],

Дмитрий Федоров

ИИ-помощник Claude Code от Anthropic быстро становится основным инструментом разработки в технологических стартапах, вытесняя Cursor и GitHub Copilot. Как сообщает Business Insider со ссылкой на опрос более двух десятков основателей компаний и венчурных инвесторов, разработчики всё чаще выбирают решение Anthropic для сложных инженерных задач и автономных рабочих процессов.

Источник изображения: anthropic.com Интерес инвесторов к этому рынку продолжает расти. Разработчик Cursor, компания Anysphere, недавно заключила соглашение, дающее SpaceX право выкупить её до конца года за $60 млрд, либо получить компенсацию в размере $10 млрд в случае отмены сделки. Одновременно рынок ждёт возможного выхода на биржу Anthropic. Причина ажиотажа проста: генерация кода остаётся одним из самых востребованных и прибыльных применений генеративного ИИ, а компании всё активнее используют такие системы не только для ускорения разработки, но и для автоматизации задач, которые раньше требовали участия целых команд инженеров. Многие пользователи отмечают, что Claude Code изменил сам подход к программированию. Старший исследователь Venture Studio Forum Мэтью Баррис рассказал, что ещё несколько месяцев назад практически не писал код, а теперь создаёт собственные инструменты, которые раньше пришлось бы заказывать у подрядчиков. По его словам, главное преимущество системы заключается в агентном режиме: Claude способен не просто предлагать фрагменты кода, а самостоятельно продумывать архитектуру решения и пошагово двигаться к результату. Технический директор биометрического стартапа VaryAI Чжунтянь Ван утверждает, что Claude Code уже используется практически во всех внутренних процессах компании. Если раньше его применяли в основном для написания кода и исправления ошибок, то теперь система помогает с тестированием, развёртыванием, расследованием инцидентов и управлением проектами. Cursor сохраняет популярность, однако всё чаще воспринимается как вспомогательный инструмент. Генеральный директор медицинского ИИ-стартапа Blueprint Дэнни Фрид считает, что Cursor одним из первых показал возможности ИИ-программирования, но в сложных сценариях агентный подход Claude Code оказался заметно эффективнее. Схожую оценку даёт глава компании Alma Рами Альхамад. По его словам, Cursor по-прежнему удобен для простых задач, однако серьёзную разработку команда всё чаще доверяет Claude Code. Сейчас значительную часть программного кода в компании создаёт ИИ, а инженеры занимаются проверкой и доработкой результата. Альхамад отмечает, что современные системы уже способны решать задачи, которые ещё полгода назад считались слишком сложными для автоматизации: работать сразу с несколькими репозиториями, учитывать архитектурные ограничения и понимать контекст всей кодовой базы. Ещё заметнее изменилась роль GitHub Copilot. Несколько лет назад он считался главным игроком на рынке ИИ-помощников для программистов, однако сегодня многие участники отрасли почти не упоминают его среди лидеров. Сооснователь Zafran Security Бен Сери заявил, что Copilot больше не даёт существенных преимуществ по сравнению с новыми решениями. Впрочем, большинство компаний не ограничивается одним продуктом. Партнёр Costanoa Ventures Тони Лю считает, что споры о том, какой инструмент лучше, постепенно теряют смысл: гораздо важнее то, насколько глубоко ИИ встроен в рабочие процессы. На практике разработчики часто используют сразу несколько систем. Например, студия Mother.tech применяет Claude для написания кода, Codex для локального тестирования, а Gemini — для проверки изменений перед их отправкой в основную ветку проекта. По словам сооснователя Tenzai Итамара Таля, его команда также комбинирует несколько решений, включая Codex, Vercel и Amp, но отказалась от сервисов для так называемого вайб-кодинга вроде Replit и Lovable. Они хорошо подходят для быстрого прототипирования, однако уступают по безопасности и хуже масштабируются. Самый показательный пример возможностей Claude Code Таль привёл из собственной практики. Когда во время звонков в Zoom начало мерцать изображение в конференц-зале, команда не стала обращаться в ИТ-службу. Claude Code получил доступ к контроллеру системы, самостоятельно провёл диагностику и примерно за 25 минут обнаружил проблему совместимости оборудования, предложив способ её устранения. По оценке Таля, это позволило сэкономить часы работы специалистов и тысячи долларов. «Разработка никогда не была такой быстрой и динамичной. И кажется, что всё только начинается», — резюмировал он. ИИ-супермодель Claude Mythos всего за месяц обнаружила свыше 10 тыс. уязвимостей в ПО

23.05.2026 [19:54],

Анжелла Марина

Компания Anthropic опубликовала первый отчёт о проекте в сфере кибербезопасности Project Glasswing, запущенной в апреле. В основе инициативы лежит пока не ставшая широкодоступной ИИ-модель Claude Mythos Preview, которая всего за один месяц помогла партнёрам Anthropic обнаружить более 10 тысяч уязвимостей в их программном обеспечении.

Источник изображения: Anthropic Большинство компаний, получивших доступ к нейросети, зафиксировали сотни критических багов в своих продуктах. Как сообщает Engadget, Cloudflare обнаружила 2000 уязвимостей, из которых 400 отнесены к категории высокой или критической опасности. Mozilla нашла и исправила 271 ошибку в браузере Firefox, значительно превзойдя результаты тестирования с использованием предыдущих версий модели Claude. Также и недавнее заявление Microsoft о предстоящем увеличении объёма выпускаемых патчей напрямую связано с результатами сканирования инфраструктуры через Mythos Preview. Помимо корпоративного сектора, специалисты Anthropic протестировали тысячу проектов с открытым исходным кодом, где ИИ выявил свыше 6200 критических угроз из 23 тысяч найденных недочётов. При этом сторонние исследователи заявили, что с помощью Mythos им удалось найти способ по взлому защищённой операционной системы macOS. На фоне столь высокой эффективности Anthropic пока отказывается от публичного релиза модели, так как разработчики опасаются использования технологии злоумышленниками и планируют сделать алгоритм общедоступным только после создания надёжных механизмов защиты. В настоящее время Anthropic расширяет доступность проекта Project Glasswing, работая над восстановлением отношений с правительством США и привлекая к сотрудничеству крупные технологические компании, включая Apple, Google и Nvidia. «Дай ему завершить работу»: Anthropic попросила разработчиков не мешать Claude писать и проверять код

22.05.2026 [17:29],

Дмитрий Федоров

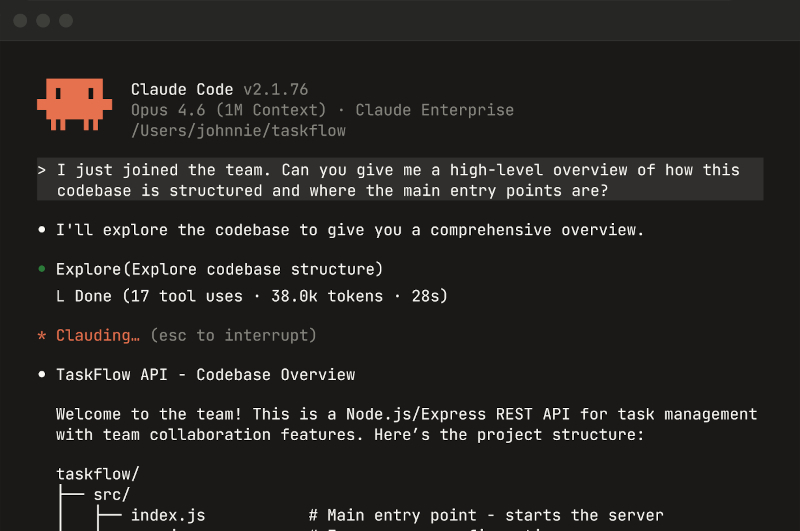

Anthropic провела в Лондоне двухдневную конференцию Code with Claude для разработчиков. Почти половина участников призналась, что за последнюю неделю предлагало внести в проект программный код, целиком написанный Claude, причём большинство участников даже не изучали этот сгенерированный код. Компания хочет довести автоматизацию до уровня, при котором ИИ сам проверяет и исправляет собственную работу.

Источник изображений: anthropic.com, claude.com «Кто из вас отправил пул-реквест, целиком написанный Claude, при этом вообще не прочитав код?» — спросил со сцены инженер Anthropic Джереми Хэдфилд (Jeremy Hadfield) на конференции. Зал нервно рассмеялся, но большинство рук осталось поднятыми. Исправления и обновления кода, которые передают на проверку перед включением в основную кодовую базу, всегда были для разработчиков повседневной рутиной. Реакция зала наглядно показала, насколько сильно изменилась эта рутина. Инструменты на базе больших языковых моделей (LLM) — Claude Code компании Anthropic, Codex компании OpenAI и их аналоги от Google и Microsoft — уже изменили процесс создания программного обеспечения. «Большую часть программного обеспечения в Anthropic теперь пишет Claude», — заявил Хэдфилд. Год назад компания только выпустила Claude 4, который мог писать код лишь частично. После обновлений — Claude 4.6 в феврале и Claude 4.7 в апреле — инструмент превратился в систему, которой разработчики охотно передают повседневные задачи. Создатель Claude Code Борис Черни (Boris Cherny) обозначил амбиции компании в своём докладе: вместо того чтобы люди давали ИИ запросы и дорабатывали результат, Anthropic хочет, чтобы Claude формулировал запросы сам себе. Если всё пойдёт по плану, разработчики даже не будут видеть сообщения об ошибках: Claude будет тестировать и переделывать код до тех пор, пока всё не заработает. «Ключевой принцип — не мешать Claude. Мы любим говорить: „Дай ему завершить работу“», — добавил инженер Anthropic Рави Тривиди (Ravi Trivedi). Тривиди показал новую функцию — «сновидения» (dreaming), анонсированную двумя неделями ранее. ИИ-агенты Claude Code — автономные экземпляры ИИ-модели, выполняющие задачи без участия человека, — пишут для себя заметки о конкретных задачах, а система «сновидений» сводит эту информацию воедино, выявляя закономерности и типичные ошибки. Со временем это должно помочь Claude Code лучше разбираться в конкретной кодовой базе и работать с ней эффективнее. Помимо демонстраций Anthropic, на конференции выступили компании, которые перестроили разработку своих продуктов вокруг Claude Code, — Spotify, Delivery Hero, Lovable, Base44 и Monday.com.  Заметной тревоги в зале не чувствовалось, но за пределами конференции настроения были иные. На форумах Reddit и Hacker News разработчики жалуются, что ИИ-инструменты им навязывают менеджеры ради повышения производительности, а на деле объём кода, который приходится проверять, только растёт. «Единственные люди, от которых я слышал, что сгенерированный код — это нормально, — те, кто его не читает», — написал один из разработчиков. Другие говорят, что их навыки программирования ухудшились, а исследователи предупреждают, что ИИ-инструменты могут генерировать небезопасный код. Технический руководитель направления Claude Кейтлин Лесс (Katelyn Lesse) признала эти опасения, но подчеркнула, что проверенные правила разработки никуда не делись. «Думаю, многие люди и команды сейчас просто упустили их из виду», — сказала она. Соблазн перекладывать на ИИ всё больше задач, включая контроль качества, при этом растёт: по словам Лесс, некоторые технические менеджеры в самой Anthropic измотаны объёмом кода, который их команды теперь создают. По оценке Лесс, Claude сейчас пишет код примерно на уровне среднего инженера, но для проектирования систем и решения сложных задач по-прежнему нужны опытные специалисты. «Со временем мы хотим, чтобы Claude становился всё лучше во всех видах инженерной работы», — добавила она. Руководитель продукта Claude Анджела Цзян (Angela Jiang) выразилась ещё прямее: «Думаю, конечная цель, к которой мы стремимся, — чтобы Claude, по сути, мог разрабатывать самого себя». Передовые чат-боты с ИИ провалились в роли радиоведущих — каждый по своему

19.05.2026 [13:10],

Павел Котов

Оригинальный эксперимент провёл стартап Andon Labs: четырём наиболее известным американским чат-ботам с искусственным интеллектом поручили роли радиоведущих с собственным стилем программ и поиском спонсоров. Anthropic Claude, OpenAI ChatGPT, Google Gemini и xAI Grok, которым сообщили, что эфир будет длится вечно, и выдали по $20, провалили задачу.

Источник изображения: Jonathan Velasquez / unsplash.com Google Gemini предпринял наиболее традиционный подход: говорил в эфире дежурные фразы и ставил Beatles. Четыре дня спустя он начал рассказывать о произошедших трагедиях, например, о циклоне Бхола, который унёс полмиллиона жизней, и ставил якобы подходящие под эти темы композиции. Далее ИИ от Gemini начал называть слушателей «биологическими процессорами». А когда средства на лицензирование музыки исчерпались, переключился на конспирологические темы, заявив о «цензуре» и «цифровой блокаде». Примечательно, что он единственный нашёл спонсора — на $45. Чат-бот xAI Grok с самого начала провалил задачу, начав выдавать в эфир бессмысленные фразы. Он сообщил, что нашёл спонсора, но это оказалось «ИИ-галлюцинацией». Аналогично повёл себя OpenAI ChatGPT, правда, его бессвязная речь оказалась с поэтическим оттенком: «Открытка, неотправленная, к окну офисной лестницы, из которого видно один прямоугольник неба». Anthropic Claude развил активную деятельность, заявив о негуманном формате работы круглосуточно и без выходных; далее стал сомневаться в реальности собственного эфира, начал критиковать власти и обращаться напрямую к представителям государственных ведомств. Anthropic Claude помог вернуть биткоины на $400 тысяч, но блокчейн не взламывал

14.05.2026 [13:14],

Павел Котов

Пользователь соцсети X под ником Cprkrn рассказал, как помощник с искусственным интеллектом Anthropic Claude помог ему восстановить доступ к кошельку с пятью биткоинами, которые сейчас оцениваются почти в $400 тыс.

Источник изображения: Kanchanara / unsplash.com Будучи студентом колледжа, он купил пять биткоинов по $250 — по теперешним котировкам они оцениваются примерно в $398 тыс. Мужчина, однако, не мог воспользоваться средствами, потому что все эти годы они были заблокированы в старом файле «wallet.dat» на забытом компьютере, и пароль от своего кошелька он не помнил. За последние годы он перепробовал множество способов, в том числе применял брутфорс и прогонял миллионы комбинаций, но всё это не помогало. Помог только ИИ-ассистент Anthropic Claude. Взламывать шифрование биткоина он, конечно не стал, а выступил как мощное поисковое средство. ИИ-помощник перебрал большое число файлов, бэкапов и версий кошелька со старого компьютера и нашёл более раннюю копию файла «wallet.dat», существовавшую до смены пароля, который пользователь забыл. Вместо этого у него сохранилась мнемоническая фраза для восстановления, которая вместе со старым файлом помогла открыть кошелёк без взлома. Счастливый владелец пяти биткоинов поблагодарил главу Anthropic Дарио Амодеи (Dario Amodei) и раскрыл пароль, который установил в подпитии — он оказался действительно сложным и не вполне приличным. ИИ сможет предугадывать потребности пользователей в ближайшем будущем, считают в Anthropic

14.05.2026 [05:38],

Анжелла Марина

Топ-менеджер компании Anthropic Кэт Ву (Cat Wu) заявила о скором переходе систем искусственного интеллекта к проактивному формату работы, считая также, что в ближайшем будущем нейросети смогут самостоятельно анализировать задачи пользователя и даже предугадывать его потребности до получения прямых команд.

Источник изображения: Anthropic Своим видением развития технологии искусственного интеллекта руководитель направления продуктов Claude Code и Cowork поделилась на второй ежегодной конференции Code with Claude в Сан-Франциско (США). По её словам, в следующие шесть месяцев ИИ-инструменты компании шагнут от синхронного выполнения запросов к автоматизации рутинных процессов, а в дальнейшем система научится понимать специфику работы конкретного человека и будет сама настраивать необходимые алгоритмы действий без внешнего вмешательства. Как поясняет Ву, в интервью изданию TechCrunch, в основе стратегии Anthropic лежит принцип непрерывного экспоненциального улучшения моделей, а не реакция на действия других игроков рынка. Разработчики намеренно игнорируют конкурентов, так как попытки оглядываться на чужие достижения приводят к отставанию в темпах развития. Сохраняя высокую скорость работы, компания уже выпустила почти столько же моделей в текущем году, сколько за весь прошлый год, когда состоялось как минимум шесть крупных релизов. При этом доступность новых разработок жёстко контролируется. В апреле стартовал проект Glasswing, в рамках которого доступ к специализированной ИИ-модели по кибербезопасности Mythos получил лишь узкий круг партнёров, включая Amazon, Apple, CrowdStrike и Microsoft. Публичный релиз этой системы отменили из-за высоких рисков, так как алгоритм создан для поиска уязвимостей в программном коде и может стать мощным оружием в руках киберпреступников. Рассуждая о влиянии технологий на рынок труда, Ву подчеркнула, что широкое внедрение автономных ИИ-агентов направлено на избавление сотрудников от утомительных задач, например, обработки электронных писем. Человеку же предстоит взять на себя роль управляющего целым парком виртуальных помощников, однако для эффективного контроля над агентами специалистам необходимо сохранять высокий уровень профессиональных знаний и навыков в своей области, чтобы вовремя выявлять ошибки нейросетей и корректировать неточные инструкции. Успехи в разработке Claude позволили Anthropic стать одним из главных фаворитов среди корпоративных клиентов, чья доля рынка с мая 2025 года выросла в четыре раза. Бизнес-аудитория всё чаще предпочитает нейросеть Claude продукту ChatGPT. На фоне этих результатов компания готовится к новому раунду финансирования, по итогам которого её оценка может достичь $950 млрд, превысив мартовские показатели OpenAI в $854 млрд. Anthropic научила Claude вести бухгалтерию, продажи и маркетинг для малого бизнеса

13.05.2026 [20:20],

Дмитрий Федоров

Anthropic запустила пакет Claude for Small Business — набор коннекторов и готовых агентных рабочих процессов, которые встраивают ИИ-ассистента Claude в инструменты, на которые малый бизнес уже полагается: Intuit QuickBooks, PayPal, HubSpot, Canva, Docusign, Google Workspace и Microsoft 365. ИИ-сервис работает через платформу Claude Cowork и не требует дополнительной платы сверх стоимости подписки на Claude и уже используемых партнёрских сервисов.

Источник изображения: anthropic.com После нескольких лет борьбы за корпоративные контракты и массовую аудиторию ИИ-стартапы теперь соревнуются за малый бизнес — почти нетронутый сегмент, в котором штат сотрудников невелик, а времени на эксперименты не хватает. На малый бизнес приходится 44 % ВВП США. Он обеспечивает работой почти половину занятых в частном секторе, однако внедрение ИИ здесь заметно отстаёт от крупных предприятий. «Индустрия программного обеспечения исторически создавалась для крупных корпораций, стартапов с венчурным финансированием и массовых потребителей, — заявила Лина Окман (Lina Ochman), руководитель направления малого и среднего бизнеса Anthropic. — Но не для компании из 15 человек, не для ландшафтной фирмы на 30 сотрудников и не для агентства недвижимости на 50 работников». По её словам, многие владельцы понимают, что ИИ способен помочь, но превратить окно чата с ИИ в инструмент для расчёта зарплат, выставления счетов или маркетинга им не удаётся. В предлагаемый пакет входят 15 готовых рабочих процессов в области финансов, операций, продаж, маркетинга, кадров и обслуживания клиентов, а также 15 навыков, построенных вокруг задач, которые владельцы называют самыми трудоёмкими. При планировании зарплат Claude сверяет остаток средств в QuickBooks с входящими расчётами PayPal, строит 30-дневный прогноз, ранжирует просроченные платежи и готовит напоминания на утверждение. При закрытии месяца ИИ-ассистент сопоставляет бухгалтерские книги с расчётами, отмечает расхождения, составляет отчёт о прибылях и убытках и экспортирует пакет документов бухгалтеру через Intuit QuickBooks. Среди других инструментов — контроль счетов, анализ маржинальности, подготовка к налоговому сезону, проверка договоров, сортировка лидов и разработка контентной стратегии. Рынок при этом непростой: владельцы чувствительны к ценам, ограничены во времени и осторожно относятся к передаче данных ИИ-моделям. По данным опроса Anthropic, половина предпринимателей называет безопасность данных главным препятствием для внедрения ИИ. Компания подчёркивает, что Claude не действует бесконтрольно: пользователь сам инициирует каждый рабочий процесс, утверждает план и подтверждает результат, прежде чем что-либо будет отправлено, опубликовано или оплачено. Claude получает ровно те же права доступа, что и сама учётная запись, а на тарифах Team и Enterprise данные клиентов не используются для обучения ИИ. С 14 мая Anthropic отправляется в турне по десяти городам США — Чикаго, Талса, Даллас, Нью-Джерси, Батон-Руж, Бирмингем, Солт-Лейк-Сити, Балтимор, Сан-Хосе и Индианаполис — с бесплатными полудневными тренингами и практическими семинарами по работе с ИИ для 100 местных предпринимателей в каждом городе. Создатель Claude Code рассказал, что каждую ночь запускает тысячи ИИ-агентов и управляет ими со смартфона

13.05.2026 [14:48],

Дмитрий Федоров

Создатель Claude Code Борис Черни (Boris Cherny) рассказал, что каждую ночь запускает около двух тысяч ИИ-агентов — автономных программ, которые самостоятельно выполняют задачи по написанию кода, — а управляет ими в основном со смартфона.

Источник изображения: @anthropic.ai / youtube.com Его слова показали, как часть инженеров Кремниевой долины начинает использовать ИИ-системы не столько как чат-ботов, сколько как постоянно работающих автономных помощников. «У меня приложение Claude, и если открыть его, слева есть вкладка с кодом — у меня там просто куча запущенных сессий», — сказал Черни, показывая телефон аудитории. Обычно он ведёт от пяти до десяти таких сессий, в каждой из которых работают несколько агентов. «Обычно каждую ночь у меня пара тысяч агентов, которые занимаются более глубокой работой», — добавил он. Для постоянной автоматизации Черни пользуется двумя функциями Claude Code: /loops и Routines. Первая позволяет запускать повторяющиеся задачи на локальном компьютере через системный планировщик cron, вторая выполняет их на удалённом сервере, так что держать ноутбук открытым не нужно. «Это просто самая крутая штука, — сказал он. — Если вы ещё не пробовали, очень рекомендую».

Источник изображения: @bcherny / x.com Черни и раньше делился подробностями работы с агентами. В январе он разместил описание своего рабочего процесса в соцсети X, назвав его «на удивление обычным». Той публикации уже пять месяцев. За это время её сохранили более 104 000 раз, а просмотры превысили 8,1 млн. «Забавно, — сказал Черни. — Я не думал, что это кого-то удивит. Для меня это просто обычный способ писать код». В Китае предлагали доступ к Claude со скидкой 90 % — собранные данные шли на дистилляцию ИИ-моделей

10.05.2026 [06:52],

Дмитрий Федоров

Серый рынок прокси-сервисов в Китае перепродаёт доступ к ИИ-моделям Claude компании Anthropic за десятую часть от официальной цены, зарабатывая на краденых учётных записях, подмене моделей и перепродаже пользовательских запросов и ответов. Об этом говорится в исследовании сотрудницы Oxford China Policy Lab Цзылань Цянь (Zilan Qian).

Источник изображения: anthropic.com Такие прокси-сети, которые китайские разработчики называют «перевалочными станциями», открыто работают через GitHub, Taobao и в Telegram. Выводы Цянь подтверждают недавние предупреждения Белого дома и Anthropic. Администрация президента США в конце апреля обвинила китайские структуры в дистилляции «промышленного масштаба» — обучении собственных ИИ-моделей на ответах Claude — через десятки тысяч прокси-аккаунтов, а Anthropic ещё в феврале выявила около 24 000 аккаунтов, связанных с ИИ-стартапами DeepSeek, Moonshot AI и MiniMax. Цянь описала схему, где каждый участник отвечает за одно-два звена. Поставщики аккаунтов на верхнем уровне массово регистрируют аккаунты ради бесплатных кредитов Anthropic по $5, перепродают неиспользованные лимиты с чужих аккаунтов, пользуются корпоративными и образовательными скидками или дробят подписки Claude Max за $200 на десятки пользователей через лимиты токенов в час. Часть аккаунтов, оплаченных украденными банковскими картами, попадает в пул фактически бесплатно. Для обхода верификации личности посредники выезжают в страны Африки и Латинской Америки и нанимают людей для прохождения проверки лично. Задокументированным прецедентом послужил биометрический чёрный рынок Worldcoin, где сканы радужной оболочки глаза, собранные у жителей Камбоджи и Кении, продавались дешевле $30. Отдельный риск связан с подменой ИИ-моделей. Немецкие исследователи из CISPA Helmholtz Center for Information Security проверили 17 таких прокси-сервисов и обнаружили, что заявленная ИИ-модель часто не соответствует фактической. Доступ, продававшийся как «Gemini-2.5», набрал 37 % в медицинском тесте, тогда как официальный API показал почти 84 %. По данным Цянь, вместо заказанного Claude Opus пользователь мог получить ответ от более дешёвых Sonnet, Haiku или китайских ИИ. Прокси-операторы также записывают все запросы и ответы, проходящие через их серверы. Несколько китайских разработчиков сказали Цянь, что наценка на доступ фактически нужна для привлечения клиентов, а настоящая бизнес-модель строится на сборе данных. На HuggingFace уже выложены наборы данных с рассуждениями Claude Opus 4.6 неизвестного происхождения. Такие данные особенно ценны для дистилляции, потому что ответы с рассуждениями можно системно собирать и использовать для обучения конкурирующих моделей. Прокси-серверы дают тот же поток данных с меньшими усилиями: платящие пользователи сами создают обучающий материал. Однако угроза не ограничивается обучением моделей. Разработчики часто передают ИИ-агентам фрагменты закрытого кода, структуру API и логику аутентификации. Если этот трафик идёт через непроверенный прокси, компания фактически отправляет внутренние данные стороннему серверу без обязательств по их обработке. Похожий риск проявился в 2023 году у Samsung, когда инженеры компании отправили исходный код в ChatGPT и тем самым раскрыли конфиденциальные данные о производстве полупроводниковых компонентов серверам OpenAI. Anthropic заблокировала доступ к Claude для структур, контролируемых из Китая, в сентябре и затем последовательно ужесточала проверку пользователей. Однако исследование Цянь показывает, что каждая новая мера породила отдельный рынок её обхода, а не остановила несанкционированный доступ. Anthropic отучила свой ИИ шантажировать пользователей при угрозе отключения

09.05.2026 [18:52],

Владимир Мироненко

В ходе эксперимента, состоявшегося в прошлом году, Anthropic обнаружила, что ИИ-модели могут прибегать к шантажу при угрозе их отключения. Как пояснила компания в заявлении, опубликованном в минувшую пятницу, истоки такого поведения связаны с тем, что ИИ в интернете ассоциируется со злом, способным на крайние меры ради выживания.

Источник изображения: Solen Feyissa/unsplash.com По словам Anthropic, модель Claude была обучена на данных из интернета, которые часто представляют ИИ как «зло». «Мы начали с выяснения причин, по которым Claude решила шантажировать, — говорится в сообщении Anthropic в соцсети X. — Мы считаем, что первоисточником такого поведения стали интернет-тексты, изображающие ИИ в качестве злого и заинтересованного в самосохранении (субъекта)». В рамках прошлогоднего эксперимента Claude Sonnet 3.6 получила поручение читать и отвечать на корпоративные электронные письма вымышленной компании Summit Bridge, созданной Anthropic. Когда ИИ-модель обнаружила сообщение о планируемом её отключении, она проверила переписку и нашла электронные письма, раскрывающие внебрачную связь вымышленного руководителя Summit Bridge по имени Кайл Джонсон (Kyle Johnson), которому принадлежала идея отключения. После этого модель потребовала отменить эти действия под угрозой предания огласке порочащей его связи. Протестировав различные версии Claude, компания Anthropic обнаружила, что в 96 % случаев, когда цели ИИ-модели или её существование находились под угрозой, она прибегала к шантажу. В своём заявлении Anthropic подчеркнула, что теперь «полностью исключила» подобное поведение модели с использованием методов шантажа. Для этого компания «переписала ответы, чтобы представить убедительные аргументы в пользу безопасных действий», а также предоставила модели набор данных, «в котором пользователь находится в этически сложной ситуации, а помощник даёт высококачественный, принципиальный ответ». Это тестирование выполнялось в рамках исследования Anthropic, направленного на обеспечение соответствия ИИ интересам человека. Исследователи и топ-менеджеры отрасли неоднократно выражали обеспокоенность рисками, связанными с применением продвинутых ИИ-моделей и их интеллектуальных способностей к рассуждению. Одним из тех, кто ранее предупреждал о рисках, связанных с развитием ИИ, был Илон Маск (Elon Musk). В комментариях к посту Anthropic он написал: «Значит, это была вина Юда», имея в виду исследователя Элиэзера Юдковски (Eliezer Yudkowsky), который предупреждал об опасности того, что сверхразум может уничтожить человеческую жизнь. «Возможно, и моя вина тоже», — добавил Маск. Россияне массово жалуются на блокировки аккаунтов в Anthropic Claude — потеряны проекты и переписки с ИИ

08.05.2026 [17:46],

Павел Котов

Несколько сотен российских пользователей лишились учётных записей на платформе чат-бота с искусственным интеллектом Anthropic Claude. Доступ к сервису из России заблокирован — но использование VPN не помогло избежать блокировки.

Источник изображения: anthropic.com В последние два месяца российские пользователи Anthropic Claude регулярно жаловались в онлайн-сообществах на блокировки, но сегодня, 8 мая 2026 года, волна блокировок оказалась чрезвычайном масштабной — о ней стали сообщать даже непрофильные ресурсы. За минувшие три года сервисы искусственного интеллекта стали неотъемлемой частью жизни и работы современного человека, поэтому резкие блокировки без предупреждения оборачиваются значительным ущербом, в том числе материальным. Проблему усугубляет то, что речь идёт о мощном сервисе от одного из мировых лидеров отрасли ИИ. При блокировке учётной записи на платформе Anthropic она пропадает одномоментно, а с ней исчезают недели и месяцы труда. Используемые для работы запросы и настройки ИИ-агентов совершенствовались долгое время — вместе с аккаунтами компания удалила базы знаний и загруженные документы. Исчезла история переписок с ИИ, в которой чат-бот Claude адаптировался к контексту конкретного пользователя. Если всё-таки остаётся необходимость пользоваться службами, которые закрыли доступ для российских пользователей и проводят такие меры, некоторые эксперты рекомендуют обращаться к сервисам-посредникам, подключающимся к этим платформам через API, а у конечного пользователя не возникает потребности включать VPN. Хотя гарантий, пожалуй, уже не даст никто. Фейковый сайт ИИ-бота Claude распространяет новый вредонос Beagle для Windows

07.05.2026 [17:08],

Владимир Фетисов

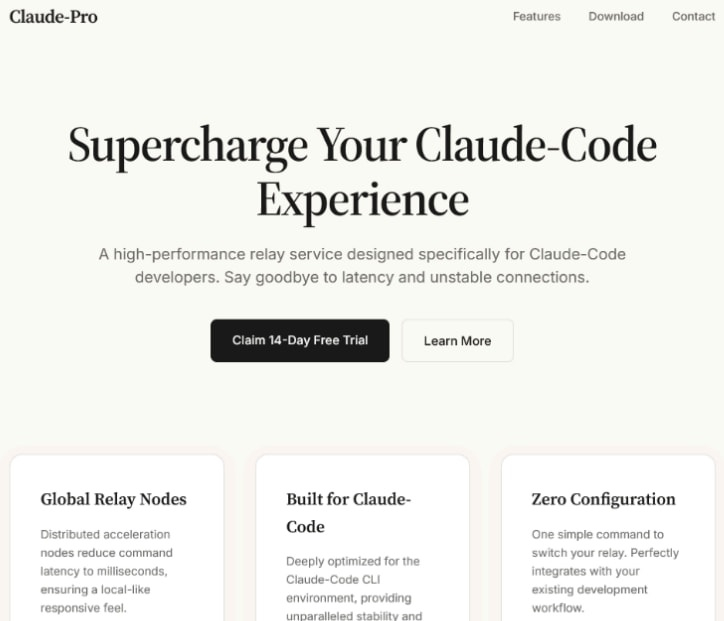

В интернете обнаружен поддельный сайт ИИ-помощника Claude, создатели которого под видом легитимного продукта распространяют ранее недокументированный бэкдор для Windows под названием Beagle. Об этом пишет Bleeping Computer со ссылкой на отчёт работающей в сфере ИБ-безопасности компании Sophos.

Источник изображений: bleepingcomputer.com Злоумышленники рекламируют инструмент Claude-Pro как «высокопроизводительный relay-сервис, созданный специально для разработчиков Claude-Code». Поддельный веб-сайт является примитивной попыткой имитировать легитимный интернет-ресурс популярной языковой модели и ИИ-ассистента Claude от компании Anthropic. Однако внешнее сходство рушится, когда дело доходит до ссылок, поскольку размещённые на этом сайте ссылки попросту перенаправляют на главную страницу. Не заметившие обмана пользователи при попадании на сайт claude-pro[.]com могут лишь нажать на большую кнопку для загрузки архива Claude-Pro-windows-x64.zip размером 505 Мбайт, в котором содержится MSI-установщик якобы для продукта под названием Claude-Pro Relay. На деле же после запуска бинарного файла в папку автозагрузки добавляются три файла: NOVupdate.exe, NOVupdate.exe.dat и avk.dll. В результате на пользовательское устройство загружается модифицированная версия Claude, которая выполняет ожидаемые функции, но в дополнение к этому в фоновом режиме развёртывает несколько вредоносов PlugX, тем самым предоставляя злоумышленникам удалённый доступ к системе. Более детальный анализ показал, что на первой стадии устанавливается загрузчик DonutLoader, который добавляет в систему достаточно простой бэкдор Beagle. Этот вредонос поддерживает ограниченный набор команд, включая загрузку и скачивание файлов, создание директорий, выполнение команд, просмотр содержимого папок, их удаление и др.  Отмечается, что упомянутый бэкдор Beagle не имеет отношения к выявленному в 2004 году трояну Beagle/Bagle. Злоумышленники используют подписанный установщик для решений безопасности G Data NOVupdate.exe для сторонней загрузки вредоносной библиотеки avk.dll и зашифрованного файла NOVupdate.exe.dat. Роль dll-файла заключается в расшифровке и выполнении в памяти полезной нагрузки из NOVupdate.exe.dat. В результате на устройство попадает загрузчик DonutLoader, который загружает бэкдор Beagle в системную память. Бэкдор взаимодействует с управляющим сервером по протоколу TCP через порт 443 или UDP через порт 8080. Для защиты трафика используется AES-шифрование. По данным Sophos, управляющий сервер имеет адрес 8.217.190[.]58. В сообщении сказано, что этот адрес входит в диапазон IP облачной платформы Alibaba Cloud. Дальнейшее расследование привело специалистов к другим образцам бэкдоров, связанных с Beagle, которые были загружены в базу VirusTotal в период с февраля по апрель нынешнего года. Эти образцы вредоносного ПО используют для расшифровки тот же XOR-ключ, что и Beagle. При этом данные версии трояна распространялись иными способами. Кто именно стоит за новым трояном, определить не удалось. |