|

Опрос

|

реклама

Быстрый переход

Apple продаст менее 500 тыс. AR-гарнитур Vision Pro в этом году — спрос в США в этом квартале рухнет в четыре раза

11.07.2024 [09:46],

Алексей Разин

Гарнитура дополненной реальности Apple Vision Pro дебютировала на домашнем для Apple рынке США в феврале по цене $3500, и расширение географии продаж в июне преследует цель поддержания интереса к специфической и недешёвой новинке, поскольку у себя на родине она в настоящее время продаётся плохо, как убеждены аналитики IDC. Всего по итогам текущего года Apple удастся продать менее 500 000 экземпляров.

Источник изображения: Apple Цитирующий аналитиков IDC ресурс Bloomberg поясняет, что с момента февральского анонса гарнитура Apple Vision Pro никак не может выйти на рубеж в 100 000 ежемесячно продаваемых экземпляров. На рынке США в этом квартале её объёмы продаж вообще последовательно сократятся почти в четыре раза до 19 108 штук, как считают авторы прогноза. Предложение новинки на рынках за пределами США при этом позволит совокупному тиражу Vision Pro по итогам третьего квартала приблизиться к 100 000 экземпляров. В четвёртом квартале зарубежные продажи Vision Pro последовательно вырастут с 80 844 до 110 142 штук, но по итогам всего года общий тираж устройства всё равно не достигнет 500 000 изделий. И только если в следующем году Apple выпустит более доступный вариант гарнитуры, который будет в два раза дешевле нынешнего, у компании появится шанс более заметно нарастить объёмы продаж, по мнению представителей IDC. При этом успех гарнитуры на локальных рынках во многом будет определяться именно наличием адаптированного цифрового и сервисного наполнения, а не ценой самой по себе. Даже в этом случае, по данным прогноза IDC, объёмы квартальных продаж гарнитур дополненной реальности Apple увеличатся с 67 791 до 341 189 штук в период с первого по четвёртый кварталы следующего года. США продолжит доминировать в структуре продаж по географическому признаку, пусть и с незначительным перевесом, но местный рынок перехватит инициативу лишь с третьего квартала будущего года. Очевидно, к тому времени как раз и появится новая более доступная гарнитура Apple. В своём нынешнем виде Vision Pro вызывает нарекания со стороны пользователей по поводу высокого веса, ограниченности набора приложений и слабой адаптации контента. Выход более доступной версии вызовет более чем двукратный рост объёмов продаж во второй половине следующего года, как предполагают представители IDC. Астронавты с Boeing Starliner могут застрять в космосе до августа — в NASA обнаружили, что у корабля перегреваются двигатели

11.07.2024 [09:41],

Геннадий Детинич

Вчера NASA провело первый брифинг по результатам наземных испытаний маневровых двигателей корабля Boeing Starliner. Пять таких отключились при попытке стыковки корабля с МКС 5 июня. Для безопасного возвращения корабля на Землю инженеры NASA начали заново анализировать ситуацию с двигателями в процессе стендовых испытаний. Как выяснилось, маневровые двигатели перегреваются сильнее расчётных показателей.

Источник изображения: NASA Для корабля Starliner это не первый случай, когда маневровые двигатели внезапно перестают работать. Так было во время предыдущего беспилотного полёта аппарата на МКС. И это произошло снова при попытке состыковаться со станцией в ходе первой тестовой пилотируемой миссии. Позже наземная команда запустила четыре из них, обеспечив кораблю безопасную стыковку на сутки позже запланированного. Новые наземные испытания показали, что двигатели коррекции орбиты в составе служебного модуля греются сильнее ожидаемого. Вероятно, к этому приводит тесное замкнутое пространство служебного отсека и нагрев от лучей Солнца. Во время наземных испытаний инженеры обеспечили двигателям этот избыточный нагрев, чтобы повторить условия, приведшие к их отказу. По большому счёту двигатели коррекции почти не участвуют в процессе свода корабля с орбиты. Для этого Starliner использует более мощные кормовые двигатели. Но на этапе отстыковки и манёвров вблизи МКС корабль, всё же, полагается на работу двигателей коррекции, которых у него 28 штук. Также NASA изучает проблему аномалии с протекающими соединениями системы по транспортировке гелия. Для агентства это неожиданная проблема, причины которой пока не ясны. Инженеры полагают, что к такому эффекту может привести засорение соединений или лишняя смазка на сальниках. Специалисты не исключают, что конструкцию соединений придётся в будущем заменить на что-то другое. В целом NASA склонно считать, что корабль Boeing Starliner можно будет вернуть на Землю в конце июля. В середине августа на МКС на корабле Dragon Crew компании SpaceX полетит очередная смена астронавтов и занятый кораблём Boeing стыковочный порт необходимо будет освободить. В качестве альтернативной меры, на крайний случай, агентство сначала вернёт предыдущую смену на Землю, что обычно не практикуется (экипажи передают смену друг другу на борту станции), что освободит место для прибывающего корабля. Несколько слов в поддержку корабля высказал «застрявший» на МКС экипаж Starliner. По мнению Барри Уилмора (Barry Wilmore) и Суниты Уильямс (Sunita Williams), Starliner — достойный корабль, но они бы не спешили рекомендовать его для регулярных полётов. На рынке электромобилей США доля Tesla впервые опустилась ниже 50 %

11.07.2024 [08:34],

Алексей Разин

Tesla опубликует подробный квартальный отчёт к концу месяца, а по предварительным данным известно, что в годовом сравнении объёмы поставок электромобилей этой марки сократились за период на 4,8 %, хотя сторонние аналитики ожидали худшего. Эксперты Cox Automotive утверждают, что доля Tesla на американском рынке электромобилей впервые опустилась ниже 50 % по итогам второго квартала.

Источник изображения: Tesla Для компании рынок электромобилей США остаётся крупнейшим с точки зрения сбыта своей продукции, здесь расположены три её предприятия, обеспечивающие выпуск электромобилей и тяговых батарей. Например, в Европе Tesla занимает не более 20 % рынка электромобилей, в Китае её доля не превышает 10 %. В прошлом году Tesla занимала 55 % рынка электромобилей США, а за год до этого контролировала почти две трети местного рынка. Второй квартал, как позволяет судить статистика Cox Automotive, компания завершила с долей 49,7 %, впервые за время своей рыночной деятельности опустившись ниже планки в 50 %. Tesla на рынке США во втором квартале продала на 6,3 % меньше электромобилей, чем годом ранее. Между тем, объёмы продаж электромобилей в США как таковые по итогам второго квартала выросли на 11,3 % в годовом сравнении, и доля машин с таким типом силовой установки выросла с прошлогодних 7,2 до 8 %. Другими словами, отрицательной динамикой продаж грешат лишь некоторые автопроизводители. Среди них, кстати, помимо Tesla, упоминаются Mercedes-Benz, Porsche и Volvo, предлагающие достаточно дорогие даже по американским меркам электромобили. Премиальный сегмент уже насытился электромобилями, рынок теперь способен расти преимущественно за счёт более доступных моделей, как считают многие аналитики. Объёмы продаж электромобилей General Motors, Ford, Hyundai и Kia на рынке США во втором квартале увеличились. Надо сказать, что подобная динамика продаж электромобилей Tesla не особо расстроила инвесторов, ведь акции компании растут на протяжении последних 11 торговых сессий. За это время они укрепились в цене более чем на треть. Предварительные итоги квартала не так сильно расстроили инвесторов, как ожидалось, да и обещанная Илоном Маском (Elon Musk) презентация роботизированного такси Cybercab должна состояться менее чем через месяц. Миллиардер по традиции пообещал, что это автоматизированное транспортное средство взорвёт рынок пассажирских грузоперевозок. В любом случае, первый квартал Tesla завершила с долей 52 % на американском рынке, и даже сейчас она продаёт там столько же электромобилей, сколько все остальные компании вместе взятые. Ухудшение её позиций закономерно с учётом усиливающейся конкуренции. Илон Маск увернулся от выплаты $500 млн бывшим сотрудникам Twitter

11.07.2024 [06:19],

Анжелла Марина

Адвокаты Илона Маска (Elon Musk) добились отклонения иска, в котором утверждалось, что тот отказался выплатить не менее 500 миллионов долларов выходного пособия тысячам сотрудников Twitter, которых он уволил в ходе массовых увольнений после приобретения социальной сети, известной теперь как X, в октябре 2022 года.

Источник изображения: David Swanson / Reuters По сообщению издания Engadget, в иске, поданном в Окружной суд США в Калифорнии в июле 2023 года, утверждалось, что около 6000 уволенных сотрудников имели право на выходное пособие в соответствии с положениями федерального Закона о пенсионном обеспечении сотрудников (ERISA). Однако окружной судья США Трина Томпсон (Trina Thompson) во вторник постановила, что закон не применим к этому делу и что оно находится вне её юрисдикции. Иск является одним из нескольких дел, поданных против Twitter и Маска бывшими сотрудниками. Несколько руководителей высшего звена, включая бывшего финансового директора Неда Сигала (Ned Segal) и бывшего генерального директора Парага Агравала (Parag Agrawal), подали иск в марте, заявив, что им должны более 128 миллионов долларов выходного пособия. Бывший главный бухгалтер подал иск в прошлом месяце, обвинив Маска в неуплате более 3,75 миллиона долларов выходного пособия. Иск, отклонённый несколько дней назад, был подан Кортни Макмиллиан (Courtney McMillian), которая курировала компенсацию и льготы Twitter, и Рональдом Купером (Ronald Cooper), операционным менеджером. Согласно иску, план выходного пособия Twitter должен был включать «как минимум» двухмесячный базовый оклад, премии за производительность и другие льготы. Но истцы заявили, что Twitter предлагал уволенным сотрудникам только одну месячную зарплату в качестве выходного пособия без каких-либо льгот. Томпсон заявила, что закон ERISA не распространяется на действия Twitter после выкупа, поскольку не существует «постоянной административной схемы», в рамках которой компания рассматривала бы претензии в индивидуальном порядке или предлагала бы такие преимущества — например, постоянную медицинскую страховку или услуги по трудоустройству. Судья заявила, что истцы могут попытаться изменить свою жалобу, но только в отношении претензий, не регулируемых ERISA. Neuralink собирается внедрить имплант в мозг второму пациенту в этом месяце

11.07.2024 [05:13],

Алексей Разин

В конце июня стало известно, что стартап Илона Маска (Elon Musk) Neuralink был вынужден отказать в проведении операции по установке импланта в мозг второго пациента в своей истории из-за проблем со здоровьем у кандидата. Теперь глава компании заявляет, что операция с участием второго пациента будет проведена через неделю с небольшим, а до конца года количество участников испытаний приблизится к десяти.

Источник изображения: Neuralink Данные заявления были сделаны во время трансляции на страницах социальной сети X с участием сотрудников Neuralink, как отмечает Bloomberg. Помимо уже существующих функциональных возможностей импланта, обсуждались потенциальные новые функции. В частности, помимо борьбы с параличом конечностей и мышц, такие импланты могут участвовать и в восстановлении потерянной человеком памяти. Опыт проведения операции на первом пациенте, Ноланде Арбоу (Noland Arbaugh, на фото выше), поможет Neuralink избежать проблем и ошибок в последующих медицинских экспериментах. Илон Маск традиционно использовал эту площадку для своих амбициозных технологических проповедей. Мозговые импланты, по его словам, должны позволить человечеству избежать долгосрочных цивилизационных рисков, связанных с искусственным интеллектом, поскольку позволят создать симбиоз с человеческим интеллектом. «Идея заключается в том, чтобы наделить человека сверхспособностями», — резюмировал глава компании. Как признался Маск, в последующих операциях по вживлению имплантов в черепную коробку Neuralink постарается нейтрализовать риски, с которыми столкнулся первый пациент. Напомним, что из-за естественной «миграции» головного мозга внутри черепной коробки часть электродов, соединяющих их, выскочила из тонких отверстий в коре головного мозга и перестала функционировать должным образом. Робот, который отвечает за часть манипуляций при установке импланта, будет использовать складки головного мозга для более надёжного внедрения электродов, а корпус самого импланта будет устанавливаться «заподлицо» с кожным покровом головы, как пояснил глава Neuralink. Маск также заявил, что пациенты смогут модернизировать используемые ими мозговые импланты по мере необходимости. Глава компании подчеркнул, что Neuralink хорошо заботится о тех животных, которых использует для испытаний имплантов и проведения операций по их вживлению. Ранее компанию обвиняли как в нарушении правил обращения с биологическими отходами, так в негуманном обращении с подопытными животными. Хакеры стали использовать отключенный Internet Explorer для атак на Windows 10 и 11

11.07.2024 [04:37],

Анжелла Марина

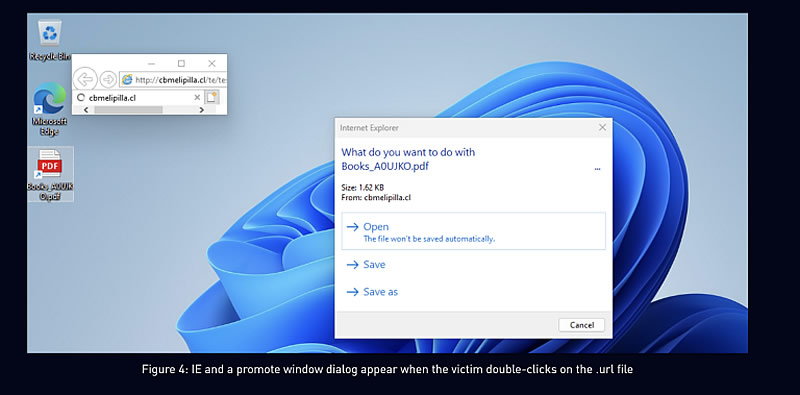

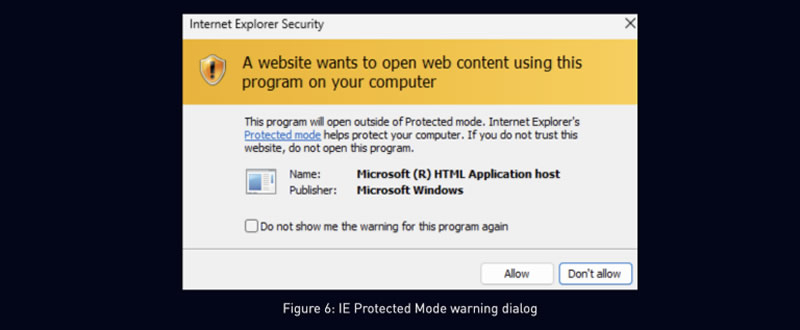

Хакеры нашли уязвимость в Windows для атак через давно устаревший и отключенный браузер Internet Explorer, несмотря на меры безопасности Microsoft. Для этого используются файлы с ярлыками .url и .hta. Если пользователь подтверждает их открытие, то на его компьютер немедленно загружается вредоносное ПО.

Источник изображения: Gerd Altmann / Pixabay Специалисты по кибербезопасности из компании Check Point обнаружили новую схему атак на компьютеры с Windows 10 и Windows 11, использующую уязвимость в устаревшем браузере Internet Explorer, сообщает PCMag. Несмотря на то, что Microsoft официально прекратила поддержку Internet Explorer и навсегда отключила его в своей операционной системе в прошлом году, хакеры нашли способ устанавливать через него вредоносное программное обеспечение.

Источник изображения: Checkpoint.com Исследователь Check Point Хайфэй Ли (Haifei Li) выявил, что злоумышленники используют файлы ярлыков Windows с расширением .url, которые можно настроить для вызова Internet Explorer. Сразу скажем, этот метод не позволит обойти современную систему защиты, присутствующую в более новых браузерах, таких как Chrome или Edge. Атака особенно эффективна при использовании фишинговых писем или вредоносных вложений. Ли обнаружил, что хакеры маскируют ярлыки под PDF-файлы. При открытии такого ярлыка Internet Explorer загружает вредоносную программу в виде файла .hta, если пользователь подтверждает все запросы.

Источник изображения: Checkpoint.com Уилл Дорман, эксперт по безопасности, отметил, что современные браузеры блокируют загрузку файлов .hta, в то время как Internet Explorer лишь выводит текстовое предупреждение, которое пользователи по незнанию могут легко проигнорировать. Особую опасность представляет тот факт, что Microsoft прекратила выпуск обновлений безопасности для Internet Explorer, что и позволяет хакерам использовать неисправленные уязвимости через этот браузер. Исследование Check Point показало, что эти атаки проводятся как минимум с января 2023 года. Хорошая новость состоит в том, что в ответ на обнаруженную уязвимость Microsoft выпустила патч, предотвращающий запуск Internet Explorer через файловые ярлыки. Специалисты также рекомендуют пользователям Windows быть особенно осторожными при работе с файлами, имеющими расширения .url, полученными из ненадёжных источников. Аналитики оценили YouTube в $455 млрд и призвали Alphabet к реструктуризации

11.07.2024 [04:34],

Анжелла Марина

Аналитики инвестиционной компании Needham оценили стоимость YouTube в 455 миллиардов долларов, что на 50 % превышает рыночную капитализацию Netflix. Однако эксперты считают, что истинная ценность видеохостинга занижена из-за структуры холдинга Alphabet, которому принадлежит YouTube.

Источник изображения: Szabo Viktor / Unsplash По словам аналитиков Лауры Мартин (Laura Martin) и Дэна Медины (Dan Medina) из Needham, структура Alphabet не позволяет в полной мере оценить её разрозненные бизнесы, особенно YouTube. Они утверждают, что отделение стримингового гиганта от материнской компании может принести пользу инвесторам, желающим сосредоточиться на доминировании YouTube в сфере потокового вещания. «В YouTube есть эта скрытая ценность, которой люди не могут торговать отдельно, и поэтому она закрыта в конгломерате Google, который при этом имеет много других рисков», — отметила Мартин. Она также упомянула, что потенциальное разделение принесёт выгоду и тем, кто восхищается ролью Alphabet в развитии ИИ. По оценкам Needham, даже продажа 5 % акций YouTube могла бы добавить 15 долларов к стоимости акций Alphabet. Конгломератная структура Alphabet давно подвергается критике за сокрытие истинной ценности её различных бизнес-направлений. Аналитики и инвесторы обращают внимание на то, что YouTube занимает доминирующую позицию на рынке потокового вещания, и прогнозируют дальнейший рост дохода от рекламы. По оценкам Bloomberg, доход от рекламы на YouTube вырастет почти на 17 % до $37 млрд в 2024 году и ещё на 14 % до $42 млрд в 2025 году. Для сравнения, ожидаемый доход Netflix в 2024 году составит около $38,7 млрд.

Источник изображения: Bloomberg.com Несмотря на то, что Netflix по-прежнему является лидером в большинстве телевизионных категорий, обзор стриминговых платформ от TD Cowen показал, что YouTube не сильно отстаёт и является лучшим выбором для просмотра контента на мобильных устройствах. Аналитики крупнейшего инвестиционного банка в мире Goldman Sachs также признают важность YouTube для роста акций Alphabet. В своей недавней заметке от 8 июля они отмечают, что доход от сегмента подписок является ключевым драйвером роста и должен увеличиться в ближайшие годы. В компании подтвердили, что сейчас время открывать сделки на покупку акций Alphabet и повысили целевую цену, отчасти из-за более высоких прогнозов роста доходов от рекламы на YouTube. Лора Мартин из Needham видит потенциал и в других частях бизнеса Alphabet, например, в сегменте рекламных технологий. Она считает, что разделение Alphabet на отдельные компании может привести к увеличению общей стоимости, заявив, что «Alphabet по частям будет стоить дороже, чем в виде единого целого». Microsoft избежала антимонопольного расследования в ЕС, заключив соглашение с CISPE

11.07.2024 [04:26],

Владимир Мироненко

Microsoft заключила в среду соглашение с CISPE (Ассоциация европейских поставщиков облачных сервисов), в состав которой входит Amazon, что позволило ей избежать антимонопольного расследования ЕС и потенциального крупного штрафа, пишет Bloomberg. CISPE отзовёт жалобу, поданную в Еврокомиссию в конце 2022 году, с обвинением Microsoft в антиконкурентной политике, наносящей ущерб облачным технологиям в Европе.

Источник изображения: trazika/Pixabay CISPE утверждала, что привязка Microsoft программного обеспечения для бизнеса к облачным сервисам Azure значительно усложнила клиентам смену поставщиков облачных услуг. Нынешнее соглашение позволит членам CISPE использовать расширенные функции Microsoft Azure, а поставщикам услуг будет разрешено предлагать приложения и сервисы Microsoft в своих локальных облачных инфраструктурах, указано в заявлении ассоциации. «Это соглашение обеспечит равные условия для европейских провайдеров услуг облачной инфраструктуры и их клиентов», — заявил генеральный секретарь CISPE Франсиско Мингоранс (Francisco Mingorance). По данным источников Reuters, урегулирование конфликта обошлось Microsoft в €20 млн. Как сообщила CISPE, в мировое соглашение не были включены Amazon Web Services (AWS), Google Cloud Platform и AliCloud, что вызвало критику со стороны первых двух компаний. В заявлении AWS указано, что соглашение «ничего не даёт подавляющему большинству клиентов Microsoft, которые до сих пор не могут использовать облако по своему выбору в Европе и по всему миру». «Мы изучаем наши варианты продолжения борьбы с антиконкурентным лицензированием Microsoft, чтобы способствовать выбору, инновациям и росту цифровой экономики в Европе», — сообщил Амит Завери (Amit Zavery), руководитель платформы Google Cloud. Новая статья: Система жидкостного охлаждения MSI MAG CoreLiquid E360

11.07.2024 [01:44],

3DNews Team

Данные берутся из публикации Система жидкостного охлаждения MSI MAG CoreLiquid E360 Новая статья: Обзор материнской платы GIGABYTE B650 AORUS ELITE AX ICE

11.07.2024 [00:05],

3DNews Team

Данные берутся из публикации Обзор материнской платы GIGABYTE B650 AORUS ELITE AX ICE Анонсирована Double Dragon Revive — первые подробности возрождения легендарной серии

10.07.2024 [23:29],

Михаил Романов

Японский издатель и разработчик Arc System Works, которому принадлежат права на франшизу Double Dragon, в журнале Famitsu анонсировал новую игру легендарной серии beat ‘em up — Double Dragon Revive. Как можно догадаться по названию, Double Dragon Revive позиционируется в качестве возвращения франшизы. Прошлогодняя Double Dragon Gaiden: Rise of the Dragons вышла удачной, но релизы в основной серии фанатов давно не радовали. В Double Dragon Revive намерены «достоверно воспроизвести азарт олдскульных сайд-скроллеров», скрестив его с обновлёнными настройками сложности, современным управлением и опытом Arc System Works в файтингах. Основной визуальной особенностью Double Dragon Revive станет перенос экшена в «стильное 3D». Трейлеров и скриншотов пока нет — лишь один скан страницы Famitsu с изображениями из будущей игры (см. ниже). Разработчики подтвердили появление в Double Dragon Revive таких персонажей, как Джимми Ли, Билли Ли, Роупер и Абобо. По словам Arc System Works, при переходе в 3D модели героев сохранили присущий им шарм. Возрождение серии не за горами: премьера Double Dragon Revive ожидается на протяжении 2025 года в версиях для PC (цифровые магазины не уточняются), PlayStation 4, PlayStation 5, Xbox One, Xbox Series X и S. Arc System Works известна в первую очередь благодаря своим файтингам (Guilty Gear Strive, DNF Duel, BlazBlue, Granblue Fantasy Versus). В 2017 году студия разработала и выпустила олдскульную Double Dragon IV, но отзывы у неё смешанные. «Сбер» теперь сотрудничает с крупнейшим майнером России BitRiver

10.07.2024 [23:02],

Владимир Мироненко

«Сбер» и BitRiver, оператор майнинговых дата-центров и импортёр майнингового оборудования, объявили о стратегическом сотрудничестве с целью наиболее эффективной реализации проектов цифровой трансформации. В рамках партнёрства стороны планируют взаимодействовть в области применения передовых практик создания и развития цифровых технологий в сферах обработки данных, сопровождения компьютерных систем и смежных направлениях. Также предполагается взаимодействие компаний в развитии ИИ-технологий, повышении качества обслуживания в области цифровых сервисов, снижении издержек на обслуживание благодаря применению инновационных технологий и повышению эффективности работы сотрудников. Предусмотрена реализация совместных образовательных и популяризирующих проектов в области цифровых технологий и ИИ. «Формирование цифровой экономики — это вопрос национальной безопасности и независимости страны. Сегодня производительность труда напрямую связана с цифровизацией и использованием ИИ», — отметил глава BitRiver. Он добавил, что совместная работа со «Сбером» над реализацией проектов позволит BitRiver сделать ещё один шаг на пути к усилению цифрового и финансового суверенитета России. Как сообщается в пресс-релизе, в I полугодии 2024 года Россия заняла второе место на мировом рынке майнинга, опередив США по темпам роста. Энергоёмкие блокчейн-вычисления усилили позиции страны в области финансов и ИТ, также была создана база для реализации масштабных проектов в области ИИ. BitRiver называет себя крупнейшим оператором майнинговых дата-центров в РФ — она управляет 15 ЦОД общей ёмкостью 533 МВт. Apple намерена продать на 10 % больше iPhone 16 до конца года, чем было продано iPhone 15 в прошлом году

10.07.2024 [22:56],

Владимир Фетисов

Компания Apple планирует реализовать не менее 90 млн iPhone 16-й серии до конца 2024 года — по задумке, спрос должны подстегнуть функции на базе искусственного интеллекта. По данным Bloomberg, Apple сообщила поставщикам и партнёрам о намерении увеличить поставки новых iPhone примерно на 10 % по сравнению с объёмом реализованных годом ранее устройств. Напомним, в 2023 году продала около 81 млн iPhone 15.  В Apple уверены, что анонсированный ранее пакет ИИ-функций Apple Intelligence, который появится в iPhone 16, будет способствовать росту спроса на «яблочные» смартфоны в конце этого года. Похоже, Apple рассчитывает на более сильный 2024 год, несмотря на то, что компании придётся конкурировать с другими смартфонами с искусственным интеллектом от разных вендоров, включая Samsung. Вторая половина прошлого года была для iPhone непростой, особенно в Китае, где местный рынок покорил Huawei Mate 60 Pro, построенный на базе процессора собственного производства. Аналитики с Уолл-стрит ожидают, что во второй половине 2024 года доходы Apple от продаж iPhone снизятся. На фоне сообщения Bloomberg о планах Apple по увеличению продаж iPhone акции компании выросли на 1,8 % до $232,74 за одну ценную бумагу. По состоянию на момент закрытия торгов акции Apple выросли в цене на 19 % с начала этого года. Эта новость также способствовала росту стоимости акций поставщиков Apple, таких как Skyworks Solution и Qorvo. Официальные представители Apple отказались от комментариев касательно планов по поставкам iPhone. По мнению аналитиков Bloomberg Intelligence, прогноз Apple по продажам iPhone является положительным знаком, учитывая достаточно низкие продажи смартфонов в течение последних двух лет. По данным аналитической компании IDC, в прошлом году объём поставок смартфонов на глобальный рынок снизился на 3,2 %, хотя Apple удалось добиться роста на 3,7 %. AMD купила крупнейшую частную ИИ-лабораторию Европы — это поможет в борьбе с Nvidia

10.07.2024 [22:52],

Анжелла Марина

Компания AMD объявила о соглашении по приобретению финской компании Silo AI, ведущего европейского разработчика специализированных систем искусственного интеллекта. Сумма сделки составила 665 млн долларов. Это приобретение укрепит позиции AMD на быстрорастущем рынке специализированного ПО и сервисов, связанных с ИИ, и поможет сократить отставание от лидера отрасли в лице Nvidia.

Источник изображения: Timothy Dykes / Unsplash По сообщению Bloomberg, базирующаяся в Хельсинки Silo AI позиционирует себя как крупнейшая частная лаборатория ИИ в Европе. При этом компания специализируется на создании ИИ-моделей и систем, адаптированных под конкретные потребности заказчиков, среди которых такие гиганты как Allianz SE, Unilever Plc и подразделение BMW Rolls-Royce. Согласно заявлению AMD, генеральный директор Silo AI Питер Сарлин (Peter Sarlin) продолжит руководить своей командой, которая войдёт в состав группы искусственного интеллекта AMD. AMD рассматривается как ближайший потенциальный конкурент Nvidia на быстрорастущем рынке оборудования для систем ИИ. Графические процессоры, на которых специализируются обе компании, оказались наиболее эффективным средством для обучения больших языковых моделей (LLM), лежащих в основе таких сервисов, как ChatGPT от OpenAI и Copilot от Microsoft. Старший вице-президент AMD Вамси Боппана (Vamsi Boppana) подчеркнул, что опыт команды Silo AI в разработке передовых ИИ-моделей и решений, включая современные языковые модели, работающие на платформах AMD, ускорит реализацию ИИ-стратегии компании и внедрение ИИ-решений для глобальных клиентов. Важно отметить, что AMD относительно недавно вышла на рынок специализированных систем ИИ и стремительно наращивает свой аппаратный и программный потенциал. Под руководством генерального директора Лизы Су (Lisa Su) компания недавно представила линейку ускорителей MI300 и прогнозирует выручку от ИИ-ускорителей в размере около $4 млрд в этом году. Для сравнения, Nvidia ожидает получить более 100 миллиардов долларов в текущем году только от производства чипов для центров обработки данных. Относительно финансовых показателей Bloomberg пишет, что с начала 2024 года акции AMD выросли примерно на 20 %, отставая от 38-% роста индекса полупроводников Филадельфийской фондовой биржи и 165-% роста Nvidia. Несмотря на это, рыночная капитализация AMD в $286 млрд близка к историческому максимуму. Надёжный инсайдер: первой Call of Duty в Game Pass станет Modern Warfare 3, причём уже скоро

10.07.2024 [22:47],

Михаил Романов

Проверенный инсайдер Том Хендерсон (Tom Henderson) в эксклюзивном материале для своего портала Insider Gaming рассказал, какая игра серии Call of Duty первой попадёт в подписку Game Pass. Напомним, в мае Activision и Microsoft подтвердили, что Call of Duty: Black Ops 6 появится в Game Pass на релизе. Это произойдёт 25 октября, однако так долго фанатам серии ждать дебюта франшизы в сервисе не придётся. По данным Хендерсона, уже во второй половине июля каталог Game Pass пополнит прошлогодняя Call of Duty: Modern Warfare 3 — пока ещё новейшая часть серии военных шутеров. Официальный анонс ожидается в самое ближайшее время — Хендерсон предположил, что он мог произойти 10 июля, потому как «таков был изначальный план с повышением цен и изменениями Xbox Game Pass». Ранее стало известно, что Microsoft повысит стоимость Xbox Game Pass Ultimate, PC Game Pass и Xbox Game Pass Core по всему миру, упразднит опцию оформить подписку Xbox Game Pass для консолей и введёт новый тариф без игр в день релиза. Согласно недавним слухам, в августе Game Pass пополнится сборником Crash Bandicoot N. Sane Trilogy, а вслед за ним в подписку добавят Spyro Reignited Trilogy и Tony Hawk’s Pro Skater 1 + 2. Game Pass за фиксированную плату предоставляет подписчикам доступ к широкой библиотеке инди-игр и блокбастеров, в том числе от самой Xbox. К середине февраля количество пользователей сервиса достигло 34 млн человек. Samsung представила смартфон Galaxy Z Flip6 Olympic Edition

10.07.2024 [21:57],

Владимир Фетисов

Сегодня компания Samsung провела в Париже очередное мероприятие Galaxy Unpacked, в рамках которого состоялся анонс ряда новинок, включая смартфоны с гибким дисплеем Galaxy Z Fold6 и Galaxy Z Flip6. Вместе с этим южнокорейский производитель анонсировал эксклюзивную версию Galaxy Z Flip6 Olympic Edition. Её получат все участники предстоящих Олимпийских и Паралимпийских игр, которые пройдут во Франции этим летом.

Источник изображений: Samsung В плане технических характеристик Galaxy Z Flip6 Olympic Edition полностью идентичен стандартной версии устройства. Однако его корпус окрашен в яркий жёлтый цвет, а комплект поставки также включает в себя тематический чехол. Любопытно, что Samsung дарит эксклюзивные смартфоны участникам Олимпийских игр с 2016 года, но в этом году спортсмены получат устройства ещё до официального их выхода на рынок.  Чтобы спортсмены могли использовать свои Galaxy Z Flip6 Olympic Edition сразу после получения, каждый смартфон оснащён eSIM с возможностью бесплатного использования 100 Гбайт данных в сетях 5G, которые предоставил оператор Orange. В дополнение к этому на смартфонах предустановлены приложения «Париж 2024» и Athlete 365, которое открывает доступ к закрытой социальной сети для спортсменов. Предустановленное приложение Samsung Wallet позволит получать бесплатные напитки в торговых автоматах, расположенных по всей Олимпийской и Паралимпийской деревне.  Не исключено, что позднее Galaxy Z Flip6 Olympic Edition поступит в свободную продажу, но без бонусов, которые будут предоставлены спортсменам. Аналогичным образом компания поступила со специальной версией Galaxy Z Flip3, которая была выпущена в честь Олимпийских игр в Пекине в 2022 году.  Участники Олимпийских и Паралимпийских игр 2024 года начнут получать Galaxy Z Flip6 Olympic Edition с 18 июля, за неделю до церемонии открытия соревнований. Микрогравитационный 3D-принтер нового поколения был успешно испытан во время суборбитального полёта Virgin Galactic 07

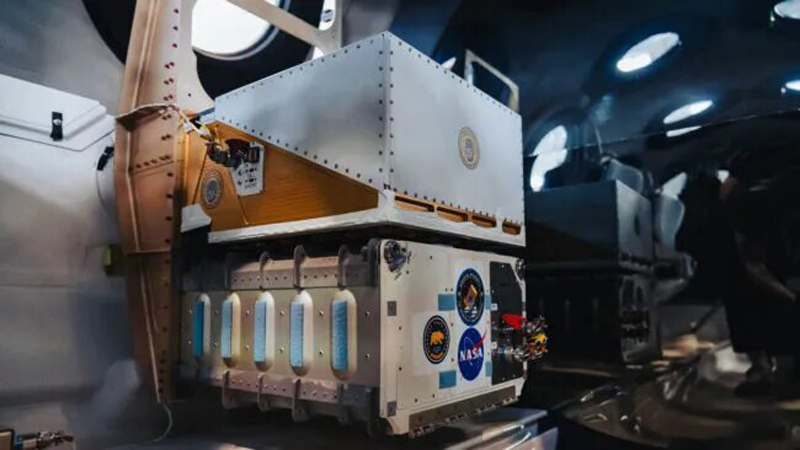

10.07.2024 [21:52],

Владимир Мироненко

8 июня состоялась миссия Virgin Galactic 07, основной целью которой был суборбитальный полёт на границу космоса туристов. Вместе с этим в ходе полёта были проведены испытания микрогравитационного 3D-принтера следующего поколения SpaceCAL. Тестирования прошло успешно, сообщили теперь разработчики аппарата.

Источник изображения: Virgin Galactic Во время 140-секундного пробного запуска SpaceCAL 3D напечатал четыре предмета из жидкого пластика PEGDA (полиэтиленгликоль диакрилат). Это были модели космических челноков и небольшие буксиры под названием Benchys, традиционно используемые в качестве эталона для оценки качества и производительности 3D-принтеров. «SpaceCAL хорошо показал себя в условиях микрогравитации в прошлых тестах в ходе параболических полётов, но было необходимо кое-что подтвердить», — сообщил Тейлор Уодделл (Taylor Waddell), научный сотрудник проекта. Он отметил, что испытания позволили проверить готовность этой технологии 3D-печати для космических путешествий. SpaceCAL 3D позволяет создавать сложные детали всего за 20 секунд. Это значительное улучшение по сравнению с другими принтерами, которым обычно требуются часы для создания аналогичных объектов. Согласно пресс-релизу, учёные также продемонстрировали универсальность системы, которая способна печатать предметы из более чем 60 различных материалов, включая силиконы, стеклянные композиты и различные биоматериалы. Способность эффективно работать в условиях микрогравитации, где многие другие 3D-принтеры сталкиваются с проблемами, делает SpaceCAL и CAL (наземный предшественник SpaceCAL) особенно перспективными для применения в освоении космоса. Среда с низкой гравитацией может дать 3D-печати преимущество, поскольку отсутствие гравитации сводит к минимуму проблемы, связанные с потоком и осаждением материала, улучшает некоторые свойства материала и предоставляет больше степеней свободы в дизайне объекта. Инди-студия анонсировала Black State — технологичный шпионский боевик в духе Metal Gear Solid с дверями-порталами из «Матрицы»

10.07.2024 [21:23],

Михаил Романов

Стамбульская студия Motion Blur посредством портала IGN представила Black State — одиночный шпионский боевик от третьего лица, сочетающий элементы из игр серии Metal Gear Solid и кинофраншизы «Матрица». По сюжету Black State секретная группировка Архитекторов призывает бывшего легендарного военного для выполнения таинственной миссии — спасти пленённого учёного и выяснить правду о некоем катаклизме. Основной особенностью Black State разработчики называют механику дверей-порталов, обеспечивающих бесшовные переходы между самыми разнообразными уровнями и гарантирующих непредсказуемость приключения. Помимо дверей-порталов, в трейлере показали проникновение на вражескую базу со стелсом в духе Metal Gear Solid (серией Konami в Motion Blur вдохновлялись наравне с The Last of Us и Uncharted), разнообразием оружия и гаджетов. Обещают захватывающий, полный поворотов сюжет, более 100 кинематографичных добиваний, динамичные и эпические битвы с боссами, «ультрафотореалистичную» графику на Unreal Engine 5 и «невероятную» оптимизацию. Скриншоты из трейлера Black State

Зрители трейлера Black State подметили скудный ИИ врагов и блёклый дизайн персонажей, но в целом остались впечатлены. «MGS встречает мастера ключей из второй "Матрицы"» — резюмировал superxpro12. Black State подтверждена эксклюзивно для ПК (заявлен релиз в Steam и Epic Games Store, но страницы пока не открылись) и на данном этапе не имеет даже примерных сроков выхода. THQ Nordic рассказала, как будет играться Titan Quest 2 — гибкая система развития, разнообразие геймплейных стилей и никаких микротранзакций

10.07.2024 [20:34],

Михаил Романов

Издательство THQ Nordic и немецкая студия Grimlore Games в новом дневнике разработки поделились дополнительными подробностями своего мифологического ролевого экшена Titan Quest 2. Titan Quest 2 позиционируется как классическая экшен-RPG с видом сверху, современной, но уходящей в традиции серии боевой системой, широким разнообразием врагов и эпическими сражениями против боссов. Основы игрового процесса Titan Quest 2:

Локациям в Titan Quest 2 присвоен тот или иной уровень, в соответствии с которым усиливаются враги и повышается качество предметов: продвижение по игре или повышение сложности напрямую вознаграждаются лучшей добычей. Комбинация оружия и брони (шесть элементов) в связке с разными вариантами мастерства открывают перед пользователем широкий выбор игровых стилей, а механика основных и дополнительных характеристик создаёт гибкую систему развития. Что ещё разработчики рассказали об игровом процессе Titan Quest 2:

Titan Quest 2 создаётся для PC (Steam), PS5, Xbox Series X и S. Геймплейный трейлер покажут 2 августа на THQ Nordic Digital Showcase 2024, а саму игру привезут на выставку gamescom 2024 в Кёльне, которая пройдёт с 21 по 25 августа. Представлена камера Sony ZV-E10 II — компактная беззеркалка для видеоблогеров за $1000

10.07.2024 [19:21],

Владимир Фетисов

Компания Sony официально представила камеру ZV-E10 II. Новинка является преемницей выпущенной в 2021 году модели ZV-E10, которая пользовалась большой популярностью среди блогеров и любителей. В новой камере Sony продолжила переносить функции с более дорогих камер на более доступные модели, но, как обычно, это не обходится без некоторых компромиссов.

Источник изображений: The Verge ZV-E10 II — это компактная беззеркальная камера с матрицей APS-C и сменной оптикой. Она получила более ёмкий аккумулятор по сравнению с предыдущей моделью, а также 26-мегапиксельный сенсор с обратной засветкой. Хотя цена ZV-E10 II значительно ниже стоимости кинематографической камеры FX30 за $1800, от которой новинка получила сенсор, она всё же на $200 дороже оригинальной ZV-E10. Новинка получила от своих полнокадровых собратьев аккумулятор NP-FZ100, благодаря чему значительно увеличилось время автономной работы. В дополнение к этому ZV-E10 II поддерживает съёмку 4K-видео на скорости до 60 кадров в секунду (4:2:0, 10 бит).  Хорошая автономность и высокое качество видеозаписи, несомненно, важнейшие качества камеры, ориентированной на съёмку длинных видеороликов. Тем не менее, чтобы реализовать это и сохранить компактные размеры ZV-E10 II, разработчикам пришлось пойти на некоторые компромиссы. К примеру, в новой камере отсутствует механический затвор, что делает её практически бесполезной при съёмке движущихся объектов. Кроме того, в ZV-E10 II нет встроенной оптической стабилизации изображения (отказ в пользу электронной стабилизации), по-прежнему нет видоискателя, а также отдельного ИИ-чипа, которые есть у более дорогих камер Sony. Таким образом, хотя ZV-E10 II и обладает превосходным автофокусом по сравнению с другими гибридными камерами, она ориентирована на видеоблогеров и запись длинных роликов. Как и предыдущие модели серии ZV, новинка отличается наличием простой системы сенсорного управления, а также поддержкой режима Cinematic Vlog для съёмки видео одним нажатием и автофокусировки Product Showcase (режим полной фокусировки для создания роликов в стиле YouTube, когда автор ролика показывает что-то перед собой).  Сама камера будет стоить в рознице $999 или $1099 в комплекте с новым объективом Sony PZ 16-50mm f/3.5-5.6 OSS II. Цена ZV-E10 II сопоставима с ценой флагманского смартфона, например, iPhone 15 Pro Max. Однако даже лучшая камера iPhone имеет сенсор в девять раз меньше матрицы APS-C в ZV-E10 II, поэтому смартфоны используют разные алгоритмы, чтобы пытаться конкурировать по качеству снимков и видео со специализированными камерами. Объявлены российские цены на складные смартфоны Galaxy Z Fold6, Flip6 и другие новинки Samsung

10.07.2024 [19:16],

Андрей Созинов

Сегодня Samsung представила множество новинок: складные смартфоны Galaxy Z Flip6 и Fold6, смарт-часы Galaxy Watch7 и Watch Ultra, наушники Galaxy Buds3 и Buds3 Pro, а также смарт-кольцо Galaxy Ring. Почти все эти новинки тут же стали доступны для предварительного заказа в России, а их продажи начнутся одновременно с остальным миром. Вместе с этим были раскрыты российские цены новинок.  О старте предзаказов объявила компании МТС. Период предзаказа на Galaxy Z Fold6, Galaxy Z Flip6 и Galaxy Watch7 продлится до 23 июля, после чего, 24 июля, новинки поступят в свободную продажу как в онлайн-магазине, так и в розничных точках МТС. Что интересно, МТС организовала эксклюзивный показ новых гаджетов Samsung в столице России, где посетители получили уникальную возможность ознакомиться с устройствами одновременно с мировой премьерой. Samsung Galaxy Z Fold6 предлагается в трех версиях с разным объёмом флеш-памяти:

Samsung Galaxy Z Flip6 доступен в двух конфигурациях:

Оба смартфона оснащены 12 Гбайт оперативной памяти. Fold6 предлагается в серой, розовой и синей расцветках, а Flip6 — в серой, голубой, мятной и желтой. В качестве бонуса первые покупатели новых смартфонов Samsung получат в подарок наушники Samsung Buds3 Pro. Что касается умных часов, для российских покупателей установлена следующая стоимость:

Galaxy Watch Ultra предлагаются в версиях серого, белого и чёрного цвета. Более компактная версия Galaxy Watch7 доступна в зеленом и серебристом цветах, а более крупная — в зеленом и белом золоте. Наконец, новые наушники от Samsung также представлены доступны для предзаказа в России:

Покупатели могут выбрать между серебристым и белым цветом. При покупке комплекта из Galaxy Watch Ultra и Galaxy Buds3 Pro предоставляется скидка в 10 000 рублей.  В конце добавим, что смарт-кольцо Galaxy Ring пока не доступно для предзаказа в России. Мировые продажи этого необычного гаджета начнутся 24 июля. Nintendo заинтриговала фанатов жутковатым тизером «взрослого» хоррора об «улыбающемся человеке»

10.07.2024 [18:37],

Михаил Романов

Японский издатель и разработчик Nintendo славится играми для всей семьи, однако, судя по загадочному тизеру в соцсетях платформодержателя, на этот раз компания готовит нечто другое. Портал Gematsu обратил внимание, что Nintendo выложила на своём YouTube-канале 15-секундный ролик под названием «Эмио» (Emio) — японская версия при этом именуется «Улыбающийся человек». В лаконичном видео на фоне звуков будто из музыкальной шкатулки можно увидеть мужчину в пальто с надетым на голову бумажным пакетом, на котором нарисовано улыбающееся лицо. Опубликованный тизер также включает логотип Nintendo Switch и упоминание «взрослого» возрастного рейтинга (Mature от ESRB, «18+» от PEGI), а в описании ролика задаются вопросом, кто такой этот Эмио. Пользователи и журналисты остались озадачены загадочным тизером от Nintendo. Мрачная атмосфера ролика намекает на хоррор, которые компания выпускает нечасто. Eurogamer также уверяет, что это не реклама следующей итерации Switch. Речь может идти о хорроре Project M (кодовое название), который польская Bloober Team до недавних пор разрабатывала совместно со студией Draw Distance (Serial Cleaners). Игра позиционируется как эксклюзив платформ Nintendo. «Мы работаем над [Project M] с одними из лучших творцов в мире для платформ Nintendo, поэтому не можем позволить себе сделать просто хорошую игру», — заявил глава Bloober Пётр Бабиено (Piotr Babieno) в недавнем интервью PAP Biznes. Сетевые приложения по всему миру оказались под угрозой взлома — разработана эффективная атака Blast-RADIUS

10.07.2024 [18:28],

Павел Котов

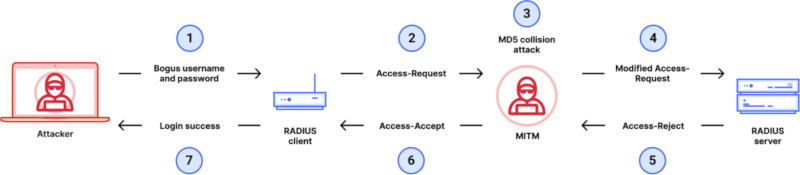

Международная группа исследователей в сфере кибербезопасности разработала схему атаки, которая позволяет взламывать RADIUS (Remote Authentication Dial-In User Service) — протокол аутентификации, который используется в сетевых приложениях по всему миру. Его слабым местом оказалась собственная реализация хеш-функции MD5.

Источник изображения: Pete Linforth / pixabay.com Протокол RADIUS был разработан в 1991 году компанией Livingston Enterprises и утверждён как официальный стандарт Инженерным советом интернета (IETF) в 1997 году. С 1994 года в RADIUS используется собственная реализация хеш-функции MD5. Эта функция, созданная в 1991 году и утверждённая IETF в 1992 году стала популярной при создании дайджестов сообщений — механизмов, при которых принимается произвольный набор данных (число, текст или файл), а на выход подаётся хеш — последовательность длиной 16 байт. Первоначально предполагалось, что потенциальный злоумышленник не сможет найти два набора исходных данных, которые на выходе давали бы один хеш. Но защита MD5 оказалась недостаточной, и функция более восприимчива к коллизиям, чем считалось ранее. В 2004 году это официально подтвердили (PDF) учёные Шаньдунского университета (Китай) Сяоюнь Ван (Xiaoyun Wang) и Хунбо Юй (Hongbo Yu); а три года спустя их теорию развили (PDF) в своей работе исследователи из Нидерландов и Швейцарии. Чтобы продемонстрировать потенциально разрушительные последствия предложенной ими атаки, европейские специалисты применили свою схему для создания двух криптографических сертификатов X.509 с одной и той же подписью MD5, но разными публичными ключами и содержимыми полей Distinguished Name. В результате такой коллизии центр сертификации может, намереваясь подписать сертификат для одного домена, неосознанно подписать его для другого, вредоносного. В 2008 году эти же учёные в рамках демонстрации создали мошеннический центр сертификации — он генерировал TLS-сертификаты, которым доверяли все основные браузеры. Ключевым компонентом атаки было разработанное исследователями приложение Hashclash, которое сейчас стало общедоступным.

Источник изображения: Cloudflare Новая схема атаки Blast-RADIUS (PDF) затрагивает все системы, в которых используется данный протокол. Она основывается на схеме атаки посредника (MITM-атаки), позволяя злоумышленнику получать администраторский доступ к устройствам, которые используют аутентификацию RADIUS на сервере. Разработанная в 2008 году схема атаки требует вычислительной мощности в размере 2800 ядро-дней, то есть эквивалента работы одного процессорного ядра в течение 2800 дней; а для Blast-RADIUS достаточно лишь 39 ядро-часов. Распределив нагрузку на кластер из 2000 ядер процессоров возрастом от 7 до 10 лет и четырёх низкопроизводительных видеокарт, исследователи сократили фактическое время атаки до пяти минут. Проанализировав расценки службы Amazon EC2, они установили, что превысить эти мощности достаточно ресурсов, арендованных за $50 в час, и эти ресурсы можно в дальнейшем масштабировать — с учётом того, что в системах на RADIUS время ожидания входа истекает всего за 30–60 секунд, угроза представляется вполне реалистичной. Единственный способ устранить уязвимость RADIUS — передавать данные по защищённым протоколам TLS или DTLS, и сейчас рабочая группа IETF занимается обновлением спецификации с учётом данного метода защиты. Но крупное обновление такого рода займёт очень много времени — месяцы или даже годы. Некоторые реализации RADIUS, в том числе от Microsoft, до сих пор не поддерживают TLS. Поэтому в качестве временного решения для окружений, где так и придётся передавать данные RADIUS по открытому протоколу UDP, предлагается внедрить атрибуты Message-Authenticator на основе механизма аутентификации пакетов HMAC-MD5 — соответствующие обновления уже предложили FreeRADIUS, Radiator, Cisco, Microsoft и Nokia. «Эта мера нарушает совместимость со старыми реализациями, которые могут не включать Message-Authenticators в запросы или ответы. Однако, в отличие от других вариантов, это не фундаментальное изменение протокола и может быть развёрнуто как простое обновление для клиентов и серверов», — предупреждают исследователи. Причём если отправитель включает Message-Authenticator при отправке данных, а принимающая сторона не требует этих атрибутов, уязвимость сохраняется — учёные указали два дополнительных сценария атак при такой схеме. Samsung представила наушники Galaxy Buds3 и Buds3 Pro с дизайном в стиле AirPods, ИИ и шумоподавлением

10.07.2024 [18:15],

Владимир Мироненко

Компания Samsung представила на мероприятии Galaxy Unpacked беспроводные наушники Samsung Galaxy Buds3 и Buds3 Pro, успевшие засветиться «вживую» ещё до анонса. Новые наушники получили обновлённые зарядные футляры, а также целый ряд функций искусственного интеллекта (ИИ).

Источник изображений: GSMArena.com В отличие от предыдущей модели Galaxy Buds 2 Pro, выполненной в форме боба, новинки получили ножки, как у AirPods, которые компания называет «лезвиями» (blades). «Лезвия» с сенсорными панелями поддерживают жестовое управление, с помощью чего можно управлять воспроизведением музыки и регулировать громкость. По краям «лезвий» у Buds3 Pro размещена светодиодная подсветка Blade Lights — небольшая полоска светодиодов, свечение которых можно регулировать в приложении Wearable. Samsung Galaxy Buds3 Pro оснащены двухполосными динамиками — плоскими высокочастотными динамиками диаметром 6,1 мм и динамическими драйверами диаметром 10,5 мм, дополненными двумя усилителями. Обновлённый кодек SSC теперь поддерживает удвоенную частоту дискретизации для улучшения качества звука.

Samsung Galaxy Buds3 и Galaxy Buds3 Pro Также у Galaxy Buds3 Pro имеется система активного шумоподавления (ANC) с микрофонами, постоянно контролирующими окружающую среду с помощью таких функций, как активный контроль шума, обнаружение сирены и обнаружение голоса. В двух последних случаях система воспроизведёт окружающий звук, чтобы пользователь мог отреагировать на происходящее. Модель машинного обучения устранит шум, доносящийся во время звонков со стороны собеседника, поскольку она обучена воссоздавать естественно звучащий голос, даже если звук исходит из шумной среды. Функция Super-Wideband обеспечивает воспроизведение голоса на частоте 16 кГц, что вдвое превышает возможности обычных Bluetooth-наушников.

Samsung Galaxy Buds3 Pro В свою очередь, наушники Galaxy Buds3 оснащены однополосными динамическими 11-мм драйверами и обладают открытой конструкцией, которая более удобна при длительном ношении. Также сообщается о функции адаптивного шумоподавления и адаптивном эквалайзере для регулировки звука в зависимости от факторов окружающей среды. Наушники получили обновлённые зарядные футляры с прозрачной верхней частью ёмкостью 515 мА·ч. Вместе с тем у Galaxy Buds3 Pro ёмкость батарей немного больше — 53 мА·ч в каждом наушнике, что обеспечивает при выключенной ANC до 7 часов воспроизведения музыки и до 30 часов с учётом использования зарядного футляра. При активированной ANC продолжительность автономной работы составляет 6 и 26 часов соответственно.

Samsung Galaxy Buds3 У модели Buds3 ёмкость батареи в каждом наушнике равна 48 мА·ч. Продолжительность автономной работы устройства составляет 5 часов с включённой ANC или до 24 часов с учётом использования футляра и 6 часов/30 часов с выключенной системой ANC. Обе модели наушников поддерживают возможность перевода речи с помощью Galaxy AI: в режиме прослушивания пользователь сможет слушать лекцию на иностранном языке с синхронным переводом с помощью телефона Galaxy и наушников на родной язык. По защите от влаги и пыли обе модели соответствуют стандарту IP57. Новинки выпускаются в двух цветах: серебристом и белом. Компания подчеркнула, что корпус наушников изготовлен из переработанного пластика из использованных рыболовных сетей и ёмкостей для воды. Уже сегодня на устройства можно оформить предзаказ с поставкой 24 июля. Стоимость Samsung Galaxy Buds3 Pro составляет $250, цена Galaxy Buds3 — $180. Samsung представила флагманские смарт-часы Galaxy Watch Ultra с рекордной автономностью до 100 часов

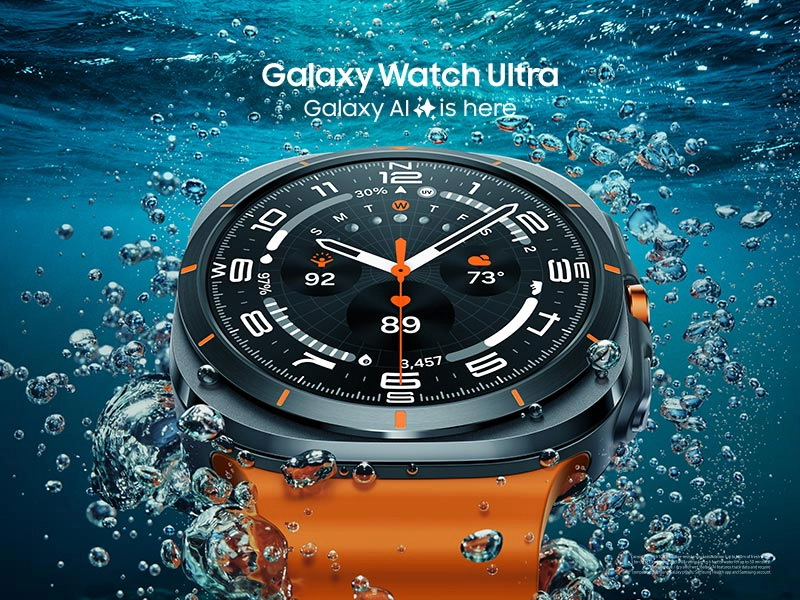

10.07.2024 [18:10],

Николай Хижняк

Помимо Galaxy Watch7 компания Samsung сегодня также представила флагманские смарт-часы Galaxy Watch Ultra. Производитель называет новинку самой мощной в линейке, поскольку она вобрала в себя все достижения и широкую функциональность этой серии устройств. Galaxy Watch Ultra будут выпускаться только в одном размере титанового корпуса, 47 мм, и будут доступны в версиях серого, белого и чёрного цвета.

Источник изображений: Samsung Часы получили 1,5-дюймовый дисплей Super AMOLED с разрешением 480 × 480 пикселей и яркостью 3000 кд/м2, защищённый сапфировым стеклом. В основе устройства используется новейший 5-ядерный процессор Exynos W1000, производящийся с применением 3-нм техпроцесса. Как и Galaxy Watch7, новые смарт-часы Galaxy Watch Ultra получили 2 Гбайт оперативной и 32 Гбайт постоянной памяти.  Ёмкость батареи Galaxy Watch Ultra составляет 590 мА·ч. Новинка поддерживает беспроводную зарядку WPC. Разработчик отмечает, что модель Galaxy Watch Ultra может похвастаться самым продолжительным временем автономной работы во всей линейке устройств Galaxy Watch: до 100 часов в режиме экономии энергии и 48 часов в режиме энергосбережения во время тренировок.   Для устройства заявляются сертификаты защиты IP68 и MIL-STD-810H, а также водонепроницаемость до 10 ATM. В них можно плавать в солёной воде. Кроме того, они могут выдерживать температуру от -20 до +55 °C и работают в более широком диапазоне высот: от 500 метров ниже уровня моря до 9 тысяч метров над уровнем моря.  Galaxy Watch Ultra оснащены тем же набором датчиков Samsung BioActive (оптический датчик биосигнала, электрический датчик ритма сердца и анализ биоэлектрического импеданса), что и модели Galaxy Watch7. Модель Ultra также получила датчик температуры, акселерометр, барометр, гироскоп, геомагнитный датчик и датчик освещённости. Есть поддержка LTE, Bluetooth 5.3, Wi-Fi 2,4+5 ГГц, NFC, GPS (L1+L5)/Glonass/Beidou/Galileo.  Samsung отмечает, что Galaxy Watch Ultra оснащены кнопкой быстрого действия. Она позволяет мгновенно запустить нужную функцию, начать тренировку, проконтролировать текущие параметры, а также настроить другие функции в соответствии с личными предпочтениями.  Также часы имеют функцию определения падения, которая автоматически распознаёт, когда пользователь упал, и вызывает помощь. Кроме того, Galaxy Watch Ultra предлагают настраиваемую функцию персональной зоны пульса, благодаря которой можно тренироваться с оптимальным уровнем интенсивности в зависимости от физических возможностей.  Стоимость смарт-часов Galaxy Watch Ultra составляет €699 или $650. |